I det här inlägget demonstrerar vi Kubeflow på AWS (en AWS-specifik distribution av Kubeflow) och värdet det tillför över Kubeflow med öppen källkod genom integrationen av högt optimerade, molnbaserade, företagsklara AWS-tjänster.

Kubeflow är plattformen för maskininlärning med öppen källkod (ML) som är dedikerad till att göra implementeringar av ML-arbetsflöden på Kubernetes enkla, bärbara och skalbara. Kubeflow tillhandahåller många komponenter, inklusive en central instrumentpanel, Jupyter-datorer för flera användare, Kubeflow Pipelines, KFServing och Katib, samt distribuerade utbildningsoperatörer för TensorFlow, PyTorch, MXNet och XGBoost, för att bygga enkla, skalbara och portabla ML-arbetsflöden .

AWS lanserade nyligen Kubeflow v1.4 som en del av sin egen Kubeflow-distribution (kallad Kubeflow på AWS), som effektiviserar datavetenskapliga uppgifter och hjälper till att bygga mycket tillförlitliga, säkra, portabla och skalbara ML-system med minskade driftskostnader genom integrationer med AWS-hanterade tjänster . Du kan använda den här Kubeflow-distributionen för att bygga ML-system ovanpå Amazon Elastic Kubernetes-tjänst (Amazon EKS) för att bygga, träna, ställa in och distribuera ML-modeller för en mängd olika användningsfall, inklusive datorseende, naturlig språkbehandling, talöversättning och finansiell modellering.

Utmaningar med öppen källkod Kubeflow

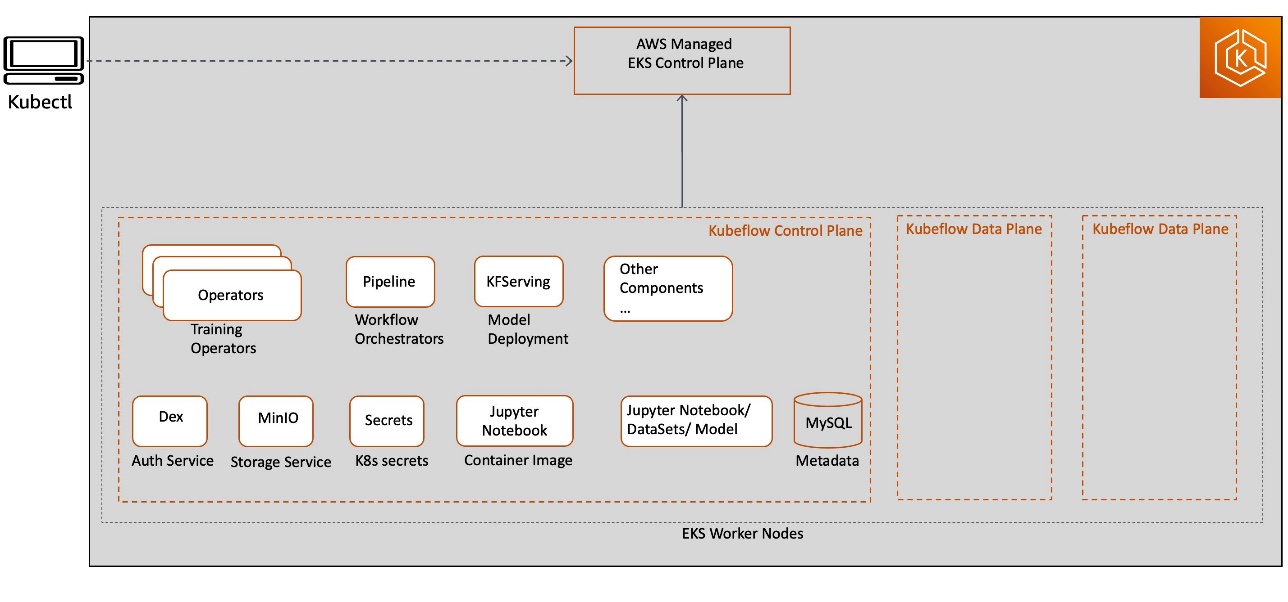

När du använder ett Kubeflow-projekt med öppen källkod distribuerar det alla Kubeflow-kontrollplans- och dataplanskomponenter på Kubernetes-arbetsnoder. Kubeflow-komponenttjänster distribueras som en del av Kubeflow-kontrollplanet, och alla resursdistributioner relaterade till Jupyter, modellträning, inställning och hosting distribueras på Kubeflow-dataplanet. Kubeflow-kontrollplanet och dataplanet kan köras på samma eller olika Kubernetes-arbetarnoder. Det här inlägget fokuserar på komponenter i Kubeflow-kontrollplanet, som illustreras i följande diagram.

Den här implementeringsmodellen kanske inte ger en företagsklar upplevelse av följande skäl:

- Alla Kubeflow-kontrollplanets tunga lyftinfrastrukturkomponenter, inklusive databas, lagring och autentisering, distribueras i själva Kubernetes klusterarbetarnod. Detta gör det utmanande att implementera en högtillgänglig Kubeflow-styrplansdesignarkitektur med ett beständigt tillstånd i händelse av fel på arbetarnod.

- Kubeflow-kontrollplansgenererade artefakter (som MySQL-instanser, podloggar eller MinIO-lagring) växer över tiden och behöver ändra storlek på lagringsvolymer med kontinuerliga övervakningsmöjligheter för att möta det växande lagringsbehovet. Eftersom Kubeflow-kontrollplanet delar resurser med Kubeflow-dataplanets arbetsbelastningar (till exempel för utbildningsjobb, pipelines och distributioner), kan rätt storlek och skalning av Kubernetes-kluster- och lagringsvolymer bli utmanande och resultera i ökade driftskostnader.

- Kubernetes begränsar loggfilens storlek, med de flesta installationer som håller den senaste gränsen på 10 MB. Som standard blir podloggarna otillgängliga efter att de når denna övre gräns. Loggarna kan också bli otillgängliga om pods vräkas, kraschar, raderas eller schemaläggs på en annan nod, vilket kan påverka tillgängligheten och övervakningsmöjligheterna för din applikationslogg.

Kubeflow på AWS

Kubeflow på AWS ger en tydlig väg att använda Kubeflow, med följande AWS-tjänster:

- Application Load Balancer för säker extern trafikhantering över HTTPS

- amazoncloudwatch för ihållande logghantering

- AWS Cognito för användarautentisering med Transport Layer Security (TLS)

- AWS Deep Learning-behållare för mycket optimerade Jupyter notebook-serverbilder

- Amazon Elastic File System (Amazon EFS) eller Amazon FSx för Luster för en enkel, skalbar och serverlös fillagringslösning för ökad träningsprestanda

- Amazon EKS för hanterade Kubernetes-kluster

- Amazon Relational Databas Service (Amazon RDS) för mycket skalbara pipelines och ett metadatalager

- AWS Secrets Manager för att skydda hemligheter som behövs för att komma åt dina applikationer

- Amazon enkel lagringstjänst (Amazon S3) för en lättanvänd butik med pipelineartefakter

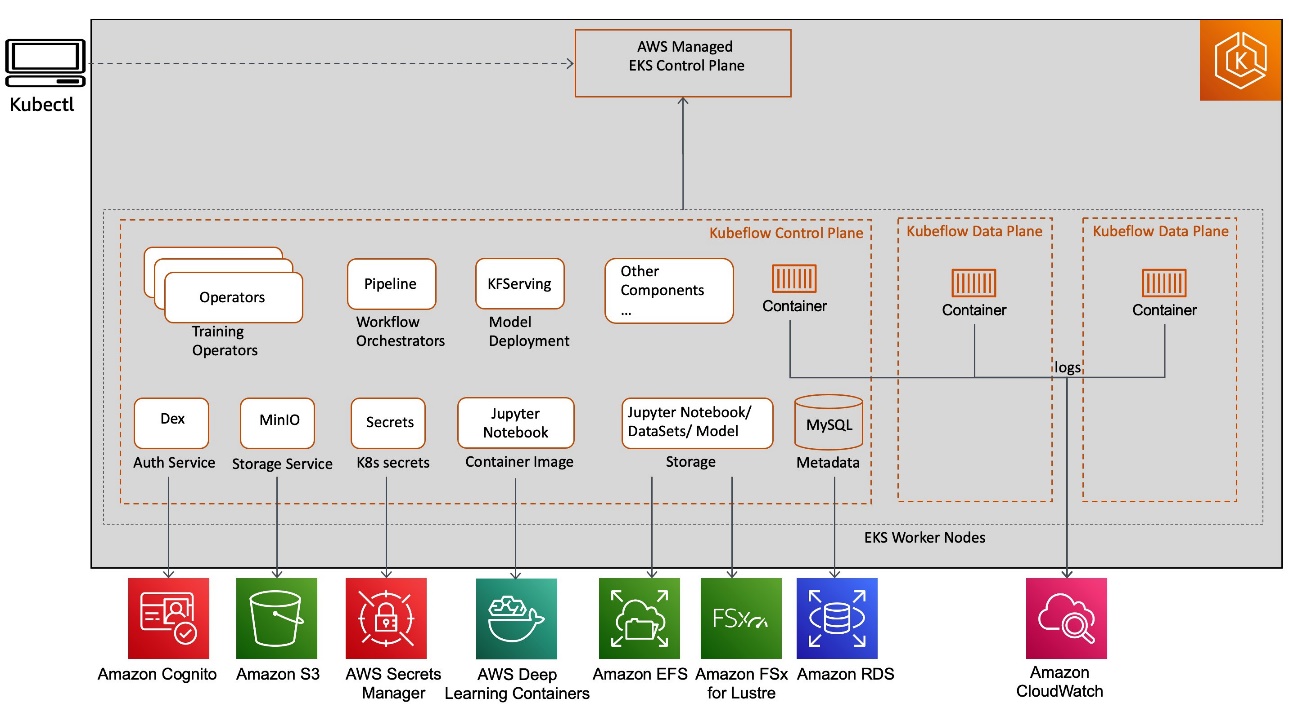

Dessa AWS-tjänstintegrationer med Kubeflow (som visas i följande diagram) tillåter oss att koppla bort kritiska delar av Kubeflows kontrollplan från Kubernetes, vilket ger en säker, skalbar, motståndskraftig och kostnadsoptimerad design.

Låt oss diskutera fördelarna med varje tjänsteintegrering och deras lösningar kring säkerhet, körning av ML-pipelines och lagring.

Säker autentisering av Kubeflow-användare med Amazon Cognito

Molnsäkerhet hos AWS har högsta prioritet, och vi investerar i att tätt integrera Kubeflow-säkerhet direkt i AWS säkerhetstjänster med delat ansvar, som följande:

- Application Load Balancer (ALB) för extern trafikledning

- AWS certifikathanterare (ACM) för att stödja TLS

- IAM -roller för servicekonton (IRSA) för finkornig åtkomstkontroll på Kubernetes Pod-nivå

- AWS nyckelhanteringstjänst (AWS KMS) för datakrypteringsnyckelhantering

- AWS-sköld för DDoS-skydd

I det här avsnittet fokuserar vi på AWS Kubeflow-styrplansintegration med Amazon Cognito. Amazon Cognito tar bort behovet av att hantera och underhålla en inbyggd Dex-lösning (open-source OpenID Connect (OIDC) med stöd av lokal LDAP)-lösning för användarautentisering och gör hemlig hantering enklare.

Du kan också använda Amazon Cognito för att lägga till användarregistrering, inloggning och åtkomstkontroll till ditt Kubeflow-gränssnitt snabbt och enkelt. Amazon Cognito skalas till miljontals användare och stöder inloggning med sociala identitetsleverantörer (IdPs), som Facebook, Google och Amazon, och företags IdPs via SAML 2.0. Detta minskar komplexiteten i din Kubeflow-installation, vilket gör den operativt smidig och enklare att använda för att uppnå isolering för flera användare.

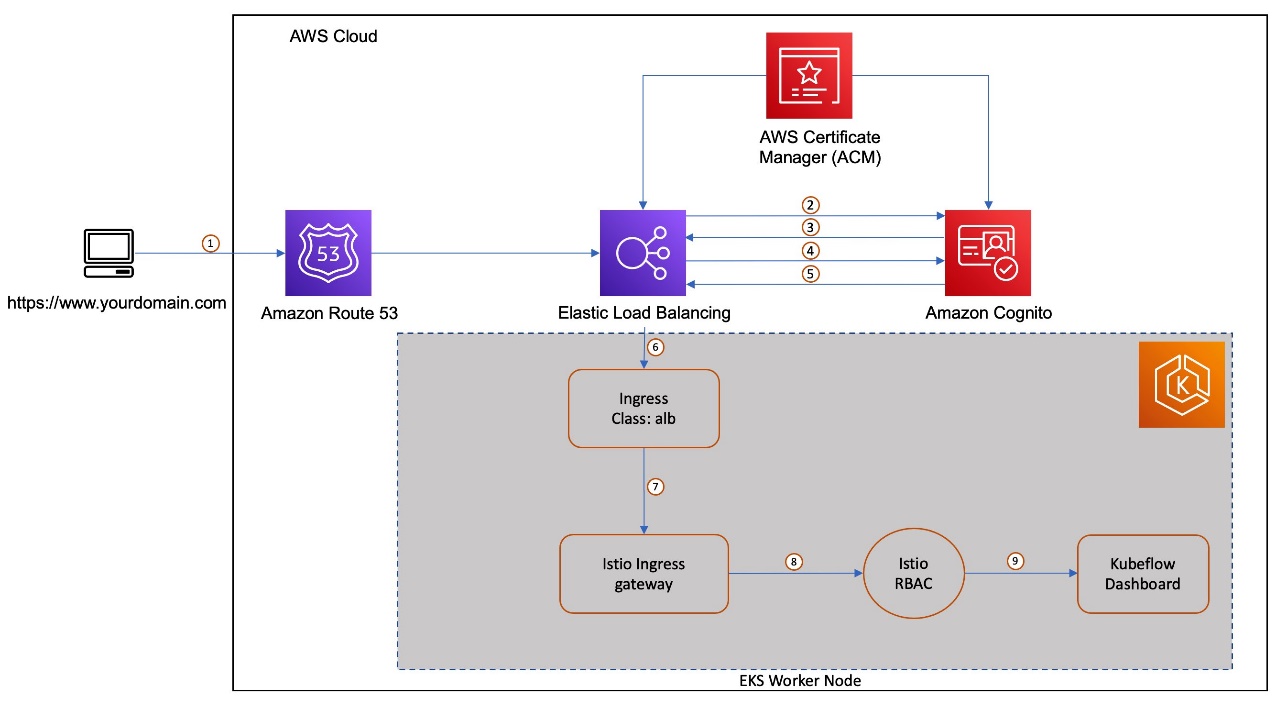

Låt oss titta på ett autentiseringsflöde för flera användare med Amazon Cognito, ALB och ACM-integrationer med Kubeflow på AWS. Det finns ett antal nyckelkomponenter som en del av denna integration. Amazon Cognito är konfigurerat som en IdP med en autentiseringsåteruppringning konfigurerad för att dirigera begäran till Kubeflow efter användarautentisering. Som en del av Kubeflow-inställningen skapas en Kubernetes ingångsresurs för att hantera extern trafik till Istio Gateway-tjänsten. AWS ALB Ingress Controller tillhandahåller en lastbalanserare för det inträdet. Vi använder Amazon väg 53 för att konfigurera en offentlig DNS för den registrerade domänen och skapa certifikat med ACM för att aktivera TLS-autentisering vid lastbalanseraren.

Följande diagram visar det typiska användararbetsflödet för att logga in på Amazon Cognito och bli omdirigerad till Kubeflow i deras respektive namnutrymme.

Arbetsflödet innehåller följande steg:

- Användaren skickar en HTTPS-begäran till Kubeflows centrala instrumentpanel bakom en lastbalanserare. Väg 53 löser FQDN till ALB-aliasposten.

- Om cookien inte finns, omdirigerar lastbalanseraren användaren till Amazon Cognito-auktoriseringsslutpunkten så att Amazon Cognito kan autentisera användaren.

- Efter att användaren har autentiserats skickar Amazon Cognito användaren tillbaka till lastbalanseraren med en auktoriseringskod.

- Lastbalanseraren presenterar auktoriseringskoden till Amazon Cognito-tokens slutpunkt.

- När Amazon Cognito har fått en giltig auktoriseringskod tillhandahåller ID-token och åtkomsttoken till lastbalanseraren.

- När din belastningsutjämnare har autentiserat en användare, skickar den åtkomsttoken till Amazon Cognito användarinformationsslutpunkt och tar emot användaranspråk. Lastbalanseraren signerar och lägger till användaranspråk i HTTP-huvudet

x-amzn-oidc-*i ett förfrågningsformat för JSON-webtoken (JWT). - Begäran från lastbalanseraren skickas till Istio Ingress Gateways pod.

- Med hjälp av ett envoy-filter avkodar Istio Gateway

x-amzn-oidc-datavärde, hämtar e-postfältet och lägger till den anpassade HTTP-huvudetkubeflow-userid, som används av Kubeflow-auktoriseringslagret. - Istio-resursbaserade åtkomstkontrollprinciper tillämpas på den inkommande begäran för att validera åtkomsten till Kubeflow Dashboard. Om någon av dessa är otillgänglig för användaren skickas ett felsvar tillbaka. Om begäran valideras vidarebefordras den till lämplig Kubeflow-tjänst och ger tillgång till Kubeflow Dashboard

Beständig Kubeflow-komponents metadata och artefaktlagring med Amazon RDS och Amazon S3

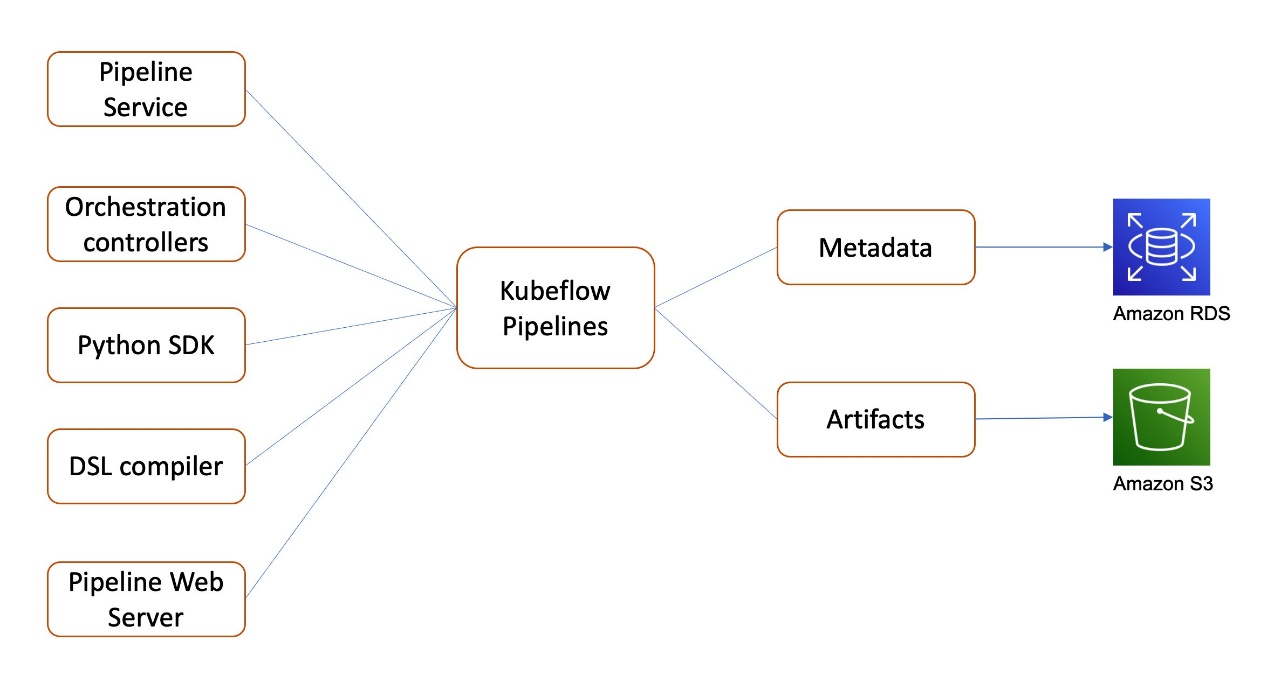

Kubeflow på AWS ger integration med Amazon Relational Databas Service (Amazon RDS) i Kubeflow Pipelines och AutoML (Sekreterare) för beständig metadatalagring och Amazon S3 i Kubeflow Pipelines för beständig artefaktlagring. Låt oss fortsätta att diskutera Kubeflow Pipelines mer i detalj.

Kubeflow Pipelines är en plattform för att bygga och distribuera bärbara, skalbara ML-arbetsflöden. Dessa arbetsflöden kan hjälpa till att automatisera komplexa ML-pipelines med inbyggda och anpassade Kubeflow-komponenter. Kubeflow Pipelines inkluderar Python SDK, en DSL-kompilator för att konvertera Python-kod till en statisk konfiguration, en Pipelines-tjänst som kör pipelines från den statiska konfigurationen och en uppsättning kontroller för att köra behållarna i Kubernetes Pods som behövs för att slutföra pipelinen.

Kubeflow Pipelines-metadata för pipelineexperiment och körningar lagras i MySQL, och artefakter inklusive pipelinepaket och mätvärden lagras i MinIO.

Som visas i följande diagram låter Kubeflow på AWS dig lagra följande komponenter med AWS-hanterade tjänster:

- Pipeline-metadata i Amazon RDS – Amazon RDS tillhandahåller en skalbar, högtillgänglig och pålitlig multi-AZ-distributionsarkitektur med en inbyggd automatiserad failover-mekanism och storleksändringsbar kapacitet för en industristandardiserad relationsdatabas som MySQL. Den hanterar vanliga databasadministrationsuppgifter utan att behöva tillhandahålla infrastruktur eller underhålla programvara.

- Rörledningsartefakter i Amazon S3 – Amazon S3 erbjuder branschledande skalbarhet, datatillgänglighet, säkerhet och prestanda, och kan användas för att möta dina krav på överensstämmelse.

Dessa integrationer hjälper till att avlasta hanteringen och underhållet av metadata och artefaktlagring från självhanterade Kubeflow till AWS-hanterade tjänster, vilket är lättare att konfigurera, driva och skala.

Stöd för distribuerade filsystem med Amazon EFS och Amazon FSx

Kubeflow bygger på Kubernetes, som tillhandahåller en infrastruktur för storskalig, distribuerad databehandling, inklusive utbildning och justering av stora modeller med ett djupt nätverk med miljontals eller till och med miljarder parametrar. För att stödja sådana distribuerade ML-system för databehandling tillhandahåller Kubeflow på AWS integration med följande lagringstjänster:

- Amazon EFS – Ett högpresterande, molnbaserat, distribuerat filsystem, som du kan hantera genom ett Amazon EFS CSI-drivrutin. Amazon EFS tillhandahåller

ReadWriteManyåtkomstläge, och du kan nu använda det för att montera i pods (Jupyter, modellträning, modellinställning) som körs i ett Kubeflow-dataplan för att tillhandahålla en beständig, skalbar och delbar arbetsyta som automatiskt växer och krymper när du lägger till och tar bort filer med inget behov av förvaltning. - Amazon FSx för Luster – Ett optimerat filsystem för datorintensiva arbetsbelastningar, såsom högpresterande datorer och ML, som du kan hantera genom Amazon FSx CSI-drivrutin. FSx för Luster tillhandahåller

ReadWriteManyåtkomstläge också, och du kan använda det för att cachelagra träningsdata med direkt anslutning till Amazon S3 som stödlager, som du kan använda för att stödja Jupyter notebook-servrar eller distribuerad träning som körs i ett Kubeflow-dataplan. Med den här konfigurationen behöver du inte överföra data till filsystemet innan du använder volymen. FSx for Luster ger konsekventa fördröjningar på under millisekunder och hög samtidighet, och kan skalas till TB/s av genomströmning och miljontals IOPS.

Distributionsalternativ för Kubeflow

AWS tillhandahåller olika Kubeflow-distributionsalternativ:

- Implementering med Amazon Cognito

- Implementering med Amazon RDS och Amazon S3

- Implementering med Amazon Cognito, Amazon RDS och Amazon S3

- Vanilj utplacering

Mer information om tjänstintegrering och tillgängliga tillägg för vart och ett av dessa alternativ finns i Distributionsalternativ. Du kan passa det alternativ som bäst passar ditt användningsfall.

I följande avsnitt går vi igenom stegen för att installera AWS Kubeflow v1.4-distribution på Amazon EKS. Sedan använder vi det befintliga XGBoost-pipelineexemplet som finns på Kubeflows centrala UI-instrumentpanel för att demonstrera integrationen och användningen av AWS Kubeflow med Amazon Cognito, Amazon RDS och Amazon S3, med Secrets Manager som tillägg.

Förutsättningar

För detta genomgång bör du ha följande förutsättningar:

- An AWS-konto.

- Ett befintligt Amazon EKS-kluster. Det bör vara Kubernetes version 1.19 eller senare. För automatiskt skapande av kluster med hjälp av exctl, Se Skapa ett Amazon EKS-kluster och använd alternativet eksctl.

Installera följande verktyg på klientdatorn som används för att komma åt ditt Kubernetes-kluster. Du kan använda AWS Cloud9, en molnbaserad integrerad utvecklingsmiljö (IDE) för Kubernetes-klusterinstallationen.

- AWS-kommandoradsgränssnitt (AWS CLI) – Ett kommandoradsverktyg för att interagera med AWS-tjänster. För installationsanvisningar, se Installera, uppdatera och avinstallera AWS CLI.

- exctl > 0.56 – Ett kommandoradsverktyg för att arbeta med Amazon EKS-kluster som automatiserar många individuella uppgifter.

- kubectl – Ett kommandoradsverktyg för att arbeta med Kubernetes-kluster.

- gå – En distribuerad versionskontrollprogramvara.

- Python 3.8+ – Python-programmeringsmiljön.

- pip – Pakethanteraren för Python.

- kustomize version 3.2.0 – Ett kommandoradsverktyg för att anpassa Kubernetes-objekt genom en kustomiseringsfil.

Installera Kubeflow på AWS

Konfigurera kubectl så att du kan ansluta till ett Amazon EKS-kluster:

Olika kontroller i Kubeflow-distribution används IAM -roller för servicekonton (IRSA). En OIDC-leverantör måste finnas för att ditt kluster ska kunna använda IRSA. Skapa en OIDC-leverantör och associera den med för ditt Amazon EKS-kluster genom att köra följande kommando, om ditt kluster inte redan har ett:

Klona AWS-manifestrepo och Kubeflow-manifestrepo och kolla in respektive releasegrenar:

För mer information om dessa versioner, se Releaser och versionshantering.

Konfigurera Amazon RDS, Amazon S3 och Secrets Manager

Du skapar Amazon RDS- och Amazon S3-resurser innan du distribuerar Kubeflow-manifesterna. Vi använder automatiserade Python-skript som tar hand om att skapa S3-hinken, RDS-databasen och nödvändiga hemligheter i Secrets Manager. Den redigerar också de nödvändiga konfigurationsfilerna för Kubeflow-pipeline och AutoML för att vara korrekt konfigurerade för RDS-databasen och S3-bucket under Kubeflow-installationen.

Skapa en IAM-användare med behörighet att tillåta GetBucketLocation och läs- och skrivåtkomst till objekt i en S3-hink där du vill lagra Kubeflow-artefakterna. Använd AWS_ACCESS_KEY_ID och AWS_SECRET_ACCESS_KEY av IAM-användaren i följande kod:

Ställ in Amazon Cognito som autentiseringsleverantör

I det här avsnittet skapar vi en anpassad domän i Route 53 och ALB för att dirigera extern trafik till Kubeflow Istio Gateway. Vi använder ACM för att skapa ett certifikat för att möjliggöra TLS-autentisering hos ALB och Amazon Cognito för att underhålla användarpoolen och hantera användarautentisering.

Ersätt följande värden i

- route53.rootDomain.name – Den registrerade domänen. Låt oss anta att denna domän är det

example.com. - route53.rootDomain.hostedZoneId – Om din domän hanteras i Route53, ange värdzons-ID som finns under värdzonsinformationen. Hoppa över det här steget om din domän hanteras av en annan domänleverantör.

- route53.subDomain.name – Namnet på underdomänen där du vill vara värd för Kubeflow (till exempel,

platform.example.com). För mer information om underdomäner, se Implementera Kubeflow med AWS Cognito som IdP. - kluster.namn – Klustrets namn och var Kubeflow distribueras.

- kluster.region – Klusterregionen där Kubeflow distribueras (till exempel,

us-west-2). - cognitoUserpool.name – Namnet på Amazon Cognito-användarpoolen (till exempel,

kubeflow-users).

Konfigurationsfilen ser ut ungefär som följande kod:

Kör skriptet för att skapa resurserna:

Skriptet uppdaterar config.yaml fil med resursnamn, ID och ARN som den skapade. Det ser ut ungefär som följande kod:

Bygg manifest och distribuera Kubeflow

Distribuera Kubeflow med följande kommando:

Uppdatera domänen med ALB-adressen

Implementeringen skapar en ingresshanterad AWS-applikationsbelastningsbalanserare. Vi uppdaterar DNS-posterna för underdomänen i Route 53 med DNS för lastbalanseraren. Kör följande kommando för att kontrollera om lastbalanseraren är försedd (detta tar cirka 3–5 minuter):

Om ADDRESS fältet är tomt efter några minuter, kontrollera loggarna för alb-ingress-controller. För instruktioner, se ALB underlåter att tillhandahålla.

När belastningsutjämnaren tillhandahålls kopierar du DNS-namnet på belastningsutjämnaren och ersätter adressen kubeflow.alb.dns in ${kubeflow_manifest_dir}/tests/e2e/utils/cognito_bootstrap/config.yaml. Kubeflow-sektionen i konfigurationsfilen ser ut som följande kod:

Kör följande skript för att uppdatera DNS-posterna för underdomänen i Route 53 med DNS för den tillhandahållna lastbalanseraren:

Felsökning

Om du stöter på några problem under installationen, se felsökningsguide eller börja på nytt genom att följa avsnittet "Städa upp" i den här bloggen.

Användningsfall genomgång

Nu när vi har slutfört installationen av de nödvändiga Kubeflow-komponenterna, låt oss se dem i aktion med hjälp av ett av de befintliga exemplen från Kubeflow Pipelines på instrumentpanelen.

Få tillgång till Kubeflow Dashboard med Amazon Cognito

För att komma igång, låt oss få tillgång till Kubeflow Dashboard. Eftersom vi använde Amazon Cognito som IdP, använd informationen i officiella README-fil. Vi skapar först några användare på Amazon Cognito-konsolen. Det är dessa användare som kommer att logga in på den centrala instrumentpanelen. Nästa, skapa en profil för användaren du skapade. Då ska du kunna komma åt instrumentpanelen via inloggningssidan på https://kubeflow.platform.example.com.

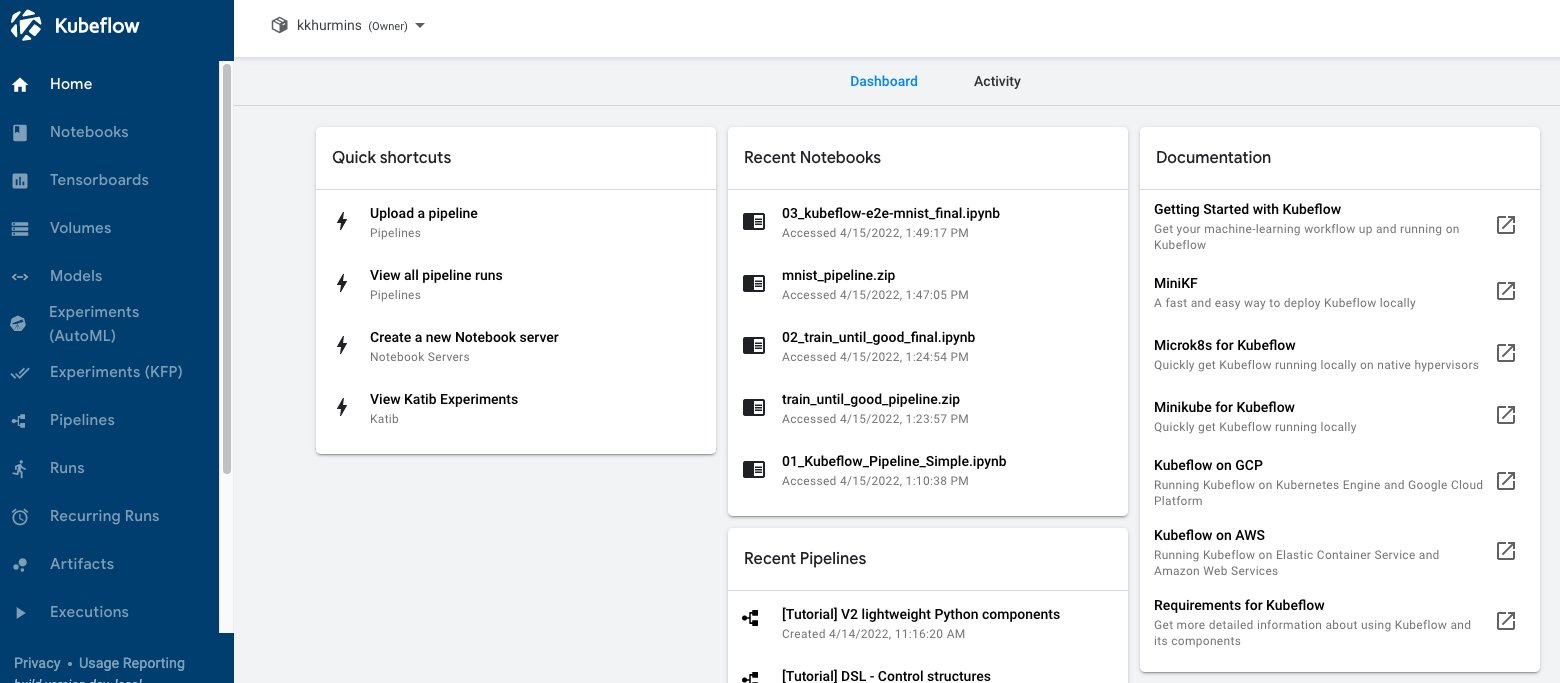

Följande skärmdump visar vår Kubeflow Dashboard.

Kör rörledningen

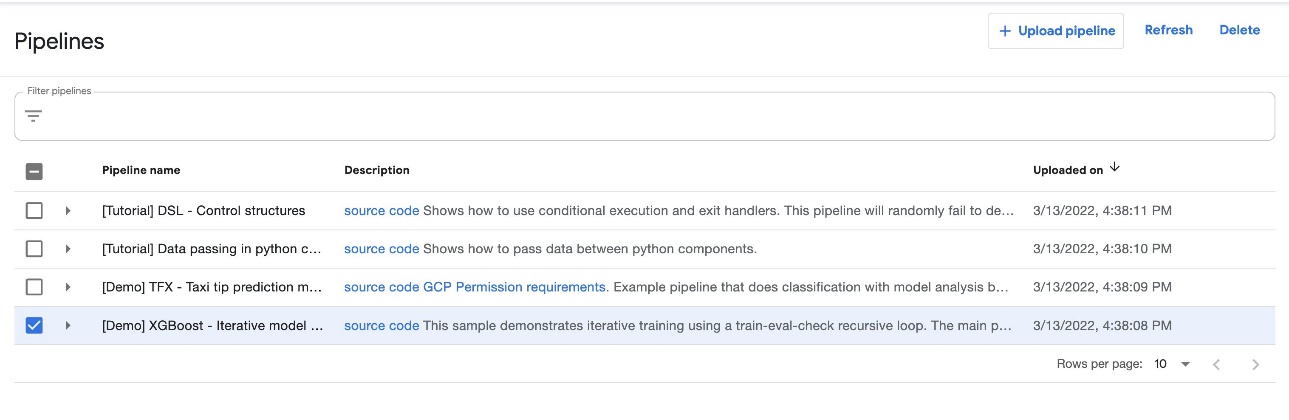

Välj på Kubeflow Dashboard Rörledningar i navigeringsnamnet. Du bör se fyra exempel från Kubeflow Pipelines som du kan köra direkt för att utforska olika Pipelines-funktioner.

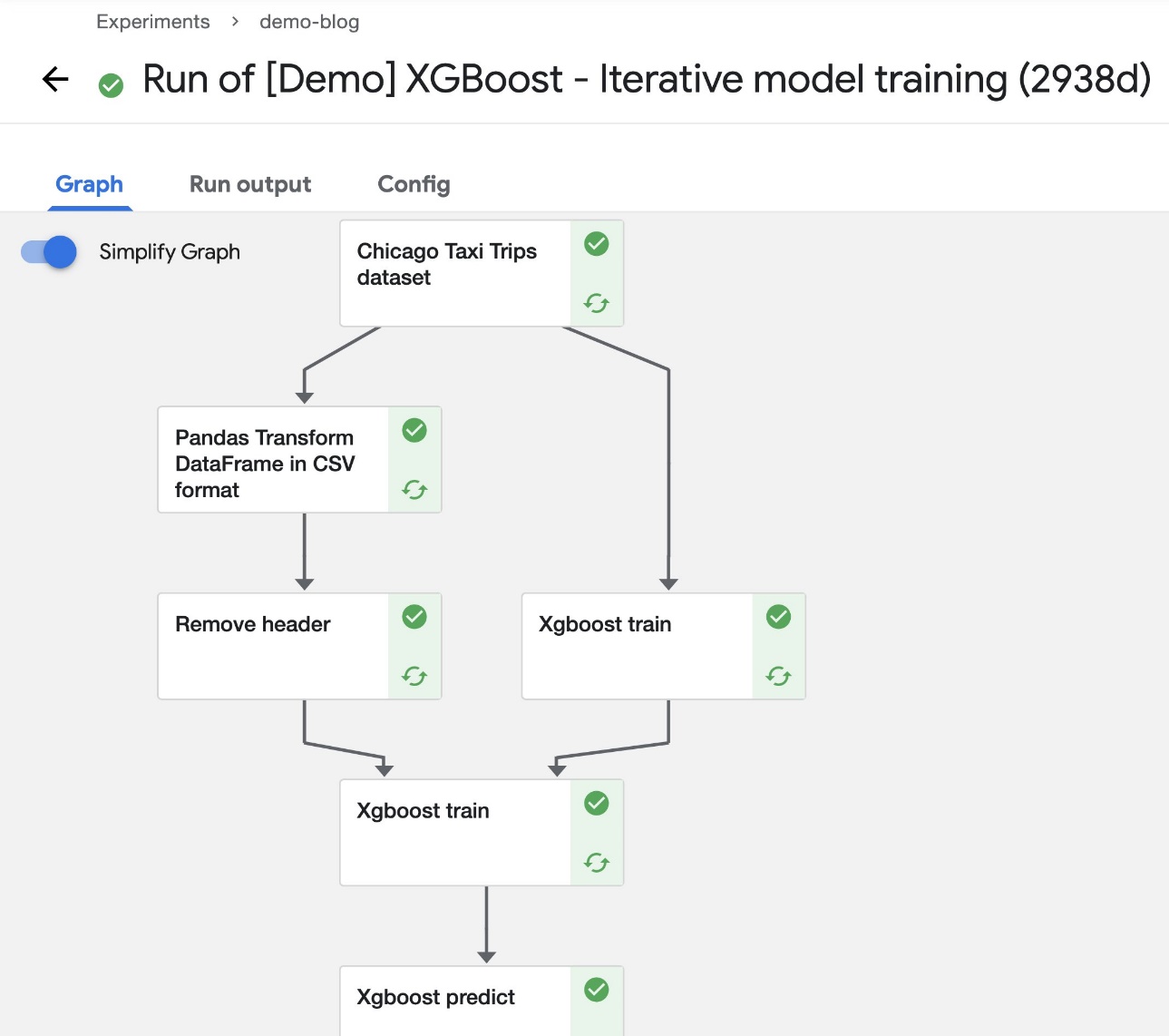

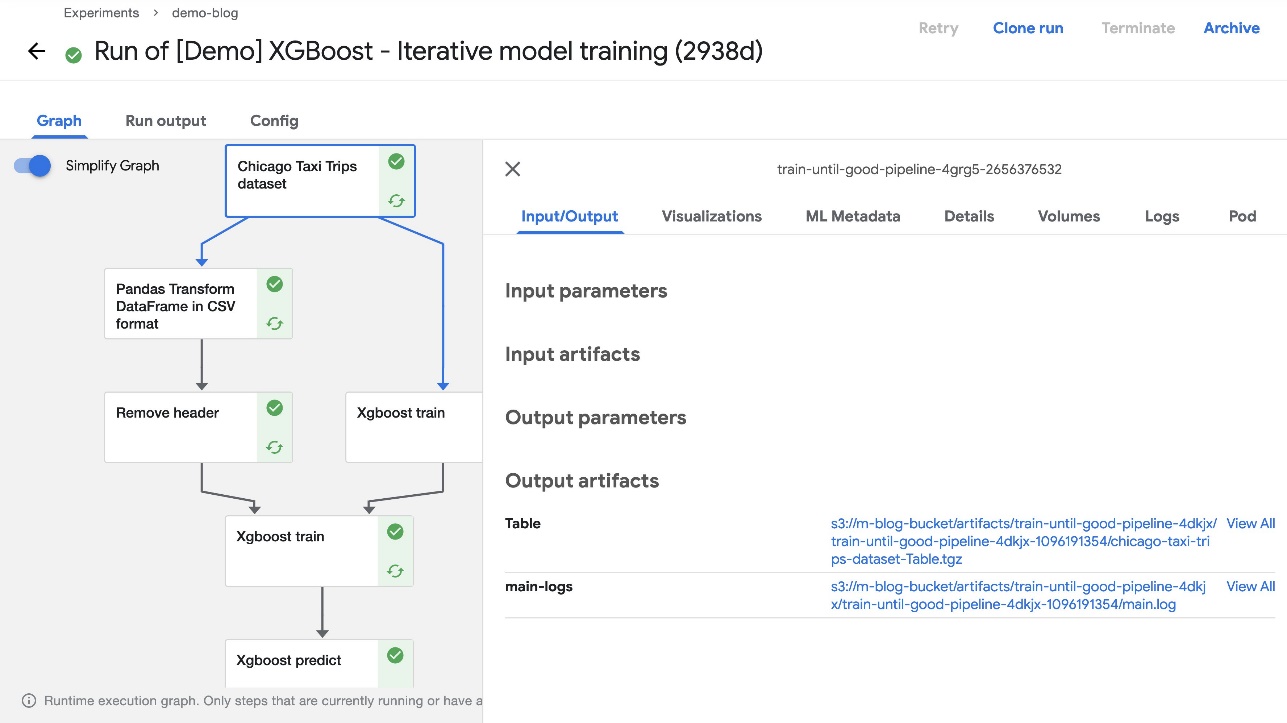

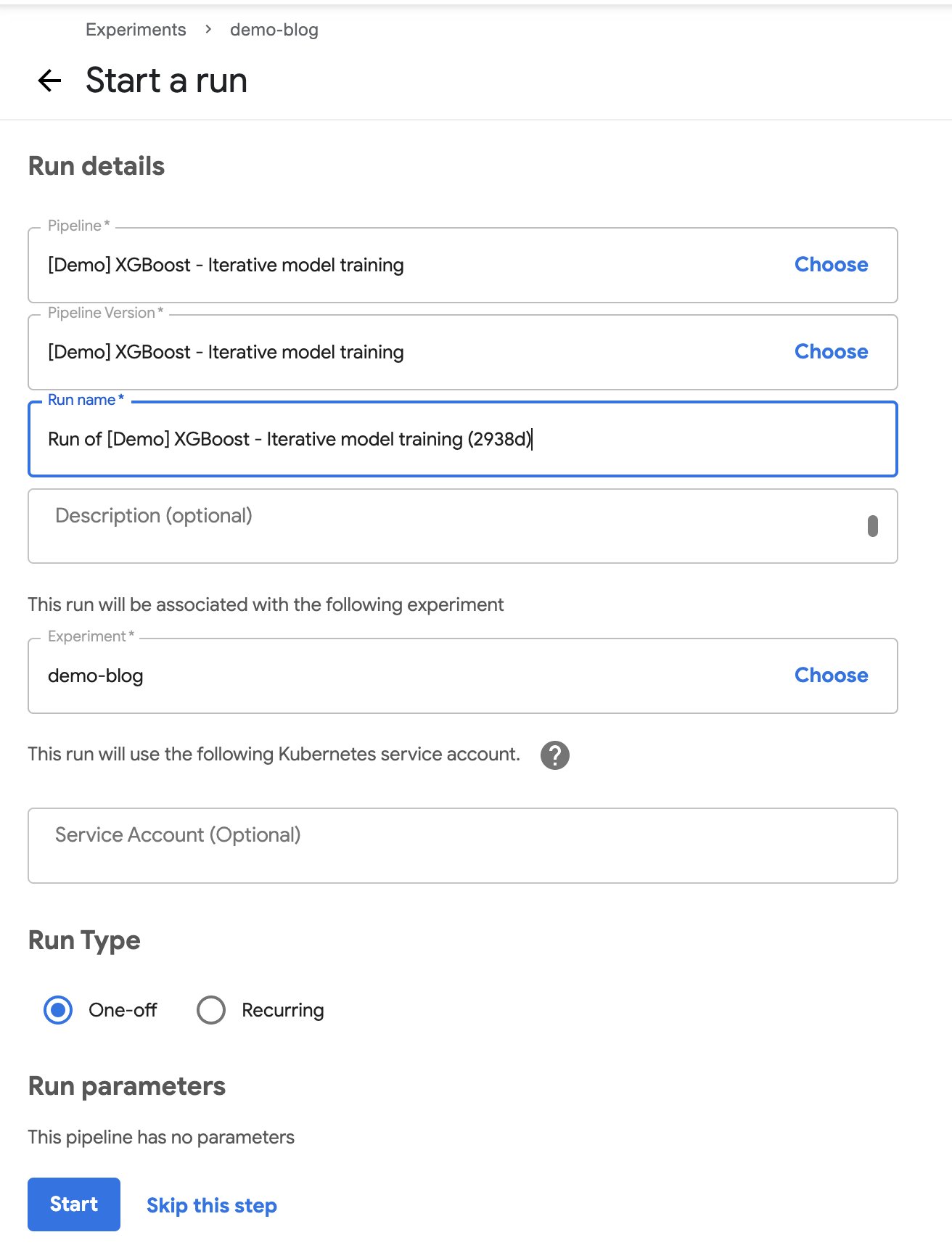

För det här inlägget använder vi XGBoost-exemplet som heter [Demo] XGBoost – Iterativ modellträning. Du hittar källkoden på GitHub. Detta är en enkel pipeline som använder det befintliga XGBoost/Train och XGBoost/Predict Kubeflow pipeline-komponenter för att iterativt träna en modell tills mätvärdena anses vara bra baserat på specificerade mätvärden.

Utför följande steg för att köra pipeline:

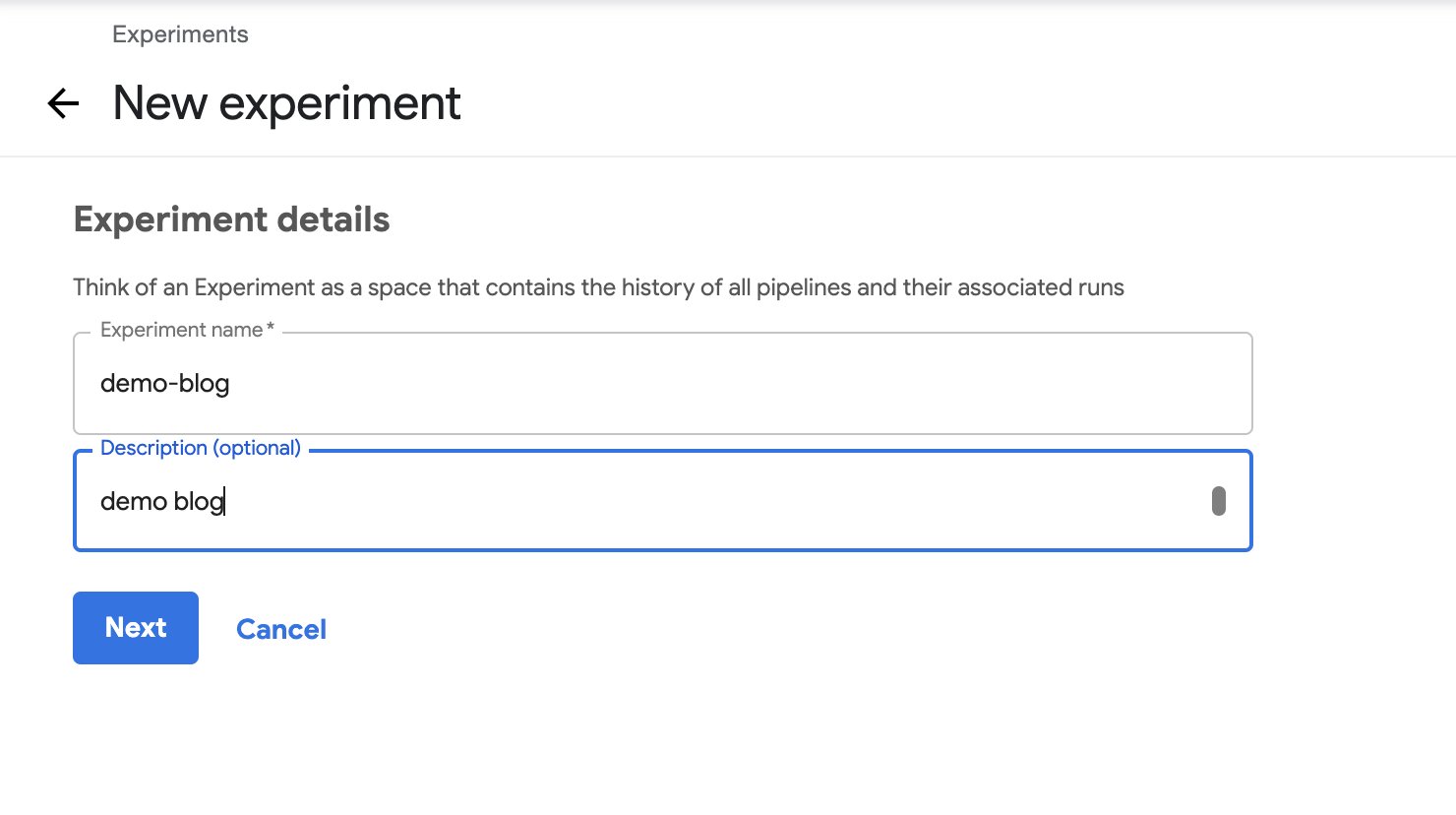

- Välj pipeline och välj Skapa experiment.

- Enligt Experimentdetaljer, ange ett namn (för det här inlägget,

demo-blog) och valfri beskrivning. - Välja Nästa.

- Enligt Kör detaljer¸ välj din pipeline och pipelineversion.

- För Kör namn, ange ett namn.

- För Experiment, välj det experiment du skapade.

- För Kör typ, Välj Engång.

- Välja Start.

Efter att pipelinen börjar köras bör du se komponenter som slutförs (inom några sekunder). I det här skedet kan du välja vilken som helst av de färdiga komponenterna för att se mer detaljer.

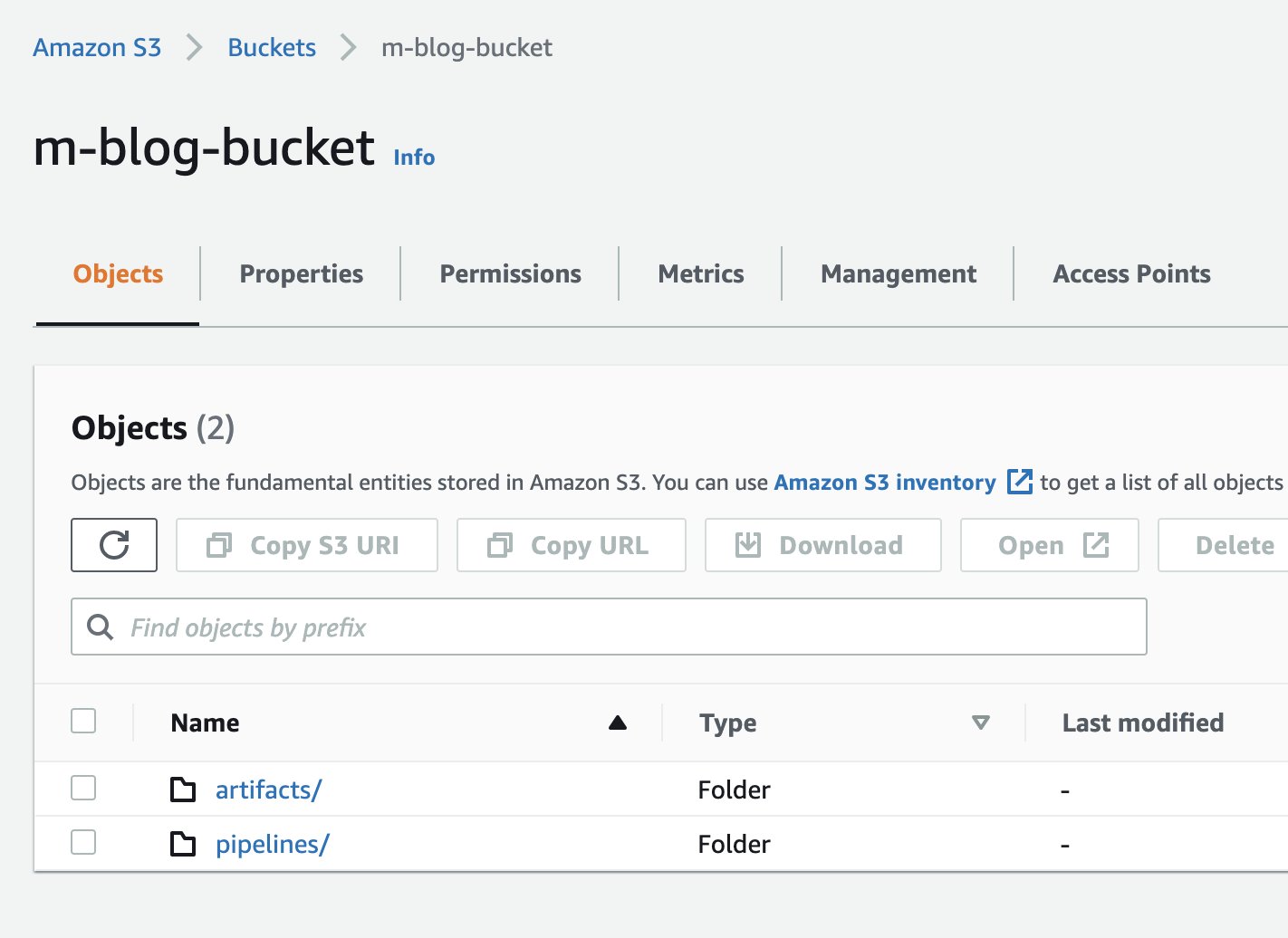

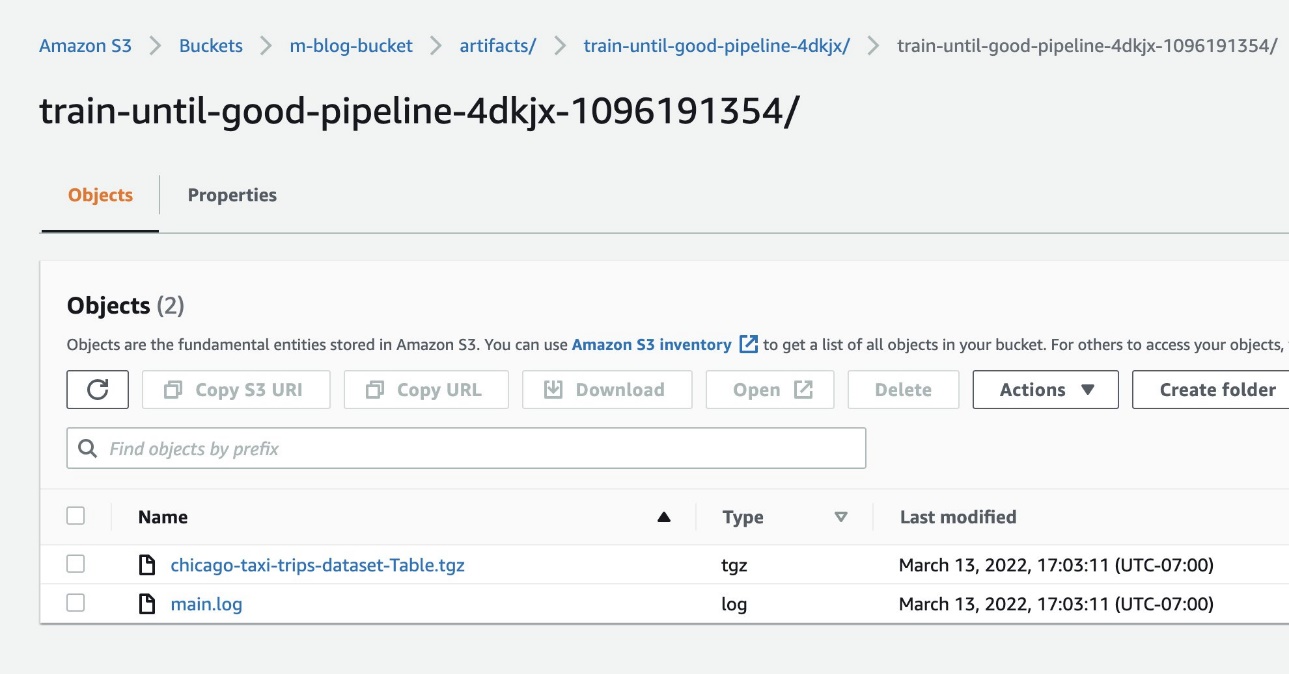

Få tillgång till artefakterna i Amazon S3

När vi distribuerade Kubeflow angav vi att Kubeflow Pipelines skulle använda Amazon S3 för att lagra dess artefakter. Detta inkluderar alla pipelineutdataartefakter, cachade körningar och pipelinegrafer – som alla sedan kan användas för rika visualiseringar och prestandautvärdering.

När pipelinekörningen är klar bör du kunna se artefakterna i S3-hinken som du skapade under installationen. För att bekräfta detta, välj valfri färdig komponent i pipelinen och kontrollera Input / Output avsnitt om standard Diagrammet flik. Artefaktadresserna bör peka på S3-bucket som du angav under distributionen.

För att bekräfta att resurserna har lagts till Amazon S3 kan vi också kontrollera S3-hinken i vårt AWS-konto via Amazon S3-konsolen.

Följande skärmdump visar våra filer.

Verifiera ML-metadata i Amazon RDS

Vi integrerade även Kubeflow Pipelines med Amazon RDS under distributionen, vilket innebär att all pipeline-metadata bör lagras i Amazon RDS. Detta inkluderar all körtidsinformation som status för en uppgift, tillgänglighet av artefakter, anpassade egenskaper associerade med körningen eller artefakterna och mer.

För att verifiera Amazon RDS-integration, följ stegen i officiella README-fil. Närmare bestämt, slutför följande steg:

- Få Amazon RDS användarnamn och lösenord från hemligheten som skapades under installationen:

- Använd dessa referenser för att ansluta till Amazon RDS från klustret:

- När MySQL-prompten öppnas kan vi verifiera

mlpipelinesdatabas enligt följande: - Nu kan vi läsa innehållet i specifika tabeller för att se till att vi kan se metadatainformation om experimenten som körde pipelines:

Städa upp

För att avinstallera Kubeflow och ta bort AWS-resurserna du skapade, utför följande steg:

- Ta bort ingress- och ingresshanterade lastbalanserare genom att köra följande kommando:

- Ta bort resten av Kubeflow-komponenterna:

- Ta bort AWS-resurserna som skapats av skript:

- Resurser skapade för Amazon RDS och Amazon S3 integration. Se till att du har konfigurationsfilen som skapats av skriptet i

${kubeflow_manifest_dir}/tests/e2e/utils/rds-s3/metadata.yaml: - Resurser skapade för Amazon Cognito-integration. Se till att du har konfigurationsfilen som skapats av skriptet i

${kubeflow_manifest_dir}/tests/e2e/utils/cognito_bootstrap/config.yaml:

- Resurser skapade för Amazon RDS och Amazon S3 integration. Se till att du har konfigurationsfilen som skapats av skriptet i

- Om du skapade ett dedikerat Amazon EKS-kluster för Kubeflow med hjälp av eksctl, kan du ta bort det med följande kommando:

Sammanfattning

I det här inlägget lyfte vi fram värdet som Kubeflow på AWS ger genom inbyggda AWS-hanterade tjänsteintegrationer för säkra, skalbara och företagsklara AI- och ML-arbetsbelastningar. Du kan välja mellan flera distributionsalternativ för att installera Kubeflow på AWS med olika tjänsteintegrationer. Användningsfallet i det här inlägget visade Kubeflow-integrering med Amazon Cognito, Secrets Manager, Amazon RDS och Amazon S3. För att komma igång med Kubeflow på AWS, se de tillgängliga AWS-integrerade distributionsalternativen i Kubeflow på AWS.

Från och med v1.3 kan du följa AWS Labs arkiv för att spåra alla AWS-bidrag till Kubeflow. Du hittar oss också på Kubeflow #AWS Slack Channel; din feedback där hjälper oss att prioritera nästa funktioner för att bidra till Kubeflow-projektet.

Om författarna

Kanwaljit Khurmi är en AI/ML Specialist Solutions Architect på Amazon Web Services. Han arbetar med AWS-produkten, teknik och kunder för att ge vägledning och teknisk assistans som hjälper dem att förbättra värdet av sina hybrid-ML-lösningar när de använder AWS. Kanwaljit är specialiserat på att hjälpa kunder med container- och maskininlärningsapplikationer.

Kanwaljit Khurmi är en AI/ML Specialist Solutions Architect på Amazon Web Services. Han arbetar med AWS-produkten, teknik och kunder för att ge vägledning och teknisk assistans som hjälper dem att förbättra värdet av sina hybrid-ML-lösningar när de använder AWS. Kanwaljit är specialiserat på att hjälpa kunder med container- och maskininlärningsapplikationer.

Meghna Baijal är en mjukvaruingenjör med AWS AI, vilket gör det enklare för användare att integrera sina maskininlärningsarbetsbelastningar på AWS genom att bygga ML-produkter och plattformar som Deep Learning Containers, Deep Learning AMIs, AWS Controllers for Kubernetes (ACK) och Kubeflow på AWS . Utanför jobbet tycker hon om att läsa, resa och syssla med att måla.

Meghna Baijal är en mjukvaruingenjör med AWS AI, vilket gör det enklare för användare att integrera sina maskininlärningsarbetsbelastningar på AWS genom att bygga ML-produkter och plattformar som Deep Learning Containers, Deep Learning AMIs, AWS Controllers for Kubernetes (ACK) och Kubeflow på AWS . Utanför jobbet tycker hon om att läsa, resa och syssla med att måla.

Suraj Kota är en mjukvaruingenjör specialiserad på maskininlärningsinfrastruktur. Han bygger verktyg för att enkelt komma igång och skala arbetsbelastningen för maskininlärning på AWS. Han arbetade med AWS Deep Learning Containers, Deep Learning AMI, SageMaker Operators for Kubernetes och andra integrationer med öppen källkod som Kubeflow.

Suraj Kota är en mjukvaruingenjör specialiserad på maskininlärningsinfrastruktur. Han bygger verktyg för att enkelt komma igång och skala arbetsbelastningen för maskininlärning på AWS. Han arbetade med AWS Deep Learning Containers, Deep Learning AMI, SageMaker Operators for Kubernetes och andra integrationer med öppen källkod som Kubeflow.

- Myntsmart. Europas bästa bitcoin- och kryptobörs.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. FRI TILLGÅNG.

- CryptoHawk. Altcoin radar. Gratis provperiod.

- Källa: https://aws.amazon.com/blogs/machine-learning/build-and-deploy-a-scalable-machine-learning-system-on-kubernetes-with-kubeflow-on-aws/

- "

- 10

- 100

- 420

- 7

- Om oss

- tillgång

- Konto

- Handling

- Tillägg

- adress

- administration

- administrering

- affiliates

- AI

- Alla

- redan

- amason

- Amazon Web Services

- Annan

- Ansökan

- tillämpningar

- lämpligt

- arkitektur

- runt

- Associate

- authenticated

- verifierar

- Autentisering

- tillstånd

- automatisera

- Automatiserad

- automatiserar

- tillgänglighet

- tillgänglig

- AWS

- blir

- Fördelarna

- BÄST

- miljarder

- Blogg

- gränsen

- SLUTRESULTAT

- Byggnad

- bygger

- inbyggd

- kapacitet

- Kapacitet

- vilken

- fall

- CD

- certifikat

- certifikat

- utmanande

- Till Kassan

- Välja

- hävdar

- klass

- koda

- Gemensam

- fullborda

- komplex

- komponent

- dator

- databehandling

- konfiguration

- Kontakta

- Anslutningar

- Konsol

- Behållare

- innehåller

- innehåll

- fortsätta

- bidra

- kontroll

- styrenhet

- upphovsrätt

- kunde

- skapa

- skapas

- skapar

- Skapa

- skapande

- referenser

- kritisk

- beställnings

- Kunder

- instrumentbräda

- datum

- databehandling

- datavetenskap

- Databas

- DDoS

- dedicerad

- Efterfrågan

- demonstrera

- demonstreras

- distribuera

- utplacerade

- utplacera

- utplacering

- distributioner

- vecklas ut

- Designa

- detalj

- detaljer

- Utveckling

- Dex

- olika

- rikta

- direkt

- diskutera

- distribueras

- fördelning

- dns

- inte

- domän

- lätt

- LÄTTANVÄND

- missar

- möjliggöra

- kryptering

- Slutpunkt

- ingenjör

- Teknik

- ange

- Företag

- Miljö

- utvärdering

- händelse

- exempel

- befintliga

- erfarenhet

- experimentera

- utforska

- Misslyckande

- Funktioner

- återkoppling

- finansiella

- Förnamn

- passa

- flöda

- Fokus

- fokuserar

- följer

- efter

- format

- hittade

- färsk

- få

- gå

- GitHub

- god

- Väx

- Odling

- hjälpa

- hjälpa

- hjälper

- här.

- Hög

- högre

- Markerad

- höggradigt

- värd

- HTTPS

- Hybrid

- Identitet

- Inverkan

- genomföra

- förbättra

- Inc.

- innefattar

- Inklusive

- ökat

- individuellt

- branschledande

- info

- informationen

- Infrastruktur

- installera

- integrerade

- integrering

- integrationer

- investera

- isolering

- problem

- IT

- sig

- Lediga jobb

- hålla

- Nyckel

- Labs

- språk

- Large

- lanserades

- inlärning

- lyft

- linje

- läsa in

- lokal

- Maskinen

- maskininlärning

- bibehålla

- GÖR

- Framställning

- hantera

- förvaltade

- ledning

- chef

- Metrics

- miljoner

- ML

- modell

- modeller

- övervakning

- mer

- mest

- namn

- Natural

- Navigering

- netto

- nät

- noder

- anteckningsbok

- antal

- Erbjudanden

- öppet

- öppen källkod

- öppnas

- operatörer

- optimerad

- Alternativet

- Tillbehör

- Övriga

- egen

- Lösenord

- prestanda

- plattform

- Plattformar

- Punkt

- Strategier

- poolen

- presentera

- prioritet

- bearbetning

- Produkt

- Produkter

- Programmering

- projektet

- skydda

- ge

- ger

- tillhandahålla

- allmän

- snabbt

- nå

- Läsning

- skäl

- post

- registrerat

- frigöra

- begära

- Obligatorisk

- Krav

- resurs

- Resurser

- respons

- REST

- Rutt

- Körning

- rinnande

- skalbarhet

- skalbar

- Skala

- skalning

- Vetenskap

- sDK

- SEC

- sekunder

- säkra

- säkerhet

- Server

- service

- Tjänster

- in

- inställning

- aktier

- Tecken

- Enkelt

- Storlek

- slak

- sova

- So

- Social hållbarhet

- Mjukvara

- Programvara ingenjör

- fast

- lösning

- Lösningar

- några

- något

- källkod

- specialist

- specialiserad

- specialiserat

- specifikt

- Etapp

- starta

- igång

- startar

- Ange

- status

- förvaring

- lagra

- Framgångsrikt

- stödja

- Stöder

- system

- System

- uppgifter

- Teknisk

- källan

- Genom

- tid

- token

- verktyg

- verktyg

- topp

- spår

- trafik

- Utbildning

- överföring

- Översättning

- transport

- Traveling

- ui

- Uppdatering

- Uppdateringar

- us

- användning

- användare

- validerade

- värde

- mängd

- olika

- verifiera

- syn

- volym

- webb

- webbservice

- VEM

- inom

- utan

- Arbete

- arbetade

- arbetssätt

- fungerar