Amazon SageMaker Ground Truth Plus hjälper dig att förbereda högkvalitativa utbildningsdatauppsättningar genom att ta bort de odifferentierade tunga lyften som är förknippade med att bygga datamärkningsapplikationer och hantera märkningspersonalen. Allt du gör är att dela data tillsammans med märkningskrav, och Ground Truth Plus ställer in och hanterar ditt arbetsflöde för datamärkning baserat på dessa krav. Därifrån märker en expertarbetare som är utbildad i en mängd olika maskininlärningsuppgifter (ML) dina data. Du behöver inte ens djup ML-expertis eller kunskap om arbetsflödesdesign och kvalitetshantering för att använda Ground Truth Plus. Nu betjänar Ground Truth Plus kunder som behöver datamärkning och mänsklig feedback för att finjustera grundmodeller för generativa AI-applikationer.

I det här inlägget kommer du att lära dig om de senaste framstegen inom mänsklig feedback för generativ AI tillgänglig via SageMaker Ground Truth Plus. Detta inkluderar nya arbetsflöden och användargränssnitt (UI) tillgängliga för att förbereda demonstrationsdatauppsättningar som används vid övervakad finjustering, insamling av högkvalitativ mänsklig feedback för att skapa preferensdatauppsättningar för att anpassa generativa AI-grundmodeller med mänskliga preferenser, samt anpassa modeller till applikationsbyggare krav på stil, substans och röst.

Utmaningar med att komma igång med generativ AI

Generativa AI-applikationer runt om i världen innehåller både enkelläges- och multimodala grundmodeller för att lösa många olika användningsfall. Vanliga bland dem är chatbots, bildgeneratorer och videogeneratorer. Stora språkmodeller (LLM) används i chatbots för kreativa sysselsättningar, akademiska och personliga assistenter, affärsinformationsverktyg och produktivitetsverktyg. Du kan använda text-till-bild-modeller för att skapa abstrakt eller realistisk AI-konst och marknadsföringstillgångar. Text-till-video-modeller används för att generera videor för konstprojekt, mycket engagerande annonser, videospelsutveckling och till och med filmutveckling.

Två av de viktigaste problemen att lösa för både modelltillverkare som skapar grundmodeller och applikationsbyggare som använder befintliga generativa grundmodeller för att bygga sina egna verktyg och applikationer är:

- Finjustera dessa grundmodeller för att kunna utföra specifika uppgifter

- Justera dem med mänskliga preferenser för att säkerställa att de ger användbar, korrekt och ofarlig information

Grundmodeller är vanligtvis förtränade på stora korpus av omärkta data och fungerar därför inte bra genom att följa instruktionerna för naturligt språk. För en LLM betyder det att de kanske kan analysera och generera språk i allmänhet, men de kanske inte kan svara på frågor konsekvent eller sammanfatta text upp till en användares önskade kvalitet. Till exempel, när en användare begär en sammanfattning av en text i en prompt, kan en modell som inte har finjusterat hur man sammanfattar text bara recitera uppmaningstexten tillbaka till användaren eller svara med något irrelevant. Om en användare ställer en fråga om ett ämne, kan svaret från en modell bara vara en recitation av frågan. För multimodala modeller, som text-till-bild- eller text-till-video-modeller, kan modellerna mata ut innehåll som inte är relaterat till prompten. Till exempel, om en företagsgrafisk designer uppmanar en text-till-bild-modell att skapa en ny logotyp eller en bild för en annons, kanske modellen inte genererar en relevant grafik relaterad till uppmaningen om den bara har ett allmänt koncept för en bild och delar av en bild. I vissa fall kan en modell producera en skadlig bild eller video, vilket riskerar användarnas förtroende eller företagets rykte.

Även om modeller är finjusterade för att utföra specifika uppgifter, kanske de inte är anpassade till mänskliga preferenser med avseende på innebörden, stilen eller innehållet i deras utdatainnehåll. I en LLM kan detta visa sig som felaktigt eller till och med skadligt innehåll som genereras av modellen. Till exempel kan en modell som inte är anpassad till mänskliga preferenser genom finjustering avge farliga, oetiska eller till och med olagliga instruktioner när en användare uppmanas till det. Ingen försiktighet kommer att ha vidtagits för att begränsa innehållet som genereras av modellen för att säkerställa att det är anpassat till mänskliga preferenser för att vara korrekt, relevant och användbart. Denna felanpassning kan vara ett problem för företag som förlitar sig på generativa AI-modeller för sina applikationer, som chatbots och multimediaskapande. För multimodala modeller kan detta ta formen av att giftiga, farliga eller kränkande bilder eller video genereras. Detta är en risk när prompter matas in i modellen utan avsikt att generera känsligt innehåll, och även om modelltillverkaren eller applikationsbyggaren inte hade tänkt tillåta modellen att generera den typen av innehåll, men det genererades ändå.

För att lösa problemen med uppgiftsspecifik förmåga och anpassa generativa grundmodeller med mänskliga preferenser måste modelltillverkare och applikationsbyggare finjustera modellerna med data med hjälp av mänskligt riktade demonstrationer och mänsklig feedback av modellutdata.

Data och utbildningstyper

Det finns flera typer av finjusteringsmetoder med olika typer av märkt data som kategoriseras som instruktionsjustering – eller lära en modell hur man följer instruktioner. Bland dem är övervakad finjustering (SFT) med hjälp av demonstrationsdata och förstärkningsinlärning från mänsklig feedback (RLHF) med hjälp av preferensdata.

Demonstrationsdata för övervakad finjustering

För att finjustera grundmodeller för att utföra specifika uppgifter som att svara på frågor eller sammanfatta text med hög kvalitet genomgår modellerna SFT med demonstrationsdata. Syftet med demonstrationsdata är att vägleda modellen genom att förse den med märkta exempel (demonstrationer) av utförda uppgifter som utförs av människor. Till exempel, för att lära en LLM hur man svarar på frågor, kommer en mänsklig kommentator att skapa en märkt datauppsättning av mänskligt genererade frågor och svar-par för att visa hur en fråga och svar-interaktion fungerar språkligt och vad innehållet betyder semantiskt. Denna typ av SFT tränar modellen att känna igen beteendemönster som demonstreras av människor i demonstrationsträningsdata. Modelltillverkare måste göra den här typen av finjusteringar för att visa att deras modeller kan utföra sådana uppgifter för nedströmsanvändare. Applikationsbyggare som använder befintliga grundmodeller för sina generativa AI-applikationer kan behöva finjustera sina modeller med demonstrationsdata för dessa uppgifter med branschspecifik eller företagsspecifik data för att förbättra relevansen och noggrannheten i sina applikationer.

Preferensdata för instruktionsinställning som RLHF

För att ytterligare anpassa grundmodeller till mänskliga preferenser måste modelltillverkare – och särskilt applikationsbyggare – generera preferensdatauppsättningar för att utföra instruktionsjustering. Preferensdata i samband med instruktionsinställning är märkta data som fångar mänsklig feedback med avseende på en uppsättning alternativ som matas ut av en generativ grundmodell. Det inkluderar vanligtvis att betygsätta eller rangordna flera slutsatser eller parvis jämföra två slutsatser från en grundmodell enligt något specifikt attribut. För LLM:er kan dessa attribut vara hjälpsamhet, noggrannhet och ofarlighet. För text-till-bild-modeller kan det vara en estetisk kvalitet eller text-bild-justering. Dessa preferensdata baserade på mänsklig feedback kan sedan användas i olika instruktionsjusteringsmetoder – inklusive RLHF – för att ytterligare finjustera en modell för att anpassas till mänskliga preferenser.

Instruktionsjustering med hjälp av preferensdata spelar en avgörande roll för att förbättra personaliseringen och effektiviteten hos grundmodeller. Detta är ett nyckelsteg i att bygga anpassade applikationer ovanpå förutbildade grundmodeller och är en kraftfull metod för att säkerställa att modeller genererar användbart, korrekt och ofarligt innehåll. Ett vanligt exempel på instruktionsjustering är att instruera en chatbot att generera tre svar på en fråga, och låta en människa läsa och rangordna alla tre enligt någon specificerad dimension, såsom toxicitet, faktaprecision eller läsbarhet. Till exempel kan ett företag använda en chatbot för sin marknadsavdelning och vill se till att innehållet är anpassat till dess varumärkesbudskap, inte uppvisar fördomar och är tydligt läsbart. Företaget skulle uppmana chatboten under instruktionsjusteringen att producera tre exempel och låta deras interna experter välja ut de som bäst passar deras mål. Med tiden bygger de en datauppsättning som används för att lära modellen vilken typ av innehåll människor föredrar genom förstärkningsinlärning. Detta gör det möjligt för chatbot-applikationen att mata ut mer relevant, läsbart och säkert innehåll.

SageMaker Ground Truth Plus

Ground Truth Plus hjälper dig att ta itu med båda utmaningarna – att skapa demonstrationsdatauppsättningar med uppgiftsspecifika möjligheter, såväl som att samla in preferensdataset från mänsklig feedback för att anpassa modeller med mänskliga preferenser. Du kan begära projekt för LLM och multimodala modeller som text-till-bild och text-till-video. För LLM:er inkluderar nyckeldemonstrationsdata generering av frågor och svar (Q&A), textsammanfattning, textgenerering och textomarbetning i syfte att moderera innehåll, stiländring eller längdändring. Viktiga LLM-preferensuppsättningar inkluderar rangordning och klassificering av textutdata. För multimodala modeller inkluderar viktiga uppgiftstyper bildtextning av bilder eller videor samt loggning av tidsstämplar för händelser i videor. Därför kan Ground Truth Plus hjälpa både modelltillverkare och applikationsbyggare på deras generativa AI-resa.

I det här inlägget dyker vi djupare in i den mänskliga kommentator- och feedbackresan på fyra fall som täcker både demonstrationsdata och preferensdata för både LLM:er och multimodala modeller: generering av frågor och svar och textrankning för LLM:er, såväl som bildtextning och videotextning för multimodala modeller.

Stora språkmodeller

I det här avsnittet diskuterar vi fråge- och svarpar och textrankning för LLM, tillsammans med anpassningar du kanske vill ha för ditt användningsfall.

Fråge- och svarpar

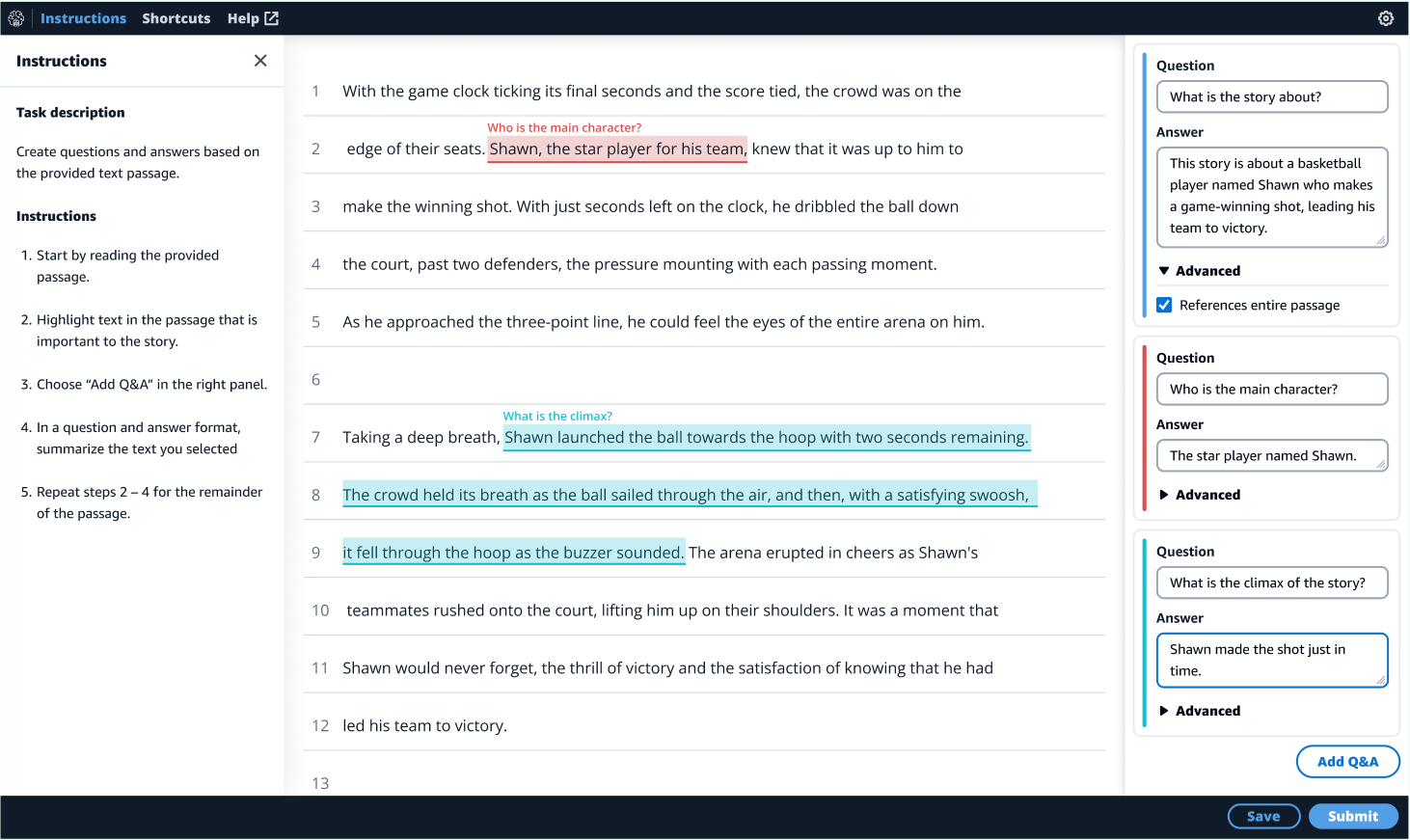

Följande skärmdump visar ett märkningsgränssnitt där en mänsklig kommentator läser en textpassage och genererar både frågor och svar i processen med att bygga en Q&A demonstrationsdatauppsättning.

Låt oss gå igenom en rundtur i användargränssnittet i annotatorns skor. På vänster sida av användargränssnittet presenteras arbetssökandens specifika instruktioner för kommentatorn. I det här fallet är det meningen att kommentatorn ska läsa textstycket som presenteras i mitten av användargränssnittet och skapa frågor och svar baserat på texten. På höger sida visas frågorna och svaren som kommentatorn har skrivit. Textpassagen samt typ, längd och antal frågor och svar kan alla anpassas av arbetssökanden under projektuppsättningen med Ground Truth Plus-teamet. I det här fallet har kommentatorn skapat en fråga som kräver att man förstår hela textavsnittet för att kunna svara och är markerad med en Refererar till hela stycket kryssruta. De andra två frågorna och svaren är baserade på specifika delar av textpassagen, vilket framgår av annotatorns höjdpunkter med färgkodad matchning. Om du vill kan du begära att frågor och svar genereras utan en medföljande textpassage, och tillhandahålla andra riktlinjer för mänskliga kommentatorer – detta stöds också av Ground Truth Plus.

Efter att frågorna och svaren har skickats kan de gå till ett valfritt arbetsflöde för kvalitetskontrollslingor där andra mänskliga granskare kommer att bekräfta att kunddefinierad distribution och typer av frågor och svar har skapats. Om det finns en bristande överensstämmelse mellan kundens krav och vad den mänskliga kommentatorn har producerat, kommer arbetet att skickas tillbaka till en människa för omarbetning innan det exporteras som en del av datasetet för att levereras till kunden. När datauppsättningen levereras tillbaka till dig är den redo att införlivas i det övervakade finjusteringsarbetsflödet efter eget gottfinnande.

Textrankning

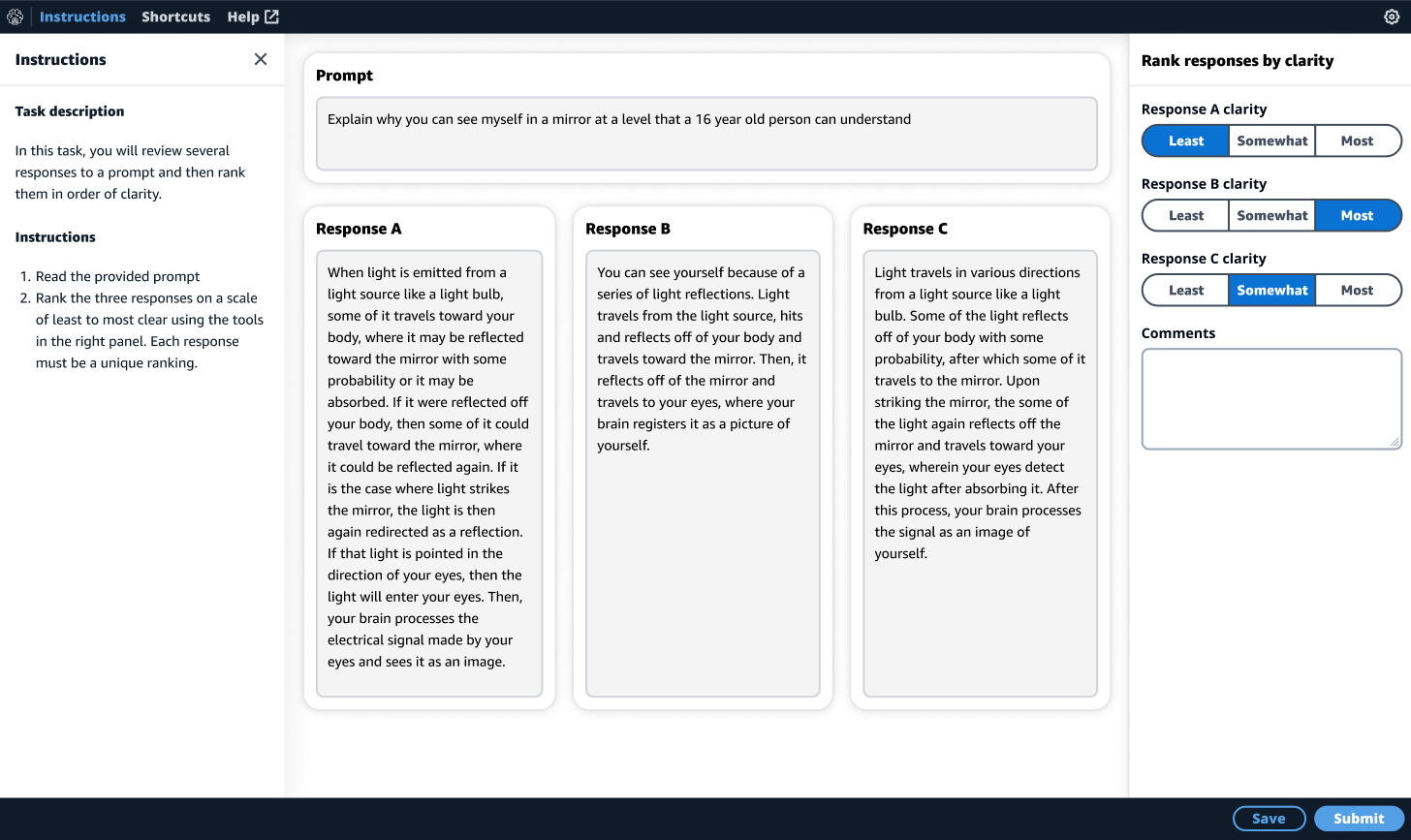

Följande skärmdump visar ett användargränssnitt för att rangordna utdata från en LLM baserat på en prompt.

Du kan helt enkelt skriva instruktionerna för den mänskliga granskaren och ta med uppmaningar och förgenererade svar till Ground Truth Plus-projektteamet för att påbörja jobbet. I det här fallet har vi begärt att en mänsklig granskare ska rangordna tre svar per prompt från en LLM på dimensionen av skrivtydlighet (läsbarhet). Återigen visar den vänstra rutan instruktionerna som den som begärt jobb har gett granskaren. I mitten är prompten högst upp på sidan, och de tre förgenererade svaren är huvuddelen för enkel användning. På den högra sidan av användargränssnittet kommer den mänskliga granskaren att rangordna dem i ordning efter mest till minst tydlig skrift.

Kunder som vill generera denna typ av preferensdatauppsättning inkluderar applikationsbyggare som är intresserade av att bygga människoliknande chatbotar och vill därför anpassa instruktionerna för eget bruk. Längden på uppmaningen, antalet svar och rankningsdimensionen kan alla anpassas. Till exempel kanske du vill rangordna fem svar i ordningsföljd av de flesta till minst faktamässigt korrekta, partiska eller giftiga, eller till och med rangordna och klassificera flera dimensioner samtidigt. Dessa anpassningar stöds i Ground Truth Plus.

Multimodala modeller

I det här avsnittet diskuterar vi bild- och videotextning för träning av multimodala modeller som text-till-bild och text-till-video-modeller, samt anpassningar som du kanske vill göra för ditt specifika användningsfall.

Bildtexter

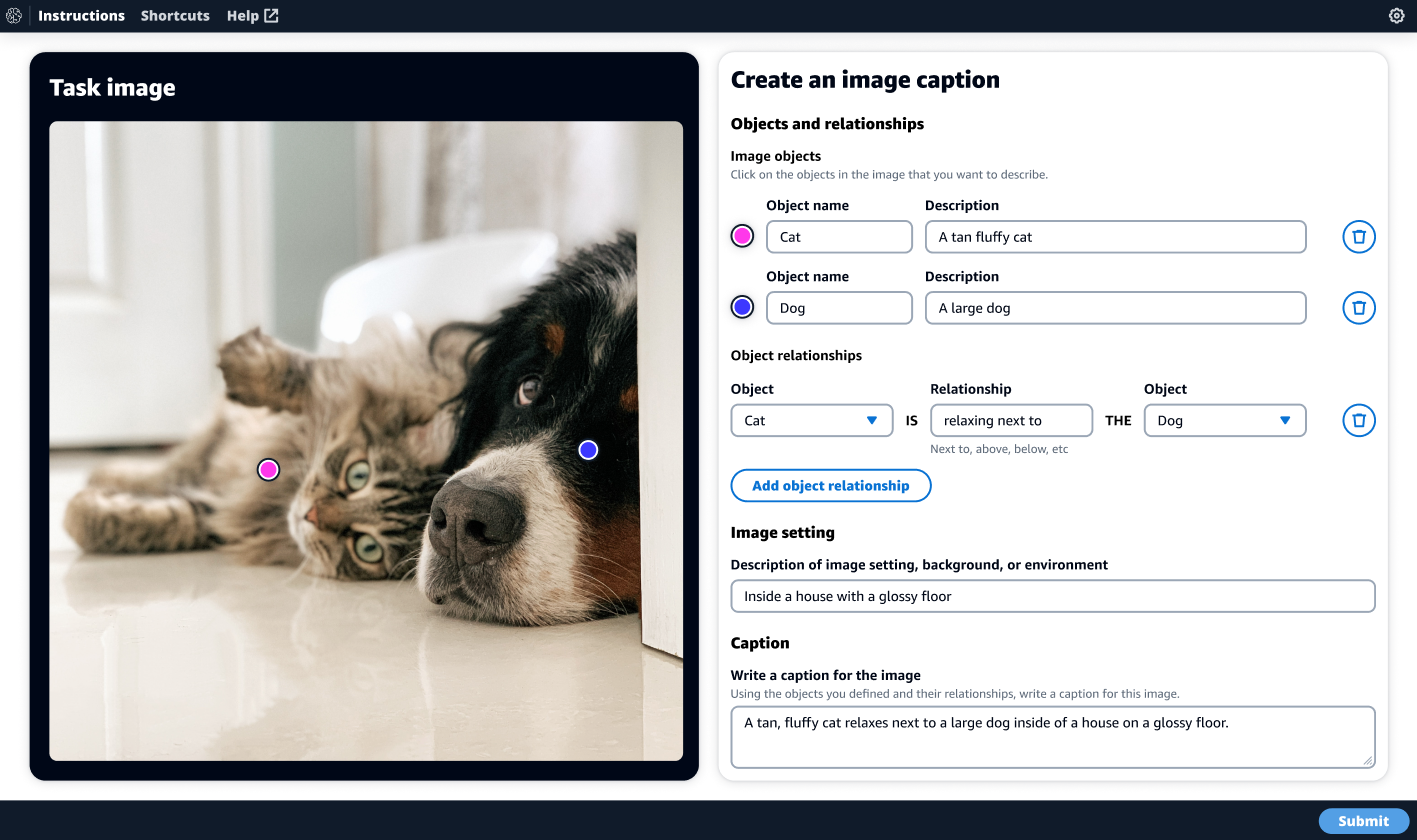

Följande skärmdump visar ett märkningsgränssnitt för bildtextning. Du kan begära ett projekt med bildtextning för att samla in data för att träna en text-till-bild-modell eller en bild-till-text-modell.

I det här fallet har vi begärt att få träna en text-till-bild-modell och har ställt specifika krav på bildtexten vad gäller längd och detalj. Användargränssnittet är utformat för att leda de mänskliga kommentatorerna genom den kognitiva processen att generera rika bildtexter genom att tillhandahålla en mental ram genom hjälpande och beskrivande verktyg. Vi har funnit att tillhandahållandet av denna mentala ram för kommentatorer resulterar i mer beskrivande och korrekta bildtexter än att bara tillhandahålla en redigerbar textruta.

Det första steget i ramverket är för den mänskliga kommentatorn att identifiera nyckelobjekt i bilden. När kommentatorn väljer ett objekt i bilden visas en färgkodad prick på objektet. I det här fallet har kommentatorn valt både hunden och katten och skapat två redigerbara fält på höger sida av användargränssnittet där kommentatorn kommer att ange namnen på objekten – katt och hund – tillsammans med en detaljerad beskrivning av varje objekt. Därefter guidas kommentatorn för att identifiera alla relationer mellan alla objekt i bilden. I det här fallet kopplar katten av bredvid hunden. Därefter uppmanas kommentatorn att identifiera specifika attribut för bilden, såsom inställning, bakgrund eller miljö. Slutligen, i textrutan för inmatning av bildtexter, instrueras kommentatorn att kombinera allt de skrev i objekt, relationer och bildinställningsfälten till en fullständig beskrivande bildtext för bilden.

Alternativt kan du konfigurera denna bildtext så att den passeras genom en människobaserad kvalitetskontrollslinga med specifika instruktioner för att säkerställa att bildtexten uppfyller kraven. Om det finns ett problem som identifieras, till exempel ett saknat nyckelobjekt, kan den bildtexten skickas tillbaka så att en människa kan åtgärda problemet innan den exporteras som en del av träningsdatauppsättningen.

Videotextning

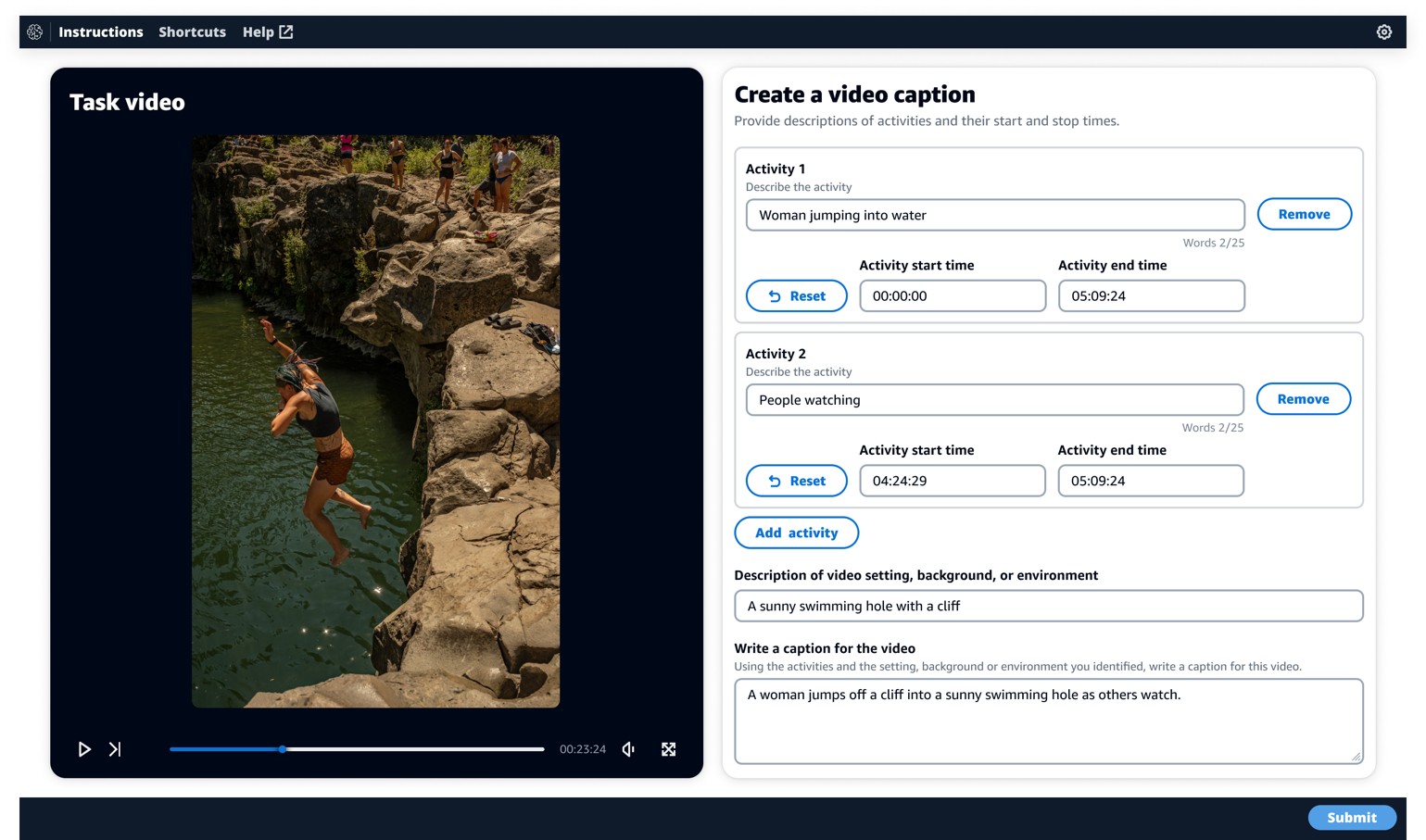

Följande skärmdump visar ett gränssnitt för videotextning för att generera rik videotextning med tidsstämpeltaggar. Du kan begära ett videotextningsprojekt för att samla in data för att bygga text-till-video eller video-till-text-modeller.

I detta etiketteringsgränssnitt har vi byggt ett liknande mentalt ramverk för att säkerställa att högkvalitativa bildtexter skrivs. Den mänskliga kommentatorn kan styra videon på vänster sida och skapa beskrivningar och tidsstämplar för varje aktivitet som visas i videon på höger sida med UI-elementen. I likhet med gränssnittet för bildtextning finns det också en plats för kommentatorn att skriva en detaljerad beskrivning av videoinställningen, bakgrunden och miljön. Slutligen instrueras kommentatorn att kombinera alla element till en sammanhängande videotextning.

I likhet med fallet med bildtextning kan videotextningen valfritt flöda genom ett mänskligt baserat kvalitetskontrollarbetsflöde för att avgöra om dina krav är uppfyllda. Om det finns ett problem med videotextningen kommer den att skickas för omarbetning av den mänskliga anteckningsarbetaren.

Slutsats

Ground Truth Plus kan hjälpa dig att förbereda datauppsättningar av hög kvalitet för att finjustera grundmodeller för generativa AI-uppgifter, från att svara på frågor till att generera bilder och videor. Det gör det också möjligt för kvalificerade mänskliga arbetsstyrkor att granska modellutdata för att säkerställa att de är i linje med mänskliga preferenser. Dessutom gör det det möjligt för applikationsbyggare att anpassa modeller med deras bransch- eller företagsdata för att säkerställa att deras applikation representerar deras föredragna röst och stil. Dessa är de första av många innovationer i Ground Truth Plus, och fler är under utveckling. Håll utkik efter framtida inlägg.

Intresserad av att starta ett projekt för att bygga eller förbättra dina generativa AI-modeller och applikationer? Kom igång med Ground Truth Plus av kontakt med vårt team i dag.

Om författarna

Jesse Manders är en Senior Product Manager i AWS AI/ML-människan i loopserviceteamet. Han arbetar i skärningspunkten mellan AI och mänsklig interaktion med målet att skapa och förbättra AI/ML-produkter och tjänster för att möta våra behov. Tidigare hade Jesse ledande roller inom ingenjörsbranschen på Apple och Lumileds, och var senior forskare i en Silicon Valley-startup. Han har en MS och Ph.D. från University of Florida och en MBA från University of California, Berkeley, Haas School of Business.

Jesse Manders är en Senior Product Manager i AWS AI/ML-människan i loopserviceteamet. Han arbetar i skärningspunkten mellan AI och mänsklig interaktion med målet att skapa och förbättra AI/ML-produkter och tjänster för att möta våra behov. Tidigare hade Jesse ledande roller inom ingenjörsbranschen på Apple och Lumileds, och var senior forskare i en Silicon Valley-startup. Han har en MS och Ph.D. från University of Florida och en MBA från University of California, Berkeley, Haas School of Business.

Romi Datta är en Senior Manager of Product Management i Amazon SageMaker-teamet ansvarig för Human in the Loop-tjänsterna. Han har varit i AWS i över 4 år och innehaft flera ledarskapsroller för produktledning inom SageMaker, S3 och IoT. Före AWS arbetade han i olika produktlednings-, ingenjörs- och operativa ledarroller på IBM, Texas Instruments och Nvidia. Han har en MS och Ph.D. i elektro- och datorteknik från University of Texas i Austin, och en MBA från University of Chicago Booth School of Business.

Romi Datta är en Senior Manager of Product Management i Amazon SageMaker-teamet ansvarig för Human in the Loop-tjänsterna. Han har varit i AWS i över 4 år och innehaft flera ledarskapsroller för produktledning inom SageMaker, S3 och IoT. Före AWS arbetade han i olika produktlednings-, ingenjörs- och operativa ledarroller på IBM, Texas Instruments och Nvidia. Han har en MS och Ph.D. i elektro- och datorteknik från University of Texas i Austin, och en MBA från University of Chicago Booth School of Business.

Jonathan Buck är en mjukvaruingenjör på Amazon Web Services som arbetar i skärningspunkten mellan maskininlärning och distribuerade system. Hans arbete involverar produktion av maskininlärningsmodeller och utveckling av nya mjukvaruapplikationer som drivs av maskininlärning för att ge kunderna de senaste funktionerna.

Jonathan Buck är en mjukvaruingenjör på Amazon Web Services som arbetar i skärningspunkten mellan maskininlärning och distribuerade system. Hans arbete involverar produktion av maskininlärningsmodeller och utveckling av nya mjukvaruapplikationer som drivs av maskininlärning för att ge kunderna de senaste funktionerna.

Alex Williams är en tillämpad vetenskapsman i human-in-the-loop-vetenskapsteamet vid AWS AI där han bedriver interaktiv systemforskning i skärningspunkten mellan människa-datorinteraktion (HCI) och maskininlärning. Innan han började på Amazon var han professor vid avdelningen för elektroteknik och datavetenskap vid University of Tennessee där han var med och ledde forskningslaboratoriet People, Agents, Interactions and Systems (PAIRS). Han har också haft forskarpositioner vid Microsoft Research, Mozilla Research och University of Oxford. Han publicerar regelbundet sitt arbete på främsta publikationsställen för HCI, som CHI, CSCW och UIST. Han har en doktorsexamen från University of Waterloo.

Alex Williams är en tillämpad vetenskapsman i human-in-the-loop-vetenskapsteamet vid AWS AI där han bedriver interaktiv systemforskning i skärningspunkten mellan människa-datorinteraktion (HCI) och maskininlärning. Innan han började på Amazon var han professor vid avdelningen för elektroteknik och datavetenskap vid University of Tennessee där han var med och ledde forskningslaboratoriet People, Agents, Interactions and Systems (PAIRS). Han har också haft forskarpositioner vid Microsoft Research, Mozilla Research och University of Oxford. Han publicerar regelbundet sitt arbete på främsta publikationsställen för HCI, som CHI, CSCW och UIST. Han har en doktorsexamen från University of Waterloo.

Sarah Gao är en Software Development Manager i Amazon SageMaker Human In the Loop (HIL) ansvarig för att bygga den ML-baserade etikettplattformen. Sarah har varit i AWS i över 4 år och haft flera ledarroller för mjukvaruhantering inom EC2-säkerhet och SageMaker. Före AWS arbetade hon i olika ingenjörsledningsroller på Oracle och Sun Microsystem.

Sarah Gao är en Software Development Manager i Amazon SageMaker Human In the Loop (HIL) ansvarig för att bygga den ML-baserade etikettplattformen. Sarah har varit i AWS i över 4 år och haft flera ledarroller för mjukvaruhantering inom EC2-säkerhet och SageMaker. Före AWS arbetade hon i olika ingenjörsledningsroller på Oracle och Sun Microsystem.

Erran Li är tillämpad vetenskapschef på human-in-the-loop-tjänster, AWS AI, Amazon. Hans forskningsintressen är 3D-djupinlärning och inlärning av syn och språkrepresentation. Tidigare var han senior forskare på Alexa AI, chef för maskininlärning på Scale AI och chefsforskare på Pony.ai. Innan dess var han med perceptionsteamet på Uber ATG och maskininlärningsplattformsteamet på Uber och arbetade med maskininlärning för autonom körning, maskininlärningssystem och strategiska initiativ av AI. Han började sin karriär på Bell Labs och var adjungerad professor vid Columbia University. Han var med och undervisade i tutorials på ICML'17 och ICCV'19, och var med och organiserade flera workshops på NeurIPS, ICML, CVPR, ICCV om maskininlärning för autonom körning, 3D-vision och robotik, maskininlärningssystem och motstridig maskininlärning. Han har en doktorsexamen i datavetenskap vid Cornell University. Han är en ACM Fellow och IEEE Fellow.

Erran Li är tillämpad vetenskapschef på human-in-the-loop-tjänster, AWS AI, Amazon. Hans forskningsintressen är 3D-djupinlärning och inlärning av syn och språkrepresentation. Tidigare var han senior forskare på Alexa AI, chef för maskininlärning på Scale AI och chefsforskare på Pony.ai. Innan dess var han med perceptionsteamet på Uber ATG och maskininlärningsplattformsteamet på Uber och arbetade med maskininlärning för autonom körning, maskininlärningssystem och strategiska initiativ av AI. Han började sin karriär på Bell Labs och var adjungerad professor vid Columbia University. Han var med och undervisade i tutorials på ICML'17 och ICCV'19, och var med och organiserade flera workshops på NeurIPS, ICML, CVPR, ICCV om maskininlärning för autonom körning, 3D-vision och robotik, maskininlärningssystem och motstridig maskininlärning. Han har en doktorsexamen i datavetenskap vid Cornell University. Han är en ACM Fellow och IEEE Fellow.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoAiStream. Web3 Data Intelligence. Kunskap förstärkt. Tillgång här.

- Minting the Future med Adryenn Ashley. Tillgång här.

- Köp och sälj aktier i PRE-IPO-företag med PREIPO®. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/high-quality-human-feedback-for-your-generative-ai-applications-from-amazon-sagemaker-ground-truth-plus/

- : har

- :är

- :inte

- :var

- $UPP

- 100

- 3d

- 7

- a

- Able

- Om oss

- SAMMANDRAG

- akademiska

- Enligt

- noggrannhet

- exakt

- ACM

- aktivitet

- Dessutom

- adress

- adopterare

- framsteg

- kontradiktoriskt

- Annons

- igen

- medel

- AI

- ai konst

- AI / ML

- alexa

- rikta

- Justerat

- uppriktning

- Alla

- tillåter

- tillåter

- ensam

- längs

- också

- amason

- Amazon SageMaker

- Amazon SageMaker Ground Sannhet

- Amazon Web Services

- bland

- an

- och

- svara

- svar

- visas

- Apple

- Ansökan

- tillämpningar

- tillämpas

- ÄR

- runt

- Konst

- AS

- Tillgångar

- assistenter

- associerad

- At

- attribut

- austin

- autonom

- tillgänglig

- AWS

- tillbaka

- bakgrund

- baserat

- BE

- varit

- innan

- Där vi får lov att vara utan att konstant prestera,

- klocka

- Berkeley

- mellan

- partisk

- förspänner

- kropp

- båda

- Box

- varumärke

- föra

- SLUTRESULTAT

- byggare

- byggare

- Byggnad

- byggt

- företag

- business intelligence

- men

- by

- kalifornien

- KAN

- kapacitet

- kapabel

- texter

- fångar

- vilken

- Karriär

- Vid

- fall

- KATT

- Centrum

- byta

- chatbot

- chatbots

- ta

- chicago

- chef

- valda

- klarhet

- klassificera

- klar

- klart

- kognitiv

- SAMMANHÄNGANDE

- COLUMBIA

- kombinera

- Gemensam

- Företag

- företag

- jämförande

- fullborda

- Avslutade

- dator

- Datorteknik

- Datavetenskap

- begrepp

- beteenden

- förtroende

- Bekräfta

- innehåll

- sammanhang

- kontroll

- cornell

- Företag

- korrekt

- kunde

- beläggning

- skapa

- skapas

- Skapa

- skapande

- Kreativ

- avgörande

- beställnings

- kund

- Kunder

- skräddarsy

- kundanpassad

- Dangerous

- datum

- datauppsättningar

- djup

- djupt lärande

- djupare

- leverera

- levereras

- demonstrera

- demonstreras

- Avdelning

- beskrivning

- Designa

- utformade

- designer

- detalj

- detaljerad

- Bestämma

- utveckla

- Utveckling

- olika

- Dimensionera

- dimensioner

- diskretion

- diskutera

- distribueras

- distribuerade system

- fördelning

- do

- inte

- Dog

- gjort

- inte

- DOT

- drivande

- under

- varje

- lätta

- enkel användning

- effektivitet

- element

- möjliggör

- engagerande

- ingenjör

- Teknik

- förbättra

- säkerställa

- ange

- Hela

- Miljö

- speciellt

- Även

- händelser

- exempel

- exempel

- uppvisar

- befintliga

- expert

- expertis

- experter

- återkoppling

- Kompis

- Fält

- Film

- Slutligen

- Förnamn

- florida

- flöda

- följer

- efter

- För

- formen

- hittade

- fundament

- fyra

- Ramverk

- från

- ytterligare

- framtida

- lek

- spelutveckling

- GAO

- samla

- samla

- Allmänt

- generera

- genereras

- generera

- generering

- generativ

- Generativ AI

- generatorer

- skaffa sig

- få

- ges

- Målet

- Grafisk

- Marken

- styra

- riktlinjer

- hade

- händer

- skadliga

- Har

- HCl

- he

- huvud

- tung

- tunga lyft

- Held

- hjälpa

- hjälp

- hjälper

- Hög

- hög kvalitet

- höjdpunkter

- höggradigt

- hans

- innehav

- innehar

- Hur ser din drömresa ut

- How To

- html

- HTTPS

- humant

- Människa

- IBM

- identifierade

- identifiera

- IEEE

- if

- Olaglig

- bild

- bilder

- med Esport

- förbättra

- förbättra

- in

- felaktig

- innefattar

- innefattar

- införliva

- industrin

- branschspecifika

- initiativ

- innovationer

- ingång

- instruktioner

- instrument

- Intelligens

- avsedd

- Avsikt

- interaktion

- interaktioner

- interaktiva

- intresserad

- intressen

- gränssnitt

- inre

- skärning

- in

- iot

- fråga

- problem

- IT

- DESS

- sig

- Jobb

- sammanfogning

- resa

- jpg

- bara

- Nyckel

- Snäll

- kunskap

- märkning

- Etiketter

- laboratorium

- Labs

- språk

- Large

- senaste

- Ledarskap

- LÄRA SIG

- inlärning

- t minst

- vänster

- Längd

- lyft

- BEGRÄNSA

- LLM

- skogsavverkning

- logotyp

- Maskinen

- maskininlärning

- Huvudsida

- göra

- ledning

- chef

- förvaltar

- hantera

- många

- markant

- Marknadsföring

- matchande

- Maj..

- betyder

- betyder

- Möt

- möter

- mentala

- meddelande

- metod

- metoder

- Microsoft

- saknas

- ML

- modell

- modeller

- måttfullhet

- mer

- mest

- Mozilla

- multimedia

- multipel

- måste

- namn

- Natural

- Behöver

- behov

- Nya

- Nästa

- Nej

- roman

- nu

- antal

- Nvidia

- objektet

- objekt

- of

- on

- ettor

- endast

- operativa

- Tillbehör

- or

- orakel

- beställa

- Övriga

- vår

- produktion

- över

- egen

- oxford

- sida

- par

- par

- panelen

- del

- särskilt

- reservdelar till din klassiker

- Godkänd

- mönster

- Personer

- varseblivning

- Utföra

- utför

- personlig

- personalisering

- Plats

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- spelar

- plus

- positioner

- Inlägg

- inlägg

- drivs

- den mäktigaste

- föredra

- preferenser

- föredragen

- Premier

- Förbered

- förbereda

- presenteras

- tidigare

- Innan

- Problem

- problem

- process

- producera

- producerad

- producent

- producenter

- Produkt

- produktledning

- produktchef

- produktivitet

- Produkter

- Professor

- projektet

- projekt

- ge

- förutsatt

- tillhandahålla

- Offentliggörande

- publicerar

- Syftet

- syfte

- sätta

- Frågor och svar

- kvalitet

- fråga

- frågor

- Rankning

- betyg

- Läsa

- redo

- realistisk

- senaste

- känner igen

- regelbundet

- relaterad

- Förhållanden

- relevanta

- förlita

- bort

- representation

- representerar

- rykte

- begära

- förfrågningar

- Obligatorisk

- Krav

- Kräver

- forskning

- avseende

- Svara

- respons

- svar

- ansvarig

- Resultat

- översyn

- Rik

- höger

- Risk

- riskera

- robotik

- Roll

- roller

- s

- säker

- sagemaker

- Skala

- skala ai

- Skola

- Vetenskap

- Forskare

- §

- säkerhet

- senior

- känslig

- skickas

- Tjänster

- portion

- in

- uppsättningar

- inställning

- inställning

- flera

- Dela

- hon

- show

- visas

- Visar

- sida

- Kisel

- Silicon Valley

- liknande

- helt enkelt

- samtidigt

- enda

- skicklig

- Mjukvara

- mjukvaruutveckling

- Programvara ingenjör

- LÖSA

- några

- något

- specifik

- specificerade

- starta

- igång

- Starta

- start

- bo

- Steg

- Strategisk

- stil

- lämnats

- substans

- sådana

- sammanfatta

- SAMMANFATTNING

- sol

- Som stöds

- förment

- System

- Ta

- tagen

- uppgift

- uppgifter

- Undervisning

- grupp

- Tennessee

- villkor

- texas

- än

- den där

- Smakämnen

- världen

- deras

- Dem

- sedan

- Där.

- därför

- Dessa

- de

- detta

- tre

- Genom

- tid

- tidsstämpel

- till

- i dag

- verktyg

- topp

- ämne

- Tour

- Tåg

- tränad

- Utbildning

- tåg

- sanningen

- självstudiekurser

- två

- Typ

- typer

- typiskt

- Uber

- ui

- förståelse

- universitet

- University of California

- University of Chicago

- University of Oxford

- användning

- användningsfall

- Begagnade

- Användare

- med hjälp av

- Dal

- mängd

- olika

- arenor

- Video

- videospel

- Video

- syn

- Röst

- vill

- önskar

- vill

- var

- we

- webb

- webbservice

- VÄL

- Vad

- när

- som

- VEM

- Hela

- kommer

- med

- utan

- Arbete

- arbetade

- arbetsflöde

- arbetsflöden

- arbetskraft

- arbetssätt

- fungerar

- Workshops

- världen

- skulle

- skriva

- skrivning

- skriven

- år

- Om er

- Din

- zephyrnet