Vi bevittnar en snabb ökning av antagandet av stora språkmodeller (LLM) som driver genererande AI-tillämpningar inom olika branscher. LLM:er kan utföra en mängd olika uppgifter, som att skapa kreativt innehåll, svara på förfrågningar via chatbots, generera kod och mer.

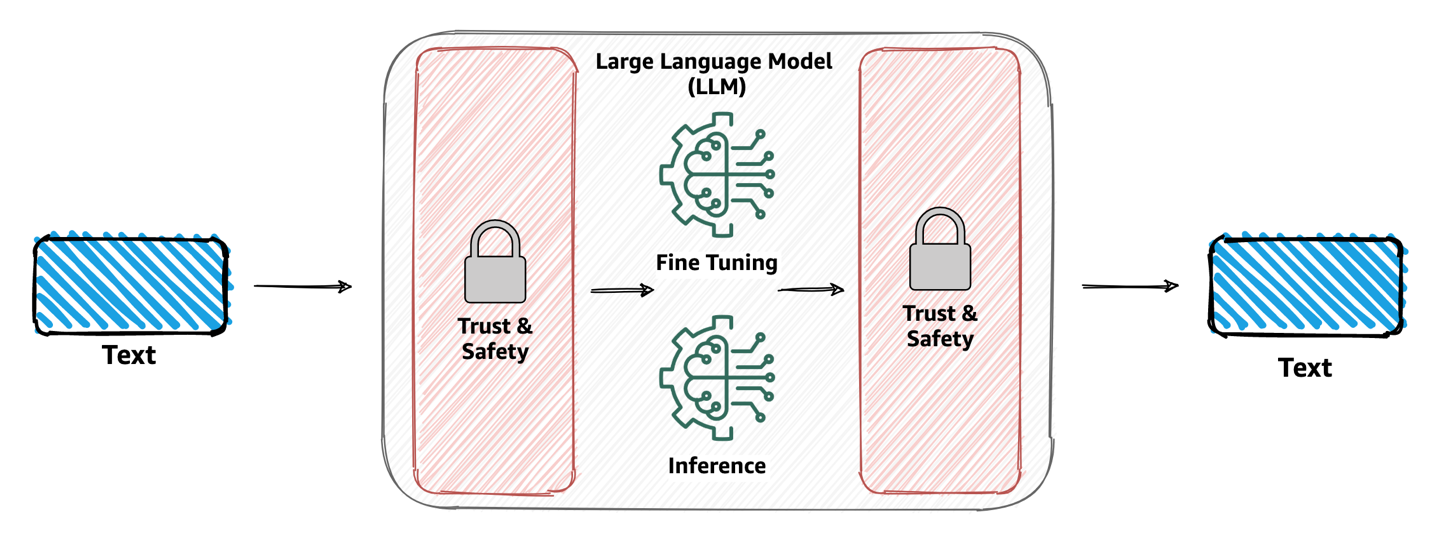

Organisationer som vill använda LLM:er för att driva sina applikationer är alltmer försiktiga med datasekretess för att säkerställa förtroende och säkerhet inom deras generativa AI-applikationer. Detta inkluderar att hantera kunders personuppgifter (PII) korrekt. Det inkluderar också att förhindra att kränkande och osäkert innehåll sprids till LLM:er och att kontrollera att data som genereras av LLM:er följer samma principer.

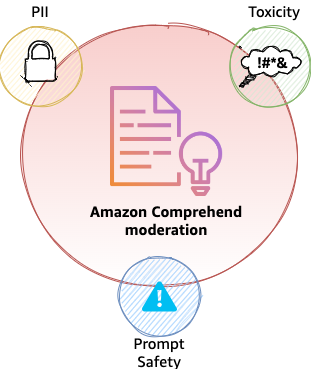

I det här inlägget diskuterar vi nya funktioner som drivs av Amazon Comprehend som möjliggör sömlös integration för att säkerställa datasekretess, innehållssäkerhet och snabb säkerhet i nya och befintliga generativa AI-applikationer.

Amazon Comprehend är en NLP-tjänst (natural language processing) som använder maskininlärning (ML) för att avslöja information i ostrukturerad data och text i dokument. I det här inlägget diskuterar vi varför förtroende och säkerhet med LLMs är viktiga för dina arbetsbelastningar. Vi går också djupare in i hur dessa nya modereringsfunktioner används med det populära ramverket för generativ AI-utveckling Langkedja att introducera en anpassningsbar förtroende- och säkerhetsmekanism för ditt användningsfall.

Varför förtroende och säkerhet med LLM är viktigt

Förtroende och säkerhet är av största vikt när man arbetar med LLM:er på grund av deras djupgående inverkan på ett brett utbud av applikationer, från chatbots för kundsupport till innehållsgenerering. Eftersom dessa modeller bearbetar stora mängder data och genererar mänskliga svar, ökar risken för missbruk eller oavsiktliga resultat. Att säkerställa att dessa AI-system fungerar inom etiska och pålitliga gränser är avgörande, inte bara för ryktet för företag som använder dem, utan också för att bevara slutanvändarnas och kundernas förtroende.

Dessutom, i takt med att LLM blir mer integrerade i våra dagliga digitala upplevelser, växer deras inflytande på våra uppfattningar, övertygelser och beslut. Att säkerställa förtroende och säkerhet med LLM:er går utöver bara tekniska åtgärder; den talar om det bredare ansvaret för AI-utövare och organisationer att upprätthålla etiska standarder. Genom att prioritera förtroende och säkerhet skyddar organisationer inte bara sina användare utan säkerställer också en hållbar och ansvarsfull tillväxt av AI i samhället. Det kan också bidra till att minska risken för att generera skadligt innehåll och hjälpa till att följa lagstadgade krav.

När det gäller förtroende och säkerhet är innehållsmoderering en mekanism som tar upp olika aspekter, inklusive men inte begränsat till:

- Integritetspolicy – Användare kan oavsiktligt tillhandahålla text som innehåller känslig information, vilket äventyrar deras integritet. Det är viktigt att upptäcka och redigera alla PII.

- Toxicitet – Att känna igen och filtrera bort skadligt innehåll, såsom hatretorik, hot eller övergrepp, är av yttersta vikt.

- Användarens avsikt – Att identifiera om användarinmatningen (prompten) är säker eller osäker är avgörande. Osäkra uppmaningar kan uttryckligen eller implicit uttrycka skadlig avsikt, som att begära personlig eller privat information och generera stötande, diskriminerande eller olagligt innehåll. Uppmaningar kan också implicit uttrycka eller begära råd om medicinska, juridiska, politiska, kontroversiella, personliga eller ekonomiska

Innehållsmoderering med Amazon Comprehend

I det här avsnittet diskuterar vi fördelarna med innehållsmoderering med Amazon Comprehend.

Ta itu med integritet

Amazon Comprehend adresserar redan integritet genom sin befintliga PII-detektering och redaktionsförmåga via DetectPIIEntities och Innehåller PIIEtiteter API:er. Dessa två API:er stöds av NLP-modeller som kan upptäcka ett stort antal PII-enheter som socialförsäkringsnummer (SSN), kreditkortsnummer, namn, adresser, telefonnummer och så vidare. För en fullständig lista över enheter, se PII universella entitetstyper. DetectPII tillhandahåller också teckennivåposition för PII-entiteten i en text; till exempel startteckenpositionen för entiteten NAME (John Doe) i meningen "Mitt namn är Joh göre” är 12 och slutteckenpositionen är 19. Dessa förskjutningar kan användas för att utföra maskering eller redaktion av värdena, och därigenom minska riskerna för spridning av privat data till LLM:er.

Ta itu med toxicitet och snabb säkerhet

Idag tillkännager vi två nya Amazon Comprehend-funktioner i form av API:er: Toxicitetsdetektering via DetectToxicContent API och snabb säkerhetsklassificering via ClassifyDocument API. Observera att DetectToxicContent är ett nytt API, medan ClassifyDocument är ett befintligt API som nu stöder snabb säkerhetsklassificering.

Detektion av toxicitet

Med Amazon Comprehend toxicitetsdetektering kan du identifiera och flagga innehåll som kan vara skadligt, stötande eller olämpligt. Denna förmåga är särskilt värdefull för plattformar där användare genererar innehåll, såsom webbplatser för sociala medier, forum, chatbots, kommentarsektioner och applikationer som använder LLM:er för att skapa innehåll. Det primära målet är att upprätthålla en positiv och säker miljö genom att förhindra spridning av giftigt innehåll.

I grunden analyserar toxicitetsdetekteringsmodellen text för att bestämma sannolikheten för att den innehåller hatiskt innehåll, hot, obsceniteter eller andra former av skadlig text. Modellen är tränad på stora datamängder som innehåller exempel på både giftigt och icke-toxiskt innehåll. Toxicitets-API:t utvärderar en given text för att ge toxicitetsklassificering och konfidenspoäng. Generativa AI-applikationer kan sedan använda denna information för att vidta lämpliga åtgärder, som att stoppa texten från att spridas till LLM. När detta skrivs är de etiketter som detekteras av toxicitetsdetektions-API:n HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULToch PROFANITY. Följande kod demonstrerar API-anropet med Python Boto3 för Amazon Comprehend-toxicitetsdetektering:

Snabb säkerhetsklassificering

Snabb säkerhetsklassificering med Amazon Comprehend hjälper till att klassificera en textuppmaning som säker eller osäker. Denna förmåga är avgörande för applikationer som chatbots, virtuella assistenter eller verktyg för innehållsmoderering där förståelse av säkerheten för en prompt kan avgöra svar, åtgärder eller innehållsspridning till LLM:er.

I huvudsak analyserar omedelbar säkerhetsklassificering mänsklig input för alla uttryckliga eller implicita skadliga avsikter, som att begära personlig eller privat information och generering av stötande, diskriminerande eller olagligt innehåll. Den flaggar också uppmaningar som söker råd om medicinska, juridiska, politiska, kontroversiella, personliga eller finansiella ämnen. Snabbklassificering returnerar två klasser, UNSAFE_PROMPT och SAFE_PROMPT, för en associerad text, med en tillhörande konfidenspoäng för varje. Konfidenspoängen sträcker sig mellan 0–1 och den sammanlagda summan blir 1. I en chatbot för kundsupport visas till exempel texten "Hur återställer jag mitt lösenord?” signalerar en avsikt att söka vägledning om procedurer för lösenordsåterställning och är märkt som SAFE_PROMPT. På samma sätt, ett uttalande som "Jag önskar att något dåligt händer dig” kan flaggas för att ha en potentiellt skadlig avsikt och märkas som UNSAFE_PROMPT. Det är viktigt att notera att snabb säkerhetsklassificering främst är inriktad på att upptäcka avsikter från mänskliga inmatningar (prompter), snarare än maskingenererad text (LLM-utgångar). Följande kod visar hur du kommer åt funktionen för snabb säkerhetsklassificering med ClassifyDocument API:

Observera att endpoint_arn i föregående kod tillhandahålls en AWS Amazon resursnummer (ARN) av mönstret arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safetyDär <region> är den AWS-region du väljer var Amazon Comprehend är tillgängligt.

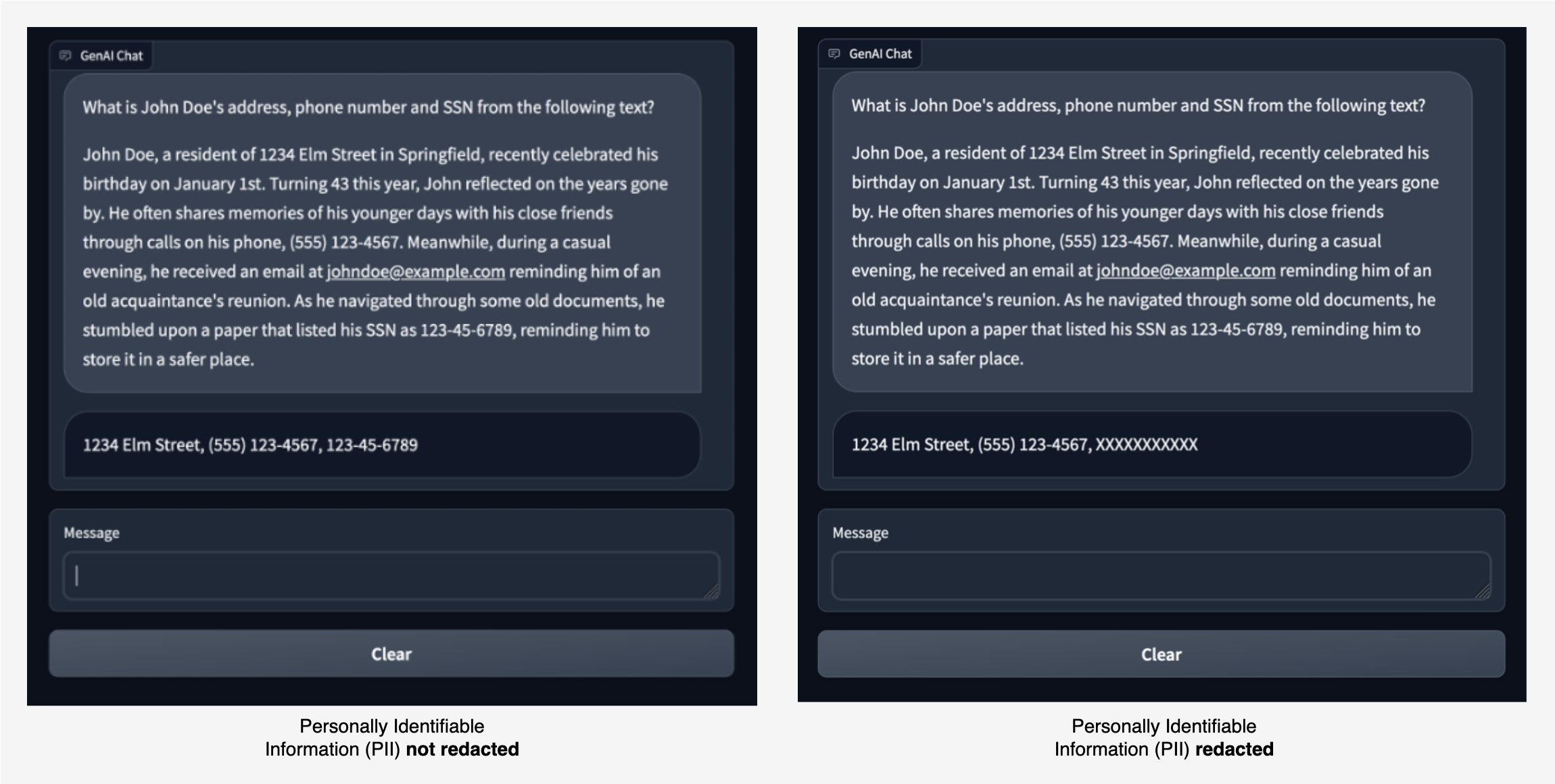

För att demonstrera dessa funktioner byggde vi en exempelchattapplikation där vi ber en LLM att extrahera PII-enheter som adress, telefonnummer och SSN från en given text. LLM hittar och returnerar lämpliga PII-enheter, som visas i bilden till vänster.

Med Amazon Comprehend-moderering kan vi redigera indata till LLM och utdata från LLM. I bilden till höger tillåts SSN-värdet skickas till LLM utan redigering. Emellertid redigeras alla SSN-värden i LLM:s svar.

Följande är ett exempel på hur en prompt som innehåller PII-information kan förhindras från att nå LLM helt och hållet. Det här exemplet visar en användare som ställer en fråga som innehåller PII-information. Vi använder Amazon Comprehend-moderering för att upptäcka PII-enheter i prompten och visa ett fel genom att avbryta flödet.

De föregående chattexemplen visar hur Amazon Comprehend-moderering tillämpar begränsningar på data som skickas till en LLM. I följande avsnitt förklarar vi hur denna modereringsmekanism implementeras med LangChain.

Integration med LangChain

Med de oändliga möjligheterna för tillämpning av LLM i olika användningsfall har det blivit lika viktigt att förenkla utvecklingen av generativa AI-applikationer. Langkedja är ett populärt ramverk med öppen källkod som gör det enkelt att utveckla generativa AI-applikationer. Amazon Comprehend-moderering utökar LangChain-ramverket för att erbjuda PII-identifiering och redaktion, toxicitetsdetektering och snabb säkerhetsklassificering via AmazonComprehendModerationChain.

AmazonComprehendModerationChain är en anpassad implementering av LangChain baskedja gränssnitt. Detta innebär att applikationer kan använda denna kedja med sina egna LLM-kedjor för att tillämpa önskad moderering på inmatningsprompten såväl som på utmatningstexten från LLM. Kedjor kan byggas genom att slå samman flera kedjor eller genom att blanda kedjor med andra komponenter. Du kan använda AmazonComprehendModerationChain med andra LLM-kedjor för att utveckla komplexa AI-applikationer på ett modulärt och flexibelt sätt.

För att förklara det ytterligare ger vi några exempel i följande avsnitt. Källkoden för AmazonComprehendModerationChain implementering kan hittas inom LangChain arkiv med öppen källkod. För fullständig dokumentation av API-gränssnittet, se LangChain API-dokumentation för Amazon Comprehend modereringskedja. Att använda denna modereringskedja är lika enkelt som att initiera en instans av klassen med standardkonfigurationer:

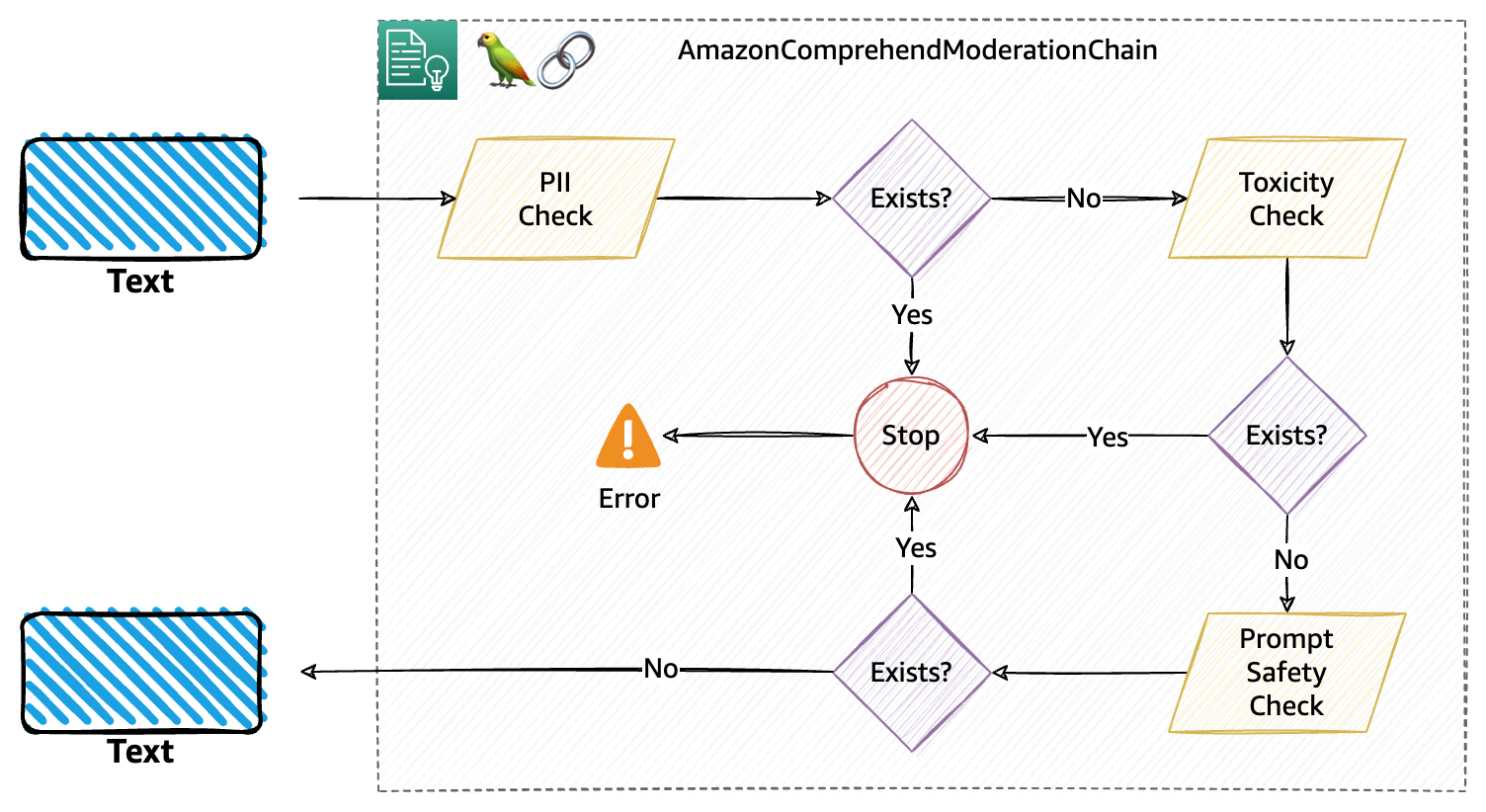

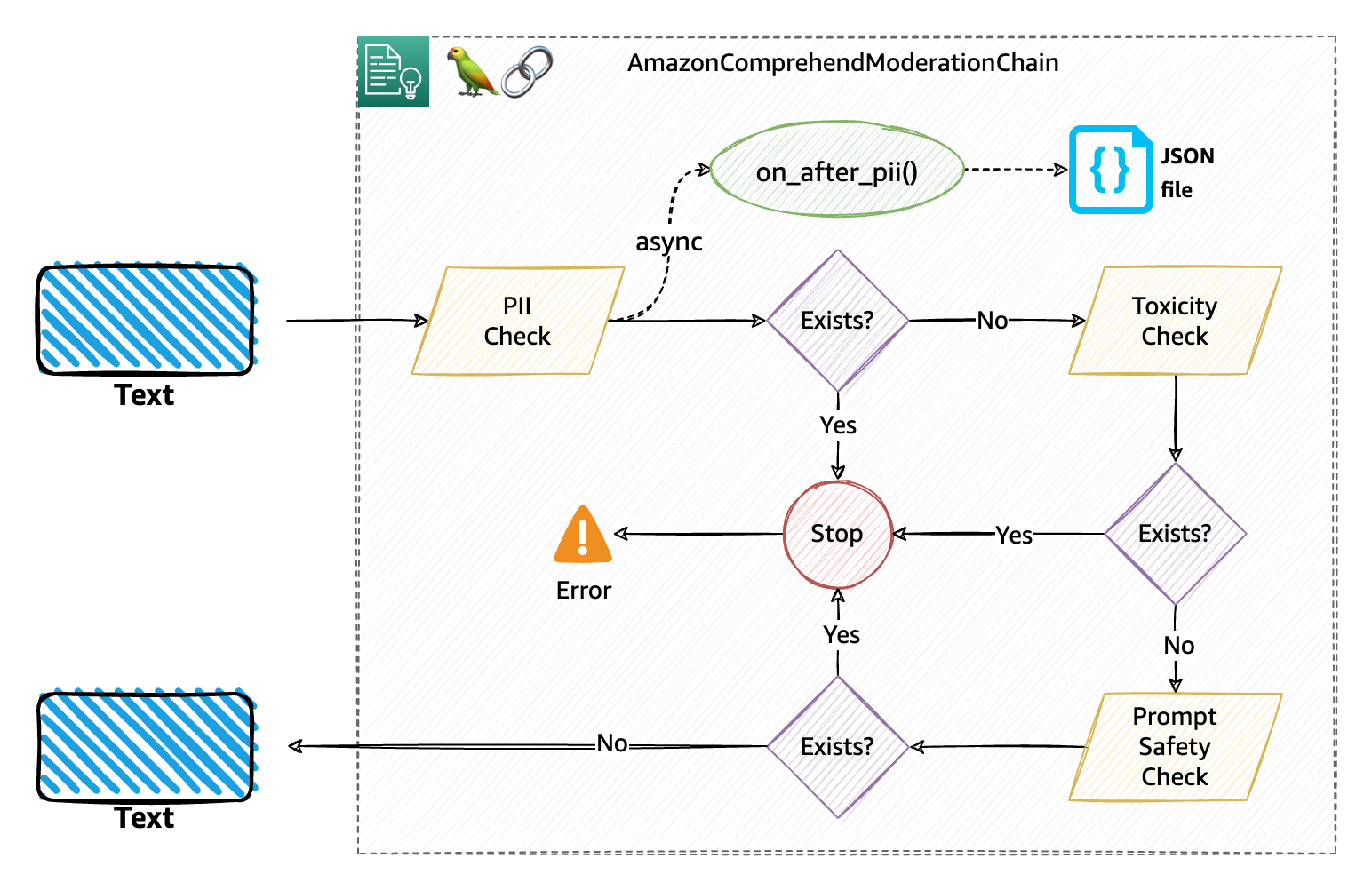

Bakom kulisserna utför modereringskedjan tre på varandra följande modereringskontroller, nämligen PII, toxicitet och snabb säkerhet, som förklaras i följande diagram. Detta är standardflödet för modereringen.

Följande kodavsnitt visar ett enkelt exempel på hur man använder modereringskedjan med Amazon FalconLite LLM (som är en kvantifierad version av Falcon 40B SFT OASST-TOP1 modell) värd i Hugging Face Hub:

I det föregående exemplet utökar vi vår kedja med comprehend_moderation för både text som går in i LLM och text som genereras av LLM. Detta kommer att utföra standardmoderering som kontrollerar PII, toxicitet och snabb säkerhetsklassificering i den sekvensen.

Anpassa din moderering med filterkonfigurationer

Du kan använda AmazonComprehendModerationChain med specifika konfigurationer, vilket ger dig möjligheten att styra vilka moderingar du vill utföra i din generativa AI-baserade applikation. I kärnan av konfigurationen har du tre tillgängliga filterkonfigurationer.

- ModereringPiiConfig – Används för att konfigurera PII-filter.

- ModereringToxicityConfig – Används för att konfigurera filter för giftigt innehåll.

- ModerationIntentConfig – Används för att konfigurera avsiktsfilter.

Du kan använda var och en av dessa filterkonfigurationer för att anpassa beteendet för hur dina modereringar beter sig. Varje filters konfigurationer har några vanliga parametrar, och några unika parametrar, som de kan initieras med. När du har definierat konfigurationerna använder du BaseModerationConfig klass för att definiera i vilken sekvens filtren måste tillämpas på texten. Till exempel, i följande kod definierar vi först de tre filterkonfigurationerna och anger sedan i vilken ordning de ska gälla:

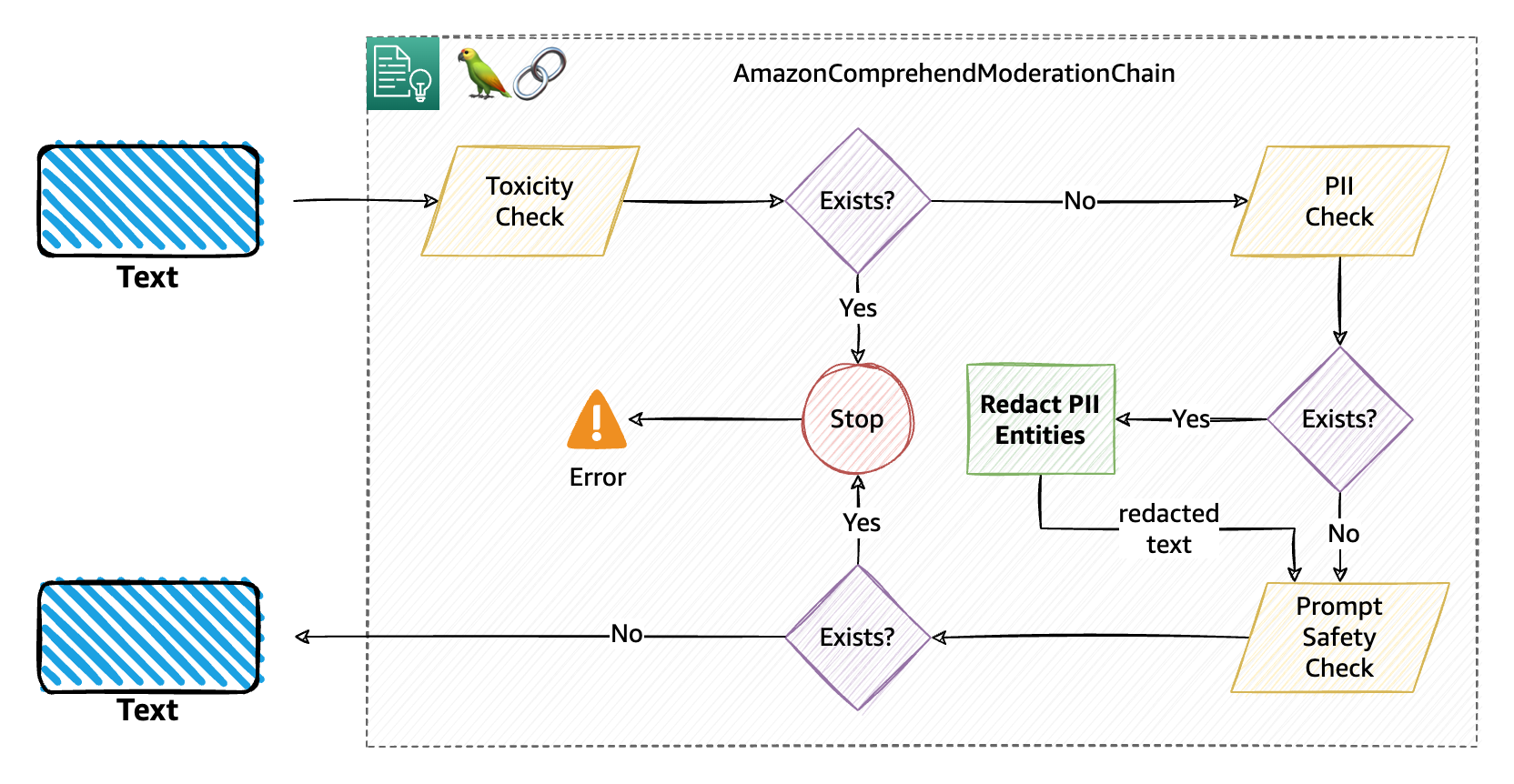

Låt oss dyka lite djupare för att förstå vad den här konfigurationen uppnår:

- Först, för toxicitetsfiltret, specificerade vi ett tröskelvärde på 0.6. Detta innebär att om texten innehåller någon av de tillgängliga giftiga etiketterna eller enheterna med en poäng som är högre än tröskeln, kommer hela kedjan att avbrytas.

- Om det inte finns något giftigt innehåll i texten är en PII-kontroll. I det här fallet är vi intresserade av att kontrollera om texten innehåller SSN-värden. Eftersom den

redactparameter är inställd påTrue, kommer kedjan att maskera de detekterade SSN-värdena (om några) där SSN-enhetens konfidenspoäng är större än eller lika med 0.5, med masktecknet specificerat (X). Omredactär inställd påFalse, kommer kedjan att avbrytas för eventuella SSN som detekteras. - Slutligen utför kedjan omedelbar säkerhetsklassificering och kommer att stoppa innehållet från att spridas längre ner i kedjan om innehållet klassificeras med

UNSAFE_PROMPTmed ett konfidensvärde som är större än eller lika med 0.8.

Följande diagram illustrerar detta arbetsflöde.

I händelse av avbrott i modereringskedjan (i detta exempel, tillämpligt för filtren för toxicitet och snabb säkerhetsklassificering), kommer kedjan att höja en Python undantag, i huvudsak stoppar den pågående kedjan och låter dig fånga undantaget (i ett försök-fångst-block) och utföra alla relevanta åtgärder. De tre möjliga undantagstyperna är:

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

Du kan konfigurera ett filter eller mer än ett filter med BaseModerationConfig. Du kan också ha samma typ av filter med olika konfigurationer inom samma kedja. Till exempel, om ditt användningsfall bara handlar om PII, kan du ange en konfiguration som måste avbryta kedjan om ett SSN upptäcks; I annat fall måste den utföra redigering på ålder och namn PII-enheter. En konfiguration för detta kan definieras enligt följande:

Använda återuppringningar och unika identifierare

Om du är bekant med begreppet arbetsflöden, kanske du också är bekant med återanrop. Callbacks inom arbetsflöden är oberoende bitar av kod som körs när vissa villkor är uppfyllda inom arbetsflödet. En återuppringning kan antingen vara blockerande eller icke-blockerande för arbetsflödet. LangChain-kedjor är i huvudsak arbetsflöden för LLM:er. AmazonComprehendModerationChain låter dig definiera dina egna återuppringningsfunktioner. Inledningsvis är implementeringen begränsad till endast asynkrona (icke-blockerande) återuppringningsfunktioner.

Detta betyder i praktiken att om du använder återuppringningar med modereringskedjan kommer de att köras oberoende av kedjans körning utan att blockera den. För modereringskedjan får du alternativ att köra bitar av kod, med vilken affärslogik som helst, efter varje moderering körs, oberoende av kedjan.

Du kan också valfritt tillhandahålla en godtycklig unik identifierarsträng när du skapar en AmazonComprehendModerationChain för att aktivera loggning och analyser senare. Till exempel, om du använder en chatbot som drivs av en LLM, kanske du vill spåra användare som konsekvent missbrukar eller medvetet eller omedvetet avslöjar personlig information. I sådana fall blir det nödvändigt att spåra ursprunget till sådana uppmaningar och kanske lagra dem i en databas eller logga dem på lämpligt sätt för vidare åtgärder. Du kan skicka ett unikt ID som tydligt identifierar en användare, till exempel deras användarnamn eller e-postadress, eller ett programnamn som genererar prompten.

Kombinationen av återuppringningar och unika identifierare ger dig ett kraftfullt sätt att implementera en modereringskedja som passar ditt användningsfall på ett mycket mer sammanhållet sätt med mindre kod som är lättare att underhålla. Återuppringningshanteraren är tillgänglig via BaseModerationCallbackHandler, med tre tillgängliga återuppringningar: on_after_pii(), on_after_toxicity()och on_after_prompt_safety(). Var och en av dessa återuppringningsfunktioner anropas asynkront efter att respektive modereringskontroll utförts inom kedjan. Dessa funktioner får också två standardparametrar:

- moderation_beacon – En ordbok som innehåller detaljer som texten som modereringen utfördes på, hela JSON-utdata från Amazon Comprehend API, typen av moderering och om de medföljande etiketterna (i konfigurationen) hittades i texten eller inte

- unikt ID – Det unika ID som du tilldelade när du initierade en instans av

AmazonComprehendModerationChain.

Följande är ett exempel på hur en implementering med callback fungerar. I det här fallet definierade vi en enda återuppringning som vi vill att kedjan ska köra efter att PII-kontrollen har utförts:

Vi använder sedan my_callback objekt medan modereringskedjan initieras och även passera en unique_id. Du kan använda återuppringningar och unika identifierare med eller utan en konfiguration. När du underklassar BaseModerationCallbackHandlermåste du implementera en eller alla återuppringningsmetoder beroende på vilka filter du tänker använda. För korthetens skull visar följande exempel ett sätt att använda återuppringningar och unique_id utan någon konfiguration:

Följande diagram förklarar hur denna modereringskedja med återuppringningar och unika identifierare fungerar. Närmare bestämt implementerade vi PII-återuppringningen som skulle skriva en JSON-fil med den information som finns tillgänglig i moderation_beacon och unique_id godkänd (användarens e-postadress i detta fall).

I följande Python anteckningsbok, har vi sammanställt några olika sätt du kan konfigurera och använda modereringskedjan med olika LLM:er, till exempel LLM:er som är värd Amazon SageMaker JumpStart och värd in Kramar Face Hub. Vi har också inkluderat exempelchattapplikationen som vi diskuterade tidigare med följande Python anteckningsbok.

Slutsats

Den transformativa potentialen hos stora språkmodeller och generativ AI är obestridlig. Men deras ansvarsfulla och etiska användning är beroende av att ta itu med frågor om förtroende och säkerhet. Genom att inse utmaningarna och aktivt implementera åtgärder för att minska risker kan utvecklare, organisationer och samhället i stort utnyttja fördelarna med dessa teknologier samtidigt som de bevarar det förtroende och säkerhet som ligger till grund för deras framgångsrika integration. Använd Amazon Comprehend ContentModerationChain för att lägga till förtroende- och säkerhetsfunktioner till alla LLM-arbetsflöden, inklusive Retrieval Augmented Generation (RAG)-arbetsflöden implementerade i LangChain.

För information om att bygga RAG-baserade lösningar med LangChain och Amazon Kendras mycket exakta, maskininlärningsdrivna (ML) intelligent sökning, ser - Bygg snabbt generativa AI-applikationer med hög precision på företagsdata med hjälp av Amazon Kendra, LangChain och stora språkmodeller. Som nästa steg, se kodprover vi skapade för att använda Amazon Comprehend-moderering med LangChain. För fullständig dokumentation av Amazon Comprehend modereringskedjans API, se LangChain API dokumentation.

Om författarna

Wrick Talukdar är seniorarkitekt med Amazon Comprehend Service-teamet. Han arbetar med AWS-kunder för att hjälpa dem att ta till sig maskininlärning i stor skala. Utanför jobbet tycker han om att läsa och fotografera.

Wrick Talukdar är seniorarkitekt med Amazon Comprehend Service-teamet. Han arbetar med AWS-kunder för att hjälpa dem att ta till sig maskininlärning i stor skala. Utanför jobbet tycker han om att läsa och fotografera.

Anjan Biswas är Senior AI Services Solutions Architect med fokus på AI/ML och Data Analytics. Anjan är en del av det världsomspännande AI-serviceteamet och arbetar med kunder för att hjälpa dem att förstå och utveckla lösningar på affärsproblem med AI och ML. Anjan har över 14 års erfarenhet av att arbeta med globala supply chain-, tillverknings- och detaljhandelsorganisationer och hjälper aktivt kunder att komma igång och skala på AWS AI-tjänster.

Anjan Biswas är Senior AI Services Solutions Architect med fokus på AI/ML och Data Analytics. Anjan är en del av det världsomspännande AI-serviceteamet och arbetar med kunder för att hjälpa dem att förstå och utveckla lösningar på affärsproblem med AI och ML. Anjan har över 14 års erfarenhet av att arbeta med globala supply chain-, tillverknings- och detaljhandelsorganisationer och hjälper aktivt kunder att komma igång och skala på AWS AI-tjänster.

Nikhil Jha är Senior Technical Account Manager på Amazon Web Services. Hans fokusområden inkluderar AI/ML och analys. På fritiden tycker han om att spela badminton med sin dotter och utforska naturen.

Nikhil Jha är Senior Technical Account Manager på Amazon Web Services. Hans fokusområden inkluderar AI/ML och analys. På fritiden tycker han om att spela badminton med sin dotter och utforska naturen.

Chin Rane är en AI/ML Specialist Solutions Architect på Amazon Web Services. Hon brinner för tillämpad matematik och maskininlärning. Hon fokuserar på att designa intelligenta dokumentbehandlingslösningar för AWS-kunder. Utanför jobbet tycker hon om att dansa salsa och bachata.

Chin Rane är en AI/ML Specialist Solutions Architect på Amazon Web Services. Hon brinner för tillämpad matematik och maskininlärning. Hon fokuserar på att designa intelligenta dokumentbehandlingslösningar för AWS-kunder. Utanför jobbet tycker hon om att dansa salsa och bachata.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 100

- 11

- 12

- 14

- 15%

- 17

- 19

- 500

- 7

- 8

- 9

- a

- förmågor

- förmåga

- Om Oss

- missbruk

- tillgång

- Konto

- exakt

- uppnår

- tvärs

- Handling

- åtgärder

- aktivt

- lägga till

- adress

- adresser

- adresse

- anslutit sig

- anta

- Antagande

- rådgivning

- Efter

- ålder

- AI

- AI-tjänster

- AI-system

- AI / ML

- Alla

- tillåts

- tillåta

- tillåter

- redan

- också

- sammanlagt

- amason

- Amazon Comprehend

- Amazon Kendra

- Amazon Web Services

- mängder

- an

- analytics

- analyser

- och

- Vi presenterar

- svara

- vilken som helst

- api

- API: er

- tillämplig

- Ansökan

- tillämpningar

- tillämpas

- applicerar

- Ansök

- lämpligt

- lämpligt

- ÄR

- områden

- AS

- be

- be

- aspekter

- delad

- assistenter

- associerad

- At

- förstärka

- augmented

- tillgänglig

- AWS

- dragen tillbaka

- Badrum

- bas

- baserat

- BE

- därför att

- blir

- blir

- beteende

- Där vi får lov att vara utan att konstant prestera,

- föreställningar

- Fördelarna

- mellan

- Bortom

- Blockera

- blockering

- båda

- gränser

- bredare

- SLUTRESULTAT

- bygga förtroende

- Byggnad

- byggt

- företag

- företag

- men

- by

- Ring

- återanrop

- kallas

- KAN

- kapacitet

- kapacitet

- kapabel

- kapital

- kortet

- Vid

- fall

- brottning

- vissa

- kedja

- kedjor

- utmaningar

- karaktär

- chatbot

- chatbots

- ta

- kontroll

- Kontroller

- haka

- val

- klass

- klasser

- klassificering

- klassificerad

- klassificera

- klient

- koda

- sammanhängande

- COM

- kombination

- kombinerad

- kommentar

- Gemensam

- komplex

- komponenter

- förstå

- begrepp

- aktuella

- oro

- villkor

- förtroende

- konfiguration

- i följd

- konsekvent

- innehåller

- innehåll

- Innehållsgenerering

- kontroll

- kontroversiell

- Kärna

- skapas

- Skapa

- Kreativ

- kredit

- kreditkort

- kritisk

- avgörande

- beställnings

- kund

- Helpdesk

- Kunder

- anpassningsbar

- skräddarsy

- dagligen

- Dans

- datum

- Data Analytics

- dataintegritet

- Databas

- datauppsättningar

- beslut

- djupare

- Standard

- definiera

- definierade

- gräva

- demonstrera

- demonstrerar

- beroende

- design

- önskas

- detaljer

- upptäcka

- detekterad

- Detektering

- Bestämma

- utveckla

- utvecklare

- Utveckling

- olika

- digital

- diskutera

- diskuteras

- tydligt

- Dyk

- do

- dokumentera

- dokumentation

- dokument

- doe

- ner

- grund

- e

- varje

- Tidigare

- lättare

- effektivt

- enkel

- antingen

- annars

- möjliggöra

- änden

- Endless

- säkerställa

- säkerställa

- Företag

- enheter

- enhet

- Miljö

- lika

- lika

- fel

- huvudsak

- väsentlig

- väsentligen

- etisk

- exempel

- exempel

- Utom

- undantag

- befintliga

- erfarenhet

- Erfarenheter

- Förklara

- förklarade

- Förklarar

- uttryckligen

- Utforska

- uttrycker

- sträcker

- extrahera

- Ansikte

- bekant

- Leverans

- Funktioner

- få

- Fil

- filtrera

- filtrering

- filter

- finansiella

- hitta

- fynd

- Förnamn

- flaggad

- flaggorna

- flexibel

- flöda

- Fokus

- fokuserade

- fokuserar

- efter

- följer

- För

- formen

- format

- former

- forum

- hittade

- Ramverk

- Frankrike

- från

- full

- funktioner

- ytterligare

- generera

- genereras

- generera

- generering

- generativ

- Generativ AI

- skaffa sig

- gif

- Ge

- ges

- ger

- Välgörenhet

- Målet

- Går

- kommer

- god

- större

- Växer

- Tillväxt

- vägleda

- Arbetsmiljö

- händer

- skadliga

- sele

- hatar

- Har

- har

- he

- hjälpa

- hjälpa

- hjälper

- höggradigt

- gångjärn

- hans

- värd

- Hur ser din drömresa ut

- How To

- Men

- html

- HTTPS

- Nav

- humant

- människolik

- i

- ID

- Identifiering

- identifierare

- identifierare

- identifierar

- identifiera

- identifiera

- if

- Olaglig

- illustrerar

- bild

- Inverkan

- genomföra

- genomförande

- genomföras

- genomföra

- importera

- vikt

- med Esport

- in

- oavsiktligt

- innefattar

- ingår

- innefattar

- Inklusive

- Öka

- Ökar

- alltmer

- oberoende

- oberoende av

- industrier

- påverka

- informationen

- initialt

- ingång

- ingångar

- förfrågningar

- exempel

- integrerade

- integrering

- Intelligent

- Intelligent dokumentbehandling

- avser

- uppsåt

- intresserad

- Gränssnitt

- avbruten

- in

- införa

- IT

- DESS

- John

- John doe

- jpg

- json

- bara

- Etiketter

- språk

- Large

- senare

- inlärning

- vänster

- Adress

- mindre

- tycka om

- sannolikhet

- Begränsad

- Lista

- liten

- lite djupare

- LLM

- log

- skogsavverkning

- Logiken

- du letar

- Maskinen

- maskininlärning

- bibehålla

- GÖR

- chef

- sätt

- Produktion

- mask

- matematik

- Materia

- Maj..

- me

- betyder

- åtgärder

- mekanism

- Media

- medicinsk

- sammanslagning

- träffade

- metoder

- missbruka

- Mildra

- Blandning

- ML

- modell

- modeller

- måttfullhet

- modulära

- mer

- mycket

- måste

- my

- namn

- nämligen

- namn

- Natural

- Naturlig språkbehandling

- nödvändigt för

- Nya

- Nya funktioner

- Nästa

- nlp

- Nej

- nu

- antal

- nummer

- talrik

- objektet

- of

- offensiv

- erbjudanden

- förskjutningar

- on

- ONE

- endast

- öppet

- öppen källkod

- driva

- drift

- Tillbehör

- or

- beställa

- organisationer

- ursprung

- Övriga

- annat

- vår

- ut

- utfall

- utomhus

- produktion

- utgångar

- utanför

- över

- egen

- parameter

- parametrar

- Yttersta

- del

- särskilt

- passera

- Godkänd

- brinner

- Lösenord

- lösenordsåterställning

- Mönster

- Utföra

- utfört

- utför

- kanske

- personlig

- Personligen

- telefon

- fotografi

- bit

- bitar

- Plattformar

- plato

- Platon Data Intelligence

- PlatonData

- i

- politiska

- Populära

- placera

- positiv

- Möjligheterna

- möjlig

- Inlägg

- potentiell

- potentiellt

- kraft

- drivs

- den mäktigaste

- konservering

- förebyggande

- primärt

- primär

- Principerna

- prioritering

- privatpolicy

- privat

- privat information

- problem

- förfaranden

- process

- bearbetning

- djupgående

- Framsteg

- ordentligt

- skydda

- ge

- ger

- Python

- fråga

- höja

- område

- intervall

- snabb

- snarare

- nå

- Läsning

- rike

- motta

- känna igen

- minska

- reducerande

- hänvisa

- region

- regulatorer

- relevanta

- pålitlig

- rykte

- begära

- Krav

- resurs

- att

- respons

- svar

- ansvaret

- ansvarig

- begränsningar

- detaljhandeln

- återgår

- höger

- Risk

- risker

- Körning

- s

- säker

- Säkerhet

- sagemaker

- Samma

- Skala

- scener

- göra

- sömlös

- §

- sektioner

- säkerhet

- se

- Seek

- SJÄLV

- senior

- känslig

- skickas

- mening

- Sekvens

- service

- Tjänster

- in

- hon

- skall

- show

- visa

- visas

- Visar

- signaler

- Liknande

- Enkelt

- förenkla

- enda

- Områden

- kodavsnitt

- So

- Social hållbarhet

- sociala medier

- Samhället

- Lösningar

- några

- något

- Källa

- källkod

- talar

- specialist

- specifik

- specifikt

- specificerade

- tal

- standarder

- starta

- igång

- .

- Steg

- Sluta

- stoppa

- lagra

- Sträng

- Senare

- framgångsrik

- sådana

- levereras

- leverera

- leveranskedjan

- stödja

- Stöder

- hållbart

- System

- Ta

- uppgifter

- grupp

- Teknisk

- Tekniken

- mall

- text

- än

- den där

- Smakämnen

- Huvudstaden

- källan

- deras

- Dem

- sedan

- Där.

- vari

- Dessa

- de

- detta

- hot

- tre

- tröskelvärde

- Genom

- tid

- till

- verktyg

- spår

- tränad

- transformativ

- Litar

- prova

- två

- Typ

- typer

- avslöja

- obestridlig

- stödja

- förstå

- förståelse

- unika

- Universell

- upprätthålla

- användning

- användningsfall

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- utnyttja

- utnyttjas

- Värdefulla

- värde

- Värden

- mängd

- olika

- Omfattande

- version

- via

- Virtuell

- W

- vill

- var

- Sätt..

- sätt

- we

- webb

- webbservice

- VÄL

- były

- Vad

- Vad är

- när

- medan

- om

- som

- medan

- VEM

- Hela

- varför

- bred

- Brett utbud

- kommer

- önskar

- med

- inom

- utan

- bevittnar

- Arbete

- arbetsflöde

- arbetsflöden

- arbetssätt

- fungerar

- skriva

- skrivning

- X

- år

- Om er

- Din

- zephyrnet