Fröet till ett paradigmskifte för maskininlärning (ML) har funnits i årtionden, men med den lätta tillgängligheten av praktiskt taget oändlig beräkningskapacitet, en massiv spridning av data och den snabba utvecklingen av ML-tekniker, anammar och använder kunder inom olika branscher snabbt ML teknik för att förändra sina företag.

Nyligen har generativa AI-applikationer fångat allas uppmärksamhet och fantasi. Vi befinner oss verkligen vid en spännande brytpunkt i den utbredda användningen av ML, och vi tror att varje kundupplevelse och applikation kommer att återuppfinnas med generativ AI.

Generativ AI är en typ av AI som kan skapa nytt innehåll och nya idéer, inklusive konversationer, berättelser, bilder, videor och musik. Liksom all AI drivs generativ AI av ML-modeller – mycket stora modeller som är förtränade på stora datakorpora och som vanligtvis kallas grundmodeller (FM).

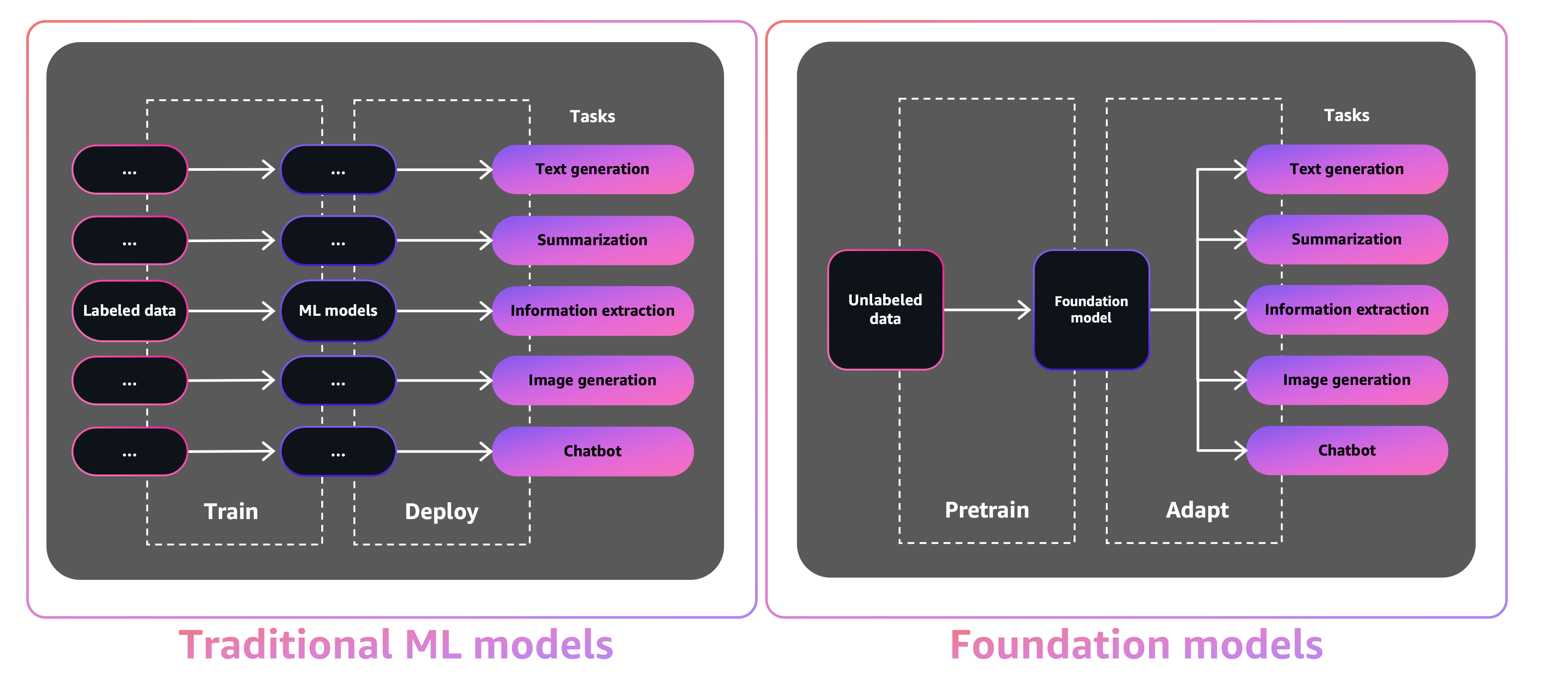

Storleken och den allmänna karaktären hos FM:er skiljer dem från traditionella ML-modeller, som vanligtvis utför specifika uppgifter, som att analysera text för känslor, klassificera bilder och prognostisera trender.

Med traditionella ML-modeller, för att uppnå varje specifik uppgift, måste du samla in märkta data, träna en modell och distribuera den modellen. Med grundmodeller kan du istället för att samla in märkt data för varje modell och träna flera modeller använda samma förtränade FM för att anpassa olika uppgifter. Du kan också anpassa FM:er för att utföra domänspecifika funktioner som skiljer sig åt för dina företag, genom att bara använda en liten bråkdel av den data och beräkning som krävs för att träna en modell från grunden.

Generativ AI har potential att störa många branscher genom att revolutionera hur innehåll skapas och konsumeras. Originalinnehållsproduktion, kodgenerering, förbättring av kundtjänst och dokumentsammanfattning är typiska användningsfall av generativ AI.

Amazon SageMaker JumpStart tillhandahåller förutbildade modeller med öppen källkod för ett brett utbud av problemtyper för att hjälpa dig komma igång med ML. Du kan stegvis träna och ställa in dessa modeller före driftsättning. JumpStart tillhandahåller också lösningsmallar som ställer in infrastruktur för vanliga användningsfall och körbara exempel anteckningsböcker för ML med Amazon SageMaker.

Med över 600 förutbildade modeller tillgängliga och växer varje dag, gör JumpStart det möjligt för utvecklare att snabbt och enkelt införliva banbrytande ML-tekniker i sina produktionsarbetsflöden. Du kan komma åt de förutbildade modellerna, lösningsmallarna och exemplen via JumpStart-målsidan i Amazon SageMaker Studio. Du kan också komma åt JumpStart-modeller med SageMaker Python SDK. För information om hur du använder JumpStart-modeller programmatiskt, se Använd SageMaker JumpStart-algoritmer med förtränade modeller.

I april 2023 presenterades AWS Amazonas berggrund, som ger ett sätt att bygga generativa AI-drivna appar via förutbildade modeller från startups, inklusive AI21 Labs, Antropiskoch Stabilitet AI. Amazon Bedrock erbjuder också tillgång till Titan Foundation-modeller, en familj av modeller som utbildats internt av AWS. Med den serverlösa upplevelsen av Amazon Bedrock kan du enkelt hitta rätt modell för dina behov, komma igång snabbt, privatanpassa FMs med din egen data och enkelt integrera och distribuera dem i dina applikationer med hjälp av AWS-verktygen och funktionerna du känner till. med (inklusive integrationer med SageMaker ML-funktioner som Amazon SageMaker-experiment att testa olika modeller och Amazon SageMaker-rörledningar att hantera dina FMs i stor skala) utan att behöva hantera någon infrastruktur.

I det här inlägget visar vi hur man distribuerar bild- och textgenerativa AI-modeller från JumpStart med hjälp av AWS Cloud Development Kit (AWS CDK). AWS CDK är ett ramverk för programvaruutveckling med öppen källkod för att definiera dina molnapplikationsresurser med hjälp av välbekanta programmeringsspråk som Python.

Vi använder modellen Stable Diffusion för bildgenerering och FLAN-T5-XL-modellen för naturlig språkförståelse (NLU) och textgenerering från Kramande ansikte i JumpStart.

Lösningsöversikt

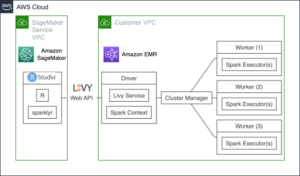

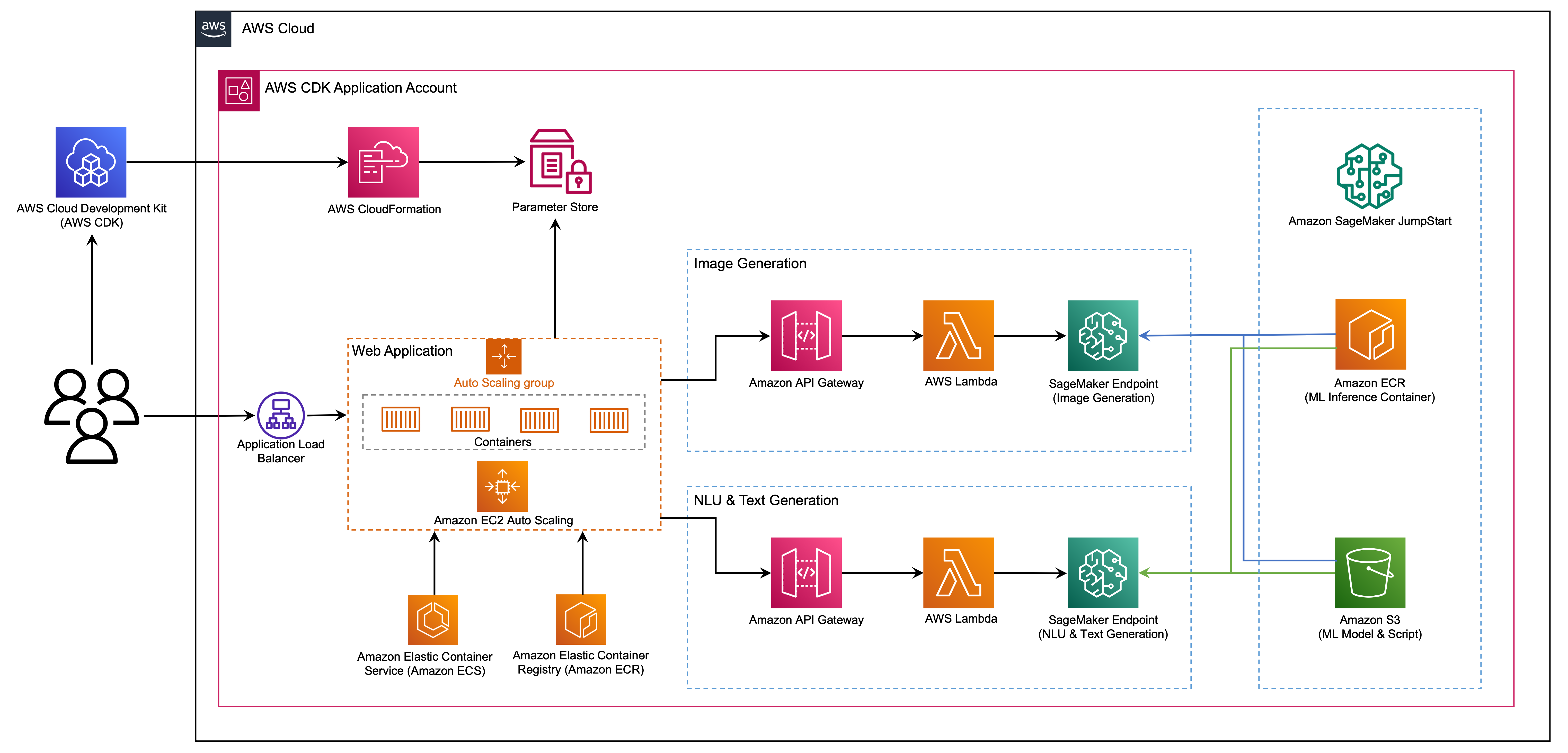

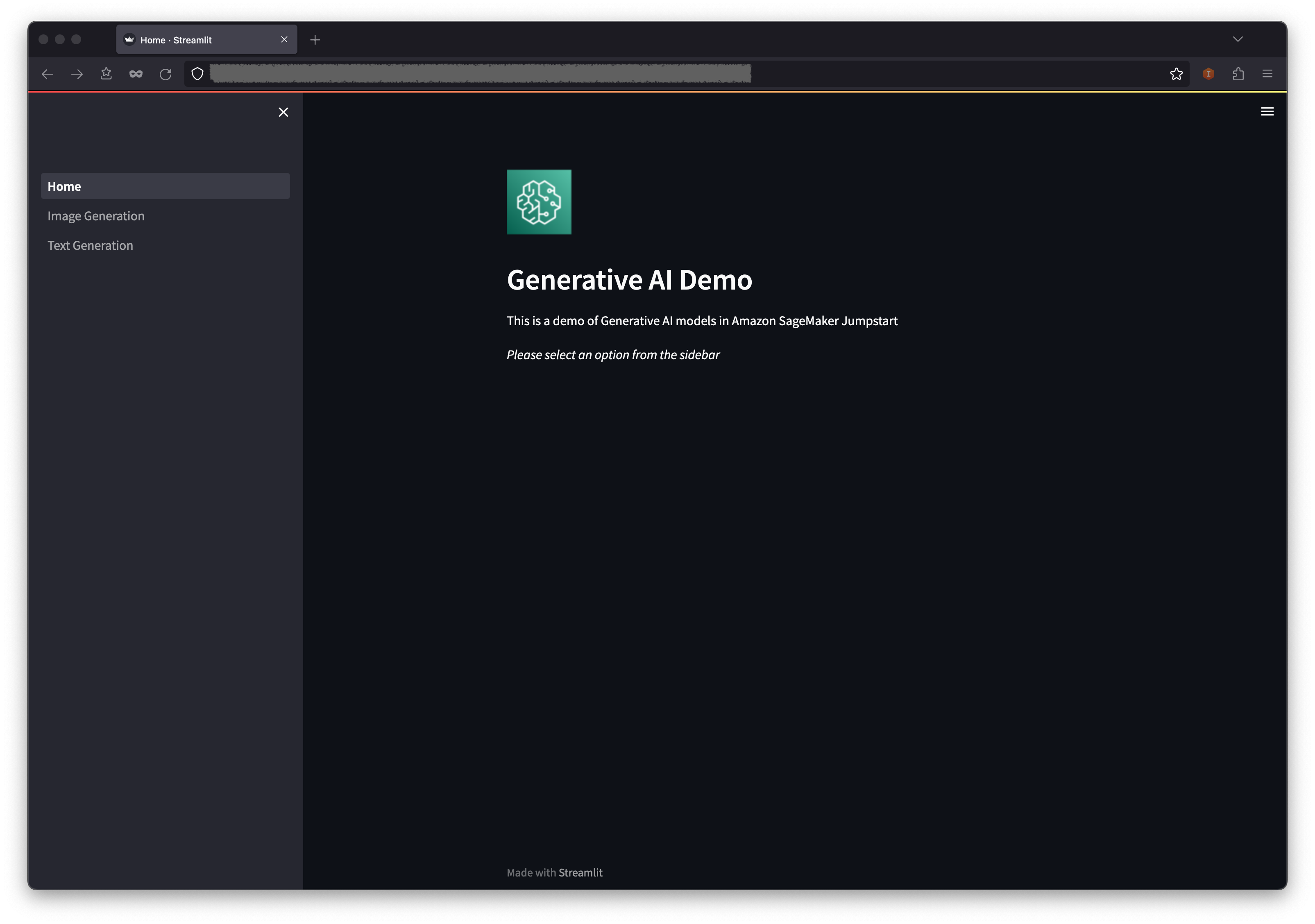

Webbapplikationen är byggd på Strömbelyst, ett Python-bibliotek med öppen källkod som gör det enkelt att skapa och dela vackra, anpassade webbappar för ML och datavetenskap. Vi är värd för webbapplikationen med hjälp av Amazon Elastic Container Service (Amazon ECS) med AWS Fargate och den nås via en Application Load Balancer. Fargate är en teknik som du kan använda med Amazon ECS för att köra behållare utan att behöva hantera servrar eller kluster eller virtuella maskiner. De generativa AI-modellens slutpunkter lanseras från JumpStart-bilder i Amazon Elastic Container Registry (Amazon ECR). Modelldata lagras på Amazon enkel lagringstjänst (Amazon S3) i JumpStart-kontot. Webbapplikationen interagerar med modellerna via Amazon API Gateway och AWS Lambda fungerar som visas i följande diagram.

API Gateway tillhandahåller webbapplikationen och andra klienter ett standard RESTful-gränssnitt, samtidigt som de skyddar Lambda-funktionerna som gränssnitt med modellen. Detta förenklar klientapplikationskoden som förbrukar modellerna. API Gateway-ändpunkterna är offentligt tillgängliga i det här exemplet, vilket ger möjlighet att utöka denna arkitektur för att implementera olika API-åtkomstkontroller och integrera med andra applikationer.

I det här inlägget går vi igenom följande steg:

- installera AWS-kommandoradsgränssnitt (AWS CLI) och AWS CDK v2 på din lokala maskin.

- Klona och ställ in AWS CDK-applikationen.

- Distribuera AWS CDK-applikationen.

- Använd AI-modellen för bildgenerering.

- Använd AI-modellen för textgenerering.

- Se de distribuerade resurserna på AWS Management Console.

Vi ger en översikt över koden i detta projekt i bilagan i slutet av detta inlägg.

Förutsättningar

Du måste ha följande förutsättningar:

Du kan distribuera infrastrukturen i den här handledningen från din lokala dator eller så kan du använda den AWS Cloud9 som din distributionsarbetsstation. AWS Cloud9 kommer förinstallerat med AWS CLI, AWS CDK och Docker. Om du väljer AWS Cloud9, skapa miljön från AWS-konsol.

Den beräknade kostnaden för att slutföra detta inlägg är $50, förutsatt att du låter resurserna vara igång i 8 timmar. Se till att du tar bort resurserna du skapar i det här inlägget för att undvika pågående avgifter.

Installera AWS CLI och AWS CDK på din lokala dator

Om du inte redan har AWS CLI på din lokala dator, se Installera eller uppdatera den senaste versionen av AWS CLI och Konfigurera AWS CLI.

Installera AWS CDK Toolkit globalt med hjälp av följande kommando för nodpakethanterare:

Kör följande kommando för att verifiera korrekt installation och skriv ut versionsnumret för AWS CDK:

Se till att du har Docker installerat på din lokala dator. Ge följande kommando för att verifiera versionen:

Klona och ställ in AWS CDK-applikationen

På din lokala dator, klona AWS CDK-applikationen med följande kommando:

Navigera till projektmappen:

Innan vi distribuerar programmet, låt oss granska katalogstrukturen:

Smakämnen stack mappen innehåller koden för varje stack i AWS CDK-applikationen. De code mappen innehåller koden för Lambda-funktionerna. Förvaret innehåller även webbapplikationen som finns under mappen web-app.

Smakämnen cdk.json filen berättar för AWS CDK Toolkit hur du kör din applikation.

Denna applikation testades i us-east-1 Region, men det bör fungera i alla regioner som har de nödvändiga tjänsterna och typen av slutledningsinstans ml.g4dn.4xlarge specificeras i app.py.

Skapa en virtuell miljö

Detta projekt är konfigurerat som ett standard Python-projekt. Skapa en virtuell Python-miljö med följande kod:

Använd följande kommando för att aktivera den virtuella miljön:

Om du är på en Windows-plattform, aktivera den virtuella miljön enligt följande:

När den virtuella miljön har aktiverats, uppgradera pip till den senaste versionen:

Installera nödvändiga beroenden:

Innan du distribuerar någon AWS CDK-applikation måste du starta upp ett utrymme i ditt konto och den region du distribuerar till. För att starta upp i din standardregion, utfärda följande kommando:

Om du vill distribuera till ett specifikt konto och område, utfärda följande kommando:

För mer information om denna inställning, besök Komma igång med AWS CDK.

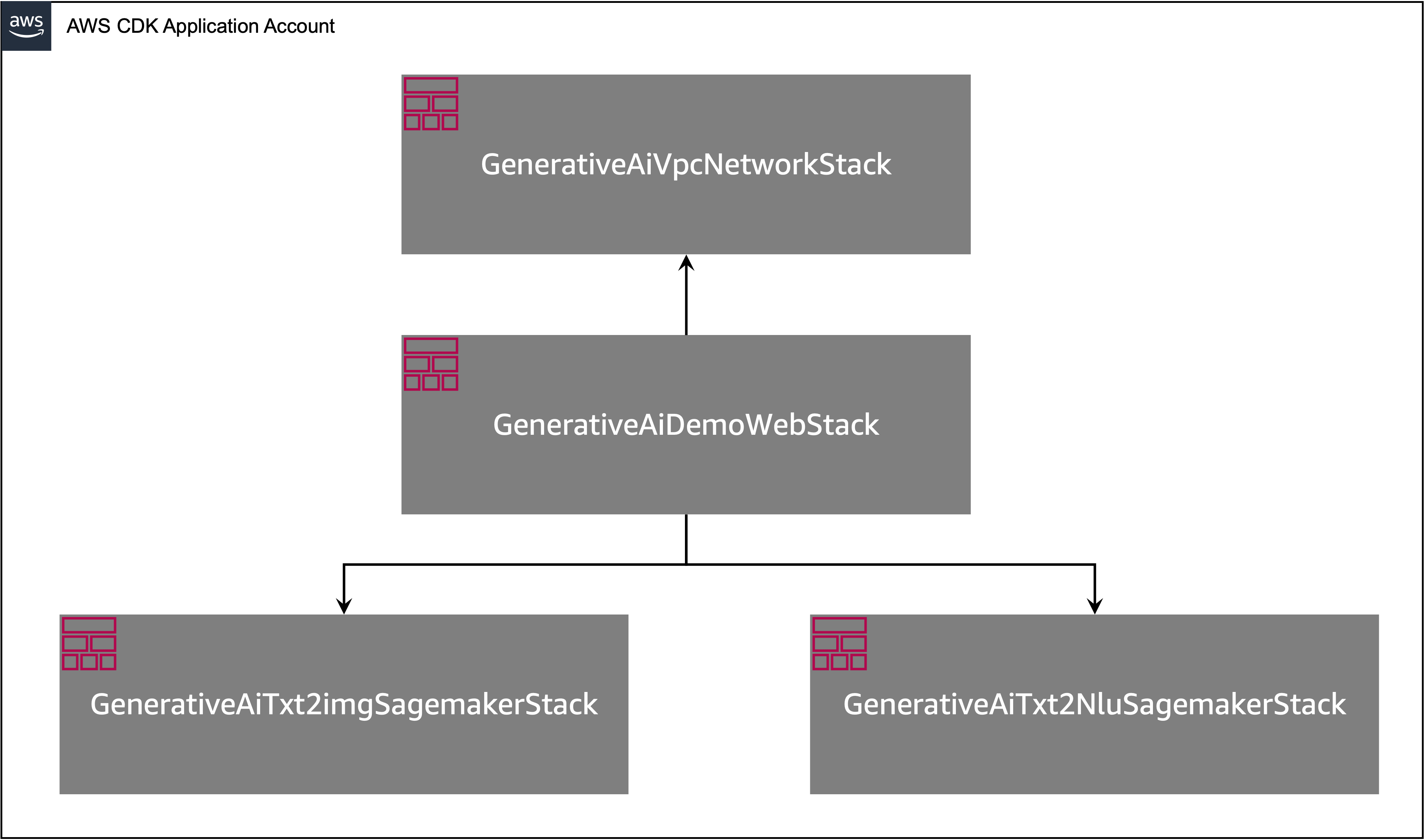

AWS CDK-applikationsstackstruktur

AWS CDK-applikationen innehåller flera stackar, som visas i följande diagram.

Du kan lista stackarna i din AWS CDK-applikation med följande kommando:

Följande är andra användbara AWS CDK-kommandon:

- cdk ls – Listar alla stackar i appen

- cdk synth – Avger det syntetiserade AWS molnformation mall

- cdk distribuera – Distribuerar denna stack till ditt standard AWS-konto och -region

- cdk diff – Jämför den utplacerade stacken med nuvarande tillstånd

- cdk docs – Öppnar AWS CDK-dokumentationen

Nästa avsnitt visar hur du distribuerar AWS CDK-applikationen.

Distribuera AWS CDK-applikationen

AWS CDK-applikationen kommer att distribueras till standardregionen baserat på din arbetsstationskonfiguration. Om du vill tvinga utplaceringen i en specifik region, ställ in din AWS_DEFAULT_REGION miljövariabel i enlighet med detta.

Vid det här laget kan du distribuera AWS CDK-applikationen. Först startar du VPC-nätverksstacken:

Om du uppmanas, skriv in y för att fortsätta med distributionen. Du bör se en lista över AWS-resurser som tillhandahålls i stacken. Det här steget tar cirka 3 minuter att slutföra.

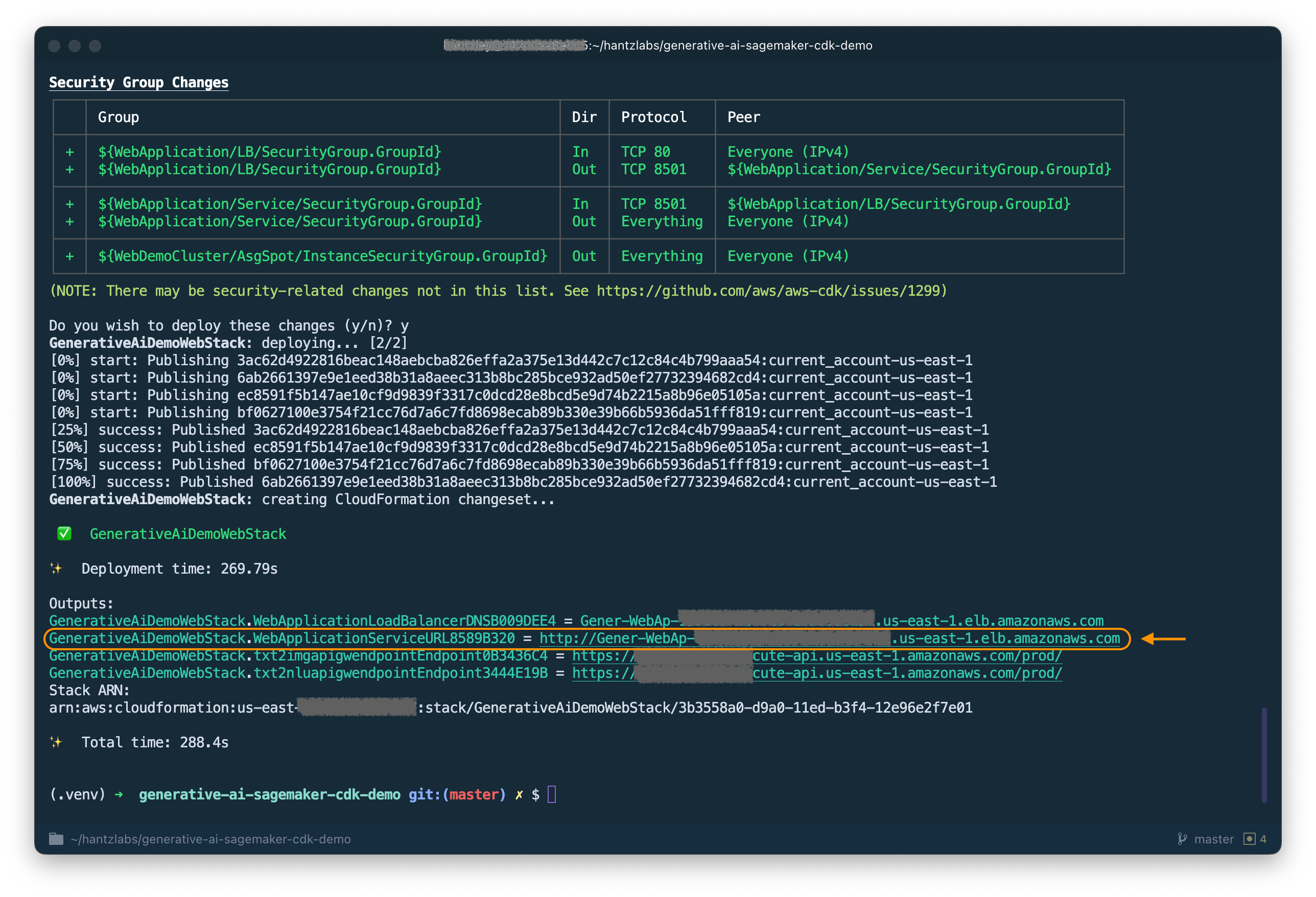

Sedan startar du webbapplikationsstacken:

Efter att ha analyserat stacken kommer AWS CDK att visa resurslistan i stacken. Ange y för att fortsätta med distributionen. Detta steg tar cirka 5 minuter.

Notera ner WebApplicationServiceURL från utgången för att användas senare. Du kan också hämta den på AWS CloudFormation-konsolen, under GenerativeAiDemoWebStack stack utgångar.

Starta nu den bildgenererande AI-modellens slutpunktsstack:

Detta steg tar cirka 8 minuter. Bildgenereringsmodellens slutpunkt är utplacerad, vi kan nu använda den.

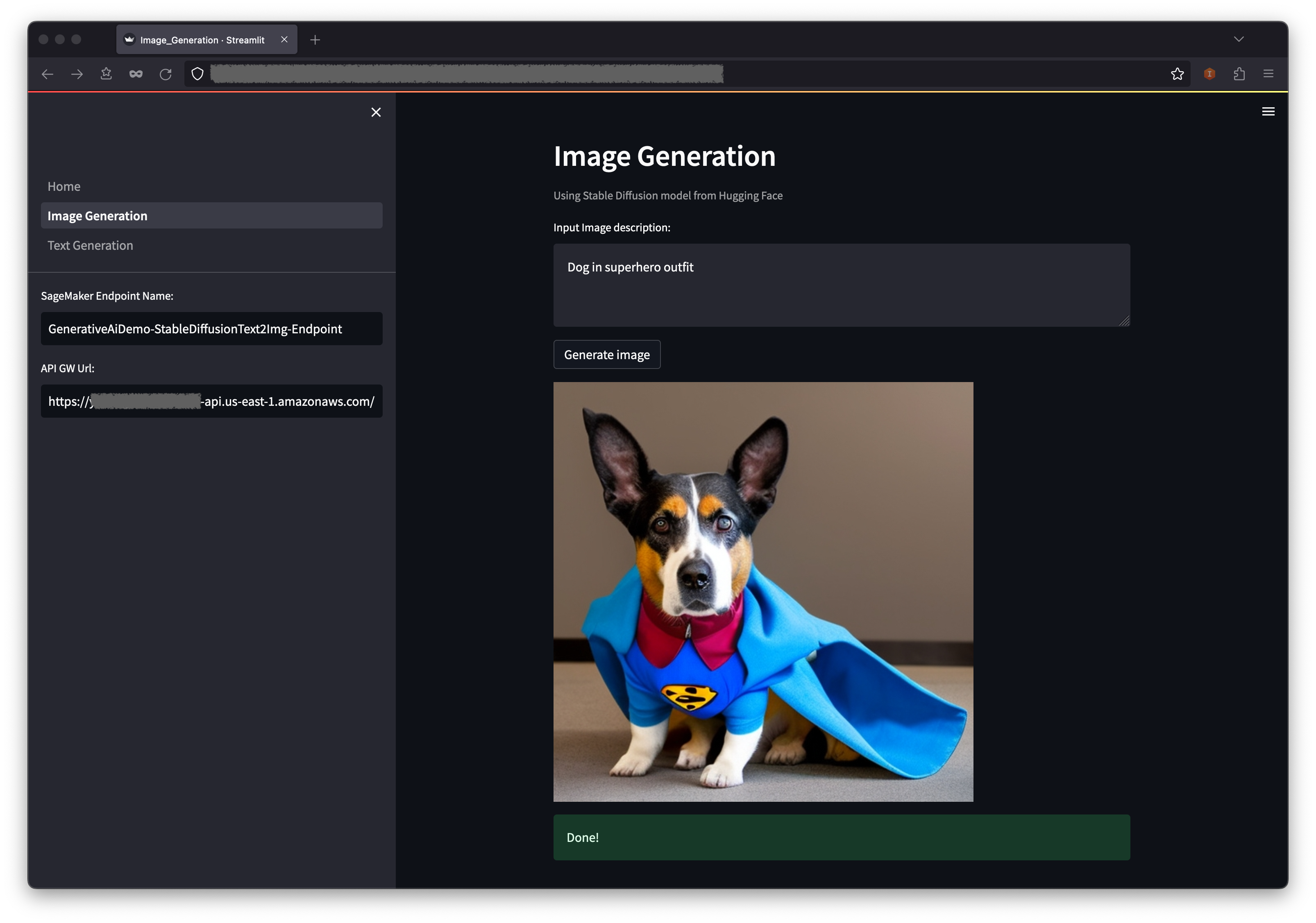

Använd AI-modellen för bildgenerering

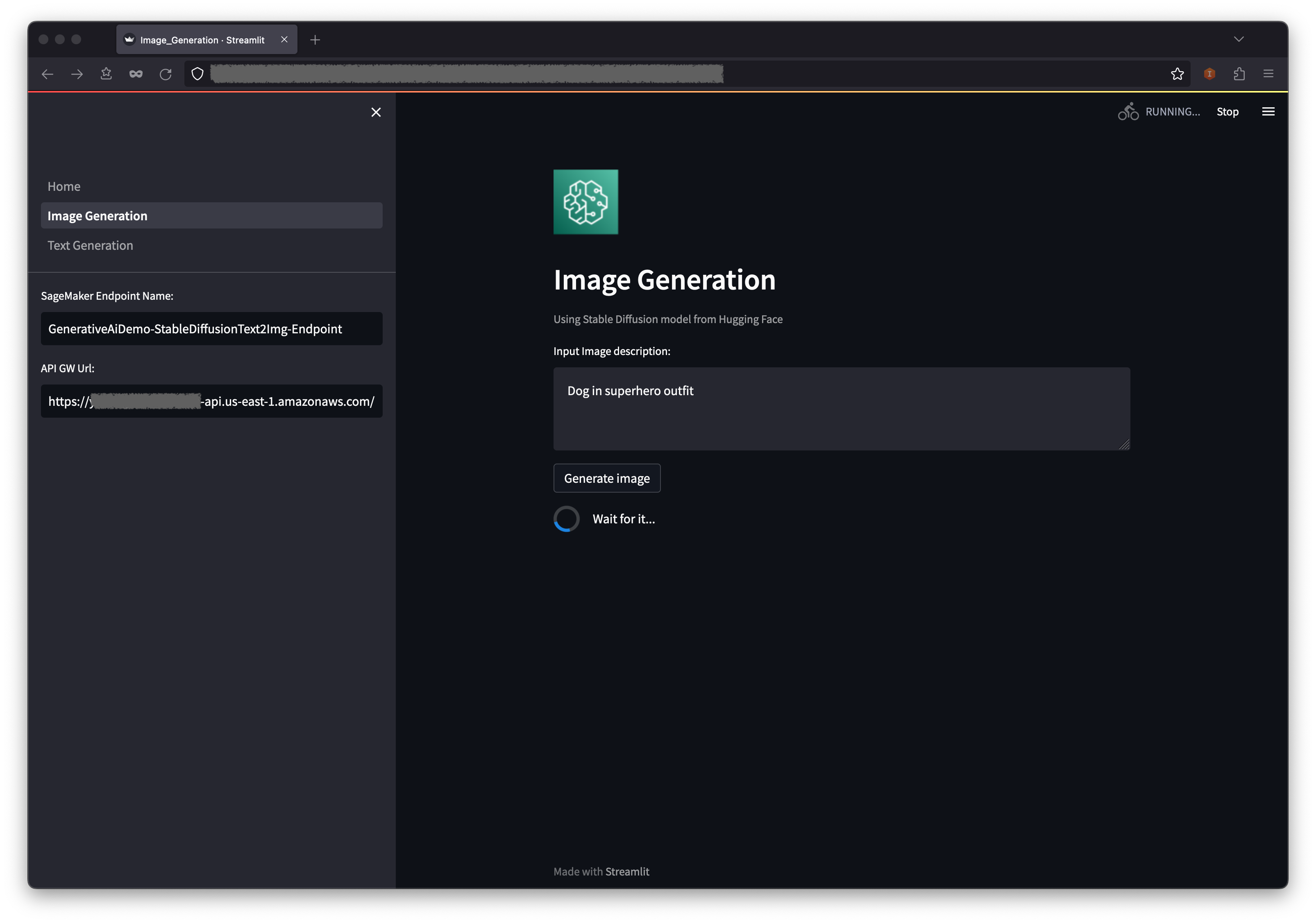

Det första exemplet visar hur man använder Stable Diffusion, en kraftfull generativ modelleringsteknik som möjliggör skapandet av högkvalitativa bilder från textuppmaningar.

- Gå till webbapplikationen med hjälp av

WebApplicationServiceURLfrån utgången avGenerativeAiDemoWebStacki din webbläsare.

- Välj i navigeringsfönstret Bildgenerering.

- Smakämnen SageMaker Endpoint Name och API GW URL fält kommer att vara förifyllda, men du kan ändra uppmaningen för bildbeskrivningen om du vill.

- Välja Skapa bild.

- Applikationen kommer att ringa till SageMaker-slutpunkten. Det tar några sekunder. En bild med egenskaperna i din bildbeskrivning kommer att visas.

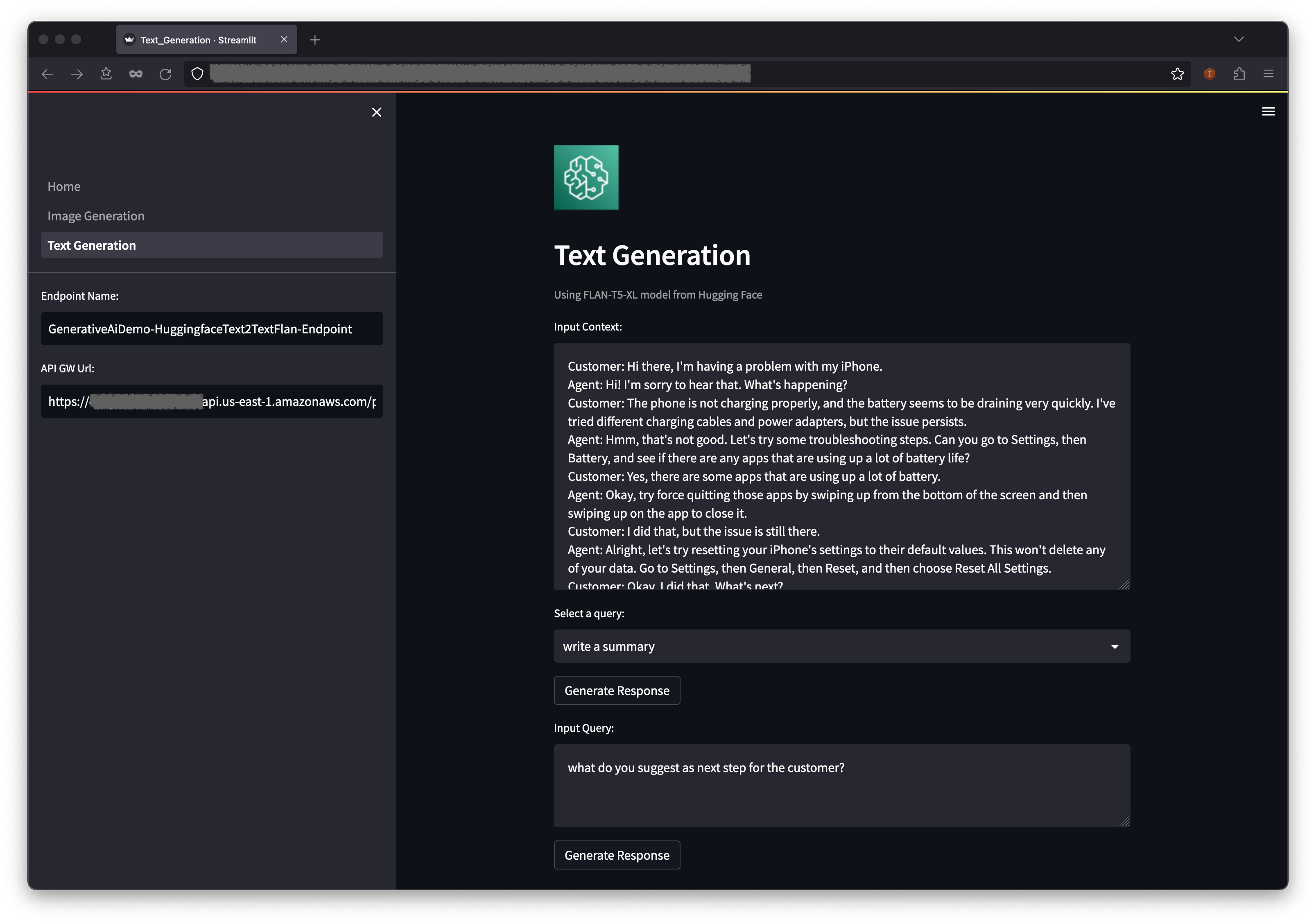

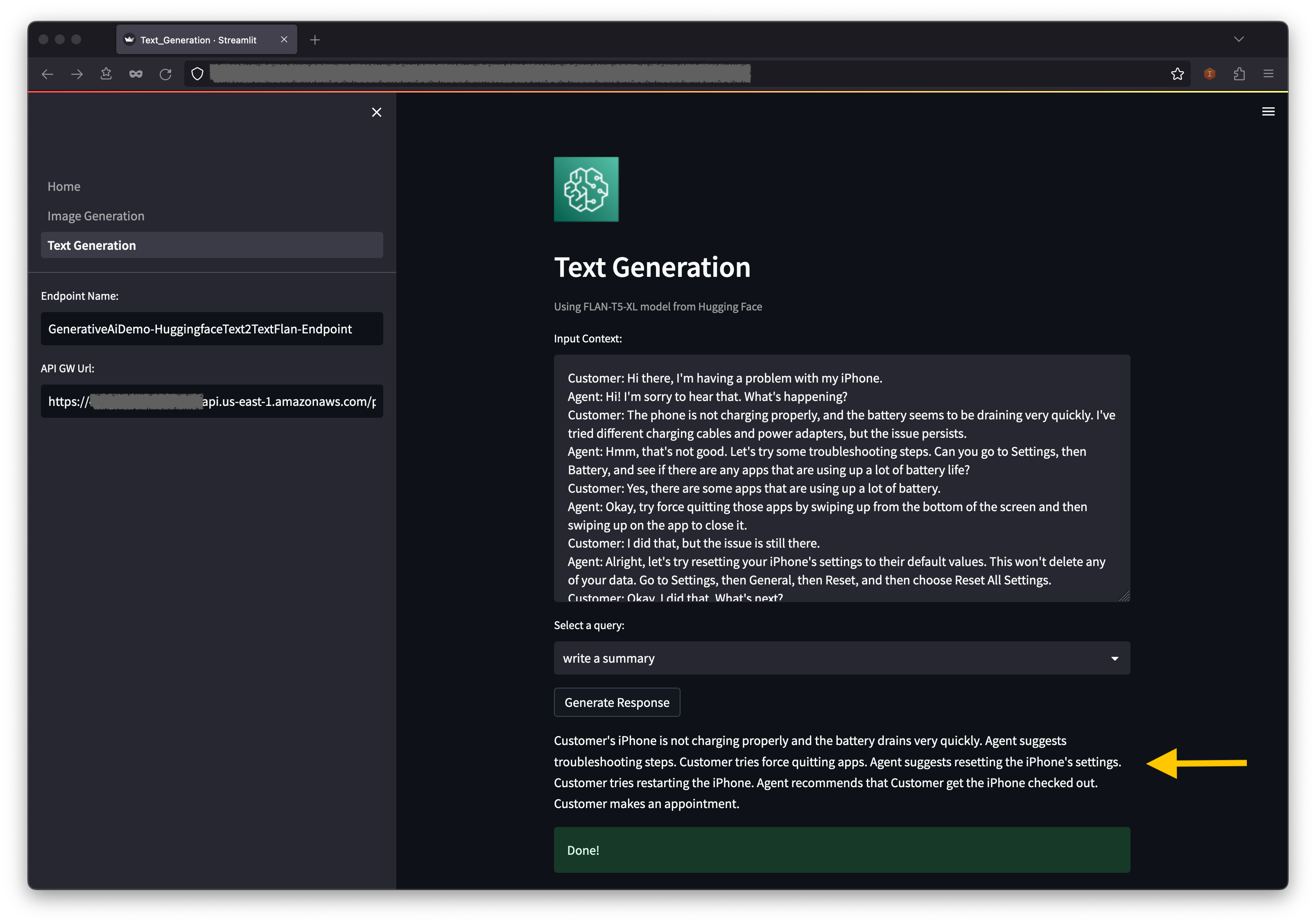

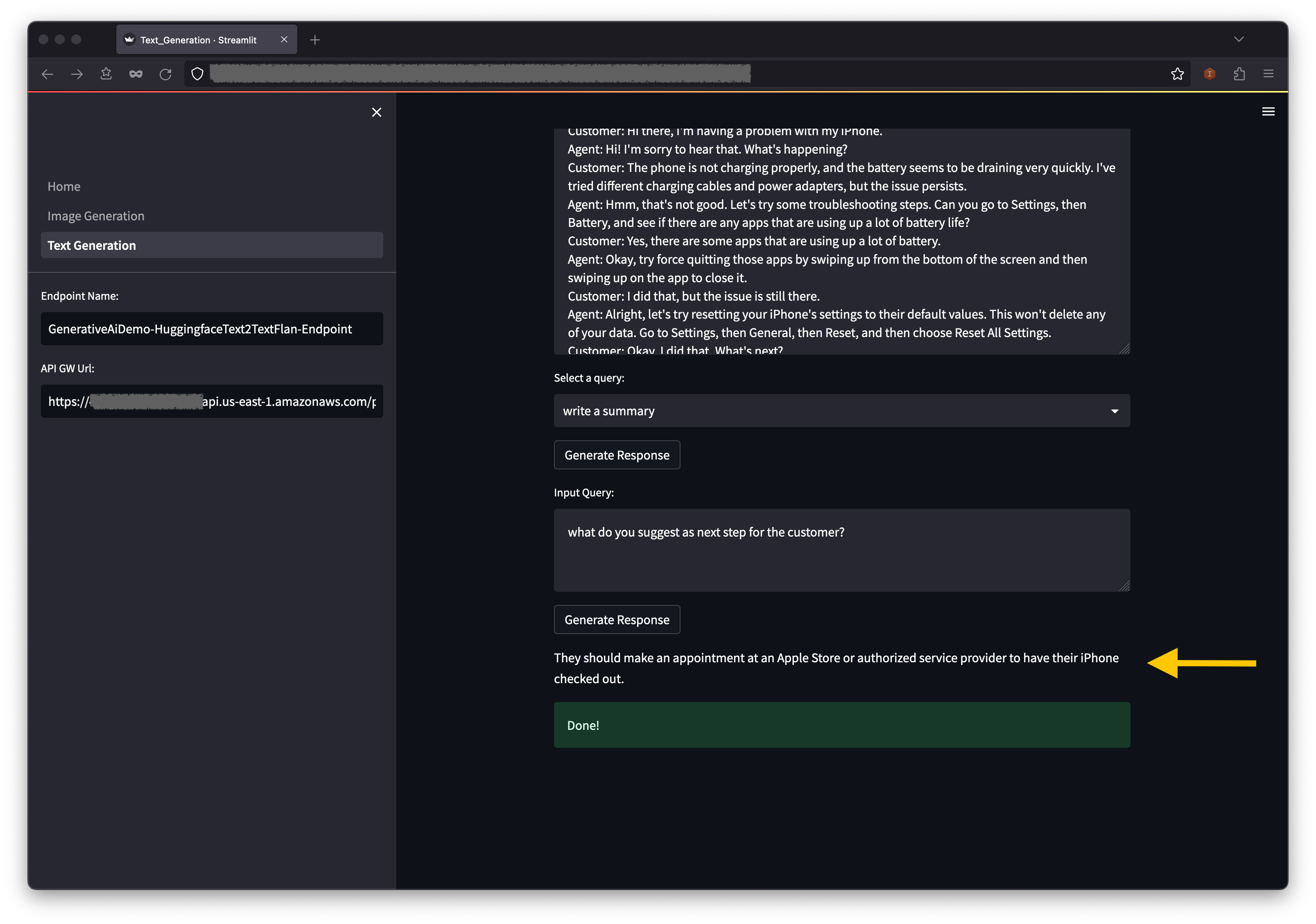

Använd AI-modellen för textgenerering

Det andra exemplet handlar om att använda FLAN-T5-XL-modellen, som är en grund- eller storspråksmodell (LLM), för att uppnå inlärning i sammanhang för textgenerering samtidigt som man tar upp ett brett spektrum av naturlig språkförståelse (NLU) och naturlig språkgenereringsuppgifter (NLG).

Vissa miljöer kan begränsa antalet slutpunkter som du kan starta åt gången. Om så är fallet kan du starta en SageMaker-slutpunkt åt gången. För att stoppa en SageMaker-slutpunkt i AWS CDK-appen måste du förstöra den distribuerade slutpunktsstacken och innan du startar den andra slutpunktsstacken. För att stänga av slutpunkten för bildgenerering AI-modell, utfärda följande kommando:

Starta sedan slutpunktsstacken för textgenerering AI-modell:

Ange y vid uppmaningarna.

Efter att textgenereringsmodellens slutpunktsstack har lanserats, slutför du följande steg:

- Gå tillbaka till webbapplikationen och välj Textgenerering i navigeringsfönstret.

- Smakämnen Inmatningskontext fältet är förifyllt med en konversation mellan en kund och en agent angående ett problem med kundens telefon, men du kan ange ditt eget sammanhang om du vill.

- Under sammanhanget hittar du några förifyllda frågor i rullgardinsmenyn. Välj en fråga och välj Generera svar.

- Du kan också ange din egen fråga i Inmatningsfråga fält och välj sedan Generera svar.

Visa de distribuerade resurserna på konsolen

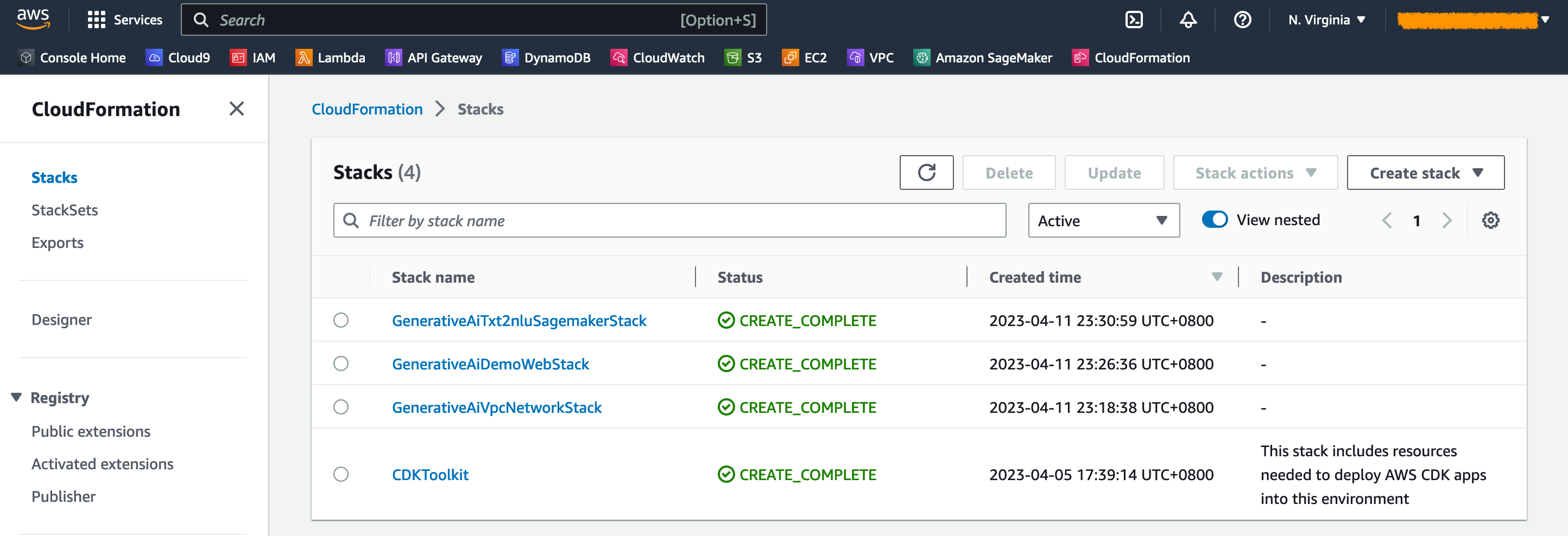

Välj på AWS CloudFormation-konsolen Stacks i navigeringsfönstret för att se de utplacerade stackarna.

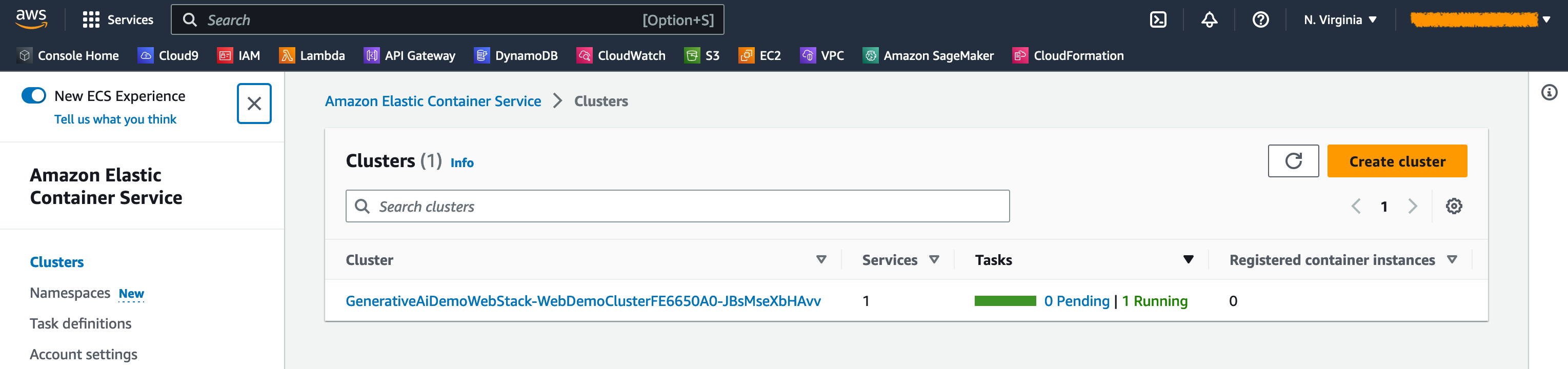

På Amazon ECS-konsolen kan du se klustren på kluster sida.

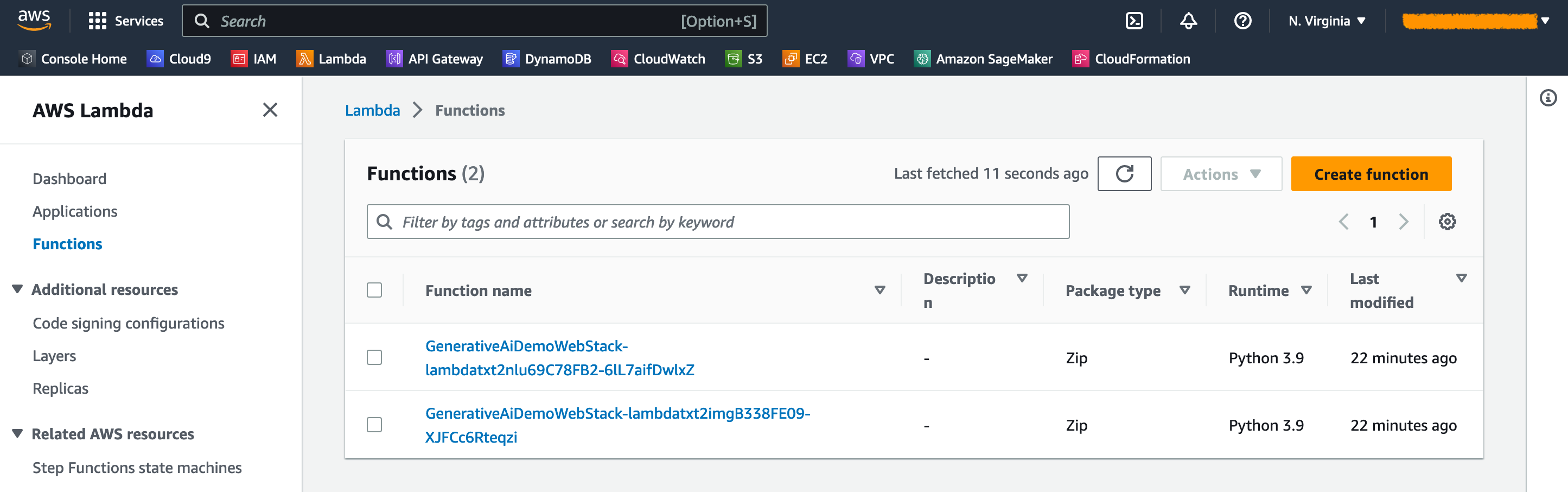

På AWS Lambda-konsolen kan du se funktionerna på Funktioner sida.

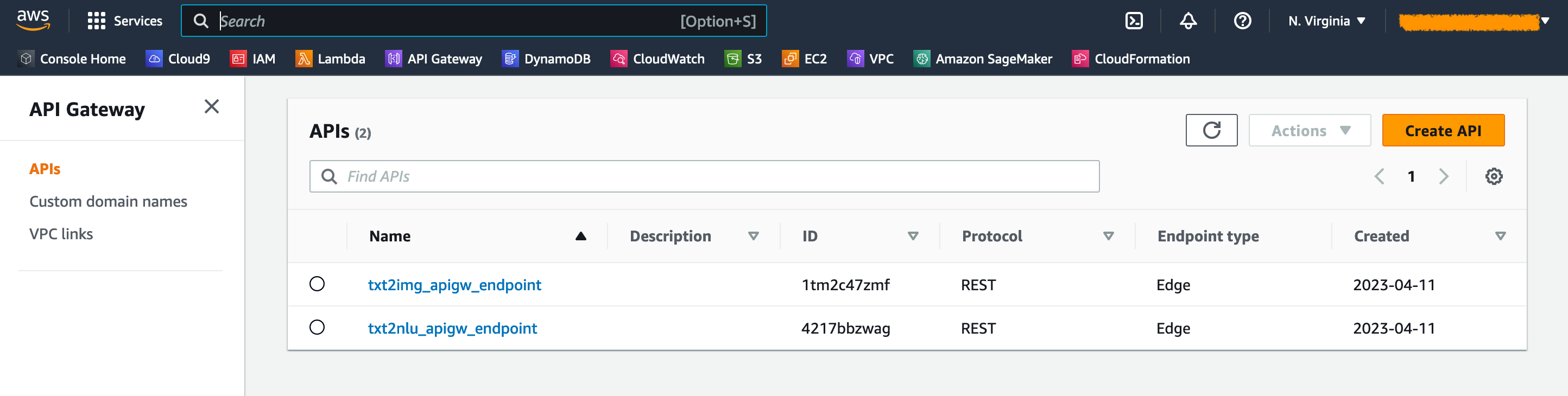

På API Gateway-konsolen kan du se API Gateway-ändpunkterna på API: er sida.

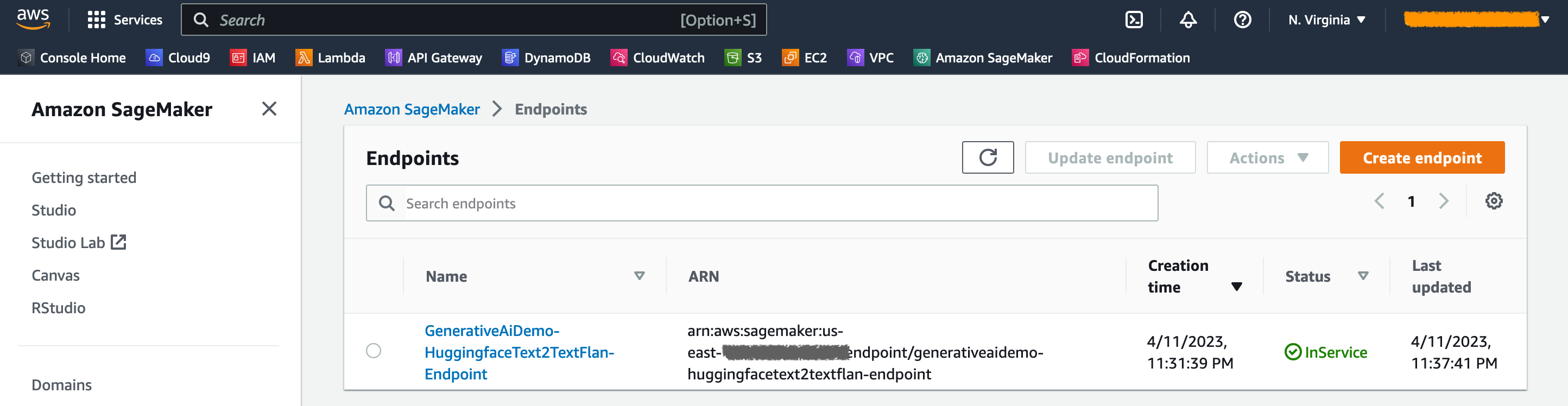

På SageMaker-konsolen kan du se de utplacerade modellens slutpunkter på endpoints sida.

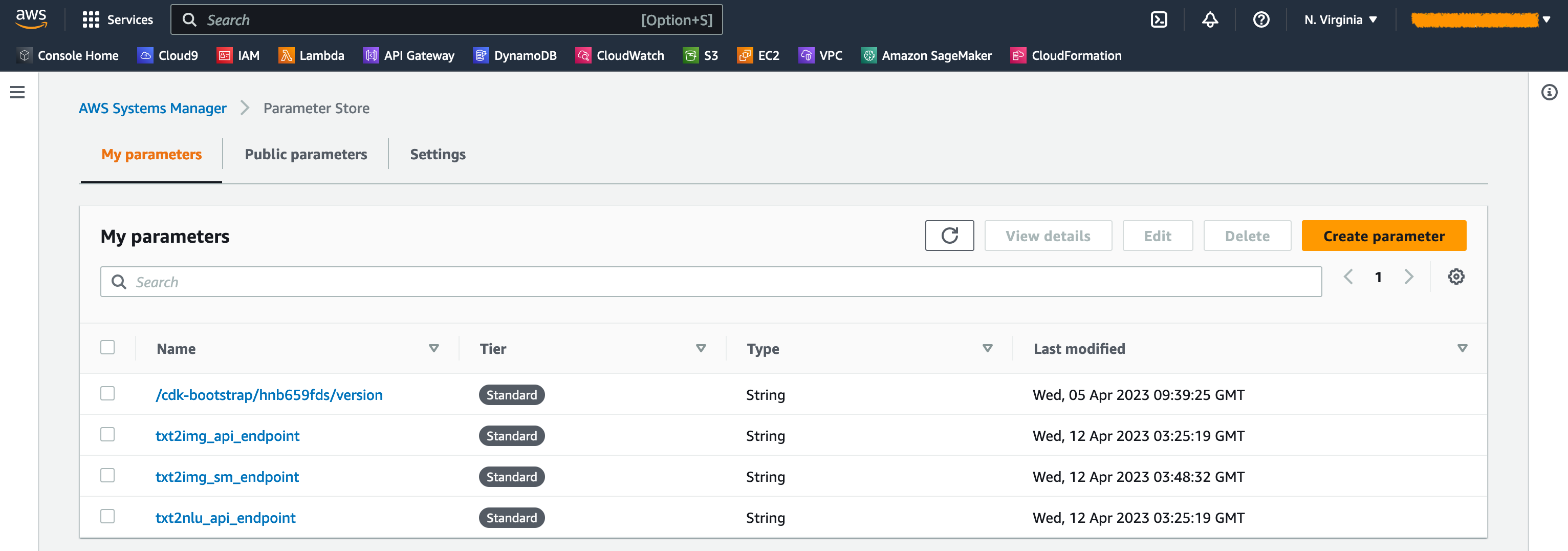

När stackarna startas genereras vissa parametrar. Dessa lagras i AWS Systems Manager Parameter Store. För att se dem, välj Parameterlagring i navigeringsfönstret på AWS systemchef konsol.

Städa upp

För att undvika onödiga kostnader, rensa upp all infrastruktur som skapats med följande kommando på din arbetsstation:

ange y vid uppmaningen. Detta steg tar cirka 10 minuter. Kontrollera om alla resurser är raderade på konsolen. Ta också bort tillgångarna S3-hinkar som skapats av AWS CDK på Amazon S3-konsolen samt tillgångsförråden på Amazon ECR.

Slutsats

Som visas i det här inlägget kan du använda AWS CDK för att distribuera generativa AI-modeller i JumpStart. Vi visade ett bildgenereringsexempel och ett textgenereringsexempel med ett användargränssnitt som drivs av Streamlit, Lambda och API Gateway.

Du kan nu bygga dina generativa AI-projekt med hjälp av förtränade AI-modeller i JumpStart. Du kan också utöka det här projektet för att finjustera grundmodellerna för ditt användningsfall och kontrollera åtkomsten till API Gateway-slutpunkter.

Vi inbjuder dig att testa lösningen och bidra till projektet GitHub. Dela dina tankar om denna handledning i kommentarerna!

Licenssammanfattning

Denna exempelkod görs tillgänglig under en modifierad MIT-licens. Se den LICENS fil för mer information. Granska också respektive licenser för stabil diffusion och flan-t5-xl modeller på Hugging Face.

Om författarna

Hantzley Taudoor är en APJ Partner Solutions Architecture Leader baserad i Singapore. Han har 20 års erfarenhet inom ICT-branschen som spänner över flera funktionella områden, inklusive lösningsarkitektur, affärsutveckling, försäljningsstrategi, konsultation och ledarskap. Han leder ett team av Senior Solutions Architects som gör det möjligt för partners att utveckla gemensamma lösningar, bygga teknisk kapacitet och styra dem genom implementeringsfasen när kunder migrerar och moderniserar sina applikationer till AWS.

Hantzley Taudoor är en APJ Partner Solutions Architecture Leader baserad i Singapore. Han har 20 års erfarenhet inom ICT-branschen som spänner över flera funktionella områden, inklusive lösningsarkitektur, affärsutveckling, försäljningsstrategi, konsultation och ledarskap. Han leder ett team av Senior Solutions Architects som gör det möjligt för partners att utveckla gemensamma lösningar, bygga teknisk kapacitet och styra dem genom implementeringsfasen när kunder migrerar och moderniserar sina applikationer till AWS.

Kwonyul Choi är CTO på BABITALK, en koreansk startup för skönhetsvårdsplattform, baserad i Seoul. Innan denna roll arbetade Kownyul som Software Development Engineer på AWS med fokus på AWS CDK och Amazon SageMaker.

Kwonyul Choi är CTO på BABITALK, en koreansk startup för skönhetsvårdsplattform, baserad i Seoul. Innan denna roll arbetade Kownyul som Software Development Engineer på AWS med fokus på AWS CDK och Amazon SageMaker.

Arunprasath Shankar är en Senior AI/ML Specialist Solutions Architect med AWS, som hjälper globala kunder att skala sina AI-lösningar effektivt och effektivt i molnet. På fritiden tycker Arun om att titta på sci-fi-filmer och lyssna på klassisk musik.

Arunprasath Shankar är en Senior AI/ML Specialist Solutions Architect med AWS, som hjälper globala kunder att skala sina AI-lösningar effektivt och effektivt i molnet. På fritiden tycker Arun om att titta på sci-fi-filmer och lyssna på klassisk musik.

Satish Upreti är en Migration Lead PSA och Security SME i partnerorganisationen i APJ. Satish har 20 års erfarenhet av lokala privata moln och offentliga molnteknologier. Sedan han började på AWS i augusti 2020 som migrationsspecialist, tillhandahåller han omfattande teknisk rådgivning och stöd till AWS-partner för att planera och implementera komplexa migrationer.

Satish Upreti är en Migration Lead PSA och Security SME i partnerorganisationen i APJ. Satish har 20 års erfarenhet av lokala privata moln och offentliga molnteknologier. Sedan han började på AWS i augusti 2020 som migrationsspecialist, tillhandahåller han omfattande teknisk rådgivning och stöd till AWS-partner för att planera och implementera komplexa migrationer.

Bilaga: Kodgenomgång

I det här avsnittet ger vi en översikt över koden i detta projekt.

AWS CDK-applikation

Den huvudsakliga AWS CDK-applikationen finns i app.py filen i rotkatalogen. Projektet består av flera stackar, så vi måste importera stackarna:

Vi definierar våra generativa AI-modeller och får de relaterade URI:erna från SageMaker:

Funktionen get_sagemaker_uris hämtar all modellinformation från JumpStart. Ser script/sagemaker_uri.py.

Sedan instansierar vi stackarna:

Den första stacken som lanseras är VPC-stacken, GenerativeAiVpcNetworkStack. Webbapplikationsstacken, GenerativeAiDemoWebStack, är beroende av VPC-stacken. Beroendet görs genom att parametern skickar vpc=network_stack.vpc.

Se app.py för hela koden.

VPC nätverksstack

I GenerativeAiVpcNetworkStack-stacken skapar vi en VPC med ett offentligt undernät och ett privat undernät som spänner över två tillgänglighetszoner:

Se /stack/generative_ai_vpc_network_stack.py för hela koden.

Demo webbapplikationsstack

I GenerativeAiDemoWebStack-stacken lanserar vi Lambda-funktioner och respektive API Gateway-ändpunkter genom vilka webbapplikationen interagerar med SageMaker-modellens slutpunkter. Se följande kodavsnitt:

Webbapplikationen är containeriserad och värd på Amazon ECS med Fargate. Se följande kodavsnitt:

Se /stack/generative_ai_demo_web_stack.py för hela koden.

Bildgenerering SageMaker modell endpoint stack

GenerativeAiTxt2imgSagemakerStack-stacken skapar bildgenereringsmodellens slutpunkt från JumpStart och lagrar slutpunktsnamnet i Systems Manager Parameter Store. Denna parameter kommer att användas av webbapplikationen. Se följande kod:

Se /stack/generative_ai_txt2img_sagemaker_stack.py för hela koden.

NLU och textgenerering SageMaker-modellslutpunktsstack

GenerativeAiTxt2nluSagemakerStack-stacken skapar NLU- och textgenereringsmodellens slutpunkt från JumpStart och lagrar slutpunktsnamnet i Systems Manager Parameter Store. Denna parameter kommer också att användas av webbapplikationen. Se följande kod:

Se /stack/generative_ai_txt2nlu_sagemaker_stack.py för hela koden.

webbapplikation

Webbapplikationen finns i /web-app katalog. Det är en Streamlit-applikation som är containeriserad enligt Dockerfile:

För att lära dig mer om Streamlit, se Strömbelyst dokumentation.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoAiStream. Web3 Data Intelligence. Kunskap förstärkt. Tillgång här.

- Minting the Future med Adryenn Ashley. Tillgång här.

- Köp och sälj aktier i PRE-IPO-företag med PREIPO®. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/deploy-generative-ai-models-from-amazon-sagemaker-jumpstart-using-the-aws-cdk/

- : har

- :är

- $UPP

- 1

- 10

- 100

- 20

- 20 år

- 2020

- 2023

- 7

- 8

- 9

- a

- Om Oss

- tillgång

- Accessed

- tillgänglig

- i enlighet med detta

- Konto

- Uppnå

- tvärs

- anpassa

- adresse

- Anta

- Antagande

- befordran

- rådgivning

- Recensioner

- AI

- AI-powered

- AI / ML

- algoritmer

- Alla

- tillåta

- redan

- också

- amason

- Amazon API Gateway

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analys

- och

- vilken som helst

- api

- app

- Ansökan

- tillämpningar

- appar

- April

- arkitektur

- ÄR

- områden

- runt

- AS

- Tillgångar

- At

- uppmärksamhet

- AUGUSTI

- tillgänglighet

- tillgänglig

- undvika

- AWS

- AWS Cloud9

- AWS molnformation

- AWS Lambda

- tillbaka

- gunga

- baserat

- BAT

- BE

- vackert

- Skönhet

- innan

- Där vi får lov att vara utan att konstant prestera,

- tro

- mellan

- Bootstrap

- bred

- webbläsare

- SLUTRESULTAT

- byggt

- företag

- affärsutveckling

- företag

- men

- by

- Ring

- KAN

- kapacitet

- Kapacitet

- fångas

- vilken

- Vid

- fall

- CD

- Centers

- byta

- egenskaper

- avgifter

- ta

- Välja

- klient

- klienter

- cloud

- Cloud9

- koda

- kommer

- Gemensam

- vanligen

- fullborda

- komplex

- Compute

- dator

- konfiguration

- Konsol

- konstruera

- rådgivning

- konsumeras

- innehöll

- Behållare

- innehåller

- innehåll

- sammanhang

- bidra

- kontroll

- Konversation

- konversationer

- korrekt

- Pris

- skapa

- skapas

- skapar

- skapande

- CTO

- Aktuella

- beställnings

- kund

- kundupplevelse

- Kundservice

- Kunder

- skräddarsy

- allra senaste

- datum

- datavetenskap

- dag

- årtionden

- Standard

- definierar

- demonstreras

- demonstrerar

- Dependency

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- vecklas ut

- beskrivning

- förstöra

- utveckla

- utvecklare

- Utveckling

- olika

- Diffusion

- Visa

- Störa

- Hamnarbetare

- dokumentera

- gjort

- inte

- ner

- varje

- lätt

- lätt

- effektivt

- effektivt

- möjliggöra

- möjliggör

- änden

- Slutpunkt

- ingenjör

- ange

- Miljö

- miljöer

- beräknad

- Varje

- varje dag

- allas

- exempel

- exempel

- spännande

- erfarenhet

- förlänga

- omfattande

- Ansikte

- falsk

- bekant

- familj

- Funktioner

- få

- fält

- Fält

- Fil

- hitta

- Förnamn

- Fokus

- efter

- följer

- För

- kraft

- fundament

- fraktion

- Ramverk

- från

- full

- fungera

- funktionella

- funktioner

- nätbryggan

- samla

- samla

- generell mening

- genereras

- generering

- generativ

- Generativ AI

- skaffa sig

- gå

- Välgörenhet

- Globalt

- Odling

- Har

- har

- he

- hjälpa

- hjälpa

- hög kvalitet

- hans

- Hem

- värd

- värd

- ÖPPETTIDER

- Hur ser din drömresa ut

- How To

- html

- http

- HTTPS

- ICT

- idéer

- if

- bild

- bilder

- fantasi

- genomföra

- genomförande

- importera

- in

- Inklusive

- införliva

- industrier

- industrin

- Oändlig

- Böjpunkt

- informationen

- Infrastruktur

- installera

- Installationen

- installerad

- exempel

- istället

- integrera

- integrationer

- interagerar

- Gränssnitt

- in

- bjuda in

- fråga

- IT

- sammanfogning

- gemensam

- jpg

- json

- koreanska

- landning

- språk

- Språk

- Large

- senare

- senaste

- lansera

- lanserades

- lansera

- leda

- ledare

- Ledarskap

- Leads

- LÄRA SIG

- inlärning

- Lämna

- Bibliotek

- Licens

- licenser

- tycka om

- BEGRÄNSA

- linje

- Lista

- Lyssna

- listor

- LLM

- läsa in

- lokal

- belägen

- Maskinen

- maskininlärning

- Maskiner

- gjord

- Huvudsida

- göra

- GÖR

- hantera

- ledning

- chef

- många

- massiv

- Meny

- kanske

- migrera

- migration

- minuter

- MIT

- ML

- modell

- modeller

- modernisera

- modifierad

- mer

- Filmer

- multipel

- Musik

- måste

- namn

- Natural

- Natur

- Navigering

- Behöver

- behov

- nät

- Nya

- Nästa

- nod

- nu

- antal

- of

- Erbjudanden

- on

- ONE

- pågående

- endast

- öppen källkod

- Programvara med öppen källkod

- öppnas

- or

- beställa

- organisation

- ursprungliga

- Övriga

- vår

- produktion

- över

- Översikt

- egen

- paket

- sida

- panelen

- paradigmet

- parameter

- parametrar

- partnern

- partner

- Förbi

- Utföra

- fas

- telefon

- Bild

- Planen

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Punkt

- Möjligheten

- Inlägg

- potentiell

- drivs

- den mäktigaste

- förutsättningar

- Skriva ut

- Innan

- privat

- Problem

- Produktion

- Programmering

- programmeringsspråk

- projektet

- projekt

- ge

- ger

- allmän

- Offentligt moln

- publicly

- Python

- sökfrågor

- snabbt

- område

- snabb

- snabbt

- redo

- nyligen

- avses

- om

- region

- relaterad

- Repository

- Obligatorisk

- Krav

- resurs

- Resurser

- att

- översyn

- revolutionera

- höger

- Roll

- rot

- Körning

- rinnande

- sagemaker

- försäljning

- Samma

- Skala

- sci-fi

- Vetenskap

- repa

- sDK

- Andra

- sekunder

- §

- säkerhet

- se

- frön

- SJÄLV

- senior

- känsla

- Seoul

- Server

- Servrar

- service

- Tjänster

- in

- inställning

- Dela

- skifta

- skall

- show

- visade

- visas

- Visar

- Enkelt

- eftersom

- Singapore

- Storlek

- Small

- EMS

- So

- Mjukvara

- mjukvaruutveckling

- lösning

- Lösningar

- några

- Källa

- Utrymme

- specialist

- specifik

- specificerade

- stabil

- stapel

- Stacks

- standard

- igång

- start

- Startups

- Steg

- Steg

- Sluta

- förvaring

- lagra

- lagras

- lagrar

- Upplevelser för livet

- Strategi

- struktur

- undernät

- stödja

- System

- tar

- uppgift

- uppgifter

- grupp

- Teknisk

- tekniker

- Tekniken

- Teknologi

- berättar

- mallar

- testa

- tester

- den där

- Smakämnen

- deras

- Dem

- sedan

- Dessa

- detta

- Genom

- tid

- titan

- till

- toolkit

- verktyg

- traditionen

- traditionell

- Tåg

- tränad

- Utbildning

- Förvandla

- Trender

- sann

- verkligen

- SVÄNG

- handledning

- två

- Typ

- typer

- typisk

- typiskt

- under

- förståelse

- avtäckt

- uppdatering

- uppgradera

- användning

- användningsfall

- Begagnade

- Användare

- Användargränssnitt

- med hjälp av

- utnyttja

- olika

- Omfattande

- verifiera

- version

- via

- Video

- utsikt

- Virtuell

- praktiskt taget

- Besök

- vill

- var

- tittar

- Sätt..

- we

- webb

- webbapplikation

- webbservice

- VÄL

- som

- medan

- bred

- Brett utbud

- utbredd

- wikipedia

- kommer

- fönster

- med

- utan

- Arbete

- arbetade

- arbetsflöden

- arbetsstation

- år

- Om er

- Din

- zephyrnet

- zoner