Moderna chatbots kan fungera som digitala agenter, vilket ger en ny väg för att leverera 24/7 kundservice och support inom många branscher. Deras popularitet härrör från förmågan att svara på kundförfrågningar i realtid och hantera flera frågor samtidigt på olika språk. Chatbots erbjuder också värdefulla datadrivna insikter om kundernas beteende samtidigt som de kan skalas utan ansträngning när användarbasen växer; därför presenterar de en kostnadseffektiv lösning för att engagera kunder. Chatbots använder de avancerade naturliga språkfunktionerna hos stora språkmodeller (LLM) för att svara på kundfrågor. De kan förstå samtalsspråk och svara naturligt. Men chatbots som bara svarar på grundläggande frågor har begränsad användbarhet. För att bli pålitliga rådgivare måste chatbots ge genomtänkta, skräddarsydda svar.

Ett sätt att möjliggöra mer kontextuella konversationer är att länka chatboten till interna kunskapsbaser och informationssystem. Genom att integrera egen företagsdata från interna kunskapsbaser kan chatbots kontextualisera sina svar till varje användares individuella behov och intressen. Till exempel kan en chatbot föreslå produkter som matchar en shoppers preferenser och tidigare köp, förklara detaljer på ett språk anpassat till användarens expertisnivå eller ge kontosupport genom att komma åt kundens specifika register. Möjligheten att intelligent införliva information, förstå naturligt språk och ge anpassade svar i ett konversationsflöde gör att chatbots kan leverera verkligt affärsvärde i olika användningsfall.

Det populära arkitekturmönstret av Retrieval Augmented Generation (RAG) används ofta för att utöka användarens frågekontext och svar. RAG kombinerar förmågan hos LLM:er med grunden i fakta och verklig kunskap som kommer från att hämta relevanta texter och passager från datakorpus. Dessa hämtade texter används sedan för att informera och jorda resultatet, vilket minskar hallucinationer och förbättrar relevansen.

I det här inlägget illustrerar vi kontextuellt förbättra en chatbot genom att använda Kunskapsbaser för Amazon Bedrock, en helt hanterad serverlös tjänst. Kunskapsbaserna för Amazon Bedrock-integration gör att vår chatbot kan ge mer relevanta, personliga svar genom att länka användarfrågor till relaterade informationsdatapunkter. Internt, Amazonas berggrund använder inbäddningar lagrade i en vektordatabas för att utöka användarens frågekontext vid körning och möjliggöra en hanterad RAG-arkitekturlösning. Vi använder Amazon-brev till aktieägare datauppsättning för att utveckla denna lösning.

Retrieval Augmented Generation

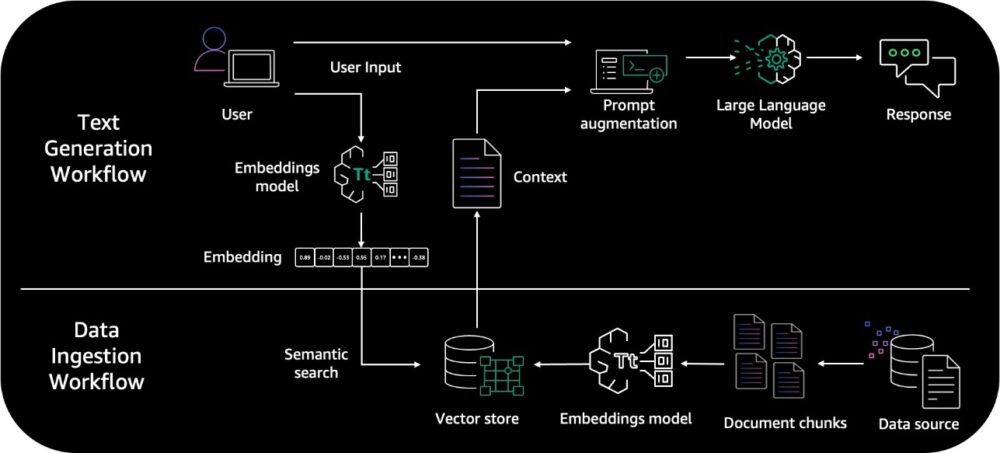

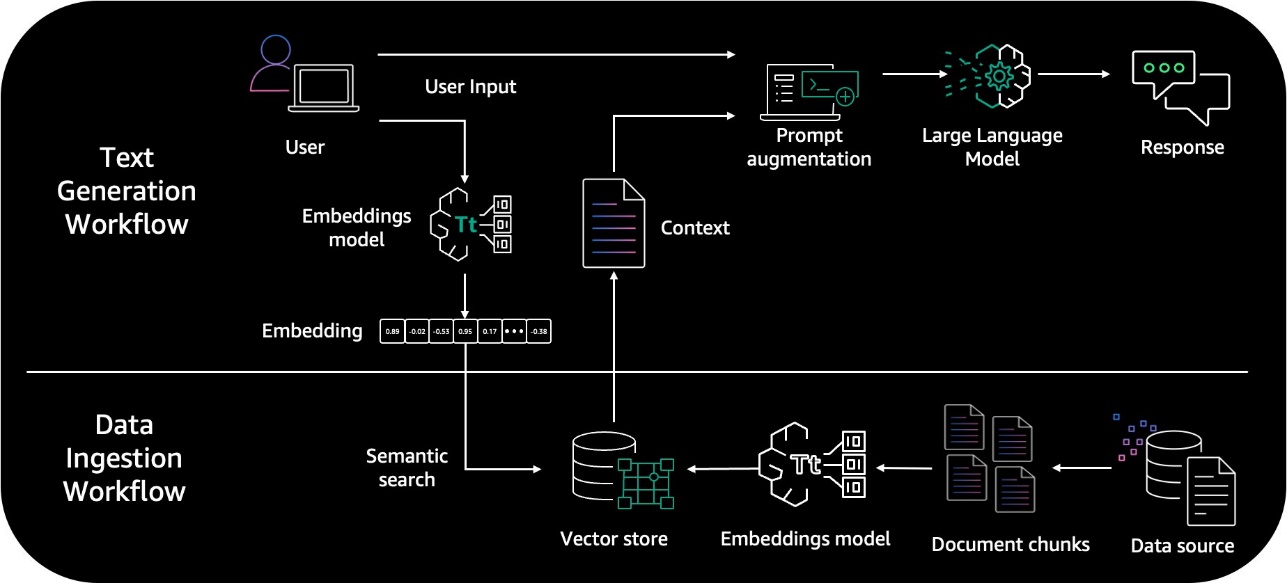

RAG är ett tillvägagångssätt för att skapa naturligt språk som införlivar informationshämtning i genereringsprocessen. RAG-arkitektur involverar två nyckelarbetsflöden: dataförbehandling genom inmatning och textgenerering med förbättrad kontext.

Arbetsflödet för datainmatning använder LLM:er för att skapa inbäddningsvektorer som representerar den semantiska betydelsen av texter. Inbäddningar skapas för dokument och användarfrågor. Dokumentinbäddningarna delas upp i bitar och lagras som index i en vektordatabas. Arbetsflödet för textgenerering tar sedan en frågas inbäddningsvektor och använder den för att hämta de mest lika dokumentbitarna baserat på vektorlikhet. Den utökar uppmaningarna med dessa relevanta bitar för att generera ett svar med hjälp av LLM. För mer information, se Grundläggande om Retrieval Augmented Generation, inbäddningar och vektordatabaser avsnitt i Förhandsvisning – Anslut grundmodeller till dina företagsdatakällor med agenter för Amazon Bedrock.

Följande diagram illustrerar RAG-arkitekturen på hög nivå.

Även om RAG-arkitekturen har många fördelar, involverar den flera komponenter, inklusive en databas, hämtningsmekanism, prompt och generativ modell. Att hantera dessa ömsesidigt beroende delar kan införa komplexitet i systemutveckling och distribution. Integreringen av hämtning och generering kräver också ytterligare ingenjörsinsatser och beräkningsresurser. Vissa bibliotek med öppen källkod tillhandahåller omslag för att minska denna omkostnad; Ändringar i biblioteken kan dock leda till fel och lägga till ytterligare overhead för versionshantering. Även med öppen källkodsbibliotek krävs betydande ansträngningar för att skriva kod, bestämma optimal chunkstorlek, generera inbäddningar och mer. Enbart detta installationsarbete kan ta veckor beroende på datavolym.

Därför kan en hanterad lösning som hanterar dessa odifferentierade uppgifter effektivisera och påskynda processen för att implementera och hantera RAG-applikationer.

Kunskapsbaser för Amazon Bedrock

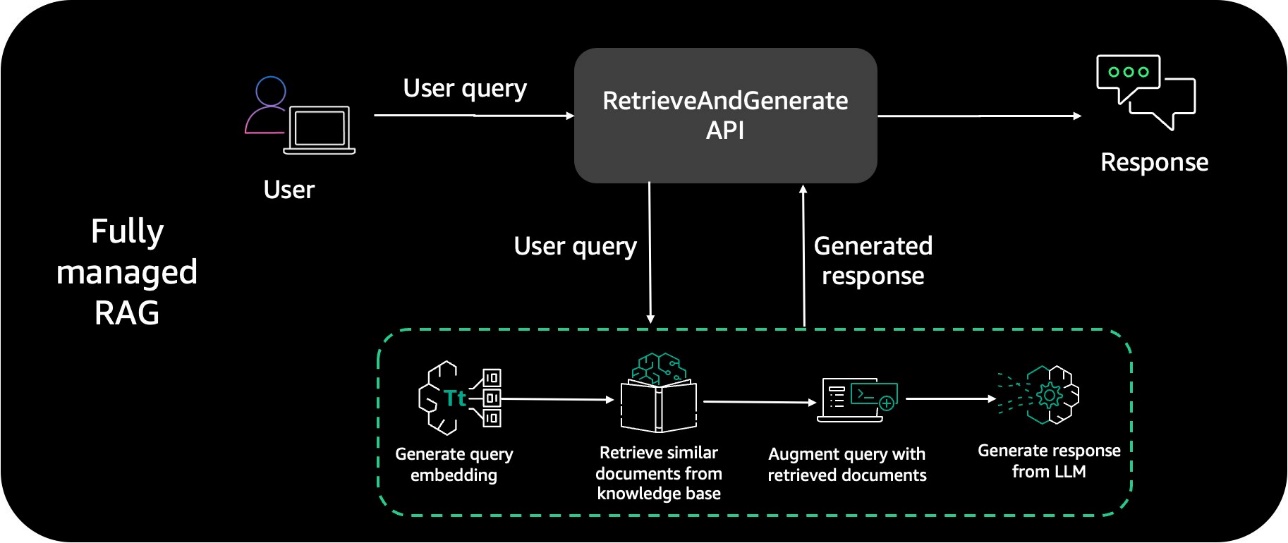

Kunskapsbaser för Amazon Bedrock är ett serverlöst alternativ för att bygga kraftfulla konversations-AI-system med hjälp av RAG. Det erbjuder helt hanterade dataintag och arbetsflöden för textgenerering.

För datainmatning hanterar den automatiskt skapa, lagra, hantera och uppdatera textinbäddningar av dokumentdata i vektordatabasen. Den delar upp dokumenten i hanterbara bitar för effektiv hämtning. Bitarna konverteras sedan till inbäddningar och skrivs till ett vektorindex, samtidigt som du kan se källdokumenten när du svarar på en fråga.

För textgenerering tillhandahåller Amazon Bedrock RetrieveAndGenerate API för att skapa inbäddningar av användarfrågor och hämtar relevanta bitar från vektordatabasen för att generera korrekta svar. Den stöder även källattribution och korttidsminne som behövs för RAG-applikationer.

Detta gör att du kan fokusera på dina kärnverksamhetstillämpningar och tar bort de odifferentierade tunga lyften.

Lösningsöversikt

Lösningen som presenteras i det här inlägget använder en chatbot skapad med en Strömbelyst applikation och inkluderar följande AWS-tjänster:

Följande diagram är ett vanligt lösningsarkitekturmönster som du kan använda för att integrera valfri chatbot-applikation till Knowledge Bases for Amazon Bedrock.

Denna arkitektur inkluderar följande steg:

- En användare interagerar med Streamlit chatbot-gränssnittet och skickar en fråga på naturligt språk

- Detta utlöser en lambdafunktion, som anropar kunskapsbaserna

RetrieveAndGenerateAPI. Internt använder Knowledge Bases en Amazon Titan inbäddningsmodell och konverterar användarfrågan till en vektor och hittar bitar som liknar användarfrågan semantiskt. Användarprompten utökas sedan med de bitar som hämtas från kunskapsbasen. Uppmaningen vid sidan av det ytterligare sammanhanget skickas sedan till en LLM för svarsgenerering. I denna lösning använder vi Antropisk Claude Instant som vår LLM för att generera användarsvar med hjälp av ytterligare sammanhang. Observera att den här lösningen stöds i regioner där Anthropic Claude på Amazon Bedrock finns tillgänglig. - Ett kontextuellt relevant svar skickas tillbaka till chatbotapplikationen och användaren.

Förutsättningar

Amazon Bedrock-användare måste begära tillgång till grundmodeller innan de är tillgängliga för användning. Detta är en engångsåtgärd och tar mindre än en minut. För den här lösningen måste du aktivera åtkomst till Titan Embeddings G1 – Text och Claude Instant – v1.2-modellen i Amazon Bedrock. För mer information, se Modellåtkomst.

Klona GitHub repo

Lösningen som presenteras i det här inlägget är tillgänglig i följande GitHub repo. Du måste klona GitHub-förvaret till din lokala maskin. Öppna ett terminalfönster och kör följande kommando. Observera att detta är ett enda git-klonkommando.

Ladda upp din kunskapsdatauppsättning till Amazon S3

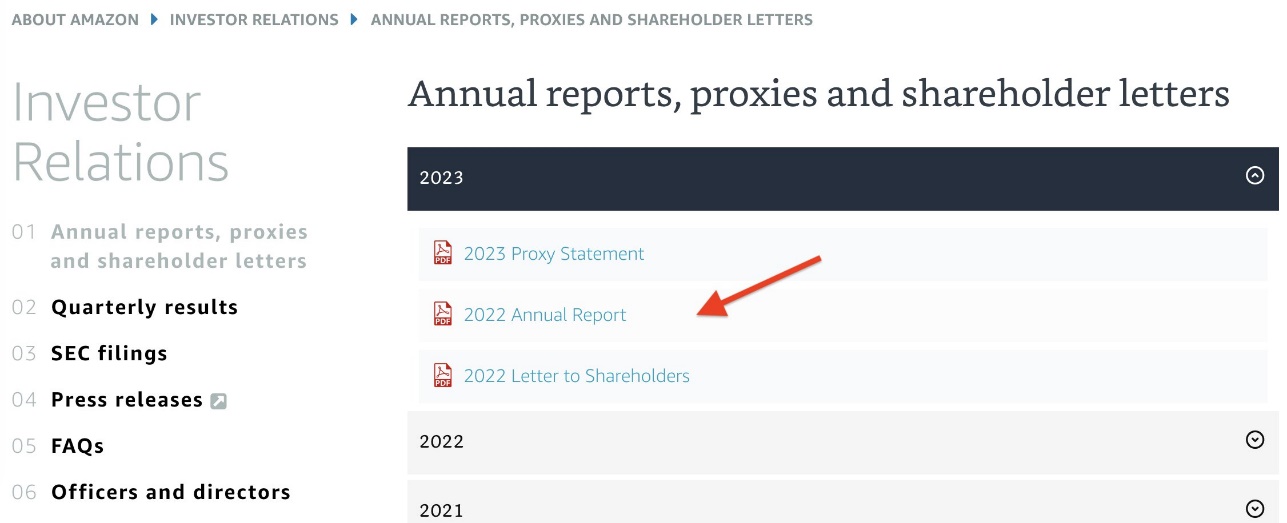

Vi laddar ner datasetet för vår kunskapsbas och laddar upp det i en S3-bucket. Denna datauppsättning kommer att mata och driva kunskapsbasen. Slutför följande steg:

- Navigera till Årsberättelser, fullmakter och aktieägarbrev datalager och ladda ner de senaste åren av Amazons aktieägarbrev.

- Välj på Amazon S3-konsolen Skopor i navigeringsfönstret.

- Välja Skapa hink.

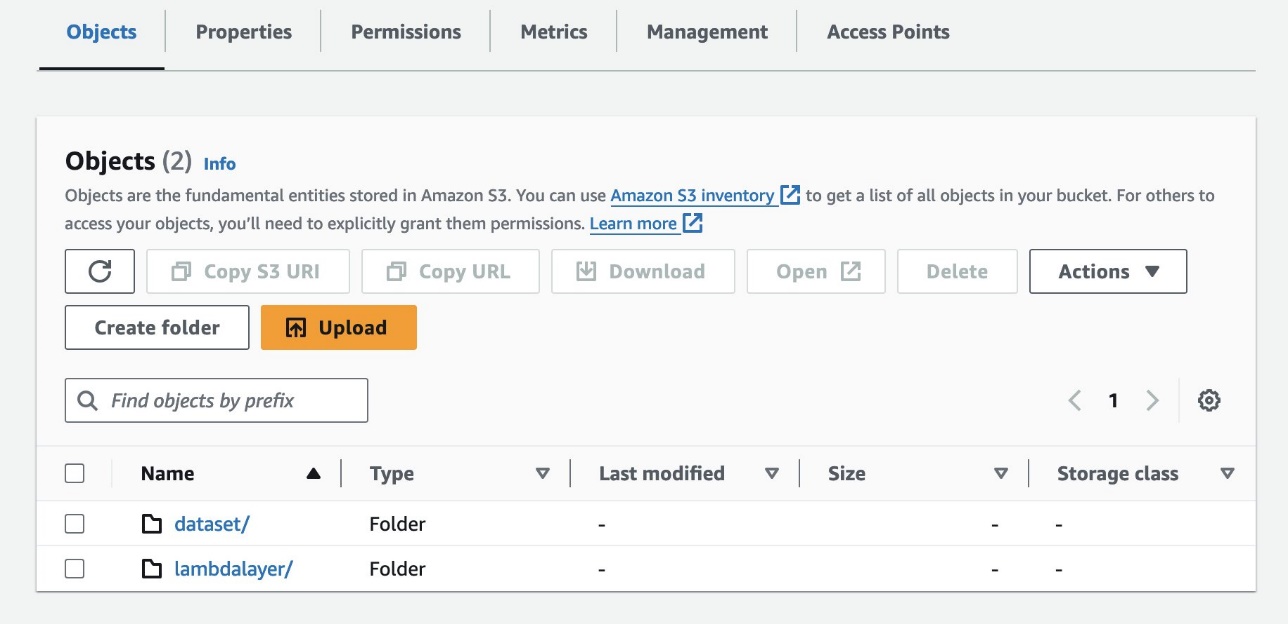

- Namnge hinken

knowledgebase-<your-awsaccount-number>. - Lämna alla andra hinkinställningar som standard och välj Skapa.

- Navigera till

knowledgebase-<your-awsaccount-number>hink. - Välja skapa mapp och namnge det dataset.

- Lämna alla andra mappinställningar som standard och välj Skapa.

- Navigera tillbaka till hinken hem och välj skapa mapp för att skapa en ny mapp och namnge den

lambdalayer. - Lämna alla andra inställningar som standard och välj Skapa.

- Navigera till

datasetmapp. - Ladda upp årsrapporterna, fullmakterna och aktieägarbrevens datauppsättningsfiler som du laddade ner tidigare till den här hinken och välj Ladda.

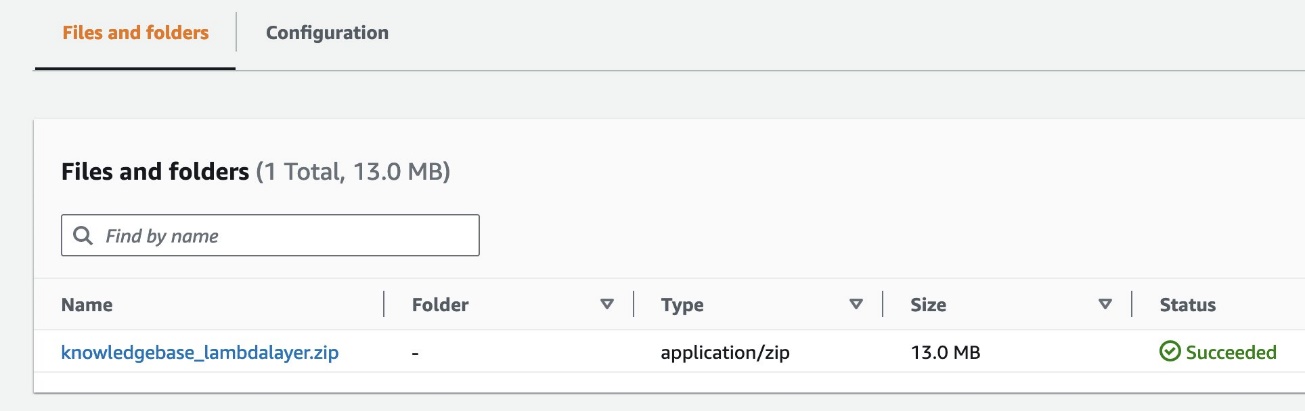

- Navigera till

lambdalayermapp. - Ladda upp

knowledgebase-lambdalayer.zipfil tillgänglig under/lambda/layermapp i GitHub-repoet som du klonade tidigare och välj Ladda. Du kommer att använda denna Lambdalagerkod senare för att skapa Lambdafunktionen.

Skapa en kunskapsbas

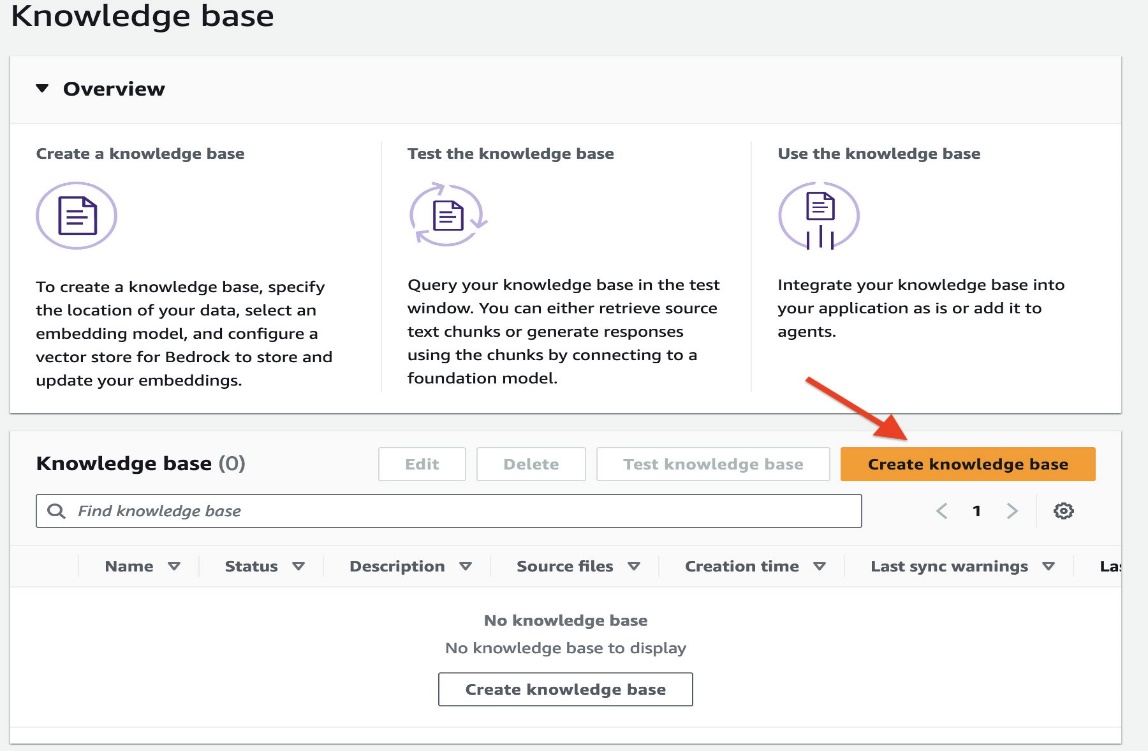

I det här steget skapar vi en kunskapsbas med hjälp av Amazon aktieägarbrevsdataset som vi laddade upp till vår S3-hink i föregående steg.

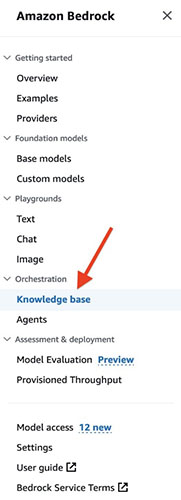

- På Amazon Bedrock-konsolen, under orkestrering välj i navigeringsfönstret Kunskapsbas.

- Välja Skapa kunskapsbas.

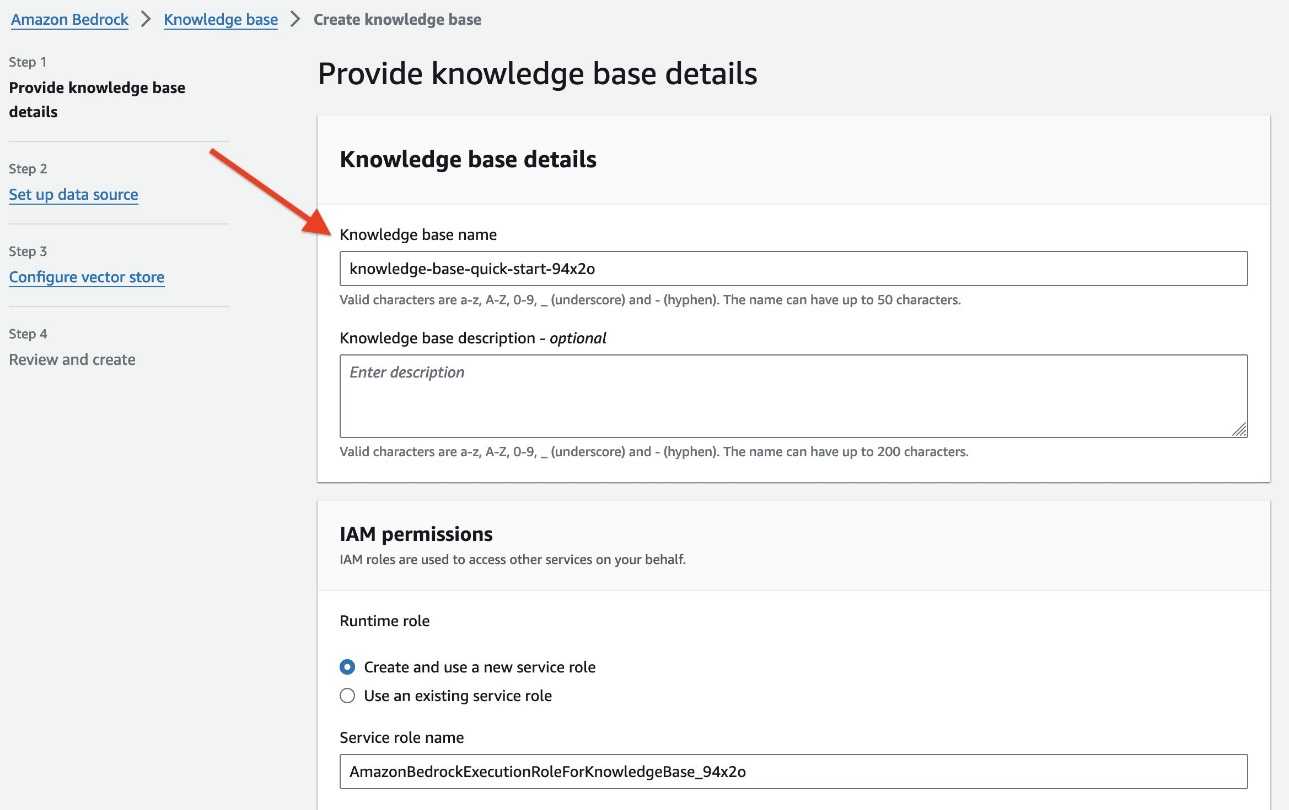

- I Kunskapsbasdetaljer sektion, ange ett namn och en valfri beskrivning.

- I IAM-behörigheter avsnitt, välj Skapa och använd en ny tjänstroll och ange ett namn för rollen.

- Lägg till taggar efter behov.

- Välja Nästa.

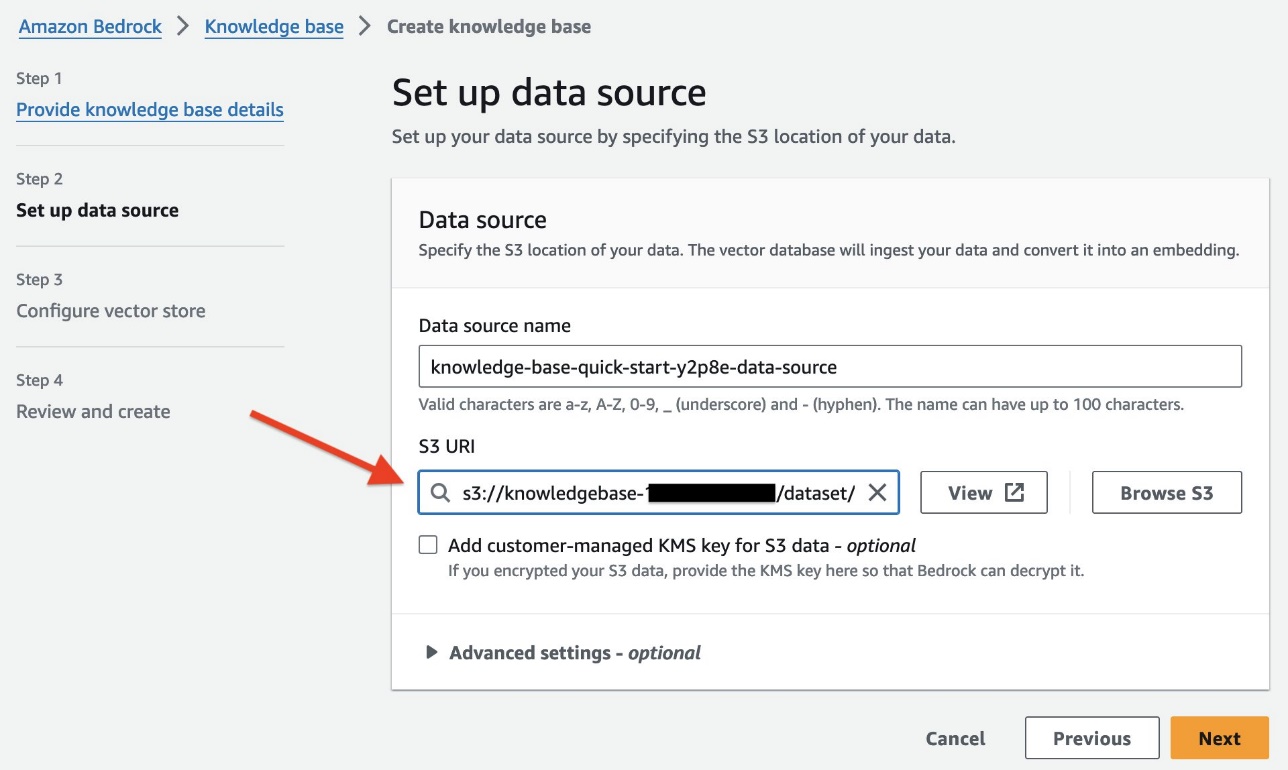

- Lämna Datakällans namn som standardnamn.

- För S3 URIväljer Bläddra i S3 för att välja S3-skopan

knowledgebase-<your-account-number>/dataset/.Du måste peka på hinken och datauppsättningsmappen som du skapade i de föregående stegen. - I Avancerade inställningar sektion, lämna standardvärdena (om du vill kan du ändra standard chunking strategi och ange chunk storlek och överlagring i procent).

- Välja Nästa.

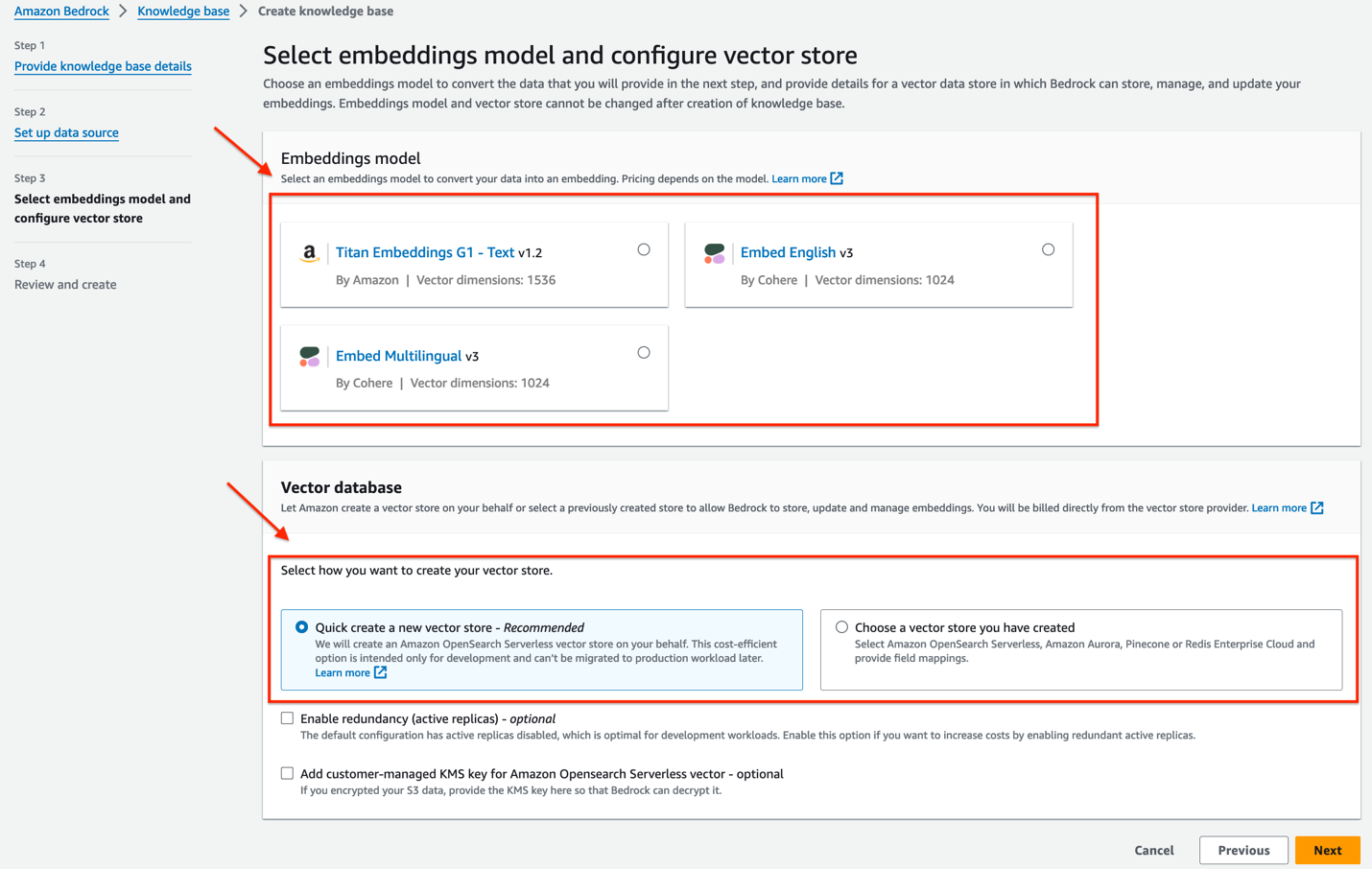

- För Inbäddningsmodell, Välj Titan Embedding G1 – Text.

- För Vektor databas, kan du antingen välja Skapa snabbt en ny vektorbutik or Välj en vektorbutik som du har skapat. Observera att för att kunna använda det vektorlager du väljer måste du ha ett vektorlager förkonfigurerat att använda. Vi stöder för närvarande fyra vektormotortyper: vektormotorn för Amazon OpenSearch Serverless, Amazon Aurora, Pinecone och Redis Enterprise Cloud. För det här inlägget väljer vi Snabbskapa en ny vektorbutik, som som standard skapar en ny OpenSearch Serverless vektorbutik på ditt konto.

- Välja Nästa.

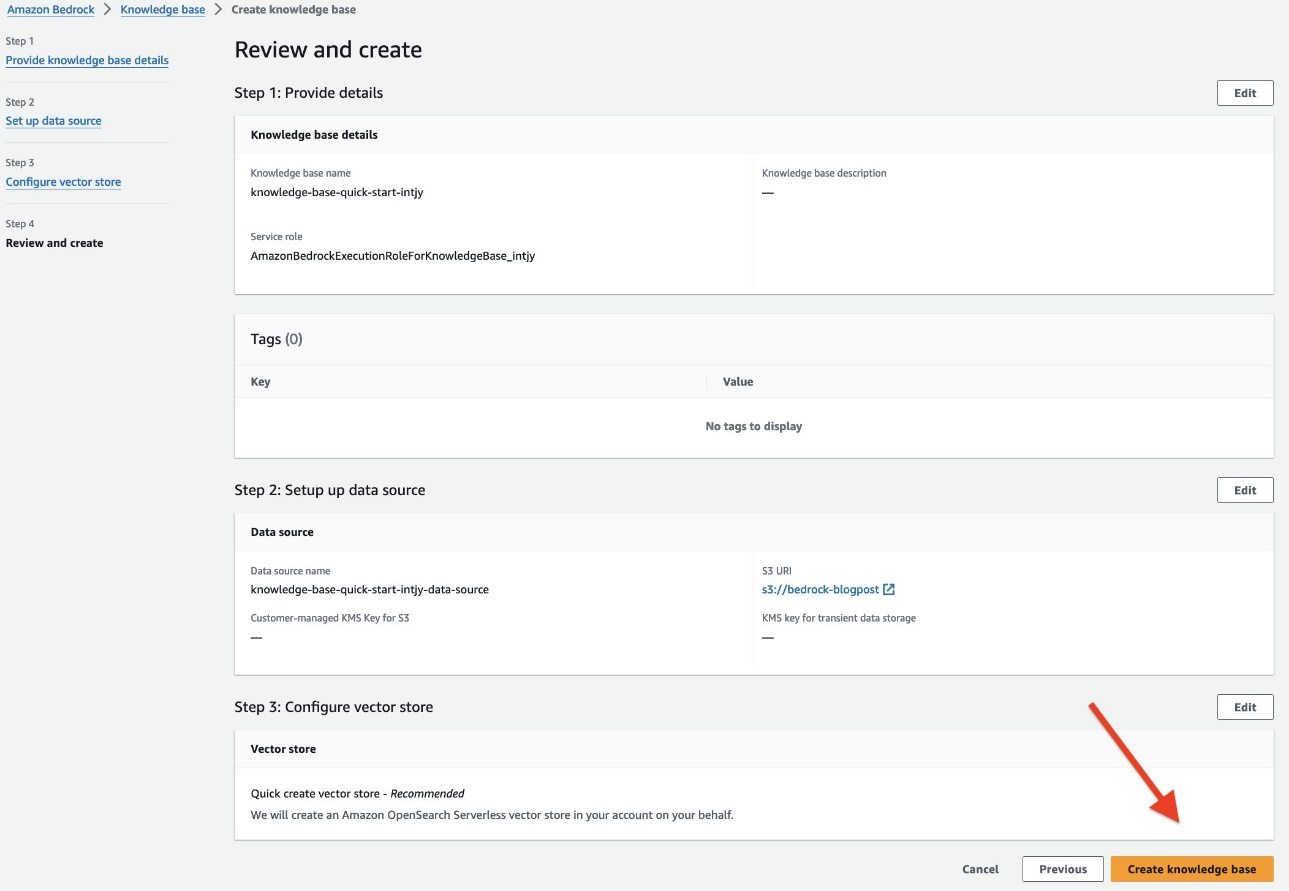

- På Granska och skapa sida, granska all information eller välj föregående för att ändra eventuella alternativ.

- Välja Skapa kunskapsbas.

Observera att processen för att skapa kunskapsbas börjar och statusen pågår. Det kommer att ta några minuter att skapa vektorbutiken och kunskapsbasen. Navigera inte bort från sidan, annars misslyckas skapandet.

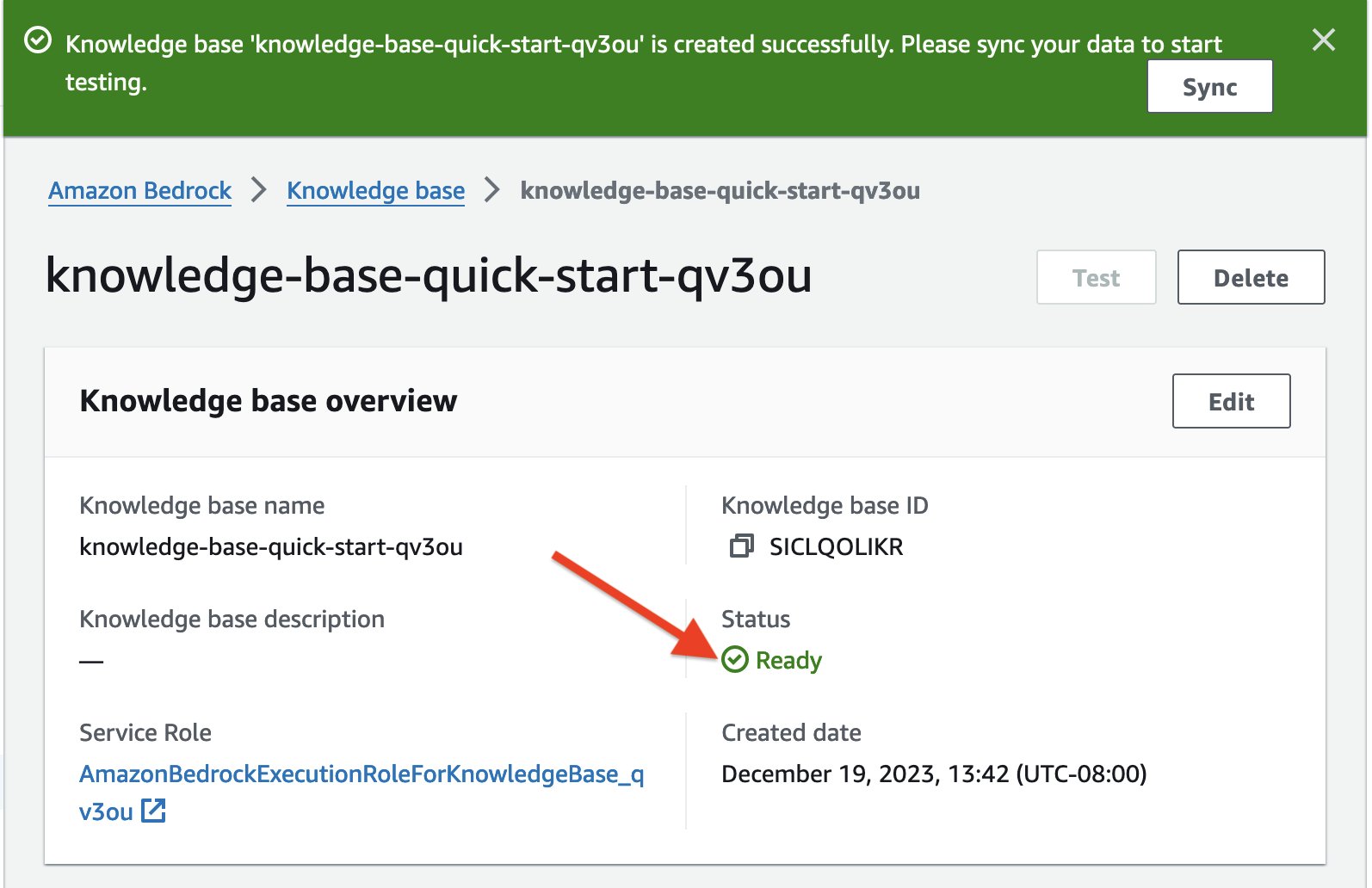

Observera att processen för att skapa kunskapsbas börjar och statusen pågår. Det kommer att ta några minuter att skapa vektorbutiken och kunskapsbasen. Navigera inte bort från sidan, annars misslyckas skapandet. - När kunskapsbasstatusen är i

Readytillstånd, anteckna kunskapsbas-ID. Du kommer att använda den i nästa steg för att konfigurera Lambdafunktionen.

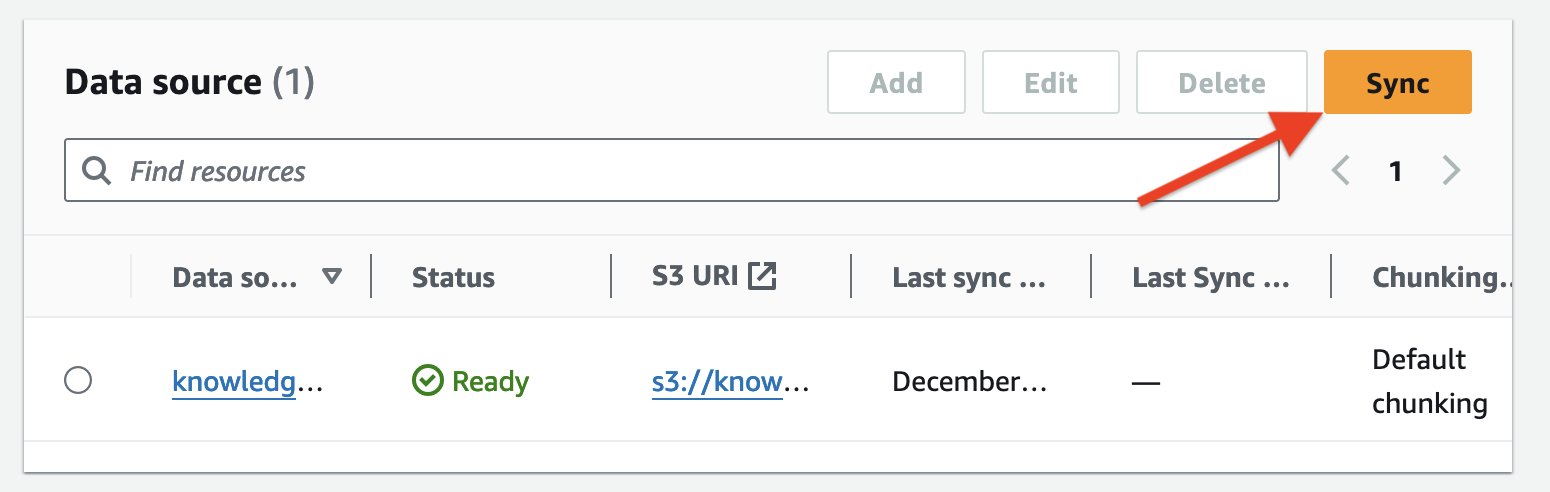

- Nu när kunskapsbasen är klar måste vi synkronisera våra Amazon-aktieägares brevdata till den. I den Datakälla avsnittet på informationssidan för kunskapsbasen, välj Synkronisera för att utlösa datainmatningsprocessen från S3-bucket till kunskapsbasen.

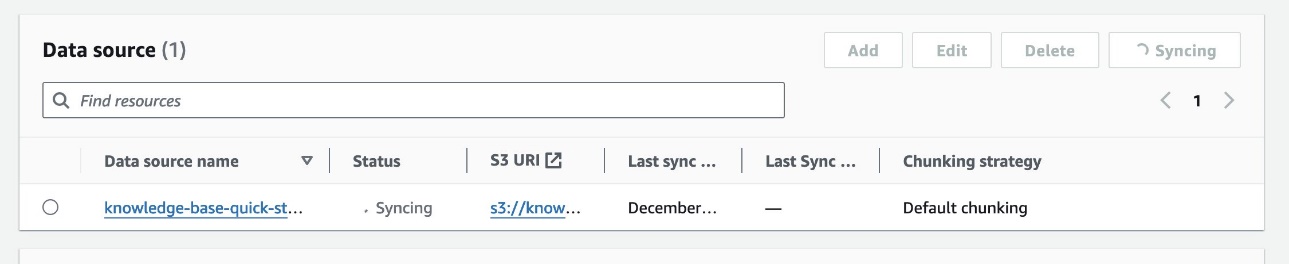

Denna synkroniseringsprocess delar upp dokumentfilerna i mindre bitar av den bitstorlek som specificerats tidigare, genererar vektorinbäddningar med den valda textinbäddningsmodellen och lagrar dem i vektorarkivet som hanteras av Knowledge Bases for Amazon Bedrock.

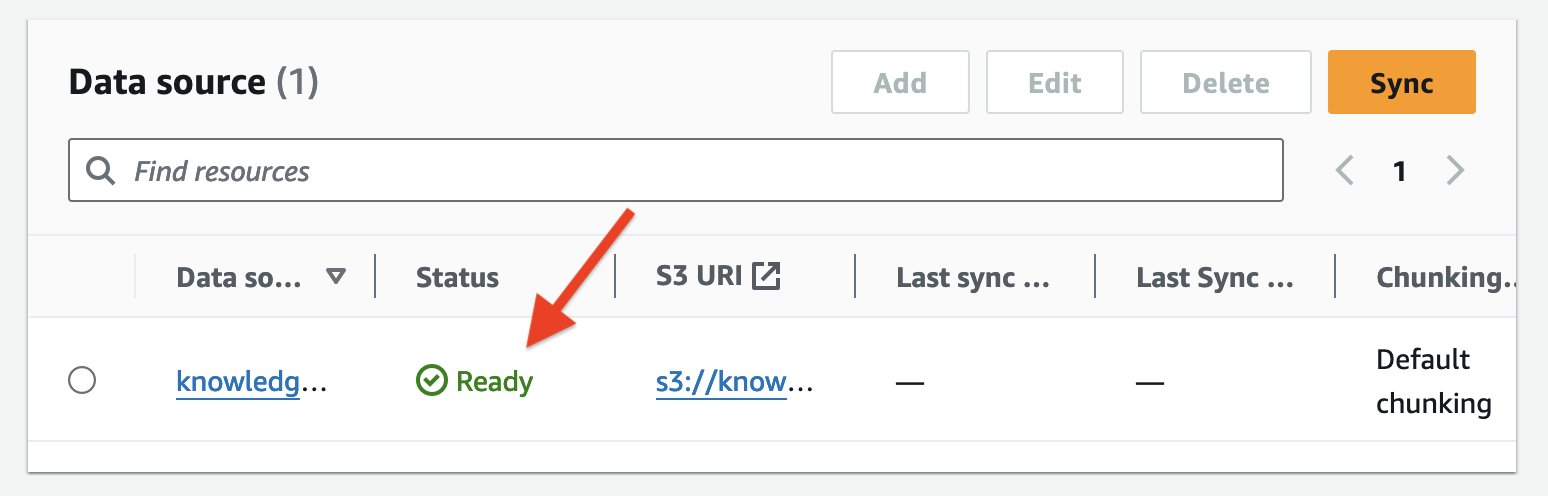

När datauppsättningssynkroniseringen är klar kommer datakällans status att ändras till Ready stat. Observera att om du lägger till ytterligare dokument i S3-datamappen måste du synkronisera om kunskapsbasen.

Grattis, din kunskapsbas är klar.

Observera att du också kan använda kunskapsbaser för Amazon Bedrock-tjänstens API:er och AWS-kommandoradsgränssnitt (AWS CLI) för att programmatiskt skapa en kunskapsbas. Du måste köra olika delar av Jupyter-anteckningsboken som finns under /notebook mapp i GitHub-repo.

Skapa en Lambda-funktion

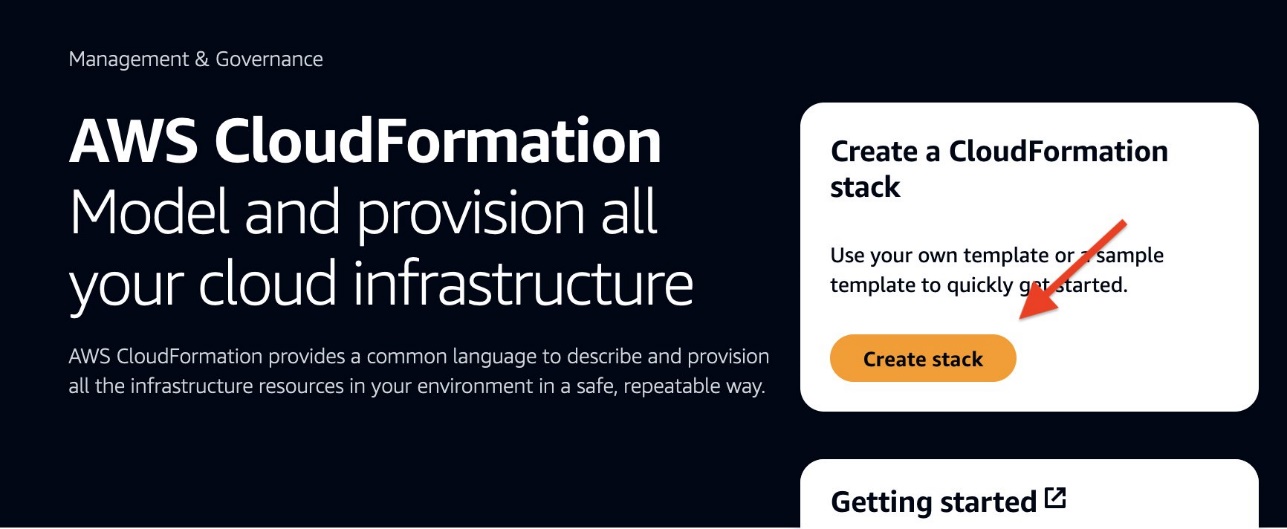

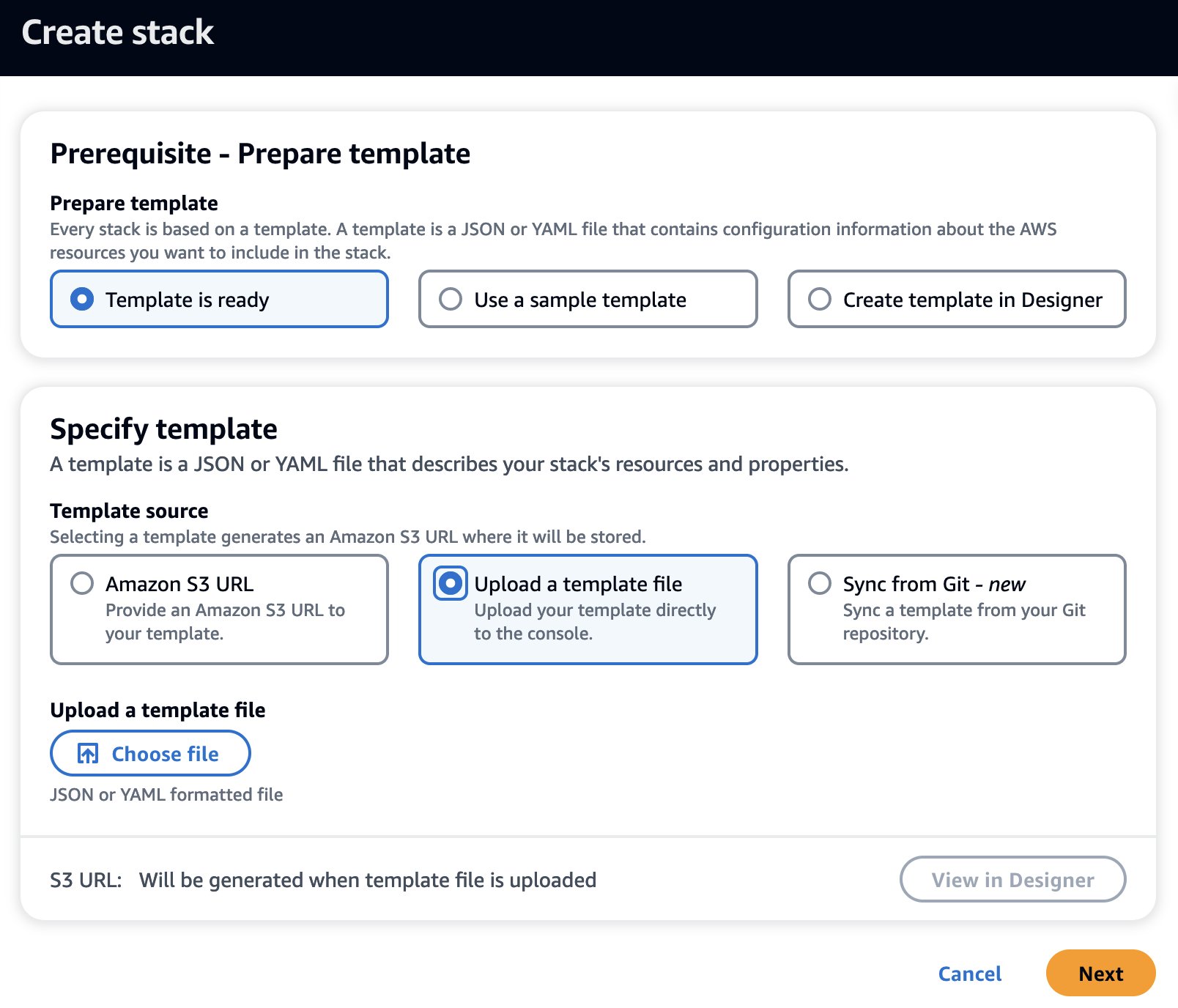

Denna Lambda-funktion distribueras med en AWS molnformation mall tillgänglig i GitHub-repo under /cfn mapp. Mallen kräver två parametrar: S3-segmentets namn och kunskapsbas-ID.

- På hemsidan för AWS CloudFormation-tjänsten väljer du Skapa stack för att skapa en ny stack.

- Välja Mallen är klar för Förbered mall.

- Välja Ladda upp mallfilen för Mallkälla.

- Välja Välj FIL, navigera till GitHub-repo som du klonade tidigare och välj .yaml-filen under

/cfnmapp. - Välja Nästa.

- För Stapla namn, ange ett namn.

- I parametrar sektion, ange kunskapsbas-ID och S3-segmentnamn som du noterade tidigare.

- Välja Nästa.

- Lämna alla standardalternativ som de är, välj Nästa, och välj Skicka.

- Kontrollera att CloudFormation-mallen kördes och att det inte finns några fel.

Grattis, du har skapat en Lambda-funktion, relaterade roller och policyer framgångsrikt.

Testa den kontextuella chatbot-applikationen

För att testa din chatbot-applikation, utför följande steg:

- Öppna en ny terminal eller ett kommandoradsfönster på din dator.

- Kör följande kommando för att installera AWS SDK för Python (Boto3). Boto3 gör det enkelt att integrera en Python-applikation, ett bibliotek eller ett skript med AWS-tjänster.

- Kör följande kommando för att installera och konfigurera en lokal Python-utvecklingsmiljö för att köra Streamlit-applikationen:

- Navigera till

/streamlitmapp i GitHub-förvarsmappen som du klonade tidigare. - Kör följande kommando för att instansiera chatbot-applikationen:

Detta bör öppna en webbaserad chattapplikation som drivs av Streamlit i din standardwebbläsare.

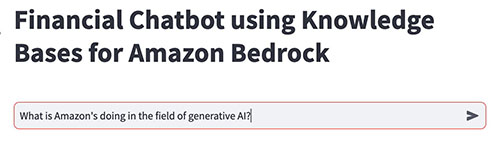

- Använd denna Streamlit chatbot-applikation för att lägga upp naturliga språkfrågor för att starta konversationerna som drivs av Knowledge Bases for Amazon Bedrock.

När du skickar en uppmaning utlöser Streamlit-appen Lambda-funktionen, som anropar kunskapsbaserna RetrieveAndGenerate API för att söka och generera svar.

Följande tabell innehåller några exempel på frågor och relaterade svar i kunskapsbasen. Testa några av dessa frågor genom att använda uppmaningar.

| frågor | svar |

| Vad gör Amazon inom området generativ AI? | Amazon har arbetat med sina egna stora språkmodeller (LLM) för generativ AI och tror att det kommer att förändra och förbättra varje kundupplevelse. De planerar att fortsätta att investera rejält i dessa modeller i alla sina konsument-, säljare-, varumärkes- och skaparupplevelser. |

| Vad är AWS intäkter från år till år 2022? | AWS-intäkterna ökade med 29 % jämfört med föregående år 2022 på en intäktsbas på 62 miljarder USD. |

| Hur många dagar har Amazon bett anställda att komma till jobbet på kontoret? | Amazon har bett företagsanställda att komma tillbaka till kontoret minst tre dagar i veckan från och med maj 2022. |

| Med hur många procent växte AWS-intäkterna år över år 2022? | AWS hade en omsättning på 29 % jämfört med föregående år ('YoY') 2022. |

| Jämfört med Graviton2-processorer, vilken prestandaförbättring levererade Graviton3-chips enligt passagen? | År 2022 levererade AWS sina Graviton3-chips, vilket gav 25 % bättre prestanda än Graviton2-processorerna. |

| Vilket var det första slutledningschipet som lanserades av AWS enligt passagen? | AWS lanserade sina första inferenschips (“Inferentia”) 2019, och de har sparat företag som Amazon över hundra miljoner dollar i kapitalkostnader. |

| Enligt sammanhanget, under vilket år ökade Amazons årliga intäkter från $245B till $434B? | Amazons årliga intäkter ökade från 245 miljarder USD 2019 till 434 miljarder USD 2022. |

| Berätta igen vad var intäkterna 2019? | Amazons intäkter 2019 var 245 miljarder dollar. |

| och 2021? | Amazons intäkter 2021 var 469.8 miljarder dollar, en ökning med 22 % jämfört med 2020. |

| Och påminn mig igen när det första slutledningschippet lanserades? | Amazons första slutledningschip var Inferentia, som lanserades 2019. |

Under det första anropet till Lambda-funktionen, RetrieveAndGenerate API returnerar en sessionId, som sedan skickas av Streamlit-appen tillsammans med den efterföljande användarprompten som en ingång till RetrieveAndGenerate API för att fortsätta konversationen i samma session. De RetrieveAndGenerate API hanterar korttidsminnet och använder chatthistoriken så länge som samma sessions-ID skickas som indata i de på varandra följande anropen.

Grattis, du har framgångsrikt skapat och testat en chatbot-applikation med kunskapsbaser för Amazon Bedrock.

Städa upp

Om du misslyckas med att ta bort resurser som S3-bucket, OpenSearch Serverless-samling och kunskapsbas kommer det att medföra avgifter. För att rensa upp dessa resurser, ta bort CloudFormation-stacken, ta bort S3-bucket (inklusive eventuella dokumentmappar och filer lagrade i den hinken), radera OpenSearch Serverless-samlingen, ta bort kunskapsbasen och ta bort alla roller, policyer och behörigheter som du skapat tidigare.

Slutsats

I det här inlägget gav vi en översikt över kontextuella chatbots och förklarade varför de är viktiga. Vi beskrev komplexiteten i dataintag och arbetsflöden för textgenerering för en RAG-arkitektur. Vi introducerade sedan hur Knowledge Bases for Amazon Bedrock skapar ett helt hanterat serverlöst RAG-system, inklusive en vektorbutik. Slutligen tillhandahöll vi en lösningsarkitektur och exempelkod i en GitHub repo för att hämta och generera kontextuella svar för en chatbotapplikation med hjälp av en kunskapsbas.

Genom att förklara värdet av kontextuella chatbots, utmaningarna med RAG-system och hur kunskapsbaser för Amazon Bedrock hanterar dessa utmaningar, syftade det här inlägget till att visa upp hur Amazon Bedrock gör det möjligt för dig att bygga sofistikerade konversations-AI-applikationer med minimal ansträngning.

För mer information, se Amazon Bedrock Developer Guide och Knowledge Base API:er.

Om författarna

Manish Chugh är en Principal Solutions Architect på AWS baserad i San Francisco, CA. Han är specialiserad på maskininlärning och generativ AI. Han arbetar med organisationer som sträcker sig från stora företag till nystartade företag med problem relaterade till maskininlärning. Hans roll innebär att hjälpa dessa organisationer att utforma skalbara, säkra och kostnadseffektiva arbetsbelastningar på AWS. Han presenterar regelbundet på AWS-konferenser och andra partnerevenemang. Utanför jobbet tycker han om att vandra på East Bay-stigar, cykla landsväg och titta på (och spela) cricket.

Manish Chugh är en Principal Solutions Architect på AWS baserad i San Francisco, CA. Han är specialiserad på maskininlärning och generativ AI. Han arbetar med organisationer som sträcker sig från stora företag till nystartade företag med problem relaterade till maskininlärning. Hans roll innebär att hjälpa dessa organisationer att utforma skalbara, säkra och kostnadseffektiva arbetsbelastningar på AWS. Han presenterar regelbundet på AWS-konferenser och andra partnerevenemang. Utanför jobbet tycker han om att vandra på East Bay-stigar, cykla landsväg och titta på (och spela) cricket.

Mani Khanuja är en Tech Lead – Generative AI Specialists, författare till boken Applied Machine Learning and High Performance Computing på AWS, och medlem i styrelsen för Women in Manufacturing Education Foundation Board. Hon leder maskininlärningsprojekt inom olika domäner som datorseende, naturlig språkbehandling och generativ AI. Hon talar på interna och externa konferenser som AWS re:Invent, Women in Manufacturing West, YouTube-webinarier och GHC 23. På fritiden gillar hon att gå långa löpturer längs stranden.

Mani Khanuja är en Tech Lead – Generative AI Specialists, författare till boken Applied Machine Learning and High Performance Computing på AWS, och medlem i styrelsen för Women in Manufacturing Education Foundation Board. Hon leder maskininlärningsprojekt inom olika domäner som datorseende, naturlig språkbehandling och generativ AI. Hon talar på interna och externa konferenser som AWS re:Invent, Women in Manufacturing West, YouTube-webinarier och GHC 23. På fritiden gillar hon att gå långa löpturer längs stranden.

Pallavi Nargund är en Principal Solutions Architect på AWS. I sin roll som möjliggörare av molnteknik arbetar hon med kunder för att förstå deras mål och utmaningar och ge föreskrivande vägledning för att uppnå deras mål med AWS-erbjudanden. Hon brinner för kvinnor inom teknik och är en kärnmedlem i Women in AI/ML på Amazon. Hon talar på interna och externa konferenser som AWS re:Invent, AWS Summits och webbseminarier. Utanför jobbet tycker hon om volontärarbete, trädgårdsarbete, cykling och vandring.

Pallavi Nargund är en Principal Solutions Architect på AWS. I sin roll som möjliggörare av molnteknik arbetar hon med kunder för att förstå deras mål och utmaningar och ge föreskrivande vägledning för att uppnå deras mål med AWS-erbjudanden. Hon brinner för kvinnor inom teknik och är en kärnmedlem i Women in AI/ML på Amazon. Hon talar på interna och externa konferenser som AWS re:Invent, AWS Summits och webbseminarier. Utanför jobbet tycker hon om volontärarbete, trädgårdsarbete, cykling och vandring.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- : har

- :är

- :var

- $UPP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- förmåga

- Om Oss

- accelerera

- tillgång

- åtkomst

- Enligt

- Konto

- exakt

- Uppnå

- tvärs

- Handling

- lägga till

- Annat

- adresser

- avancerat

- fördelar

- rådgivare

- igen

- medel

- AI

- AI-system

- AI / ML

- syftar

- Alla

- tillåta

- tillåter

- ensam

- längs

- vid sidan av

- också

- amason

- Amazon Web Services

- an

- och

- årsringar

- ÅRSOMSÄTTNING

- svara

- svar

- Antropisk

- vilken som helst

- api

- API: er

- app

- Ansökan

- tillämpningar

- tillämpas

- tillvägagångssätt

- arkitektur

- ÄR

- AS

- At

- förstärka

- augmented

- Augments

- aurora

- Författaren

- automatiskt

- tillgänglig

- Avenue

- bort

- AWS

- AWS molnformation

- AWS re: Invent

- tillbaka

- bas

- baserat

- grundläggande

- bukt

- Beach

- blir

- varit

- innan

- Börjar

- börjar

- beteende

- tror

- Bättre

- Miljarder

- ombord

- styrelse

- boken

- varumärke

- webbläsare

- SLUTRESULTAT

- företag

- Business Applications

- by

- CA

- Ring

- Samtal

- KAN

- kapacitet

- kapital

- fall

- CD

- utmaningar

- byta

- Förändringar

- avgifter

- chatt

- chatbot

- chatbots

- Till Kassan

- chip

- Pommes frites

- val

- Välja

- rena

- cli

- cloud

- MOLNTEKNIK

- koda

- samling

- kombinerar

- komma

- kommer

- Gemensam

- Företag

- företag

- fullborda

- komplexiteter

- komponenter

- beräkningar

- dator

- Datorsyn

- databehandling

- konferenser

- Kontakta

- Konsol

- Konsumenten

- sammanhang

- kontextuella

- kontextualisera

- fortsätta

- Konversation

- konversera

- konversations AI

- konversationer

- konverterad

- Kärna

- Företag

- kostnadseffektiv

- kunde

- skapa

- skapas

- skapar

- Skapa

- skapande

- skaparen

- kricket

- För närvarande

- kund

- kundbeteende

- kundupplevelse

- Kundservice

- Kunder

- kundanpassad

- datum

- datapunkter

- data driven

- Databas

- Dagar

- Standard

- leverera

- levereras

- leverera

- beroende

- utplacerade

- utplacering

- beskriven

- beskrivning

- detaljer

- Bestämma

- utveckla

- Utvecklare

- Utveckling

- Diagrammet

- DID

- olika

- digital

- Direktörer

- flera

- dokumentera

- dokument

- gör

- dollar

- domäner

- inte

- ner

- ladda ner

- varje

- Tidigare

- tidigt skede

- öster

- Utbildning

- effektiv

- ansträngning

- enkelt

- antingen

- inbäddning

- anställda

- möjliggöra

- möjliggörare

- möjliggör

- engagerande

- Motor

- Teknik

- förbättrad

- förbättra

- ange

- Företag

- företag

- Miljö

- fel

- Även

- händelser

- Varje

- exempel

- erfarenhet

- Erfarenheter

- expertis

- Förklara

- förklarade

- förklara

- extern

- fakta

- MISSLYCKAS

- få

- fält

- Fil

- Filer

- Slutligen

- fynd

- Förnamn

- flöda

- Fokus

- efter

- För

- fundament

- fyra

- Francisco

- Fri

- från

- fullständigt

- fungera

- g1

- generera

- genererar

- generering

- generativ

- Generativ AI

- gå

- GitHub

- Ge

- Go

- Mål

- växte

- Marken

- Väx

- Växer

- vägleda

- hade

- hantera

- Handtag

- Har

- he

- tung

- tunga lyft

- hjälpa

- här

- Hög

- högnivå

- hans

- historia

- Hem

- Hur ser din drömresa ut

- Men

- html

- http

- HTTPS

- hundra

- ID

- if

- illustrera

- illustrerar

- genomföra

- med Esport

- förbättra

- förbättring

- förbättra

- in

- innefattar

- Inklusive

- införliva

- inkorporerar

- Öka

- ökat

- index

- index

- individuellt

- industrier

- underrätta

- informationen

- Informationssystem

- ingång

- förfrågningar

- insikter

- installera

- omedelbar

- integrera

- Integrera

- integrering

- interagerar

- intressen

- Gränssnitt

- inre

- invändigt

- in

- införa

- introducerade

- investera

- anropar

- involverade

- innebär

- IT

- jpg

- Nyckel

- kunskap

- språk

- Språk

- Large

- Stora företag

- Efternamn

- senare

- lanserades

- lager

- leda

- Leads

- inlärning

- t minst

- Lämna

- mindre

- brev

- Nivå

- bibliotek

- Bibliotek

- lyft

- tycka om

- gillar

- Begränsad

- linje

- länkning

- LLM

- lokal

- Lång

- Maskinen

- maskininlärning

- Huvudsida

- GÖR

- hanterlig

- förvaltade

- förvaltar

- hantera

- Produktion

- många

- Match

- Maj..

- me

- betyder

- mekanism

- medlem

- Minne

- endast

- miljon

- miljoner dollar

- minimum

- minut

- minuter

- modell

- modeller

- modifiera

- mer

- mest

- multipel

- namn

- Natural

- Naturlig språkbehandling

- Navigera

- Navigering

- Behöver

- behövs

- behov

- Nya

- Nästa

- Nej

- Ingen

- Notera

- anteckningsbok

- noterade

- mål

- of

- erbjudanden

- offer~~POS=TRUNC

- Erbjudanden

- Office

- Ofta

- on

- ONE

- öppet

- öppen källkod

- optimala

- Alternativet

- Tillbehör

- or

- organisationer

- Övriga

- annat

- vår

- ut

- produktion

- utanför

- över

- OH

- Översikt

- egen

- sida

- panelen

- parametrar

- partnern

- reservdelar till din klassiker

- passagen

- passager

- Godkänd

- brinner

- Tidigare

- Mönster

- procentuell

- prestanda

- behörigheter

- personlig

- Planen

- plato

- Platon Data Intelligence

- PlatonData

- i

- Punkt

- poäng

- Strategier

- Populära

- popularitet

- Inlägg

- kraft

- drivs

- den mäktigaste

- preferenser

- presentera

- presenteras

- presenterar

- föregående

- Principal

- problem

- process

- bearbetning

- processorer

- Produkter

- Framsteg

- projekt

- prompter

- proprietary

- ge

- förutsatt

- ger

- tillhandahålla

- inköp

- Python

- sökfrågor

- fråga

- fråga

- frågor

- Snabbt

- trasa

- som sträcker sig

- RE

- redo

- verklig

- verkliga världen

- realtid

- register

- minska

- reducerande

- hänvisa

- regioner

- regelbundet

- relaterad

- relevans

- relevanta

- avlägsnar

- Rapport

- Repository

- representerar

- begära

- Obligatorisk

- Kräver

- Resurser

- Svara

- respons

- svar

- hämtning

- återgår

- intäkter

- översyn

- väg

- Roll

- roller

- Körning

- kör

- runtime

- Samma

- prov

- San

- San Francisco

- sparade

- skalbar

- skalning

- skript

- sDK

- Sök

- §

- sektioner

- säkra

- se

- välj

- vald

- semantisk

- skickas

- tjänar

- Server

- service

- Tjänster

- session

- in

- inställningar

- inställning

- aktieägare

- aktieägare

- hon

- kortsiktigt

- skall

- visa

- signifikant

- liknande

- samtidigt

- enda

- Storlek

- mindre

- lösning

- Lösningar

- några

- sofistikerade

- Källa

- Källor

- talar

- specialister

- specialiserat

- specifik

- specificerade

- delas

- Delar upp

- stapel

- starta

- Startups

- Ange

- status

- stjälkar

- Steg

- Steg

- lagra

- lagras

- lagrar

- misslyckande

- okomplicerad

- Strategi

- effektivisera

- skicka

- senare

- väsentligen

- Framgångsrikt

- sådana

- föreslå

- Toppmöten

- stödja

- Som stöds

- Stöder

- synkronisera.

- system

- System

- bord

- skräddarsydd

- Ta

- tar

- uppgifter

- tech

- Teknologi

- mall

- terminal

- testa

- testade

- text

- än

- den där

- Smakämnen

- den information

- källan

- deras

- Dem

- sedan

- Där.

- därför

- Dessa

- de

- detta

- de

- tre

- Genom

- tid

- titan

- till

- Förvandla

- utlösa

- betrodd

- prova

- två

- typer

- under

- förstå

- uppdatering

- uppladdad

- användning

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- verktyg

- v1

- Värdefulla

- värde

- Värden

- olika

- syn

- volym

- vill

- var

- tittar

- Sätt..

- we

- webb

- webbläsare

- webbservice

- Webb-baserad

- Webbseminarier

- vecka

- veckor

- väster

- Vad

- när

- som

- medan

- varför

- kommer

- fönster

- med

- Kvinnor

- kvinnor inom teknik

- Arbete

- arbetsflöde

- arbetsflöden

- arbetssätt

- fungerar

- skriva

- skriva kod

- skriven

- jaml

- år

- år

- Om er

- Din

- Youtube

- zephyrnet