Beskrivning

Din grundskolelärare visade dig förmodligen inte hur du lägger till 20-siffriga tal. Men om du vet hur man lägger till mindre siffror behöver du bara papper och penna och lite tålamod. Börja med en plats och arbeta åt vänster steg för steg, och snart kommer du att stapla upp kvintiljoner med lätthet.

Sådana problem är lätta för människor, men bara om vi närmar oss dem på rätt sätt. "Hur vi människor löser dessa problem är inte att "stirra på det och sedan skriva ner svaret", sa han Eran Malach, en maskininlärningsforskare vid Harvard University. "Vi går faktiskt genom stegen."

Den insikten har inspirerat forskare som studerar de stora språkmodellerna som driver chatbotar som ChatGPT. Även om dessa system kan häva frågor som involverar några steg av aritmetik, kommer de ofta flub problem som involverar många steg, som att beräkna summan av två stora tal. Men 2022, ett team av Google-forskare visade att genom att be språkmodeller generera steg-för-steg-lösningar gjorde det möjligt för modellerna att lösa problem som tidigare verkade utom räckhåll. Deras teknik, kallad chain-of-thought prompting, blev snart utbredd, även när forskare kämpade för att förstå vad som får det att fungera.

Nu har flera team utforskat kraften i tankekedjans resonemang genom att använda tekniker från en svårbegriplig gren av teoretisk datavetenskap som kallas beräkningskomplexitetsteori. Det är det senaste kapitlet i en forskningslinje som använder komplexitetsteori för att studera språkmodellernas inneboende möjligheter och begränsningar. Dessa ansträngningar klargör var vi kan förvänta oss att modeller misslyckas, och de kan peka mot nya tillvägagångssätt för att bygga dem.

"De tar bort en del av magin," sa Dimitris Papailiopoulos, en maskininlärningsforskare vid University of Wisconsin, Madison. "Det är en bra sak."

Utbildning av transformatorer

Stora språkmodeller är uppbyggda kring matematiska strukturer som kallas artificiella neurala nätverk. De många "neuronerna" i dessa nätverk utför enkla matematiska operationer på långa talsträngar som representerar enskilda ord, och omvandlar varje ord som passerar genom nätverket till ett annat. Detaljerna i denna matematiska alkemi beror på en annan uppsättning siffror som kallas nätverkets parametrar, som kvantifierar styrkan hos kopplingarna mellan neuroner.

För att träna en språkmodell för att producera sammanhängande utdata börjar forskare vanligtvis med ett neuralt nätverk vars parametrar alla har slumpmässiga värden, och matar sedan mängder av data från hela internet. Varje gång modellen ser ett nytt textblock försöker den förutsäga varje ord i tur och ordning: Den gissar det andra ordet baserat på det första, det tredje utifrån de två första, och så vidare. Den jämför varje förutsägelse med den faktiska texten och justerar sedan dess parametrar för att minska skillnaden. Varje tweak ändrar bara modellens förutsägelser en liten bit, men på något sätt gör deras kollektiva effekt att en modell kan reagera konsekvent på indata som den aldrig har sett.

Forskare har tränat neurala nätverk för att bearbeta språk i 20 år. Men arbetet tog fart på riktigt 2017, när forskare på Google introducerade en ny typ av nätverk kallas transformator.

"Detta föreslogs för sju år sedan, vilket verkar som förhistoria," sa Pablo Barceló, en maskininlärningsforskare vid det påvliga katolska universitetet i Chile.

Det som gjorde transformatorer så transformativa är att det är lätt att skala upp dem – för att öka antalet parametrar och mängden träningsdata – utan att göra träningen oöverkomligt dyr. Innan transformatorer hade neurala nätverk högst några hundra miljoner parametrar; idag har de största transformatorbaserade modellerna mer än en biljon. Mycket av förbättringen av språkmodellernas prestanda under de senaste fem åren kommer från att helt enkelt skala upp.

Transformatorer gjorde detta möjligt genom att använda speciella matematiska strukturer som kallas uppmärksamhetshuvuden, som ger dem ett slags fågelperspektiv av texten de läser. När en transformator läser ett nytt textblock, skannar dess uppmärksamhetshuvuden snabbt det hela och identifierar relevanta kopplingar mellan ord - kanske noterar att det fjärde och åttonde ordet sannolikt är mest användbart för att förutsäga det 10:e. Sedan skickar uppmärksamhetshuvudena ord vidare till ett enormt nät av neuroner som kallas ett feedforward-nätverk, som gör den tunga siffran som behövs för att generera de förutsägelser som hjälper den att lära sig.

Riktiga transformatorer har flera lager av uppmärksamhetshuvuden åtskilda av feedforward-nätverk och spottar bara ut förutsägelser efter det sista lagret. Men vid varje lager har uppmärksamhetshuvudena redan identifierat det mest relevanta sammanhanget för varje ord, så det beräkningsintensiva feedforward-steget kan ske samtidigt för varje ord i texten. Det påskyndar träningsprocessen, vilket gör det möjligt att träna transformatorer på allt större uppsättningar data. Ännu viktigare, det tillåter forskare att sprida den enorma beräkningsbelastningen av att träna ett massivt neuralt nätverk över många processorer som arbetar tillsammans.

För att få ut det mesta av massiva datamängder, "måste du göra modellerna riktigt stora", sa David Chiang, en maskininlärningsforskare vid University of Notre Dame. "Det kommer bara inte att vara praktiskt att träna dem om det inte är parallelliserat."

Den parallella strukturen som gör det så enkelt att träna transformatorer hjälper dock inte efter träning – då finns det ingen anledning att förutsäga ord som redan finns. Under ordinarie drift matar transformatorer ut ett ord i taget och kopplar tillbaka varje utgång till ingången innan de genererar nästa ord, men de har fortfarande fastnat i en arkitektur optimerad för parallell bearbetning.

När transformatorbaserade modeller växte och vissa uppgifter fortsatte att ge dem problem, började vissa forskare undra om pushen mot mer parallelliserbara modeller hade kostat. Fanns det ett sätt att teoretiskt förstå transformatorernas beteende?

Transformatorernas komplexitet

Teoretiska studier av neurala nätverk möter många svårigheter, särskilt när de försöker redogöra för träning. Neurala nätverk använder en välkänd procedur för att justera sina parametrar vid varje steg i träningsprocessen. Men det kan vara svårt att förstå varför denna enkla procedur sammanfaller med en bra uppsättning parametrar.

Istället för att överväga vad som händer under träning, studerar vissa forskare transformatorernas inneboende kapacitet genom att föreställa sig att det är möjligt att justera deras parametrar till godtyckliga värden. Detta motsvarar att behandla en transformator som en speciell typ av programmerbar dator.

"Du har en datorenhet, och du vill veta," Ja, vad kan den göra? Vilka typer av funktioner kan den beräkna?'” sa Chiang.

Dessa är de centrala frågorna i det formella studiet av beräkning. Fältet går tillbaka till 1936, när Alan Turing först föreställde sig en fantasifull apparat, nu kallad en Turing-maskin, som kunde utföra vilken beräkning som helst genom att läsa och skriva symboler på ett oändligt band. Beräkningskomplexitetsteoretiker skulle senare bygga vidare på Turings arbete genom att bevisa att beräkningsproblem naturligt faller in i olika komplexitetsklasser definieras av de resurser som krävs för att lösa dem.

2019, Barceló och två andra forskare visat att en idealiserad version av en transformator med ett fast antal parametrar skulle kunna vara lika kraftfull som en Turingmaskin. Om du ställer in en transformator för att upprepade gånger mata tillbaka dess utsignal som en ingång och ställer in parametrarna till lämpliga värden för det specifika problem du vill lösa, kommer den så småningom att spotta ut det korrekta svaret.

Det resultatet var en utgångspunkt, men det förlitade sig på några orealistiska antaganden som sannolikt skulle överskatta kraften hos transformatorer. Under åren sedan dess har forskare arbetat med att utveckla mer realistiska teoretiska ramverk.

En sådan insats började 2021, då William Merrill, nu doktorand vid New York University, lämnade ett tvåårigt stipendium vid Allen Institute for Artificial Intelligence i Seattle. Medan han var där, hade han analyserat andra typer av neurala nätverk med tekniker som verkade vara en dålig passform för transformatorers parallella arkitektur. Strax innan han lämnade inledde han ett samtal med Allen Institute for AI-forskare Ashish Sabharwal, som hade studerat komplexitetsteori innan han gick in i AI-forskning. De började misstänka att komplexitetsteorin kunde hjälpa dem att förstå gränserna för transformatorer.

"Det verkade bara som om det är en enkel modell; det måste finnas några begränsningar som man bara kan sätta fast”, sa Sabharwal.

Paret analyserade transformatorer med hjälp av en gren av beräkningskomplexitetsteori, kallad kretskomplexitet, som ofta används för att studera parallell beräkning och hade nyligen tillämpats till förenklade versioner av transformatorer. Under det följande året förfinade de flera av de orealistiska antagandena i tidigare arbete. För att studera hur den parallella strukturen hos transformatorer kan begränsa deras kapacitet, övervägde paret fallet där transformatorer inte matade tillbaka sin utgång till sin ingång - istället skulle deras första utgång vara det slutliga svaret. De visat att transformatorerna i detta teoretiska ramverk inte kunde lösa några beräkningsproblem som ligger utanför en specifik komplexitetsklass. Och många matematiska problem, inklusive relativt enkla sådana som att lösa linjära ekvationer, tros ligga utanför denna klass.

I grund och botten visade de att parallellism hade en kostnad - åtminstone när transformatorer var tvungna att spotta ut ett svar direkt. "Transformatorer är ganska svaga om sättet du använder dem är att du ger en input, och du bara förväntar dig ett omedelbart svar," sa Merrill.

Tankeexperiment

Merrill och Sabharwals resultat väckte en naturlig fråga - hur mycket kraftfullare blir transformatorer när de tillåts återvinna sina utgångar? Barceló och hans medförfattare hade studerat detta fall i sin analys 2019 av idealiserade transformatorer, men med mer realistiska antaganden förblev frågan öppen. Och under de mellanliggande åren hade forskare upptäckt tankekedjan, vilket gav frågan en nyfunnen relevans.

Merrill och Sabharwal visste att deras rent matematiska tillvägagångssätt inte kunde fånga alla aspekter av tankekedjans resonemang i riktiga språkmodeller, där formuleringen i prompten kan vara mycket viktigt. Men oavsett hur en prompt formuleras, så länge den får en språkmodell att mata ut steg-för-steg-lösningar, kan modellen i princip återanvända resultatet av mellansteg vid efterföljande passeringar genom transformatorn. Det kan ge ett sätt att kringgå gränserna för parallell beräkning.

Under tiden hade ett team från Peking University tänkt i liknande banor, och deras preliminära resultat var positiva. I en uppsats från maj 2023 identifierade de några matematiska problem som borde vara omöjliga för vanliga transformatorer i Merrill och Sabharwals ramverk, och visade att mellansteg gjorde det möjligt för transformatorerna att lösa dessa problem.

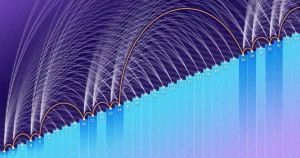

I oktober följde Merrill och Sabharwal upp sitt tidigare arbete med en detaljerad teoretisk studie av tankekedjans beräkningskraft. De kvantifierade hur den extra beräkningskraften beror på antalet mellansteg som en transformator får använda innan den måste spotta ut ett slutgiltigt svar. I allmänhet förväntar sig forskarna att det lämpliga antalet mellansteg för att lösa ett problem beror på storleken på input till problemet. Till exempel kräver den enklaste strategin för att lägga till två 20-siffriga tal dubbelt så många mellanliggande additionssteg som samma metod för att lägga till två 10-siffriga tal.

Exempel som detta tyder på att transformatorer inte skulle tjäna mycket på att använda bara några mellansteg. Merrill och Sabharwal bevisade faktiskt att tankekedjan verkligen börjar hjälpa till när antalet mellansteg växer i proportion till storleken på insatsen, och många problem kräver att antalet mellansteg fortfarande växer mycket större.

Grundligheten i resultatet imponerade på forskare. "De satte verkligen fast det här," sa Daniel Hsu, en maskininlärningsforskare vid Columbia University.

Merrill och Sabharwals senaste arbete indikerar att tankekedjan inte är ett universalmedel - i princip kan det hjälpa transformatorer att lösa svårare problem, men bara till priset av en hel del beräkningsansträngning.

"Vi är intresserade av olika sätt att komma runt transformatorernas begränsningar med ett steg," sa Merrill. "Tankekedja är ett sätt, men det här dokumentet visar att det kanske inte är det mest ekonomiska sättet."

Tillbaka till verkligheten

Fortfarande varnar forskarna för att denna typ av teoretisk analys bara kan avslöja så mycket om verkliga språkmodeller. Positiva resultat – bevis på att transformatorer i princip kan lösa vissa problem – innebär inte att en språkmodell faktiskt lär sig dessa lösningar under träning.

Och även resultat som tar itu med transformatorernas begränsningar kommer med förbehåll: De indikerar att ingen transformator kan lösa vissa problem perfekt i alla fall. Naturligtvis är det en ganska hög nivå. "Det kan finnas speciella fall av problemet som det skulle kunna hantera bra," sa Hsu.

Trots dessa varningar erbjuder det nya verket en mall för att analysera olika typer av neurala nätverksarkitekturer som så småningom kan ersätta transformatorer. Om en komplexitetsteorianalys tyder på att vissa typer av nätverk är mer kraftfulla än andra, skulle det vara bevis på att dessa nätverk kan klara sig bättre i den verkliga världen också.

Chiang betonade också att forskning om transformatorers begränsningar är desto mer värdefull eftersom språkmodeller i allt högre grad används i ett brett utbud av verkliga tillämpningar, vilket gör det lätt att överskatta deras förmågor.

"Det finns faktiskt många saker som de inte gör så bra, och vi måste vara väldigt, väldigt medvetna om vad begränsningarna är," sa Chiang. "Det är därför den här typen av arbete är väldigt viktigt."

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://www.quantamagazine.org/how-chain-of-thought-reasoning-helps-neural-networks-compute-20240321/

- : har

- :är

- :inte

- :var

- ][s

- $UPP

- 10:e

- 20

- 20 år

- 2017

- 2019

- 2021

- 2022

- 2023

- a

- förmågor

- Om oss

- Konto

- tvärs

- faktiska

- faktiskt

- lägga till

- tillsats

- Dessutom

- adress

- justera

- Efter

- sedan

- AI

- ai forskning

- Alan

- Alan Turing

- Alkemi

- Alla

- allen

- tillåts

- tillåter

- längs

- redan

- också

- mängd

- mängder

- an

- analys

- analyseras

- analys

- och

- Annan

- svara

- vilken som helst

- tillämpningar

- tillvägagångssätt

- tillvägagångssätt

- lämpligt

- godtycklig

- Arcane

- arkitektur

- arkitekturer

- ÄR

- runt

- konstgjord

- artificiell intelligens

- AS

- be

- aspekter

- antaganden

- At

- uppmärksamhet

- bort

- tillbaka

- bar

- baserat

- BE

- blev

- blir

- varit

- innan

- började

- börjar

- beteende

- Bättre

- mellan

- Bortom

- Bit

- Blockera

- Branch

- SLUTRESULTAT

- Byggnad

- byggt

- men

- by

- beräkning

- kallas

- KAN

- kapacitet

- fånga

- Vid

- fall

- Orsakerna

- försiktighet

- centrala

- vissa

- kedja

- Förändringar

- Kapitel

- chatbots

- ChatGPT

- Chile

- klass

- SAMMANHÄNGANDE

- Kollektiv

- COLUMBIA

- komma

- kommer

- Komplexiteten

- beräkning

- beräkningar

- beräkningskraft

- beräkningsmässigt

- Compute

- dator

- Datavetenskap

- databehandling

- Anslutningar

- Tänk

- anses

- sammanhang

- fortsatte

- Konversation

- korrekt

- Pris

- kunde

- Kurs

- datum

- datauppsättningar

- Datum

- definierade

- bero

- beror

- detaljer

- utveckla

- anordning

- DID

- Skillnaden

- olika

- svårt

- svårigheter

- upptäckt

- do

- gör

- inte

- inte

- ner

- under

- varje

- Tidigare

- lätta

- lätt

- effekt

- ansträngning

- ansträngningar

- Åttonde

- aktiverad

- möjliggör

- enorm

- ekvationer

- speciellt

- undgå

- Även

- så småningom

- Varje

- bevis

- exempel

- existerar

- förvänta

- dyra

- utforskas

- extra

- Ansikte

- MISSLYCKAS

- Höst

- få

- fält

- slutlig

- änden

- Förnamn

- passa

- fem

- fixerad

- följt

- efter

- För

- formell

- Fjärde

- Ramverk

- ramar

- från

- funktioner

- Få

- Allmänt

- generera

- generera

- skaffa sig

- få

- Ge

- Ge

- kommer

- god

- fick

- grad

- uppgradera

- växte

- Väx

- Växer

- hade

- hantera

- hända

- händer

- hårdare

- Harvard

- Harvard Universitet

- Har

- he

- huvuden

- tung

- hjälpa

- hjälper

- Hög

- hans

- Hur ser din drömresa ut

- How To

- http

- HTTPS

- Människa

- hundra

- identifierade

- identifiera

- if

- inbillade

- omedelbar

- med Esport

- omöjligt

- imponerad

- förbättring

- in

- Inklusive

- Öka

- alltmer

- ja

- indikerar

- pekar på

- individuellt

- Oändlig

- ING

- ingång

- ingångar

- inuti

- insikt

- inspirerat

- istället

- Institute

- Intelligens

- intresserad

- Internet

- ingripande

- in

- inneboende

- introducerade

- involverar

- IT

- DESS

- bara

- Snäll

- slag

- Vet

- språk

- Large

- större

- största

- Efternamn

- senare

- senaste

- lager

- skikt

- LÄRA SIG

- inlärning

- t minst

- lämnar

- lie

- tycka om

- sannolikt

- BEGRÄNSA

- begränsningar

- gränser

- linje

- linjär

- rader

- läsa in

- Lång

- Lot

- Maskinen

- maskininlärning

- gjord

- magasinet

- magi

- göra

- GÖR

- Framställning

- många

- massiv

- matte

- matematisk

- Materia

- Maj..

- merrill

- kanske

- miljon

- modell

- modeller

- mer

- mest

- rörliga

- mycket

- multipel

- måste

- Natural

- Behöver

- behövs

- nät

- nätverk

- neurala

- neurala nätverk

- neurala nätverk

- nervceller

- aldrig

- Nya

- New York

- Nästa

- Nej

- notera

- nu

- antal

- nummer

- oktober

- of

- sänkt

- Erbjudanden

- Ofta

- on

- ONE

- ettor

- endast

- till

- öppet

- drift

- Verksamhet

- optimerad

- vanlig

- Övriga

- Övrigt

- ut

- produktion

- utgångar

- utanför

- över

- par

- universalmedel

- Papper

- Parallell

- parametrar

- passera

- passerar

- Tidigare

- Tålamod

- peking

- perfekt

- Utföra

- prestanda

- kanske

- Plats

- plato

- Platon Data Intelligence

- PlatonData

- Punkt

- dålig

- positiv

- möjlig

- kraft

- den mäktigaste

- Praktisk

- förutse

- förutsäga

- förutsägelse

- Förutsägelser

- preliminära

- pretty

- föregående

- tidigare

- Principen

- förmodligen

- Problem

- problem

- förfaranden

- process

- bearbetning

- processorer

- producera

- programmerbar

- korrektur

- andel

- föreslagen

- visat

- ge

- bevisa

- rent

- Tryck

- Quantamagazin

- kvantifierad

- fråga

- frågor

- snabbt

- ganska

- insamlat

- slumpmässig

- område

- nå

- Läsning

- verklig

- verkliga världen

- realistisk

- Verkligheten

- verkligen

- senaste

- minska

- raffinerade

- relativt

- relevans

- relevanta

- förblev

- ta bort

- UPPREPAT

- ersätta

- representerar

- kräver

- Obligatorisk

- Kräver

- forskning

- forskaren

- forskare

- Resurser

- Svara

- resultera

- Resultat

- återanvända

- avslöjar

- höger

- Nämnda

- Samma

- Skala

- skalning

- scanna

- Skola

- Vetenskap

- Seattle

- Andra

- verkade

- verkar

- sett

- ser

- in

- uppsättningar

- sju

- flera

- Inom kort

- skall

- show

- visade

- Visar

- liknande

- Enkelt

- förenklade

- helt enkelt

- samtidigt

- eftersom

- Storlek

- mindre

- So

- Lösningar

- LÖSA

- Lösa

- några

- på något sätt

- snart

- speciell

- specifik

- hastigheter

- spridning

- stapling

- starta

- Starta

- Steg

- Steg

- Fortfarande

- Strategi

- hållfasthet

- struktur

- strukturer

- student

- studerade

- studier

- Läsa på

- Studerar

- senare

- sådana

- föreslå

- Föreslår

- System

- Tandem

- uppgifter

- grupp

- lag

- Tekniken

- tekniker

- mall

- text

- än

- den där

- Smakämnen

- deras

- Dem

- sedan

- teoretiska

- Teorin

- Där.

- Dessa

- de

- sak

- saker

- Tänkande

- Tredje

- detta

- de

- trodde

- Genom

- tid

- till

- i dag

- tog

- mot

- Tåg

- Utbildning

- transformativ

- transformator

- transformatorer

- behandling

- Biljon

- problem

- prova

- turing

- SVÄNG

- justera

- tweaks

- Dubbelt

- två

- Typ

- typer

- typiskt

- förstå

- universitet

- såvida inte

- användning

- Begagnade

- användbara

- användningar

- med hjälp av

- Värdefulla

- Värden

- version

- versioner

- mycket

- utsikt

- gå

- vill

- var

- Sätt..

- sätt

- we

- svag

- webb

- webp

- VÄL

- ALLBEKANT

- były

- Vad

- när

- om

- som

- medan

- Hela

- vars

- varför

- bred

- Brett utbud

- utbredd

- kommer

- med

- utan

- undrar

- ord

- formulering

- ord

- Arbete

- arbetade

- arbetssätt

- världen

- skulle

- skriva

- skrivning

- år

- år

- york

- Om er

- zephyrnet