Amazon SageMaker JumpStart är Machine Learning (ML) navet i SageMaker som tillhandahåller förutbildade, allmänt tillgängliga modeller för ett brett utbud av problemtyper för att hjälpa dig komma igång med maskininlärning.

JumpStart erbjuder också exempel på anteckningsböcker som använder Amazon SageMaker funktioner som instansutbildning och experiment över ett stort antal modelltyper och användningsfall. Dessa exempel anteckningsböcker innehåller kod som visar hur man tillämpar ML-lösningar med SageMaker och JumpStart. De kan anpassas för att matcha dina egna behov och kan därmed påskynda applikationsutvecklingen.

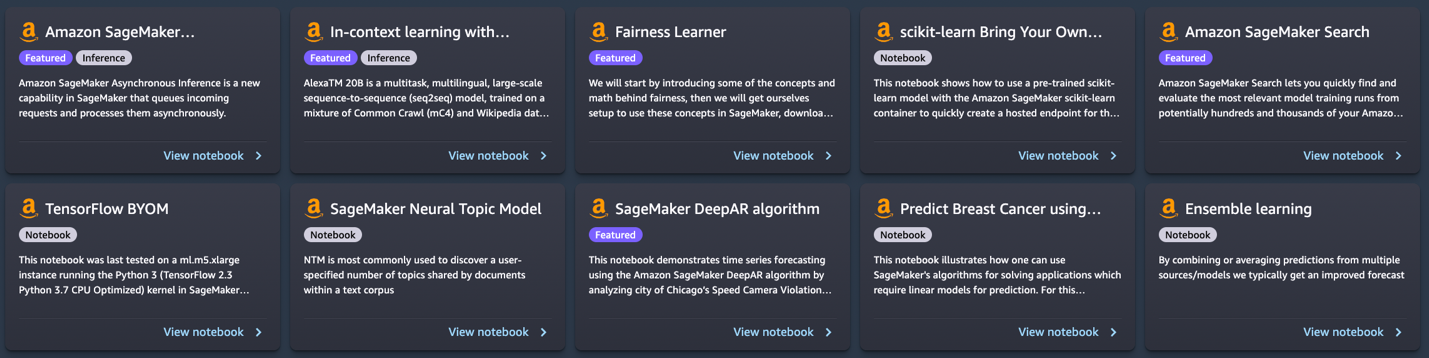

Nyligen lade vi till 10 nya anteckningsböcker till JumpStart in Amazon SageMaker Studio. Det här inlägget fokuserar på dessa nya anteckningsböcker. När detta skrivs erbjuder JumpStart 56 bärbara datorer, allt från att använda state-of-the-art modeller för naturlig språkbehandling (NLP) till att fixa bias i datauppsättningar när man tränar modeller.

De 10 nya anteckningsböckerna kan hjälpa dig på följande sätt:

- De erbjuder exempelkod för dig att köra som den är från JumpStart UI i Studio och se hur koden fungerar

- De visar användningen av olika SageMaker och JumpStart API:er

- De erbjuder en teknisk lösning som du kan skräddarsy ytterligare utifrån dina egna behov

Antalet anteckningsböcker som erbjuds genom JumpStart ökar regelbundet när fler anteckningsböcker läggs till. Dessa anteckningsböcker finns också tillgängliga på github.

Översikt över anteckningsböcker

De 10 nya anteckningsböckerna är följande:

- Inlärning i sammanhang med AlexaTM 20B – Demonstrerar hur man använder AlexaTM 20B för inlärning i sammanhang med noll- och få-shot-inlärning på fem exempeluppgifter: textsammanfattning, generering av naturligt språk, maskinöversättning, extraktiv frågesvar och naturligt språkinferens och klassificering.

- Fairness linear learner i SageMaker – Det har nyligen funnits oro för partiskhet i ML-algoritmer som ett resultat av att efterlikna existerande mänskliga fördomar. Den här anteckningsboken tillämpar rättvisekoncept för att justera modellförutsägelser på lämpligt sätt.

- Hantera ML-experiment med SageMaker Search – Amazon SageMaker Search låter dig snabbt hitta och utvärdera de mest relevanta modellutbildningskörningarna från potentiellt hundratals och tusentals SageMaker modellutbildningsjobb.

- SageMaker neurala ämnesmodell – SageMaker Neural Topic Model (NTM) är en oövervakad inlärningsalgoritm som försöker beskriva en uppsättning observationer som en blandning av distinkta kategorier.

- Förutse körhastighetsöverträdelser – SageMaker DeepAR-algoritmen kan användas för att träna en modell för flera gator samtidigt och förutsäga överträdelser för flera gatukameror.

- Förutsägelse av bröstcancer – Den här anteckningsboken använder UCI:s diagnostiska datauppsättning för bröstcancer för att bygga en prediktiv modell av huruvida en bröstmassabild indikerar en godartad eller maligna tumör.

- Ensembleförutsägelser från flera modeller – Genom att kombinera eller beräkna medelvärde för förutsägelser från flera källor och modeller får vi vanligtvis en förbättrad prognos. Den här anteckningsboken illustrerar detta koncept.

- SageMaker asynkron slutledning – Asynkron inferens är ett nytt inferensalternativ för nästan realtids-inferensbehov. Begäranden kan ta upp till 15 minuter att behandla och har en nyttolaststorlek på upp till 1 GB.

- TensorFlow ta med din egen modell – Lär dig hur du tränar en TensorFlow-modell lokalt och distribuerar på SageMaker med den här anteckningsboken.

- Scikit-lär ta med din egen modell - Den här anteckningsboken visar hur man använder en förtränad Scikit-learn-modell med SageMaker Scikit-learn-behållaren för att snabbt skapa en värdslutpunkt för den modellen.

Förutsättningar

För att använda dessa anteckningsböcker, se till att du har tillgång till Studio med en exekveringsroll som låter dig köra SageMaker-funktionalitet. Den korta videon nedan hjälper dig att navigera till JumpStart-anteckningsböcker.

I följande avsnitt går vi igenom var och en av de 10 nya lösningarna och diskuterar några av deras intressanta detaljer.

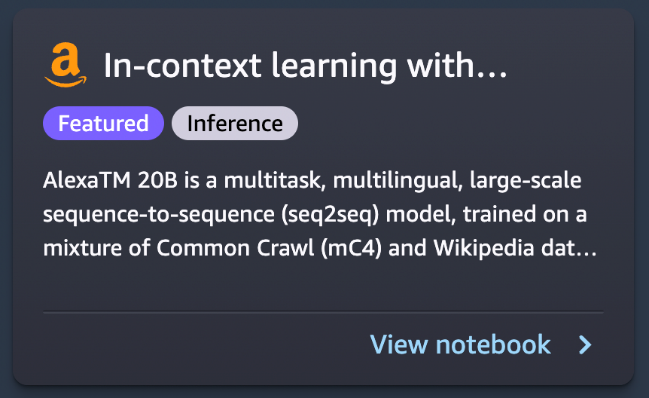

Inlärning i sammanhang med AlexaTM 20B

AlexaTM 20B är en multitask, flerspråkig, storskalig sekvens-till-sekvens (seq2seq)-modell, tränad på en blandning av Common Crawl (mC4) och Wikipedia-data på 12 språk, med hjälp av denoising och Causal Language Modeling (CLM) uppgifter. Den uppnår toppmoderna prestanda på vanliga språkuppgifter i sammanhanget såsom sammanfattning i en enda åtgärd och maskinöversättning i ett skott, överträffar modeller med endast dekoder som Open AI:s GPT3 och Googles PaLM, som är över åtta gånger större.

Inlärning i sammanhang, även känd som vilket fick, syftar på en metod där du använder en NLP-modell på en ny uppgift utan att behöva finjustera den. Ett fåtal uppgiftsexempel ges till modellen endast som en del av inferensinmatningen, ett paradigm som kallas få skott i kontextinlärning. I vissa fall kan modellen prestera bra utan några träningsdata alls, endast givet en förklaring av vad som bör förutsägas. Det här kallas noll-shot inlärning i sammanhang.

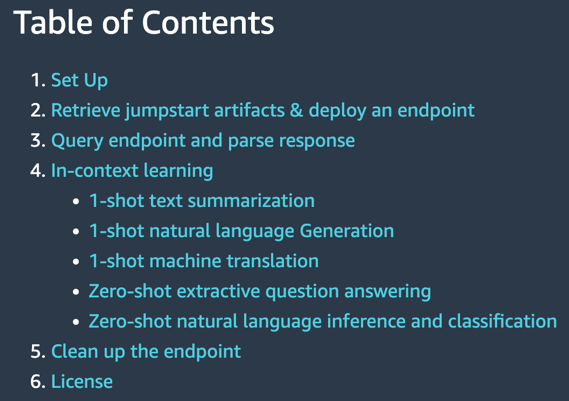

Den här anteckningsboken visar hur man distribuerar AlexaTM 20B genom JumpStart API och kör inferens. Den visar också hur AlexaTM 20B kan användas för inlärning i sammanhang med fem exempeluppgifter: textsammanfattning, generering av naturligt språk, maskinöversättning, extraktiv frågesvar och naturligt språkinferens och klassificering.

|

|

Anteckningsboken visar följande:

- Sammanfattning av text i ett slag, generering av naturligt språk och maskinöversättning med ett enda träningsexempel för var och en av dessa uppgifter

- Zero-shot frågesvar och naturlig språkinferens plus klassificering med modellen som den är, utan att behöva ge några träningsexempel.

Prova att köra din egen text mot den här modellen och se hur den sammanfattar text, extraherar frågor och svar eller översätter från ett språk till ett annat.

Fairness linjär inlärare i SageMaker

Det har nyligen funnits oro för partiskhet i ML-algoritmer som ett resultat av att efterlikna existerande mänskliga fördomar. Nuförtiden har flera ML-metoder starka sociala konsekvenser, till exempel används de för att förutsäga banklån, försäkringsräntor eller reklam. Tyvärr kommer en algoritm som lär sig av historiska data naturligtvis ärva tidigare fördomar. Den här anteckningsboken presenterar hur man kan övervinna detta problem genom att använda SageMaker och rättvisa algoritmer i samband med linjära elever.

Den börjar med att introducera några av begreppen och matematiken bakom rättvisa, sedan laddar den ned data, tränar en modell och tillämpar slutligen rättvisekoncept för att justera modellförutsägelser på lämpligt sätt.

|

|

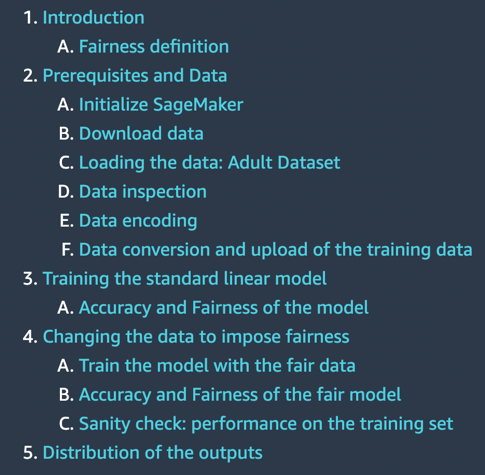

Anteckningsboken visar följande:

- Kör en linjär standardmodell på UCI:s Adult dataset.

- Visar orättvisa i modellförutsägelser

- Fixar data för att ta bort partiskhet

- Återutbilda modellen

Prova att köra din egen data med hjälp av den här exempelkoden och upptäck om det finns partiskhet. Efter det, försök att ta bort bias, om någon, i din datauppsättning med hjälp av de medföljande funktionerna i den här anteckningsboken.

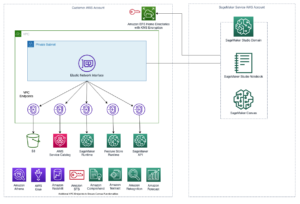

Hantera ML-experimentering med SageMaker Search

SageMaker Search låter dig snabbt hitta och utvärdera de mest relevanta modellutbildningskörningarna från potentiellt hundratals och tusentals SageMaker modellutbildningsjobb. Att utveckla en ML-modell kräver kontinuerligt experimenterande, provning av nya inlärningsalgoritmer och justering av hyperparametrar, samtidigt som man observerar effekterna av sådana förändringar på modellens prestanda och noggrannhet. Denna iterativa övning leder ofta till en explosion av hundratals modellträningsexperiment och modellversioner, vilket saktar ner konvergensen och upptäckten av en vinnande modell. Dessutom gör informationsexplosionen det väldigt svårt att spåra en modellversions härkomst – den unika kombinationen av datamängder, algoritmer och parametrar som skapade den modellen i första hand.

Den här anteckningsboken visar hur du använder SageMaker Search för att snabbt och enkelt organisera, spåra och utvärdera dina modellutbildningsjobb på SageMaker. Du kan söka på alla definierande attribut från inlärningsalgoritmen som används, hyperparameterinställningar, träningsdatauppsättningar som används och till och med taggarna du har lagt till i modellutbildningsjobben. Du kan också snabbt jämföra och rangordna dina träningskörningar baserat på deras prestationsmått, såsom träningsförlust och valideringsnoggrannhet, och därigenom skapa topplistor för att identifiera de vinnande modellerna som kan distribueras i produktionsmiljöer. SageMaker Search kan snabbt spåra tillbaka hela linjen för en modellversion som distribueras i en live-miljö, ända fram till de datauppsättningar som används för att träna och validera modellen.

|

|

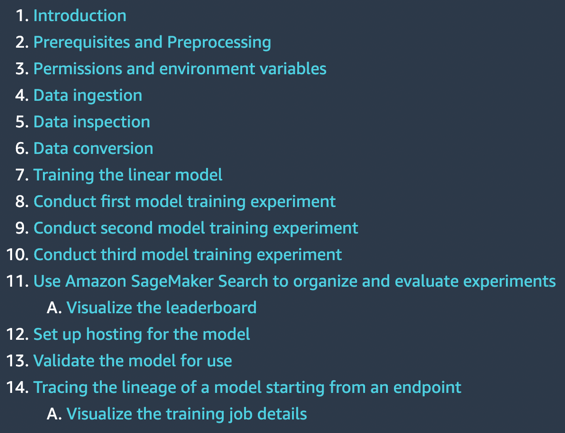

Anteckningsboken visar följande:

- Träna en linjär modell tre gånger

- Använder SageMaker Search för att organisera och utvärdera dessa experiment

- Visualisera resultaten i en topplista

- Distribuera en modell till en slutpunkt

- Spåra härstamning av modellen med början från slutpunkten

I din egen utveckling av prediktiva modeller kan du köra flera experiment. Testa att använda SageMaker Search i sådana experiment och upplev hur det kan hjälpa dig på flera sätt.

SageMaker neurala ämnesmodell

SageMaker Neural Topic Model (NTM) är en oövervakad inlärningsalgoritm som försöker beskriva en uppsättning observationer som en blandning av distinkta kategorier. NTM används oftast för att upptäcka ett användarspecificerat antal ämnen som delas av dokument inom en textkorpus. Här är varje observation ett dokument, funktionerna är närvaron (eller antalet förekomster) av varje ord, och kategorierna är ämnena. Eftersom metoden är oövervakad, är ämnena inte specificerade i förväg och är inte garanterade att överensstämma med hur en människa naturligt kan kategorisera dokument. Ämnena lärs in som en sannolikhetsfördelning över de ord som förekommer i varje dokument. Varje dokument beskrivs i sin tur som en blandning av ämnen.

Den här anteckningsboken använder SageMaker NTM-algoritmen för att träna en modell på datasetet 20NewsGroups. Denna datauppsättning har använts i stor utsträckning som ett riktmärke för ämnesmodellering.

|

|

Anteckningsboken visar följande:

- Skapa ett SageMaker-utbildningsjobb på en datauppsättning för att producera en NTM-modell

- Använda modellen för att utföra slutledning med en SageMaker-slutpunkt

- Utforska den tränade modellen och visualisera inlärda ämnen

Du kan enkelt ändra den här anteckningsboken så att den körs på dina textdokument och dela upp dem i olika ämnen.

Förutse körhastighetsöverträdelser

Den här anteckningsboken visar tidsserieprognoser med SageMaker DeepAR-algoritmen genom att analysera staden Chicagos datauppsättning för hastighetskameraöverträdelser. Data.gov är värd för datasetet och hanteras av US General Services Administration, Technology Transformation Service.

Dessa överträdelser fångas upp av kamerasystem och är tillgängliga för att förbättra allmänhetens liv genom dataportalen Chicago stad. Datauppsättningen Speed Camera Violation kan användas för att urskilja mönster i data och få meningsfulla insikter.

Datauppsättningen innehåller flera kameraplatser och dagliga överträdelser. Varje daglig överträdelseräkning för en kamera kan betraktas som en separat tidsserie. Du kan använda SageMaker DeepAR-algoritmen för att träna en modell för flera gator samtidigt och förutsäga överträdelser för flera gatukameror.

|

|

Anteckningsboken visar följande:

- Träna SageMaker DeepAR-algoritmen på tidsseriedataset med hjälp av punktinstanser

- Att dra slutsatser om den tränade modellen för att göra förutsägelser om trafiköverträdelser

Med den här anteckningsboken kan du lära dig hur tidsserieproblem kan lösas med hjälp av DeepAR-algoritmen i SageMaker och prova att tillämpa den på dina egna tidsseriedatauppsättningar.

Förutsägelse av bröstcancer

Den här anteckningsboken tar ett exempel för förutsägelse av bröstcancer med hjälp av UCI:s diagnostiska datauppsättning för bröstcancer. Den använder denna datauppsättning för att bygga en prediktiv modell av huruvida en bröstmassabild indikerar en godartad eller malign tumör.

|

|

Anteckningsboken visar följande:

- Grundläggande inställningar för att använda SageMaker

- Konvertera datamängder till Protobuf-format som används av SageMaker-algoritmerna och ladda upp till Amazon enkel lagringstjänst (Amazon S3)

- Träna en SageMaker linjär inlärarmodell på datamängden

- Värd för den utbildade modellen

- Poängsättning med hjälp av den tränade modellen

Du kan gå igenom den här anteckningsboken för att lära dig hur du löser ett affärsproblem med SageMaker, och förstår stegen som är involverade för att träna och vara värd för en modell.

Ensemble förutsägelser från flera modeller

I praktiska tillämpningar av ML på prediktiva uppgifter räcker det ofta inte med en modell. De flesta förutsägelsetävlingar kräver vanligtvis att man kombinerar prognoser från flera källor för att få en förbättrad prognos. Genom att kombinera eller beräkna ett genomsnitt av förutsägelser från flera källor eller modeller får vi vanligtvis en förbättrad prognos. Detta beror på att det finns en stor osäkerhet i valet av modell och att det inte finns någon riktig modell i många praktiska tillämpningar. Därför är det fördelaktigt att kombinera förutsägelser från olika modeller. I den Bayesianska litteraturen kallas denna idé för Bayesiansk modellmedelvärde och har visat sig fungera mycket bättre än att bara välja en modell.

Den här anteckningsboken presenterar ett illustrativt exempel för att förutsäga om en person tjänar över 50,000 XNUMX USD per år baserat på information om sin utbildning, arbetslivserfarenhet, kön och mer.

|

|

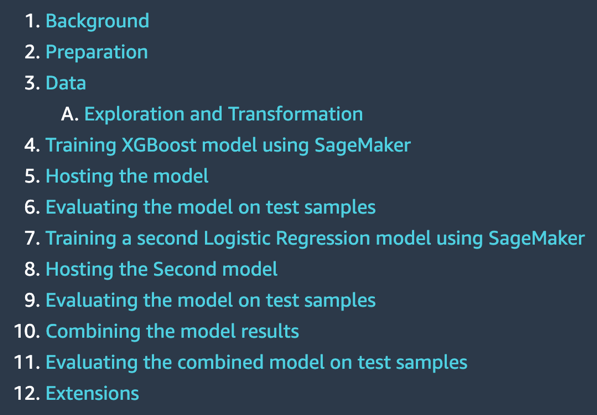

Anteckningsboken visar följande:

- Förbereder din SageMaker-anteckningsbok

- Laddar en datauppsättning från Amazon S3 med SageMaker

- Undersöker och transformerar data så att de kan matas till SageMakers algoritmer

- Beräkna en modell med SageMaker XGBoost (Extreme Gradient Boosting) algoritm

- Hostar modellen på SageMaker för att göra pågående förutsägelser

- Uppskattning av en andra modell med SageMaker linjära inlärarmetod

- Kombinera förutsägelserna från båda modellerna och utvärdera den kombinerade förutsägelsen

- Generera slutliga förutsägelser på testdatauppsättningen

Prova att köra den här anteckningsboken på din datauppsättning och använda flera algoritmer. Prova att experimentera med olika kombinationer av modeller som erbjuds av SageMaker och JumpStart och se vilken kombination av modellsammansättning som ger bäst resultat på din egen data.

SageMaker asynkron slutledning

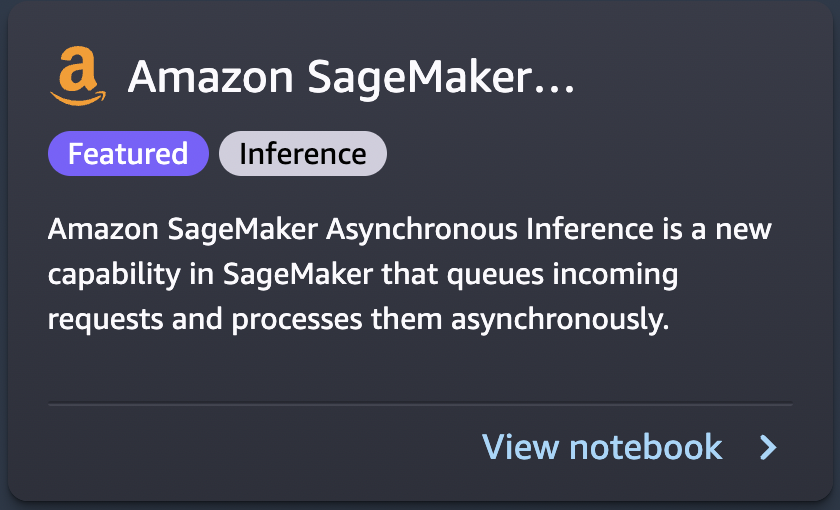

SageMaker asynkron inferens är en ny funktion i SageMaker som köar inkommande förfrågningar och behandlar dem asynkront. SageMaker erbjuder för närvarande två slutledningsalternativ för kunder att distribuera ML-modeller: ett realtidsalternativ för arbetsbelastningar med låg latens och batchtransformering, ett offlinealternativ för att bearbeta slutledningsförfrågningar på partier av data som är tillgängliga i förväg. Realtidsinferens är lämplig för arbetsbelastningar med nyttolaststorlekar på mindre än 6 MB och kräver att slutledningsbegäranden behandlas inom 60 sekunder. Batchtransform är lämplig för offline slutsatser om batcher av data.

Asynkron inferens är ett nytt inferensalternativ för nästan realtids-inferensbehov. Begäranden kan ta upp till 15 minuter att behandla och har en nyttolaststorlek på upp till 1 GB. Asynkron slutledning är lämplig för arbetsbelastningar som inte har krav på sekundär latens och som har avslappnade latenskrav. Till exempel kan du behöva bearbeta en slutsats om en stor bild på flera MB inom 5 minuter. Dessutom låter asynkrona slutpunkter slutpunkter dig kontrollera kostnaderna genom att skala ner slutpunktsinstansräkningen till noll när de är inaktiva, så att du bara betalar när dina slutpunkter behandlar förfrågningar.

|

|

Anteckningsboken visar följande:

- Skapa en SageMaker-modell

- Skapa en slutpunkt med denna modell och asynkron slutledningskonfiguration

- Att göra förutsägelser mot denna asynkrona slutpunkt

Den här anteckningsboken visar ett fungerande exempel på att sätta ihop en asynkron slutpunkt för en SageMaker-modell.

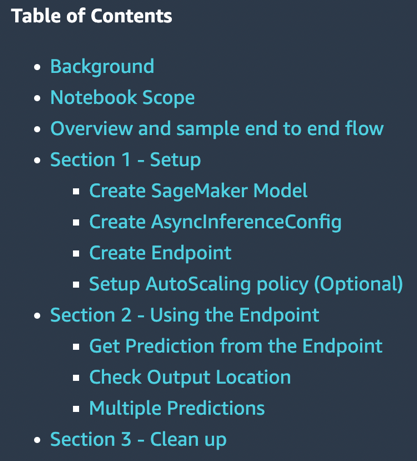

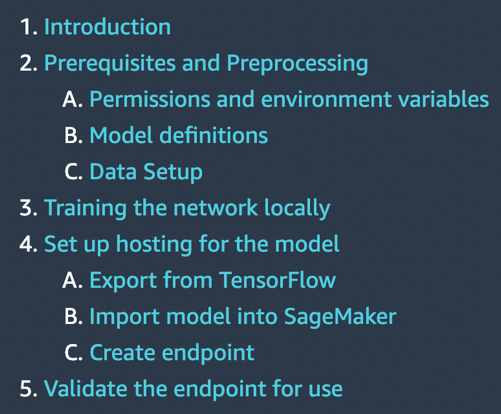

TensorFlow ta med din egen modell

En TensorFlow-modell tränas lokalt i en klassificeringsuppgift där denna bärbara dator körs. Sedan distribueras den på en SageMaker-slutpunkt.

|

|

Anteckningsboken visar följande:

- Utbildning av en TensorFlow-modell lokalt på IRIS-datauppsättningen

- Importerar den modellen till SageMaker

- Hostar den på en slutpunkt

Om du har TensorFlow-modeller som du utvecklat själv, kan den här exempelanteckningsboken hjälpa dig att vara värd för din modell på en SageMaker-hanterad slutpunkt.

Scikit-lär ta med din egen modell

SageMaker inkluderar funktionalitet för att stödja en värddatormiljö, distribuerad, serverlös utbildning och realtidsvärd. Det fungerar bäst när alla dessa tre tjänster används tillsammans, men de kan också användas fristående. Vissa användningsfall kräver kanske bara hosting. Kanske har modellen tränats innan SageMaker existerade, i en annan tjänst.

Anteckningsboken visar följande:

- Att använda en förtränad Scikit-learn-modell med SageMaker Scikit-learn-behållaren för att snabbt skapa en värdslutpunkt för den modellen

Om du har Scikit-learn-modeller som du själv utvecklat, kan den här anteckningsboken hjälpa dig att vara värd för din modell på en SageMaker-hanterad slutpunkt.

Rengör resurser

När du är klar med att köra en anteckningsbok i JumpStart, se till att göra det Ta bort alla resurser så att alla resurser som du skapade i processen raderas och din fakturering stoppas. Den sista cellen i dessa anteckningsböcker tar vanligtvis bort slutpunkter som skapas.

Sammanfattning

Det här inlägget ledde dig genom 10 nya exempelanteckningsböcker som nyligen lades till i JumpStart. Även om det här inlägget fokuserade på dessa 10 nya anteckningsböcker, finns det totalt 56 tillgängliga anteckningsböcker när detta skrivs. Vi uppmuntrar dig att logga in på Studio och utforska JumpStart-anteckningsböckerna själva och börja få omedelbart värde ur dem. För mer information, se Amazon SageMaker Studio och SageMaker JumpStart.

Om författaren

Dr Raju Penmatcha är en AI/ML Specialist Solutions Architect in AI Platforms på AWS. Han tog sin doktorsexamen från Stanford University. Han arbetar nära med svittjänsterna med låg/ingen kod i SageMaker som hjälper kunder att enkelt bygga och distribuera modeller och lösningar för maskininlärning.

Dr Raju Penmatcha är en AI/ML Specialist Solutions Architect in AI Platforms på AWS. Han tog sin doktorsexamen från Stanford University. Han arbetar nära med svittjänsterna med låg/ingen kod i SageMaker som hjälper kunder att enkelt bygga och distribuera modeller och lösningar för maskininlärning.

- AI

- ai konst

- ai art generator

- har robot

- Amazon SageMaker

- Amazon SageMaker JumpStart

- artificiell intelligens

- artificiell intelligenscertifiering

- artificiell intelligens inom bankväsendet

- artificiell intelligens robot

- robotar med artificiell intelligens

- programvara för artificiell intelligens

- AWS maskininlärning

- blockchain

- blockchain konferens ai

- coingenius

- konversationskonstnärlig intelligens

- kryptokonferens ai

- dalls

- djupt lärande

- du har google

- maskininlärning

- plato

- plato ai

- Platon Data Intelligence

- Platon spel

- PlatonData

- platogaming

- skala ai

- syntax

- zephyrnet