AutoML låter dig få snabba, allmänna insikter från dina data direkt i början av ett maskininlärningsprojekts (ML)-projektlivscykel. Att i förväg förstå vilka förbearbetningstekniker och algoritmtyper som ger bäst resultat minskar tiden för att utveckla, träna och distribuera rätt modell. Den spelar en avgörande roll i varje modells utvecklingsprocess och låter datavetare fokusera på de mest lovande ML-teknikerna. Dessutom tillhandahåller AutoML en baslinjemodellprestanda som kan fungera som referenspunkt för datavetenskapsteamet.

Ett AutoML-verktyg tillämpar en kombination av olika algoritmer och olika förbehandlingstekniker på dina data. Till exempel kan den skala data, utföra univariat funktionsval, utföra PCA vid olika varianströskelnivåer och tillämpa klustring. Sådana förbehandlingstekniker kan tillämpas individuellt eller kombineras i en pipeline. Därefter skulle ett AutoML-verktyg träna olika modelltyper, såsom linjär regression, Elastic-Net eller Random Forest, på olika versioner av din förbearbetade datamängd och utföra hyperparameteroptimering (HPO). Amazon SageMaker autopilot eliminerar de tunga lyften av att bygga ML-modeller. Efter att ha tillhandahållit datasetet utforskar SageMaker Autopilot automatiskt olika lösningar för att hitta den bästa modellen. Men vad händer om du vill distribuera din skräddarsydda version av ett AutoML-arbetsflöde?

Det här inlägget visar hur man skapar ett skräddarsytt AutoML-arbetsflöde på Amazon SageMaker med hjälp av Amazon SageMaker Automatisk modellinställning med exempelkod tillgänglig i en GitHub -repo.

Lösningsöversikt

För detta användningsfall, låt oss anta att du är en del av ett datavetenskapsteam som utvecklar modeller inom en specialiserad domän. Du har utvecklat en uppsättning anpassade förbearbetningstekniker och valt ett antal algoritmer som du vanligtvis förväntar dig att fungera bra med ditt ML-problem. När du arbetar med nya ML-användningsfall vill du först utföra en AutoML-körning med dina förbearbetningstekniker och algoritmer för att begränsa omfattningen av potentiella lösningar.

För det här exemplet använder du inte en specialiserad datauppsättning; istället arbetar du med California Housing-dataset som du kommer att importera från Amazon enkel lagringstjänst (Amazon S3). Fokus är att demonstrera den tekniska implementeringen av lösningen med SageMaker HPO, som senare kan appliceras på valfri dataset och domän.

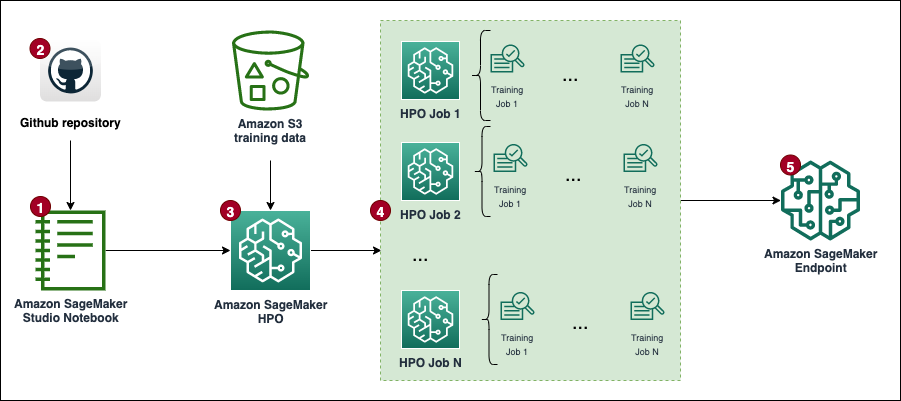

Följande diagram visar det övergripande arbetsflödet för lösningen.

Förutsättningar

Följande är förutsättningar för att slutföra genomgången i det här inlägget:

Implementera lösningen

Hela koden finns tillgänglig i GitHub repo.

Stegen för att implementera lösningen (som anges i arbetsflödesdiagrammet) är följande:

- Skapa en notebook-instans och ange följande:

- För Anteckningsbok instans typväljer ml.t3.medium.

- För Elastisk inferensväljer ingen.

- För Plattformsidentifierareväljer Amazon Linux 2, Jupyter Lab 3.

- För IAM-roll, välj standard

AmazonSageMaker-ExecutionRole. Om den inte finns, skapa en ny AWS identitets- och åtkomsthantering (IAM) roll och bifoga AmazonSageMakerFullAccess IAM-policy.

Observera att du bör skapa en verkställande roll och policy med minimal omfattning i produktionen.

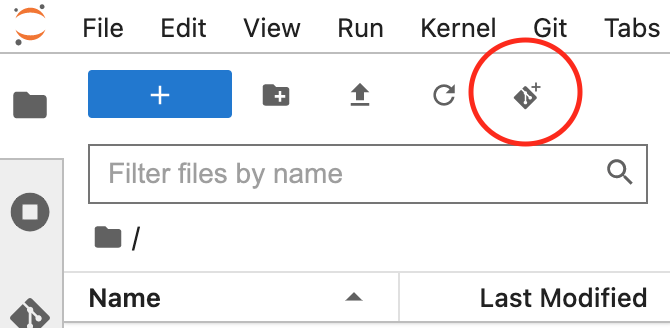

- Öppna JupyterLab-gränssnittet för din notebook-instans och klona GitHub-repo.

Du kan göra det genom att starta en ny terminalsession och köra git clone <REPO> kommandot eller genom att använda UI-funktionaliteten, som visas i följande skärmdump.

- Öppna

automl.ipynbnotebook-fil, väljconda_python3kärna och följ instruktionerna för att trigga en uppsättning HPO-jobb.

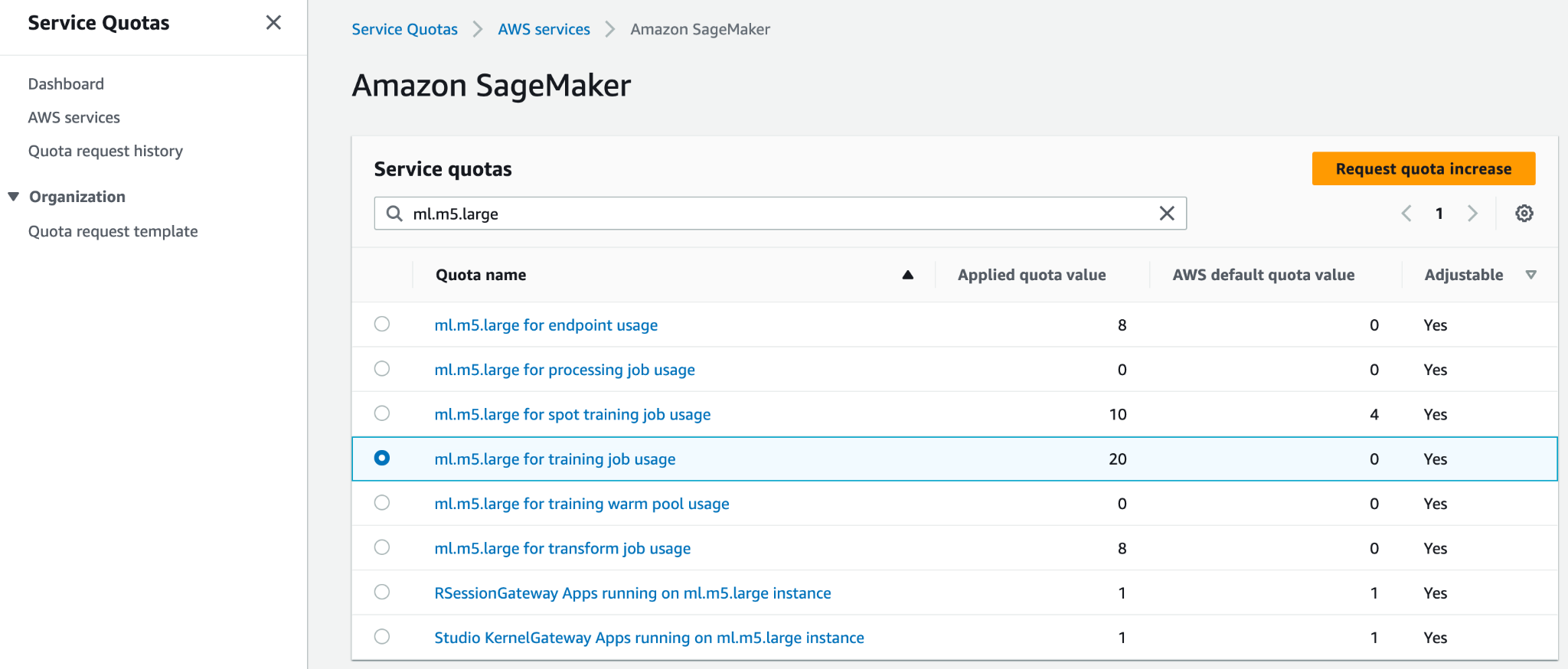

För att köra koden utan några ändringar måste du öka tjänstekvoten för ml.m5.large för träningsjobbanvändning och Antal instanser över alla utbildningsjobb. AWS tillåter som standard endast 20 parallella SageMaker-utbildningsjobb för båda kvoterna. Du måste begära en kvotökning till 30 för båda. Båda kvotändringarna bör vanligtvis godkännas inom några minuter. Hänvisa till Begär en kvothöjning för mer information.

Om du inte vill ändra kvoten kan du helt enkelt ändra värdet på MAX_PARALLEL_JOBS variabel i skriptet (till exempel till 5).

- Varje HPO-jobb kommer att slutföra en uppsättning av utbildningsjobb försök och indikera modellen med optimala hyperparametrar.

- Analysera resultaten och använda den bäst presterande modellen.

Denna lösning kommer att medföra kostnader på ditt AWS-konto. Kostnaden för denna lösning beror på antalet och varaktigheten av HPO-utbildningsjobb. I takt med att dessa ökar kommer kostnaderna också att öka. Du kan minska kostnaderna genom att begränsa utbildningstiden och konfigurera TuningJobCompletionCriteriaConfig enligt instruktionerna som diskuteras senare i detta inlägg. För prisinformation, se Amazon SageMaker Prissättning.

I de följande avsnitten diskuterar vi anteckningsboken mer i detalj med kodexempel och stegen för att analysera resultaten och välja den bästa modellen.

Första installationen

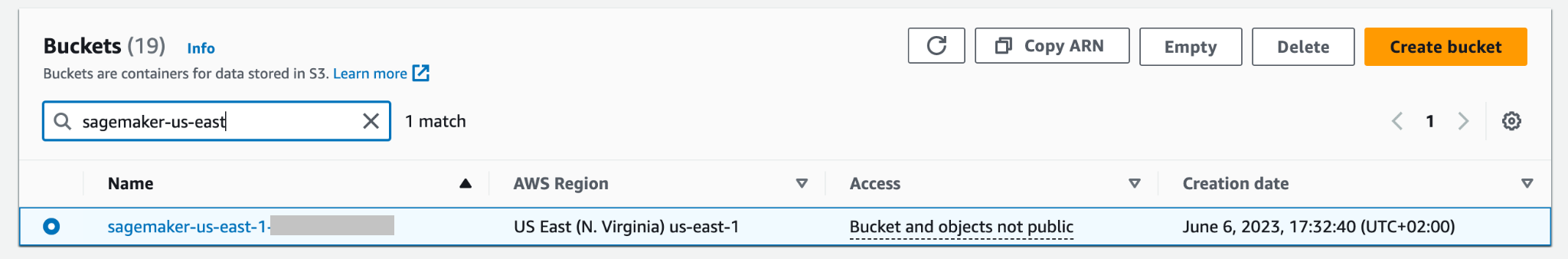

Låt oss börja med att köra Importer och inställningar avsnitt i custom-automl.ipynb anteckningsbok. Den installerar och importerar alla nödvändiga beroenden, instansierar en SageMaker-session och klient och ställer in standardregionen och S3-hinken för lagring av data.

Dataförberedelse

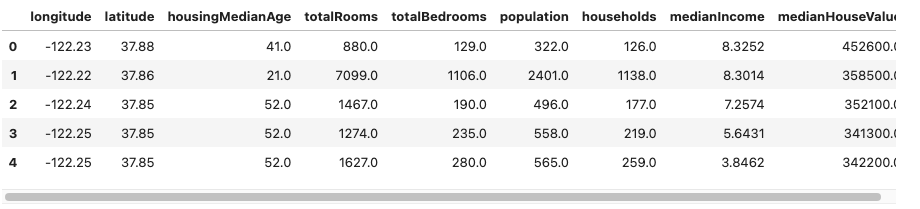

Ladda ner California Housing dataset och förbered den genom att köra Hämta data avsnitt av anteckningsboken. Datauppsättningen är uppdelad i tränings- och testdataramar och laddas upp till SageMaker-sessionens standard S3-bucket.

Hela datamängden har 20,640 9 poster och totalt XNUMX kolumner, inklusive målet. Målet är att förutsäga medianvärdet för ett hus (medianHouseValue kolumn). Följande skärmdump visar de översta raderna i datamängden.

Utbildning manus mall

AutoML-arbetsflödet i det här inlägget är baserat på scikit lära förbearbetning av pipelines och algoritmer. Syftet är att generera en stor kombination av olika förbearbetningspipelines och algoritmer för att hitta den bästa uppställningen. Låt oss börja med att skapa ett generiskt träningsskript, som finns kvar lokalt på anteckningsboken. I det här skriptet finns det två tomma kommentarsblock: ett för att injicera hyperparametrar och det andra för förbearbetningsmodellens pipelineobjekt. De kommer att injiceras dynamiskt för varje förbearbetningsmodellkandidat. Syftet med att ha ett generiskt skript är att hålla implementeringen DRY (upprepa inte dig själv).

Skapa förbearbetning och modellkombinationer

Smakämnen preprocessors ordboken innehåller en specifikation av förbearbetningstekniker som tillämpas på alla indatafunktioner i modellen. Varje recept definieras med hjälp av en Pipeline eller ett FeatureUnion objekt från scikit-learn, som kedjar samman individuella datatransformationer och staplar ihop dem. Till exempel, mean-imp-scale är ett enkelt recept som säkerställer att saknade värden tillräknas med hjälp av medelvärden för respektive kolumn och att alla funktioner skalas med hjälp av Standardskalare. Däremot mean-imp-scale-pca receptet kedjer ihop ytterligare några operationer:

- Beräkna saknade värden i kolumner med dess medelvärde.

- Tillämpa funktionsskalning med medelvärde och standardavvikelse.

- Beräkna PCA ovanpå indata vid ett specificerat varianströskelvärde och slå samman det med de imputerade och skalade indatafunktionerna.

I det här inlägget är alla inmatningsfunktioner numeriska. Om du har fler datatyper i din indatauppsättning bör du ange en mer komplicerad pipeline där olika förbearbetningsgrenar tillämpas på olika funktionstyper.

Smakämnen models ordboken innehåller specifikationer för olika algoritmer som du anpassar datasetet till. Varje modelltyp kommer med följande specifikation i ordboken:

- script_output – Pekar på platsen för träningsskriptet som används av skattaren. Detta fält fylls i dynamiskt när

modelsordboken kombineras medpreprocessorslexikon. - insertioner – Definierar kod som kommer att infogas i

script_draft.pyoch sparades sedan underscript_output. Nyckeln“preprocessor”lämnas avsiktligt tomt eftersom denna plats är fylld med en av förprocessorerna för att skapa flera kombinationer av modell-förprocessor. - hyperparametrar – En uppsättning hyperparametrar som är optimerade av HPO-jobbet.

- include_cls_metadata – Mer konfigurationsdetaljer krävs av SageMaker

Tunerklass.

Ett fullständigt exempel på models ordboken är tillgänglig i GitHub-förrådet.

Låt oss sedan iterera igenom preprocessors och models ordböcker och skapa alla möjliga kombinationer. Till exempel, om din preprocessors ordboken innehåller 10 recept och du har 5 modelldefinitioner i models dictionary innehåller den nyskapade pipelines-lexikonet 50 preprocessor-modell pipelines som utvärderas under HPO. Observera att enskilda pipeline-skript inte skapas ännu vid denna tidpunkt. Nästa kodblock (cell 9) i Jupyter notebook itererar genom alla förprocessormodellobjekt i pipelines ordbok, infogar alla relevanta kodbitar och behåller en pipelinespecifik version av skriptet lokalt i anteckningsboken. Dessa skript används i nästa steg när du skapar individuella estimatorer som du kopplar in i HPO-jobbet.

Definiera estimatorer

Du kan nu arbeta med att definiera SageMaker Estimators som HPO-jobbet använder efter att skripten är klara. Låt oss börja med att skapa en omslagsklass som definierar några gemensamma egenskaper för alla estimatorer. Det ärver från SKLearn klass och anger roll, antal instanser och typ, samt vilka kolumner som används av skriptet som funktioner och mål.

Låt oss bygga estimators ordbok genom att iterera genom alla skript som genererats före och finns i scripts katalog. Du instansierar en ny estimator med hjälp av SKLearnBase klass, med ett unikt estimatornamn och ett av skripten. Observera att estimators ordboken har två nivåer: den översta nivån definierar en pipeline_family. Detta är en logisk gruppering baserad på vilken typ av modeller som ska utvärderas och är lika med längden på models lexikon. Den andra nivån innehåller individuella förprocessortyper kombinerade med de givna pipeline_family. Denna logiska gruppering krävs när du skapar HPO-jobbet.

Definiera HPO-tunerargument

För att optimera överföring av argument till HPO Tuner klass, den HyperparameterTunerArgs dataklassen initieras med argument som krävs av HPO-klassen. Den levereras med en uppsättning funktioner som säkerställer att HPO-argument returneras i ett format som förväntas när flera modelldefinitioner distribueras samtidigt.

Nästa kodblock använder det tidigare introducerade HyperparameterTunerArgs dataklass. Du skapar en annan ordbok som heter hp_args och generera en uppsättning indataparametrar som är specifika för var och en estimator_family från estimators lexikon. Dessa argument används i nästa steg vid initialisering av HPO-jobb för varje modellfamilj.

Skapa HPO-tunerobjekt

I det här steget skapar du individuella tuners för varje estimator_family. Varför skapar ni tre separata HPO-jobb istället för att bara lansera ett för alla estimatorer? De HyperparameterTuner klass är begränsad till 10 modelldefinitioner kopplade till den. Därför är varje HPO ansvarig för att hitta den bäst presterande förprocessorn för en given modellfamilj och ställa in den modellfamiljens hyperparametrar.

Följande är några fler punkter angående installationen:

- Optimeringsstrategin är Bayesian, vilket innebär att HPO aktivt övervakar prestandan för alla försök och navigerar optimeringen mot mer lovande hyperparameterkombinationer. Tidig stopp bör ställas in på off or Bil när man arbetar med en Bayesiansk strategi, som hanterar den logiken själv.

- Varje HPO-jobb körs för maximalt 100 jobb och kör 10 jobb parallellt. Om du har att göra med större datamängder kanske du vill öka det totala antalet jobb.

- Dessutom kanske du vill använda inställningar som styr hur länge ett jobb körs och hur många jobb din HPO utlöser. Ett sätt att göra det är att ställa in maximal körtid i sekunder (för det här inlägget ställer vi in den på 1 timme). En annan är att använda den nyligen släppta

TuningJobCompletionCriteriaConfig. Den erbjuder en uppsättning inställningar som övervakar framstegen för dina jobb och avgör om det är troligt att fler jobb kommer att förbättra resultatet. I det här inlägget ställer vi in det maximala antalet träningsjobb som inte förbättras till 20. På så sätt, om poängen inte förbättras (till exempel från det fyrtionde försöket), behöver du inte betala för de återstående försöken tillsmax_jobsnås.

Låt oss nu iterera igenom tuners och hp_args ordböcker och utlösa alla HPO-jobb i SageMaker. Notera användningen av wait-argumentet inställt på False, vilket innebär att kärnan inte väntar tills resultaten är klara och du kan utlösa alla jobb på en gång.

Det är troligt att inte alla utbildningsjobb kommer att slutföras och vissa av dem kan stoppas av HPO-jobbet. Anledningen till detta är TuningJobCompletionCriteriaConfig—Optimeringen avslutas om något av de angivna kriterierna uppfylls. I det här fallet, när optimeringskriterierna inte förbättras för 20 på varandra följande jobb.

Analysera resultat

Cell 15 i anteckningsboken kontrollerar om alla HPO-jobb är klara och kombinerar alla resultat i form av en pandadataram för vidare analys. Innan vi analyserar resultaten i detalj, låt oss ta en titt på SageMaker-konsolen på hög nivå.

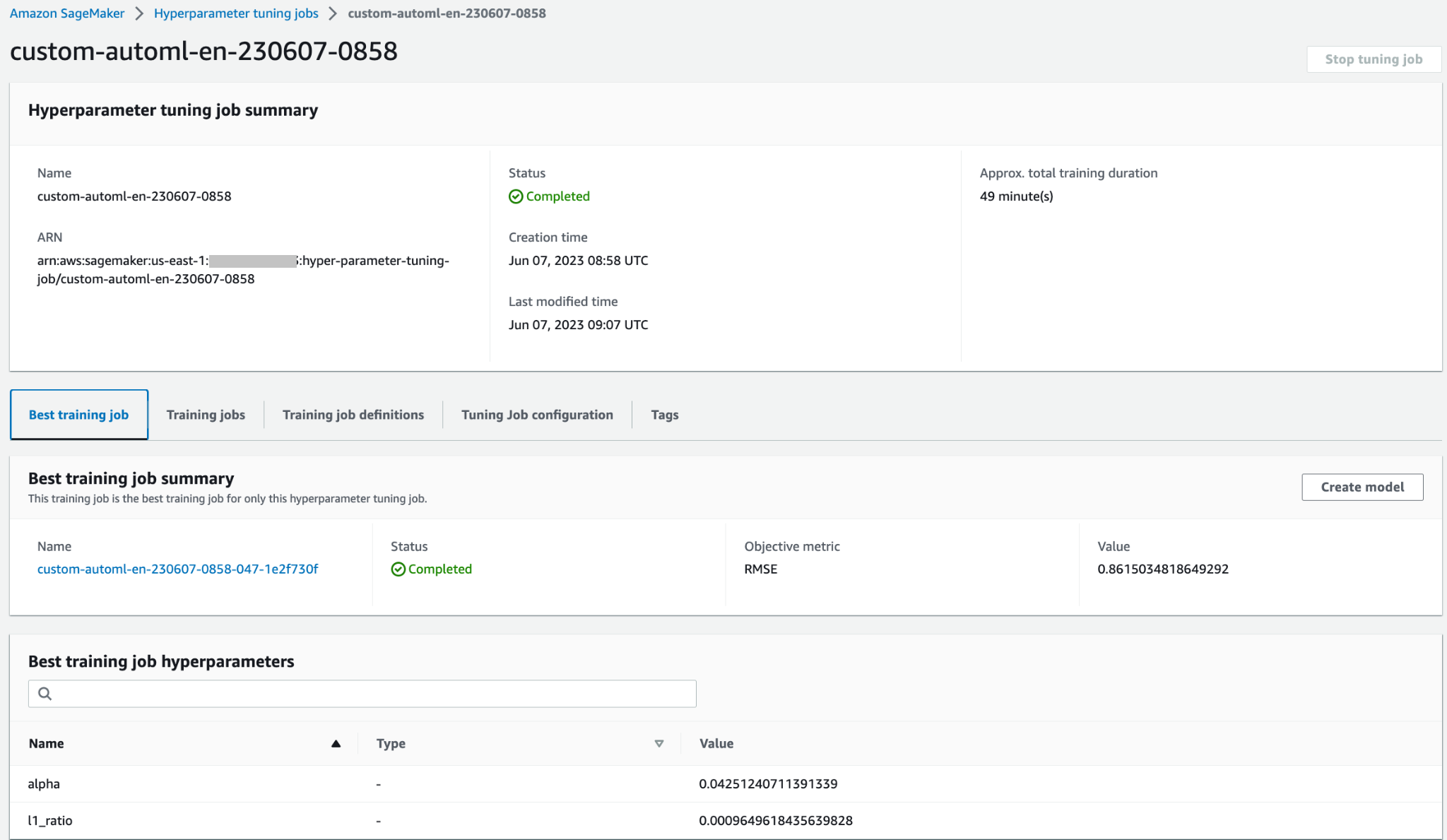

På toppen av den Hyperparameter tuning jobb sida kan du se dina tre lanserade HPO-jobb. Alla slutade tidigt och utförde inte alla 100 träningsjobb. I följande skärmdump kan du se att Elastic-Net-modellfamiljen genomförde det högsta antalet försök, medan andra inte behövde så många träningsjobb för att hitta det bästa resultatet.

Du kan öppna HPO-jobbet för att få tillgång till mer information, såsom individuella träningsjobb, jobbkonfiguration och information om och prestanda för det bästa träningsjobbet.

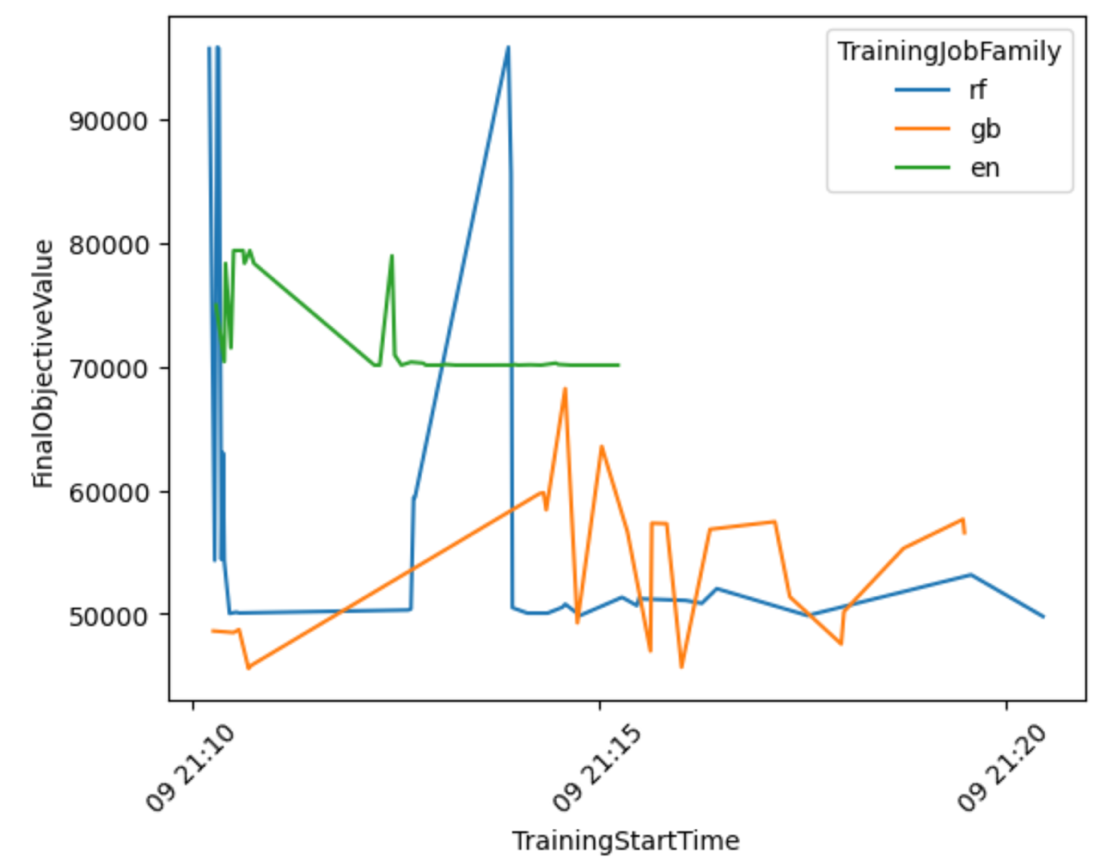

Låt oss ta fram en visualisering baserad på resultaten för att få mer insikt om AutoML-arbetsflödesprestanda i alla modellfamiljer.

Från följande graf kan du dra slutsatsen att Elastic-Net modellens prestanda pendlade mellan 70,000 80,000 och XNUMX XNUMX RMSE och stannade så småningom, eftersom algoritmen inte kunde förbättra sin prestanda trots provning av olika förbearbetningstekniker och hyperparametervärden. Det verkar också som RandomForest prestanda varierade mycket beroende på hyperparameteruppsättningen som utforskades av HPO, men trots många försök kunde den inte gå under 50,000 XNUMX RMSE-felet. GradientBoosting uppnådde den bästa prestandan redan från början och gick under 50,000 XNUMX RMSE. HPO försökte förbättra det resultatet ytterligare men kunde inte uppnå bättre prestanda över andra hyperparameterkombinationer. En allmän slutsats för alla HPO-jobb är att det inte krävdes så många jobb för att hitta den bästa uppsättningen hyperparametrar för varje algoritm. För att ytterligare förbättra resultatet skulle du behöva experimentera med att skapa fler funktioner och utföra ytterligare funktionsteknik.

Du kan också undersöka en mer detaljerad bild av kombinationen modell-förprocessor för att dra slutsatser om de mest lovande kombinationerna.

Välj den bästa modellen och distribuera den

Följande kodavsnitt väljer den bästa modellen baserat på det lägsta uppnådda målvärdet. Du kan sedan distribuera modellen som en SageMaker-slutpunkt.

Städa upp

För att förhindra oönskade avgifter på ditt AWS-konto rekommenderar vi att du tar bort AWS-resurserna som du använde i det här inlägget:

- På Amazon S3-konsolen, töm data från S3-hinken där träningsdata lagrades.

- Stoppa notebook-instansen på SageMaker-konsolen.

- Ta bort modellens slutpunkt om du distribuerade den. Slutpunkter bör tas bort när de inte längre används, eftersom de faktureras efter utplacerad tid.

Slutsats

I det här inlägget visade vi upp hur man skapar ett anpassat HPO-jobb i SageMaker med hjälp av ett anpassat urval av algoritmer och förbearbetningstekniker. Speciellt visar detta exempel hur man automatiserar processen att generera många träningsskript och hur man använder Python-programmeringsstrukturer för effektiv distribution av flera parallella optimeringsjobb. Vi hoppas att den här lösningen kommer att utgöra ställningen för alla anpassade modelljusteringsjobb som du kommer att distribuera med SageMaker för att uppnå högre prestanda och snabba upp dina ML-arbetsflöden.

Kolla in följande resurser för att ytterligare fördjupa din kunskap om hur du använder SageMaker HPO:

Om författarna

Konrad Semsch är senior ML Solutions Architect på Amazon Web Services Data Lab Team. Han hjälper kunder att använda maskininlärning för att lösa sina affärsutmaningar med AWS. Han tycker om att uppfinna och förenkla för att ge kunderna enkla och pragmatiska lösningar för sina AI/ML-projekt. Han brinner mest för MlOps och traditionell datavetenskap. Utanför jobbet är han ett stort fan av vindsurfing och kitesurfing.

Konrad Semsch är senior ML Solutions Architect på Amazon Web Services Data Lab Team. Han hjälper kunder att använda maskininlärning för att lösa sina affärsutmaningar med AWS. Han tycker om att uppfinna och förenkla för att ge kunderna enkla och pragmatiska lösningar för sina AI/ML-projekt. Han brinner mest för MlOps och traditionell datavetenskap. Utanför jobbet är han ett stort fan av vindsurfing och kitesurfing.

Tonfisk Ersoy är Senior Solutions Architect på AWS. Hennes primära fokus är att hjälpa offentliga kunder att använda molnteknik för sina arbetsbelastningar. Hon har en bakgrund inom applikationsutveckling, företagsarkitektur och kontaktcenterteknologier. Hennes intressen inkluderar serverlösa arkitekturer och AI/ML.

Tonfisk Ersoy är Senior Solutions Architect på AWS. Hennes primära fokus är att hjälpa offentliga kunder att använda molnteknik för sina arbetsbelastningar. Hon har en bakgrund inom applikationsutveckling, företagsarkitektur och kontaktcenterteknologier. Hennes intressen inkluderar serverlösa arkitekturer och AI/ML.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- : har

- :är

- :inte

- :var

- $UPP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Able

- Om oss

- tillgång

- Enligt

- Konto

- Uppnå

- uppnås

- tvärs

- aktivt

- Annat

- Dessutom

- anta

- Efter

- AI / ML

- Syftet

- algoritm

- algoritmer

- Alla

- tillåta

- tillåter

- redan

- också

- amason

- Amazon SageMaker

- Amazon Web Services

- an

- analys

- analysera

- analys

- och

- Annan

- vilken som helst

- Ansökan

- Application Development

- tillämpas

- applicerar

- Ansök

- godkänd

- arkitektur

- ÄR

- Argumentet

- argument

- AS

- utgå ifrån

- At

- bifoga

- bil

- automatisera

- Automat

- automatiskt

- AutoML

- tillgänglig

- AWS

- bakgrund

- bas

- baserat

- Baslinje

- Bayesian

- BE

- därför att

- innan

- Börjar

- nedan

- BÄST

- Bättre

- mellan

- Stor

- Blockera

- Block

- båda

- grenar

- SLUTRESULTAT

- Byggnad

- företag

- men

- Knappen

- by

- kalifornien

- Ring

- kallas

- KAN

- kandidat

- Vid

- fall

- Centrum

- kedjor

- utmaningar

- byta

- Förändringar

- avgifter

- Kontroller

- Välja

- klass

- CLF

- klient

- cloud

- kluster

- klustring

- koda

- Kolumn

- Kolonner

- kombination

- kombinationer

- kombinerad

- kombinerar

- kommer

- kommentar

- Gemensam

- fullborda

- Avslutade

- fullborda

- komplicerad

- avslutar

- slutsats

- Genomför

- konfiguration

- i följd

- Konsol

- kontakta

- kontaktcenter

- innehåller

- Däremot

- kontroll

- Pris

- Kostar

- kunde

- skapa

- skapas

- Skapa

- kriterier

- avgörande

- För närvarande

- beställnings

- Kunder

- datum

- datavetenskap

- datauppsättningar

- som handlar om

- beslutar

- Fördjupa

- Standard

- definierade

- definierar

- definierande

- definitioner

- demonstrera

- demonstrerar

- bero

- beroenden

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- härleda

- Trots

- detalj

- detaljerad

- detaljer

- utveckla

- utvecklade

- Utveckling

- utvecklar

- avvikelse

- DICT

- olika

- kataloger

- diskutera

- diskuteras

- do

- inte

- domän

- inte

- ner

- dra

- torka

- varaktighet

- under

- dynamiskt

- varje

- Tidig

- effektiv

- eliminerar

- möjliggöra

- Slutpunkt

- Teknik

- säkerställa

- säkerställer

- Företag

- Hela

- helt

- lika

- fel

- utvärdera

- utvärderade

- så småningom

- Varje

- undersöka

- exempel

- exempel

- utförande

- existerar

- förvänta

- förväntat

- experimentera

- förklarade

- utforskas

- utforskar

- falsk

- familjer

- familj

- fläkt

- Leverans

- Funktioner

- få

- fält

- Fil

- fyllda

- hitta

- finna

- Förnamn

- passa

- fem

- Fokus

- följer

- efter

- följer

- För

- skog

- formen

- format

- RAM

- från

- främre

- full

- fungera

- funktionalitet

- funktioner

- ytterligare

- Allmänt

- generera

- genereras

- generera

- skaffa sig

- gå

- GitHub

- ges

- Go

- Målet

- kommer

- diagram

- sidan

- Handtag

- Har

- har

- he

- tung

- tunga lyft

- hjälpa

- hjälper

- här

- högnivå

- högre

- högsta

- hoppas

- timme

- Huset

- hushåll

- bostäder

- Hur ser din drömresa ut

- How To

- html

- http

- HTTPS

- Hyperparameteroptimering

- Inställning av hyperparameter

- Identitet

- if

- genomföra

- genomförande

- importera

- import

- förbättra

- förbättra

- in

- innefattar

- Inklusive

- Öka

- indikerar

- individuellt

- Individuellt

- informationen

- ingång

- ingångar

- Insert

- insikter

- exempel

- istället

- instruktioner

- integrering

- avsiktligt

- intressen

- Gränssnitt

- in

- introducerade

- IT

- DESS

- sig

- Jobb

- Lediga jobb

- jpg

- bara

- bara en

- Ha kvar

- Nyckel

- kunskap

- lab

- Large

- större

- senare

- lanserades

- lansera

- inlärning

- vänster

- Längd

- Nivå

- nivåer

- livscykel

- lyft

- tycka om

- sannolikt

- begränsande

- linux

- läsa in

- lokalt

- belägen

- läge

- Logiken

- logisk

- Lång

- längre

- se

- Lot

- lägst

- Maskinen

- maskininlärning

- många

- maximal

- Maj..

- betyda

- betyder

- Sammanfoga

- träffade

- Metrics

- kanske

- minuter

- saknas

- ML

- MLOps

- modell

- modeller

- modifiera

- Övervaka

- monitorer

- mer

- mest

- multipel

- namn

- smal

- navigerar

- Behöver

- Nya

- nytt

- Nästa

- Nej

- Ingen

- anteckningsbok

- noterade

- nu

- antal

- numpy

- objektet

- mål

- objekt

- of

- sänkt

- Erbjudanden

- on

- gång

- ONE

- endast

- öppet

- Verksamhet

- optimala

- optimering

- Optimera

- optimerad

- or

- beställa

- OS

- Övriga

- Övrigt

- ut

- produktion

- utanför

- över

- övergripande

- sida

- pandor

- Parallell

- parametrar

- del

- särskilt

- Förbi

- brinner

- bana

- Betala

- Utföra

- prestanda

- utför

- kvarstår

- bitar

- rörledning

- plato

- Platon Data Intelligence

- PlatonData

- spelar

- kontakt

- Punkt

- poäng

- policy

- befolkning

- möjlig

- Inlägg

- potentiell

- pragmatisk

- förutse

- Predictor

- Förbered

- förutsättningar

- presenterar

- förhindra

- tidigare

- prissättning

- primär

- Skriva ut

- Problem

- process

- producera

- Produktion

- Programmering

- Framsteg

- projektet

- projekt

- lovande

- egenskaper

- ge

- ger

- tillhandahålla

- allmän

- Syftet

- Python

- slumpmässig

- snabb

- kommit fram till

- redo

- Anledningen

- nyligen

- Receptet

- rekommenderar

- register

- minska

- minskar

- hänvisa

- referens

- om

- regex

- region

- frigörs

- relevanta

- Återstående

- ta bort

- upprepa

- Repository

- begära

- kräver

- Obligatorisk

- Resurser

- att

- ansvarig

- begränsad

- resultera

- Resultat

- avkastning

- höger

- Roll

- Körning

- rinnande

- kör

- runtime

- sagemaker

- SageMaker Automatisk modellinställning

- sparade

- Skala

- skalning

- Vetenskap

- vetenskapsmän

- scikit lära

- omfattning

- göra

- skript

- skript

- Andra

- sekunder

- §

- sektioner

- sektor

- se

- verkar

- vald

- Val

- SJÄLV

- senior

- separat

- tjänar

- Server

- service

- Tjänster

- session

- in

- uppsättningar

- inställningar

- inställning

- hon

- skall

- utställningsmonter

- visas

- Visar

- Enkelt

- förenkla

- helt enkelt

- kodavsnitt

- So

- lösning

- Lösningar

- LÖSA

- några

- specialiserad

- specifik

- specifikation

- specifikationer

- specificerade

- fart

- delas

- stapel

- standard

- starta

- Starta

- status

- Steg

- Steg

- Sluta

- slutade

- stoppa

- förvaring

- lagras

- misslyckande

- Strategi

- struktur

- strukturer

- Senare

- sådana

- Som stöds

- bord

- skräddarsydd

- Ta

- Målet

- grupp

- Teknisk

- tekniker

- Tekniken

- terminal

- testa

- Testning

- den där

- Smakämnen

- deras

- Dem

- sedan

- Där.

- därför

- Dessa

- de

- detta

- de

- tre

- tröskelvärde

- Genom

- tid

- till

- tillsammans

- verktyg

- topp

- Totalt

- mot

- traditionell

- Tåg

- Utbildning

- transformationer

- rättegång

- försök

- försökte

- utlösa

- triggas

- trigg

- försöker

- trimma

- två

- Typ

- typer

- typiskt

- ui

- under

- förståelse

- unika

- tills

- oönskade

- uppladdad

- Användning

- användning

- användningsfall

- Begagnade

- användningar

- med hjälp av

- BEKRÄFTA

- värde

- Värden

- variabel

- varierande

- olika

- version

- versioner

- utsikt

- visualisering

- W

- vänta

- genomgång

- vill

- var

- Sätt..

- we

- webb

- webbservice

- VÄL

- były

- Vad

- när

- medan

- om

- som

- varför

- kommer

- med

- inom

- utan

- Arbete

- arbetsflöde

- arbetsflöden

- arbetssätt

- skulle

- skriva

- ännu

- Om er

- Din

- själv

- zephyrnet