Att skapa skalbara och effektiva pipelines för maskininlärning (ML) är avgörande för att effektivisera utvecklingen, driftsättningen och hanteringen av ML-modeller. I det här inlägget presenterar vi ett ramverk för att automatisera skapandet av en riktad acyklisk graf (DAG) för Amazon SageMaker-rörledningar baserat på enkla konfigurationsfiler. De ramkod och exempel som presenteras här täcker endast modellutbildningspipelines, men kan lätt utvidgas till att även omfatta batch-inferenspipelines.

Detta dynamiska ramverk använder konfigurationsfiler för att orkestrera förbearbetnings-, utbildnings-, utvärderings- och registreringssteg för användningsfall för både enmodeller och flermodeller baserat på användardefinierade Python-skript, infrastrukturbehov (inklusive Amazon Virtual Private Cloud (Amazon VPC) undernät och säkerhetsgrupper, AWS identitets- och åtkomsthantering (IAM) roller, AWS nyckelhanteringstjänst (AWS KMS)-nycklar, behållarregister och instanstyper), input och output Amazon enkel lagringstjänst (Amazon S3) sökvägar och resurstaggar. Konfigurationsfiler (YAML och JSON) tillåter ML-utövare att specificera odifferentierad kod för orkestrering av träningspipelines med deklarativ syntax. Detta gör det möjligt för datavetare att snabbt bygga och iterera på ML-modeller, och gör det möjligt för ML-ingenjörer att köra igenom kontinuerlig integration och kontinuerlig leverans (CI/CD) ML-pipelines snabbare, vilket minskar tiden till produktion för modeller.

Lösningsöversikt

Den föreslagna ramkoden börjar med att läsa konfigurationsfilerna. Den skapar sedan dynamiskt en SageMaker Pipelines DAG baserat på stegen som deklareras i konfigurationsfilerna och interaktionerna och beroenden mellan stegen. Detta orkestreringsramverk vänder sig till både enmodeller och flermodeller och ger ett smidigt flöde av data och processer. Följande är de viktigaste fördelarna med denna lösning:

- Automation – Hela ML-arbetsflödet, från förbearbetning av data till modellregistret, orkestreras utan manuella ingrepp. Detta minskar tiden och ansträngningen som krävs för modellexperimentering och operationalisering.

- reproducerbarhet – Med en fördefinierad konfigurationsfil kan datavetare och ML-ingenjörer reproducera hela arbetsflödet och uppnå konsekventa resultat över flera körningar och miljöer.

- skalbarhet - Amazon SageMaker används genom hela pipelinen, vilket gör det möjligt för ML-utövare att bearbeta stora datamängder och träna komplexa modeller utan infrastrukturproblem.

- Flexibilitet – Ramverket är flexibelt och kan rymma ett brett utbud av ML-användningsfall, ML-ramverk (som XGBoost och TensorFlow), flermodellutbildning och flerstegsutbildning. Varje steg i utbildningens DAG kan anpassas via konfigurationsfilen.

- Modellstyrning - Den Amazon SageMaker Model Registry integration gör det möjligt att spåra modellversioner och därför främja dem till produktion med tillförsikt.

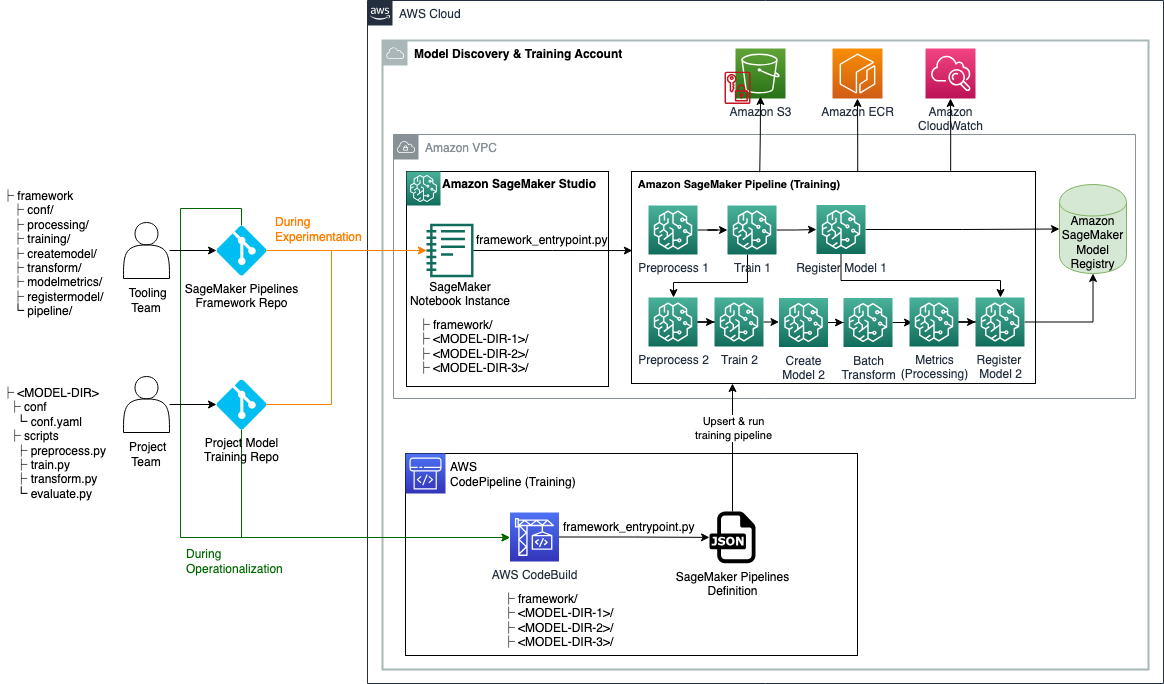

Följande arkitekturdiagram visar hur du kan använda det föreslagna ramverket under både experiment och operationalisering av ML-modeller. Under experiment kan du klona ramkodsförrådet som tillhandahålls i det här inlägget och dina projektspecifika källkodsförråd till Amazon SageMaker Studio, och ställ in din virtuella miljö (detaljerat senare i det här inlägget). Du kan sedan upprepa förbearbetnings-, utbildnings- och utvärderingsskript, såväl som konfigurationsval. För att skapa och köra en SageMaker Pipelines utbildnings-DAG kan du anropa ramverkets ingångspunkt, som kommer att läsa alla konfigurationsfiler, skapa nödvändiga steg och orkestrera dem baserat på den specificerade stegordningen och beroenden.

Under operationaliseringen klonas CI-pipelinen ramkodförrådet och projektspecifika utbildningsförråd till ett AWS CodeBuild jobb, där ramverkets ingångsskript anropas för att skapa eller uppdatera SageMaker Pipelines utbildnings-DAG, och sedan köra det.

Förvarsstruktur

Smakämnen GitHub repository innehåller följande kataloger och filer:

- /framework/conf/ – Den här katalogen innehåller en konfigurationsfil som används för att ställa in gemensamma variabler för alla modelleringsenheter som undernät, säkerhetsgrupper och IAM-roller vid körning. En modelleringsenhet är en sekvens av upp till sex steg för att träna en ML-modell.

- /framework/createmodel/ – Den här katalogen innehåller ett Python-skript som skapar en SageMaker modell objekt baserat på modellartefakter från en SageMaker Pipelines träningssteg. Modellobjektet används senare i en SageMaker batch-transformation jobb för att utvärdera modellprestanda på en testuppsättning.

- /framework/modelmetrics/ – Den här katalogen innehåller ett Python-skript som skapar en Amazon SageMaker-bearbetning jobb för att generera en modellmetrik JSON-rapport för en tränad modell baserad på resultaten av ett SageMaker batchtransformeringsjobb utfört på testdata.

- /framework/pipeline/ – Den här katalogen innehåller Python-skript som använder Python-klasser definierade i andra ramverkskataloger för att skapa eller uppdatera en SageMaker Pipelines DAG baserat på de angivna konfigurationerna. Skriptet model_unit.py används av pipeline_service.py för att skapa en eller flera modelleringsenheter. Varje modelleringsenhet är en sekvens av upp till sex steg för att träna en ML-modell: bearbeta, träna, skapa modell, transformera, mätvärden och registermodell. Konfigurationer för varje modelleringsenhet bör specificeras i modellens respektive arkiv. Pipeline_service.py ställer också in beroenden mellan SageMaker Pipelines-steg (hur steg inom och över modelleringsenheter sekvenseras eller kedjas) baserat på sagemakerPipeline-sektionen, som bör definieras i konfigurationsfilen för ett av modellförråden (ankarmodellen). Detta låter dig åsidosätta standardberoenden som härleds av SageMaker Pipelines. Vi diskuterar konfigurationsfilstrukturen senare i det här inlägget.

- /framework/processing/ – Den här katalogen innehåller ett Python-skript som skapar ett SageMaker Processing-jobb baserat på den angivna Docker-bilden och ingångsskriptet.

- /framework/registermodel/ – Den här katalogen innehåller ett Python-skript för att registrera en tränad modell tillsammans med dess beräknade mätvärden i SageMaker Model Registry.

- /framework/training/ – Den här katalogen innehåller ett Python-skript som skapar ett SageMaker-utbildningsjobb.

- /framework/transform/ – Den här katalogen innehåller ett Python-skript som skapar ett SageMaker-batchtransformeringsjobb. I samband med modellträning används detta för att beräkna prestandamåttet för en tränad modell på testdata.

- /framework/utilities/ – Den här katalogen innehåller verktygsskript för att läsa och ansluta konfigurationsfiler, samt loggning.

- /framework_entrypoint.py – Den här filen är ingångspunkten för ramkoden. Den anropar en funktion definierad i katalogen /framework/pipeline/ för att skapa eller uppdatera en SageMaker Pipelines DAG och köra den.

- /exempel/ – Den här katalogen innehåller flera exempel på hur du kan använda detta automationsramverk för att skapa enkla och komplexa utbildnings-DAGs.

- /env.env – Den här filen låter dig ställa in vanliga variabler som subnät, säkerhetsgrupper och IAM-roll som miljövariabler.

- /requirements.txt – Den här filen anger Python-bibliotek som krävs för ramkoden.

Förutsättningar

Du bör ha följande förutsättningar innan du distribuerar den här lösningen:

- Ett AWS-konto

- SageMaker Studio

- En SageMaker-roll med Amazon S3 läs/skriv och AWS KMS kryptera/dekryptera behörigheter

- En S3-hink för att lagra data, skript och modellartefakter

- Alternativt kan AWS-kommandoradsgränssnitt (AWS CLI)

- Python3 (Python 3.7 eller senare) och följande Python-paket:

- boto3

- sagemaker

- PyYAML

- Ytterligare Python-paket som används i dina anpassade skript

Distribuera lösningen

Utför följande steg för att distribuera lösningen:

- Organisera ditt modellträningsförråd enligt följande struktur:

- Klona ramkoden och din modellkällkod från Git-arkiven:

-

- klon

dynamic-sagemaker-pipelines-frameworkrepo i en träningskatalog. I följande kod antar vi att träningskatalogen anropasaws-train: - Klona modellens källkod under samma katalog. För träning med flera modeller, upprepa detta steg för så många modeller du behöver för att träna.

- klon

För utbildning i en modell bör din katalog se ut så här:

För flermodellutbildning bör din katalog se ut så här:

- Ställ in följande miljövariabler. Asterisker indikerar miljövariabler som krävs; resten är valfria.

| Miljöfaktor | Beskrivning |

SMP_ACCOUNTID* |

AWS-konto där SageMaker-pipelinen körs |

SMP_REGION* |

AWS-region där SageMaker-pipelinen körs |

SMP_S3BUCKETNAME* |

S3 hinknamn |

SMP_ROLE* |

SageMaker roll |

SMP_MODEL_CONFIGPATH* |

Relativ sökväg för konfigurationsfilerna för en eller flera modeller |

SMP_SUBNETS |

Subnät-ID:n för SageMaker-nätverkskonfiguration |

SMP_SECURITYGROUPS |

Säkerhetsgrupp-ID:n för SageMaker-nätverkskonfiguration |

För användningsfall med en enda modell, SMP_MODEL_CONFIGPATH kommer vara <MODEL-DIR>/conf/conf.yaml. För användningsfall med flera modeller, SMP_MODEL_CONFIGPATH kommer vara */conf/conf.yaml, vilket gör att du kan hitta alla conf.yaml filer med Pythons glob-modul och kombinera dem för att bilda en global konfigurationsfil. Under experiment (lokal testning) kan du specificera miljövariabler inuti filen env.env och sedan exportera dem genom att köra följande kommando i din terminal:

Observera att värdena för miljövariabler i env.env ska placeras inom citattecken (t.ex. SMP_REGION="us-east-1"). Under operationalisering bör dessa miljövariabler ställas in av CI-pipeline.

- Skapa och aktivera en virtuell miljö genom att köra följande kommandon:

- Installera de nödvändiga Python-paketen genom att köra följande kommando:

- Redigera din modellträning

conf.yamlfiler. Vi diskuterar konfigurationsfilens struktur i nästa avsnitt. - Från terminalen ringer du ramverkets ingångspunkt för att skapa eller uppdatera och köra SageMaker Pipeline Training DAG:

- Visa och felsök SageMaker Pipelines som körs på Rörledningar fliken i SageMaker Studio UI.

Konfigurationsfilstruktur

Det finns två typer av konfigurationsfiler i den föreslagna lösningen: ramkonfiguration och modellkonfiguration. I det här avsnittet beskriver vi var och en i detalj.

Ramkonfiguration

Smakämnen /framework/conf/conf.yaml fil ställer in variablerna som är gemensamma för alla modelleringsenheter. Detta inkluderar SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPSoch SMP_MODELNAME. Se steg 3 i installationsinstruktionerna för beskrivningar av dessa variabler och hur du ställer in dem via miljövariabler.

Modellkonfiguration

För varje modell i projektet måste vi specificera följande i <MODEL-DIR>/conf/conf.yaml fil (asterisker indikerar nödvändiga avsnitt, resten är valfria):

- /conf/models* – I det här avsnittet kan du konfigurera en eller flera modelleringsenheter. När ramkoden körs kommer den automatiskt att läsa alla konfigurationsfiler under körning och lägga till dem i konfigurationsträdet. Teoretiskt kan du specificera alla modelleringsenheter i samma

conf.yamlfil, men det rekommenderas att specificera varje modelleringsenhetskonfiguration i sin respektive katalog eller Git-förråd för att minimera fel. Enheterna är följande:- {modellnamn}* – Namnet på modellen.

- källkatalog* - En vanlig

source_dirsökväg att använda för alla steg inom modelleringsenheten. - förprocess – Detta avsnitt specificerar förbearbetningsparametrar.

- tåg* – Detta avsnitt specificerar träningsjobbparametrar.

- omvandla* – Det här avsnittet specificerar SageMaker Transform-jobbparametrar för att göra förutsägelser om testdata.

- utvärdera – Det här avsnittet specificerar SageMaker Processing-jobbparametrar för att generera en modellmetrik JSON-rapport för den tränade modellen.

- register* – Det här avsnittet specificerar parametrar för registrering av den tränade modellen i SageMaker Model Registry.

- /conf/sagemakerPipeline* – Det här avsnittet definierar SageMaker Pipelines-flödet, inklusive beroenden mellan steg. För användning av en modell definieras det här avsnittet i slutet av konfigurationsfilen. För användningsfall med flera modeller,

sagemakerPipelineavsnittet behöver bara definieras i konfigurationsfilen för en av modellerna (någon av modellerna). Vi hänvisar till denna modell som ankarmodell. Parametrarna är följande:- pipelineName* – Namnet på SageMaker pipeline.

- modeller* – Kapslad lista över modelleringsenheter:

- {modellnamn}* – Modellidentifierare, som ska matcha en {model-name} identifierare i /conf/models-avsnittet.

- steg* -

- stegnamn* – Stegnamnet som ska visas i SageMaker Pipelines DAG.

- steg_klass* – (Union[Bearbetning, Utbildning, CreateModel, Transform, Metrics, RegisterModel])

- steg_typ* – Den här parametern krävs endast för förbearbetningssteg, för vilka den ska ställas in på förbearbetning. Detta behövs för att särskilja förbearbetnings- och utvärderingssteg, som båda har en

step_classav bearbetning. - aktivera_cache – ([Union[True, False]]). Detta indikerar om du vill aktivera SageMaker Pipelines cachning för detta steg.

- chain_input_source_step – ([lista[stegnamn]]). Du kan använda detta för att ställa in kanalutgångarna för ett annat steg som ingång till detta steg.

- chain_input_additional_prefix – Detta är endast tillåtet för steg i transformationen

step_class, och kan användas tillsammans medchain_input_source_stepparameter för att fastställa filen som ska användas som indata till transformeringssteget.

- steg* -

- {modellnamn}* – Modellidentifierare, som ska matcha en {model-name} identifierare i /conf/models-avsnittet.

- beroenden – Det här avsnittet specificerar i vilken sekvens SageMaker Pipelines-stegen ska köras. Vi har anpassat Apache Airflow-notationen för det här avsnittet (till exempel,

{step_name} >> {step_name}). Om det här avsnittet lämnas tomt, explicita beroenden som anges avchain_input_source_stepparameter eller implicita beroenden definierar SageMaker Pipelines DAG-flödet.

Observera att vi rekommenderar att du har ett träningssteg per modelleringsenhet. Om flera träningssteg är definierade för en modelleringsenhet tar de efterföljande stegen implicit det sista träningssteget för att skapa modellobjektet, beräkna mätvärden och registrera modellen. Om du behöver träna flera modeller, rekommenderas det att skapa flera modelleringsenheter.

Exempel

I det här avsnittet visar vi tre exempel på ML-modellutbildnings-DAGs skapade med hjälp av det presenterade ramverket.

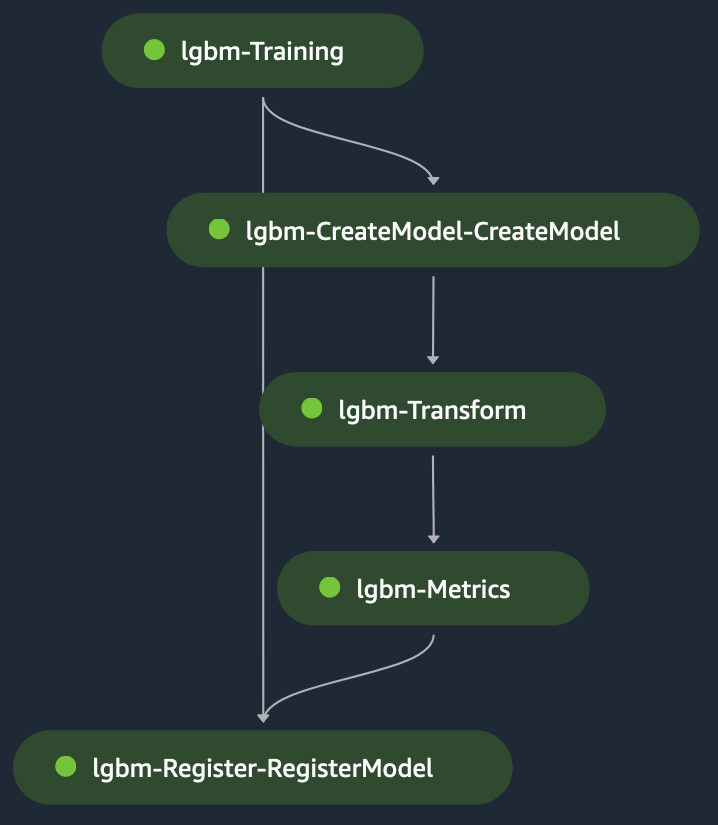

Enmodellsutbildning: LightGBM

Detta är ett exempel på en modell för ett användningsfall för klassificering där vi använder LightGBM i skriptläge på SageMaker. De dataset består av kategoriska och numeriska variabler för att förutsäga den binära etiketten Revenue (för att förutsäga om försökspersonen gör ett köp eller inte). De förbearbetning av skript används för att modellera data för träning och testning och sedan placera den i en S3 hink. S3-vägarna tillhandahålls sedan till träningssteg i konfigurationsfilen.

När träningssteget körs laddar SageMaker filen på behållaren kl /opt/ml/input/data/{channelName}/, tillgänglig via miljövariabeln SM_CHANNEL_{channelName} på behållaren (channelName= 'tåg' eller 'test').De träningsmanus gör följande:

- Ladda filerna lokalt från lokala containersökvägar med hjälp av NumPy laddning modul.

- Ställ in hyperparametrar för träningsalgoritmen.

- Spara den tränade modellen på den lokala containervägen

/opt/ml/model/.

SageMaker tar innehållet under /opt/ml/model/ för att skapa en tarball som används för att distribuera modellen till SageMaker för värd.

Transformeringssteget tar som ingång det stegade testfil som indata och den tränade modellen för att göra förutsägelser på den tränade modellen. Utdata från transformeringssteget är kedjad till måttenhetssteget för att utvärdera modellen mot marken sanning, som uttryckligen tillhandahålls till måttenhetssteget. Slutligen är utgången av metriksteget implicit kedjad till registersteget för att registrera modellen i SageMaker Model Registry med information om modellens prestanda producerad i metriksteget. Följande figur visar en visuell representation av tränings-DAG. Du kan referera till skripten och konfigurationsfilen för detta exempel i GitHub repo.

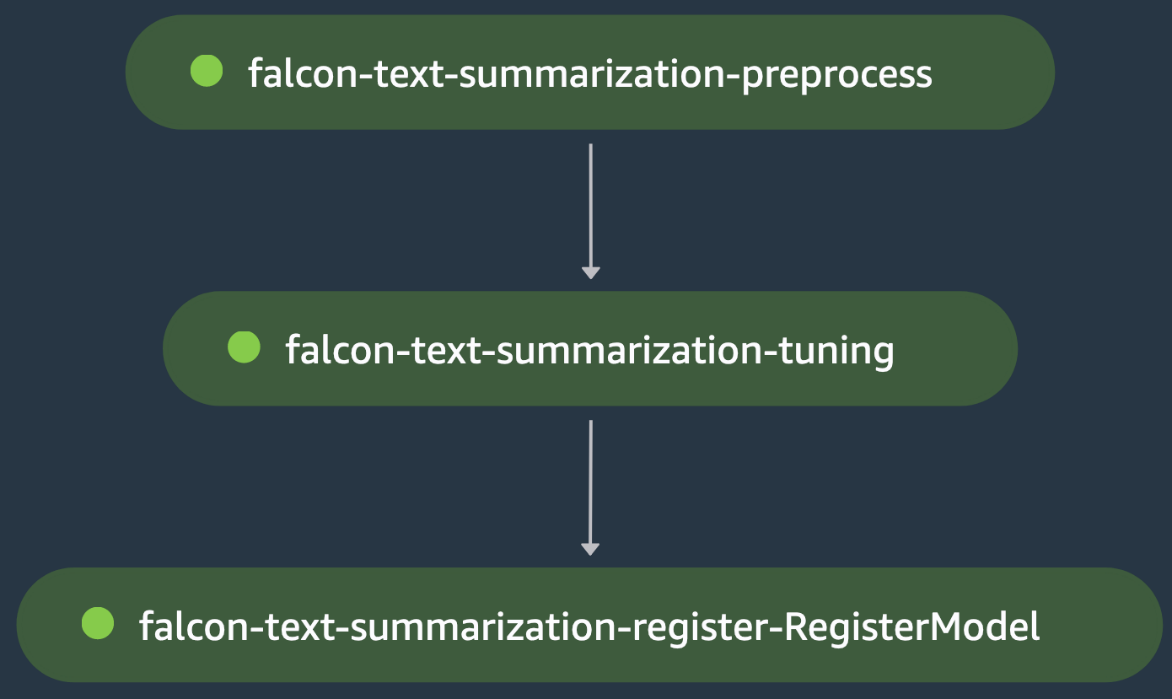

Enmodellsutbildning: LLM finjustering

Detta är ytterligare ett träningsexempel med en modell, där vi orkestrerar finjustering av en Falcon-40B storspråksmodell (LLM) från Hugging Face Hub för ett användningsfall för textsammanfattning. De förbearbetning av skript laddar samsum dataset från Hugging Face, laddar tokenizern för modellen och bearbetar tåg-/testdatadelarna för att finjustera modellen på denna domändata i steget falcon-text-summarization-preprocess.

Utgången är kedjad till falcon-text-summarization-tuning-steget, där träningsmanus laddar Falcon-40B LLM från Hugging Face Hub och startar accelererad finjustering med LoRA på tåget splittrade. Modellen utvärderas i samma steg efter finjustering, vilket portvakter utvärderingsförlusten misslyckas med falcon-text-summarization-tuning-steget, vilket gör att SageMaker-pipelinen stannar innan den kan registrera den finjusterade modellen. Annars körs falcon-text-summarization-tuning-steget framgångsrikt och modellen registreras i SageMaker Model Registry. Följande figur visar en visuell representation av LLM-finjusterings-DAG. Skripten och konfigurationsfilen för detta exempel är tillgängliga i GitHub repo.

Multi-modell utbildning

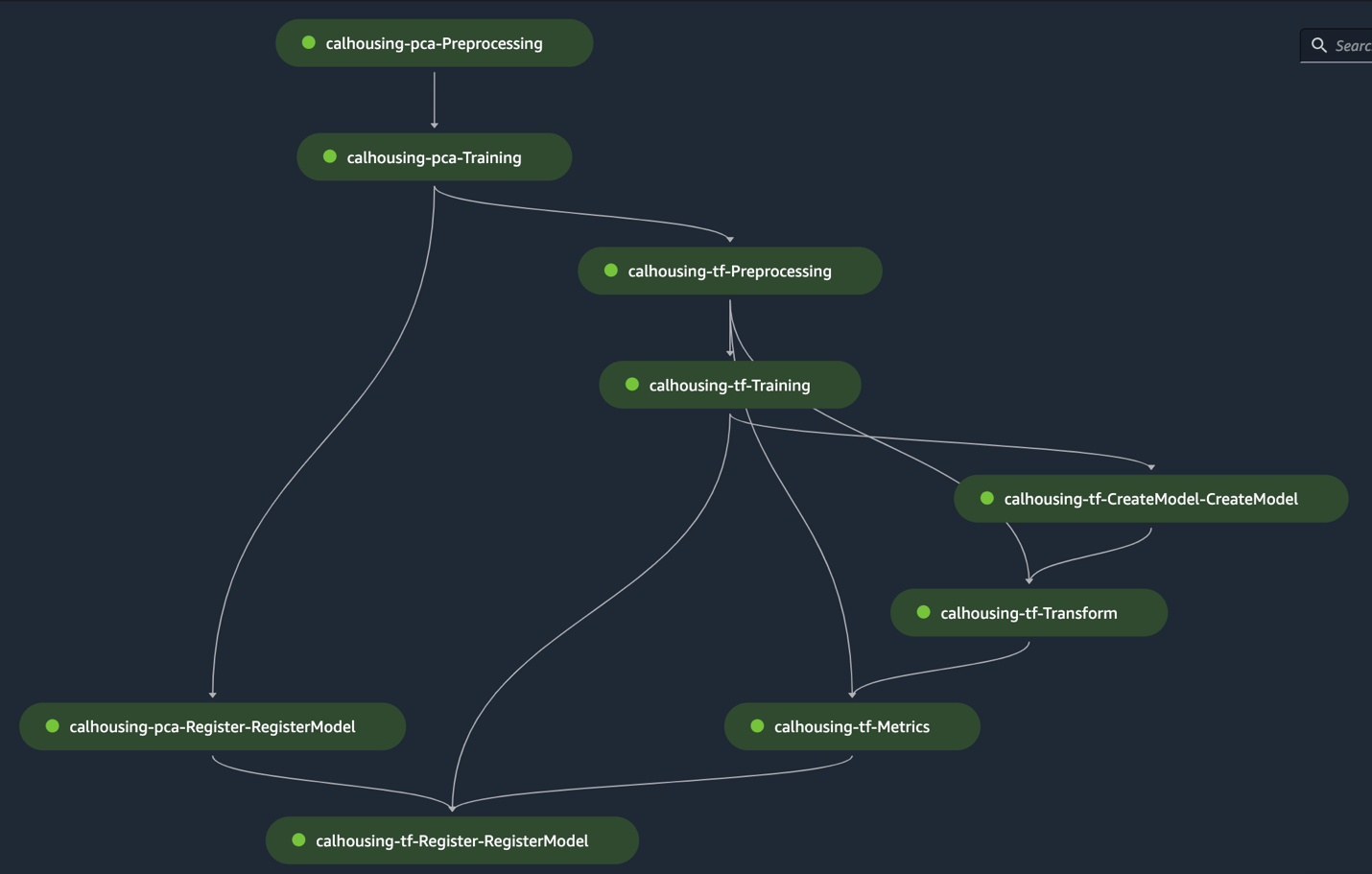

Detta är ett träningsexempel med flera modeller där en modell för principal komponentanalys (PCA) tränas för dimensionsreduktion och en TensorFlow Multilayer Perceptron-modell tränas för Kalifornien bostadspris förutsägelse. TensorFlow-modellens förbearbetningssteg använder en utbildad PCA-modell för att minska dimensionaliteten hos dess träningsdata. Vi lägger till ett beroende i konfigurationen för att säkerställa att TensorFlow-modellen registreras efter PCA-modellregistrering. Följande figur visar en visuell representation av exemplet på multi-modell utbildning DAG. Skripten och konfigurationsfilerna för detta exempel är tillgängliga i GitHub repo.

Städa upp

Utför följande steg för att rensa upp dina resurser:

- Använd AWS CLI för att lista och ta bort eventuella återstående pipelines som skapas av Python-skripten.

- Om du vill kan du radera andra AWS-resurser som S3-hinken eller IAM-rollen som skapats utanför SageMaker Pipelines.

Slutsats

I det här inlägget presenterade vi ett ramverk för att automatisera SageMaker Pipelines DAG-skapande baserat på konfigurationsfiler. Det föreslagna ramverket erbjuder en framtidsinriktad lösning på utmaningen att orkestrera komplexa ML-arbetsbelastningar. Genom att använda en konfigurationsfil ger SageMaker Pipelines flexibiliteten att bygga orkestrering med minimal kod, så att du kan effektivisera processen för att skapa och hantera både enmodeller och flermodellspipelines. Detta tillvägagångssätt sparar inte bara tid och resurser, utan främjar också MLOs bästa praxis, vilket bidrar till den övergripande framgången för ML-initiativ. Mer information om implementeringsdetaljer finns i GitHub repo.

Om författarna

Luis Felipe Yepez Barrios, är en maskininlärningsingenjör med AWS Professional Services, fokuserad på skalbara distribuerade system och automationsverktyg för att påskynda vetenskaplig innovation inom området maskininlärning (ML). Dessutom hjälper han företagskunder med att optimera sina maskininlärningslösningar genom AWS-tjänster.

Luis Felipe Yepez Barrios, är en maskininlärningsingenjör med AWS Professional Services, fokuserad på skalbara distribuerade system och automationsverktyg för att påskynda vetenskaplig innovation inom området maskininlärning (ML). Dessutom hjälper han företagskunder med att optimera sina maskininlärningslösningar genom AWS-tjänster.

Jinzhao Feng, är en maskininlärningsingenjör på AWS Professional Services. Han fokuserar på att bygga och implementera storskaliga generativa AI och klassiska ML-pipelinelösningar. Han är specialiserad på FMOps, LLMOps och distribuerad utbildning.

Jinzhao Feng, är en maskininlärningsingenjör på AWS Professional Services. Han fokuserar på att bygga och implementera storskaliga generativa AI och klassiska ML-pipelinelösningar. Han är specialiserad på FMOps, LLMOps och distribuerad utbildning.

Hårda Asnani, är en maskininlärningsingenjör på AWS. Hans bakgrund är inom tillämpad datavetenskap med fokus på att operationalisera maskininlärningsarbetsbelastningar i molnet i stor skala.

Hårda Asnani, är en maskininlärningsingenjör på AWS. Hans bakgrund är inom tillämpad datavetenskap med fokus på att operationalisera maskininlärningsarbetsbelastningar i molnet i stor skala.

Hasan Shojaei, är Sr. Data Scientist med AWS Professional Services, där han hjälper kunder över olika branscher att lösa sina affärsutmaningar genom användning av big data, maskininlärning och molnteknik. Innan denna roll ledde Hasan flera initiativ för att utveckla nya fysikbaserade och datadrivna modelleringstekniker för toppenergiföretag. Utanför jobbet brinner Hasan för böcker, vandring, fotografi och historia.

Hasan Shojaei, är Sr. Data Scientist med AWS Professional Services, där han hjälper kunder över olika branscher att lösa sina affärsutmaningar genom användning av big data, maskininlärning och molnteknik. Innan denna roll ledde Hasan flera initiativ för att utveckla nya fysikbaserade och datadrivna modelleringstekniker för toppenergiföretag. Utanför jobbet brinner Hasan för böcker, vandring, fotografi och historia.

Alec Jenab, är en maskininlärningsingenjör som är specialiserad på att utveckla och operationalisera lösningar för maskininlärning i stor skala för företagskunder. Alec brinner för att få ut innovativa lösningar på marknaden, särskilt inom områden där maskininlärning på ett meningsfullt sätt kan förbättra slutanvändarens upplevelse. Utanför jobbet tycker han om att spela basket, åka snowboard och upptäcka gömda pärlor i San Francisco.

Alec Jenab, är en maskininlärningsingenjör som är specialiserad på att utveckla och operationalisera lösningar för maskininlärning i stor skala för företagskunder. Alec brinner för att få ut innovativa lösningar på marknaden, särskilt inom områden där maskininlärning på ett meningsfullt sätt kan förbättra slutanvändarens upplevelse. Utanför jobbet tycker han om att spela basket, åka snowboard och upptäcka gömda pärlor i San Francisco.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :är

- :inte

- :var

- $UPP

- 120

- 160

- 7

- 8

- 9

- a

- Able

- Om oss

- accelererad

- tillgång

- tillgänglig

- rymma

- Enligt

- Konto

- uppnå

- tvärs

- aktivera

- acyklisk

- lägga till

- Efter

- mot

- AI

- algoritm

- Alla

- tillåter

- tillåts

- tillåter

- längs

- också

- amason

- Amazon SageMaker

- Amazon SageMaker-rörledningar

- Amazon Web Services

- bland

- an

- analys

- Ankare

- och

- Annan

- vilken som helst

- Apache

- tillämpas

- tillvägagångssätt

- arkitektur

- ÄR

- områden

- AS

- assist

- utgå ifrån

- At

- automatisera

- automatiskt

- automatisera

- Automation

- tillgänglig

- AWS

- AWS professionella tjänster

- bakgrund

- baserat

- Basketboll

- BE

- innan

- Fördelarna

- BÄST

- bästa praxis

- Stor

- Stora data

- Böcker

- båda

- Föra

- SLUTRESULTAT

- företag

- men

- by

- beräkna

- beräknat

- Ring

- kallas

- Samtal

- KAN

- Vid

- fall

- tillgodoser

- Orsakerna

- kedjad

- utmanar

- utmaningar

- Kanal

- val

- klasser

- klassificering

- rena

- cli

- klienter

- cloud

- koda

- kombinera

- Gemensam

- Företag

- komplex

- komponent

- oro

- förtroende

- konfiguration

- förening

- konsekvent

- består

- Behållare

- Behållare

- innehåller

- innehåll

- sammanhang

- kontinuerlig

- Bidragande

- täcka

- skapa

- skapas

- skapar

- Skapa

- skapande

- avgörande

- beställnings

- Kunder

- kundanpassad

- DAG

- datum

- datavetenskap

- datavetare

- data driven

- datauppsättningar

- deklarerade

- Standard

- definiera

- definierade

- definierar

- leverans

- demonstrera

- beroenden

- Dependency

- distribuera

- utplacera

- utplacering

- beskriva

- detalj

- detaljerad

- detaljer

- utveckla

- utveckla

- Utveckling

- Diagrammet

- olika

- riktad

- kataloger

- katalog

- upptäcka

- diskutera

- visas

- skilja på

- distribueras

- distribuerade system

- distribuerad utbildning

- Hamnarbetare

- gör

- domän

- under

- dynamisk

- dynamiskt

- varje

- effektiv

- ansträngning

- bemyndigar

- möjliggöra

- möjliggör

- möjliggör

- änden

- energi

- ingenjör

- Ingenjörer

- säkerställa

- Företag

- Hela

- inträde

- Miljö

- miljöer

- fel

- speciellt

- utvärdera

- utvärderade

- utvärdering

- utvärdering

- Varje

- exempel

- exempel

- påskynda

- erfarenhet

- uttryckligen

- export

- förlängas

- Ansikte

- MISSLYCKAS

- falsk

- snabbare

- fält

- Figur

- Fil

- Filer

- Slutligen

- hitta

- Flexibilitet

- flexibel

- flöda

- Fokus

- fokuserade

- fokuserar

- efter

- följer

- För

- formen

- framåtblickande

- Ramverk

- ramar

- Francisco

- från

- fungera

- Vidare

- generera

- generativ

- Generativ AI

- gå

- Välgörenhet

- styrning

- diagram

- större

- Grupp

- Gruppens

- Har

- har

- he

- hjälper

- här.

- dold

- hans

- historia

- värd

- bostäder

- Hur ser din drömresa ut

- How To

- html

- http

- HTTPS

- Nav

- identifierare

- Identitet

- ids

- if

- bild

- genomförande

- genomföra

- förbättra

- in

- I andra

- innefattar

- Inklusive

- indikerar

- pekar på

- industrier

- slutsatsen

- informationen

- Infrastruktur

- initiativ

- Innovation

- innovativa

- ingång

- inuti

- installera

- exempel

- instruktioner

- integrering

- interaktioner

- ingripande

- in

- IT

- DESS

- Jobb

- sammanfogning

- jpg

- json

- Nyckel

- nycklar

- etikett

- språk

- Large

- Efternamn

- senare

- inlärning

- Led

- vänster

- bibliotek

- tycka om

- linje

- Lista

- LLM

- läsa in

- laster

- lokal

- lokalt

- skogsavverkning

- se

- ser ut som

- förlust

- Maskinen

- maskininlärning

- göra

- GÖR

- Framställning

- ledning

- hantera

- manuell

- många

- marknad

- Match

- metriska

- Metrics

- minimum

- minimera

- ML

- MLOps

- Mode

- modell

- modellering

- modeller

- Modulerna

- mer

- multipel

- namn

- nödvändigt för

- Behöver

- behövs

- behov

- nätverk

- Nästa

- Nej

- roman

- objektet

- of

- Erbjudanden

- on

- ONE

- endast

- optimera

- or

- iscensatt

- orkestrerar

- orkestrering

- Övriga

- annat

- produktion

- utgångar

- utanför

- övergripande

- åsidosätta

- paket

- parameter

- parametrar

- brinner

- bana

- banor

- för

- prestanda

- utfört

- fotografi

- rörledning

- plato

- Platon Data Intelligence

- PlatonData

- i

- Punkt

- Inlägg

- praxis

- fördefinierad

- förutse

- Förutsägelser

- förutsättningar

- presentera

- presenteras

- pris

- Principal

- Innan

- privat

- process

- processer

- bearbetning

- producerad

- Produktion

- professionell

- projektet

- främjar

- främja

- föreslagen

- förutsatt

- ger

- inköp

- Python

- snabbt

- område

- Läsa

- lätt

- Läsning

- rekommenderar

- rekommenderas

- minska

- minskar

- reduktion

- hänvisa

- region

- registrera

- registrerat

- registrera

- Registrering

- register

- Återstående

- upprepa

- rapport

- Repository

- representation

- Obligatorisk

- Krav

- resurs

- Resurser

- att

- REST

- Resultat

- intäkter

- översyn

- Roll

- roller

- Körning

- rinnande

- kör

- runtime

- sagemaker

- SageMaker-rörledningar

- Samma

- San

- San Francisco

- skalbar

- Skala

- Vetenskap

- vetenskaplig

- Forskare

- vetenskapsmän

- skript

- skript

- §

- sektioner

- säkerhet

- Sekvens

- Tjänster

- in

- uppsättningar

- flera

- skall

- Visar

- Enkelt

- SEX

- släta

- So

- lösning

- Lösningar

- LÖSA

- Källa

- källkod

- specialiserad

- specialiserat

- specificerade

- delas

- Delar upp

- startar

- Steg

- Steg

- Sluta

- förvaring

- misslyckande

- effektivisera

- rationalisering

- struktur

- studio

- ämne

- subnät

- senare

- framgång

- Framgångsrikt

- sådana

- levereras

- syntax

- System

- Ta

- tar

- tekniker

- Tekniken

- tensorflow

- terminal

- testa

- Testning

- text

- den där

- Smakämnen

- Registret

- deras

- Dem

- sedan

- därför

- Dessa

- detta

- tre

- Genom

- hela

- tid

- till

- topp

- Spårning

- Tåg

- tränad

- Utbildning

- Förvandla

- träd

- sann

- två

- typer

- ui

- under

- enhet

- enheter

- Uppdatering

- användning

- användningsfall

- Begagnade

- Användare

- Användarupplevelse

- användningar

- med hjälp av

- verktyg

- Värden

- variabel

- versioner

- via

- Virtuell

- visuell

- we

- webb

- webbservice

- VÄL

- när

- om

- som

- VEM

- bred

- Brett utbud

- kommer

- med

- inom

- utan

- Arbete

- arbetsflöde

- XGBoost

- jaml

- Om er

- Din

- zephyrnet