Generativa AI-lösningar har potential att förvandla företag genom att öka produktiviteten och förbättra kundupplevelsen, och att använda stora språkmodeller (LLM) med dessa lösningar har blivit allt populärare. Att bygga proof of concept är relativt enkelt eftersom banbrytande grundmodeller är tillgängliga från specialiserade leverantörer genom ett enkelt API-anrop. Därför har organisationer av olika storlekar och över olika branscher börjat ombilda sina produkter och processer med hjälp av generativ AI.

Trots sin rikedom av allmänna kunskaper har toppmoderna LLM:er bara tillgång till den information de utbildats i. Detta kan leda till faktiska felaktigheter (hallucinationer) när LLM uppmanas att generera text baserat på information de inte såg under sin utbildning. Därför är det avgörande att överbrygga klyftan mellan LLM:s allmänna kunskap och dina egna data för att hjälpa modellen att generera mer exakta och kontextuella svar samtidigt som risken för hallucinationer minskar. Den traditionella metoden för finjustering, även om den är effektiv, kan vara beräkningskrävande, dyr och kräver teknisk expertis. Ett annat alternativ att överväga kallas Retrieval Augmented Generation (RAG), som förser LLM med ytterligare information från en extern kunskapskälla som enkelt kan uppdateras.

Dessutom måste företag säkerställa datasäkerhet när de hanterar proprietära och känsliga uppgifter, såsom personuppgifter eller immateriella rättigheter. Detta är särskilt viktigt för organisationer som verkar i hårt reglerade branscher, såsom finansiella tjänster och hälso- och sjukvård och biovetenskap. Därför är det viktigt att förstå och kontrollera flödet av dina data genom den generativa AI-applikationen: Var finns modellen? Var behandlas uppgifterna? Vem har tillgång till uppgifterna? Kommer uppgifterna att användas för att träna modeller, vilket så småningom riskerar att läcka känslig data till offentliga LLM:er?

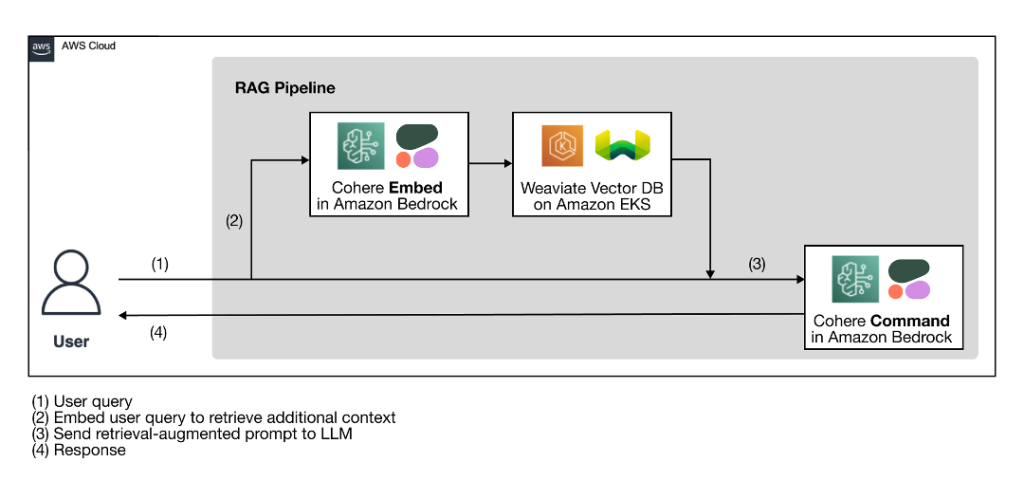

Det här inlägget diskuterar hur företag kan bygga korrekta, transparenta och säkra generativa AI-applikationer samtidigt som de behåller full kontroll över proprietär data. Den föreslagna lösningen är en RAG-pipeline som använder en AI-native teknologistack, vars komponenter är designade från grunden med AI i sin kärna, snarare än att ha AI-kapacitet som en eftertanke. Vi visar hur man bygger en end-to-end RAG-applikation med hjälp av Coheres språkmodeller dig genom Amazonas berggrund och en Weaviate vektordatabas på AWS Marketplace. Den medföljande källkoden är tillgänglig i relaterat GitHub-förråd värd av Weaviate. Även om AWS inte kommer att ansvara för att underhålla eller uppdatera koden i partnerns repository, uppmuntrar vi kunder att kontakta Weaviate direkt angående eventuella önskade uppdateringar.

Lösningsöversikt

Följande arkitekturdiagram på hög nivå illustrerar den föreslagna RAG-pipelinen med en AI-native teknologistack för att bygga korrekta, transparenta och säkra generativa AI-lösningar.

Figur 1: RAG-arbetsflöde med hjälp av Coheres språkmodeller genom Amazon Bedrock och en Weaviate-vektordatabas på AWS Marketplace

Som ett förberedelsesteg för RAG-arbetsflödet tas en vektordatabas, som fungerar som den externa kunskapskällan, in med den ytterligare kontexten från den proprietära datan. Det faktiska RAG-arbetsflödet följer de fyra stegen som illustreras i diagrammet:

- Användaren anger sin fråga.

- Användarfrågan används för att hämta relevant ytterligare kontext från vektordatabasen. Detta görs genom att generera vektorinbäddningarna av användarfrågan med en inbäddningsmodell för att utföra en vektorsökning för att hämta den mest relevanta kontexten från databasen.

- Det hämtade sammanhanget och användarfrågan används för att utöka en promptmall. Den hämtningsförstärkta prompten hjälper LLM att generera en mer relevant och exakt komplettering, vilket minimerar hallucinationer.

- Användaren får ett mer exakt svar baserat på sin fråga.

Den AI-native teknologistacken som illustreras i arkitekturdiagrammet har två nyckelkomponenter: Cohere-språkmodeller och en Weaviate-vektordatabas.

Sammanhängande språkmodeller i Amazon Bedrock

Smakämnen Cohere Plattform ger språkmodeller med toppmodern prestanda till företag och utvecklare genom ett enkelt API-anrop. Det finns två nyckeltyper av språkbehandlingsfunktioner som Cohere-plattformen tillhandahåller – generativ och inbäddad – och var och en betjänas av en annan typ av modell:

- Textgenerering med Kommando – Utvecklare kan komma åt slutpunkter som driver genererande AI-funktioner, vilket möjliggör applikationer som konversation, svar på frågor, copywriting, sammanfattning, informationsextraktion och mer.

- Textrepresentation med Bädda – Utvecklare kan komma åt slutpunkter som fångar textens semantiska betydelse, vilket möjliggör applikationer som vektorsökmotorer, textklassificering och klustring med mera. Cohere Embed finns i två former, en engelskspråkig modell och en flerspråkig modell, som båda är nu tillgänglig på Amazon Bedrock.

Cohere-plattformen ger företag möjlighet att anpassa sin generativa AI-lösning privat och säkert genom Amazon Bedrock-utbyggnaden. Amazon Bedrock är en fullt hanterad molntjänst som gör det möjligt för utvecklingsteam att snabbt bygga och skala generativa AI-applikationer samtidigt som du håller dina data och applikationer säkra och privata. Dina data används inte för tjänsteförbättringar, delas aldrig med tredjepartsmodellleverantörer och finns kvar i Region där API-anropet behandlas. Data krypteras alltid under överföring och vila, och du kan kryptera data med dina egna nycklar. Amazon Bedrock stöder säkerhetskrav, inklusive US Health Insurance Portability and Accountability Act (HIPAA) behörighet och efterlevnad av General Data Protection Regulation (GDPR). Dessutom kan du säkert integrera och enkelt distribuera dina generativa AI-applikationer med hjälp av de AWS-verktyg du redan är bekant med.

Weaviate vektordatabas på AWS Marketplace

Väv är en AI-native vektor databas som gör det enkelt för utvecklingsteam att bygga säkra och transparenta generativa AI-applikationer. Weaviate används för att lagra och söka i både vektordata och källobjekt, vilket förenklar utvecklingen genom att eliminera behovet av att vara värd för och integrera separata databaser. Weaviate levererar semantisk sökprestanda på undersekund och kan skalas för att hantera miljarder vektorer och miljontals hyresgäster. Med en unik utökningsbar arkitektur, integrerar Weaviate naturligt med Cohere-grundmodeller som distribueras i Amazon Bedrock för att underlätta den bekväma vektoriseringen av data och använda dess generativa kapacitet inifrån databasen.

Weaviates AI-native vektordatabas ger kunderna flexibiliteten att distribuera den som en bring-your-own-cloud (BYOC)-lösning eller som en hanterad tjänst. Denna showcase använder Weaviate Kubernetes Cluster på AWS Marketplace, en del av Weaviates BYOC-erbjudande, som tillåter containerbaserad skalbar distribution inuti din AWS-hyresgäst och VPC med bara några få klick med hjälp av en AWS molnformation mall. Detta tillvägagångssätt säkerställer att din vektordatabas distribueras i din specifika region nära grundmodellerna och proprietära data för att minimera latens, stödja datalokalitet och skydda känslig data samtidigt som potentiella regulatoriska krav, såsom GDPR, hanteras.

Använda fallöversikt

I följande avsnitt visar vi hur man bygger en RAG-lösning med hjälp av den AI-native teknologistacken med Cohere, AWS och Weaviate, som illustreras i lösningsöversikten.

Användningsexemplet genererar riktade annonser för semestervistelser baserat på en målgrupp. Målet är att använda användarfrågan för målgruppen (till exempel "familj med små barn") för att hämta den mest relevanta semesteruppgiften (till exempel en lista med lekplatser i närheten) och sedan generera en annons för hämtad listning skräddarsydd för målgruppen.

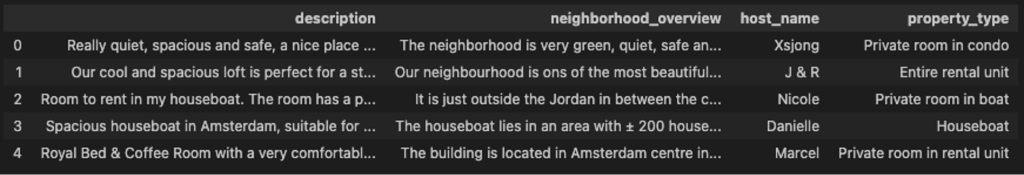

Figur 2: Första raderna med semesterboende som är tillgängliga från Inside Airbnb.

Datauppsättningen är tillgänglig från Inuti Airbnb och är licensierad enligt a Creative Commons Erkännande 4.0 Internationell licens. Du hittar den medföljande koden i GitHub repository.

Förutsättningar

För att följa med och använda alla AWS-tjänster i följande handledning, se till att du har en AWS-konto.

Aktivera komponenter i den AI-native teknologistacken

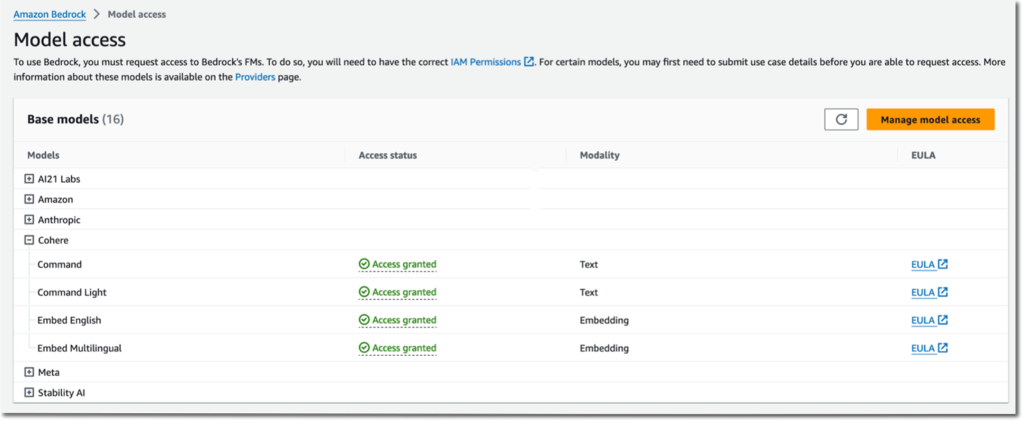

Först måste du aktivera de relevanta komponenterna som diskuteras i lösningsöversikten i ditt AWS-konto. Slutför följande steg:

- Till vänster Amazon Bedrock-konsolväljer Modellåtkomst i navigeringsfönstret.

- Välja Hantera modellåtkomst längst upp till höger.

- Välj de grundmodeller du väljer och begär åtkomst.

Figur 3: Hantera modellåtkomst i Amazon Bedrock-konsolen.

Därefter ställer du in ett Weaviate-kluster.

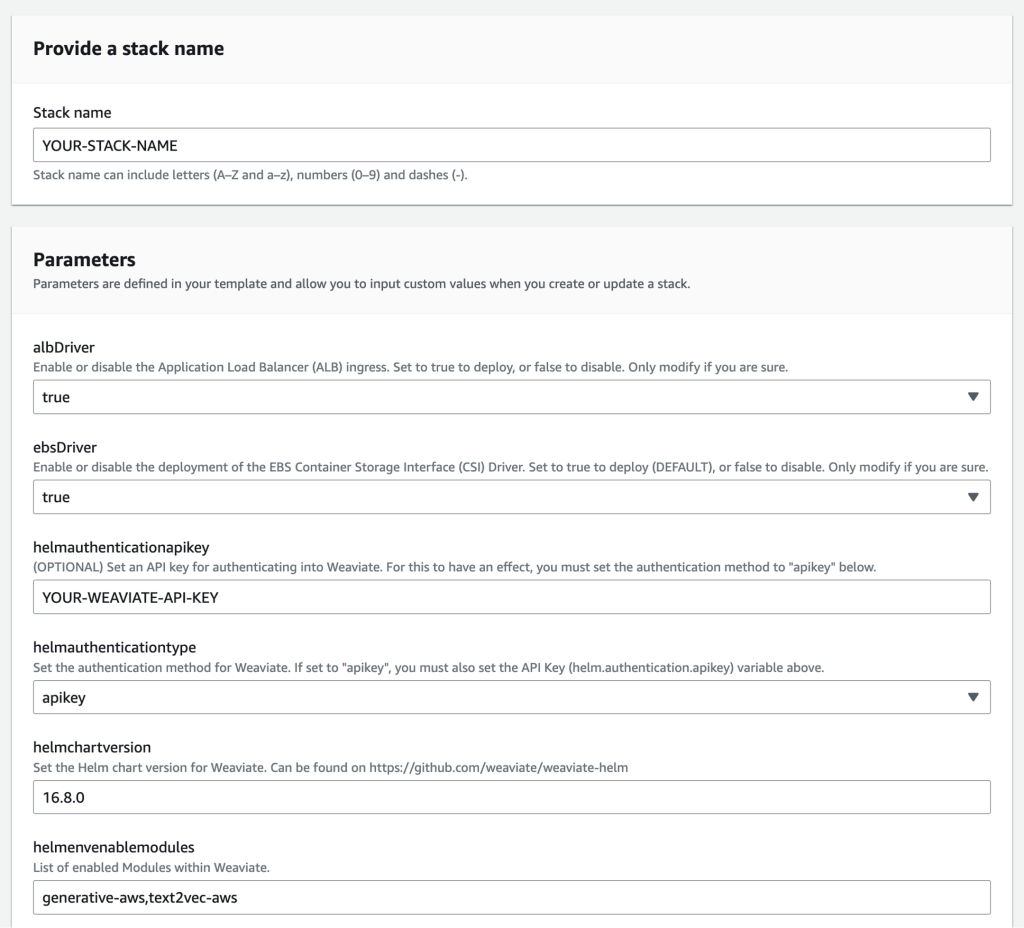

- Prenumerera på Weaviate Kubernetes Cluster på AWS Marketplace.

- Starta programvaran med a CloudFormation-mall enligt din föredragna tillgänglighetszon.

CloudFormation-mallen är förfylld med standardvärden.

- För Stapla namn, ange ett stacknamn.

- För helautentiseringstyp, rekommenderas att aktivera autentisering genom inställning

helmauthenticationtypetillapikeyoch definiera a helmauthenticationapikey. - För helmauthenticationapikey, ange din Weaviate API-nyckel.

- För helmchartversion, ange ditt versionsnummer. Det måste vara minst v.16.8.0. Referera till GitHub repo för den senaste versionen.

- För helmenabledmodules, se till

tex2vec-awsochgenerative-awsfinns i listan över aktiverade moduler inom Weaviate.

Figur 4: CloudFormation-mall.

Den här mallen tar cirka 30 minuter att färdigställa.

Anslut till Weaviate

Slutför följande steg för att ansluta till Weaviate:

- I Amazon SageMaker-konsol, navigera till Notebook-instanser i navigeringsfönstret via Notebook > Notebook-instanser till vänster.

- Skapa en ny anteckningsbok-instans.

- Installera Weaviate-klientpaketet med de nödvändiga beroenden:

- Anslut till din Weaviate-instans med följande kod:

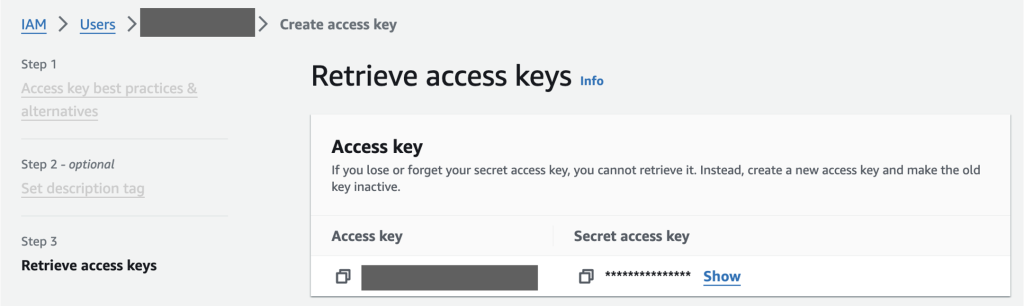

- Weaviate URL – Åtkomst till Weaviate via belastningsbalanserarens URL. I den Amazon Elastic Compute Cloud (Amazon EC2) -konsol, välj Lastbalanserare i navigeringsfönstret och hitta lastbalanseraren. Leta efter kolumnen DNS-namn och lägg till

http://framför det. - Weaviate API-nyckel – Det här är nyckeln du ställde in tidigare i CloudFormation-mallen (

helmauthenticationapikey). - AWS-åtkomstnyckel och hemlig åtkomstnyckel – Du kan hämta åtkomstnyckeln och den hemliga åtkomstnyckeln för din användare i AWS identitets- och åtkomsthantering (IAM) -konsol.

Figur 5: AWS Identity and Access Management (IAM)-konsol för att hämta AWS-åtkomstnyckel och hemlig åtkomstnyckel.

Konfigurera Amazon Bedrock-modulen för att aktivera Cohere-modeller

Därefter definierar du en datainsamling (class) ringde Listings att lagra listornas dataobjekt, vilket är analogt med att skapa en tabell i en relationsdatabas. I det här steget konfigurerar du de relevanta modulerna för att möjliggöra användningen av Cohere-språkmodeller som finns på Amazon Bedrock inbyggt från Weaviates vektordatabas. Vectorizern ("text2vec-aws") och generativ modul ("generative-aws“) specificeras i definitionen av datainsamling. Båda dessa moduler tar tre parametrar:

- "service" - Använda sig av "

bedrock" för Amazon Bedrock (alternativt använd "sagemaker" för Amazon SageMaker JumpStart) - "Område" – Ange den region där din modell är utplacerad

- "modell" – Ange grundmodellens namn

Se följande kod:

Mata in data i Weaviates vektordatabas

I det här steget definierar du strukturen för datainsamlingen genom att konfigurera dess egenskaper. Förutom egenskapens namn och datatyp kan du också konfigurera om endast dataobjektet ska lagras eller om det ska lagras tillsammans med dess vektorinbäddningar. I det här exemplet, host_name och property_type är inte vektoriserade:

Kör följande kod för att skapa samlingen i din Weaviate-instans:

Du kan nu lägga till objekt till Weaviate. Du använder en batchimportprocess för maximal effektivitet. Kör följande kod för att importera data. Under importen kommer Weaviate att använda den definierade vektoriseraren för att skapa en vektorinbäddning för varje objekt. Följande kod laddar objekt, initierar en batchprocess och lägger till objekt till målsamlingen ett efter ett:

Retrieval Augmented Generation

Du kan bygga en RAG-pipeline genom att implementera en generativ sökfråga på din Weaviate-instans. För detta definierar du först en promptmall i form av en f-sträng som kan ta in användarfrågan ({target_audience}) direkt och det ytterligare sammanhanget ({{host_name}}, {{property_type}}, {{description}}och {{neighborhood_overview}}) från vektordatabasen vid körning:

Därefter kör du en generativ sökfråga. Detta uppmanar den definierade generativa modellen med en prompt som består av användarfrågan såväl som hämtad data. Följande fråga hämtar ett listobjekt (.with_limit(1)) från Listings samling som mest liknar användarfrågan (.with_near_text({"concepts": target_audience})). Sedan användarfrågan (target_audience) och de hämtade listornas egenskaper (["description", "neighborhood", "host_name", "property_type"]) matas in i promptmallen. Se följande kod:

I följande exempel kan du se att föregående kodbit för target_audience = “Family with small children” hämtar en lista från programledaren Marre. Uppmaningsmallen utökas med Marres listinformation och målgrupp:

Baserat på den förstärkta uppmaningen genererar Cohere's Command-modell följande riktade annons:

Alternativa anpassningar

Du kan göra alternativa anpassningar av olika komponenter i den föreslagna lösningen, till exempel följande:

- Coheres språkmodeller finns också tillgängliga via Amazon SageMaker JumpStart, som ger tillgång till banbrytande grundmodeller och gör det möjligt för utvecklare att distribuera LLM till Amazon SageMaker, en helt hanterad tjänst som sammanför en bred uppsättning verktyg för att möjliggöra högpresterande, låg kostnad maskininlärning för alla användningsfall. Weaviate är integrerat med SageMaker också.

- Ett kraftfullt tillägg till denna lösning är Cohere Rerank endpoint, tillgängligt via SageMaker JumpStart. Omrankning kan förbättra relevansen av sökresultat från lexikal eller semantisk sökning. Omrankning fungerar genom att beräkna semantiska relevanspoäng för dokument som hämtas av ett söksystem och rangordna dokumenten baserat på dessa poäng. Att lägga till Rerank till en applikation kräver endast en kodändring.

- För att tillgodose olika driftsättningskrav för olika produktionsmiljöer kan Weaviate distribueras på olika ytterligare sätt. Den finns till exempel som en direktnedladdning från Weaviate hemsida, som fortsätter Amazon Elastic Kubernetes-tjänst (Amazon EKS) eller lokalt via Hamnarbetare or Kubernetes. Den finns också som en hanterad service som kan köras säkert inom en VPC eller som en offentlig molntjänst värd på AWS med en 14-dagars gratis provperiod.

- Du kan servera din lösning i en VPC med hjälp av Amazon Virtual Private Cloud (Amazon VPC), som gör det möjligt för organisationer att lansera AWS-tjänster i ett logiskt isolerat virtuellt nätverk, som liknar ett traditionellt nätverk men med fördelarna med AWS skalbara infrastruktur. Beroende på den klassificerade känslighetsnivån för uppgifterna kan organisationer också inaktivera internetåtkomst i dessa VPC:er.

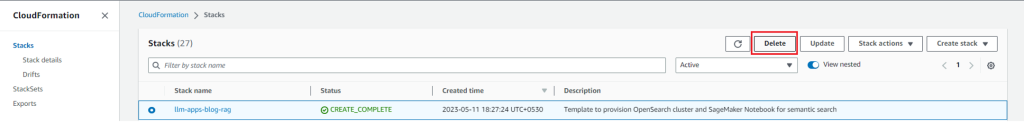

Städa upp

För att förhindra oväntade debiteringar, ta bort alla resurser du distribuerade som en del av det här inlägget. Om du startade CloudFormation-stacken kan du ta bort den via AWS CloudFormation-konsolen. Observera att det kan finnas vissa AWS-resurser, som t.ex Amazon Elastic Block Store (Amazon EBS) volymer och AWS nyckelhanteringstjänst (AWS KMS)-nycklar, som kanske inte raderas automatiskt när CloudFormation-stacken tas bort.

Figur 6: Ta bort alla resurser via AWS CloudFormation-konsolen.

Slutsats

Det här inlägget diskuterade hur företag kan bygga korrekta, transparenta och säkra generativa AI-applikationer samtidigt som de fortfarande har full kontroll över sin data. Den föreslagna lösningen är en RAG-pipeline som använder en AI-native teknologistack som en kombination av Cohere-grundmodeller i Amazon Bedrock och en Weaviate-vektordatabas på AWS Marketplace. RAG-metoden gör det möjligt för företag att överbrygga klyftan mellan LLM:s allmänna kunskap och proprietära data samtidigt som hallucinationer minimeras. En AI-native teknologistack möjliggör snabb utveckling och skalbar prestanda.

Du kan börja experimentera med RAG proof of concept för dina företagsfärdiga generativa AI-applikationer med hjälp av stegen som beskrivs i det här inlägget. Den medföljande källkoden är tillgänglig i relaterat GitHub-förråd. Tack för att du läste. Ge gärna kommentarer eller feedback i kommentarsfältet.

Om författarna

James Yi är senior AI/ML Partner Solutions Architect i Technology Partners COE Tech-team på Amazon Web Services. Han brinner för att arbeta med företagskunder och partners för att designa, distribuera och skala AI/ML-applikationer för att få affärsvärde. Utanför jobbet tycker han om att spela fotboll, resa och umgås med sin familj.

James Yi är senior AI/ML Partner Solutions Architect i Technology Partners COE Tech-team på Amazon Web Services. Han brinner för att arbeta med företagskunder och partners för att designa, distribuera och skala AI/ML-applikationer för att få affärsvärde. Utanför jobbet tycker han om att spela fotboll, resa och umgås med sin familj.

Leonie Monigatti är en Developer Advocate på Weaviate. Hennes fokusområde är AI/ML, och hon hjälper utvecklare att lära sig om generativ AI. Utanför jobbet delar hon också med sig av sina lärdomar inom datavetenskap och ML på sin blogg och på Kaggle.

Leonie Monigatti är en Developer Advocate på Weaviate. Hennes fokusområde är AI/ML, och hon hjälper utvecklare att lära sig om generativ AI. Utanför jobbet delar hon också med sig av sina lärdomar inom datavetenskap och ML på sin blogg och på Kaggle.

Meor Amer är en Developer Advocate på Cohere, en leverantör av banbrytande teknik för naturlig språkbehandling (NLP). Han hjälper utvecklare att bygga banbrytande applikationer med Coheres stora språkmodeller (LLM).

Meor Amer är en Developer Advocate på Cohere, en leverantör av banbrytande teknik för naturlig språkbehandling (NLP). Han hjälper utvecklare att bygga banbrytande applikationer med Coheres stora språkmodeller (LLM).

Skynda Mao är senior AI/ML Partner Solutions Architect i Emerging Technologies-teamet på Amazon Web Services. Han brinner för att arbeta med företagskunder och partners för att designa, distribuera och skala AI/ML-applikationer för att få fram deras affärsvärden. Utanför jobbet tycker han om att fiska, resa och spela pingis.

Skynda Mao är senior AI/ML Partner Solutions Architect i Emerging Technologies-teamet på Amazon Web Services. Han brinner för att arbeta med företagskunder och partners för att designa, distribuera och skala AI/ML-applikationer för att få fram deras affärsvärden. Utanför jobbet tycker han om att fiska, resa och spela pingis.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/build-enterprise-ready-generative-ai-solutions-with-cohere-foundation-models-in-amazon-bedrock-and-weaviate-vector-database-on-aws-marketplace/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 10

- 100

- 11

- 12

- 13

- 16

- 17

- 19

- 23

- 30

- 32

- 33

- 7

- 8

- 9

- a

- Om Oss

- tillgång

- Enligt

- Konto

- ansvar

- exakt

- tvärs

- Agera

- faktiska

- lägga till

- lagt till

- tillsats

- Dessutom

- Annat

- ytterligare information

- Dessutom

- adresse

- Lägger

- vuxna

- Annons

- förespråkare

- AI

- AI / ML

- Airbnb

- Alla

- tillåter

- längs

- redan

- också

- alternativ

- Även

- alltid

- amason

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- amsterdam

- an

- och

- Annan

- svar

- vilken som helst

- api

- Ansökan

- tillämpningar

- tillvägagångssätt

- arkitektur

- ÄR

- OMRÅDE

- områden

- AS

- åt sidan

- At

- Sevärdheter

- publik

- förstärka

- augmented

- Autentisering

- automatiskt

- tillgänglighet

- tillgänglig

- bort

- AWS

- AWS molnformation

- AWS Identity and Access Management (IAM)

- AWS Marketplace

- gunga

- barer

- baserat

- BE

- därför att

- blir

- börjat

- Fördelarna

- BÄST

- mellan

- miljarder

- Blockera

- Blogg

- öka

- båda

- BRO

- Bringar

- bred

- SLUTRESULTAT

- Byggnad

- företag

- företag

- men

- by

- kaféer

- Ring

- kallas

- KAN

- kapacitet

- fånga

- Vid

- tillgodose

- centrala

- centrum

- byta

- avgifter

- Barn

- val

- Välja

- Stad

- klass

- klassificering

- klassificerad

- klient

- Stäng

- cloud

- kluster

- klustring

- koda

- samling

- Kolumn

- kombination

- komma

- kommer

- kommentarer

- Commons

- fullborda

- fullbordan

- Efterlevnad

- komponenter

- Består

- Compute

- databehandling

- begrepp

- Begreppen

- konfigurering

- Kontakta

- Tänk

- Konsol

- sammanhang

- kontextuella

- kontroll

- Bekväm

- bekvämt

- konversera

- copywriting

- Kärna

- skapa

- Skapa

- avgörande

- kund

- Kunder

- skräddarsy

- allra senaste

- datum

- dataskydd

- datavetenskap

- datasäkerhet

- Databas

- databaser

- Standard

- definiera

- definierade

- definierande

- definition

- levererar

- demonstrera

- beroenden

- beroende

- distribuera

- utplacerade

- utplacering

- härleda

- beskrivning

- Designa

- utformade

- önskas

- detaljer

- Utvecklare

- utvecklare

- Utveckling

- utvecklingsteam

- olika

- matsal

- rikta

- direkt

- diskuteras

- dns

- dokument

- gjort

- ladda ner

- under

- varje

- Tidigare

- lätt

- Effektiv

- effektivitet

- förhöjd

- berättigande

- eliminera

- embed

- inbäddning

- smärgel

- nya tekniker

- bemyndigar

- möjliggöra

- aktiverad

- möjliggör

- möjliggör

- uppmuntra

- krypterad

- början till slut

- Motorer

- Engelska

- säkerställa

- säkerställer

- ange

- Företag

- företag

- Går in

- Hela

- miljöer

- så småningom

- exempel

- dyra

- erfarenhet

- Erfarenheter

- expertis

- extern

- extraktion

- främja

- bekant

- familj

- SNABB

- Funktioner

- Med

- Fed

- återkoppling

- känna

- få

- Fil

- finansiella

- finansiella tjänster

- hitta

- Förnamn

- Fiske

- Flexibilitet

- Golv

- flöda

- Fokus

- följer

- efter

- följer

- För

- formen

- former

- fundament

- fyra

- Fri

- fri rättegång

- från

- främre

- full

- fullständigt

- ytterligare

- spalt

- GDPR

- Allmänt

- generell information

- Allmän uppgiftsskyddsförordning

- generera

- genererar

- generera

- generering

- generativ

- Generativ AI

- GitHub

- ger

- Målet

- Marken

- Grupp

- Hälften

- hantera

- Arbetsmiljö

- Har

- har

- he

- Rubrik

- Hälsa

- sjukförsäkring

- hälso-och sjukvård

- Hjärta

- kraftigt

- hjälpa

- hjälpa

- hjälper

- här

- högnivå

- högpresterande

- hans

- Hem

- värd

- värd

- Hur ser din drömresa ut

- How To

- http

- HTTPS

- Identitet

- if

- illustrerar

- genomföra

- importera

- med Esport

- förbättra

- förbättringar

- förbättra

- in

- Inklusive

- alltmer

- industrier

- informationen

- information utvinning

- Infrastruktur

- inuti

- installera

- exempel

- försäkring

- integrera

- integrerade

- integrerar

- intellektuella

- immateriella rättigheter

- Internationell

- Internet

- internetåtkomst

- in

- isolerat

- IT

- DESS

- jpg

- bara

- Ha kvar

- hålla

- Nyckel

- nycklar

- barn

- kunskap

- språk

- Large

- Latens

- senaste

- lansera

- lanserades

- leda

- Leads

- läckage

- LÄRA SIG

- inlärning

- t minst

- vänster

- Nivå

- Licensierade

- livet

- Life Sciences

- linje

- Lista

- lista

- Annonser

- levande

- LLM

- läsa in

- laster

- lokal

- lokalt

- belägen

- läge

- logiskt

- se

- du letar

- låg kostnad

- Maskinen

- maskininlärning

- upprätthålla

- göra

- GÖR

- hantera

- förvaltade

- ledning

- marknadsplats

- Master

- maximal

- Maj..

- betyder

- betyder

- Minnen

- metod

- miljoner

- minimerande

- minuter

- ML

- modell

- modeller

- Modulerna

- Moduler

- mer

- mest

- måste

- namn

- natively

- Natural

- Naturlig språkbehandling

- Navigera

- Navigering

- Behöver

- nät

- aldrig

- Nya

- nlp

- Nej

- Notera

- anteckningsbok

- nu

- antal

- objektet

- objekt

- of

- erbjudanden

- erbjuda

- on

- ONE

- endast

- drift

- Alternativet

- or

- organisationer

- Övriga

- vår

- skisse

- utanför

- över

- Översikt

- egen

- paket

- betalas

- pandor

- panelen

- parametrar

- parkering

- del

- särskilt

- partnern

- partner

- brinner

- perfekt

- Utföra

- prestanda

- personlig

- personlig information

- bit

- rörledning

- Plats

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- i

- Populära

- bärbarhet

- Inlägg

- potentiell

- kraft

- den mäktigaste

- föregående

- föredragen

- beredning

- presentera

- förhindra

- privat

- process

- Bearbetad

- processer

- bearbetning

- Produktion

- produktivitet

- Produkter

- prompter

- korrektur

- egenskaper

- egenskapen

- föreslagen

- proprietary

- skydda

- skydd

- ge

- leverantör

- leverantörer

- ger

- allmän

- Offentligt moln

- fråga

- snabbt

- trasa

- Rankning

- snarare

- RE

- Läsa

- Läsning

- erhåller

- rekommenderas

- reducerande

- hänvisa

- om

- region

- reglerad

- reglerade industrier

- reglering

- regulatorer

- relativt

- relevans

- relevanta

- resterna

- Repository

- begära

- Obligatorisk

- Krav

- Kräver

- liknar

- Resurser

- respons

- svar

- ansvarig

- REST

- restauranger

- resultera

- Resultat

- höger

- Risk

- riskera

- Rum

- RAD

- Körning

- kör

- runtime

- s

- sagemaker

- skalbar

- Skala

- Vetenskap

- VETENSKAPER

- Sök

- Sökmotorer

- Secret

- §

- sektioner

- säkra

- säkert

- säkerhet

- se

- semantisk

- senior

- känslig

- Känslighet

- separat

- tjänar

- eras

- serverar

- service

- Tjänster

- in

- inställning

- delas

- aktier

- hon

- Kort

- visa

- liknande

- Enkelt

- förenklar

- enda

- storlekar

- Small

- Fotboll

- Mjukvara

- lösning

- Lösningar

- några

- Källa

- källkod

- Utrymme

- specialiserad

- specifik

- specificerade

- Spendera

- stapel

- starta

- state-of-the-art

- bo

- Steg

- Steg

- Fortfarande

- lagra

- lagras

- okomplicerad

- struktur

- snygg

- sådana

- lämplig

- stödja

- Stöder

- säker

- system

- bord

- skräddarsydd

- Ta

- tar

- Målet

- riktade

- grupp

- lag

- tech

- Teknisk

- Tekniken

- Teknologi

- mall

- hyresgäst

- text

- Textklassificering

- än

- tack

- den där

- Smakämnen

- den information

- deras

- sedan

- Där.

- därför

- Dessa

- de

- tredje part

- detta

- tre

- Genom

- tid

- till

- tillsammans

- verktyg

- topp

- traditionell

- Tåg

- tränad

- Utbildning

- Förvandla

- transitering

- transparent

- Traveling

- rättegång

- handledning

- två

- Typ

- typer

- oss

- under

- förstå

- Oväntat

- oförglömlig

- unikt

- uppdaterad

- Uppdateringar

- uppdatering

- övervåningen

- URL

- Användning

- användning

- användningsfall

- Begagnade

- Användare

- användningar

- med hjälp av

- semester

- värde

- Värden

- olika

- Ve

- version

- via

- Virtuell

- volymer

- gå

- Sätt..

- sätt

- we

- Rikedom

- webb

- webbservice

- välkommen

- VÄL

- były

- när

- som

- medan

- VEM

- vars

- kommer

- med

- inom

- Arbete

- arbetsflöde

- arbetssätt

- fungerar

- skriva

- Om er

- Din

- zephyrnet