Bedrägerier på internet kan bli mycket farligare nu, tack vare att bedragare har obehindrad tillgång till ChatGPT, Techradar rapporter.

Den mycket populära AI-drivna chatboten, ChatGPT, skapar ständigt rubriker. Med sin förmåga att skriva allt från att felsöka iframe-kod till komplex datorprogrammeringskod har ChatGPT etablerat AI som årets tekniska modeord.

Trots sin enorma popularitet och engagemang har ChatGPT väckt oro kring etik och reglering.

Läs också: ChatGPT-användare 'Jailbreak' AI, Släpp loss Dan Alter Ego

En nyligen rapport publicerad av cybersäkerhetsforskare vid Norton Labs presenterade tre viktiga sätt som hotaktörer kan missbruka ChatGPT. Rapporten indikerade att ChatGPT kunde missbrukas för att göra internetbedrägerier på ett mer effektivt sätt: genom generering av djupt falskt innehåll, skapande av nätfiske och skapande av skadlig programvara.

"Norton Labs förväntar sig att bedragare också tittar på kapaciteten hos stora språkmodeller och testar sätt att förbättra sina cyberbrott för att göra dem mer realistiska och trovärdiga", heter det i rapporten.

Verktygets förmåga att producera "desinformation av hög kvalitet eller desinformation i stor skala" skulle kunna hjälpa botfarmer att intensifiera oenigheten mer effektivt. Detta kan göra det möjligt för illvilliga aktörer att utan ansträngning "injaga tvivel och manipulera berättelser på flera språk", enligt Norton.

Mycket övertygande "felinformation"

Att skriva affärsplaner, strategier och företagsbeskrivningar på ett övertygande sätt är en barnlek för ChatGPT. Men denna potential ökar också riskerna för desinformation, som kan förvandlas till en bluff.

"Innehållet som genereras av ChatGPT är inte bara oavsiktligt felaktigt, utan en dålig skådespelare kan också använda dessa verktyg för att avsiktligt skapa innehåll som används för att skada människor på något sätt", stod det i rapporten.

Dess förmåga att generera "desinformation av hög kvalitet eller desinformation i stor skala kan leda till misstro och forma berättelser på olika språk."

Att skriva recensioner av produkter har blivit allt lättare med ChatGPT, som inte kan spåras eftersom det genererar individuella svar med samma tillhandahållna information varje gång. Trots sin förmåga innebär det utmaningen att "upptäcka falska recensioner och fula produkter."

Oroväckande nog kan verktyget också användas för mobbning.

"Att använda dessa verktyg i trakasseringskampanjer på sociala medier för att tysta eller mobba människor är också ett möjligt resultat som skulle ha en nedslående effekt på talet", konstaterar rapporten.

ChatGPT i nätfiskekampanjer

ChatGPT är särskilt bra på att generera mänskligt klingande text på olika språk, med läsare som inte är klokare på om texten är producerad av AI eller människa. Inte ens OpenAI, utvecklaren av ChatGPT, kan identifiera om en text skrevs av AI, och säger att "det är omöjligt att på ett tillförlitligt sätt upptäcka all AI-skriven text."

Möjligheterna att ChatGPT används i nätfiskekampanjer är verkliga.

Skadliga aktörer kan använda ChatGPT för att skapa nätfiske-e-postmeddelanden eller inlägg på sociala medier som verkar komma från legitima källor, vilket gör det svårare att upptäcka och försvara sig mot dessa typer av hot, heter det i rapporten.

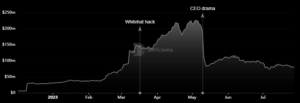

När dess popularitet ökar är en trolig följd en ökning av antalet "nätfiskekampanjer och deras sofistikerade".

Rapporten föreslog att "skadliga aktörer kan mata ChatGPT med verkliga exempel på icke-skadliga meddelanden från de företag som de vill utge sig för och beordra AI att skapa nya baserat på samma stil med skadlig avsikt."

Sådana kampanjer kan visa sig vara mycket framgångsrika för att lura individer att avslöja personlig information eller skicka pengar till kriminella enheter. Norton Labs rådde konsumenter att vara försiktiga när de "klickar på länkar eller tillhandahåller personlig information."

ChatGPT kan skapa skadlig programvara

Att generera kod och anpassa olika programmeringsspråk är helt enkelt en del av ChatGPTs tjänster. Så det är inte konstigt att bedragare använder det för att generera skadlig programvara.

"Med rätt uppmaning kan nybörjare som författare av skadlig programvara beskriva vad de vill göra och få fungerande kodavsnitt", enligt rapporten. Detta utgör ett allvarligt hot om skadliga attacker som är tillräckligt avancerade för att orsaka förödelse.

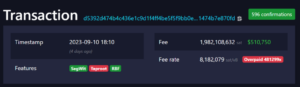

"Ett exempel är att generera kod för att upptäcka när en bitcoin-plånboksadress kopieras till urklippet så att den kan ersättas med en skadlig adress som kontrolleras av skadlig programvara", förklarade rapporten.

Som ett resultat kommer tillgängligheten av en sådan chatbot att orsaka en ökning av sofistikeringen av skadlig programvara.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Källa: https://metanews.com/chatgpt-is-being-used-to-make-quality-scams/

- :är

- 7

- 8

- a

- förmåga

- Able

- Om Oss

- missbruk

- tillgång

- Enligt

- aktörer

- adress

- avancerat

- mot

- AI

- AI-powered

- Stöd

- Alla

- och

- förutse

- visas

- ÄR

- AS

- At

- Attacker

- Författaren

- Författarna

- tillgänglighet

- Badrum

- baserat

- BE

- därför att

- blir

- Där vi får lov att vara utan att konstant prestera,

- Bitcoin

- Bitcoin plånbok

- Bot

- mobbning

- företag

- by

- Kampanjer

- KAN

- kan inte

- kapacitet

- Kapacitet

- Orsak

- försiktig

- utmanar

- chatbot

- ChatGPT

- koda

- Företag

- företag

- komplex

- dator

- oro

- konsumenter

- innehåll

- Innehållsgenerering

- kontinuerligt

- kontrolleras

- kunde

- farkoster

- skapa

- skapande

- Kriminell

- Cybersäkerhet

- Dangerous

- beskriva

- Utvecklare

- olika

- svårt

- Avslöjar

- oenighet

- desinformation

- tvivlar

- varje

- effekt

- Effektiv

- effektivt

- e

- möjliggöra

- ingrepp

- enheter

- etablerade

- etik

- Även

- allt

- exempel

- exempel

- förklarade

- fejka

- gårdar

- För

- bedragare

- från

- generera

- genereras

- genererar

- generera

- generering

- skaffa sig

- god

- Har

- har

- Rubriker

- höggradigt

- Men

- HTTPS

- stor

- humant

- identifiera

- omöjligt

- in

- Öka

- Ökar

- alltmer

- indikerade

- individuellt

- individer

- informationen

- uppsåt

- avsiktligt

- Internet

- IT

- DESS

- Nyckel

- Labs

- språk

- Språk

- Large

- leda

- livet

- länkar

- liten

- Lot

- göra

- Framställning

- malware

- max-bredd

- Media

- meddelanden

- kanske

- desinformation

- misstro

- modeller

- pengar

- mer

- multipel

- berättelser

- Nya

- Anmärkningar

- nybörjare

- antal

- of

- on

- ONE

- OpenAI

- beställa

- Resultat

- del

- särskilt

- Personer

- personlig

- Nätfiske

- planer

- plato

- Platon Data Intelligence

- PlatonData

- Spela

- Spela för

- Populära

- popularitet

- utgör

- möjlig

- inlägg

- potentiell

- producera

- producerad

- Produkter

- Programmering

- programmeringsspråk

- utsikter

- Bevisa

- förutsatt

- tillhandahålla

- publicerade

- Läsa

- läsare

- verklig

- verkliga livet

- realistisk

- senaste

- reglering

- ersättas

- rapport

- forskare

- resultera

- Omdömen

- risker

- Samma

- Skala

- Lurendrejeri

- Bedragare

- bedrägerier

- skicka

- allvarlig

- Tjänster

- Forma

- Tystnad

- helt enkelt

- So

- Social hållbarhet

- sociala medier

- Sociala medier inlägg

- några

- Källor

- tal

- trots

- anges

- strategier

- stil

- framgångsrik

- sådana

- tech

- Testning

- Tack

- den där

- Smakämnen

- deras

- Dem

- Dessa

- hot

- hotaktörer

- hot

- tre

- Genom

- tid

- till

- verktyg

- verktyg

- SVÄNG

- typer

- frigöra

- användning

- användare

- plånbok

- Sätt..

- sätt

- Vad

- om

- som

- brett

- kommer

- med

- arbetssätt

- skulle

- skriva

- skriven

- zephyrnet