Idag är vi glada att kunna meddela att Falcon 180B-grundmodellen utvecklad av Technology Innovation Institute (TII) och utbildad på Amazon SageMaker är tillgänglig för kunder via Amazon SageMaker JumpStart att distribuera med ett klick för att köra slutledning. Med en storlek på 180 miljarder parametrar och tränad på en massiv datauppsättning på 3.5 biljoner token, är Falcon 180B den största och en av de mest presterande modellerna med öppet tillgängliga vikter. Du kan prova den här modellen med SageMaker JumpStart, ett nav för maskininlärning (ML) som ger tillgång till algoritmer, modeller och ML-lösningar så att du snabbt kan komma igång med ML. I det här inlägget går vi igenom hur du upptäcker och distribuerar Falcon 180B-modellen via SageMaker JumpStart.

Vad är Falcon 180B

Falcon 180B är en modell släppt av JAG DET som följer tidigare släpp i Falcon-familjen. Det är en uppskalad version av Falcon 40B, och den använder multi-query uppmärksamhet för bättre skalbarhet. Det är en autoregressiv språkmodell som använder en optimerad transformatorarkitektur. Den tränades på 3.5 biljoner tokens data, främst bestående av webbdata från RefinedWeb (cirka 85%). Modellen har två versioner: 180B och 180B-Chat. 180B är en rå, förtränad modell, som bör finjusteras ytterligare för de flesta användningsfall. 180B-Chat är bättre lämpad för att ta allmänna instruktioner. Chattmodellen har finjusterats på chatt- och instruktionersdatauppsättningar tillsammans med flera storskaliga konversationsdatauppsättningar.

Modellen görs tillgänglig under Falcon-180B TII-licens och Policy för godkänd användning.

Falcon 180B tränades av TII på Amazon SageMaker, på ett kluster med cirka 4K A100 GPU:er. Den använde en anpassad distribuerad träningskodbas vid namn Gigatron, som använder 3D-parallellism med ZeRO, och anpassade, högpresterande Triton-kärnor. Den distribuerade träningsarkitekturen som används Amazon enkel lagringstjänst (Amazon S3) som den enda enhetliga tjänsten för dataladdning och skrivning och läsning av kontrollpunkter, vilket särskilt bidrog till arbetsbelastningens tillförlitlighet och operativa enkelhet.

Vad är SageMaker JumpStart

Med SageMaker JumpStart kan ML-utövare välja från en växande lista med bäst presterande foundationmodeller. ML-utövare kan distribuera grundmodeller till dedikerade SageMaker-instanser i en nätverksisolerad miljö och anpassa modeller med Amazon SageMaker för modellträning och implementering.

Du kan nu upptäcka och distribuera Falcon 180B med några få klick in Amazon SageMaker Studio eller programmatiskt genom SageMaker Python SDK, vilket gör att du kan härleda modellprestanda och MLOps-kontroller med SageMaker-funktioner som t.ex. Amazon SageMaker-rörledningar, Amazon SageMaker Debugger, eller behållarloggar. Modellen distribueras i en AWS säker miljö och under dina VPC-kontroller, vilket hjälper till att säkerställa datasäkerhet. Falcon 180B är upptäckbar och kan distribueras i regioner där de nödvändiga instanserna är tillgängliga. För närvarande finns ml.p4de-instanser tillgängliga i USA East (N. Virginia) och US West (Oregon).

Upptäck modeller

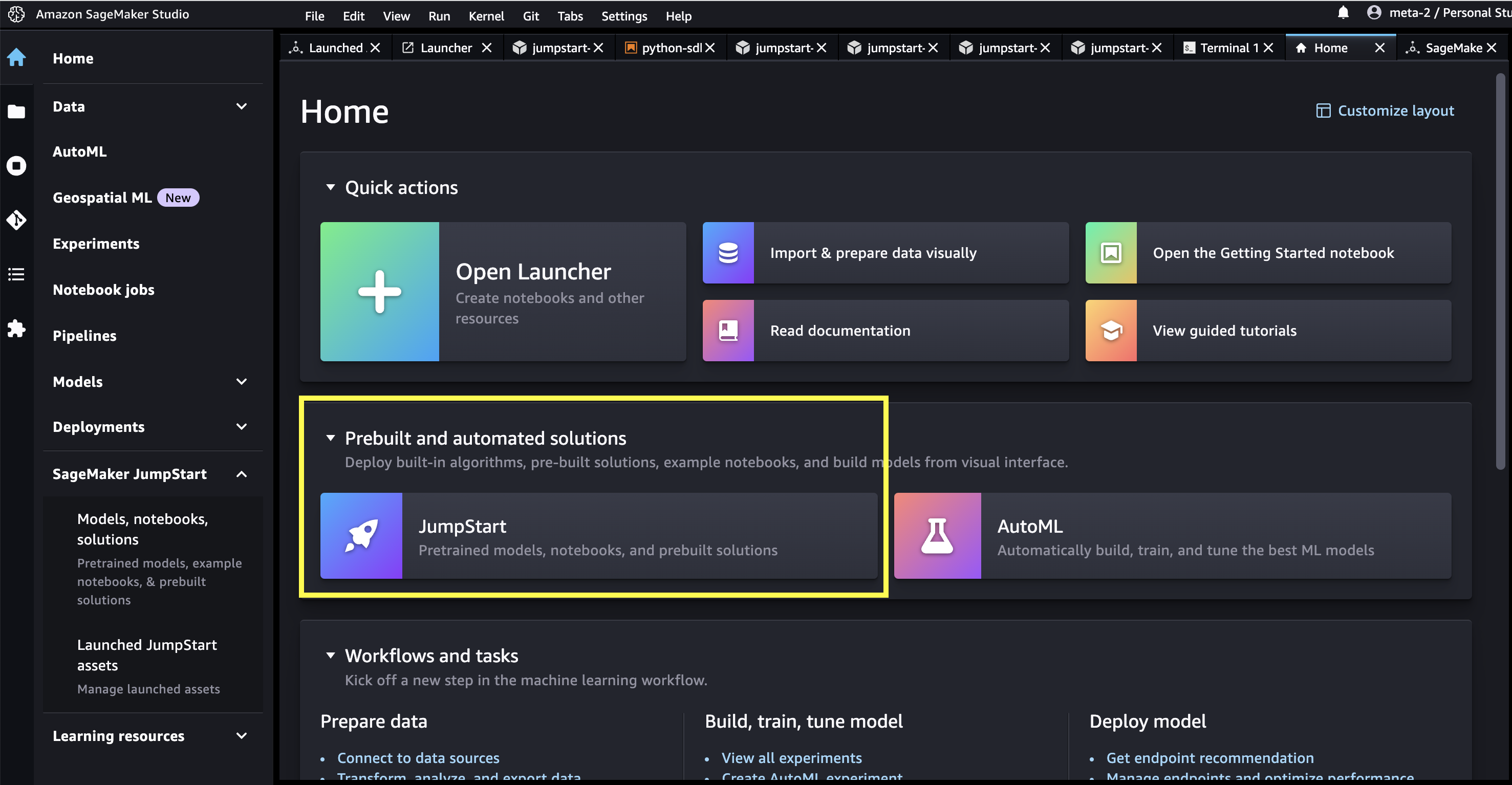

Du kan komma åt grundmodellerna genom SageMaker JumpStart i SageMaker Studio UI och SageMaker Python SDK. I det här avsnittet går vi igenom hur du upptäcker modellerna i SageMaker Studio.

SageMaker Studio är en integrerad utvecklingsmiljö (IDE) som tillhandahåller ett enda webbaserat visuellt gränssnitt där du kan komma åt specialbyggda verktyg för att utföra alla ML-utvecklingssteg, från att förbereda data till att bygga, träna och distribuera dina ML-modeller. För mer information om hur du kommer igång och konfigurerar SageMaker Studio, se Amazon SageMaker Studio.

I SageMaker Studio kan du komma åt SageMaker JumpStart, som innehåller förutbildade modeller, bärbara datorer och förbyggda lösningar, under Förbyggda och automatiserade lösningar.

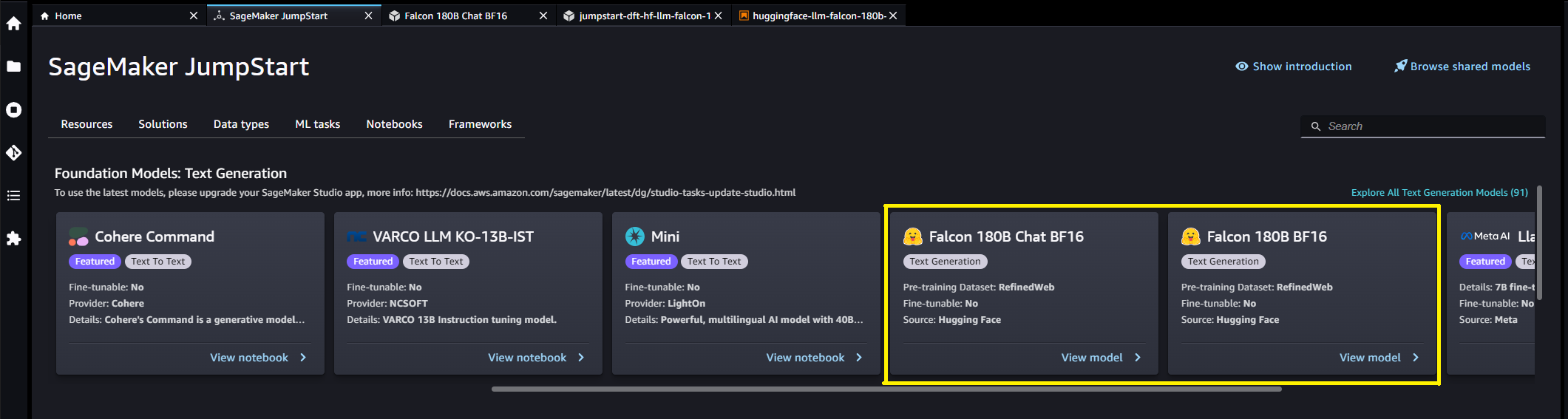

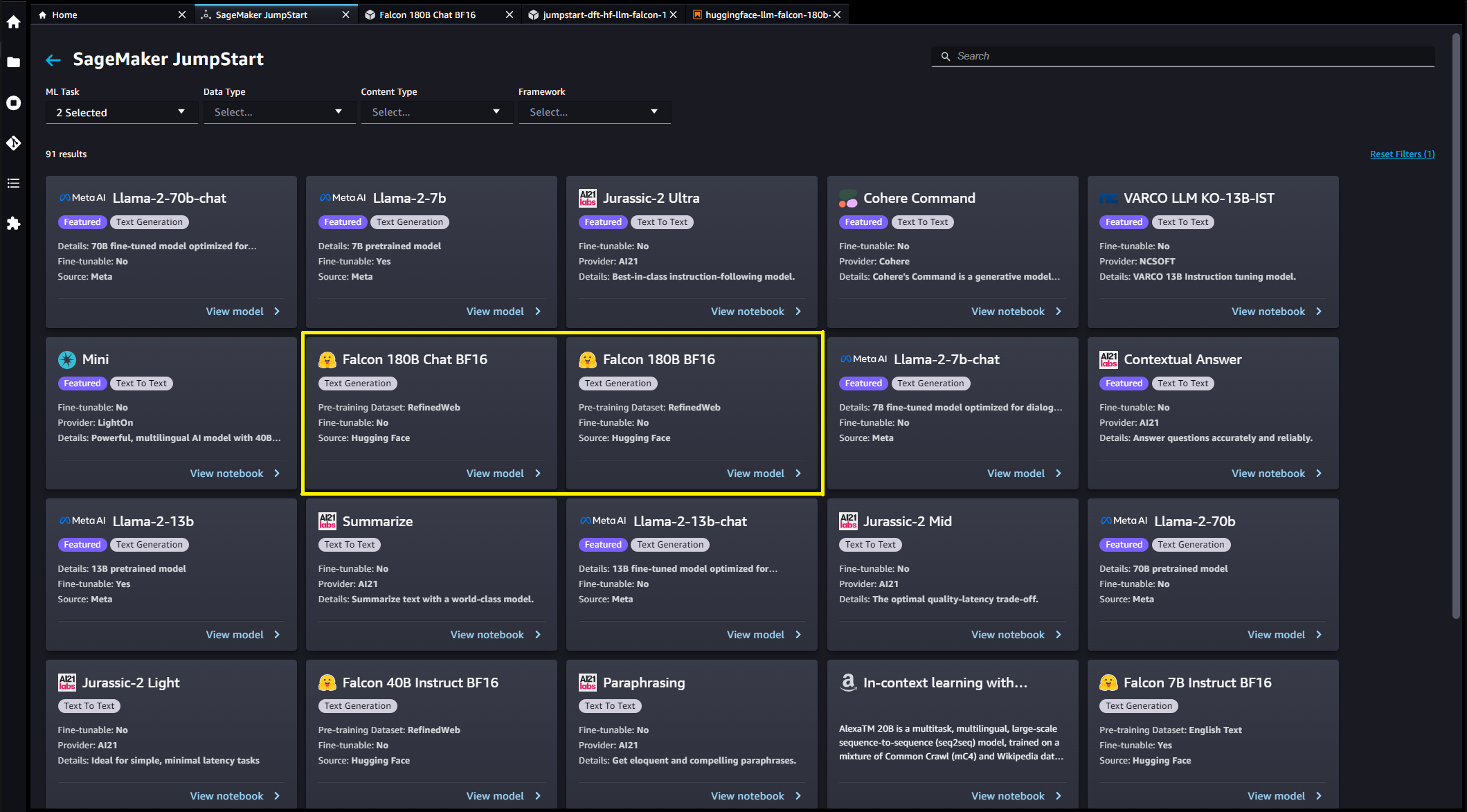

Från SageMaker JumpStart-målsidan kan du söka efter lösningar, modeller, bärbara datorer och andra resurser. Du kan hitta Falcon 180B i Grundmodeller: Textgenerering karusell

Du kan även hitta andra modellvarianter genom att välja Utforska alla textgenereringsmodeller eller söker efter Falcon.

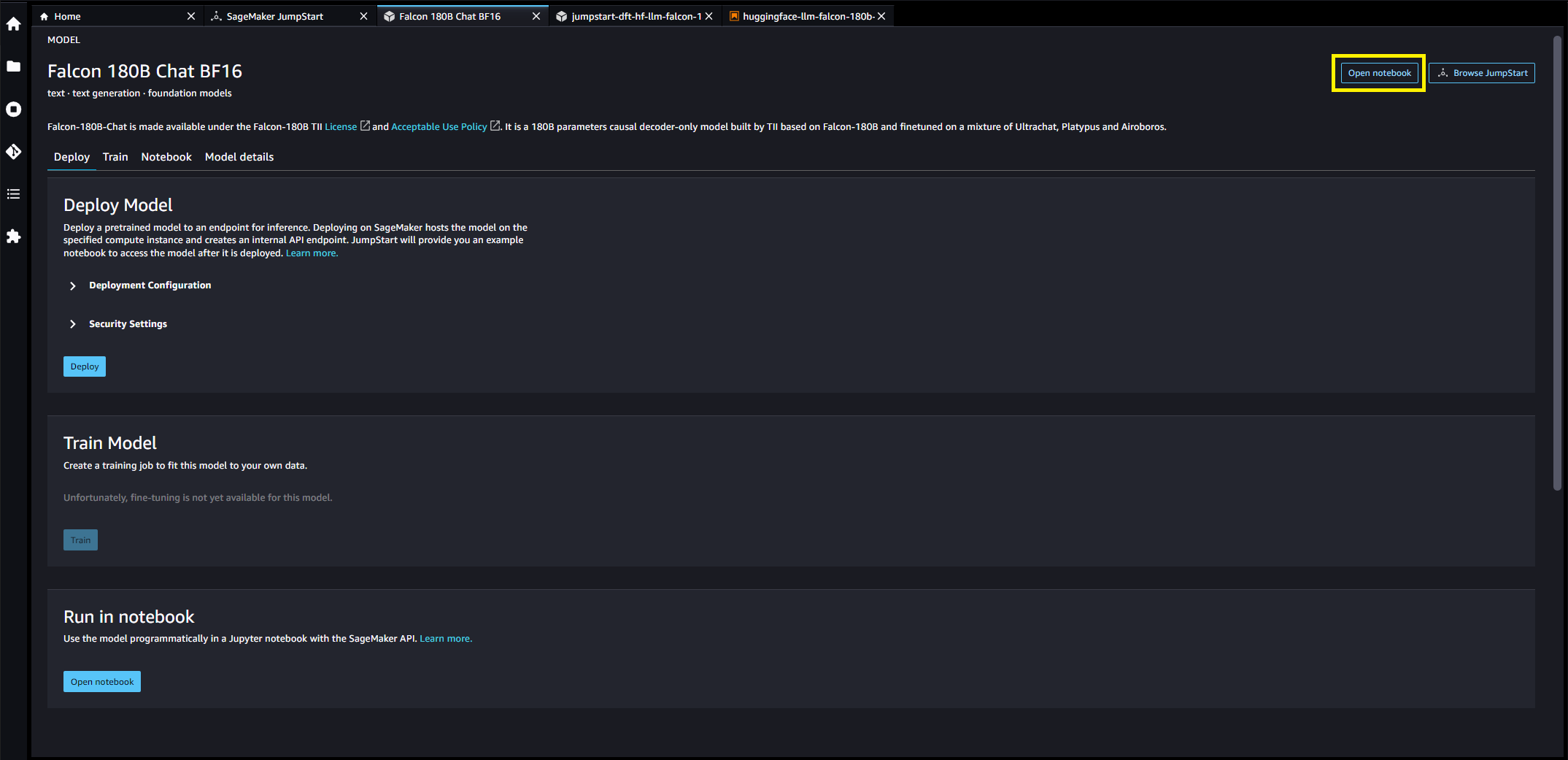

Du kan välja modellkortet för att se detaljer om modellen såsom licens, data som används för att träna och hur du använder den. Du hittar också två knappar, Distribuera och Öppna Notebook, som hjälper dig att använda modellen (följande skärmdump visar Distribuera alternativ).

Distribuera modeller

När du väljer Distribuera, startar modellimplementeringen. Alternativt kan du distribuera via exempelanteckningsboken som dyker upp genom att välja Öppna Notebook. Exemplet på anteckningsboken ger vägledning från början till slut om hur man distribuerar modellen för slutledning och städar upp resurser.

För att distribuera med en bärbar dator börjar vi med att välja en lämplig modell, specificerad av model_id. Du kan distribuera vilken som helst av de valda modellerna på SageMaker med följande kod:

Detta distribuerar modellen på SageMaker med standardkonfigurationer, inklusive standardinstanstypen och standard VPC-konfigurationer. Du kan ändra dessa konfigurationer genom att ange icke-standardvärden i JumpStartModel. För att lära dig mer, se API dokumentation. Efter att den har distribuerats kan du köra slutledning mot den distribuerade slutpunkten genom en SageMaker-prediktor. Se följande kod:

Inferensparametrar styr textgenereringsprocessen vid slutpunkten. Kontrollen för max nya tokens hänvisar till storleken på utdata som genereras av modellen. Observera att detta inte är detsamma som antalet ord eftersom modellens ordförråd inte är detsamma som det engelska ordförrådet och varje token kanske inte är ett engelskspråkigt ord. Temperaturen styr slumpmässigheten i utgången. Högre temperatur resulterar i mer kreativa och hallucinerade utgångar. Alla inferensparametrar är valfria.

Den här 180B-parametermodellen är på 335 GB och kräver ännu mer GPU-minne för att utföra inferens i 16-bitars precision. För närvarande stöder JumpStart endast denna modell på ml.p4de.24xlarge-instanser. Det är möjligt att distribuera en 8-bitars kvantiserad modell på en ml.p4d.24xlarge-instans genom att tillhandahålla env={"HF_MODEL_QUANTIZE": "bitsandbytes"} sökordsargument till JumpStartModel konstruktör och specificering instance_type="ml.p4d.24xlarge" till distributionsmetoden. Observera dock att latensen per token är ungefär 5 gånger långsammare för denna kvantiserade konfiguration.

Följande tabell listar alla Falcon-modeller som är tillgängliga i SageMaker JumpStart tillsammans med modell-ID:n, standardinstanstyper, maximalt antal totala tokens (summan av antalet inmatade tokens och antalet genererade tokens) som stöds och den typiska svarslatensen per token för var och en av dessa modeller.

| Modellnamn | Modell-ID | Standardinstanstyp | Max totalt antal tokens | Latens per token* |

| Falcon 7B | huggingface-llm-falcon-7b-bf16 |

ml.g5.2xlarge | 2048 | 34 ms |

| Falcon 7B Instruktion | huggingface-llm-falcon-7b-instruct-bf16 |

ml.g5.2xlarge | 2048 | 34 ms |

| Falcon 40B | huggingface-llm-falcon-40b-bf16 |

ml.g5.12xlarge | 2048 | 57 ms |

| Falcon 40B Instruktion | huggingface-llm-falcon-40b-instruct-bf16 |

ml.g5.12xlarge | 2048 | 57 ms |

| Falcon 180B | huggingface-llm-falcon-180b-bf16 |

ml.p4de.24xlarge | 2048 | 45 ms |

| Falcon 180B Chat | huggingface-llm-falcon-180b-chat-bf16 |

ml.p4de.24xlarge | 2048 | 45 ms |

*Latens per token tillhandahålls för mediansvarstiden för exemplets prompter i den här bloggen; detta värde kommer att variera beroende på längden på ingångs- och utmatningssekvenser.

Inferens- och exempeluppmaningar för Falcon 180B

Falcon-modeller kan användas för textkomplettering för vilken text som helst. Genom textgenerering kan du utföra en mängd olika uppgifter, som att svara på frågor, språköversättning, sentimentanalys och många fler. Slutpunkten accepterar följande nyttolastschema:

Du kan utforska definitionen av dessa klientparametrar och deras standardvärden inom text-generation-inference-förrådet.

Följande är några exempel på uppmaningar och texten som genereras av modellen. Alla utgångar här genereras med inferensparametrar {"max_new_tokens": 768, "stop": ["<|endoftext|>", "###"]}.

Att bygga en webbplats kan göras i 10 enkla steg:

Du kanske märker att den här förtränade modellen genererar långa textsekvenser som inte nödvändigtvis är idealiska för dialoger. Innan vi visar hur den finjusterade chattmodellen presterar för en större uppsättning dialogbaserade uppmaningar, illustrerar de följande två exemplen hur man använder Falcon-modeller med få-shot inlärning i sammanhanget, där vi tillhandahåller träningsexempel som är tillgängliga för modellen. Observera att "få-shot-inlärning" inte justerar modellvikter - vi gör bara slutsatser om den utplacerade modellen under den här processen samtidigt som vi tillhandahåller några exempel inom inmatningskontexten för att hjälpa guild modellutdata.

Slutlednings- och exempeluppmaningar för Falcon 180B-Chat

Med Falcon 180B-Chat-modeller, optimerade för dialoganvändningsfall, kan input till chattmodellens slutpunkter innehålla tidigare historik mellan chattassistenten och användaren. Du kan ställa frågor kontextuella till konversationen som har hänt hittills. Du kan också tillhandahålla systemkonfigurationen, såsom personas, som definierar chattassistentens beteende. Inmatad nyttolast till ändpunkten är densamma som Falcon 180B-modellen förutom inputs strängvärde ska använda följande format:

Följande är några exempel på uppmaningar och texten som genereras av modellen. Alla utgångar genereras med inferensparametrar {"max_new_tokens":256, "stop": ["nUser:", "<|endoftext|>", " User:", "###"]}.

I följande exempel har användaren haft ett samtal med assistenten om turistplatser i Paris. Därefter frågar användaren om det första alternativet som rekommenderas av chattassistenten.

Städa upp

När du är klar med att köra anteckningsboken, se till att ta bort alla resurser som du skapade under processen så att din fakturering stoppas. Använd följande kod:

Slutsats

I det här inlägget visade vi dig hur du kommer igång med Falcon 180B i SageMaker Studio och distribuerar modellen för slutledning. Eftersom grundmodeller är förutbildade kan de hjälpa till att sänka utbildnings- och infrastrukturkostnaderna och möjliggöra anpassning för ditt användningsfall. Besök SageMaker JumpStart i SageMaker Studio nu för att komma igång.

Resurser

Om författarna

Dr Kyle Ulrich är en tillämpad forskare med Amazon SageMaker JumpStart-teamet. Hans forskningsintressen inkluderar skalbara maskininlärningsalgoritmer, datorseende, tidsserier, Bayesianska icke-parametriska och Gaussiska processer. Hans doktorsexamen är från Duke University och han har publicerat artiklar i NeurIPS, Cell och Neuron.

Dr Kyle Ulrich är en tillämpad forskare med Amazon SageMaker JumpStart-teamet. Hans forskningsintressen inkluderar skalbara maskininlärningsalgoritmer, datorseende, tidsserier, Bayesianska icke-parametriska och Gaussiska processer. Hans doktorsexamen är från Duke University och han har publicerat artiklar i NeurIPS, Cell och Neuron.

Dr Ashish Khetan är en Senior Applied Scientist med Amazon SageMaker JumpStart och hjälper till att utveckla maskininlärningsalgoritmer. Han tog sin doktorsexamen från University of Illinois Urbana-Champaign. Han är en aktiv forskare inom maskininlärning och statistisk slutledning och har publicerat många artiklar i NeurIPS, ICML, ICLR, JMLR, ACL och EMNLP-konferenser.

Dr Ashish Khetan är en Senior Applied Scientist med Amazon SageMaker JumpStart och hjälper till att utveckla maskininlärningsalgoritmer. Han tog sin doktorsexamen från University of Illinois Urbana-Champaign. Han är en aktiv forskare inom maskininlärning och statistisk slutledning och har publicerat många artiklar i NeurIPS, ICML, ICLR, JMLR, ACL och EMNLP-konferenser.

Olivier Cruchant är en huvudsaklig maskininlärningsspecialistlösningsarkitekt på AWS, baserad i Frankrike. Olivier hjälper AWS-kunder – från små startups till stora företag – att utveckla och distribuera maskininlärningsapplikationer i produktionsklass. På fritiden tycker han om att läsa forskningsrapporter och utforska vildmarken med vänner och familj.

Olivier Cruchant är en huvudsaklig maskininlärningsspecialistlösningsarkitekt på AWS, baserad i Frankrike. Olivier hjälper AWS-kunder – från små startups till stora företag – att utveckla och distribuera maskininlärningsapplikationer i produktionsklass. På fritiden tycker han om att läsa forskningsrapporter och utforska vildmarken med vänner och familj.

Karl Albertsen leder Amazon SageMakers grundmodellnav, algoritmer och partnerskapsteam.

Karl Albertsen leder Amazon SageMakers grundmodellnav, algoritmer och partnerskapsteam.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Fordon / elbilar, Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- ChartPrime. Höj ditt handelsspel med ChartPrime. Tillgång här.

- BlockOffsets. Modernisera miljökompensation ägande. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/falcon-180b-foundation-model-from-tii-is-now-available-via-amazon-sagemaker-jumpstart/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 150

- 20

- 25

- 26%

- 3d

- 4k

- 7

- 8

- 9

- a

- Om oss

- accepterar

- tillgång

- tillgänglig

- Uppnå

- aktiv

- lägga till

- Dessutom

- adress

- Efter

- mot

- algoritmer

- Alla

- tillåter

- längs

- också

- alltid

- am

- amason

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analys

- och

- och infrastruktur

- Meddela

- Annan

- svara

- vilken som helst

- någon

- lockande

- tillämpningar

- tillämpas

- lämpligt

- cirka

- arkitektur

- ÄR

- Argumentet

- Konst

- Artikeln

- AS

- be

- Assistent

- At

- uppmärksamhet

- attrahera

- attraktion

- Automatiserad

- tillgänglig

- vägar

- AWS

- baserat

- batteri

- Bayesian

- BE

- vackert

- därför att

- varit

- innan

- beteende

- Bättre

- mellan

- fakturering

- Blogg

- ståtar

- webbläsare

- byggare

- byggare

- Byggnad

- företag

- men

- by

- kaféer

- KAN

- kapacitet

- kortet

- Karusellen

- Vid

- fall

- byta

- ta

- Välja

- välja

- valda

- Stad

- klassificera

- kluster

- cms

- koda

- Kodbas

- samling

- Kolonner

- COM

- kombinerad

- Gemensam

- företag

- fullborda

- fullbordan

- dator

- Datorsyn

- konferenser

- konfiguration

- Bestående

- kontakta

- innehålla

- Behållare

- innehåller

- innehåll

- sammanhang

- kontextuella

- kontinuerligt

- bidrog

- kontroll

- kontroller

- Konversation

- konversera

- Kostar

- skapa

- skapas

- Skapa

- Kreativ

- Cup

- Aktuella

- För närvarande

- beställnings

- kund

- Helpdesk

- Kunder

- anpassning

- skräddarsy

- datum

- datasäkerhet

- datauppsättningar

- dag

- Beslutet

- dedicerad

- Standard

- definiera

- definition

- demonstrera

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- vecklas ut

- Designa

- destination

- detaljer

- Bestämma

- utveckla

- utvecklade

- Utveckling

- dialogruta

- dialog

- olika

- Upptäck

- distribueras

- distribuerad utbildning

- do

- gör

- domän

- Domain Name

- DOMÄNNAMN

- gjort

- drömmar

- Duke

- hertig universitet

- under

- varje

- lätta

- lätt

- öster

- lätt

- möjliggöra

- möjliggör

- början till slut

- Slutpunkt

- energi

- Teknik

- Engelska

- säkerställa

- företag

- Miljö

- speciellt

- Även

- exempel

- exempel

- Utom

- exciterade

- expertis

- utforska

- Utforska

- uttryckt

- förlängning

- förlängningar

- omfattande

- familj

- kända

- långt

- fascinerande

- Funktioner

- få

- hitta

- Förnamn

- Flyta

- efter

- följer

- För

- format

- Tidigare

- fundament

- fyra

- RAM

- Frankrike

- franska

- vänner

- från

- funktion

- ytterligare

- Gardens

- Save

- generera

- genereras

- genererar

- generering

- skaffa sig

- glas

- Go

- Målet

- Mål

- kommer

- god

- fick

- GPU

- GPUs

- stor

- Odling

- vägleda

- skrå

- hade

- hänt

- hatar

- Har

- har

- he

- Hjärta

- hjälpa

- hjälp

- hjälpa

- hjälper

- här.

- dold

- dold juvel

- högpresterande

- högre

- hans

- historia

- Hem

- värd

- värd

- Hur ser din drömresa ut

- How To

- Men

- html

- HTTPS

- Nav

- i

- ikoniska

- ID

- idealisk

- ids

- if

- Illinois

- bild

- bilder

- importera

- imponerande

- in

- innefattar

- Inklusive

- otroligt

- informationen

- Infrastruktur

- Innovation

- ingång

- ingångar

- exempel

- Institute

- instruktioner

- integrerade

- intresserad

- intressen

- Gränssnitt

- in

- isolerat

- IT

- DESS

- jpg

- känd

- kyle

- landning

- språk

- Large

- Stora företag

- storskalig

- större

- största

- Latens

- senaste

- lansera

- Lagar

- Layout

- Leads

- LÄRA SIG

- inlärning

- Längd

- Licens

- ljus

- fodrad

- LINK

- länkar

- Lista

- listor

- läser in

- Lång

- lägre

- luxemburg

- Maskinen

- maskininlärning

- gjord

- göra

- Framställning

- ledning

- förvaltar

- många

- förundras

- Massa

- massiv

- max

- maximal

- Maj..

- betyder

- betyder

- Media

- medeltida

- Minne

- meddelande

- metod

- kanske

- Blandning

- blandning

- ML

- MLOps

- modell

- modeller

- mer

- mest

- rörelse

- museum

- Musik

- my

- namn

- Som heter

- namn

- Navigera

- Navigering

- nödvändigtvis

- Behöver

- negativ

- netto

- nät

- Neutral

- Nya

- Nästa

- natt

- Nej

- anteckningsbok

- Lägga märke till..

- nu

- antal

- observatörer

- of

- Erbjudanden

- Olja

- Oliv

- on

- gång

- ONE

- endast

- öppet

- operativa

- optimerad

- Alternativet

- Tillbehör

- or

- Oregon

- Övriga

- ut

- skisse

- produktion

- över

- sida

- sidor

- Palats

- papper

- parameter

- parametrar

- paris

- Park

- särskilt

- partnerskap

- betalning

- betalningsmetod

- Personer

- för

- perfekt

- Utföra

- prestanda

- utför

- phd

- telefon

- Fysik

- bit

- Planen

- plato

- Platon Data Intelligence

- PlatonData

- snälla du

- positiv

- möjlig

- Inlägg

- inlägg

- Precision

- Predictor

- förbereda

- presentera

- föregående

- primärt

- Principal

- problem

- process

- processer

- Produkt

- främja

- ordentligt

- ge

- förutsatt

- leverantör

- ger

- tillhandahålla

- publicerade

- Syftet

- sätta

- Python

- frågor

- snabbt

- slumpmässighet

- Raw

- Läsning

- Receptet

- rekommenderas

- hänvisa

- hänvisar

- Oavsett

- regioner

- registrera

- registrera

- registrar

- Registrering

- relativ

- relativitet

- frigörs

- meddelanden

- relevanta

- tillförlitlighet

- pålitlig

- ihåg

- Repository

- representerar

- Kräver

- erforderlig

- forskning

- forskaren

- Resurser

- respons

- Resultat

- Rik

- Rider

- royalty

- Körning

- rinnande

- s

- sagemaker

- salt

- Samma

- skalbarhet

- skalbar

- Skala

- Forskare

- sDK

- HAV

- Sök

- söka

- Säsong

- Andra

- §

- säkra

- säkerhet

- se

- frö

- vald

- väljer

- senior

- känsla

- Serier

- service

- Tjänster

- in

- inställningar

- flera

- Dela

- affärer

- Kort

- skall

- show

- visade

- Visar

- signera

- Enkelt

- enkelhet

- helt enkelt

- enda

- Områden

- Storlek

- Långsamt

- Small

- So

- än så länge

- Social hållbarhet

- sociala medier

- Sociala medier inlägg

- Lösningar

- några

- något

- Källa

- Utrymme

- specialist

- specificerade

- fart

- starta

- igång

- Startups

- Stater

- stationen

- statistisk

- Steg

- Sluta

- slutade

- förvaring

- lagra

- gata

- Sträng

- studio

- Bedövning

- sådana

- stödja

- Som stöds

- Stöder

- säker

- Symbolen

- system

- bord

- Ta

- tar

- uppgifter

- smak

- grupp

- lag

- Teknologi

- Teknisk innovation

- mall

- testa

- text

- den där

- Smakämnen

- världen

- deras

- Dem

- tema

- sedan

- Teorin

- Där.

- Dessa

- de

- Tredje

- detta

- Genom

- tid

- Tidsföljder

- till

- tillsammans

- token

- tokens

- verktyg

- verktyg

- Totalt

- Torn

- Tåg

- tränad

- Utbildning

- transformator

- Översätt

- Översättning

- Biljon

- tur

- Triton

- prova

- tweet

- två

- Typ

- typer

- typisk

- ui

- under

- enhetlig

- unika

- universitet

- tills

- uppladdning

- us

- användning

- användningsfall

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- Vakuum

- värde

- Värden

- mängd

- olika

- version

- versioner

- via

- Vibe

- Video

- Video

- utsikt

- visningar

- Virginia

- syn

- Besök

- besökare

- visuellt

- gå

- vill

- var

- vattenmärke

- we

- webb

- webbservice

- Webb-baserad

- Webbplats

- vecka

- veckor

- VÄL

- väster

- Vad

- Vad är

- när

- som

- medan

- kommer

- fönster

- med

- inom

- utan

- ord

- ord

- världen

- skrivning

- ja

- Om er

- Din

- zephyrnet

- noll-