Det här inlägget är skrivet tillsammans med Kostia Kofman och Jenny Tokar från Booking.com.

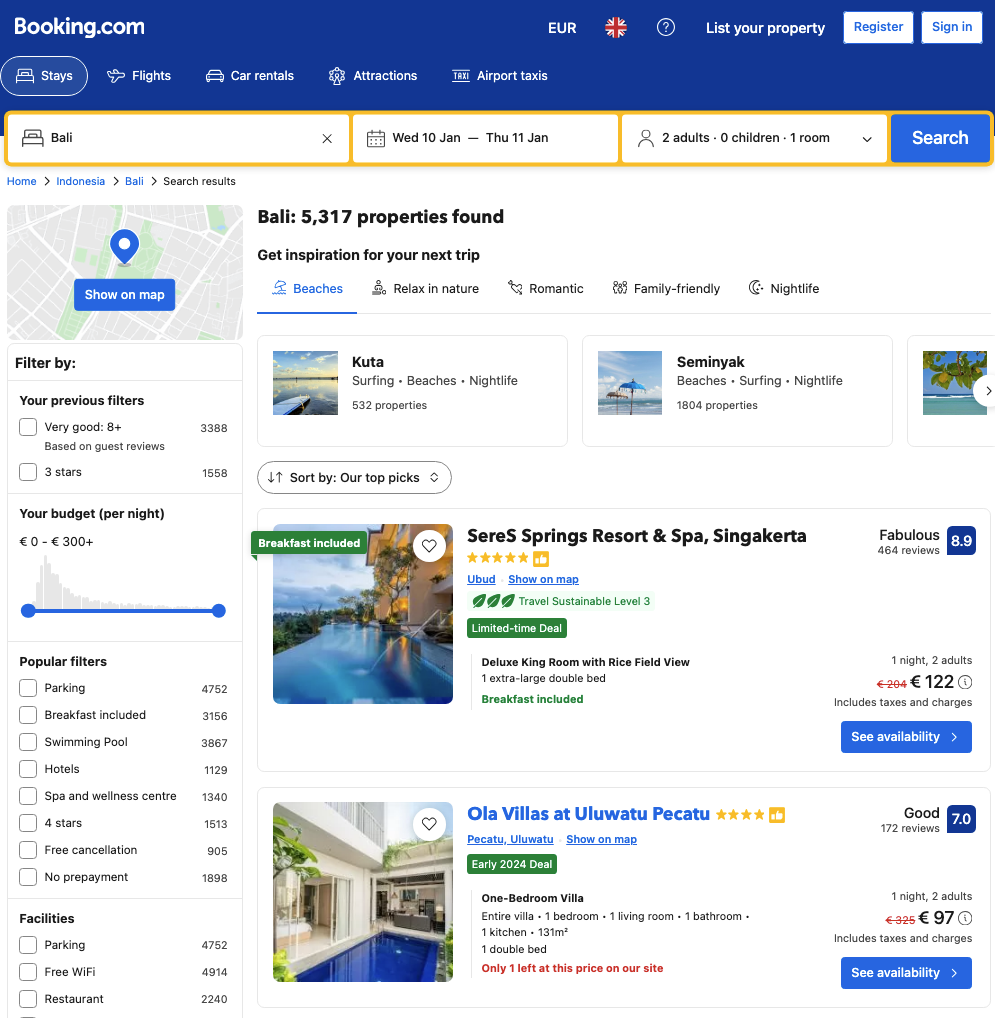

Som en global ledare inom onlineresebranschen, Booking.com söker alltid innovativa sätt att förbättra sina tjänster och ge kunderna skräddarsydda och sömlösa upplevelser. Rankingteamet på Booking.com spelar en avgörande roll för att se till att sök- och rekommendationsalgoritmerna är optimerade för att leverera de bästa resultaten för sina användare.

Genom att dela interna resurser med andra interna team, mötte Ranking team machine learning (ML)-forskare ofta på långa väntetider för att få tillgång till resurser för modellträning och experiment – vilket utmanade deras förmåga att snabbt experimentera och förnya sig. Ranking-teamet insåg behovet av en moderniserad ML-infrastruktur och gav sig ut på en resa för att använda kraften i Amazon SageMaker att bygga, träna och distribuera ML-modeller i stor skala.

Booking.com samarbetade med AWS professionella tjänster att bygga en lösning för att påskynda tiden till marknaden för förbättrade ML-modeller genom följande förbättringar:

- Minskade väntetider för resurser för träning och experiment

- Integrering av väsentliga ML-funktioner som justering av hyperparameter

- En minskad utvecklingscykel för ML-modeller

Minskade väntetider skulle innebära att teamet snabbt kunde iterera och experimentera med modeller och få insikter i mycket snabbare takt. Att använda SageMaker on-demand tillgängliga instanser möjliggjorde en tiofaldig minskning av väntetiden. Viktiga ML-funktioner som justering av hyperparameter och modellförklaring saknades i lokalerna. Teamets moderniseringsresa introducerade dessa funktioner genom Amazon SageMaker Automatisk modellinställning och Amazon SageMaker Clarify. Slutligen var teamets strävan att få omedelbar feedback på varje ändring som görs i koden, minska återkopplingsslingan från minuter till ett ögonblick och därigenom minska utvecklingscykeln för ML-modeller.

I det här inlägget fördjupar vi oss i den resa som gjorts av Ranking-teamet på Booking.com när de utnyttjade SageMakers möjligheter för att modernisera sitt ML-experimentramverk. Genom att göra det övervann de inte bara sina befintliga utmaningar, utan förbättrade också sin sökupplevelse, vilket i slutändan gynnade miljontals resenärer över hela världen.

Tillvägagångssätt för modernisering

Ranking-teamet består av flera ML-forskare som var och en behöver utveckla och testa sin egen modell offline. När en modell bedöms vara framgångsrik enligt offline-utvärderingen kan den flyttas till produktions A/B-testning. Om den visar onlineförbättringar kan den distribueras till alla användare.

Målet med detta projekt var att skapa en användarvänlig miljö för ML-forskare att enkelt köra anpassningsbar Amazon SageMaker Model Building Pipelines att testa sina hypoteser utan att behöva koda långa och komplicerade moduler.

En av flera utmaningar var att anpassa den befintliga pipelinelösningen på plats för användning på AWS. Lösningen involverade två nyckelkomponenter:

- Ändra och utöka befintlig kod – Den första delen av vår lösning innebar modifiering och utökning av vår befintliga kod för att göra den kompatibel med AWS-infrastruktur. Detta var avgörande för att säkerställa en smidig övergång från lokal till molnbaserad bearbetning.

- Utveckling av klientpaket – Ett klientpaket utvecklades som fungerar som ett omslag kring SageMaker API:er och den tidigare befintliga koden. Detta paket kombinerar de två, vilket gör det möjligt för ML-forskare att enkelt konfigurera och distribuera ML-pipelines utan kodning.

SageMaker pipeline konfiguration

Anpassningsbarhet är nyckeln till modellbyggandet, och det uppnåddes genom config.ini, en omfattande konfigurationsfil. Den här filen fungerar som kontrollcenter för alla ingångar och beteenden i pipelinen.

Tillgängliga konfigurationer inuti config.ini innefattar:

- Pipeline detaljer – Utövaren kan definiera pipelinens namn, specificera vilka steg som ska köras, bestämma var utdata ska lagras i Amazon enkel lagringstjänst (Amazon S3), och välj vilka datauppsättningar som ska användas

- AWS-kontouppgifter – Du kan bestämma vilken region pipelinen ska köras i och vilken roll som ska användas

- Stegspecifik konfiguration – För varje steg i pipelinen kan du ange detaljer som antal och typ av instanser som ska användas, tillsammans med relevanta parametrar

Följande kod visar ett exempel på en konfigurationsfil:

config.ini är en versionskontrollerad fil som hanteras av Git, som representerar den minimala konfiguration som krävs för en framgångsrik träningspipelinekörning. Under utvecklingen kan lokala konfigurationsfiler som inte är versionskontrollerade användas. Dessa lokala konfigurationsfiler behöver bara innehålla inställningar som är relevanta för en specifik körning, vilket introducerar flexibilitet utan komplexitet. Klienten för att skapa pipeline är utformad för att hantera flera konfigurationsfiler, där den senaste har företräde framför tidigare inställningar.

SageMaker pipeline steg

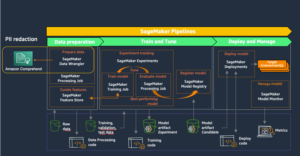

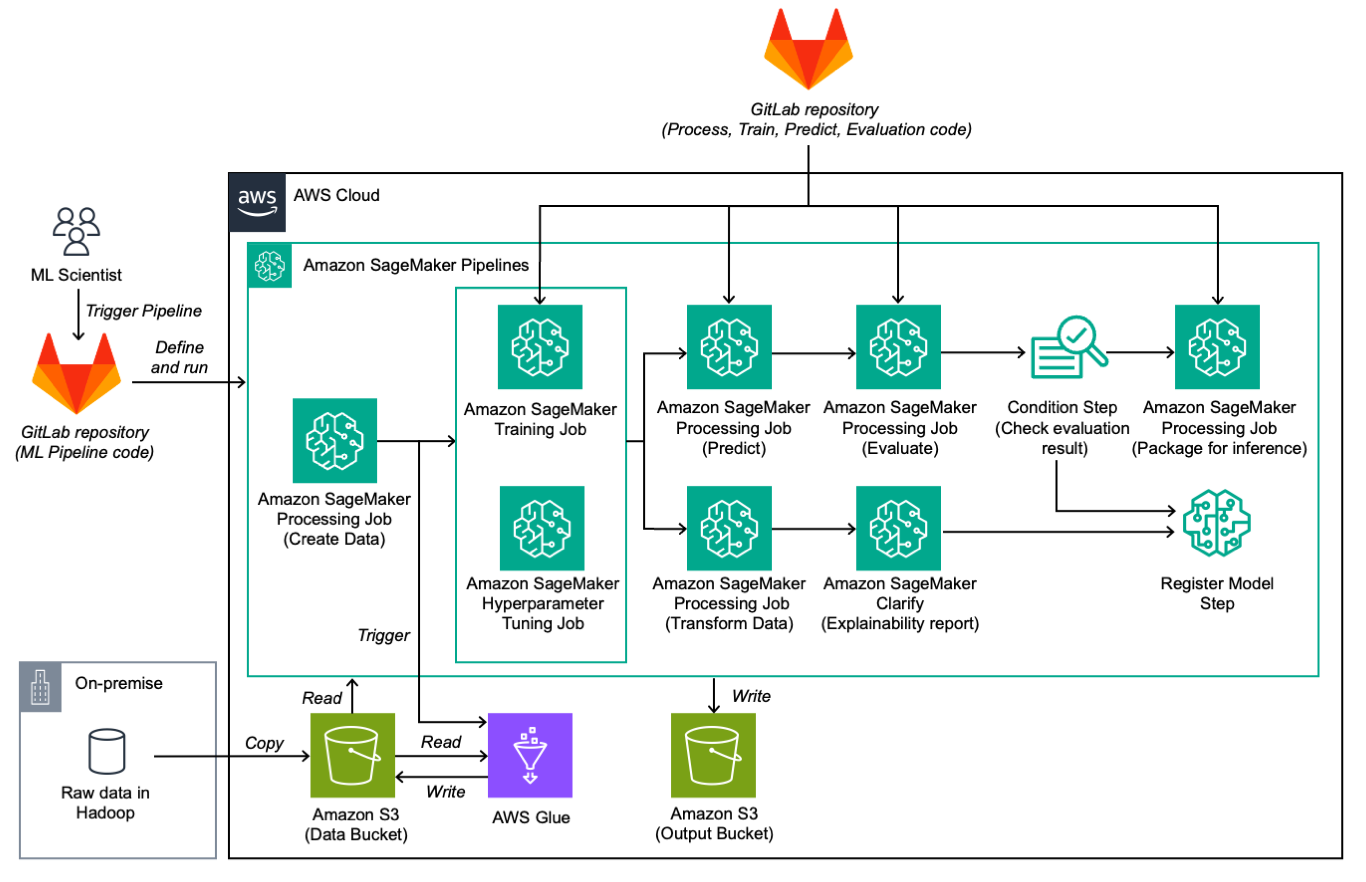

Pipelinjen är uppdelad i följande steg:

- Träna och testa dataförberedelser – Terabyte av rådata kopieras till en S3-hink, bearbetas med hjälp av AWS-lim jobb för Spark-bearbetning, vilket resulterar i att data struktureras och formateras för kompatibilitet.

- Tåg – Utbildningssteget använder TensorFlow-kalkylatorn för SageMaker-utbildningsjobb. Träning sker på ett distribuerat sätt med Horovod, och den resulterande modellartefakten lagras i Amazon S3. För hyperparameterjustering kan ett hyperparameteroptimeringsjobb (HPO) initieras, varvid man väljer den bästa modellen baserat på objektivmåttet.

- förutsäga – I det här steget använder ett SageMaker Processing-jobb den lagrade modellartefakten för att göra förutsägelser. Denna process körs parallellt på tillgängliga maskiner, och förutsägelseresultaten lagras i Amazon S3.

- Utvärdera – Ett PySpark-bearbetningsjobb utvärderar modellen med hjälp av ett anpassat Spark-skript. Utvärderingsrapporten lagras sedan i Amazon S3.

- Skick – Efter utvärdering tas beslut om modellens kvalitet. Detta beslut baseras på ett villkorsmått definierat i konfigurationsfilen. Om utvärderingen är positiv registreras modellen som godkänd; annars registreras den som avvisad. I båda fallen registreras utvärderings- och förklaringsrapporten, om den genereras, i modellregistret.

- Paketmodell för slutledning – Med ett bearbetningsjobb, om utvärderingsresultaten är positiva, paketeras modellen, lagras i Amazon S3 och görs redo för uppladdning till den interna ML-portalen.

- Förklara – SageMaker Clarify genererar en förklaringsrapport.

Två distinkta förråd används. Det första arkivet innehåller definitionen och byggkoden för ML-pipeline, och det andra arkivet innehåller koden som körs i varje steg, såsom bearbetning, utbildning, förutsägelse och utvärdering. Detta tillvägagångssätt med dubbla lagringsplatser möjliggör större modularitet och gör det möjligt för vetenskaps- och ingenjörsteam att iterera oberoende av ML-kod och ML-pipelinekomponenter.

Följande diagram illustrerar arbetsflödet för lösningen.

Automatisk modellinställning

Utbildning av ML-modeller kräver ett iterativt tillvägagångssätt med flera träningsexperiment för att bygga en robust och effektiv slutmodell för affärsbruk. ML-forskarna måste välja lämplig modelltyp, bygga rätt indatauppsättningar och justera uppsättningen hyperparametrar som styr modellinlärningsprocessen under utbildningen.

Valet av lämpliga värden för hyperparametrar för modellträningsprocessen kan avsevärt påverka modellens slutliga prestanda. Det finns dock inget unikt eller definierat sätt att avgöra vilka värden som är lämpliga för ett specifikt användningsfall. För det mesta kommer ML-forskare att behöva köra flera träningsjobb med lite olika uppsättningar av hyperparametrar, observera modellens träningsmått och sedan försöka välja mer lovande värden för nästa iteration. Denna process för att trimma modellprestanda är också känd som hyperparameteroptimering (HPO), och kan ibland kräva hundratals experiment.

Ranking-teamet brukade utföra HPO manuellt i sin lokala miljö eftersom de bara kunde lansera ett mycket begränsat antal utbildningsjobb parallellt. Därför var de tvungna att köra HPO sekventiellt, testa och välja olika kombinationer av hyperparametervärden manuellt och regelbundet övervaka framstegen. Detta förlängde modellutvecklingen och justeringsprocessen och begränsade det totala antalet HPO-experiment som kunde köras under en genomförbar tid.

Med flytten till AWS kunde Ranking-teamet använda funktionen för automatisk modellinställning (AMT) i SageMaker. AMT gör det möjligt för Ranking ML-forskare att automatiskt starta hundratals utbildningsjobb inom hyperparameterintervall av intresse för att hitta den bäst presterande versionen av den slutliga modellen enligt det valda måttet. Ranking-teamet kan nu välja mellan fyra olika automatiska inställningsstrategier för val av hyperparameter:

- Rutnätssökning – AMT förväntar sig att alla hyperparametrar ska vara kategoriska värden, och den kommer att lansera träningsjobb för varje distinkt kategorisk kombination och utforska hela hyperparameterutrymmet.

- Slumpmässig sökning – AMT kommer slumpmässigt att välja kombinationer av hyperparametervärden inom angivna intervall. Eftersom det inte finns något beroende mellan olika träningsjobb och val av parametervärde, kan flera parallella träningsjobb startas med denna metod, vilket påskyndar den optimala parametervalsprocessen.

- Bayesiansk optimering – AMT använder Bayesiansk optimeringsimplementering för att gissa den bästa uppsättningen hyperparametervärden och behandlar det som ett regressionsproblem. Den kommer att överväga tidigare testade hyperparameterkombinationer och dess inverkan på modellträningsjobben med det nya parametervalet, optimera för smartare parameterval med färre experiment, men det kommer också att lansera träningsjobb endast sekventiellt för att alltid kunna lära av tidigare utbildningar.

- Hyperband – AMT kommer att använda mellanliggande och slutliga resultat av de träningsjobb som den kör för att dynamiskt omfördela resurser till träningsjobb med hyperparameterkonfigurationer som visar mer lovande resultat samtidigt som de automatiskt stoppar de som underpresterar.

AMT på SageMaker gjorde det möjligt för Ranking-teamet att minska tiden som spenderades på hyperparameterjusteringsprocessen för sin modellutveckling genom att göra det möjligt för dem för första gången att köra flera parallella experiment, använda automatiska inställningsstrategier och utföra tvåsiffriga träningskörningar inom några dagar, något som inte var genomförbart i lokalerna.

Modellförklaring med SageMaker Clarify

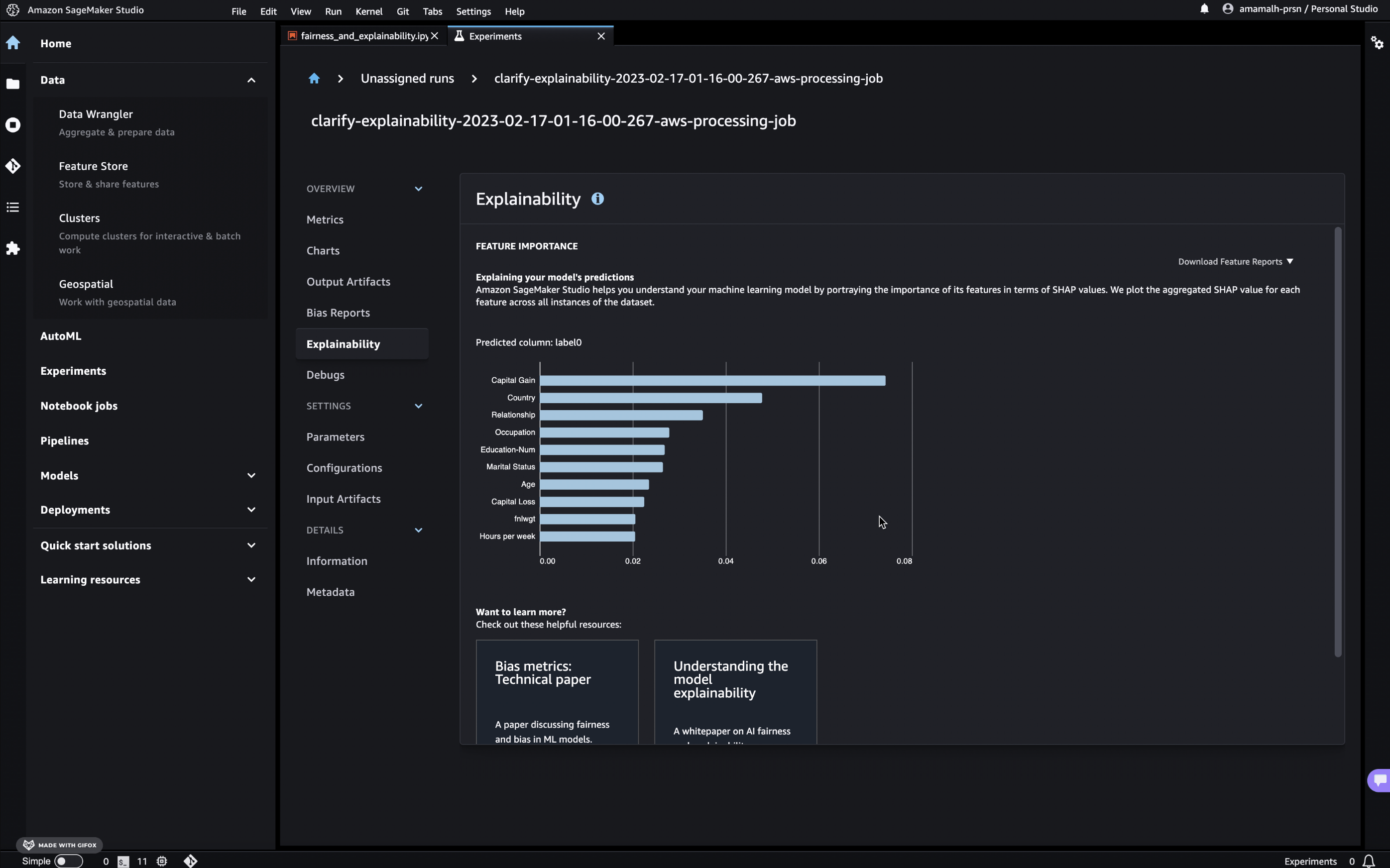

Modellförklaring gör det möjligt för ML-utövare att förstå karaktären och beteendet hos sina ML-modeller genom att tillhandahålla värdefulla insikter för funktionsteknik och urvalsbeslut, vilket i sin tur förbättrar kvaliteten på modellförutsägelserna. Ranking-teamet ville utvärdera sina insikter om förklarabarhet på två sätt: förstå hur funktionsindata påverkar modellutdata över hela deras datauppsättning (global tolkningsbarhet), och även kunna upptäcka ingångsfunktionspåverkan för en specifik modellförutsägelse på en datapunkt av intresse ( lokal tolkning). Med dessa data kan Ranking ML-forskare fatta välgrundade beslut om hur de kan förbättra sin modellprestanda ytterligare och redogöra för de utmanande förutsägelseresultat som modellen ibland skulle ge.

SageMaker Clarify gör att du kan generera modellförklaringsrapporter med hjälp av Shapley Additiv förklaringar (SHAP) när du tränar dina modeller på SageMaker, vilket stödjer både global och lokal modelltolkbarhet. Förutom modellförklaringsrapporter stöder SageMaker Clarify köra analyser för pre-training bias-metrik, post-training bias-metrik och partiella beroendediagram. Jobbet kommer att köras som ett SageMaker Processing-jobb inom AWS-kontot och det integreras direkt med SageMaker-pipelines.

Den globala tolkningsrapporten genereras automatiskt i jobbutdata och visas i Amazon SageMaker Studio miljö som en del av träningsexperimentet. Om denna modell sedan registreras i SageMakers modellregister, kommer rapporten dessutom att kopplas till modellartefakten. Genom att använda båda dessa alternativ kunde Ranking-teamet enkelt spåra olika modellversioner och deras beteendeförändringar.

För att utforska indatafunktionernas inverkan på en enskild förutsägelse (lokala tolkningsvärden), aktiverade Ranking-teamet parametern save_local_shap_values i SageMaker Clarify-jobben och kunde ladda dem från S3-skopan för vidare analyser i Jupyter-anteckningsböckerna i SageMaker Studio.

De föregående bilderna visar ett exempel på hur en modellförklarbarhet skulle se ut för en godtycklig ML-modell.

Träningsoptimering

Framväxten av djupinlärning (DL) har lett till att ML blivit allt mer beroende av beräkningskraft och stora mängder data. ML-utövare möter ofta hindret att effektivt använda resurser när de tränar dessa komplexa modeller. När du kör träning på stora datorkluster uppstår olika utmaningar när det gäller att optimera resursutnyttjandet, inklusive problem som I/O-flaskhalsar, kärnlanseringsförseningar, minnesbegränsningar och underutnyttjade resurser. Om konfigurationen av träningsjobbet inte är finjusterad för effektivitet, kan dessa hinder resultera i suboptimal hårdvaraanvändning, förlängd träningstid eller till och med ofullständiga träningskörningar. Dessa faktorer ökar projektkostnaderna och försenar tidslinjerna.

Profilering av CPU- och GPU-användning hjälper till att förstå dessa ineffektiviteter, bestämma hårdvarurursförbrukningen (tid och minne) för de olika TensorFlow-operationerna i din modell, lösa prestandaflaskhalsar och, i slutändan, få modellen att köras snabbare.

Rankinglaget använde ramprofileringsfunktionen för Amazon SageMaker Debugger (nu avskaffad till förmån för Amazon SageMaker Profiler) för att optimera dessa utbildningsjobb. Detta gör att du kan spåra alla aktiviteter på CPU:er och GPU:er, såsom CPU- och GPU-användning, kärnkörningar på GPU:er, kärnlanseringar på processorer, synkroniseringsoperationer, minnesoperationer över GPU:er, latenser mellan kärnlanseringar och motsvarande körningar och dataöverföring mellan processorer och GPU:er.

Ranking laget använde också TensorFlow Profiler egenskap av TensorBoard, som ytterligare hjälpte till att profilera TensorFlow-modellutbildningen. SageMaker är nu ytterligare integrerat med TensorBoard och tar med TensorBoards visualiseringsverktyg till SageMaker, integrerade med SageMaker-utbildning och domäner. TensorBoard låter dig utföra modellfelsökningsuppgifter med TensorBoards visualiseringsplugin.

Med hjälp av dessa två verktyg optimerade Ranking-teamet sin TensorFlow-modell och kunde identifiera flaskhalsar och minska den genomsnittliga träningsstegtiden från 350 millisekunder till 140 millisekunder på CPU och från 170 millisekunder till 70 millisekunder på GPU, hastigheter på 60 % och 59 %, respektive.

Affärsresultat

Migreringsinsatserna kretsade kring att förbättra tillgänglighet, skalbarhet och elasticitet, vilket tillsammans förde ML-miljön mot en ny nivå av operationell excellens, exemplifierad av den ökade modellträningsfrekvensen och minskade misslyckanden, optimerade träningstider och avancerade ML-funktioner.

Modell träningsfrekvens och misslyckanden

Antalet månatliga modellutbildningsjobb femdubblades, vilket ledde till betydligt mer frekventa modelloptimeringar. Dessutom ledde den nya ML-miljön till en minskning av felfrekvensen för pipelinekörningar, och sjönk från cirka 50 % till 20 %. Den misslyckade bearbetningstiden minskade drastiskt, från över en timme i genomsnitt till försumbara 5 sekunder. Detta har kraftigt ökat operativ effektivitet och minskat resursslöseri.

Optimerad träningstid

Migrationen förde med sig effektivitetsökningar genom SageMaker-baserad GPU-utbildning. Detta skifte minskade modellträningstiden till en femtedel av dess tidigare varaktighet. Tidigare tog utbildningsprocesserna för modeller för djupinlärning cirka 60 timmar på CPU; detta strömlinjeformades till cirka 12 timmar på GPU. Denna förbättring sparar inte bara tid utan påskyndar också utvecklingscykeln, vilket möjliggör snabbare iterationer och modellförbättringar.

Avancerade ML-funktioner

Centralt för migreringens framgång är användningen av SageMaker-funktionsuppsättningen, som omfattar hyperparameterjustering och modellförklarbarhet. Dessutom tillät migreringen sömlös experimentspårning med hjälp av Amazon SageMaker-experiment, vilket möjliggör mer insiktsfulla och produktiva experiment.

Det viktigaste är att den nya ML-experimentmiljön stödde den framgångsrika utvecklingen av en ny modell som nu är i produktion. Denna modell är djupinlärning snarare än trädbaserad och har introducerat märkbara förbättringar i onlinemodellprestanda.

Slutsats

Det här inlägget gav en översikt över AWS Professional Services och Booking.com-samarbetet som resulterade i implementeringen av ett skalbart ML-ramverk och som framgångsrikt minskade tiden till marknaden för ML-modeller i deras Ranking-team.

Ranking-teamet på Booking.com lärde sig att migreringen till molnet och SageMaker har visat sig vara fördelaktig, och att anpassning av maskininlärningsoperationer (MLOps) gör det möjligt för deras ML-ingenjörer och forskare att fokusera på sitt hantverk och öka utvecklingshastigheten. Teamet delar med sig av lärdomarna och arbetet som gjorts med hela ML-communityt på Booking.com, genom samtal och dedikerade sessioner med ML-utövare där de delar koden och kapaciteten. Vi hoppas att detta inlägg kan fungera som ytterligare ett sätt att dela kunskapen.

AWS Professional Services är redo att hjälpa ditt team att utveckla skalbar och produktionsklar ML i AWS. För mer information, se AWS professionella tjänster eller kontakta din kontoansvariga för att komma i kontakt.

Om författarna

Laurens van der Maas är en maskininlärningsingenjör på AWS Professional Services. Han arbetar nära kunder som bygger sina maskininlärningslösningar på AWS, specialiserar sig på distribuerad utbildning, experiment och ansvarsfull AI, och brinner för hur maskininlärning förändrar världen som vi känner den.

Laurens van der Maas är en maskininlärningsingenjör på AWS Professional Services. Han arbetar nära kunder som bygger sina maskininlärningslösningar på AWS, specialiserar sig på distribuerad utbildning, experiment och ansvarsfull AI, och brinner för hur maskininlärning förändrar världen som vi känner den.

Daniel Zagyva är datavetare på AWS Professional Services. Han är specialiserad på att utveckla skalbara, produktionsklassade maskininlärningslösningar för AWS-kunder. Hans erfarenhet sträcker sig över olika områden, inklusive naturlig språkbehandling, generativ AI och maskininlärning.

Daniel Zagyva är datavetare på AWS Professional Services. Han är specialiserad på att utveckla skalbara, produktionsklassade maskininlärningslösningar för AWS-kunder. Hans erfarenhet sträcker sig över olika områden, inklusive naturlig språkbehandling, generativ AI och maskininlärning.

Kostia Kofman är en Senior Machine Learning Manager på Booking.com, leder Search Ranking ML-teamet och övervakar Booking.coms mest omfattande ML-system. Med expertis inom personalisering och rankning trivs han med att utnyttja den senaste tekniken för att förbättra kundupplevelsen.

Kostia Kofman är en Senior Machine Learning Manager på Booking.com, leder Search Ranking ML-teamet och övervakar Booking.coms mest omfattande ML-system. Med expertis inom personalisering och rankning trivs han med att utnyttja den senaste tekniken för att förbättra kundupplevelsen.

Jenny Tokar är Senior Machine Learning Engineer på Booking.coms sökrankningsteam. Hon är specialiserad på att utveckla end-to-end ML-pipelines som kännetecknas av effektivitet, tillförlitlighet, skalbarhet och innovation. Jennys expertis ger hennes team möjlighet att skapa banbrytande rankningsmodeller som betjänar miljontals användare varje dag.

Jenny Tokar är Senior Machine Learning Engineer på Booking.coms sökrankningsteam. Hon är specialiserad på att utveckla end-to-end ML-pipelines som kännetecknas av effektivitet, tillförlitlighet, skalbarhet och innovation. Jennys expertis ger hennes team möjlighet att skapa banbrytande rankningsmodeller som betjänar miljontals användare varje dag.

Aleksandra Dokic är Senior Data Scientist på AWS Professional Services. Hon tycker om att stödja kunder att bygga innovativa AI/ML-lösningar på AWS och hon är entusiastisk över affärstransformationer genom kraften i data.

Aleksandra Dokic är Senior Data Scientist på AWS Professional Services. Hon tycker om att stödja kunder att bygga innovativa AI/ML-lösningar på AWS och hon är entusiastisk över affärstransformationer genom kraften i data.

Luba Protsiva är Engagement Manager på AWS Professional Services. Hon är specialiserad på att leverera data- och GenAI/ML-lösningar som gör det möjligt för AWS-kunder att maximera sitt affärsvärde och accelerera innovationshastigheten.

Luba Protsiva är Engagement Manager på AWS Professional Services. Hon är specialiserad på att leverera data- och GenAI/ML-lösningar som gör det möjligt för AWS-kunder att maximera sitt affärsvärde och accelerera innovationshastigheten.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- förmåga

- Able

- Om oss

- accelerera

- tillgång

- Enligt

- Konto

- uppnås

- tvärs

- aktiviteter

- handlingar

- anpassning

- Dessutom

- Dessutom

- avancerat

- påverka

- Efter

- AI

- AI / ML

- algoritmer

- Alla

- tillåts

- tillåter

- längs

- också

- alltid

- amason

- Amazon SageMaker

- Amazon Web Services

- mängd

- mängder

- an

- analyser

- och

- Annan

- API: er

- tillvägagångssätt

- lämpligt

- godkänd

- cirka

- godtycklig

- ÄR

- områden

- stiga upp

- runt

- AS

- aspiration

- At

- Automat

- automatiskt

- tillgänglighet

- tillgänglig

- genomsnitt

- AWS

- AWS professionella tjänster

- tillbaka

- baserat

- Bayesian

- BE

- därför att

- passande

- beteende

- beteende

- beteenden

- fördelaktigt

- gynnar

- BÄST

- mellan

- förspänning

- bokning

- Booking.com

- båda

- flaskhals

- Bringar

- fört

- SLUTRESULTAT

- Byggnad

- företag

- men

- by

- KAN

- kapacitet

- Vid

- fall

- Centrum

- centrerad

- utmaningar

- utmanande

- byta

- Förändringar

- byte

- känne

- Välja

- valda

- klient

- nära

- cloud

- koda

- Kodning

- samarbetat

- samverkan

- kollektivt

- COM

- kombination

- kombinationer

- kombinerar

- vanligen

- samfundet

- kompatibilitet

- kompatibel

- komplex

- Komplexiteten

- komplicerad

- komponenter

- beräkningar

- beräkningskraft

- Compute

- tillstånd

- konfiguration

- Tänk

- består

- begränsningar

- konsumeras

- konsumtion

- innehålla

- innehåller

- kontroll

- korrekt

- Motsvarande

- Kostar

- kunde

- farkoster

- skapa

- skapande

- avgörande

- beställnings

- kund

- Kunder

- anpassningsbar

- allra senaste

- spetsteknik

- cykel

- datum

- Förberedelse av data

- datavetare

- datauppsättningar

- dag

- Dagar

- beslutar

- Beslutet

- beslut

- minskade

- dedicerad

- anses

- djup

- djupt lärande

- definiera

- definierade

- definition

- fördröja

- fördröjningar

- leverera

- leverera

- gräva

- beroende

- Dependency

- distribuera

- utplacerade

- fasats

- utformade

- detaljer

- Bestämma

- utveckla

- utvecklade

- utveckla

- Utveckling

- Diagrammet

- olika

- direkt

- Upptäck

- visas

- distinkt

- distribueras

- distribuerad utbildning

- dividerat

- gör

- domäner

- gjort

- drastiskt

- Drop

- varaktighet

- under

- dynamiskt

- varje

- lätt

- effektivitet

- effektivt

- ansträngningar

- inlett

- bemyndigar

- möjliggöra

- aktiverad

- möjliggör

- möjliggör

- encompassing

- början till slut

- ingrepp

- ingenjör

- Teknik

- Ingenjörer

- förbättra

- förbättra

- säkerställa

- Hela

- Miljö

- epoker

- väsentlig

- utvärdera

- utvärdering

- Även

- Varje

- varje dag

- exempel

- Excellence

- exciterade

- exemplifierade

- befintliga

- förvänta

- påskyndar

- erfarenhet

- Erfarenheter

- experimentera

- experiment

- expertis

- Förklara

- utforska

- Utforska

- sträcker

- sträcker

- förlängning

- omfattande

- Ansikte

- inför

- faktorer

- Misslyckades

- Misslyckande

- misslyckanden

- falsk

- snabbare

- gynna

- möjlig

- Leverans

- Funktioner

- återkoppling

- färre

- Fil

- Filer

- slutlig

- Slutligen

- hitta

- Förnamn

- första gången

- Flexibilitet

- Fokus

- efter

- För

- fyra

- Ramverk

- Frekvens

- frekvent

- från

- ytterligare

- Vidare

- få

- generera

- genereras

- genererar

- generativ

- Generativ AI

- skaffa sig

- gå

- Välgörenhet

- Målet

- GPU

- GPUs

- större

- antar

- hade

- hantera

- hårdvara

- utnyttjas

- Har

- he

- hjälpa

- hjälpte

- hjälper

- här

- hans

- hoppas

- timme

- ÖPPETTIDER

- Hur ser din drömresa ut

- How To

- Men

- html

- http

- HTTPS

- Hundratals

- hinder

- Hyperparameteroptimering

- Inställning av hyperparameter

- identifiera

- if

- illustrerar

- bilder

- omedelbar

- Inverkan

- genomförande

- viktigt

- förbättra

- förbättras

- förbättring

- förbättringar

- förbättrar

- in

- innefattar

- Inklusive

- Öka

- ökat

- Ökar

- alltmer

- oberoende av

- industrin

- ineffektivitet

- påverka

- informationen

- informeras

- Infrastruktur

- initieras

- förnya

- Innovation

- innovativa

- ingång

- ingångar

- inuti

- insiktsfull

- insikter

- omedelbar

- integrerade

- integrerar

- intresse

- inre

- in

- introducerade

- införa

- involverade

- problem

- IT

- iteration

- iterationer

- DESS

- Jobb

- Lediga jobb

- resa

- jpg

- Nyckel

- Vet

- kunskap

- känd

- saknas

- språk

- Large

- senaste

- lansera

- lanserades

- lanserar

- ledare

- ledande

- LÄRA SIG

- lärt

- inlärning

- Led

- Nivå

- hävstångs

- tycka om

- Begränsad

- kopplade

- läsa in

- lokal

- Lång

- se

- ser ut som

- Maskinen

- maskininlärning

- Maskiner

- gjord

- göra

- förvaltade

- chef

- sätt

- manuellt

- Maximera

- betyda

- Minne

- metod

- metriska

- Metrics

- migrerande

- migration

- miljoner

- millisekunder

- minimum

- minuter

- ML

- MLOps

- modell

- modeller

- modernisera

- Moduler

- Övervaka

- månad

- mer

- mest

- flytta

- rörd

- mycket

- multipel

- namn

- Natural

- Naturlig språkbehandling

- Natur

- Behöver

- Nya

- Nästa

- Nej

- nu

- antal

- mål

- observera

- hinder

- of

- offline

- Ofta

- on

- On-Demand

- ONE

- nätet

- endast

- operativa

- Verksamhet

- optimala

- optimering

- optimeringar

- Optimera

- optimerad

- optimera

- Tillbehör

- or

- Övriga

- annat

- vår

- ut

- produktion

- utgångar

- över

- övergripande

- övervaka

- Översikt

- egen

- Fred

- paket

- förpackade

- Parallell

- parameter

- del

- brinner

- Utföra

- prestanda

- utför

- personalisering

- rörledning

- svängbara

- plato

- Platon Data Intelligence

- PlatonData

- spelar

- insticksmoduler

- Punkt

- Portal

- positiv

- Inlägg

- kraft

- praxis

- föregående

- förutse

- förutsägelse

- Förutsägelser

- beredning

- föregående

- tidigare

- Problem

- process

- Bearbetad

- processer

- bearbetning

- Produktion

- produktiv

- professionell

- Profil

- profilering

- Framsteg

- projektet

- lovande

- visat

- ge

- förutsatt

- tillhandahålla

- kvalitet

- snabbt

- intervall

- Rankning

- snabbt

- Betygsätta

- snarare

- Raw

- nå

- redo

- motta

- känna igen

- Rekommendation

- registreras

- minska

- Minskad

- reducerande

- reduktion

- om

- region

- registrera

- registrerat

- register

- regelbundet

- Avvisade..

- relevanta

- tillförlitlighet

- rapport

- Rapport

- Repository

- representerar

- kräver

- Obligatorisk

- Kräver

- Lös

- resurs

- Resurser

- respektive

- ansvarig

- resultera

- resulterande

- Resultat

- Rise

- robusta

- Roll

- Körning

- rinnande

- kör

- sagemaker

- SageMaker-rörledningar

- skalbarhet

- skalbar

- Skala

- Vetenskap

- Forskare

- vetenskapsmän

- skript

- sömlös

- Sök

- Andra

- sekunder

- se

- söker

- välj

- väljer

- Val

- senior

- tjänar

- serverar

- Tjänster

- sessioner

- in

- uppsättningar

- inställningar

- flera

- Dela

- delning

- hon

- skifta

- skall

- show

- Visar

- signifikant

- Enkelt

- enda

- något annorlunda

- smartare

- släta

- So

- lösning

- Lösningar

- något

- Utrymme

- Gnista

- specialiserat

- specifik

- fart

- spent

- Steg

- Steg

- stoppa

- förvaring

- lagras

- strategier

- strömlinjeformad

- starkt

- strukturerade

- studio

- suboptimal

- framgång

- framgångsrik

- Framgångsrikt

- sådana

- Som stöds

- Stödjande

- Stöder

- synkronisera.

- system

- skräddarsydd

- tar

- Talks

- uppgifter

- grupp

- lag

- Teknologi

- tensorflow

- testa

- testade

- Testning

- än

- den där

- Smakämnen

- världen

- deras

- Dem

- sedan

- Där.

- vari

- därför

- Dessa

- de

- detta

- de

- Trivs

- Genom

- tid

- tidslinjer

- gånger

- till

- verktyg

- Rör

- mot

- spår

- Spårning

- Tåg

- Utbildning

- utbildningar

- överföring

- transformationer

- övergång

- färdas

- resebranschen

- resenärer

- behandling

- sann

- prova

- trimma

- SVÄNG

- två

- Typ

- Ytterst

- förstå

- unika

- Användning

- användning

- användningsfall

- Begagnade

- användarvänligt

- användare

- användningar

- med hjälp av

- utnyttjas

- Värdefulla

- värde

- Värden

- olika

- Omfattande

- Hastighet

- version

- versioner

- mycket

- visualisering

- vänta

- ville

- var

- Sätt..

- sätt

- we

- webb

- webbservice

- były

- när

- som

- medan

- VEM

- kommer

- med

- inom

- utan

- Arbete

- arbetsflöde

- fungerar

- världen

- inom hela sverige

- skulle

- Om er

- Din

- zephyrnet