Det här inlägget är skrivet av Ramdev Wudali och Kiran Mantripragada från Thomson Reuters.

1992, Thomson Reuters (TR) släppte sin första juridiska forskningstjänst för AI, WIN (Westlaw Is Natural), en innovation på den tiden, eftersom de flesta sökmotorer endast stödde booleska termer och kopplingar. Sedan dess har TR uppnått många fler milstolpar eftersom dess AI-produkter och -tjänster ständigt växer i antal och variation, och stödjer juridik, skatte-, redovisnings-, efterlevnads- och nyhetstjänstpersonal över hela världen, med miljarder insikter om maskininlärning (ML) som genereras varje år .

Med denna enorma ökning av AI-tjänster var nästa milstolpe för TR att effektivisera innovation och underlätta samarbete. Standardisera byggandet och återanvändningen av AI-lösningar över affärsfunktioner och AI-utövares personas, samtidigt som du säkerställer att företagets bästa praxis följs:

- Automatisera och standardisera det repetitiva odifferentierade ingenjörsarbetet

- Säkerställ erforderlig isolering och kontroll av känsliga uppgifter i enlighet med gemensamma förvaltningsstandarder

- Ge enkel åtkomst till skalbara datorresurser

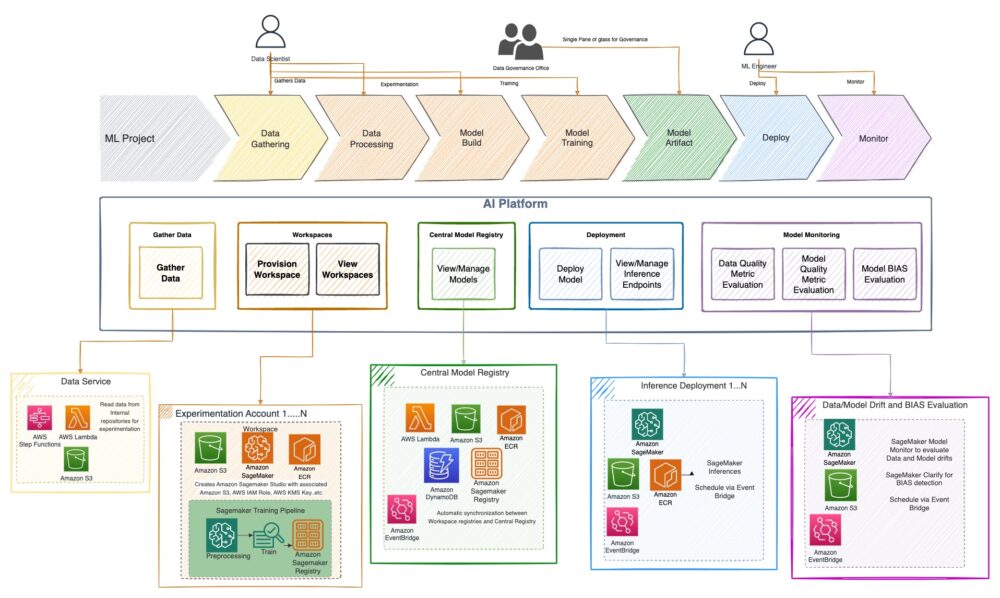

För att uppfylla dessa krav byggde TR Enterprise AI-plattformen kring följande fem pelare: en datatjänst, experimentarbetsyta, centralt modellregister, modelldistributionstjänst och modellövervakning.

I det här inlägget diskuterar vi hur TR och AWS samarbetade för att utveckla TR:s första Enterprise AI-plattform någonsin, ett webbaserat verktyg som skulle ge möjligheter allt från ML-experimentering, utbildning, ett centralt modellregister, modellinstallation och modellövervakning. Alla dessa funktioner är byggda för att möta TR:s ständigt föränderliga säkerhetsstandarder och tillhandahålla enkla, säkra och kompatibla tjänster till slutanvändare. Vi delar också med oss av hur TR möjliggjorde övervakning och styrning för ML-modeller skapade över olika affärsenheter med en enda glasruta.

Utmaningarna

Historiskt på TR har ML varit en förmåga för team med avancerade datavetare och ingenjörer. Team med mycket kvalificerade resurser kunde implementera komplexa ML-processer enligt deras behov, men blev snabbt mycket silo. Siled approacher gav ingen synlighet för att ge styrning i extremt kritiska beslutsfattande förutsägelser.

TR:s affärsteam har stor domänkunskap; Men den tekniska kompetensen och den tunga ingenjörsinsatsen som krävs i ML gör det svårt att använda deras djupa expertis för att lösa affärsproblem med kraften i ML. TR vill demokratisera kompetensen och göra den tillgänglig för fler inom organisationen.

Olika team i TR följer sina egna rutiner och metoder. TR vill bygga de möjligheter som sträcker sig över ML-livscykeln till sina användare för att påskynda leveransen av ML-projekt genom att göra det möjligt för team att fokusera på affärsmål och inte på den repetitiva odifferentierade ingenjörssatsningen.

Dessutom fortsätter regleringar kring data och etisk AI att utvecklas, vilket kräver gemensamma styrningsstandarder för TR:s AI-lösningar.

Lösningsöversikt

TR:s Enterprise AI-plattform var tänkt att tillhandahålla enkla och standardiserade tjänster till olika personer, och erbjuda möjligheter för varje steg i ML:s livscykel. TR har identifierat fem huvudkategorier som modulariserar alla TR:s krav:

- datatjänster – För att möjliggöra enkel och säker åtkomst till företagsdatatillgångar

- Experimentarbetsyta – Att tillhandahålla kapacitet att experimentera och träna ML-modeller

- Centralt modellregister – En företagskatalog för modeller byggda över olika affärsenheter

- Modelldistributionstjänst – Att tillhandahålla olika inferensutbyggnadsalternativ enligt TR:s företags CI/CD-praxis

- Modellövervakningstjänster – Att tillhandahålla möjligheter att övervaka data och modellera bias och drifter

Som visas i följande diagram är dessa mikrotjänster byggda med några nyckelprinciper i åtanke:

- Ta bort den odifferentierade tekniska ansträngningen från användarna

- Tillhandahåll de nödvändiga funktionerna genom att klicka på en knapp

- Säkra och styr alla funktioner enligt TR:s företagsstandarder

- Ta med en enda glasruta för ML-aktiviteter

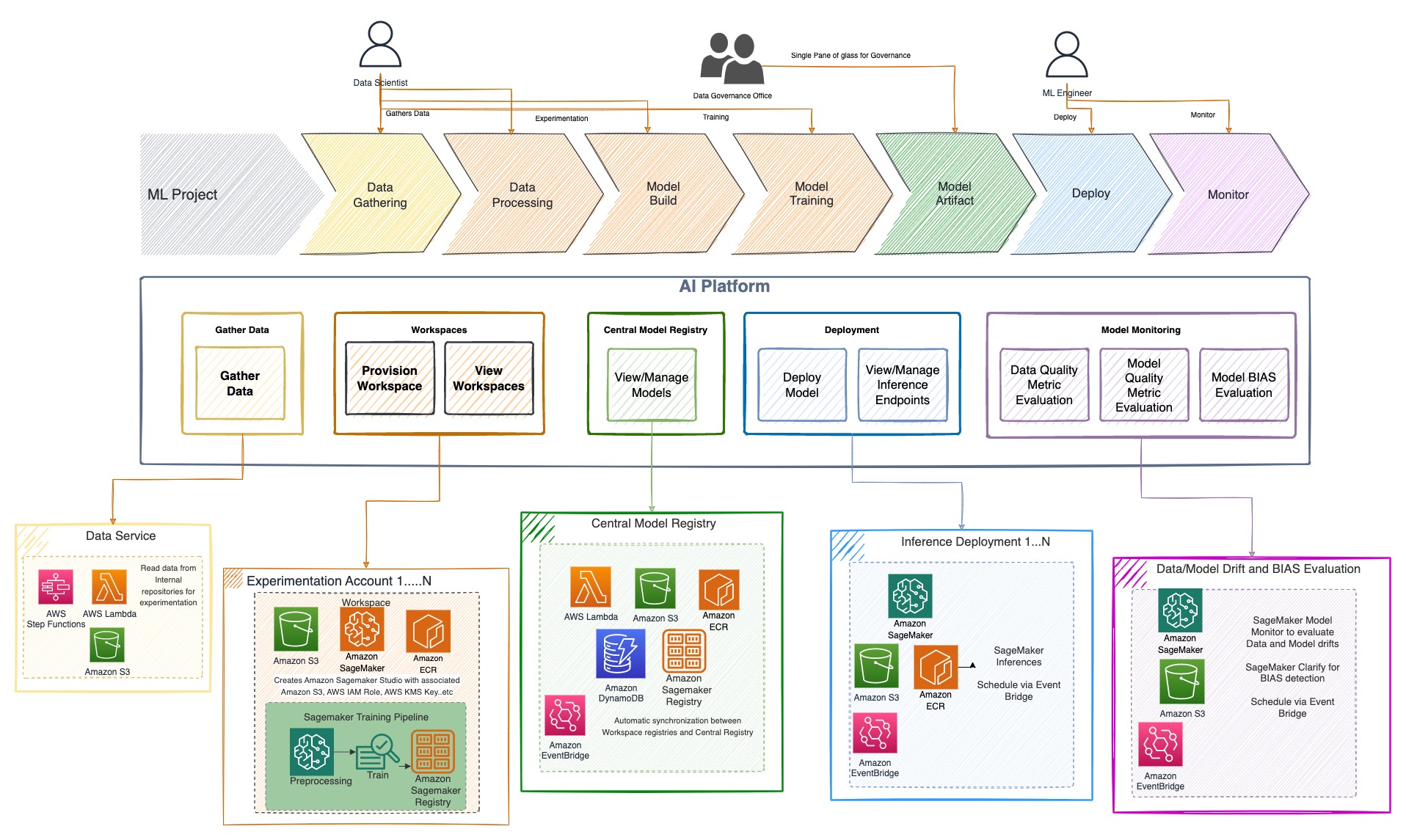

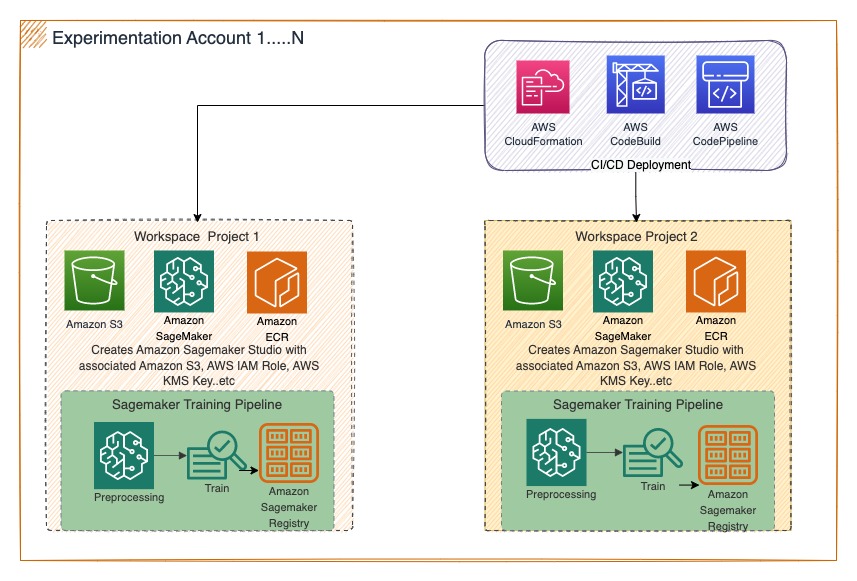

TR:s AI Platform mikrotjänster är byggda med Amazon SageMaker som kärnmotor, AWS-serverlösa komponenter för arbetsflöden och AWS DevOps-tjänster för CI/CD-praxis. SageMaker Studio används för experiment och träning, och SageMakers modellregister används för att registrera modeller. Det centrala modellregistret består av både SageMaker modellregistret och en Amazon DynamoDB tabell. SageMaker värdtjänster används för att distribuera modeller, medan SageMaker modellmonitor och SageMaker förtydliga används för att övervaka modeller för drift, bias, anpassade metriska räknare och förklarabarhet.

Följande avsnitt beskriver dessa tjänster i detalj.

datatjänster

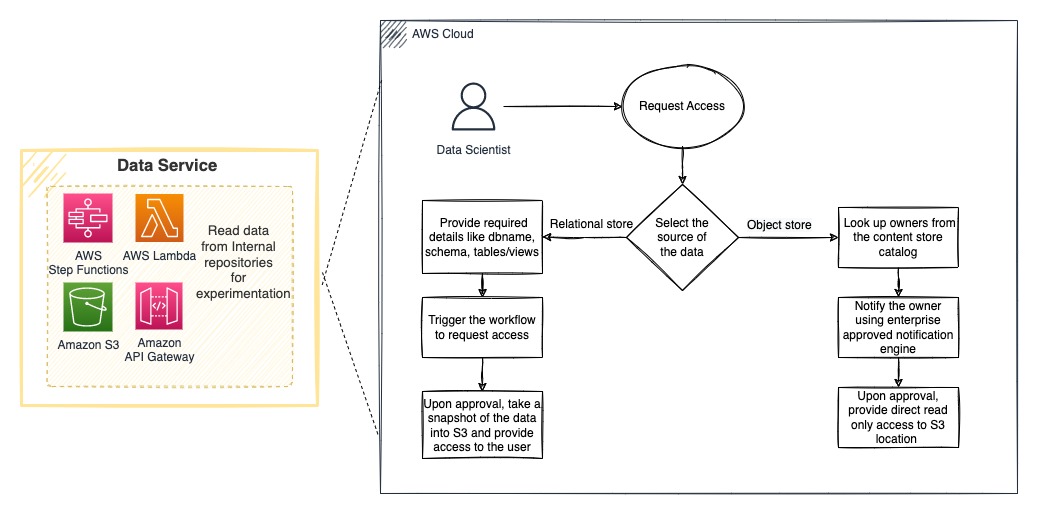

En traditionell ML-projektlivscykel börjar med att hitta data. I allmänhet lägger dataforskare 60 % eller mer av sin tid på att hitta rätt data när de behöver det. Precis som alla organisationer har TR flera datalager som fungerar som en enda sanningspunkt för olika datadomäner. TR identifierade två viktiga företagsdatalager som tillhandahåller data för de flesta av deras ML-användningsfall: ett objektlager och ett relationsdatalager. TR byggde en AI Platform-datatjänst för att sömlöst ge tillgång till båda datalagren från användarnas experimentarbetsytor och ta bort bördan från användarna att navigera i komplexa processer för att skaffa data på egen hand. TR:s AI-plattform följer alla efterlevnad och bästa praxis som definieras av teamet för data- och modellstyrning. Detta inkluderar en obligatorisk Data Impact Assessment som hjälper ML-utövare att förstå och följa den etiska och lämpliga användningen av data, med formella godkännandeprocesser för att säkerställa lämplig åtkomst till data. Kärnan i denna tjänst, liksom alla plattformstjänster, är säkerheten och efterlevnaden enligt de bästa praxis som fastställts av TR och branschen.

Amazon enkel lagringstjänst (Amazon S3) objektlagring fungerar som en innehållsdatasjö. TR byggde processer för att på ett säkert sätt komma åt data från innehållsdatasjön till användarnas experimentarbetsytor med bibehållen behörighet och granskningsbarhet. Snowflake används som företagets relationella primära datalager. På användarens begäran och baserat på godkännandet från dataägaren, tillhandahåller AI Platform-datatjänsten en ögonblicksbild av data till användaren som är lättillgänglig i deras experimentarbetsyta.

Att komma åt data från olika källor är ett tekniskt problem som enkelt kan lösas. Men komplexiteten TR har löst är att bygga godkännandearbetsflöden som automatiserar identifiering av dataägaren, skickar en åtkomstbegäran, ser till att dataägaren meddelas att de har en väntande åtkomstbegäran, och baserat på godkännandestatus vidtar åtgärder för att tillhandahålla data till begäranden. Alla händelser under denna process spåras och loggas för granskning och efterlevnad.

Som visas i följande diagram använder TR AWS stegfunktioner att orkestrera arbetsflödet och AWS Lambda för att köra funktionen. Amazon API Gateway används för att exponera funktionaliteten med en API-slutpunkt som ska konsumeras från deras webbportal.

Modellexperiment och utveckling

En väsentlig förmåga för att standardisera ML-livscykeln är en miljö som tillåter datavetare att experimentera med olika ML-ramverk och datastorlekar. Att möjliggöra en sådan säker, kompatibel miljö i molnet inom några minuter befriar datavetare från bördan att hantera molninfrastruktur, nätverkskrav och säkerhetsstandardåtgärder, för att istället fokusera på datavetenskapsproblemet.

TR bygger en experimentarbetsyta som erbjuder tillgång till tjänster som t.ex AWS-lim, Amazon EMR, och SageMaker Studio för att möjliggöra databearbetning och ML-kapacitet som följer företagets molnsäkerhetsstandarder och nödvändig kontoisolering för varje affärsenhet. TR har stött på följande utmaningar under implementeringen av lösningen:

- Orkestrering var tidigt inte helt automatiserad och involverade flera manuella steg. Att spåra var problem uppstod var inte lätt. TR övervann detta fel genom att orkestrera arbetsflödena med hjälp av stegfunktioner. Med hjälp av stegfunktioner blev det mycket enklare att bygga komplexa arbetsflöden, hantera tillstånd och felhantering.

- Rätt AWS identitets- och åtkomsthantering (IAM) rolldefinition för experimentarbetsytan var svår att definiera. För att följa TR:s interna säkerhetsstandarder och minsta privilegiemodell definierades ursprungligen arbetsplatsrollen med inline-policyer. Följaktligen växte den inline-policyn med tiden och blev mångsidig och överskred den tillåtna policystorleksgränsen för IAM-rollen. För att mildra detta gick TR över till att använda fler kundhanterade policyer och hänvisade till dem i definitionen av arbetsytan.

- TR nådde ibland standardresursgränserna som tillämpas på AWS-kontonivå. Detta orsakade enstaka misslyckanden med att lansera SageMaker-jobb (till exempel utbildningsjobb) på grund av att den önskade resurstypgränsen nåddes. TR arbetade nära SageMakers serviceteam i denna fråga. Detta problem löstes efter att AWS-teamet lanserade SageMaker som en stödd tjänst i Servicekvoter i juni 2022.

Idag kan datavetare vid TR starta ett ML-projekt genom att skapa en oberoende arbetsyta och lägga till erforderliga teammedlemmar för att samarbeta. Obegränsad skala som erbjuds av SageMaker är till hands genom att tillhandahålla dem anpassade kärnbilder med olika storlekar. SageMaker Studio blev snabbt en avgörande komponent i TR:s AI-plattform och har förändrat användarbeteendet från att använda begränsade skrivbordsapplikationer till skalbara och tillfälliga specialbyggda motorer. Följande diagram illustrerar denna arkitektur.

Centralt modellregister

Modellregistret tillhandahåller ett centralt arkiv för alla TR:s maskininlärningsmodeller, möjliggör risk- och hälsohantering av dessa på ett standardiserat sätt över affärsfunktioner och effektiviserar potentiella modellers återanvändning. Därför behövde tjänsten göra följande:

- Ge möjligheten att registrera både nya och äldre modeller, oavsett om de är utvecklade inom eller utanför SageMaker

- Implementera styrningsarbetsflöden, så att datavetare, utvecklare och intressenter kan se och gemensamt hantera modellernas livscykel

- Öka transparensen och samarbetet genom att skapa en centraliserad bild av alla modeller över TR tillsammans med metadata och hälsomått

TR startade designen med bara SageMaker-modellregistret, men ett av TR:s nyckelkrav är att ge möjlighet att registrera modeller skapade utanför SageMaker. TR utvärderade olika relationsdatabaser men valde till slut DynamoDB eftersom metadataschemat för modeller som kommer från äldre källor kommer att vara väldigt olika. TR ville inte heller påtvinga användarna något ytterligare arbete, så de implementerade en sömlös automatisk synkronisering mellan AI Platforms arbetsyta SageMaker-registren till det centrala SageMaker-registret med hjälp av Amazon EventBridge regler och obligatoriska IAM-roller. TR förbättrade det centrala registret med DynamoDB för att utöka möjligheterna att registrera äldre modeller som skapades på användarnas skrivbord.

TR:s centrala modellregister för AI Platform är integrerat i AI Platform-portalen och tillhandahåller ett visuellt gränssnitt för att söka efter modeller, uppdatera modellmetadata och förstå modellbaslinjemått och periodiska anpassade övervakningsmått. Följande diagram illustrerar denna arkitektur.

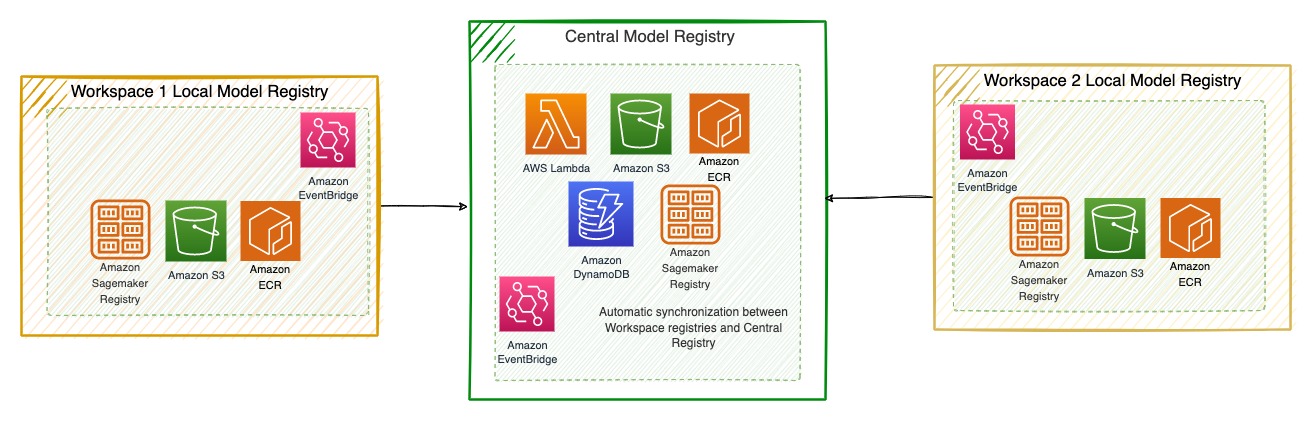

Modelldistribution

TR identifierade två huvudmönster för att automatisera distributionen:

- Modeller utvecklade med SageMaker genom SageMaker batch-omvandlingsjobb för att få slutsatser enligt ett föredraget schema

- Modeller utvecklade utanför SageMaker på lokala stationära datorer med öppen källkodsbibliotek, genom ta med din egen container-metoden med SageMaker-bearbetningsjobb för att köra anpassad slutledningskod, som ett effektivt sätt att migrera dessa modeller utan att omfaktorisera koden

Med AI Platform-distributionstjänsten kan TR-användare (datavetare och ML-ingenjörer) identifiera en modell från katalogen och distribuera ett slutledningsjobb till sitt valda AWS-konto genom att tillhandahålla de nödvändiga parametrarna genom ett UI-drivet arbetsflöde.

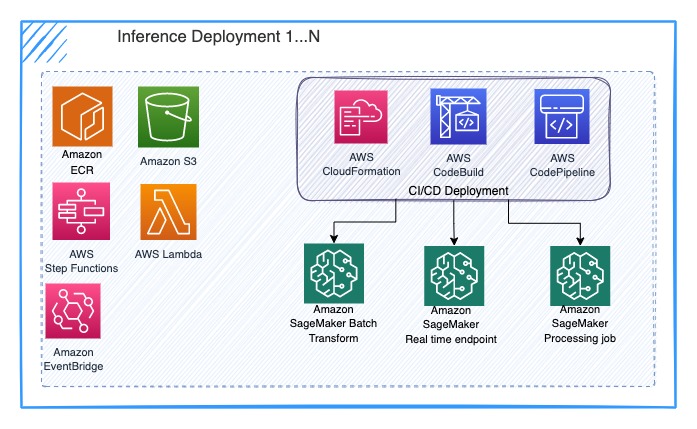

TR automatiserade denna distribution med hjälp av AWS DevOps-tjänster som AWS CodePipeline och AWS CodeBuild. TR använder stegfunktioner för att organisera arbetsflödet för att läsa och förbearbeta data för att skapa SageMaker slutledningsjobb. TR distribuerar de nödvändiga komponenterna som kod med hjälp av AWS molnformation mallar. Följande diagram illustrerar denna arkitektur.

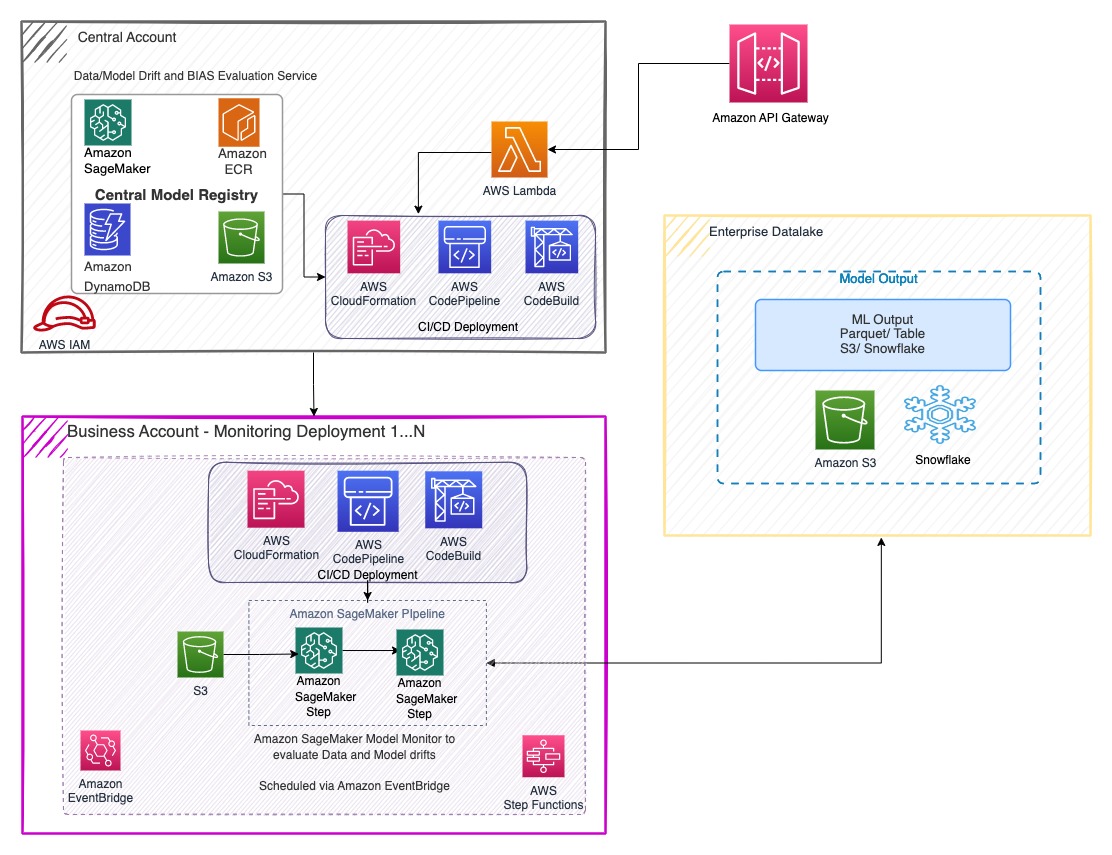

Modellövervakning

ML-livscykeln är inte komplett utan att kunna övervaka modeller. TR:s företagsstyrningsteam ger också mandat och uppmuntrar affärsteam att övervaka sin modellprestanda över tid för att hantera eventuella regulatoriska utmaningar. TR började med att övervaka modeller och data för drift. TR använde SageMaker Model Monitor för att tillhandahålla en databaslinje och slutledningsgrundsanning för att regelbundet övervaka hur TR:s data och slutsatser avviker. Tillsammans med SageMaker modellövervakningsmått förbättrade TR övervakningskapaciteten genom att utveckla anpassade mätvärden som är specifika för deras modeller. Detta kommer att hjälpa TR:s datavetare att förstå när de ska omskola sin modell.

Tillsammans med driftövervakning vill TR också förstå bias i modellerna. De färdiga funktionerna i SageMaker Clarify används för att bygga TR:s bias-tjänst. TR övervakar både data- och modellbias och gör dessa mätvärden tillgängliga för sina användare via AI Platform-portalen.

För att hjälpa alla team att anta dessa företagsstandarder har TR gjort dessa tjänster oberoende och lätt tillgängliga via AI Platform-portalen. TR:s affärsteam kan gå in i portalen och distribuera ett modellövervakningsjobb eller bias-övervakningsjobb på egen hand och köra dem enligt deras föredragna schema. De meddelas om jobbets status och mätvärden för varje körning.

TR använde AWS-tjänster för CI/CD-distribution, arbetsflödesorkestrering, serverlösa ramverk och API-slutpunkter för att bygga mikrotjänster som kan triggas oberoende, som visas i följande arkitektur.

Resultat och framtida förbättringar

TR:s AI-plattform gick live under Q3 2022 med alla fem huvudkomponenterna: en datatjänst, experimentarbetsyta, centralt modellregister, modelldistribution och modellövervakning. TR genomförde interna utbildningssessioner för sina affärsenheter ombord på plattformen och erbjöd dem självstyrda utbildningsvideor.

AI-plattformen har tillhandahållit kapacitet till TR:s team som aldrig funnits tidigare; det har öppnat ett brett utbud av möjligheter för TR:s företagsstyrningsteam att förbättra efterlevnadsstandarder och centralisera registret, vilket ger en enda glasruta över alla ML-modeller inom TR.

TR erkänner att ingen produkt är som bäst vid första lanseringen. Alla TR:s komponenter är på olika mognadsnivåer, och TR:s Enterprise AI Platform-team befinner sig i en kontinuerlig förbättringsfas för att iterativt förbättra produktfunktionerna. TR:s nuvarande utvecklingspipeline inkluderar att lägga till ytterligare SageMaker-inferensalternativ som realtids-, asynkron- och flermodellslutpunkter. TR planerar också att lägga till modellförklaring som en funktion till sin modellövervakningstjänst. TR planerar att använda förklaringsförmågan hos SageMaker Clarify för att utveckla sin interna förklaringstjänst.

Slutsats

TR kan nu bearbeta enorma mängder data på ett säkert sätt och använda avancerade AWS-funktioner för att ta ett ML-projekt från idé till produktion under loppet av veckor, jämfört med månaderna det tog innan. Med de out-of-the-box-möjligheterna hos AWS-tjänster kan team inom TR registrera och övervaka ML-modeller för första gången någonsin, och uppnå överensstämmelse med deras utvecklande modellstyrningsstandarder. TR gav datavetare och produktteam möjlighet att effektivt släppa lös sin kreativitet för att lösa de flesta komplexa problem.

För att veta mer om TR:s Enterprise AI-plattform på AWS, kolla in AWS re:Invent 2022-session. Om du vill lära dig hur TR accelererade användningen av maskininlärning med hjälp av AWS Data Lab program, se fallstudie.

Om författarna

Ramdev Wudali är en dataarkitekt som hjälper arkitekten och bygga AI/ML-plattformen för att göra det möjligt för datavetare och forskare att utveckla lösningar för maskininlärning genom att fokusera på datavetenskap och inte på infrastrukturbehoven. På fritiden älskar han att vika papper för att skapa origami-tesselationer och att bära vanvördiga t-shirts.

Ramdev Wudali är en dataarkitekt som hjälper arkitekten och bygga AI/ML-plattformen för att göra det möjligt för datavetare och forskare att utveckla lösningar för maskininlärning genom att fokusera på datavetenskap och inte på infrastrukturbehoven. På fritiden älskar han att vika papper för att skapa origami-tesselationer och att bära vanvördiga t-shirts.

Kiran Mantripragada är Senior Director för AI Platform på Thomson Reuters. AI Platform-teamet är ansvarigt för att möjliggöra produktionsklassade AI-programvaruapplikationer och möjliggöra arbetet för datavetare och maskininlärningsforskare. Med en passion för vetenskap, AI och ingenjörskonst gillar Kiran att överbrygga klyftan mellan forskning och produktisering för att föra den verkliga innovationen av AI till slutkonsumenterna.

Kiran Mantripragada är Senior Director för AI Platform på Thomson Reuters. AI Platform-teamet är ansvarigt för att möjliggöra produktionsklassade AI-programvaruapplikationer och möjliggöra arbetet för datavetare och maskininlärningsforskare. Med en passion för vetenskap, AI och ingenjörskonst gillar Kiran att överbrygga klyftan mellan forskning och produktisering för att föra den verkliga innovationen av AI till slutkonsumenterna.

Bhavana Chirumamilla är Sr. Resident Architect på AWS. Hon brinner för data- och ML-verksamhet och tillför massor av entusiasm för att hjälpa företag att bygga data- och ML-strategier. På fritiden njuter hon av tid med familjen på att resa, vandra, arbeta i trädgården och titta på dokumentärer.

Bhavana Chirumamilla är Sr. Resident Architect på AWS. Hon brinner för data- och ML-verksamhet och tillför massor av entusiasm för att hjälpa företag att bygga data- och ML-strategier. På fritiden njuter hon av tid med familjen på att resa, vandra, arbeta i trädgården och titta på dokumentärer.

Srinivasa Shaik är en lösningsarkitekt på AWS baserad i Boston. Han hjälper företagskunder att påskynda sin resa till molnet. Han brinner för containrar och maskininlärningsteknik. På fritiden gillar han att umgås med familjen, laga mat och resa.

Srinivasa Shaik är en lösningsarkitekt på AWS baserad i Boston. Han hjälper företagskunder att påskynda sin resa till molnet. Han brinner för containrar och maskininlärningsteknik. På fritiden gillar han att umgås med familjen, laga mat och resa.

Qingwei Li är maskininlärningsspecialist på Amazon Web Services. Han fick sin doktorsexamen i Operations Research efter att han bröt sin rådgivares forskningsbidragskonto och inte lyckades leverera det Nobelpris han lovade. För närvarande hjälper han kunder inom finanssektorn och försäkringsbranschen att bygga maskininlärningslösningar på AWS. På fritiden gillar han att läsa och undervisa.

Qingwei Li är maskininlärningsspecialist på Amazon Web Services. Han fick sin doktorsexamen i Operations Research efter att han bröt sin rådgivares forskningsbidragskonto och inte lyckades leverera det Nobelpris han lovade. För närvarande hjälper han kunder inom finanssektorn och försäkringsbranschen att bygga maskininlärningslösningar på AWS. På fritiden gillar han att läsa och undervisa.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- 7

- a

- Able

- Om Oss

- accelerera

- accelererad

- tillgång

- tillgänglig

- Enligt

- Konto

- Redovisning

- uppnås

- uppnå

- förvärva

- tvärs

- Handling

- handlingar

- Annat

- adress

- anta

- avancerat

- Efter

- AI

- AI-plattform

- AI-tjänster

- AI / ML

- Alla

- tillåter

- vid sidan av

- amason

- Amazon SageMaker

- Amazon Web Services

- mängder

- och

- api

- tillämpningar

- tillämpas

- tillvägagångssätt

- tillvägagångssätt

- godkännande

- arkitektur

- runt

- tillstånd

- automatisera

- Automatiserad

- Automat

- tillgänglig

- AWS

- baserat

- Baslinje

- därför att

- innan

- Där vi får lov att vara utan att konstant prestera,

- BÄST

- bästa praxis

- mellan

- förspänning

- miljarder

- boston

- BRO

- föra

- Bringar

- Pank

- SLUTRESULTAT

- Byggnad

- bygger

- byggt

- belastning

- företag

- affärsfunktioner

- kapacitet

- fall

- katalog

- kategorier

- orsakas

- centrala

- centraliserad

- utmaningar

- ta

- välja

- valda

- nära

- cloud

- molninfrastruktur

- Cloud Security

- koda

- samarbeta

- samarbetat

- samverkan

- kollektivt

- kommande

- Gemensam

- jämfört

- fullborda

- komplex

- Komplexiteten

- Efterlevnad

- kompatibel

- komponent

- komponenter

- Består

- databehandling

- konsumeras

- konsumenter

- Behållare

- Behållare

- innehåll

- fortsätta

- kontinuerlig

- kontroll

- Kärna

- skapa

- skapas

- Skapa

- kreativitet

- kritisk

- avgörande

- Aktuella

- För närvarande

- beställnings

- Kunder

- datum

- datasjö

- databehandling

- datavetenskap

- databaser

- Beslutsfattande

- djup

- djup expertis

- Standard

- leverera

- leverans

- DEMOKRATISERA

- distribuera

- utplacering

- vecklas ut

- beskriva

- Designa

- desktop

- detalj

- bestämd

- utveckla

- utvecklade

- utvecklare

- utveckla

- Utveckling

- olika

- svårt

- Direktör

- diskutera

- dokumentärer

- domän

- domäner

- ner

- Tidig

- lättare

- lätt

- effektivt

- effektiv

- ansträngning

- befogenhet

- möjliggöra

- aktiverad

- möjliggör

- möjliggör

- uppmuntrar

- Slutpunkt

- Motor

- Teknik

- Ingenjörer

- Motorer

- förbättrad

- säkerställa

- säkerställa

- Företag

- företag

- entusiasm

- Miljö

- fel

- väsentlig

- etisk

- utvärderade

- händelser

- NÅGONSIN

- utvecklas

- utvecklas

- exempel

- experimentera

- expertis

- förlänga

- extremt

- främja

- Misslyckades

- familj

- Leverans

- Funktioner

- få

- slutlig

- finansiella

- finansiell tjänst

- hitta

- finna

- Förnamn

- första gången

- Fokus

- fokusering

- följer

- efter

- följer

- formell

- ramar

- från

- Uppfylla

- fullständigt

- funktionalitet

- funktioner

- framtida

- spalt

- Allmänt

- genereras

- skaffa sig

- glas

- Go

- Mål

- styrning

- bevilja

- Marken

- Odling

- Arbetsmiljö

- Hård

- Hälsa

- hjälpa

- hjälpa

- hjälper

- höggradigt

- värd

- Hur ser din drömresa ut

- Men

- html

- HTTPS

- identifierade

- identifiera

- identifiera

- Identitet

- bilder

- Inverkan

- genomföra

- genomföras

- genomföra

- ålagts

- förbättra

- in

- innefattar

- Öka

- oberoende

- oberoende av

- industrin

- Infrastruktur

- inledande

- Innovation

- insikter

- istället

- försäkring

- integrerade

- Gränssnitt

- inre

- involverade

- isolering

- fråga

- IT

- Jobb

- Lediga jobb

- resa

- Nyckel

- Vet

- kunskap

- sjö

- lansera

- lanserades

- lansera

- LÄRA SIG

- inlärning

- Legacy

- Adress

- Nivå

- nivåer

- bibliotek

- BEGRÄNSA

- gränser

- lever

- lokal

- Maskinen

- maskininlärning

- gjord

- större

- GÖR

- Framställning

- hantera

- ledning

- hantera

- mandat

- sätt

- manuell

- många

- förfall

- åtgärder

- Medlemmar

- metadata

- metoder

- metriska

- Metrics

- microservices

- migrera

- milstolpe

- delmål

- emot

- minuter

- Mildra

- ML

- modell

- modeller

- Övervaka

- övervakning

- monitorer

- månader

- mer

- mest

- multipel

- Natural

- Navigera

- Behöver

- behov

- nätverk

- Nya

- nyheter

- Nästa

- Nobelpriset

- antal

- objektet

- tillfällig

- erbjuds

- erbjuda

- Erbjudanden

- Ombord

- ONE

- öppen källkod

- öppnade

- Verksamhet

- Tillbehör

- orkestrering

- organisation

- ursprungligen

- utanför

- egen

- ägaren

- panelen

- Papper

- parametrar

- brinner

- brinner

- mönster

- Personer

- prestanda

- periodisk

- fas

- rörledning

- planering

- planer

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Punkt

- Strategier

- policy

- Portal

- Möjligheterna

- Inlägg

- potentiell

- kraft

- praxis

- Förutsägelser

- föredragen

- primär

- Principerna

- Priset

- Problem

- problem

- process

- processer

- bearbetning

- Produkt

- Produktion

- Produkter

- yrkesmän/kvinnor

- Program

- projektet

- projekt

- utlovade

- ge

- förutsatt

- ger

- tillhandahålla

- Q3

- q3 2022

- snabbt

- område

- som sträcker sig

- RE

- kommit fram till

- Läsning

- verklig

- realtid

- mottagna

- registrera

- register

- föreskrifter

- regulatorer

- frigöra

- frigörs

- ta bort

- Repository

- begära

- Obligatorisk

- Krav

- forskning

- forskare

- resurs

- Resurser

- ansvarig

- Reuters

- Risk

- Roll

- roller

- regler

- Körning

- sagemaker

- SageMaker Inference

- skalbar

- Skala

- tidtabellen

- Vetenskap

- vetenskapsmän

- sömlös

- sömlöst

- Sök

- Sökmotorer

- sektioner

- säkra

- Säkrad

- säkert

- säkerhet

- skicka

- senior

- känslig

- tjänar

- Server

- service

- Tjänster

- sessioner

- flera

- Dela

- visas

- Enkelt

- eftersom

- enda

- Storlek

- storlekar

- skicklig

- färdigheter

- Snapshot

- So

- Mjukvara

- lösning

- Lösningar

- LÖSA

- Källor

- specialist

- specifik

- spendera

- Spendera

- Etapp

- intressenter

- standardisera

- standarder

- igång

- startar

- Stater

- status

- Steg

- Steg

- förvaring

- lagra

- lagrar

- strategier

- effektivisera

- studio

- sådana

- Som stöds

- Stödjande

- bytte

- synkronisering

- bord

- Ta

- skatt

- Undervisning

- grupp

- lag

- Teknisk

- tekniska förmågor

- Tekniken

- mallar

- villkor

- Smakämnen

- deras

- därför

- Thomson Reuters

- Genom

- hela

- tid

- till

- verktyg

- Spårning

- traditionell

- Tåg

- Utbildning

- Förvandla

- Öppenhet

- Traveling

- enorm

- triggas

- förstå

- enhet

- enheter

- frigöra

- obegränsat

- Uppdatering

- användning

- Användare

- användare

- mängd

- olika

- Omfattande

- via

- Video

- utsikt

- synlighet

- tittar

- webb

- webbservice

- Webb-baserad

- veckor

- om

- medan

- bred

- Brett utbud

- kommer

- vinna

- inom

- utan

- Arbete

- arbetade

- arbetsflöden

- inom hela sverige

- skulle

- år

- Din

- zephyrnet