I det här inlägget visar vi hur man använder neural arkitektursökning (NAS) baserad strukturell beskärning för att komprimera en finjusterad BERT-modell för att förbättra modellens prestanda och minska slutledningstider. Förutbildade språkmodeller (PLM) genomgår snabb kommersiell och företagsadoption inom områdena produktivitetsverktyg, kundservice, sökning och rekommendationer, automatisering av affärsprocesser och skapande av innehåll. Att distribuera PLM-slutpunkter är vanligtvis förknippat med högre latens och högre infrastrukturkostnader på grund av beräkningskraven och minskad beräkningseffektivitet på grund av det stora antalet parametrar. Att beskära en PLM minskar storleken och komplexiteten på modellen samtidigt som den behåller dess förutsägande förmåga. Beskärda PLM:er uppnår ett mindre minnesfotavtryck och lägre latens. Vi visar att genom att beskära en PLM och byta ut parameterräkning och valideringsfel för en specifik måluppgift, och vi kan uppnå snabbare svarstider jämfört med bas-PLM-modellen.

Multi-objektiv optimering är ett område för beslutsfattande som optimerar mer än en objektiv funktion, såsom minnesförbrukning, träningstid och beräkningsresurser, för att optimeras samtidigt. Strukturell beskärning är en teknik för att minska storleken och beräkningskraven för PLM genom att beskära lager eller neuroner/noder samtidigt som man försöker bevara modellens noggrannhet. Genom att ta bort lager, uppnår strukturell beskärning högre kompressionshastigheter, vilket leder till hårdvaruvänlig strukturerad sparsamhet som minskar körtider och svarstider. Att tillämpa en strukturell beskärningsteknik på en PLM-modell resulterar i en lättare modell med ett lägre minnesfotavtryck som, när den lagras som en slutpunkt i SageMaker, erbjuder förbättrad resurseffektivitet och lägre kostnad jämfört med den ursprungliga finjusterade PLM.

Koncepten som illustreras i det här inlägget kan tillämpas på applikationer som använder PLM-funktioner, såsom rekommendationssystem, sentimentanalys och sökmotorer. Specifikt kan du använda det här tillvägagångssättet om du har dedikerade team för maskininlärning (ML) och datavetenskap som finjusterar sina egna PLM-modeller med hjälp av domänspecifika datamängder och distribuerar ett stort antal slutpunkter med Amazon SageMaker. Ett exempel är en onlineåterförsäljare som använder ett stort antal slutpunkter för slutpunkter för textsammanfattning, produktkatalogklassificering och produktfeedback sentimentklassificering. Ett annat exempel kan vara en vårdgivare som använder PLM slutpunkter för klassificering av kliniska dokument, namngiven enhetsidentifiering från medicinska rapporter, medicinska chatbots och patientriskstratifiering.

Lösningsöversikt

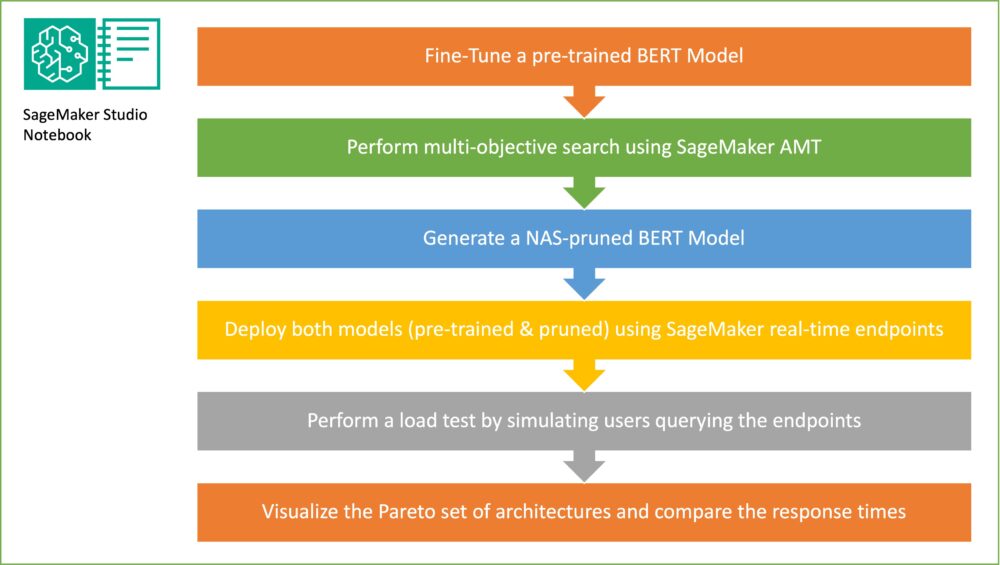

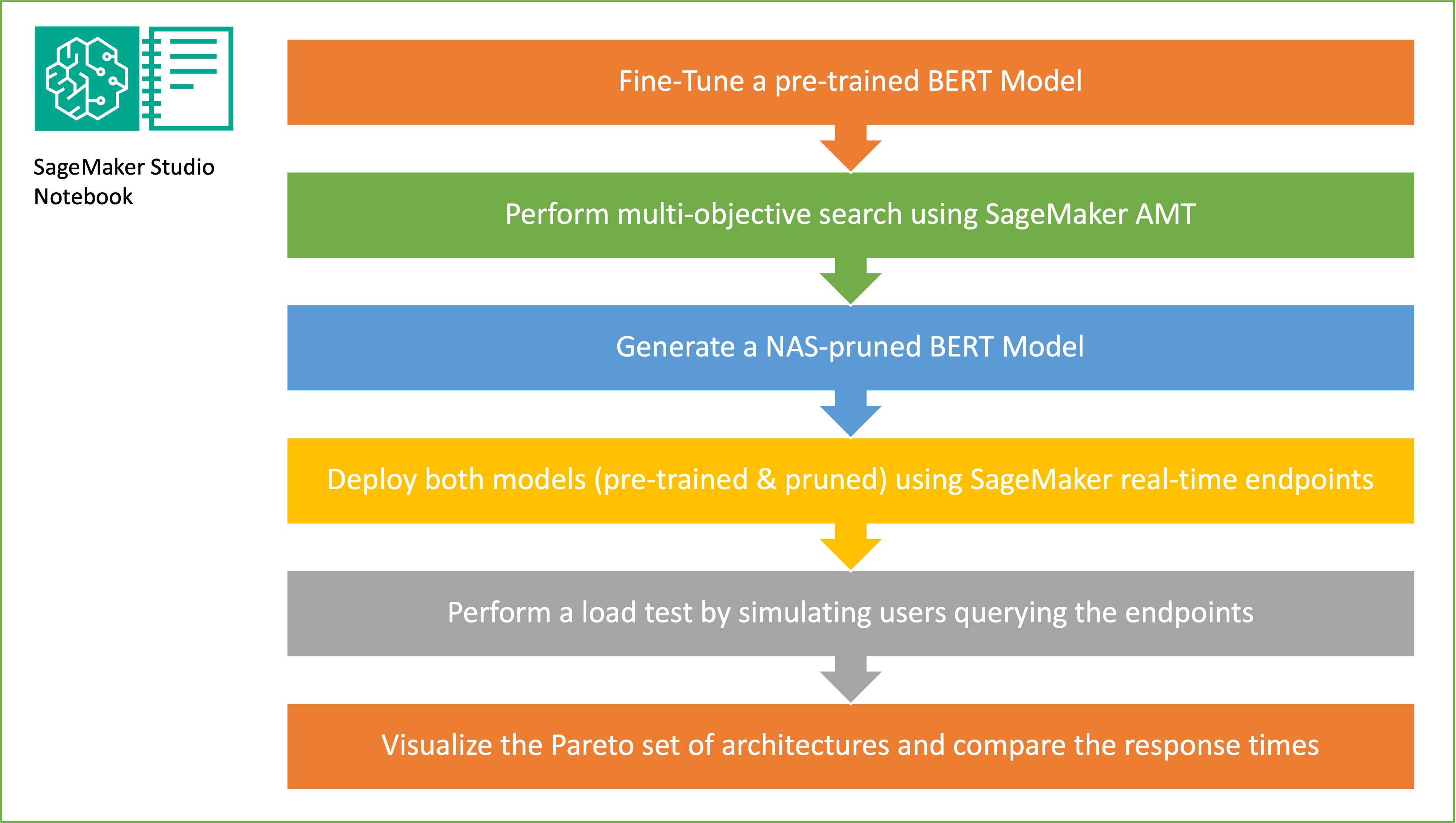

I det här avsnittet presenterar vi det övergripande arbetsflödet och förklarar tillvägagångssättet. Först använder vi en Amazon SageMaker Studio anteckningsbok att finjustera en förtränad BERT-modell på en måluppgift med hjälp av en domänspecifik datauppsättning. BERTI (Bidirectional Encoder Representations from Transformers) är en förtränad språkmodell baserad på transformatorarkitektur används för NLP-uppgifter (natural language processing). Neural architecture search (NAS) är ett tillvägagångssätt för att automatisera designen av artificiella neurala nätverk och är nära besläktat med hyperparameteroptimering, ett allmänt använt tillvägagångssätt inom området maskininlärning. Målet med NAS är att hitta den optimala arkitekturen för ett givet problem genom att söka över en stor uppsättning kandidatarkitekturer med hjälp av tekniker som gradientfri optimering eller genom att optimera önskade mätvärden. Arkitekturens prestanda mäts vanligtvis med hjälp av mätvärden som valideringsförlust. SageMaker Automatisk modellinställning (AMT) automatiserar den tråkiga och komplexa processen att hitta de optimala kombinationerna av hyperparametrar i ML-modellen som ger den bästa modellens prestanda. AMT använder intelligenta sökalgoritmer och iterativa utvärderingar med hjälp av en rad hyperparametrar som du anger. Den väljer hyperparametervärdena som skapar en modell som presterar bäst, mätt med prestandamått som noggrannhet och F-1-poäng.

Finjusteringsmetoden som beskrivs i det här inlägget är generisk och kan tillämpas på alla textbaserade datauppsättningar. Uppgiften som tilldelas BERT PLM kan vara en textbaserad uppgift som sentimentanalys, textklassificering eller frågor och svar. I denna demo är måluppgiften ett binärt klassificeringsproblem där BERT används för att identifiera, från en datauppsättning som består av en samling par av textfragment, om betydelsen av ett textfragment kan härledas från det andra fragmentet. Vi använder Identifiera textuella entailment dataset från benchmarking-sviten GLUE. Vi utför en multi-objektiv sökning med SageMaker AMT för att identifiera de undernätverk som erbjuder optimala avvägningar mellan parameterantal och prediktionsnoggrannhet för måluppgiften. När vi utför en multi-objektiv sökning börjar vi med att definiera noggrannheten och parameterantalet som de mål som vi strävar efter att optimera.

Inom BERT PLM-nätverket kan det finnas modulära, fristående delnätverk som tillåter modellen att ha specialiserade möjligheter som språkförståelse och kunskapsrepresentation. BERT PLM använder ett multi-headed självuppmärksamhet sub-nätverk och ett feed-forward sub-nätverk. Ett flerhövdat, självuppmärksamhetslager tillåter BERT att relatera olika positioner av en enda sekvens för att beräkna en representation av sekvensen genom att tillåta flera huvuden att ta hand om flera kontextsignaler. Inmatningen är uppdelad i flera underutrymmen och självuppmärksamhet appliceras på var och en av underutrymmena separat. Flera huvuden i en transformator PLM tillåter modellen att gemensamt ta hand om information från olika representationsdelrum. Ett feed-forward-undernätverk är ett enkelt neuralt nätverk som tar utdata från det flerhövdade självuppmärksamhetsundernätverket, bearbetar data och returnerar de slutliga kodarrepresentationerna.

Målet med slumpmässigt urval av undernätverk är att träna mindre BERT-modeller som kan prestera tillräckligt bra på måluppgifter. Vi samplar 100 slumpmässiga delnätverk från den finjusterade BERT-basmodellen och utvärderar 10 nätverk samtidigt. De tränade undernätverken utvärderas för de objektiva måtten och den slutliga modellen väljs utifrån de avvägningar som finns mellan de objektiva måtten. Vi visualiserar Pareto fram för de samplade delnätverken, som innehåller den beskärda modellen som erbjuder den optimala avvägningen mellan modellnoggrannhet och modellstorlek. Vi väljer kandidatundernätverket (NAS-beskärad BERT-modell) baserat på modellstorleken och modellnoggrannheten som vi är villiga att byta ut. Därefter är vi värd för slutpunkterna, den förtränade BERT-basmodellen och den NAS-beskärade BERT-modellen med SageMaker. För att utföra lasttestning använder vi Gräshoppa, ett belastningstestverktyg med öppen källkod som du kan implementera med Python. Vi kör belastningstestning på båda ändpunkterna med Locust och visualiserar resultaten med hjälp av Pareto-fronten för att illustrera avvägningen mellan svarstider och noggrannhet för båda modellerna. Följande diagram ger en översikt över arbetsflödet som förklaras i det här inlägget.

Förutsättningar

För denna tjänst krävs följande förutsättningar:

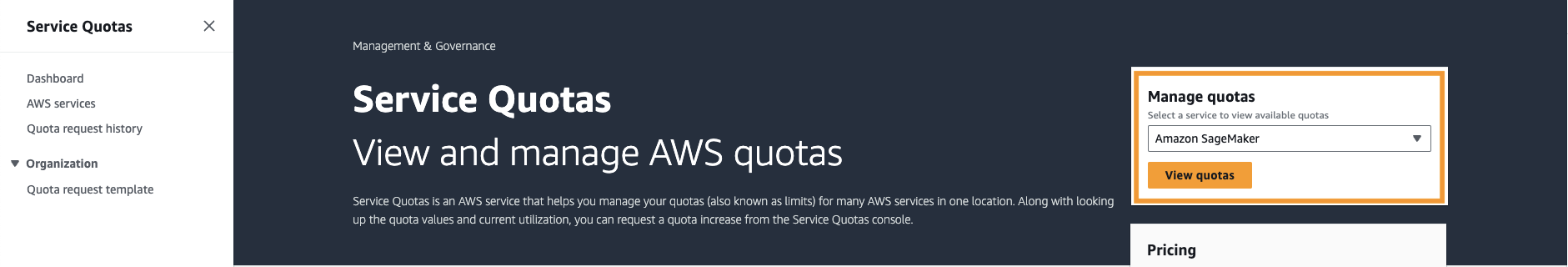

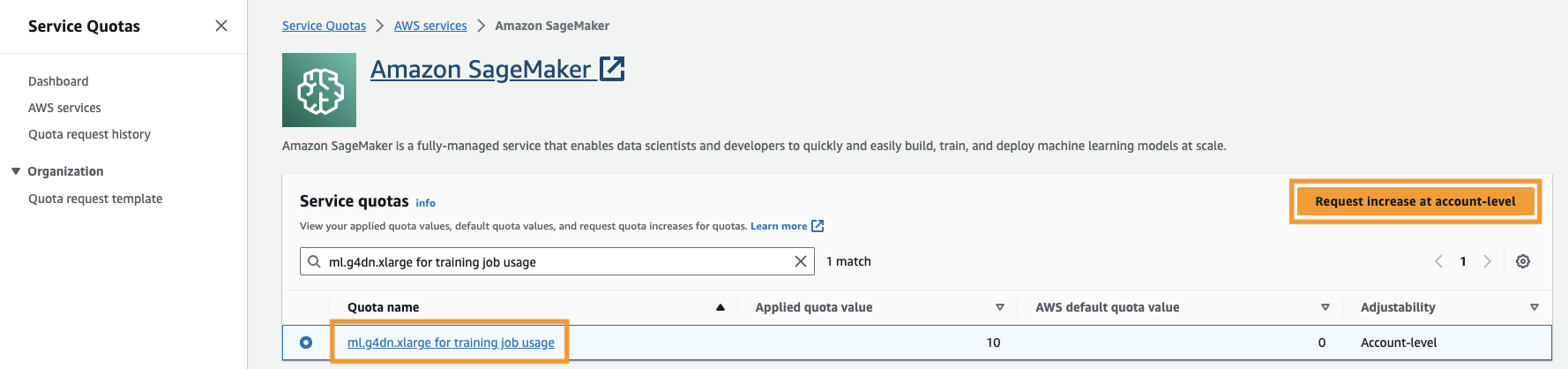

Du måste också öka tjänstekvot för att komma åt minst tre instanser av ml.g4dn.xlarge-instanser i SageMaker. Instanstypen ml.g4dn.xlarge är den kostnadseffektiva GPU-instansen som låter dig köra PyTorch inbyggt. För att öka tjänstekvoten, utför följande steg:

- På konsolen, navigera till Service Quotas.

- För Hantera kvoterväljer Amazon SageMakerOch välj sedan Se kvoter.

- Sök efter "ml-g4dn.xlarge för träningsjobbanvändning" och välj kvotposten.

- Välja Begär ökning på kontonivå.

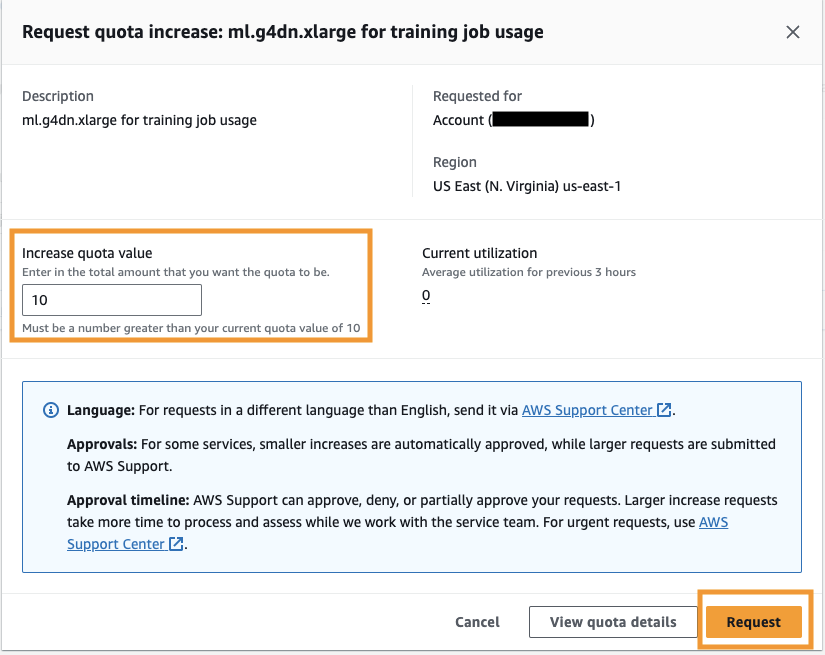

- För Öka kvotvärdet, ange ett värde på 5 eller högre.

- Välja FÖRFRÅGAN.

Det begärda kvotgodkännandet kan ta lite tid att slutföra beroende på kontobehörigheterna.

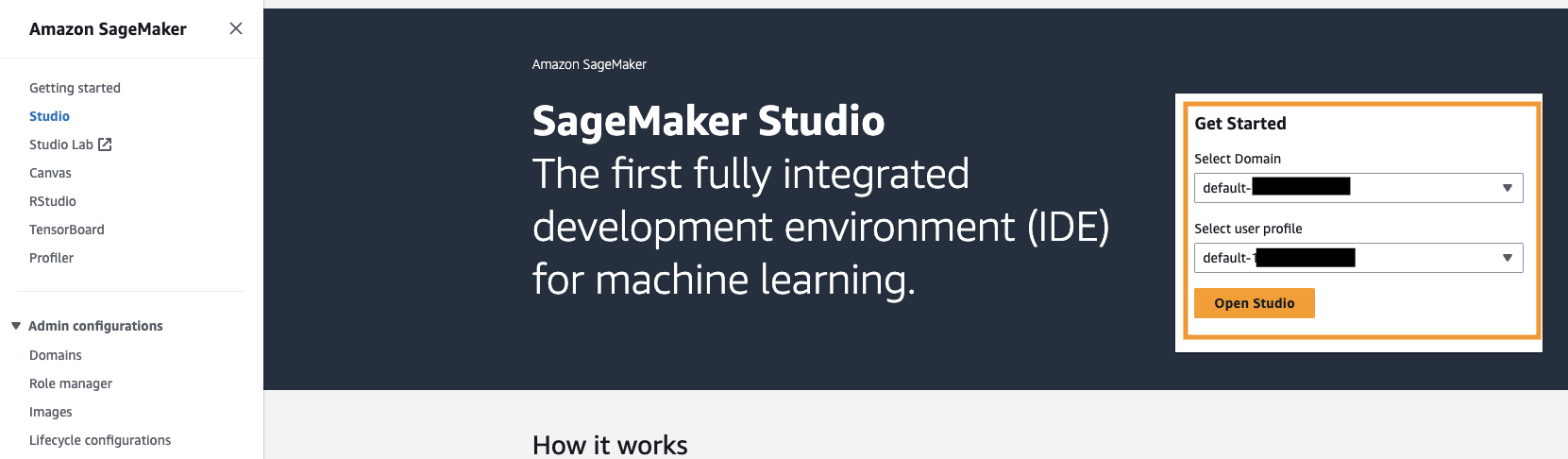

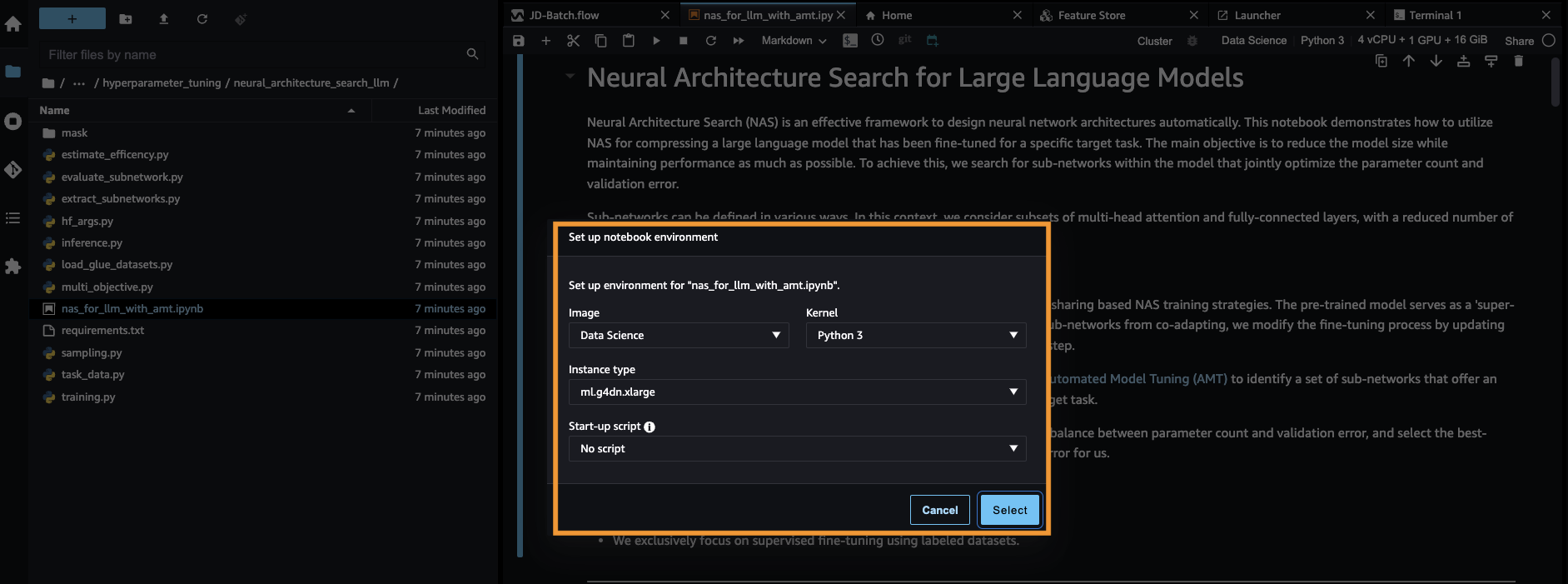

- Öppna SageMaker Studio från SageMaker-konsolen.

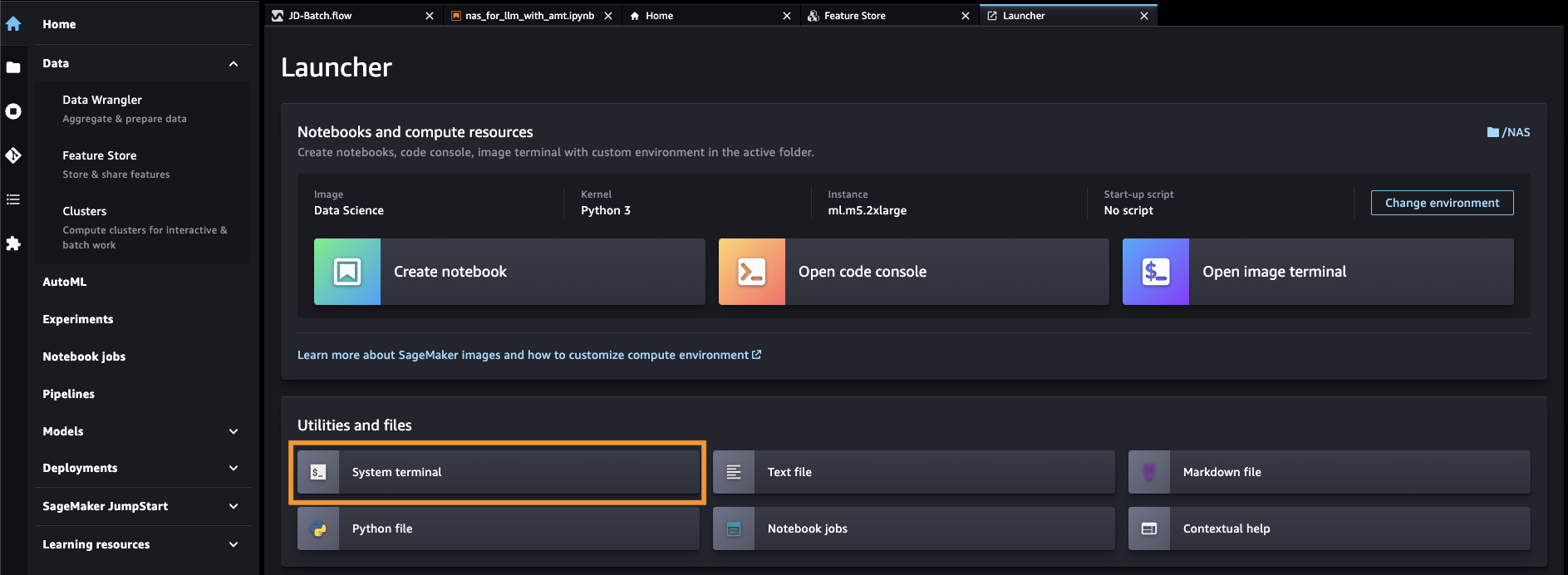

- Välja Systemterminal under Verktyg och filer.

- Kör följande kommando för att klona GitHub repo till SageMaker Studio-instansen:

- Navigera till

amazon-sagemaker-examples/hyperparameter_tuning/neural_architecture_search_llm. - Öppna filen

nas_for_llm_with_amt.ipynb. - Ställ in miljön med en

ml.g4dn.xlargeinstans och välj Välja.

Ställ in den förutbildade BERT-modellen

I det här avsnittet importerar vi datasetet Recognizing Textual Entailment från datauppsättningsbiblioteket och delar upp datauppsättningen i tränings- och valideringsuppsättningar. Denna datauppsättning består av meningspar. BERT PLM:s uppgift är att, givet två textfragment, känna igen om betydelsen av ett textfragment kan härledas från det andra fragmentet. I följande exempel kan vi härleda betydelsen av den första frasen från den andra frasen:

Vi laddar datauppsättningen för textigenkännande involvering från LIM benchmarking svit via datauppsättningsbibliotek från Hugging Face i vårt träningsmanus (./training.py). Vi delade upp den ursprungliga träningsdatauppsättningen från GLUE i ett tränings- och valideringsset. I vårt tillvägagångssätt finjusterar vi BERT-basmodellen med hjälp av träningsdatauppsättningen, sedan utför vi en multi-objektiv sökning för att identifiera uppsättningen av undernätverk som balanserar optimalt mellan de objektiva måtten. Vi använder träningsdataset enbart för att finjustera BERT-modellen. Däremot använder vi valideringsdata för sökningen med flera mål genom att mäta noggrannheten på datauppsättningen för holdoutvalidering.

Finjustera BERT PLM med hjälp av en domänspecifik datauppsättning

De typiska användningsfallen för en rå BERT-modell inkluderar nästa meningsprediktion eller maskerad språkmodellering. För att använda BERT-basmodellen för nedströmsuppgifter som textigenkänning, måste vi finjustera modellen ytterligare med hjälp av en domänspecifik datauppsättning. Du kan använda en finjusterad BERT-modell för uppgifter som sekvensklassificering, frågesvar och tokenklassificering. Men för denna demo använder vi den finjusterade modellen för binär klassificering. Vi finjusterar den förtränade BERT-modellen med träningsdataset som vi förberedde tidigare, med hjälp av följande hyperparametrar:

Vi sparar modellutbildningens kontrollpunkt till en Amazon enkel lagringstjänst (Amazon S3) hink, så att modellen kan laddas under den NAS-baserade flerobjektssökningen. Innan vi tränar modellen definierar vi måtten som epok, träningsförlust, antal parametrar och valideringsfel:

Efter att finjusteringsprocessen startar tar träningsjobbet cirka 15 minuter att slutföra.

Utför en sökning med flera mål för att välja undernätverk och visualisera resultaten

I nästa steg utför vi en multi-objektiv sökning på den finjusterade BERT-basmodellen genom att sampla slumpmässiga undernätverk med SageMaker AMT. För att komma åt ett undernätverk inom supernätverket (den finjusterade BERT-modellen) maskerar vi alla komponenter i PLM som inte är en del av undernätverket. Att maskera ett supernätverk för att hitta undernätverk i en PLM är en teknik som används för att isolera och identifiera mönster av modellens beteende. Observera att Hugging Face-transformatorer behöver den dolda storleken för att vara en multipel av antalet huvuden. Den dolda storleken i en transformator PLM styr storleken på det dolda tillståndsvektorutrymmet, vilket påverkar modellens förmåga att lära sig komplexa representationer och mönster i data. I en BERT PLM har den dolda tillståndsvektorn en fast storlek (768). Vi kan inte ändra den dolda storleken, och därför måste antalet huvuden vara i [1, 3, 6, 12].

I motsats till optimering med en enda målsättning har vi vanligtvis inte en enda lösning som optimerar alla mål samtidigt. Istället strävar vi efter att samla en uppsättning lösningar som dominerar alla andra lösningar i minst ett mål (som valideringsfel). Nu kan vi starta sökningen med flera mål genom AMT genom att ställa in mätvärdena som vi vill minska (valideringsfel och antal parametrar). De slumpmässiga undernätverken definieras av parametern max_jobs och antalet samtidiga jobb definieras av parametern max_parallel_jobs. Koden för att ladda modellens kontrollpunkt och utvärdera undernätverket är tillgänglig i evaluate_subnetwork.py skript.

AMT-inställningsjobbet tar cirka 2 timmar och 20 minuter att köra. Efter att AMT-inställningsjobbet har körts framgångsrikt analyserar vi jobbets historik och samlar in undernätverkets konfigurationer, såsom antal huvuden, antal lager, antal enheter och motsvarande mätvärden såsom valideringsfel och antal parametrar. Följande skärmdump visar sammanfattningen av ett framgångsrikt AMT-tunerjobb.

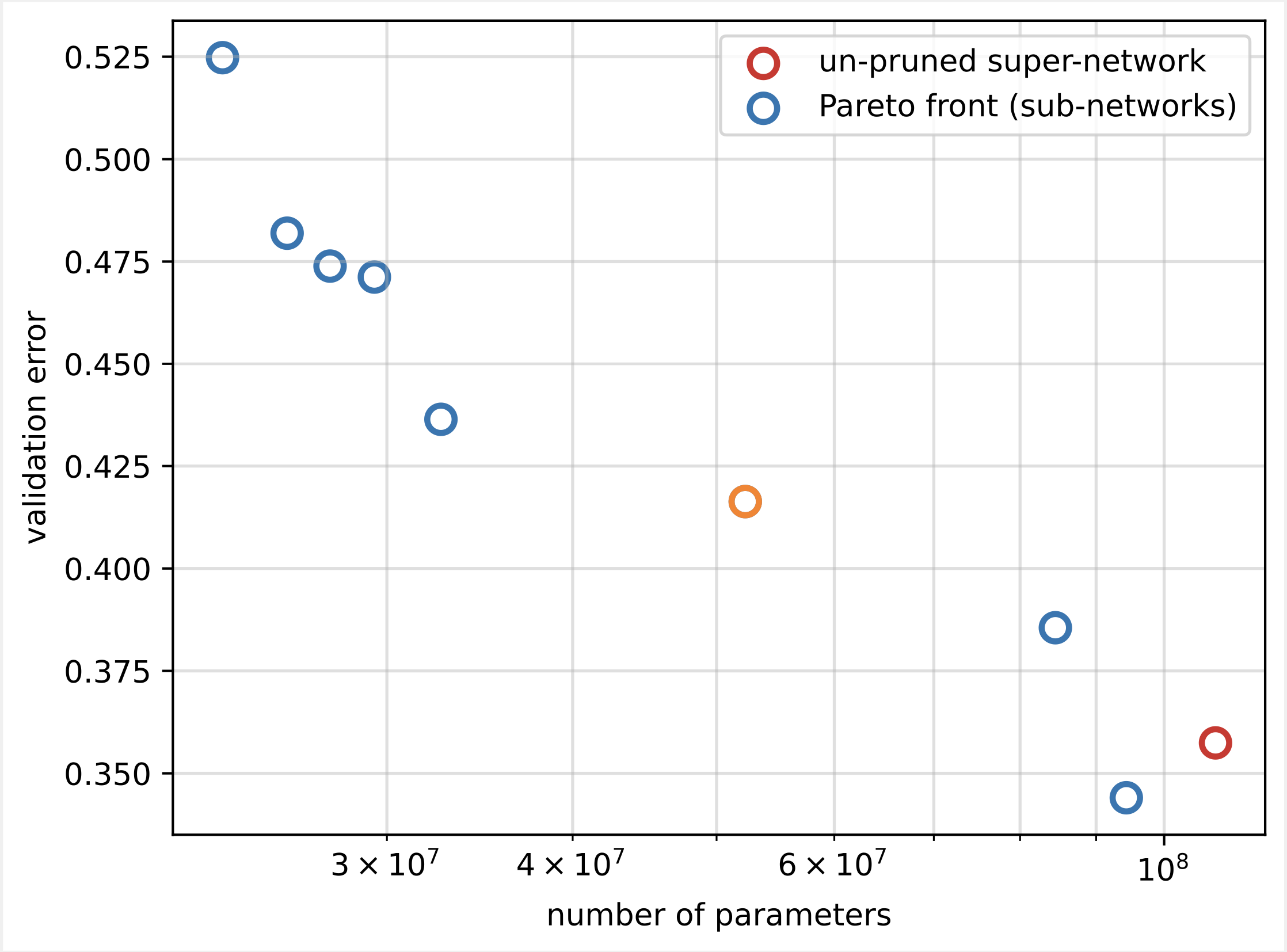

Därefter visualiserar vi resultaten med hjälp av en Pareto-uppsättning (även känd som Pareto-gräns eller Pareto-optimal uppsättning), som hjälper oss att identifiera optimala uppsättningar av undernätverk som dominerar alla andra undernätverk i det objektiva måttet (valideringsfel):

Först samlar vi in data från AMT-inställningsjobbet. Sedan ritar vi upp Pareto-uppsättningen med hjälp av matplotlob.pyplot med antal parametrar i x-axeln och valideringsfel i y-axeln. Detta innebär att när vi flyttar från ett undernätverk av Pareto-uppsättningen till ett annat måste vi antingen offra prestanda eller modellstorlek men förbättra den andra. I slutändan ger Pareto-setet oss flexibiliteten att välja det undernätverk som bäst passar våra preferenser. Vi kan bestämma hur mycket vi vill minska storleken på vårt nätverk och hur mycket prestanda vi är villiga att offra.

Distribuera den finjusterade BERT-modellen och den NAS-optimerade subnätverksmodellen med SageMaker

Därefter distribuerar vi den största modellen i vårt Pareto-set som leder till minsta möjliga prestandadegenerering till en SageMaker slutpunkt. Den bästa modellen är den som ger en optimal avvägning mellan valideringsfelet och antalet parametrar för vårt användningsfall.

Modelljämförelse

Vi tog en förtränad BERT-basmodell, finjusterade den med hjälp av en domänspecifik datauppsättning, körde en NAS-sökning för att identifiera dominerande undernätverk baserat på objektiva mätvärden och distribuerade den beskärda modellen på en SageMaker-slutpunkt. Dessutom tog vi den förutbildade BERT-basmodellen och distribuerade basmodellen på en andra SageMaker-slutpunkt. Därefter sprang vi belastningstestning använde Locust på båda slutpunkterna och utvärderade prestandan i termer av svarstid.

Först importerar vi de nödvändiga Locust- och Boto3-biblioteken. Sedan konstruerar vi en begäran metadata och registrerar starttiden som ska användas för belastningstestning. Sedan skickas nyttolasten till SageMaker endpoint invoke API via BotoClient för att simulera verkliga användarförfrågningar. Vi använder Locust för att skapa flera virtuella användare för att skicka förfrågningar parallellt och mäta slutpunktsprestanda under belastningen. Tester körs genom att öka antalet användare för var och en av de två slutpunkterna. Efter att testerna är slutförda matar Locust ut en CSV-fil för begäranstatistik för var och en av de distribuerade modellerna.

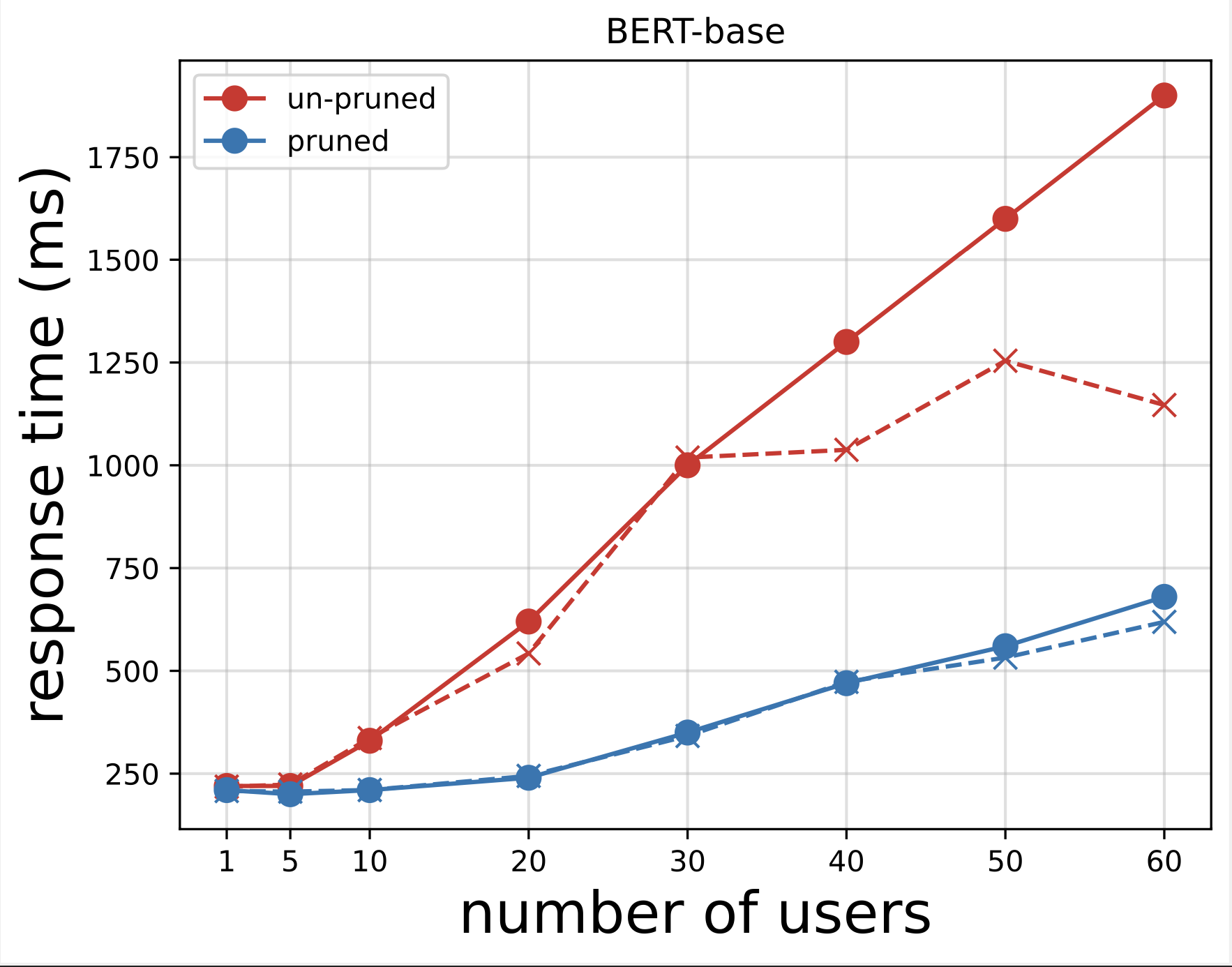

Därefter genererar vi svarstidsdiagrammen från de CSV-filer som laddats ner efter att ha kört testen med Locust. Syftet med att plotta svarstiden vs. antalet användare är att analysera belastningstestresultaten genom att visualisera effekten av responstiden för modellens slutpunkter. I följande diagram kan vi se att den NAS-beskärade modellens slutpunkt uppnår en lägre svarstid jämfört med den grundläggande BERT-modellens slutpunkt.

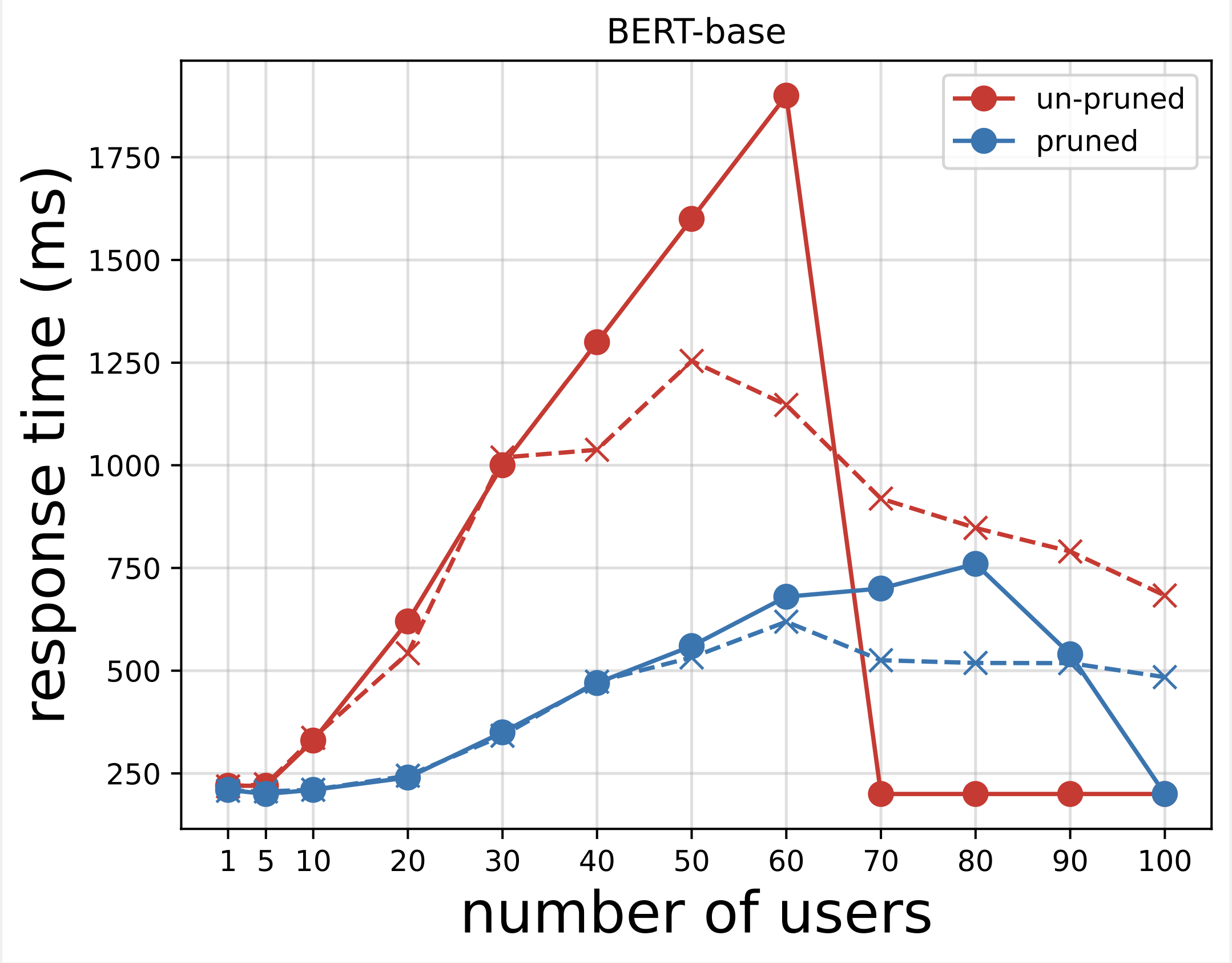

I det andra diagrammet, som är en förlängning av det första diagrammet, observerar vi att efter cirka 70 användare, börjar SageMaker att strypa BERT-basmodellens slutpunkt och kastar ett undantag. Men för den NAS-beskärade modellens slutpunkt sker strypningen mellan 90–100 användare och med en lägre svarstid.

Från de två diagrammen ser vi att den beskurna modellen har en snabbare svarstid och skalar bättre jämfört med den obeskärade modellen. När vi skalar antalet slutpunkter, vilket är fallet med användare som distribuerar ett stort antal slutpunkter för sina PLM-applikationer, börjar kostnadsfördelarna och prestandaförbättringen bli ganska betydande.

Städa upp

För att ta bort SageMaker-ändpunkterna för den finjusterade BERT-basmodellen och den NAS-beskärade modellen, utför följande steg:

- Välj på SageMaker-konsolen Slutledning och endpoints i navigeringsfönstret.

- Välj slutpunkten och ta bort den.

Alternativt, från SageMaker Studio-anteckningsboken, kör följande kommandon genom att ange slutpunktsnamnen:

Slutsats

I det här inlägget diskuterade vi hur man använder NAS för att beskära en finjusterad BERT-modell. Vi tränade först en bas BERT-modell med domänspecifik data och distribuerade den till en SageMaker-slutpunkt. Vi utförde en multi-objektiv sökning på den finjusterade basmodellen BERT med SageMaker AMT för en måluppgift. Vi visualiserade Pareto-fronten och valde den Pareto optimala NAS-beskärade BERT-modellen och distribuerade modellen till en andra SageMaker-slutpunkt. Vi utförde belastningstestning med Locust för att simulera användare som frågade båda slutpunkterna och mätte och registrerade svarstiderna i en CSV-fil. Vi plottade svarstiden kontra antalet användare för båda modellerna.

Vi observerade att den beskärade BERT-modellen presterade betydligt bättre i både svarstid och instansstrypningströskel. Vi drog slutsatsen att den NAS-beskärade modellen var mer motståndskraftig mot en ökad belastning på slutpunkten, och bibehöll en lägre svarstid även när fler användare stressade systemet jämfört med basmodellen BERT. Du kan tillämpa NAS-tekniken som beskrivs i det här inlägget på vilken stor språkmodell som helst för att hitta en beskuren modell som kan utföra måluppgiften med betydligt lägre svarstid. Du kan optimera tillvägagångssättet ytterligare genom att använda latens som en parameter förutom valideringsförlust.

Även om vi använder NAS i det här inlägget är kvantisering ett annat vanligt tillvägagångssätt som används för att optimera och komprimera PLM-modeller. Kvantisering minskar precisionen för vikterna och aktiveringarna i ett tränat nätverk från 32-bitars flyttal till lägre bitbredder som 8-bitars eller 16-bitars heltal, vilket resulterar i en komprimerad modell som genererar snabbare slutledning. Kvantisering minskar inte antalet parametrar; istället minskar det precisionen hos de befintliga parametrarna för att få en komprimerad modell. NAS-beskärning tar bort redundanta nätverk i en PLM, vilket skapar en sparsam modell med färre parametrar. Vanligtvis används NAS-beskärning och kvantisering tillsammans för att komprimera stora PLM:er för att bibehålla modellnoggrannhet, minska valideringsförluster samtidigt som prestanda förbättras och modellstorlek. De andra vanliga teknikerna för att minska storleken på PLM inkluderar kunskapsdestillation, matrisfaktoriseringoch destillationskaskader.

Tillvägagångssättet som föreslås i blogginlägget är lämpligt för team som använder SageMaker för att träna och finjustera modellerna med hjälp av domänspecifik data och distribuera slutpunkterna för att generera slutsatser. Om du letar efter en helt hanterad tjänst som erbjuder ett urval av högpresterande grundmodeller som behövs för att bygga generativa AI-applikationer, överväg att använda Amazonas berggrund. Om du letar efter förutbildade modeller med öppen källkod för ett brett spektrum av affärsanvändningsfall och vill komma åt lösningsmallar och exempelanteckningsböcker, överväg att använda Amazon SageMaker JumpStart. En förtränad version av Hugging Face BERT-modellen med basfodral som vi använde i det här inlägget är också tillgänglig från SageMaker JumpStart.

Om författarna

Aparajithan Vaidyanathan är en Principal Enterprise Solutions Architect på AWS. Han är en molnarkitekt med 24+ års erfarenhet av att designa och utveckla företag, storskaliga och distribuerade mjukvarusystem. Han är specialiserad på generativ AI och maskininlärning av datateknik. Han är en blivande maratonlöpare och hans hobbyer inkluderar vandring, cykling och att umgås med sin fru och två pojkar.

Aparajithan Vaidyanathan är en Principal Enterprise Solutions Architect på AWS. Han är en molnarkitekt med 24+ års erfarenhet av att designa och utveckla företag, storskaliga och distribuerade mjukvarusystem. Han är specialiserad på generativ AI och maskininlärning av datateknik. Han är en blivande maratonlöpare och hans hobbyer inkluderar vandring, cykling och att umgås med sin fru och två pojkar.

Aaron Klein är en Sr Applied Scientist vid AWS och arbetar med automatiserade maskininlärningsmetoder för djupa neurala nätverk.

Aaron Klein är en Sr Applied Scientist vid AWS och arbetar med automatiserade maskininlärningsmetoder för djupa neurala nätverk.

Jacek Golebiowski är Sr Applied Scientist vid AWS.

Jacek Golebiowski är Sr Applied Scientist vid AWS.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/reduce-inference-time-for-bert-models-using-neural-architecture-search-and-sagemaker-automated-model-tuning/

- : har

- :är

- :inte

- :var

- ][s

- $UPP

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 17

- 19

- 20

- 26%

- 30

- 31

- 320

- 7

- 70

- 72

- 8

- 9

- a

- förmåga

- Able

- tillgång

- Konto

- noggrannhet

- Uppnå

- uppnår

- aktiveringar

- Dessutom

- Antagande

- Efter

- AI

- Syftet

- sikta

- algoritmer

- Alla

- tillåter

- tillåta

- tillåter

- också

- amason

- Amazon Web Services

- mängd

- an

- analys

- analytics

- analysera

- och

- Annan

- svar

- vilken som helst

- api

- tillämpningar

- tillämpas

- Ansök

- Tillämpa

- tillvägagångssätt

- godkännande

- cirka

- arkitektur

- ÄR

- OMRÅDE

- områden

- argument

- runt

- konstgjord

- AS

- blivande

- delad

- associerad

- At

- försök

- förväntat

- Automatiserad

- automatiserar

- Automat

- automatisera

- Automation

- tillgänglig

- AWS

- Axis

- Balansera

- bas

- baserat

- BE

- blir

- innan

- beteende

- benchmarking

- Fördelarna

- BÄST

- Bättre

- mellan

- Bit

- kropp

- båda

- SLUTRESULTAT

- företag

- Affärsprocess

- men

- by

- KAN

- kandidat

- kapacitet

- Vid

- fall

- katalog

- byta

- Diagram

- Diagram

- chatbots

- val

- Välja

- valda

- klass

- klassificering

- Klinisk

- nära

- cloud

- koda

- samla

- samling

- kombinationer

- kommersiella

- Gemensam

- vanligen

- jämfört

- fullborda

- Avslutade

- komplex

- Komplexiteten

- komponenter

- beräkningar

- Compute

- Begreppen

- ingås

- Tänk

- består

- Konsol

- begränsningar

- konstruera

- konsumtion

- innehåller

- innehåll

- innehållsskapande

- sammanhang

- fortsätta

- Däremot

- kontroller

- Motsvarande

- Pris

- Kostar

- räkna

- skapa

- skapar

- skapande

- kund

- Kundservice

- datum

- datavetenskap

- datauppsättningar

- datum Tid

- beslutar

- Beslutsfattande

- dedicerad

- djup

- definiera

- definierade

- definierande

- demo

- demonstrera

- beroende

- distribuera

- utplacerade

- utplacera

- vecklas ut

- beskriven

- Designa

- design

- önskas

- utveckla

- olika

- diskuteras

- distribueras

- dokumentera

- inte

- dominerande

- Dominera

- inte

- grund

- under

- e

- varje

- effektivitet

- effektiv

- antingen

- Slutpunkt

- Teknik

- Motorer

- tillräckligt

- ange

- Företag

- företagets adoption

- enhet

- inträde

- Miljö

- epok

- fel

- utvärdera

- utvärderade

- utvärderingar

- Även

- händelser

- exempel

- Utom

- undantag

- uteslutande

- befintliga

- erfarenhet

- Förklara

- förklarade

- förlängning

- Ansikte

- falsk

- snabbare

- Funktioner

- återkoppling

- färre

- fält

- Fil

- Filer

- slutlig

- hitta

- finna

- Förnamn

- fixerad

- Flexibilitet

- flytande

- efter

- Fotavtryck

- För

- hittade

- fundament

- från

- främre

- Frontier

- fullständigt

- fungera

- ytterligare

- generera

- genererar

- generativ

- Generativ AI

- skaffa sig

- ges

- Målet

- GPU

- grå

- händer

- Har

- he

- huvud

- huvuden

- hälso-och sjukvård

- hjälper

- dold

- högpresterande

- högre

- hans

- historia

- värd

- värd

- ÖPPETTIDER

- Hur ser din drömresa ut

- How To

- Men

- html

- http

- HTTPS

- Kramar ansikte

- Hyperparameteroptimering

- Inställning av hyperparameter

- i

- identifiera

- IDX

- if

- illustrera

- Inverkan

- Konsekvenser

- genomföra

- importera

- förbättra

- förbättras

- förbättring

- förbättra

- in

- innefattar

- Öka

- ökat

- ökande

- informationen

- Infrastruktur

- ingång

- exempel

- istället

- Intelligent

- in

- IT

- DESS

- Jobb

- Lediga jobb

- jpg

- json

- kunskap

- känd

- språk

- Large

- storskalig

- största

- Latens

- lager

- skikt

- Leads

- LÄRA SIG

- inlärning

- t minst

- Låt

- bibliotek

- Bibliotek

- linje

- läsa in

- log

- skogsavverkning

- du letar

- förlust

- förluster

- lägre

- Maskinen

- maskininlärning

- bibehålla

- upprätthålla

- människa

- förvaltade

- Marathon

- mask

- matplotlib

- maximal

- Maj..

- betyder

- mäta

- mätning

- medicinsk

- Möt

- Minne

- metadata

- metoder

- metriska

- Metrics

- kanske

- minuter

- ML

- modell

- modellering

- modeller

- modulära

- mer

- flytta

- mycket

- multipel

- måste

- namn

- Som heter

- namn

- vid

- Natural

- Naturlig språkbehandling

- Navigera

- Navigering

- nödvändigt för

- Behöver

- behövs

- behov

- nät

- nätverk

- neurala

- neurala nätverk

- neurala nätverk

- Nästa

- nlp

- Ingen

- Notera

- anteckningsbok

- nu

- antal

- objektet

- mål

- mål

- observera

- of

- sänkt

- erbjudanden

- Erbjudanden

- on

- ONE

- nätet

- online-återförsäljare

- endast

- öppet

- öppen källkod

- optimala

- optimering

- Optimera

- optimerad

- optimerar

- optimera

- or

- beställa

- ursprungliga

- Övriga

- vår

- ut

- produktion

- utgångar

- över

- övergripande

- Översikt

- egen

- par

- panelen

- Parallell

- parameter

- parametrar

- Pareto

- del

- Godkänd

- bana

- Patienten

- mönster

- Utföra

- prestanda

- utfört

- utför

- utför

- behörigheter

- plato

- Platon Data Intelligence

- PlatonData

- Punkt

- poäng

- positioner

- Inlägg

- Precision

- förutsägelse

- Predictor

- preferenser

- beredd

- förutsättningar

- presentera

- tidigare

- Principal

- Problem

- process

- Processautomation

- processer

- bearbetning

- Produkt

- produktivitet

- föreslagen

- leverantör

- ger

- tillhandahålla

- dra

- Drar

- Syftet

- syfte

- Python

- pytorch

- Frågor och svar

- fråga

- ganska

- slumpmässig

- område

- snabb

- rates

- Raw

- verklig

- erkännande

- känner igen

- känna igen

- Rekommendation

- rekommendationer

- post

- registreras

- Red

- minska

- Minskad

- minskar

- regex

- relaterad

- avlägsnar

- bort

- Rapport

- representation

- begära

- förfrågningar

- Obligatorisk

- Krav

- elastisk

- resurs

- Resurser

- respektive

- respons

- Resultat

- återförsäljare

- kvarhållande

- återgår

- rider

- Risk

- RAD

- Körning

- runner

- rinnande

- kör

- s

- offra

- sagemaker

- SageMaker Inference

- Save

- Skala

- skalor

- Vetenskap

- Forskare

- göra

- skript

- Sök

- Sökmotorer

- söka

- Andra

- §

- se

- välj

- vald

- SJÄLV

- sända

- mening

- känsla

- Sekvens

- service

- Tjänster

- session

- in

- uppsättningar

- inställning

- Visar

- signaler

- signifikant

- Enkelt

- samtidigt

- enda

- Storlek

- mindre

- So

- Mjukvara

- lösning

- Lösningar

- några

- Källa

- Utrymme

- specialiserad

- specialiserat

- specifik

- specifikt

- Spendera

- delas

- starta

- startar

- Ange

- statistik

- Steg

- Steg

- förvaring

- strukturell

- strukturerade

- studio

- väsentlig

- framgångsrik

- Framgångsrikt

- sådana

- lämplig

- svit

- SAMMANFATTNING

- system

- System

- Ta

- tar

- Målet

- uppgift

- uppgifter

- lag

- Tekniken

- tekniker

- mallar

- villkor

- Testning

- tester

- text

- Textklassificering

- text-

- än

- den där

- Smakämnen

- deras

- sedan

- Där.

- därför

- Dessa

- detta

- tre

- tröskelvärde

- Genom

- tid

- gånger

- till

- tillsammans

- token

- tog

- verktyg

- verktyg

- handla

- Handel

- Tåg

- tränad

- Utbildning

- transformator

- transformatorer

- sann

- prova

- trimma

- två

- Typ

- typer

- typisk

- typiskt

- Ytterst

- under

- genomgå

- förståelse

- enheter

- us

- användning

- användningsfall

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- godkännande

- värde

- Värden

- version

- via

- Virtuell

- visualisera

- vs

- vill

- var

- we

- webb

- webbservice

- VÄL

- när

- om

- som

- medan

- VEM

- bred

- Brett utbud

- brett

- fru

- wikipedia

- kommer

- beredd

- med

- inom

- Arbete

- arbetsflöde

- arbetssätt

- X

- år

- Avkastning

- Om er

- Din

- zephyrnet