Onlinespel och sociala gemenskaper erbjuder röst- och textchattfunktioner för sina användare att kommunicera. Även om röst- och textchatt ofta stöder vänliga skämt, kan det också leda till problem som hatretorik, nätmobbning, trakasserier och bedrägerier. Idag förlitar sig många företag enbart på mänskliga moderatorer för att granska giftigt innehåll. Men att verifiera överträdelser i chatten är tidskrävande, felbenägen och utmanande att skala.

I det här inlägget introducerar vi lösningar som möjliggör moderering av ljud och textchatt med hjälp av olika AWS-tjänster, inklusive Amazon Transcribe, Amazon Comprehend, Amazonas berggrundoch Amazon OpenSearch Service.

Sociala plattformar söker en standardlösning för moderering som är enkel att initiera, men de kräver också anpassning för att hantera olika policyer. Latens och kostnad är också kritiska faktorer som måste beaktas. Genom att orkestrera toxicitetsklassificering med stora språkmodeller (LLM) med generativ AI erbjuder vi en lösning som balanserar enkelhet, latens, kostnad och flexibilitet för att tillfredsställa olika krav.

Exempelkoden för detta inlägg finns tillgänglig i GitHub repository.

Arbetsflöde för moderering av ljudchatt

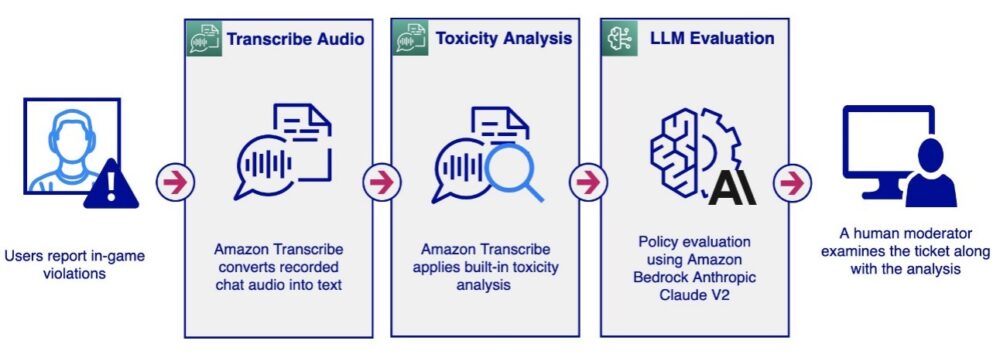

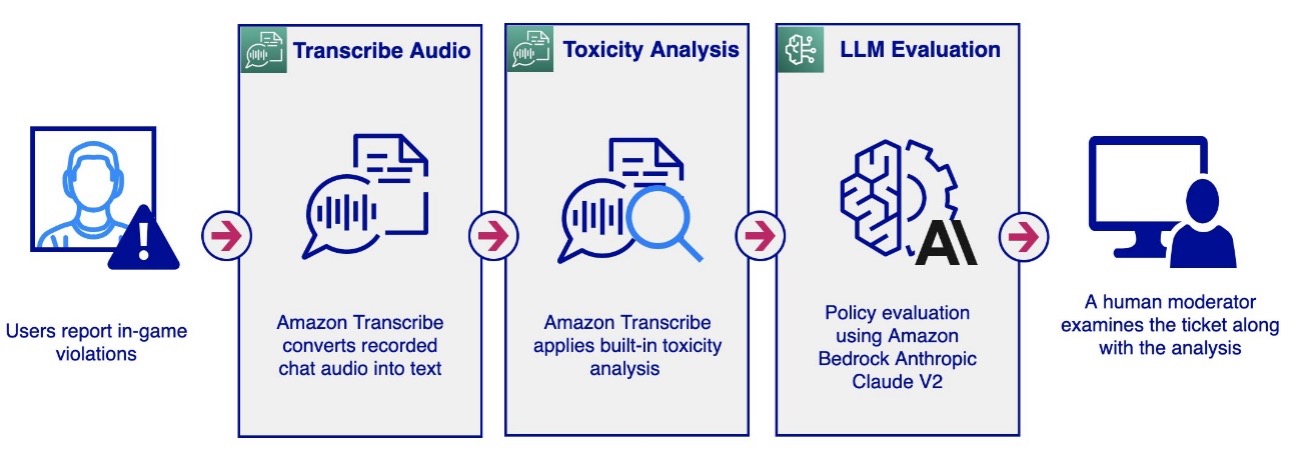

Ett arbetsflöde för moderering av ljudchatt kan initieras av en användare som rapporterar andra användare på en spelplattform för policyöverträdelser som svordomar, hatretorik eller trakasserier. Detta representerar ett passivt förhållningssätt till ljudmoderering. Systemet spelar in alla ljudkonversationer utan omedelbar analys. När en rapport tas emot hämtar arbetsflödet de relaterade ljudfilerna och initierar analysprocessen. En mänsklig moderator granskar sedan den rapporterade konversationen och undersöker dess innehåll för att avgöra om den bryter mot plattformspolicyn.

Alternativt kan arbetsflödet triggas proaktivt. Till exempel, i ett socialt ljudchattrum, kunde systemet spela in alla konversationer och tillämpa analys.

Både passiva och proaktiva tillvägagångssätt kan utlösa följande pipeline för ljudanalys.

Arbetsflödet för ljudmoderering innefattar följande steg:

- Arbetsflödet börjar med att man tar emot ljudfilen och lagrar den på en Amazon enkel lagringstjänst (Amazon S3) hink för Amazon Transcribe att komma åt.

- Amazon-transkriberingen

StartTranscriptionJobAPI anropas med Toxicitetsdetektion aktiverad. Amazon Transcribe konverterar ljudet till text och ger ytterligare information om toxicitetsanalys. För mer information om toxicitetsanalys, se Flagga skadligt språk i talade konversationer med Amazon Transcribe Toxicity Detection. - Om toxicitetsanalysen ger ett toxicitetspoäng som överstiger en viss tröskel (till exempel 50 %), kan vi använda Kunskapsbaser för Amazon Bedrock för att utvärdera budskapet mot anpassade policyer med hjälp av LLM.

- Den mänskliga moderatorn får en detaljerad ljudmodereringsrapport som belyser de konversationssegment som anses vara giftiga och bryter mot policyn, vilket gör att de kan fatta ett välgrundat beslut.

Följande skärmdump visar ett exempel på en applikation som visar toxicitetsanalys för ett ljudsegment. Den inkluderar den ursprungliga transkriptionen, resultaten från Amazon Transcribe-toxicitetsanalysen och analysen som utfördes med hjälp av en kunskapsbas från Amazon Bedrock genom Amazon Bedrock Anthropic Claude V2-modellen.

LLM-analysen ger ett överträdelseresultat (Y eller N) och förklarar logiken bakom modellens beslut om policyöverträdelse. Dessutom innehåller kunskapsbasen de refererade policydokumenten som används av utvärderingen, vilket ger moderatorer ytterligare sammanhang.

Detektion av toxicitet för transkribering av Amazon

Amazon Transcribe är en tjänst för automatisk taligenkänning (ASR) som gör det enkelt för utvecklare att lägga till tal-till-text-kapacitet till sina applikationer. Arbetsflödet för ljudmoderering använder Amazon Transcribe Toxicity Detection, som är en maskininlärningsfunktion (ML) som använder ljud- och textbaserade ledtrådar för att identifiera och klassificera röstbaserat giftigt innehåll i sju kategorier, inklusive sexuella trakasserier, hatretorik, hot , övergrepp, svordomar, förolämpningar och grafiskt språk. Förutom att analysera text, använder Toxicitetsdetektion talsignaler som toner och tonhöjd för att identifiera giftiga avsikter i tal.

Ljudmodereringsarbetsflödet aktiverar LLM:s policyutvärdering endast när toxicitetsanalysen överskrider ett fastställt tröskelvärde. Detta tillvägagångssätt minskar fördröjningen och optimerar kostnaderna genom att selektivt tillämpa LLM, vilket filtrerar bort en betydande del av trafiken.

Använd LLM prompt ingenjörskonst för att tillgodose anpassade policyer

De förtränade toxicitetsdetektionsmodellerna från Amazon Transcribe och Amazon Comprehend tillhandahåller en bred toxicitetstaxonomi, som vanligtvis används av sociala plattformar för att moderera användargenererat innehåll i ljud- och textformat. Även om dessa förutbildade modeller effektivt upptäcker problem med låg latens, kan du behöva en lösning för att upptäcka överträdelser mot ditt specifika företags- eller affärsdomänpolicy, vilket de förutbildade modellerna ensamma inte kan uppnå.

Dessutom upptäcker kränkningar i kontextuella konversationer, som att identifiera barns sexuella grooming konversationer, kräver en anpassningsbar lösning som innebär att man beaktar chattmeddelanden och sammanhang utanför det, som användarens ålder, kön och konversationshistorik. Det är här LLM:er kan erbjuda den flexibilitet som behövs för att utöka dessa krav.

Amazon Bedrock är en helt hanterad tjänst som erbjuder ett urval av högpresterande grundmodeller (FM) från ledande AI-företag. Dessa lösningar använder Anthropic Claude v2 från Amazon Bedrock för att moderera ljudtranskriptioner och textchattmeddelanden med hjälp av en flexibel promptmall, som beskrivs i följande kod:

Mallen innehåller platshållare för policybeskrivningen, chattmeddelandet och ytterligare regler som kräver moderering. Den antropiska Claude V2-modellen levererar svar i det instruerade formatet (Y eller N), tillsammans med en analys som förklarar varför den anser att meddelandet bryter mot policyn. Detta tillvägagångssätt låter dig definiera flexibla modereringskategorier och formulera dina policyer på mänskligt språk.

Den traditionella metoden att utbilda en intern klassificeringsmodell involverar besvärliga processer som datakommentarer, utbildning, testning och modelldistribution, vilket kräver expertis hos datavetare och ML-ingenjörer. LLM erbjuder däremot en hög grad av flexibilitet. Affärsanvändare kan ändra uppmaningar på mänskligt språk, vilket leder till ökad effektivitet och minskade iterationscykler i ML-modellutbildning.

Kunskapsbaser för Amazon Bedrock

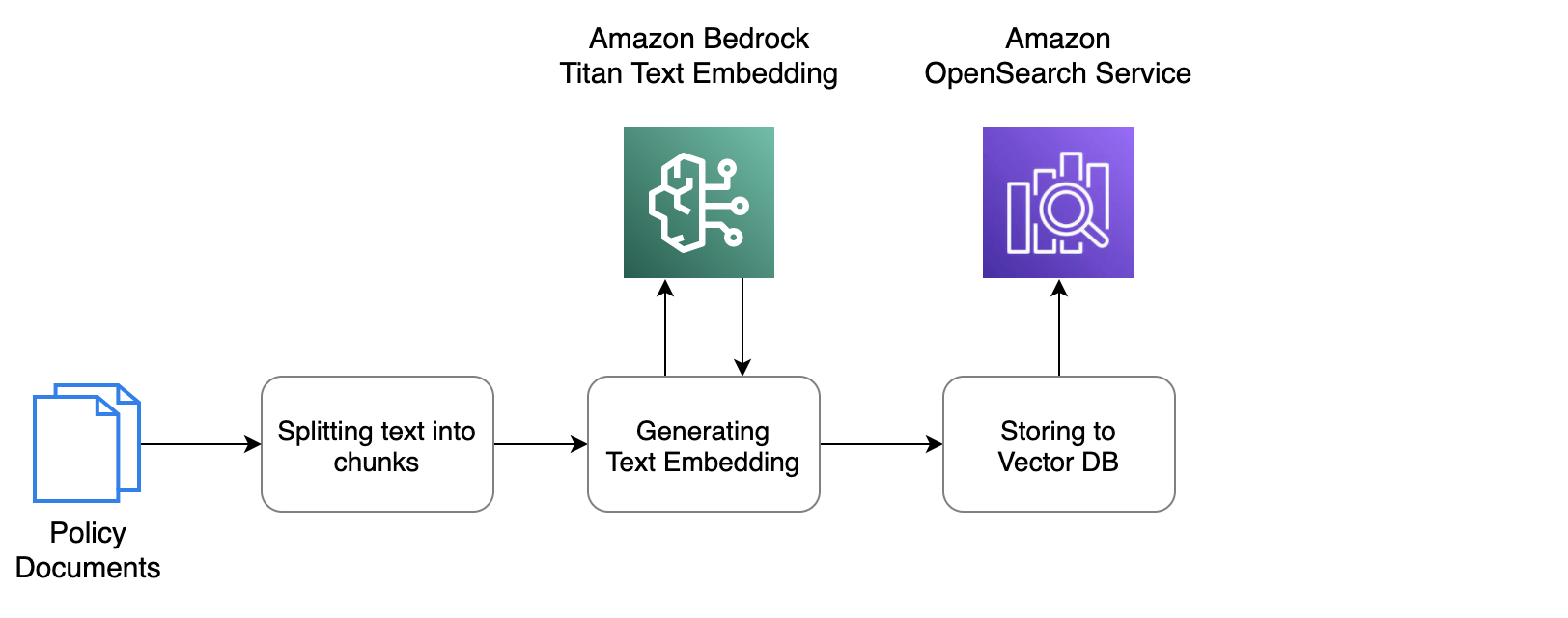

Även om promptteknik är effektivt för att anpassa policyer, kan injicera långa policyer och regler direkt i LLM-uppmaningar för varje meddelande introducera latens och öka kostnaderna. För att ta itu med detta använder vi Amazon Bedrock kunskapsbaser som ett hanterat Retrieval Augmented Generation (RAG) system. Detta gör att du kan hantera policydokumentet flexibelt, vilket gör att arbetsflödet endast kan hämta de relevanta policysegmenten för varje inmatningsmeddelande. Detta minimerar antalet tokens som skickas till LLM:erna för analys.

Du kan använda AWS Management Console att ladda upp policydokumenten till en S3-bucket och sedan indexera dokumenten till en vektordatabas för effektiv hämtning. Följande är ett konceptuellt arbetsflöde som hanteras av en Amazon Bedrock kunskapsbas som hämtar dokument från Amazon S3, delar upp texten i bitar och anropar Amazon Bedrock Titan textinbäddningsmodell för att konvertera textbitarna till vektorer, som sedan lagras i vektordatabasen.

I denna lösning använder vi Amazon OpenSearch Service som vektorlager. Opensearch är en skalbar, flexibel och utökningsbar mjukvarusvit med öppen källkod för sökning, analys, säkerhetsövervakning och observerbarhetsapplikationer, licensierad under Apache 2.0-licensen. OpenSearch Service är en helt hanterad tjänst som gör det enkelt att distribuera, skala och driva OpenSearch i AWS-molnet.

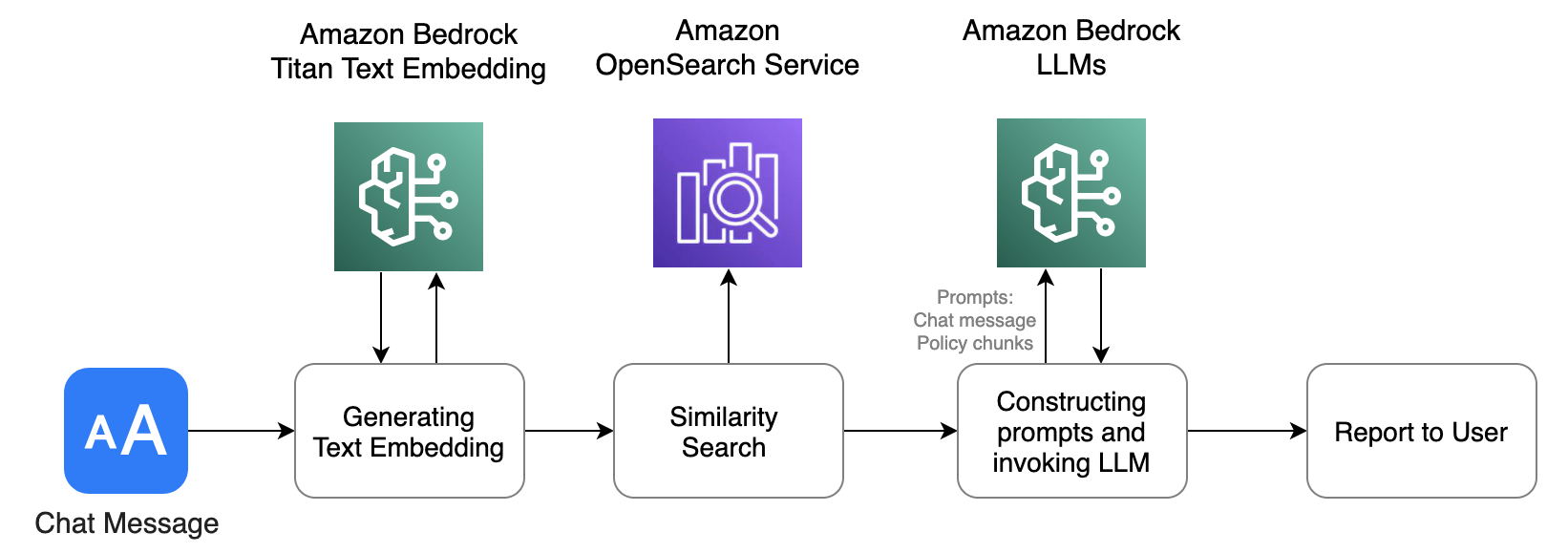

Efter att dokumentet har indexerats i OpenSearch Service skickar arbetsflödet för moderering av ljud och text chattmeddelanden, vilket utlöser följande frågeflöde för anpassad policyutvärdering.

Processen liknar initieringsarbetsflödet. Först konverteras textmeddelandet till textinbäddningar med hjälp av Amazon Bedrock Titan Text Embedding API. Dessa inbäddningar används sedan för att utföra en vektor sökning mot OpenSearch Service-databasen, som redan har fyllts med dokumentinbäddningar. Databasen returnerar policybitar med den högsta matchande poängen, relevanta för inmatningstextmeddelandet. Vi komponerar sedan uppmaningar som innehåller både inmatningschattmeddelandet och policysegmentet, som skickas till Antropic Claude V2 för utvärdering. LLM-modellen returnerar ett analysresultat baserat på de snabba instruktionerna.

För detaljerade instruktioner om hur du skapar en ny instans med ditt policydokument i en kunskapsbas för Amazon Bedrock, se Knowledge Bases levererar nu en fullständigt hanterad RAG-upplevelse i Amazon Bedrock.

Arbetsflöde för moderering av textchatt

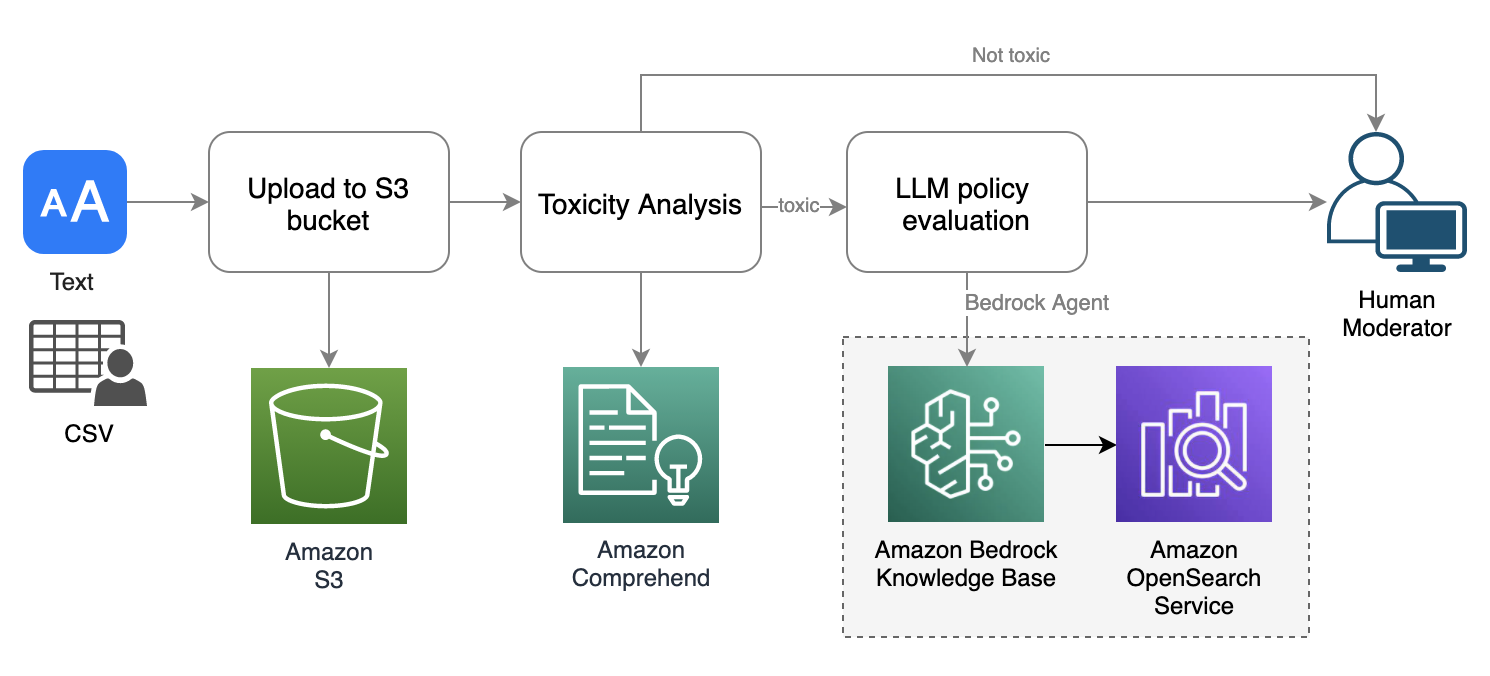

Arbetsflödet för moderering av textchatt följer ett liknande mönster som ljudmoderering, men det använder Amazon Comprehend-toxicitetsanalys, som är skräddarsydd för textmoderering. Exempelappen stöder ett gränssnitt för att ladda upp masstextfiler i CSV- eller TXT-format och tillhandahåller ett gränssnitt för enstaka meddelanden för snabb testning. Följande diagram illustrerar arbetsflödet.

Arbetsflödet för textmoderering innefattar följande steg:

- Användaren laddar upp en textfil till en S3-hink.

- Amazon Comprehend toxicitetsanalys tillämpas på textmeddelandet.

- Om toxicitetsanalysen returnerar ett toxicitetspoäng som överstiger ett visst tröskelvärde (till exempel 50 %), använder vi en kunskapsbas från Amazon Bedrock för att utvärdera budskapet mot anpassade policyer med hjälp av Anthropic Claude V2 LLM.

- En policyutvärderingsrapport skickas till den mänskliga moderatorn.

Amazon Comprehend toxicitetsanalys

I arbetsflödet för textmoderering använder vi Amazon Comprehend-toxicitetsanalys för att bedöma toxicitetsnivån för textmeddelandena. Amazon Comprehend är en NLP-tjänst (natural language processing) som använder ML för att avslöja värdefulla insikter och kopplingar i text. Amazon Comprehend toxicity detection API tilldelar textinnehåll ett övergripande toxicitetspoäng, som sträcker sig från 0–1, vilket indikerar sannolikheten för att det är giftigt. Den kategoriserar också text i följande kategorier och ger en konfidenspoäng för var och en: hate_speech, grafik, harrassement_or_abuse, sexuell, violence_or_threat, förolämpning och svordomar.

I detta arbetsflöde för textmoderering spelar Amazon Comprehend-toxicitetsanalys en avgörande roll för att identifiera om det inkommande textmeddelandet innehåller giftigt innehåll. I likhet med arbetsflödet för ljudmoderering inkluderar det ett villkor att aktivera nedströms LLM-policyutvärderingen endast när toxicitetsanalysen returnerar en poäng som överstiger en fördefinierad tröskel. Denna optimering hjälper till att minska den totala latens och kostnader förknippade med LLM-analys.

Sammanfattning

I det här inlägget introducerade vi lösningar för moderering av ljud och textchatt med hjälp av AWS-tjänster, inklusive Amazon Transcribe, Amazon Comprehend, Amazon Bedrock och OpenSearch Service. Dessa lösningar använder förutbildade modeller för toxicitetsanalys och är orkestrerade med generativa AI LLMs för att uppnå den optimala balansen i noggrannhet, latens och kostnad. De ger dig också möjlighet att flexibelt definiera dina egna policyer.

Du kan uppleva exempelappen genom att följa instruktionerna i GitHub repo.

Om författaren

Lana Zhang är en Senior Solutions Architect på AWS WWSO AI Services-teamet, specialiserat på AI och ML för Content Moderation, Computer Vision, Natural Language Processing och Generative AI. Med sin expertis är hon dedikerad till att marknadsföra AWS AI/ML-lösningar och hjälpa kunder att transformera sina affärslösningar inom olika branscher, inklusive sociala medier, spel, e-handel, media, reklam och marknadsföring.

Lana Zhang är en Senior Solutions Architect på AWS WWSO AI Services-teamet, specialiserat på AI och ML för Content Moderation, Computer Vision, Natural Language Processing och Generative AI. Med sin expertis är hon dedikerad till att marknadsföra AWS AI/ML-lösningar och hjälpa kunder att transformera sina affärslösningar inom olika branscher, inklusive sociala medier, spel, e-handel, media, reklam och marknadsföring.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/moderate-audio-and-text-chats-using-aws-ai-services-and-llms/

- : har

- :är

- :inte

- :var

- 100

- 118

- 14

- 7

- a

- Om Oss

- missbruk

- tillgång

- rymma

- Konto

- noggrannhet

- Uppnå

- tvärs

- aktivera

- lägga till

- Dessutom

- Annat

- ytterligare information

- adress

- reklam

- mot

- ålder

- AI

- AI-tjänster

- AI / ML

- Alla

- tillåta

- tillåter

- ensam

- längs

- redan

- också

- Även

- amason

- Amazon Comprehend

- Amazon Transcribe

- Amazon Web Services

- an

- analys

- analytics

- analys

- och

- Antropisk

- Apache

- api

- app

- Ansökan

- tillämpningar

- tillämpas

- Ansök

- Tillämpa

- tillvägagångssätt

- tillvägagångssätt

- ÄR

- AS

- bedöma

- bistå

- Assistent

- bistå

- associerad

- At

- audio

- augmented

- Författaren

- Automat

- tillgänglig

- AWS

- Balansera

- saldon

- bas

- baserat

- BE

- varit

- börjar

- bakom

- Där vi får lov att vara utan att konstant prestera,

- båda

- Breaking

- bred

- företag

- men

- by

- KAN

- kapacitet

- kategorier

- vissa

- utmanande

- chatt

- katter

- val

- klassificering

- klassificera

- cloud

- koda

- vanligen

- kommunicera

- samhällen

- Företag

- företag

- förstå

- dator

- Datorsyn

- begreppsmässig

- tillstånd

- genomfördes

- förtroende

- Anslutningar

- Tänk

- anses

- med tanke på

- innehåller

- innehåll

- sammanhang

- kontextuella

- Däremot

- Konversation

- konversationer

- konvertera

- konverterad

- Pris

- Kostar

- kunde

- skapa

- kritisk

- avgörande

- besvärlig

- Kunder

- anpassningsbar

- anpassning

- kundanpassad

- cykler

- datum

- Databas

- beslutar

- Beslutet

- dedicerad

- definiera

- Examen

- levererar

- distribuera

- utplacering

- beskrivning

- detaljerad

- upptäcka

- Detektering

- Bestämma

- utvecklare

- Diagrammet

- direkt

- visning

- flera

- dokumentera

- dokument

- gör

- domän

- ner

- e-handel

- varje

- effektivitet

- effektiv

- effektivt

- antingen

- inbäddning

- ge

- möjliggöra

- aktiverad

- möjliggör

- Teknik

- Ingenjörer

- förbättrad

- utvärdera

- utvärdering

- exempel

- överstiger

- överstiger

- erfarenhet

- expert

- expertis

- förklara

- Förklarar

- förlänga

- faktorer

- Fil

- Filer

- filtrering

- hitta

- Förnamn

- Flexibilitet

- flexibel

- flexibelt

- flöda

- efter

- följer

- För

- format

- fundament

- vänliga

- från

- fullständigt

- funktionalitet

- Vidare

- Gaming

- spelplattform

- Kön

- generering

- generativ

- Generativ AI

- Grafisk

- skadliga

- hatar

- hjälper

- här

- Hög

- högpresterande

- högsta

- belysa

- historia

- Hur ser din drömresa ut

- How To

- Men

- html

- http

- HTTPS

- humant

- identifiera

- identifiera

- if

- illustrerar

- omedelbar

- in

- innefattar

- Inklusive

- Inkommande

- Öka

- index

- indexeras

- pekar på

- indikerar

- industrier

- informationen

- informeras

- initiera

- initieras

- initierar

- initiering

- ingång

- insikter

- exempel

- instruktioner

- Förolämpning

- uppsåt

- Gränssnitt

- in

- införa

- introducerade

- undersöker

- åberopas

- anropar

- innebär

- problem

- IT

- iteration

- DESS

- Jobb

- jpg

- Ha kvar

- kunskap

- språk

- Large

- Latens

- leda

- ledande

- inlärning

- Nivå

- Licens

- Licensierade

- sannolikhet

- LLM

- Låg

- Maskinen

- maskininlärning

- göra

- GÖR

- hantera

- förvaltade

- ledning

- hantera

- många

- Marknadsföring

- matchande

- Maj..

- betyder

- Media

- meddelande

- meddelanden

- metod

- minimerar

- ML

- modell

- modeller

- måttlig

- modererande

- måttfullhet

- modifiera

- övervakning

- mer

- måste

- Natural

- Naturlig språkbehandling

- Behöver

- behövs

- Nya

- nlp

- nu

- antal

- of

- erbjudanden

- Erbjudanden

- Ofta

- on

- endast

- öppet

- öppen källkod

- driva

- optimala

- optimering

- optimerar

- or

- iscensatt

- orkestrerar

- ursprungliga

- Övriga

- ut

- skisse

- utanför

- övergripande

- egen

- passiva

- Mönster

- Utföra

- rörledning

- Tonhöjd

- plattform

- Plattformar

- plato

- Platon Data Intelligence

- PlatonData

- spelar

- snälla du

- Strategier

- policy

- befolkad

- del

- Inlägg

- fördefinierad

- Proaktiv

- problem

- process

- processer

- bearbetning

- HÄDELSER

- främja

- prompter

- ge

- ger

- tillhandahålla

- fråga

- Snabbt

- trasa

- som sträcker sig

- logiska grunden

- mottagna

- erhåller

- mottagande

- erkännande

- post

- register

- minska

- Minskad

- minskar

- hänvisa

- refererade

- om

- relaterad

- relevanta

- förlita

- rapport

- Rapporterad

- Rapportering

- representerar

- kräver

- Krav

- Kräver

- Svara

- svar

- resultera

- Resultat

- hämtning

- återgår

- översyn

- Omdömen

- Roll

- Rum

- Regel

- regler

- säker

- Säkerhet

- prov

- tillfredsställa

- skalbar

- Skala

- bedrägerier

- vetenskapsmän

- göra

- Sök

- §

- säkerhet

- Seek

- segmentet

- segment

- sänder

- senior

- skickas

- service

- Tjänster

- in

- sju

- Sexuell

- hon

- Visar

- signifikant

- liknande

- Enkelt

- enkelhet

- Social hållbarhet

- sociala medier

- sociala plattformar

- Mjukvara

- enbart

- lösning

- Lösningar

- Källa

- specialiserat

- specifik

- tal

- Taligenkänning

- tal-till-text

- Delar upp

- talat

- Steg

- förvaring

- lagra

- lagras

- misslyckande

- okomplicerad

- sådana

- svit

- stödja

- Stöder

- system

- MÄRKA

- skräddarsydd

- tagen

- taxonomi

- grupp

- mall

- Testning

- text

- den där

- Smakämnen

- deras

- Dem

- sedan

- Dessa

- de

- tänker

- detta

- hot

- tröskelvärde

- Genom

- tidskrävande

- titan

- till

- i dag

- tokens

- traditionell

- trafik

- Utbildning

- omvandla

- utlösa

- triggas

- trigg

- Litar

- avslöja

- under

- uppladdning

- användning

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- Värdefulla

- olika

- verifiera

- ÖVERTRÄDELSE

- Överträdelser

- syn

- Röst

- we

- webb

- webbservice

- när

- om

- som

- medan

- varför

- wikipedia

- kommer

- med

- inom

- utan

- ord

- arbetsflöde

- Om er

- Din

- zephyrnet