การเลือกวัตถุที่แยกจากกันในฉากภาพดูเหมือนเป็นเรื่องง่ายสำหรับเรา แต่เครื่องจักรมีปัญหากับงานนี้ ตอนนี้โมเดล AI ใหม่จาก Meta ได้พัฒนาแนวคิดกว้างๆ ว่าวัตถุคืออะไร ทำให้สามารถแยกวัตถุออกได้แม้ว่าจะไม่เคยเห็นมาก่อนก็ตาม

อาจดูเหมือนเป็นงานคอมพิวเตอร์วิทัศน์ที่ค่อนข้างธรรมดา แต่ความสามารถในการแยกวิเคราะห์ภาพและหาจุดที่วัตถุหนึ่งสิ้นสุดและอีกวัตถุหนึ่งเริ่มต้นขึ้นนั้นเป็นทักษะพื้นฐานที่ดี หากปราศจากงานที่ซับซ้อนกว่านี้มากมายก็จะไม่สามารถแก้ไขได้

“การแบ่งส่วนวัตถุ” ไม่ใช่เรื่องใหม่ นักวิจัยด้าน AI ได้ทำงานเกี่ยวกับมันมาหลายปีแล้ว แต่โดยทั่วไปแล้ว การสร้างโมเดลเหล่านี้เป็นกระบวนการที่กินเวลามากซึ่งต้องใช้คำอธิบายประกอบรูปภาพจำนวนมากและทรัพยากรคอมพิวเตอร์จำนวนมาก และโดยทั่วไปแล้ว โมเดลที่ได้จะมีความเฉพาะเจาะจงสูงสำหรับกรณีการใช้งานเฉพาะ

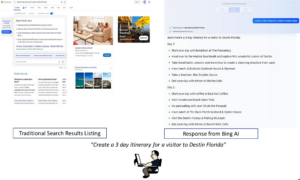

แม้ว่าตอนนี้ นักวิจัยที่ Meta ได้เปิดตัว Segment Anything Model (SAM) ซึ่งสามารถตัดวัตถุใดๆ ออกจากฉากใดๆ ก็ตาม โดยไม่คำนึงว่าเคยเห็นอะไรแบบนี้มาก่อนหรือไม่ แบบจำลองยังสามารถตอบสนองต่อข้อความแจ้งต่างๆ ที่หลากหลาย ตั้งแต่คำอธิบายข้อความ การคลิกเมาส์ หรือแม้แต่ข้อมูลการติดตามการมอง

“SAM ได้เรียนรู้แนวคิดทั่วไปว่าวัตถุคืออะไร และมันสามารถสร้างหน้ากากสำหรับวัตถุใดๆ ในภาพหรือวิดีโอใดๆ ก็ได้” นักวิจัยระบุใน บล็อก เสา. “เราเชื่อว่าความเป็นไปได้นั้นกว้าง และเรารู้สึกตื่นเต้นกับกรณีการใช้งานที่เป็นไปได้มากมายที่เรายังไม่เคยคิดมาก่อน”

กุญแจสำคัญในการพัฒนาโมเดลคือชุดข้อมูลใหม่จำนวน 1.1 พันล้านมาสก์การแบ่งส่วน ซึ่งหมายถึงบริเวณของภาพที่ถูกแยกออกและใส่คำอธิบายประกอบเพื่อแสดงว่ามีวัตถุใดวัตถุหนึ่ง สร้างขึ้นจากการผสมผสานระหว่างการใส่คำอธิบายประกอบโดยมนุษย์สำหรับรูปภาพและกระบวนการอัตโนมัติ และเป็นคอลเลกชันที่ใหญ่ที่สุดของประเภทนี้ที่รวบรวมมาจนถึงปัจจุบัน

นักวิจัยของ Meta กล่าวว่าได้พัฒนาแนวคิดทั่วไปว่าวัตถุคืออะไร ซึ่งทำให้สามารถแบ่งกลุ่มสิ่งที่ไม่เคยเห็นมาก่อนได้ด้วยการฝึกอบรมชุดข้อมูลขนาดใหญ่ดังกล่าว ความสามารถในการสรุปนี้ทำให้นักวิจัยขนานนาม SAM ว่า "แบบจำลองพื้นฐาน" คำที่ขัดแย้ง ใช้เพื่ออธิบายโมเดลสำเร็จรูปขนาดใหญ่อื่นๆ เช่น GPT ของ OpenAI ซีรีส์ซึ่งมีความสามารถทั่วไปที่สามารถใช้เป็นรากฐานสำหรับโฮสต์ของแอปพลิเคชัน

การแบ่งส่วนภาพเป็นองค์ประกอบหลักในงานด้านการมองเห็นด้วยคอมพิวเตอร์ที่หลากหลาย หากคุณไม่สามารถแยกองค์ประกอบต่างๆ ของฉากออกจากกันได้ ก็ยากที่จะทำอะไรที่ซับซ้อนกว่านี้ได้ ในบล็อกของพวกเขา นักวิจัยกล่าวว่าสามารถพิสูจน์ได้ว่ามีประโยชน์อย่างมากในการตัดต่อวิดีโอและรูปภาพ หรือช่วยในการวิเคราะห์ภาพทางวิทยาศาสตร์

บางทีอาจเกี่ยวข้องกับความทะเยอทะยานของ metaverse ของบริษัทมากกว่า พวกเขามีการสาธิตวิธีการใช้ร่วมกับชุดหูฟังความเป็นจริงเสมือนเพื่อเลือกวัตถุเฉพาะตามการจ้องมองของผู้ใช้ พวกเขายังกล่าวอีกว่าอาจจับคู่กับโมเดลภาษาขนาดใหญ่เพื่อสร้างระบบหลายโมดอลที่สามารถเข้าใจทั้งเนื้อหาภาพและข้อความของหน้าเว็บ

ความสามารถในการจัดการกับการแจ้งเตือนที่หลากหลายทำให้ระบบมีความยืดหยุ่นเป็นพิเศษ ใน หน้าเว็บ สาธิตโมเดลใหม่ บริษัทแสดงให้เห็นว่าหลังจากวิเคราะห์ภาพแล้ว สามารถแยกวัตถุเฉพาะออกได้ด้วยการคลิกด้วยเคอร์เซอร์ของเมาส์ พิมพ์สิ่งที่คุณต้องการแบ่งกลุ่ม หรือเพียงแค่แบ่งภาพทั้งหมดออกเป็น แยกวัตถุ

และที่สำคัญที่สุดคือ บริษัทเปิดแหล่งที่มาทั้งโมเดลและชุดข้อมูลเพื่อวัตถุประสงค์ในการวิจัย เพื่อให้ผู้อื่นสามารถต่อยอดจากผลงานของตนได้ นี่เป็นแนวทางเดียวกับที่บริษัทใช้กับโมเดลภาษาขนาดใหญ่ของ LLaMA ซึ่งนำไปสู่การเกิดขึ้นอย่างรวดเร็ว รั่วออนไลน์ และกระตุ้นก คลื่นแห่งการทดลอง โดยมือสมัครเล่นและแฮกเกอร์

สิ่งเดียวกันนี้จะเกิดขึ้นกับ SAM หรือไม่ แต่ทั้งสองวิธีถือเป็นของขวัญสำหรับชุมชนการวิจัย AI ที่สามารถเร่งความคืบหน้าเกี่ยวกับปัญหาการมองเห็นคอมพิวเตอร์ที่สำคัญ

เครดิตภาพ: เมตาเอไอ

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตบล็อคเชน Web3 Metaverse ข่าวกรอง ขยายความรู้. เข้าถึงได้ที่นี่.

- ที่มา: https://singularityhub.com/2023/04/10/metas-new-ai-can-identify-and-remove-objects-in-images/

- :เป็น

- $ ขึ้น

- 1

- a

- ความสามารถ

- สามารถ

- เร่งความเร็ว

- หลังจาก

- AI

- วิจัยไอ

- การอนุญาต

- ช่วยให้

- ความทะเยอทะยาน

- การวิเคราะห์

- วิเคราะห์

- และ

- อื่น

- การใช้งาน

- เข้าใกล้

- เป็น

- AS

- ลอม

- At

- อัตโนมัติ

- ตาม

- BE

- ก่อน

- กำลัง

- เชื่อ

- พันล้าน

- บล็อก

- หมดสภาพ

- กว้าง

- สร้าง

- การก่อสร้าง

- by

- CAN

- ความสามารถในการ

- กรณี

- ชุด

- การผสมผสาน

- ชุมชน

- บริษัท

- บริษัท

- ซับซ้อน

- ส่วนประกอบ

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- การคำนวณ

- แนวคิด

- มาก

- บรรจุ

- เนื้อหา

- ได้

- สร้าง

- ที่สร้างขึ้น

- เครดิต

- ตัด

- ข้อมูล

- วันที่

- จัดการ

- อย่างแน่นอน

- บรรยาย

- ลักษณะ

- พัฒนา

- พัฒนาการ

- ต่าง

- ทั้ง

- สิ้นสุด

- ทั้งหมด

- แม้

- ตื่นเต้น

- อย่างเป็นธรรม

- มีความยืดหยุ่น

- สำหรับ

- ฐานราก

- ราคาเริ่มต้นที่

- พื้นฐาน

- General

- สร้าง

- ของขวัญ

- แฮกเกอร์

- เกิดขึ้น

- ยาก

- มี

- ชุดหูฟัง

- ช่วย

- อย่างสูง

- เจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HTTPS

- เป็นมนุษย์

- ความคิด

- ภาพ

- ภาพ

- สำคัญ

- in

- ใช้งานง่าย

- ล้ำค่า

- เปลี่ยว

- IT

- ITS

- คีย์

- ภาษา

- ใหญ่

- ใหญ่ที่สุด

- ได้เรียนรู้

- นำ

- กดไลก์

- ดูรายละเอียด

- เครื่อง

- ทำให้

- คู่มือ

- หลาย

- มาสก์

- มาก

- Meta

- metaverse

- อาจ

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- ใหม่

- ความคิด

- วัตถุ

- วัตถุ

- of

- on

- ONE

- อื่นๆ

- ผลิตภัณฑ์อื่นๆ

- หน้า

- จับคู่

- ในสิ่งที่สนใจ

- โดยเฉพาะ

- เลือก

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- ความเป็นไปได้

- ที่มีศักยภาพ

- ที่อาจเกิดขึ้น

- สวย

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- กระบวนการ

- ความคืบหน้า

- พิสูจน์

- ให้

- วัตถุประสงค์

- พิสัย

- อย่างรวดเร็ว

- ความจริง

- หมายถึง

- ไม่คำนึงถึง

- ภูมิภาค

- ซากศพ

- การวิจัย

- นักวิจัย

- แหล่งข้อมูล

- คำตอบ

- ส่งผลให้

- แซม

- เดียวกัน

- ฉาก

- วิทยาศาสตร์

- ดูเหมือนว่า

- ส่วน

- การแบ่งส่วน

- แยก

- ชุด

- แสดงให้เห็นว่า

- ง่ายดาย

- ความสามารถ

- So

- เฉพาะ

- โดยเฉพาะ

- การต่อสู้

- อย่างเช่น

- ระบบ

- งาน

- งาน

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- สิ่ง

- ตลอด

- ต้องใช้เวลามาก

- ไปยัง

- การฝึกอบรม

- เป็นปกติ

- เข้าใจ

- เปิดตัว

- us

- ใช้

- ความหลากหลาย

- วีดีโอ

- เสมือน

- ความเป็นจริงเสมือน

- วิสัยทัศน์

- ทาง..

- เว็บ

- อะไร

- ว่า

- ที่

- กว้าง

- ช่วงกว้าง

- จะ

- กับ

- ไม่มี

- งาน

- ออกไปทำงาน

- ทำงาน

- จะ

- ปี

- คุณ

- ลมทะเล