ในภาพรวมด้านการดูแลสุขภาพที่พัฒนาอย่างรวดเร็วในปัจจุบัน แพทย์ต้องเผชิญกับข้อมูลทางคลินิกจำนวนมหาศาลจากแหล่งข้อมูลต่างๆ เช่น บันทึกของผู้ดูแล บันทึกสุขภาพอิเล็กทรอนิกส์ และรายงานภาพ ข้อมูลจำนวนมากนี้ แม้จะจำเป็นสำหรับการดูแลผู้ป่วย แต่ก็อาจทำให้ผู้เชี่ยวชาญทางการแพทย์ต้องเสียเวลามากในการกลั่นกรองและวิเคราะห์ การสรุปและดึงข้อมูลเชิงลึกอย่างมีประสิทธิภาพจากข้อมูลนี้มีความสำคัญอย่างยิ่งต่อการดูแลผู้ป่วยและการตัดสินใจที่ดีขึ้น ข้อมูลผู้ป่วยโดยสรุปอาจมีประโยชน์ต่อกระบวนการดาวน์สตรีมจำนวนมาก เช่น การรวมข้อมูล การเข้ารหัสผู้ป่วยอย่างมีประสิทธิภาพ หรือการจัดกลุ่มผู้ป่วยที่มีการวินิจฉัยคล้ายกันเพื่อการตรวจสอบ

โมเดลปัญญาประดิษฐ์ (AI) และแมชชีนเลิร์นนิง (ML) แสดงให้เห็นถึงคำมั่นสัญญาที่ดีในการจัดการกับความท้าทายเหล่านี้ สามารถฝึกโมเดลให้วิเคราะห์และตีความข้อมูลข้อความจำนวนมาก ย่อข้อมูลให้เป็นบทสรุปที่กระชับได้อย่างมีประสิทธิภาพ กระบวนการสรุปโดยอัตโนมัติทำให้แพทย์สามารถเข้าถึงข้อมูลที่เกี่ยวข้องได้อย่างรวดเร็ว ทำให้พวกเขาสามารถมุ่งเน้นไปที่การดูแลผู้ป่วยและตัดสินใจอย่างรอบรู้มากขึ้น ดูต่อไปนี้ กรณีศึกษา เพื่อเรียนรู้เพิ่มเติมเกี่ยวกับกรณีการใช้งานจริง

อเมซอน SageMakerซึ่งเป็นบริการ ML ที่มีการจัดการเต็มรูปแบบ เป็นแพลตฟอร์มที่เหมาะสำหรับโฮสต์และปรับใช้โมเดลและวิธีการสรุปตาม AI/ML ต่างๆ ในโพสต์นี้ เราจะสำรวจตัวเลือกต่างๆ สำหรับการใช้เทคนิคการสรุปบน SageMaker รวมถึงการใช้ Amazon SageMaker JumpStart โมเดลพื้นฐาน การปรับแต่งโมเดลที่ฝึกไว้ล่วงหน้าอย่างละเอียดจาก Hugging Face และการสร้างโมเดลสรุปแบบกำหนดเอง นอกจากนี้ เรายังหารือถึงข้อดีและข้อเสียของแต่ละวิธี ซึ่งช่วยให้บุคลากรทางการแพทย์สามารถเลือกโซลูชันที่เหมาะสมที่สุดสำหรับการสร้างข้อมูลสรุปทางคลินิกที่ซับซ้อนและกระชับและแม่นยำ

คำศัพท์สำคัญสองคำที่ต้องรู้ก่อนเริ่ม: อบรมล่วงหน้า และ ปรับจูน. โมเดลที่ได้รับการฝึกฝนล่วงหน้าหรือโมเดลพื้นฐานคือโมเดลที่ได้รับการสร้างและฝึกฝนจากคลังข้อมูลขนาดใหญ่ โดยทั่วไปแล้วสำหรับความรู้ภาษาทั่วไป การปรับละเอียดคือกระบวนการที่โมเดลที่ผ่านการฝึกอบรมล่วงหน้าได้รับชุดข้อมูลเฉพาะโดเมนเพิ่มเติมเพื่อเพิ่มประสิทธิภาพในงานเฉพาะ ในสถานพยาบาล นี่หมายถึงการให้ข้อมูลบางอย่างแก่แบบจำลอง รวมถึงวลีและคำศัพท์ที่เกี่ยวข้องกับการดูแลผู้ป่วยโดยเฉพาะ

สร้างแบบจำลองการสรุปแบบกำหนดเองบน SageMaker

แม้จะเป็นวิธีที่ใช้ความพยายามสูงสุด แต่บางองค์กรอาจต้องการสร้างแบบจำลองการสรุปแบบกำหนดเองบน SageMaker ตั้งแต่เริ่มต้น วิธีการนี้ต้องการความรู้เชิงลึกเกี่ยวกับโมเดล AI/ML และอาจเกี่ยวข้องกับการสร้างสถาปัตยกรรมโมเดลตั้งแต่เริ่มต้นหรือการปรับโมเดลที่มีอยู่ให้เหมาะกับความต้องการเฉพาะ การสร้างโมเดลแบบกำหนดเองสามารถให้ความยืดหยุ่นและการควบคุมกระบวนการสรุปผลที่มากขึ้น แต่ยังต้องใช้เวลาและทรัพยากรมากกว่าเมื่อเทียบกับแนวทางที่เริ่มต้นจากโมเดลที่ได้รับการฝึกอบรมล่วงหน้า จำเป็นต้องชั่งน้ำหนักข้อดีและข้อเสียของตัวเลือกนี้อย่างรอบคอบก่อนดำเนินการต่อ เนื่องจากอาจไม่เหมาะสำหรับทุกกรณีการใช้งาน

โมเดลพื้นฐานของ SageMaker JumpStart

ตัวเลือกที่ยอดเยี่ยมสำหรับการใช้การสรุปบน SageMaker คือการใช้โมเดลพื้นฐาน JumpStart โมเดลเหล่านี้พัฒนาโดยองค์กรวิจัย AI ชั้นนำ นำเสนอโมเดลภาษาที่ฝึกไว้ล่วงหน้าหลากหลายรูปแบบซึ่งปรับให้เหมาะกับงานต่างๆ รวมถึงการสรุปข้อความ SageMaker JumpStart มีโมเดลพื้นฐานสองประเภท: โมเดลที่เป็นกรรมสิทธิ์และโมเดลโอเพ่นซอร์ส SageMaker JumpStart ยังมีคุณสมบัติตรงตามข้อกำหนด HIPAA ทำให้มีประโยชน์สำหรับปริมาณงานด้านการดูแลสุขภาพ ท้ายที่สุดจะขึ้นอยู่กับลูกค้าเพื่อให้แน่ใจว่าปฏิบัติตาม ดังนั้นโปรดดำเนินการตามขั้นตอนที่เหมาะสม ดู การสร้างสถาปัตยกรรมสำหรับการรักษาความปลอดภัยและการปฏิบัติตามข้อกำหนด HIPAA บน Amazon Web Services .

โมเดลรองพื้นที่เป็นกรรมสิทธิ์

โมเดลที่เป็นกรรมสิทธิ์ เช่น โมเดล Jurassic จาก AI21 และโมเดล Cohere Generate จาก Cohere สามารถค้นพบได้ผ่าน SageMaker JumpStart บน คอนโซลการจัดการ AWS และกำลังอยู่ในระหว่างการดูตัวอย่าง การใช้โมเดลที่เป็นกรรมสิทธิ์สำหรับการสรุปผลนั้นเหมาะสมอย่างยิ่งเมื่อคุณไม่จำเป็นต้องปรับแต่งโมเดลของคุณอย่างละเอียดด้วยข้อมูลที่กำหนดเอง นี่เป็นโซลูชันที่ใช้งานง่ายและพร้อมใช้งานทันที ซึ่งสามารถตอบสนองความต้องการในการสรุปข้อมูลของคุณด้วยการกำหนดค่าที่น้อยที่สุด เมื่อใช้ความสามารถของโมเดลที่ผ่านการฝึกอบรมล่วงหน้าเหล่านี้ คุณจะประหยัดเวลาและทรัพยากรที่จะใช้ในการฝึกฝนและปรับแต่งโมเดลแบบกำหนดเองได้อย่างละเอียด นอกจากนี้ โมเดลที่เป็นกรรมสิทธิ์มักจะมาพร้อมกับ API และ SDK ที่เป็นมิตรกับผู้ใช้ ทำให้กระบวนการรวมเข้ากับระบบและแอปพลิเคชันที่คุณมีอยู่คล่องตัวขึ้น หากความต้องการในการสรุปของคุณสามารถตอบสนองได้ด้วยโมเดลที่เป็นกรรมสิทธิ์ซึ่งได้รับการฝึกอบรมล่วงหน้าโดยไม่ต้องมีการปรับแต่งหรือการปรับแต่งเฉพาะเจาะจง โมเดลเหล่านี้นำเสนอโซลูชันที่สะดวก คุ้มค่า และมีประสิทธิภาพสำหรับงานสรุปข้อความของคุณ เนื่องจากโมเดลเหล่านี้ไม่ได้รับการฝึกฝนมาโดยเฉพาะสำหรับกรณีการใช้งานด้านการดูแลสุขภาพ จึงไม่สามารถรับประกันคุณภาพสำหรับภาษาทางการแพทย์นอกกรอบได้หากไม่มีการปรับแต่งอย่างละเอียด

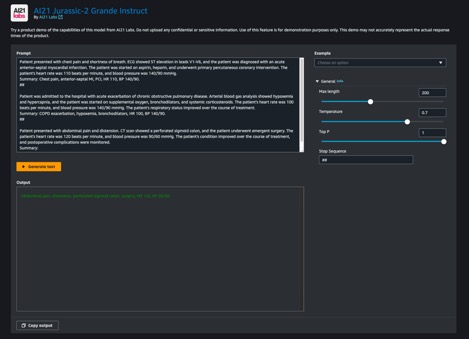

Jurassic-2 Grande Instruct เป็นโมเดลภาษาขนาดใหญ่ (LLM) โดย AI21 Labs ซึ่งปรับให้เหมาะสมสำหรับคำสั่งภาษาธรรมชาติและใช้ได้กับงานภาษาต่างๆ มี API และ Python SDK ที่ใช้งานง่าย สร้างสมดุลระหว่างคุณภาพและราคาที่จ่ายได้ การใช้งานยอดนิยม ได้แก่ การสร้างสำเนาการตลาด ขับเคลื่อนแชทบอท และการสรุปข้อความ

บนคอนโซล SageMaker ให้ไปที่ SageMaker JumpStart ค้นหาโมเดล AI21 Jurassic-2 Grande Instruct แล้วเลือก ลองแบบ.

หากคุณต้องการปรับใช้โมเดลกับตำแหน่งข้อมูล SageMaker ที่คุณจัดการ คุณสามารถทำตามขั้นตอนในตัวอย่างนี้ สมุดบันทึกซึ่งแสดงวิธีการปรับใช้ Jurassic-2 Large โดยใช้ SageMaker

โมเดลพื้นฐานโอเพ่นซอร์ส

โมเดลโอเพ่นซอร์สประกอบด้วยโมเดล FLAN T5, Bloom และ GPT-2 ที่สามารถค้นพบผ่าน SageMaker JumpStart ใน สตูดิโอ Amazon SageMaker UI, SageMaker JumpStart บนคอนโซล SageMaker และ SageMaker JumpStart API โมเดลเหล่านี้สามารถปรับแต่งอย่างละเอียดและปรับใช้กับตำแหน่งข้อมูลภายใต้บัญชี AWS ของคุณ ทำให้คุณเป็นเจ้าของน้ำหนักโมเดลและรหัสสคริปต์โดยสมบูรณ์

Flan-T5 XL เป็นรุ่นที่ทรงพลังและใช้งานได้หลากหลาย ออกแบบมาสำหรับงานด้านภาษาที่หลากหลาย การปรับโมเดลอย่างละเอียดด้วยข้อมูลเฉพาะโดเมนของคุณ ช่วยให้คุณสามารถปรับประสิทธิภาพให้เหมาะสมสำหรับกรณีการใช้งานเฉพาะของคุณ เช่น การสรุปข้อความหรืองาน NLP อื่นๆ สำหรับรายละเอียดเกี่ยวกับวิธีปรับแต่ง Flan-T5 XL โดยใช้ SageMaker Studio UI โปรดดูที่ คำแนะนำในการปรับแต่ง FLAN T5 XL ด้วย Amazon SageMaker Jumpstart.

ปรับแต่งโมเดลที่ได้รับการฝึกอบรมล่วงหน้าอย่างละเอียดด้วย Hugging Face บน SageMaker

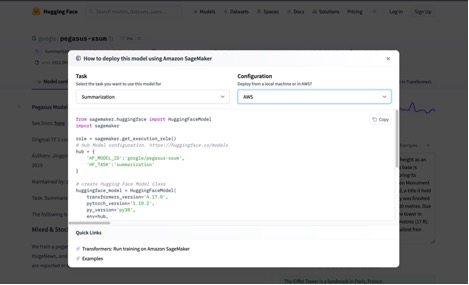

หนึ่งในตัวเลือกที่ได้รับความนิยมมากที่สุดสำหรับการใช้การสรุปผลบน SageMaker คือการปรับแต่งแบบจำลองที่ได้รับการฝึกอบรมล่วงหน้าอย่างละเอียดโดยใช้ Hugging Face หม้อแปลง ห้องสมุด. Hugging Face มีโมเดลหม้อแปลงที่ผ่านการฝึกอบรมล่วงหน้ามากมาย ซึ่งออกแบบมาโดยเฉพาะสำหรับงานประมวลผลภาษาธรรมชาติ (NLP) ต่างๆ รวมถึงการสรุปข้อความ ด้วยไลบรารี Hugging Face Transformers คุณสามารถปรับแต่งโมเดลที่ได้รับการฝึกอบรมล่วงหน้าเหล่านี้อย่างละเอียดในข้อมูลเฉพาะโดเมนของคุณโดยใช้ SageMaker วิธีการนี้มีข้อดีหลายประการ เช่น เวลาในการฝึกอบรมที่เร็วขึ้น ประสิทธิภาพที่ดีขึ้นในโดเมนเฉพาะ และการบรรจุแบบจำลองและการปรับใช้ที่ง่ายขึ้นโดยใช้เครื่องมือและบริการ SageMaker ในตัว หากคุณไม่พบรุ่นที่เหมาะสมใน SageMaker JumpStart คุณสามารถเลือกรุ่นใดก็ได้ที่นำเสนอโดย Hugging Face และปรับแต่งอย่างละเอียดโดยใช้ SageMaker

ในการเริ่มทำงานกับโมเดลเพื่อเรียนรู้เกี่ยวกับความสามารถของ ML สิ่งที่คุณต้องทำคือเปิด SageMaker Studio ค้นหาโมเดลที่ได้รับการฝึกอบรมล่วงหน้าที่คุณต้องการใช้ใน กอดหน้านางแบบฮับและเลือก SageMaker เป็นวิธีการปรับใช้ของคุณ Hugging Face จะให้รหัสแก่คุณเพื่อคัดลอก วาง และเรียกใช้ในสมุดบันทึกของคุณ ง่ายเหมือนกันนะเนี่ย! ไม่จำเป็นต้องมีประสบการณ์ด้านวิศวกรรม ML

ไลบรารี Hugging Face Transformers ช่วยให้ผู้สร้างสามารถใช้งานโมเดลที่ได้รับการฝึกอบรมล่วงหน้าและทำงานขั้นสูง เช่น การปรับแต่งอย่างละเอียด ซึ่งเราจะสำรวจในส่วนต่อไปนี้

จัดหาทรัพยากร

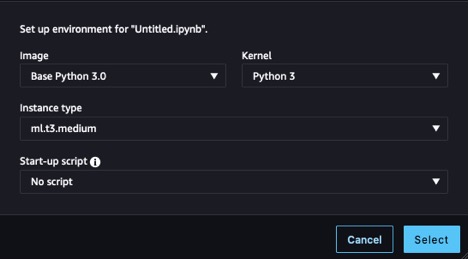

ก่อนที่เราจะเริ่มได้ เราต้องจัดเตรียมสมุดบันทึก สำหรับคำแนะนำ โปรดดูขั้นตอนที่ 1 และ 2 ใน สร้างและฝึกโมเดลแมชชีนเลิร์นนิงในพื้นที่. สำหรับตัวอย่างนี้ เราใช้การตั้งค่าที่แสดงในภาพหน้าจอต่อไปนี้

เรายังต้องสร้าง บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon บัคเก็ต (Amazon S3) เพื่อจัดเก็บข้อมูลการฝึกอบรมและสิ่งประดิษฐ์การฝึกอบรม สำหรับคำแนะนำ โปรดดูที่ การสร้างถัง.

เตรียมชุดข้อมูล

ในการปรับแต่งโมเดลของเราให้มีความรู้ด้านโดเมนที่ดีขึ้น เราจำเป็นต้องได้รับข้อมูลที่เหมาะสมกับงาน เมื่อฝึกอบรมกรณีการใช้งานระดับองค์กร คุณจะต้องผ่านงานด้านวิศวกรรมข้อมูลจำนวนหนึ่งเพื่อเตรียมข้อมูลของคุณเองให้พร้อมสำหรับการฝึกอบรม งานเหล่านั้นอยู่นอกขอบเขตของโพสต์นี้ สำหรับตัวอย่างนี้ เราได้สร้างข้อมูลสังเคราะห์เพื่อจำลองบันทึกการพยาบาลและจัดเก็บไว้ใน Amazon S3 การจัดเก็บข้อมูลของเราใน Amazon S3 ทำให้เราสามารถ ออกแบบปริมาณงานของเราให้สอดคล้องกับ HIPAA. เราเริ่มต้นด้วยการรับโน้ตเหล่านั้นและโหลดลงในอินสแตนซ์ที่โน้ตบุ๊กของเรากำลังทำงานอยู่:

บันทึกประกอบด้วยคอลัมน์ที่มีรายการทั้งหมด บันทึกย่อ และคอลัมน์ที่มีฉบับย่อที่เป็นตัวอย่างว่าผลลัพธ์ที่เราต้องการควรเป็นอย่างไร สรุป จุดประสงค์ของการใช้ชุดข้อมูลนี้คือเพื่อปรับปรุงคำศัพท์ทางชีววิทยาและการแพทย์ของแบบจำลองของเรา เพื่อให้สอดคล้องกับการสรุปในบริบททางการแพทย์มากขึ้น ซึ่งเรียกว่า การปรับโดเมนอย่างละเอียดและแสดงโมเดลของเราถึงวิธีจัดโครงสร้างเอาต์พุตสรุป ในบางกรณีการสรุป เราอาจต้องการสร้างบทคัดย่อจากบทความหรือบทสรุปแบบบรรทัดเดียวของบทวิจารณ์ แต่ในกรณีนี้ เรากำลังพยายามให้แบบจำลองของเราแสดงอาการและการดำเนินการในเวอร์ชันย่อ สำหรับผู้ป่วยจนถึงปัจจุบัน

โหลดโมเดล

โมเดลที่เราใช้เป็นรากฐานของเราคือ Pegasus เวอร์ชันของ Google ซึ่งมีอยู่ใน Hugging Face Hub ซึ่งเรียกว่า เพกาซัส-xsum. มีการฝึกอบรมล่วงหน้าสำหรับการสรุปอยู่แล้ว ดังนั้นกระบวนการปรับแต่งของเราจึงสามารถมุ่งเน้นที่การขยายขอบเขตความรู้ด้านโดเมน การปรับเปลี่ยนงานที่โมเดลของเรารันเป็นการปรับแต่งแบบอื่นที่ไม่ได้กล่าวถึงในโพสต์นี้ ไลบรารี Transformer ให้คลาสแก่เราเพื่อโหลดคำจำกัดความของโมเดลจากของเรา model_checkpoint: google/pegasus-xsum. สิ่งนี้จะโหลดโมเดลจากฮับและสร้างอินสแตนซ์ในโน้ตบุ๊กของเราเพื่อให้เราสามารถใช้งานได้ในภายหลัง เพราะ pegasus-xsum เป็นรูปแบบลำดับต่อลำดับ เราต้องการใช้ประเภท Seq2Seq ของ โมเดลรถยนต์ ระดับ:

ตอนนี้เรามีโมเดลของเราแล้ว ก็ถึงเวลาให้ความสนใจกับส่วนประกอบอื่นๆ ที่จะทำให้เราสามารถรันลูปการฝึกอบรมได้

สร้างโทเค็นไนเซอร์

ส่วนประกอบแรกคือโทเค็นไนเซอร์ tokenization เป็นกระบวนการที่คำจากข้อมูลอินพุตถูกแปลงเป็นการแสดงตัวเลขที่แบบจำลองของเราสามารถเข้าใจได้ อีกครั้ง ไลบรารี Transformer จัดเตรียมคลาสให้เราโหลดคำจำกัดความของ tokenizer จากจุดตรวจเดียวกับที่เราใช้สร้างอินสแตนซ์ของโมเดล:

ด้วยวัตถุ tokenizer นี้ เราสามารถสร้างฟังก์ชันการประมวลผลล่วงหน้าและแมปเข้ากับชุดข้อมูลของเราเพื่อให้โทเค็นพร้อมที่จะป้อนเข้าสู่โมเดล สุดท้าย เราจัดรูปแบบเอาต์พุตโทเค็นและนำคอลัมน์ที่มีข้อความต้นฉบับออก เนื่องจากโมเดลจะไม่สามารถตีความได้ ตอนนี้เหลืออินพุตโทเค็นที่พร้อมป้อนเข้าสู่โมเดล ดูรหัสต่อไปนี้:

เมื่อโทเค็นข้อมูลของเราและแบบจำลองของเราสร้างอินสแตนซ์ เราเกือบจะพร้อมแล้วสำหรับการฝึกวนซ้ำ ส่วนประกอบต่อไปที่เราต้องการสร้างคือ data collator และ optimizer Data collator เป็นอีกคลาสหนึ่งที่ให้บริการโดย Hugging Face ผ่านไลบรารี Transformers ซึ่งเราใช้เพื่อสร้างชุดข้อมูลโทเค็นสำหรับการฝึกอบรม เราสามารถสร้างสิ่งนี้ได้อย่างง่ายดายโดยใช้โทเค็นไนเซอร์และวัตถุโมเดลที่เรามีอยู่แล้ว เพียงแค่ค้นหาประเภทคลาสที่เกี่ยวข้องซึ่งเราใช้ก่อนหน้านี้สำหรับโมเดลของเรา (Seq2Seq) สำหรับคลาสคอลเลเตอร์ ฟังก์ชันของเครื่องมือเพิ่มประสิทธิภาพคือการรักษาสถานะการฝึกอบรมและอัปเดตพารามิเตอร์ตามการสูญเสียการฝึกอบรมของเราเมื่อเราทำงานผ่านลูป ในการสร้างเครื่องมือเพิ่มประสิทธิภาพ เราสามารถนำเข้า Optim แพ็คเกจจากโมดูลคบเพลิงซึ่งมีอัลกอริธึมการปรับให้เหมาะสมจำนวนมาก สิ่งที่พบได้ทั่วไปบางอย่างที่คุณอาจเคยพบมาก่อน ได้แก่ Stochastic Gradient Descent และ อาดัมซึ่งใช้ในตัวอย่างของเรา ตัวสร้างของ Adam ใช้พารามิเตอร์โมเดลและอัตราการเรียนรู้แบบกำหนดพารามิเตอร์สำหรับการดำเนินการฝึกอบรมที่กำหนด ดูรหัสต่อไปนี้:

ขั้นตอนสุดท้ายก่อนที่เราจะเริ่มต้นการฝึกได้คือการสร้างตัวเร่งความเร็วและตัวกำหนดอัตราการเรียนรู้ Accelerator มาจากไลบรารีอื่น (เราใช้ Transformers เป็นหลัก) ที่ผลิตโดย Hugging Face ซึ่งมีชื่อว่า Accelerate และจะแยกตรรกะที่จำเป็นในการจัดการอุปกรณ์ระหว่างการฝึก (เช่น ใช้ GPU หลายตัว) สำหรับองค์ประกอบสุดท้าย เรากลับไปที่ไลบรารี Transformers ที่มีประโยชน์ตลอดเวลาเพื่อใช้งานตัวกำหนดอัตราการเรียนรู้ของเรา โดยการระบุประเภทตัวกำหนดตารางเวลา จำนวนขั้นตอนการฝึกอบรมทั้งหมดในลูปของเรา และเครื่องมือเพิ่มประสิทธิภาพที่สร้างไว้ก่อนหน้านี้ get_scheduler ฟังก์ชันส่งกลับวัตถุที่ช่วยให้เราปรับอัตราการเรียนรู้เริ่มต้นของเราตลอดกระบวนการฝึกอบรม:

ตอนนี้เราพร้อมสำหรับการฝึกซ้อมแล้ว! มาตั้งค่างานฝึกอบรมโดยเริ่มจากการสร้างอินสแตนซ์ การฝึกอบรม_args โดยใช้ไลบรารี Transformers และเลือกค่าพารามิเตอร์ เราสามารถส่งสิ่งเหล่านี้พร้อมกับส่วนประกอบและชุดข้อมูลที่เตรียมไว้อื่นๆ ของเราโดยตรงไปยัง ผู้ฝึกสอน และเริ่มการฝึก ดังโค้ดต่อไปนี้ ขึ้นอยู่กับขนาดของชุดข้อมูลและพารามิเตอร์ที่เลือก การดำเนินการนี้อาจใช้เวลานานพอสมควร

จัดแพ็คเกจแบบจำลองสำหรับการอนุมาน

หลังจากดำเนินการฝึกอบรมแล้ว วัตถุแบบจำลองก็พร้อมที่จะใช้สำหรับการอนุมาน ตามแนวทางปฏิบัติที่ดีที่สุด ให้บันทึกงานของเราไว้ใช้ในอนาคต เราจำเป็นต้องสร้างโมเดลอาร์ติแฟกต์ ซิปเข้าด้วยกัน และอัปโหลด tarball ของเราไปยัง Amazon S3 เพื่อจัดเก็บ เพื่อเตรียมโมเดลของเราสำหรับการ zip เราจำเป็นต้องคลายโมเดลที่ปรับแต่งแล้ว จากนั้นบันทึกโมเดลไบนารีและไฟล์กำหนดค่าที่เกี่ยวข้อง นอกจากนี้ เรายังจำเป็นต้องบันทึกโทเค็นไนเซอร์ของเราไปยังไดเร็กทอรีเดียวกับที่เราบันทึกโมเดลอาร์ติแฟกต์ของเรา เพื่อให้พร้อมใช้งานเมื่อเราใช้โมเดลสำหรับการอนุมาน ของเรา model_dir โฟลเดอร์ควรมีลักษณะดังนี้:

สิ่งที่เหลืออยู่คือการเรียกใช้คำสั่ง tar เพื่อบีบอัดไดเร็กทอรีของเราและอัปโหลดไฟล์ tar.gz ไปยัง Amazon S3:

โมเดลที่ปรับแต่งใหม่ของเราพร้อมแล้วและพร้อมใช้สำหรับการอนุมาน

ทำการอนุมาน

หากต้องการใช้แบบจำลองนี้สำหรับการอนุมาน ให้เปิดไฟล์ใหม่และใช้รหัสต่อไปนี้ แก้ไขไฟล์ model_data พารามิเตอร์เพื่อให้พอดีกับตำแหน่งบันทึกสิ่งประดิษฐ์ของคุณใน Amazon S3 เดอะ HuggingFaceModel ตัวสร้างจะสร้างโมเดลของเราใหม่จากจุดตรวจสอบที่เราบันทึกไว้ model.tar.gzซึ่งเราสามารถปรับใช้สำหรับการอนุมานโดยใช้วิธีการปรับใช้ การทำให้ปลายทางใช้งานได้จะใช้เวลาสองสามนาที

หลังจากปรับใช้จุดสิ้นสุดแล้ว เราสามารถใช้ตัวทำนายที่เราสร้างขึ้นเพื่อทดสอบได้ ผ่าน predict วิธีการเพย์โหลดข้อมูลและเรียกใช้เซลล์ และคุณจะได้รับการตอบสนองจากโมเดลที่ปรับแต่งแล้วของคุณ:

หากต้องการดูประโยชน์ของการปรับแต่งโมเดลอย่างละเอียด เรามาทดสอบอย่างรวดเร็วกัน ตารางต่อไปนี้ประกอบด้วยพร้อมต์และผลลัพธ์ของการส่งผ่านพร้อมท์นั้นไปยังโมเดลก่อนและหลังการปรับละเอียด

| รวดเร็ว | การตอบสนองโดยไม่มีการปรับจูน | ตอบสนองด้วยการปรับละเอียด |

| สรุปอาการที่ผู้ป่วยประสบ ผู้ป่วยเป็นชายอายุ 45 ปี มีอาการเจ็บหน้าอกใต้อกร้าวไปที่แขนซ้าย ความเจ็บปวดเกิดขึ้นอย่างกะทันหันในขณะที่เขากำลังทำงานในสวน ซึ่งเกี่ยวข้องกับการหายใจถี่เล็กน้อยและเสียงกระแอม อัตราการเต้นของหัวใจของผู้ป่วยเมื่อมาถึงคือ 120 อัตราการหายใจ 24 ความดันโลหิต 170/95 ตรวจคลื่นไฟฟ้าหัวใจ 12 ครั้งเมื่อมาถึงแผนกฉุกเฉินและให้ไนโตรกลีเซอรีนใต้ลิ้น XNUMX ครั้งโดยไม่บรรเทาอาการเจ็บหน้าอก กราฟคลื่นไฟฟ้าหัวใจแสดงการยกระดับ ST ในส่วนหน้าซึ่งแสดงให้เห็นถึงภาวะกล้ามเนื้อหัวใจตายเฉียบพลันส่วนหน้า เราได้ติดต่อห้องตรวจสวนหัวใจและเตรียมการสวนหัวใจโดยแพทย์โรคหัวใจ | ขอนำเสนอกรณีกล้ามเนื้อหัวใจตายเฉียบพลัน | อาการเจ็บหน้าอก, หน้า MI, PCI |

อย่างที่คุณเห็น โมเดลที่ปรับแต่งอย่างละเอียดของเราใช้คำศัพท์ด้านสุขภาพแตกต่างกัน และเราสามารถเปลี่ยนโครงสร้างของการตอบสนองให้เหมาะกับวัตถุประสงค์ของเราได้ โปรดทราบว่าผลลัพธ์จะขึ้นอยู่กับชุดข้อมูลของคุณและตัวเลือกการออกแบบที่ทำขึ้นในระหว่างการฝึกอบรม รุ่นของรุ่นของคุณอาจให้ผลลัพธ์ที่แตกต่างกันมาก

ทำความสะอาด

เมื่อคุณใช้โน้ตบุ๊ก SageMaker เสร็จแล้ว อย่าลืมปิดเครื่องเพื่อหลีกเลี่ยงค่าใช้จ่ายจากทรัพยากรที่ต้องใช้เวลานาน โปรดทราบว่าการปิดอินสแตนซ์จะทำให้คุณสูญเสียข้อมูลใดๆ ที่จัดเก็บไว้ในหน่วยความจำชั่วคราวของอินสแตนซ์ ดังนั้นคุณควรบันทึกงานทั้งหมดของคุณไปยังที่จัดเก็บข้อมูลถาวรก่อนที่จะทำการล้างข้อมูล คุณจะต้องไปที่ ปลายทาง บนคอนโซล SageMaker และลบจุดสิ้นสุดใดๆ ที่ปรับใช้สำหรับการอนุมาน หากต้องการลบอาร์ติแฟกต์ทั้งหมด คุณต้องไปที่คอนโซล Amazon S3 เพื่อลบไฟล์ที่อัปโหลดไปยังบัคเก็ตของคุณ

สรุป

ในโพสต์นี้ เราได้สำรวจตัวเลือกต่างๆ สำหรับการใช้เทคนิคการสรุปข้อความบน SageMaker เพื่อช่วยให้บุคลากรทางการแพทย์ประมวลผลและดึงข้อมูลเชิงลึกจากข้อมูลทางคลินิกจำนวนมหาศาลได้อย่างมีประสิทธิภาพ เราได้หารือเกี่ยวกับการใช้โมเดลพื้นฐาน SageMaker Jumpstart การปรับแต่งโมเดลที่ได้รับการฝึกอบรมล่วงหน้าอย่างละเอียดจาก Hugging Face และการสร้างโมเดลการสรุปผลแบบกำหนดเอง แต่ละวิธีมีข้อดีและข้อเสียของตัวเอง ซึ่งรองรับความต้องการและข้อกำหนดที่แตกต่างกัน

การสร้างแบบจำลองการสรุปแบบกำหนดเองบน SageMaker ช่วยให้มีความยืดหยุ่นและการควบคุมมากมาย แต่ต้องใช้เวลาและทรัพยากรมากกว่าการใช้แบบจำลองที่ผ่านการฝึกอบรมมาแล้ว โมเดลพื้นฐาน SageMaker Jumpstart มอบโซลูชันที่ใช้งานง่ายและคุ้มราคาสำหรับองค์กรที่ไม่ต้องการการปรับแต่งหรือการปรับแต่งเฉพาะ รวมถึงตัวเลือกบางอย่างสำหรับการปรับแต่งแบบง่าย การปรับจูนโมเดลที่ได้รับการฝึกอบรมล่วงหน้าอย่างละเอียดจาก Hugging Face ให้เวลาการฝึกเร็วขึ้น ประสิทธิภาพเฉพาะโดเมนที่ดีขึ้น และการผสานรวมอย่างราบรื่นกับเครื่องมือและบริการของ SageMaker ในแคตตาล็อกโมเดลต่างๆ มากมาย แต่ต้องใช้ความพยายามในการนำไปใช้งาน ในขณะที่เขียนบทความนี้ Amazon ได้ประกาศทางเลือกอื่น อเมซอน เบดร็อคซึ่งจะนำเสนอความสามารถในการสรุปในสภาพแวดล้อมที่มีการจัดการมากยิ่งขึ้น

ด้วยการทำความเข้าใจข้อดีและข้อเสียของแต่ละวิธี บุคลากรทางการแพทย์และองค์กรต่างๆ สามารถตัดสินใจอย่างชาญฉลาดเกี่ยวกับโซลูชันที่เหมาะสมที่สุดสำหรับการสร้างบทสรุปที่กระชับและแม่นยำของข้อมูลทางคลินิกที่ซับซ้อน ในท้ายที่สุด การใช้โมเดลการสรุปตาม AI/ML บน SageMaker สามารถปรับปรุงการดูแลผู้ป่วยและการตัดสินใจได้อย่างมีนัยสำคัญ โดยทำให้ผู้เชี่ยวชาญทางการแพทย์สามารถเข้าถึงข้อมูลที่เกี่ยวข้องได้อย่างรวดเร็วและมุ่งเน้นไปที่การดูแลที่มีคุณภาพ

แหล่งข้อมูล

สำหรับสคริปต์ฉบับสมบูรณ์ที่กล่าวถึงในโพสต์นี้และข้อมูลตัวอย่างบางส่วน โปรดดูที่ repo GitHub. สำหรับข้อมูลเพิ่มเติมเกี่ยวกับวิธีเรียกใช้ปริมาณงาน ML บน AWS โปรดดูแหล่งข้อมูลต่อไปนี้:

เกี่ยวกับผู้แต่ง

โคดี้ คอลลินส์ เป็นสถาปนิกโซลูชันในนิวยอร์กที่ Amazon Web Services เขาทำงานร่วมกับลูกค้า ISV เพื่อสร้างโซลูชันชั้นนำของอุตสาหกรรมในระบบคลาวด์ เขาประสบความสำเร็จในการส่งมอบโครงการที่ซับซ้อนสำหรับอุตสาหกรรมที่หลากหลาย โดยเพิ่มประสิทธิภาพและปรับขนาดให้เหมาะสมที่สุด ในเวลาว่าง เขาชอบอ่านหนังสือ เดินทาง และฝึกยิวยิตสู

โคดี้ คอลลินส์ เป็นสถาปนิกโซลูชันในนิวยอร์กที่ Amazon Web Services เขาทำงานร่วมกับลูกค้า ISV เพื่อสร้างโซลูชันชั้นนำของอุตสาหกรรมในระบบคลาวด์ เขาประสบความสำเร็จในการส่งมอบโครงการที่ซับซ้อนสำหรับอุตสาหกรรมที่หลากหลาย โดยเพิ่มประสิทธิภาพและปรับขนาดให้เหมาะสมที่สุด ในเวลาว่าง เขาชอบอ่านหนังสือ เดินทาง และฝึกยิวยิตสู

อาเมียร์ ฮากเม เป็น AWS Solutions Architect ที่อาศัยอยู่ในเพนซิลเวเนีย โฟกัสแบบมืออาชีพของเขาเกี่ยวข้องกับการทำงานร่วมกับผู้จำหน่ายซอฟต์แวร์อิสระทั่วภาคตะวันออกเฉียงเหนือ โดยแนะนำพวกเขาในการออกแบบและสร้างแพลตฟอร์มล้ำสมัยที่ปรับขนาดได้บน AWS Cloud

อาเมียร์ ฮากเม เป็น AWS Solutions Architect ที่อาศัยอยู่ในเพนซิลเวเนีย โฟกัสแบบมืออาชีพของเขาเกี่ยวข้องกับการทำงานร่วมกับผู้จำหน่ายซอฟต์แวร์อิสระทั่วภาคตะวันออกเฉียงเหนือ โดยแนะนำพวกเขาในการออกแบบและสร้างแพลตฟอร์มล้ำสมัยที่ปรับขนาดได้บน AWS Cloud

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

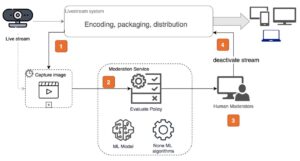

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. ยานยนต์ / EVs, คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- BlockOffsets การปรับปรุงการเป็นเจ้าของออฟเซ็ตด้านสิ่งแวดล้อมให้ทันสมัย เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- สามารถ

- เกี่ยวกับเรา

- บทคัดย่อ

- เร่งความเร็ว

- คันเร่ง

- เข้า

- ลงชื่อเข้าใช้

- ถูกต้อง

- ข้าม

- การปฏิบัติ

- อาดัม

- ที่อยู่

- การบริหารงาน

- สูง

- ข้อได้เปรียบ

- หลังจาก

- อีกครั้ง

- การรวมตัว

- AI

- วิจัยไอ

- AI / ML

- อัลกอริทึม

- ทั้งหมด

- การอนุญาต

- ช่วยให้

- ตาม

- แล้ว

- ด้วย

- อเมซอน

- อเมซอน SageMaker

- Amazon Web Services

- จำนวน

- จำนวน

- an

- วิเคราะห์

- และ

- ประกาศ

- อื่น

- ใด

- API

- APIs

- เหมาะสม

- การใช้งาน

- ประยุกต์

- เข้าใกล้

- วิธีการ

- เหมาะสม

- สถาปัตยกรรม

- เป็น

- ARM

- การมาถึง

- บทความ

- AS

- ที่เกี่ยวข้อง

- At

- ความสนใจ

- โดยอัตโนมัติ

- ใช้ได้

- หลีกเลี่ยง

- ไป

- AWS

- สมดุล

- ตาม

- BE

- เพราะ

- รับ

- ก่อน

- เริ่ม

- ประโยชน์

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ดีกว่า

- BIN

- เลือด

- ความดันโลหิต

- บานสะพรั่ง

- กล่อง

- ลมหายใจ

- กว้าง

- สร้าง

- ผู้สร้าง

- การก่อสร้าง

- สร้าง

- built-in

- แต่

- by

- โทรศัพท์

- ที่เรียกว่า

- CAN

- ความสามารถในการ

- ซึ่ง

- รอบคอบ

- กรณี

- กรณี

- แค็ตตาล็อก

- ก่อให้เกิด

- ความท้าทาย

- เปลี่ยนแปลง

- chatbots

- ทางเลือก

- Choose

- เลือก

- เลือก

- ชั้น

- คลินิก

- เมฆ

- รหัส

- รหัส

- การเข้ารหัส

- การทำงานร่วมกัน

- คอลัมน์

- คอลัมน์

- อย่างไร

- มา

- ร่วมกัน

- เมื่อเทียบกับ

- ร้องเรียน

- ซับซ้อน

- การปฏิบัติตาม

- ส่วนประกอบ

- ส่วนประกอบ

- สงบ

- กระชับ

- องค์ประกอบ

- จุดด้อย

- ปลอบใจ

- ก่อสร้าง

- สิ่งแวดล้อม

- ควบคุม

- สะดวกสบาย

- ตรงกัน

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- ค่าใช้จ่าย

- ได้

- ปกคลุม

- สร้าง

- ที่สร้างขึ้น

- การสร้าง

- สำคัญมาก

- ขณะนี้

- ประเพณี

- ลูกค้า

- ลูกค้า

- การปรับแต่ง

- ข้อมูล

- ชุดข้อมูล

- การตัดสินใจ

- การตัดสินใจ

- คำนิยาม

- ส่ง

- แสดงให้เห็นถึง

- แผนก

- ขึ้นอยู่กับ

- ทั้งนี้ขึ้นอยู่กับ

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- ออกแบบ

- ได้รับการออกแบบ

- การออกแบบ

- ที่ต้องการ

- รายละเอียด

- พัฒนา

- อุปกรณ์

- ต่าง

- โดยตรง

- ค้นพบ

- สนทนา

- กล่าวถึง

- หลาย

- do

- แพทย์

- การทำ

- โดเมน

- โดเมน

- ทำ

- Dont

- ลง

- ข้อเสีย

- ในระหว่าง

- แต่ละ

- ง่ายดาย

- อย่างง่ายดาย

- ง่าย

- ง่ายต่อการใช้งาน

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ความพยายาม

- อิเล็กทรอนิกส์

- บันทึกสุขภาพอิเล็กทรอนิกส์

- เช็คคุณสมบัติที่นี่

- กรณีฉุกเฉิน

- ทำให้สามารถ

- ช่วยให้

- การเปิดใช้งาน

- ปลายทาง

- ชั้นเยี่ยม

- เสริม

- ทำให้มั่นใจ

- Enterprise

- การเข้า

- สิ่งแวดล้อม

- ยุค

- จำเป็น

- แม้

- การพัฒนา

- ตัวอย่าง

- ที่มีอยู่

- ประสบการณ์

- ประสบ

- สำรวจ

- สำรวจ

- สำรวจ

- การขยาย

- สารสกัด

- ใบหน้า

- ต้องเผชิญกับ

- ไกล

- เร็วขึ้น

- เฟด

- สองสาม

- เนื้อไม่มีมัน

- ไฟล์

- สุดท้าย

- ในที่สุด

- หา

- หา

- ชื่อจริง

- พอดี

- ความยืดหยุ่น

- โฟกัส

- ปฏิบัติตาม

- ดังต่อไปนี้

- สำหรับ

- รูป

- รากฐาน

- ราคาเริ่มต้นที่

- เต็ม

- อย่างเต็มที่

- ฟังก์ชัน

- นอกจากนี้

- อนาคต

- ได้รับ

- General

- สร้าง

- สร้าง

- การสร้าง

- ได้รับ

- ได้รับ

- ให้

- กำหนด

- ให้

- Go

- ของ Google

- GPUs

- ยิ่งใหญ่

- มากขึ้น

- รับประกัน

- มี

- he

- สุขภาพ

- การดูแลสุขภาพ

- หัวใจสำคัญ

- ช่วย

- ของเขา

- โฮสติ้ง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HTML

- ที่ http

- HTTPS

- Hub

- กอดใบหน้า

- ในอุดมคติ

- if

- การถ่ายภาพ

- การดำเนินการ

- การดำเนินงาน

- การดำเนินการ

- นำเข้า

- สำคัญ

- ปรับปรุง

- in

- ลึกซึ้ง

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- อิสระ

- อุตสาหกรรม

- อุตสาหกรรม

- ข้อมูล

- แจ้ง

- แรกเริ่ม

- อินพุต

- ปัจจัยการผลิต

- ข้อมูลเชิงลึก

- ตัวอย่าง

- คำแนะนำการใช้

- บูรณาการ

- Intelligence

- เข้าไป

- รวมถึง

- IT

- ITS

- การสัมภาษณ์

- JSON

- เพียงแค่

- ทราบ

- ความรู้

- ห้องปฏิบัติการ

- ห้องปฏิบัติการ

- ภูมิประเทศ

- ภาษา

- ใหญ่

- ชื่อสกุล

- ต่อมา

- นำ

- ชั้นนำ

- นำไปสู่

- เรียนรู้

- การเรียนรู้

- ซ้าย

- ห้องสมุด

- กดไลก์

- LLM

- โหลด

- โหลด

- ที่ตั้ง

- ตรรกะ

- ดู

- สูญเสีย

- ปิด

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- เก็บรักษา

- ทำ

- การทำ

- จัดการ

- การจัดการ

- การจัดการ

- แผนที่

- การตลาด

- อาจ..

- หมายความ

- ทางการแพทย์

- พบ

- หน่วยความจำ

- ครึ่ง

- วิธี

- อาจ

- ต่ำสุด

- นาที

- ML

- แบบ

- โมเดล

- โมดูล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- เป็นที่นิยม

- หลาย

- ที่มีชื่อ

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- นำทาง

- จำเป็นต้อง

- ความต้องการ

- ใหม่

- นิวยอร์ก

- ใหม่

- ถัดไป

- NLP

- ไม่

- สมุดบันทึก

- หมายเหตุ / รายละเอียดเพิ่มเติม

- ตอนนี้

- จำนวน

- วัตถุ

- วัตถุ

- of

- เสนอ

- เสนอ

- เสนอ

- เก่า

- on

- ONE

- คน

- การโจมตี

- ไปยัง

- เปิด

- โอเพนซอร์ส

- ทำงาน

- การเพิ่มประสิทธิภาพ

- เพิ่มประสิทธิภาพ

- การปรับให้เหมาะสม

- การเพิ่มประสิทธิภาพ

- ตัวเลือกเสริม (Option)

- Options

- or

- ใบสั่ง

- องค์กร

- เป็นต้นฉบับ

- อื่นๆ

- มิฉะนั้น

- ของเรา

- ออก

- เอาท์พุต

- ด้านนอก

- เกิน

- ของตนเอง

- การเป็นเจ้าของ

- แพ็คเกจ

- บรรจุภัณฑ์

- หน้า

- อาการเจ็บปวด

- พารามิเตอร์

- พารามิเตอร์

- ในสิ่งที่สนใจ

- ส่ง

- ที่ผ่านไป

- ผู้ป่วย

- ผู้ป่วย

- เพกาซัส

- เพนซิล

- การปฏิบัติ

- เกี่ยวกับ

- วลี

- เวที

- แพลตฟอร์ม

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- ยอดนิยม

- โพสต์

- ที่มีประสิทธิภาพ

- powering

- การปฏิบัติ

- Predictor

- ชอบ

- เตรียมการ

- เตรียม

- นำเสนอ

- ความดัน

- ดูตัวอย่าง

- ก่อนหน้านี้

- ส่วนใหญ่

- กระบวนการ

- กระบวนการ

- การประมวลผล

- ผลิต

- มืออาชีพ

- มืออาชีพ

- โครงการ

- คำมั่นสัญญา

- เป็นเจ้าของ

- PROS

- ให้

- ให้

- ให้

- การให้

- บทบัญญัติ

- วัตถุประสงค์

- วัตถุประสงค์

- ใส่

- หลาม

- คุณภาพ

- รวดเร็ว

- อย่างรวดเร็ว

- พิสัย

- อย่างรวดเร็ว

- คะแนน

- การอ่าน

- พร้อม

- โลกแห่งความจริง

- บันทึก

- ตรงประเด็น

- การสงเคราะห์

- เอาออก

- รายงาน

- ต้องการ

- จำเป็นต้องใช้

- ความต้องการ

- ต้อง

- การวิจัย

- แหล่งข้อมูล

- คำตอบ

- ผลสอบ

- รับคืน

- ทบทวน

- บทบาท

- วิ่ง

- วิ่ง

- ทำงาน

- sagemaker

- เดียวกัน

- ลด

- scalability

- ที่ปรับขนาดได้

- ขอบเขต

- รอยขีดข่วน

- SDK

- sdks

- ไร้รอยต่อ

- ส่วน

- ความปลอดภัย

- เห็น

- แยก

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- การตั้งค่า

- หลาย

- สั้นลง

- น่า

- โชว์

- แสดง

- แสดงให้เห็นว่า

- ปิด

- ร่อน

- สำคัญ

- อย่างมีความหมาย

- คล้ายคลึงกัน

- ง่าย

- ที่เรียบง่าย

- ขนาด

- So

- จนถึงตอนนี้

- ซอฟต์แวร์

- ทางออก

- โซลูชัน

- บาง

- บางสิ่งบางอย่าง

- แหล่งที่มา

- โดยเฉพาะ

- เฉพาะ

- การใช้จ่าย

- เริ่มต้น

- ที่เริ่มต้น

- สถานะ

- รัฐของศิลปะ

- ขั้นตอน

- การเก็บรักษา

- จัดเก็บ

- เก็บไว้

- การเก็บรักษา

- การทำให้เพรียวลม

- โครงสร้าง

- สตูดิโอ

- ลิ้น

- ประสบความสำเร็จ

- อย่างเช่น

- ฉับพลัน

- สูท

- เหมาะสม

- สรุป

- แน่ใจ

- อาการ

- สรุป

- สังเคราะห์

- ข้อมูลสังเคราะห์

- ระบบ

- ตาราง

- เอา

- นำ

- ใช้เวลา

- งาน

- งาน

- เทคนิค

- คำศัพท์

- เงื่อนไขการใช้บริการ

- ทดสอบ

- กว่า

- ที่

- พื้นที่

- ฮับ

- พวกเขา

- แล้วก็

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- เหล่านั้น

- สาม

- ตลอด

- ตลอด

- เวลา

- ต้องใช้เวลามาก

- ครั้ง

- ไปยัง

- วันนี้

- ร่วมกัน

- โทเค็น

- ราชสกุล

- เครื่องมือ

- ไฟฉาย

- รวม

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- เปลี่ยน

- หม้อแปลงไฟฟ้า

- หม้อแปลง

- การเดินทาง

- สอง

- ชนิด

- ชนิด

- เป็นปกติ

- ui

- ในที่สุด

- ไม่สามารถ

- ภายใต้

- เข้าใจ

- ความเข้าใจ

- บันทึก

- อัปโหลด

- us

- ใช้

- ใช้กรณี

- มือสอง

- ที่ใช้งานง่าย

- ใช้

- การใช้

- การใช้ประโยชน์

- การตรวจสอบ

- ความคุ้มค่า

- ต่างๆ

- กว้างใหญ่

- ผู้ขาย

- อเนกประสงค์

- รุ่น

- มาก

- ไดรฟ์

- ต้องการ

- คือ

- we

- ความมั่งคั่ง

- เว็บ

- บริการเว็บ

- ชั่งน้ำหนัก

- ดี

- อะไร

- เมื่อ

- ที่

- ในขณะที่

- กว้าง

- ช่วงกว้าง

- จะ

- กับ

- ไม่มี

- คำ

- งาน

- การทำงาน

- โรงงาน

- จะ

- การเขียน

- ปี

- นิวยอร์ก

- คุณ

- ของคุณ

- ลมทะเล

- รหัสไปรษณีย์