โพสต์นี้เขียนร่วมกับ Jad Chamoun ผู้อำนวยการฝ่ายวิศวกรรมของ Forethought Technologies, Inc. และ Salina Wu วิศวกร ML อาวุโสของ Forethought Technologies, Inc.

คิดล่วงหน้า เป็นชุด AI ชั้นนำสำหรับการบริการลูกค้า หัวใจสำคัญของชุดโปรแกรมคือนวัตกรรม สนับสนุนGPT™ เทคโนโลยีที่ใช้แมชชีนเลิร์นนิงเพื่อเปลี่ยนวงจรชีวิตการสนับสนุนลูกค้า—เพิ่มการเบี่ยงเบน ปรับปรุง CSAT และเพิ่มประสิทธิภาพการทำงานของเจ้าหน้าที่ SupportGPT™ ใช้ประโยชน์จากระบบการดึงข้อมูล (IR) ที่ล้ำสมัยและโมเดลภาษาขนาดใหญ่ (LLM) เพื่อขับเคลื่อนการโต้ตอบกับลูกค้ามากกว่า 30 ล้านครั้งต่อปี

กรณีการใช้งานหลักของ SupportGPT ช่วยเพิ่มคุณภาพและประสิทธิภาพของการโต้ตอบและการดำเนินการสนับสนุนลูกค้า ด้วยการใช้ระบบ IR ที่ล้ำสมัยที่ขับเคลื่อนโดยการฝังและแบบจำลองการจัดอันดับ SupportGPT สามารถค้นหาข้อมูลที่เกี่ยวข้องได้อย่างรวดเร็ว ส่งมอบคำตอบที่ถูกต้องและรัดกุมสำหรับคำถามของลูกค้า Foreththought ใช้แบบจำลองที่ปรับตามลูกค้าแต่ละรายเพื่อตรวจจับความตั้งใจของลูกค้าเพื่อแก้ปัญหาการโต้ตอบกับลูกค้า การรวมโมเดลภาษาขนาดใหญ่ช่วยให้ปฏิสัมพันธ์กับตัวแทนอัตโนมัติมีความเป็นมนุษย์ สร้างประสบการณ์การสนับสนุนที่น่าดึงดูดและน่าพึงพอใจยิ่งขึ้น

SupportGPT ยังช่วยตัวแทนฝ่ายสนับสนุนลูกค้าด้วยการเสนอคำแนะนำการเติมข้อความอัตโนมัติและสร้างการตอบกลับที่เหมาะสมกับตั๋วลูกค้าที่สอดคล้องกับการตอบกลับก่อนหน้านี้ของบริษัท ด้วยการใช้โมเดลภาษาขั้นสูง ตัวแทนสามารถจัดการกับข้อกังวลของลูกค้าได้รวดเร็วและแม่นยำยิ่งขึ้น ส่งผลให้ลูกค้ามีความพึงพอใจสูงขึ้น

นอกจากนี้ สถาปัตยกรรมของ SupportGPT ช่วยให้สามารถตรวจจับช่องว่างในฐานความรู้ด้านการสนับสนุน ซึ่งช่วยให้ตัวแทนให้ข้อมูลที่ถูกต้องมากขึ้นแก่ลูกค้า เมื่อพบช่องว่างเหล่านี้แล้ว SupportGPT สามารถสร้างบทความและเนื้อหาอื่นๆ โดยอัตโนมัติเพื่อเติมเต็มช่องว่างความรู้เหล่านี้ เพื่อให้มั่นใจว่าฐานความรู้การสนับสนุนยังคงยึดลูกค้าเป็นศูนย์กลางและเป็นปัจจุบัน

ในโพสต์นี้ เราจะแชร์วิธีที่ Forethudth ใช้ อเมซอน SageMaker จุดสิ้นสุดหลายรุ่นในกรณีการใช้งาน AI เชิงกำเนิดเพื่อประหยัดค่าใช้จ่ายกว่า 66%

ความท้าทายด้านโครงสร้างพื้นฐาน

เพื่อช่วยนำความสามารถเหล่านี้ออกสู่ตลาด Forethought ปรับขนาดปริมาณงาน ML ได้อย่างมีประสิทธิภาพและจัดหาโซลูชันที่ปรับให้เหมาะกับแต่ละบุคคลโดยเฉพาะซึ่งปรับให้เหมาะกับกรณีการใช้งานเฉพาะของลูกค้าแต่ละราย การปรับให้เป็นส่วนตัวแบบไฮเปอร์นี้ทำได้โดยการปรับแต่งโมเดลการฝังและตัวแยกประเภทในข้อมูลลูกค้าอย่างละเอียด ทำให้มั่นใจได้ถึงผลลัพธ์การดึงข้อมูลที่ถูกต้องและความรู้ในโดเมนที่ตอบสนองความต้องการเฉพาะของลูกค้าแต่ละราย แบบจำลองการเติมข้อความอัตโนมัติที่ปรับแต่งเองยังได้รับการปรับแต่งอย่างละเอียดในข้อมูลลูกค้าเพื่อเพิ่มความแม่นยำและความเกี่ยวข้องของคำตอบที่สร้างขึ้น

หนึ่งในความท้าทายที่สำคัญในการประมวลผลของ AI คือการใช้ทรัพยากรฮาร์ดแวร์อย่าง GPU อย่างมีประสิทธิภาพ เพื่อรับมือกับความท้าทายนี้ Forethought ใช้ SageMaker multi-model endpoints (MME) เพื่อเรียกใช้ AI หลายรุ่นบนจุดสิ้นสุดและสเกลการอนุมานเดียว เนื่องจากการทำให้โมเดลเป็นส่วนตัวแบบไฮเปอร์นั้นต้องการโมเดลที่ไม่ซ้ำใครในการฝึกอบรมและใช้งาน จำนวนของโมเดลจะปรับขนาดตามเส้นตรงกับจำนวนไคลเอนต์ ซึ่งอาจกลายเป็นค่าใช้จ่ายสูง

เพื่อให้บรรลุความสมดุลของประสิทธิภาพสำหรับการอนุมานแบบเรียลไทม์และค่าใช้จ่าย Forethought เลือกใช้ SageMaker MME ซึ่งรองรับการเร่งความเร็ว GPU SageMaker MME ช่วยให้ Forethought สามารถส่งมอบโซลูชันที่มีประสิทธิภาพสูง ปรับขยายได้ และคุ้มทุนด้วยเวลาแฝงที่ต่ำกว่าวินาที จัดการกับสถานการณ์การสนับสนุนลูกค้าที่หลากหลายตามขนาด

SageMaker และความรอบคอบ

SageMaker เป็นบริการที่มีการจัดการเต็มรูปแบบซึ่งช่วยให้นักพัฒนาและนักวิทยาศาสตร์ข้อมูลสามารถสร้าง ฝึกฝน และปรับใช้โมเดล ML ได้อย่างรวดเร็ว SageMaker MME มอบโซลูชันที่ปรับขนาดได้และคุ้มค่าสำหรับการปรับใช้โมเดลจำนวนมากสำหรับการอนุมานแบบเรียลไทม์ MME ใช้คอนเทนเนอร์ที่ให้บริการร่วมกันและกลุ่มทรัพยากรที่สามารถใช้อินสแตนซ์แบบเร่ง เช่น GPU เพื่อโฮสต์โมเดลทั้งหมดของคุณ สิ่งนี้ช่วยลดต้นทุนการโฮสต์โดยเพิ่มการใช้งานปลายทางให้สูงสุดเมื่อเทียบกับการใช้อุปกรณ์ปลายทางรุ่นเดียว นอกจากนี้ยังลดค่าใช้จ่ายในการปรับใช้เนื่องจาก SageMaker จัดการการโหลดและยกเลิกการโหลดโมเดลในหน่วยความจำและปรับขนาดตามรูปแบบการรับส่งข้อมูลของปลายทาง นอกจากนี้ จุดสิ้นสุดตามเวลาจริงของ SageMaker ทั้งหมดยังได้รับประโยชน์จากความสามารถในตัวในการจัดการและตรวจสอบโมเดล เช่น ตัวแปรเงา, ปรับขนาดอัตโนมัติและการรวมเนทีฟด้วย อเมซอน คลาวด์วอตช์ (ดูข้อมูลเพิ่มเติมได้ที่ เมตริก CloudWatch สำหรับการปรับใช้ปลายทางหลายรุ่น).

เมื่อ Forethought เติบโตจนมีโมเดลหลายร้อยรุ่นที่ต้องใช้ทรัพยากร GPU เราก็เห็นโอกาสในการสร้างสถาปัตยกรรมที่คุ้มค่า เชื่อถือได้ และจัดการได้ผ่าน SageMaker MME ก่อนที่จะย้ายไปยัง SageMaker MME โมเดลของเราถูกปรับใช้บน Kubernetes บน บริการ Amazon Elastic Kubernetes (อเมซอน EKS). แม้ว่า Amazon EKS จะมีความสามารถในการจัดการ แต่ก็เห็นได้ชัดว่าเรากำลังจัดการโครงสร้างพื้นฐานที่ไม่ได้ปรับแต่งมาโดยเฉพาะสำหรับการอนุมาน ความคิดล่วงหน้าต้องจัดการการอนุมานโมเดลใน Amazon EKS เอง ซึ่งเป็นภาระต่อประสิทธิภาพทางวิศวกรรม ตัวอย่างเช่น เพื่อแชร์ทรัพยากร GPU ราคาแพงระหว่างรุ่นต่างๆ เรามีหน้าที่รับผิดชอบในการจัดสรรเศษส่วนหน่วยความจำที่เข้มงวดให้กับรุ่นที่ระบุระหว่างการปรับใช้ เราต้องการแก้ไขปัญหาสำคัญต่อไปนี้กับโครงสร้างพื้นฐานที่มีอยู่ของเรา:

- ค่าใช้จ่ายที่สูง – เพื่อให้แน่ใจว่าแต่ละโมเดลมีทรัพยากรเพียงพอ เราจะระมัดระวังอย่างมากในการกำหนดจำนวนโมเดลให้พอดีต่ออินสแตนซ์ ส่งผลให้ต้นทุนสำหรับการโฮสต์แบบจำลองสูงเกินความจำเป็น

- ความน่าเชื่อถือต่ำ – แม้จะมีการจัดสรรหน่วยความจำแบบอนุรักษ์นิยม แต่ไม่ใช่ทุกรุ่นที่มีข้อกำหนดเหมือนกัน และบางครั้งบางรุ่นอาจมีข้อผิดพลาดหน่วยความจำไม่เพียงพอ (OOM)

- การจัดการที่ไม่มีประสิทธิภาพ – เราต้องจัดการรายการการปรับใช้ที่แตกต่างกันสำหรับโมเดลแต่ละประเภท (เช่น ตัวแยกประเภท การฝัง และการเติมข้อความอัตโนมัติ) ซึ่งใช้เวลานานและเกิดข้อผิดพลาดได้ง่าย เรายังต้องรักษาตรรกะเพื่อกำหนดการจัดสรรหน่วยความจำสำหรับโมเดลประเภทต่างๆ

ในท้ายที่สุด เราต้องการแพลตฟอร์มการอนุมานเพื่อจัดการแบบจำลองของเราในขณะรันไทม์เพื่อปรับปรุงต้นทุน ความน่าเชื่อถือ และการจัดการการให้บริการแบบจำลองของเรา SageMaker MME ช่วยให้เราสามารถตอบสนองความต้องการเหล่านี้ได้

ด้วยการโหลดและยกเลิกการโหลดโมเดลที่ชาญฉลาดและไดนามิก และความสามารถในการปรับขนาด SageMaker MME จึงมอบโซลูชันที่มีราคาไม่แพงและเชื่อถือได้มากกว่าสำหรับการโฮสต์โมเดลของเรา ตอนนี้เราสามารถรองรับโมเดลต่ออินสแตนซ์ได้มากขึ้น และไม่ต้องกังวลเกี่ยวกับข้อผิดพลาดของ OOM เนื่องจาก SageMaker MME จัดการการโหลดและยกเลิกการโหลดโมเดลแบบไดนามิก นอกจากนี้ การปรับใช้ยังทำได้ง่ายเพียงแค่เรียก Boto3 SageMaker API และแนบนโยบายการปรับขนาดอัตโนมัติที่เหมาะสม

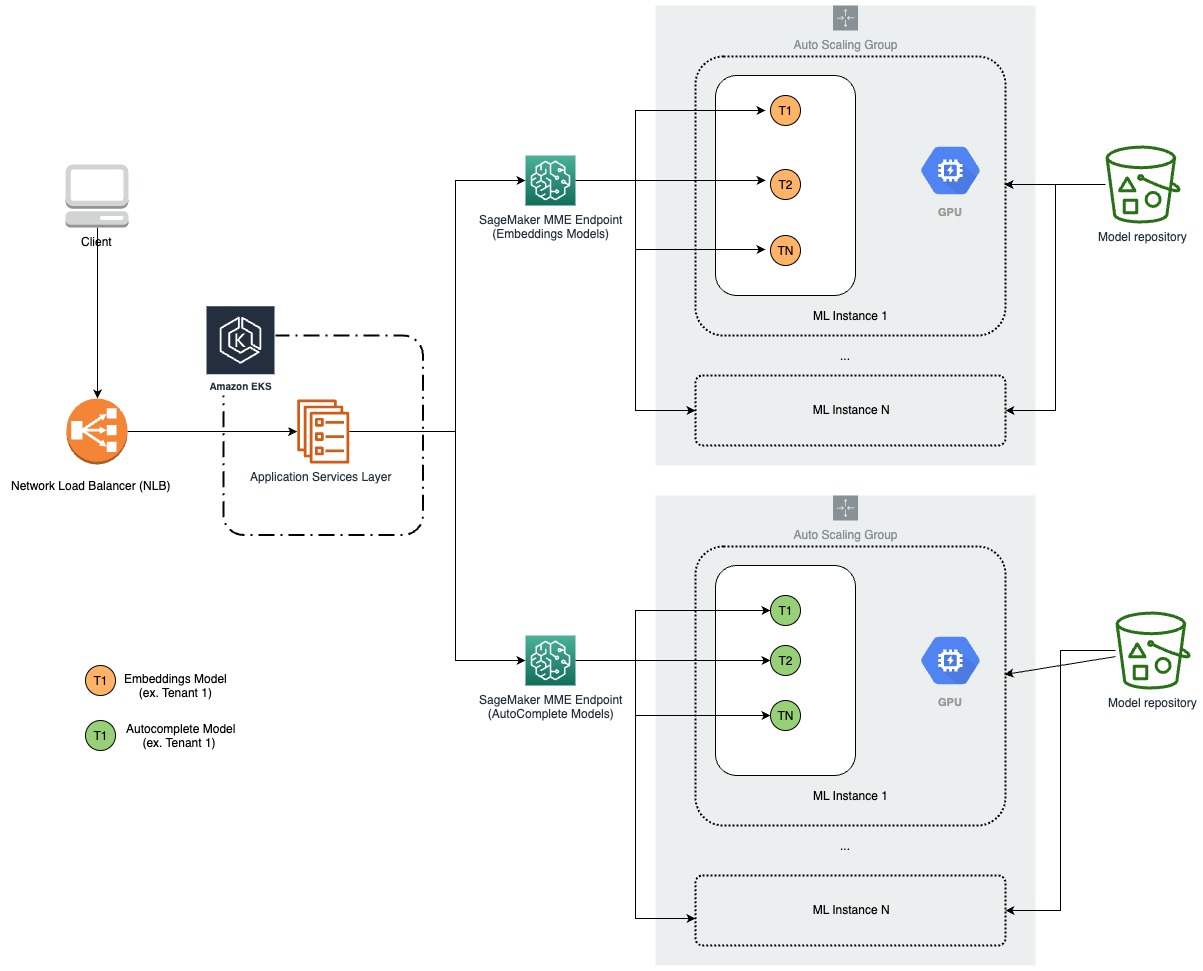

ไดอะแกรมต่อไปนี้แสดงให้เห็นถึงสถาปัตยกรรมดั้งเดิมของเรา

ในการเริ่มต้นการย้ายไปยัง SageMaker MME เราได้ระบุกรณีการใช้งานที่ดีที่สุดสำหรับ MME และโมเดลใดของเราที่จะได้รับประโยชน์สูงสุดจากการเปลี่ยนแปลงนี้ MME เหมาะที่สุดสำหรับสิ่งต่อไปนี้:

- รุ่นที่คาดว่าจะมีเวลาแฝงต่ำ แต่สามารถทนต่อเวลาเริ่มต้นเย็น (เมื่อโหลดครั้งแรก)

- รุ่นที่ถูกเรียกบ่อยและสม่ำเสมอ

- รุ่นที่ต้องการทรัพยากร GPU บางส่วน

- โมเดลที่ใช้ข้อกำหนดทั่วไปและตรรกะการอนุมานร่วมกัน

เราพบว่าโมเดลการฝังและโมเดลภาษาเติมข้อความอัตโนมัติเป็นตัวเลือกที่ดีที่สุดสำหรับการย้ายข้อมูลของเรา ในการจัดระเบียบโมเดลเหล่านี้ภายใต้ MME เราจะสร้าง MME หนึ่งรายการต่อประเภทโมเดลหรืองาน หนึ่งรายการสำหรับโมเดลการฝังของเรา และอีกรายการสำหรับโมเดลภาษาเติมข้อความอัตโนมัติ

เรามีเลเยอร์ API ที่ด้านบนของแบบจำลองของเราสำหรับการจัดการแบบจำลองและการอนุมาน หน้าที่ของเราคือการทำงานใหม่วิธีที่ API นี้ปรับใช้และจัดการการอนุมานเกี่ยวกับโมเดลภายใต้ประทุนด้วย SageMaker โดยมีการเปลี่ยนแปลงเล็กน้อยเกี่ยวกับวิธีที่ลูกค้าและทีมผลิตภัณฑ์โต้ตอบกับ API นอกจากนี้ เรายังจำเป็นต้องทำแพ็กเกจโมเดลของเราและลอจิกการอนุมานแบบกำหนดเองเพื่อให้เข้ากันได้กับ NVIDIA Triton Inference Server โดยใช้ SageMaker MME

แผนภาพต่อไปนี้แสดงสถาปัตยกรรมใหม่ของเรา

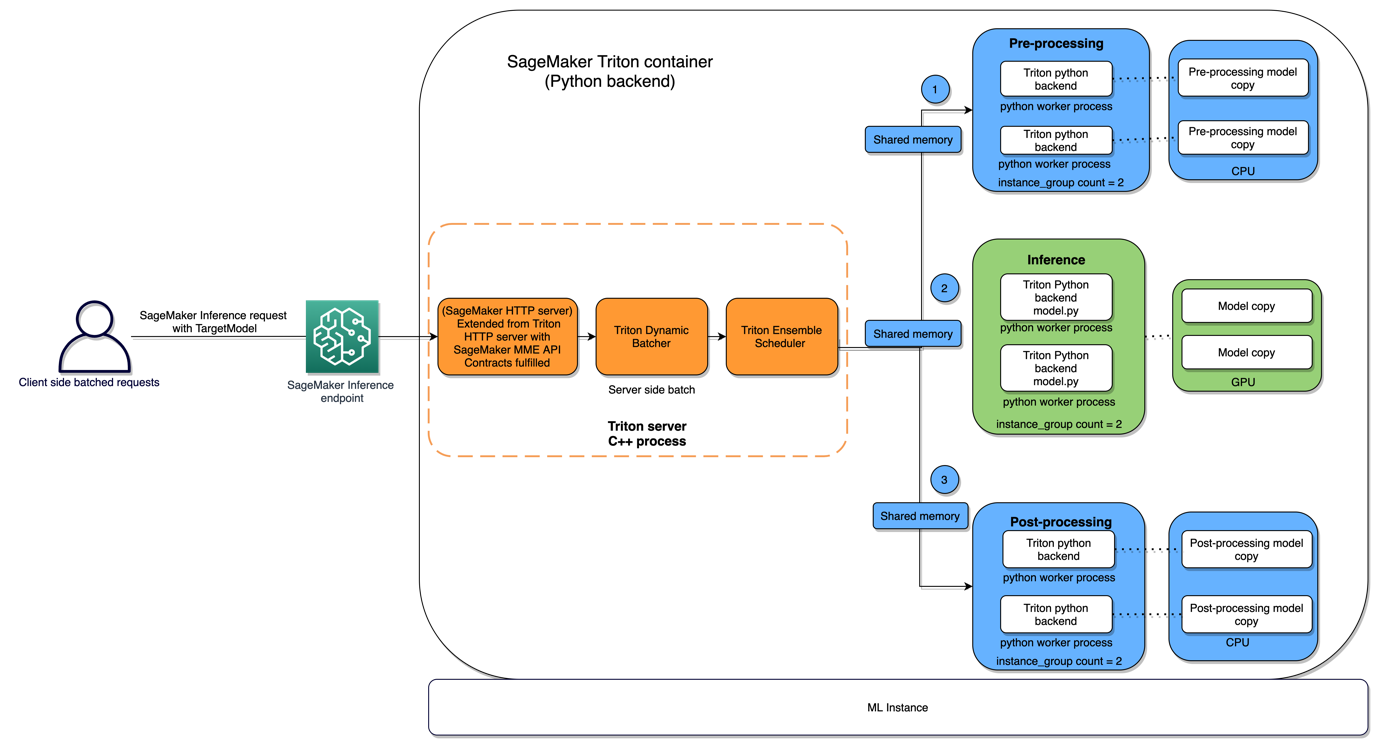

ตรรกะการอนุมานแบบกำหนดเอง

ก่อนที่จะย้ายไปที่ SageMaker รหัสการอนุมานแบบกำหนดเองของ Forethought (การประมวลผลล่วงหน้าและการประมวลผลภายหลัง) จะทำงานในเลเยอร์ API เมื่อมีการเรียกใช้โมเดล วัตถุประสงค์คือเพื่อถ่ายโอนฟังก์ชันนี้ไปยังตัวโมเดลเองเพื่อชี้แจงการแบ่งแยกความรับผิดชอบ ทำให้เป็นโมดูลและทำให้โค้ดง่ายขึ้น และลดภาระใน API

ฝัง

โมเดลการฝังของ Forethought ประกอบด้วยอาร์ติแฟกต์โมเดล PyTorch สองรายการ และคำขอการอนุมานจะกำหนดโมเดลที่จะเรียก แต่ละรุ่นต้องการข้อความที่ประมวลผลล่วงหน้าเป็นอินพุต ความท้าทายหลักคือการรวมขั้นตอนการประมวลผลล่วงหน้าและรองรับสิ่งประดิษฐ์โมเดลสองชิ้นต่อคำจำกัดความของโมเดล เพื่อตอบสนองความต้องการหลายขั้นตอนในตรรกะการอนุมาน Forethought ได้พัฒนาโมเดล Triton ensemble ที่มีสองขั้นตอน: กระบวนการประมวลผลล่วงหน้าของแบ็กเอนด์ Python และการเรียกโมเดลแบ็กเอนด์ PyTorch แบบจำลองทั้งมวลอนุญาตให้กำหนดและเรียงลำดับขั้นตอนในลอจิกการอนุมาน โดยแต่ละขั้นตอนจะแสดงด้วยแบบจำลอง Triton ของแบ็คเอนด์ประเภทใดก็ได้ เพื่อให้แน่ใจว่าเข้ากันได้กับแบ็กเอนด์ Triton PyTorch สิ่งประดิษฐ์โมเดลที่มีอยู่จะถูกแปลงเป็นรูปแบบ TorchScript โมเดล Triton แยกกันถูกสร้างขึ้นสำหรับแต่ละคำจำกัดความของโมเดล และเลเยอร์ API ของ Forethought มีหน้าที่พิจารณาความเหมาะสม TargetModel เพื่อเรียกใช้ตามคำขอที่เข้ามา

อัตโนมัติ

แบบจำลองการเติมข้อความอัตโนมัติ (ลำดับต่อลำดับ) นำเสนอชุดข้อกำหนดที่แตกต่างกัน โดยเฉพาะอย่างยิ่ง เราจำเป็นต้องเปิดใช้ความสามารถในการวนซ้ำการเรียกหลายรุ่นและแคชอินพุตจำนวนมากสำหรับการโทรแต่ละครั้ง ทั้งหมดนี้ในขณะที่รักษาเวลาแฝงให้ต่ำ นอกจากนี้ โมเดลเหล่านี้จำเป็นต้องมีทั้งขั้นตอนก่อนการประมวลผลและขั้นตอนหลังการประมวลผล เพื่อตอบสนองความต้องการเหล่านี้และบรรลุความยืดหยุ่นตามที่ต้องการ Forethought ได้พัฒนาโมเดล MME เติมข้อความอัตโนมัติโดยใช้แบ็กเอนด์ Triton Python ซึ่งมีข้อได้เปรียบในการเขียนโมเดลเป็นโค้ด Python

เปรียบเทียบ

หลังจากกำหนดรูปทรงของโมเดล Triton แล้ว เราได้ปรับใช้โมเดลกับจุดสิ้นสุดการจัดเตรียม และดำเนินการเปรียบเทียบทรัพยากรและประสิทธิภาพ เป้าหมายหลักของเราคือการระบุเวลาแฝงสำหรับการเริ่มเย็นเทียบกับโมเดลในหน่วยความจำ และดูว่าเวลาแฝงได้รับผลกระทบจากขนาดคำขอและการทำงานพร้อมกันอย่างไร นอกจากนี้ เรายังต้องการทราบว่ามีกี่โมเดลที่เหมาะกับแต่ละอินสแตนซ์ มีกี่โมเดลที่จะทำให้อินสแตนซ์ขยายขนาดตามนโยบายการปรับขนาดอัตโนมัติของเรา และการขยายขนาดจะเกิดขึ้นได้เร็วเพียงใด เพื่อให้สอดคล้องกับประเภทอินสแตนซ์ที่เราใช้อยู่ เราได้ทำการเปรียบเทียบด้วยอินสแตนซ์ ml.g4dn.xlarge และ ml.g4dn.2xlarge

ผลสอบ

ตารางต่อไปนี้สรุปผลลัพธ์ของเรา

| ขนาดคำขอ | เวลาแฝงในการเริ่มเย็น | แฝงการอนุมานแคช | เวลาแฝงพร้อมกัน (5 คำขอ) |

| ขนาดเล็ก (30 โทเค็น) | วินาที 12.7 | วินาที 0.03 | วินาที 0.12 |

| ปานกลาง (250 โทเค็น) | วินาที 12.7 | วินาที 0.05 | วินาที 0.12 |

| ใหญ่ (550 โทเค็น) | วินาที 12.7 | วินาที 0.13 | วินาที 0.12 |

อย่างเห็นได้ชัด เวลาแฝงสำหรับคำขอเริ่มเย็นจะสูงกว่าเวลาแฝงสำหรับคำขออนุมานแคชอย่างมีนัยสำคัญ นี่เป็นเพราะต้องโหลดโมเดลจากดิสก์หรือ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) เมื่อมีการร้องขอการเริ่มเย็น เวลาแฝงสำหรับคำขอพร้อมกันยังสูงกว่าเวลาแฝงสำหรับคำขอเดี่ยว นี่เป็นเพราะต้องมีการแชร์โมเดลระหว่างคำขอที่เกิดขึ้นพร้อมกัน ซึ่งอาจนำไปสู่การโต้แย้งได้

ตารางต่อไปนี้เปรียบเทียบเวลาแฝงของรุ่นดั้งเดิมและรุ่น SageMaker

| ขนาดคำขอ | โมเดลรุ่นเก่า | โมเดล SageMaker |

| ขนาดเล็ก (30 โทเค็น) | วินาที 0.74 | วินาที 0.24 |

| ปานกลาง (250 โทเค็น) | วินาที 0.74 | วินาที 0.24 |

| ใหญ่ (550 โทเค็น) | วินาที 0.80 | วินาที 0.32 |

โดยรวมแล้ว โมเดล SageMaker เป็นตัวเลือกที่ดีกว่าสำหรับการโฮสต์โมเดลเติมข้อความอัตโนมัติมากกว่าโมเดลเดิม มีเวลาแฝงที่ต่ำกว่า ความสามารถในการปรับขนาด ความน่าเชื่อถือ และความปลอดภัย

การใช้ทรัพยากร

ในการสืบเสาะหาจำนวนโมเดลที่เหมาะสมที่สุดสำหรับแต่ละอินสแตนซ์ เราได้ทำการทดสอบหลายชุด การทดลองของเราเกี่ยวข้องกับการโหลดโมเดลไปยังจุดสิ้นสุดของเราโดยใช้ประเภทอินสแตนซ์ ml.g4dn.xlarge โดยไม่มีนโยบายปรับขนาดอัตโนมัติ

อินสแตนซ์เฉพาะเหล่านี้มีหน่วยความจำ 15.5 GB และเรามีเป้าหมายที่จะใช้งานหน่วยความจำ GPU ประมาณ 80% ต่ออินสแตนซ์ เมื่อพิจารณาขนาดของอาร์ติแฟกต์โมเดลตัวเข้ารหัสแต่ละรายการ เราจัดการเพื่อหาจำนวนตัวเข้ารหัส Triton ที่เหมาะสมที่สุดในการโหลดบนอินสแตนซ์เพื่อให้เข้าถึงการใช้งานหน่วยความจำ GPU เป้าหมายของเรา นอกจากนี้ เนื่องจากโมเดลการฝังแต่ละโมเดลของเราสอดคล้องกับโมเดลเอ็นโค้ดเดอร์ Triton สองโมเดล เราจึงสามารถจัดเก็บโมเดลการฝังในจำนวนที่กำหนดต่ออินสแตนซ์ ด้วยเหตุนี้ เราจึงคำนวณจำนวนอินสแตนซ์ทั้งหมดที่ต้องใช้ในการให้บริการโมเดลการฝังทั้งหมดของเรา การทดลองนี้มีความสำคัญอย่างยิ่งในการเพิ่มประสิทธิภาพการใช้ทรัพยากรของเราและเพิ่มประสิทธิภาพของแบบจำลองของเรา

เราทำการเปรียบเทียบที่คล้ายกันสำหรับโมเดลเติมข้อความอัตโนมัติของเรา รุ่นเหล่านี้มีขนาดประมาณ 292.0 MB ต่อรุ่น ขณะที่เราทดสอบจำนวนโมเดลที่พอดีกับอินสแตนซ์ ml.g4dn.xlarge เดียว เราสังเกตเห็นว่าเราสามารถใส่โมเดลได้เพียงสี่โมเดลเท่านั้นก่อนที่อินสแตนซ์ของเราจะเริ่มยกเลิกการโหลดโมเดล แม้ว่าโมเดลจะมีขนาดเล็กก็ตาม ข้อกังวลหลักของเราคือ:

- สาเหตุของการใช้หน่วยความจำ CPU เพิ่มขึ้นอย่างรวดเร็ว

- สาเหตุที่โมเดลถูกยกเลิกการโหลดเมื่อเราพยายามโหลดในโมเดลอื่นแทนที่จะเป็นโมเดลที่ใช้ล่าสุด (LRU) น้อยที่สุด

เราสามารถระบุสาเหตุของการใช้งานหน่วยความจำที่เพิ่มขึ้นอย่างรวดเร็วซึ่งมาจากการเริ่มสภาพแวดล้อมรันไทม์ CUDA ของเราในโมเดล Python ซึ่งจำเป็นต่อการย้ายโมเดลและข้อมูลของเราในและนอกอุปกรณ์ GPU CUDA โหลดการอ้างอิงภายนอกจำนวนมากลงในหน่วยความจำ CPU เมื่อเริ่มต้นรันไทม์ เนื่องจากแบ็คเอนด์ Triton PyTorch จัดการและสรุปการย้ายข้อมูลเข้าและออกจากอุปกรณ์ GPU เราจึงไม่พบปัญหานี้สำหรับโมเดลการฝังของเรา เพื่อแก้ไขปัญหานี้ เราได้ลองใช้อินสแตนซ์ ml.g4dn.2xlarge ซึ่งมีหน่วยความจำ GPU เท่าเดิม แต่มีหน่วยความจำ CPU มากกว่าสองเท่า นอกจากนี้ เรายังเพิ่มการปรับแต่งเล็กๆ น้อยๆ หลายอย่างในโค้ดส่วนหลังของ Python รวมถึงการลบเทนเซอร์หลังการใช้งาน การล้างแคช การปิดใช้งานการไล่ระดับสี และการรวบรวมขยะ ด้วยประเภทอินสแตนซ์ที่ใหญ่ขึ้น เราจึงสามารถรองรับได้ 10 รุ่นต่ออินสแตนซ์ และการใช้งานหน่วยความจำ CPU และ GPU ก็มีความสอดคล้องกันมากขึ้น

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมนี้

ปรับขนาดอัตโนมัติ

เราแนบนโยบายการปรับขนาดอัตโนมัติกับทั้งการฝังและการเติมข้อความอัตโนมัติ MME นโยบายของเราสำหรับจุดสิ้นสุดการฝังของเรากำหนดเป้าหมายการใช้หน่วยความจำ GPU เฉลี่ย 80% โดยใช้เมตริกที่กำหนดเอง แบบจำลองการเติมข้อความอัตโนมัติของเราเห็นรูปแบบการเข้าชมสูงในช่วงเวลาทำการและปริมาณการเข้าชมน้อยที่สุดในชั่วข้ามคืน ด้วยเหตุนี้ เราจึงสร้างนโยบายการปรับขนาดอัตโนมัติตาม InvocationsPerInstance เพื่อให้เราสามารถปรับขนาดตามรูปแบบการรับส่งข้อมูล ประหยัดค่าใช้จ่ายโดยไม่สูญเสียความน่าเชื่อถือ ตามการเปรียบเทียบการใช้ทรัพยากรของเรา เราได้กำหนดค่านโยบายการปรับขยายของเราโดยมีเป้าหมายที่ 225 InvocationsPerInstance.

ปรับใช้ตรรกะและไปป์ไลน์

การสร้าง MME บน SageMaker นั้นตรงไปตรงมาและคล้ายกับการสร้างตำแหน่งข้อมูลอื่นๆ บน SageMaker หลังจากสร้างจุดสิ้นสุดแล้ว การเพิ่มโมเดลเพิ่มเติมไปยังจุดสิ้นสุดทำได้ง่ายเพียงแค่ย้ายส่วนจำลองไปยังเส้นทาง S3 ที่ปลายทางกำหนดเป้าหมาย ณ จุดนี้ เราสามารถส่งคำขอการอนุมานไปยังโมเดลใหม่ของเราได้

เราได้กำหนดตรรกะที่จะใช้ในข้อมูลเมตาของแบบจำลอง จัดรูปแบบจุดสิ้นสุดที่กำหนดขึ้นตามข้อมูลเมตา และตรวจสอบว่ามีจุดสิ้นสุดนั้นอยู่หรือไม่ หากไม่เป็นเช่นนั้น เราจะสร้างจุดสิ้นสุดและเพิ่มสิ่งประดิษฐ์โมเดล Triton ไปยังแพตช์ S3 สำหรับจุดสิ้นสุด ตัวอย่างเช่น หากข้อมูลเมตาของโมเดลระบุว่าเป็นโมเดลเติมข้อความอัตโนมัติ ระบบจะสร้างจุดสิ้นสุดสำหรับโมเดลเติมข้อความอัตโนมัติและเส้นทาง S3 ที่เกี่ยวข้องสำหรับอาร์ติแฟกต์โมเดลเติมข้อความอัตโนมัติ หากปลายทางมีอยู่ เราจะคัดลอกแบบจำลองสิ่งประดิษฐ์ไปยังเส้นทาง S3

เมื่อเรามีรูปร่างโมเดลของเราสำหรับโมเดล MME และฟังก์ชันสำหรับการปรับใช้โมเดลของเรากับ MME เราต้องการวิธีที่จะทำให้การปรับใช้เป็นแบบอัตโนมัติ ผู้ใช้ของเราต้องระบุว่าต้องการปรับใช้โมเดลใด เราจัดการบรรจุภัณฑ์และการปรับใช้แบบจำลอง รหัสการอนุมานแบบกำหนดเองที่บรรจุในโมเดลได้รับการกำหนดเวอร์ชันและพุชไปยัง Amazon S3; ในขั้นตอนการบรรจุ เราดึงรหัสอนุมานตามเวอร์ชันที่ระบุ (หรือเวอร์ชันล่าสุด) และใช้ไฟล์ YAML ที่ระบุโครงสร้างไฟล์ของรุ่น Triton

ข้อกำหนดข้อหนึ่งสำหรับเราคือโมเดล MME ทั้งหมดของเราจะถูกโหลดลงในหน่วยความจำเพื่อหลีกเลี่ยงเวลาแฝงในการเริ่มเย็นในระหว่างการร้องขอการอนุมานการผลิตเพื่อโหลดในโมเดล เพื่อให้บรรลุเป้าหมายนี้ เราจัดเตรียมทรัพยากรให้เพียงพอเพื่อให้พอดีกับโมเดลทั้งหมดของเรา (ตามการเปรียบเทียบก่อนหน้านี้) และเรียกใช้โมเดลทุกรุ่นใน MME ของเราเป็นรายชั่วโมง

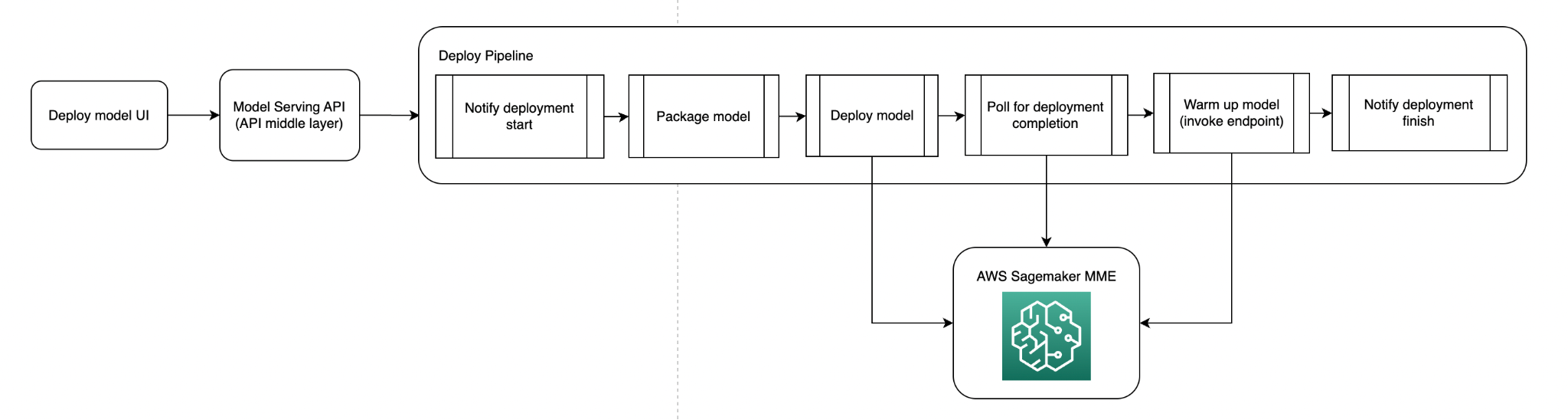

ไดอะแกรมต่อไปนี้แสดงไปป์ไลน์การปรับใช้โมเดล

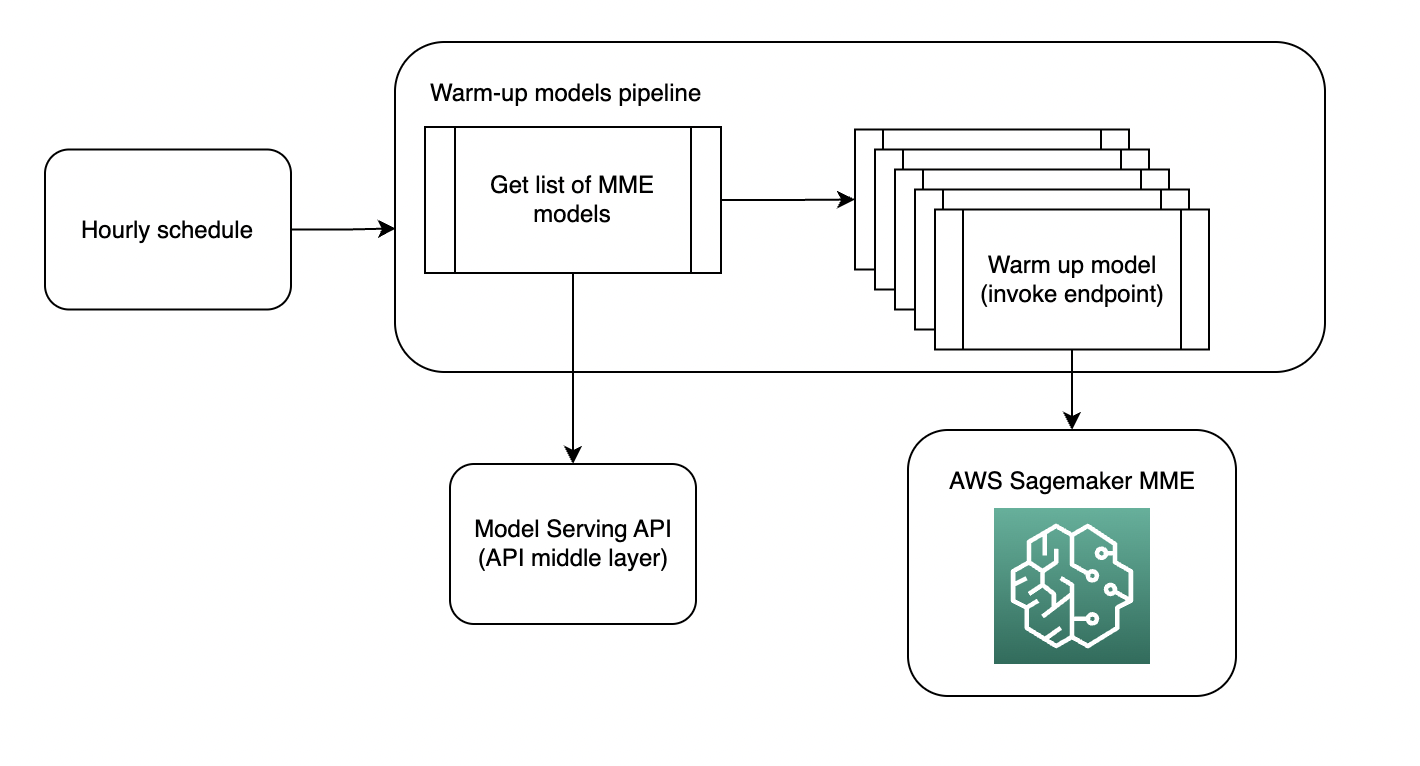

แผนภาพต่อไปนี้แสดงท่ออุ่นเครื่องแบบจำลอง

การเรียกใช้โมเดล

เลเยอร์ API ที่มีอยู่ของเราให้สิ่งที่เป็นนามธรรมสำหรับผู้โทรเพื่อทำการอนุมานเกี่ยวกับโมเดล ML ทั้งหมดของเรา ซึ่งหมายความว่าเราต้องเพิ่มฟังก์ชันการทำงานให้กับเลเยอร์ API เพื่อเรียกใช้ SageMaker MME ด้วยโมเดลเป้าหมายที่ถูกต้องโดยขึ้นอยู่กับคำขอการอนุมาน โดยไม่มีการเปลี่ยนแปลงใดๆ กับรหัสการโทร รหัสอนุมานของ SageMaker รับคำขออนุมาน จัดรูปแบบอินพุต Triton ที่กำหนดไว้ในโมเดล Triton ของเรา และเรียกใช้ MME โดยใช้ Boto3

ผลประโยชน์ด้านต้นทุน

ความรอบคอบทำให้เกิดความก้าวหน้าที่สำคัญในการลดต้นทุนการโฮสต์แบบจำลองและลดข้อผิดพลาด OOM ของแบบจำลอง ต้องขอบคุณการย้ายไปยัง SageMaker MME ก่อนการเปลี่ยนแปลงนี้ อินสแตนซ์ ml.g4dn.xlarge ทำงานใน Amazon EKS เมื่อเปลี่ยนไปใช้ MME เราค้นพบว่าสามารถจัดเก็บโมเดลการฝังได้ 12 โมเดลต่ออินสแตนซ์ ในขณะที่ใช้หน่วยความจำ GPU ได้ถึง 80% สิ่งนี้ทำให้ค่าใช้จ่ายรายเดือนของเราลดลงอย่างมาก เราตระหนักถึงการประหยัดต้นทุนได้ถึง 80% ยิ่งไปกว่านั้น ในการจัดการทราฟฟิกที่สูงขึ้น เราได้พิจารณาขยายขนาดแบบจำลอง สมมติว่าเราใช้ตัวจำลองสามตัว เราพบว่าการประหยัดต้นทุนของเราจะยังคงมีอยู่มากแม้ภายใต้เงื่อนไขเหล่านี้ โดยอยู่ที่ประมาณ 43%

การเดินทางด้วย MME ของ SageMaker ได้รับการพิสูจน์แล้วว่ามีประโยชน์ทางการเงิน ลดค่าใช้จ่ายของเราในขณะเดียวกันก็รับประกันประสิทธิภาพของโมเดลที่เหมาะสมที่สุด ก่อนหน้านี้ โมเดลภาษาการเติมข้อความอัตโนมัติของเราได้รับการปรับใช้ใน Amazon EKS ซึ่งจำเป็นต้องใช้อินสแตนซ์ ml.g4dn.xlarge ในจำนวนที่แตกต่างกันตามการจัดสรรหน่วยความจำต่อโมเดล ส่งผลให้มีค่าใช้จ่ายต่อเดือนมาก อย่างไรก็ตาม ด้วยการโยกย้ายไปยัง SageMaker MME เมื่อเร็ว ๆ นี้ เราสามารถลดค่าใช้จ่ายเหล่านี้ได้อย่างมาก ตอนนี้เราโฮสต์โมเดลทั้งหมดของเราบนอินสแตนซ์ ml.g4dn.2xlarge ทำให้เราสามารถบรรจุโมเดลได้อย่างมีประสิทธิภาพมากขึ้น สิ่งนี้ได้ลดค่าใช้จ่ายรายเดือนของเราลงอย่างมาก และตอนนี้เราประหยัดต้นทุนได้ในช่วง 66–74% ความเคลื่อนไหวนี้ได้แสดงให้เห็นว่าการใช้ทรัพยากรอย่างมีประสิทธิภาพสามารถนำไปสู่การประหยัดทางการเงินได้อย่างมากโดยใช้ SageMaker MME

สรุป

ในโพสต์นี้ เราได้ทบทวนวิธีที่ Forethought ใช้ตำแหน่งข้อมูลหลายรุ่นของ SageMaker เพื่อลดต้นทุนสำหรับการอนุมานแบบเรียลไทม์ SageMaker รับมือกับการยกของหนักที่ไม่แตกต่าง ดังนั้น Forethought จึงสามารถเพิ่มประสิทธิภาพด้านวิศวกรรมได้ นอกจากนี้ยังช่วยให้ Forethought สามารถลดต้นทุนสำหรับการอนุมานแบบเรียลไทม์ได้อย่างมาก ในขณะที่ยังคงรักษาประสิทธิภาพที่จำเป็นสำหรับการดำเนินงานที่สำคัญทางธุรกิจ เมื่อทำเช่นนั้น Forethought สามารถมอบข้อเสนอที่แตกต่างให้กับลูกค้าโดยใช้โมเดลที่ปรับให้เหมาะกับแต่ละบุคคล ใช้ SageMaker MME เพื่อโฮสต์โมเดลของคุณตามขนาดและลดต้นทุนการโฮสต์โดยปรับปรุงการใช้งานปลายทาง นอกจากนี้ยังลดค่าใช้จ่ายในการปรับใช้เนื่องจาก Amazon SageMaker จัดการการโหลดโมเดลในหน่วยความจำและปรับขนาดตามรูปแบบการรับส่งข้อมูลไปยังปลายทางของคุณ คุณสามารถค้นหาตัวอย่างโค้ดในการโฮสต์โมเดลหลายรุ่นโดยใช้ SageMaker MME GitHub.

เกี่ยวกับผู้เขียน

จาดจำรูญ เป็นผู้อำนวยการฝ่ายวิศวกรรมหลักที่ Forethought ทีมของเขามุ่งเน้นไปที่วิศวกรรมแพลตฟอร์มซึ่งครอบคลุมวิศวกรรมข้อมูล โครงสร้างพื้นฐานการเรียนรู้ของเครื่อง และโครงสร้างพื้นฐานระบบคลาวด์ คุณสามารถพบเขาได้ที่ LinkedIn.

จาดจำรูญ เป็นผู้อำนวยการฝ่ายวิศวกรรมหลักที่ Forethought ทีมของเขามุ่งเน้นไปที่วิศวกรรมแพลตฟอร์มซึ่งครอบคลุมวิศวกรรมข้อมูล โครงสร้างพื้นฐานการเรียนรู้ของเครื่อง และโครงสร้างพื้นฐานระบบคลาวด์ คุณสามารถพบเขาได้ที่ LinkedIn.

ซาลีน่า วู เป็นวิศวกร Sr. Machine Learning Infrastructure ที่ Forethought.ai เธอทำงานอย่างใกล้ชิดกับทีมแมชชีนเลิร์นนิงเพื่อสร้างและดูแลการฝึกอบรม การให้บริการ และโครงสร้างพื้นฐานข้อมูลแบบ end-to-end เธอได้รับแรงบันดาลใจเป็นพิเศษจากการแนะนำวิธีใหม่ๆ ในการปรับปรุงประสิทธิภาพและลดต้นทุนในพื้นที่ ML เมื่อไม่ได้ทำงาน ซาลีนาชอบเล่นเซิร์ฟ เล่นเครื่องปั้นดินเผา และอยู่กับธรรมชาติ

ซาลีน่า วู เป็นวิศวกร Sr. Machine Learning Infrastructure ที่ Forethought.ai เธอทำงานอย่างใกล้ชิดกับทีมแมชชีนเลิร์นนิงเพื่อสร้างและดูแลการฝึกอบรม การให้บริการ และโครงสร้างพื้นฐานข้อมูลแบบ end-to-end เธอได้รับแรงบันดาลใจเป็นพิเศษจากการแนะนำวิธีใหม่ๆ ในการปรับปรุงประสิทธิภาพและลดต้นทุนในพื้นที่ ML เมื่อไม่ได้ทำงาน ซาลีนาชอบเล่นเซิร์ฟ เล่นเครื่องปั้นดินเผา และอยู่กับธรรมชาติ

เจมส์พาร์ค เป็นสถาปนิกโซลูชันที่ Amazon Web Services เขาทำงานร่วมกับ Amazon.com ในการออกแบบ สร้าง และปรับใช้โซลูชันเทคโนโลยีบน AWS และมีความสนใจเป็นพิเศษใน AI และการเรียนรู้ของเครื่อง ในเวลาว่างเขาชอบที่จะแสวงหาวัฒนธรรมใหม่ๆ ประสบการณ์ใหม่ๆ และติดตามเทรนด์เทคโนโลยีล่าสุด คุณสามารถพบเขาได้ที่ LinkedIn.

เจมส์พาร์ค เป็นสถาปนิกโซลูชันที่ Amazon Web Services เขาทำงานร่วมกับ Amazon.com ในการออกแบบ สร้าง และปรับใช้โซลูชันเทคโนโลยีบน AWS และมีความสนใจเป็นพิเศษใน AI และการเรียนรู้ของเครื่อง ในเวลาว่างเขาชอบที่จะแสวงหาวัฒนธรรมใหม่ๆ ประสบการณ์ใหม่ๆ และติดตามเทรนด์เทคโนโลยีล่าสุด คุณสามารถพบเขาได้ที่ LinkedIn.

สุนิล ปัทมนาภรณ์ เป็นสถาปนิก Startup Solutions ที่ AWS ในฐานะอดีตผู้ก่อตั้งและ CTO ของสตาร์ทอัพ เขาหลงใหลเกี่ยวกับแมชชีนเลิร์นนิงและมุ่งเน้นที่การช่วยเหลือสตาร์ทอัพใช้ประโยชน์จาก AI/ML สำหรับผลลัพธ์ทางธุรกิจ และออกแบบและปรับใช้โซลูชัน ML/AI ในวงกว้าง

สุนิล ปัทมนาภรณ์ เป็นสถาปนิก Startup Solutions ที่ AWS ในฐานะอดีตผู้ก่อตั้งและ CTO ของสตาร์ทอัพ เขาหลงใหลเกี่ยวกับแมชชีนเลิร์นนิงและมุ่งเน้นที่การช่วยเหลือสตาร์ทอัพใช้ประโยชน์จาก AI/ML สำหรับผลลัพธ์ทางธุรกิจ และออกแบบและปรับใช้โซลูชัน ML/AI ในวงกว้าง

ดาวัล พาเทล เป็นหัวหน้าสถาปนิก Machine Learning ที่ AWS เขาได้ทำงานร่วมกับองค์กรต่างๆ ตั้งแต่องค์กรขนาดใหญ่ไปจนถึงสตาร์ทอัพขนาดกลางในปัญหาที่เกี่ยวข้องกับการคำนวณแบบกระจายและปัญญาประดิษฐ์ เขามุ่งเน้นไปที่การเรียนรู้อย่างลึกซึ้งรวมถึงโดเมน NLP และ Computer Vision เขาช่วยให้ลูกค้าบรรลุการอนุมานแบบจำลองประสิทธิภาพสูงบน SageMaker

ดาวัล พาเทล เป็นหัวหน้าสถาปนิก Machine Learning ที่ AWS เขาได้ทำงานร่วมกับองค์กรต่างๆ ตั้งแต่องค์กรขนาดใหญ่ไปจนถึงสตาร์ทอัพขนาดกลางในปัญหาที่เกี่ยวข้องกับการคำนวณแบบกระจายและปัญญาประดิษฐ์ เขามุ่งเน้นไปที่การเรียนรู้อย่างลึกซึ้งรวมถึงโดเมน NLP และ Computer Vision เขาช่วยให้ลูกค้าบรรลุการอนุมานแบบจำลองประสิทธิภาพสูงบน SageMaker

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- การเงิน EVM ส่วนต่อประสานแบบครบวงจรสำหรับการเงินแบบกระจายอำนาจ เข้าถึงได้ที่นี่.

- กลุ่มสื่อควอนตัม IR/PR ขยาย เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. ข้อมูลอัจฉริยะ Web3 ขยายความรู้ เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/how-forethought-saves-over-66-in-costs-for-generative-ai-models-using-amazon-sagemaker/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 10

- 100

- 12

- 13

- 15%

- 24

- 250

- 30

- 32

- 7

- 80

- a

- ความสามารถ

- สามารถ

- เกี่ยวกับเรา

- สิ่งที่เป็นนามธรรม

- บทคัดย่อ

- เร่ง

- ตาม

- ความถูกต้อง

- ถูกต้อง

- แม่นยำ

- บรรลุ

- ประสบความสำเร็จ

- การบรรลุ

- ข้าม

- เพิ่ม

- ที่เพิ่ม

- เพิ่ม

- นอกจากนี้

- เพิ่มเติม

- นอกจากนี้

- ที่อยู่

- ที่อยู่

- สูง

- ความได้เปรียบ

- หลังจาก

- ตัวแทน

- ตัวแทน

- AI

- กรณีการใช้งาน ai

- AI / ML

- มีวัตถุประสงค์เพื่อ

- จัดแนว

- ชิด

- ทั้งหมด

- การจัดสรร

- อนุญาต

- ช่วยให้

- แล้ว

- ด้วย

- แม้ว่า

- อเมซอน

- อเมซอน SageMaker

- Amazon Web Services

- Amazon.com

- จำนวน

- an

- และ

- ทุกๆปี

- อื่น

- คำตอบ

- ใด

- API

- APIs

- เห็นได้ชัด

- เหมาะสม

- ประมาณ

- สถาปัตยกรรม

- เป็น

- รอบ

- บทความ

- เทียม

- ปัญญาประดิษฐ์

- AS

- ช่วย

- ที่เกี่ยวข้อง

- At

- รถยนต์

- โดยอัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- เฉลี่ย

- หลีกเลี่ยง

- ไป

- AWS

- แบ็กเอนด์

- ยอดคงเหลือ

- ฐาน

- ตาม

- BE

- กลายเป็น

- เพราะ

- กลายเป็น

- รับ

- ก่อน

- เริ่ม

- กำลัง

- การเปรียบเทียบ

- เป็นประโยชน์

- ประโยชน์

- ที่ดีที่สุด

- ดีกว่า

- ระหว่าง

- การส่งเสริม

- ทั้งสอง

- นำมาซึ่ง

- สร้าง

- built-in

- ภาระ

- ธุรกิจ

- แต่

- by

- แคช

- คำนวณ

- โทรศัพท์

- ที่เรียกว่า

- โทร

- โทร

- CAN

- ผู้สมัคร

- ความสามารถในการ

- กรณี

- กรณี

- จัดเลี้ยง

- ก่อให้เกิด

- ท้าทาย

- ความท้าทาย

- เปลี่ยนแปลง

- การเปลี่ยนแปลง

- ตรวจสอบ

- ทางเลือก

- เลือก

- ลูกค้า

- อย่างใกล้ชิด

- เมฆ

- โครงสร้างพื้นฐานคลาวด์

- รหัส

- ผู้สมัครที่ไม่รู้จัก

- การเก็บรวบรวม

- COM

- มา

- ร่วมกัน

- บริษัท

- เมื่อเทียบกับ

- ความเข้ากันได้

- เข้ากันได้

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- การคำนวณ

- ความกังวลเกี่ยวกับ

- พร้อมกัน

- เงื่อนไข

- ดำเนินการ

- การกำหนดค่า

- อนุรักษ์นิยม

- มาก

- ถือว่า

- พิจารณา

- ภาชนะ

- เนื้อหา

- แปลง

- แกน

- แก้ไข

- สอดคล้อง

- ราคา

- ประหยัดค่าใช้จ่าย

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- แพง

- ค่าใช้จ่าย

- ได้

- ครอบคลุม

- สร้าง

- ที่สร้างขึ้น

- การสร้าง

- สำคัญมาก

- CTO

- ประเพณี

- ลูกค้า

- ข้อมูลลูกค้า

- ความพึงพอใจของลูกค้า

- บริการลูกค้า

- Customer Support

- ลูกค้า

- การปรับแต่ง

- ข้อมูล

- วันที่

- ลดลง

- ลดลง

- ลึก

- การเรียนรู้ลึก ๆ

- กำหนด

- การกำหนด

- ส่งมอบ

- การส่งมอบ

- แสดงให้เห็นถึง

- ทั้งนี้ขึ้นอยู่กับ

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- การใช้งาน

- ออกแบบ

- ที่ต้องการ

- แม้จะมี

- กำหนด

- แน่นอน

- แน่นอน

- การกำหนด

- พัฒนา

- นักพัฒนา

- เครื่อง

- DID

- ต่าง

- แตกต่าง

- ผู้อำนวยการ

- ค้นพบ

- แตกต่าง

- กระจาย

- คอมพิวเตอร์แบบกระจาย

- การทำ

- โดเมน

- โดเมน

- Dont

- เป็นคุ้งเป็นแคว

- ในระหว่าง

- พลวัต

- แบบไดนามิก

- แต่ละ

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- การฝัง

- ทำให้สามารถ

- ช่วยให้

- จบสิ้น

- ปลายทาง

- น่าสนใจ

- วิศวกร

- ชั้นเยี่ยม

- เสริม

- การเสริมสร้าง

- พอ

- ทำให้มั่นใจ

- การสร้างความมั่นใจ

- ผู้ประกอบการ

- สิ่งแวดล้อม

- ข้อผิดพลาด

- แม้

- ทุกๆ

- ตัวอย่าง

- ที่มีอยู่

- ที่คาดหวัง

- รายจ่าย

- แพง

- ประสบการณ์

- ประสบการณ์

- การทดลอง

- ภายนอก

- เร็วขึ้น

- เนื้อไม่มีมัน

- ไฟล์

- ใส่

- ทางการเงิน

- ให้เงิน

- หา

- ชื่อจริง

- พอดี

- FLEET

- ความยืดหยุ่น

- มุ่งเน้นไปที่

- ดังต่อไปนี้

- สำหรับ

- รูป

- อดีต

- พบ

- ผู้สร้าง

- สี่

- ราคาเริ่มต้นที่

- อย่างเต็มที่

- ฟังก์ชั่น

- ต่อไป

- นอกจากนี้

- ช่องว่าง

- สร้าง

- สร้าง

- กำเนิด

- กำเนิด AI

- ได้รับ

- GIF

- กำหนด

- ให้

- เป้าหมาย

- GPU

- GPUs

- การไล่ระดับสี

- มี

- มือ

- จัดการ

- จัดการ

- การจัดการ

- เกิดขึ้น

- ฮาร์ดแวร์

- มี

- มี

- he

- หนัก

- ยกของหนัก

- ช่วย

- การช่วยเหลือ

- จะช่วยให้

- จุดสูง

- ประสิทธิภาพสูง

- สูงกว่า

- พระองค์

- ของเขา

- กระโปรงหน้ารถ

- เจ้าภาพ

- โฮสติ้ง

- ค่าใช้จ่ายในการโฮสต์

- ชั่วโมง

- บ้าน

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- ร้อย

- ระบุ

- if

- แสดงให้เห็นถึง

- ทันที

- ปรับปรุง

- การปรับปรุง

- in

- อิงค์

- รวมทั้ง

- ขาเข้า

- เพิ่ม

- แสดง

- แสดงว่า

- ข้อมูล

- โครงสร้างพื้นฐาน

- โครงสร้างพื้นฐาน

- นวัตกรรม

- อินพุต

- ปัจจัยการผลิต

- ตัวอย่าง

- แทน

- การบูรณาการ

- บูรณาการ

- Intelligence

- ปฏิสัมพันธ์

- ปฏิสัมพันธ์

- อยากเรียนรู้

- เข้าไป

- แนะนำ

- เรียก

- จะเรียก

- ร่วมมือ

- ปัญหา

- IT

- ITS

- ตัวเอง

- การเดินทาง

- jpg

- เพียงแค่

- การเก็บรักษา

- คีย์

- ทราบ

- ความรู้

- ภาษา

- ใหญ่

- องค์กรขนาดใหญ่

- ที่มีขนาดใหญ่

- ความแอบแฝง

- ล่าสุด

- ชั้น

- นำ

- ชั้นนำ

- การเรียนรู้

- น้อยที่สุด

- นำ

- มรดก

- น้อยลง

- เลฟเวอเรจ

- ยกระดับ

- facelift

- โหลด

- โหลด

- โหลด

- ตรรกะ

- ต่ำ

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- หลัก

- เก็บรักษา

- การบำรุงรักษา

- ทำ

- จัดการ

- การจัดการ

- การจัดการ

- จัดการ

- การจัดการ

- หลาย

- ตลาด

- การเพิ่ม

- หมายความว่า

- หน่วยความจำ

- เมตาดาต้า

- ตัวชี้วัด

- การโยกย้าย

- การโยกย้าย

- ล้าน

- ต่ำสุด

- ผู้เยาว์

- ซึ่งบรรเทา

- ML

- แบบ

- โมเดล

- การตรวจสอบ

- รายเดือน

- ข้อมูลเพิ่มเติม

- ยิ่งไปกว่านั้น

- มากที่สุด

- แรงบันดาลใจ

- ย้าย

- การย้าย

- มาก

- ปลายทางหลายรุ่น

- หลาย

- ต้อง

- พื้นเมือง

- ธรรมชาติ

- จำเป็น

- จำเป็นต้อง

- จำเป็น

- ความต้องการ

- ใหม่

- NLP

- ตอนนี้

- จำนวน

- Nvidia

- วัตถุประสงค์

- of

- ปิด

- เสนอ

- การเสนอ

- เสนอ

- มักจะ

- on

- ครั้งเดียว

- ONE

- เพียง

- การดำเนินการ

- โอกาส

- ดีที่สุด

- การเพิ่มประสิทธิภาพ

- or

- ใบสั่ง

- องค์กร

- อื่นๆ

- ของเรา

- ตัวเรา

- ออก

- ผลลัพธ์

- เกิน

- ค้างคืน

- ห่อ

- แพ็คเกจ

- แพคเกจ

- บรรจุภัณฑ์

- ในสิ่งที่สนใจ

- โดยเฉพาะ

- หลงใหล

- ปะ

- เส้นทาง

- แบบแผน

- รูปแบบ

- การปฏิบัติ

- มุมมอง

- ท่อ

- เวที

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- นโยบาย

- นโยบาย

- โพสต์

- อำนาจ

- ขับเคลื่อน

- นำเสนอ

- ก่อน

- ก่อนหน้านี้

- ประถม

- หลัก

- ก่อน

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- การประมวลผล

- ผลิตภัณฑ์

- การผลิต

- ผลผลิต

- เหมาะสม

- ที่พิสูจน์แล้ว

- ให้

- ให้

- ให้

- บทบัญญัติ

- ผลักดัน

- ใส่

- หลาม

- ไฟฉาย

- คุณภาพ

- คำสั่ง

- การแสวงหา

- อย่างรวดเร็ว

- พิสัย

- ตั้งแต่

- อันดับ

- มาถึง

- เรียลไทม์

- ตระหนัก

- เมื่อเร็ว ๆ นี้

- เมื่อเร็ว ๆ นี้

- ลด

- ลด

- ลด

- ที่เกี่ยวข้อง

- ความสัมพันธ์กัน

- ตรงประเด็น

- ความเชื่อถือได้

- น่าเชื่อถือ

- ซากศพ

- เป็นตัวแทนของ

- ขอ

- การร้องขอ

- จำเป็นต้องใช้

- ความต้องการ

- ความต้องการ

- ต้อง

- ทรัพยากร

- แหล่งข้อมูล

- การตอบสนอง

- ความรับผิดชอบ

- รับผิดชอบ

- ผล

- ส่งผลให้

- ผลสอบ

- สุดท้าย

- ขวา

- เข้มงวด

- ราก

- วิ่ง

- วิ่ง

- เสียสละ

- sagemaker

- การอนุมาน SageMaker

- เดียวกัน

- ความพอใจ

- ลด

- ประหยัด

- เงินออม

- เห็น

- scalability

- ที่ปรับขนาดได้

- ขนาด

- ไต่ขึ้น

- ตาชั่ง

- ปรับ

- สถานการณ์

- สถานการณ์

- นักวิทยาศาสตร์

- ค้นหา

- ความปลอดภัย

- ที่กำลังมองหา

- ระดับอาวุโส

- แยก

- ลำดับ

- ชุด

- ให้บริการ

- บริการ

- บริการ

- การให้บริการ

- ชุด

- หลาย

- เงา

- รูปร่าง

- Share

- ที่ใช้ร่วมกัน

- เธอ

- สำคัญ

- อย่างมีความหมาย

- คล้ายคลึงกัน

- ง่าย

- ลดความซับซ้อน

- เดียว

- ขนาด

- เล็ก

- สมาร์ท

- So

- ทางออก

- โซลูชัน

- แก้

- บาง

- ช่องว่าง

- โดยเฉพาะ

- เฉพาะ

- ที่ระบุไว้

- ขัดขวาง

- การแสดงละคร

- เริ่มต้น

- ข้อความที่เริ่ม

- การเริ่มต้น

- startups

- รัฐของศิลปะ

- ขั้นตอน

- ขั้นตอน

- ยังคง

- การเก็บรักษา

- ซื่อตรง

- ความก้าวหน้า

- เป็นกอบเป็นกำ

- อย่างเช่น

- ชุด

- สนับสนุน

- ระบบ

- ตาราง

- ต่อสู้

- ปรับปรุง

- เอา

- ใช้เวลา

- เป้า

- เป้าหมาย

- เป้าหมาย

- งาน

- ทีม

- ทีม

- เทคโนโลยี

- เทคโนโลยี

- การทดสอบ

- การทดสอบ

- กว่า

- ขอบคุณ

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- สาม

- ตลอด

- บัตรเข้าชม

- เวลา

- ต้องใช้เวลามาก

- ไปยัง

- ราชสกุล

- ด้านบน

- รวม

- การจราจร

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- โอน

- แปลง

- การเปลี่ยนแปลง

- แนวโน้ม

- พยายาม

- ไทรทัน

- สองครั้ง

- สอง

- ชนิด

- ชนิด

- ภายใต้

- เป็นเอกลักษณ์

- us

- การใช้

- ใช้

- ใช้กรณี

- มือสอง

- ผู้ใช้

- ใช้

- การใช้

- การใช้ประโยชน์

- รุ่น

- มาก

- วิสัยทัศน์

- vs

- ต้องการ

- อยาก

- คือ

- ทาง..

- วิธี

- we

- เว็บ

- บริการเว็บ

- คือ

- เมื่อ

- ว่า

- ที่

- ในขณะที่

- กับ

- ไม่มี

- งาน

- ทำงาน

- โรงงาน

- กังวล

- จะ

- การเขียน

- wu

- มันแกว

- คุณ

- ของคุณ

- ลมทะเล