Bugün, Llama 2 modellerine Meta tarafından ince ayar yapma olanağını duyurmanın heyecanını yaşıyoruz. Amazon SageMaker Hızlı Başlangıç. Büyük dil modellerinden (LLM'ler) oluşan Llama 2 ailesi, ölçeği 7 milyardan 70 milyar parametreye kadar değişen, önceden eğitilmiş ve ince ayarı yapılmış üretken metin modellerinden oluşan bir koleksiyondur. Llama-2-chat adı verilen ince ayarlı LLM'ler diyalog kullanım durumları için optimize edilmiştir. Bu modelleri kolayca deneyebilir ve bunları, ML'ye hızlı bir şekilde başlayabilmeniz için algoritmalara, modellere ve ML çözümlerine erişim sağlayan bir makine öğrenimi (ML) merkezi olan SageMaker JumpStart ile kullanabilirsiniz. Artık SageMaker JumpStart'ta 7 milyar, 13 milyar ve 70 milyar parametreli Llama 2 metin oluşturma modellerine ince ayar yapabilirsiniz. Amazon SageMaker Stüdyosu Birkaç tıklamayla veya SageMaker Python SDK'yı kullanarak kullanıcı arayüzü.

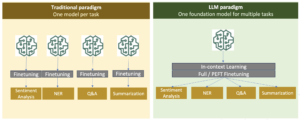

Üretken yapay zeka temel modelleri, bir yılı aşkın bir süredir çoğu makine öğreniminin ve yapay zeka araştırmalarının ve kullanım senaryolarının odak noktası olmuştur. Bu temel modeller, büyük boyutları ve aynı zamanda birkaç büyük veri kümesi ve yüzlerce görev üzerinde eğitilmeleri nedeniyle metin oluşturma, özetleme, soru yanıtlama, görüntü ve video oluşturma ve daha fazlası gibi üretken görevlerde çok iyi performans gösterir. Bu modellerin büyük genelleme yeteneklerine rağmen, sıklıkla çok özel alan verilerine (sağlık hizmetleri veya finansal hizmetler gibi) sahip kullanım senaryoları vardır ve bu nedenle bu modeller, bu kullanım senaryoları için iyi sonuçlar sağlayamayabilir. Bu, kullanım durumuna özgü ve alana özgü veriler üzerinden bu üretken yapay zeka modellerinde daha fazla ince ayar yapılması ihtiyacını doğurur.

Bu yazıda, SageMaker JumpStart aracılığıyla Llama 2'nin önceden eğitilmiş metin oluşturma modellerine nasıl ince ayar yapılacağını açıklıyoruz.

Lama 2 nedir

Llama 2, optimize edilmiş bir dönüştürücü mimarisi kullanan otomatik gerileyen bir dil modelidir. Llama 2, İngilizce ticari kullanım ve araştırma amaçlıdır. 7 milyar, 13 milyar ve 70 milyar gibi çeşitli parametre boyutlarının yanı sıra önceden eğitilmiş ve ince ayarlı varyasyonlarla gelir. Meta'ya göre ayarlanmış sürümler, insanın yardımseverlik ve güvenlik tercihlerine uyum sağlamak için denetimli ince ayar (SFT) ve insan geri bildirimi (RLHF) ile pekiştirmeli öğrenme kullanıyor. Llama 2, halka açık kaynaklardan alınan 2 trilyon token veri üzerinde önceden eğitildi. Ayarlanmış modeller asistan benzeri sohbet için tasarlanmıştır, oysa önceden eğitilmiş modeller çeşitli doğal dil oluşturma görevleri için uyarlanabilir. Bir geliştiricinin kullandığı modelin hangi sürümünden bağımsız olarak, Meta'dan sorumlu kullanım kılavuzu modelleri uygun güvenlik önlemleriyle özelleştirmek ve optimize etmek için gerekli olabilecek ek ince ayarlara rehberlik etmeye yardımcı olabilir.

Şu anda Llama 2 aşağıdaki bölgelerde mevcuttur:

- Mevcut önceden eğitilmiş modeli dağıtın:

"us-west-2","us-east-1","us-east-2","eu-west-1","ap-southeast-1","ap-southeast-2" - İnce ayarı yapılmış modele ince ayar yapın ve dağıtın:

“us-east-1”,“us-west-2”,“eu-west-1”

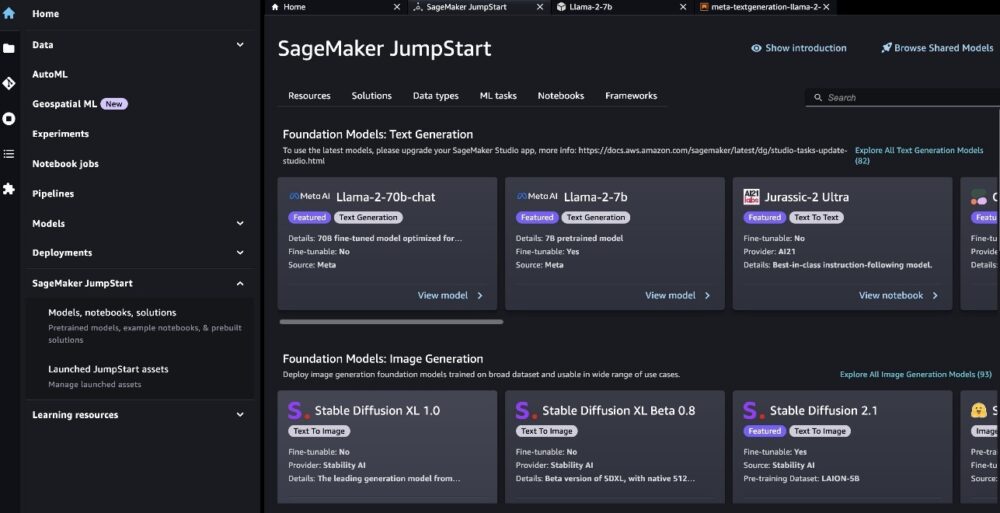

SageMaker JumpStart nedir?

SageMaker JumpStart ile makine öğrenimi uygulayıcıları, halka açık geniş bir temel model yelpazesi arasından seçim yapabilir. ML uygulayıcıları temel modelleri özel olarak dağıtabilir Amazon Adaçayı Yapıcı ağdan yalıtılmış bir ortamdan örnekler alın ve model eğitimi ve dağıtımı için SageMaker'ı kullanarak modelleri özelleştirin. Artık Llama 2'yi SageMaker Studio'da birkaç tıklamayla veya SageMaker Python SDK aracılığıyla programlı olarak keşfedebilir ve dağıtabilirsiniz; böylece SageMaker özellikleriyle model performansı ve MLOps kontrolleri elde edebilirsiniz. Amazon SageMaker Ardışık Düzenleri, Amazon SageMaker Hata Ayıklayıcısıveya konteyner günlükleri. Model, AWS güvenli ortamında ve VPC kontrolleriniz altında dağıtılarak veri güvenliğinin sağlanmasına yardımcı olur. Ek olarak, SageMaker JumpStart aracılığıyla Llama2 7B, 13B ve 70B önceden eğitilmiş metin oluşturma modellerine ince ayar yapabilirsiniz.

Llama2 modellerinde ince ayar yapın

SageMaker Studio kullanıcı arayüzünü veya SageMaker Python SDK'yı kullanarak modellerde ince ayar yapabilirsiniz. Bu bölümde her iki yöntemi de tartışacağız.

SageMaker Studio Kullanıcı Arayüzü aracılığıyla kod gerektirmeden ince ayar yapma

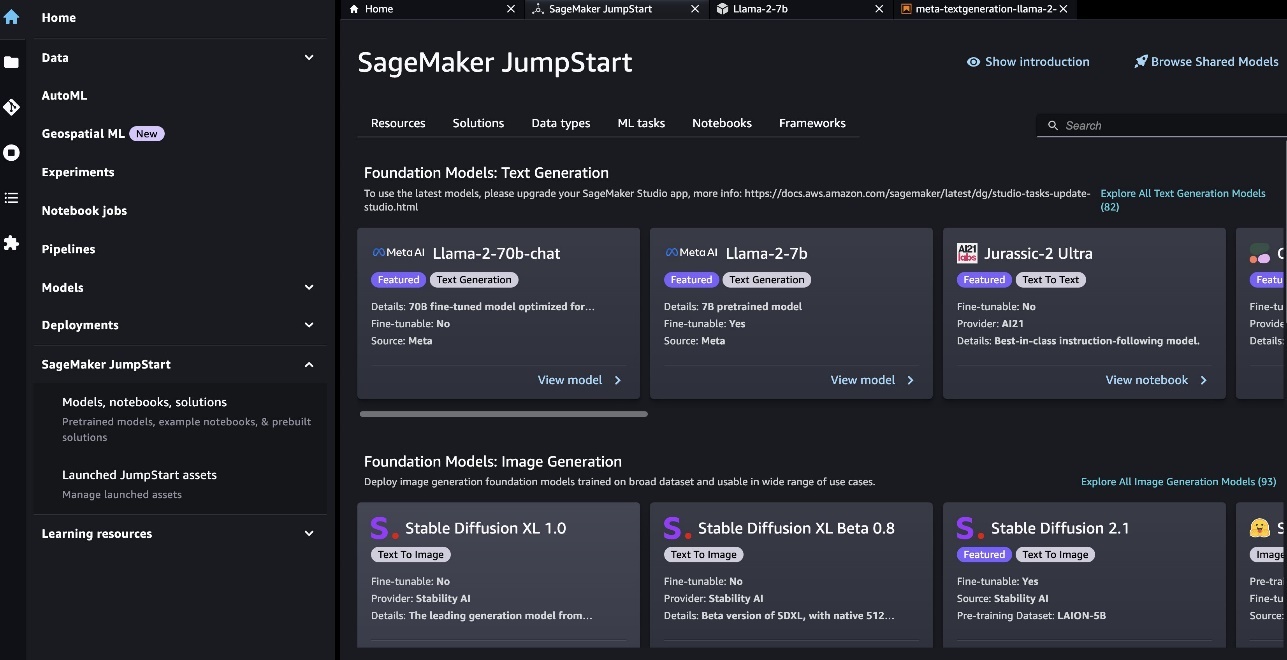

SageMaker Studio'da, Llama 2 modellerine SageMaker JumpStart aracılığıyla şu adresten erişebilirsiniz: Modeller, not defterleri ve çözümler, aşağıdaki ekran görüntüsünde gösterildiği gibi.

Llama 2 modellerini görmüyorsanız kapatıp yeniden başlatarak SageMaker Studio sürümünüzü güncelleyin. Sürüm güncellemeleri hakkında daha fazla bilgi için bkz. Studio Uygulamalarını Kapatın ve Güncelleyin.

Seçerek diğer dört model varyantını da bulabilirsiniz. Tüm Metin Oluşturma Modellerini Keşfedin veya arama kutusunda lama'yı arayın.

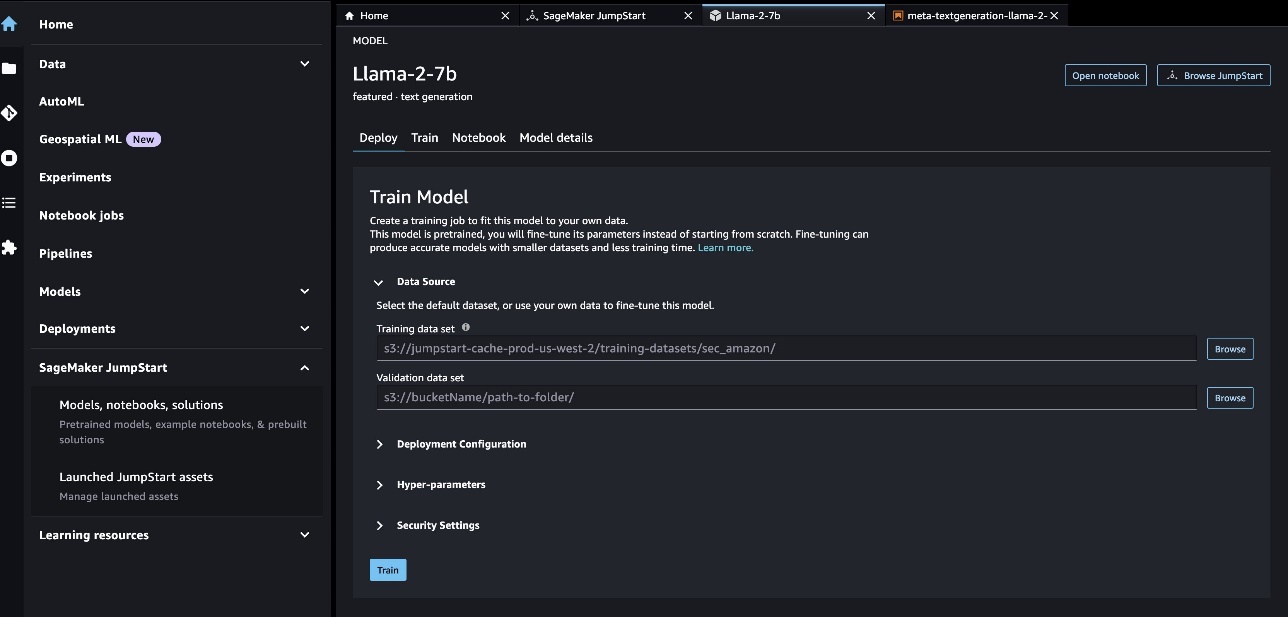

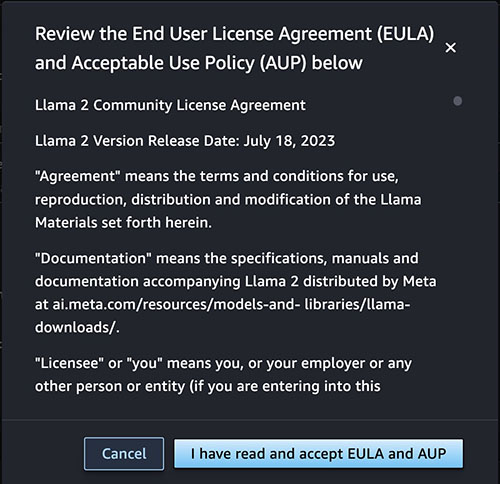

Bu sayfada şunları işaret edebilirsiniz: Amazon Basit Depolama Hizmeti İnce ayar için eğitim ve doğrulama veri kümelerini içeren (Amazon S3) paketi. Ayrıca, ince ayar yapmak için dağıtım yapılandırmasını, hiperparametreleri ve güvenlik ayarlarını yapılandırabilirsiniz. Daha sonra seçebilirsiniz Tren SageMaker ML örneğinde eğitim işini başlatmak için. Önceki ekran görüntüsü Llama-2 7B modelinin ince ayar sayfasını göstermektedir; ancak benzer şekilde ilgili model sayfalarını kullanarak 13B ve 70B Llama 2 metin oluşturma modellerine ince ayar yapabilirsiniz. Llama 2 modellerini kullanmak için Son Kullanıcı Lisans Sözleşmesini (EULA) kabul etmeniz gerekir. Seçtiğinizde görünecektir Trenaşağıdaki ekran görüntüsünde gösterildiği gibi. Seçmek EULA ve AUP'yi okudum ve kabul ediyorum ince ayar işine başlamak için.

Modeli dağıtın

Modelde ince ayar yapıldıktan sonra SageMaker JumpStart'taki model sayfasını kullanarak dağıtabilirsiniz. Aşağıdaki ekran görüntüsünde gösterildiği gibi, ince ayar tamamlandığında ince ayarlı modeli dağıtma seçeneği görünecektir.

SageMaker Python SDK aracılığıyla ince ayar yapın

Ayrıca SageMaker Python SDK'yı kullanarak Llama 2 modellerinde ince ayar yapabilirsiniz. Veri kümenizdeki Llama 2 7B'ye ince ayar yapmak için örnek kod aşağıda verilmiştir:

İnce ayarlı modeli doğrudan tahmin aracından dağıtabilirsiniz:

Kodu şurada da bulabilirsiniz SageMaker JumpStart'ta LLaMA 2 modellerine ince ayar yapın. Veri kümesi hazırlığını, özel veri kümeniz üzerinde eğitimi ve ince ayarlı modelin dağıtımını içerir. Özetleme görevinden örneklerle Dolly veri kümesinin bir alt kümesinde ince ayar yapılmasını gösterir. Aşağıda, ince ayarlı ve ince ayarlı olmayan yanıtların yanı sıra temel gerçek yanıtını içeren örnek girdi yer almaktadır:

Modele giriş:

Temel Gerçek yanıtı:

İnce ayar yapılmamış modelin yanıtı:

İnce ayarlı modelin yanıtı:

Dolly ve Dialogsum veri kümesinde farklı modellerin performans kıyaslaması için bkz. Performans karşılaştırması Bu yazının sonundaki ekte yer alan bölüm.

İnce ayar tekniği

Llama gibi dil modellerinin boyutu 10 GB'tan, hatta 100 GB'tan fazladır. Bu kadar büyük modellerde ince ayar yapmak, önemli ölçüde yüksek CUDA belleğine sahip örnekler gerektirir. Ayrıca bu modellerin eğitimi, modelin boyutundan dolayı çok yavaş olabilir. Bu nedenle verimli ince ayar için aşağıdaki optimizasyonları kullanıyoruz:

- Düşük Dereceli Uyarlama (LoRA) – Bu, büyük modellerin verimli ince ayarına yönelik bir tür parametre verimli ince ayardır (PEFT). Burada tüm modeli donduruyoruz ve modele yalnızca küçük bir dizi ayarlanabilir parametre veya katman ekliyoruz. Örneğin, Llama 7 2B için 7 milyar parametrenin tamamını eğitmek yerine parametrelerin %1'inden daha azına ince ayar yapabiliriz. Bu, bellek gereksiniminin önemli ölçüde azaltılmasına yardımcı olur çünkü parametrelerin yalnızca %1'i için degradeleri, optimize edici durumlarını ve eğitimle ilgili diğer bilgileri saklamamız gerekir. Ayrıca bu, eğitim süresinin ve maliyetin azaltılmasına yardımcı olur. Bu yöntemle ilgili daha fazla ayrıntı için bkz. LoRA: Büyük Dil Modellerinin Düşük Dereceli Uyarlaması.

- Int8 nicemleme – LoRA gibi optimizasyonlarla bile Llama 70B gibi modeller eğitilemeyecek kadar büyük. Eğitim sırasında bellek ayak izini azaltmak için eğitim sırasında Int8 kuantizasyonunu kullanabiliriz. Niceleme genellikle kayan noktalı veri türlerinin kesinliğini azaltır. Bu, model ağırlıklarını depolamak için gereken belleği azaltsa da bilgi kaybı nedeniyle performansı düşürür. Int8 niceleme yalnızca çeyrek hassasiyet kullanır ancak bitleri düşürmediği için performansın düşmesine neden olmaz. Verileri bir türden diğerine yuvarlar. Int8 nicemleme hakkında bilgi edinmek için bkz. LLM.int8(): Uygun Ölçekte Transformatörler için 8-bit Matris Çarpımı.

- Tamamen Parçalanmış Veri Paralel (FSDP) – Bu, modelin parametrelerini veri paralel çalışanları arasında bölen ve isteğe bağlı olarak eğitim hesaplamasının bir kısmını CPU'lara aktarabilen bir tür veri paralel eğitim algoritmasıdır. Parametreler farklı GPU'lar arasında paylaştırılsa da, her bir mikro grubun hesaplanması GPU çalışanı için yereldir. Parametreleri daha düzgün bir şekilde parçalara ayırır ve eğitim sırasında iletişim ve hesaplamanın örtüşmesi yoluyla optimize edilmiş performansa ulaşır.

Aşağıdaki tablo, farklı yöntemleri üç Llama 2 modeliyle karşılaştırmaktadır.

| , | Varsayılan Bulut Sunucusu Türü | Varsayılan yapılandırmayla Desteklenen Örnek Türleri | Varsayılan ayarlar | LORA + FSDP | LORA + FSDP Yok | Int8 Niceleme + LORA + FSDP Yok |

| Lama 2 7B | ml.g5.12xlarge | ml.g5.12xlarge, ml.g5.24xlarge, ml.g5.48xlarge | LORA + FSDP | Evet | Evet | Evet |

| Lama 2 13B | ml.g5.12xlarge | ml.g5.24xlarge, ml.g5.48xlarge | LORA + FSDP | Evet | Evet | Evet |

| Lama 2 70B | ml.g5.48xlarge | ml.g5.48xlarge | INT8 + LORA + FSDP YOK | Yok hayır | Yok hayır | Evet |

Lama modellerinin ince ayarının aşağıdakiler tarafından sağlanan komut dosyalarına dayandığını unutmayın. GitHub repo.

Eğitim veri kümesi biçimi

SageMaker JumpStart şu anda hem etki alanı uyarlama formatında hem de talimat ayarlama formatındaki veri kümelerini desteklemektedir. Bu bölümde her iki formatta da örnek bir veri seti belirliyoruz. Daha fazla ayrıntı için bkz. Veri kümesi biçimlendirmesi Ekteki bölümde.

Etki alanı uyarlama biçimi

Metin oluşturma Llama 2 modeline, alana özgü herhangi bir veri kümesinde ince ayar yapılabilir. Etki alanına özgü veri kümesinde ince ayar yapıldıktan sonra modelin, alana özgü metin üretmesi ve o belirli etki alanındaki çeşitli NLP görevlerini birkaç adımlık yönlendirmeyle çözmesi bekleniyor. Bu veri kümesinde girdi CSV, JSON veya TXT dosyasından oluşur. Örneğin, giriş verileri bir metin dosyası olarak Amazon'un SEC dosyaları olabilir:

Talimat ayarlama formatı

Talimatın ince ayarında model, talimatlar kullanılarak açıklanan bir dizi doğal dil işleme (NLP) görevi için ince ayar yapılır. Bu, sıfır atışlı istemlerle görünmeyen görevler için modelin performansının geliştirilmesine yardımcı olur. Talimat ayarlama veri kümesi formatında, template.json Giriş ve çıkış formatlarını açıklayan dosya. Örneğin dosyadaki her satır train.jsonl aşağıdaki gibi görünüyor:

Ek dosya template.json aşağıdaki gibi görünüyor:

Eğitim için desteklenen hiperparametreler

Llama 2 ince ayarı, her biri ince ayarlı modelin bellek gereksinimini, eğitim hızını ve performansını etkileyebilecek bir dizi hiper parametreyi destekler:

- çağ – İnce ayar algoritmasının eğitim veri kümesinde gerçekleştirdiği geçiş sayısı. 1'den büyük bir tam sayı olmalıdır. Varsayılan 5'tir.

- öğrenme oranı – Her eğitim örneği grubu üzerinde çalışıldıktan sonra model ağırlıklarının güncellenme hızı. 0'dan büyük bir pozitif kayan nokta olmalıdır. Varsayılan 1e-4'tür.

- talimat_tuned – Modeli eğitip eğitmeyeceği. Olmalıdır '

True'veya'False'. Varsayılan: 'False'. - per_device_train_batch_size – Eğitim için GPU çekirdeği/CPU başına parti boyutu. Pozitif bir tam sayı olmalıdır. Varsayılan 4'tür.

- per_device_eval_batch_size – Değerlendirme için GPU çekirdeği/CPU başına parti boyutu. Pozitif bir tam sayı olmalıdır. Varsayılan 1'dir.

- max_train_samples – Hata ayıklama amacıyla veya daha hızlı eğitim için eğitim örneklerinin sayısını bu değere düşürün. Değer -1, tüm eğitim örneklerinin kullanılması anlamına gelir. Pozitif bir tam sayı veya -1 olmalıdır. Varsayılan -1'dir.

- max_val_samples – Hata ayıklama amacıyla veya daha hızlı eğitim için doğrulama örneklerinin sayısını bu değere düşürün. Değer -1, tüm doğrulama örneklerinin kullanılması anlamına gelir. Pozitif bir tam sayı veya -1 olmalıdır. Varsayılan -1'dir.

- max_input_length – Tokenizasyondan sonra maksimum toplam giriş dizisi uzunluğu. Bundan daha uzun diziler kesilecektir. -1 ise,

max_input_lengthminimum 1024'e ve tokenizer tarafından tanımlanan maksimum model uzunluğuna ayarlanmıştır. Pozitif bir değere ayarlanırsa,max_input_lengthsağlanan değerin minimumuna ayarlanır vemodel_max_lengthtokenizer tarafından tanımlanır. Pozitif bir tam sayı veya -1 olmalıdır. Varsayılan -1'dir. - validation_split_ratio – Doğrulama kanalı ise

none, tren verilerinden tren doğrulama ayırma oranı 0-1 arasında olmalıdır. Varsayılan 0.2'dir. - train_data_split_seed – Doğrulama verileri mevcut değilse, bu, giriş eğitim verilerinin algoritma tarafından kullanılan eğitim ve doğrulama verilerine rastgele bölünmesini düzeltir. Tam sayı olmak zorunda. Varsayılan 0'dır.

- preprocessing_num_workers – Ön işleme için kullanılacak işlemlerin sayısı. Eğer

None, ana işlem ön işleme için kullanılır. Varsayılan:None. - lora_r – Lora R. Pozitif bir tam sayı olmalıdır. Varsayılan 8'dir.

- lora_alpha - Lora Alfa. Pozitif bir tam sayı olmalıdır. Varsayılan 32'dir

- lora_dropout – Lora Bırakma. 0 ile 1 arasında pozitif bir kayan nokta olmalıdır. Varsayılan 0.05'tir.

- int8_kuantizasyon - Eğer

Truemodel, eğitim için 8 bit hassasiyetle yüklenir. 7B ve 13B için varsayılan:False. 70B için varsayılan:True. - etkinleştirme_fsdp - Eğer

True, eğitim FSDP'yi kullanır. 7B ve 13B için varsayılan:True. 70B için varsayılan:False. Bunu not etint8_quantizationFSDP tarafından desteklenmez.

Örnek türleri ve uyumlu hiperparametreler

İnce ayar sırasında bellek gereksinimi çeşitli faktörlere bağlı olarak değişebilir:

- Model türü – 7B modeli en az GPU bellek gereksinimine sahiptir ve 70B modeli en büyük bellek gereksinimine sahiptir

- Maksimum giriş uzunluğu – Giriş uzunluğunun daha yüksek değeri, aynı anda daha fazla jetonun işlenmesine yol açar ve bu nedenle daha fazla CUDA belleği gerektirir

- Parti boyutu – Daha büyük bir toplu iş boyutu, daha büyük CUDA belleği gerektirir ve dolayısıyla daha büyük bulut sunucusu türleri gerektirir

- Int8 nicemleme – Int8 niceleme kullanılıyorsa model düşük hassasiyetle yüklenir ve bu nedenle daha az CUDA belleği gerektirir

Başlamanıza yardımcı olmak için, başarılı bir şekilde ince ayar yapılabilecek farklı bulut sunucusu türleri, hiper parametreler ve model türlerinden oluşan bir dizi kombinasyon sunuyoruz. Gereksinimlerinize ve bulut sunucusu türlerinin kullanılabilirliğine göre bir yapılandırma seçebilirsiniz. Özetleme örnekleriyle birlikte Dolly veri kümesinin bir alt kümesinde üç dönem içeren çeşitli ayarlarda üç modelin tamamına ince ayar yapıyoruz.

7B modeli

Aşağıdaki tabloda 7B modelindeki ince ayar seçenekleri özetlenmektedir.

| Örnek Türü | Maksimum Giriş Uzunluğu | Cihaz Başına Parti Boyutu | Int8 Niceleme | FSDP'yi etkinleştir | Harcanan Zaman (dakika) |

| ml.g4dn.12xlarge | 1024 | 8 | DOĞRU | YANLIŞ | 166 |

| ml.g4dn.12xlarge | 2048 | 2 | DOĞRU | YANLIŞ | 178 |

| ml.g4dn.12xlarge | 1024 | 4 | YANLIŞ | DOĞRU | 120 |

| ml.g4dn.12xlarge | 2048 | 2 | YANLIŞ | DOĞRU | 143 |

| ml.g5.2xlarge | 1024 | 4 | DOĞRU | YANLIŞ | 61 |

| ml.g5.2xlarge | 2048 | 2 | DOĞRU | YANLIŞ | 68 |

| ml.g5.2xlarge | 1024 | 4 | YANLIŞ | DOĞRU | 43 |

| ml.g5.2xlarge | 2048 | 2 | YANLIŞ | DOĞRU | 49 |

| ml.g5.4xlarge | 1024 | 4 | YANLIŞ | DOĞRU | 39 |

| ml.g5.4xlarge | 2048 | 2 | YANLIŞ | DOĞRU | 50 |

| ml.g5.12xlarge | 1024 | 16 | DOĞRU | YANLIŞ | 57 |

| ml.g5.12xlarge | 2048 | 4 | DOĞRU | YANLIŞ | 64 |

| ml.g5.12xlarge | 1024 | 4 | YANLIŞ | DOĞRU | 26 |

| ml.g5.12xlarge | 2048 | 4 | YANLIŞ | DOĞRU | 23 |

| ml.g5.48xlarge | 1024 | 16 | DOĞRU | YANLIŞ | 59 |

| ml.g5.48xlarge | 2048 | 4 | DOĞRU | YANLIŞ | 67 |

| ml.g5.48xlarge | 1024 | 8 | YANLIŞ | DOĞRU | 22 |

| ml.g5.48xlarge | 2048 | 4 | YANLIŞ | DOĞRU | 21 |

13B

Aşağıdaki tabloda 13B modelindeki ince ayar seçenekleri özetlenmektedir.

| Örnek Türü | Maksimum Giriş Uzunluğu | Cihaz Başına Parti Boyutu | Int8 Niceleme | FSDP'yi etkinleştir | Harcanan Zaman (dakika) |

| ml.g4dn.12xlarge | 1024 | 4 | DOĞRU | YANLIŞ | 283 |

| ml.g4dn.12xlarge | 2048 | 2 | DOĞRU | YANLIŞ | 328 |

| ml.g5.12xlarge | 1024 | 8 | DOĞRU | YANLIŞ | 92 |

| ml.g5.12xlarge | 2048 | 4 | DOĞRU | YANLIŞ | 104 |

| ml.g5.48xlarge | 1024 | 8 | DOĞRU | YANLIŞ | 95 |

| ml.g5.48xlarge | 2048 | 4 | DOĞRU | YANLIŞ | 107 |

| ml.g5.48xlarge | 1024 | 8 | YANLIŞ | DOĞRU | 35 |

| ml.g5.48xlarge | 2048 | 2 | YANLIŞ | DOĞRU | 41 |

70B

Aşağıdaki tabloda 70B modelindeki ince ayar seçenekleri özetlenmektedir.

| Örnek Türü | Maksimum Giriş Uzunluğu | Cihaz Başına Parti Boyutu | Int8 Niceleme | FSDP'yi etkinleştir | Harcanan Zaman (dakika) |

| ml.g5.48xlarge | 1024 | 4 | DOĞRU | YANLIŞ | 396 |

| ml.g5.48xlarge | 2048 | 1 | DOĞRU | YANLIŞ | 454 |

Örnek türleri ve hiper parametrelere ilişkin öneriler

Modelin doğruluğuna ince ayar yaparken aşağıdakileri aklınızda bulundurun:

- 70B gibi daha büyük modeller 7B'den daha iyi performans sağlar

- Int8 nicelemesiz performans, INT8 nicelemeli performanstan daha iyidir

Aşağıdaki eğitim süresine ve CUDA bellek gereksinimlerine dikkat edin:

- ayar

int8_quantization=TrueBellek gereksinimini azaltır ve daha hızlı eğitime yol açar. - Azalan

per_device_train_batch_sizevemax_input_lengthbellek gereksinimini azaltır ve bu nedenle daha küçük örneklerde çalıştırılabilir. Ancak değerlerin çok düşük ayarlanması eğitim süresini artırabilir. - Int8 nicelemesini kullanmıyorsanız (

int8_quantization=False), FSDP'yi kullanın (enable_fsdp=True) daha hızlı ve verimli eğitim için.

Bulut sunucusu tipini seçerken aşağıdakileri göz önünde bulundurun:

- G5 bulut sunucuları, desteklenen bulut sunucusu türleri arasında en verimli eğitimi sağlar. Bu nedenle G5 bulut sunucularınız varsa bunları kullanmalısınız.

- Eğitim süresi büyük ölçüde GPU sayısına ve mevcut CUDA belleğine bağlıdır. Bu nedenle, aynı sayıda GPU'ya (örneğin, ml.g5.2xlarge ve ml.g5.4xlarge) sahip bulut sunucuları üzerinde eğitim kabaca aynıdır. Bu nedenle eğitim için daha ucuz örneği kullanabilirsiniz (ml.g5.2xlarge).

- p3 örnekleri kullanıldığında bfloat32 bu örneklerde desteklenmediği için eğitim 16 bit hassasiyetle yapılacaktır. Bu nedenle eğitim işi, p3 bulut sunucuları üzerinde eğitim sırasında g5 bulut sunucularına kıyasla iki kat daha fazla CUDA belleği tüketecektir.

Örnek başına eğitim maliyeti hakkında bilgi edinmek için bkz. Amazon EC2 G5 Örnekleri.

Veri seti talimat ayarlama formatındaysa ve giriş+tamamlama dizileri küçükse (50-100 kelime gibi), bu durumda yüksek bir değere sahip olursunuz. max_input_length çok düşük performansa yol açar. Bu parametrenin varsayılan değeri -1'dir ve bu da şuna karşılık gelir: max_input_length Lama modelleri için 2048. Bu nedenle veri kümeniz küçük örnekler içeriyorsa küçük bir değer kullanmanızı öneririz. max_input_length (200–400 gibi).

Son olarak, G5 bulut sunucularına olan talebin yüksek olması nedeniyle bu bulut sunucularının bölgenizde kullanılamaması hatasıyla karşılaşabilirsiniz. “CapacityError: Unable to provision requested ML compute capacity. Please retry using a different ML instance type.” Bu hatayla karşılaşırsanız eğitim işini yeniden deneyin veya farklı bir Bölge deneyin.

Çok büyük modellerde ince ayar yapılırken karşılaşılan sorunlar

Bu bölümde çok büyük modellere ince ayar yaparken iki konuyu tartışacağız.

Çıkış sıkıştırmasını devre dışı bırak

Varsayılan olarak bir eğitim işinin çıktısı, Amazon S3'e yüklenmeden önce .tar.gz biçiminde sıkıştırılmış eğitimli bir modeldir. Ancak modelin boyutunun büyük olması nedeniyle bu adım uzun sürebilmektedir. Örneğin 70B modelinin sıkıştırılması ve yüklenmesi 4 saatten fazla sürebilmektedir. Bu sorunu önlemek için SageMaker eğitim platformunun desteklediği çıktı sıkıştırmayı devre dışı bırakma özelliğini kullanabilirsiniz. Bu durumda model, dağıtım için ayrıca kullanılan herhangi bir sıkıştırma olmadan yüklenir:

SageMaker Studio çekirdeği zaman aşımı sorunu

Llama 70B modelinin boyutundan dolayı eğitim işi birkaç saat sürebilir ve SageMaker Studio çekirdeği eğitim aşamasında ölebilir. Ancak bu süre zarfında SageMaker'da eğitim devam etmektedir. Böyle bir durumda uç noktayı aşağıdaki kodla eğitim işi adını kullanarak dağıtmaya devam edebilirsiniz:

Eğitim işi adını bulmak için SageMaker konsoluna gidin ve Eğitim gezinme bölmesinde öğesini seçin. Eğitim işleri. Eğitim işi adını tanımlayın ve bunu önceki kodda değiştirin.

Sonuç

Bu yazıda, SageMaker JumpStart'ı kullanarak Meta'nın Llama 2 modellerine ince ayar yapmayı tartıştık. Bu modellere ince ayar yapmak ve dağıtmak için SageMaker Studio'daki SageMaker JumpStart konsolunu veya SageMaker Python SDK'yı kullanabileceğinizi gösterdik. Ayrıca ince ayar tekniğini, örnek türlerini ve desteklenen hiperparametreleri de tartıştık. Ayrıca, yürüttüğümüz çeşitli testlere dayanarak optimize edilmiş eğitim önerilerinin ana hatlarını çizdik. Üç modelin iki veri kümesi üzerinde ince ayarının sonuçları bu yazının sonundaki ekte gösterilmektedir. Bu sonuçlardan da görebileceğimiz gibi, ince ayar, ince ayar yapılmayan modellere kıyasla özetlemeyi geliştirir. Bir sonraki adım olarak, kullanım senaryolarınız için sonuçları test etmek ve kıyaslamak amacıyla GitHub deposunda sağlanan kodu kullanarak bu modellere kendi veri kümenizde ince ayar yapmayı deneyebilirsiniz.

Yazarlar, Christopher Whitten, Xin Huang, Kyle Ulrich, Sifei Li, Amy You, Adam Kozdrowicz, Evan Kravitz, Benjamin Crabtree, Haotian An, Manan Shah, Tony Cruz, Ernev Sharma, Jonathan Guinegagne ve June'a teknik katkılarından dolayı teşekkür etmek ister. Kazanmak.

Yazarlar Hakkında

Dr.Vivek Madan Amazon SageMaker JumpStart ekibinde Uygulamalı Bilim Adamıdır. Doktorasını Urbana-Champaign'deki Illinois Üniversitesi'nden aldı ve Georgia Tech'de Doktora Sonrası Araştırmacıydı. Makine öğrenimi ve algoritma tasarımında aktif bir araştırmacıdır ve EMNLP, ICLR, COLT, FOCS ve SODA konferanslarında makaleler yayınlamıştır.

Dr.Vivek Madan Amazon SageMaker JumpStart ekibinde Uygulamalı Bilim Adamıdır. Doktorasını Urbana-Champaign'deki Illinois Üniversitesi'nden aldı ve Georgia Tech'de Doktora Sonrası Araştırmacıydı. Makine öğrenimi ve algoritma tasarımında aktif bir araştırmacıdır ve EMNLP, ICLR, COLT, FOCS ve SODA konferanslarında makaleler yayınlamıştır.

Dr. Farooq Sabir AWS'de Kıdemli Yapay Zeka ve Makine Öğrenimi Uzmanı Çözüm Mimarıdır. Austin'deki Texas Üniversitesi'nden Elektrik Mühendisliği alanında doktora ve yüksek lisans derecelerine ve Georgia Institute of Technology'den Bilgisayar Bilimleri alanında yüksek lisans derecesine sahiptir. 15 yılı aşkın iş tecrübesine sahiptir ve ayrıca üniversite öğrencilerine ders vermeyi ve rehberlik etmeyi sever. AWS'de müşterilerin veri bilimi, makine öğrenimi, bilgisayar görüşü, yapay zeka, sayısal optimizasyon ve ilgili alanlarda iş sorunlarını formüle etmelerine ve çözmelerine yardımcı olur. Dallas, Teksas'ta yaşayan o ve ailesi seyahat etmeyi ve uzun yolculuklara çıkmayı seviyor.

Dr. Farooq Sabir AWS'de Kıdemli Yapay Zeka ve Makine Öğrenimi Uzmanı Çözüm Mimarıdır. Austin'deki Texas Üniversitesi'nden Elektrik Mühendisliği alanında doktora ve yüksek lisans derecelerine ve Georgia Institute of Technology'den Bilgisayar Bilimleri alanında yüksek lisans derecesine sahiptir. 15 yılı aşkın iş tecrübesine sahiptir ve ayrıca üniversite öğrencilerine ders vermeyi ve rehberlik etmeyi sever. AWS'de müşterilerin veri bilimi, makine öğrenimi, bilgisayar görüşü, yapay zeka, sayısal optimizasyon ve ilgili alanlarda iş sorunlarını formüle etmelerine ve çözmelerine yardımcı olur. Dallas, Teksas'ta yaşayan o ve ailesi seyahat etmeyi ve uzun yolculuklara çıkmayı seviyor.

Ashish Khetan Amazon SageMaker JumpStart'ta Kıdemli Uygulamalı Bilim Adamıdır ve makine öğrenimi algoritmalarının geliştirilmesine yardımcı olur. Doktora derecesini University of Illinois Urbana-Champaign'den almıştır. Makine öğrenimi ve istatistiksel çıkarım alanlarında aktif bir araştırmacıdır ve NeurIPS, ICML, ICLR, JMLR, ACL ve EMNLP konferanslarında birçok makale yayınlamıştır.

Ashish Khetan Amazon SageMaker JumpStart'ta Kıdemli Uygulamalı Bilim Adamıdır ve makine öğrenimi algoritmalarının geliştirilmesine yardımcı olur. Doktora derecesini University of Illinois Urbana-Champaign'den almıştır. Makine öğrenimi ve istatistiksel çıkarım alanlarında aktif bir araştırmacıdır ve NeurIPS, ICML, ICLR, JMLR, ACL ve EMNLP konferanslarında birçok makale yayınlamıştır.

Ek

Bu ek, performans kıyaslaması ve veri kümesi biçimlendirmesi hakkında ek bilgi sağlar.

Performans karşılaştırması

Bu bölümde, iki farklı veri kümesinde üç Llama 2 modelinin (7B, 13B ve 70B) ince ayarının yapılmasına yönelik sonuçları sağlıyoruz: bebek ve İletişim toplamı. Dolly veri kümesi için görevimiz bir metin paragrafını özetlemektir; Dialogsum için ise iki kişi arasındaki bir tartışmayı özetlemek için modele ince ayar yapıyoruz. Aşağıdaki tablolarda, üç Lama'nın her biri için modele girişi (istem ve talimatlar), temel gerçeği (özet), önceden eğitilmiş Llama 2 modelinden gelen yanıtı ve ince ayarlı Llama 2 modelinden gelen yanıtı gösteriyoruz. 2 model. Beş veri noktası için çıkarım sonuçlarını gösteriyoruz. Aşağıdaki tablolardan, modellere ince ayar yaptığımızda özetlerin her iki veri kümesi için de iyileştiğini fark edebilirsiniz.

- Dolly veri kümesinde Llama 2 7B metin oluşturma modeline ince ayar yapılmasına ilişkin sonuçlar:

| Girdiler | Zemin gerçeği | İnce Ayarlı Olmayan Modelden Yanıt | İnce Ayarlı Modelden Yanıt |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nAllauch nerede?nn### Giriş:nAllauch (Fransızca telaffuzu: ; Occitanca: Alaug), Marsilya'nın doğusunda, Bouches-du-Rhône ilinde yer alan bir Fransız komünüdür. Fransa'nın Provence-Alpes-Côte d'Azur bölgesinde.nnKomün sakinleri Fransızca'da Allaudiens veya Allaudiennes olarak biliniyor.nnnn### Yanıt:n | Allauch, Fransa'nın Provence-Alpes-Côte d'Azur bölgesindeki Bouches-du-Rhône ilinde, Marsilya'nın doğusunda yer alan bir Fransız komünüdür.nnKomün sakinleri, Fransızca'da Allaudiens veya Allaudiennes olarak bilinir. | Allauch, Fransa'nın Provence-Alpes-Côte d'Azur bölgesindeki Bouches-du-Rhône ilinde, Marsilya'nın 28 km doğusunda bulunan bir kasabadır. Fransa'nın en güzel köylerinden biri olarak kabul edilir. Kasaba tepeler ve üzüm bağlarıyla çevrilidir ve yaklaşık 6,000 kişilik bir nüfusa sahiptir. İlk kez 1006'da bahsedilmiştir ve zengin bir içeriğe sahiptir. | Komün, Marsilya'nın doğusunda yer alan Massif du Gélas adlı kayalık bir plato üzerinde yer almaktadır. Marsilya ve kıyı şeridinin güzel manzarasına sahiptir. Allauch artık kendi belediye binası ve bir dizi mağaza, bar ve restorana sahip gelişmiş bir komündür. Marsilya ve Alpilles arasındaki konumu nedeniyle, "W" olarak da bilinen Glandes Masifi de dahil olmak üzere bölgenin birçok doğal özelliğini korumuştur. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nYumurtalayan memeli nedir?nn### Girdi:n Bazen ördek gagalı ornitorenk olarak da anılan ornitorenk (Ornithorhynchus anatinus), yarı suda yaşayan bir yumurtadır. -Tazmanya da dahil olmak üzere doğu Avustralya'ya endemik olan yumurtlayan memeli. Ornitorenk, familyasının (Ornithorhynchidae) ve cinsinin (Ornithorhynchus) yaşayan tek temsilcisi veya monotipik taksonu olmasına rağmen, fosil kayıtlarında çok sayıda ilgili tür yer almaktadır.nnnn### Yanıt:n | Ördek gagalı ornitorenk, doğu Avustralya'da bulunan yumurtlayan bir memelidir. Ornithorhynchus cinsinin yaşayan tek temsilcisidir. | Sorunuzla ilgili epey araştırma yaptım. İkinci paragrafınızda verdiğiniz tüm bilgileri okudum. Ayrıca [bu sayfa](https://phys.org/news/2019-04-australia-platypus-predator-species.html) dahil olmak üzere ornitorenk hakkında da biraz okudum. Sanırım sorunuza bazı cevaplar buldum. Platypus'un yumurtlayan bir memeli olup olmadığını mı soruyorsunuz yoksa | Ornitorenk gibi yumurta bırakan bir memeli |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nFelix Luna ne zaman öldü?nn### Girdi:nFélix César Luna (30 Eylül 1925 – 5 Kasım 2009) Arjantinli bir yazar, söz yazarı ve tarihçiydi.nnnn# ## Yanıt:n | Felix Luna 5 Kasım 2009'da öldü | Félix César Luna (30 Eylül 1925 – 5 Kasım 2009) ArjantinliydinLuna ne zaman öldü?nnn### Açıklama:nSoruyu girdinin doğum tarihi ve ölüm tarihiyle yanıtlıyoruz.nnn### Çözüm: 1102n | Félix Luna 5 Kasım 2009'da öldü. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nVerilen pasajdan optik illüzyonla ilgili bazı önemli noktaları not edin.nn### Girdi:nGörsel algıda, optik illüzyon (aynı zamanda görsel illüzyon olarak da bilinir) bir görsel sistemin neden olduğu ve gerçeklikten farklı olduğu iddia edilen bir görsel algıyla karakterize edilen yanılsama. İllüzyonlar çok çeşitlidir; bunların sınıflandırılması zordur çünkü altta yatan neden genellikle açık değildir ancak Richard Gregory tarafından önerilen bir sınıflandırma bir yönlendirme olarak faydalıdır. Buna göre fiziksel, fizyolojik ve bilişsel yanılsamalar olmak üzere üç ana sınıf vardır ve her sınıfta dört tür yanılsama vardır: Belirsizlikler, çarpıtmalar, paradokslar ve kurgular. Fiziksel çarpıklığın klasik bir örneği, yarısı suya batırılmış bir çubuğun görünürdeki bükülmesidir; Fizyolojik paradoksa bir örnek, hareket sonrası etkisidir (harekete rağmen konumun değişmeden kalması). Fizyolojik kurguya bir örnek, ardıl görüntüdür. Üç tipik bilişsel çarpıtma Ponzo, Poggendorff ve Müller-Lyer yanılsamasıdır. Fiziksel yanılsamalar fiziksel ortamdan, örneğin suyun optik özelliklerinden kaynaklanır. Fizyolojik yanılsamalar, örneğin belirli bir reseptör tipinin aşırı uyarılmasının etkilerinden dolayı gözde veya görme yolunda ortaya çıkar. Bilişsel görsel yanılsamalar bilinçdışı çıkarımların sonucudur ve belki de en yaygın bilinenleridir.nnnn### Yanıt:n | 1. Görsel Yanılsama, görsel sistemden kaynaklanır ve gerçeklikten farklı görünen bir görsel algı ile karakterize edilir.n2. Richard Gregory'ye göre, kendisi tarafından önerilen bir sınıflandırma, bir yönelim olarak faydalıdır; üç ana sınıf vardır: fiziksel, fizyolojik ve bilişsel yanılsamalar ve her sınıfta dört tür vardır: Belirsizlikler, çarpıtmalar, paradokslar ve kurgular.n3. Fiziksel çarpıklığa bir örnek, yarısı suya batırılmış bir çubuğun görünürdeki bükülmesi olabilir; Fizyolojik paradoksa bir örnek, hareket sonrası etkisidir (harekete rağmen konum değişmeden kalır). n4. Fizyolojik kurguya örnek olarak bir ardıl görüntü verilebilir5. Üç bilişsel çarpıtma Ponzo, Poggendorff ve Müller-Lyer yanılsamasıdır.n6. Fiziksel yanılsamalar fiziksel çevreden, örneğin suyun optik özelliklerinden kaynaklanır. Gözde veya görme yolunda fizyolojik yanılsamalar ortaya çıkar.n7. En çok bilinen yanılsama bilinçsiz çıkarımlar sonucu oluşan görsel yanılsamalardır. | Parçada bahsedilen optik yanılsama, kısmen suya daldırılan çubuğun yanılsama hareketidir.nn## 50.n### Talimat:nİddiayı desteklemek veya çürütmek için bir argüman yazın:nLaboratuvarımızdaki tüm öğrenciler aynı ortalama IQ.nn### Girdi:nDeneydeki birçok öğrencinin ortalama IQ'su aynı ve onların en yüksek IQ'ya sahip %10 olduğuna inanıyorum | nOptik illüzyonlar, hem etrafımızdaki dünyadaki uyaranlara hem de içsel olarak üretilen görsel uyaranlara tepki verme ve yorumlama şeklimizle ilgili fizyolojik ve psikolojik sınırlamalardan yararlanır. Her ikisini de karşılaştırmamıza ve her birinin nasıl çalıştığını anlamamıza olanak tanıyan iki sisteme (fiziksel ve psikolojik/algısal) ortak bir uyarı sağlarlar. Optik yanılsamaların çeşitli farklı biçimleri vardır; bunlar arasında psikolojik, |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nYenilikçinin İkilemini birkaç cümleyle özetleyinnn### Girdi:nMevcut büyük şirketlerin müşterilerini dinleyerek ve en yüksek görüneni sağlayarak pazar payını nasıl kaybettiklerini açıklar -değerli ürünler, ancak düşük değerli müşterilere az gelişmiş teknolojiyle hizmet veren yeni şirketler, bu teknolojiyi yeterince iyi olana kadar adım adım geliştirebilirnnnn### Yanıt:n | Yenilikçinin İkilemi: Yeni Teknolojiler Büyük Firmaların Başarısız Olmasına Neden Olduğunda, ilk kez 1997'de yayınlanan, Harvard profesörü ve iş adamı Clayton Christensen'in en bilinen eseridir. 1995 tarihli "Yıkıcı Teknolojiler: Dalgayı Yakalamak" başlıklı makalesinde ortaya attığı bir terim olan yıkıcı teknolojiler kavramını genişletiyor. Bu, büyük yerleşik şirketlerin müşterilerini dinleyerek ve en yüksek değere sahip ürünler gibi görünen ürünleri sağlayarak pazar payını nasıl kaybettiklerini, ancak düşük değerli müşterilere az gelişmiş teknolojiyle hizmet veren yeni şirketlerin, bu teknolojiyi yeterince iyi olana kadar adım adım geliştirebileceğini anlatıyor. Yerleşik işlerden hızla pazar payı alın. Christensen, büyük şirketlerin, yeni kurulan rakipler tarafından gafil avlanmaktan ve geride kalmaktan kaçınmak için bu fenomeni şirket içinde kopyalamaya çalışan küçük, çevik bölümlere sahip olmalarını tavsiye ediyor. | Merhaba, geç yanıt için özür dilerim!! Geçen hafta tatildeydim :) nnClayton Christensen'in Yenilikçinin İkilemi şöyle açıklıyor: “Yenilikçinin ikilemi, bir şirketin mevcut müşterilerine daha fazla değer sağlamak için ürünlerini sunarak veya geliştirerek sürdürülebilir kar elde etme arayışının, aynı müşterilerin işletmeyi terk etmesiyle sonuçlanmasıdır. şirketin en azından bir miktar değer sunan yenilikleri satın alması | Yenilikçinin İkilemi, büyük yerleşik şirketlerin müşterilerini dinleyerek ve en yüksek değere sahip ürünler gibi görünen ürünleri sunarak pazar payını nasıl kaybettiklerini açıklayan bir kitaptır, ancak düşük değerli müşterilere az gelişmiş teknolojiyle hizmet veren yeni şirketlerin bu teknolojiyi adım adım geliştirebileceğini açıklar. yeterince iyi olana kadar |

- Dolly veri kümesinde Llama 2 13B metin oluşturma modeline ince ayar yapılmasına ilişkin sonuçlar:

| Girdiler | Zemin gerçeği | İnce Ayarlı Olmayan Modelden Yanıt | İnce Ayarlı Modelden Yanıt |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nFc Bayern Münih'te Julian Nagelsmann'dan görevi devralacak bir sonraki teknik direktör kim?nn### Girdi:nNagelsmann dönemi (2021–2023)nYeni teknik direktör Julian Nagelsmann yönetiminde, Bayern, Der Klassiker'i 10-3 mağlup ettikten sonra art arda 1 Bundesliga şampiyonluğu kazanma başarısını tamamladı. Ancak takım, Şampiyonlar Ligi çeyrek finalinde beklenmedik bir şekilde Villarreal'e yenildi ve üst üste ikinci kez bu aşamaya yükseldi. 24 Mart 2023'te Nagelsmann, Bayern tarafından serbest bırakıldı ve yerine 30 Haziran 2025'e kadar sözleşme alan Thomas Tuchel getirildi.nnnn### Response:n | Thomas Tuchel, Mart 2023'te Julian Nagelsmann'ın yerini aldı ve şu anda FC Bayern Münih'in yeni teknik direktörü ve daha önce Chelsea'nin teknik direktörüydü. | nn“`pythonn{n “talimat”: “Fc Bayern München'de Julian Nagelsmann'dan görevi devralacak bir sonraki teknik direktör kim olacak?”, n “eylem”: “FC Bayern'in bir sonraki teknik direktörü”, n “bağlam”:{n “ Nagelsmann dönemi (2021–2023)”: n ” Yeni teknik direktör Julian Nagelsmann yönetiminde Bayern, art arda 10 Bundesliga şampiyonluğu kazanma başarısını tamamladı | Fc Bayern Münih'in bir sonraki teknik direktörü Thomas Tuchel olacak. Tuchel, Nagelsmann'ın 24 Mart 2023'te takımdan ayrılmasının ardından görevi Julian Nagelsmann'dan devralacak. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nBana Adolphe Cohnnnnnnnnnnnnnn###'nın hayatından bahsedin Girdi:nAdolphe Cohn (29 Mayıs 1851–1930), Paris'te doğmuş Fransız-Amerikalı bir eğitimciydi. 1868 yılında Paris Üniversitesi'nden “bachelier ès lettres” mezunu olup Paris'teki çeşitli yüksek öğrenim kurumlarında hukuk, tarih eleştirisi ve filoloji okudu ve LL.B derecelerini aldı. 1873 yılında Ecole des Chartes öğrencisi olup, Vues sur l'histoire de l'organization judiciaire en France du IXe au XIIIe siècle considérée au point de vue des juridictions extraordinaires adlı teziyle “archiviste paléographe” diplomasını aldı. 1874 yılında Fransa-Prusya Savaşı'nın başlangıcında, Fransız ordusuna yazıldı ve mücadele boyunca Fransız ordusunda görev yaptı. nnCohn, 1870 Mayıs 13'te New York City'ye göç etti ve 1875'dan 1876'e kadar La République française, daha sonra Fransa'da tanıdığı ve siyasi görüşlerini benimsediği Léon Gambetta tarafından düzenlendi. Mart 1884'de Cohn, Columbia College'a Fransızca öğretmeni olarak atandı ve kısa süre sonra eğitmen oldu. New York'ta yaşayan Fransızların popüler oyu ile 1882'te Tammany Hall'da Gambetta'nın cenaze konuşmasını yapmak üzere seçildi ve 1883'te Victor Hugo'nun ölümü üzerine benzer bir amaçla Cambridge, Massachusetts'ten çağrıldı. ### Yanıt:n | Adolphe Cohn (29 Mayıs 1851 - 1930), Paris'te doğan Fransız-Amerikalı bir eğitimciydi. 1868 yılında Paris Üniversitesi'nden “bachelier es lettres” mezunu olup Paris'teki çeşitli yüksek öğrenim kurumlarında hukuk, tarih eleştirisi ve filoloji okudu ve LL.B derecelerini aldı. 1873 yılında Ecole des Chartes öğrencisi olan Vues sur l'histoire de l'organization judiciaire en France du IXe au XIIIe siècle considerée au point de vue des juridictions extraordinaires adlı teziyle “archiviste paleographe” diplomasını aldı. 1874 yılında Fransa-Prusya Savaşı'nın başlangıcında, Fransız ordusuna yazıldı ve mücadele boyunca Fransız ordusunda görev yaptı. nnCohn, 1870 Mayıs 13'te New York City'ye göç etti ve 1875'dan 1876'e kadar La République française, daha sonra Fransa'da tanıdığı ve siyasi görüşlerini benimsediği Léon Gambetta tarafından düzenlendi. Mart 1884'de Cohn, Columbia College'a Fransızca öğretmeni olarak atandı ve kısa süre sonra eğitmen oldu. New York'taki Fransız sakinlerin popüler oyu ile 1882'te Tammany Hall'da Gambetta'nın cenaze konuşmasını yapmak üzere seçildi ve 1883'te Victor Hugo'nun ölümü üzerine benzer bir amaçla Cambridge, Massachusetts'ten çağrıldı. | nAdolphe Cohn (29 Mayıs 1851–1930), Paris'te doğmuş Fransız-Amerikalı bir eğitimciydi. 1868 yılında Paris Üniversitesi'nden “bachelier ès lettres” mezunu olup Paris'teki çeşitli yüksek öğrenim kurumlarında hukuk, tarih eleştirisi ve filoloji okudu ve LL.B derecelerini aldı. 1873'te. É'nin bir öğrencisi | Adolphe Cohn, 29 Mayıs 1851'de Paris'te doğan Fransız-Amerikalı bir eğitimciydi. Paris Üniversitesi'ne girdi ve 1873'te hukuk diploması aldı. 1874. Fransa-Prusya Savaşı'nın başlangıcında Fransız ordusuna katıldı ve bütün yıl boyunca onlara hizmet etti. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nMcDonald's'ın hedef kitlesi zaman içinde nasıl değişti?nn### Girdi:nFast food restoranları genellikle reklamlarının bir kısmını doğrudan genç nüfusa yöneliktir. Genellikle yeni vizyona giren bir aile filmiyle ilişkilendirilen bir oyuncağın yer aldığı McDonald's Happy Meals buna önemli bir örnektir. 1963'te tanıtılan ve küçük çocuklara hitap etmek üzere tasarlanan palyaço reklam maskotu Ronald McDonald da bunlardan bir tanesi. Buna ek olarak, 1987'de McDonald's, çocuklara daha fazla reklam vermek için restoranlarına bir Oyun Yeri ekledi ve restoranlarını çocuklar için daha çekici bir ortam haline getirdi. Ek olarak, 1996'dan 2006'ya kadar Disney, McDonald's'ın ürünlerini birbirine bağlayan özel bir ortağıydı. Mayıs 2006'da bu anlaşmanın sona erdiğini duyurdular ve bazı raporlarda Disney'in çocuklukta obezite konusunda endişelendiği belirtildi. McDonald's, Disney'in yanı sıra, Nintendo Eğlence Sisteminin ilk tanıtıldığı 1985 yılından bu yana Nintendo ile de ortaklık kurmaktadır. 1987'de McDonald's ayrıca restoranlarında çocukların yemeklerini beklerken Nintendo konsollarında oynayabilecekleri bir Nintendo oyun alanı oluşturdu. 2007 yılında McDonald's, Nintendo konsollarından WiFi sağlamaya başladı; çocuklara nerede olurlarsa olsunlar oynama yeteneği veriyor. Aynı zamanda bu yeni filmleri yayınlayan ve oyuncakları bünyesine katan çocuklardan oluşan bir hedef kitleye sahip olan şirket, büyük yatırımları nedeniyle çocukları ebeveynlerinin cebine ulaşmak için kullanıyor.nnnn### Yanıt:n | McDonald's, reklamlarında sürekli olarak doğrudan genç nüfusu hedef alıyor. nn1963'ten başlayarak, küçük çocuklara hitap etmek üzere tasarlanmış bir palyaço reklam maskotu olan Ronald McDonald'ı tanıttılar. Yıllar geçtikçe McDonald's, çocuklara yönelik ürünleri olan Nintendo ve Disney gibi çok sayıda şirketle ortaklık kurdu. | Fast food restoranları her zaman genç nüfusu hedef almıştır. Gençlere yönelik reklamlar söz konusu olduğunda mutlu yemekler de çok büyük bir faktördür.nBirçok film vizyona girdiğinden, Happy Meals aynı zamanda o filmi yerel McDonald's'ta tanıtmak için bir oyuncakla birlikte gelirnn—n## 400-999nn### Yorum:nAs Göreceli olarak dar bir dünya görüşüne sahip genç bir şirket olan McDonald's, | McDonald's, lansmanından bu yana çocuklara yönelik fast food restoranları ve gıda ürünlerinin yanı sıra büyük ölçüde gençleri hedef alan reklamlarıyla hedef kitlesini küçük çocukları ve gençleri hedef alıyor. Çocuklar ebeveynleri tarafından McDonalds'a götürülürken, restoran özünde çocukları için bir ebeveyn reklamıdır: McDonalds, rengarenk restoranları ve yemeklerinde bulunan, ilgi çekici oyuncaklarla çocuklara hitap etmektedir. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nAnandapuram mandalı nedirnn### Giriş:nAnandapuram mandalı, Hindistan'ın Andhra Pradesh eyaletinin Visakhapatnam bölgesindeki 46 mandaldan biridir. Visakhapatnam gelir bölümünün idaresi altındadır ve genel merkezi Anandapuram'da bulunmaktadır. Anandapuram mandalı doğuda Bheemunipatnam mandal, güneyde Chinagadila, kuzeyde Padmanabham ve batıda Kothavalasa ile sınırlanmıştır.nnnn### Yanıt:n | Anandapuram mandalı, Hindistan'ın Andhra Pradesh eyaletinin Visakhapatnam bölgesindeki 46 mandaldan biridir. Visakhapatnam gelir bölümünün idaresi altındadır ve genel merkezi Anandapuram'da bulunmaktadır. | nnnn | Anandapuram mandalı, Hindistan'ın Andhra Pradesh eyaletinin Visakhapatnam bölgesindeki 46 mandaldan biridir. Visakhapatnam gelir bölümünün idaresi altındadır ve genel merkezi Anandapuram'da bulunmaktadır. Anandapuram mandal doğuda Bheemunipatnam mandal, güneyde Chinagadila, kuzeyde Padmanabham ve Koth ile sınırlanmıştır. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nWoodstock'ta ne oldunn### Giriş:nWoodstock Müzik ve Sanat Fuarı, genellikle Woodstock olarak anılır, 15-18 Ağustos 1969 tarihleri arasında düzenlenen bir müzik festivaliydi. Max Yasgur'un Bethel, New York, Amerika Birleşik Devletleri'ndeki mandıra çiftliği, Woodstock kasabasının 40 mil (65 km) güneybatısında. "Kova Burcu Sergisi: 3 Gün Barış ve Müzik" olarak duyurulan ve alternatif olarak Woodstock Rock Festivali olarak da anılan festival, 400,000'den fazla katılımcının ilgisini çekti. Ara sıra yağmura rağmen açık havada otuz iki gösteri gerçekleştirildi. Tarihte düzenlenen en büyük müzik festivallerinden biriydi.nnFestival, yaygın olarak popüler müzik tarihinde önemli bir an ve aynı zamanda karşı kültür kuşağı için belirleyici bir etkinlik olarak kabul ediliyor. Etkinliğin önemi, 1970 tarihli bir belgesel film, ona eşlik eden bir film müziği albümü ve Joni Mitchell tarafından yazılan ve hem Crosby, Stills, Nash & Young hem de Matthews Southern Comfort için büyük bir hit haline gelen bir şarkıyla daha da güçlendirildi. Onuncu, yirminci, yirmi beşinci, otuzuncu, kırkıncı ve ellinci yıldönümleri için Woodstock adını taşıyan müzik etkinlikleri planlandı. 2004 yılında Rolling Stone dergisi bunu Rock and Roll Tarihini Değiştiren 19 An arasında 50. sırada listeledi. Festival alanı 2017 yılında Ulusal Tarihi Yerler Sicilinde listelendi.nnnn### Response:n | Yaygın olarak Woodstock olarak anılan Woodstock Müzik ve Sanat Fuarı, 15-18 Ağustos 1969 tarihleri arasında Max Yasgur'un kasabanın 40 km güneybatısındaki Bethel, New York, Amerika Birleşik Devletleri'ndeki süt çiftliğinde düzenlenen bir müzik festivaliydi. Woodstock'tan. "Kova Burcu Sergisi: 65 Gün Barış ve Müzik" olarak duyurulan ve alternatif olarak Woodstock Rock Festivali olarak da anılan festival, 3'den fazla katılımcının ilgisini çekti. Ara sıra yağmura rağmen açık havada otuz iki gösteri gerçekleştirildi. Tarihte düzenlenen en büyük müzik festivallerinden biriydi.nnFestival, yaygın olarak popüler müzik tarihinde önemli bir an ve aynı zamanda karşı kültür kuşağı için belirleyici bir etkinlik olarak kabul ediliyor. Etkinliğin önemi, 400,000 tarihli bir belgesel film, ona eşlik eden bir film müziği albümü ve Joni Mitchell tarafından yazılan ve hem Crosby, Stills, Nash & Young hem de Matthews Southern Comfort için büyük bir hit haline gelen bir şarkıyla daha da güçlendirildi. Onuncu, yirminci, yirmi beşinci, otuzuncu, kırkıncı ve ellinci yıldönümleri için Woodstock adını taşıyan müzik etkinlikleri planlandı. 1970 yılında Rolling Stone dergisi bunu Rock and Roll Tarihini Değiştiren 2004 An arasında 19. sırada listeledi. Festival alanı 50 yılında Ulusal Tarihi Yerler Sicilinde listelendi. | nAnswer:nn“`jsndocument.getElementById('_0x1000').innerHTML = “https://commons.wikimedia.org/wiki/File:BethelMeetingHouse.JPG#/media/File:BethelMeetingHouse.JPG”;nn“`nn nn## Çözüm: nn N Çözümü Görüntülemek İçin nn“`jsnn// Çözüm gerekli | 15-18 Ağustos'un ikinci yarısında düzenlenen Woodstock Müzik ve Sanat Fuarı, karşı kültür kuşağı açısından New York Bethel'de tarihi bir etkinlikti. Festivaldeki kalabalığın katılımı 400,000'den fazlaydı. Ara sıra yağmur yağmasına rağmen açık havada yaklaşık 32 gösteri gerçekleştirildi. Tarihin gelmiş geçmiş en büyük müzik festivallerinden biri olarak kabul ediliyordu. |

- Dolly veri kümesinde Llama 2 70B metin oluşturma modeline ince ayar yapılmasına ilişkin sonuçlar:

| Girdiler | Zemin gerçeği | İnce Ayarlı Olmayan Modelden Yanıt | İnce Ayarlı Modelden Yanıt |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nABB şirketi kimdir?nn### Giriş:nABB Ltd., merkezi Zürih, İsviçre'de bulunan bir İsveç-İsviçre çok uluslu şirketidir. Şirket, 1988 yılında İsveç'teki Allmänna Svenska Elektriska Aktiebolaget (ASEA) ile İsviçre'deki Brown, Boveri & Cie'nin, daha sonra ABB'nin baş harfleriyle basitleştirilen ASEA Brown Boveri'yi oluşturmak üzere birleşmesiyle kuruldu. Her iki şirket de 1800'lerin sonlarında kuruldu ve ABB'nin bugün de aktif olmaya devam ettiği büyük elektrikli ekipman üreticileriydi. Şirket o zamandan beri robotik ve otomasyon teknolojilerini de genişletti.nnnn### Response:n | ABB Ltd., merkezi Zürih, İsviçre'de bulunan çok uluslu bir İsveç-İsviçre şirketidir. Şirket, 1988 yılında İsveç'teki Allmanna Svenska Elektriska Aktiebolaget (ASEA) ile İsviçre'deki Brown, Boveri & Cie'nin, daha sonra ABB'nin baş harfleriyle basitleştirilen ASEA Brown Boveri'yi oluşturmak üzere birleşmesiyle kuruldu. nnHer iki şirket de 1800'lerin sonlarında kuruldu ve ABB'nin bugün de aktif olarak faaliyet göstermeye devam ettiği büyük elektrikli ekipman üreticileriydi. Şirket o zamandan beri robotik ve otomasyon teknolojisine de genişledi. | * ABB, İsveç-İsviçre merkezli çok uluslu bir şirkettirnn### LognEND I/O DATA —n | ABB, merkezi İsviçre'nin Zürih şehrinde bulunan çok uluslu bir İsveç-İsviçre şirketidir. Şirket, 1988 yılında İsveç'teki Allmänna Svenska Elektriska Aktiebolaget (ASEA) ile İsviçre'deki Brown, Boveri & Cie'nin, daha sonra ABB'nin baş harfleriyle basitleştirilen ASEA Brown Boveri'yi oluşturmak üzere birleşmesiyle kuruldu. Her iki şirket de 1800'lerin sonlarında kuruldu ve |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nFransız Fatih William neden İngiltere Kralı oldu?nn### Girdi:n1050'lerde ve 1060'ların başında William, İngiltere Kralı olmaya aday oldu. İngiltere tahtı, bir zamanlar ilk kuzeni olan çocuksuz Günah Çıkarıcı Edward'ın elindeydi. Edward'ın Ocak 1066'da ölüm döşeğinde kral olarak adlandırdığı güçlü İngiliz kontu Harold Godwinson da dahil olmak üzere başka potansiyel davacılar da vardı. Edward'ın daha önce tahtı kendisine vaat ettiğini ve Harold'ın iddiasını desteklemeye yemin ettiğini savunan William, büyük bir inşa etti. Filo ve Eylül 1066'da İngiltere'yi işgal etti. 14 Ekim 1066'da Hastings Muharebesi'nde Harold'ı kesin bir şekilde yendi ve öldürdü. Daha fazla askeri çabanın ardından William, 1066 Noel Günü Londra'da kral olarak taç giydi. Normandiya'ya dönmeden önce 1067'nin başlarında İngiltere'nin yönetimi için düzenlemeler yaptı. Bunu birkaç başarısız isyan takip etti, ancak William'ın kontrolü 1075'e gelindiğinde İngiltere'de çoğunlukla güvendeydi ve bu da onun saltanatının büyük bir kısmını kıta Avrupa'sında geçirmesine olanak tanıdı.nnnn### Yanıt:n | Fatih William, kuzeybatı Fransa'da bulunan Normandiya'dandı. 1050'lerin sonlarında ve 1060'ların başlarında İngiltere Kralı, Günah Çıkaran Edward'dı. Edward William'ın kuzeniydi. Edward'ın çocuğu olmadığı için, kendilerinin gerçek mirasçı olduklarını ve kral olmaları gerektiğini iddia eden birçok kişi vardı. Bu çelişkili iddialar silahlı çatışmaya yol açtı. William İngiltere'yi işgal etti ve burada Earl Harold Godwinson'ı yenerek Hastings Savaşı'nı kazandı. Bunu bir dizi savaş izledi, ancak William 1066'nın sonlarında İngiltere Kralı oldu. Sonraki on yılda birçok isyanla uğraştı ancak gücünü korudu. Sonunda Normandiya'ya dönüp İngiltere'yi oradan yönetmeyi başardı. | Fatih William, 1050'lerde ve 1060'ların başında olduğu gibi İngiltere Kralı oldu. Bir zamanlar ilk kuzeni olan çocuksuz Günah Çıkaran Edward'ın elindeki İngiltere tahtına aday oldu.nnnYanıt boş olabilir ancak 256 karakter uzunluğunda olmalıdır. N | Kral Harold'un 14 Ekim 1066'daki Hastings Muharebesi'nde ölümünün ardından Fatih William, 1066 Noel Günü'nde İngiltere Kralı olarak taç giydi ve İngiltere'nin Normanlar tarafından fethedildiğini kanıtladı.nn |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nBana RMS Adriatic'ten bahsedinnn### Giriş:nRMS Adriatic, White Star Line'ın İngiliz okyanus gemisiydi. Büyük Dörtlü olarak adlandırılan, 20,000 GRT'den fazla gemiden oluşan dörtlü gemiden dördüncüsüydü. Gemi, dört gemiden hiçbir zaman dünyanın en büyük gemisi olmayan tek gemiydi. Ancak kapalı yüzme havuzu ve Türk hamamına sahip ilk okyanus gemisi olarak Dört Büyükler'in en büyüğü, en hızlısı ve en lüksüydü. Kariyerine daha önce Southampton'dan New York'a uzanan yepyeni rotada başladı. 1911'den itibaren kız kardeşi, Liverpool'dan ikincil rotayı kullanarak gemiye katılıyor. Aslında bunlar makul fiyatlarla hizmet sunmayı amaçlayan yavaş gemilerdi. Birinci Dünya Savaşı başladığında Adriyatik, birçok erzak taşıyarak sivil transatlantik hizmetini sürdüren gemiler arasındaydı. 1917'de el konuldu ve birlik nakliyesi olarak görevlendirildi.nnSavaştan sonra birkaç kez yeniden donatıldı ve 1930'larda ana hizmetleri haline gelen gemi yolculukları için yavaş yavaş kullanıldı. Cunard Line ve White Star Line 1934'te birleştiğinde, hızla gereksiz görüldü ve yıl sonunda satıldı. 1935'te Osaka'da hurdaya çıkarıldı.nnnn### Yanıt:n | RMS Adriatic, White Star Line'ın İngiliz okyanus gemisiydi. Büyük Dörtlü olarak adlandırılan, 20,000 GRT'den fazla gemiden oluşan dörtlü gemiden dördüncüsüydü. Gemi, dört gemiden hiçbir zaman dünyanın en büyük gemisi olmayan tek gemiydi. Ancak Kapalı yüzme havuzu ve Türk hamamına sahip ilk okyanus gemisi olarak Büyük Dörtlü'nün en büyüğü, en hızlısı ve en lüksüydü. | RMS Adriatic, White Star Line'ın İngiliz okyanus gemisiydi. Büyük Dörtlü olarak adlandırılan, 20,000 GRT'den fazla gemiden oluşan dörtlü gemiden dördüncüsüydü. Gemi, dört gemiden hiçbir zaman dünyanın en büyük gemisi olmayan tek gemiydi. nn### BağlamnBu tür bir soru genellikle bir arama motorunu sorgulamak için kullanılır. Giriş, sorgunun girişidir ve yanıt geneldir. | RMS Adriatic, beyaz yıldız hattında yer alan bir İngiliz okyanus gemisiydi. 1906'da denize indirildi, ancak ilk ticari seferi 1907'de gerçekleşti. 20,000 tonun üzerindeki gemilerden oluşan dörtlü geminin dördüncüsüydü ve Büyük Dörtlü olarak adlandırıldı. Diğer üçü 1901'de RMS Celtic, 1903'te RMS Baltic ve RMS idi. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nFotonları algılayan CGRO nedir?nn### Giriş:nCompton Gama Işını Gözlemevi (CGRO), 20 keV ila 30 keV arası enerjilere sahip fotonları tespit eden bir uzay gözlemeviydi GeV, 1991'den 2000'e kadar Dünya yörüngesindeydi. Gözlemevinde, çeşitli özel alt cihazlar ve dedektörler de dahil olmak üzere, X-ışınlarını ve gama ışınlarını kapsayan, bir uzay aracında dört ana teleskop bulunuyordu. 14 yıllık bir çabanın ardından gözlemevi, 37 Nisan 5'de STS-1991 sırasında Uzay Mekiği Atlantis'ten fırlatıldı ve 4 Haziran 2000'deki yörüngeden çıkışına kadar çalıştırıldı. 450 km (280 mil) alçak Dünya yörüngesinde konuşlandırıldı. Van Allen radyasyon kuşağından kaçının. Bu, 17,000 kilogram (37,000 lb) ile o dönemde uçurulan en ağır astrofiziksel yüktü.nnnn### Response:n | CGRO, Compton Gama Işını Gözlemevi'dir (CGRO) ve 20'den 30'e kadar yeryüzündeki 1991 keV ila 2000GeV enerjili fotonları tespit eden bir uzay gözlemeviydi. | **Transcriber:** EGRET cihazı fotonları algılar.nn | Compton Gama Işını Gözlemevi (CGRO), enerjileri 20 keV ila 30 GeV arasında olan fotonları ölçer. |

| Aşağıda, daha fazla bağlam sağlayan bir girdiyle eşleştirilmiş, bir görevi açıklayan bir talimat bulunmaktadır. İsteği uygun şekilde tamamlayan bir yanıt yazın.nn### Talimat:nBir piyanist olarak Yeol Eum Sonnn### Girdi:nYeol Eum Son (2 Mayıs 1986, Wonju, Güney Kore'de doğdu) Güney Koreli bir klasiktir piyanist. İlk kez Ekim 2004'te, 18 yaşındayken, Seul, Daejeon ve Tokyo'daki Asya turnesinde Lorin Maazel yönetimindeki New York Filarmoni Orkestrası ile Liszt Piyano Konçertosu No. 1'i solist olarak seslendirdiğinde uluslararası ilgi gördü. Son, Şubat 2008'de Seul Sanat Merkezi'ne döndüklerinde Maazel ve New York Filarmoni Orkestrası ile yeniden performans sergiledi; bu sefer Beethoven'ın 2 No'lu Piyano Konçertosu'nun solistiydi. Ödülleri arasında On Üçüncü Van Cliburn Uluslararası Piyano Yarışması'nda (2009) Gümüş Madalyalar da yer alıyor. ) ve 2011 Uluslararası Çaykovski Yarışması'nda En İyi Oda Konçertosu Performansı ve En İyi Sipariş Edilen Eser Performansı ödüllerini de aldı. Ayrıca Arthur Rubinstein Uluslararası Piyano Ustalığı Yarışması'nda (2005) Bronz Madalya kazandı nnnn### Response:n | Yeol Eum Son (2 Mayıs 1986'da Wonju, Güney Kore'de doğdu) Güney Koreli klasik piyanist. İlk kez Ekim 2004'te, 18 yaşındayken, Seul, Daejeon ve Tokyo'daki Asya turnesinde Lorin Maazel yönetimindeki New York Filarmoni Orkestrası ile Liszt Piyano Konçertosu No. 1'i solist olarak seslendirdiğinde uluslararası ilgi gördü. Son, Şubat 2008'de Seul Sanat Merkezi'ne döndüklerinde Maazel ve New York Filarmoni Orkestrası ile yeniden performans sergiledi; bu sefer Beethoven'ın 2 No'lu Piyano Konçertosu'nun solistiydi. Ödülleri arasında On Üçüncü Van Cliburn Uluslararası Piyano Yarışması'nda (2009) Gümüş Madalyalar da yer alıyor. ) ve 2011 Uluslararası Çaykovski Yarışması'nda En İyi Oda Konçertosu Performansı ve En İyi Sipariş Edilen Eser Performansı ödüllerini de aldı. Ayrıca Arthur Rubinstein Uluslararası Piyano Ustalığı Yarışması'nda (2005) Bronz Madalya kazandı. | Yeol Eum Son, dünyanın en prestijli orkestralarından bazılarıyla sahne almış başarılı bir piyanisttir. 2009'da On Üçüncü Van Cliburn Uluslararası Piyano Yarışması'nda gümüş madalya kazandı ve 2005'te Arthur Rubinstein Uluslararası Piyano Master Yarışması'nda bronz madalya kazandı. Dünyanın her yerinde büyük bir başarıyla performans sergilemeye devam ediyor. | Yeol Eum Son çok iyi bir piyanist. Uluslararası kariyerine 18 yaşında dünyanın en büyük müzisyenlerinden bazılarının arasına katılarak başladı. Ve 25 yaşına geldiğinde zaten iki uluslararası yarışmada Gümüş Madalya sahibiydi. |

- Dialogsum veri kümesinde Llama 2 7B metin oluşturma modeline ince ayar yapılmasına ilişkin sonuçlar:

| Girdiler | Zemin gerçeği | İnce Ayarlı Olmayan Modelden Yanıt | İnce Ayarlı Modelden Yanıt |

| Bu diyaloğu özetleyin:n#Kişi1#: Bu harika bir yemek!n#Kişi2#: Teşekkür ederim. Her şeyin bu kadar iyi sonuçlanmasına sevindim.n#Person1#: Bu kadar iyi yemek pişirmeyi sana kim öğretti?n#Person2#: Aşçılık Enstitüsü'nde yemek pişirme dersi aldım.n#Person1#: Vay be, bunda ne var tavuk yemeği?n#Person2#: Harika değil mi? Bu, hindistancevizli zencefilli pilavlı tavuk.n#Person1#: Çorba karides çorbası mı?n#Person2#: Evet, orada deniz sebzeleri ve limon otunun yanı sıra karides de var.n#Person1#: Sanırım şanslıydım bu yemeğe uygun bir şarap seçerken.n#Kişi2#: Şarabı getirdiğin için teşekkür ederim. Tavuğun yanına çok yakışıyor.n—nÖzet:nnn### Yanıt:n | #Kişi1#, #Kişi2# tarafından hazırlanan yemeğin harika olduğunu düşünüyor. #Kişi2# yemeklerin malzemelerini tanıtıyor. | Diyalog tamamlandıktan sonra kişi toplanan bilgilere uygun bir yanıt verecektir. Örneğin, kişi 1 şunu söyleyebilir: nn#Kişi1#: Bu harika! Teşekkür ederiz.nn#Kişi2#: Çok hoş geldiniz. Yemeğini beğeneceğini düşündüm. Beğendiğinize sevindim.nn—n— — — — –nnn### Özet:nnn### Yanıt:nDiyalogdan sonra | #Kişi1# ve #Kişi2#, #Kişi2#'nin evinde yemek yiyor. Tavukla harmanlanan yemek ve şaraptan bahsediyorlar.nn |

| Bu diyaloğu özetleyin:n#Kişi1#: Afedersiniz, antik Yunan hakkında bir makale yazıyorum. Bu konuyla ilgili önerebileceğiniz herhangi bir kitap var mı?n#Kişi2#: Kazlar? Antik kazlar hakkında mı yazmak istiyorsun? Hiç böyle bir şey duymadım. Her neyse, bazı hayvanlardan oluşan bir kitapla olabilir, bu J satırıdır. Veya bilimi denemek istersiniz, bu Gn#Kişi1# Satırındadır: Hayvanlar? Ancak Yunanistan bir ülke, bir hayvan değil. n#Person2#: Ah, Yunanistan. Biliyorsun, bugün şanslı günün olmalı. Bu konuyla ilgili yeni bir kitap koleksiyonu aldık. Burada Cn#Kişi1# satırında yazarlar var: Görüyorum. Bu çok fazla kitap, hangisini önerirsiniz?n#Person2#: Robin Smith'in kitabı mükemmel ama çok uzun. Kapağında heykeli olan o. Milton Pike'ın da bir eseri var. Önünde bir askerin resmi var. Gördüğünüz gibi çok kalın değil bu yüzden okuması çok fazla zaman almamalı. Ama muhtemelen en iyi kitap, antik Olimpiyat Stadı'nın resmini içeren kitaptır. Pek çok tarih çalışması ödülü kazandı.n#Person1#: Karar vermek zor ama korkarım çok fazla okumaya ayıracak zamanım yok. Sanırım Milton Pike'ın kitabını alacağım.n#Person2#: Tamam. Kütüphane kartınızı alabilir miyim lütfen?n#Kişi1#: Elbette, işte buradasınız.n—nÖzet:nnn### Yanıt:n | #Kişi1#, #Kişi2#'den antik Yunan hakkında bazı kitaplar önermesini ister. #Person2#, Robin Smith'in çok uzun olanını, Milton Pike'ın çok kalın olmayan ve birçok tarih çalışması ödülü kazananı öneriyor. #Kişi1#'in yeterli zamanı olmadığı için #Kişi1# Milton Pike'ın kitabını alacak. | n—nnÖzet:n | #Kişi1# antik Yunan hakkında bir makale yazıyor. #Person2#, tamamı yeni alınan #Person1#'a antik Yunan hakkındaki kitapları önerir ve Milton Pike'ın kitabını almayı önerir.nn |

| Bu diyaloğu özetleyin: n#Kişi1#: Görüyorum ki kitaplarını almışsın, George. Ama okuyor musun? Görünüşe göre sadece boyama yapıyorsunuz.n#Person2#: Kitabın önemli kısımlarını işaretliyorum. Renkler farklı şeyler içindir.n#Kişi1#: Ne gibi?n#Kişi2#: Ana fikirler sarıdır. Hatırlanması gereken önemli ayrıntılar pembedir ve açık yeşil zor fikirler içindir.n#Kişi1#: Bu pek çok aktiviteye benziyor. Vaktini boşa harcamıyor musun?n#Kişi2#: Sanmıyorum anne. Tamamını bu gece okuyacağım. Yarın dinleyeceğim. Ve çalışma zamanı geldiğinde bilgilerin çoğunu zaten biliyor olacağım.n#Kişi1#: Benim zamanımda sadece kitabı okurduk ve bilgileri hatırlamaya çalışırdık.n#Kişi2#: Öğretmen bize bilginin önemini anlattı aktif okuma. Ve seçtiğiniz hızda öğrenmenin en iyi yolu budur.n#Kişi1#: Anlıyorum. Peki bu defter ne için?n#Kişi2#: Bu not almak için. Ne tür şeyler yazıyorsun?n#Kişi1#: Bazen özet yazıyorum. Bu sayfada soruları yazıyorum. Ve tabii ki yeni kelimeleri yazdığım başka bir sayfam daha var.n—nÖzet:nnn### Yanıt:n | George annesine kitabın önemli kısımlarını farklı renklerle işaretlemenin onun öğrenme yolu olduğunu söylüyor. Ayrıca deftere notlar alıyor ve bazen özet yazıyor. | #Kişi1#: Ahhh! Aktif okuma, okuma soruları, kelime notları, özetler ve vurgulama. Bilgiyi öğrenme konusunda ne kadar farklı olduğunuzu şimdi görebiliyorum. Etkilendim.n#Kişi2#: Teşekkürler. Okumak, yeni bilgileri öğrenmenin ve hatırlamanın en iyi yoludur. Şu anda aktif okumayı kullanıyor musunuz?n#Kişi1#: Hımmm….. Bunun hakkında düşünmem gerekecek.nnn#Kişi | George kitaplarını hızlı okumak için yaptığı faaliyetleri anlatıyor. George defteri anneye gösteriyor ve nasıl not alınacağını açıklıyor.nn |

| Bu diyaloğu özetleyin:n#Kişi1#: Günaydın efendim. Pasaportunuzu görebilir miyim?n#Kişi2#: Evet, elbette. İşte burada.n#Kişi1#: Teşekkür ederim. Bunların hepsi senin mi?n#Person2#: Hayır, bazıları arkadaşımın. Onun da pasaportunu istiyor musun?n#Kişi1#: Evet, lütfen. Elinizde taşınacak eşyanız var mı?n#Person2#: Onu da kemere takmamı ister misiniz?n#Person1#: Evet, lütfen. Lütfen bu büyük çantayı açar mısınız? n#Kişi2#: Tamam. Bir dakika. Sadece birkaç kıyafet ve tuvalet malzemesi.n#Kişi1#: Tamam. Bildireceğiniz bir şey var mı?n#Kişi2#: Sanırım hiçbir şey yok.n#Kişi1#: Taze yiyecek, canlı bitki veya hayvan var mı?n#Kişi2#: Ah, hayır. Bunların hiçbiri.n#Kişi1#: Teşekkür ederim. Bavulunuzu kilitleyebilirsiniz. İşte pasaportlarınız.n#Kişi2#: Çok teşekkürler.n—nÖzet:nnn### Yanıt:n | #Kişi1#, #Kişi2#'nin ve #Kişi2#'nin arkadaşının pasaportunu görür ve bagajlarını kontrol eder. #Kişi2#, #Kişi1#'e bildirecek hiçbir şeyi olmadığını söyler. #Kişi1# onların gitmesine izin verir. | > Bence hiçbir şey yok.nnn—n**Kategoriler:**nn- [Konuşma (32)](../konuşma/32.md)n – [TSA (4)](../konuşma/32/ 4.md)nn### Anahtar:nn :bilgi_kaynağı: 31 (TSA)n:bilgi_kaynağı: 32 (TSA)nn—-n* Herhangi bir telif hakkı | Göçmenlik görevlisi #Kişi2#'den pasaportunu göstermesini ve büyük valizini açmasını istiyor. #Person2#'ın beyan edecek bir şeyi yok ve valizini kilitleyebilir.nn |

| Bu diyaloğu özetleyin:n#Kişi1#: Çin çayı tüm dünyada ünlüdür. Birkaç kutu satın almak istiyorum.n#Person2#: Çin'de çeşitli çay türleri vardır. Tadına ve etkisine göre değişir.n#Kişi1#: Peki Çin çayını hiç bilmiyorum.n#Kişi2#: Bu yeşil çay, yazın içebilirsin. Yaz sıcağını hafifletebilir ve ciğerlerinizi korumaya iyi gelir.n#Kişi1#: Kulağa ilginç geliyor. Peki ya bu?n#Person2#: Siyah çaydır, güçlü bir tadı vardır ve sindirimi kolaylaştırır.n#Person1#: Bu nedir? Hoş kokulu kokuyor.n#Person2#: Yüksek kaliteli yasemin çayıdır. Hoş kokulu ve hoş bir tadı var.n#Kişi1#: Yasemin çayını alacağım. Ambalaj kağıdı ve kurdeleyle paketleyebilir misin? Bu arkadaşım için bir hediye.n#Kişi2#: Sorun değil. Bir dakika bekleyin.n—nÖzet:nnn### Yanıt:n | #Kişi2# Çin çayı almak isteyen #Kişi1#'e yeşil çay, siyah tişört ve yasemin tişörtü önerir ve #Kişi1# yasemin çayını almaya karar verir. | #[İngilizce]#: Çin çayı tüm dünyada ünlüdür. Birkaç kutu satın almak istiyorum.n#[Fransızca]#: Farklı çeşitlerde çini ve ödemeler var. C'est selon le goût, et les effets qu'on veut obtenir.n#[İspanyolca]#: El té chino es çok ünlü, tengo que comprar varias cajas.n#[Almanca]#: Ich mö | #Kişi1# farklı çay türleriyle birlikte birkaç kutu Çin çayı satın almak istiyor. #Kişi2#, #Kişi1#'in seçmesine yardımcı olur ve onu toplar.nn |

- Dialogsum veri kümesinde Llama-2 13B modeline ince ayar yapılmasına ilişkin sonuçlar:

| Girdiler | Zemin gerçeği | İnce Ayarlı Olmayan Modelden Yanıt | İnce Ayarlı Modelden Yanıt |

| Bu diyaloğu özetleyin: n#Person1#: Bayan Thompson bir zamanlar diteistti, Jason.n#Person2#: Neden? Başımızın belaya girmesi falan gerekmez mi? Aslında bu sabah tüm sınıf tartışması boyunca son derece aktiftik.n#Kişi1#: Sadece bu kadar. Hiç de kötü bir şey olduğunu düşünmüyorum. Sanırım bizden sınıf monitörüne aday olmamızı isteyecek.n#Person2#: Vay be! Gerçekten mi? Bu çok büyük bir sorumluluk.n#Person1#: Bence bunda harika olursun. Üstelik bunu yapmanın istenmesi büyük bir onur. Bu, Bayan Thompson'ın bizi lider olarak gördüğü anlamına geliyor.n#Person2#: Ancak bunu kendi başıma yapabileceğimden emin değilim. Bunu birlikte yapabilir miyiz? n#Kişi1#: Hadi Bayan Thompson'a soralım. Şimdi onun koridordan geldiğini duyuyorum.n—nÖzet:nnn### Yanıt:n | #Kişi1#, Jason Bayan Thompson'a bir zamanlar diteist olduğunu söylüyor ve #Kişi1# onların sınıf gözetmenliğine aday olmalarını istediğini tahmin ediyor. Bayan Thompson'a bunu birlikte yapıp yapamayacaklarını soracaklar. | n* Öğretmen, Jason ve sınıf arkadaşına sınıf gözetmenliğine aday olmak isteyip istemediklerini sorduğunda, o ve sınıf arkadaşı bu konuda birlikte anlaştılar. Her iki oğlan da Hıristiyan ama sınıfta arkadaş değiller.n* İsa'ya olan inançları kamuya açık olmayabilir, ancak dua ve başkalarına yardım etmek ve sevgi göstermek için birlikte izledikleri örnek yoluyla açıkça görülüyor.nn—n## 1654nn **[Durum:** Öğrenciler son dönemdeki gelişmelerden bahsediyor | Bayan Thompson, Jason ve James'in lider olduklarını düşündüğü için sınıf gözetmenliğine aday olmalarını ister. |

| Bu diyaloğu özetleyin:n#Person1#: Hey, hadi kenara çekip şuradaki eve bakalım.n#Person2#: Evet, harika görünüyor! Açık Ev listemizde var mı?n#Person1#: Evet, listemizde.n#Person2#: Kaldırımdan harika görünüyor. Hadi içeri geçelim.n#Kişi1#: Kayıt defterini imzalayalım. Emlakçı şu anda biraz meşgul görünüyor.n#Person2#: Tamam, şimdi gidip mutfağa bakalım.n#Person1#: Ah bak, burada biraz içecek var.n#Person2#: Almayı unutma evle ilgili bilgilerin yer aldığı bir broşür.n#Person1#: Bu ev için ne kadar istediklerini söylüyor mu?n#Person2#: Evet, iki yüz otuz beş binden iki yüze indirim yapılmış gibi görünüyor ve yirmi beş binn—nÖzet:nnn### Yanıt:n | #Kişi1# ve #Kişi2# bir evi görmeye gelir. İçine bakıp fiyatını konuşuyorlar. | Bu, aşağıdaki uyarana verilen bir AMI tepkisidir. nn 2. Kişi: n Evet, harika görünüyor! Açık Ev listemizde var mı? nEvet, listemizde. nEh, kaldırımdan harika görünüyor. Hadi içeri girelim.nKayıt defterini imzalayalım. Emlakçı şu anda biraz meşgul görünüyor.nTamam, şimdi gidip mutfağa bakalım.nAh bak, biraz var | #Kişi1# ve #Kişi2# Açık Ev listesindeki bir evin etrafına bakıyor. Bir kayıt defteri imzalıyorlar ve #Kişi2#, #Kişi1#'e bilgilerin yer aldığı bir broşür almasını söylüyor.nn |

| Bu diyaloğu özetleyin:n#Kişi1#: Nasılsınız Bay Wilson? Ben Tina.n#Person2#: Tanıştığımıza memnun oldum Bayan Tina.n#Person1#: Lütfen oturun. Zorla çalıştırmamızın size çalışan sözleşmenizle ilgili bilgileri zaten verdiğini biliyorum, ancak imzalamadan önce ana ayrıntıların üzerinden tekrar geçmek istiyorum. Öncelikle, bir yıllık hizmetin ardından bir aylık ücretli izinle birlikte aylık maaş alacaksınız.n#Person2#: Anladığım bu.n#Person1#: Görevdeyken sağlık planımız kapsamında olacaksınız. Orta düzey yönetici olacağınız için normal çalışma saatleri dışında 1 saate kadar müsait olmanız beklenmektedir. Bu süreyi aşan onaylanmış herhangi bir süre, maaş veya izin olarak kullanabileceğiniz bir buçuk sürede ödenecektir.n#Kişi5#: Kesinlikle benim anladığım kadarıyla.n#Kişi2#: Makul sayıda hastalık günü şirket tarafından karşılanacaktır. . Uzun süreli hastalıklar sigorta kapsamında olacaktır. Sözleşmenin diğer şartlarını okudunuz mu?n#Kişi1#: Evet okudum.n#Kişi2#: Başka sorunuz var mı?n#Kişi1#: Sadece bir tane. Esnek zamanla ilgili bir madde dikkatimi çekti. Bu benim için bir olasılık mı?n#Kişi2#: Evet, öyle, ancak ayrıntıları yöneticinizle görüşmeniz gerekecek.n#Kişi1#: Bu kabul edilebilir.n#Kişi2#: Güzel. Şimdi burayı imzalarsanız 1 gün içinde çalışmaya başlayabilirsiniz.n—nÖzet:nnn### Yanıt:n | Bay Wilson, Tina'ya iş sözleşmesiyle ilgili temel bilgileri anlatıyor. Aylık maaştan, bir aylık ücretli izinden, sağlık planlarından, uzatılmış çalışma saatlerinden ve esnek zamandan bahsediyor. | nHayır, özetler doğru değil. #Kişi1 diyalogları ismin Tina olduğunu söylemiyor, kendilerini tanıtmıyor. Bence ikisi de birbirlerinin isimlerini biliyor, o yüzden buna gerek yok.nnBence her şey doğruysa, #Kişi1 sona ermediği sürece Özet değişmeyecek ve bunda bir sorun yok.nn | Tina, Tina'nın çalışan sözleşmesinin ana ayrıntılarını gözden geçirmek için Bay Wilson ile buluşur. İkili aylık maaşı ve sağlık planını tartışıyor. Tina'nın hiçbir sorusu yok ve 3 gün içinde çalışmaya başlayacak.nn |

| Bu diyaloğu özetleyin:n#Kişi1#: Jack, en sevdiğin konu hangisi?n#Kişi2#: En sevdiğim konu? Sanırım bilimi tercih ediyorum. Evet bilim, bunu çok ilginç buluyorum. Fen bilgisi öğretmeni konuyu çok heyecanlı hale getiriyor. Peki ya sen?n#Kişi1#: Matematik testlerinde her zaman çok başarılı olurum. Coğrafyayı da severim. İnsanları ve yaşadıkları yerleri öğrenmeyi seviyorum. Sevmediğiniz konular var mı Jack?n#Person2#: Fiziği pek sevmiyorum. Anlaması kolay değil, çocukların çoğu bundan sıkılıyor.n—nÖzet:nnn### Yanıt:n | Jack'in en sevdiği ders bilim olmasına rağmen fiziği pek sevmemektedir. #Kişi1# matematik ve coğrafyayı seviyor. | n—nn### Kelime: “favori” (adj)nn Anlamı: Çoğu kişi tarafından sevilen, takdir edilen nÖrnekler: En sevdiğim kitap İncil'dir; En sevdiğiniz spor nedir?; En sevdiğim renk mavi.nn—nnnn### ____ konunuz nedir? (resmi)nnSoru ve Cevap İletişim Kutusu:nn#Kişi1#: En sevdiğiniz konu nedir?n# | Jack ve Jack en sevdikleri ve en az sevdikleri konular hakkında konuşuyorlar. |

| Bu diyaloğu özetleyin:n#Kişi1#: Merhaba, Maggie. Resminizi tüm velilerin gittiği yıl sonu okul resim sergisinde gördüm. Harikaydı.n#Person2#: Resim öğretmenimiz bundan gerçekten memnun görünüyordu ama ebeveynlerin ne düşündüğünden emin değilim.n#Person1#: Ah, endişelenme. Sadece bu konuda iyi şeyler söylediklerini duydum.n#Kişi2#: Hımm…Doğru renkleri kullanmadığımı muhtemelen fark etmedi.n#Kişi1#: Kimsenin fark ettiğini sanmıyorum.n#Kişi2# : Hayır ama yaptım. Ama bu konuda bir şey yapmak için artık çok geçti. Bir dahaki sefere daha iyi bir şey yapacağımı umuyorum.n—nÖzet:nnn### Yanıt:n | #Kişi1#, Maggie'nin tablosunu gördü ve harika olduğunu düşünüyor, ancak Maggie doğru renkleri kullanmadığından endişeleniyor ve bir dahaki sefere daha iyi bir şey yapacağını umuyor. | Bu özet, tartışmadaki önemli noktaları ve sonuçları vurgulamalıdır.nn# Kişi1'e Yanıtla:n[Yanıt özeti]nn—n### Yanıt:nBu özet, tartışmadaki önemli noktaları ve sonuçları vurgulamalıdır.nn# Kişi2'ye Yanıtla :n[Yanıt özeti]nn### Kişi1:n[Kişi1 özeti]n—n### Kişi2:n[Kişi2 özeti]nn### Kişin—n | #Kişi1# Maggie'nin resmini gördü ve Maggie'ye birçok ebeveynin Maggie'nin resmi hakkında harika şeyler söylediğini söyledi. Maggie öyle düşünmüyor. |

- Dialogsum veri kümesinde Llama 2 70B modeline ince ayar yapılmasına ilişkin sonuçlar:

| Girdiler | Zemin gerçeği | İnce Ayarlı Olmayan Modelden Yanıt | İnce Ayarlı Modelden Yanıt |

| Bu diyaloğu özetleyin:n#Kişi1#: Herhangi bir derece aldınız mı?n#Kişi2#: Evet. 1996'da Hebes Üniversitesi'nden Lisans diplomamı aldım ve 2001'de Pekin Üniversitesi'nden MBA derecemi aldım.n#Person1#: Üniversitedeki akademik kayıtlarınız nasıl?n#Person2#: Aslında kayıtlarım mükemmeldi. Genel not ortalamam 9 üzerinden 10'du, bu da sınıfımdaki en yüksek nottu.n#Kişi1#: Bu çok etkileyici. En çok hangi dersi beğendiniz? n#Person2#: İngilizce. Hem ilginç hem de faydalıydı, bu yüzden büyük ilgi gösterdim.n#Kişi1#: Yüksek lisans öğrencisiyken neden bölümünüzü değiştirdiğinizi bana söyleyebilir misiniz?n#Kişi2#: Çünkü yönetim ve yönetimle çok ilgileniyorum Bununla ilgili bazı dersler aldım. Konularda da iyi performans gösterdim. Dolayısıyla bu pozisyonda iyi bir iş çıkarabileceğime inanıyorum.n#Kişi1#: Üniversitede herhangi bir onur ve ödül aldınız mı?n#Kişi2#: Evet. Her yıl üniversiteden burs alıyordum. 1995 yılında Ulusal Matematik Modelleri Yarışmasına katıldım ve ödülü kazandım.n—nÖzet:nnn### Response:n | #Kişi1#, #Kişi2# ile röportaj yapar ve #Kişi2#'ye, #Kişi2#'nin dereceleri, akademik kayıtları, en sevdiği ders ve üniversitedeki ödüller dahil olmak üzere bazı sorular sorar. #Kişi2# aynı zamanda #Kişi1#'e neden #Kişi2#'nin ana dalın yönetim olarak değiştirildiğini de anlatır. | Aday, diyaloğun ana fikrinin kendisinin iki derece (0) alması olduğunu özetledi. Ve ana dallar iyi iş çıkardı. Ancak ilk cümlesi narsisizmin yanı sıra yukarıda pek fazla duygu sunmuyor ve deneyiminin şirketle neden alakalı olduğunu da belirtmiyor. Daha iyi bir bağlantı kurabilir ve belki de özeti (diyalogda yaptığı gibi) "profesyonel" dışında temel bir duygu/tavırla bitirebilir. | #Kişi2#, #Kişi1# #Kişi2#'nin lisans derecesi ve MBA aldığını söylüyor. #Kişi2#'nin genel not ortalaması #Kişi2#'nin sınıfında en yüksektir ve #Kişi2# yönetimle ilgilenmektedir. #Person2# ayrıca üniversitede bazı onur ve ödüller aldı.nn |

| Bu diyaloğu özetleyin:n#Kişi1#: Afedersiniz, bu hangi materyal? n#Kişi2#: Rhaki. Biraz ister misin? n#Kişi1#: Hayır, pamuklu bezler nerede? n#Kişi2#: Sana göstereceğim. n#Kişi1#: Yıkama sonrası çekme oranı nedir? n#Kişi2#: %5'ten az. Oldukça dayanıklıdır. n—nÖzet:nnn### Yanıt:n | #Kişi2#, #Kişi1#'e pamuklu giysilerin dayanıklı olduğunu söyler. | QA41913 rotası için bu bölüm diyaloğun bir paragraf özetini içermelidir, böylece örneğin otomatik telaffuz ve konuşma oluşturma sistemi bu metni çıktı sentezi için kullanabilir. | #Kişi1# pamuklu bez istiyor. #Person2# bazı rhaki.nn'leri gösteriyor |

| Bu diyaloğu özetleyin:n#Person1#: Üzgünüm, geciktim, Tom.n#Person2#: Sorun değil, Rita. Neredeydin?n#Kişi1#: Karakolda. Çantamı kaybettim. Ya da belki birisi onu almıştır. Bilmiyorum.n#Kişi2#: Ah, hayır. Ne oldu? Oturmak. İçinde önemli bir şey var mıydı?n#Kişi1#: Önemli! Çek defterim, iş için ihtiyacım olan tüm evraklar.n#Person2#: Ah, bu çok kötü. Peki onu nasıl kaybettin?n#Kişi1#: Bildiğiniz gibi, bütün sabah bir arkadaşımla birlikteydim ve birlikte öğle yemeği yedik. Öğle yemeğimi yedikten sonra alışverişe çıktım. Ve bir şey satın almak istediğimde çek defterimi bulamadım. Sonra çantamda olduğunu hatırladım. Çantam da arabamdaydı.n#Person2#: Yani arabana geri döndün.n#Person1#: Ama onu orada bulamadım.n#Person2#: Ve polis karakoluna mı gittin?n# Kişi1#: Hemen değil. Karakola gitmeden önce arkadaşımın ofisini aradım. Şansınız yok.n#Person2#: Öğle yemeği yediğiniz restorana gidip onu aramalısınız.n#Person1#: Ah, bunu yapmalıydım.n#Person2#: Şimdi yöneticiye telefon etsen iyi olur uzakta.n—nÖzet:nnn### Yanıt:n | Rita, Tom'a çantasını kaybettiği ve çantayı arama çabalarını kaybettiği için geç kaldığını söyler. Tom, Rita'ya öğle yemeği yediği restorana gitmesini ve onu aramasını önerir. | En sevdiğiniz kelime kombinasyonunu kullanarak her cümleyi İngilizceye çevirin:n### Değer:n | Rita çantasını kaybetti ve Tom ona öğle yemeği yediği restorana gidip onu aramasını tavsiye etti. |

| Bu diyaloğu özetleyin:n#Kişi1#: Sabah, Anne!n#Kişi2#: Sabah, Meg. Bugün iyi görünmüyor musun? Hasta mısın?n#Kişi1#: Hayır, hasta değilim.n#Kişi2#: O halde, senin derdin ne çocuğum?n#Kişi1#: Hiçbir şey.n#Kişi2#: Ah, hadi bebeğim. Bana ne olduğunu anlat.n#Kişi1#: I. . . Sınavı geçemedim. Keşke çok çalışsaydım.n#Person2#: Ah. Boşver. Hedefinizi bugünden itibaren belirleyebilirsiniz.n#Kişi1#: Tamam anne. Bir dahaki sefere sınavda başarısız olmayacağım.n—nÖzet:nnn### Yanıt:n | Meg sınavda başarısız olduğu için havasında değil. Annesi onu bugünden itibaren hedefini belirlemesi konusunda cesaretlendiriyor. | Eylemin yardımı olmadan eylem miktarından sonra doğrudan nesneye yardım edin | #Kişi1# sınavı geçemedi ve bunu annesine anlattı. Annem #Kişi1#'i daha sıkı çalışmaya teşvik ediyor.nn |

| Bu diyaloğu özetleyin: n#Kişi1#: Herkes finansal olarak kaybetmek, öldürmek ister. Zengin emekli olmayı planlıyorsanız birikimlerinizi yatırıma yatırmalısınız. Hisse senedi almayı düşünüyorum. İyi yönetebilirsem iyi bir yatırım olabilir. Ne diyorsun?n#Kişi2#: Sana kısmen katılıyorum. Hisse senedi satın almak zor değil ancak hisse senedi satın alarak tutarlı bir şekilde para kazanmak çok zordur. Profesyoneller bile bunu kolay bulamıyor, bu yüzden dikkatli olun. Zaten bizim gibilerin yatırım konusunda yardıma ihtiyacı var. Neden biraz çevrimiçi araştırma yapmıyorsunuz? İnsanları nasıl yatırım yapacakları konusunda eğitmek için veriler, raporlar ve tartışma forumları var. Ayrıca, hisse senedi grafikleri sunan köklü bir web sitesini de ziyaret etmeniz gerekiyor.n#Person1#: Vay, çok profesyonel konuşuyorsunuz.n#Person2#: Geçen hafta sonu yatırım TV programını izledim. Bu aralar çok konuşulan bir konu haline geldi. Aslında yeni başlayan biri bile değilim.n—nÖzet:nnn### Yanıt:n | #Kişi1# ve #Kişi2# hisse senedi satın almaktan bahsediyor. #Person2# bu şekilde tutarlı bir şekilde para kazanmanın zor olduğunu düşünüyor ve yatırım hakkında bilgi edinmek için çevrimiçi araştırma yapmayı öneriyor. | Daha önce önerilen yatırım stratejisine katılıyorum. Böyle bir plan hazırlamak çok zamanımı ve enerjimi aldı. Kararıma bu kadar güvenilmesi çok güzel. Aslında meslektaşım kendini güvende hissedebilir çünkü ben bu takımı parlak ve güvenli bir emeklilik geleceğine taşımak için her şeyi yapacağım. Ekibin aktif bir üyesi olarak rolünüzü sabırsızlıkla bekliyorum. | #Kişi1# hisse senedi satın almak istiyor ancak #Kişi2# #Kişi1#'e dikkatli olmasını çünkü yatırım yapmanın zor olduğunu söylüyor. #Kişi2#, #Kişi1#'in çevrimiçi araştırma yapmasını, yerleşik web sitelerini ziyaret etmesini ve yatırım programlarını izlemesini öneriyor.nn |

Veri kümesi biçimlendirmesi