Son yıllarda derin öğrenme sinir ağlarında (DNN'ler) inanılmaz bir büyüme görüldü. Bu büyüme, daha doğru modellerde ve hatta üretici yapay zeka ile yeni olasılıkların açılmasında görülebilir: doğal dili sentezleyen büyük dil modelleri (LLM'ler), metinden görüntü oluşturucular ve daha fazlası. DNN'lerin bu artan yetenekleri, eğitilmek için önemli hesaplama kaynakları gerektiren büyük modellere sahip olma maliyetiyle birlikte gelir. Dağıtılmış eğitim bu sorunu iki teknikle ele alır: veri paralelliği ve model paralelliği. Veri paralelliği, eğitim sürecini birden çok düğüm ve çalışan üzerinde ölçeklendirmek için kullanılır ve model paralelliği, bir modeli böler ve belirlenen altyapıya uydurur. Amazon Adaçayı Yapıcı dağıtılmış eğitim işler, tek tıklamayla (veya tek bir API çağrısıyla) dağıtılmış bir bilgi işlem kümesi kurmanıza, bir model eğitmenize, sonucu şuraya kaydetmenize olanak tanır: Amazon Basit Depolama Hizmeti (Amazon S3) ve tamamlandığında kümeyi kapatın. Ayrıca SageMaker, dağıtılmış eğitim alanında aşağıdaki gibi özellikleri kullanıma sunarak sürekli olarak yenilik yapmıştır: heterojen kümeler için dağıtılmış eğitim kitaplıkları veri paralellik ve model paralelliği.

Dağıtılmış bir ortamda verimli eğitim, hiperparametrelerin ayarlanmasını gerektirir. Birden fazla GPU üzerinde eğitim yaparken iyi uygulamanın yaygın bir örneği, GPU başına aynı parti boyutunu korumak için parti (veya mini parti) boyutunu GPU numarasıyla çarpmaktır. Bununla birlikte, hiperparametrelerin ayarlanması genellikle model yakınsamasını etkiler. Bu nedenle, dağıtılmış eğitimin üç faktörü dengelemesi gerekir: dağıtım, hiperparametreler ve model doğruluğu.

Bu yazıda, dağıtılmış eğitimin yakınsama üzerindeki etkisini ve nasıl kullanılacağını keşfedeceğiz. Amazon SageMaker Otomatik Model Ayarlama veri paralelliğini kullanarak dağıtılmış eğitim için model hiperparametrelerinde ince ayar yapmak.

Bu gönderide belirtilen kaynak kodu şu adreste bulunabilir: GitHub deposu (bir m5.xlarge örneği önerilir).

Eğitimi tek bir ortamdan dağıtılmış ortama ölçeklendirin

Veri paralelliği, eğitim sürecini birden fazla bilgi işlem kaynağına göre ölçeklendirmenin ve daha hızlı eğitim süresi elde etmenin bir yoludur. Veri paralelliği ile, veriler bilgi işlem düğümleri arasında bölümlenir ve her düğüm, gradyanları kendi bölümlerine göre hesaplar ve modeli günceller. Bu güncellemeler, eşzamansız, birden çoğa veya hepsinden hepsine bir şekilde bir veya birden çok parametre sunucusu kullanılarak yapılabilir. Başka bir yol da AllReduce algoritması kullanmak olabilir. Örneğin, ring allreduce algoritmasında, her düğüm komşu düğümlerinden yalnızca ikisiyle iletişim kurar, böylece toplam veri aktarımlarını azaltır. Parametre sunucuları ve ring-allreduce hakkında daha fazla bilgi edinmek için bkz. Amazon SageMaker'da Horovod veya Parametre Sunucuları ile TensorFlow dağıtılmış eğitimi kolayca başlatma. Veri bölümleme ile ilgili olarak, varsa n hesaplama düğümleri, daha sonra her düğüm verilerin bir alt kümesini almalıdır, yaklaşık 1/n boyutunda.

Ölçeklendirme eğitiminin model yakınsama üzerindeki etkisini göstermek için iki basit deney yapıyoruz:

Her model eğitimi iki kez çalıştırıldı: tek bir örnekte ve birden çok örneğe dağıtıldı. DNN dağıtılmış eğitim için, dağıtılmış işlemcilerden tam olarak yararlanmak amacıyla mini parti boyutunu örnek sayısıyla (dört) çarptık. Aşağıdaki tabloda kurulum ve sonuçlar özetlenmektedir.

| Sorun tipi | Görüntü sınıflandırması | İkili sınıflandırma | ||

| Model | DNN | XGBoost | ||

| örnek | ml.c4.xlarge | ml.m5.2xlarge | ||

| Veri seti |

(Etiketlenmiş görseller) |

Doğrudan pazarlama (tablolu, sayısal ve vektörleştirilmiş kategoriler) |

||

| Doğrulama metriği | doğruluk | AUC | ||

| Epocs/Yuvarlaklar | 20 | 150 | ||

| Örnek Sayısı | 1 | 4 | 1 | 3 |

| Dağıtım türü | N / A | Parametre sunucusu | N / A | Tümünü Azalt |

| Eğitim süresi (dakika) | 8 | 3 | 3 | 1 |

| Nihai Doğrulama puanı | 0.97 | 0.11 | 0.78 | 0.63 |

Her iki model için de eğitim süresi, dağıtım faktörü tarafından neredeyse doğrusal olarak azaltılmıştır. Ancak, model yakınsaması önemli bir düşüş yaşadı. Bu davranış, iki farklı model, farklı bilgi işlem örnekleri, farklı dağıtım yöntemleri ve farklı veri türleri için tutarlıdır. Öyleyse, eğitim sürecini dağıtmak neden model doğruluğunu etkiledi?

Bu etkiyi açıklamaya çalışan birkaç teori var:

- Tensör güncellemelerinin boyutu büyük olduğunda, çalışanlar ile parametre sunucusu arasındaki trafik tıkanabilir. Bu nedenle, eşzamansız parametre sunucuları, ağırlık güncellemelerindeki gecikmeler nedeniyle önemli ölçüde daha kötü yakınsamaya maruz kalacaktır [1].

- Parti boyutunu artırmak, aşırı uydurmaya ve zayıf genellemeye yol açarak doğrulama doğruluğunu azaltabilir [2].

- Model parametrelerini eşzamansız olarak güncellerken, bazı DNN'ler en son güncellenen model ağırlıklarını kullanmıyor olabilir; bu nedenle, birkaç yineleme geride kalan ağırlıklara dayalı olarak gradyanları hesaplayacaklar. Bu, ağırlıkta katılığa yol açar [3] ve birkaç nedenden kaynaklanabilir.

- Bazı hiperparametreler modele veya optimize ediciye özeldir. Örneğin, XGBoost resmi belgeleri,

exactdeğeritree_modehiperparametre, dağıtılmış eğitimi desteklemez çünkü XGBoost, satır bölme veri dağıtımını kullanırken,exactağaç yöntemi, sıralanmış bir sütun biçiminde çalışır. - Bazı araştırmacılar, daha büyük bir mini parti yapılandırmanın daha az stokastikliğe sahip gradyanlara yol açabileceğini öne sürdü. Bu, kayıp fonksiyonu yerel minimum ve eyer noktaları içerdiğinde ve adım boyutunda herhangi bir değişiklik yapılmadığında, optimizasyonun bu tür yerel minimumlarda veya eyer noktasında takılıp kalmasıyla gerçekleşebilir [4].

Dağıtılmış eğitim için optimize edin

Hiperparametre optimizasyonu (HPO), bir öğrenme algoritması için en uygun olan bir dizi hiperparametreyi arama ve seçme işlemidir. SageMaker Otomatik Model Ayarlama (AMT), sağlanan veri kümesi üzerinde birden çok eğitim işi çalıştırarak yönetilen bir hizmet olarak HPO sağlar. SageMaker AMT, belirttiğiniz hiperparametre aralıklarını arar ve seçtiğiniz bir metrikle ölçülen en iyi değerleri döndürür. SageMaker AMT'yi yerleşik algoritmalarla kullanabilir veya özel algoritmalarınızı ve kapsayıcılarınızı kullanabilirsiniz.

Bununla birlikte, dağıtılmış eğitim için optimizasyon, genel HPO'dan farklıdır çünkü eğitim işi başına tek bir eşgörünüm başlatmak yerine, her iş aslında bir eşgörünüm kümesi başlatır. Bu, maliyet üzerinde daha büyük bir etki anlamına gelir (özellikle DNN için tipik olan maliyetli GPU hızlandırmalı bulut sunucularını düşünürseniz). Ek olarak AMT limitleri, muhtemelen vurabilirsin SageMaker hesap limitleri eşzamanlı eğitim örneği sayısı için. Son olarak, başlatma kümeleri, daha uzun başlatma süresi nedeniyle operasyonel ek yük getirebilir. SageMaker AMT, bu sorunları çözmek için belirli özelliklere sahiptir. Erken durdurma özellikli hiper bant iyi performans gösteren hiperparametre yapılandırmalarında ince ayar yapılmasını ve düşük performans gösterenlerin otomatik olarak durdurulmasını sağlar. Bu, eğitim süresinin verimli kullanılmasını sağlar ve gereksiz maliyetleri azaltır. Ayrıca SageMaker AMT, Amazon EC2 Spot Bulut Sunucularının kullanımını tam olarak destekler; %90'a varan eğitim maliyeti isteğe bağlı bulut sunucuları üzerinde. Uzun başlatma süreleriyle ilgili olarak SageMaker AMT, her ayarlama işinde eğitim örneklerini otomatik olarak yeniden kullanır ve böylece her birinin ortalama başlatma süresini azaltır. eğitim işi 20 kez. Ek olarak, takip etmelisiniz AMT en iyi uygulamalarıilgili hiperparametreleri, bunların uygun aralıklarını ve ölçeklerini ve en iyi sayıda eşzamanlı eğitim işini seçmek ve sonuçları yeniden oluşturmak için rastgele bir tohum ayarlamak gibi.

Bir sonraki bölümde, daha önce tartıştığımız XGBoost örneğini kullanarak bir AMT işini yapılandırırken, çalıştırırken ve analiz ederken bu özellikleri çalışırken görüyoruz.

Bir ayarlama işini yapılandırın, çalıştırın ve analiz edin

Daha önce de belirtildiği gibi, kaynak kodu şu adreste bulunabilir: GitHub repo. 1-5. Adımlarda, verileri indirip hazırlıyoruz, xgb3 tahmin aracı (dağıtılmış XGBoost tahmin aracı üç örnek kullanacak şekilde ayarlanmıştır), eğitim işlerini çalıştırın ve sonuçları gözlemleyin. Bu bölümde, Adım 1-5'ten geçtiğinizi varsayarak, o tahmin edici için ayarlama işinin nasıl ayarlanacağını açıklıyoruz.

Ayarlama işi, performansı değerlendirmek için bir ölçüm kullanarak başlattığı eğitim işleri için en uygun hiperparametreleri hesaplar. Yapabilirsiniz kendi metriğinizi yapılandırınSageMaker'ın yapılandırdığınız ve yaydığınız normal ifadeye göre ayrıştıracağı stdoutveya metriklerini kullanın SageMaker yerleşik algoritmaları. Bu örnekte, yerleşik XGBoost objektif metriği, yani bir normal ifade yapılandırmamıza gerek yok. Model yakınsamasını optimize etmek için doğrulama AUC metriğine dayalı olarak optimizasyon yapıyoruz:

Yedi hiperparametre ayarlıyoruz:

- sayı_yuvarlak – Eğitim sırasında artırma için tur sayısı.

- eta – Aşırı uyumu önlemek için güncellemelerde kullanılan adım boyutu küçülmesi.

- alfa – Ağırlıklarda L1 düzenleme terimi.

- min_child_weight – Bir çocukta ihtiyaç duyulan minimum örnek ağırlığı (kendir) toplamı. Ağaç bölme adımı, örnek ağırlığının toplamı şundan az olan bir yaprak düğümle sonuçlanırsa:

min_child_weight, oluşturma işlemi daha fazla bölümlemeden vazgeçer. - Maksimum derinlik – Bir ağacın maksimum derinliği.

- colsample_bylevel – Her düzeyde, her bölme için sütunların alt örnek oranı. Bu alt örnekleme, bir ağaçta ulaşılan her yeni derinlik seviyesi için bir kez gerçekleşir.

- colsample_bytree – Her ağacı oluştururken sütunların alt örnek oranı. İnşa edilen her ağaç için, alt örnekleme bir kez gerçekleşir.

XGBoost hiperparametreleri hakkında daha fazla bilgi edinmek için bkz. XGBoost Hiperparametreleri. Aşağıdaki kod, yedi hiperparametreyi ve bunların aralıklarını gösterir:

Ardından, Hyperband stratejisi için yapılandırma ve SageMaker SDK kullanılarak ayarlayıcı nesnesi yapılandırması. HyperbandStrategyConfig iki parametre kullanabilir: max_resource (isteğe bağlı) amaca ulaşmak için bir eğitim işi için kullanılacak maksimum yineleme sayısı ve min_resource – eğitimi durdurmadan önce bir eğitim işi tarafından kullanılacak minimum yineleme sayısı. Kullanırız HyperbandStrategyConfig Yapılandırmak için StrategyConfig, daha sonra ayarlama işi tanımı tarafından kullanılır. Aşağıdaki koda bakın:

Şimdi bir yaratıyoruz HyperparameterTuner aşağıdaki bilgileri ilettiğimiz nesne:

- Üç örnekle çalışacak şekilde ayarlanmış XGBoost tahmin aracı

- Objektif metrik adı ve tanımı

- Hiperparametre aralıklarımız

- Toplam çalıştırılacak eğitim işi sayısı ve paralel olarak çalıştırılabilecek eğitim işi sayısı gibi kaynak yapılandırmalarını ayarlama

- Hiper bant ayarları (son adımda yapılandırdığımız strateji ve yapılandırma)

- Erken durdurma (

early_stopping_type) ayarlanırOff

Erken durdurmayı neden Kapalı olarak ayarladık? Eğitim işleri, hiperparametre ayarlama işinin nesnel ölçütünü iyileştirme olasılığı düşük olduğunda erken durdurulabilir. Bu, işlem süresini kısaltmaya ve modelinize gereğinden fazla uydurmayı önlemeye yardımcı olabilir. Ancak Hyperband, erken durdurmayı uygulamak için gelişmiş bir yerleşik mekanizma kullanır. Bu nedenle, parametre early_stopping_type olarak ayarlanmalıdır Off Hyperband dahili erken durdurma özelliğini kullanırken. Aşağıdaki koda bakın:

Son olarak, çağırarak otomatik model ayarlama işine başlıyoruz. uygun yöntem. İşi eşzamansız bir şekilde başlatmak istiyorsanız, wait için False. Aşağıdaki koda bakın:

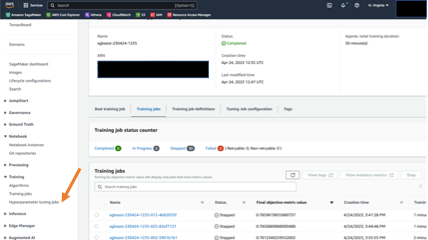

İşin ilerleyişini ve özetini SageMaker konsolundan takip edebilirsiniz. Gezinti bölmesinde, altında Eğitim, seçmek Hiperparametre ayarlama işleri, ardından ilgili ayarlama işini seçin. Aşağıdaki ekran görüntüsü, eğitim işlerinin durumu ve performansıyla ilgili ayrıntılarla birlikte ayarlama işini gösterir.

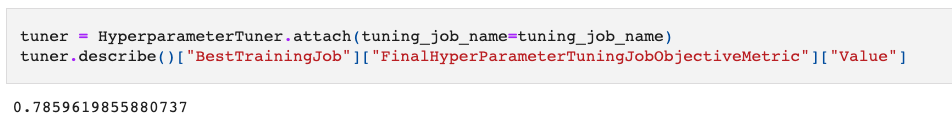

Ayarlama işi tamamlandığında sonuçları gözden geçirebiliriz. Not defteri örneğinde, SageMaker SDK kullanarak sonuçların nasıl çıkarılacağını gösteriyoruz. İlk olarak, ayarlama işinin model yakınsamasını nasıl artırdığını inceliyoruz. ekleyebilirsiniz HyperparameterTuner iş adını kullanarak nesneyi çağırın ve tanımlamak yöntem. Yöntem, ayarlama işi meta verilerini ve sonuçlarını içeren bir sözlük döndürür.

Aşağıdaki kodda, objektif ölçütümüzle (doğrulama AUC) ölçülen en iyi performans gösteren eğitim işinin değerini alıyoruz:

Sonuç, doğrulama setinde AUC cinsinden 0.78'dir. Bu, ilk 0.63'e göre önemli bir gelişme!

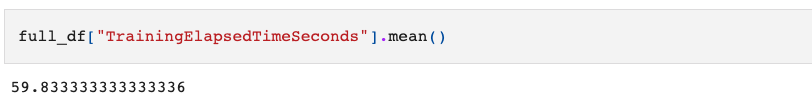

Ardından, eğitim işimizin ne kadar hızlı çalıştığını görelim. Bunun için, HiperparametreTuningJobAnalytics ayarlama işiyle ilgili sonuçları almak ve analiz ve görselleştirme için bir Pandas veri çerçevesine okumak için SDK'daki yöntem:

Bir eğitim işinin Hyperband stratejisiyle aldığı ortalama süreyi görelim:

Ortalama süre yaklaşık 1 dakika sürmüştür. Bu, düşük performans gösteren eğitim işlerini erkenden durduran Hyperband strateji mekanizmasıyla tutarlıdır. Maliyet açısından, ayarlama işi bizden toplam 30 dakikalık eğitim süresi için ücret aldı. Hyperband erken durdurma olmadan, toplam faturalandırılabilir eğitim süresinin 90 dakika olması bekleniyordu (30 iş * iş başına 1 dakika * iş başına 3 örnek). Bu, maliyet tasarrufu açısından üç kat daha iyidir! Son olarak, tuning işinin 30 eğitim işi çalıştırdığını ve toplam 12 dakika sürdüğünü görüyoruz. Bu, beklenen süreden neredeyse %50 daha azdır (30 iş/4 paralel iş * iş başına 3 dakika).

Sonuç

Bu yazıda, dağıtılmış ortamlarla modelleri eğitirken gözlemlenen bazı yakınsama sorunlarını açıkladık. Hyperband kullanan SageMaker AMT'nin, verileri paralel dağıtılmış eğitimin optimize etmesinin getirdiği temel endişeleri ele aldığını gördük: yakınsama (%10'dan fazla iyileştirilmiş), operasyonel verimlilik (ayarlama işi, sıralı, optimize edilmemiş bir işe göre %50 daha az zaman aldı) almış) ve maliyet etkinliği (30'a karşılık 90 faturalandırılabilir eğitim işi süresi dakikası). Aşağıdaki tablo sonuçlarımızı özetlemektedir:

| İyileştirme Metrik | Ayarlama Yok/Saf Model Ayarlama Uygulaması | SageMaker Hyperband Otomatik Model Ayarı | Ölçülen İyileştirme |

| Model Kalitesi (Doğrulama AUC ile ölçülmüştür) |

0.63 | 0.78 | İNDİRİM |

| Ücret (Faturalandırılabilir eğitim dakikalarıyla ölçülmüştür) |

90 | 30 | İNDİRİM |

| Operasyonel verimlilik (Toplam çalışma süresi ile ölçülmüştür) |

24 | 12 | İNDİRİM |

Ölçekleme (küme boyutu) açısından ince ayar yapmak için, ayarlama işini birden fazla küme yapılandırmasıyla tekrarlayabilir ve hız ve model doğruluğunu karşılayan en uygun hiperparametreleri bulmak için sonuçları karşılaştırabilirsiniz.

Bunu başarmak için gerekli adımlara raporun son bölümünde yer verdik. defter.

Referanslar

[1] Lian, Xiangru ve ark. "Eşzamansız merkezi olmayan paralel stokastik gradyan iniş." Uluslararası Makine Öğrenimi Konferansı. PMLR, 2018.

[2] Keskar, Nitish Shirish, et al. "Derin öğrenme için büyük toplu eğitim üzerine: Genelleme boşluğu ve keskin minimumlar." arXiv ön baskı arXiv: 1609.04836 (2016).

[3] Dai, Wei ve ark. "Dağıtılmış makine öğreniminde bayatlığın etkisini anlamaya doğru." arXiv ön baskı arXiv: 1810.03264 (2018).

[4] Dauphin, Yann N., ve ark. "Yüksek boyutlu dışbükey olmayan optimizasyonda eyer noktası sorununu belirleme ve bunlara saldırma." Sinirsel bilgi işleme sistemlerindeki gelişmeler 27 (2014).

Yazar Hakkında

Uri Rosenberg, Avrupa, Orta Doğu ve Afrika için AI ve ML Uzman Teknik Müdürüdür. İsrail merkezli Uri, kurumsal müşterilerin ML iş yüklerini uygun ölçekte tasarlaması, oluşturması ve çalıştırması için güçlendirmeye çalışıyor. Boş zamanlarında bisiklete binmekten, yürüyüş yapmaktan ve veri hazırlığından şikayet etmekten hoşlanıyor.

Uri Rosenberg, Avrupa, Orta Doğu ve Afrika için AI ve ML Uzman Teknik Müdürüdür. İsrail merkezli Uri, kurumsal müşterilerin ML iş yüklerini uygun ölçekte tasarlaması, oluşturması ve çalıştırması için güçlendirmeye çalışıyor. Boş zamanlarında bisiklete binmekten, yürüyüş yapmaktan ve veri hazırlığından şikayet etmekten hoşlanıyor.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. Otomotiv / EV'ler, karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- Blok Ofsetleri. Çevre Dengeleme Sahipliğini Modernleştirme. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/effectively-solve-distributed-training-convergence-issues-with-amazon-sagemaker-hyperband-automatic-model-tuning/

- :vardır

- :dır-dir

- :olumsuzluk

- $UP

- 1

- 10

- 100

- 12

- İNDİRİM

- 20

- 200

- 2014

- 2016

- 2018

- 24

- 27

- 30

- 7

- 8

- 9

- a

- Hakkımızda

- Hesap

- doğruluk

- doğru

- Başarmak

- Action

- aslında

- ilave

- Ayrıca

- adres

- adresleri

- ileri

- etkiler

- Afrika

- AI

- AL

- algoritma

- algoritmalar

- Alfa

- zaten

- Ayrıca

- şaşırtıcı

- Amazon

- Amazon EC2

- Amazon Adaçayı Yapıcı

- Amazon Web Servisleri

- arasında

- an

- analiz

- analytics

- çözümlemek

- ve

- Başka

- api

- Tamam

- uygun

- yaklaşık olarak

- ARE

- AS

- At

- iliştirmek

- Saldırma

- Otomatik

- otomatik olarak

- ortalama

- önlemek

- AWS

- Bakiye

- merkezli

- BE

- Çünkü

- önce

- davranış

- arkasında

- İYİ

- Daha iyi

- arasında

- Büyük

- artırılması

- her ikisi de

- inşa etmek

- bina

- yerleşik

- by

- hesaplanması

- çağrı

- çağrı

- CAN

- Alabilirsin

- yetenekleri

- kategoriler

- neden

- değişiklik

- yüklü

- çocuk

- Klinik

- seçme

- tıklayın

- Küme

- kod

- Sütun

- Sütunlar

- nasıl

- ortak

- karşılaştırmak

- tamamlamak

- hesaplamak

- Endişeler

- eşzamanlı

- Konferans

- yapılandırma

- yapılandırılmış

- Düşünmek

- tutarlı

- konsolos

- inşa

- Konteynerler

- içeren

- devamlı olarak

- Yakınsama

- Ücret

- pahalı

- maliyetler

- olabilir

- yaratmak

- görenek

- Müşteriler

- DAI

- veri

- Veri Hazırlama

- Merkezi olmayan

- derin

- derin öğrenme

- tanım

- gecikmeleri

- göstermek

- derinlik

- tanımlamak

- tarif edilen

- Dizayn

- belirlenen

- ayrıntılar

- DID

- farklı

- tartışılan

- dağıtıldı

- dağıtılmış eğitim

- dağıtım

- dağıtım

- do

- belgeleme

- Değil

- yapılmış

- Dont

- aşağı

- indir

- Damla

- gereken

- süre

- sırasında

- E&T

- her

- Daha erken

- Erken

- kolayca

- Doğu

- Efekt

- etkili bir şekilde

- verim

- verimli

- istihdam

- güçlendirmek

- etkinleştirmek

- sağlar

- olmasını sağlar

- kuruluş

- çevre

- ortamları

- özellikle

- AVRUPA

- değerlendirmek

- Hatta

- Her

- muayene etmek

- örnek

- beklenen

- deneyler

- Açıklamak

- keşfetmek

- çıkarmak

- faktör

- faktörler

- Moda

- HIZLI

- Daha hızlı

- Özellikler(Hazırlık aşamasında)

- Özellikler

- az

- Nihayet

- bulmak

- Ad

- uygun

- takip et

- takip etme

- İçin

- biçim

- bulundu

- dört

- ÇERÇEVE

- itibaren

- tamamen

- işlev

- daha fazla

- Ayrıca

- boşluk

- üretken

- üretken yapay zeka

- jeneratörler

- almak

- alma

- verir

- Tercih Etmenizin

- GPU

- GPU'lar

- gradyanları

- büyük

- Büyüme

- olmak

- Var

- sahip olan

- he

- yardım et

- onun

- vurmak

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTML

- http

- HTTPS

- Hiperparametre Ayarı

- if

- görüntüleri

- darbe

- Etkiler

- iyileştirmek

- gelişmiş

- iyileşme

- in

- dahil

- artmış

- bilgi

- Altyapı

- ilk

- örnek

- yerine

- iç

- içine

- tanıtmak

- tanıttı

- Israil

- sorunlar

- IT

- yineleme

- ONUN

- İş

- Mesleki Öğretiler

- tutmak

- L1

- dil

- büyük

- büyük

- Soyad

- sonra

- başlatmak

- başlattı

- fırlatma

- öncülük etmek

- İlanlar

- ÖĞRENİN

- öğrenme

- az

- seviye

- kütüphaneler

- sevmek

- yerel

- Uzun

- uzun

- kayıp

- makine

- makine öğrenme

- yapılmış

- Ana

- yönetilen

- müdür

- çok

- masif

- maksimum

- Mayıs..

- anlamına geliyor

- mekanizma

- adı geçen

- Metadata

- yöntem

- yöntemleri

- metrik

- Metrikleri

- Orta

- Orta Doğu

- olabilir

- asgari

- dakika

- dakika

- ML

- model

- modelleri

- Daha

- çoğu

- çoklu

- çarpılır

- şart

- isim

- Doğal (Madenden)

- Navigasyon

- gerek

- gerekli

- ihtiyaçlar

- ağlar

- nöral ağlar

- yeni

- sonraki

- yok hayır

- düğüm

- düğümler

- defter

- numara

- nesne

- nesnel

- gözlemek

- of

- kapalı

- resmi

- sık sık

- on

- On-Demand

- bir Zamanlar

- ONE

- bir tek

- açma

- işletmek

- işletme

- optimum

- optimizasyon

- optimize

- optimize

- or

- sipariş

- bizim

- dışarı

- tekrar

- tüm

- kendi

- pandalar

- bölmesi

- Paralel

- parametre

- parametreler

- geçmek

- başına

- performans

- yer

- Platon

- Plato Veri Zekası

- PlatoVeri

- Nokta

- noktaları

- yoksul

- olanakları

- belki

- Çivi

- uygulama

- hazırlık

- Hazırlamak

- önlemek

- Sorun

- süreç

- işleme

- işlemciler

- Ilerleme

- önerilen

- sağlamak

- sağlanan

- sağlar

- rasgele

- oran

- ulaştı

- Okumak

- nedenleri

- son

- Tavsiye edilen

- azaltmak

- Indirimli

- azaltır

- azaltarak

- Saygılarımızla

- regex

- uygun

- tekrar et

- gerektirir

- gerektirir

- Araştırmacılar

- kaynak

- Kaynaklar

- sonuç

- Sonuçlar

- İade

- yorum

- mermi

- SIRA

- koşmak

- koşu

- sagemaker

- SageMaker Otomatik Model Ayarlama

- aynı

- İndirim

- testere

- diyor

- SC

- ölçek

- terazi

- ölçekleme

- sdk

- arama

- Bölüm

- görmek

- tohum

- görüldü

- seçme

- Sunucular

- hizmet

- Hizmetler

- set

- ayar

- ayarlar

- kurulum

- Yedi

- keskin

- meli

- şov

- gösterilen

- Gösteriler

- kapatmak

- önemli

- önemli ölçüde

- Basit

- tek

- beden

- So

- ÇÖZMEK

- biraz

- Kaynak

- kaynak kodu

- uzay

- uzman

- özel

- hız

- bölmek

- Splits

- Spot

- başlama

- XNUMX dakika içinde!

- başlangıç

- Durum

- adım

- Basamaklar

- durdu

- durdurma

- Durdurur

- hafızası

- Stratejileri

- böyle

- acı

- ÖZET

- destek

- Destekler

- tablo

- alınan

- alır

- Teknik

- teknikleri

- tensorflow

- dönem

- şartlar

- göre

- o

- The

- Kaynak

- ve bazı Asya

- Onları

- sonra

- Orada.

- böylece

- bu nedenle

- Bunlar

- onlar

- Re-Tweet

- Bu

- üç

- İçinden

- zaman

- zamanlar

- için

- aldı

- Toplam

- trafik

- Tren

- eğitilmiş

- Eğitim

- transferler

- ağaç

- denemek

- Iki kere

- iki

- türleri

- tipik

- altında

- anlayış

- olası

- gereksiz

- güncellenmiş

- Güncellemeler

- güncellenmesi

- us

- kullanım

- Kullanılmış

- kullanım

- kullanma

- kullanmak

- onaylama

- değer

- Değerler

- görüntüleme

- vs

- istemek

- oldu

- Yol..

- we

- ağ

- web hizmetleri

- ağırlık

- Kimler

- ne zaman

- oysa

- hangi

- neden

- Vikipedi

- irade

- ile

- içinde

- olmadan

- işçiler

- çalışır

- kötü

- olur

- XGBoost

- yıl

- Sen

- zefirnet