ChatGPT'nin piyasaya sürülmesi ve üretken yapay zekanın popülaritesinin artması, AWS'de kurumsal sohbet robotları gibi daha konuşkan yeni ürünler ve hizmetler oluşturmak için bu teknolojiyi nasıl kullanabileceklerini merak eden müşterilerin hayal gücünü harekete geçirdi. Bu gönderi, bir sohbet başlatmak ve mevcut temel modellerle etkileşime geçmek için Chat Studio adını verdiğimiz bir web kullanıcı arayüzünü nasıl oluşturabileceğinizi gösterir. Amazon SageMaker Hızlı Başlangıç Llama 2, Stabil Difüzyon ve diğer modeller gibi Amazon Adaçayı Yapıcı. Bu çözümü dağıttıktan sonra kullanıcılar hızlı bir şekilde başlayabilir ve bir web arayüzü aracılığıyla konuşmaya dayalı yapay zekadaki birden fazla temel modelin özelliklerini deneyimleyebilir.

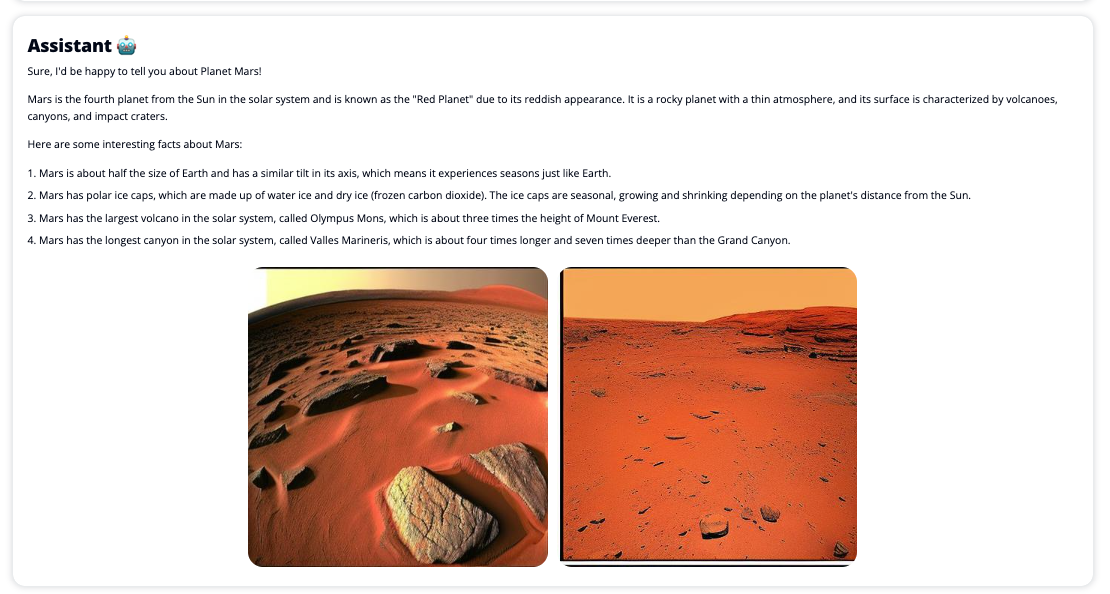

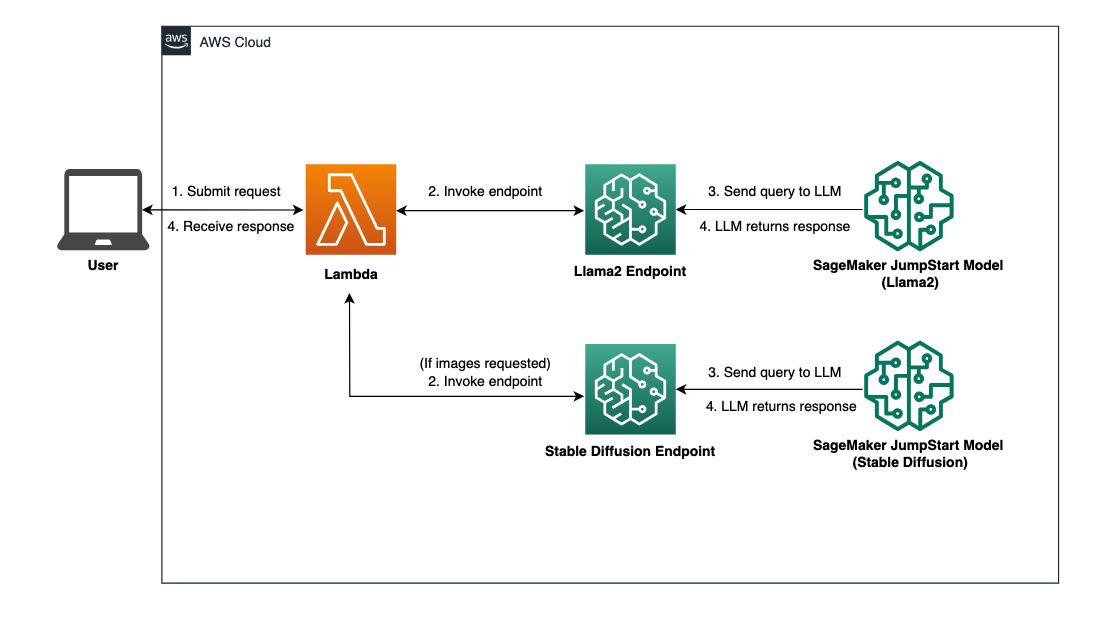

Chat Studio ayrıca, kullanıcının medyanın görüntülenmesini talep etmesi durumunda ilgili resim ve videolardan oluşan bir kolaj döndürmek için isteğe bağlı olarak Kararlı Dağıtım modeli uç noktasını çağırabilir. Bu özellik, medyanın yanıta eşlik eden varlıklar olarak kullanılmasıyla kullanıcı deneyiminin geliştirilmesine yardımcı olabilir. Bu, hedeflerinize ulaşmak için Chat Studio'yu ek entegrasyonlarla nasıl zenginleştirebileceğinizin yalnızca bir örneğidir.

Aşağıdaki ekran görüntüleri bir kullanıcı sorgusunun ve yanıtının nasıl göründüğüne dair örnekleri göstermektedir.

Büyük dil modelleri

ChatGPT gibi üretken yapay zeka sohbet robotları, büyük miktarlarda etiketlenmemiş metin üzerinde eğitilebilen derin öğrenme sinir ağına dayanan büyük dil modelleri (LLM'ler) tarafından desteklenmektedir. LLM'lerin kullanımı, gerçek insanlarla etkileşimlere çok benzeyen daha iyi bir konuşma deneyimine olanak tanır, bağlantı duygusunu geliştirir ve kullanıcı memnuniyetini artırır.

SageMaker temel modelleri

2021'de Stanford İnsan Merkezli Yapay Zeka Enstitüsü bazı Yüksek Lisans'ları şu şekilde adlandırdı: temel modelleri. Temel modeller geniş ve geniş bir genel veri seti üzerinde önceden eğitilmiştir ve dijital sanat oluşturmaktan çok dilli metin sınıflandırmaya kadar çok çeşitli kullanım durumlarında daha fazla optimizasyon için temel oluşturması amaçlanmaktadır. Bu temel modeller müşteriler arasında popülerdir çünkü yeni bir modeli sıfırdan eğitmek zaman alır ve pahalı olabilir. SageMaker JumpStart, üçüncü taraf açık kaynak ve özel sağlayıcılar tarafından sağlanan yüzlerce temel modele erişim sağlar.

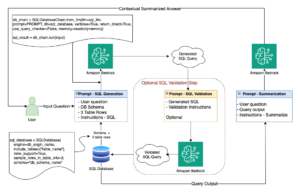

Çözüme genel bakış

Bu gönderide, SageMaker aracılığıyla önceden eğitilmiş ve özel LLM'lerin dağıtılması ve dağıtılan modellerle arayüz oluşturacak bir web kullanıcı arayüzünün oluşturulması için az kodlu bir iş akışı anlatılmaktadır. Aşağıdaki adımları ele alıyoruz:

- SageMaker temel modellerini dağıtın.

- Sürüş AWS Lambda ve AWS Kimlik ve Erişim Yönetimi (IAM) izinlerini kullanma AWS CloudFormation.

- Kullanıcı arayüzünü kurun ve çalıştırın.

- İsteğe bağlı olarak diğer SageMaker temel modellerini ekleyin. Bu adım, Chat Studio'nun ek temel modellerle etkileşim kurma yeteneğini genişletir.

- İsteğe bağlı olarak uygulamayı kullanarak dağıtın AWS Yükseltme. Bu adım, Chat Studio'yu web'e dağıtır.

Çözüm mimarisine genel bakış için aşağıdaki şemaya bakın.

Önkoşullar

Çözümü gözden geçirmek için aşağıdaki ön koşullara sahip olmanız gerekir:

- An AWS hesabı Yeterli IAM kullanıcı ayrıcalıklarına sahip.

npmyerel ortamınıza kuruludur. Nasıl kurulacağına ilişkin talimatlar içinnpmbakın Node.js ve npm'yi indirme ve yükleme.- İlgili SageMaker uç noktaları için 1 hizmet kotası. Llama 2 13b Chat için ml.g5.48xlarge örneğini, Stable Diffusion 2.1 için ise ml.p3.2xlarge örneğini kullanıyoruz.

Hizmet kotası artışı talebinde bulunmak için AWS Hizmet Kotaları konsolu, şu yöne rotayı ayarla AWS hizmetleri, SageMakerve uç nokta kullanımı için ml.g1xlarge ve uç nokta kullanımı için ml.p5.48xlarge için hizmet kotasının 3.2 değerine yükseltilmesi talebinde bulunun.

Bulut sunucusu tipinin kullanılabilirliğine bağlı olarak hizmet kotası isteğinin onaylanması birkaç saat sürebilir.

SageMaker temel modellerini dağıtın

SageMaker, geliştiricilerin makine öğrenimi modellerini kolaylıkla hızlı bir şekilde oluşturmasına ve eğitmesine yönelik, tam olarak yönetilen bir makine öğrenimi (ML) hizmetidir. Llama 2 13b Chat ve Stabil Difüzyon 2.1 temel modellerini aşağıdakileri kullanarak dağıtmak için aşağıdaki adımları tamamlayın: Amazon SageMaker Stüdyosu:

- Bir SageMaker alanı oluşturun. Talimatlar için bkz. Hızlı kurulumu kullanarak Amazon SageMaker Etki Alanına Ekleme.

Bir etki alanı tüm depolamayı ayarlar ve SageMaker'a erişecek kullanıcılar eklemenizi sağlar.

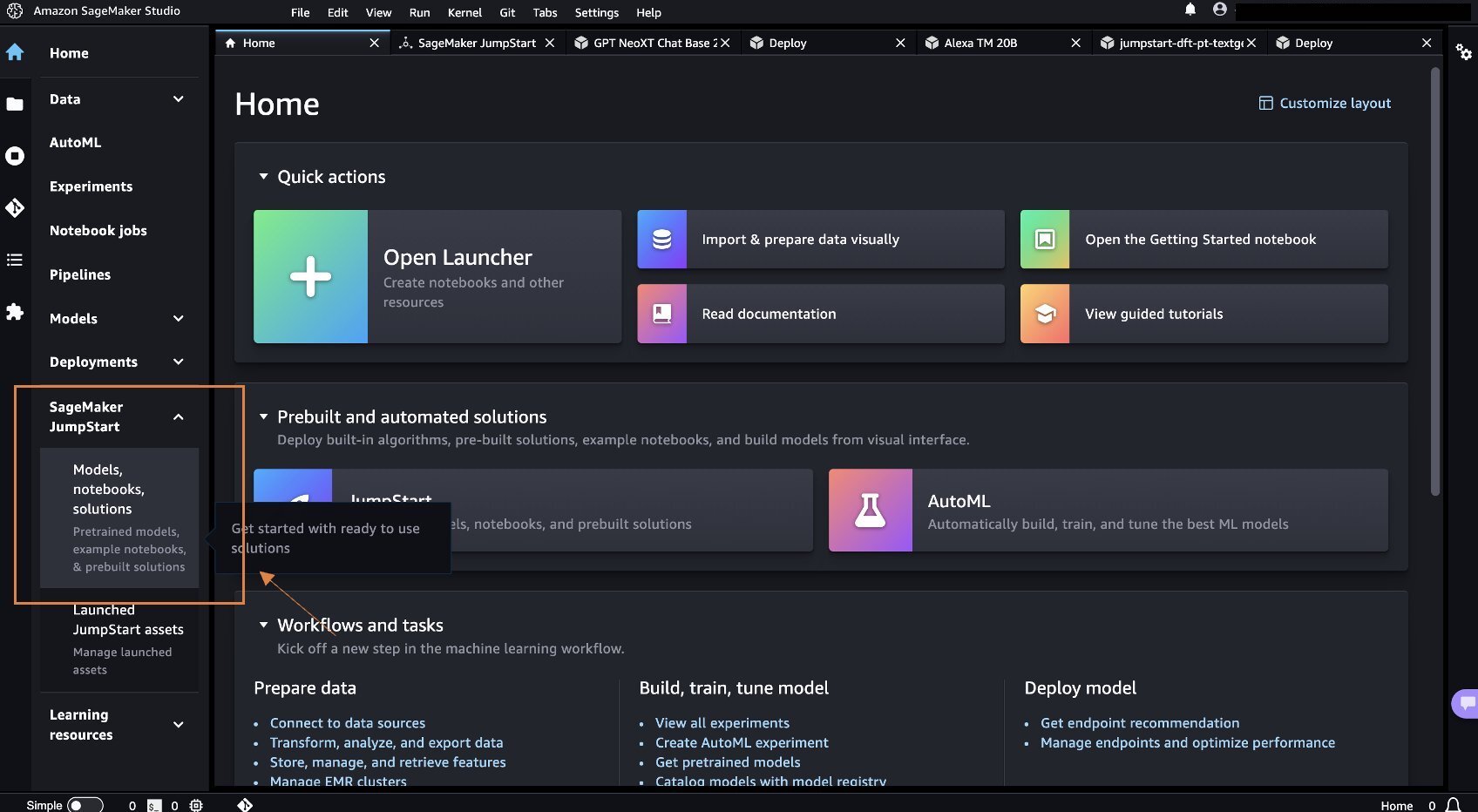

- SageMaker konsolunda, Stüdyo gezinme bölmesinde, ardından Stüdyo Aç.

- Studio başlatıldığında, altında Adaçayı Yapıcı Hızlı Başlangıç gezinme bölmesinde öğesini seçin. Modeller, defterler, çözümler.

- Arama çubuğunda Llama 2 13b Chat'i arayın.

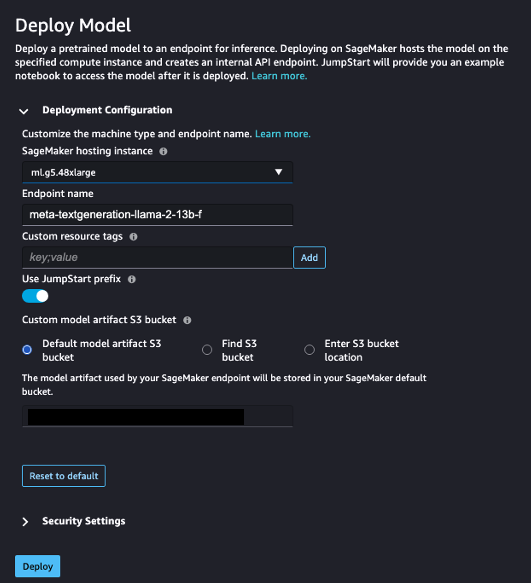

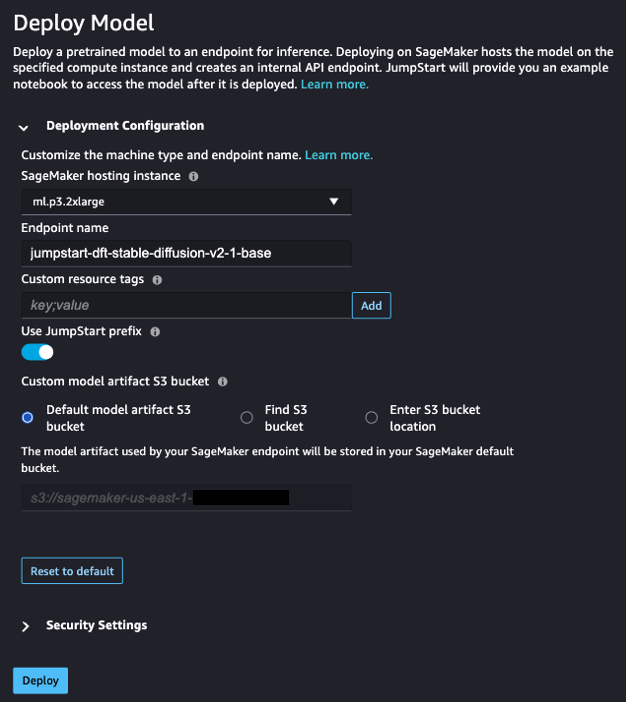

- Altında Dağıtım Yapılandırması, Için SageMaker barındırma örneği, seçmek ml.g5.48xlarge ve için Bitiş noktası adı, girmek

meta-textgeneration-llama-2-13b-f. - Klinik Dağıtın.

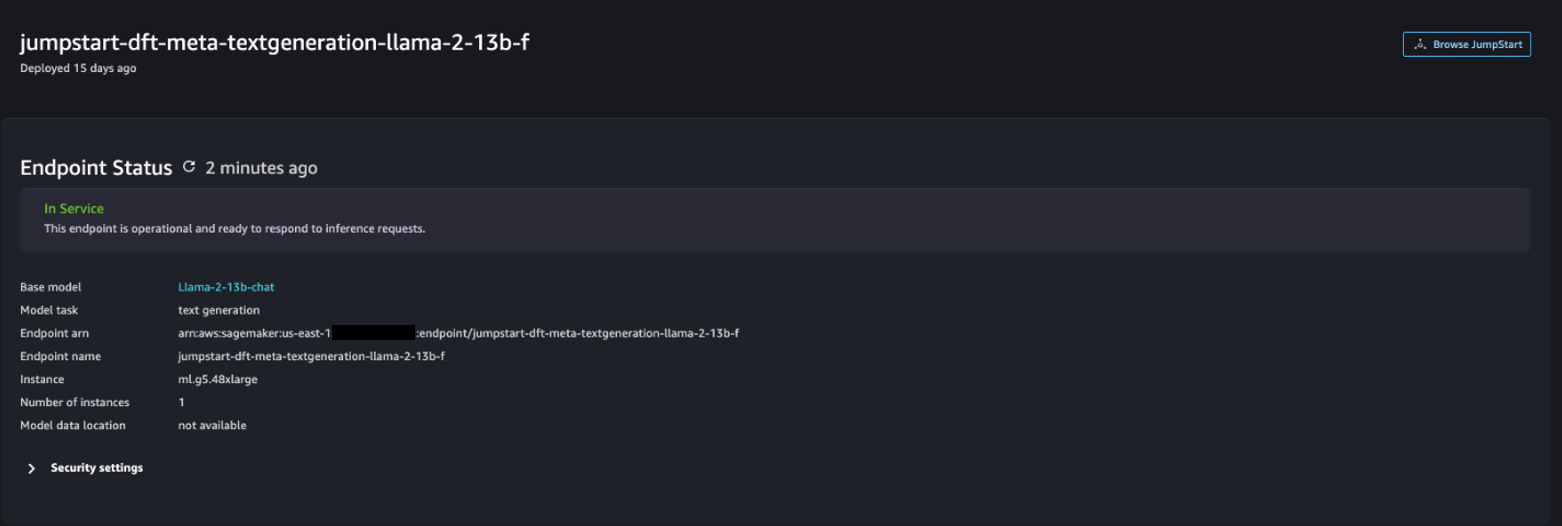

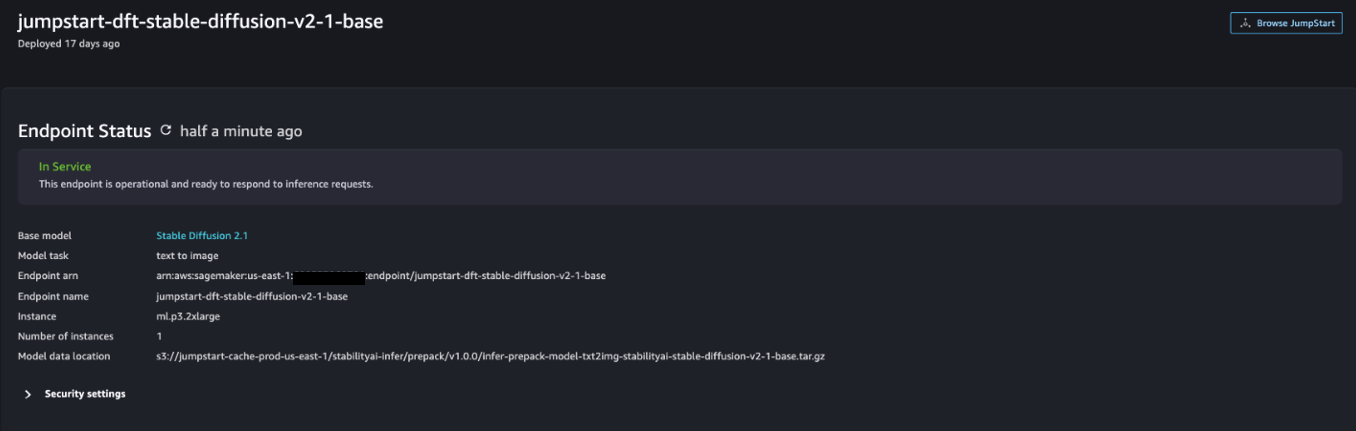

Dağıtım başarılı olduktan sonra, şunu görebilmeniz gerekir: In Service durumu.

- Üzerinde Modeller, defterler, çözümler sayfasında Kararlı Difüzyon 2.1'i arayın.

- Altında Dağıtım Yapılandırması, Için SageMaker barındırma örneği, seçmek ml.p3.2xlarge ve için Bitiş noktası adı, girmek

jumpstart-dft-stable-diffusion-v2-1-base. - Klinik Sürüş.

Dağıtım başarılı olduktan sonra, şunu görebilmeniz gerekir: In Service durumu.

AWS CloudFormation'ı kullanarak Lambda ve IAM izinlerini dağıtın

Bu bölümde, kullanıcı isteğinizi işleyen, dağıttığınız SageMaker uç noktasını çağıran ve gerekli tüm IAM izinlerini dağıtan bir Lambda işlevini dağıtan bir CloudFormation yığınını nasıl başlatabileceğiniz açıklanmaktadır. Aşağıdaki adımları tamamlayın:

- gidin GitHub deposu ve CloudFormation şablonunu indirin (

lambda.cfn.yaml) yerel makinenize. - CloudFormation konsolunda şunu seçin: Yığın oluştur açılır menüsünü seçin ve Yeni kaynaklarla (standart).

- Üzerinde Şablonu belirtin sayfa seç Bir şablon dosyası yükleyin ve Dosya seçin.

- Seçin

lambda.cfn.yamlindirdiğiniz dosyayı seçin ve ardından Sonraki. - Üzerinde Yığın ayrıntılarını belirtme sayfasında bir yığın adı ve önkoşullarda edindiğiniz API anahtarını girin, ardından Sonraki.

- Üzerinde Yığın seçeneklerini yapılandırma sayfasını seçin Sonraki.

- Değişiklikleri inceleyip onaylayın ve seçin Gönder.

Web kullanıcı arayüzünü ayarlama

Bu bölümde web kullanıcı arayüzünü (kullanılarak oluşturulan) çalıştırma adımları açıklanmaktadır. Bulut Tasarım Sistemi) yerel makinenizde:

- IAM konsolunda kullanıcıya gidin

functionUrl. - Üzerinde Güvenlik Kimlik Bilgileri sekmesini seçin Erişim anahtarı oluştur.

- Üzerinde Temel en iyi uygulamalara ve alternatiflere erişin sayfa seç Komut Satırı Arabirimi (CLI) Ve seç Sonraki.

- Üzerinde Açıklama etiketini ayarla sayfasını seçin Erişim anahtarı oluştur.

- Erişim anahtarını ve gizli erişim anahtarını kopyalayın.

- Klinik tamam.

- gidin GitHub deposu Ve indirmek için

react-llm-chat-studiokodu. - Klasörü tercih ettiğiniz IDE'de başlatın ve bir terminal açın.

- Şu yöne rotayı ayarla

src/configs/aws.jsonve elde ettiğiniz erişim anahtarını ve gizli erişim anahtarını girin. - Terminale aşağıdaki komutları girin:

- Açılış http://localhost:3000 tarayıcınızda ve modellerinizle etkileşime girmeye başlayın!

Chat Studio'yu kullanmak için açılır menüden temel bir model seçin ve sorgunuzu metin kutusuna girin. Yanıtla birlikte yapay zeka tarafından oluşturulan görselleri almak için sorgunuzun sonuna "resimli" ifadesini ekleyin.

Diğer SageMaker temel modellerini ekleyin

Bu çözümün kapasitesini ilave SageMaker temel modellerini içerecek şekilde daha da genişletebilirsiniz. Her model, SageMaker uç noktasını çağırırken farklı giriş ve çıkış formatları beklediğinden, modelle arayüz oluşturmak için callSageMakerEndpoints Lambda işlevine bazı dönüşüm kodları yazmanız gerekecektir.

Bu bölümde, seçtiğiniz ek modeli uygulamak için gereken genel adımlar ve kod değişiklikleri açıklanmaktadır. 6-8. Adımlar için temel Python dili bilgisinin gerekli olduğunu unutmayın.

- SageMaker Studio'da seçtiğiniz SageMaker temel modelini dağıtın.

- Klinik Adaçayı Yapıcı Hızlı Başlangıç ve JumpStart varlıklarını başlatın.

- Yeni dağıtılan model uç noktanızı seçin ve Not Defterini Aç.

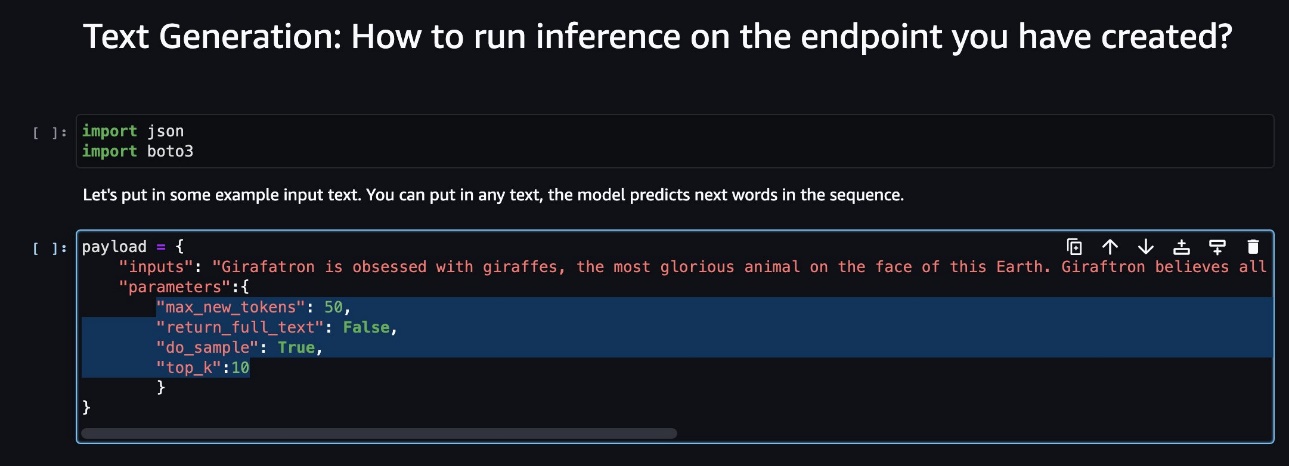

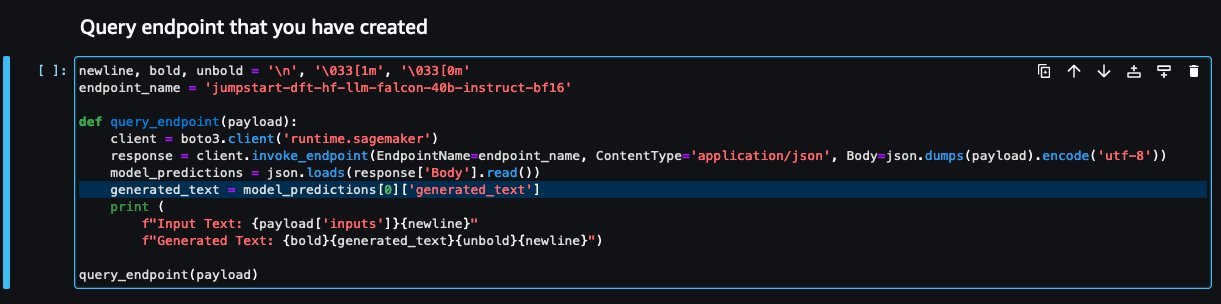

- Dizüstü bilgisayar konsolunda yük parametrelerini bulun.

Bunlar, yeni modelin SageMaker uç noktasını çağırırken beklediği alanlardır. Aşağıdaki ekran görüntüsü bir örneği göstermektedir.

- Lambda konsolunda şuraya gidin:

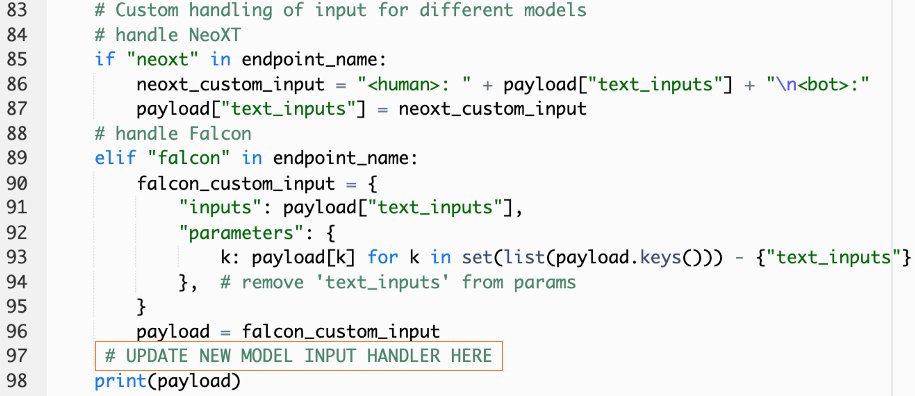

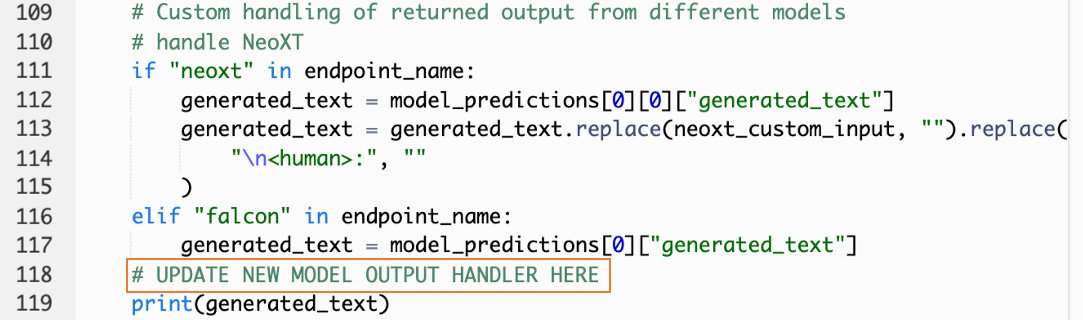

callSageMakerEndpoints. - Yeni modeliniz için özel bir giriş işleyicisi ekleyin.

Aşağıdaki ekran görüntüsünde Falcon 40B Instruct BF16 ve GPT NeoXT Chat Base 20B FP16 için girişi dönüştürdük. Kopyaladığınız yük parametrelerine referansla giriş dönüştürme mantığını eklemek için özel parametre mantığınızı belirtildiği gibi ekleyebilirsiniz.

- Dizüstü bilgisayar konsoluna dönün ve bulun

query_endpoint.

Bu işlev, son metin yanıtını çıkarmak için modellerin çıktısını nasıl dönüştüreceğiniz konusunda size bir fikir verir.

- İçindeki koda referansla

query_endpoint, yeni modeliniz için özel bir çıktı işleyicisi ekleyin.

- Klinik Dağıtın.

- IDE'nizi açın, başlatın

react-llm-chat-studiokodunu girin ve şuraya gidin:src/configs/models.json. - Model adınızı ve model uç noktanızı ekleyin ve 4. Adımdaki yük parametrelerini aşağıdaki alana girin.

payloadaşağıdaki biçimi kullanarak: - Yeni modelinizle etkileşime geçmek için tarayıcınızı yenileyin!

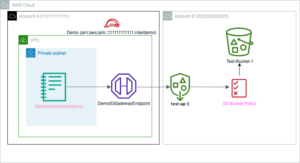

Uygulamayı Amplify kullanarak dağıtma

Amplify, uygulamanızı hızlı ve verimli bir şekilde dağıtmanıza olanak tanıyan eksiksiz bir çözümdür. Bu bölümde Chat Studio'yu bir sunucuya dağıtma adımları açıklanmaktadır. Amazon CloudFront Uygulamanızı diğer kullanıcılarla paylaşmak istiyorsanız Amplify'ı kullanarak dağıtım yapın.

- gidin

react-llm-chat-studioDaha önce oluşturduğunuz kod klasörü. - Terminale aşağıdaki komutları girin ve kurulum talimatlarını izleyin:

- Aşağıdaki komutu kullanarak yeni bir Amplify projesi başlatın. Bir proje adı girin, varsayılan yapılandırmaları kabul edin ve AWS erişim anahtarları Kimlik doğrulama yöntemini seçmeniz istendiğinde.

- Aşağıdaki komutu kullanarak Amplify projesini barındırın. Seçmek Amazon CloudFront ve S3 Eklenti modunu seçmeniz istendiğinde.

- Son olarak projeyi aşağıdaki komutla derleyin ve dağıtın:

- Dağıtım başarılı olduktan sonra tarayıcınızda sağlanan URL'yi açın ve modellerinizle etkileşim kurmaya başlayın!

Temizlemek

Gelecekte ücret alınmasını önlemek için aşağıdaki adımları tamamlayın:

- CloudFormation yığınını silin. Talimatlar için bkz. AWS CloudFormation konsolunda bir yığını silme.

- SageMaker JumpStart uç noktasını silin. Talimatlar için bkz. Uç Noktaları ve Kaynakları Sil.

- SageMaker alanını silin. Talimatlar için bkz. Bir Amazon SageMaker Etki Alanı Silme.

Sonuç

Bu yazıda, AWS'de dağıtılan LLM'lerle arayüz oluşturmak için bir web kullanıcı arayüzünün nasıl oluşturulacağını açıkladık.

Bu çözümle, LLM'nizle etkileşime girebilir ve LLM'yi test etmek veya soru sormak için kullanıcı dostu bir şekilde sohbet edebilir ve gerekirse resim ve videolardan oluşan bir kolaj alabilirsiniz.

Bu çözümü, ek temel modellerini entegre etmek gibi çeşitli yollarla genişletebilirsiniz. Amazon Kendra ile entegrasyon kurumsal içeriği anlamak ve daha fazlası için makine öğrenimi destekli akıllı aramayı etkinleştirmek için!

Sizi denemeye davet ediyoruz AWS'de önceden eğitilmiş farklı LLM'ler mevcutturveya SageMaker'da kendi LLM'lerinizi geliştirin ve hatta oluşturun. Sorularınızı ve bulgularınızı yorumlarda bize bildirin, iyi eğlenceler!

yazarlar hakkında

Jarrett Yeo Shan Wei ASEAN genelinde Kamu Sektörünü kapsayan AWS Profesyonel Hizmetler'de Yardımcı Bulut Mimarıdır ve müşterilerin modernleşmesine ve buluta geçiş yapmasına yardımcı olmanın savunucusudur. Beş AWS sertifikası aldı ve ayrıca 8. Uluslararası Yapay Zeka Konferansı'nda degrade artırıcı makine grupları hakkında bir araştırma makalesi yayınladı. Jarrett boş zamanlarında AWS'deki üretken yapay zeka sahnesine odaklanıyor ve katkıda bulunuyor.

Jarrett Yeo Shan Wei ASEAN genelinde Kamu Sektörünü kapsayan AWS Profesyonel Hizmetler'de Yardımcı Bulut Mimarıdır ve müşterilerin modernleşmesine ve buluta geçiş yapmasına yardımcı olmanın savunucusudur. Beş AWS sertifikası aldı ve ayrıca 8. Uluslararası Yapay Zeka Konferansı'nda degrade artırıcı makine grupları hakkında bir araştırma makalesi yayınladı. Jarrett boş zamanlarında AWS'deki üretken yapay zeka sahnesine odaklanıyor ve katkıda bulunuyor.

Tammy Lim Lee Xin AWS'de Yardımcı Bulut Mimarıdır. Müşterilerin bulutu benimseme yolculuklarında istedikleri sonuçları elde etmelerine yardımcı olmak için teknolojiyi kullanıyor ve AI/ML konusunda tutkulu. İş dışında seyahat etmeyi, yürüyüş yapmayı ve ailesi ve arkadaşlarıyla vakit geçirmeyi seviyor.

Tammy Lim Lee Xin AWS'de Yardımcı Bulut Mimarıdır. Müşterilerin bulutu benimseme yolculuklarında istedikleri sonuçları elde etmelerine yardımcı olmak için teknolojiyi kullanıyor ve AI/ML konusunda tutkulu. İş dışında seyahat etmeyi, yürüyüş yapmayı ve ailesi ve arkadaşlarıyla vakit geçirmeyi seviyor.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/create-a-web-ui-to-interact-with-llms-using-amazon-sagemaker-jumpstart/

- :vardır

- :dır-dir

- $UP

- 1

- 10

- 120

- 160

- 2021

- 3000

- 320

- 7

- 8

- 8th

- a

- Yapabilmek

- Hakkımızda

- Kabul et

- erişim

- onaylamak

- karşısında

- eklemek

- Ek

- Benimseme

- savunucu

- Sonra

- AI

- AI / ML

- Türkiye

- veriyor

- boyunca

- Ayrıca

- Amazon

- Amazon Adaçayı Yapıcı

- Amazon SageMaker Hızlı Başlangıç

- Amazon Web Servisleri

- yükseltmek

- an

- ve

- api

- Uygulama

- onaylı

- mimari

- ARE

- Sanat

- yapay

- yapay zeka

- AS

- ASEAN

- sormak

- Varlıklar

- Ortak

- At

- elde

- Doğrulama

- kullanılabilirliği

- mevcut

- önlemek

- AWS

- AWS CloudFormation

- AWS Profesyonel Hizmetleri

- bar

- baz

- merkezli

- temel

- BE

- Çünkü

- İYİ

- en iyi uygulamalar

- Daha iyi

- artırılması

- kutu

- geniş

- tarayıcı

- inşa etmek

- by

- çağrı

- aramalar

- CAN

- Alabilirsin

- yetenekleri

- kabiliyet

- Yakalanan

- durumlarda

- sertifikalar

- değişiklikler

- yükler

- chatbots

- ChatGPT

- seçim

- Klinik

- sınıflandırma

- yakından

- bulut

- bulut benimseme

- kod

- yorumlar

- tamamlamak

- Konferans

- yapılandırma

- bağ

- konsolos

- içerik

- katkıda bulunur

- konuşma

- konuşkan

- konuşma yapay zekası

- uyan

- kapak

- kaplama

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- Oluşturma

- meraklı

- görenek

- Müşteriler

- veri

- derin

- derin öğrenme

- Varsayılan

- teslim etmek

- bağlı

- dağıtmak

- konuşlandırılmış

- dağıtma

- açılma

- dağıtır

- tanım

- Dizayn

- İstediğiniz

- ayrıntılar

- geliştiriciler

- farklı

- Yayılma

- dijital

- dijital Sanat

- görüntülenen

- dağıtım

- domain

- indir

- Daha erken

- kolaylaştırmak

- verimli biçimde

- etkinleştirmek

- son

- Son nokta

- artırmak

- zenginleştirmek

- Keşfet

- kuruluş

- çevre

- Hatta

- Her

- örnek

- örnekler

- beklediğini

- pahalı

- deneyim

- deneme

- açıkladı

- uzatmak

- uzanır

- çıkarmak

- aile

- Özellikler(Hazırlık aşamasında)

- az

- Alanlar

- fileto

- son

- bulmak

- bulgular

- beş

- odaklanır

- takip et

- takip etme

- İçin

- biçim

- teşvik

- vakıf

- temel

- Ücretsiz

- arkadaşlar

- itibaren

- tamamen

- işlev

- daha fazla

- gelecek

- genel

- Genel veri

- üreten

- üretken

- üretken yapay zeka

- almak

- verir

- Goller

- Var

- he

- yardım et

- yardım

- onun

- ambar

- hosting

- SAAT

- Ne kadar

- Nasıl Yapılır

- HTML

- http

- HTTPS

- İnsanlar

- Yüzlerce

- Fikir

- Kimlik

- if

- görüntüleri

- hayal gücü

- uygulamak

- gelişmiş

- in

- dahil

- Artırmak

- belirtilen

- giriş

- kurmak

- yüklü

- yükleme

- örnek

- Enstitü

- talimatlar

- entegre

- entegrasyonlar

- İstihbarat

- Akıllı

- etkileşim

- etkileşim

- etkileşimleri

- arayüzey

- Uluslararası

- içine

- davetiye

- ONUN

- seyahat

- jpg

- sadece

- sadece bir

- anahtar

- Bilmek

- bilgi

- dil

- büyük

- başlatmak

- fırlatma

- öğrenme

- Rüzgâraltı

- izin

- sevmek

- çizgi

- lama

- Yüksek Lisans

- yerel

- mantık

- Bakın

- gibi görünmek

- seviyor

- makine

- makine öğrenme

- yönetilen

- tavır

- Mayıs..

- demek

- medya

- Neden

- Menü

- yöntem

- göç

- ML

- Moda

- model

- modelleri

- modernleştirmek

- Daha

- çoklu

- şart

- isim

- Gezin

- Navigasyon

- gerekli

- gerek

- ağ

- sinir

- sinir ağı

- yeni

- Yeni ürünler

- yeni

- düğüm

- node.js

- notlar

- defter

- elde

- of

- on

- ONE

- açık

- açık kaynak

- Opsiyonlar

- or

- Diğer

- sonuçlar

- çıktı

- dışında

- genel bakış

- kendi

- Kanal

- bölmesi

- kâğıt

- parametre

- parametreler

- tutkulu

- izinleri

- Platon

- Plato Veri Zekası

- PlatoVeri

- fişe takmak

- Popüler

- popülerlik

- Çivi

- powered

- uygulamalar

- tercihli

- önkoşullar

- ayrıcalıklar

- Süreçler

- Ürünler

- profesyonel

- proje

- özel

- sağlamak

- sağlanan

- sağlayıcılar

- sağlar

- halka açık

- yayınlanan

- Python

- Sorular

- Hızlı

- hızla

- yükseltmek

- menzil

- gerçek

- başvurmak

- referans

- uygun

- talep

- isteklerinizi

- gereklidir

- araştırma

- benzer,

- Kaynaklar

- yanıt

- dönüş

- Yükselmek

- koşmak

- sagemaker

- memnuniyet

- sahne

- çizik

- ekran

- Ara

- Gizli

- Bölüm

- sektör

- görmek

- seçmek

- duyu

- hizmet vermek

- hizmet

- Hizmetler

- set

- Setleri

- kurulum

- paylaş

- o

- meli

- şov

- Gösteriler

- pasajı

- çözüm

- biraz

- Kaynak

- Harcama

- kararlı

- yığın

- standart

- stanford

- başlama

- başladı

- Durum

- adım

- Basamaklar

- hafızası

- stüdyo

- böyle

- yeterli

- Bizi daha iyi tanımak için

- alır

- Teknoloji

- şablon

- terminal

- test

- metin

- Metin Sınıflandırması

- o

- The

- ve bazı Asya

- sonra

- Bunlar

- onlar

- üçüncü şahıslara ait

- Re-Tweet

- gerçi?

- İçinden

- zaman

- için

- üst

- Tren

- eğitilmiş

- Eğitim

- Dönüştürmek

- Dönüşüm

- transforme

- tip

- ui

- altında

- anlayış

- URL

- us

- kullanım

- kullanım

- kullanıcı

- Kullanıcı Deneyimi

- Kullanıcı Arayüzü

- kullanıcı dostu

- kullanıcılar

- kullanım

- kullanma

- değer

- çeşitli

- Videolar

- yürümek

- yürüyüşleri

- yolları

- we

- ağ

- web hizmetleri

- Ne

- ne zaman

- hangi

- DSÖ

- geniş

- Geniş ürün yelpazesi

- irade

- dilek

- ile

- İş

- iş akışı

- yazmak

- Yeo

- Sen

- zefirnet