ЧОРНИЙ КАПЕЛЮХ США – Лас-Вегас – п’ятниця, 11 серпня – Штучний інтелект (ШІ) не є новачком у світі технологій, але оскільки ChatGPT і подібні пропозиції виводять його за межі лабораторних середовищ і випадків використання, таких як Siri, Марія «Азерія» Маркстедтер, засновник і генеральний директор Azeria Labs, сказала, що спеціалісти з безпеки повинні бути напоготові щодо того, як його еволюція вплине на їхні щоденні реалії.

Жартома вона стверджувала, що штучний інтелект «тепер у надійних руках великих технологічних компаній, які змагаються з часом, щоб захиститися від ліквідації», після OpenAI випускає свою модель ChatGPT тоді як інші компанії стрималися. «З зростання ChatGPT, підхід Google у мирний час закінчився, і всі підхопилися», — сказала вона, виступаючи цього тижня з основної сцени Black Hat USA.

Дивіться, куди йдуть гроші

Компанії інвестують мільйони доларів у штучний інтелект, але щоразу, коли світ переходить до нового типу технологій, «корпоративні перегони озброєнь не викликаються турботою про безпеку чи безпеку, оскільки безпека сповільнює прогрес».

Вона сказала про випадки використання інтегрувати ШІ розвиваються, і починають заробляти великі гроші, особливо ті, хто домінує на ринку. Однак існує потреба в «творці, щоб зламати його, і виправити це, і врешті-решт запобігти тому, щоб технологія в її майбутніх сценаріях використання вибухнула прямо перед нами».

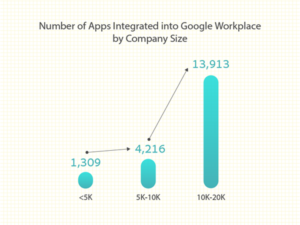

Вона додала, що компанії, можливо, відчувають дещо нераціональне надлишок. «Кожна компанія зараз хоче стати зразком бізнес-машини ШІ, і те, як наші компанії збираються використовувати ці інструменти для інтеграції ШІ, матиме значний вплив на нашу модель загроз», — сказала вона. Однак швидке впровадження ШІ означає, що його вплив на всю модель кіберзагроз залишається невідомим.

Зростання загроз ChatGPT

Визнаючи це ChatGPT було «досить важко уникнути протягом останніх дев’яти місяців», Маркстедтер сказав, що стрімке зростання кількості користувачів призвело до того, що деякі компанії обмежили доступ до нього. За її словами, підприємства були налаштовані скептично, оскільки OpenAI — це чорна скринька, і все, що ви надсилаєте в ChatGPT, буде частиною набору даних OpenAI.

Вона сказала: «Компанії не хочуть передавати свої конфіденційні дані зовнішньому постачальнику, тому вони почали заборона співробітникам від використання ChatGPT для роботи, але кожна компанія все ще хоче і навіть змушена розширювати свої продукти та послуги для персоналу за допомогою ШІ; вони просто не довіряють конфіденційні дані … зовнішнім постачальникам, які можуть стати частиною набору даних».

Однак інтенсивна зосередженість і швидкі темпи розробки та інтеграції OpenAI змусять практиків безпеки швидко розвиватися.

«Тож те, як наші організації збираються використовувати ці речі, змінюється досить швидко: від того, що ви перевіряєте для веб-переглядача, до того, що компанії інтегрують у свою власну інфраструктуру, до чогось, що незабаром стане рідним для нашої операційної системи та мобільного пристрою. ," вона сказала.

Можливість для промисловості

Маркстедтер сказав, що найбільша проблема для штучного інтелекту та кібербезпеки полягає в тому, що у нас недостатньо людей із навички та знання оцінити ці системи та створити необхідні нам огорожі. «Тож із цих маленьких викликів уже з’являються нові види роботи», — сказала вона.

На завершення Маркстедтер виділив чотири висновки: по-перше, системи штучного інтелекту, варіанти їх використання та можливості розвиваються; по-друге, нам потрібно серйозно поставитися до можливості того, що автономні агенти ШІ стануть реальністю на нашому підприємстві; по-третє, нам потрібно переглянути наші концепції щодо ідентичності та програм; і по-четверте, нам потрібно переглянути наші концепції безпеки даних.

«Тож нам потрібно дізнатися про саму технологію, яка змінює наші системи та нашу модель загроз, щоб вирішити ці нові проблеми, і технологічні зміни для нас не є чимось новим», – сказала вона. «У нас немає посібників, щоб розповісти нам, як вирішити наші попередні проблеми. Ми всі так чи інакше самоучки, і зараз наша галузь приваблює творчі уми з цілим мисленням. Тож ми знаємо, як вивчати нові системи та знаходити творчі способи їх зламати».

На завершення вона сказала, що це наш шанс переосмислити себе, свою позицію безпеки та захист. «Для наступної небезпеки викликів безпеці нам потрібно об’єднатися як спільнота та сприяти дослідженню в цих сферах», – сказала вона.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. Автомобільні / електромобілі, вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- ChartPrime. Розвивайте свою торгову гру за допомогою ChartPrime. Доступ тут.

- BlockOffsets. Модернізація екологічної компенсаційної власності. Доступ тут.

- джерело: https://www.darkreading.com/threat-intelligence/security-pressure-mounts-ai-promises-peril

- :є

- : ні

- :де

- $UP

- 7

- a

- МЕНЮ

- доступ

- доданий

- адреса

- Прийняття

- впливати

- проти

- агенти

- AI

- Системи ШІ

- Оповіщення

- ВСІ

- вже

- an

- та

- Інший

- все

- підхід

- додатка

- ЕСТЬ

- області

- зброю

- навколо

- AS

- оцінити

- At

- Приваблює

- серпня

- автономний

- назад

- BE

- становлення

- Великий

- найбільший

- Біт

- Black

- Black Hat

- підривати

- Box

- Перерва

- браузер

- бізнес

- підприємства

- але

- by

- CAN

- випадків

- Генеральний директор

- проблеми

- шанс

- Зміни

- заміна

- ChatGPT

- перевірка

- стверджував,

- Приходити

- співтовариство

- Компанії

- конкурувати

- поняття

- Занепокоєння

- уклали

- Корпоративний

- створювати

- Креатив

- Кібербезпека

- щодня

- НЕБЕЗПЕЧНО

- дані

- безпеку даних

- набір даних

- розробка

- пристрій

- доларів

- Домінувати

- Дон

- вниз

- керований

- ефект

- з'являються

- досить

- підприємство

- підприємств

- Весь

- середовищах

- бігти

- особливо

- Навіть

- Кожен

- все

- еволюція

- еволюціонувати

- еволюціонує

- зазнають

- зовнішній

- особи

- ШВИДКО

- знайти

- Перший

- виправляти

- Сфокусувати

- для

- Примусово

- Сприяти

- засновник

- Засновник і генеральний директор

- чотири

- Четвертий

- п'ятниця

- від

- фінансування

- буде

- Руки

- Жорсткий

- hat

- Мати

- Герой

- Виділено

- Як

- How To

- Однак

- HTTPS

- Особистість

- Impact

- in

- Augmenter

- промисловість

- Інфраструктура

- інтегрувати

- інтеграція

- Інтелект

- в

- інвестування

- IT

- ЙОГО

- робота

- JPG

- Стрибнув

- просто

- Лейтмотив

- Знати

- lab

- Labs

- ЛАГ

- Лас-Вегас

- останній

- витік

- УЧИТЬСЯ

- Led

- Важіль

- як

- трохи

- серія

- машина

- зробити

- Марія

- ринок

- Може..

- засоби

- мільйони

- умів

- Розум

- Mobile

- мобільний пристрій

- модель

- гроші

- місяців

- МОНТАЖ

- рідний

- Необхідність

- Нові

- новачок

- наступний

- немає

- зараз

- of

- Пропозиції

- on

- ONE

- OpenAI

- операційний

- операційна система

- Можливість

- or

- порядок

- організації

- Інше

- наші

- себе

- з

- над

- власний

- алюр

- частина

- світ

- Люди

- plato

- Інформація про дані Платона

- PlatoData

- можливість

- тиск

- досить

- запобігати

- попередній

- Проблема

- проблеми

- Продукти

- прогрес

- обіцяє

- Постачальник

- провайдери

- Штовхати

- швидко

- racing

- швидко

- Реальність

- випуску

- залишається

- дослідження

- право

- Зростання

- s

- сейф

- Безпека

- Зазначений

- приказка

- другий

- безпеку

- чутливий

- серйозно

- Послуги

- комплект

- вона

- Зміни

- значний

- аналогічний

- скептичний

- сповільнюється

- So

- деякі

- що в сім'ї щось

- скоро

- розмова

- Стажування

- почалася

- Починаючи

- Як і раніше

- Вивчення

- система

- Systems

- Приймати

- Takeaways

- технології

- технологічний

- Технологія

- технологічні компанії

- сказати

- Що

- Команда

- світ

- їх

- Їх

- Там.

- Ці

- вони

- речі

- третій

- це

- На цьому тижні

- ті

- загроза

- час

- до

- разом

- інструменти

- до

- Довіряйте

- тип

- Зрештою

- невідомий

- Майбутні

- us

- USA

- використання

- користувачі

- використання

- VEGAS

- дуже

- послуга

- хотіти

- хоче

- було

- шлях..

- способи

- we

- week

- були

- коли б ні

- в той час як

- ВООЗ

- волі

- з

- в

- Work

- Трудові ресурси

- світ

- Ти

- зефірнет