آج، ہمیں یہ اعلان کرتے ہوئے خوشی ہو رہی ہے کہ OpenAI Whisper فاؤنڈیشن ماڈل استعمال کرنے والے صارفین کے لیے دستیاب ہے۔ ایمیزون سیج میکر جمپ اسٹارٹ. Whisper خودکار اسپیچ ریکگنیشن (ASR) اور اسپیچ ٹرانسلیشن کے لیے پہلے سے تربیت یافتہ ماڈل ہے۔ 680 ہزار گھنٹے کے لیبل لگائے گئے ڈیٹا پر تربیت یافتہ، Whisper ماڈلز بہت سارے ڈیٹا سیٹس اور ڈومینز کو فائن ٹیوننگ کی ضرورت کے بغیر عام کرنے کی مضبوط صلاحیت کا مظاہرہ کرتے ہیں۔ Sagemaker JumpStart SageMaker کا مشین لرننگ (ML) مرکز ہے جو ML کے ساتھ جلدی شروع کرنے میں آپ کی مدد کرنے کے لیے بلٹ ان الگورتھم اور اینڈ ٹو اینڈ سلوشن ٹیمپلیٹس کے علاوہ فاؤنڈیشن ماڈلز تک رسائی فراہم کرتا ہے۔

آپ ASR کا استعمال بھی کر سکتے ہیں۔ ایمیزون نقل ,ایک مکمل طور پر منظم اور مسلسل تربیت یافتہ خودکار اسپیچ ریکگنیشن سروس۔

اس پوسٹ میں، ہم آپ کو دکھاتے ہیں کہ کس طرح تعینات کیا جائے۔ اوپن اے آئی سرگوشی ماڈل اور آڈیو کو نقل کرنے اور ترجمہ کرنے کے لیے ماڈل کو طلب کریں۔

OpenAI Whisper ماڈل استعمال کرتا ہے۔ گلے لگنے والا چہرہ کنٹینر SageMaker JumpStart ماڈل ہب کسٹمر کے طور پر، آپ SageMaker SDK سے باہر ماڈل اسکرپٹ کو برقرار رکھے بغیر ASR استعمال کر سکتے ہیں۔ سیج میکر جمپ سٹارٹ ماڈلز ان اینڈ پوائنٹس کے ساتھ حفاظتی کرنسی کو بھی بہتر بناتے ہیں جو نیٹ ورک آئسولیشن کو فعال کرتے ہیں۔

سیج میکر میں فاؤنڈیشن ماڈل

سیج میکر جمپ سٹارٹ مقبول ماڈل ہبز سے ماڈلز کی ایک رینج تک رسائی فراہم کرتا ہے جس میں Hugging Face، PyTorch Hub، اور TensorFlow Hub شامل ہیں، جسے آپ SageMaker میں اپنے ML ترقیاتی ورک فلو کے اندر استعمال کر سکتے ہیں۔ ایم ایل میں حالیہ پیشرفت نے ماڈلز کی ایک نئی کلاس کو جنم دیا ہے جس کے نام سے جانا جاتا ہے۔ بنیاد ماڈل، جو عام طور پر اربوں پیرامیٹرز پر تربیت یافتہ ہیں اور استعمال کے معاملات کے وسیع زمرے میں ڈھال سکتے ہیں، جیسے متن کا خلاصہ، ڈیجیٹل آرٹ تیار کرنا، اور زبان کا ترجمہ۔ چونکہ یہ ماڈلز کو تربیت دینا مہنگا ہے، اس لیے صارفین ان ماڈلز کو خود تربیت دینے کے بجائے موجودہ پہلے سے تربیت یافتہ فاؤنڈیشن ماڈلز کو استعمال کرنا چاہتے ہیں اور ضرورت کے مطابق ان کو ٹھیک کرنا چاہتے ہیں۔ سیج میکر ان ماڈلز کی کیوریٹڈ فہرست فراہم کرتا ہے جن میں سے آپ سیج میکر کنسول پر انتخاب کر سکتے ہیں۔

اب آپ SageMaker JumpStart کے اندر مختلف ماڈل فراہم کنندگان سے فاؤنڈیشن ماڈلز تلاش کر سکتے ہیں، جس سے آپ فاؤنڈیشن ماڈلز کے ساتھ تیزی سے شروعات کر سکتے ہیں۔ SageMaker JumpStart مختلف کاموں یا ماڈل فراہم کنندگان کی بنیاد پر فاؤنڈیشن ماڈل پیش کرتا ہے، اور آپ آسانی سے ماڈل کی خصوصیات اور استعمال کی شرائط کا جائزہ لے سکتے ہیں۔ آپ ان ماڈلز کو ٹیسٹ UI ویجیٹ استعمال کرکے بھی آزما سکتے ہیں۔ جب آپ پیمانے پر فاؤنڈیشن ماڈل استعمال کرنا چاہتے ہیں، تو آپ SageMaker کو چھوڑے بغیر ماڈل فراہم کنندگان کی طرف سے پہلے سے بنی ہوئی نوٹ بکس کا استعمال کر کے ایسا کر سکتے ہیں۔ چونکہ ماڈلز AWS پر ہوسٹ اور تعینات کیے گئے ہیں، آپ کو یقین ہے کہ آپ کا ڈیٹا، چاہے ماڈل کو جانچنے یا استعمال کرنے کے لیے استعمال کیا جائے، فریقین ثالث کے ساتھ اشتراک نہیں کیا جائے گا۔

اوپن اے آئی وسپر فاؤنڈیشن ماڈل

وسپر ASR اور تقریری ترجمے کے لیے پہلے سے تربیت یافتہ ماڈل ہے۔ کاغذ میں سرگوشی تجویز کی گئی تھی۔ بڑے پیمانے پر کمزور نگرانی کے ذریعے مضبوط تقریر کی شناخت اوپن اے آئی کی طرف سے ایلک ریڈفورڈ، اور دیگر۔ اصل کوڈ مل سکتا ہے۔ اس GitHub ذخیرے میں.

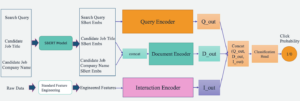

وسپر ایک ٹرانسفارمر پر مبنی انکوڈر-ڈیکوڈر ماڈل ہے، جسے a بھی کہا جاتا ہے۔ ترتیب سے ترتیب ماڈل اسے بڑے پیمانے پر کمزور نگرانی کا استعمال کرتے ہوئے 680 ہزار گھنٹے کے لیبل والے اسپیچ ڈیٹا پر تربیت دی گئی۔ وسپر ماڈلز بہت سارے ڈیٹاسیٹس اور ڈومینز کو ٹھیک ٹیوننگ کی ضرورت کے بغیر عام کرنے کی مضبوط صلاحیت کا مظاہرہ کرتے ہیں۔

ماڈلز کو یا تو صرف انگریزی ڈیٹا یا کثیر لسانی ڈیٹا پر تربیت دی گئی تھی۔ صرف انگریزی ماڈلز کو تقریر کی شناخت کے کام پر تربیت دی گئی۔ کثیر لسانی ماڈلز کو اسپیچ ریکگنیشن اور اسپیچ ٹرانسلیشن پر تربیت دی گئی۔ تقریر کی شناخت کے لیے، ماڈل میں نقل کی پیش گوئی کرتا ہے۔ اسی آڈیو کے طور پر زبان. تقریری ترجمے کے لیے، ماڈل a میں نقل کی پیش گوئی کرتا ہے۔ مختلف آڈیو کی زبان۔

وسپر چیک پوائنٹس مختلف ماڈل سائز کی پانچ کنفیگریشنز میں آتے ہیں۔ سب سے چھوٹے چار کو یا تو صرف انگریزی یا کثیر لسانی ڈیٹا پر تربیت دی جاتی ہے۔ سب سے بڑی چوکیاں صرف کثیر لسانی ہیں۔ تمام دس پہلے سے تربیت یافتہ چوکیاں پر دستیاب ہیں۔ گلے ملنا چہرے کا مرکز. چیک پوائنٹس کا خلاصہ درج ذیل جدول میں حب پر موجود ماڈلز کے لنکس کے ساتھ کیا گیا ہے۔

| ماڈل کا نام | پیرامیٹرز کی تعداد | بہزبانی |

| سرگوشی | 39 ایم | جی ہاں |

| سرگوشی کی بنیاد | 74 ایم | جی ہاں |

| سرگوشی - چھوٹا | 244 ایم | جی ہاں |

| وسوسہ | 769 ایم | جی ہاں |

| سرگوشی بڑی | 1550 ایم | جی ہاں |

| whisper-large-v2 | 1550 ایم | جی ہاں |

آئیے دریافت کریں کہ آپ SageMaker JumpStart میں Whisper ماڈلز کو کس طرح استعمال کر سکتے ہیں۔

OpenAI Whisper فاؤنڈیشن ماڈل WER اور لیٹنسی کا موازنہ

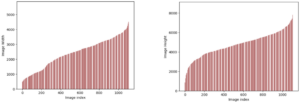

مختلف OpenAI Whisper ماڈلز کے لیے لفظ ایرر ریٹ (WER) کی بنیاد پر LibriSpeech ٹیسٹ صاف مندرجہ ذیل جدول میں دکھایا گیا ہے۔ اسپیچ ریکگنیشن یا مشین ٹرانسلیشن سسٹم کی کارکردگی کے لیے WER ایک عام میٹرک ہے۔ یہ حوالہ متن (زمین کی سچائی یا صحیح نقل) اور ASR سسٹم کے آؤٹ پٹ کے درمیان غلطیوں کی تعداد کے لحاظ سے فرق کی پیمائش کرتا ہے، بشمول متبادلات، اندراجات، اور حذف کرنا جو ASR آؤٹ پٹ کو حوالہ میں تبدیل کرنے کے لیے درکار ہیں۔ متن یہ نمبرز سے لیے گئے ہیں۔ گلے لگانے والا چہرہ ویب سائٹ.

| ماڈل | WER (فیصد) |

| سرگوشی | 7.54 |

| سرگوشی کی بنیاد | 5.08 |

| سرگوشی - چھوٹا | 3.43 |

| وسوسہ | 2.9 |

| سرگوشی بڑی | 3 |

| whisper-large-v2 | 3 |

اس بلاگ کے لیے، ہم نے نیچے دی گئی آڈیو فائل لی اور مختلف سرگوشی کے ماڈلز میں تقریر کی شناخت کی تاخیر کا موازنہ کیا۔ لیٹنسی اس لمحے کی مقدار ہے جب صارف درخواست بھیجتا ہے اس وقت تک جب تک کہ آپ کی درخواست یہ بتاتی ہے کہ درخواست مکمل ہو گئی ہے۔ مندرجہ ذیل جدول میں موجود اعداد ml.g100xlarge مثال پر ہوسٹ کردہ ماڈل کے ساتھ ایک ہی آڈیو فائل کا استعمال کرتے ہوئے کل 5.2 درخواستوں کے لیے اوسط تاخیر کی نمائندگی کرتے ہیں۔

| ماڈل | اوسط تاخیر | ماڈل آؤٹ پٹ |

| سرگوشی | 0.43 | ہم مشین کی روشنی کے ساتھ بہت پرجوش وقت میں رہ رہے ہیں۔ ایم ایل ماڈل کی ترقی کی رفتار واقعی میں بڑھے گی۔ لیکن آپ اس آخری حالت تک نہیں پہنچ پائیں گے جو ہم اگلے آنے والے سالوں میں جیت گئے تھے۔ جب تک کہ ہم ان ماڈلز کو ہر ایک کے لیے زیادہ قابل رسائی نہ بنائیں۔ |

| سرگوشی کی بنیاد | 0.49 | ہم مشین لرننگ کے ساتھ بہت پرجوش دور میں جی رہے ہیں۔ ایم ایل ماڈل کی ترقی کی رفتار واقعی میں بڑھے گی۔ لیکن آپ اس آخری حالت تک نہیں پہنچ پائیں گے جو ہم اگلے آنے والے سالوں میں جیت گئے تھے۔ جب تک کہ ہم ان ماڈلز کو ہر ایک کے لیے زیادہ قابل رسائی نہ بنائیں۔ |

| سرگوشی - چھوٹا | 0.84 | ہم مشین لرننگ کے ساتھ بہت پرجوش دور میں جی رہے ہیں۔ ایم ایل ماڈل کی ترقی کی رفتار واقعی میں بڑھے گی۔ لیکن آپ اس آخری حالت تک نہیں پہنچ پائیں گے جو ہم اگلے آنے والے سالوں میں چاہتے ہیں جب تک کہ ہم ان ماڈلز کو ہر ایک کے لیے زیادہ قابل رسائی نہ بنائیں۔ |

| وسوسہ | 1.5 | ہم مشین لرننگ کے ساتھ بہت پرجوش دور میں جی رہے ہیں۔ ایم ایل ماڈل کی ترقی کی رفتار واقعی میں بڑھے گی۔ لیکن آپ اس آخری حالت تک نہیں پہنچ پائیں گے جو ہم اگلے آنے والے سالوں میں چاہتے ہیں جب تک کہ ہم ان ماڈلز کو ہر ایک کے لیے زیادہ قابل رسائی نہ بنائیں۔ |

| سرگوشی بڑی | 1.96 | ہم مشین لرننگ کے ساتھ بہت پرجوش دور میں جی رہے ہیں۔ ایم ایل ماڈل کی ترقی کی رفتار واقعی میں بڑھے گی۔ لیکن آپ اس آخری حالت تک نہیں پہنچ پائیں گے جو ہم اگلے آنے والے سالوں میں چاہتے ہیں جب تک کہ ہم ان ماڈلز کو ہر ایک کے لیے زیادہ قابل رسائی نہ بنائیں۔ |

| whisper-large-v2 | 1.98 | ہم مشین لرننگ کے ساتھ بہت پرجوش دور میں جی رہے ہیں۔ ایم ایل ماڈل کی ترقی کی رفتار واقعی میں بڑھے گی۔ لیکن آپ اس آخری حالت تک نہیں پہنچ پائیں گے جو ہم اگلے آنے والے سالوں میں چاہتے ہیں جب تک کہ ہم ان ماڈلز کو ہر ایک کے لیے زیادہ قابل رسائی نہ بنائیں۔ |

حل واک تھرو

آپ ایمیزون سیج میکر کنسول کا استعمال کرتے ہوئے یا ایمیزون سیج میکر نوٹ بک کا استعمال کرتے ہوئے وسپر ماڈل تعینات کرسکتے ہیں۔ اس پوسٹ میں، ہم یہ ظاہر کرتے ہیں کہ کس طرح SageMaker اسٹوڈیو کنسول یا SageMaker نوٹ بک کا استعمال کرتے ہوئے Whisper API کو تعینات کیا جائے اور پھر اسپیچ ریکگنیشن اور زبان کے ترجمے کے لیے تعینات ماڈل کا استعمال کریں۔ اس پوسٹ میں استعمال شدہ کوڈ میں پایا جا سکتا ہے۔ یہ GitHub نوٹ بک.

آئیے ہر قدم کو تفصیل سے بڑھاتے ہیں۔

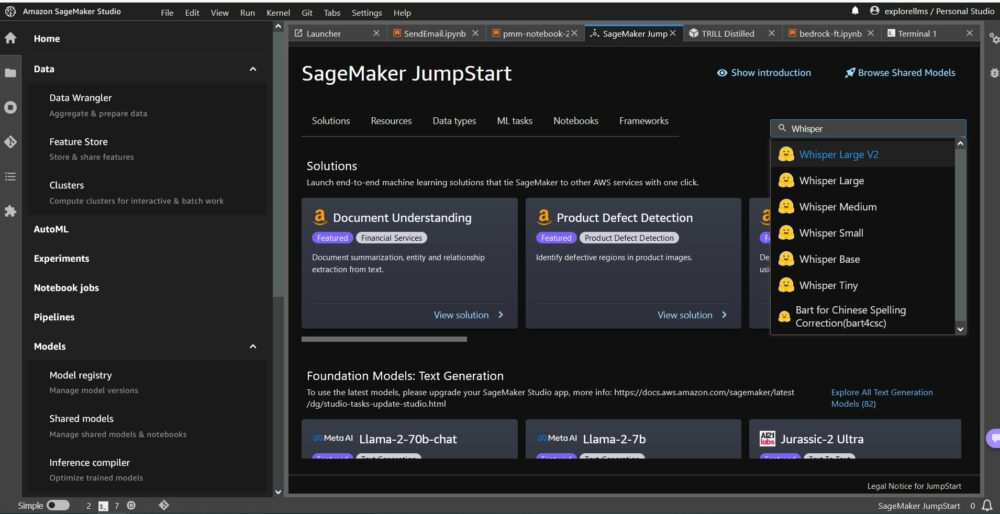

کنسول سے وسپر تعینات کریں۔

- سیج میکر جمپ اسٹارٹ کے ساتھ شروع کرنے کے لیے، ایمیزون سیج میکر اسٹوڈیو کنسول کھولیں اور سیج میکر جمپ اسٹارٹ کے لانچ پیج پر جائیں اور منتخب کریں۔ جمپ اسٹارٹ کے ساتھ شروع کریں۔.

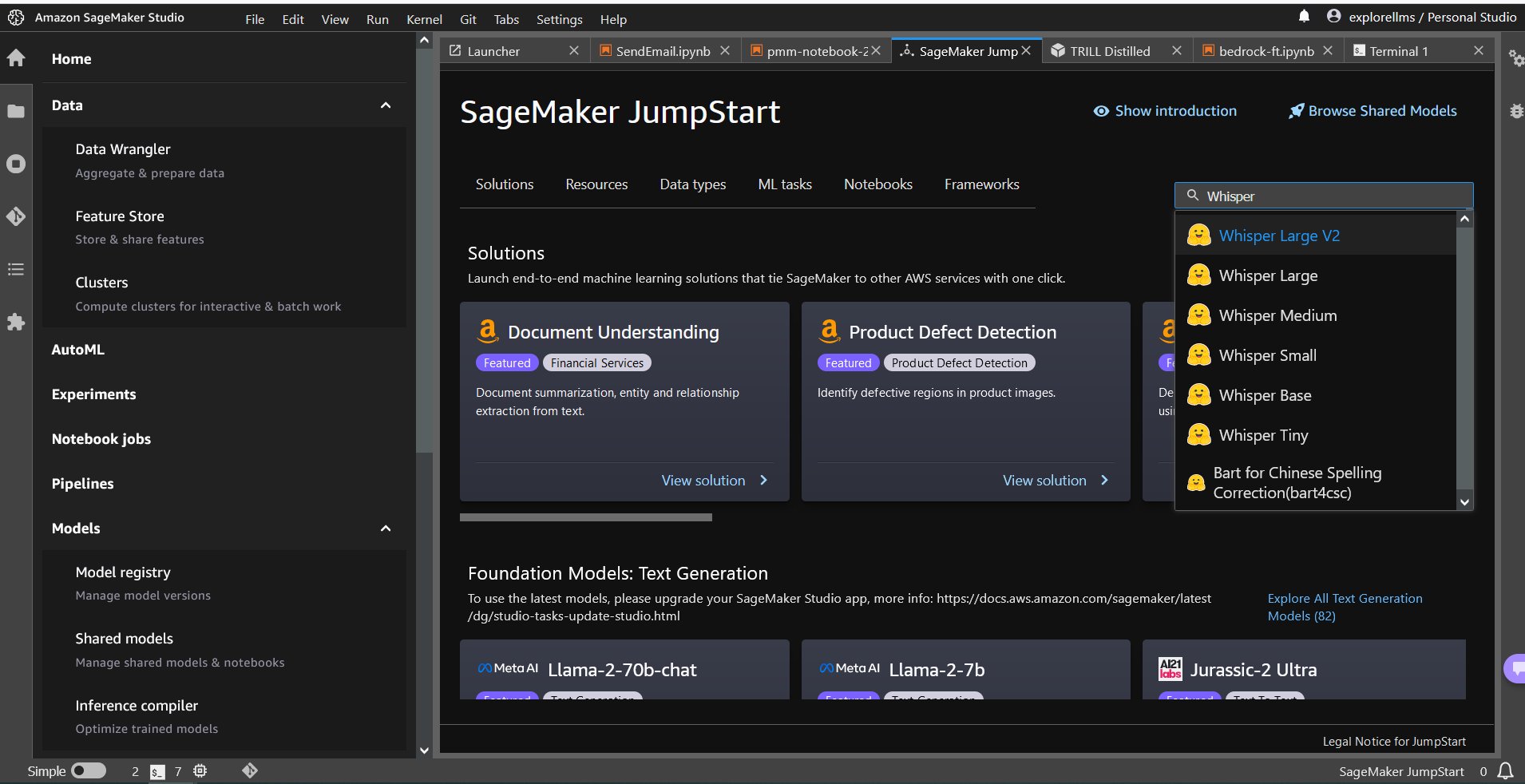

- Whisper ماڈل کو منتخب کرنے کے لیے، آپ یا تو اوپر والے ٹیبز کو استعمال کر سکتے ہیں یا اوپر دائیں طرف سرچ باکس استعمال کر سکتے ہیں جیسا کہ درج ذیل اسکرین شاٹ میں دکھایا گیا ہے۔ اس مثال کے لیے، اوپر دائیں جانب سرچ باکس کا استعمال کریں اور درج کریں۔

Whisper، اور پھر ڈراپ ڈاؤن مینو سے مناسب وسپر ماڈل منتخب کریں۔

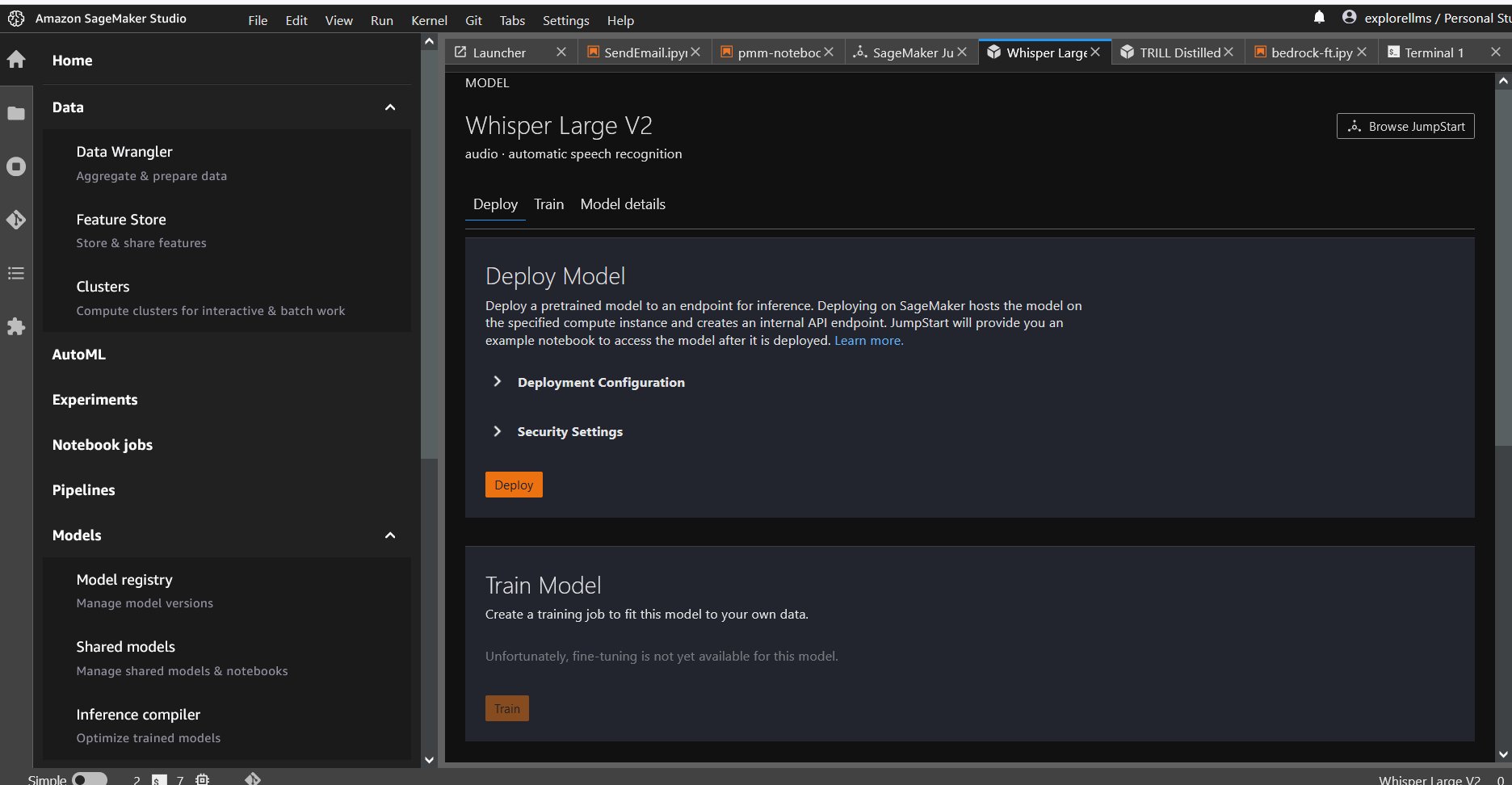

- وسپر ماڈل کو منتخب کرنے کے بعد، آپ ماڈل کو تعینات کرنے کے لیے کنسول استعمال کر سکتے ہیں۔ آپ تعیناتی کے لیے ایک مثال منتخب کر سکتے ہیں یا ڈیفالٹ استعمال کر سکتے ہیں۔

سیج میکر نوٹ بک سے فاؤنڈیشن ماڈل لگائیں۔

مختلف کاموں کو حل کرنے کے لیے پہلے تعینات کرنے اور پھر تعینات کردہ ماڈل کو استعمال کرنے کے اقدامات یہ ہیں:

- قائم

- ایک ماڈل منتخب کریں۔

- نمونے بازیافت کریں اور ایک اختتامی نقطہ تعینات کریں۔

- ASR کے لیے تعینات ماڈل استعمال کریں۔

- زبان کے ترجمے کے لیے تعینات ماڈل استعمال کریں۔

- اختتامی نقطہ کو صاف کریں۔

قائم

اس نوٹ بک کا تجربہ سیج میکر اسٹوڈیو میں ایک ml.t3.medium مثال پر Python 3 (ڈیٹا سائنس) کرنل کے ساتھ کیا گیا تھا اور Amazon SageMaker نوٹ بک مثال میں conda_python3 دانا

پہلے سے تربیت یافتہ ماڈل منتخب کریں۔

Boto3 کا استعمال کرتے ہوئے سیج میکر سیشن ترتیب دیں، اور پھر وہ ماڈل ID منتخب کریں جسے آپ تعینات کرنا چاہتے ہیں۔

نمونے بازیافت کریں اور ایک اختتامی نقطہ تعینات کریں۔

SageMaker کا استعمال کرتے ہوئے، آپ پہلے سے تربیت یافتہ ماڈل کا اندازہ لگا سکتے ہیں، یہاں تک کہ اسے کسی نئے ڈیٹاسیٹ پر پہلے ٹھیک بنائے بغیر۔ پہلے سے تربیت یافتہ ماڈل کی میزبانی کرنے کے لیے، کی ایک مثال بنائیں sagemaker.model.Model اور اسے تعینات کریں. درج ذیل کوڈ ڈیفالٹ مثال کا استعمال کرتا ہے۔ ml.g5.2xlarge whisper-large-v2 ماڈل کے انفرنس اینڈ پوائنٹ کے لیے۔ آپ پاس کر کے ماڈل کو دوسری مثال کی اقسام پر تعینات کر سکتے ہیں۔ instance_type میں JumpStartModel کلاس تعیناتی میں چند منٹ لگ سکتے ہیں۔

خودکار تقریر کی پہچان

اس کے بعد، آپ SageMaker جمپ سٹارٹ پبلک سے نمونہ آڈیو فائل، sample1.wav پڑھتے ہیں۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3) مقام اور اسے منتقل کریں پیش گو تقریر کی شناخت کے لیے۔ آپ اس نمونے کی فائل کو کسی بھی دوسرے نمونے کی آڈیو فائل سے بدل سکتے ہیں لیکن اس بات کو یقینی بنائیں کہ .wav فائل کا نمونہ 16 kHz پر لیا گیا ہے کیونکہ خودکار اسپیچ ریکگنیشن ماڈلز کی ضرورت ہے۔ ان پٹ آڈیو فائل 30 سیکنڈ سے کم ہونی چاہیے۔

اندازہ لگاتے وقت یہ ماڈل بہت سے پیرامیٹرز کو سپورٹ کرتا ہے۔ ان میں شامل ہیں:

max_length: ماڈل آؤٹ پٹ کی لمبائی تک متن تیار کرتا ہے۔ اگر بیان کیا جائے تو یہ ایک مثبت عدد ہونا چاہیے۔- زبان اور کام: یہاں آؤٹ پٹ کی زبان اور کام کی وضاحت کریں۔ ماڈل نقل یا ترجمہ کے کام کی حمایت کرتا ہے۔

max_new_tokens: پیدا کرنے کے لیے ٹوکن کی زیادہ سے زیادہ تعداد۔num_return_sequences: آؤٹ پٹ سیکونسز کی تعداد لوٹائی گئی۔ اگر بیان کیا جائے تو یہ ایک مثبت عدد ہونا چاہیے۔num_beams: لالچی تلاش میں استعمال ہونے والے شہتیروں کی تعداد۔ اگر متعین کیا جائے تو اس کا عدد اس سے بڑا یا اس کے برابر ہونا چاہیے۔num_return_sequences.no_repeat_ngram_size: ماڈل اس بات کو یقینی بناتا ہے کہ الفاظ کی ایک ترتیبno_repeat_ngram_sizeآؤٹ پٹ ترتیب میں دہرایا نہیں جاتا ہے۔ اگر بیان کیا جائے تو یہ 1 سے بڑا مثبت عدد ہونا چاہیے۔- درجہ حرارت: یہ آؤٹ پٹ میں بے ترتیب پن کو کنٹرول کرتا ہے۔ زیادہ درجہ حرارت کے نتیجے میں کم امکان والے الفاظ کے ساتھ آؤٹ پٹ کی ترتیب ہوتی ہے اور کم درجہ حرارت کے نتیجے میں زیادہ امکان والے الفاظ کے ساتھ آؤٹ پٹ کی ترتیب ہوتی ہے۔ اگر درجہ حرارت 0 تک پہنچ جاتا ہے، تو اس کے نتیجے میں لالچی ضابطہ کشائی ہوتی ہے۔ اگر بیان کیا گیا ہے، تو یہ ایک مثبت فلوٹ ہونا چاہیے۔

early_stopping: اگرTrueجب تمام بیم مفروضے جملے کے ٹوکن کے اختتام پر پہنچ جاتے ہیں تو ٹیکسٹ جنریشن ختم ہو جاتی ہے۔ اگر بیان کیا گیا ہے، تو یہ بولین ہونا چاہیے۔do_sample: اگرTrue، امکان کے لیے اگلے لفظ کا نمونہ لیں۔ اگر بیان کیا گیا ہے، تو یہ بولین ہونا چاہیے۔top_k: ٹیکسٹ جنریشن کے ہر مرحلے میں، صرف سے نمونہtop_kسب سے زیادہ امکان الفاظ. اگر بیان کیا جائے تو یہ ایک مثبت عدد ہونا چاہیے۔top_p: متن کی تخلیق کے ہر مرحلے میں، مجموعی امکان کے ساتھ الفاظ کے سب سے چھوٹے ممکنہ سیٹ سے نمونہ لیں۔top_p. اگر متعین کیا جائے تو یہ 0 اور 1 کے درمیان فلوٹ ہونا چاہیے۔

اختتامی نقطہ کی درخواست کرتے وقت آپ پچھلے پیرامیٹرز کے کسی بھی ذیلی سیٹ کی وضاحت کر سکتے ہیں۔ اگلا، ہم آپ کو ایک مثال دکھاتے ہیں کہ ان دلائل کے ساتھ اختتامی نقطہ کو کیسے پکارا جائے۔

زبان کا ترجمہ

Whisper ماڈلز کا استعمال کرتے ہوئے زبان کے ترجمہ کو دکھانے کے لیے، فرانسیسی میں درج ذیل آڈیو فائل کا استعمال کریں اور اس کا انگریزی میں ترجمہ کریں۔ فائل کا نمونہ 16 kHz پر ہونا چاہیے (جیسا کہ ASR ماڈلز کی ضرورت ہے)، اس لیے اگر ضرورت ہو تو فائلوں کو دوبارہ نمونہ بنانا یقینی بنائیں اور یقینی بنائیں کہ آپ کے نمونے 30 سیکنڈ سے زیادہ نہ ہوں۔

- ڈاؤن لوڈ، اتارنا

sample_french1.wavSageMaker سے JumpStart عوامی S3 مقام سے تاکہ اسے Whisper ماڈل کے ذریعے ترجمہ کے لیے پے لوڈ میں پاس کیا جا سکے۔

- ٹاسک پیرامیٹر کو بطور سیٹ کریں۔

translateاور زبان کے طور پرFrenchوسپر ماڈل کو تقریر کا ترجمہ کرنے پر مجبور کرنا۔ - استعمال پیش گو زبان کے ترجمہ کی پیشن گوئی کرنے کے لیے۔ اگر آپ کو کلائنٹ کی غلطی (غلطی 413) موصول ہوتی ہے، تو اختتامی نقطہ پر پے لوڈ کا سائز چیک کریں۔ SageMaker کے لیے پے لوڈز اینڈ پوائنٹ کی درخواستیں تقریباً 5 MB تک محدود ہیں۔

- فرانسیسی آڈیو فائل سے انگریزی میں ترجمہ شدہ ٹیکسٹ آؤٹ پٹ درج ذیل ہے:

صاف کرو

اختتامی نقطہ کی جانچ کرنے کے بعد، SageMaker inference endpoint کو حذف کریں اور چارجز سے بچنے کے لیے ماڈل کو حذف کریں۔

نتیجہ

اس پوسٹ میں، ہم نے آپ کو Amazon SageMaker کا استعمال کرتے ہوئے دلچسپ ایپلی کیشنز بنانے کے لیے OpenAI Whisper ماڈل کی جانچ اور استعمال کرنے کا طریقہ دکھایا۔ آج ہی SageMaker میں فاؤنڈیشن ماڈل آزمائیں اور ہمیں اپنی رائے سے آگاہ کریں!

یہ رہنمائی صرف معلوماتی مقاصد کے لیے ہے۔ آپ کو اب بھی اپنی خود مختار تشخیص کرنی چاہیے اور اس بات کو یقینی بنانے کے لیے اقدامات کرنے چاہییں کہ آپ کوالٹی کنٹرول کے اپنے مخصوص طریقوں اور معیارات، اور مقامی قواعد، قوانین، ضوابط، لائسنس اور استعمال کی شرائط جو آپ پر لاگو ہوتے ہیں، آپ کے مواد، اور اس رہنمائی میں حوالہ دیا گیا تھرڈ پارٹی ماڈل۔ AWS کا اس رہنمائی میں حوالہ دیا گیا فریق ثالث ماڈل پر کوئی کنٹرول یا اختیار نہیں ہے اور وہ اس بات کی کوئی نمائندگی یا ضمانت نہیں دیتا ہے کہ فریق ثالث کا ماڈل محفوظ، وائرس سے پاک، آپریشنل، یا آپ کے پیداواری ماحول اور معیارات کے ساتھ مطابقت رکھتا ہے۔ AWS کوئی نمائندگی، ضمانت یا ضمانت نہیں دیتا ہے کہ اس رہنمائی میں کسی بھی معلومات کے نتیجے میں کوئی خاص نتیجہ یا نتیجہ نکلے گا۔

مصنفین کے بارے میں

ہیمنت سنگھ۔ ایمیزون سیج میکر جمپ اسٹارٹ میں تجربہ رکھنے والا ایک اپلائیڈ سائنٹسٹ ہے۔ انہوں نے کورنٹ انسٹی ٹیوٹ آف میتھمیٹیکل سائنسز سے ماسٹرز کیا اور آئی آئی ٹی دہلی سے بی ٹیک کیا۔ اسے قدرتی زبان کی پروسیسنگ، کمپیوٹر ویژن، اور ٹائم سیریز کے تجزیہ کے ڈومین میں مشین لرننگ کے مسائل کی ایک متنوع رینج پر کام کرنے کا تجربہ ہے۔

ہیمنت سنگھ۔ ایمیزون سیج میکر جمپ اسٹارٹ میں تجربہ رکھنے والا ایک اپلائیڈ سائنٹسٹ ہے۔ انہوں نے کورنٹ انسٹی ٹیوٹ آف میتھمیٹیکل سائنسز سے ماسٹرز کیا اور آئی آئی ٹی دہلی سے بی ٹیک کیا۔ اسے قدرتی زبان کی پروسیسنگ، کمپیوٹر ویژن، اور ٹائم سیریز کے تجزیہ کے ڈومین میں مشین لرننگ کے مسائل کی ایک متنوع رینج پر کام کرنے کا تجربہ ہے۔

رچنا چڈا AWS میں اسٹریٹجک اکاؤنٹس میں ایک پرنسپل حل آرکیٹیکٹ AI/ML ہے۔ رچنا ایک پر امید ہیں جو یقین رکھتی ہیں کہ AI کا اخلاقی اور ذمہ دارانہ استعمال مستقبل میں معاشرے کو بہتر بنا سکتا ہے اور معاشی اور سماجی خوشحالی لا سکتا ہے۔ اپنے فارغ وقت میں، رچنا اپنے خاندان کے ساتھ وقت گزارنا، پیدل سفر کرنا اور موسیقی سننا پسند کرتی ہے۔

رچنا چڈا AWS میں اسٹریٹجک اکاؤنٹس میں ایک پرنسپل حل آرکیٹیکٹ AI/ML ہے۔ رچنا ایک پر امید ہیں جو یقین رکھتی ہیں کہ AI کا اخلاقی اور ذمہ دارانہ استعمال مستقبل میں معاشرے کو بہتر بنا سکتا ہے اور معاشی اور سماجی خوشحالی لا سکتا ہے۔ اپنے فارغ وقت میں، رچنا اپنے خاندان کے ساتھ وقت گزارنا، پیدل سفر کرنا اور موسیقی سننا پسند کرتی ہے۔

ڈاکٹر آشیش کھیتان Amazon SageMaker بلٹ ان الگورتھم کے ساتھ ایک سینئر اپلائیڈ سائنٹسٹ ہے اور مشین لرننگ الگورتھم تیار کرنے میں مدد کرتا ہے۔ انہوں نے یونیورسٹی آف الینوائے اربانا-چمپین سے پی ایچ ڈی کی۔ وہ مشین لرننگ اور شماریاتی اندازہ میں ایک فعال محقق ہے، اور اس نے NeurIPS، ICML، ICLR، JMLR، ACL، اور EMNLP کانفرنسوں میں بہت سے مقالے شائع کیے ہیں۔

ڈاکٹر آشیش کھیتان Amazon SageMaker بلٹ ان الگورتھم کے ساتھ ایک سینئر اپلائیڈ سائنٹسٹ ہے اور مشین لرننگ الگورتھم تیار کرنے میں مدد کرتا ہے۔ انہوں نے یونیورسٹی آف الینوائے اربانا-چمپین سے پی ایچ ڈی کی۔ وہ مشین لرننگ اور شماریاتی اندازہ میں ایک فعال محقق ہے، اور اس نے NeurIPS، ICML، ICLR، JMLR، ACL، اور EMNLP کانفرنسوں میں بہت سے مقالے شائع کیے ہیں۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/whisper-models-for-automatic-speech-recognition-now-available-in-amazon-sagemaker-jumpstart/

- : ہے

- : ہے

- : نہیں

- $UP

- 1

- 10

- 100

- 12

- 14

- 15٪

- 150

- 16

- 30

- 7

- 8

- 9

- a

- کی صلاحیت

- ہمارے بارے میں

- تک رسائی حاصل

- قابل رسائی

- اکاؤنٹس

- کے پار

- فعال

- اصل میں

- اس کے علاوہ

- ترقی

- AI

- AI / ML

- یلگوردمز

- تمام

- بھی

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون سیج میکر جمپ اسٹارٹ

- ایمیزون سیج میکر اسٹوڈیو

- ایمیزون ویب سروسز

- رقم

- an

- تجزیہ

- اور

- اعلان کریں

- کوئی بھی

- اے پی آئی

- درخواست

- ایپلی کیشنز

- اطلاقی

- کا اطلاق کریں

- نقطہ نظر

- مناسب

- کیا

- دلائل

- فن

- AS

- تشخیص

- At

- آڈیو

- اتھارٹی

- خودکار

- دستیاب

- اوسط

- سے اجتناب

- AWS

- کی بنیاد پر

- BE

- بیم

- کیونکہ

- رہا

- خیال ہے

- نیچے

- کے درمیان

- اربوں

- بلاگ

- باکس

- لانے

- تعمیر

- تعمیر میں

- لیکن

- by

- کر سکتے ہیں

- مقدمات

- قسم

- خصوصیات

- بوجھ

- چیک کریں

- میں سے انتخاب کریں

- طبقے

- کلائنٹ

- کوڈ

- کس طرح

- آنے والے

- کامن

- مقابلے میں

- ہم آہنگ

- مکمل

- عمل

- کمپیوٹر

- کمپیوٹر ویژن

- کانفرنسوں

- کنسول

- کنٹینر

- مواد

- مسلسل

- کنٹرول

- کنٹرول

- درست

- تخلیق

- cured

- گاہک

- گاہکوں

- اعداد و شمار

- ڈیٹا سائنس

- ڈیٹاسیٹس

- ضابطہ ربائی کرنا

- پہلے سے طے شدہ

- دلی

- مظاہرہ

- تعیناتی

- تعینات

- تعیناتی

- تفصیل

- ترقی

- ترقی یافتہ

- ترقی

- فرق

- مختلف

- ڈیجیٹل

- ڈیجیٹل آرٹ

- متنوع

- do

- کرتا

- ڈومین

- ڈومینز

- نہیں

- ہر ایک

- آسانی سے

- یا تو

- ملازمین

- کو چالو کرنے کے

- کو فعال کرنا

- آخر

- آخر سے آخر تک

- اختتام پوائنٹ

- انگریزی

- کو یقینی بنانے کے

- یقینی بناتا ہے

- درج

- ماحولیات

- برابر

- خرابی

- نقائص

- اخلاقی

- کا جائزہ لینے

- بھی

- سب

- مثال کے طور پر

- حد سے تجاوز

- بہت پرجوش

- دلچسپ

- موجودہ

- توسیع

- مہنگی

- تجربہ

- تلاش

- چہرہ

- خاندان

- چند

- فائل

- فائلوں

- مل

- پہلا

- پانچ

- فلوٹ

- کے بعد

- مندرجہ ذیل ہے

- کے لئے

- مجبور

- ملا

- فاؤنڈیشن

- چار

- فرانسیسی

- سے

- مستقبل

- پیدا

- پیدا ہوتا ہے

- پیدا کرنے والے

- نسل

- حاصل

- GitHub کے

- دی

- Go

- ملا

- زیادہ سے زیادہ

- لالچی

- گراؤنڈ

- ضمانت دیتا ہے

- رہنمائی

- ہے

- ہونے

- he

- مدد

- مدد کرتا ہے

- اس کی

- یہاں

- اعلی

- ان

- میزبان

- میزبانی کی

- HOURS

- کس طرح

- کیسے

- HTML

- HTTPS

- حب

- مرکز

- ID

- if

- ایلی نوائے

- درآمد

- کو بہتر بنانے کے

- in

- شامل

- سمیت

- اضافہ

- آزاد

- اشارہ کرتا ہے

- معلومات

- معلومات

- ان پٹ

- انسٹال

- مثال کے طور پر

- انسٹی ٹیوٹ

- دلچسپ

- میں

- تنہائی

- IT

- فوٹو

- JSON

- جان

- جانا جاتا ہے

- زبان

- بڑے پیمانے پر

- سب سے بڑا

- تاخیر

- شروع

- قوانین

- سیکھنے

- چھوڑ کر

- لمبائی

- کم

- دو

- لائسنس

- لائٹنینگ کا

- امکان

- امکان

- پسند

- لمیٹڈ

- لنکس

- لسٹ

- سن

- رہ

- مقامی

- محل وقوع

- کم

- مشین

- مشین لرننگ

- برقرار رکھنے کے

- بنا

- بہت سے

- ریاضیاتی

- زیادہ سے زیادہ

- اقدامات

- درمیانہ

- مینو

- میٹرک۔

- شاید

- منٹ

- ML

- ماڈل

- ماڈل

- لمحہ

- زیادہ

- سب سے زیادہ

- موسیقی

- ضروری

- قدرتی

- قدرتی زبان عملیات

- ضرورت ہے

- ضرورت

- نیٹ ورک

- نئی

- اگلے

- نہیں

- کوئی بھی نہیں

- نوٹ بک

- اب

- تعداد

- تعداد

- of

- تجویز

- on

- صرف

- کھول

- اوپنائی

- آپریشنل

- or

- اصل

- دیگر

- دیگر

- باہر

- نتائج

- پیداوار

- باہر

- پر

- خود

- صفحہ

- کاغذات

- پیرامیٹر

- پیرامیٹرز

- خاص طور پر

- جماعتوں

- منظور

- منظور

- پیٹنٹ

- فیصد

- انجام دیں

- کارکردگی

- کارکردگی کا مظاہرہ

- پی ایچ ڈی

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- مہربانی کرکے

- مقبول

- مثبت

- ممکن

- پوسٹ

- طریقوں

- پیشن گوئی

- پیش گو

- پیش گوئیاں

- پرنسپل

- مسائل

- پروسیسنگ

- پیداوار

- مجوزہ

- خوشحالی

- فراہم کرنے والے

- فراہم کرتا ہے

- عوامی

- شائع

- مقاصد

- ازگر

- pytorch

- معیار

- جلدی سے

- بے ترتیب پن

- رینج

- شرح

- بلکہ

- تک پہنچنے

- پڑھیں

- واقعی

- وصول

- حال ہی میں

- تسلیم

- حوالہ

- کہا جاتا ہے

- ضابطے

- بار بار

- کی جگہ

- کی نمائندگی

- درخواست

- درخواستوں

- ضرورت

- محقق

- جواب

- ذمہ دار

- نتیجہ

- نتائج کی نمائش

- کا جائزہ لینے کے

- ٹھیک ہے

- اضافہ

- قوانین

- s

- sagemaker

- سیج میکر کا اندازہ

- فروخت

- اسی

- پیمانے

- سائنس

- سائنس

- سائنسدان

- اسکرپٹ

- sdk

- تلاش کریں

- سیکنڈ

- محفوظ بنانے

- سیکورٹی

- بھیجتا ہے

- سینئر

- سزا

- تسلسل

- سیریز

- سروس

- سروسز

- اجلاس

- مقرر

- مشترکہ

- ہونا چاہئے

- دکھائیں

- نمائش

- سے ظاہر ہوا

- دکھایا گیا

- سادہ

- سائز

- سائز

- So

- سماجی

- سوسائٹی

- حل

- حل

- مخصوص

- مخصوص

- تقریر

- تقریر کی شناخت

- تیزی

- خرچ کرنا۔

- معیار

- شروع

- حالت

- شماریات

- مرحلہ

- مراحل

- ابھی تک

- ذخیرہ

- حکمت عملی

- مضبوط

- سٹوڈیو

- اس طرح

- نگرانی

- کی حمایت کرتا ہے

- اس بات کا یقین

- کے نظام

- ٹیبل

- لے لو

- لیا

- ٹاسک

- کاموں

- ٹیک

- سانچے

- دس

- ٹیسسرور

- شرائط

- ٹیسٹ

- تجربہ

- متن

- سے

- کہ

- ۔

- مرکز

- ان

- خود

- تو

- یہ

- وہ

- تھرڈ

- تیسرے فریقوں

- تیسری پارٹی

- اس

- ہزار

- وقت

- وقت کا سلسلہ

- اوقات

- کرنے کے لئے

- آج

- ٹوکن

- ٹوکن

- لیا

- سب سے اوپر

- کل

- ٹرین

- تربیت یافتہ

- تبدیل

- ترجمہ کریں

- ترجمہ

- بھروسہ رکھو

- حقیقت

- کوشش

- اقسام

- عام طور پر

- ui

- یونیورسٹی

- جب تک

- us

- استعمال

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- رکن کا

- استعمال

- کا استعمال کرتے ہوئے

- قیمت

- مختلف

- بہت

- کی طرف سے

- نقطہ نظر

- چاہتے ہیں

- تھا

- we

- ویب

- ویب خدمات

- آپ کا استقبال ہے

- تھے

- جب

- چاہے

- جس

- کسبی

- ڈبلیو

- وسیع

- گے

- ساتھ

- کے اندر

- بغیر

- وون

- لفظ

- الفاظ

- کام کا بہاؤ

- کام کر

- سال

- تم

- اور

- زیفیرنیٹ