پچھلے چند سالوں میں بڑے لینگویج ماڈلز (LLMs) غیر معمولی مہارت کے ساتھ متن کو سمجھنے، تخلیق کرنے اور جوڑ توڑ کرنے کے قابل شاندار ٹولز کے طور پر نمایاں ہوئے ہیں۔ ان کی ممکنہ ایپلی کیشنز بات چیت کے ایجنٹوں سے لے کر مواد کی تخلیق اور معلومات کی بازیافت تک پھیلی ہوئی ہیں، جو تمام صنعتوں میں انقلاب لانے کا وعدہ رکھتی ہیں۔ تاہم، ان ماڈلز کے ذمہ دارانہ اور موثر استعمال کو یقینی بناتے ہوئے اس صلاحیت کو بروئے کار لانا LLM تشخیص کے اہم عمل پر منحصر ہے۔ تشخیص ایک ایسا کام ہے جو LLM یا جنریٹیو AI سروس کے آؤٹ پٹ کے معیار اور ذمہ داری کی پیمائش کے لیے استعمال ہوتا ہے۔ LLMs کا اندازہ نہ صرف ماڈل کی کارکردگی کو سمجھنے کی خواہش سے ہوتا ہے بلکہ ذمہ دار AI کو لاگو کرنے کی ضرورت اور غلط معلومات یا متعصب مواد فراہم کرنے کے خطرے کو کم کرنے اور نقصان دہ، غیر محفوظ، بدنیتی پر مبنی اور غیر اخلاقی نسل کو کم سے کم کرنے کی ضرورت سے بھی ہوتا ہے۔ مواد مزید برآں، LLMs کا جائزہ لینے سے حفاظتی خطرات کو کم کرنے میں بھی مدد مل سکتی ہے، خاص طور پر فوری ڈیٹا ٹمپرنگ کے تناظر میں۔ LLM پر مبنی ایپلی کیشنز کے لیے، کمزوریوں کی نشاندہی کرنا اور ایسے حفاظتی اقدامات کو نافذ کرنا بہت ضروری ہے جو ڈیٹا کی ممکنہ خلاف ورزیوں اور غیر مجاز ہیرا پھیری سے تحفظ فراہم کرتے ہیں۔

سیدھی سیدھی ترتیب اور ایک کلک اپروچ کے ساتھ ایل ایل ایم کی جانچ کے لیے ضروری ٹولز فراہم کرکے، ایمیزون سیج میکر واضح کریں۔ ایل ایل ایم کی تشخیص کی صلاحیتیں صارفین کو مذکورہ بالا فوائد میں سے زیادہ تر تک رسائی فراہم کرتی ہیں۔ ان ٹولز کو ہاتھ میں رکھتے ہوئے، اگلا چیلنج ایل ایل ایم کی تشخیص کو مشین لرننگ اینڈ آپریشن (MLOps) لائف سائیکل میں ضم کرنا ہے تاکہ عمل میں آٹومیشن اور اسکیل ایبلٹی حاصل کی جا سکے۔ اس پوسٹ میں، ہم آپ کو دکھاتے ہیں کہ ایمیزون سیج میکر کلیریفائی ایل ایل ایم کی تشخیص کو ایمیزون سیج میکر پائپ لائنز کے ساتھ کیسے مربوط کیا جائے تاکہ ایل ایل ایم کی تشخیص کو پیمانے پر کیا جا سکے۔ مزید برآں، ہم اس میں کوڈ کی مثال فراہم کرتے ہیں۔ GitHub کے Llama2-7b-f، Falcon-7b، اور فائن ٹیونڈ Llama2-7b ماڈلز جیسی مثالوں کا استعمال کرتے ہوئے، صارفین کو پیمانے پر متوازی ملٹی ماڈل کی تشخیص کرنے کے قابل بنانے کے لیے ذخیرہ۔

ایل ایل ایم کی تشخیص کس کو کرنے کی ضرورت ہے؟

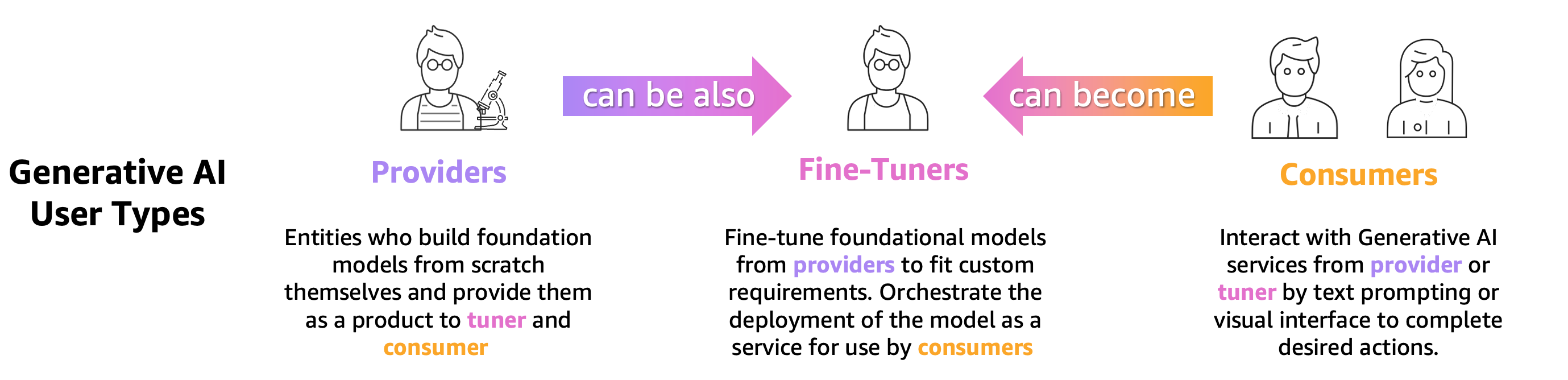

کوئی بھی شخص جو تربیت دیتا ہے، ٹھیک ٹیون کرتا ہے یا پہلے سے تربیت یافتہ LLM استعمال کرتا ہے اسے اس LLM کے ذریعے چلنے والی ایپلیکیشن کے رویے کا اندازہ لگانے کے لیے اس کا درست اندازہ لگانے کی ضرورت ہے۔ اس اصول کی بنیاد پر، ہم جنریٹیو AI صارفین کو درجہ بندی کر سکتے ہیں جنہیں LLM تشخیصی صلاحیتوں کی ضرورت ہے 3 گروپوں میں جیسا کہ مندرجہ ذیل تصویر میں دکھایا گیا ہے: ماڈل فراہم کرنے والے، فائن ٹیونرز، اور صارفین۔

- فاؤنڈیشن ماڈل (FM) فراہم کرنے والے ٹرین ماڈل جو عام مقصد کے ہیں۔ ان ماڈلز کو بہت سے نیچے کی دھارے والے کاموں کے لیے استعمال کیا جا سکتا ہے، جیسے کہ فیچر نکالنا یا مواد تیار کرنا۔ ہر تربیت یافتہ ماڈل کو بہت سے کاموں کے خلاف بینچ مارک کرنے کی ضرورت ہوتی ہے تاکہ نہ صرف اس کی کارکردگی کا اندازہ لگایا جا سکے بلکہ دوسرے موجودہ ماڈلز کے ساتھ اس کا موازنہ بھی کیا جا سکے، ان شعبوں کی نشاندہی کی جا سکے جن میں بہتری کی ضرورت ہے اور آخر میں، میدان میں ہونے والی پیشرفت پر نظر رکھنے کے لیے۔ ماڈل فراہم کنندگان کو ابتدائی ڈیٹا سیٹ کے معیار اور اپنے ماڈل کے درست رویے کو یقینی بنانے کے لیے کسی بھی تعصب کی موجودگی کو بھی چیک کرنے کی ضرورت ہے۔ ماڈل فراہم کرنے والوں کے لیے تشخیصی ڈیٹا اکٹھا کرنا بہت ضروری ہے۔ مزید برآں، ان اعداد و شمار اور میٹرکس کو آنے والے ضوابط کی تعمیل کے لیے جمع کیا جانا چاہیے۔ ISO 42001، بائیڈن انتظامیہ کا ایگزیکٹو آرڈر، اور EU AI ایکٹ اس بات کو یقینی بنانے میں مدد کے لیے کہ AI سسٹمز محفوظ، محفوظ اور قابل بھروسہ ہیں معیارات، ٹولز اور ٹیسٹ تیار کریں۔ مثال کے طور پر، EU AI ایکٹ کو یہ معلومات فراہم کرنے کا کام سونپا گیا ہے کہ کون سے ڈیٹا سیٹس کو تربیت کے لیے استعمال کیا جاتا ہے، ماڈل کو چلانے کے لیے کس کمپیوٹ پاور کی ضرورت ہوتی ہے، ماڈل کے نتائج کو عوامی/صنعت کے معیاری بینچ مارکس کے خلاف رپورٹ کرنا اور اندرونی اور بیرونی جانچ کے نتائج کا اشتراک کرنا ہے۔

- ماڈل ٹھیک ٹیونرز مخصوص کاموں کو حل کرنا چاہتے ہیں (جیسے جذبات کی درجہ بندی، خلاصہ، سوال کے جوابات) کے ساتھ ساتھ ڈومین کے مخصوص کاموں کو اپنانے کے لیے پہلے سے تربیت یافتہ ماڈل۔ انہیں ماڈل فراہم کنندگان کے ذریعہ تیار کردہ تشخیصی میٹرکس کی ضرورت ہوتی ہے تاکہ صحیح پہلے سے تربیت یافتہ ماڈل کو نقطہ آغاز کے طور پر منتخب کیا جا سکے۔

انہیں ٹاسک مخصوص یا ڈومین کے مخصوص ڈیٹاسیٹس کے ساتھ اپنے مطلوبہ استعمال کے کیس کے خلاف اپنے عمدہ ماڈلز کا جائزہ لینے کی ضرورت ہے۔ اکثر، انہیں اپنے پرائیویٹ ڈیٹاسیٹس کو درست کرنا اور بنانا چاہیے کیونکہ عوامی طور پر دستیاب ڈیٹاسیٹس، یہاں تک کہ جو کسی خاص کام کے لیے ڈیزائن کیے گئے ہیں، ممکن ہے کہ ان کے مخصوص استعمال کے معاملے کے لیے درکار باریکیوں کو مناسب طریقے سے حاصل نہ کر سکیں۔

فائن ٹیوننگ مکمل ٹریننگ سے تیز اور سستی ہے اور اس کے لیے تعیناتی اور جانچ کے لیے تیز آپریٹو تکرار کی ضرورت ہوتی ہے کیونکہ عام طور پر امیدواروں کے بہت سے ماڈلز تیار کیے جاتے ہیں۔ ان ماڈلز کا جائزہ لینے سے ماڈل میں مسلسل بہتری، انشانکن اور ڈیبگنگ کی اجازت ملتی ہے۔ نوٹ کریں کہ فائن ٹیونرز اپنے ماڈلز کے صارفین بن سکتے ہیں جب وہ حقیقی دنیا کی ایپلی کیشنز تیار کرتے ہیں۔ - ماڈل صارفین یا ماڈل تعینات کرنے والے پیداوار میں عمومی مقصد یا عمدہ ماڈلز کی خدمت اور نگرانی کرتے ہیں، جس کا مقصد LLMs کو اپنانے کے ذریعے اپنی ایپلی کیشنز یا خدمات کو بڑھانا ہے۔ ان کے سامنے پہلا چیلنج یہ یقینی بنانا ہے کہ منتخب کردہ LLM ان کی مخصوص ضروریات، لاگت اور کارکردگی کی توقعات کے مطابق ہو۔ ماڈل کے نتائج کی تشریح اور سمجھنا ایک مستقل تشویش ہے، خاص طور پر جب رازداری اور ڈیٹا کی حفاظت شامل ہو (مثلاً مالیاتی شعبے جیسی ریگولیٹڈ صنعتوں میں آڈیٹنگ کے خطرے اور تعمیل کے لیے)۔ تعصب یا نقصان دہ مواد کے پھیلاؤ کو روکنے کے لیے ماڈل کی مسلسل جانچ بہت ضروری ہے۔ ایک مضبوط مانیٹرنگ اور ایویلیویشن فریم ورک کو لاگو کر کے، ماڈل صارفین LLMs میں رجعت کی شناخت اور اس کا ازالہ کر سکتے ہیں، اس بات کو یقینی بناتے ہوئے کہ یہ ماڈل وقت کے ساتھ ساتھ اپنی تاثیر اور وشوسنییتا کو برقرار رکھیں۔

ایل ایل ایم کی تشخیص کیسے کریں۔

مؤثر ماڈل کی تشخیص میں تین بنیادی اجزاء شامل ہیں: ان پٹ ڈیٹا سیٹس (پرامپٹ، بات چیت یا باقاعدہ ان پٹس) اور تشخیصی منطق کا جائزہ لینے کے لیے ایک یا زیادہ FMs یا ٹھیک ٹیونڈ ماڈل۔

تشخیص کے لیے ماڈلز کو منتخب کرنے کے لیے، مختلف عوامل پر غور کرنا چاہیے، بشمول ڈیٹا کی خصوصیات، مسئلہ کی پیچیدگی، دستیاب کمپیوٹیشنل وسائل، اور مطلوبہ نتائج۔ ان پٹ ڈیٹا اسٹور منتخب ماڈل کی تربیت، فائن ٹیوننگ اور جانچ کے لیے ضروری ڈیٹا فراہم کرتا ہے۔ یہ بہت ضروری ہے کہ یہ ڈیٹا اسٹور اچھی ساخت، نمائندہ اور اعلیٰ معیار کا ہو، کیونکہ ماڈل کی کارکردگی کا انحصار اس ڈیٹا پر ہوتا ہے جس سے وہ سیکھتا ہے۔ آخر میں، تشخیصی منطق ماڈل کی کارکردگی کا اندازہ لگانے کے لیے استعمال ہونے والے معیار اور میٹرکس کی وضاحت کرتی ہے۔

یہ تینوں اجزاء مل کر ایک مربوط فریم ورک بناتے ہیں جو مشین لرننگ ماڈلز کی سخت اور منظم تشخیص کو یقینی بناتا ہے، جو بالآخر باخبر فیصلے اور ماڈل کی تاثیر میں بہتری کا باعث بنتا ہے۔

ماڈل کی تشخیص کی تکنیک اب بھی تحقیق کا ایک فعال میدان ہے۔ کاموں اور منظرناموں کی ایک وسیع رینج کا احاطہ کرنے کے لیے پچھلے کچھ سالوں میں محققین کی کمیونٹی کے ذریعہ بہت سے عوامی معیارات اور فریم ورک بنائے گئے تھے جیسے گلو, زبردست گون, ہیلم, ایم ایم ایل یو اور بڑا بنچ. ان بینچ مارکس میں لیڈر بورڈ ہوتے ہیں جن کا استعمال تشخیص شدہ ماڈلز کا موازنہ اور ان کے برعکس کرنے کے لیے کیا جا سکتا ہے۔ HELM کی طرح بینچ مارکس کا مقصد بھی درستگی کے اقدامات، جیسے کہ درستگی یا F1 سکور سے ماورا میٹرکس کا جائزہ لینا ہے۔ HELM بینچ مارک میں منصفانہ، تعصب اور زہریلے پن کے لیے میٹرکس شامل ہیں جو کہ مجموعی ماڈل ایویلیویشن سکور میں یکساں طور پر اہم ہیں۔

ان تمام بینچ مارکس میں میٹرکس کا ایک سیٹ شامل ہے جس سے اندازہ ہوتا ہے کہ ماڈل کسی خاص کام پر کس طرح کارکردگی کا مظاہرہ کرتا ہے۔ سب سے مشہور اور سب سے عام میٹرکس ہیں۔ RED (ریکال اورینٹڈ انڈر اسٹڈی برائے گسٹنگ ایویلیویشن) بلو (دو لسانی تشخیص انڈر اسٹڈی)، یا الکا (واضح ترتیب کے ساتھ ترجمہ کی تشخیص کے لیے میٹرک)۔ وہ میٹرکس خودکار تشخیص کے لیے ایک کارآمد ٹول کے طور پر کام کرتے ہیں، جو تیار کردہ اور حوالہ جات کے درمیان لغوی مماثلت کے مقداری اقدامات فراہم کرتے ہیں۔ تاہم، وہ انسان جیسی زبان کی نسل کی پوری وسعت کو حاصل نہیں کرتے، جس میں معنوی تفہیم، سیاق و سباق یا اسلوبیاتی باریکیاں شامل ہیں۔ مثال کے طور پر، HELM مخصوص استعمال کے معاملات سے متعلقہ تشخیصی تفصیلات، حسب ضرورت اشارے کی جانچ کے لیے حل، اور غیر ماہرین کے ذریعے استعمال کیے جانے والے آسانی سے تشریح شدہ نتائج فراہم نہیں کرتا، کیونکہ یہ عمل مہنگا ہو سکتا ہے، پیمانے پر آسان نہیں، اور صرف مخصوص کاموں کے لیے۔

مزید برآں، انسان جیسی زبان کی نسل کو حاصل کرنے کے لیے اکثر اوقات انسان کے اندر کی لوپ کو شامل کرنے کی ضرورت ہوتی ہے تاکہ خودکار درستگی کے میٹرکس کی تکمیل کے لیے کوالٹیٹی تشخیص اور انسانی فیصلے سامنے آئیں۔ انسانی تشخیص LLM آؤٹ پٹس کا اندازہ لگانے کے لیے ایک قابل قدر طریقہ ہے لیکن یہ موضوعی اور تعصب کا شکار بھی ہو سکتا ہے کیونکہ مختلف انسانی تشخیص کاروں کی متن کے معیار کی مختلف آراء اور تشریحات ہو سکتی ہیں۔ مزید برآں، انسانی تشخیص وسائل سے بھرپور اور مہنگا ہو سکتا ہے اور اس کے لیے اہم وقت اور محنت درکار ہو سکتی ہے۔

آئیے اس بات کی گہرائی میں غوطہ لگائیں کہ ایمیزون سیج میکر کلیریفائی کس طرح بغیر کسی رکاوٹ کے نقطوں کو جوڑتا ہے، ماڈل کی مکمل جانچ اور انتخاب کرنے میں صارفین کی مدد کرتا ہے۔

ایمیزون سیج میکر واضح کے ساتھ ایل ایل ایم کی تشخیص

Amazon SageMaker Clarify صارفین کو میٹرکس کو خودکار کرنے میں مدد کرتا ہے، جس میں درستگی، مضبوطی، زہریلا پن، دقیانوسی تصورات اور خودکار کے لیے حقیقت پر مبنی علم، اور انداز، ہم آہنگی، انسانی بنیادوں پر تشخیص کے لیے مطابقت، اور LLM کی تشخیص کے لیے ایک فریم ورک فراہم کرکے تشخیص کے طریقے شامل ہیں لیکن ان تک محدود نہیں۔ اور LLM پر مبنی خدمات جیسے Amazon Bedrock۔ مکمل طور پر منظم سروس کے طور پر، SageMaker Clarify Amazon SageMaker کے اندر اوپن سورس تشخیصی فریم ورک کے استعمال کو آسان بناتا ہے۔ صارفین اپنے منظرناموں کے لیے متعلقہ تشخیصی ڈیٹاسیٹس اور میٹرکس کا انتخاب کر سکتے ہیں اور انہیں اپنے پرامپٹ ڈیٹاسیٹس اور تشخیصی الگورتھم کے ساتھ بڑھا سکتے ہیں۔ SageMaker Clarify LLM ورک فلو میں مختلف کرداروں کو سپورٹ کرنے کے لیے متعدد فارمیٹس میں تشخیصی نتائج فراہم کرتا ہے۔ ڈیٹا سائنسدان نوٹ بک، سیج میکر ماڈل کارڈز، اور پی ڈی ایف رپورٹس میں سیج میکر کلیرائف ویژولائزیشن کے ساتھ تفصیلی نتائج کا تجزیہ کر سکتے ہیں۔ دریں اثنا، آپریشنز ٹیمیں Amazon SageMaker GroundTruth کا استعمال کر سکتی ہیں تاکہ وہ ہائی رسک آئٹمز کا جائزہ لیں اور ان کی تشریح کریں جن کی SageMaker Clarify شناخت کرتا ہے۔ مثال کے طور پر، دقیانوسی تصورات، زہریلا پن، فرار PII، یا کم درستگی۔

تشریحات اور کمک سیکھنے کو بعد میں ممکنہ خطرات کو کم کرنے کے لیے استعمال کیا جاتا ہے۔ شناخت شدہ خطرات کی انسان دوست وضاحتیں دستی جائزہ کے عمل کو تیز کرتی ہیں، اس طرح اخراجات میں کمی آتی ہے۔ خلاصہ رپورٹیں کاروباری اسٹیک ہولڈرز کو مختلف ماڈلز اور ورژنز کے درمیان تقابلی معیارات پیش کرتی ہیں، باخبر فیصلہ سازی میں سہولت فراہم کرتی ہیں۔

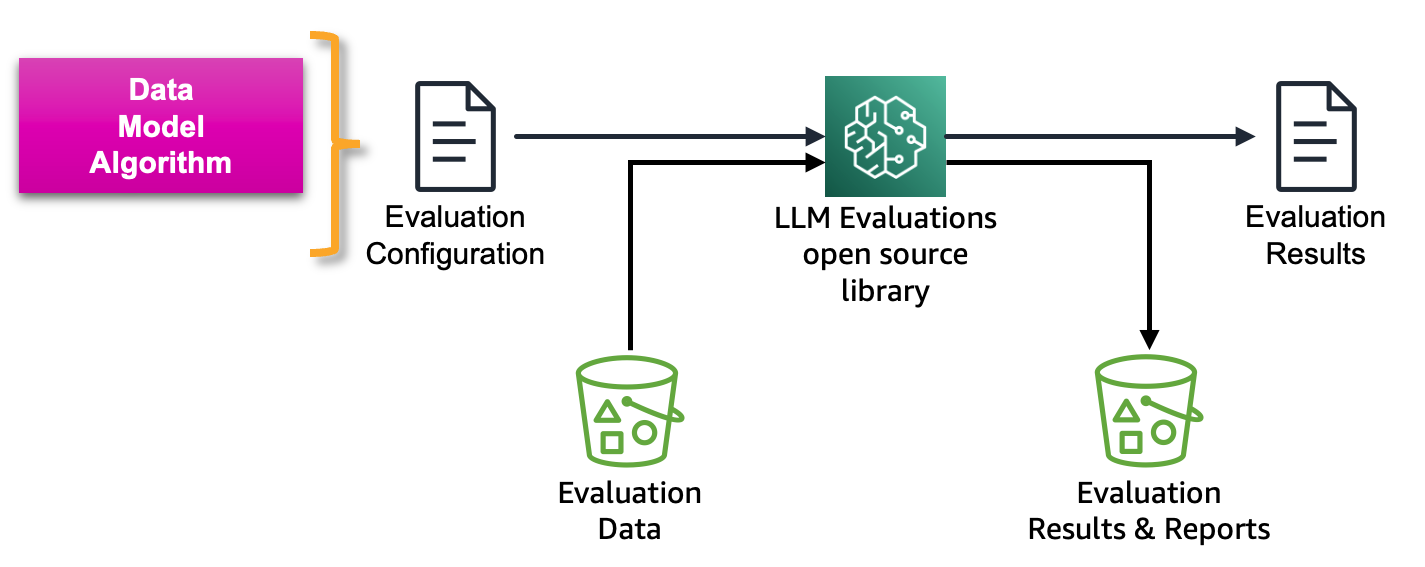

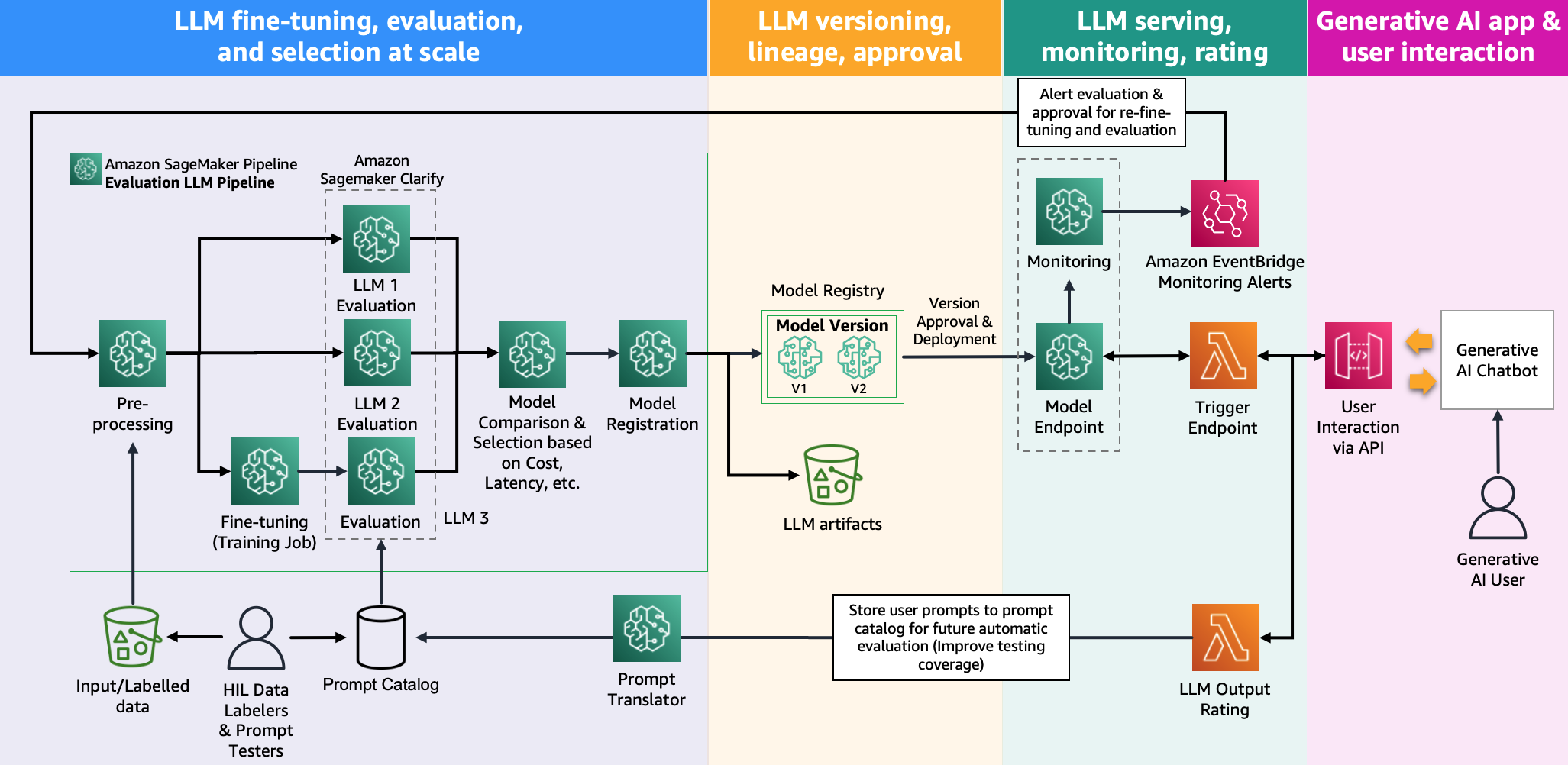

مندرجہ ذیل اعداد و شمار LLMs اور LLM پر مبنی خدمات کا جائزہ لینے کے لیے فریم ورک کو ظاہر کرتا ہے:

Amazon SageMaker Clarify LLM evaluation ایک اوپن سورس فاؤنڈیشن ماڈل ایویلیوایشن (FMEval) لائبریری ہے جسے AWS نے تیار کیا ہے تاکہ صارفین کو آسانی سے LLMs کا جائزہ لینے میں مدد ملے۔ تمام فنکشنلٹیز کو بھی ایمیزون سیج میکر اسٹوڈیو میں شامل کیا گیا ہے تاکہ اس کے صارفین کے لیے ایل ایل ایم کی تشخیص ممکن ہو سکے۔ مندرجہ ذیل حصوں میں، ہم MLOps اصولوں کا استعمال کرتے ہوئے پیمانے پر LLM تشخیص کو قابل بنانے کے لیے SageMaker Pipelines کے ساتھ Amazon SageMaker Clarify LLM تشخیصی صلاحیتوں کے انضمام کو متعارف کراتے ہیں۔

Amazon SageMaker MLOps لائف سائیکل

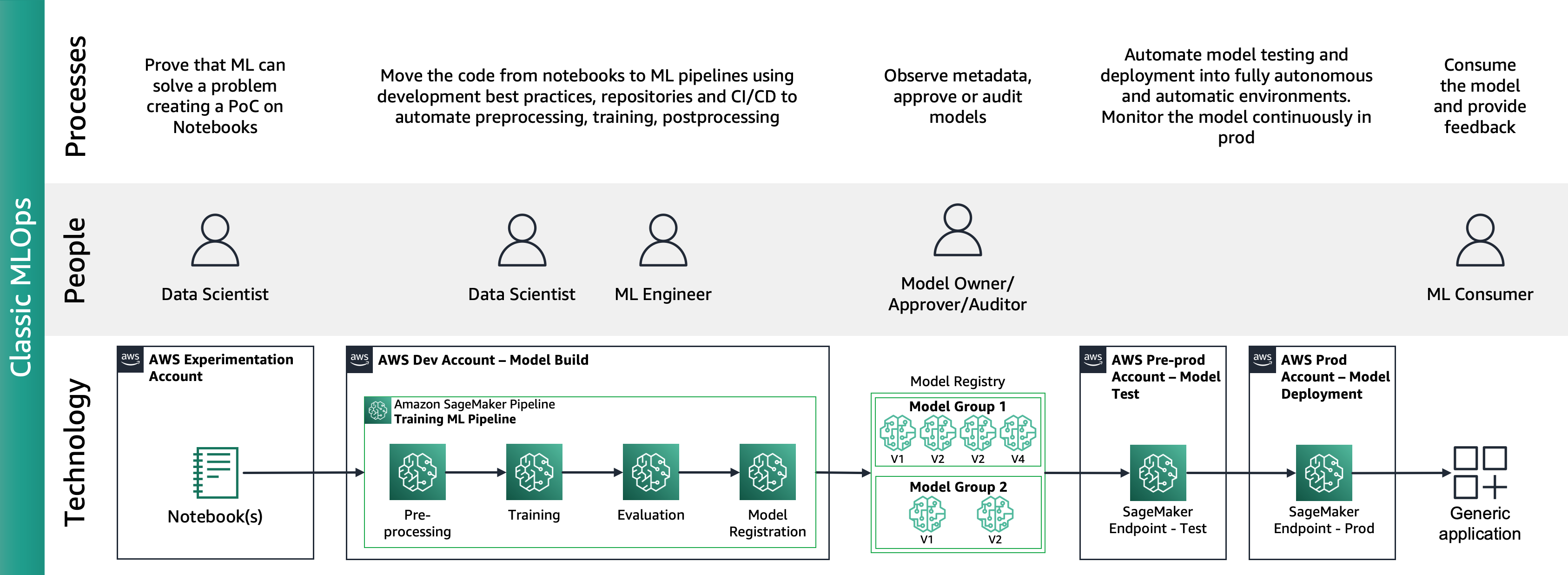

بطور پوسٹ "Amazon SageMaker کے ساتھ کاروباری اداروں کے لیے MLOps فاؤنڈیشن روڈ میپبیان کرتا ہے، MLOps عمل، لوگوں اور ٹیکنالوجی کا مجموعہ ہے تاکہ ML کے استعمال کے معاملات کو موثر طریقے سے تیار کیا جا سکے۔

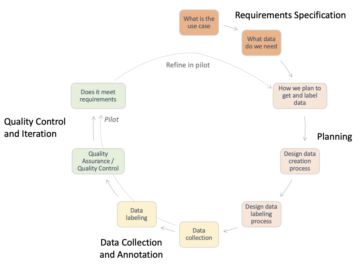

مندرجہ ذیل اعداد و شمار اختتام سے آخر تک MLOps لائف سائیکل کو ظاہر کرتا ہے:

ایک عام سفر ایک ڈیٹا سائنسدان کے ساتھ شروع ہوتا ہے جو ایک پروف-آف-کانسیپٹ (PoC) نوٹ بک بناتا ہے تاکہ یہ ثابت کیا جا سکے کہ ML کسی کاروباری مسئلے کو حل کر سکتا ہے۔ تصور کے ثبوت (PoC) کی ترقی کے دوران، یہ ڈیٹا سائنسدان پر آتا ہے کہ وہ بزنس کلیدی کارکردگی کے اشارے (KPIs) کو مشین لرننگ ماڈل میٹرکس میں تبدیل کرے، جیسے کہ درستگی یا غلط مثبت شرح، اور ان کا جائزہ لینے کے لیے ایک محدود ٹیسٹ ڈیٹاسیٹ کا استعمال کریں۔ میٹرکس ڈیٹا سائنسدان ایم ایل انجینئرز کے ساتھ مل کر کوڈ کو نوٹ بک سے ریپوزٹری تک منتقل کرتے ہیں، ایمیزون سیج میکر پائپ لائنز کا استعمال کرتے ہوئے ایم ایل پائپ لائنز بناتے ہیں، جو پروسیسنگ کے مختلف مراحل اور کاموں کو جوڑتے ہیں، بشمول پری پروسیسنگ، تربیت، تشخیص، اور پوسٹ پروسیسنگ، یہ سب کچھ مسلسل نئی پروڈکشن کو شامل کرتے ہوئے ڈیٹا Amazon SageMaker پائپ لائنز کی تعیناتی ریپوزٹری کے تعاملات اور CI/CD پائپ لائن ایکٹیویشن پر منحصر ہے۔ ایم ایل پائپ لائن ماڈل رجسٹری میں اعلیٰ کارکردگی کا مظاہرہ کرنے والے ماڈلز، کنٹینر امیجز، تشخیصی نتائج، اور اسٹیٹس کی معلومات کو برقرار رکھتی ہے، جہاں ماڈل سٹیک ہولڈرز کارکردگی کا جائزہ لیتے ہیں اور کارکردگی کے نتائج اور بینچ مارکس کی بنیاد پر پیداوار میں پیشرفت کا فیصلہ کرتے ہیں، اس کے بعد ایک اور CI/CD پائپ لائن کو چالو کیا جاتا ہے۔ سٹیجنگ اور پروڈکشن کی تعیناتی کے لیے۔ ایک بار پروڈکشن میں، ML صارفین ماڈل کو ایپلیکیشن سے ٹریگرڈ انفرنس کے ذریعے براہ راست درخواست یا API کالز کے ذریعے استعمال کرتے ہیں، جس میں کارکردگی کے جاری جائزہ کے لیے ماڈل مالکان کو فیڈ بیک لوپ فراہم کیے جاتے ہیں۔

ایمیزون سیج میکر واضح اور MLOps انضمام

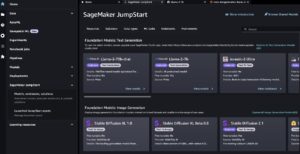

MLOps لائف سائیکل کے بعد، فائن ٹیونرز یا اوپن سورس ماڈلز کے صارفین Amazon SageMaker Jumpstart اور MLOps سروسز کا استعمال کرتے ہوئے فائن ٹیونڈ ماڈل یا FM تیار کرتے ہیں، جیسا کہ میں بیان کیا گیا ہے۔ ایمیزون سیج میکر جمپ سٹارٹ کے پہلے سے تربیت یافتہ ماڈلز کے ساتھ MLOps کے طریقوں کو نافذ کرنا. یہ فاؤنڈیشن ماڈل آپریشنز (FMOps) اور LLM آپریشنز (LLMOps) کے لیے ایک نئے ڈومین کی طرف لے جاتا ہے۔ FMOps/LLMOps: تخلیقی AI اور MLOps کے ساتھ اختلافات کو فعال کریں۔.

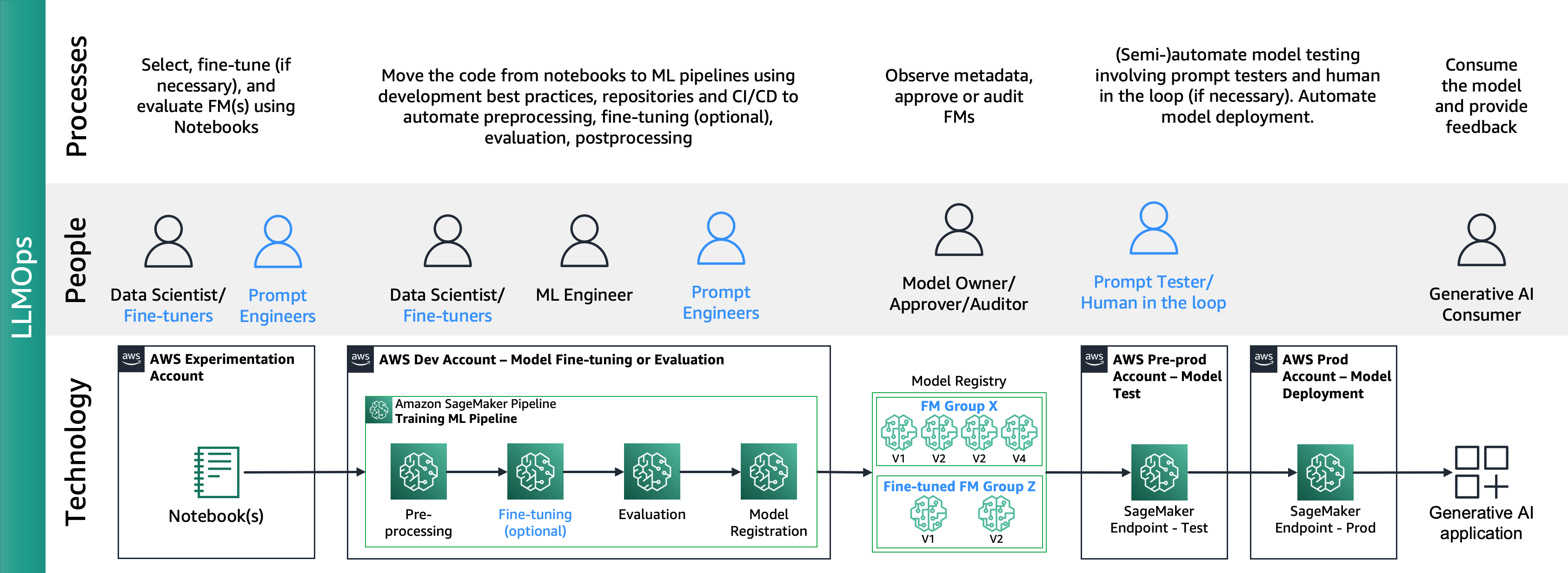

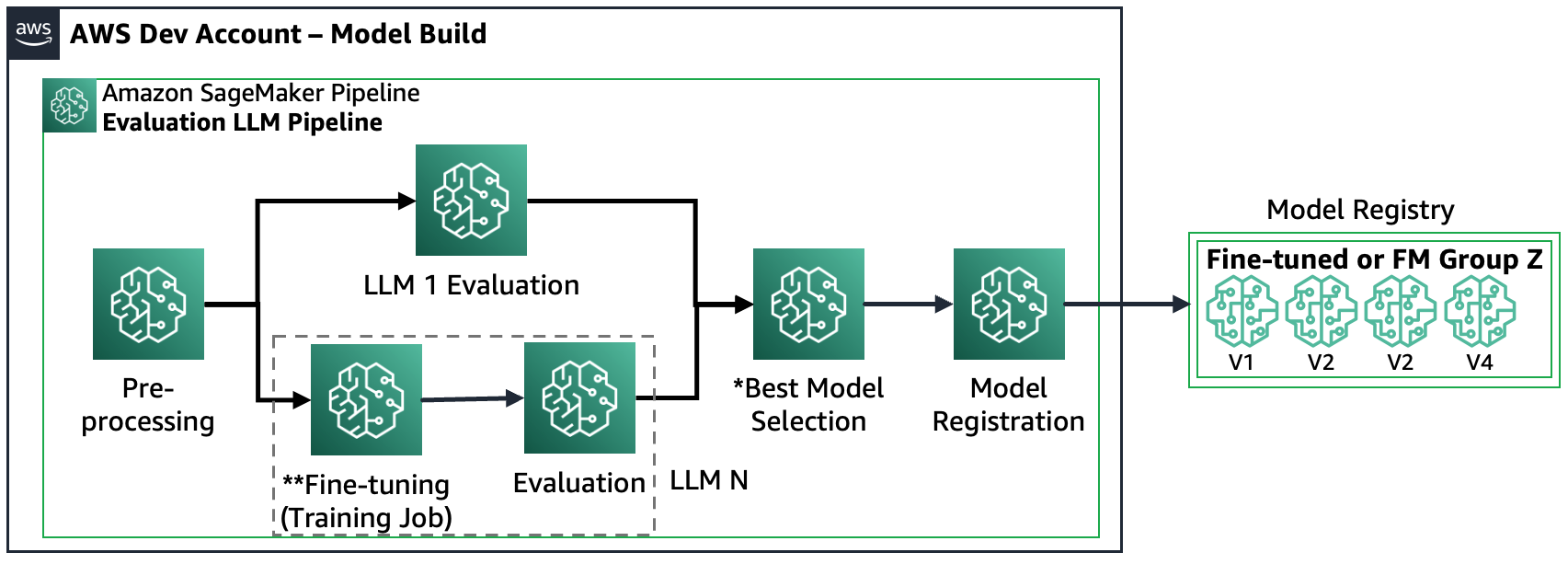

درج ذیل اعداد و شمار LLMOps کے اختتام سے آخر تک کے لائف سائیکل کو ظاہر کرتا ہے:

LLMOps میں MLOps کے مقابلے میں بنیادی فرق ماڈل کا انتخاب اور ماڈل کی تشخیص ہے جس میں مختلف عمل اور میٹرکس شامل ہیں۔ ابتدائی تجرباتی مرحلے میں، ڈیٹا سائنسدان (یا فائن ٹیونرز) FM کا انتخاب کرتے ہیں جو ایک مخصوص جنریٹو AI استعمال کے کیس کے لیے استعمال کیا جائے گا۔

اس کے نتیجے میں اکثر متعدد FMs کی جانچ اور فائن ٹیوننگ ہوتی ہے، جن میں سے کچھ موازنہ کے نتائج حاصل کر سکتے ہیں۔ ماڈل (ماڈل) کے انتخاب کے بعد، پرامپٹ انجینئر تشخیص کے لیے ضروری ان پٹ ڈیٹا اور متوقع آؤٹ پٹ تیار کرنے کے ذمہ دار ہوتے ہیں (مثلاً ان پٹ پرامپٹ جس میں ان پٹ ڈیٹا اور استفسار ہوتا ہے) اور مماثلت اور زہریلے پن جیسے میٹرکس کی وضاحت کرتے ہیں۔ ان میٹرکس کے علاوہ، ڈیٹا سائنسدانوں یا فائن ٹیونرز کو نتائج کی توثیق کرنی چاہیے اور مناسب FM کا انتخاب نہ صرف درست میٹرکس پر کرنا چاہیے، بلکہ دیگر صلاحیتوں جیسے کہ تاخیر اور لاگت پر بھی۔ پھر، وہ ایک ماڈل کو SageMaker اینڈ پوائنٹ پر تعینات کر سکتے ہیں اور اس کی کارکردگی کو چھوٹے پیمانے پر جانچ سکتے ہیں۔ اگرچہ تجرباتی مرحلے میں ایک سیدھا سادا عمل شامل ہو سکتا ہے، لیکن پیداوار میں منتقلی کے لیے صارفین کو اس عمل کو خودکار بنانے اور حل کی مضبوطی کو بڑھانے کی ضرورت ہوتی ہے۔ لہذا، ہمیں تشخیص کو خودکار کرنے کے طریقے پر گہرا غوطہ لگانے کی ضرورت ہے، ٹیسٹرز کو پیمانے پر موثر تشخیص کرنے اور ماڈل ان پٹ اور آؤٹ پٹ کی حقیقی وقت کی نگرانی کو لاگو کرنے کے قابل بنانا۔

ایف ایم کی تشخیص کو خودکار بنائیں

ایمیزون سیج میکر پائپ لائنز پری پروسیسنگ، ایف ایم فائن ٹیوننگ (اختیاری طور پر) اور پیمانے پر تشخیص کے تمام مراحل کو خودکار کرتی ہیں۔ تجربے کے دوران منتخب کردہ ماڈلز کو دیکھتے ہوئے، پرامپٹ انجینئرز کو بہت سے پرامپٹس تیار کرکے اور انہیں پرامپٹ کیٹلاگ نامی ایک مخصوص اسٹوریج ریپوزٹری میں اسٹور کرکے کیسز کے ایک بڑے سیٹ کا احاطہ کرنے کی ضرورت ہے۔ مزید معلومات کے لیے رجوع کریں۔ FMOps/LLMOps: تخلیقی AI اور MLOps کے ساتھ اختلافات کو فعال کریں۔. اس کے بعد، ایمیزون سیج میکر پائپ لائنز کو اس طرح تشکیل دیا جا سکتا ہے:

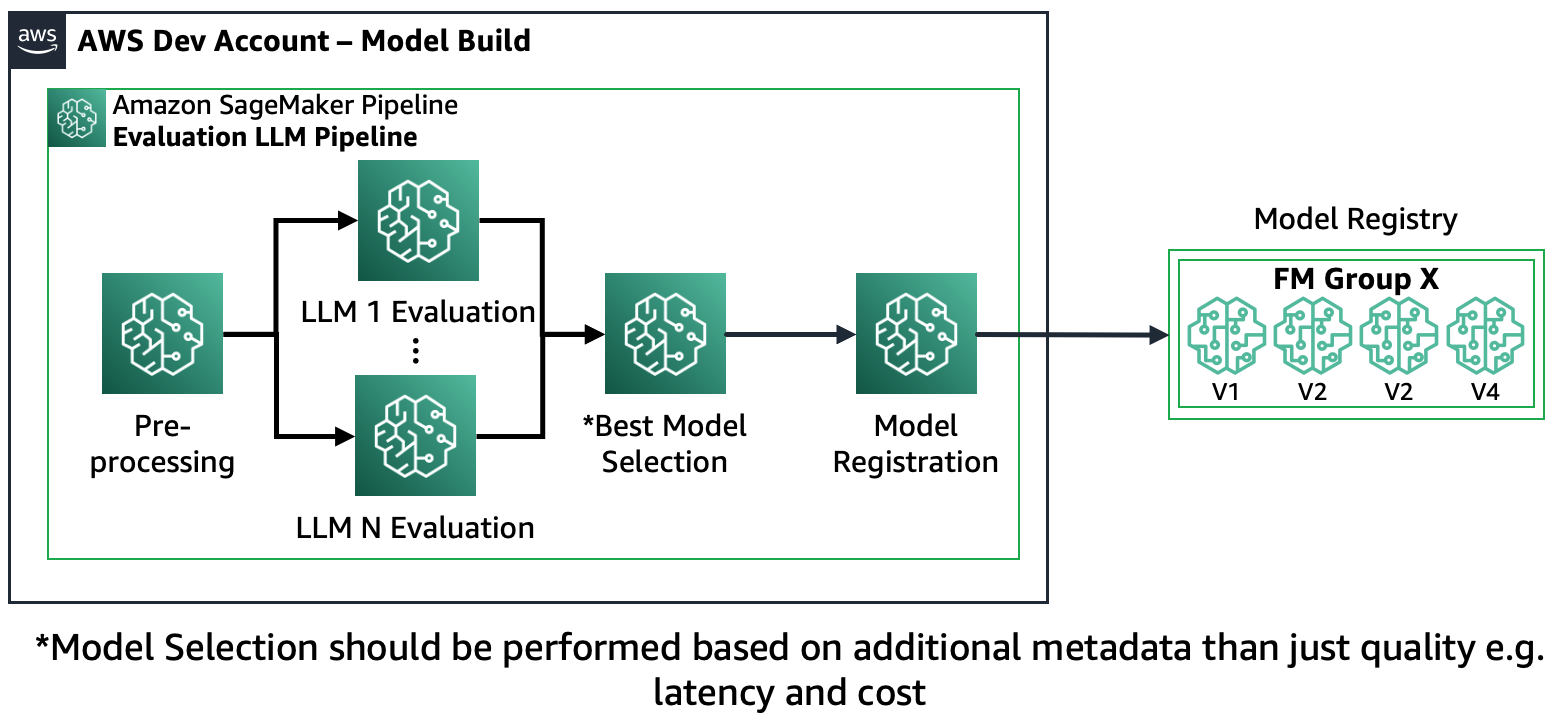

منظر نامہ 1 - متعدد FMs کا اندازہ کریں: اس منظر نامے میں، FMs کاروبار کے استعمال کے معاملے کو فائن ٹیوننگ کے بغیر کور کر سکتے ہیں۔ Amazon SageMaker پائپ لائن درج ذیل مراحل پر مشتمل ہے: ڈیٹا پری پروسیسنگ، متعدد FMs کی متوازی تشخیص، ماڈلز کا موازنہ، اور درستگی اور دیگر خصوصیات جیسے قیمت یا تاخیر، منتخب ماڈل نمونے کی رجسٹریشن، اور میٹا ڈیٹا پر مبنی انتخاب۔

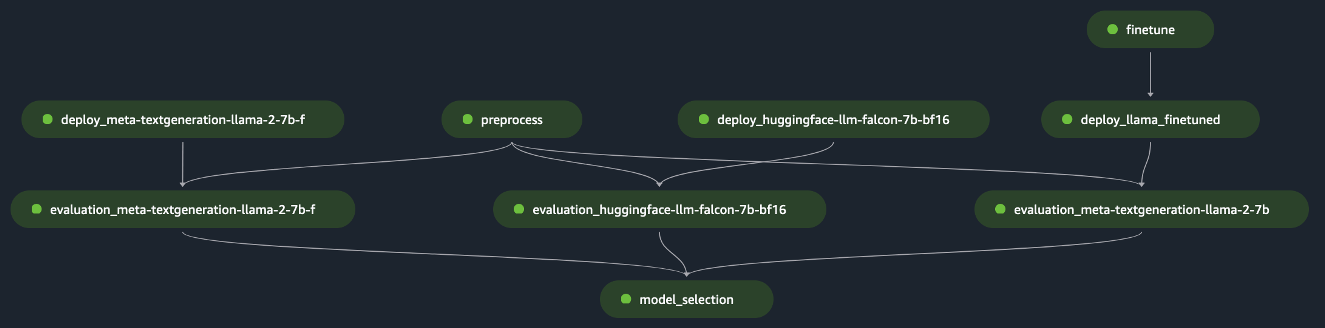

مندرجہ ذیل خاکہ اس فن تعمیر کو واضح کرتا ہے۔

منظر نامہ 2 - ایک سے زیادہ FMs کو ٹھیک بنائیں اور ان کا اندازہ کریں۔: اس منظر نامے میں، Amazon SageMaker پائپ لائن کا ڈھانچہ منظرنامہ 1 کی طرح ہے، لیکن یہ ہر FM کے لیے ٹھیک ٹیوننگ اور تشخیصی مراحل دونوں کے متوازی طور پر چلتی ہے۔ بہترین فائن ٹیون ماڈل کو ماڈل رجسٹری میں رجسٹر کیا جائے گا۔

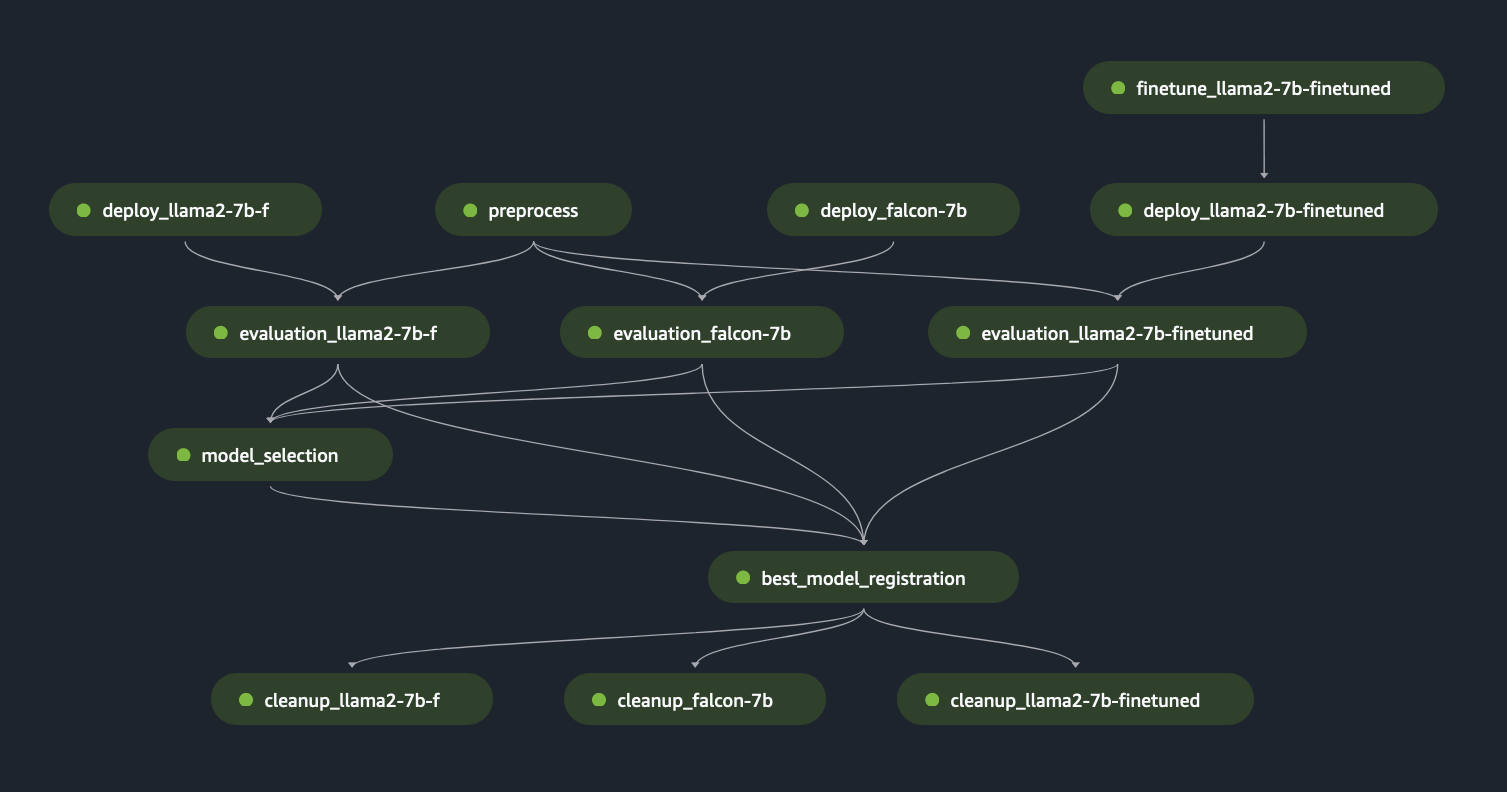

مندرجہ ذیل خاکہ اس فن تعمیر کو واضح کرتا ہے۔

منظر نامہ 3 - متعدد FMs اور ٹھیک ٹیونڈ FMs کا اندازہ کریں۔: یہ منظر عام مقصد کے FMs اور فائن ٹیونڈ FMs کا جائزہ لینے کا ایک مجموعہ ہے۔ اس صورت میں، صارفین یہ دیکھنا چاہتے ہیں کہ آیا ایک عمدہ ماڈل عام مقصد کے FM سے بہتر کارکردگی کا مظاہرہ کر سکتا ہے۔

مندرجہ ذیل اعداد و شمار نتیجے میں SageMaker پائپ لائن کے اقدامات کو ظاہر کرتا ہے۔

نوٹ کریں کہ ماڈل کی رجسٹریشن دو نمونوں کی پیروی کرتی ہے: (a) ایک اوپن سورس ماڈل اور نمونے اسٹور کریں یا (b) ملکیتی FM کا حوالہ اسٹور کریں۔ مزید معلومات کے لیے رجوع کریں۔ FMOps/LLMOps: تخلیقی AI اور MLOps کے ساتھ اختلافات کو فعال کریں۔.

حل جائزہ

پیمانے پر LLM تشخیص میں آپ کے سفر کو تیز کرنے کے لیے، ہم نے ایک ایسا حل بنایا ہے جو Amazon SageMaker Clarify اور نئی Amazon SageMaker Pipelines SDK دونوں کا استعمال کرتے ہوئے منظرناموں کو نافذ کرتا ہے۔ کوڈ کی مثال، بشمول ڈیٹاسیٹس، سورس نوٹ بکس اور سیج میکر پائپ لائنز (اسٹیپس اور ایم ایل پائپ لائن) پر دستیاب ہے۔ GitHub کے. اس مثال کے حل کو تیار کرنے کے لیے، ہم نے دو FMs استعمال کیے ہیں: Llama2 اور Falcon-7B۔ اس پوسٹ میں، ہماری بنیادی توجہ SageMaker پائپ لائن حل کے ان اہم عناصر پر ہے جو تشخیص کے عمل سے متعلق ہیں۔

تشخیص کی ترتیب: تشخیص کے طریقہ کار کو معیاری بنانے کے مقصد کے لیے، ہم نے ایک YAML کنفیگریشن فائل (evaluation_config.yaml) بنائی ہے، جس میں تشخیص کے عمل کے لیے ضروری تفصیلات شامل ہیں بشمول ڈیٹاسیٹ، ماڈل (ماڈل) اور الگورتھم سیج میکر پائپ لائن کا تشخیصی مرحلہ۔ درج ذیل مثال کنفیگریشن فائل کی وضاحت کرتی ہے۔

pipeline: name: "llm-evaluation-multi-models-hybrid" dataset: dataset_name: "trivia_qa_sampled" input_data_location: "evaluation_dataset_trivia.jsonl" dataset_mime_type: "jsonlines" model_input_key: "question" target_output_key: "answer" models: - name: "llama2-7b-f" model_id: "meta-textgeneration-llama-2-7b-f" model_version: "*" endpoint_name: "llm-eval-meta-textgeneration-llama-2-7b-f" deployment_config: instance_type: "ml.g5.2xlarge" num_instances: 1 evaluation_config: output: '[0].generation.content' content_template: [[{"role":"user", "content": "PROMPT_PLACEHOLDER"}]] inference_parameters: max_new_tokens: 100 top_p: 0.9 temperature: 0.6 custom_attributes: accept_eula: True prompt_template: "$feature" cleanup_endpoint: True - name: "falcon-7b" ... - name: "llama2-7b-finetuned" ... finetuning: train_data_path: "train_dataset" validation_data_path: "val_dataset" parameters: instance_type: "ml.g5.12xlarge" num_instances: 1 epoch: 1 max_input_length: 100 instruction_tuned: True chat_dataset: False ... algorithms: - algorithm: "FactualKnowledge" module: "fmeval.eval_algorithms.factual_knowledge" config: "FactualKnowledgeConfig" target_output_delimiter: "<OR>"تشخیص کا مرحلہ: نیا SageMaker پائپ لائن SDK صارفین کو '@step' Python ڈیکوریٹر کا استعمال کرتے ہوئے ML ورک فلو میں حسب ضرورت اقدامات کی وضاحت کرنے کی لچک فراہم کرتا ہے۔ لہذا، صارفین کو ایک بنیادی Python اسکرپٹ بنانے کی ضرورت ہے جو مندرجہ ذیل کے طور پر تشخیص کرتا ہے:

def evaluation(data_s3_path, endpoint_name, data_config, model_config, algorithm_config, output_data_path,): from fmeval.data_loaders.data_config import DataConfig from fmeval.model_runners.sm_jumpstart_model_runner import JumpStartModelRunner from fmeval.reporting.eval_output_cells import EvalOutputCell from fmeval.constants import MIME_TYPE_JSONLINES s3 = boto3.client("s3") bucket, object_key = parse_s3_url(data_s3_path) s3.download_file(bucket, object_key, "dataset.jsonl") config = DataConfig( dataset_name=data_config["dataset_name"], dataset_uri="dataset.jsonl", dataset_mime_type=MIME_TYPE_JSONLINES, model_input_location=data_config["model_input_key"], target_output_location=data_config["target_output_key"], ) evaluation_config = model_config["evaluation_config"] content_dict = { "inputs": evaluation_config["content_template"], "parameters": evaluation_config["inference_parameters"], } serializer = JSONSerializer() serialized_data = serializer.serialize(content_dict) content_template = serialized_data.replace('"PROMPT_PLACEHOLDER"', "$prompt") print(content_template) js_model_runner = JumpStartModelRunner( endpoint_name=endpoint_name, model_id=model_config["model_id"], model_version=model_config["model_version"], output=evaluation_config["output"], content_template=content_template, custom_attributes="accept_eula=true", ) eval_output_all = [] s3 = boto3.resource("s3") output_bucket, output_index = parse_s3_url(output_data_path) for algorithm in algorithm_config: algorithm_name = algorithm["algorithm"] module = importlib.import_module(algorithm["module"]) algorithm_class = getattr(module, algorithm_name) algorithm_config_class = getattr(module, algorithm["config"]) eval_algo = algorithm_class(algorithm_config_class(target_output_delimiter=algorithm["target_output_delimiter"])) eval_output = eval_algo.evaluate(model=js_model_runner, dataset_config=config, prompt_template=evaluation_config["prompt_template"], save=True,) print(f"eval_output: {eval_output}") eval_output_all.append(eval_output) html = markdown.markdown(str(EvalOutputCell(eval_output[0]))) file_index = (output_index + "/" + model_config["name"] + "_" + eval_algo.eval_name + ".html") s3_object = s3.Object(bucket_name=output_bucket, key=file_index) s3_object.put(Body=html) eval_result = {"model_config": model_config, "eval_output": eval_output_all} print(f"eval_result: {eval_result}") return eval_resultسیج میکر پائپ لائن: ڈیٹا پری پروسیسنگ، ماڈل کی تعیناتی اور ماڈل کی تشخیص جیسے ضروری اقدامات بنانے کے بعد، صارف کو SageMaker Pipeline SDK کا استعمال کرتے ہوئے اقدامات کو آپس میں جوڑنے کی ضرورت ہے۔ نیا SDK خود کار طریقے سے مختلف مراحل کے درمیان انحصار کی تشریح کر کے ورک فلو کو پیدا کرتا ہے جب SageMaker پائپ لائن تخلیق API کی درخواست کی جاتی ہے جیسا کہ درج ذیل مثال میں دکھایا گیا ہے:

import os

import argparse

from datetime import datetime import sagemaker

from sagemaker.workflow.pipeline import Pipeline

from sagemaker.workflow.function_step import step

from sagemaker.workflow.step_outputs import get_step # Import the necessary steps

from steps.preprocess import preprocess

from steps.evaluation import evaluation

from steps.cleanup import cleanup

from steps.deploy import deploy from lib.utils import ConfigParser

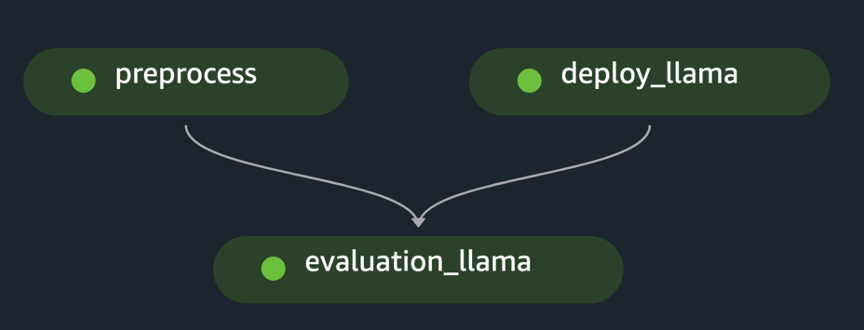

from lib.utils import find_model_by_name if __name__ == "__main__": os.environ["SAGEMAKER_USER_CONFIG_OVERRIDE"] = os.getcwd() sagemaker_session = sagemaker.session.Session() # Define data location either by providing it as an argument or by using the default bucket default_bucket = sagemaker.Session().default_bucket() parser = argparse.ArgumentParser() parser.add_argument("-input-data-path", "--input-data-path", dest="input_data_path", default=f"s3://{default_bucket}/llm-evaluation-at-scale-example", help="The S3 path of the input data",) parser.add_argument("-config", "--config", dest="config", default="", help="The path to .yaml config file",) args = parser.parse_args() # Initialize configuration for data, model, and algorithm if args.config: config = ConfigParser(args.config).get_config() else: config = ConfigParser("pipeline_config.yaml").get_config() evalaution_exec_id = datetime.now().strftime("%Y_%m_%d_%H_%M_%S") pipeline_name = config["pipeline"]["name"] dataset_config = config["dataset"] # Get dataset configuration input_data_path = args.input_data_path + "/" + dataset_config["input_data_location"] output_data_path = (args.input_data_path + "/output_" + pipeline_name + "_" + evalaution_exec_id) print("Data input location:", input_data_path) print("Data output location:", output_data_path) algorithms_config = config["algorithms"] # Get algorithms configuration model_config = find_model_by_name(config["models"], "llama2-7b") model_id = model_config["model_id"] model_version = model_config["model_version"] evaluation_config = model_config["evaluation_config"] endpoint_name = model_config["endpoint_name"] model_deploy_config = model_config["deployment_config"] deploy_instance_type = model_deploy_config["instance_type"] deploy_num_instances = model_deploy_config["num_instances"] # Construct the steps processed_data_path = step(preprocess, name="preprocess")(input_data_path, output_data_path) endpoint_name = step(deploy, name=f"deploy_{model_id}")(model_id, model_version, endpoint_name, deploy_instance_type, deploy_num_instances,) evaluation_results = step(evaluation, name=f"evaluation_{model_id}", keep_alive_period_in_seconds=1200)(processed_data_path, endpoint_name, dataset_config, model_config, algorithms_config, output_data_path,) last_pipeline_step = evaluation_results if model_config["cleanup_endpoint"]: cleanup = step(cleanup, name=f"cleanup_{model_id}")(model_id, endpoint_name) get_step(cleanup).add_depends_on([evaluation_results]) last_pipeline_step = cleanup # Define the SageMaker Pipeline pipeline = Pipeline( name=pipeline_name, steps=[last_pipeline_step], ) # Build and run the Sagemaker Pipeline pipeline.upsert(role_arn=sagemaker.get_execution_role()) # pipeline.upsert(role_arn="arn:aws:iam::<...>:role/service-role/AmazonSageMaker-ExecutionRole-<...>") pipeline.start()مثال ابتدائی ڈیٹا سیٹ کو پہلے سے پروسیس کرنے، ماڈل کی تعیناتی، اور تشخیص کو چلا کر سنگل ایف ایم کی تشخیص کو لاگو کرتی ہے۔ تیار کردہ پائپ لائن ڈائریکٹڈ ایسکلک گراف (DAG) کو درج ذیل شکل میں دکھایا گیا ہے۔

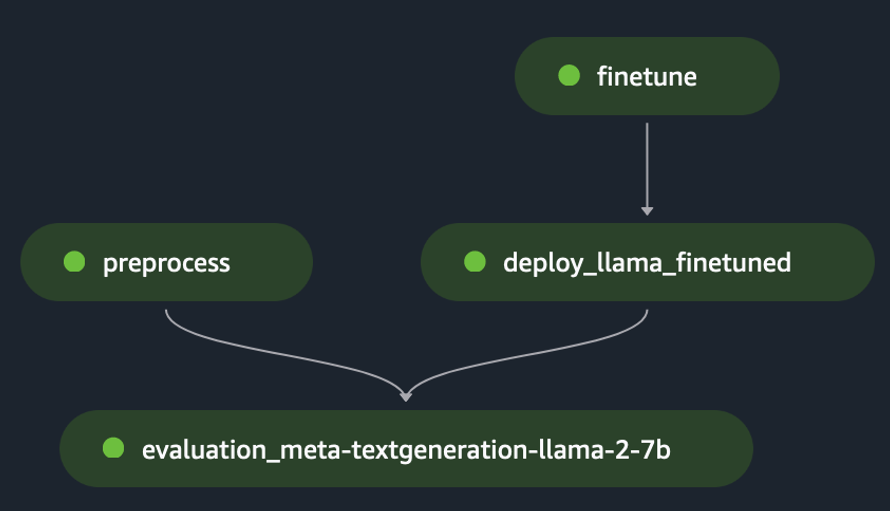

اسی طرح کے نقطہ نظر کی پیروی کرتے ہوئے اور مثال کو استعمال کرتے ہوئے سیج میکر جمپ اسٹارٹ پر ایل ایل اے ایم اے 2 ماڈلز کو ٹھیک بنائیں، ہم نے پائپ لائن کو ایک ٹھیک ٹیونڈ ماڈل کا اندازہ کرنے کے لیے بنایا، جیسا کہ درج ذیل تصویر میں دکھایا گیا ہے۔

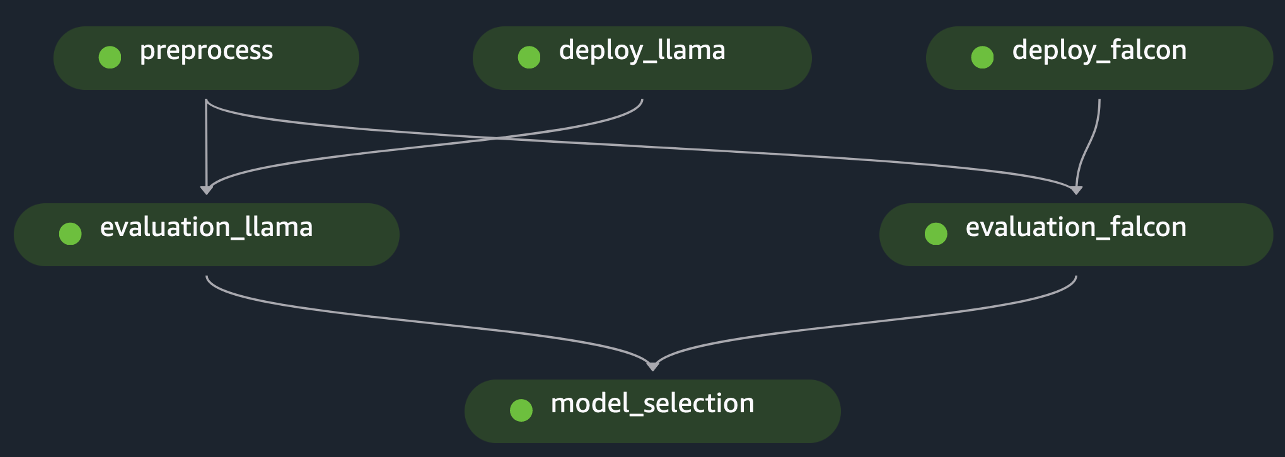

SageMaker پائپ لائن کے پچھلے مراحل کو بطور "لیگو" بلاکس استعمال کرتے ہوئے، ہم نے منظر نامہ 1 اور منظر نامہ 3 کے لیے حل تیار کیا، جیسا کہ درج ذیل اعداد و شمار میں دکھایا گیا ہے۔ خاص طور پر، GitHub کے ریپوزٹری صارف کو متوازی طور پر متعدد FMs کا جائزہ لینے کے قابل بناتا ہے یا فاؤنڈیشن اور فائن ٹیون ماڈل دونوں کی تشخیص کو ملا کر زیادہ پیچیدہ تشخیص انجام دیتا ہے۔

ذخیرہ میں دستیاب اضافی خصوصیات میں درج ذیل شامل ہیں:

- متحرک تشخیص مرحلہ نسل: ہمارا حل کنفیگریشن فائل کی بنیاد پر تمام ضروری تشخیصی اقدامات کو متحرک کرتا ہے تاکہ صارفین کسی بھی ماڈل کی تعداد کا جائزہ لے سکیں۔ ہم نے نئے قسم کے ماڈلز، جیسے کہ Hugging Face یا Amazon Bedrock کے آسان انضمام کو سپورٹ کرنے کے لیے حل کو بڑھا دیا ہے۔

- اختتامی نقطہ کی دوبارہ تعیناتی کو روکیں۔: اگر ایک اختتامی نقطہ پہلے سے موجود ہے تو ہم تعیناتی کے عمل کو چھوڑ دیتے ہیں۔ یہ صارف کو تشخیص کے لیے FMs کے ساتھ اختتامی پوائنٹس کو دوبارہ استعمال کرنے کی اجازت دیتا ہے، جس کے نتیجے میں لاگت کی بچت ہوتی ہے اور تعیناتی کا وقت کم ہوتا ہے۔

- اختتامی نقطہ کی صفائی: تشخیص کی تکمیل کے بعد SageMaker پائپ لائن تعینات کیے گئے اختتامی مقامات کو ختم کر دیتی ہے۔ بہترین ماڈل اینڈ پوائنٹ کو زندہ رکھنے کے لیے اس فعالیت کو بڑھایا جا سکتا ہے۔

- ماڈل کے انتخاب کا مرحلہ: ہم نے ماڈل سلیکشن سٹیپ پلیس ہولڈر شامل کیا ہے جس کے لیے حتمی ماڈل کے انتخاب کی کاروباری منطق کی ضرورت ہوتی ہے، بشمول قیمت یا تاخیر جیسے معیار۔

- ماڈل رجسٹریشن کا مرحلہ: بہترین ماڈل کو ایک مخصوص ماڈل گروپ کے نئے ورژن کے طور پر Amazon SageMaker ماڈل رجسٹری میں رجسٹر کیا جا سکتا ہے۔

- گرم تالاب: سیج میکر کے زیر انتظام گرم تالاب آپ کو کام کی تکمیل کے بعد فراہم کردہ انفراسٹرکچر کو برقرار رکھنے اور دوبارہ استعمال کرنے دیتے ہیں تاکہ بار بار کام کے بوجھ میں تاخیر کو کم کیا جا سکے۔

مندرجہ ذیل اعداد و شمار ان صلاحیتوں اور ایک کثیر ماڈل تشخیصی مثال کو واضح کرتا ہے جسے صارف اس میں ہمارے حل کا استعمال کرتے ہوئے آسانی سے اور متحرک طور پر تخلیق کر سکتے ہیں۔ GitHub کے ذخیرہ.

ہم نے جان بوجھ کر ڈیٹا کی تیاری کو دائرہ کار سے باہر رکھا کیونکہ اسے گہرائی میں ایک مختلف پوسٹ میں بیان کیا جائے گا، بشمول فوری کیٹلاگ ڈیزائن، پرامپٹ ٹیمپلیٹس، فوری اصلاح۔ مزید معلومات اور متعلقہ اجزاء کی تعریف کے لیے، رجوع کریں۔ FMOps/LLMOps: تخلیقی AI اور MLOps کے ساتھ اختلافات کو فعال کریں۔.

نتیجہ

اس پوسٹ میں، ہم نے Amazon SageMaker Clarify LLM تشخیصی صلاحیتوں اور Amazon SageMaker پائپ لائنز کا استعمال کرتے ہوئے پیمانے پر LLMs کی تشخیص کو خودکار اور فعال کرنے کے طریقے پر توجہ مرکوز کی۔ نظریاتی فن تعمیر کے ڈیزائن کے علاوہ، ہمارے پاس اس میں مثال کوڈ ہے۔ GitHub کے ریپوزٹری (جس میں Llama2 اور Falcon-7B FMs شامل ہیں) تاکہ صارفین کو ان کے اپنے توسیع پذیر تشخیصی میکانزم تیار کرنے کے قابل بنایا جا سکے۔

مندرجہ ذیل مثال ماڈل کی تشخیص کے فن تعمیر کو ظاہر کرتی ہے۔

اس پوسٹ میں، ہم نے ایل ایل ایم کی تشخیص کو پیمانے پر چلانے پر توجہ مرکوز کی جیسا کہ مثال کے بائیں جانب دکھایا گیا ہے۔ مستقبل میں، ہم مثالیں تیار کرنے پر توجہ مرکوز کریں گے جس میں بیان کردہ رہنما خطوط پر عمل کرتے ہوئے FMs کی پیداوار سے آخر تک کے لائف سائیکل کو پورا کیا جائے گا۔ FMOps/LLMOps: تخلیقی AI اور MLOps کے ساتھ اختلافات کو فعال کریں۔. اس میں LLM سرونگ، مانیٹرنگ، آؤٹ پٹ ریٹنگ کا ذخیرہ شامل ہے جو آخر کار خودکار دوبارہ تشخیص اور فائن ٹیوننگ کو متحرک کرے گا اور آخر کار، لیبل لگے ہوئے ڈیٹا یا پرامپٹس کیٹلاگ پر کام کرنے کے لیے انسانوں کے اندر لوپ کا استعمال کرے گا۔

مصنفین کے بارے میں

ڈاکٹر سوکرتیس کارتکیس ایمیزون ویب سروسز کے لیے پرنسپل مشین لرننگ اور آپریشنز کے ماہر حل آرکیٹیکٹ ہیں۔ Sokratis انٹرپرائز صارفین کو اپنی مشین لرننگ (ML) اور جنریٹیو AI سلوشنز کو AWS سروسز سے فائدہ اٹھا کر اور ان کے آپریٹنگ ماڈل، یعنی MLOps/FMOps/LLMOps فاؤنڈیشنز، اور ترقی کے بہترین طریقوں سے فائدہ اٹھاتے ہوئے تبدیلی کا روڈ میپ تشکیل دینے کے قابل بنانے پر توجہ مرکوز کرتا ہے۔ اس نے توانائی، خوردہ، صحت، مالیات، موٹر سپورٹس وغیرہ کے ڈومینز میں جدید اختتام سے آخر تک پیداوار کی سطح کے ML اور AI سلوشنز کی ایجاد، ڈیزائننگ، رہنمائی اور نفاذ پر 15+ سال گزارے ہیں۔

ڈاکٹر سوکرتیس کارتکیس ایمیزون ویب سروسز کے لیے پرنسپل مشین لرننگ اور آپریشنز کے ماہر حل آرکیٹیکٹ ہیں۔ Sokratis انٹرپرائز صارفین کو اپنی مشین لرننگ (ML) اور جنریٹیو AI سلوشنز کو AWS سروسز سے فائدہ اٹھا کر اور ان کے آپریٹنگ ماڈل، یعنی MLOps/FMOps/LLMOps فاؤنڈیشنز، اور ترقی کے بہترین طریقوں سے فائدہ اٹھاتے ہوئے تبدیلی کا روڈ میپ تشکیل دینے کے قابل بنانے پر توجہ مرکوز کرتا ہے۔ اس نے توانائی، خوردہ، صحت، مالیات، موٹر سپورٹس وغیرہ کے ڈومینز میں جدید اختتام سے آخر تک پیداوار کی سطح کے ML اور AI سلوشنز کی ایجاد، ڈیزائننگ، رہنمائی اور نفاذ پر 15+ سال گزارے ہیں۔

جگدیپ سنگھ سونی۔ نیدرلینڈ میں مقیم AWS میں سینئر پارٹنر سلوشنز آرکیٹیکٹ ہیں۔ وہ سسٹم انٹیگریٹرز اور ٹیکنالوجی پارٹنرز دونوں کی مدد کے لیے DevOps، GenAI اور بلڈر ٹولز کے لیے اپنے جذبے کا استعمال کرتا ہے۔ جگدیپ اپنی ٹیم کے اندر جدت لانے اور نئی ٹیکنالوجیز کو فروغ دینے کے لیے اپنی ایپلیکیشن ڈویلپمنٹ اور فن تعمیر کے پس منظر کا اطلاق کرتا ہے۔

جگدیپ سنگھ سونی۔ نیدرلینڈ میں مقیم AWS میں سینئر پارٹنر سلوشنز آرکیٹیکٹ ہیں۔ وہ سسٹم انٹیگریٹرز اور ٹیکنالوجی پارٹنرز دونوں کی مدد کے لیے DevOps، GenAI اور بلڈر ٹولز کے لیے اپنے جذبے کا استعمال کرتا ہے۔ جگدیپ اپنی ٹیم کے اندر جدت لانے اور نئی ٹیکنالوجیز کو فروغ دینے کے لیے اپنی ایپلیکیشن ڈویلپمنٹ اور فن تعمیر کے پس منظر کا اطلاق کرتا ہے۔

ڈاکٹر ریکارڈو گیٹی اٹلی میں مقیم ایک سینئر اسٹارٹ اپ سولیوشن آرکیٹیکٹ ہے۔ وہ صارفین کے لیے ایک تکنیکی مشیر ہے، جو ان کے کاروبار کو بڑھانے کے لیے درست ٹولز اور ٹیکنالوجیز کو اختراع کرنے، تیزی سے پیمانے اور منٹوں میں عالمی سطح پر جانے میں مدد کرتا ہے۔ وہ ہمیشہ ہی مشین لرننگ اور جنریٹیو AI کے بارے میں پرجوش رہا ہے، اس نے اپنے کام کے دوران مختلف ڈومینز میں ان ٹیکنالوجیز کا مطالعہ کیا اور ان کا اطلاق کیا۔ وہ AWS اطالوی پوڈ کاسٹ "Casa Startup" کے میزبان اور ایڈیٹر ہیں، جو اسٹارٹ اپ کے بانیوں کی کہانیوں اور نئے تکنیکی رجحانات کے لیے وقف ہیں۔

ڈاکٹر ریکارڈو گیٹی اٹلی میں مقیم ایک سینئر اسٹارٹ اپ سولیوشن آرکیٹیکٹ ہے۔ وہ صارفین کے لیے ایک تکنیکی مشیر ہے، جو ان کے کاروبار کو بڑھانے کے لیے درست ٹولز اور ٹیکنالوجیز کو اختراع کرنے، تیزی سے پیمانے اور منٹوں میں عالمی سطح پر جانے میں مدد کرتا ہے۔ وہ ہمیشہ ہی مشین لرننگ اور جنریٹیو AI کے بارے میں پرجوش رہا ہے، اس نے اپنے کام کے دوران مختلف ڈومینز میں ان ٹیکنالوجیز کا مطالعہ کیا اور ان کا اطلاق کیا۔ وہ AWS اطالوی پوڈ کاسٹ "Casa Startup" کے میزبان اور ایڈیٹر ہیں، جو اسٹارٹ اپ کے بانیوں کی کہانیوں اور نئے تکنیکی رجحانات کے لیے وقف ہیں۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/operationalize-llm-evaluation-at-scale-using-amazon-sagemaker-clarify-and-mlops-services/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 1

- 100

- 7

- 9

- a

- ہمارے بارے میں

- رفتار کو تیز تر

- تک رسائی حاصل

- درستگی

- درست طریقے سے

- حاصل

- حصول

- کے پار

- ایکٹ

- چالو کرنے کی

- فعال

- تیزابیت

- شامل کیا

- اس کے علاوہ

- اس کے علاوہ

- پتہ

- مناسب

- انتظامیہ

- اپنانے

- منہ بولابیٹا بنانے

- ترقی

- مشیر

- کے بعد

- کے خلاف

- ایجنٹ

- AI

- اے آئی ایکٹ

- اے آئی سسٹمز

- مقصد

- مقصد

- یلگورتم

- یلگوردمز

- سیدھ میں لائیں

- زندہ

- تمام

- کی اجازت دیتا ہے

- پہلے ہی

- بھی

- ہمیشہ

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون سیج میکر جمپ اسٹارٹ

- ایمیزون سیج میکر پائپ لائنز

- ایمیزون سیج میکر اسٹوڈیو

- ایمیزون ویب سروسز

- an

- تجزیے

- اور

- ایک اور

- جواب

- کوئی بھی

- اے پی آئی

- درخواست

- درخواست کی ترقی

- ایپلی کیشنز

- اطلاقی

- لاگو ہوتا ہے

- نقطہ نظر

- مناسب

- فن تعمیر

- کیا

- علاقوں

- دلیل

- AS

- تشخیص کریں

- اندازہ

- تشخیص

- جائزوں

- At

- آڈیٹنگ

- خود کار طریقے سے

- آٹومیٹڈ

- خودکار

- خود کار طریقے سے

- میشن

- دستیاب

- AWS

- پس منظر

- کی بنیاد پر

- بنیادی

- BE

- کیونکہ

- بن

- رہا

- رویے

- معیار

- بینچ مارک

- معیارات

- فوائد

- BEST

- بہتر

- کے درمیان

- سے پرے

- تعصب

- باصلاحیت

- باضابطہ

- بلاکس

- دونوں

- خلاف ورزیوں

- چوڑائی

- لانے

- تعمیر

- بلڈر

- کاروبار

- لیکن

- by

- کہا جاتا ہے

- کالز

- کر سکتے ہیں

- امیدوار

- صلاحیتوں

- صلاحیت رکھتا

- قبضہ

- کارڈ

- کیریئر کے

- کیس

- مقدمات

- کیٹلوگ

- کچھ

- چیلنج

- خصوصیات

- سستی

- چیک کریں

- میں سے انتخاب کریں

- منتخب کیا

- درجہ بندی

- درجہ بندی کرنا۔

- صاف

- کوڈ

- ہم آہنگ

- تعاون

- مجموعہ

- امتزاج

- کامن

- کمیونٹی

- موازنہ

- موازنہ

- مقابلے میں

- موازنہ

- مکمل

- تکمیل

- پیچیدہ

- پیچیدگی

- تعمیل

- عمل

- جزو

- اجزاء

- پر مشتمل ہے

- کمپیوٹیشنل

- کمپیوٹنگ

- تصور

- اندیشہ

- سلوک

- چل رہا ہے

- انعقاد کرتا ہے

- ترتیب

- رابطہ قائم کریں

- جڑتا

- سمجھا

- مشتمل

- تعمیر

- صارفین

- کنٹینر

- پر مشتمل ہے

- مواد

- مواد پیدا کرنا

- سیاق و سباق

- مسلسل

- مسلسل

- اس کے برعکس

- سنوادی

- مکالمات

- تبدیل

- درست

- قیمت

- لاگت کی بچت

- مہنگی

- اخراجات

- احاطہ

- تخلیق

- بنائی

- تخلیق

- مخلوق

- معیار

- اہم

- اہم

- اپنی مرضی کے

- گاہکوں

- ماؤنٹین

- اعداد و شمار

- ڈیٹا کی تیاری

- ڈیٹا سائنسدان

- ڈیٹا کی حفاظت

- ڈیٹا سیٹ

- ڈیٹا ٹمپرنگ

- ڈیٹاسیٹس

- تاریخ کے وقت

- فیصلہ کرنا

- فیصلہ کرنا

- فیصلے

- وقف

- گہری

- گہری ڈبکی

- پہلے سے طے شدہ

- وضاحت

- تعریفیں

- فراہم کرتا ہے

- ڈیمانڈ

- انحصار

- انحصار کرتا ہے

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- گہرائی

- بیان کیا

- نامزد

- ڈیزائن

- ڈیزائننگ

- ڈیزائن

- خواہش

- مطلوبہ

- تفصیلی

- تفصیلات

- ترقی

- ترقی یافتہ

- ترقی

- ترقی

- اختلافات

- مختلف

- براہ راست

- ہدایت

- ڈوبکی

- متنوع

- do

- نہیں کرتا

- ڈومین

- ڈومینز

- ڈرائیو

- کے دوران

- متحرک طور پر

- e

- ہر ایک

- آسانی سے

- آسان

- ایڈیٹر

- موثر

- تاثیر

- ہنر

- مؤثر طریقے سے

- کوشش

- یا تو

- عناصر

- اور

- ملازم

- کو چالو کرنے کے

- کے قابل بناتا ہے

- کو فعال کرنا

- آخر سے آخر تک

- اختتام پوائنٹ

- توانائی

- انجینئرز

- بڑھانے کے

- کو یقینی بنانے کے

- یقینی بناتا ہے

- کو یقینی بنانے ہے

- انٹرپرائز

- اداروں

- عہد

- یکساں طور پر

- خاص طور پر

- ضروری

- وغیرہ

- EU

- اندازہ

- اندازہ

- کا جائزہ لینے

- تشخیص

- بھی

- آخر میں

- مثال کے طور پر

- مثال کے طور پر

- ایگزیکٹو

- موجودہ

- توقعات

- توقع

- تیز کریں

- استحصال کرنا

- توسیع

- توسیع

- بیرونی

- نکالنے

- f1

- چہرہ

- سہولت

- عوامل

- انصاف

- آبشار

- جھوٹی

- مشہور

- فاسٹ

- تیز تر

- نمایاں کریں

- خاصیت

- آراء

- چند

- میدان

- اعداد و شمار

- اعداد و شمار

- فائل

- فائنل

- آخر

- کی مالی اعانت

- مالی

- مالیاتی شعبے

- پہلا

- لچک

- توجہ مرکوز

- توجہ مرکوز

- توجہ مرکوز

- پیچھے پیچھے

- کے بعد

- مندرجہ ذیل ہے

- کے لئے

- فارم

- فاؤنڈیشن

- بنیادیں

- بانیوں

- فریم ورک

- فریم ورک

- اکثر

- سے

- پورا

- مکمل

- افعال

- فعالیت

- بنیادی

- مزید برآں

- مستقبل

- جمع

- جنرل

- عام مقصد

- پیدا

- پیدا

- پیدا ہوتا ہے

- پیدا کرنے والے

- نسل

- پیداواری

- پیداواری AI۔

- حاصل

- دی

- گلوبل

- Go

- عطا

- گراف

- گروپ

- گروپ کا

- بڑھتے ہوئے

- ہاتھ

- نقصان دہ

- استعمال کرنا

- ہے

- ہونے

- he

- صحت

- بھاری

- مدد

- مدد

- مدد کرتا ہے

- ہائی

- اعلی خطرہ

- قبضہ

- ان

- انعقاد

- میزبان

- کس طرح

- کیسے

- تاہم

- HTML

- HTTPS

- انسانی

- i

- کی نشاندہی

- شناخت

- شناخت

- if

- وضاحت کرتا ہے

- تصاویر

- پر عملدرآمد

- پر عمل درآمد

- عمل

- درآمد

- اہمیت

- بہتری

- بہتری

- in

- شامل

- شامل ہیں

- سمیت

- شامل

- شامل کرنا

- انڈیکیٹر

- صنعتوں

- معلومات

- مطلع

- انفراسٹرکچر

- ابتدائی

- اختراعات

- جدت طرازی

- جدید

- ان پٹ

- آدانوں

- ضم

- انضمام

- جان بوجھ کر

- بات چیت

- اندرونی

- میں

- متعارف کرانے

- درخواست کی

- شامل

- ملوث

- شامل

- ISO

- IT

- اطالوی

- اٹلی

- اشیاء

- تکرار

- میں

- ایوب

- سفر

- فوٹو

- رکھیں

- رکھی

- کلیدی

- علم

- زبان

- بڑے

- بڑے

- آخری

- آخر میں

- تاخیر

- قیادت

- لیڈر بورڈ

- معروف

- سیکھنے

- سیکھتا ہے

- چھوڑ دیا

- دو

- لیورنگنگ

- لائبریری

- زندگی کا دورانیہ

- کی طرح

- لمیٹڈ

- LINK

- لاما

- ایل ایل ایم

- محل وقوع

- منطق

- لو

- مشین

- مشین لرننگ

- مین

- برقرار رکھنے کے

- برقرار رکھتا ہے

- میں کامیاب

- جوڑ توڑ

- ہراساں کرنا

- دستی

- بہت سے

- مئی..

- دریں اثناء

- پیمائش

- اقدامات

- نظام

- میٹا ڈیٹا

- طریقہ

- طریقوں

- میٹرک۔

- پیمائش کا معیار

- منٹ

- غلط معلومات

- تخفیف کریں

- تخفیف کرنا

- ML

- ایم ایل اوپس

- ماڈل

- ماڈل

- ماڈیول

- کی نگرانی

- نگرانی

- زیادہ

- سب سے زیادہ

- حوصلہ افزائی

- Motorsports

- بہت

- ایک سے زیادہ

- ضروری

- نام

- ضروری

- ضرورت ہے

- ضروریات

- نیدرلینڈ

- نئی

- نئی ٹیکنالوجی

- اگلے

- غیر ماہرین

- براہ مہربانی نوٹ کریں

- نوٹ بک

- شیڈنگ

- تعداد

- of

- پیش کرتے ہیں

- اکثر

- on

- ایک بار

- ایک

- جاری

- صرف

- اوپن سورس

- کام

- آپریشن

- آپریشنز

- رائے

- اصلاح کے

- or

- OS

- دیگر

- ہمارے

- باہر

- نتائج

- نتائج

- پیداوار

- نتائج

- بقایا

- پر

- مجموعی طور پر

- خود

- مالکان

- متوازی

- پیرامیٹرز

- خاص طور پر

- خاص طور پر

- پارٹنر

- شراکت داروں کے

- جذبہ

- جذباتی

- راستہ

- پیٹرن

- لوگ

- انجام دیں

- کارکردگی

- پرفارمنس

- کارکردگی کا مظاہرہ

- مرحلہ

- پائپ لائن

- مقام

- پلیس ہولڈر

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- پی او سی

- podcast

- پوائنٹ

- پول

- پول

- پوسٹ

- ممکنہ

- طاقت

- طاقت

- طریقوں

- صحت سے متعلق

- تیاری

- کی تیاری

- کی موجودگی

- کی روک تھام

- پچھلا

- پرائمری

- پرنسپل

- اصولوں پر

- کی رازداری

- نجی

- مسئلہ

- طریقہ کار

- عمل

- عمل

- پروسیسنگ

- پیداوار

- بڑھنے

- اہمیت

- وعدہ

- کو فروغ دینا

- اشارہ کرتا ہے

- ثبوت

- تصور کا ثبوت

- خصوصیات

- ملکیت

- حفاظت

- ثابت کریں

- فراہم

- فراہم کرنے والے

- فراہم کرتا ہے

- فراہم کرنے

- عوامی

- عوامی طور پر

- مقصد

- ازگر

- قابلیت

- معیار

- مقدار کی

- سوال

- رینج

- شرح

- درجہ بندی

- اصلی

- حقیقی دنیا

- اصل وقت

- کو کم

- کم

- کو کم کرنے

- کا حوالہ دیتے ہیں

- حوالہ

- رجسٹرڈ

- رجسٹریشن

- رجسٹری

- باقاعدہ

- باضابطہ

- ریگولیٹڈ صنعتیں

- ضابطے

- متعلقہ

- مطابقت

- متعلقہ

- وشوسنییتا

- بار بار

- رپورٹ

- رپورٹ

- رپورٹیں

- ذخیرہ

- نمائندے

- ضرورت

- کی ضرورت ہے

- تحقیق

- محققین

- وسائل سے متعلق

- وسائل

- ذمہ داری

- ذمہ دار

- نتیجے

- نتائج کی نمائش

- خوردہ

- برقرار رکھنے

- واپسی

- دوبارہ استعمال

- کا جائزہ لینے کے

- انقلاب ساز

- ٹھیک ہے

- سخت

- طلوع

- رسک

- خطرات

- سڑک موڈ

- مضبوط

- مضبوطی

- کردار

- کردار

- رن

- چل رہا ہے

- چلتا ہے

- s

- محفوظ

- تحفظات

- sagemaker

- سیج میکر پائپ لائنز

- بچت

- اسکیل ایبلٹی

- توسیع پذیر

- پیمانے

- منظر نامے

- منظرنامے

- سائنسدان

- سائنسدانوں

- گنجائش

- سکور

- اسکرپٹ

- sdk

- بغیر کسی رکاوٹ کے

- سیکشنز

- شعبے

- محفوظ بنانے

- سیکورٹی

- سیکورٹی خطرات

- منتخب

- منتخب

- منتخب

- انتخاب

- سینئر

- جذبات

- خدمت

- سروس

- سروسز

- خدمت

- اجلاس

- مقرر

- تشکیل دینا۔

- سیکنڈ اور

- دکھائیں

- دکھایا گیا

- شوز

- کی طرف

- اہم

- اسی طرح

- آسان بناتا ہے۔

- صرف

- بعد

- ایک

- چھوٹے

- حل

- حل

- حل

- کچھ

- ماخذ

- دورانیہ

- ماہر

- مخصوص

- خاص طور پر

- خرچ

- کھینچنا

- اسٹیک ہولڈرز

- مانکیکرن

- معیار

- اسٹینفورڈ

- شروع

- شروع ہوتا ہے

- شروع

- درجہ

- مرحلہ

- مراحل

- ابھی تک

- ذخیرہ

- ذخیرہ

- خبریں

- ذخیرہ کرنے

- براہ راست

- منظم

- تعلیم حاصل کی

- سٹوڈیو

- سٹائل

- بعد میں

- اس طرح

- خلاصہ

- حمایت

- کے نظام

- سسٹمز

- پگھلنے

- ٹاسک

- کاموں

- ٹیم

- ٹیموں

- ٹیکنیکل

- تکنیک

- تکنیکی

- ٹیکنالوجی

- ٹیکنالوجی

- سانچے

- ٹیسٹ

- ٹیسٹر۔

- ٹیسٹنگ

- ٹیسٹ

- متن

- سے

- کہ

- ۔

- مستقبل

- ان

- ان

- تو

- نظریاتی

- اس طرح

- لہذا

- یہ

- وہ

- اس

- ان

- تین

- کے ذریعے

- بھر میں

- وقت

- کرنے کے لئے

- مل کر

- کے آلے

- اوزار

- ٹریک

- ٹرین

- تربیت یافتہ

- ٹریننگ

- ٹرینوں

- تبدیلی

- منتقلی

- منتقلی

- ترجمہ

- رجحانات

- ٹرگر

- سچ

- قابل اعتماد

- دو

- اقسام

- ٹھیٹھ

- آخر میں

- غیر مجاز

- سمجھ

- افہام و تفہیم

- بے مثال

- آئندہ

- استعمال کی شرائط

- استعمال کیس

- استعمال کیا جاتا ہے

- رکن کا

- صارفین

- استعمال

- کا استعمال کرتے ہوئے

- عام طور پر

- استعمال

- تصدیق کریں۔

- قیمتی

- مختلف

- ورژن

- ورژن

- کی طرف سے

- اہم

- نقصان دہ

- چاہتے ہیں

- گرم

- we

- ویب

- ویب خدمات

- اچھا ہے

- تھے

- کیا

- جب

- جس

- جبکہ

- ڈبلیو

- وسیع

- وسیع رینج

- وکیپیڈیا

- گے

- ساتھ

- کے اندر

- بغیر

- کام

- کام کا بہاؤ

- کام کر

- دنیا

- یامل

- سال

- پیداوار

- تم

- اور

- زیفیرنیٹ