ڈیٹا سائنسدانوں کے لیے، مشین لرننگ (ML) ماڈلز کو تصور کے ثبوت سے پیداوار تک منتقل کرنا اکثر ایک اہم چیلنج پیش کرتا ہے۔ اہم چیلنجوں میں سے ایک اچھی کارکردگی کا مظاہرہ کرنے والے، مقامی طور پر تربیت یافتہ ماڈل کو کلاؤڈ پر لگانا اور دیگر ایپلی کیشنز میں استعمال کرنا ہو سکتا ہے۔ اس عمل کو منظم کرنا بوجھل ہو سکتا ہے، لیکن صحیح ٹول کے ساتھ، آپ مطلوبہ کوشش کو نمایاں طور پر کم کر سکتے ہیں۔

ایمیزون سیج میکر کا اندازہ، جسے عام طور پر اپریل 2022 میں دستیاب کیا گیا تھا، آپ کے لیے ML ماڈلز کو پیداوار میں تعینات کرنا آسان بناتا ہے تاکہ پیمانے پر پیشین گوئیاں کی جا سکیں، ML انفراسٹرکچر اور ماڈل کی تعیناتی کے اختیارات کا وسیع انتخاب فراہم کرتے ہوئے تمام قسم کے ML تخمینہ کی ضروریات کو پورا کرنے میں مدد ملے۔ آپ استعمال کر سکتے ہیں سیج میکر سرور لیس انفرنس اینڈ پوائنٹس کام کے بوجھ کے لیے جن میں ٹریفک کی تیز رفتاری کے درمیان وقفہ وقفہ ہوتا ہے اور وہ سردی کے آغاز کو برداشت کر سکتے ہیں۔ اختتامی پوائنٹس ٹریفک کی بنیاد پر خود بخود اسکیل ہو جاتے ہیں اور سرورز کو منتخب کرنے اور ان کے نظم و نسق کی غیر متفرق ہیوی لفٹنگ کو چھین لیتے ہیں۔ اس کے علاوہ، آپ استعمال کر سکتے ہیں او ڈبلیو ایس لامبڈا۔ براہ راست اپنے ماڈلز کو بے نقاب کرنے اور اپنے پسندیدہ اوپن سورس فریم ورک کا استعمال کرتے ہوئے اپنی ML ایپلیکیشنز کو تعینات کرنے کے لیے، جو زیادہ لچکدار اور سرمایہ کاری مؤثر ثابت ہو سکتا ہے۔

فاسٹ اے پی آئی Python کے ساتھ APIs بنانے کے لیے ایک جدید، اعلیٰ کارکردگی والا ویب فریم ورک ہے۔ یہ اس وقت نمایاں ہوتا ہے جب بات RESTful مائیکرو سروسز کے ساتھ سرور لیس ایپلی کیشنز تیار کرنے کی ہوتی ہے اور متعدد صنعتوں میں پیمانے پر ML تخمینہ کی ضرورت ہوتی ہے۔ اس کی آسانی اور خودکار API دستاویزات جیسے بلٹ ان فنکشنلٹیز اسے ML انجینئرز کے درمیان اعلی کارکردگی کا اندازہ لگانے والے APIs کے لیے ایک مقبول انتخاب بناتی ہیں۔ آپ فاسٹ اے پی آئی سے باہر کی فنکشنلٹیز کا استعمال کرتے ہوئے اپنے راستوں کی وضاحت اور ترتیب دے سکتے ہیں تاکہ ضرورت کے مطابق بڑھتے ہوئے کاروباری منطق کو بڑھایا جا سکے، مقامی طور پر جانچ کر سکیں اور اسے لیمبڈا پر ہوسٹ کر سکیں، پھر اسے ایک API گیٹ وے کے ذریعے بے نقاب کریں، جو آپ کو اجازت دیتا ہے۔ اپنے کوڈز کو بغیر کسی بھاری لفٹنگ یا ری فیکٹرنگ کے Lambda پر ایک اوپن سورس ویب فریم ورک لائیں۔

یہ پوسٹ آپ کو دکھاتی ہے کہ فاسٹ اے پی آئی، ڈوکر، لیمبڈا، اور استعمال کرتے ہوئے اپنے ایم ایل ماڈل کو اینڈ پوائنٹ کے طور پر بے نقاب کرکے سرور لیس ایم ایل انفرنس کو آسانی سے کیسے تعینات اور چلانا ہے۔ ایمیزون API گیٹ وے. ہم آپ کو یہ بھی دکھاتے ہیں کہ کس طرح کا استعمال کرتے ہوئے تعیناتی کو خودکار کرنا ہے۔ AWS کلاؤڈ ڈویلپمنٹ کٹ (AWS CDK)۔

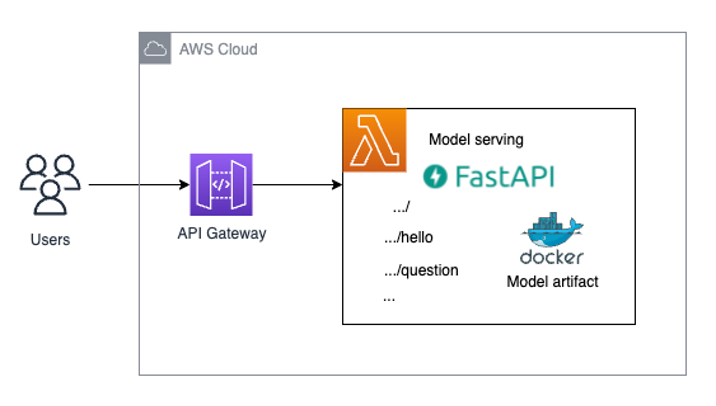

حل جائزہ

درج ذیل خاکہ اس حل کے فن تعمیر کو ظاہر کرتا ہے جسے ہم اس پوسٹ میں تعینات کرتے ہیں۔

شرائط

آپ کے پاس درج ذیل شرائط ہونی چاہئیں:

- Python3 کے ساتھ انسٹال ہوا۔

virtualenvPython میں ورچوئل ماحول بنانے اور ان کا انتظام کرنے کے لیے - AWS CDK CLI استعمال کرنے کے قابل ہونے کے لیے آپ کے سسٹم پر aws-cdk v2 انسٹال ہوا ہے۔

- ڈوکر آپ کی مقامی مشین پر انسٹال اور چل رہا ہے۔

جانچ کریں کہ آیا تمام ضروری سافٹ ویئر انسٹال ہے:

- ۔ AWS کمانڈ لائن انٹرفیس (AWS CLI) کی ضرورت ہے۔ اپنے اکاؤنٹ میں لاگ ان کریں اور وہ علاقہ منتخب کریں جہاں آپ حل کو تعینات کرنا چاہتے ہیں۔

- اپنا Python ورژن چیک کرنے کے لیے درج ذیل کوڈ کا استعمال کریں:

- اگر چیک کریں

virtualenvPython میں ورچوئل ماحول بنانے اور ان کا انتظام کرنے کے لیے انسٹال کیا گیا ہے۔ سخت الفاظ میں، یہ کوئی سخت ضرورت نہیں ہے، لیکن یہ آپ کی زندگی کو آسان بنا دے گا اور اس پوسٹ کے ساتھ ساتھ زیادہ آسانی سے پیروی کرنے میں مدد کرتا ہے۔ درج ذیل کوڈ کا استعمال کریں: - چیک کریں کہ آیا سی ڈی کے انسٹال ہے۔ یہ ہمارے حل کو تعینات کرنے کے لیے استعمال کیا جائے گا۔

- چیک کریں کہ آیا ڈوکر انسٹال ہے۔ ہمارا حل آپ کے ماڈل کو Docker امیج کے ذریعے Lambda تک قابل رسائی بنائے گا۔ اس تصویر کو مقامی طور پر بنانے کے لیے، ہمیں Docker کی ضرورت ہے۔

- یقینی بنائیں کہ ڈوکر مندرجہ ذیل کوڈ کے ساتھ چل رہا ہے:

AWS CDK کا استعمال کرتے ہوئے اپنے FastAPI پروجیکٹ کی ساخت کیسے بنائیں

ہم اپنے پروجیکٹ کے لیے درج ذیل ڈائریکٹری ڈھانچہ استعمال کرتے ہیں (کچھ بوائلر پلیٹ AWS CDK کوڈ کو نظر انداز کرتے ہوئے جو اس پوسٹ کے تناظر میں غیر ضروری ہے):

ڈائریکٹری مندرجہ ذیل ہے Python کے لیے AWS CDK پروجیکٹس کا تجویز کردہ ڈھانچہ.

اس ذخیرہ کا سب سے اہم حصہ ہے۔ fastapi_model_serving ڈائریکٹری اس میں وہ کوڈ ہے جو AWS CDK اسٹیک کی وضاحت کرے گا اور وہ وسائل جو ماڈل پیش کرنے کے لیے استعمال کیے جائیں گے۔

۔ fastapi_model_serving ڈائریکٹری پر مشتمل ہے model_endpoint سب ڈائرکٹری، جس میں تمام ضروری اثاثے شامل ہیں جو ہمارے سرور لیس اینڈ پوائنٹ کو بناتے ہیں، یعنی ڈوکر امیج بنانے کے لیے Dockerfile جسے Lambda استعمال کرے گا، Lambda فنکشن کوڈ جو FastAPI کو انفرنس کی درخواستوں کو ہینڈل کرنے کے لیے استعمال کرتا ہے اور انہیں صحیح اینڈ پوائنٹ تک پہنچاتا ہے، اور ماڈل۔ ماڈل کے نمونے جو ہم تعینات کرنا چاہتے ہیں۔ model_endpoint بھی مندرجہ ذیل پر مشتمل ہے:

Docker- اس ذیلی ڈائرکٹری میں درج ذیل ہیں:Dockerfile- اس کا استعمال لیمبڈا فنکشن کے لیے تمام نمونے (لیمبڈا فنکشن کوڈ، ماڈل آرٹفیکٹس، وغیرہ) کے ساتھ صحیح جگہ پر بنانے کے لیے کیا جاتا ہے تاکہ انہیں بغیر کسی مسئلے کے استعمال کیا جا سکے۔serving.api.tar.gz- یہ ایک ٹربال ہے جس میں رن ٹائم فولڈر کے تمام اثاثے شامل ہیں جو ڈوکر امیج بنانے کے لیے ضروری ہیں۔ ہم بحث کرتے ہیں کہ اسے کیسے بنایا جائے۔.tar.gzاس پوسٹ میں بعد میں فائل کریں۔runtime- اس ذیلی ڈائرکٹری میں درج ذیل ہیں:serving_api- لیمبڈا فنکشن کا کوڈ اور ضروریات.txt فائل میں اس کے انحصار کی وضاحت کی گئی ہے۔custom_lambda_utils- اس میں ایک انفرنس اسکرپٹ شامل ہے جو ماڈل کے ضروری نمونے لوڈ کرتا ہے تاکہ ماڈل کو منتقل کیا جا سکے۔serving_apiجو پھر اسے اختتامی نقطہ کے طور پر بے نقاب کرے گا۔

مزید برآں، ہمارے پاس ٹیمپلیٹ ڈائرکٹری ہے، جو فولڈر کے ڈھانچے اور فائلوں کا ایک ٹیمپلیٹ فراہم کرتی ہے جہاں آپ اپنے حسب ضرورت کوڈز اور APIs کی وضاحت کر سکتے ہیں اس نمونے کے بعد جو ہم پہلے گزرے تھے۔ ٹیمپلیٹ ڈائرکٹری میں ڈمی کوڈ ہوتا ہے جسے آپ لیمبڈا کے نئے فنکشنز بنانے کے لیے استعمال کر سکتے ہیں:

dummy- اس کوڈ پر مشتمل ہے جو Python رن ٹائم کا استعمال کرتے ہوئے ایک عام Lambda فنکشن کی ساخت کو نافذ کرتا ہے۔api- اس کوڈ پر مشتمل ہے جو لیمبڈا فنکشن کو لاگو کرتا ہے جو ایک فاسٹ اے پی آئی اینڈ پوائنٹ کو موجودہ API گیٹ وے کے گرد لپیٹتا ہے۔

حل تعینات کریں۔

پہلے سے طے شدہ طور پر، کوڈ کو eu-west-1 ریجن کے اندر تعینات کیا جاتا ہے۔ اگر آپ خطے کو تبدیل کرنا چاہتے ہیں، تو آپ DEPLOYMENT_REGION سیاق و سباق کے متغیر کو cdk.json فائل.

تاہم، ذہن میں رکھیں کہ حل arm64 فن تعمیر کے سب سے اوپر ایک Lambda فنکشن کو تعینات کرنے کی کوشش کرتا ہے، اور یہ کہ یہ خصوصیت تمام خطوں میں دستیاب نہیں ہوسکتی ہے۔ اس صورت میں، آپ کو آرکیٹیکچر پیرامیٹر میں تبدیل کرنے کی ضرورت ہے۔ fastapi_model_serving_stack.py فائل، نیز ڈوکر ڈائرکٹری کے اندر ڈوکر فائل کی پہلی لائن، اس حل کو x86 فن تعمیر پر میزبانی کرنے کے لیے۔

حل کو تعینات کرنے کے لیے، درج ذیل مراحل کو مکمل کریں:

- GitHub ذخیرہ کو کلون کرنے کے لیے درج ذیل کمانڈ کو چلائیں:

git clone https://github.com/aws-samples/lambda-serverless-inference-fastapiچونکہ ہم یہ ظاہر کرنا چاہتے ہیں کہ حل ماڈل نمونے کے ساتھ کام کر سکتا ہے جنہیں آپ مقامی طور پر تربیت دیتے ہیں، ہمارے پاس پہلے سے تربیت یافتہ نمونے کے نمونے کے نمونے موجود ہیں۔ ڈسٹل برٹ میں سوال کا جواب دینے کے کام کے لیے Hugging Face ماڈل ہب پر ماڈلserving_api.tar.gzفائل ڈاؤن لوڈ میں تقریباً 3-5 منٹ لگ سکتے ہیں۔ اب، ماحول کو ترتیب دیں. - پہلے سے تربیت یافتہ ماڈل ڈاؤن لوڈ کریں جو Hugging Face ماڈل ہب سے میں تعینات کیا جائے گا۔

./model_endpoint/runtime/serving_api/custom_lambda_utils/model_artifactsڈائریکٹری یہ ایک ورچوئل ماحول بھی بناتا ہے اور تمام انحصار کو انسٹال کرتا ہے جن کی ضرورت ہے۔ آپ کو صرف ایک بار یہ کمانڈ چلانے کی ضرورت ہے:make prep. اس کمانڈ میں لگ بھگ 5 منٹ لگ سکتے ہیں (آپ کی انٹرنیٹ بینڈوتھ پر منحصر ہے) کیونکہ اسے ماڈل کے نمونے ڈاؤن لوڈ کرنے کی ضرورت ہے۔ - اے کے اندر ماڈل کے نمونے پیک کریں۔

.tar.gzآرکائیو جو ڈوکر امیج کے اندر استعمال کیا جائے گا جو AWS CDK اسٹیک میں بنایا گیا ہے۔ آپ کو اس کوڈ کو چلانے کی ضرورت ہے جب بھی آپ ماڈل آرٹفیکٹس یا API میں تبدیلیاں کرتے ہیں تاکہ ہمیشہ آپ کے سرونگ اینڈ پوائنٹ کا سب سے تازہ ترین ورژن پیک کیا جا سکے۔make package_model. تمام نمونے اپنی جگہ پر ہیں۔ اب ہم آپ کے AWS اکاؤنٹ میں AWS CDK اسٹیک لگا سکتے ہیں۔ - اگر آپ پہلی بار کسی ماحول میں AWS CDK ایپ کو تعینات کر رہے ہیں تو cdk بوٹسٹریپ چلائیں (اکاؤنٹ + ریجن کا مجموعہ):

اس اسٹیک میں وسائل شامل ہیں جو ٹول کٹ کے آپریشن کے لیے درکار ہیں۔ مثال کے طور پر، اسٹیک میں ایک Amazon Simple Storage Service (Amazon S3) بالٹی شامل ہے جسے تعیناتی کے عمل کے دوران ٹیمپلیٹس اور اثاثوں کو ذخیرہ کرنے کے لیے استعمال کیا جاتا ہے۔

چونکہ ہم اس AWS CDK کی تعیناتی میں مقامی طور پر Docker امیجز بنا رہے ہیں، ہمیں AWS CDK CLI کے ذریعے اس اسٹیک کو تعینات کرنے سے پہلے اس بات کو یقینی بنانا ہوگا کہ Docker ڈیمون چل رہا ہے۔

- یہ چیک کرنے کے لیے کہ آیا آپ کے سسٹم پر ڈاکر ڈیمون چل رہا ہے یا نہیں، درج ذیل کمانڈ کا استعمال کریں:

اگر آپ کو غلطی کا پیغام نہیں ملتا ہے، تو آپ کو حل کو تعینات کرنے کے لیے تیار رہنا چاہیے۔

- مندرجہ ذیل کمانڈ کے ساتھ حل کو تعینات کریں:

ڈوکر امیج کو بنانے اور آگے بڑھانے کی وجہ سے اس قدم میں لگ بھگ 5-10 منٹ لگ سکتے ہیں۔

خرابیوں کا سراغ لگانا

اگر آپ میک صارف ہیں، تو آپ کو لاگ ان کرتے وقت غلطی کا سامنا کرنا پڑ سکتا ہے۔ ایمیزون لچکدار کنٹینر رجسٹری (ایمیزون ای سی آر) ڈوکر لاگ ان کے ساتھ، جیسے Error saving credentials ... not implemented. مثال کے طور پر:

اس سے پہلے کہ آپ AWS CDK کے اندر Docker کنٹینرز کے اوپر لیمبڈا استعمال کر سکیں، آپ کو تبدیل کرنے کی ضرورت پڑ سکتی ہے۔ ~/docker/config.json فائل مزید خاص طور پر، آپ کو credsStore پیرامیٹر میں تبدیل کرنا پڑ سکتا ہے۔ ~/.docker/config.json osxkeychain پر۔ یہ میک پر ایمیزون ای سی آر لاگ ان کے مسائل کو حل کرتا ہے۔

ریئل ٹائم انفرنس چلائیں۔

آپ کے بعد AWS کلاؤڈ فارمیشن اسٹیک کامیابی کے ساتھ تعینات کیا گیا ہے، پر جائیں۔ نتائج AWS CloudFormation کنسول پر اپنے اسٹیک کے لیے ٹیب اور اینڈ پوائنٹ یو آر ایل کھولیں۔ اب ہمارا ماڈل اینڈ پوائنٹ یو آر ایل کے ذریعے قابل رسائی ہے اور ہم ریئل ٹائم انفرنس چلانے کے لیے تیار ہیں۔

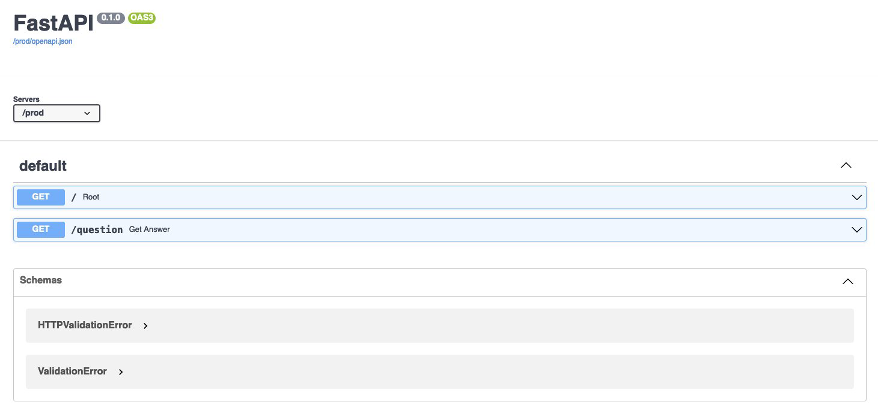

یہ دیکھنے کے لیے یو آر ایل پر جائیں کہ آیا آپ "ہیلو ورلڈ" پیغام دیکھ سکتے ہیں اور شامل کر سکتے ہیں۔ /docs پتہ پر یہ دیکھنے کے لیے کہ آیا آپ انٹرایکٹو سویگر UI صفحہ کو کامیابی سے دیکھ سکتے ہیں۔ کچھ ٹھنڈا شروع ہونے کا وقت ہوسکتا ہے، لہذا آپ کو کچھ بار انتظار کرنے یا تازہ دم کرنے کی ضرورت پڑسکتی ہے۔

FastAPI swagger UI صفحہ کے لینڈنگ پیج پر لاگ ان ہونے کے بعد، آپ روٹ کے ذریعے چل سکتے ہیں۔ / یا کے ذریعے /question.

سے /، آپ API چلا سکتے ہیں اور "ہیلو ورلڈ" پیغام حاصل کرسکتے ہیں۔

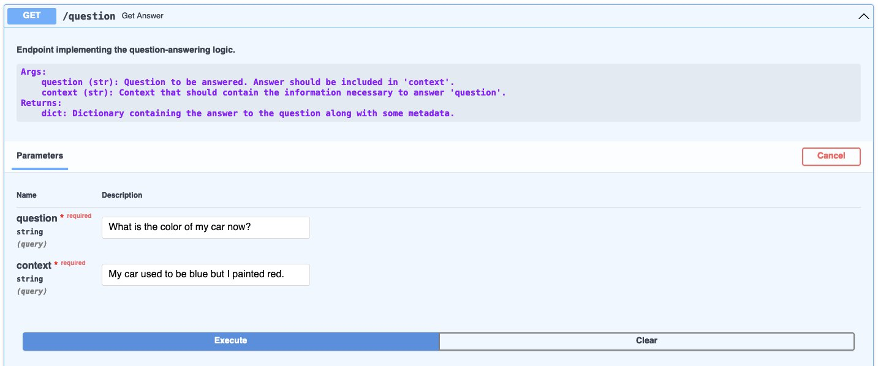

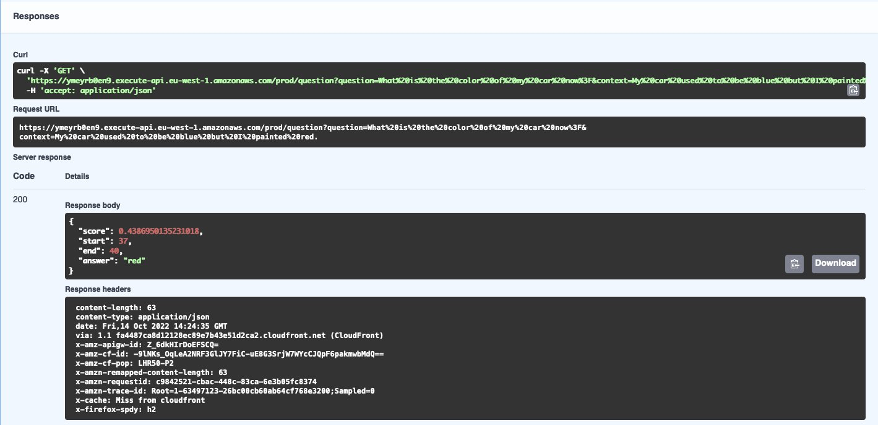

سے /question، آپ API چلا سکتے ہیں اور اس ماڈل پر ML تخمینہ چلا سکتے ہیں جو ہم نے سوال کے جواب کے کیس کے لیے تعینات کیا ہے۔ مثال کے طور پر، ہم یہ سوال استعمال کرتے ہیں کہ اب میری گاڑی کا رنگ کیا ہے؟ اور سیاق و سباق یہ ہے کہ میری گاڑی نیلی ہوتی تھی لیکن میں نے سرخ رنگ کیا۔

جب آپ کا انتخاب کریں چلائیں، دیئے گئے سیاق و سباق کی بنیاد پر، ماڈل جواب کے ساتھ سوال کا جواب دے گا، جیسا کہ درج ذیل اسکرین شاٹ میں دکھایا گیا ہے۔

رسپانس باڈی میں، آپ ماڈل کے اعتماد سکور کے ساتھ جواب دیکھ سکتے ہیں۔ آپ دوسری مثالوں کے ساتھ بھی تجربہ کر سکتے ہیں یا اپنی موجودہ ایپلیکیشن میں API کو سرایت کر سکتے ہیں۔

متبادل طور پر، آپ کوڈ کے ذریعے اندازہ چلا سکتے ہیں۔ Python میں لکھی گئی ایک مثال یہ ہے۔ requests لائبریری:

کوڈ مندرجہ ذیل سے ملتی جلتی ایک تار نکالتا ہے:

اگر آپ AWS پر جنریٹو AI اور بڑے لینگویج ماڈلز کی تعیناتی کے بارے میں مزید جاننے میں دلچسپی رکھتے ہیں، تو یہاں چیک کریں:

- OpenLLaMa کے ساتھ AWS Lambda پر سرور لیس جنریٹو AI تعینات کریں۔

- بڑے ماڈل انفرنس کنٹینرز کا استعمال کرتے ہوئے AWS Inferentia2 پر بڑے زبان کے ماڈلز تعینات کریں۔

صاف کرو

اپنے ذخیرے کی روٹ ڈائرکٹری کے اندر، اپنے وسائل کو صاف کرنے کے لیے درج ذیل کوڈ کو چلائیں:

نتیجہ

اس پوسٹ میں، ہم نے متعارف کرایا ہے کہ آپ اپنے پسندیدہ ویب ایپلیکیشن فریم ورک، جیسے FastAPI کا استعمال کرتے ہوئے اپنے تربیت یافتہ ML ماڈل کو تعینات کرنے کے لیے Lambda کا استعمال کیسے کر سکتے ہیں۔ ہم نے ایک تفصیلی کوڈ ذخیرہ فراہم کیا ہے جسے آپ تعینات کر سکتے ہیں، اور آپ جس بھی تربیت یافتہ ماڈل کے نمونے پر کارروائی کرتے ہیں اس پر سوئچ کرنے کی لچک برقرار رکھتے ہیں۔ کارکردگی کا انحصار اس بات پر ہو سکتا ہے کہ آپ ماڈل کو کیسے لاگو اور تعینات کرتے ہیں۔

اسے خود آزمانے کے لیے آپ کا استقبال ہے، اور ہم آپ کے تاثرات سن کر بہت پرجوش ہیں!

مصنفین کے بارے میں

ٹنگی لی سٹاک ہوم، سویڈن میں مقیم AWS کا ایک انٹرپرائز سلوشنز آرکیٹیکٹ ہے جو Nordics کے صارفین کی مدد کرتا ہے۔ وہ کلاؤڈ سے بہتر بنیادی ڈھانچے کے حل کے فن تعمیر، ڈیزائن، اور ترقی میں صارفین کی مدد کرنے سے لطف اندوز ہوتی ہے۔ وہ AI اور مشین لرننگ میں مہارت رکھتی ہے اور صارفین کو ان کی AI/ML ایپلی کیشنز میں ذہانت کے ساتھ بااختیار بنانے میں دلچسپی رکھتی ہے۔ اپنے فارغ وقت میں، وہ ایک جز وقتی مصور بھی ہیں جو ناول لکھتی ہیں اور پیانو بجاتی ہیں۔

ٹنگی لی سٹاک ہوم، سویڈن میں مقیم AWS کا ایک انٹرپرائز سلوشنز آرکیٹیکٹ ہے جو Nordics کے صارفین کی مدد کرتا ہے۔ وہ کلاؤڈ سے بہتر بنیادی ڈھانچے کے حل کے فن تعمیر، ڈیزائن، اور ترقی میں صارفین کی مدد کرنے سے لطف اندوز ہوتی ہے۔ وہ AI اور مشین لرننگ میں مہارت رکھتی ہے اور صارفین کو ان کی AI/ML ایپلی کیشنز میں ذہانت کے ساتھ بااختیار بنانے میں دلچسپی رکھتی ہے۔ اپنے فارغ وقت میں، وہ ایک جز وقتی مصور بھی ہیں جو ناول لکھتی ہیں اور پیانو بجاتی ہیں۔

ڈیمیر کیٹووک زیورخ، سوئٹزرلینڈ میں مقیم AWS سے مشین لرننگ انجینئر ہے۔ وہ صارفین کے ساتھ مشغول رہتا ہے اور توسیع پذیر اور مکمل طور پر فعال ML ایپلیکیشنز کو لاگو کرنے میں ان کی مدد کرتا ہے۔ وہ صارفین کے لیے مشین لرننگ ایپلی کیشنز بنانے اور تیار کرنے کے بارے میں پرجوش ہے اور AI/ML کی دنیا میں نئے رجحانات اور جدید ٹیکنالوجیز کو تلاش کرنے کے لیے ہمیشہ بے چین رہتا ہے۔

ڈیمیر کیٹووک زیورخ، سوئٹزرلینڈ میں مقیم AWS سے مشین لرننگ انجینئر ہے۔ وہ صارفین کے ساتھ مشغول رہتا ہے اور توسیع پذیر اور مکمل طور پر فعال ML ایپلیکیشنز کو لاگو کرنے میں ان کی مدد کرتا ہے۔ وہ صارفین کے لیے مشین لرننگ ایپلی کیشنز بنانے اور تیار کرنے کے بارے میں پرجوش ہے اور AI/ML کی دنیا میں نئے رجحانات اور جدید ٹیکنالوجیز کو تلاش کرنے کے لیے ہمیشہ بے چین رہتا ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ آٹوموٹو / ای وی، کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- بلاک آفسیٹس۔ ماحولیاتی آفسیٹ ملکیت کو جدید بنانا۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/deploy-a-serverless-ml-inference-endpoint-of-large-language-models-using-fastapi-aws-lambda-and-aws-cdk/

- : ہے

- : نہیں

- :کہاں

- $UP

- 1

- 10

- 100

- 13

- 2022

- 7

- 9

- a

- قابلیت

- ہمارے بارے میں

- قابل رسائی

- اکاؤنٹ

- کے پار

- شامل کریں

- اس کے علاوہ

- پتہ

- AI

- AI / ML

- تمام

- کی اجازت دیتا ہے

- ساتھ

- بھی

- ہمیشہ

- ایمیزون

- ایمیزون ویب سروسز

- کے درمیان

- an

- اور

- جواب

- کوئی بھی

- اے پی آئی

- APIs

- اپلی کیشن

- درخواست

- ایپلی کیشنز

- اپریل

- فن تعمیر

- محفوظ شدہ دستاویزات

- کیا

- ارد گرد

- AS

- اثاثے

- At

- خود کار طریقے سے

- خودکار

- خود کار طریقے سے

- دستیاب

- دور

- AWS

- AWS کلاؤڈ فارمیشن

- او ڈبلیو ایس لامبڈا۔

- پسدید

- بینڈوڈتھ

- کی بنیاد پر

- BE

- کیونکہ

- اس سے پہلے

- کے درمیان

- بلیو

- جسم

- بوٹسٹریپ

- لانے

- وسیع

- تعمیر

- عمارت

- تعمیر

- تعمیر میں

- کاروبار

- لیکن

- by

- کر سکتے ہیں

- کار کے

- کیس

- مقدمات

- چیلنج

- چیلنجوں

- تبدیل

- تبدیلیاں

- چیک کریں

- انتخاب

- میں سے انتخاب کریں

- بادل

- کوڈ

- کوڈ

- سردی

- رنگ

- مجموعہ

- آتا ہے

- مکمل

- تصور

- آپکا اعتماد

- رابطہ قائم کریں

- کنکشن

- کنسول

- پر مشتمل ہے

- کنٹینر

- کنٹینر

- پر مشتمل ہے

- سیاق و سباق

- درست

- سرمایہ کاری مؤثر

- سکتا ہے

- تخلیق

- پیدا

- تخلیق

- اسناد

- گاہکوں

- اپنی مرضی کے مطابق

- جدید

- اعداد و شمار

- پہلے سے طے شدہ

- منحصر ہے

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- ڈیزائن

- تفصیلی

- ترقی

- ترقی

- براہ راست

- بات چیت

- میں Docker

- دستاویزات

- نہیں

- ڈاؤن لوڈ، اتارنا

- دو

- کے دوران

- اس سے قبل

- کو کم

- آسان

- آسانی سے

- آسان

- کوشش

- یمبیڈ

- بااختیار بنانے

- آخر

- اختتام پوائنٹ

- منگنی

- انجینئر

- انجینئرز

- کو یقینی بنانے کے

- انٹرپرائز

- ماحولیات

- ماحول

- خرابی

- مثال کے طور پر

- مثال کے طور پر

- بہت پرجوش

- عملدرآمد

- موجودہ

- باہر نکلیں

- تجربہ

- تلاش

- چہرہ

- نمایاں کریں

- چند

- فائل

- فائلوں

- پہلا

- پہلی بار

- لچک

- لچکدار

- پر عمل کریں

- کے بعد

- مندرجہ ذیل ہے

- کے لئے

- فریم ورک

- سے

- تقریب

- افعال

- افعال

- گیٹ وے

- عام طور پر

- پیداواری

- پیداواری AI۔

- حاصل

- GitHub کے

- دی

- Go

- جا

- بڑھتے ہوئے

- ہینڈل

- ہارڈ

- ہے

- he

- سن

- بھاری

- بھاری وزن اٹھانا

- مدد

- مدد

- مدد کرتا ہے

- اس کی

- یہاں

- اعلی کارکردگی

- میزبان

- کس طرح

- کیسے

- تاہم

- HTML

- HTTP

- HTTPS

- حب

- i

- ناقابل یقین

- if

- تصویر

- تصاویر

- پر عملدرآمد

- عمل

- اہم

- in

- دیگر میں

- شامل ہیں

- صنعتوں

- انفراسٹرکچر

- کے اندر

- نصب

- انٹیلی جنس

- انٹرایکٹو

- دلچسپی

- انٹرنیٹ

- میں

- متعارف

- مسائل

- IT

- میں

- خود

- JSON

- Keen

- جاننا

- لینڈنگ

- زبان

- بڑے

- بعد

- سیکھنے

- لائبریری

- زندگی

- اٹھانے

- کی طرح

- لائن

- بوجھ

- مقامی

- مقامی طور پر

- لاگ ان کریں

- لاگ ان

- منطق

- لاگ ان

- میک

- مشین

- مشین لرننگ

- بنا

- مین

- بنا

- بناتا ہے

- انتظام

- مینیجنگ

- مئی..

- سے ملو

- پیغام

- مائکروسافٹ

- شاید

- برا

- منٹ

- ML

- ماڈل

- ماڈل

- جدید

- زیادہ

- سب سے زیادہ

- منتقل

- ایک سے زیادہ

- ضروری

- my

- یعنی

- ضروری

- ضرورت ہے

- ضرورت

- ضروریات

- نئی

- اب

- of

- اکثر

- on

- ایک بار

- ایک

- صرف

- کھول

- اوپن سورس

- آپریشن

- آپشنز کے بھی

- or

- حکم

- عام

- دیگر

- ہمارے

- باہر

- پیک۔

- صفحہ

- پیرامیٹر

- حصہ

- منظور

- جذباتی

- کارکردگی

- ادوار

- مقام

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- ادا کرتا ہے

- مقبول

- پوسٹ

- پیشن گوئی

- کو ترجیح دی

- ضروریات

- تحفہ

- عمل

- پیداوار

- منصوبے

- منصوبوں

- ثبوت

- تصور کا ثبوت

- ثابت کریں

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- دھکیلنا

- ازگر

- سوال

- تیار

- اصل وقت

- ریڈ

- کو کم

- خطے

- خطوں

- ذخیرہ

- درخواستوں

- ضرورت

- ضرورت

- ضروریات

- وسائل

- جواب

- نتیجہ

- برقرار رکھنے

- ٹھیک ہے

- جڑ

- روٹ

- راستے

- رن

- چل رہا ہے

- sagemaker

- بچت

- توسیع پذیر

- پیمانے

- سائنسدانوں

- گنجائش

- سکور

- دیکھنا

- منتخب

- انتخاب

- بے سرور

- سرورز

- سروس

- سروسز

- خدمت

- مقرر

- وہ

- ہونا چاہئے

- دکھائیں

- نمائش

- دکھایا گیا

- شوز

- اہم

- نمایاں طور پر

- اسی طرح

- سادہ

- ایک

- So

- سافٹ ویئر کی

- حل

- حل

- حل کرتا ہے

- کچھ

- بات

- خصوصی

- خاص طور پر

- مخصوص

- ڈھیر لگانا

- کھڑا ہے

- شروع کریں

- شروع ہوتا ہے

- درجہ

- مرحلہ

- مراحل

- ذخیرہ

- ذخیرہ

- ذخیرہ کرنے

- سلک

- ساخت

- کامیابی کے ساتھ

- اس طرح

- امدادی

- سویڈن

- سوئٹزرلینڈ

- کے نظام

- لے لو

- ٹاسک

- ٹیکنالوجی

- سانچے

- سانچے

- ٹیسٹ

- کہ

- ۔

- ان

- ان

- تو

- وہاں.

- وہ

- اس

- کے ذریعے

- وقت

- اوقات

- کرنے کے لئے

- کے آلے

- سب سے اوپر

- ٹریفک

- ٹرین

- تربیت یافتہ

- رجحانات

- کوشش

- ui

- یونیکس

- اپ ڈیٹ کرنے کے لئے

- URL

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- رکن کا

- استعمال

- کا استعمال کرتے ہوئے

- ورژن

- کی طرف سے

- مجازی

- انتظار

- چاہتے ہیں

- تھا

- we

- ویب

- ویب ایپلی کیشن

- ویب خدمات

- آپ کا استقبال ہے

- اچھا ہے

- چلا گیا

- کیا

- کیا ہے

- جب

- جب بھی

- چاہے

- جس

- ڈبلیو

- گے

- ساتھ

- بغیر

- کام

- دنیا

- لکھا

- تم

- اور

- اپنے آپ کو

- زیفیرنیٹ

- زیورخ