جب زیادہ تر لوگ آڈیو ڈیٹا کے ساتھ مشین لرننگ (ML) کو استعمال کرنے کے بارے میں سوچتے ہیں، تو استعمال کا معاملہ جو عام طور پر ذہن میں آتا ہے۔ مائلیکھن، جسے اسپیچ ٹو ٹیکسٹ بھی کہا جاتا ہے۔ تاہم، دیگر مفید ایپلیکیشنز ہیں، بشمول آوازوں کا پتہ لگانے کے لیے ML کا استعمال۔

آواز کا پتہ لگانے کے لیے سافٹ ویئر استعمال کرنا کہلاتا ہے۔ آڈیو واقعہ کا پتہ لگانا، اور اس میں متعدد ایپلی کیشنز ہیں۔ مثال کے طور پر، فرض کریں کہ آپ شور مچانے والے فیکٹری کے فرش سے آوازوں کی نگرانی کرنا چاہتے ہیں، الارم کی گھنٹی سن رہے ہیں جو مشین میں کسی مسئلے کی نشاندہی کرتی ہے۔ صحت کی دیکھ بھال کے ماحول میں، آپ کسی مریض کی آوازوں کو غیر فعال طور پر سننے کے لیے آڈیو ایونٹ کا پتہ لگانے کا استعمال کر سکتے ہیں جو صحت کے شدید مسئلے کی نشاندہی کرتی ہے۔ میڈیا کے کام کا بوجھ اس تکنیک کے لیے موزوں ہے، مثال کے طور پر اس بات کا پتہ لگانا کہ جب کھیلوں کی ویڈیو میں ریفری کی سیٹی بجائی جاتی ہے۔ اور یقیناً، آپ اس تکنیک کو مختلف نگرانی کے کام کے بوجھ میں استعمال کر سکتے ہیں، جیسے شہر کی سڑک کے اوپر نصب مائیکروفون سے بندوق کی گولی یا کار کے حادثے کی آواز سننا۔

یہ پوسٹ بیان کرتی ہے کہ آڈیو فائل میں آوازوں کا پتہ لگانے کا طریقہ یہاں تک کہ اگر بیک وقت اہم پس منظر کی آوازیں آرہی ہوں۔ مزید یہ کہ شاید حیرت کی بات یہ ہے کہ ہم پتہ لگانے کے لیے کمپیوٹر ویژن پر مبنی تکنیکوں کا استعمال کرتے ہیں۔ ایمیزون پہچان۔.

مشین لرننگ کے ساتھ آڈیو ڈیٹا کا استعمال

آڈیو واقعات کا پتہ لگانے کا پہلا قدم یہ سمجھنا ہے کہ آڈیو ڈیٹا کی نمائندگی کیسے کی جاتی ہے۔ اس پوسٹ کے مقاصد کے لیے، ہم صرف ریکارڈ شدہ آڈیو سے نمٹتے ہیں، حالانکہ یہ تکنیکیں سٹریمنگ آڈیو کے ساتھ کام کرتی ہیں۔

ریکارڈ شدہ آڈیو کو عام طور پر صوتی نمونوں کی ترتیب کے طور پر ذخیرہ کیا جاتا ہے، جو وقت کے ساتھ ساتھ ریکارڈنگ کے دوران مائکروفون سے ٹکرانے والی آواز کی لہروں کی شدت کی پیمائش کرتے ہیں۔ ان نمونوں کو ذخیرہ کرنے کے لیے مختلف قسم کے فارمیٹس ہیں، لیکن ایک عام طریقہ یہ ہے کہ 10,000، 20,000، یا حتیٰ کہ 40,000 نمونے فی سیکنڈ ذخیرہ کیے جائیں، جس میں ہر نمونہ 0–65535 (دو بائٹس) کا عدد ہوتا ہے۔ چونکہ ہر نمونہ کسی خاص لمحے میں صرف آواز کی لہروں کی شدت کو ماپتا ہے، اس لیے آواز کا ڈیٹا عام طور پر ایم ایل پروسیسز کے لیے مددگار نہیں ہوتا ہے کیونکہ اس کی خام حالت میں کوئی مفید خصوصیات نہیں ہوتی ہیں۔

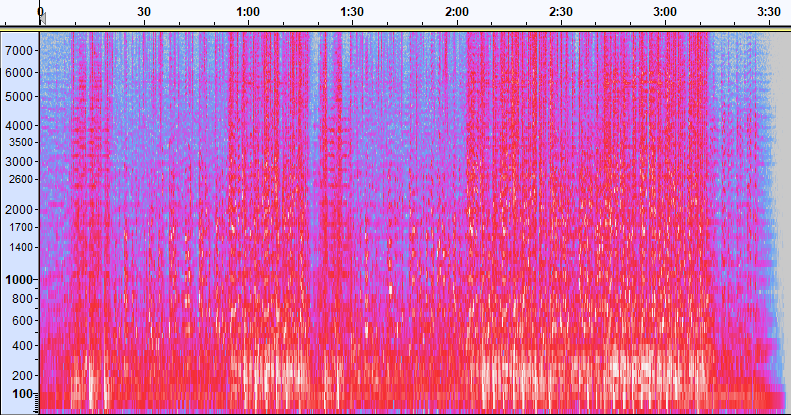

اس ڈیٹا کو کارآمد بنانے کے لیے، آواز کے نمونے کو ایک تصویر میں تبدیل کیا جاتا ہے جسے a کہا جاتا ہے۔ سپیکٹروگرام، جو آڈیو ڈیٹا کی نمائندگی ہے جو وقت کے ساتھ ساتھ مختلف فریکوئنسی بینڈز کی شدت کو ظاہر کرتا ہے۔ مندرجہ ذیل تصویر ایک مثال دکھاتی ہے۔

اس تصویر کا X محور وقت کی نمائندگی کرتا ہے، یعنی تصویر کا بایاں کنارہ آواز کا بالکل آغاز ہے، اور تصویر کا دائیں کنارہ اختتام ہے۔ تصویر کے اندر ڈیٹا کا ہر کالم مختلف فریکوئنسی بینڈز کی نمائندگی کرتا ہے (تصویر کے بائیں جانب پیمانہ سے اشارہ کیا جاتا ہے)، اور ہر نقطہ پر رنگ اس وقت اس فریکوئنسی کی شدت کو ظاہر کرتا ہے۔

سپیکٹروگرامس کے لیے عمودی اسکیلنگ کو دوسری نمائندگیوں میں تبدیل کیا جا سکتا ہے۔ مثال کے طور پر، لکیری اسکیلنگ کا مطلب ہے کہ Y محور یکساں طور پر تعدد پر تقسیم ہوتا ہے، لوگاریتھمک اسکیلنگ لاگ اسکیل کا استعمال کرتی ہے، وغیرہ۔ ان نمائندگیوں کو استعمال کرنے میں مسئلہ یہ ہے کہ ساؤنڈ فائل میں فریکوئنسیز عام طور پر یکساں طور پر تقسیم نہیں ہوتیں، اس لیے زیادہ تر معلومات جن میں ہماری دلچسپی ہو سکتی ہے وہ تصویر کے نچلے حصے (نچلی تعدد) کے قریب کلسٹر ہو جاتی ہے۔

اس مسئلے کو حل کرنے کے لیے، ہماری نمونہ تصویر ایک مثال ہے۔ میل سپیکٹروگرام، جس کو قریب سے اندازہ لگایا جاتا ہے کہ انسان کس طرح آواز کو محسوس کرتا ہے۔ تصویر کے بائیں جانب فریکوئنسی انڈیکیٹرز کو دیکھیں — وہ اس بات کا اندازہ دیتے ہیں کہ انہیں عمودی طور پر کیسے تقسیم کیا جاتا ہے، اور یہ واضح ہے کہ یہ ایک غیر لکیری پیمانہ ہے۔

مزید برآں، ہم پیمائش کی جا رہی آڈیو کی مختلف خصوصیات کو بڑھانے کے لیے وقت کے حساب سے شدت کی پیمائش میں ترمیم کر سکتے ہیں۔ جیسا کہ Y محور اسکیلنگ کے ساتھ جو میل سپیکٹروگرام کے ذریعہ لاگو کیا جاتا ہے، دیگر خصوصیات پر زور دیتے ہیں جیسے کہ 12 مخصوص پچ کلاسوں کی شدت جو موسیقی (کروما) کے مطالعہ کے لیے استعمال ہوتی ہیں۔ ایک اور طبقہ افقی (ہارمونک) خصوصیات یا عمودی (ٹکرانے والی) خصوصیات پر زور دیتا ہے۔ آواز کی جس قسم کا پتہ لگایا جا رہا ہے اسے پتہ لگانے کے نظام کے لیے استعمال ہونے والے سپیکٹروگرام کی قسم کو چلانا چاہیے۔

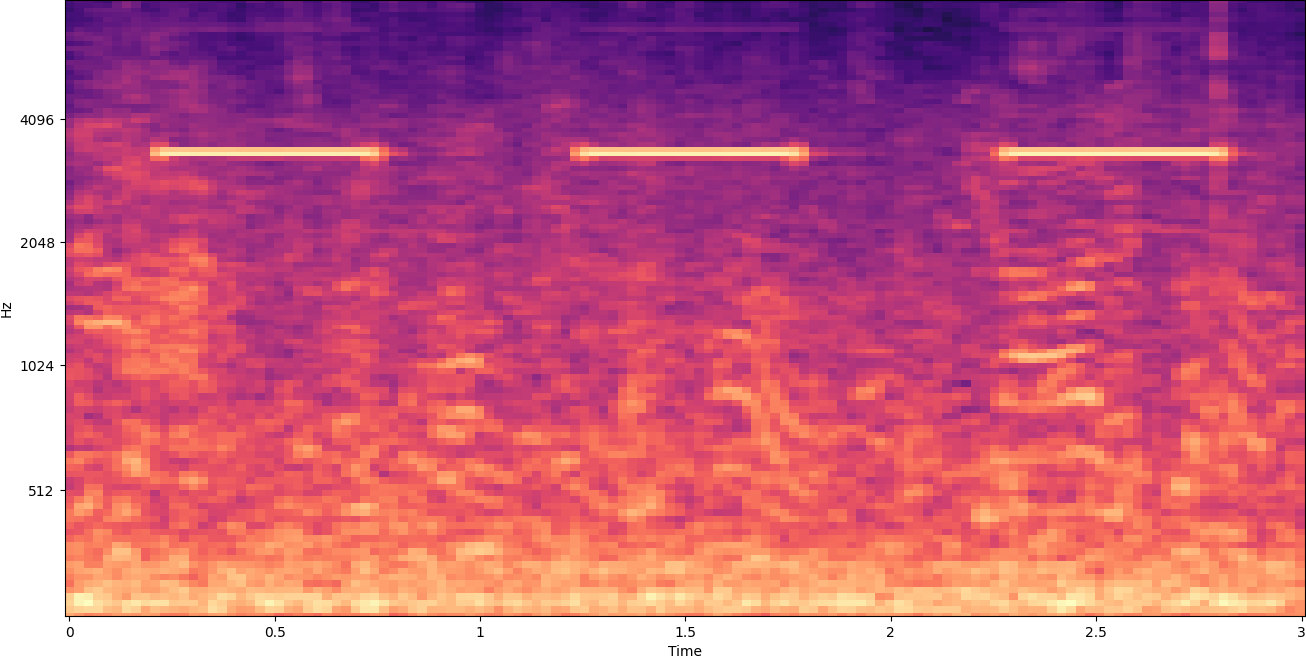

پہلے کی مثال سپیکٹروگرام ایک میوزک کلپ کی نمائندگی کرتا ہے جو صرف 2 منٹ سے زیادہ طویل ہے۔ زوم ان کرنے سے مزید تفصیل سامنے آتی ہے، جیسا کہ درج ذیل تصویر میں دکھایا گیا ہے۔

تصویر کے اوپری حصے کے نمبر آڈیو فائل کے آغاز سے سیکنڈز کی تعداد دکھاتے ہیں۔ آپ آوازوں کا ایک سلسلہ واضح طور پر دیکھ سکتے ہیں جو ہر سیکنڈ میں چار بار سے زیادہ دہراتی دکھائی دیتی ہے، جس کی نشاندہی تصویر کے نیچے کے قریب روشن رنگوں سے ہوتی ہے۔

جیسا کہ آپ دیکھ سکتے ہیں، یہ آڈیو کو سپیکٹروگرام میں تبدیل کرنے کے فوائد میں سے ایک ہے — الگ الگ آوازیں اکثر کھلی آنکھ سے آسانی سے دکھائی دیتی ہیں، اور اگر وہ نہ بھی ہوں تو بھی کمپیوٹر وژن آبجیکٹ کا پتہ لگانے والے الگورتھم کے ذریعے اکثر ان کا پتہ لگایا جا سکتا ہے۔ درحقیقت، یہ وہی عمل ہے جسے ہم آوازوں کا پتہ لگانے کے لیے فالو کرتے ہیں۔

سپیکٹروگرام میں مجرد آوازوں کی تلاش

آڈیو فائل کی لمبائی پر منحصر ہے جسے ہم تلاش کر رہے ہیں، صرف ایک یا دو سیکنڈ تک چلنے والی مجرد آواز تلاش کرنا ایک چیلنج ہے۔ پہلے اسپیکٹروگرام کا حوالہ دیں جو ہم نے شیئر کیا تھا—کیونکہ ہم پورے 3:30 منٹ کا ڈیٹا دیکھ رہے ہیں، ایسی تفصیلات جو صرف ایک سیکنڈ یا اس سے زیادہ عرصے تک دکھائی نہیں دے رہی ہیں۔ دوسری تصویر میں دکھائی جانے والی تال کو دیکھنے کے لیے ہم نے بہت زیادہ زوم کیا۔ واضح طور پر، بڑی ساؤنڈ فائلوں (اور اس وجہ سے بہت بڑے سپیکٹروگرام) کے ساتھ، ہم جلدی مسائل کا شکار ہو جاتے ہیں جب تک کہ ہم کوئی مختلف طریقہ استعمال نہ کریں۔ اس نقطہ نظر کو کہتے ہیں۔ کھڑکی.

ونڈونگ سے مراد ایک سلائیڈنگ ونڈو کا استعمال کرنا ہے جو ایک وقت میں چند سیکنڈ (یا اس سے کم) کو الگ کرتے ہوئے پورے سپیکٹروگرام میں حرکت کرتی ہے۔ مجموعی تصویر کے حصوں کو بار بار الگ کرنے سے، ہمیں چھوٹی تصاویر ملتی ہیں جو آواز کی موجودگی کا پتہ لگانے کے لیے قابل تلاش ہوتی ہیں۔ کیونکہ ہر ونڈو کے نتیجے میں تصویر کا صرف ایک حصہ نکل سکتا ہے جسے ہم تلاش کر رہے ہیں (جیسا کہ ایسی آواز کی تلاش کے معاملے میں جو ونڈو کے شروع میں بالکل شروع نہیں ہوتی ہے)، ونڈونگ اکثر کامیاب ونڈوز کے اوورلیپ ہونے کے ساتھ انجام دی جاتی ہے۔ مثال کے طور پر، پہلی ونڈو 0:00 سے شروع ہوتی ہے اور 2 سیکنڈ تک بڑھ جاتی ہے، پھر دوسری ونڈو 0:01 سے شروع ہوتی ہے اور 2 سیکنڈ تک بڑھ جاتی ہے، اور تیسری ونڈو 0:02 پر شروع ہوتی ہے اور 2 سیکنڈ تک بڑھ جاتی ہے، وغیرہ۔

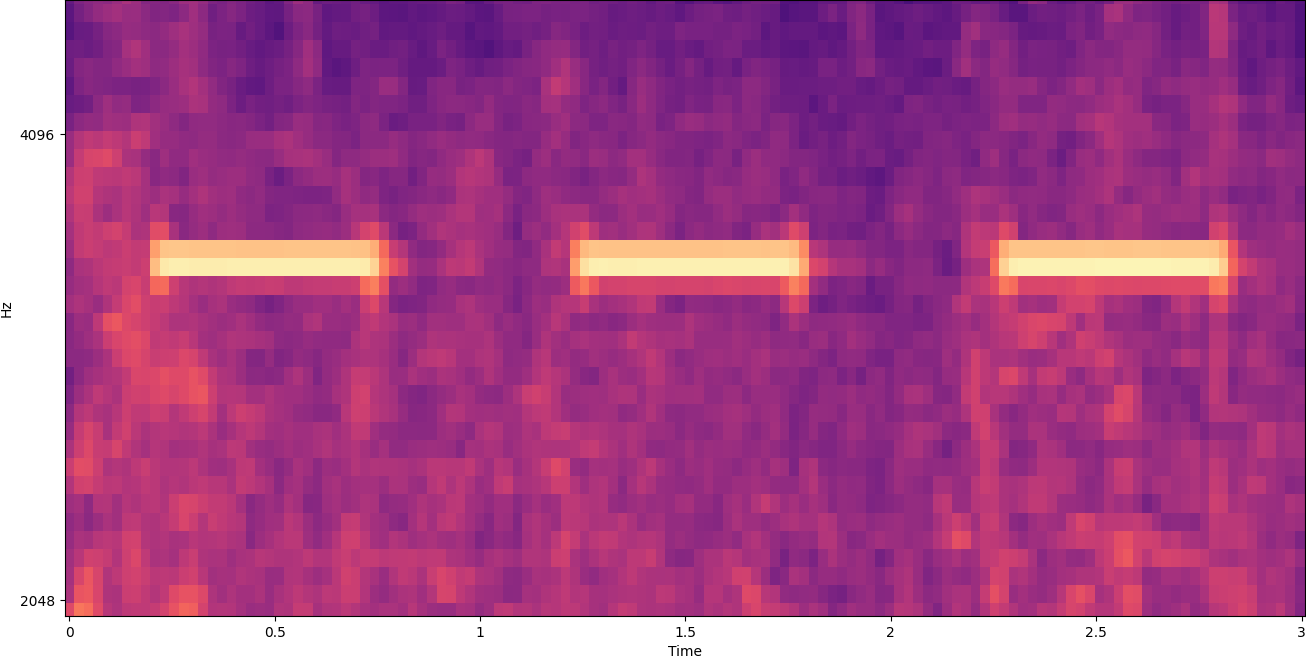

ونڈونگ سپیکٹروگرام امیج کو افقی طور پر تقسیم کرتی ہے۔ ہم تصویر کے کچھ عمودی حصوں کو تراش کر یا تلاش کر کے مخصوص فریکوئنسی بینڈز کو الگ کر کے پتہ لگانے کے عمل کی تاثیر کو بہتر بنا سکتے ہیں۔ مثال کے طور پر، اگر آپ جانتے ہیں کہ آپ جس خطرے کی گھنٹی کا پتہ لگانا چاہتے ہیں وہ آوازیں تخلیق کرتی ہے جو ایک مخصوص فریکوئنسی سے دوسری تک ہوتی ہے، تو آپ موجودہ ونڈو میں ترمیم کر کے صرف ان فریکوئنسی رینجز پر غور کر سکتے ہیں۔ اس سے ہیرا پھیری کے لیے ڈیٹا کی مقدار میں کافی حد تک کمی آتی ہے، اور اس کے نتیجے میں بہت تیز تلاش ہوتی ہے۔ یہ درستگی کو بھی بہتر بناتا ہے، کیونکہ یہ مطلوبہ حد سے باہر فریکوئنسی بینڈ میں ہونے والے ممکنہ غلط مثبت میچوں کو ختم کر رہا ہے۔ درج ذیل تصاویر ایک مکمل Y محور (بائیں) کا محدود Y محور (دائیں) سے موازنہ کرتی ہیں۔

اب جب کہ ہم جانتے ہیں کہ ونڈونگ اپروچ کے ساتھ سپیکٹروگرام پر کیسے اعادہ کرنا ہے اور مخصوص فریکوئنسی بینڈز کو فلٹر کرنا ہے، اگلا مرحلہ آواز کی اصل تلاش کرنا ہے۔ اس کے لئے، ہم استعمال کرتے ہیں ایمیزون ریکگنیشن کسٹم لیبلز. Recognition Custom Labels کی خصوصیت Amazon Recognition کی موجودہ صلاحیتوں کو تیار کرتی ہے، جو پہلے ہی کئی زمروں میں دسیوں لاکھوں تصاویر پر تربیت یافتہ ہے۔ ہزاروں تصاویر کے بجائے، آپ کو صرف تربیتی امیجز کا ایک چھوٹا سیٹ اپ لوڈ کرنے کی ضرورت ہے (عام طور پر چند سو تصاویر، لیکن بہترین ٹریننگ ڈیٹاسیٹ کا سائز تجرباتی طور پر مخصوص استعمال کے معاملے کی بنیاد پر حاصل کیا جانا چاہیے تاکہ ماڈل کو کم یا زیادہ تربیت سے بچایا جا سکے۔ ) جو Recognition Custom Labels کنسول کے ذریعے آپ کے استعمال کے معاملے کے لیے مخصوص ہیں۔

اگر آپ کی تصاویر پر پہلے ہی لیبل لگا ہوا ہے، تو Amazon Recognition ٹریننگ صرف چند کلکس کے ساتھ قابل رسائی ہے۔ متبادل طور پر، آپ ایمیزون ریکگنیشن لیبلنگ انٹرفیس کے اندر براہ راست تصاویر پر لیبل لگا سکتے ہیں، یا استعمال کر سکتے ہیں۔ ایمیزون سیج میکر گراؤنڈ ٹروتھ انہیں آپ کے لیے لیبل کرنے کے لیے۔ جب Amazon Recognition آپ کے تصویری سیٹ سے تربیت شروع کرتا ہے، تو یہ آپ کے لیے صرف چند گھنٹوں میں ایک حسب ضرورت تصویری تجزیہ ماڈل تیار کرتا ہے۔ پردے کے پیچھے، Recognition Custom Labels خود بخود ٹریننگ ڈیٹا کو لوڈ اور معائنہ کرتا ہے، صحیح ML الگورتھم کا انتخاب کرتا ہے، ایک ماڈل کو تربیت دیتا ہے، اور ماڈل کی کارکردگی کے میٹرکس فراہم کرتا ہے۔ اس کے بعد آپ اپنا کسٹم ماڈل استعمال کر سکتے ہیں۔ شناخت کسٹم لیبلز API اور اسے اپنی ایپلی کیشنز میں ضم کریں۔

تربیتی ڈیٹا کو جمع کرنا اور شناخت کے کسٹم لیبلز ماڈل کو تربیت دینا

میں اس پوسٹ کے ساتھ منسلک GitHub ریپو، آپ کو کوڈ ملے گا جو دکھاتا ہے کہ پس منظر کے شور سے قطع نظر دھوئیں کے الارم کی آواز کو کیسے سننا ہے۔ اس صورت میں، ہمارا Recognition Custom Labels ماڈل ایک بائنری درجہ بندی کا ماڈل ہے، مطلب یہ ہے کہ نتائج یا تو "smoke alarm sound کا پتہ چلا" یا "smoke alarm sound کا پتہ نہیں چلا۔"

اپنی مرضی کے مطابق ماڈل بنانے کے لیے، ہمیں تربیتی ڈیٹا کی ضرورت ہے۔ وہ تربیتی ڈیٹا دو اہم اقسام پر مشتمل ہے: ماحولیاتی آوازیں، اور وہ آوازیں جن کا آپ پتہ لگانا چاہتے ہیں (جیسے دھوئیں کا الارم بج رہا ہے)۔

ماحولیاتی ڈیٹا کو مختلف قسم کے ساؤنڈ اسکیپس کی نمائندگی کرنی چاہیے جو اس ماحول کے لیے مخصوص ہیں جس میں آپ آواز کا پتہ لگانا چاہتے ہیں۔ مثال کے طور پر، اگر آپ فیکٹری کے ماحول میں دھوئیں کے الارم کی آواز کا پتہ لگانا چاہتے ہیں، تو اس فیکٹری کے ماحول میں ریکارڈ کی گئی آوازوں سے شروع کریں۔ مختلف قسم کے حالات (بلاشبہ دھوئیں کے الارم کے بجنے کے)۔

آپ جن آوازوں کا پتہ لگانا چاہتے ہیں ان کو اگر ممکن ہو تو الگ تھلگ کیا جانا چاہیے، یعنی ریکارڈنگز صرف آواز ہی ہونی چاہیے بغیر کسی ماحولیاتی پس منظر کی آوازوں کے۔ ہماری مثال کے طور پر، یہ دھوئیں کے الارم کے بجنے کی آواز ہے۔

ان آوازوں کو جمع کرنے کے بعد، GitHub ریپو میں موجود کوڈ یہ دکھاتا ہے کہ ماحولیاتی آوازوں کو دھوئیں کے الارم کی آوازوں کے ساتھ مختلف طریقوں سے کیسے ملایا جائے (اور پھر انہیں سپیکٹروگرام میں تبدیل کیا جائے) تاکہ متعدد ایسی تصاویر بنائیں جو ماحولیاتی آوازوں کی نمائندگی کرتی ہوں۔ دھوئیں کے الارم کے ساتھ اور اس کے بغیر ان پر چھایا ہوا ہے۔ مندرجہ ذیل تصویر کچھ ماحولیاتی آوازوں کی ایک مثال ہے جس میں دھوئیں کے الارم کی آواز (روشن افقی سلاخوں) کے اوپر لپٹی ہوئی ہے۔

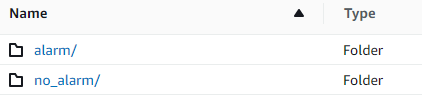

تربیت اور ٹیسٹ کا ڈیٹا ایک میں محفوظ کیا جاتا ہے۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3) بالٹی۔ درج ذیل ڈائرکٹری کا ڈھانچہ بالٹی کے اندر ڈیٹا کو منظم کرنے کے لیے ایک اچھا نقطہ آغاز ہے۔

GitHub ریپو میں نمونہ کوڈ آپ کو یہ منتخب کرنے کی اجازت دیتا ہے کہ کتنی تربیتی تصاویر بنائیں۔ شناخت حسب ضرورت لیبلز کو تربیتی تصاویر کی ایک بڑی تعداد کی ضرورت نہیں ہے۔ 200-500 تصاویر کا تربیتی سیٹ کافی ہونا چاہیے۔

Recognition Custom Labels پروجیکٹ بنانے کے لیے ضروری ہے کہ آپ S3 فولڈر کے URIs کی وضاحت کریں جس میں ٹریننگ ڈیٹا، اور (اختیاری طور پر) ٹیسٹ ڈیٹا ہو۔ تربیتی کام کے لیے ڈیٹا کے ذرائع کی وضاحت کرتے وقت، اختیارات میں سے ایک ہے۔ خودکار لیبلنگ، جیسا کہ مندرجہ ذیل اسکرین شاٹ میں دکھایا گیا ہے۔

اس آپشن کو استعمال کرنے کا مطلب ہے کہ Amazon Recognition فولڈرز کے ناموں کو لیبل کے نام کے طور پر استعمال کرتا ہے۔ ہمارے سموک الارم کا پتہ لگانے کے کیس کے لیے، ٹرین کے اندر فولڈر کا ڈھانچہ اور ٹیسٹ فولڈر مندرجہ ذیل اسکرین شاٹ کی طرح لگتا ہے۔

تربیتی اعداد و شمار کی تصاویر ان فولڈرز میں جاتی ہیں، جن میں اسموک الارم کی آواز پر مشتمل سپیکٹروگرامس الارم فولڈر میں جاتے ہیں، اور سپیکٹروگرامس جن میں دھوئیں کے الارم کی آواز نہیں ہوتی ہے۔ no_alarm فولڈر Amazon Recognition ان ناموں کو کسٹم لیبل ماڈل کے آؤٹ پٹ کلاس کے ناموں کے طور پر استعمال کرتا ہے۔

حسب ضرورت لیبل ماڈل کی تربیت میں عموماً 30-90 منٹ لگتے ہیں۔ اس تربیت کے اختتام پر، آپ کو تربیت یافتہ ماڈل شروع کرنا چاہیے تاکہ یہ استعمال کے لیے دستیاب ہو۔

آواز کا پتہ لگانے کے لیے اینڈ ٹو اینڈ فن تعمیر

ہم اپنا ماڈل بنانے کے بعد، اگلا مرحلہ ایک انفرنس پائپ لائن کو ترتیب دینا ہے، تاکہ ہم ماڈل کا استعمال اس بات کا پتہ لگانے کے لیے کر سکیں کہ آیا کسی آڈیو فائل میں اسموک الارم کی آواز موجود ہے۔ ایسا کرنے کے لیے، ان پٹ ساؤنڈ کو سپیکٹروگرام میں تبدیل کیا جانا چاہیے اور پھر ونڈو اور فریکوئنسی کے مطابق فلٹر کیا جانا چاہیے، جیسا کہ تربیتی عمل کے لیے کیا گیا تھا۔ سپیکٹروگرام کی ہر ونڈو ماڈل کو دی جاتی ہے، جو ایک درجہ بندی واپس کرتی ہے جو اس بات کی نشاندہی کرتی ہے کہ آیا دھوئیں کا الارم بجتا ہے یا نہیں۔

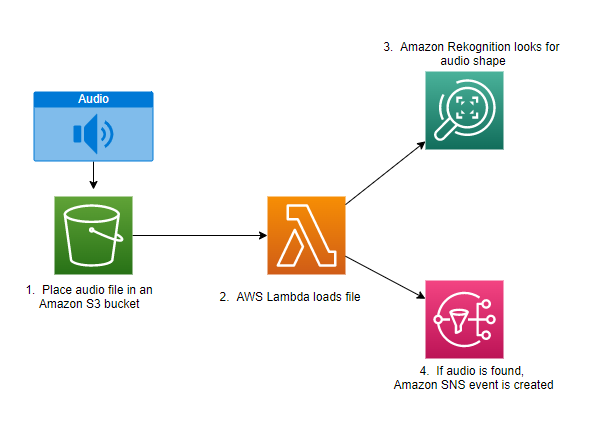

مندرجہ ذیل خاکہ ایک مثال فن تعمیر کو دکھاتا ہے جو اس انفرنس پائپ لائن کو لاگو کرتا ہے۔

یہ فن تعمیر ایک آڈیو فائل کو S3 بالٹی میں رکھنے کا انتظار کرتا ہے، جس کے بعد او ڈبلیو ایس لامبڈا۔ فنکشن کو طلب کیا جائے گا۔ لیمبڈا ایک سرور لیس، ایونٹ سے چلنے والی کمپیوٹ سروس ہے جو آپ کو کسی بھی قسم کی ایپلیکیشن یا بیک اینڈ سروس کے لیے سرورز کی فراہمی یا انتظام کیے بغیر کوڈ چلانے دیتی ہے۔ آپ 200 سے زیادہ AWS سروسز اور سافٹ ویئر سے بطور سروس (SaaS) ایپلی کیشنز سے ایک Lambda فنکشن کو ٹرگر کر سکتے ہیں، اور صرف اس کی ادائیگی کر سکتے ہیں جو آپ استعمال کرتے ہیں۔

لیمبڈا فنکشن کو بالٹی کا نام اور آڈیو فائل کی کلید (یا فائل کا نام) کا نام ملتا ہے۔ فائل کو ایمیزون S3 سے فنکشن کی میموری میں ڈاؤن لوڈ کیا جاتا ہے، جو پھر اسے سپیکٹروگرام میں تبدیل کرتا ہے اور ونڈونگ اور فریکوئنسی فلٹرنگ کرتا ہے۔ سپیکٹروگرام کا ہر کھڑکی والا حصہ پھر ایمیزون ریکوگنیشن کو بھیجا جاتا ہے، جو آواز کا پتہ لگانے کے لیے پہلے سے تربیت یافتہ ایمیزون کسٹم لیبلز ماڈل کا استعمال کرتا ہے۔ اگر وہ آواز ملتی ہے تو، لیمبڈا فنکشن اشارہ کرتا ہے کہ ایک استعمال کرکے ایمیزون سادہ نوٹیفکیشن سروس (ایمیزون ایس این ایس) نوٹیفکیشن۔ ایمیزون ایس این ایس ایک پب/سب اپروچ پیش کرتا ہے جہاں پر اطلاعات بھیجی جا سکتی ہیں۔ ایمیزون سادہ قطار سروس (ایمیزون ایس کیو ایس) قطاریں، لیمبڈا فنکشنز، ایچ ٹی ٹی پی ایس اینڈ پوائنٹس، ای میل ایڈریسز، موبائل پش، اور بہت کچھ۔

نتیجہ

آپ آڈیو ڈیٹا کے ساتھ مشین لرننگ کا استعمال اس بات کا تعین کرنے کے لیے کر سکتے ہیں کہ بعض آوازیں کب آتی ہیں، یہاں تک کہ جب دوسری آوازیں ایک ہی وقت میں آ رہی ہوں۔ ایسا کرنے کے لیے آواز کو ایک سپیکٹروگرام امیج میں تبدیل کرنے کی ضرورت ہوتی ہے، اور پھر فریکوئنسی بینڈ کے ذریعے ونڈو اور فلٹرنگ کے ذریعے اس سپیکٹروگرام کے مختلف حصوں پر گھر جانا پڑتا ہے۔ شناخت حسب ضرورت لیبلز آواز کا پتہ لگانے کے لیے حسب ضرورت ماڈل کو تربیت دینا آسان بناتا ہے۔

آپ استعمال کر سکتے ہیں GitHub repo آپ کے اپنے تجربات کے لیے نقطہ آغاز کے طور پر اس پوسٹ کے مثالی کوڈ پر مشتمل ہے۔ آڈیو ایونٹ کا پتہ لگانے کے بارے میں مزید معلومات کے لیے، رجوع کریں۔ صوتی واقعہ کا پتہ لگانا: ایک سبق.

مصنفین کے بارے میں

گریگ سومرویل AWS پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ ٹیم میں ایک سینئر پروٹوٹائپنگ آرکیٹیکٹ ہے، جہاں وہ AWS کے صارفین کو مشین لرننگ، IoT اور سرور لیس ٹیکنالوجیز کے ساتھ چیلنج کرنے والے مسائل کے جدید حل پر عمل درآمد کرنے میں مدد کرتا ہے۔ وہ این آربر، مشی گن میں رہتا ہے اور یوگا کی مشق کرنے، اپنے کتوں کو پالنے، اور پوکر کھیلنے سے لطف اندوز ہوتا ہے۔

گریگ سومرویل AWS پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ ٹیم میں ایک سینئر پروٹوٹائپنگ آرکیٹیکٹ ہے، جہاں وہ AWS کے صارفین کو مشین لرننگ، IoT اور سرور لیس ٹیکنالوجیز کے ساتھ چیلنج کرنے والے مسائل کے جدید حل پر عمل درآمد کرنے میں مدد کرتا ہے۔ وہ این آربر، مشی گن میں رہتا ہے اور یوگا کی مشق کرنے، اپنے کتوں کو پالنے، اور پوکر کھیلنے سے لطف اندوز ہوتا ہے۔

جیف ہرمن AWS پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ ٹیم میں ایک سینئر پروٹوٹائپنگ آرکیٹیکٹ ہے، جہاں وہ AWS کے صارفین کو چیلنجنگ مسائل کے جدید حل پر عمل درآمد میں مدد کرتا ہے۔ وہ یونین ویل، کنیکٹی کٹ میں رہتا ہے اور لکڑی کے کام، لوہار اور مائن کرافٹ سے لطف اندوز ہوتا ہے۔

جیف ہرمن AWS پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ ٹیم میں ایک سینئر پروٹوٹائپنگ آرکیٹیکٹ ہے، جہاں وہ AWS کے صارفین کو چیلنجنگ مسائل کے جدید حل پر عمل درآمد میں مدد کرتا ہے۔ وہ یونین ویل، کنیکٹی کٹ میں رہتا ہے اور لکڑی کے کام، لوہار اور مائن کرافٹ سے لطف اندوز ہوتا ہے۔

- AI

- ai آرٹ

- AI آرٹ جنریٹر

- عی روبوٹ

- ایمیزون پہچان۔

- مصنوعی ذہانت

- مصنوعی ذہانت کا سرٹیفیکیشن

- بینکنگ میں مصنوعی ذہانت

- مصنوعی ذہانت والا روبوٹ

- مصنوعی ذہانت والے روبوٹ

- مصنوعی ذہانت سافٹ ویئر

- AWS مشین لرننگ

- blockchain

- بلاکچین کانفرنس

- coingenius

- بات چیت مصنوعی ذہانت

- crypto کانفرنس ai

- dall-e

- گہری سیکھنے

- گوگل عی

- مشین لرننگ

- پلاٹا

- افلاطون اے

- افلاطون ڈیٹا انٹیلی جنس

- افلاطون گیم

- پلیٹو ڈیٹا

- پلیٹو گیمنگ

- پیمانہ ai

- نحو

- زیفیرنیٹ