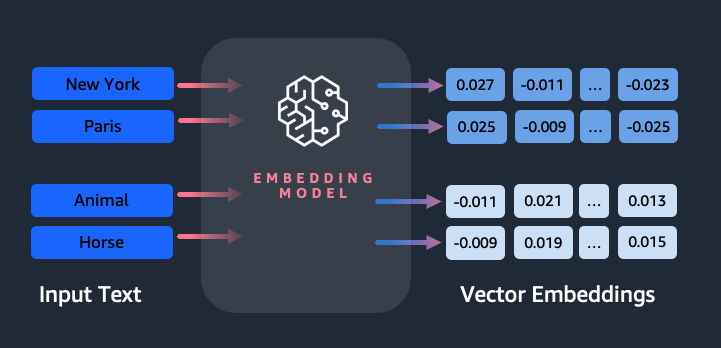

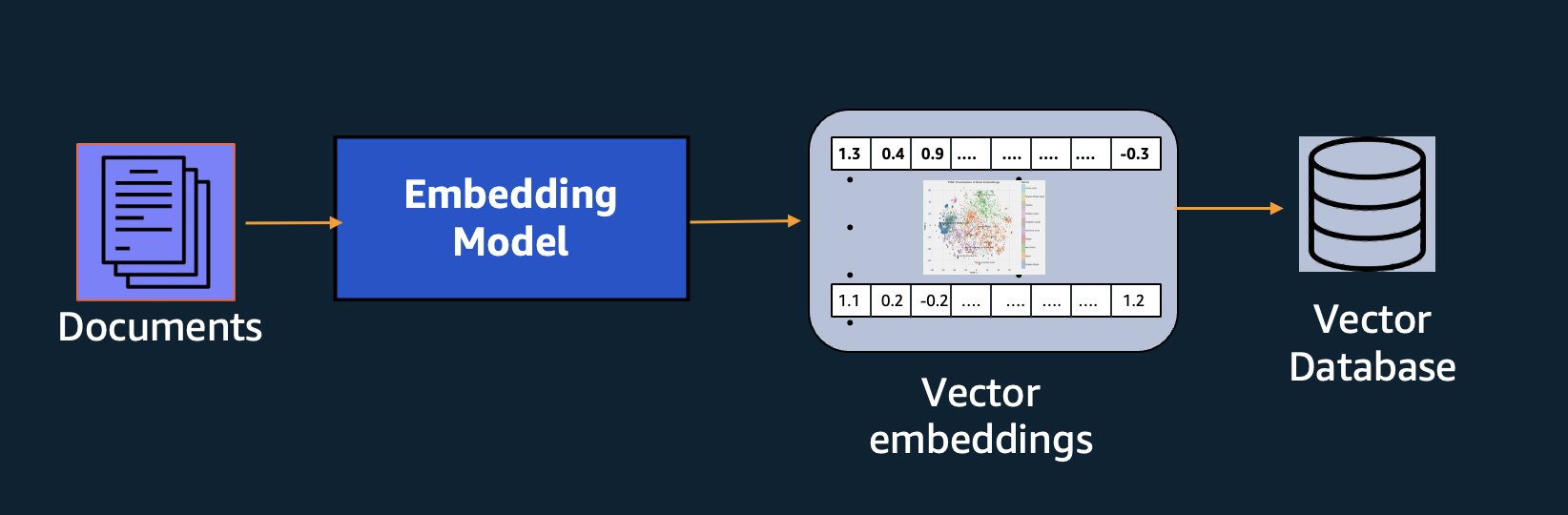

ایمبیڈنگز نیچرل لینگویج پروسیسنگ (NLP) اور مشین لرننگ (ML) میں کلیدی کردار ادا کرتی ہیں۔ ٹیکسٹ ایمبیڈنگ متن کو عددی نمائندگی میں تبدیل کرنے کے عمل سے مراد ہے جو ایک اعلی جہتی ویکٹر اسپیس میں رہتی ہے۔ یہ تکنیک ML الگورتھم کے استعمال کے ذریعے حاصل کی جاتی ہے جو ڈیٹا کے معنی اور سیاق و سباق کو سمجھنے کے قابل بناتی ہے (معنی رشتوں) اور ڈیٹا کے اندر پیچیدہ تعلقات اور نمونوں کو سیکھنے (نحوی تعلقات)۔ آپ وسیع پیمانے پر ایپلی کیشنز کے لیے نتیجے میں آنے والی ویکٹر کی نمائندگی کو استعمال کر سکتے ہیں، جیسے کہ معلومات کی بازیافت، متن کی درجہ بندی، قدرتی زبان کی پروسیسنگ، اور بہت سی دوسری۔

ایمیزون ٹائٹن ٹیکسٹ ایمبیڈنگز ٹیکسٹ ایمبیڈنگز کا ایک ماڈل ہے جو قدرتی زبان کے متن کو تبدیل کرتا ہے — جو کہ واحد الفاظ، فقرے، یا یہاں تک کہ بڑی دستاویزات پر مشتمل ہوتا ہے — کو عددی نمائندگیوں میں تبدیل کرتا ہے جو لفظی مماثلت کی بنیاد پر تلاش، پرسنلائزیشن، اور کلسٹرنگ جیسے طاقت کے استعمال کے معاملات میں استعمال کیا جا سکتا ہے۔

اس پوسٹ میں، ہم Amazon Titan Text Embeddings ماڈل، اس کی خصوصیات، اور مثال کے استعمال کے معاملات پر تبادلہ خیال کرتے ہیں۔

کچھ کلیدی تصورات میں شامل ہیں:

- متن کی عددی نمائندگی (ویکٹرز) الفاظ کے درمیان سیمنٹکس اور تعلقات کو پکڑتی ہے۔

- متن کی مماثلت کا موازنہ کرنے کے لیے بھرپور سرایت کا استعمال کیا جا سکتا ہے۔

- کثیر لسانی متن کی سرایت مختلف زبانوں میں معنی کی شناخت کر سکتی ہے۔

متن کے ٹکڑے کو ویکٹر میں کیسے تبدیل کیا جاتا ہے؟

ایک جملے کو ویکٹر میں تبدیل کرنے کی متعدد تکنیکیں ہیں۔ ایک مقبول طریقہ ورڈ ایمبیڈنگ الگورتھم کا استعمال کرنا ہے، جیسے Word2Vec، GloVe، یا FastText، اور پھر جملے کی سطح کے ویکٹر کی نمائندگی کے لیے لفظ ایمبیڈنگز کو جمع کرنا۔

ایک اور عام طریقہ یہ ہے کہ بڑے لینگویج ماڈلز (LLMs) کا استعمال کیا جائے، جیسے BERT یا GPT، جو پورے جملے کے لیے سیاق و سباق کے ساتھ سرایت کر سکتے ہیں۔ یہ ماڈلز ٹرانسفارمرز جیسے گہرے سیکھنے والے فن تعمیر پر مبنی ہیں، جو ایک جملے میں سیاق و سباق کی معلومات اور الفاظ کے درمیان تعلقات کو زیادہ مؤثر طریقے سے پکڑ سکتے ہیں۔

ہمیں ایمبیڈنگ ماڈل کی ضرورت کیوں ہے؟

LLMs کے لیے زبان کی معنوی ڈگریوں کو سمجھنے کے لیے ویکٹر ایمبیڈنگز بنیادی ہیں، اور LLMs کو بہاوی NLP کاموں جیسے جذبات کا تجزیہ، نام کی ہستی کی شناخت، اور متن کی درجہ بندی پر اچھی کارکردگی کا اہل بناتے ہیں۔

معنوی تلاش کے علاوہ، آپ Retrieval Augmented Generation (RAG) کے ذریعے مزید درست نتائج کے لیے اپنے اشارے کو بڑھانے کے لیے ایمبیڈنگز کا استعمال کر سکتے ہیں—لیکن انہیں استعمال کرنے کے لیے، آپ کو انہیں ویکٹر کی صلاحیتوں کے ساتھ ڈیٹا بیس میں اسٹور کرنے کی ضرورت ہوگی۔

ایمیزون ٹائٹن ٹیکسٹ ایمبیڈنگز ماڈل کو آر اے جی کے استعمال کے کیسز کو فعال کرنے کے لیے ٹیکسٹ کی بازیافت کے لیے بہتر بنایا گیا ہے۔ یہ آپ کو پہلے اپنے ٹیکسٹ ڈیٹا کو عددی نمائندگی یا ویکٹر میں تبدیل کرنے کے قابل بناتا ہے، اور پھر ان ویکٹرز کو کسی ویکٹر ڈیٹابیس سے متعلقہ حصئوں کو درست طریقے سے تلاش کرنے کے لیے استعمال کرتا ہے، جس سے آپ دوسرے فاؤنڈیشن ماڈلز کے ساتھ مل کر اپنے ملکیتی ڈیٹا کا زیادہ سے زیادہ فائدہ اٹھا سکتے ہیں۔

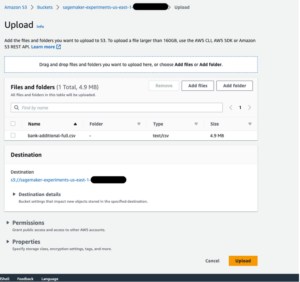

کیونکہ Amazon Titan Text Embeddings ایک منظم ماڈل ہے۔ ایمیزون بیڈرک، یہ مکمل طور پر بغیر سرور کے تجربے کے طور پر پیش کیا گیا ہے۔ آپ اسے Amazon Bedrock REST کے ذریعے استعمال کر سکتے ہیں۔ API یا AWS SDK۔ مطلوبہ پیرامیٹرز وہ ٹیکسٹ ہیں جسے آپ ایمبیڈنگز اور کی تخلیق کرنا چاہیں گے۔ modelID پیرامیٹر، جو Amazon Titan Text Embeddings ماڈل کے نام کی نمائندگی کرتا ہے۔ مندرجہ ذیل کوڈ ایک مثال ہے AWS SDK برائے Python (Boto3):

آؤٹ پٹ کچھ اس طرح نظر آئے گا:

کا حوالہ دیتے ہیں ایمیزون بیڈرک بوٹو 3 سیٹ اپ مطلوبہ پیکجز کو انسٹال کرنے کے طریقے کے بارے میں مزید تفصیلات کے لیے، Amazon Bedrock سے جڑیں، اور ماڈلز کی درخواست کریں۔

ایمیزون ٹائٹن ٹیکسٹ ایمبیڈنگز کی خصوصیات

Amazon Titan Text Embeddings کے ساتھ، آپ 8,000 ٹوکن تک ان پٹ کر سکتے ہیں، جس سے یہ آپ کے استعمال کے معاملے کی بنیاد پر ایک لفظ، فقرے، یا پوری دستاویزات کے ساتھ کام کرنے کے لیے موزوں ہے۔ ایمیزون ٹائٹن طول و عرض 1536 کے آؤٹ پٹ ویکٹرز کو واپس کرتا ہے، اسے اعلی درجے کی درستگی دیتا ہے، جبکہ کم تاخیر، لاگت سے موثر نتائج کے لیے بھی بہتر بناتا ہے۔

Amazon Titan Text Embeddings 25 سے زیادہ مختلف زبانوں میں ٹیکسٹ کے لیے ایمبیڈنگز بنانے اور استفسار کرنے کی حمایت کرتا ہے۔ اس کا مطلب ہے کہ آپ ہر اس زبان کے لیے علیحدہ ماڈل بنانے اور برقرار رکھنے کی ضرورت کے بغیر اپنے استعمال کے کیسز پر ماڈل لاگو کر سکتے ہیں جس کی آپ حمایت کرنا چاہتے ہیں۔

متعدد زبانوں پر تربیت یافتہ سنگل ایمبیڈنگ ماڈل کا ہونا درج ذیل اہم فوائد فراہم کرتا ہے:

- وسیع تر رسائی - باکس کے باہر 25 سے زیادہ زبانوں کو سپورٹ کرکے، آپ بہت سے بین الاقوامی مارکیٹوں میں صارفین اور مواد تک اپنی ایپلیکیشنز کی رسائی کو بڑھا سکتے ہیں۔

- مستقل کارکردگی - متعدد زبانوں کا احاطہ کرنے والے متحد ماڈل کے ساتھ، آپ کو ہر زبان کے لیے الگ الگ اصلاح کرنے کے بجائے تمام زبانوں میں مستقل نتائج حاصل ہوتے ہیں۔ ماڈل کو مجموعی طور پر تربیت دی جاتی ہے لہذا آپ کو تمام زبانوں میں فائدہ حاصل ہوتا ہے۔

- کثیر لسانی استفسار کی حمایت - ایمیزون ٹائٹن ٹیکسٹ ایمبیڈنگز کسی بھی معاون زبان میں ٹیکسٹ ایمبیڈنگز کو استفسار کرنے کی اجازت دیتا ہے۔ یہ کسی ایک زبان تک محدود کیے بغیر تمام زبانوں میں معنوی طور پر ایک جیسے مواد کو بازیافت کرنے کے لیے لچک فراہم کرتا ہے۔ آپ ایسی ایپلی کیشنز بنا سکتے ہیں جو ایک ہی متحد ایمبیڈنگ اسپیس کا استعمال کرتے ہوئے کثیر لسانی ڈیٹا کا استفسار اور تجزیہ کریں۔

اس تحریر کے مطابق، درج ذیل زبانیں معاون ہیں:

- عربی

- چینی (آسان کردہ)

- چینی (روایتی)

- چیک

- ڈچ

- انگریزی

- فرانسیسی

- جرمن

- عبرانی

- ہندی

- اطالوی

- جاپانی

- کناڈا

- کوریا

- ملیالم

- مراٹهی

- پولستانی

- پرتگالی

- روسی

- ہسپانوی

- سویڈش

- فلپائنی ٹیگالوگ

- تامل

- تیلگو

- ترکی

LangChain کے ساتھ Amazon Titan Text Embeddings کا استعمال

لینگ چین کے ساتھ کام کرنے کے لیے ایک مقبول اوپن سورس فریم ورک ہے۔ پیدا کرنے والا AI ماڈلز اور معاون ٹیکنالوجیز۔ اس میں ایک شامل ہے۔ BedrockEmbeddings کلائنٹ جو آسانی سے Boto3 SDK کو تجریدی پرت کے ساتھ لپیٹ دیتا ہے۔ دی BedrockEmbeddings کلائنٹ آپ کو JSON درخواست یا ردعمل کے ڈھانچے کی تفصیلات جانے بغیر براہ راست متن اور سرایت کے ساتھ کام کرنے کی اجازت دیتا ہے۔ ذیل میں ایک سادہ مثال ہے:

آپ LangChain's بھی استعمال کر سکتے ہیں۔ BedrockEmbeddings ایمیزون بیڈروک ایل ایل ایم کلائنٹ کے ساتھ ساتھ آر اے جی، سیمنٹک سرچ، اور سرایت سے متعلق دیگر پیٹرن کو لاگو کرنے کو آسان بنانے کے لیے۔

ایمبیڈنگ کے لیے کیسز کا استعمال کریں۔

اگرچہ RAG فی الحال ایمبیڈنگز کے ساتھ کام کرنے کے لیے سب سے زیادہ مقبول استعمال کیس ہے، لیکن استعمال کے بہت سے دوسرے کیسز ہیں جہاں ایمبیڈنگز کو لاگو کیا جا سکتا ہے۔ ذیل میں کچھ اضافی منظرنامے ہیں جہاں آپ مخصوص مسائل کو حل کرنے کے لیے ایمبیڈنگز کا استعمال کر سکتے ہیں، یا تو خود یا LLM کے تعاون سے:

- سوال و جواب - ایمبیڈنگز RAG پیٹرن کے ذریعے سوال و جواب کے انٹرفیس کو سپورٹ کرنے میں مدد کر سکتی ہیں۔ ویکٹر ڈیٹابیس کے ساتھ جوڑ بنانے والی ایمبیڈنگ جنریشن آپ کو علمی ذخیرے میں سوالات اور مواد کے درمیان قریبی مماثلت تلاش کرنے کی اجازت دیتی ہے۔

- ذاتی نوعیت کی تجاویز - سوال و جواب کی طرح، آپ تعطیل کے مقامات، کالج، گاڑیاں، یا صارف کے فراہم کردہ معیار کی بنیاد پر دیگر مصنوعات تلاش کرنے کے لیے سرایت کا استعمال کر سکتے ہیں۔ یہ میچوں کی ایک سادہ فہرست کی شکل اختیار کر سکتا ہے، یا پھر آپ ہر ایک سفارش پر کارروائی کرنے کے لیے LLM استعمال کر سکتے ہیں اور یہ بتا سکتے ہیں کہ یہ صارف کے معیار کو کیسے پورا کرتا ہے۔ آپ اس نقطہ نظر کو صارف کی مخصوص ضروریات کی بنیاد پر اپنی مرضی کے مطابق "10 بہترین" مضامین تیار کرنے کے لیے بھی استعمال کر سکتے ہیں۔

- ڈیٹا مینجمنٹ - جب آپ کے پاس ڈیٹا کے ذرائع ہیں جو ایک دوسرے سے صاف طور پر نقشہ نہیں بناتے ہیں، لیکن آپ کے پاس متنی مواد ہے جو ڈیٹا ریکارڈ کو بیان کرتا ہے، تو آپ ممکنہ ڈپلیکیٹ ریکارڈز کی شناخت کے لیے سرایت کا استعمال کر سکتے ہیں۔ مثال کے طور پر، آپ ڈپلیکیٹ امیدواروں کی شناخت کے لیے ایمبیڈنگز استعمال کر سکتے ہیں جو مختلف فارمیٹنگ، مخففات، یا ترجمہ شدہ نام بھی استعمال کر سکتے ہیں۔

- ایپلیکیشن پورٹ فولیو کی معقولیت - جب کسی پیرنٹ کمپنی اور حصول کے لیے ایپلیکیشن پورٹ فولیوز کو سیدھ میں لانا چاہتے ہیں، تو یہ ہمیشہ واضح نہیں ہوتا ہے کہ ممکنہ اوورلیپ کو کہاں سے تلاش کرنا ہے۔ کنفیگریشن مینجمنٹ ڈیٹا کا معیار ایک محدود عنصر ہو سکتا ہے، اور ایپلیکیشن لینڈ سکیپ کو سمجھنے کے لیے ٹیموں کے درمیان ہم آہنگی پیدا کرنا مشکل ہو سکتا ہے۔ ایمبیڈنگز کے ساتھ معنوی مماثلت کا استعمال کرتے ہوئے، ہم معقولیت کے لیے اعلیٰ ممکنہ امیدواروں کی ایپلی کیشنز کی شناخت کرنے کے لیے ایپلیکیشن پورٹ فولیوز میں ایک فوری تجزیہ کر سکتے ہیں۔

- مواد کی گروپ بندی - آپ ایمبیڈنگز کا استعمال کر سکتے ہیں تاکہ ملتے جلتے مواد کو ان زمروں میں گروپ کرنے میں مدد کریں جو شاید آپ کو وقت سے پہلے معلوم نہ ہوں۔ مثال کے طور پر، فرض کریں کہ آپ کے پاس کسٹمر کی ای میلز یا آن لائن پروڈکٹ کے جائزوں کا ایک مجموعہ تھا۔ آپ ہر آئٹم کے لیے ایمبیڈنگز بنا سکتے ہیں، پھر ان ایمبیڈنگز کو چلائیں۔ k کا مطلب ہے کلسٹرنگ گاہک کے خدشات، مصنوعات کی تعریف یا شکایات، یا دیگر موضوعات کی منطقی گروہ بندیوں کی نشاندہی کرنے کے لیے۔ اس کے بعد آپ ایل ایل ایم کا استعمال کرتے ہوئے ان گروپنگ کے مواد سے فوکسڈ خلاصے تیار کر سکتے ہیں۔

سیمنٹک تلاش کی مثال

ہمارے میں مثال GitHub پر، ہم Amazon Titan Text Embeddings، LangChain، اور Streamlit کے ساتھ ایک سادہ ایمبیڈنگز سرچ ایپلی کیشن کا مظاہرہ کرتے ہیں۔

مثال ایک صارف کے استفسار سے ان میموری ویکٹر ڈیٹا بیس میں قریب ترین اندراجات سے میل کھاتی ہے۔ پھر ہم ان میچوں کو براہ راست یوزر انٹرفیس میں ڈسپلے کرتے ہیں۔ یہ مفید ہو سکتا ہے اگر آپ کسی RAG ایپلیکیشن کا ازالہ کرنا چاہتے ہیں، یا ایمبیڈنگس ماڈل کا براہ راست جائزہ لینا چاہتے ہیں۔

سادگی کے لیے، ہم ان میموری کا استعمال کرتے ہیں۔ FAISS ایمبیڈنگ ویکٹرز کو ذخیرہ کرنے اور تلاش کرنے کے لیے ڈیٹا بیس۔ پیمانے پر حقیقی دنیا کے منظر نامے میں، آپ ممکنہ طور پر ایک مستقل ڈیٹا اسٹور استعمال کرنا چاہیں گے جیسے Amazon OpenSearch Serverless کے لیے ویکٹر انجن یا pgvector PostgreSQL کے لیے توسیع۔

ویب ایپلیکیشن سے مختلف زبانوں میں چند اشارے آزمائیں، جیسے کہ درج ذیل:

- میں اپنے استعمال کی نگرانی کیسے کر سکتا ہوں؟

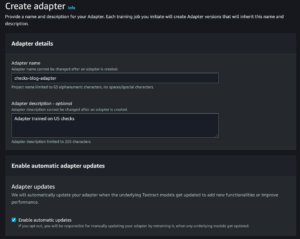

- میں ماڈلز کو کس طرح اپنی مرضی کے مطابق بنا سکتا ہوں؟

- میں کون سی پروگرامنگ زبانیں استعمال کر سکتا ہوں؟

- تبصرہ mes données sont-elles sécurisées ?

- 私のデータはどのように保護されていますか?

- Quais fornecedores de modelos estão disponíveis por meio do Bedrock؟

- welchen Regionen ist Amazon Bedrock verfügbar میں؟

- 有哪些级别的支持?

نوٹ کریں کہ اگرچہ ماخذ مواد انگریزی میں تھا، دوسری زبانوں میں سوالات متعلقہ اندراجات کے ساتھ مماثل تھے۔

نتیجہ

فاؤنڈیشن ماڈلز کی ٹیکسٹ جنریشن کی صلاحیتیں بہت پرجوش ہیں، لیکن یہ یاد رکھنا ضروری ہے کہ متن کو سمجھنا، علم کے ایک حصے سے متعلقہ مواد تلاش کرنا، اور حصئوں کے درمیان رابطہ قائم کرنا جنریٹو AI کی مکمل قدر حاصل کرنے کے لیے بہت ضروری ہے۔ ہم اگلے سالوں میں ایمبیڈنگز کے استعمال کے نئے اور دلچسپ کیسز کو دیکھتے رہیں گے کیونکہ ان ماڈلز میں بہتری آتی جارہی ہے۔

اگلے مراحل

آپ مندرجہ ذیل ورکشاپس میں نوٹ بک یا ڈیمو ایپلی کیشنز کے طور پر سرایت کرنے کی اضافی مثالیں تلاش کر سکتے ہیں:

مصنفین کے بارے میں

جیسن سٹیل نیو انگلینڈ کے علاقے میں مقیم AWS میں ایک سینئر سولیوشن آرکیٹیکٹ ہے۔ وہ صارفین کے ساتھ کام کرتا ہے تاکہ AWS کی صلاحیتوں کو ان کے سب سے بڑے کاروباری چیلنجوں سے ہم آہنگ کیا جا سکے۔ کام سے باہر، وہ اپنا وقت چیزیں بنانے اور اپنے خاندان کے ساتھ مزاحیہ کتابوں کی فلمیں دیکھنے میں صرف کرتا ہے۔

جیسن سٹیل نیو انگلینڈ کے علاقے میں مقیم AWS میں ایک سینئر سولیوشن آرکیٹیکٹ ہے۔ وہ صارفین کے ساتھ کام کرتا ہے تاکہ AWS کی صلاحیتوں کو ان کے سب سے بڑے کاروباری چیلنجوں سے ہم آہنگ کیا جا سکے۔ کام سے باہر، وہ اپنا وقت چیزیں بنانے اور اپنے خاندان کے ساتھ مزاحیہ کتابوں کی فلمیں دیکھنے میں صرف کرتا ہے۔

نتن یوسیبیئس AWS میں ایک Sr. Enterprise Solutions آرکیٹیکٹ ہے، جو سافٹ ویئر انجینئرنگ، انٹرپرائز آرکیٹیکچر، اور AI/ML میں تجربہ کار ہے۔ وہ تخلیقی AI کے امکانات کو تلاش کرنے کے بارے میں بہت پرجوش ہے۔ وہ صارفین کے ساتھ تعاون کرتا ہے تاکہ وہ AWS پلیٹ فارم پر اچھی طرح سے آرکیٹیکڈ ایپلی کیشنز بنانے میں ان کی مدد کرے، اور ٹیکنالوجی کے چیلنجوں کو حل کرنے اور ان کے کلاؤڈ سفر میں مدد کرنے کے لیے وقف ہے۔

نتن یوسیبیئس AWS میں ایک Sr. Enterprise Solutions آرکیٹیکٹ ہے، جو سافٹ ویئر انجینئرنگ، انٹرپرائز آرکیٹیکچر، اور AI/ML میں تجربہ کار ہے۔ وہ تخلیقی AI کے امکانات کو تلاش کرنے کے بارے میں بہت پرجوش ہے۔ وہ صارفین کے ساتھ تعاون کرتا ہے تاکہ وہ AWS پلیٹ فارم پر اچھی طرح سے آرکیٹیکڈ ایپلی کیشنز بنانے میں ان کی مدد کرے، اور ٹیکنالوجی کے چیلنجوں کو حل کرنے اور ان کے کلاؤڈ سفر میں مدد کرنے کے لیے وقف ہے۔

راج پاٹھک کینیڈا اور ریاستہائے متحدہ میں بڑی Fortune 50 کمپنیوں اور درمیانے درجے کے مالیاتی خدمات کے اداروں (FSI) کے پرنسپل سلوشنز آرکیٹیکٹ اور تکنیکی مشیر ہیں۔ وہ مشین لرننگ ایپلی کیشنز جیسے جنریٹو AI، قدرتی زبان کی پروسیسنگ، ذہین دستاویز کی پروسیسنگ، اور MLOps میں مہارت رکھتا ہے۔

راج پاٹھک کینیڈا اور ریاستہائے متحدہ میں بڑی Fortune 50 کمپنیوں اور درمیانے درجے کے مالیاتی خدمات کے اداروں (FSI) کے پرنسپل سلوشنز آرکیٹیکٹ اور تکنیکی مشیر ہیں۔ وہ مشین لرننگ ایپلی کیشنز جیسے جنریٹو AI، قدرتی زبان کی پروسیسنگ، ذہین دستاویز کی پروسیسنگ، اور MLOps میں مہارت رکھتا ہے۔

مانی خانوجا ایک ٹیک لیڈ - جنریٹو AI ماہرین، کتاب کی مصنفہ - AWS پر اپلائیڈ مشین لرننگ اور ہائی پرفارمنس کمپیوٹنگ، اور مینوفیکچرنگ ایجوکیشن فاؤنڈیشن بورڈ میں خواتین کے لیے بورڈ آف ڈائریکٹرز کی رکن ہیں۔ وہ مختلف ڈومینز جیسے کمپیوٹر ویژن، نیچرل لینگویج پروسیسنگ اور جنریٹیو AI میں مشین لرننگ (ML) پروجیکٹس کی رہنمائی کرتی ہیں۔ وہ بڑے پیمانے پر مشین لرننگ ماڈل بنانے، تربیت دینے اور تعینات کرنے میں صارفین کی مدد کرتی ہے۔ وہ اندرونی اور بیرونی کانفرنسوں میں بولتی ہیں جیسے کہ: ایجاد، ویمن ان مینوفیکچرنگ ویسٹ، یوٹیوب ویبینرز اور جی ایچ سی 23۔ اپنے فارغ وقت میں، وہ ساحل سمندر پر لمبی دوڑنا پسند کرتی ہے۔

مانی خانوجا ایک ٹیک لیڈ - جنریٹو AI ماہرین، کتاب کی مصنفہ - AWS پر اپلائیڈ مشین لرننگ اور ہائی پرفارمنس کمپیوٹنگ، اور مینوفیکچرنگ ایجوکیشن فاؤنڈیشن بورڈ میں خواتین کے لیے بورڈ آف ڈائریکٹرز کی رکن ہیں۔ وہ مختلف ڈومینز جیسے کمپیوٹر ویژن، نیچرل لینگویج پروسیسنگ اور جنریٹیو AI میں مشین لرننگ (ML) پروجیکٹس کی رہنمائی کرتی ہیں۔ وہ بڑے پیمانے پر مشین لرننگ ماڈل بنانے، تربیت دینے اور تعینات کرنے میں صارفین کی مدد کرتی ہے۔ وہ اندرونی اور بیرونی کانفرنسوں میں بولتی ہیں جیسے کہ: ایجاد، ویمن ان مینوفیکچرنگ ویسٹ، یوٹیوب ویبینرز اور جی ایچ سی 23۔ اپنے فارغ وقت میں، وہ ساحل سمندر پر لمبی دوڑنا پسند کرتی ہے۔

مارک رائے AWS کے لیے ایک پرنسپل مشین لرننگ آرکیٹیکٹ ہے، جو صارفین کو AI/ML سلوشنز ڈیزائن کرنے اور بنانے میں مدد کرتا ہے۔ مارک کا کام ML کے استعمال کے کیسز کی ایک وسیع رینج پر محیط ہے، جس میں کمپیوٹر ویژن، گہری سیکھنے، اور پورے انٹرپرائز میں ML کی پیمائش میں بنیادی دلچسپی ہے۔ اس نے کئی صنعتوں میں کمپنیوں کی مدد کی ہے، بشمول انشورنس، مالیاتی خدمات، میڈیا اور تفریح، صحت کی دیکھ بھال، افادیت، اور مینوفیکچرنگ۔ مارک کے پاس چھ AWS سرٹیفیکیشنز ہیں، بشمول ML اسپیشلٹی سرٹیفیکیشن۔ AWS میں شامل ہونے سے پہلے، مارک 25 سال سے زائد عرصے تک ایک معمار، ڈویلپر، اور ٹیکنالوجی لیڈر تھے، بشمول مالیاتی خدمات میں 19 سال۔

مارک رائے AWS کے لیے ایک پرنسپل مشین لرننگ آرکیٹیکٹ ہے، جو صارفین کو AI/ML سلوشنز ڈیزائن کرنے اور بنانے میں مدد کرتا ہے۔ مارک کا کام ML کے استعمال کے کیسز کی ایک وسیع رینج پر محیط ہے، جس میں کمپیوٹر ویژن، گہری سیکھنے، اور پورے انٹرپرائز میں ML کی پیمائش میں بنیادی دلچسپی ہے۔ اس نے کئی صنعتوں میں کمپنیوں کی مدد کی ہے، بشمول انشورنس، مالیاتی خدمات، میڈیا اور تفریح، صحت کی دیکھ بھال، افادیت، اور مینوفیکچرنگ۔ مارک کے پاس چھ AWS سرٹیفیکیشنز ہیں، بشمول ML اسپیشلٹی سرٹیفیکیشن۔ AWS میں شامل ہونے سے پہلے، مارک 25 سال سے زائد عرصے تک ایک معمار، ڈویلپر، اور ٹیکنالوجی لیڈر تھے، بشمول مالیاتی خدمات میں 19 سال۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/getting-started-with-amazon-titan-text-embeddings/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 000

- 10

- 100

- 12

- 121

- 125

- 19

- 23

- 25

- 50

- 7

- 8

- a

- ہمارے بارے میں

- تجری

- قبول کریں

- درستگی

- درست

- درست طریقے سے

- حاصل کیا

- حصول

- حصول

- کے پار

- اس کے علاوہ

- ایڈیشنل

- فائدہ

- مشیر

- جمع کرنا

- آگے

- AI

- AI / ML

- یلگوردمز

- سیدھ کریں

- تمام

- کی اجازت

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- ساتھ

- شانہ بشانہ

- بھی

- ہمیشہ

- ایمیزون

- ایمیزون ویب سروسز

- an

- تجزیہ

- تجزیے

- اور

- جواب

- کوئی بھی

- درخواست

- ایپلی کیشنز

- اطلاقی

- کا اطلاق کریں

- نقطہ نظر

- فن تعمیر

- آرکیٹیکچرز

- کیا

- رقبہ

- مضامین

- AS

- مدد

- At

- اضافہ

- اضافہ

- مصنف

- دستیاب

- AWS

- کی بنیاد پر

- BE

- بیچ

- کیا جا رہا ہے

- فوائد

- کے درمیان

- بورڈ

- بورڈ آف ڈائریکٹرز

- جسم

- کتاب

- باکس

- تعمیر

- عمارت

- کاروبار

- لیکن

- by

- کر سکتے ہیں

- کینیڈا

- امیدوار

- امیدواروں

- صلاحیتوں

- قبضہ

- قبضہ

- کیس

- مقدمات

- اقسام

- تصدیق

- سرٹیفکیٹ

- چیلنجوں

- درجہ بندی

- کلائنٹ

- کلوز

- بادل

- clustering کے

- کوڈ

- تعاون کرتا ہے

- مجموعہ

- کالجز

- مجموعہ

- کامن

- کمپنیاں

- کمپنی کے

- موازنہ

- شکایات

- پیچیدہ

- کمپیوٹر

- کمپیوٹر ویژن

- کمپیوٹنگ

- تصورات

- اندراج

- کانفرنسوں

- ترتیب

- رابطہ قائم کریں

- کنکشن

- کنکشن

- متواتر

- مواد

- سیاق و سباق

- متعلقہ

- جاری

- آسانی سے

- تبدیل

- تبدیل

- تعاون

- ہم آہنگی

- سرمایہ کاری مؤثر

- سکتا ہے

- ڈھکنے

- کا احاطہ کرتا ہے

- تخلیق

- تخلیق

- معیار

- اہم

- اس وقت

- اپنی مرضی کے

- گاہک

- گاہکوں

- اپنی مرضی کے مطابق

- اعداد و شمار

- ڈیٹا بیس

- de

- وقف

- گہری

- گہری سیکھنے

- گہری

- وضاحت

- ڈگری

- ڈیمو

- مظاہرہ

- تعیناتی

- بیان کرتا ہے

- ڈیزائن

- منزلوں

- تفصیلات

- ڈیولپر

- مختلف

- مشکل

- طول و عرض

- براہ راست

- ڈائریکٹرز

- بات چیت

- دکھائیں

- do

- دستاویز

- دستاویزات

- ڈومینز

- نہیں

- ہر ایک

- تعلیم

- مؤثر طریقے

- یا تو

- ای میل

- سرایت کرنا

- ابھر کر سامنے آئے

- کو چالو کرنے کے

- کے قابل بناتا ہے

- انجن

- انجنیئرنگ

- انگلینڈ

- انگریزی

- انٹرپرائز

- تفریح

- پوری

- مکمل

- ہستی

- اندازہ

- بھی

- مثال کے طور پر

- مثال کے طور پر

- دلچسپ

- توسیع

- تجربہ

- تجربہ کار

- وضاحت

- ایکسپلور

- مدت ملازمت میں توسیع

- بیرونی

- سہولت

- عنصر

- خاندان

- خصوصیات

- چند

- مالی

- مالیاتی خدمات

- مل

- تلاش

- پہلا

- لچک

- توجہ مرکوز

- کے بعد

- کے لئے

- فارم

- فارچیون

- فاؤنڈیشن

- فریم ورک

- مفت

- سے

- مکمل

- بنیادی

- پیدا

- نسل

- پیداواری

- پیداواری AI۔

- حاصل

- حاصل کرنے

- دے

- دستانے

- Go

- سب سے بڑا

- تھا

- ہے

- he

- صحت کی دیکھ بھال

- مدد

- مدد

- مدد

- مدد کرتا ہے

- اس کی

- ہائی

- ان

- کی ڈگری حاصل کی

- کس طرح

- کیسے

- HTML

- HTTPS

- i

- شناخت

- if

- پر عمل درآمد

- درآمد

- اہم

- کو بہتر بنانے کے

- in

- دیگر میں

- شامل

- شامل ہیں

- سمیت

- صنعتوں

- معلومات

- ان پٹ

- انسٹال

- کے بجائے

- اداروں

- انشورنس

- انٹیلجنٹ

- ذہین دستاویز پروسیسنگ

- دلچسپی

- دلچسپ

- انٹرفیس

- انٹرفیسز

- اندرونی

- بین الاقوامی سطح پر

- میں

- IT

- میں

- شمولیت

- سفر

- فوٹو

- JSON

- کلیدی

- جان

- جاننا

- علم

- زمین کی تزئین کی

- زبان

- زبانیں

- بڑے

- پرت

- قیادت

- رہنما

- لیڈز

- سیکھنے

- دو

- کی طرح

- امکان

- پسند

- محدود

- لسٹ

- ایل ایل ایم

- منطقی

- لانگ

- دیکھو

- تلاش

- مشین

- مشین لرننگ

- برقرار رکھنے کے

- بنا

- بنانا

- میں کامیاب

- انتظام

- مینوفیکچرنگ

- بہت سے

- نقشہ

- نشان

- نشانات

- Markets

- ملا

- میچ

- کے ملاپ

- مواد

- me

- مطلب

- کا مطلب ہے کہ

- میڈیا

- رکن

- طریقہ

- شاید

- ML

- ایم ایل اوپس

- ماڈل

- ماڈل

- کی نگرانی

- زیادہ

- سب سے زیادہ

- سب سے زیادہ مقبول

- فلم

- ایک سے زیادہ

- my

- نام

- نامزد

- نام

- قدرتی

- قدرتی زبان عملیات

- ضرورت ہے

- ضرورت ہے

- ضروریات

- نئی

- اگلے

- ویزا

- واضح

- of

- کی پیشکش کی

- on

- ایک

- آن لائن

- کھول

- اوپن سورس

- اصلاح

- اصلاح

- or

- حکم

- دیگر

- دیگر

- ہمارے

- باہر

- پیداوار

- باہر

- پر

- اوورلیپ

- خود

- پیکجوں کے

- جوڑا

- پیرامیٹر

- پیرامیٹرز

- بنیادی کمپنی

- حصئوں

- جذباتی

- پاٹرن

- پیٹرن

- فی

- انجام دیں

- کارکردگی

- شخصی

- جملے

- ٹکڑا

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- کھیلیں

- مہربانی کرکے

- مقبول

- BY

- پورٹ فولیو

- محکموں

- امکانات

- پوسٹ

- پوسٹگریسقیل

- ممکنہ

- طاقت

- پرائمری

- پرنسپل

- پرنٹ

- پہلے

- مسائل

- عمل

- پروسیسنگ

- مصنوعات

- مصنوعات کی جائزہ

- حاصل

- پروگرامنگ

- پروگرامنگ زبانوں

- منصوبوں

- اشارہ کرتا ہے

- ملکیت

- فراہم

- فراہم

- فراہم کرتا ہے

- ازگر

- معیار

- سوالات

- استفسار میں

- سوال

- سوالات

- فوری

- چیتھڑا

- رینج

- RE

- تک پہنچنے

- حقیقی دنیا

- تسلیم

- سفارش

- سفارشات

- ریکارڈ

- ریکارڈ

- مراد

- تعلقات

- متعلقہ

- یاد

- ذخیرہ

- نمائندگی

- کی نمائندگی کرتا ہے

- درخواست

- ضرورت

- جواب

- باقی

- محدود

- نتیجے

- نتائج کی نمائش

- بازیافت

- واپسی

- جائزہ

- کردار

- رن

- چلتا ہے

- s

- اسی

- کا کہنا ہے کہ

- پیمانے

- سکیلنگ

- منظر نامے

- منظرنامے

- sdk

- تلاش کریں

- دیکھنا

- معنوی

- سیمنٹ

- سینئر

- سزا

- جذبات

- علیحدہ

- بے سرور

- سروسز

- وہ

- اسی طرح

- سادہ

- سادگی

- آسان

- آسان بنانے

- ایک

- چھ

- So

- سافٹ ویئر کی

- سافٹ ویئر انجینئرنگ

- حل

- حل

- حل کرنا۔

- کچھ

- کچھ

- ماخذ

- ذرائع

- خلا

- بولی

- ماہرین

- مہارت دیتا ہے

- خاص

- مخصوص

- شروع کریں

- شروع

- امریکہ

- ذخیرہ

- ڈھانچوں

- اس طرح

- حمایت

- تائید

- امدادی

- کی حمایت کرتا ہے

- لے لو

- کاموں

- ٹیموں

- ٹیک

- ٹیکنیکل

- تکنیک

- تکنیک

- ٹیکنالوجی

- ٹیکنالوجی

- بتا

- متن

- متن کی درجہ بندی

- کہ

- ۔

- ماخذ

- ان

- ان

- موضوعات

- تو

- وہاں.

- یہ

- چیزیں

- اس

- ان

- اگرچہ؟

- کے ذریعے

- وقت

- ٹائٹین

- کرنے کے لئے

- ٹوکن

- روایتی

- ٹرین

- تربیت یافتہ

- ٹرانسفارمرز

- تبدیل

- سمجھ

- افہام و تفہیم

- متحد

- متحدہ

- ریاست ہائے متحدہ امریکہ

- استعمال

- استعمال کی شرائط

- استعمال کیس

- استعمال کیا جاتا ہے

- مفید

- رکن کا

- صارف مواجہ

- صارفین

- کا استعمال کرتے ہوئے

- افادیت

- چھٹی

- قیمت

- مختلف

- گاڑیاں

- بہت

- کی طرف سے

- نقطہ نظر

- چاہتے ہیں

- تھا

- دیکھ

- we

- ویب

- ویب ایپلی کیشن

- ویب خدمات

- Webinars

- اچھا ہے

- تھے

- مغربی

- جب

- جس

- جبکہ

- وسیع

- وسیع رینج

- گے

- ساتھ

- کے اندر

- بغیر

- خواتین

- لفظ

- الفاظ

- کام

- کام کر

- کام کرتا ہے

- ورکشاپ

- گا

- لکھنا

- تحریری طور پر

- سال

- تم

- اور

- یو ٹیوب پر

- زیفیرنیٹ