مشین لرننگ (ML) ایپلی کیشنز تعینات کرنے کے لیے پیچیدہ ہیں اور اکثر ان کو ہائپر اسکیل کرنے کی صلاحیت کی ضرورت ہوتی ہے، اور انتہائی کم تاخیر کی ضروریات اور سخت لاگت والے بجٹ ہوتے ہیں۔ دھوکہ دہی کا پتہ لگانے، پروڈکٹ کی سفارشات، اور ٹریفک کی پیشین گوئی جیسے معاملات استعمال کریں ایسی مثالیں ہیں جہاں ملی سیکنڈز اہمیت رکھتے ہیں اور کاروباری کامیابی کے لیے اہم ہیں۔ سروس لیول کے سخت معاہدوں (SLAs) کو پورا کرنے کی ضرورت ہے، اور ایک عام درخواست کے لیے متعدد مراحل کی ضرورت ہو سکتی ہے جیسے پری پروسیسنگ، ڈیٹا ٹرانسفارمیشن، فیچر انجینئرنگ، ماڈل سلیکشن منطق، ماڈل ایگریگیشن، اور پوسٹ پروسیسنگ۔

بہترین لاگت اور کمپیوٹ کی افادیت کے ساتھ پیمانے پر ایم ایل ماڈلز کی تعیناتی ایک مشکل اور بوجھل کام ہو سکتا ہے۔ بیرونی ڈیٹا کے ذرائع کے ساتھ ساتھ رن ٹائم ماحول جیسے کہ بنیادی کمپیوٹ وسائل کی CPU/GPU پاور پر مبنی ہر ماڈل کی اپنی خوبیاں اور انحصار ہوتے ہیں۔ ایک درخواست کو ایک ہی انفرنس کی درخواست کی خدمت کے لیے متعدد ML ماڈلز کی ضرورت ہو سکتی ہے۔ بعض حالات میں، ایک درخواست متعدد ماڈلز میں بہہ سکتی ہے۔ یہاں کوئی ایک سائز کے مطابق نہیں ہے، اور ML پریکٹیشنرز کے لیے یہ ضروری ہے کہ وہ بار بار آنے والے ML ہوسٹنگ چیلنجوں سے نمٹنے کے لیے آزمائے گئے اور ثابت شدہ طریقے تلاش کریں۔ یہ ایم ایل ماڈل ہوسٹنگ کے لیے ڈیزائن پیٹرن کے ارتقاء کا باعث بنا ہے۔

اس پوسٹ میں، ہم ML ایپلیکیشنز کی تعمیر کے لیے عام ڈیزائن کے نمونوں کو تلاش کرتے ہیں۔ ایمیزون سیج میکر.

ایم ایل ایپلی کیشنز بنانے کے لیے ڈیزائن پیٹرن

آئیے ایم ایل ایپلی کیشنز کی میزبانی کے لیے استعمال کرنے کے لیے درج ذیل ڈیزائن پیٹرن کو دیکھتے ہیں۔

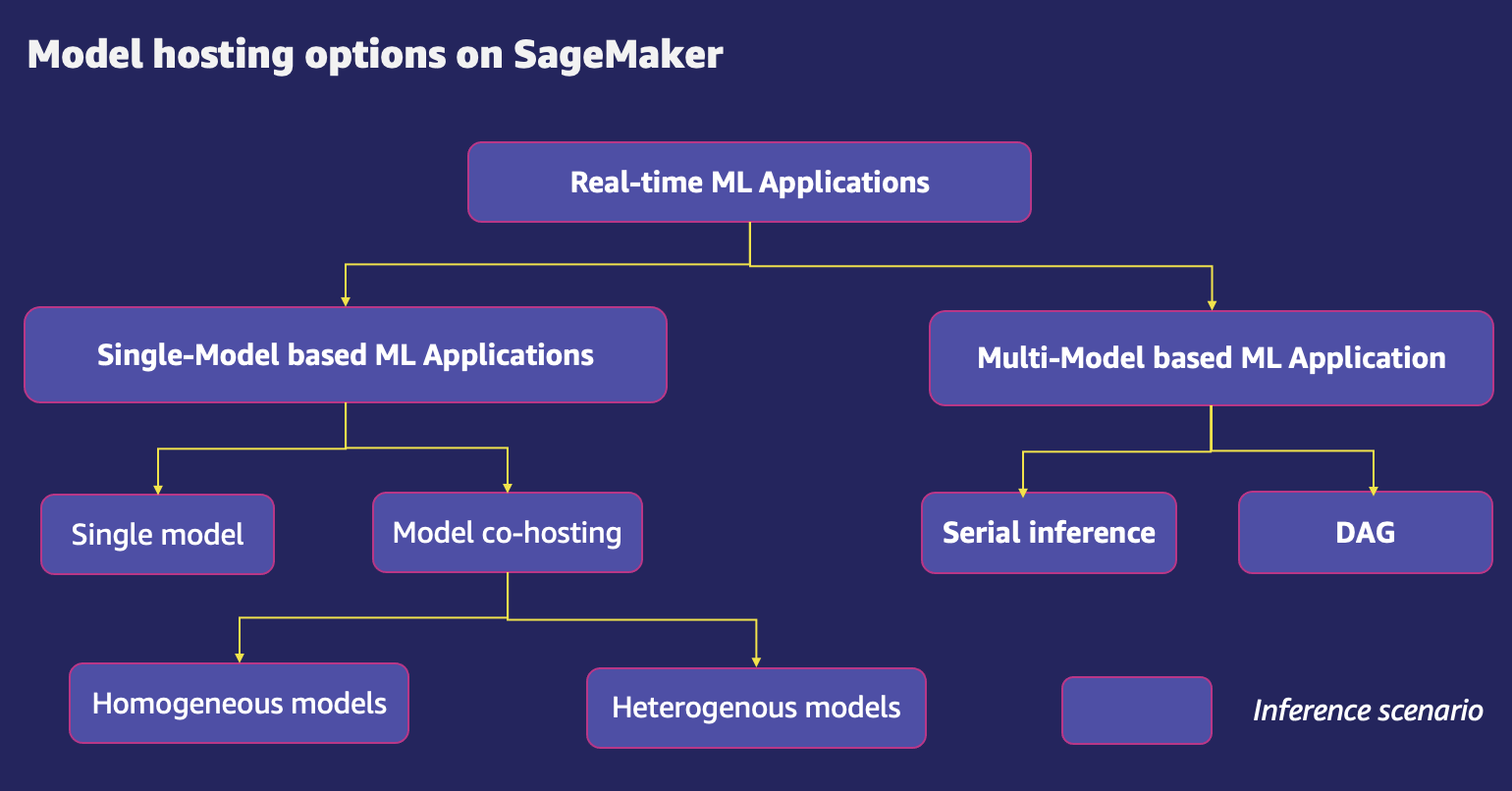

سنگل ماڈل پر مبنی ایم ایل ایپلی کیشنز

یہ ایک بہترین آپشن ہے جب آپ کے ML استعمال کیس کو درخواست کی خدمت کے لیے ایک ماڈل کی ضرورت ہوتی ہے۔ ماڈل کو ان پٹ ٹریفک کی بنیاد پر پیمانہ کرنے کی صلاحیت کے ساتھ ایک سرشار کمپیوٹ انفراسٹرکچر پر تعینات کیا گیا ہے۔ یہ آپشن اس وقت بھی مثالی ہے جب کلائنٹ کی ایپلیکیشن میں کم تاخیر (ملی سیکنڈ یا سیکنڈ کی ترتیب میں) تخمینہ کی ضرورت ہو۔

ملٹی ماڈل پر مبنی ایم ایل ایپلی کیشنز

ہوسٹنگ کو زیادہ سرمایہ کاری مؤثر بنانے کے لیے، یہ ڈیزائن پیٹرن آپ کو ایک ہی کرایہ دار کے انفراسٹرکچر پر متعدد ماڈلز کی میزبانی کرنے کی اجازت دیتا ہے۔ ایک سے زیادہ ML ماڈلز میزبان یا کنٹینر کے وسائل کا اشتراک کر سکتے ہیں، بشمول میموری میں سب سے زیادہ استعمال ہونے والے ML ماڈلز کو کیش کرنا، جس کے نتیجے میں میموری اور کمپیوٹ وسائل کا بہتر استعمال ہوتا ہے۔ ان ماڈلز کی قسموں پر منحصر ہے جن کو آپ نے تعینات کرنے کا انتخاب کیا ہے، ماڈل شریک میزبانی درج ذیل طریقے استعمال کر سکتی ہے:

- ملٹی ماڈل ہوسٹنگ - یہ اختیار آپ کو ایک ہی اختتامی نقطہ پر مشترکہ سرونگ کنٹینر کا استعمال کرتے ہوئے متعدد ماڈلز کی میزبانی کرنے کی اجازت دیتا ہے۔ یہ خصوصیت اس وقت مثالی ہے جب آپ کے پاس ملتے جلتے ماڈلز کی ایک بڑی تعداد ہو جسے آپ مشترکہ سرونگ کنٹینر کے ذریعے پیش کر سکتے ہیں اور آپ کو ایک ہی وقت میں تمام ماڈلز تک رسائی کی ضرورت نہیں ہے۔

- ملٹی کنٹینر ہوسٹنگ - یہ آپشن اس وقت مثالی ہے جب آپ کے پاس ایک جیسے وسائل کی ضروریات کے ساتھ مختلف سرونگ اسٹیک پر متعدد ماڈلز چل رہے ہوں، اور جب انفرادی ماڈلز کے پاس اختتامی نقطہ کی پوری صلاحیت کو استعمال کرنے کے لیے کافی ٹریفک نہ ہو۔ ملٹی کنٹینر ہوسٹنگ آپ کو متعدد کنٹینرز تعینات کرنے کی اجازت دیتی ہے جو ایک ہی اختتامی نقطہ پر مختلف ماڈلز یا فریم ورک استعمال کرتے ہیں۔ ماڈل مکمل طور پر متضاد ہوسکتے ہیں، ان کے اپنے خود مختار سرونگ اسٹیک کے ساتھ۔

- ماڈل ensembles - پیداواری استعمال کے بہت سے معاملات میں، اکثر ایسے بہت سے اپ اسٹریم ماڈل ہوسکتے ہیں جو دیے گئے ڈاون اسٹریم ماڈل کو ان پٹ فراہم کرتے ہیں۔ یہ ہے جہاں ensembles مفید ہیں. انسمبل پیٹرن میں کم کرنے کے لیے ایک یا زیادہ بیس ماڈلز سے اختلاط آؤٹ پٹ شامل ہوتا ہے۔ عام کرنے کی غلطی پیشن گوئی کی. بیس ماڈل متنوع اور مختلف الگورتھم کے ذریعہ تربیت یافتہ ہوسکتے ہیں۔ ماڈل کے جوڑے سنگل ماڈلز سے بہتر کارکردگی کا مظاہرہ کر سکتے ہیں کیونکہ جب جوڑا اپروچ استعمال کیا جاتا ہے تو ماڈل کی پیشین گوئی کی غلطی کم ہو جاتی ہے۔

ذیل میں جوڑا پیٹرن اور ان کے متعلقہ ڈیزائن پیٹرن کے عام استعمال کے معاملات ہیں:

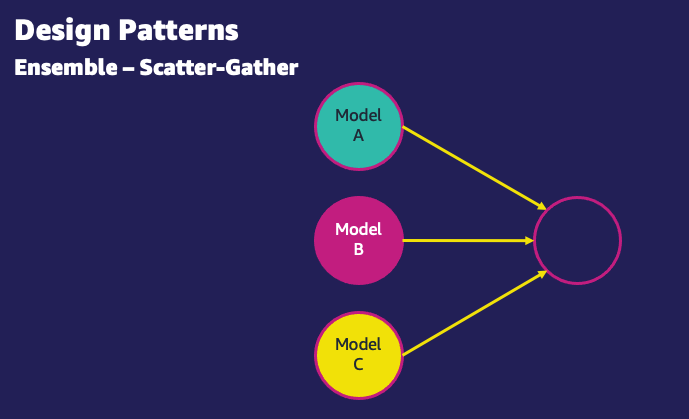

- بکھرنا-جمع کرنا - ایک سکیٹر-گیدر پیٹرن میں، تخمینہ کی درخواست متعدد ماڈلز تک پہنچائی جاتی ہے۔ اس کے بعد جوابات کو جمع کرنے اور انہیں ایک ہی قیاس کے جواب میں ڈسٹل کرنے کے لیے ایک ایگریگیٹر کا استعمال کیا جاتا ہے۔ مثال کے طور پر، تصویر کی درجہ بندی کے استعمال کا کیس کام کو انجام دینے کے لیے تین مختلف ماڈلز کا استعمال کر سکتا ہے۔ سکیٹر-گیدر پیٹرن آپ کو تین مختلف ماڈلز پر چلائے جانے والے انفرنسز سے نتائج کو یکجا کرنے اور سب سے زیادہ ممکنہ درجہ بندی ماڈل منتخب کرنے کی اجازت دیتا ہے۔

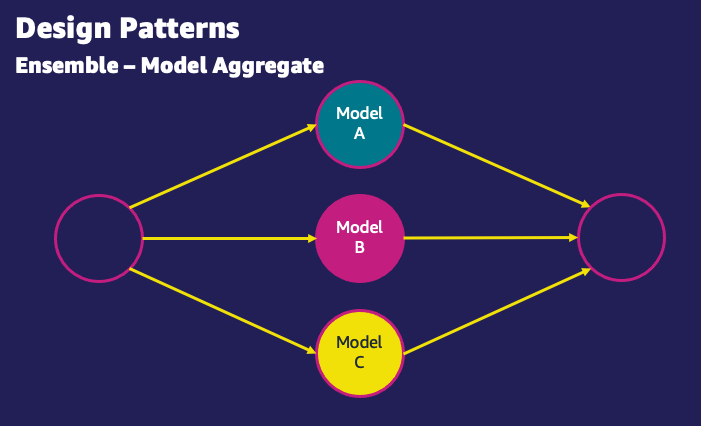

- مجموعی ماڈل - ایک مجموعی پیٹرن میں، متعدد ماڈلز سے حاصل ہونے والی پیداوار کا اوسط لیا جاتا ہے۔ درجہ بندی کے ماڈلز کے لیے، ایک سے زیادہ ماڈلز کی پیشین گوئیوں کا اندازہ اس طبقے کا تعین کرنے کے لیے کیا جاتا ہے جس نے سب سے زیادہ ووٹ حاصل کیے ہیں اور اسے جوڑ کے حتمی آؤٹ پٹ کے طور پر سمجھا جاتا ہے۔ مثال کے طور پر، پھلوں کے ایک سیٹ کو سنتری یا سیب کے طور پر درجہ بندی کرنے کے لیے دو قسم کی درجہ بندی کے مسئلے میں، اگر دو ماڈل ایک نارنجی کو ووٹ دیتے ہیں اور ایک ماڈل ایک سیب کو ووٹ دیتا ہے، تو مجموعی پیداوار ایک سنتری ہوگی۔ مجموعہ انفرادی ماڈلز میں غلطیت کا مقابلہ کرنے میں مدد کرتا ہے اور آؤٹ پٹ کو زیادہ درست بناتا ہے۔

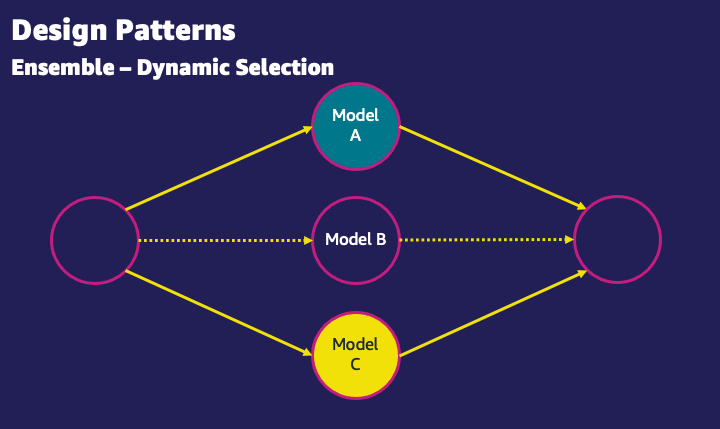

- متحرک انتخاب - جوڑنے والے ماڈلز کے لیے ایک اور نمونہ یہ ہے کہ دی گئی ان پٹ خصوصیات کے لیے متحرک طور پر ماڈل کا انتخاب کرنا ہے۔ مثال کے طور پر، پھلوں کی تصاویر کے دیے گئے ان پٹ میں، اگر ان پٹ میں نارنجی ہے، تو ماڈل A استعمال کیا جائے گا کیونکہ یہ سنتری کے لیے مخصوص ہے۔ اگر ان پٹ میں ایک سیب ہے تو ماڈل B استعمال کیا جائے گا کیونکہ یہ سیب کے لیے مخصوص ہے۔

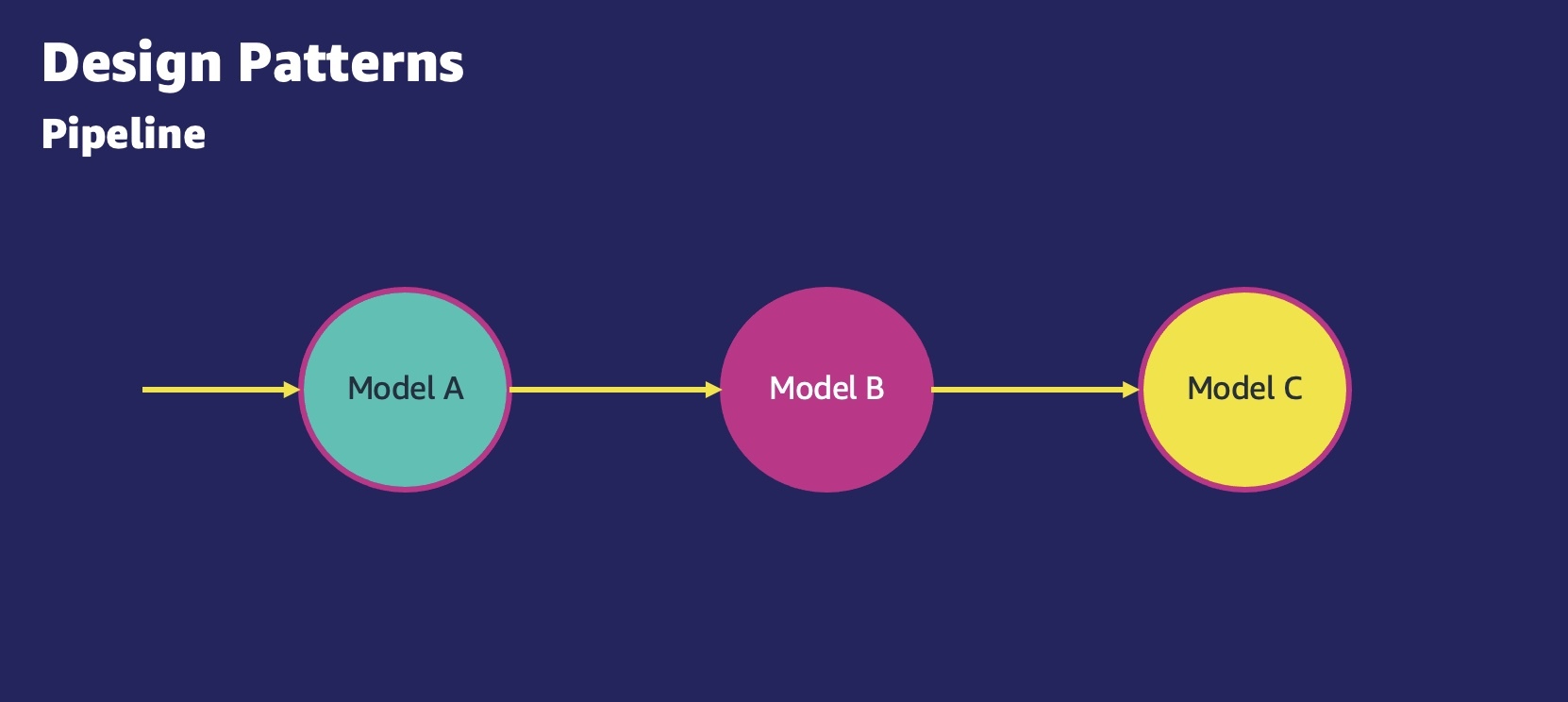

- سیریل انفرنس ایم ایل ایپلی کیشنز - سیریل انفرنس پیٹرن کے ساتھ، جسے انفرنس پائپ لائن بھی کہا جاتا ہے، استعمال کے کیسز میں قیاس پیدا کرنے کے لیے پہلے سے تربیت یافتہ ML ماڈل کو استعمال کرنے سے پہلے آنے والے ڈیٹا کو پری پروسیس کرنے کی ضرورت ہوتی ہے۔ مزید برآں، بعض صورتوں میں، پیدا شدہ قیاسات پر مزید کارروائی کرنے کی ضرورت پڑسکتی ہے، تاکہ انہیں بہاؤ کی ایپلی کیشنز کے ذریعے آسانی سے استعمال کیا جاسکے۔ ایک انفرنس پائپ لائن آپ کو ماڈل ٹریننگ کے دوران استعمال ہونے والے اسی پری پروسیسنگ کوڈ کو دوبارہ استعمال کرنے کی اجازت دیتی ہے تاکہ پیشین گوئیوں کے لیے استعمال ہونے والے تخمینے کی درخواست کے ڈیٹا پر کارروائی کی جا سکے۔

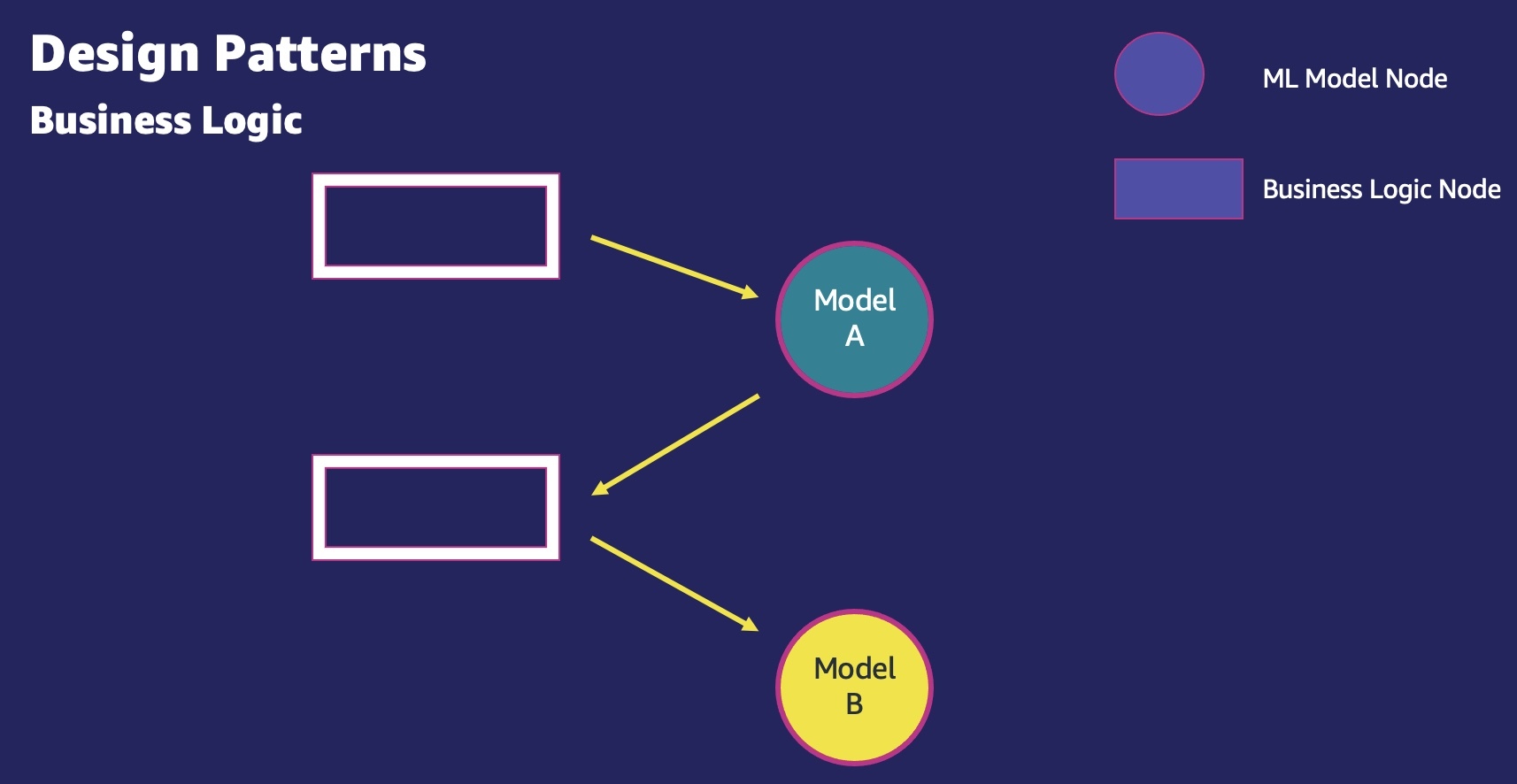

- کاروباری منطق - ایم ایل کی پیداوار میں ہمیشہ کاروباری منطق شامل ہوتی ہے۔ کاروباری منطق کے نمونوں میں وہ سب کچھ شامل ہوتا ہے جو ML ٹاسک کو انجام دینے کے لیے درکار ہے جو کہ ML ماڈل کا اندازہ نہیں ہے۔ اس میں سے ماڈل لوڈ کرنا شامل ہے۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3)، مثال کے طور پر، ان پٹ کی توثیق کرنے کے لیے ڈیٹا بیس کی تلاش، فیچر اسٹور سے پہلے سے گنتی شدہ خصوصیات حاصل کرنا، وغیرہ۔ کاروباری منطق کے ان مراحل کے مکمل ہونے کے بعد، ان پٹ کو ایم ایل ماڈلز میں منتقل کیا جاتا ہے۔

ML تخمینہ کے اختیارات

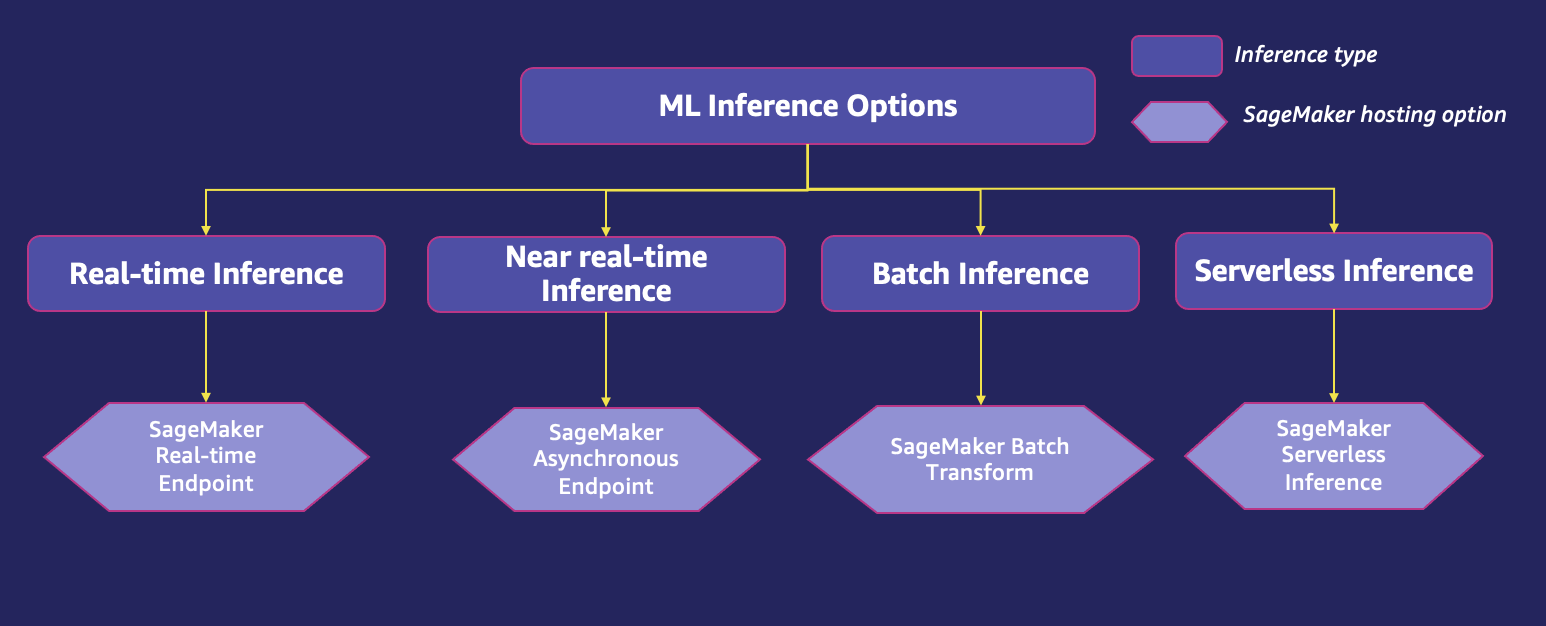

ماڈل کی تعیناتی کے لیے، یہ ضروری ہے کہ آپ اپنے استعمال کے معاملے سے پیچھے ہٹ کر کام کریں۔ پیشن گوئی کی تعدد کیا ہے؟ کیا آپ اپنی درخواست پر لائیو ٹریفک اور اپنے کلائنٹس کو حقیقی وقت کے جواب کی توقع کرتے ہیں؟ کیا آپ کے پاس ایک ہی استعمال کے کیس کے لیے ڈیٹا کے مختلف ذیلی سیٹوں کے لیے بہت سے ماڈلز تربیت یافتہ ہیں؟ کیا پیشین گوئی ٹریفک میں اتار چڑھاؤ آتا ہے؟ کیا قیاس کی تاخیر ایک تشویش ہے؟ ان تفصیلات کی بنیاد پر، تمام سابقہ ڈیزائن کے نمونوں کو درج ذیل تعیناتی اختیارات کا استعمال کرتے ہوئے لاگو کیا جا سکتا ہے:

- ریئل ٹائم اندازہ - ریئل ٹائم انفرنس انفرنس ورک بوجھ کے لیے مثالی ہے جہاں آپ کے پاس ریئل ٹائم، انٹرایکٹو، کم تاخیر کے تقاضے ہیں۔ ریئل ٹائم ML انفرنس ورک بوجھ میں سنگل ماڈل پر مبنی ML ایپلیکیشن شامل ہو سکتی ہے، جہاں ایک ایپلیکیشن کو ایک درخواست کی خدمت کے لیے صرف ایک ML ماڈل کی ضرورت ہوتی ہے، یا ایک ملٹی ماڈل پر مبنی ML ایپلیکیشن، جہاں ایک ایپلی کیشن کو ایک سے زیادہ ML ماڈلز کی ضرورت ہوتی ہے۔ درخواست

- قریب-حقیقی وقت (غیر مطابقت پذیر) تخمینہ - قریب قریب حقیقی وقت کے تخمینے کے ساتھ، آپ آنے والی درخواستوں کو قطار میں لگا سکتے ہیں۔ اس کا استعمال سیکڑوں MBs والے ان پٹ پر تخمینہ لگانے کے لیے کیا جا سکتا ہے۔ یہ قریب قریب حقیقی وقت میں کام کرتا ہے اور صارفین کو تخمینہ کے لیے ان پٹ استعمال کرنے اور S3 بالٹی سے اختتامی نقطہ سے آؤٹ پٹ پڑھنے کی اجازت دیتا ہے۔ یہ خاص طور پر NLP اور کمپیوٹر ویژن والے معاملات میں کارآمد ثابت ہو سکتا ہے، جہاں بڑے پے لوڈ ہوتے ہیں جن کے لیے پہلے سے پروسیسنگ کے طویل وقت کی ضرورت ہوتی ہے۔

- بیچ کا اندازہ - بیچ کا تخمینہ بڑے ڈیٹاسیٹ پر قیاس آف لائن چلانے کے لیے استعمال کیا جا سکتا ہے۔ چونکہ یہ آف لائن چلتا ہے، بیچ کا اندازہ سب سے کم تاخیر کی پیشکش نہیں کرتا ہے۔ یہاں، تخمینہ کی درخواست پر یا تو بیچ کے تخمینہ جاب کے شیڈول یا ایونٹ پر مبنی ٹرگر کے ساتھ کارروائی کی جاتی ہے۔

- بے سرور تخمینہ - سرور لیس انفرنس ایسے کام کے بوجھ کے لیے مثالی ہے جن میں ٹریفک کی رفتار کے درمیان وقفہ وقفہ ہوتا ہے اور یہ بیکار مدت کے بعد پہلی درخواست کے لیے چند اضافی سیکنڈ کی تاخیر (کولڈ اسٹارٹ) کو برداشت کر سکتا ہے۔ مثال کے طور پر، چیٹ بوٹ سروس یا فارم پر کارروائی کرنے یا دستاویزات سے ڈیٹا کا تجزیہ کرنے کے لیے درخواست۔ اس صورت میں، آپ کو ایک آن لائن انفرنس آپشن چاہیے ہو سکتا ہے جو خود کار طریقے سے فراہم کرنے کے قابل ہو اور تخمینہ کی درخواستوں کے حجم کی بنیاد پر کمپیوٹ کی صلاحیت کو پیمانہ کر سکے۔ اور بیکار وقت کے دوران، اسے کمپیوٹ کی صلاحیت کو مکمل طور پر بند کرنے کے قابل ہونا چاہیے تاکہ آپ سے چارج نہ کیا جائے۔ سرور لیس انفرنس خود کار طریقے سے کمپیوٹ وسائل کو لانچ کرکے اور ٹریفک کے لحاظ سے ان کو اندر اور باہر اسکیل کرکے سرورز کو منتخب کرنے اور ان کا نظم کرنے کی غیر متفرق بھاری لفٹنگ کو دور کرتا ہے۔

صحیح ML inference آپشن کو منتخب کرنے کے لیے فٹنس فنکشنز کا استعمال کریں۔

صحیح ہوسٹنگ آپشن کے بارے میں فیصلہ کرنا ضروری ہے کیونکہ یہ آپ کی ایپلی کیشنز کے ذریعہ فراہم کردہ اختتامی صارفین کو متاثر کرتا ہے۔ اس مقصد کے لیے، ہم کا تصور ادھار لے رہے ہیں۔ فٹنس کے افعال، جسے نیل فورڈ اور ان کے ساتھیوں نے AWS پارٹنر تھاٹ ورکس سے اپنے کام میں تیار کیا تھا۔ ارتقائی فن تعمیرات کی تعمیر. فٹنس فنکشنز گاہک کے مقاصد کی بنیاد پر ہوسٹنگ کے مختلف اختیارات کا نسخہ جات فراہم کرتے ہیں۔ فٹنس فنکشنز آپ کو اپنے فن تعمیر کے منصوبہ بند ارتقا کی اجازت دینے کے لیے ضروری ڈیٹا حاصل کرنے میں مدد کرتے ہیں۔ وہ قابل پیمائش اقدار کا تعین کرتے ہیں تاکہ یہ اندازہ لگایا جا سکے کہ آپ کا حل آپ کے مقرر کردہ اہداف کو حاصل کرنے کے کتنا قریب ہے۔ تندرستی کے فنکشنز مطلوبہ تبدیلی کے عمل کی رہنمائی کے لیے فن تعمیر کے تیار ہونے کے ساتھ ہی ڈھال سکتے ہیں اور ہونا چاہیے۔ یہ آرکیٹیکٹس کو ٹیم کی خود مختاری کو برقرار رکھتے ہوئے اپنی ٹیموں کی رہنمائی کرنے کے لیے ایک ٹول فراہم کرتا ہے۔

فٹنس کے پانچ اہم فنکشنز ہیں جن کا گاہک اپنے ML ماڈلز اور ایپلیکیشنز کی میزبانی کے لیے صحیح ML inference آپشن کو منتخب کرنے کے لیے خیال رکھتے ہیں۔

| فٹنس فنکشن | Description |

| قیمت |

توسیع پذیر فریم ورک پر ML ماڈل اور ML ایپلیکیشن کو تعینات کرنا اور برقرار رکھنا ایک اہم کاروباری عمل ہے، اور ماڈل ہوسٹنگ انفراسٹرکچر، ہوسٹنگ آپشن، ML فریم ورک، ML ماڈل کی خصوصیات، اصلاح، اسکیلنگ پالیسی، اور مزید. کام کے بوجھ کو ہارڈ ویئر کے بنیادی ڈھانچے کا بہترین استعمال کرنا چاہیے تاکہ اس بات کو یقینی بنایا جا سکے کہ لاگت برقرار رہے۔ یہ فٹنس فنکشن خاص طور پر بنیادی ڈھانچے کی لاگت سے مراد ہے، جو ملکیت کی مجموعی لاگت (TCO) کا ایک حصہ ہے۔ انفراسٹرکچر کے اخراجات اسٹوریج، نیٹ ورک اور کمپیوٹ کے لیے مشترکہ اخراجات ہیں۔ TCO کے دیگر اجزاء کو سمجھنا بھی ضروری ہے، بشمول آپریشنل اخراجات اور سیکورٹی اور تعمیل کے اخراجات۔ آپریشنل اخراجات ML انفراسٹرکچر کو چلانے، نگرانی کرنے اور برقرار رکھنے کے مشترکہ اخراجات ہیں۔ آپریشنل اخراجات کا حساب ہر ایک منظر نامے کی بنیاد پر مطلوبہ انجینئرز کی تعداد اور انجینئروں کی سالانہ تنخواہ کے حساب سے لگایا جاتا ہے، جو ایک مخصوص مدت میں جمع ہوتے ہیں۔ گاہک جو سیلف مینیجڈ ML سلوشنز استعمال کر رہے ہیں۔ ایمیزون لچکدار کمپیوٹ کلاؤڈ (ایمیزون ای سی 2)، ایمیزون لچکدار کنٹینر سروس (ایمیزون ای سی ایس)، اور ایمیزون لچکدار کبیرنیٹس سروس (ایمیزون ای کے ایس) کو خود آپریشنل ٹولنگ بنانے کی ضرورت ہے۔ SageMaker استعمال کرنے والے صارفین نمایاں طور پر کم TCO خرچ کرتے ہیں۔ SageMaker inference ایک مکمل طور پر منظم سروس ہے اور ML ماڈلز کو تخمینہ کے لیے تعینات کرنے کی صلاحیتیں فراہم کرتی ہے۔ آپ کو مثالیں فراہم کرنے، مثال کی صحت کی نگرانی کرنے، سیکیورٹی اپ ڈیٹس یا پیچ کا نظم کرنے، آپریشنل میٹرکس کو خارج کرنے، یا اپنے ML انفرنس ورک بوجھ کے لیے مانیٹرنگ بنانے کی ضرورت نہیں ہے۔ اعلی دستیابی اور لچک کو یقینی بنانے کے لیے اس میں بلٹ ان صلاحیتیں ہیں۔ SageMaker آرام اور ٹرانزٹ میں اینڈ ٹو اینڈ انکرپشن کے ساتھ سیکیورٹی کو سپورٹ کرتا ہے، بشمول روٹ والیوم کی انکرپشن اور ایمیزون لچکدار بلاک اسٹور (ایمیزون ای بی ایس) والیوم، ایمیزون ورچوئل پرائیویٹ کلاؤڈ (ایمیزون وی پی سی) سپورٹ، AWS پرائیویٹ لنک, کسٹمر کے زیر انتظام چابیاں، AWS شناخت اور رسائی کا انتظام (IAM) عمدہ رسائی کنٹرول، AWS CloudTrail آڈٹ، تربیت کے لیے انٹرنوڈ انکرپشن، ٹیگ پر مبنی رسائی کنٹرول، نیٹ ورک آئسولیشن، اور انٹرایکٹو ایپلیکیشن پراکسی۔ یہ تمام حفاظتی خصوصیات SageMaker میں باکس کے باہر فراہم کی گئی ہیں، اور 3 سال کی مدت میں انجینئرنگ کی کوششوں کے دسیوں مہینوں کے کاروبار کو بچا سکتی ہیں۔ SageMaker ایک HIPAA- اہل سروس ہے، اور PCI، SOC، GDPR، اور ISO کے تحت تصدیق شدہ ہے۔ سیج میکر ایف سی ایف اینڈ پوائنٹس کو بھی سپورٹ کرتا ہے۔ TCO کے بارے میں مزید معلومات کے لیے رجوع کریں۔ Amazon SageMaker کی ملکیت کی کل لاگت. |

| تخمینہ میں تاخیر | بہت سے ML ماڈلز اور ایپلیکیشنز لیٹنسی بہت اہم ہیں، جس میں انفرنس لیٹینسی سروس لیول کے مقصد کے ذریعے متعین حدود کے اندر ہونی چاہیے۔ انفرنس میں تاخیر کا انحصار بہت سے عوامل پر ہوتا ہے، بشمول ماڈل کا سائز اور پیچیدگی، ہارڈویئر پلیٹ فارم، سافٹ ویئر کا ماحول، اور نیٹ ورک فن تعمیر۔ مثال کے طور پر، بڑے اور زیادہ پیچیدہ ماڈلز کو اندازہ لگانے میں زیادہ وقت لگ سکتا ہے۔ |

| تھرو پٹ (لین دین فی سیکنڈ) | ماڈل کا اندازہ لگانے کے لیے، کارکردگی کو ٹیوننگ کرنے اور ML ایپلیکیشن کے کاروباری مقصد کو حاصل کرنے کے لیے تھرو پٹ کو بہتر بنانا بہت ضروری ہے۔ جیسا کہ ہم ML کے تمام پہلوؤں میں تیزی سے آگے بڑھ رہے ہیں، بشمول چپ ڈیزائن میں ریاضی کی کارروائیوں کے نچلے درجے کے نفاذ، ہارڈ ویئر کے لیے مخصوص لائبریریاں کارکردگی کو بہتر بنانے میں زیادہ کردار ادا کرتی ہیں۔ مختلف عوامل جیسے پے لوڈ کا سائز، نیٹ ورک ہاپس، ہاپس کی نوعیت، ماڈل گراف کی خصوصیات، ماڈل میں آپریٹرز، اور CPU، GPU، اور ماڈل ہوسٹنگ مثالوں کا میموری پروفائل ML ماڈل کے تھرو پٹ کو متاثر کرتے ہیں۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی | ML ماڈلز یا ایپلیکیشنز کے لیے ایک قابل توسیع فریم ورک پر چلنا بہت ضروری ہے جو مختلف ٹریفک کی طلب کو سنبھال سکے۔ یہ CPU اور GPU وسائل کے زیادہ سے زیادہ استعمال کی بھی اجازت دیتا ہے اور کمپیوٹ وسائل کی ضرورت سے زیادہ فراہمی کو روکتا ہے۔ |

| متوقع ٹریفک پیٹرن | ایم ایل ماڈلز یا ایپلی کیشنز میں ٹریفک کے مختلف نمونے ہو سکتے ہیں، جس میں مسلسل ریئل ٹائم لائیو ٹریفک سے لے کر ہر سیکنڈ میں ہزاروں درخواستوں کی متواتر چوٹیوں تک، اور کبھی کبھار، غیر متوقع درخواست کے نمونوں سے لے کر بڑے ڈیٹا سیٹس پر آف لائن بیچ کی درخواستوں تک۔ اپنے ML ماڈل کے لیے صحیح ہوسٹنگ آپشن کو منتخب کرنے کے لیے متوقع ٹریفک پیٹرن سے پیچھے ہٹ کر کام کرنے کی سفارش کی جاتی ہے۔ |

SageMaker کے ساتھ ماڈلز کی تعیناتی

سیج میکر۔ ایک مکمل طور پر منظم AWS سروس ہے جو ہر ڈویلپر اور ڈیٹا سائنسدان کو ML ماڈلز کو تیزی سے بنانے، تربیت دینے، اور پیمانے پر تعینات کرنے کی صلاحیت فراہم کرتی ہے۔ SageMaker inference کے ساتھ، آپ اپنے ML ماڈلز کو میزبانی کے اختتامی مقامات پر تعینات کر سکتے ہیں اور تخمینہ کے نتائج حاصل کر سکتے ہیں۔ سیج میکر آپ کے کام کے بوجھ کی ضروریات کو پورا کرنے کے لیے ہارڈ ویئر اور فیچرز کا ایک وسیع انتخاب فراہم کرتا ہے، جس سے آپ ہارڈویئر ایکسلریشن کے ساتھ 70 سے زیادہ مثالوں کی اقسام کو منتخب کر سکتے ہیں۔ SageMaker SageMaker Inference Recommender نامی ایک نئی خصوصیت کا استعمال کرتے ہوئے انفرنس مثال کی قسم کی سفارش بھی فراہم کر سکتا ہے، اگر آپ کو یقین نہیں ہے کہ آپ کے کام کے بوجھ کے لیے کون سا بہترین ہوگا۔

آپ اپنے استعمال کے معاملات کو بہترین طریقے سے پورا کرنے کے لیے تعیناتی کے اختیارات کا انتخاب کر سکتے ہیں، جیسے کہ حقیقی وقت کا اندازہ، غیر مطابقت پذیر، بیچ، اور یہاں تک کہ سرور کے بغیر اختتامی پوائنٹس۔ اس کے علاوہ، سیج میکر مختلف تعیناتی کی حکمت عملی پیش کرتا ہے جیسے کینری، نیلے رنگ سبز, کی چھایا، اور ماڈل کی تعیناتی کے لیے A/B ٹیسٹنگ، ملٹی ماڈل، ملٹی کنٹینر اینڈ پوائنٹس، اور لچکدار اسکیلنگ کے ساتھ لاگت سے موثر تعیناتی کے ساتھ۔ SageMaker انفرنس کے ساتھ، آپ اپنے اختتامی پوائنٹس کے لیے کارکردگی میٹرکس دیکھ سکتے ہیں۔ ایمیزون کلاؤڈ واچ, اختتامی پوائنٹس کو خود بخود پیمانہ کریں۔ ٹریفک کی بنیاد پر، اور بغیر کسی دستیابی کو کھونے کے اپنے ماڈلز کو پروڈکشن میں اپ ڈیٹ کریں۔

SageMaker آپ کے ماڈل کو تعینات کرنے کے لیے چار اختیارات پیش کرتا ہے تاکہ آپ پیشین گوئیاں کرنا شروع کر سکیں:

- ریئل ٹائم اندازہ - یہ ملی سیکنڈ لیٹینسی کے تقاضوں، 6 MB تک کے پے لوڈ سائز، اور 60 سیکنڈ تک کے پروسیسنگ اوقات کے ساتھ کام کے بوجھ کے لیے موزوں ہے۔

- بیچ کی تبدیلی - یہ اعداد و شمار کے بڑے بیچوں پر آف لائن پیشین گوئیوں کے لیے مثالی ہے جو سامنے دستیاب ہیں۔

- غیر مطابقت پذیر تخمینہ - یہ کام کے بوجھ کے لیے ڈیزائن کیا گیا ہے جن میں سب سیکنڈ لیٹینسی کے تقاضے، 1 جی بی تک پے لوڈ سائز، اور 15 منٹ تک کے پروسیسنگ کے اوقات نہیں ہیں۔

- بے سرور تخمینہ - سرور لیس انفرنس کے ساتھ، آپ بنیادی انفراسٹرکچر کو کنفیگر یا مینیج کیے بغیر قیاس کے لیے ایم ایل ماڈلز کو تیزی سے تعینات کر سکتے ہیں۔ مزید برآں، آپ صرف تخمینہ کی درخواستوں پر کارروائی کرنے کے لیے استعمال ہونے والی کمپیوٹ صلاحیت کے لیے ادائیگی کرتے ہیں، جو وقفے وقفے سے کام کے بوجھ کے لیے مثالی ہے۔

درج ذیل خاکہ آپ کو SageMaker ہوسٹنگ ماڈل کی تعیناتی کے اختیارات کے ساتھ متعلقہ فٹنس فنکشن کے جائزوں کو سمجھنے میں مدد کر سکتا ہے۔

آئیے ہر ایک تعیناتی کے اختیارات کو مزید تفصیل سے دریافت کریں۔

سیج میکر میں اصل وقت کا اندازہ

اگر آپ کے پاس ٹریفک برقرار ہے اور آپ کو 6 MB تک پے لوڈ سائز اور 60 سیکنڈ تک کے پروسیسنگ ٹائمز کے ساتھ اپنی درخواستوں کے لیے کم اور مستقل تاخیر کی ضرورت ہے تو SageMaker ریئل ٹائم انفرنس کی سفارش کی جاتی ہے۔ آپ اپنے ماڈل کو SageMaker ہوسٹنگ سروسز میں تعینات کرتے ہیں اور ایک اختتامی نقطہ حاصل کرتے ہیں جسے اندازہ لگانے کے لیے استعمال کیا جا سکتا ہے۔ یہ اینڈ پوائنٹس مکمل طور پر منظم ہیں اور آٹو اسکیلنگ کو سپورٹ کرتے ہیں۔ ریئل ٹائم انفرنس استعمال کے معاملات کے لیے مقبول ہے جہاں آپ کو کم تاخیر، متوقع ٹریفک کے نمونوں کے ساتھ مطابقت پذیر ردعمل کی توقع ہوتی ہے، جیسے کہ مصنوعات اور خدمات کے لیے ذاتی سفارشات یا ٹرانزیکشنل فراڈ کا پتہ لگانے کے کیسز۔

عام طور پر، ایک کلائنٹ ایپلیکیشن SageMaker HTTPS اینڈ پوائنٹ کو درخواستیں بھیجتی ہے تاکہ تعینات کردہ ماڈل سے نتائج حاصل کیے جا سکیں۔ آپ ایک ہی SageMaker HTTPS اینڈ پوائنٹ پر ایک ماڈل کی متعدد مختلف حالتیں تعینات کر سکتے ہیں۔ یہ پیداوار میں ماڈل کی مختلف حالتوں کو جانچنے کے لیے مفید ہے۔ آٹو اسکیلنگ آپ کو اپنے کام کے بوجھ میں ہونے والی تبدیلیوں کے جواب میں ماڈل کے لیے فراہم کردہ مثالوں کی تعداد کو متحرک طور پر ایڈجسٹ کرنے کی اجازت دیتی ہے۔

مندرجہ ذیل جدول فٹنس افعال کی بنیاد پر SageMaker کے حقیقی وقت کا اندازہ لگانے کے لیے رہنمائی فراہم کرتا ہے۔

| فٹنس فنکشن | Description |

| قیمت |

ریئل ٹائم اینڈ پوائنٹس قیاس کی درخواستوں کے لیے ہم آہنگ جواب پیش کرتے ہیں۔ چونکہ اختتامی نقطہ ہمیشہ چل رہا ہے اور ریئل ٹائم ہم وقت ساز تخمینہ جواب فراہم کرنے کے لیے دستیاب ہے، آپ مثال استعمال کرنے کے لیے ادائیگی کرتے ہیں۔ جب آپ ایک سے زیادہ اینڈ پوائنٹس کو متعین کرتے ہیں تو لاگت میں تیزی سے اضافہ ہو سکتا ہے، خاص طور پر اگر اینڈ پوائنٹس بنیادی مثالوں کو مکمل طور پر استعمال نہیں کرتے ہیں۔ اپنے ماڈل کے لیے صحیح مثال کا انتخاب اس بات کو یقینی بنانے میں مدد کرتا ہے کہ آپ کے پاس اپنے ماڈلز کے لیے سب سے کم قیمت پر سب سے زیادہ پرفارمنس مثال ہے۔ آٹو اسکیلنگ کی سفارش کی جاتی ہے کہ ممکنہ کم ترین قیمت پر مستحکم اور متوقع کارکردگی کو برقرار رکھنے کے لیے ٹریفک کے لحاظ سے صلاحیت کو متحرک طور پر ایڈجسٹ کیا جائے۔ SageMaker Graviton2 اور Graviton3 پر مبنی ML مثال کے خاندانوں تک رسائی بڑھاتا ہے۔ AWS Graviton ایمیزون EC64 پر چلنے والے آپ کے کلاؤڈ ورک بوجھ کے لیے بہترین قیمت کی کارکردگی فراہم کرنے کے لیے 2 بٹ آرم نیوورس کور کا استعمال کرتے ہوئے ایمیزون ویب سروسز کے ذریعے پروسیسر اپنی مرضی کے مطابق بنائے گئے ہیں۔ Graviton پر مبنی مثالوں کے ساتھ، آپ کے پاس SageMaker پر اپنے ML ماڈلز کو تعینات کرتے وقت لاگت اور کارکردگی کو بہتر بنانے کے لیے مزید اختیارات ہیں۔ سیج میکر بھی سپورٹ کرتا ہے۔ Inf1 مثالیں۔، اعلی کارکردگی اور لاگت سے موثر ML تخمینہ فراہم کرتا ہے۔ 1-16 کے ساتھ AWS Inferentia چپس فی مثال، Inf1 مثالیں کارکردگی میں پیمانہ کر سکتی ہیں اور AWS GPU پر مبنی مثالوں کے مقابلے میں تین گنا زیادہ تھرو پٹ اور 50% تک کم لاگت فراہم کر سکتی ہیں۔ SageMaker میں Inf1 مثالیں استعمال کرنے کے لیے، آپ اپنے تربیت یافتہ ماڈلز کو استعمال کر کے مرتب کر سکتے ہیں۔ ایمیزون سیج میکر نیو اور مرتب شدہ ماڈل کو SageMaker پر تعینات کرنے کے لیے Inf1 مثالوں کو منتخب کریں۔ آپ بھی دریافت کر سکتے ہیں۔ سیج میکر کے لیے بچت کے منصوبے ڈیمانڈ قیمت کے مقابلے میں 64% تک لاگت کی بچت سے فائدہ اٹھانا۔ جب آپ اینڈ پوائنٹ بناتے ہیں تو سیج میکر ہر ایم ایل کمپیوٹ مثال کے ساتھ ایک EBS اسٹوریج والیوم منسلک کرتا ہے جو اینڈ پوائنٹ کی میزبانی کرتا ہے۔ اسٹوریج والیوم کا سائز مثال کی قسم پر منحصر ہے۔ ریئل ٹائم اینڈ پوائنٹس کے لیے اضافی لاگت میں GB-مہینے کے پروویژن شدہ سٹوریج کی لاگت شامل ہے، نیز GB ڈیٹا پر عملدرآمد کیا گیا ہے اور GB ڈیٹا کو اینڈ پوائنٹ مثال سے باہر پروسیس کیا گیا ہے۔ |

| تخمینہ میں تاخیر | جب آپ کو ملی سیکنڈ کی تاخیر کے تقاضوں کے ساتھ مستقل اختتامی نقطہ کی ضرورت ہو تو حقیقی وقت کا اندازہ مثالی ہوتا ہے۔ یہ 6 MB تک پے لوڈ سائز، اور 60 سیکنڈ تک کے پروسیسنگ اوقات کو سپورٹ کرتا ہے۔ |

| انحصار |

انفرنس تھرو پٹ کی ایک مثالی قدر ماڈل، ماڈل ان پٹ سائز، بیچ سائز، اور اینڈ پوائنٹ مثال کی قسم جیسے عوامل کے تابع ہے۔ ایک بہترین عمل کے طور پر، ان پٹ کی درخواستوں اور وسائل کے استعمال کے لیے CloudWatch میٹرکس کا جائزہ لیں، اور بہترین تھرو پٹ حاصل کرنے کے لیے مناسب مثال کی قسم منتخب کریں۔ ایک کاروباری ایپلیکیشن یا تو تھرو پٹ آپٹمائزڈ یا لیٹنسی آپٹیمائزڈ ہو سکتی ہے۔ مثال کے طور پر، ڈائنامک بیچنگ ریئل ٹائم انفرنس کا استعمال کرتے ہوئے تاخیر سے متعلق حساس ایپس کے تھرو پٹ کو بڑھانے میں مدد کر سکتی ہے۔ تاہم، بیچ کے سائز کی حدود ہیں، جس کے بغیر قیاس میں تاخیر متاثر ہو سکتی ہے۔ جب آپ تھرو پٹ کو بہتر بنانے کے لیے بیچ کے سائز میں اضافہ کریں گے تو انفرنس میں تاخیر بڑھے گی۔ لہٰذا، دیر سے حساس ایپلی کیشنز کے لیے حقیقی وقت کا اندازہ ایک مثالی آپشن ہے۔ SageMaker غیر مطابقت پذیر تخمینہ اور بیچ ٹرانسفارم کے آپشنز فراہم کرتا ہے، جو ریئل ٹائم انفرنس کے مقابلے میں زیادہ تھرو پٹ دینے کے لیے بہتر بنائے جاتے ہیں اگر کاروباری ایپلی کیشنز قدرے زیادہ تاخیر کو برداشت کر سکیں۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی |

سیج میکر ریئل ٹائم اینڈ پوائنٹس سپورٹ آٹو اسکیلنگ عمومیت سے ہٹ کر. جب کام کا بوجھ بڑھتا ہے، تو آٹو اسکیلنگ آن لائن مزید مثالیں لاتی ہے۔ جب کام کا بوجھ کم ہوجاتا ہے، تو آٹو اسکیلنگ غیر ضروری مثالوں کو ہٹا دیتی ہے، جس سے آپ کی کمپیوٹ لاگت کو کم کرنے میں مدد ملتی ہے۔ آٹو اسکیلنگ کے بغیر، آپ کو چوٹی ٹریفک یا رسک ماڈل کی عدم دستیابی کا انتظام کرنا ہوگا۔ جب تک آپ کے ماڈل کی ٹریفک دن بھر مستحکم نہیں رہتی ہے، غیر استعمال شدہ گنجائش زیادہ ہوگی۔ یہ کم استعمال اور ضائع ہونے والے وسائل کی طرف جاتا ہے. SageMaker کے ساتھ، آپ متوقع ٹریفک پیٹرن کی بنیاد پر مختلف اسکیلنگ کے اختیارات تشکیل دے سکتے ہیں۔ جب آپ کسی مخصوص CloudWatch میٹرک کی بنیاد پر اسکیل کرنا چاہتے ہیں تو سادہ اسکیلنگ یا ٹارگٹ ٹریکنگ اسکیلنگ مثالی ہے۔ آپ یہ ایک مخصوص میٹرک کو منتخب کرکے اور حد کی قدریں ترتیب دے کر کر سکتے ہیں۔ اس اختیار کے لیے تجویز کردہ میٹرکس اوسط ہیں۔ اگر آپ کو ایڈوانس کنفیگریشن درکار ہے تو، آپ الارم کی خلاف ورزی کے سائز کی بنیاد پر اسکیل کرنے کے لیے مثالوں کی تعداد کو متحرک طور پر ایڈجسٹ کرنے کے لیے ایک سٹیپ اسکیلنگ پالیسی سیٹ کر سکتے ہیں۔ جب مطالبہ کسی خاص سطح تک پہنچ جاتا ہے تو یہ آپ کو زیادہ جارحانہ ردعمل کو ترتیب دینے میں مدد کرتا ہے۔ جب آپ جانتے ہوں کہ ڈیمانڈ دن، ہفتے، مہینے یا سال میں کسی خاص شیڈول کی پیروی کرتی ہے تو آپ ایک طے شدہ اسکیلنگ کا اختیار استعمال کر سکتے ہیں۔ اس سے آپ کو شروع اور اختتامی اوقات کے ساتھ ایک وقتی شیڈول یا بار بار چلنے والے شیڈول یا کرون ایکسپریشنز کی وضاحت کرنے میں مدد ملتی ہے، جو آٹو اسکیلنگ ایکشن کے شروع ہونے اور بند ہونے کے وقت کی حدود بناتے ہیں۔ مزید تفصیلات کے لئے ملاحظہ کریں ایمیزون سیج میکر میں آٹو اسکیلنگ انفرنس اینڈ پوائنٹس کو ترتیب دینا اور خودکار اسکیلنگ کا استعمال کرتے ہوئے ٹیسٹ لوڈ کریں اور Amazon SageMaker اینڈ پوائنٹ کو بہتر بنائیں. |

| ٹریفک پیٹرن | مستقل یا باقاعدہ ٹریفک پیٹرن کے ساتھ کام کے بوجھ کے لیے حقیقی وقت کا اندازہ مثالی ہے۔ |

سیج میکر میں غیر مطابقت پذیر اندازہ

SageMaker غیر مطابقت پذیر تخمینہ سیج میکر میں ایک نئی صلاحیت ہے جو آنے والی درخواستوں کو قطار میں کھڑا کرتی ہے اور ان پر غیر مطابقت پذیری سے کارروائی کرتی ہے۔ یہ اختیار بڑے پے لوڈ سائز (1 جی بی تک)، طویل پروسیسنگ کے اوقات (15 منٹ تک) اور قریب قریب ریئل ٹائم لیٹنسی کی ضروریات کے لیے مثالی ہے۔ غیر مطابقت پذیر اندازے کے لیے مثال کے طور پر کام کے بوجھ میں صحت کی دیکھ بھال کرنے والی کمپنیاں شامل ہیں جو بے ضابطگیوں کا پتہ لگانے کے لیے ہائی ریزولوشن بائیو میڈیکل امیجز یا ایکو کارڈیوگرام جیسی ویڈیوز پر کارروائی کرتی ہیں۔ یہ ایپلی کیشنز دن میں مختلف اوقات میں آنے والی ٹریفک کی برسٹ وصول کرتی ہیں اور کم قیمت پر قریب قریب حقیقی وقت پر کارروائی کی ضرورت ہوتی ہے۔ ان درخواستوں کے پروسیسنگ کے اوقات منٹوں کی ترتیب میں ہو سکتے ہیں، ریئل ٹائم انفرنس کو چلانے کی ضرورت کو ختم کرتے ہوئے۔ اس کے بجائے، ان پٹ پے لوڈز کو خودکار قطار اور پہلے سے طے شدہ ہم آہنگی کی حد کے ساتھ Amazon S3 جیسے آبجیکٹ اسٹور سے متضاد طور پر پروسیس کیا جا سکتا ہے۔ پروسیسنگ کے بعد، SageMaker پہلے سے واپس کیے گئے Amazon S3 مقام میں تخمینہ جواب دیتا ہے۔ آپ اختیاری طور پر کامیابی یا غلطی کی اطلاعات کے ذریعے حاصل کرنے کا انتخاب کر سکتے ہیں۔ ایمیزون سادہ نوٹیفکیشن سروس (ایمیزون ایس این ایس)۔

مندرجہ ذیل جدول فٹنس افعال کی بنیاد پر SageMaker غیر مطابقت پذیر تخمینہ کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔

| فٹنس فنکشن | Description |

| قیمت | غیر مطابقت پذیر تخمینہ بڑے پے لوڈز اور برسٹ ٹریفک والے لاگت سے متعلق کام کے بوجھ کے لیے ایک بہترین انتخاب ہے۔ غیر مطابقت پذیر تخمینہ آپ کو لاگت کو بچانے کے قابل بناتا ہے جب آپ پر کارروائی کے لیے کوئی درخواستیں نہ ہوں تو مثال کی گنتی کو خود بخود اسکیل کرکے صفر کر سکتے ہیں، لہذا آپ صرف اس وقت ادائیگی کرتے ہیں جب آپ کا اختتامی نقطہ درخواستوں پر کارروائی کر رہا ہو۔ وہ درخواستیں جو موصول ہوتی ہیں جب صفر کی مثالیں ہوتی ہیں، اختتامی نقطہ کے پیمانے کے بعد پروسیسنگ کے لیے قطار میں لگ جاتی ہیں۔ |

| تخمینہ میں تاخیر | غیر مطابقت پذیر تخمینہ قریب قریب حقیقی وقت میں تاخیر کی ضروریات کے لیے مثالی ہے۔ درخواستوں کو ایک قطار میں رکھا جاتا ہے اور جیسے ہی کمپیوٹ دستیاب ہوتا ہے اس پر کارروائی کی جاتی ہے۔ اس کے نتیجے میں عام طور پر دسیوں ملی سیکنڈ میں تاخیر ہوتی ہے۔ |

| انحصار | غیر لیٹنسی حساس استعمال کے معاملات کے لیے غیر مطابقت پذیر تخمینہ مثالی ہے، کیونکہ ایپلی کیشنز کو تھرو پٹ پر سمجھوتہ کرنے کی ضرورت نہیں ہے۔ ٹریفک میں اضافے کے دوران درخواستوں کو نہیں چھوڑا جاتا کیونکہ غیر مطابقت پذیر انفرنس اینڈ پوائنٹ درخواستوں کو چھوڑنے کے بجائے قطار میں کھڑا کرتا ہے۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی |

سیج میکر سپورٹ کرتا ہے۔ آٹو اسکیلنگ غیر مطابقت پذیر اختتامی نقطہ کے لیے۔ ریئل ٹائم ہوسٹڈ اینڈ پوائنٹس کے برعکس، غیر مطابقت پذیر انفرنس اینڈ پوائنٹس کم از کم صلاحیت کو صفر پر سیٹ کرکے مثالوں کو صفر تک کم کرنے کی حمایت کرتے ہیں۔ غیر مطابقت پذیر اختتامی پوائنٹس کے لیے، SageMaker سختی سے تجویز کرتا ہے کہ آپ تعینات کردہ ماڈل (متغیر) کے لیے ٹارگٹ ٹریکنگ اسکیلنگ کے لیے پالیسی کنفیگریشن بنائیں۔ استعمال کے ایسے معاملات کے لیے جو چند منٹ کے کولڈ اسٹارٹ جرمانے کو برداشت کر سکتے ہیں، آپ اختیاری طور پر اختتامی نقطہ مثال کی گنتی کو صفر تک سکیل کر سکتے ہیں جب کوئی بقایا درخواستیں نہ ہوں اور نئی درخواستوں کے آتے ہی بیک اپ سکیل کر سکیں تاکہ آپ صرف اس مدت کے لیے ادائیگی کریں اختتامی نقطہ فعال طور پر درخواستوں پر کارروائی کر رہے ہیں۔ |

| ٹریفک پیٹرن | اسینکرونس اینڈ پوائنٹس آنے والی درخواستوں کو قطار میں لگاتے ہیں اور ان پر غیر مطابقت پذیری سے کارروائی کرتے ہیں۔ وہ وقفے وقفے سے یا کبھی کبھار ٹریفک کے نمونوں کے لیے ایک اچھا اختیار ہیں۔ |

سیج میکر میں بیچ کا اندازہ

SageMaker بیچ ٹرانسفارم ڈیٹا کے بڑے بیچوں پر آف لائن پیشین گوئیوں کے لیے مثالی ہے جو سامنے دستیاب ہیں۔ بیچ ٹرانسفارم فیچر ڈیٹا کو تبدیل کرنے اور انفرنس پیدا کرنے کے لیے ایک اعلیٰ کارکردگی اور ہائی تھرو پٹ طریقہ ہے۔ یہ ان منظرناموں کے لیے مثالی ہے جہاں آپ ڈیٹا کے بڑے بیچوں سے نمٹ رہے ہیں، آپ کو سبسیکنڈ لیٹنسی کی ضرورت نہیں ہے، یا ٹریننگ ڈیٹا کو پہلے سے پروسیس اور تبدیل کرنے کی ضرورت ہے۔ اشتہارات اور مارکیٹنگ یا صحت کی دیکھ بھال جیسے مخصوص ڈومینز کے صارفین کو اکثر ہائپر اسکیل ڈیٹاسیٹس پر آف لائن پیشین گوئیاں کرنے کی ضرورت ہوتی ہے جہاں زیادہ تر تھرو پٹ اکثر استعمال کے معاملے کا مقصد ہوتا ہے اور تاخیر کوئی تشویش کی بات نہیں ہے۔

جب بیچ ٹرانسفارم جاب شروع ہوتا ہے، سیج میکر کمپیوٹ کی مثالوں کو شروع کرتا ہے اور ان کے درمیان کام کا بوجھ تقسیم کرتا ہے۔ یہ وسائل کو جاری کرتا ہے جب ملازمتیں مکمل ہو جاتی ہیں، لہذا آپ صرف وہی ادائیگی کرتے ہیں جو آپ کی ملازمت کے دوران استعمال کیا گیا تھا۔ جب کام مکمل ہو جاتا ہے، SageMaker پیشین گوئی کے نتائج کو S3 بالٹی میں محفوظ کرتا ہے جس کی آپ وضاحت کرتے ہیں۔ بیچ کا اندازہ لگانے والے کام عام طور پر افقی اسکیلنگ کے لیے اچھے امیدوار ہوتے ہیں۔ کلسٹر کے اندر ہر کارکن دوسرے کارکنوں کے ساتھ معلومات کے تبادلے کی ضرورت کے بغیر ڈیٹا کے مختلف ذیلی سیٹ پر کام کر سکتا ہے۔ AWS متعدد اسٹوریج اور کمپیوٹ آپشنز پیش کرتا ہے جو افقی اسکیلنگ کو فعال کرتے ہیں۔ SageMaker بیچ ٹرانسفارم کے لیے مثال کے طور پر کام کے بوجھ میں آف لائن ایپلی کیشنز شامل ہیں جیسے کہ کسٹمر کے منتھن کی پیشین گوئی کرنے کے لیے بینکنگ ایپلی کیشنز جہاں ایک آف لائن جاب کو وقتاً فوقتاً چلانے کے لیے شیڈول کیا جا سکتا ہے۔

مندرجہ ذیل جدول فٹنس افعال کی بنیاد پر SageMaker بیچ ٹرانسفارم کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔

| فٹنس فنکشن | Description |

| قیمت | سیج میکر بیچ ٹرانسفارم آپ کو بڑے یا چھوٹے بیچ ڈیٹا سیٹس پر پیشین گوئیاں چلانے کی اجازت دیتا ہے۔ استعمال کی مدت کی بنیاد پر، آپ سے منتخب کردہ مثال کی قسم کے لیے چارج کیا جاتا ہے۔ SageMaker کام کے آغاز پر وسائل کی فراہمی کا انتظام کرتا ہے اور کام مکمل ہونے پر انہیں جاری کرتا ہے۔ کوئی اضافی ڈیٹا پروسیسنگ لاگت نہیں ہے۔ |

| تخمینہ میں تاخیر | آپ ایونٹ پر مبنی یا طے شدہ درخواست استعمال کر سکتے ہیں۔ لیٹینسی قیاس ڈیٹا کے سائز، کام کی موافقت، ماڈل کی پیچیدگی، اور کمپیوٹ مثال کی صلاحیت کے لحاظ سے مختلف ہو سکتی ہے۔ |

| انحصار |

بیچ ٹرانسفارم جابز ڈیٹا سیٹس کی ایک رینج پر کی جا سکتی ہیں، ڈیٹا کے پیٹا بائٹس سے لے کر بہت چھوٹے ڈیٹا سیٹس تک۔ ڈیٹا کے چھوٹے حصوں میں بڑے ڈیٹاسیٹس کا سائز تبدیل کرنے کی ضرورت نہیں ہے۔ آپ پیرامیٹرز کے لیے بہترین اقدار کا استعمال کر کے بیچ ٹرانسفارم جابز کو تیز کر سکتے ہیں جیسے MaxPayloadInMB, MaxConcurrentTransforms، یا بیچ اسٹریٹجی. کے لیے مثالی قدر بیچ پروسیسنگ آپ کے وسائل کو بڑھا سکتی ہے اور آپ کے وسائل کو بہتر بنا سکتی ہے کیونکہ یہ تاخیر کی قیمت پر ایک خاص وقت میں بڑی تعداد میں نتائج کو مکمل کرنے میں مدد کرتا ہے۔ اعلی تھرو پٹ کے لیے ماڈل کی تعیناتی کو بہتر بنانے کے لیے، عمومی رہنما خطوط یہ ہے کہ بیچ کے سائز کو بڑھایا جائے جب تک کہ تھرو پٹ کم نہ ہو جائے۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی | SageMaker بیچ ٹرانسفارم آف لائن اندازہ کے لیے استعمال کیا جاتا ہے جو تاخیر سے حساس نہیں ہے۔ |

| ٹریفک پیٹرن | آف لائن انفرنس کے لیے، ایک بیچ ٹرانسفارم جاب شیڈول کیا جاتا ہے یا ایونٹ پر مبنی ٹرگر کا استعمال کرتے ہوئے شروع کیا جاتا ہے۔ |

سیج میکر میں بے سرور اندازہ

سیج میکر سرور لیس انفرنس آپ کو بنیادی انفراسٹرکچر کو کنفیگر یا مینیج کیے بغیر قیاس کے لیے ایم ایل ماڈلز کو تعینات کرنے کی اجازت دیتا ہے۔ آپ کے ماڈل کو موصول ہونے والے تخمینے کی درخواستوں کے حجم کی بنیاد پر، SageMaker سرور لیس انفرنس خودکار طور پر پروویژن، اسکیلز، اور کمپیوٹ صلاحیت کو بند کر دیتا ہے۔ نتیجے کے طور پر، آپ اپنے انفرنس کوڈ کو چلانے کے لیے صرف کمپیوٹ ٹائم اور پروسیس شدہ ڈیٹا کی مقدار کے لیے ادائیگی کرتے ہیں، نہ کہ بیکار وقت کے لیے۔ آپ SageMaker کے بلٹ ان الگورتھم اور ML فریم ورک پیش کرنے والے کنٹینرز استعمال کر سکتے ہیں تاکہ آپ اپنے ماڈل کو بغیر سرور کے انفرنس اینڈ پوائنٹ پر تعینات کر سکیں یا اپنا کنٹینر لانے کا انتخاب کریں۔ اگر ٹریفک قابل قیاس اور مستحکم ہو جاتا ہے، تو آپ آسانی سے بغیر کسی سرور لیس انفرنس اینڈ پوائنٹ سے سیج میکر ریئل ٹائم اینڈ پوائنٹ پر اپ ڈیٹ کر سکتے ہیں بغیر آپ کے کنٹینر کی تصویر میں تبدیلی کی ضرورت ہے۔ سرور لیس انفرنس کے ساتھ، آپ SageMaker کی دیگر خصوصیات سے بھی فائدہ اٹھاتے ہیں، بشمول بلٹ ان میٹرکس جیسے کہ درخواست کی گنتی، فالٹس، لیٹنسی، میزبان میٹرکس، اور CloudWatch میں غلطیاں۔

درج ذیل جدول فٹنس افعال کی بنیاد پر SageMaker سرور لیس انفرنس کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔

| فٹنس فنکشن | Description |

| قیمت | اگر آپ کے پاس کبھی کبھار یا وقفے وقفے سے ٹریفک کے نمونے ہوتے ہیں تو ایک پے-ایس-یو-رن ماڈل کے ساتھ، سرور لیس انفرنس ایک سرمایہ کاری مؤثر اختیار ہے۔ آپ صرف اس مدت کے لیے ادائیگی کرتے ہیں جس کے لیے اختتامی نقطہ درخواست پر کارروائی کرتا ہے، اور اس وجہ سے اگر ٹریفک کا پیٹرن وقفے وقفے سے ہوتا ہے تو اخراجات بچا سکتے ہیں۔ |

| تخمینہ میں تاخیر |

سرور لیس اینڈ پوائنٹس استعمال کے نمونوں کی بنیاد پر سیکنڈوں کے اندر دسیوں سے ہزاروں انفرنسز کو فوری طور پر پیمانہ کرنے کی صلاحیت کے ساتھ کم قیاس میں تاخیر (ملی سیکنڈ سے سیکنڈ کی ترتیب میں) پیش کرتے ہیں، جو وقفے وقفے سے یا غیر متوقع ٹریفک کے ساتھ ML ایپلیکیشنز کے لیے مثالی بناتے ہیں۔ چونکہ سرور لیس اینڈ پوائنٹس ڈیمانڈ کے حساب سے وسائل فراہم کرتے ہیں، اس لیے آپ کا اینڈ پوائنٹ ایک بیکار مدت کے بعد پہلی درخواست کے لیے چند اضافی سیکنڈوں میں تاخیر (کولڈ اسٹارٹ) کا تجربہ کر سکتا ہے۔ سرد شروع ہونے کا وقت آپ کے ماڈل کے سائز، آپ کے ماڈل کو ڈاؤن لوڈ کرنے میں کتنا وقت لگتا ہے، اور آپ کے کنٹینر کے آغاز کے وقت پر منحصر ہے۔ |

| انحصار | اپنے سرور لیس اینڈ پوائنٹ کو کنفیگر کرتے وقت، آپ میموری کا سائز اور زیادہ سے زیادہ ہم آہنگی کی درخواستیں بتا سکتے ہیں۔ سیج میکر سرور لیس انفرنس خود کار طریقے سے کمپیوٹ وسائل کو آپ کی منتخب کردہ میموری کے متناسب تفویض کرتا ہے۔ اگر آپ میموری کے بڑے سائز کا انتخاب کرتے ہیں، تو آپ کے کنٹینر کو مزید vCPUs تک رسائی حاصل ہے۔ عام اصول کے طور پر، میموری کا سائز کم از کم آپ کے ماڈل کے سائز جتنا بڑا ہونا چاہیے۔ آپ جو میموری سائز منتخب کر سکتے ہیں وہ ہیں 1024 MB، 2048 MB، 3072 MB، 4096 MB، 5120 MB، اور 6144 MB۔ آپ کے منتخب کردہ میموری سائز سے قطع نظر، سرور لیس اینڈ پوائنٹس میں 5 جی بی فیمرل ڈسک اسٹوریج دستیاب ہے۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی | سرور لیس اینڈ پوائنٹس خود بخود کمپیوٹ وسائل کو لانچ کرتے ہیں اور ٹریفک کے لحاظ سے ان کو اندر اور باہر پیمانہ کرتے ہیں، مثال کی قسموں کو منتخب کرنے یا اسکیلنگ کی پالیسیوں کو منظم کرنے کی ضرورت کو ختم کرتے ہیں۔ یہ سرورز کو منتخب کرنے اور ان کا انتظام کرنے کی غیر متفرق بھاری لفٹنگ کو دور کرتا ہے۔ |

| ٹریفک پیٹرن | سرور لیس اندازہ کام کے بوجھ کے لیے مثالی ہے جس میں کبھی کبھار یا وقفے وقفے سے ٹریفک کے پیٹرن ہوتے ہیں۔ |

سیج میکر میں ماڈل ہوسٹنگ ڈیزائن پیٹرن

سیج میکر انفرنس اینڈ پوائنٹس ایم ایل ماڈلز کی میزبانی کے لیے ڈوکر کنٹینرز کا استعمال کرتے ہیں۔ کنٹینرز آپ کو سافٹ ویئر کو معیاری یونٹس میں پیک کرنے کی اجازت دیتے ہیں جو ڈوکر کو سپورٹ کرنے والے کسی بھی پلیٹ فارم پر مستقل طور پر چلتے ہیں۔ یہ پلیٹ فارمز میں نقل پذیری، ناقابل تغیر بنیادی ڈھانچے کی تعیناتیوں، اور آسان تبدیلی کے انتظام اور CI/CD کے نفاذ کو یقینی بناتا ہے۔ SageMaker مقبول فریم ورکس جیسے Apache MXNet، TensorFlow، PyTorch، Sklearn، اور Hugging Face کے لیے پہلے سے تعمیر شدہ مینیجڈ کنٹینرز فراہم کرتا ہے۔ دستیاب سیج میکر کنٹینر امیجز کی مکمل فہرست کے لیے رجوع کریں۔ دستیاب ڈیپ لرننگ کنٹینرز امیجز. اس صورت میں کہ SageMaker کے پاس معاون کنٹینر نہیں ہے، آپ اپنا کنٹینر (BYOC) بھی بنا سکتے ہیں اور اپنی مرضی کی تصویر کو آگے بڑھا سکتے ہیں، ان انحصارات کو انسٹال کر سکتے ہیں جو آپ کے ماڈل کے لیے ضروری ہیں۔

SageMaker پر ماڈل تعینات کرنے کے لیے، آپ کو کنٹینر (SageMaker کے زیر انتظام فریم ورک کنٹینرز یا BYOC) اور کنٹینر کی میزبانی کے لیے ایک کمپیوٹ مثال کی ضرورت ہے۔ SageMaker مشترکہ ML ماڈل ہوسٹنگ ڈیزائن پیٹرن کے لیے متعدد جدید اختیارات کی حمایت کرتا ہے جہاں ماڈلز کو ایک کنٹینر پر ہوسٹ کیا جا سکتا ہے یا مشترکہ کنٹینر پر شریک میزبانی کی جا سکتی ہے۔

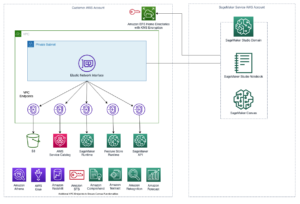

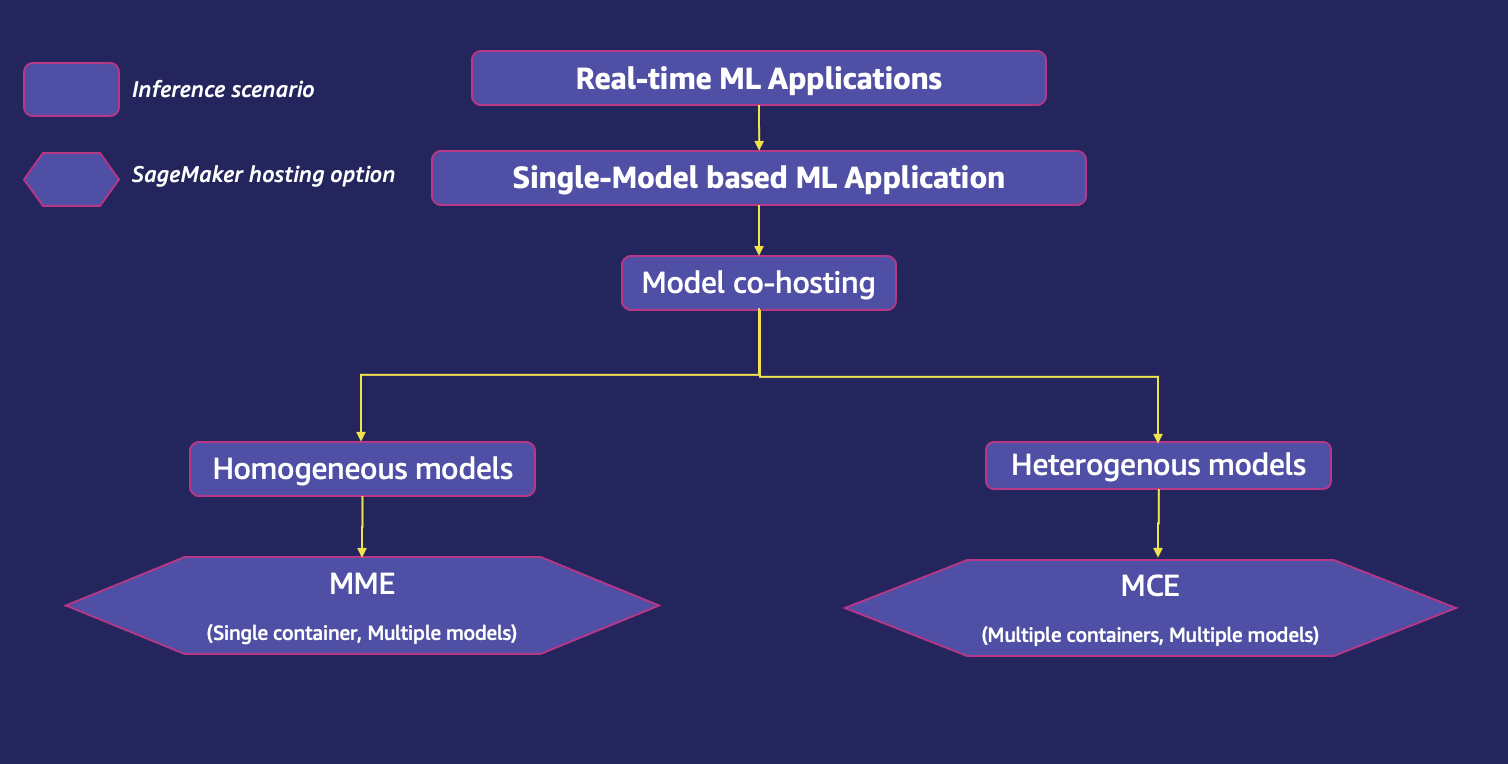

ایک حقیقی وقت کی ML ایپلیکیشن ایک پیشین گوئی کی درخواست کی خدمت کے لیے ایک ماڈل یا متعدد ماڈلز کا استعمال کر سکتی ہے۔ مندرجہ ذیل خاکہ ML ایپلیکیشن کے لیے مختلف قیاس آرائیوں کو دکھاتا ہے۔

آئیے ہر ایک سابقہ انفرنس منظرناموں کے لیے ایک موزوں سیج میکر ہوسٹنگ آپشن کو تلاش کریں۔ آپ یہ جانچنے کے لیے فٹنس فنکشنز کا حوالہ دے سکتے ہیں کہ آیا یہ دیے گئے استعمال کیس کے لیے صحیح آپشن ہے۔

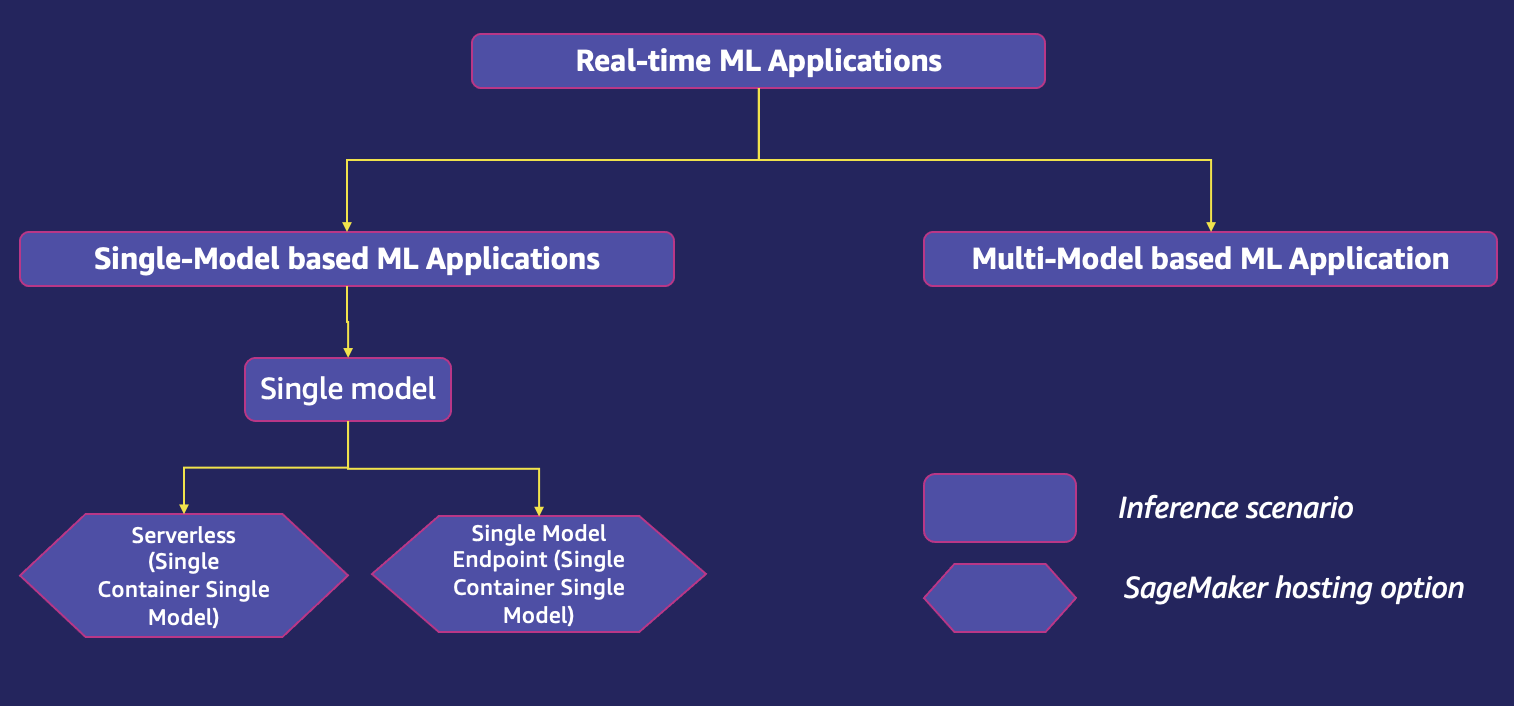

سنگل ماڈل پر مبنی ML ایپلیکیشن کی میزبانی کرنا

تعیناتی کے منظر نامے پر منحصر SageMaker ہوسٹنگ سروسز کا استعمال کرتے ہوئے سنگل ماڈل پر مبنی ML ایپلیکیشنز کی میزبانی کرنے کے کئی اختیارات ہیں۔

سنگل ماڈل اینڈ پوائنٹ

SageMaker سنگل ماڈل اینڈ پوائنٹس آپ کو ایک کنٹینر پر ایک ماڈل کی میزبانی کرنے کی اجازت دیتے ہیں جس کی میزبانی کم تاخیر اور زیادہ تھرو پٹ کے لیے وقف شدہ مثالوں پر کی جاتی ہے۔ یہ اینڈ پوائنٹس مکمل طور پر منظم ہیں اور آٹو اسکیلنگ کو سپورٹ کرتے ہیں۔ آپ سنگل ماڈل اینڈ پوائنٹ کو ایک پروویژنڈ اینڈ پوائنٹ کے طور پر کنفیگر کر سکتے ہیں جہاں آپ اینڈ پوائنٹ انفراسٹرکچر کنفیگریشن میں گزرتے ہیں جیسے کہ مثال کی قسم اور شمار، یا ایک سرور لیس اینڈ پوائنٹ جہاں سیج میکر خودکار طور پر کمپیوٹ وسائل کو لانچ کرتا ہے اور ٹریفک کے لحاظ سے ان کو اندر اور باہر نکالتا ہے، ضرورت کو ختم کرتے ہوئے مثال کی اقسام کا انتخاب کرنے یا اسکیلنگ کی پالیسیوں کو منظم کرنے کے لیے۔ سرور لیس اینڈ پوائنٹس وقفے وقفے سے یا غیر متوقع ٹریفک والی ایپلیکیشنز کے لیے ہیں۔

درج ذیل خاکہ سنگل ماڈل اینڈ پوائنٹ انفرنس منظرنامے دکھاتا ہے۔

مندرجہ ذیل جدول ایک پروویژن شدہ سنگل ماڈل اینڈ پوائنٹ کے لیے فٹنس افعال کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔ سرور لیس اینڈ پوائنٹ فٹنس فنکشن کی تشخیص کے لیے، اس پوسٹ میں سرور لیس اینڈ پوائنٹ سیکشن دیکھیں۔

| فٹنس فنکشن | Description |

| قیمت | آپ سے منتخب کردہ مثال کی قسم کے استعمال کا معاوضہ لیا جاتا ہے۔ چونکہ اختتامی نقطہ ہمیشہ چل رہا ہے اور دستیاب ہے، اس لیے اخراجات میں تیزی سے اضافہ ہو سکتا ہے۔ اپنے ماڈل کے لیے صحیح مثال کا انتخاب اس بات کو یقینی بنانے میں مدد کرتا ہے کہ آپ کے پاس اپنے ماڈلز کے لیے سب سے کم قیمت پر سب سے زیادہ پرفارمنس مثال ہے۔ آٹو اسکیلنگ کی سفارش کی جاتی ہے کہ ممکنہ کم ترین قیمت پر مستحکم اور متوقع کارکردگی کو برقرار رکھنے کے لیے ٹریفک کے لحاظ سے صلاحیت کو متحرک طور پر ایڈجسٹ کیا جائے۔ |

| تخمینہ میں تاخیر | سنگل ماڈل کا اختتامی نقطہ ملی سیکنڈ کی تاخیر کے تقاضوں کے ساتھ ریئل ٹائم، انٹرایکٹو، ہم وقت ساز اندازہ فراہم کرتا ہے۔ |

| انحصار | تھرو پٹ مختلف عوامل سے متاثر ہو سکتا ہے، جیسے کہ ماڈل ان پٹ سائز، بیچ کا سائز، اختتامی نقطہ مثال کی قسم، وغیرہ۔ ان پٹ کی درخواستوں اور وسائل کے استعمال کے لیے CloudWatch میٹرکس کا جائزہ لینے اور زیادہ سے زیادہ تھرو پٹ حاصل کرنے کے لیے مناسب مثال کی قسم منتخب کرنے کی سفارش کی جاتی ہے۔ SageMaker ML ماڈلز کو تعینات کرتے وقت وسائل کا نظم کرنے اور تخمینہ کی کارکردگی کو بہتر بنانے کے لیے خصوصیات فراہم کرتا ہے۔ آپ کر سکتے ہیں۔ Neo کا استعمال کرتے ہوئے ماڈل کی کارکردگی کو بہتر بنائیں، یا اپنے اختتامی نقطہ کے لئے GPU مثال کا استعمال کرتے ہوئے اپنے SageMaker ہوسٹڈ ماڈلز کے بہتر تھرو پٹ کے لئے Inf1 مثالوں کا استعمال کریں۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی | آٹو اسکیلنگ کو باکس سے باہر سپورٹ کیا جاتا ہے۔ سیج میکر ایک مناسب انتخاب کرنے کی تجویز کرتا ہے۔ اسکیلنگ کی ترتیب کارکردگی کا مظاہرہ کر کے لوڈ ٹیسٹ. |

| ٹریفک پیٹرن | ایک سنگل ماڈل اینڈ پوائنٹ کام کے بوجھ کے لیے مثالی ہے جس میں ٹریفک پیٹرن کی پیش گوئی کی جاسکتی ہے۔ |

متعدد ماڈلز کی مشترکہ میزبانی کرنا

جب آپ ماڈلز کی ایک بڑی تعداد کے ساتھ کام کر رہے ہوتے ہیں، تو ہر ایک کو ایک مخصوص کنٹینر اور مثال کے ساتھ انفرادی اختتامی نقطہ پر تعینات کرنے سے قیمت میں نمایاں اضافہ ہو سکتا ہے۔ مزید برآں، پروڈکشن میں بہت سارے ماڈلز کا انتظام کرنا بھی مشکل ہو جاتا ہے، خاص طور پر جب آپ کو ایک ہی وقت میں تمام ماڈلز کو طلب کرنے کی ضرورت نہیں ہوتی ہے لیکن پھر بھی انہیں ہر وقت دستیاب رہنے کی ضرورت ہوتی ہے۔ ایک ہی بنیادی کمپیوٹ وسائل پر متعدد ماڈلز کی مشترکہ میزبانی پیمانے پر ML کی تعیناتیوں کو منظم کرنا آسان بناتی ہے اور اختتامی نقطہ اور اس کے بنیادی کمپیوٹ وسائل کے بڑھتے ہوئے استعمال کے ذریعے آپ کی میزبانی کی لاگت کو کم کرتی ہے۔ سیج میکر ایڈوانسڈ ماڈل کو-ہوسٹنگ آپشنز کو سپورٹ کرتا ہے جیسے ہم جنس ماڈلز کے لیے ملٹی ماڈل اینڈ پوائنٹ (MME) اور متضاد ماڈلز کے لیے ملٹی کنٹینر اینڈ پوائنٹ (MCE)۔ یکساں ماڈلز مشترکہ سروس کنٹینر پر ایک ہی ML فریم ورک کا استعمال کرتے ہیں، جبکہ متضاد ماڈلز آپ کو متعدد سرونگ کنٹینرز تعینات کرنے کی اجازت دیتے ہیں جو ایک ہی اختتامی نقطہ پر مختلف ماڈلز یا فریم ورک استعمال کرتے ہیں۔

درج ذیل خاکہ SageMaker کا استعمال کرتے ہوئے ماڈل شریک میزبانی کے اختیارات دکھاتا ہے۔

سیج میکر ملٹی ماڈل اینڈ پوائنٹس

سیج میکر۔ ایم ایم ایز آپ کو ایک ہی اختتامی نقطہ پر مشترکہ سرونگ کنٹینر کا استعمال کرتے ہوئے متعدد ماڈلز کی میزبانی کرنے کی اجازت دیتا ہے۔ یہ ماڈلز کی ایک بڑی تعداد کو تعینات کرنے کے لیے ایک قابل توسیع اور لاگت سے مؤثر حل ہے جو ایک ہی استعمال کے کیس، فریم ورک، یا انفرنس منطق کو پورا کرتے ہیں۔ ایم ایم ای کال کرنے والے کے ذریعے طلب کیے گئے ماڈل کی بنیاد پر متحرک طور پر درخواستیں پیش کر سکتے ہیں۔ یہ تعیناتی اوور ہیڈ کو بھی کم کرتا ہے کیونکہ SageMaker ماڈلز کو میموری میں لوڈ کرنے اور ان پر ٹریفک پیٹرن کی بنیاد پر اسکیلنگ کا انتظام کرتا ہے۔ یہ خصوصیت اس وقت مثالی ہے جب آپ کے پاس ملتے جلتے ماڈلز کی ایک بڑی تعداد ہو جسے آپ مشترکہ سرونگ کنٹینر کے ذریعے پیش کر سکتے ہیں اور آپ کو ایک ہی وقت میں تمام ماڈلز تک رسائی کی ضرورت نہیں ہے۔ ملٹی ماڈل اینڈ پوائنٹس آپ کے تمام ماڈلز میں میموری کے وسائل کی ٹائم شیئرنگ کو بھی قابل بناتے ہیں۔ یہ اس وقت بہترین کام کرتا ہے جب ماڈل سائز اور درخواست میں تاخیر کے لحاظ سے کافی یکساں ہوں، جس سے MMEs کو تمام ماڈلز میں مثالوں کو مؤثر طریقے سے استعمال کرنے کی اجازت ملتی ہے۔ SageMaker MMEs دونوں CPU اور GPU حمایت یافتہ ماڈلز کی میزبانی کی حمایت کرتے ہیں۔ GPU حمایت یافتہ ماڈلز کا استعمال کرکے، آپ اینڈ پوائنٹ کے بڑھتے ہوئے استعمال اور اس کے بنیادی تیز رفتار کمپیوٹ مثالوں کے ذریعے اپنے ماڈل کی تعیناتی کی لاگت کو کم کر سکتے ہیں۔ MMEs کے حقیقی دنیا کے استعمال کے معاملے کے لیے، رجوع کریں۔ کثیر کرایہ دار SaaS استعمال کے کیسز کے لیے مشین لرننگ انفرنس کو کیسے پیمانہ کریں۔.

درج ذیل جدول MMEs کے لیے فٹنس افعال کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔

| فٹنس فنکشن | Description |

| قیمت |

MMEs ایک ہی اختتامی نقطہ پر ہزاروں ماڈلز کی میزبانی کے لیے مشترکہ سرونگ کنٹینر کا استعمال کرنے کے قابل بناتے ہیں۔ یہ سنگل ماڈل اینڈ پوائنٹس کے استعمال کے مقابلے میں اختتامی نقطہ کے استعمال کو بہتر بنا کر میزبانی کے اخراجات کو نمایاں طور پر کم کرتا ہے۔ مثال کے طور پر، اگر آپ کے پاس ml.c10.large مثال کا استعمال کرتے ہوئے تعینات کرنے کے لیے 5 ماڈل ہیں، سیج میکر کی قیمتوں کا تعین، 10 سنگل ماڈل پرسسٹنٹ اینڈ پوائنٹس رکھنے کی قیمت ہے: 10 * $0.102 = $1.02 فی گھنٹہ۔ جبکہ 10 ماڈلز کی میزبانی کرنے والے ایک MME کے ساتھ، ہم لاگت کی 10 گنا بچت حاصل کرتے ہیں: 1 * $0.102 = $0.102 فی گھنٹہ۔ |

| تخمینہ میں تاخیر |

پہلے سے طے شدہ طور پر، MMEs میموری میں اور ڈسک پر اکثر استعمال ہونے والے ماڈلز کو کیش کرتے ہیں تاکہ کم تاخیر کا اندازہ لگایا جا سکے۔ کیشڈ ماڈلز کو ڈسک سے صرف اس وقت اتارا یا حذف کیا جاتا ہے جب کسی نئے ٹارگٹڈ ماڈل کو ایڈجسٹ کرنے کے لیے کنٹینر کی میموری یا ڈسک کی جگہ ختم ہوجاتی ہے۔ MMEs ماڈلز کی سست لوڈنگ کی اجازت دیتے ہیں، جس کا مطلب ہے کہ ماڈلز کو میموری میں لوڈ کیا جاتا ہے جب پہلی بار درخواست کی جاتی ہے۔ یہ میموری کے استعمال کو بہتر بناتا ہے۔ تاہم، یہ پہلے لوڈ پر رسپانس ٹائم میں اضافے کا سبب بنتا ہے، جس کے نتیجے میں کولڈ اسٹارٹ کا مسئلہ پیدا ہوتا ہے۔ لہٰذا، MMEs ایسے منظرناموں کے لیے بھی موزوں ہیں جو کبھی کبھار استعمال ہونے والے ماڈلز کو استعمال کرنے کے دوران ہونے والے کولڈ سٹارٹ سے متعلقہ لیٹنسی جرمانے کو برداشت کر سکتے ہیں۔ ML ایپلیکیشنز کے لیٹنسی اور تھرو پٹ اہداف کو پورا کرنے کے لیے، GPU مثالوں کو CPU مثالوں پر ترجیح دی جاتی ہے (کمپیوٹیشنل پاور GPUs کی پیشکش کو دیکھتے ہوئے)۔ GPU کے لیے MME سپورٹ کے ساتھ، آپ ایک SageMaker اینڈ پوائنٹ کے پیچھے ہزاروں ڈیپ لرننگ ماڈلز تعینات کر سکتے ہیں۔ MMEs ایک GPU کور پر ایک سے زیادہ ماڈلز چلا سکتے ہیں، ایک سے زیادہ ماڈلز میں اختتامی نقطہ کے پیچھے GPU مثالیں شیئر کر سکتے ہیں، اور آنے والی ٹریفک کی بنیاد پر ماڈلز کو متحرک طور پر لوڈ اور ان لوڈ کر سکتے ہیں۔ اس کے ساتھ، آپ لاگت کو نمایاں طور پر بچا سکتے ہیں اور قیمت کی بہترین کارکردگی حاصل کر سکتے ہیں۔ اگر آپ کا استعمال کیس نمایاں طور پر زیادہ لین دین فی سیکنڈ (TPS) یا تاخیر کے تقاضوں کا مطالبہ کرتا ہے، تو ہم تجویز کرتے ہیں کہ ماڈلز کو وقف شدہ اختتامی پوائنٹس پر ہوسٹ کریں۔ |

| انحصار |

MME انفرنس تھرو پٹ کی ایک مثالی قدر ماڈل، پے لوڈ سائز، اور اینڈ پوائنٹ مثال کی قسم جیسے عوامل پر منحصر ہے۔ مثال کے طور پر میموری کی زیادہ مقدار آپ کو مزید ماڈل لوڈ کرنے کے قابل بناتی ہے اور تخمینہ کی درخواستوں کو پیش کرنے کے لیے تیار ہے۔ آپ کو ماڈل لوڈ کرنے میں وقت ضائع کرنے کی ضرورت نہیں ہے۔ vCPUs کی زیادہ مقدار آپ کو مزید منفرد ماڈلز کو بیک وقت استعمال کرنے کے قابل بناتی ہے۔ MMEs ماڈل کو متحرک طور پر لوڈ اور ان لوڈ کرتے ہیں اور مثال میموری سے، جو I/O کی کارکردگی کو متاثر کر سکتا ہے۔ GPU کے ساتھ SageMaker MMEs استعمال کرتے ہوئے کام کرتے ہیں۔ NVIDIA ٹرائٹن انفرنس سرور، جو ایک اوپن سورس انفرنس سرونگ سافٹ ویئر ہے جو انفرنس پیش کرنے کے عمل کو آسان بناتا ہے اور اعلی قیاس کی کارکردگی فراہم کرتا ہے۔ SageMaker ماڈل کو NVIDIA Triton کنٹینر کی میموری پر GPU ایکسلریٹڈ مثال پر لوڈ کرتا ہے اور تخمینہ کی درخواست کو پورا کرتا ہے۔ GPU کور ایک مثال میں تمام ماڈلز کے ذریعہ شیئر کیا جاتا ہے۔ اگر ماڈل پہلے سے ہی کنٹینر میموری میں لوڈ ہے، تو اس کے بعد کی درخواستیں تیزی سے پیش کی جاتی ہیں کیونکہ SageMaker کو اسے دوبارہ ڈاؤن لوڈ کرنے اور لوڈ کرنے کی ضرورت نہیں ہے۔ کامیاب پیداواری تعیناتیوں میں کارکردگی کی جانچ اور تجزیہ کی سفارش کی جاتی ہے۔ SageMaker ملٹی ماڈل اینڈ پوائنٹس کے لیے CloudWatch میٹرکس فراہم کرتا ہے تاکہ آپ اپنے اختتامی نقطہ کو بہتر بنانے میں مدد کے لیے اختتامی نقطہ کے استعمال اور کیش ہٹ ریٹ کا تعین کر سکیں۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی | سیج میکر ملٹی ماڈل اینڈ پوائنٹس آٹو اسکیلنگ کو مکمل طور پر سپورٹ کرتے ہیں، جو ٹریفک پیٹرن کی بنیاد پر ماڈلز کے پیمانے کو یقینی بنانے کے لیے ماڈلز کی نقل کا انتظام کرتا ہے۔ تاہم، اختتامی نقطہ کو آٹو اسکیلنگ کے لیے مثالوں کے بہترین سائز کا تعین کرنے کے لیے ایک مناسب لوڈ ٹیسٹنگ کی سفارش کی جاتی ہے۔ بہت زیادہ ماڈلز کو اتارنے سے بچنے کے لیے ایم ایم ای فلیٹ کو دائیں سائز دینا ضروری ہے۔ چند بڑی مثالوں پر سینکڑوں ماڈلز کو لوڈ کرنے سے کچھ معاملات میں تھروٹلنگ ہو سکتی ہے، اور زیادہ اور چھوٹی مثالوں کے استعمال کو ترجیح دی جا سکتی ہے۔ SageMaker میں خودکار ماڈل اسکیلنگ کا فائدہ اٹھانے کے لیے، یقینی بنائیں کہ آپ کے پاس موجود ہے۔ مثال کے طور پر آٹو اسکیلنگ سیٹ اپ اضافی مثال کی گنجائش فراہم کرنے کے لیے۔ اینڈپوائنٹ فلیٹ میں مزید مثالیں شامل کرنے کے لیے حسب ضرورت پیرامیٹرز یا درخواست فی منٹ (تجویز کردہ) کے ساتھ اپنی اینڈ پوائنٹ لیول اسکیلنگ پالیسی ترتیب دیں۔ آٹو اسکیل ایونٹ کو متحرک کرنے کے لیے استعمال کی جانے والی درخواست کی شرح اختتامی نقطہ کے ذریعے پیش کیے جانے والے ماڈلز کے مکمل سیٹ پر پیشین گوئیوں کے مجموعی سیٹ پر مبنی ہوتی ہے۔ |

| ٹریفک پیٹرن | MMEs اس وقت مثالی ہوتے ہیں جب آپ کے پاس ایک جیسے سائز کے ماڈلز کی ایک بڑی تعداد ہوتی ہے جسے آپ مشترکہ سرونگ کنٹینر کے ذریعے پیش کر سکتے ہیں اور ایک ہی وقت میں تمام ماڈلز تک رسائی کی ضرورت نہیں ہوتی ہے۔ |

سیج میکر ملٹی کنٹینر اینڈ پوائنٹس

سیج میکر۔ MCEs 15 کنٹینرز تک کی تعیناتی کی حمایت کریں جو ایک ہی اختتامی نقطہ پر مختلف ماڈلز یا فریم ورک استعمال کرتے ہیں، اور ان کو آزادانہ طور پر یا ترتیب میں کم تاخیر کا اندازہ لگانے اور لاگت کی بچت کے لیے استعمال کرتے ہیں۔ ماڈل مکمل طور پر متضاد ہوسکتے ہیں، ان کے اپنے خود مختار سرونگ اسٹیک کے ساتھ۔ ایک ہی مثال پر مختلف فریم ورکس سے متعدد ماڈلز کی محفوظ طریقے سے میزبانی آپ کی لاگت میں %90 تک بچا سکتی ہے۔

ایم سی ای کی درخواست کے نمونے درج ذیل ہیں:

- انفرنس پائپ لائنز – ایک MME میں کنٹینرز کو ایک لکیری ترتیب میں مدعو کیا جا سکتا ہے، جسے a بھی کہا جاتا ہے۔ سیریل انفرنس پائپ لائن. وہ عام طور پر پری پروسیسنگ، ماڈل انفرنس، اور پوسٹ پروسیسنگ کو آزاد کنٹینرز میں الگ کرنے کے لیے استعمال ہوتے ہیں۔ موجودہ کنٹینر سے آؤٹ پٹ کو ان پٹ کے طور پر اگلے میں منتقل کیا جاتا ہے۔ سیج میکر میں ان کی نمائندگی ایک واحد پائپ لائن ماڈل کے طور پر کی جاتی ہے۔ ایک انفرنس پائپ لائن کو MME کے طور پر تعینات کیا جا سکتا ہے، جہاں پائپ لائن میں موجود کنٹینرز میں سے ایک متحرک طور پر درخواست کی جا رہی ماڈل کی بنیاد پر پیش کر سکتا ہے۔

- براہ راست دعوت - کے ساتھ براہ راست درخواست, ایک درخواست MCE پر ہوسٹ کردہ ایک مخصوص انفرنس کنٹینر کو بھیجی جا سکتی ہے۔

مندرجہ ذیل جدول MCEs کے لیے فٹنس افعال کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔

| فٹنس فنکشن | Description |

| قیمت | MCEs آپ کو ایک ہی اختتامی نقطہ پر 15 مختلف ML کنٹینرز چلانے اور انہیں آزادانہ طور پر استعمال کرنے کے قابل بناتا ہے، اس طرح اخراجات کی بچت ہوتی ہے۔ یہ آپشن اس وقت مثالی ہے جب آپ کے پاس ایک جیسے وسائل کی ضروریات کے ساتھ مختلف سرونگ اسٹیکس پر متعدد ماڈلز چل رہے ہوں، اور جب انفرادی ماڈلز کے پاس اختتامی نقطہ کی پوری صلاحیت کو استعمال کرنے کے لیے کافی ٹریفک نہ ہو۔ لہذا MCEs سنگل ماڈل اینڈ پوائنٹ سے زیادہ لاگت سے موثر ہیں۔ MCEs سنکرونس انفرنس رسپانس پیش کرتے ہیں، جس کا مطلب ہے کہ اینڈ پوائنٹ ہمیشہ دستیاب ہوتا ہے اور آپ مثال کے اپ ٹائم کے لیے ادائیگی کرتے ہیں۔ مثالوں کی تعداد اور قسم کے لحاظ سے لاگت میں اضافہ ہو سکتا ہے۔ |

| تخمینہ میں تاخیر | MCEs ہر ایک ماڈل کے لیے مختلف ML فریم ورکس اور الگورتھم کے ساتھ ML ایپس چلانے کے لیے مثالی ہیں جن تک کبھی کبھار ہی رسائی حاصل کی جاتی ہے لیکن پھر بھی کم تاخیر کا اندازہ درکار ہوتا ہے۔ ماڈلز ہمیشہ کم تاخیر کا اندازہ لگانے کے لیے دستیاب ہوتے ہیں اور کولڈ اسٹارٹ کا کوئی مسئلہ نہیں ہے۔ |

| انحصار | MCEs ایک ملٹی کنٹینر اینڈ پوائنٹ پر 15 کنٹینرز تک محدود ہیں، اور وسائل کے تنازعہ کی وجہ سے GPU کا اندازہ تعاون یافتہ نہیں ہے۔ ڈائریکٹ انوکیشن موڈ کا استعمال کرتے ہوئے ملٹی کنٹینر اینڈ پوائنٹس کے لیے، SageMaker نہ صرف مثال کی سطح کے میٹرکس فراہم کرتا ہے جیسا کہ یہ دوسرے عام اینڈ پوائنٹس کے ساتھ کرتا ہے، بلکہ فی کنٹینر میٹرکس کو بھی سپورٹ کرتا ہے۔ ایک بہترین عمل کے طور پر، ان پٹ کی درخواستوں اور وسائل کے استعمال کے لیے CloudWatch میٹرکس کا جائزہ لیں، اور بہترین تھرو پٹ حاصل کرنے کے لیے مناسب مثال کی قسم منتخب کریں۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی | MCEs آٹو اسکیلنگ کی حمایت کرتے ہیں۔ تاہم، خودکار اسکیلنگ کو ترتیب دینے کے لیے، یہ تجویز کیا جاتا ہے کہ ہر کنٹینر میں موجود ماڈل ہر تخمینہ کی درخواست پر اسی طرح کے CPU استعمال اور تاخیر کو ظاہر کرے۔ اس کی سفارش کی جاتی ہے کیونکہ اگر ملٹی کنٹینر اینڈ پوائنٹ کی ٹریفک کم CPU استعمال ماڈل سے ایک اعلی CPU استعمال ماڈل کی طرف منتقل ہو جاتی ہے، لیکن کال کا مجموعی حجم وہی رہتا ہے، اختتامی نقطہ کی پیمائش نہیں ہوتی ہے، اور کافی مثالیں نہیں ہوسکتی ہیں۔ اعلی CPU استعمال ماڈل کی تمام درخواستوں کو ہینڈل کرنے کے لیے۔ |

| ٹریفک پیٹرن | MCEs مختلف فریم ورکس (جیسے TensorFlow، PyTorch، یا Sklearn) کے ماڈلز کی میزبانی کے لیے مستقل یا باقاعدہ ٹریفک پیٹرن کے ساتھ کام کے بوجھ کے لیے مثالی ہیں جن کے پاس حتمی نقطہ مثال کی پوری صلاحیت کو پورا کرنے کے لیے کافی ٹریفک نہیں ہو سکتی ہے۔ |

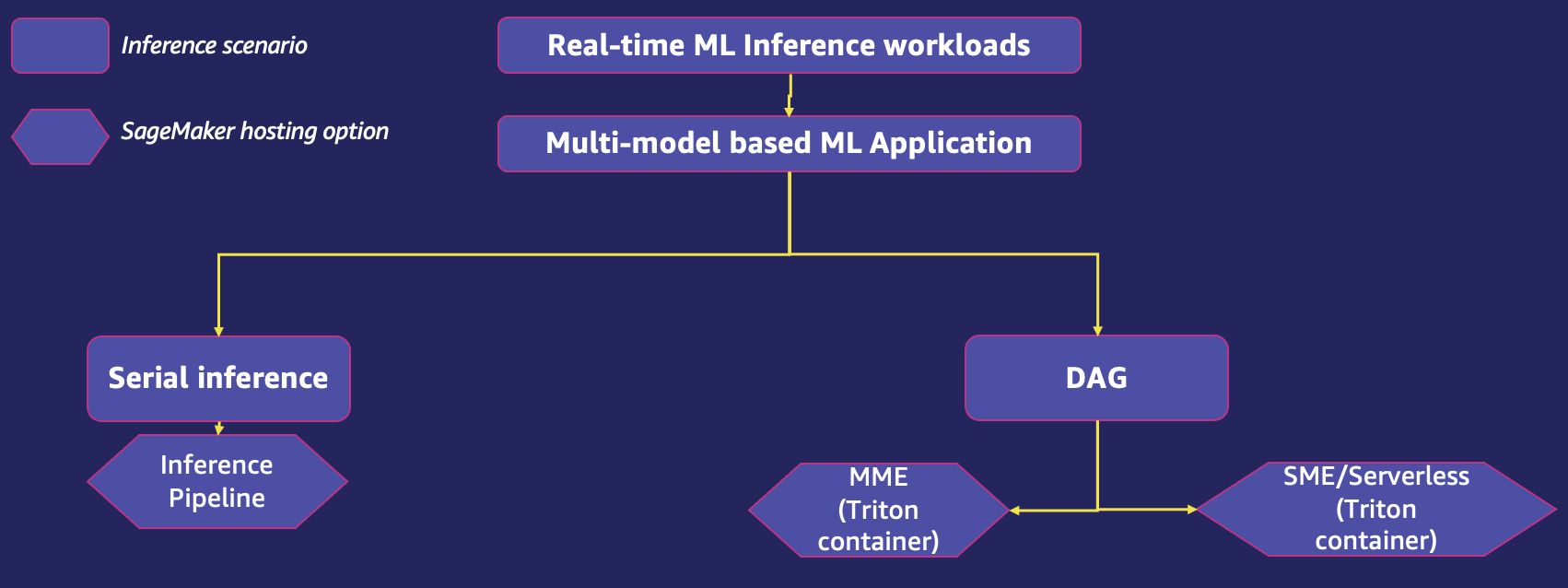

ملٹی ماڈل پر مبنی ایم ایل ایپلیکیشن کی میزبانی کرنا

بہت سی کاروباری ایپلی کیشنز کو اپنے صارفین کو پیشین گوئی کی ایک درخواست پیش کرنے کے لیے متعدد ML ماڈلز استعمال کرنے کی ضرورت ہوتی ہے۔ مثال کے طور پر، ایک خوردہ کمپنی جو اپنے صارفین کو سفارشات فراہم کرنا چاہتی ہے۔ اس استعمال کے معاملے میں ML ایپلیکیشن مختلف قسم کی مصنوعات کی سفارش کرنے کے لیے مختلف حسب ضرورت ماڈلز استعمال کرنا چاہتی ہے۔ اگر کمپنی انفرادی صارف کی معلومات کا استعمال کرتے ہوئے سفارشات میں ذاتی نوعیت کا اضافہ کرنا چاہتی ہے، تو حسب ضرورت ماڈلز کی تعداد مزید بڑھ جاتی ہے۔ ایک الگ کمپیوٹ مثال پر ہر کسٹم ماڈل کی میزبانی کرنا نہ صرف لاگت سے ممنوع ہے، بلکہ اگر تمام ماڈلز کو کثرت سے استعمال نہ کیا جائے تو ہوسٹنگ کے وسائل کو کم استعمال کرنے کا باعث بنتا ہے۔ سیج میکر ملٹی ماڈل پر مبنی ایم ایل ایپلی کیشنز کے لیے ہوسٹنگ کے موثر اختیارات پیش کرتا ہے۔

درج ذیل خاکہ SageMaker کا استعمال کرتے ہوئے سنگل اینڈ پوائنٹ کے لیے ملٹی ماڈل ہوسٹنگ کے اختیارات دکھاتا ہے۔

سیریل انفرنس پائپ لائن

ایک انفرنس پائپ لائن ایک SageMaker ماڈل ہے جو کہ 2-15 کنٹینرز کی لکیری ترتیب پر مشتمل ہے جو ڈیٹا پر انفرنسز کے لیے درخواستوں پر کارروائی کرتی ہے۔ آپ پہلے سے تربیت یافتہ سیج میکر بلٹ ان الگورتھم اور ڈوکر کنٹینرز میں پیک کیے گئے اپنے حسب ضرورت الگورتھم کے کسی بھی امتزاج کی وضاحت اور تعیناتی کے لیے ایک انفرنس پائپ لائن کا استعمال کرتے ہیں۔ آپ پری پروسیسنگ، پیشین گوئیاں، اور پوسٹ پروسیسنگ ڈیٹا سائنس کے کاموں کو یکجا کرنے کے لیے ایک انفرنس پائپ لائن کا استعمال کر سکتے ہیں۔ ایک کنٹینر سے آؤٹ پٹ کو ان پٹ کے طور پر اگلے میں منتقل کیا جاتا ہے۔ پائپ لائن ماڈل کے لیے کنٹینرز کی وضاحت کرتے وقت، آپ اس ترتیب کی بھی وضاحت کرتے ہیں جس میں کنٹینرز چلائے جاتے ہیں۔ سیج میکر میں ان کی نمائندگی ایک واحد پائپ لائن ماڈل کے طور پر کی جاتی ہے۔ انفرنس پائپ لائن کو ایک ایم ایم ای کے طور پر تعینات کیا جا سکتا ہے، جہاں پائپ لائن میں موجود ایک کنٹینر متحرک طور پر درخواستوں کو مدعو کیے جانے والے ماڈل کی بنیاد پر پیش کر سکتا ہے۔ آپ بھی چلا سکتے ہیں a بیچ کی تبدیلی ایک تخمینہ پائپ لائن کے ساتھ کام. انفرنس پائپ لائنز مکمل طور پر منظم ہیں۔

درج ذیل جدول سیریل انفرنس پائپ لائن کا استعمال کرتے ہوئے ایم ایل ماڈل ہوسٹنگ کے لیے فٹنس فنکشنز کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔

| فٹنس فنکشن | Description |

| قیمت | سیریل انفرنس پائپ لائن آپ کو ایک ہی اینڈ پوائنٹ پر 15 مختلف ایم ایل کنٹینرز چلانے کے قابل بناتی ہے، جس کے نتیجے میں انفرنس کنٹینرز کی میزبانی کی لاگت کا اثر ہوتا ہے۔ اس خصوصیت کو استعمال کرنے کے لیے کوئی اضافی اخراجات نہیں ہیں۔ آپ صرف ان مثالوں کے لیے ادائیگی کرتے ہیں جو اختتامی نقطہ پر چل رہے ہیں۔ مثالوں کی تعداد اور قسم کے لحاظ سے لاگت میں اضافہ ہو سکتا ہے۔ |

| تخمینہ میں تاخیر | جب ایک ML ایپلیکیشن کو انفرنس پائپ لائن کے طور پر تعینات کیا جاتا ہے، تو مختلف ماڈلز کے درمیان ڈیٹا کنٹینر کی جگہ نہیں چھوڑتا ہے۔ فیچر پروسیسنگ اور انفرنسز کم لیٹنسی کے ساتھ چلتے ہیں کیونکہ کنٹینرز ایک ہی EC2 مثالوں پر موجود ہوتے ہیں۔ |

| انحصار | ایک انفرنس پائپ لائن ماڈل کے اندر، سیج میکر HTTP درخواستوں کی ترتیب کے طور پر درخواستوں کو ہینڈل کرتا ہے۔ پائپ لائن میں پہلا کنٹینر ابتدائی درخواست کو ہینڈل کرتا ہے، پھر انٹرمیڈیٹ جواب دوسرے کنٹینر کو درخواست کے طور پر بھیجا جاتا ہے، اور اسی طرح، پائپ لائن میں ہر کنٹینر کے لیے۔ سیج میکر کلائنٹ کو حتمی جواب دیتا ہے۔ تھرو پٹ ماڈل، ماڈل ان پٹ سائز، بیچ سائز، اور اختتامی نقطہ مثال کی قسم جیسے عوامل کے تابع ہے۔ ایک بہترین عمل کے طور پر، ان پٹ کی درخواستوں اور وسائل کے استعمال کے لیے CloudWatch میٹرکس کا جائزہ لیں، اور بہترین تھرو پٹ حاصل کرنے کے لیے مناسب مثال کی قسم منتخب کریں۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی | سیریل انفرنس پائپ لائنز آٹو اسکیلنگ کو سپورٹ کرتی ہیں۔ تاہم، خودکار اسکیلنگ کو ترتیب دینے کے لیے، یہ تجویز کیا جاتا ہے کہ ہر کنٹینر میں موجود ماڈل ہر تخمینہ کی درخواست پر اسی طرح کے CPU استعمال اور تاخیر کو ظاہر کرے۔ اس کی سفارش کی جاتی ہے کیونکہ اگر ملٹی کنٹینر اینڈ پوائنٹ کی ٹریفک کم CPU استعمال ماڈل سے اعلی CPU استعمال ماڈل کی طرف منتقل ہو جاتی ہے، لیکن کال کا مجموعی حجم ایک ہی رہتا ہے، تو اختتامی نقطہ کم نہیں ہوتا ہے اور اس کے لیے کافی مثالیں نہیں ہو سکتیں۔ اعلی CPU استعمال ماڈل کی تمام درخواستوں کو ہینڈل کریں۔ |

ٹریفک پیٹرن |

سیریل انفرنس پائپ لائنز ان ماڈلز کے ساتھ پیشین گوئی ٹریفک پیٹرن کے لیے مثالی ہیں جو ایک ہی اختتامی نقطہ پر ترتیب وار چلتے ہیں۔ |

ماڈل ensembles کی تعیناتی (Triton DAG):

سیج میکر کے ساتھ انضمام پیش کرتا ہے۔ NVIDIA ٹرائٹن انفرنس سرور کے ذریعے ٹرائٹن انفرنس سرور کنٹینرز. ان کنٹینرز میں NVIDIA Triton Inference Server، عام ML فریم ورکس کے لیے سپورٹ، اور کارآمد ماحولیاتی متغیرات شامل ہیں جو آپ کو SageMaker پر کارکردگی کو بہتر بنانے دیتے ہیں۔ NVIDIA Triton کنٹینر امیجز کے ساتھ، آپ آسانی سے ML ماڈلز پیش کر سکتے ہیں اور NVIDIA Triton کے ذریعے فراہم کردہ پرفارمنس آپٹیمائزیشنز، ڈائنامک بیچنگ، اور ملٹی فریم ورک سپورٹ سے فائدہ اٹھا سکتے ہیں۔ ٹریٹن GPU اور CPU کے زیادہ سے زیادہ استعمال میں مدد کرتا ہے، اور تخمینہ کی لاگت کو مزید کم کرتا ہے۔

کاروباری استعمال کے معاملات میں جہاں ML ایپلیکیشنز پیشین گوئی کی درخواست پیش کرنے کے لیے متعدد ماڈلز کا استعمال کرتی ہیں، اگر ہر ماڈل ایک مختلف فریم ورک استعمال کرتا ہے یا الگ مثال پر میزبانی کرتا ہے، تو یہ کام کے بوجھ اور لاگت میں اضافے کے ساتھ ساتھ مجموعی تاخیر میں اضافے کا باعث بن سکتا ہے۔ SageMaker NVIDIA Triton Inference Server تمام بڑے فریم ورکس، جیسے TensorFlow GraphDef، TensorFlow SavedModel، ONNX، PyTorch TorchScript، TensorRT، اور Python/C++ ماڈل فارمیٹس اور بہت کچھ سے ماڈلز کی تعیناتی کی حمایت کرتا ہے۔ ٹرائٹن ماڈل کا جوڑا ایک یا زیادہ ماڈلز یا پری پروسیسنگ اور پوسٹ پروسیسنگ منطق کی پائپ لائن اور ان کے درمیان ان پٹ اور آؤٹ پٹ ٹینسر کے کنکشن کی نمائندگی کرتا ہے۔ ایک جوڑ کے لئے ایک ہی استدلال کی درخواست پوری پائپ لائن کو چلانے کو متحرک کرتی ہے۔ ٹریٹن میں متعدد بلٹ ان شیڈولنگ اور بیچنگ الگورتھم بھی ہیں جو انفرادی تخمینہ کی درخواستوں کو یکجا کرتے ہیں تاکہ انفرنس تھرو پٹ کو بہتر بنایا جاسکے۔ یہ شیڈولنگ اور بیچنگ کے فیصلے کلائنٹ کے لیے شفاف ہیں زیادہ سے زیادہ لچک اور متفاوت کمپیوٹنگ کی ضروریات کو سپورٹ کرنے کے لیے ماڈلز کو CPUs یا GPUs پر چلایا جا سکتا ہے۔

ملٹی ماڈل اینڈ پوائنٹس پر متعدد GPU کی حمایت یافتہ ماڈلز کی میزبانی کے ذریعے تعاون کیا جاتا ہے۔ سیج میکر ٹرائٹن انفرنس سرور. NVIDIA Triton Inference Server کو لاگو کرنے کے لیے بڑھا دیا گیا ہے۔ MME API معاہدہ، MMEs کے ساتھ ضم کرنے کے لیے۔ آپ NVIDIA Triton Inference Server استعمال کر سکتے ہیں، جو مختلف فریم ورک بیک اینڈز کے لیے ایک ماڈل ریپوزٹری کنفیگریشن بناتا ہے، تاکہ آٹو اسکیلنگ کے ساتھ ایک MME تعینات کیا جا سکے۔ یہ خصوصیت آپ کو سیکڑوں ہائپر پرسنلائزڈ ماڈلز کو پیمانہ کرنے کی اجازت دیتی ہے جو AI ایپلی کیشنز میں آخری صارف کے منفرد تجربات کو پورا کرنے کے لیے ٹھیک بنائے گئے ہیں۔ آپ فرکشنل GPUs کا استعمال کرتے ہوئے اپنی انفرنس ایپلی کیشن کے لیے ضروری قیمت کی کارکردگی حاصل کرنے کے لیے بھی اس فیچر کا استعمال کر سکتے ہیں۔ مزید جاننے کے لیے رجوع کریں۔ Amazon SageMaker ملٹی ماڈل اینڈ پوائنٹس کے ساتھ GPU پر متعدد ڈیپ لرننگ ماڈلز چلائیں۔.

درج ذیل جدول ٹرائٹن انفرنس کنٹینرز پر GPU سپورٹ کے ساتھ MMEs کا استعمال کرتے ہوئے ML ماڈل ہوسٹنگ کے لیے فٹنس فنکشنز کا جائزہ لینے کے لیے رہنمائی فراہم کرتا ہے۔ سنگل ماڈل اینڈ پوائنٹس اور سرور لیس اینڈ پوائنٹ فٹنس فنکشن کی تشخیص کے لیے، اس پوسٹ میں پہلے والے حصے دیکھیں۔

| فٹنس فنکشن | Description |

| قیمت | ٹریٹن انفرنس سرور کا استعمال کرتے ہوئے GPU سپورٹ کے ساتھ SageMaker MMEs ایک SageMaker اینڈ پوائنٹ کے پیچھے بڑی تعداد میں ڈیپ لرننگ ماڈلز کو تعینات کرنے کے لیے ایک قابل توسیع اور سرمایہ کاری مؤثر طریقہ فراہم کرتے ہیں۔ MMEs کے ساتھ، متعدد ماڈلز ایک اختتامی نقطہ کے پیچھے GPU مثال کا اشتراک کرتے ہیں۔ یہ آپ کو ایک سے زیادہ ماڈلز کی میزبانی کی لکیری طور پر بڑھتی ہوئی لاگت کو توڑنے اور تمام ماڈلز میں انفراسٹرکچر کو دوبارہ استعمال کرنے کے قابل بناتا ہے۔ آپ مثال کے اپ ٹائم کی ادائیگی کرتے ہیں۔ |

| تخمینہ میں تاخیر |

ٹریٹن انفرنس سرور کے ساتھ سیج میکر انتہائی کم (سنگل ڈیجٹ ملی سیکنڈ) انفرنس لیٹنسی کے ساتھ تھرو پٹ اور ہارڈ ویئر کے استعمال کو زیادہ سے زیادہ کرنے کے لیے مقصد سے بنایا گیا ہے۔ اس میں حمایت یافتہ ایم ایل فریم ورک کی ایک وسیع رینج ہے (بشمول TensorFlow، PyTorch، ONNX، XGBoost، اور NVIDIA TensorRT) اور انفراسٹرکچر بیک اینڈز، بشمول NVIDIA GPUs، CPUs، اور AWS Inferentia. SageMaker Triton Inference Server کا استعمال کرتے ہوئے GPU کے لیے MME سپورٹ کے ساتھ، آپ ایک SageMaker اینڈ پوائنٹ کے پیچھے ہزاروں ڈیپ لرننگ ماڈلز تعینات کر سکتے ہیں۔ SageMaker ماڈل کو NVIDIA Triton کنٹینر کی میموری پر GPU ایکسلریٹڈ مثال پر لوڈ کرتا ہے اور تخمینہ کی درخواست کو پورا کرتا ہے۔ GPU کور ایک مثال میں تمام ماڈلز کے ذریعہ شیئر کیا جاتا ہے۔ اگر ماڈل پہلے سے ہی کنٹینر میموری میں لوڈ ہے، تو اس کے بعد کی درخواستیں تیزی سے پیش کی جاتی ہیں کیونکہ SageMaker کو اسے دوبارہ ڈاؤن لوڈ کرنے اور لوڈ کرنے کی ضرورت نہیں ہے۔ |

| انحصار |

MMEs ایک ہی وقت میں، Triton Inference Server کے ساتھ GPU پر ایک سے زیادہ ڈیپ لرننگ یا ML ماڈل چلانے کی صلاحیتیں پیش کرتے ہیں۔ یہ آپ کو آسانی سے NVIDIA Triton ملٹی فریم ورک استعمال کرنے کی اجازت دیتا ہے، SageMaker مکمل طور پر منظم ماڈل کی تعیناتی کے ساتھ اعلی کارکردگی کا اندازہ پیش کرتا ہے۔ ٹرائٹن تمام NVIDIA GPU-, x86-, Arm® CPU-، اور AWS Inferentia پر مبنی inferencing کی حمایت کرتا ہے۔ یہ تھرو پٹ اور استعمال کو زیادہ سے زیادہ کرنے کے لیے ڈائنامک بیچنگ، کنکرنٹ رنز، بہترین ماڈل کنفیگریشن، ماڈل کا جوڑا، اور اسٹریمنگ آڈیو اور ویڈیو ان پٹس پیش کرتا ہے۔ دوسرے عوامل جیسے نیٹ ورک اور پے لوڈ کا سائز اندازہ سے وابستہ اوور ہیڈ میں کم سے کم کردار ادا کر سکتا ہے۔ |

| اسکیلنگ کنفیگریشن کی پیچیدگی |

MMEs ایک آٹو اسکیلنگ پالیسی کا استعمال کرتے ہوئے افقی طور پر پیمائش کر سکتے ہیں، اور میٹرکس کی بنیاد پر اضافی GPU کمپیوٹ مثالیں فراہم کر سکتے ہیں جیسے ٹرائٹن انفرنس سرور کے ساتھ، آپ آسانی سے ایک حسب ضرورت کنٹینر بنا سکتے ہیں جس میں آپ کا ماڈل ٹریٹن کے ساتھ شامل ہو اور اسے سیج میکر پر لایا جائے۔ SageMaker Inference درخواستوں کو ہینڈل کرے گا اور استعمال میں اضافے کے ساتھ ہی کنٹینر کو خود بخود اسکیل کرے گا، جس سے AWS پر Triton کے ساتھ ماڈل کی تعیناتی آسان ہوجائے گی۔ |

| ٹریفک پیٹرن |

MMEs ایک ہی اختتامی نقطہ پر DAGs کے طور پر چلنے والے ماڈلز کے ساتھ پیشین گوئی کرنے والے ٹریفک پیٹرن کے لیے مثالی ہیں۔ SageMaker MME کے اختتامی نقطہ پر ٹریفک کی تشکیل کا خیال رکھتا ہے اور بہترین قیمت کی کارکردگی کے لیے GPU مثالوں پر بہترین ماڈل کاپیاں برقرار رکھتا ہے۔ یہ ٹریفک کو اس مثال تک پہنچاتا رہتا ہے جہاں ماڈل لوڈ ہوتا ہے۔ اگر مثال کے وسائل زیادہ استعمال کی وجہ سے صلاحیت تک پہنچ جاتے ہیں، تو SageMaker زیادہ استعمال ہونے والے ماڈلز کو لوڈ کرنے کے لیے وسائل کو خالی کرنے کے لیے کنٹینر سے کم استعمال شدہ ماڈلز اتارتا ہے۔ |

بہترین طریقوں

درج ذیل بہترین طریقوں پر غور کریں:

- ماڈل کے درمیان اعلی ہم آہنگی اور کم جوڑے - ماڈلز کو ایک ہی کنٹینر میں ہوسٹ کریں جس میں اعلی ہم آہنگی ہو (ایک ہی کاروباری فعالیت کو چلاتا ہے) اور اپ گریڈ اور انتظام میں آسانی کے لیے ان کو اکٹھا کریں۔ ایک ہی وقت میں، ان ماڈلز کو ایک دوسرے سے ڈی جول کریں (ان کو مختلف کنٹینر میں ہوسٹ کریں) تاکہ آپ دوسرے ماڈلز کو متاثر کیے بغیر ایک ماڈل کو آسانی سے اپ گریڈ کر سکیں۔ متعدد ماڈلز کی میزبانی کریں جو ایک اختتامی نقطہ کے پیچھے مختلف کنٹینرز استعمال کرتے ہیں اور پھر آزادانہ طور پر استعمال کرتے ہیں یا ماڈل پری پروسیسنگ اور پوسٹ پروسیسنگ منطق کو سیریل انفرنس پائپ لائن کے طور پر شامل کرتے ہیں۔

- تخمینہ میں تاخیر - ان ماڈلز کو گروپ کریں جو واحد کاروباری فعالیت سے چلنے والے ہیں اور انہیں ایک کنٹینر میں میزبانی کریں تاکہ ہاپس کی تعداد کو کم سے کم کیا جاسکے اور اس وجہ سے مجموعی تاخیر کو کم سے کم کریں۔ دیگر انتباہات ہیں، جیسے کہ اگر گروپ کردہ ماڈلز ایک سے زیادہ فریم ورک استعمال کرتے ہیں؛ آپ متعدد کنٹینرز میں میزبانی کرنے کا انتخاب بھی کر سکتے ہیں لیکن تاخیر کو کم کرنے اور لاگت کو کم کرنے کے لیے ایک ہی میزبان پر چل سکتے ہیں۔

- منطقی طور پر اعلی ہم آہنگی کے ساتھ ایم ایل ماڈلز کو گروپ کریں۔ - منطقی گروپ ایسے ماڈلز پر مشتمل ہو سکتا ہے جو یکساں ہوں (مثال کے طور پر، تمام XGBoost ماڈل) یا متفاوت (مثال کے طور پر، چند XGBoost اور چند BERT)۔ یہ ان ماڈلز پر مشتمل ہو سکتا ہے جو متعدد کاروباری افعال میں مشترکہ ہیں یا صرف ایک کاروباری فعالیت کو پورا کرنے کے لیے مخصوص ہو سکتے ہیں۔

- مشترکہ ماڈلز - اگر منطقی گروپ مشترکہ ماڈلز پر مشتمل ہے، تو ماڈلز کو اپ گریڈ کرنے میں آسانی اور تاخیر SageMaker کے اختتامی نکات کی تعمیر میں اہم کردار ادا کرے گی۔ مثال کے طور پر، اگر تاخیر ایک ترجیح ہے، تو بہتر ہے کہ تمام ماڈلز کو ایک ہی کنٹینر میں ایک واحد SageMaker اینڈ پوائنٹ کے پیچھے رکھ دیا جائے تاکہ متعدد ہاپس سے بچا جا سکے۔ منفی پہلو یہ ہے کہ اگر کسی بھی ماڈل کو اپ گریڈ کرنے کی ضرورت ہے، تو اس کے نتیجے میں اس ماڈل کی میزبانی کرنے والے تمام متعلقہ SageMaker اینڈ پوائنٹس کو اپ گریڈ کیا جائے گا۔

- غیر مشترکہ ماڈلز - اگر منطقی گروپ صرف کاروباری خصوصیت کے مخصوص ماڈلز پر مشتمل ہے اور دوسرے گروپوں کے ساتھ اشتراک نہیں کیا گیا ہے، تو پیکیجنگ کی پیچیدگی اور تاخیر کے طول و عرض حاصل کرنے کی کلید بن جائیں گے۔ یہ مشورہ دیا جاتا ہے کہ ان ماڈلز کو سنگل سیج میکر اینڈ پوائنٹ کے پیچھے ایک کنٹینر میں ہوسٹ کریں۔

- ہارڈ ویئر کا موثر استعمال (CPU، GPU) - CPU پر مبنی ماڈلز کو ایک ساتھ گروپ کریں اور انہیں ایک ہی میزبان پر ہوسٹ کریں تاکہ آپ CPU کو مؤثر طریقے سے استعمال کر سکیں۔ اسی طرح، GPU پر مبنی ماڈلز کو ایک ساتھ گروپ کریں تاکہ آپ ان کو موثر طریقے سے استعمال اور اسکیل کر سکیں۔ ہائبرڈ کام کے بوجھ ہیں جن کے لیے ایک ہی میزبان پر CPU اور GPU دونوں کی ضرورت ہوتی ہے۔ ایک ہی میزبان پر صرف CPU اور GPU-صرف ماڈلز کی میزبانی اعلی ہم آہنگی اور درخواست میں تاخیر کے تقاضوں سے چلتی ہے۔ مزید برآں، لاگت، پیمانے کی صلاحیت، اور ناکامی کی صورت میں اثرات پر دھماکے کا رداس کلیدی جہتیں ہیں جن پر غور کرنا ہے۔

- فٹنس افعال - ایم ایل ہوسٹنگ آپشن کو منتخب کرنے کے لیے فٹنس فنکشنز کو بطور گائیڈ لائن استعمال کریں۔

نتیجہ

جب ML ہوسٹنگ کی بات آتی ہے تو، کوئی ایک سائز کے مطابق تمام اپروچ نہیں ہے۔ ایم ایل پریکٹیشنرز کو اپنے ایم ایل ہوسٹنگ چیلنجوں سے نمٹنے کے لیے صحیح ڈیزائن پیٹرن کا انتخاب کرنے کی ضرورت ہے۔ فٹنس فنکشنز کا جائزہ لینا صحیح ML ہوسٹنگ آپشن کو منتخب کرنے کے بارے میں اصولی رہنمائی فراہم کرتا ہے۔

میزبانی کے اختیارات میں سے ہر ایک کے بارے میں مزید تفصیلات کے لیے، اس سیریز میں درج ذیل پوسٹس کو دیکھیں:

مصنفین کے بارے میں

دھول پٹیل AWS میں پرنسپل مشین لرننگ آرکیٹیکٹ ہے۔ انہوں نے تقسیم شدہ کمپیوٹنگ اور مصنوعی ذہانت سے متعلق مسائل پر بڑے اداروں سے لے کر درمیانے درجے کے اسٹارٹ اپس تک کی تنظیموں کے ساتھ کام کیا ہے۔ وہ NLP اور کمپیوٹر ویژن ڈومینز سمیت گہری سیکھنے پر توجہ مرکوز کرتا ہے۔ وہ صارفین کو SageMaker پر اعلیٰ کارکردگی کے ماڈل کا اندازہ حاصل کرنے میں مدد کرتا ہے۔

دھول پٹیل AWS میں پرنسپل مشین لرننگ آرکیٹیکٹ ہے۔ انہوں نے تقسیم شدہ کمپیوٹنگ اور مصنوعی ذہانت سے متعلق مسائل پر بڑے اداروں سے لے کر درمیانے درجے کے اسٹارٹ اپس تک کی تنظیموں کے ساتھ کام کیا ہے۔ وہ NLP اور کمپیوٹر ویژن ڈومینز سمیت گہری سیکھنے پر توجہ مرکوز کرتا ہے۔ وہ صارفین کو SageMaker پر اعلیٰ کارکردگی کے ماڈل کا اندازہ حاصل کرنے میں مدد کرتا ہے۔

دیپالی راجلے ایمیزون ویب سروسز میں AI/ML ماہر تکنیکی اکاؤنٹ مینیجر ہے۔ وہ انٹرپرائز صارفین کے ساتھ کام کرتی ہے جو بہترین طریقوں کے ساتھ مشین لرننگ سلوشنز کو نافذ کرنے کے لیے تکنیکی رہنمائی فراہم کرتی ہے۔ اپنے فارغ وقت میں، وہ پیدل سفر، فلموں اور خاندان اور دوستوں کے ساتھ گھومنے پھرنے سے لطف اندوز ہوتی ہے۔

دیپالی راجلے ایمیزون ویب سروسز میں AI/ML ماہر تکنیکی اکاؤنٹ مینیجر ہے۔ وہ انٹرپرائز صارفین کے ساتھ کام کرتی ہے جو بہترین طریقوں کے ساتھ مشین لرننگ سلوشنز کو نافذ کرنے کے لیے تکنیکی رہنمائی فراہم کرتی ہے۔ اپنے فارغ وقت میں، وہ پیدل سفر، فلموں اور خاندان اور دوستوں کے ساتھ گھومنے پھرنے سے لطف اندوز ہوتی ہے۔

سوربھ تریکنڈے Amazon SageMaker Inference کے لیے ایک سینئر پروڈکٹ مینیجر ہے۔ وہ صارفین کے ساتھ کام کرنے کا شوق رکھتا ہے اور مشین لرننگ کو جمہوری بنانے کے مقصد سے حوصلہ افزائی کرتا ہے۔ وہ پیچیدہ ایم ایل ایپلی کیشنز، ملٹی ٹیننٹ ایم ایل ماڈلز، لاگت کی اصلاح، اور ڈیپ لرننگ ماڈلز کی تعیناتی کو مزید قابل رسائی بنانے سے متعلق بنیادی چیلنجوں پر توجہ مرکوز کرتا ہے۔ اپنے فارغ وقت میں، سوربھ کو پیدل سفر کرنا، اختراعی ٹیکنالوجیز کے بارے میں سیکھنا، TechCrunch کی پیروی کرنا اور اپنے خاندان کے ساتھ وقت گزارنا پسند ہے۔

سوربھ تریکنڈے Amazon SageMaker Inference کے لیے ایک سینئر پروڈکٹ مینیجر ہے۔ وہ صارفین کے ساتھ کام کرنے کا شوق رکھتا ہے اور مشین لرننگ کو جمہوری بنانے کے مقصد سے حوصلہ افزائی کرتا ہے۔ وہ پیچیدہ ایم ایل ایپلی کیشنز، ملٹی ٹیننٹ ایم ایل ماڈلز، لاگت کی اصلاح، اور ڈیپ لرننگ ماڈلز کی تعیناتی کو مزید قابل رسائی بنانے سے متعلق بنیادی چیلنجوں پر توجہ مرکوز کرتا ہے۔ اپنے فارغ وقت میں، سوربھ کو پیدل سفر کرنا، اختراعی ٹیکنالوجیز کے بارے میں سیکھنا، TechCrunch کی پیروی کرنا اور اپنے خاندان کے ساتھ وقت گزارنا پسند ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو بلاک چین۔ Web3 Metaverse Intelligence. علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/model-hosting-patterns-in-amazon-sagemaker-part-1-common-design-patterns-for-building-ml-applications-on-amazon-sagemaker/

- 1

- 10

- 100

- 11

- 39

- 7

- 70

- a

- کی صلاحیت

- قابلیت

- ہمارے بارے میں

- تیز

- تک رسائی حاصل

- رسائی

- قابل رسائی

- ایڈجسٹ کریں

- اکاؤنٹ

- درست

- حاصل

- حصول

- کے پار

- عمل

- فعال طور پر

- اس کے علاوہ

- ایڈیشنل

- اس کے علاوہ

- پتہ

- آگے بڑھانے کے

- اعلی درجے کی

- فائدہ

- اشتہار.

- پر اثر انداز

- کے بعد

- مجموعی

- جمع کرنے والا

- جارحانہ

- معاہدے

- AI

- AI / ML

- الارم

- یلگوردمز

- تمام

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- پہلے ہی

- ہمیشہ

- ایمیزون

- ایمیزون EC2

- ایمیزون سیج میکر

- ایمیزون ویب سروسز

- رقم

- تجزیہ

- تجزیے

- اور

- اور بنیادی ڈھانچہ

- سالانہ

- ایک اور

- اپاچی

- اے پی آئی

- ایپل

- درخواست

- ایپلی کیشنز

- نقطہ نظر

- مناسب

- ایپس

- فن تعمیر

- بازو

- مصنوعی

- مصنوعی ذہانت

- پہلوؤں

- تشخیص

- منسلک

- اوصاف

- آڈیو

- آڈٹ

- آٹو

- آٹومیٹڈ

- خودکار

- خود کار طریقے سے

- دستیابی

- دستیاب

- اوسط

- AWS

- واپس

- حمایت کی

- بینکنگ

- بیس

- کی بنیاد پر

- کیونکہ

- بن

- ہو جاتا ہے

- اس سے پہلے

- پیچھے

- کیا جا رہا ہے

- فائدہ

- BEST

- بہترین طریقوں

- بہتر

- کے درمیان

- بایڈیکل

- بلاک

- قرض ادا کرنا

- حدود

- باکس

- خلاف ورزی

- توڑ

- لانے

- لاتا ہے

- بجٹ

- تعمیر

- عمارت

- تعمیر

- تعمیر میں

- کاروبار

- بزنس ایپلی کیشنز

- کاروبار کے عمل

- کاروبار

- کیشے

- حساب

- فون

- کہا جاتا ہے

- کالر

- امیدواروں

- صلاحیتوں

- اہلیت

- پرواہ

- کیس

- مقدمات

- اقسام

- وجوہات

- کچھ

- مصدقہ

- چیلنجوں

- تبدیل

- تبدیلیاں

- خصوصیات

- الزام عائد کیا

- چیٹ بٹ

- چیک کریں

- چپ

- انتخاب

- انتخاب

- میں سے انتخاب کریں

- منتخب کریں

- طبقے

- درجہ بندی

- درجہ بندی کرنا۔

- کلائنٹ

- کلائنٹس

- کلوز

- بادل

- کلسٹر

- کوڈ

- سنبھالا

- ساتھیوں

- جمع

- کی روک تھام

- مجموعہ

- جمع

- مل کر

- کامن

- کمپنیاں

- کمپنی کے

- مقابلے میں

- مکمل

- مکمل طور پر

- پیچیدہ

- پیچیدگی

- تعمیل

- اجزاء

- پر مشتمل

- سمجھوتہ

- کمپیوٹیشنل طاقت

- کمپیوٹنگ

- کمپیوٹر

- کمپیوٹر ویژن

- کمپیوٹنگ

- تصور

- اندیشہ

- سمورتی

- ترتیب

- کنکشن

- متواتر

- بسم

- صارفین

- کنٹینر

- کنٹینر

- پر مشتمل ہے

- جاری

- جاری ہے

- مسلسل

- کنٹرول

- کور

- اسی کے مطابق

- قیمت

- لاگت کی بچت

- سرمایہ کاری مؤثر

- اخراجات

- سکتا ہے

- تخلیق

- پیدا

- اہم

- اہم

- موجودہ

- اپنی مرضی کے

- گاہک

- گاہکوں

- ماؤنٹین

- اعداد و شمار

- ڈیٹا پروسیسنگ

- ڈیٹا سائنس

- ڈیٹا سائنسدان

- ڈیٹا بیس

- ڈیٹاسیٹس

- دن

- معاملہ

- فیصلے

- وقف

- گہری

- گہری سیکھنے

- پہلے سے طے شدہ

- وضاحت

- نجات

- ڈیمانڈ

- مطالبات

- جمہوری بنانا

- منحصر ہے

- انحصار کرتا ہے

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- تعینات

- ڈیزائن

- ڈیزائن پیٹرن

- ڈیزائن

- تفصیل

- تفصیلات

- کھوج

- اس بات کا تعین

- ڈیولپر

- ترقی

- ڈایاگرام

- مختلف

- مشکل

- طول و عرض

- براہ راست

- مختلف

- تقسیم کئے

- تقسیم کمپیوٹنگ

- متنوع

- میں Docker

- دستاویزات

- نہیں کرتا

- ڈومینز

- نہیں

- نیچے

- ڈاؤن لوڈ، اتارنا

- نیچے کی طرف

- کارفرما

- گرا دیا

- چھوڑنا

- کے دوران

- متحرک

- ہر ایک

- اس سے قبل

- آسان

- آسانی سے

- موثر

- مؤثر طریقے

- تاثیر

- استعداد کار

- ہنر

- مؤثر طریقے سے

- کوشش

- یا تو

- ختم کرنا

- کو چالو کرنے کے

- کے قابل بناتا ہے

- خفیہ کاری

- آخر سے آخر تک

- اختتام پوائنٹ

- انجنیئرنگ

- انجینئرز

- کافی

- کو یقینی بنانے کے

- یقینی بناتا ہے

- انٹرپرائز

- اداروں

- پوری

- ماحولیات

- خرابی

- نقائص

- خاص طور پر

- اندازہ

- اندازہ

- بھی

- واقعہ

- سب کچھ

- ارتقاء

- مثال کے طور پر

- مثال کے طور پر

- ایکسچینج

- نمائش

- توقع ہے

- توقع

- تجربہ

- تجربات

- تلاش

- اظہار

- بیرونی

- اضافی

- چہرہ

- عوامل

- ناکامی

- کافی

- خاندانوں

- خاندان

- تیز تر

- نمایاں کریں

- خصوصیات

- کھانا کھلانا

- چند

- فائنل

- پہلا

- پہلی بار

- فٹنس

- فلیٹ

- لچک

- بہاؤ

- اتار چڑھاؤ

- توجہ مرکوز

- کے بعد

- مندرجہ ذیل ہے

- فورڈ

- فارم

- فارم

- جزوی

- فریم ورک

- فریم ورک

- دھوکہ دہی

- فراڈ کا پتہ لگانے

- مفت

- فرکوےنسی

- اکثر

- دوست

- سے

- پھل

- مکمل

- مکمل طور پر

- تقریب

- افعال

- فعالیت

- افعال

- مزید

- GDPR

- جنرل

- پیدا

- پیدا کرنے والے

- حاصل

- دے دو

- دی

- مقصد

- اہداف

- اچھا

- GPU

- GPUs

- گراف

- عظیم

- زیادہ سے زیادہ

- بہت

- گروپ

- گروپ کا

- بڑھائیں

- رہنمائی

- ہینڈل

- ہینڈل

- موبائل

- ہارڈ ویئر

- ہونے

- صحت

- صحت کی دیکھ بھال

- مدد

- مدد

- مدد کرتا ہے

- یہاں

- ہائی

- اعلی کارکردگی

- بهترین ریزولوشن

- اعلی

- مارو

- افقی

- میزبان

- میزبانی کی

- ہوسٹنگ

- ہوسٹنگ کے اخراجات

- ہوسٹنگ خدمات

- کس طرح

- تاہم

- HTML

- HTTPS

- سینکڑوں

- ہائبرڈ

- مثالی

- شناختی

- ناقابل یقین

- تصویر

- تصویر کی درجہ بندی

- تصاویر

- غیر معقول

- اثر

- متاثر

- اثرات

- پر عملدرآمد

- عملدرآمد

- پر عمل درآمد

- اہم

- کو بہتر بنانے کے

- کو بہتر بنانے کے

- in

- شامل

- شامل ہیں

- سمیت

- موصولہ

- اضافہ

- اضافہ

- اضافہ

- اضافہ

- آزاد

- آزادانہ طور پر

- انفرادی

- معلومات

- انفراسٹرکچر

- ابتدائی

- جدید

- جدید ٹیکنالوجیز

- ان پٹ

- انسٹال کرنا

- مثال کے طور پر

- کے بجائے

- ضم

- انضمام

- انٹیلی جنس

- انٹرایکٹو

- شامل

- ISO

- تنہائی

- IT

- ایوب

- نوکریاں

- کلیدی

- چابیاں

- جان

- جانا جاتا ہے

- بڑے

- بڑے

- تاخیر

- شروع

- آغاز

- شروع

- قیادت

- معروف

- لیڈز

- جانیں

- سیکھنے

- چھوڑ دو

- قیادت

- سطح

- لائبریریوں

- اٹھانے

- لمیٹڈ

- حدود

- لسٹ

- رہتے ہیں

- لوڈ

- لوڈ کر رہا ہے

- بوجھ

- محل وقوع

- لانگ

- اب

- دیکھو

- کھونے

- بہت

- لو

- مشین

- مشین لرننگ

- بنا

- مین

- برقرار رکھنے کے

- برقرار رکھتا ہے

- اہم

- بنا

- بناتا ہے

- بنانا

- انتظام

- میں کامیاب

- انتظام

- مینیجر

- انتظام کرتا ہے

- مینیجنگ

- بہت سے

- مارکیٹنگ

- ریاضیاتی

- معاملہ

- زیادہ سے زیادہ

- زیادہ سے زیادہ

- کا مطلب ہے کہ

- سے ملو

- یاد داشت

- طریقہ

- طریقوں

- میٹرک۔

- پیمائش کا معیار

- شاید

- کم سے کم

- کم سے کم

- منٹ

- مخلوط

- ML

- موڈ

- ماڈل

- ماڈل

- کی نگرانی

- نگرانی

- مہینہ

- ماہ

- زیادہ

- سب سے زیادہ

- حوصلہ افزائی

- فلم

- ملٹی ماڈل اینڈ پوائنٹ

- ایک سے زیادہ

- بھیڑ

- فطرت، قدرت

- ضروری

- ضرورت ہے

- ضروریات

- نیٹ ورک

- نئی

- اگلے

- ویزا

- نوٹیفیکیشن

- اطلاعات

- تعداد

- NVIDIA

- اعتراض

- مقصد

- مقاصد

- حاصل کرنا

- کبھی کبھار

- پیش کرتے ہیں

- تجویز

- آف لائن

- ایک

- آن لائن

- اوپن سورس

- کام

- چل رہا ہے

- کام

- آپریشنل

- آپریشنز

- آپریٹرز

- زیادہ سے زیادہ

- اصلاح کے

- کی اصلاح کریں

- اصلاح

- اصلاح کرتا ہے

- اصلاح

- اختیار

- آپشنز کے بھی

- اورنج

- حکم

- تنظیمیں

- دیگر

- بقایا

- مجموعی طور پر

- خود

- ملکیت

- پیکج

- پیکیجنگ

- پیرامیٹرز

- حصہ

- خاص طور پر

- پارٹنر

- منظور

- جذباتی

- پیچ

- پاٹرن

- پیٹرن

- ادا

- چوٹی

- انجام دیں

- کارکردگی

- کارکردگی کا مظاہرہ

- مدت

- متواتر

- ادوار

- شخصی

- نجیکرت

- لینے

- پائپ لائن

- مقام

- مقامات

- منصوبہ بنایا

- کی منصوبہ بندی

- پلیٹ فارم

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- کھیلیں

- علاوہ

- پالیسیاں

- پالیسی

- مقبول

- ممکن

- پوسٹ

- مراسلات

- طاقت

- پریکٹس

- طریقوں

- پیش قیاسی

- پیش گوئی

- کی پیشن گوئی

- پیشن گوئی

- کو ترجیح دی

- پہلے

- قیمت

- پرنسپل

- ترجیح

- نجی

- مسئلہ

- مسائل

- عمل

- عملدرآمد

- عمل

- پروسیسنگ

- پروسیسرز

- مصنوعات

- پروڈکٹ مینیجر

- پیداوار

- حاصل

- پروفائل

- مناسب

- فراہم

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- پراجیکٹ

- پراکسی

- مقصد

- پش

- pytorch

- جلدی سے

- رینج

- لے کر

- میں تیزی سے

- شرح

- قیمتیں

- تک پہنچنے

- پہنچتا ہے

- پڑھیں

- تیار

- اصلی

- حقیقی دنیا

- اصل وقت

- وصول

- موصول

- موصول

- سفارش

- سفارش

- سفارشات

- سفارش کی

- سفارش کر رہا ہے

- تجویز ہے

- بار بار چلنے والی

- کو کم

- کم

- مراد

- بے شک

- باقاعدہ

- متعلقہ

- ریلیز

- متعلقہ

- باقی

- ذخیرہ

- نمائندگی

- کی نمائندگی کرتا ہے

- درخواست

- درخواستوں

- کی ضرورت

- ضرورت

- ضرورت

- ضروریات

- کی ضرورت ہے

- وسائل

- وسائل

- جواب

- باقی

- نتیجہ

- نتیجے

- نتائج کی نمائش

- خوردہ

- واپسی

- کا جائزہ لینے کے

- رسک

- کردار

- جڑ

- روٹ

- حکمرانی

- رن

- چل رہا ہے

- ساس

- sagemaker

- سیج میکر کا اندازہ

- تنخواہ

- اسی

- محفوظ کریں

- بچت

- بچت

- توسیع پذیر

- پیمانے

- ترازو

- سکیلنگ

- منظرنامے

- شیڈول

- شیڈول کے مطابق

- سائنس

- سائنسدان

- دوسری

- سیکنڈ

- سیکشن

- سیکشنز

- محفوظ طریقے سے

- سیکورٹی

- منتخب

- انتخاب

- سینئر

- حساس

- تسلسل

- سیریل

- سیریز

- خدمت

- بے سرور

- سرورز

- کام کرتا ہے

- سروس

- سروسز

- خدمت

- مقرر

- قائم کرنے

- کئی

- تشکیل دینا۔

- سیکنڈ اور

- مشترکہ

- شفٹوں

- ہونا چاہئے

- شوز

- اہم

- نمایاں طور پر

- اسی طرح

- اسی طرح

- سادہ

- ایک

- سائز

- سائز

- چھوٹے

- چھوٹے

- So

- سافٹ ویئر کی

- حل

- حل

- کچھ

- ذرائع

- خلا

- ماہر

- خصوصی

- مخصوص

- خاص طور پر

- مخصوص

- تیزی

- خرچ کرنا۔

- spikes

- مستحکم

- ڈھیر لگانا

- Stacks

- شروع کریں

- شروع

- شروع ہوتا ہے

- شروع

- سترٹو

- مستحکم

- مرحلہ

- مراحل

- ابھی تک

- رک جاتا ہے

- ذخیرہ

- ذخیرہ

- حکمت عملیوں

- محرومی

- سخت

- سختی

- بعد میں

- کامیابی

- کامیاب

- اس طرح

- کافی

- موزوں

- حمایت

- تائید

- کی حمایت کرتا ہے

- اضافے

- ٹیبل

- لے لو

- لیتا ہے

- ہدف

- ھدف بنائے گئے

- ٹاسک

- کاموں

- ٹیم

- ٹیموں

- TechCrunch

- ٹیکنیکل

- ٹیکنالوجی

- کرایہ دار

- ٹیسسرور

- ٹیسٹ

- ٹیسٹنگ

- ۔

- ان

- خود

- اس طرح

- لہذا

- ہزاروں

- تین

- حد

- کے ذریعے

- بھر میں

- تھرو پٹ

- وقت

- اوقات

- کرنے کے لئے

- مل کر

- بھی

- کے آلے

- کل

- ٹی پی

- ٹریکنگ

- ٹریفک

- ٹرین

- تربیت یافتہ

- ٹریننگ

- لین دین

- معاملات

- تبدیل

- تبدیلی

- تبدیل

- ٹرانزٹ

- شفاف

- ٹرگر

- رخ

- ٹرن

- اقسام

- ٹھیٹھ

- عام طور پر

- کے تحت

- بنیادی

- سمجھ

- منفرد

- یونٹس

- ناقابل اعتبار

- غیر استعمال شدہ

- اپ ڈیٹ کریں

- تازہ ترین معلومات

- اپ گریڈ

- اعلی درجے کی

- اپ ٹائم

- استعمال

- استعمال کی شرائط

- استعمال کیس

- رکن کا

- صارفین

- عام طور پر

- استعمال

- استعمال کیا

- تصدیق کریں۔

- قیمت

- اقدار

- مختلف

- مختلف

- کی طرف سے

- ویڈیو

- ویڈیوز

- لنک

- مجازی

- نقطہ نظر

- حجم

- ووٹ

- ووٹ

- فضلے کے

- ویب

- ویب خدمات

- ہفتے

- کیا

- کیا ہے

- جس

- جبکہ

- وسیع

- وسیع رینج

- گے

- کے اندر

- بغیر

- کام

- کام کیا

- کارکن

- کارکنوں

- کام کر

- کام کرتا ہے

- دنیا

- گا

- XGBoost

- سال

- تم

- اور

- زیفیرنیٹ

- صفر