Các nhà nghiên cứu khí hậu ở Hoa Kỳ đã phát triển một cách tiếp cận có hệ thống để đào tạo lại các thuật toán trí tuệ nhân tạo học sâu nhằm đối phó với các tình huống khác nhau. Nhóm nghiên cứu nhận thấy rằng, trái ngược với sự hiểu biết thông thường, đào tạo lại các cấp độ trước đó của thuật toán thường đạt được kết quả tốt hơn so với đào tạo lại các cấp độ sau.

Học sâu là một loại máy học tiên tiến, đôi khi gây tranh cãi, trong đó các thuật toán máy tính tự dạy các tính năng quan trọng của một hệ thống và học cách phân loại về bản chất và dự đoán về hành vi của nó, thường với độ chính xác vượt xa khả năng của con người. Có lẽ minh chứng nổi tiếng nhất về ứng dụng của deep learning là chiến thắng của chương trình AlphaGo của Google trước nhà vô địch cờ vây Lee Sedol vào năm 2017. Tuy nhiên, deep learning có nhiều ứng dụng thực tế hơn: nó có thể dự đoán quá trình gấp nếp của protein, sàng lọc sinh thiết mô để phát hiện các dấu hiệu sớm của bệnh ung thư và dự đoán các kiểu thời tiết.

Tuy nhiên, vì các thuật toán học sâu không được lập trình bởi một toán tử bên ngoài, nên chúng cũng không thể được lập trình lại một cách đơn giản. Thay vào đó, nếu hệ thống thay đổi, thuật toán phải được đào tạo lại bằng cách sử dụng dữ liệu từ hệ thống mới. Điều này rất quan trọng trong khí hậu học nếu các thuật toán học sâu được đào tạo bằng cách sử dụng các điều kiện khí hậu ngày nay để đưa ra những dự đoán hữu ích về điều kiện thời tiết trong một thế giới bị ảnh hưởng bởi biến đổi khí hậu. Quá trình này - quen thuộc với con người - thích ứng kinh nghiệm trước đó với các tình huống không quen thuộc được các nhà khoa học máy tính gọi là học chuyển đổi.

bí ẩn sâu sắc

Nhà khoa học khí hậu Pedram Hassanzadeh của Đại học Rice ở Texas giải thích rằng các thuật toán học sâu xử lý thông tin theo trình tự các lớp. “Thông tin đi vào một lớp, lớp này trích xuất một số thông tin, sau đó gửi thông tin này đến một lớp khác, lớp này trích xuất thêm thông tin.” Quá trình này cuối cùng tạo ra đầu ra, nhưng như Hassanzadeh giải thích, “Không ai biết chính xác công việc của mỗi lớp là gì bởi vì chúng tôi không thiết kế bất kỳ lớp nào trong số chúng – tất cả chúng đều được học.” Học chuyển đổi sử dụng một lượng nhỏ dữ liệu có sẵn từ tập dữ liệu mới để đào tạo lại một (hoặc một vài) trong số các cấp độ này và Hassanzadeh nói rằng điều quan trọng là bạn chọn cấp độ nào.

Ông nói, sự khôn ngoan thông thường chỉ ra rằng các chi tiết cụ thể của vấn đề được giải quyết ở các lớp sâu nhất của mạng (những lớp gần đầu ra nhất). Do đó, để thực hiện học chuyển đổi, đây là cách tốt nhất để đào tạo lại. Hassanzadeh giải thích: “Những gì đã được thực hiện trong quá khứ là Google đào tạo một mạng nghìn lớp trên Google Hình ảnh và sau đó ai đó mang đến một số lượng nhỏ tia X, vì vậy họ đào tạo lại các lớp 998 và 999. Thay vào đó, ông và các đồng nghiệp của mình đã thực hiện một cách tiếp cận có hệ thống.

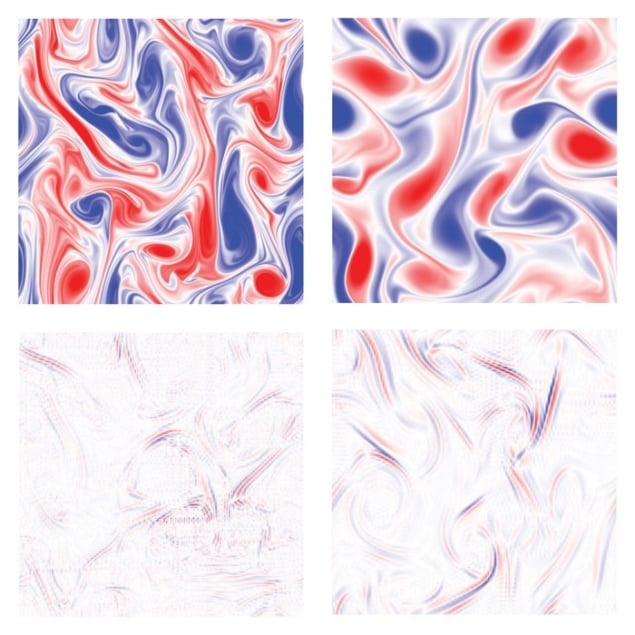

Các nhà nghiên cứu đã thực hiện các mô phỏng có độ phân giải cao về hành vi của chất lỏng trong ba nhóm điều kiện khác nhau. Họ đã sử dụng những dữ liệu này để huấn luyện ba thuật toán học sâu 10 lớp nhằm dự đoán hành vi của chất lỏng theo từng tham số cụ thể này. Họ đã thay đổi một số tham số như số Reynolds (tỷ lệ giữa lực quán tính và lực nhớt) hoặc độ xoáy của chất lỏng trong từng trường hợp và tiến hành một loạt mô phỏng có độ phân giải cao khác để dự đoán hành vi của chất lỏng mới. Trong mỗi trường hợp trong số ba trường hợp, họ đã đào tạo các thuật toán giống nhau trên dữ liệu mới. Cuối cùng, họ tiến hành học chuyển các thuật toán cũ trên một tập hợp con nhỏ của dữ liệu mới, xem xét hiệu quả của việc đào tạo lại từng cấp độ và so sánh hiệu suất của thuật toán cũ được đào tạo lại với thuật toán đã được đào tạo từ đầu trên dữ liệu mới.

Đào tạo lại các lớp nông

Kết quả thật đáng ngạc nhiên. Hassanzadeh cho biết: “Trong bài báo này, chúng tôi thấy rằng các lớp nông nhất là lớp tốt nhất để đào tạo lại. Có quyền truy cập vào tín hiệu dự đoán được tạo ra bằng cách đào tạo lại lần lượt từng lớp đã cho họ một cửa sổ về tác động của từng lớp đối với tín hiệu cuối cùng này. Do đó, họ chỉ đơn giản sử dụng phép phân tích quang phổ của từng tín hiệu để xem cách mỗi lớp điều chỉnh từng tần số hiện tại. Một số cấp độ đang kiểm soát các tần số thấp và rất hữu ích khi đào tạo lại các cấp độ này khi chúng nắm bắt được các tính năng vĩ mô, thay đổi mượt mà của thuật toán. Trong khi đó, các cấp độ khác đã dự đoán các chi tiết và việc đào tạo lại những thứ này một mình là gần như vô dụng. Các nhà nghiên cứu đã cung cấp một giao thức để xác định các cấp độ quan trọng nhất trong bất kỳ trường hợp cụ thể nào. Hassanzadeh nói: “Chúng tôi không muốn nói rằng chúng tôi có một quy tắc chung trong bài báo này. “Bây giờ chúng tôi đã tìm thấy các hệ thống, chẳng hạn như các lớp ở giữa là tốt nhất [để đào tạo lại].”

Trí tuệ nhân tạo đơn giản hóa việc tính toán các thuộc tính điện tử

Nhóm mô tả công việc trong một bài báo được xuất bản trong PNAS Nexus.

“Tôi nghĩ đó là một bài báo thực sự thú vị,” nhà vật lý thiên văn và chuyên gia máy học cho biết Shirley Hồ của Viện Flatiron ở thành phố New York. Cô ấy nói thêm, “Mặt khác, trong nhiều ngành khoa học khác, chúng tôi đã sử dụng phân tích quang phổ từ lâu, vì vậy tôi đoán câu hỏi đặt ra là liệu áp dụng nó cho nhiều lớp có phải là một đóng góp đáng kể hay không. Tôi có cảm giác rằng đó có thể là một trong những thứ đã ở trong tâm trí mọi người, nhưng không ai viết ra nó. Nó có thể là một trong những bài báo tuyệt vời mà một khi bạn nói ra thì mọi người đều thấy rõ ràng.”

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://physicsworld.com/a/new-approach-retrains-deep-neural-networks-to-deal-with-changes-in-complex-systems/

- 2017

- a

- Giới thiệu

- truy cập

- Đạt được

- Hoạt động

- Thêm

- tiên tiến

- thuật toán

- thuật toán

- Tất cả

- cô đơn

- số lượng

- phân tích

- và

- Một

- các ứng dụng

- Nộp đơn

- phương pháp tiếp cận

- nhân tạo

- trí tuệ nhân tạo

- có sẵn

- bởi vì

- BEST

- Hơn

- đáy

- Mang lại

- tính toán

- Ung thư

- không thể

- khả năng

- trường hợp

- trường hợp

- nhà vô địch

- thay đổi

- Những thay đổi

- City

- Khí hậu

- Khí hậu thay đổi

- đồng nghiệp

- so sánh

- phức tạp

- máy tính

- điều kiện

- trái

- đóng góp

- kiểm soát

- gây tranh cãi

- thông thường

- dữ liệu

- tập dữ liệu

- nhiều

- sâu

- học kĩ càng

- sâu nhất

- Thiết kế

- chi tiết

- xác định

- phát triển

- ra lệnh

- sự khác biệt

- khác nhau

- dont

- suốt trong

- mỗi

- Sớm hơn

- Đầu

- hiệu lực

- hay

- điện tử

- cuối cùng

- chính xác

- ví dụ

- kinh nghiệm

- chuyên gia

- Giải thích

- ngoài

- Chất chiết xuất

- quen

- nổi tiếng

- Tính năng

- vài

- Hình

- cuối cùng

- Cuối cùng

- Lực lượng

- tìm thấy

- tần số

- từ

- được

- được

- Go

- Đi

- tuyệt vời

- Nhóm

- tay

- có

- độ phân giải cao

- cao

- Độ đáng tin của

- Tuy nhiên

- HTTPS

- Con người

- hình ảnh

- hình ảnh

- quan trọng

- in

- thông tin

- thay vì

- Viện

- Sự thông minh

- thú vị

- vấn đề

- IT

- Việc làm

- nổi tiếng

- lớp

- lớp

- LEARN

- học

- học tập

- Lee

- Cấp

- niveaux

- Danh sách

- dài

- thời gian dài

- tìm kiếm

- máy

- học máy

- làm cho

- nhiều

- max-width

- Trong khi đó

- Tên đệm

- tâm trí

- kiểu mẫu

- chi tiết

- hầu hết

- nhiều

- Thiên nhiên

- mạng

- mạng

- mạng thần kinh

- Mới

- Newyork

- thành phố new york

- con số

- Rõ ràng

- Xưa

- ONE

- mở

- nhà điều hành

- Nền tảng khác

- Giấy

- giấy tờ

- thông số

- qua

- mô hình

- của người dân

- Thực hiện

- hiệu suất

- có lẽ

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- máy nghe nhạc

- Thực tế

- dự đoán

- dự đoán

- Dự đoán

- trình bày

- Trước khi

- có lẽ

- Vấn đề

- quá trình

- Sản xuất

- chương trình

- lập trình

- Protein

- giao thức

- cung cấp

- công bố

- câu hỏi

- tỉ lệ

- công nhận

- nhà nghiên cứu

- Kết quả

- Gạo

- Quy tắc

- tương tự

- nói

- Quy mô

- khoa học

- Nhà khoa học

- các nhà khoa học

- Màn

- Trình tự

- định

- bộ

- không sâu

- thể hiện

- Tín hiệu

- có ý nghĩa

- Dấu hiệu

- đơn giản

- tình huống

- nhỏ

- thông suốt

- So

- một số

- riêng

- Quang phổ

- đáng kể

- như vậy

- thật ngạc nhiên

- hệ thống

- hệ thống

- nhóm

- texas

- Sản phẩm

- tự

- vì thế

- điều

- số ba

- thumbnail

- thời gian

- đến

- hôm nay

- hàng đầu

- Train

- đào tạo

- Hội thảo

- tàu hỏa

- chuyển

- đúng

- XOAY

- Dưới

- không quen

- trường đại học

- us

- Thời tiết

- Điều gì

- liệu

- cái nào

- sự khôn ngoan

- Công việc

- làm việc

- thế giới

- viết

- Bạn

- zephyrnet