我们最近在 亚马逊SageMaker Python SDK 允许数据科学家运行在他们首选的集成开发人员环境 (IDE) 和笔记本中编写的机器学习 (ML) 代码以及相关的运行时依赖项 亚马逊SageMaker 对本地完成的实验进行最少代码更改的培训工作。 在处理任何 ML 问题时,数据科学家通常会在数据处理和训练模型方面进行多次实验迭代。 他们希望运行此 ML 代码并以易于使用和最少代码更改的方式进行实验。 Amazon SageMaker 模型训练 帮助数据科学家在 AWS 的计算基础设施上运行完全托管的大规模训练作业。 SageMaker Training 还通过高级工具帮助数据科学家,例如 Amazon SageMaker调试器 和 Profiler 来调试和分析他们的大规模训练工作。

对于预算较少、团队规模较小且时间紧迫的客户,为在 SageMaker 上运行而重写的每一个新概念和代码行都会降低他们执行核心任务(即数据处理和训练 ML 模型)的效率。 他们希望在自己选择的框架中编写一次代码,并能够从在笔记本电脑上运行代码无缝地转移到使用 SageMaker 功能大规模运行代码。

借助 SageMaker Python SDK 的这一新功能,数据科学家可以在几分钟内将他们的 ML 代码载入 SageMaker 培训平台。 您只需向 ML 代码中添加一行代码,SageMaker 就会智能地理解您的代码以及数据集和工作区环境设置,并将其作为 SageMaker 训练作业运行。 然后,您可以利用 SageMaker Training 平台的关键功能,例如轻松扩展作业的能力,以及 Debugger 和 Profiler 等其他相关工具。 在此版本中,您可以将本地机器学习 (ML) Python 代码作为单节点 Amazon SageMaker 训练作业或多个并行作业运行。 远程功能不支持分布式训练作业(跨多个节点)。

在本文中,我们将向您展示如何使用此新功能将本地 ML 代码作为 SageMaker 训练作业运行。

解决方案概述

您现在可以运行在 IDE 或笔记本中编写的 ML 代码作为 SageMaker 训练作业,方法是使用简单的装饰器注释该函数,该函数充当用户代码库的入口点。 调用后,此功能会自动为您的 ML 代码中的所有关联变量、函数、包、环境变量和其他运行时要求拍摄快照,将它们序列化,并将它们作为 SageMaker 训练作业提交。 它集成了最近宣布的 用于设置参数默认值的 SageMaker Python SDK 功能. 此功能简化了您需要学习的 SageMaker 构造,以便能够使用 SageMaker Training 运行代码。 数据科学家可以在任何首选的 IDE(例如 亚马逊SageMaker Studio、笔记本、VS Code 或 PyCharm)。 准备就绪后,您可以使用 @remote 装饰器并将其作为 SageMaker 作业大规模运行。

此功能将熟悉的开源 Python 对象作为参数和输出。 此外,您无需了解容器生命周期管理,只需在不同的计算上下文(例如本地 IDE、Studio 或训练作业)中运行您的工作负载,即可将配置开销降至最低。 要将任何本地代码作为 SageMaker 训练作业运行,此功能会推断运行作业所需的配置,例如 AWS身份和访问管理 (IAM) 角色、加密密钥和网络配置,来自 Studio 或 IDE 设置(可以是 默认设置) 并默认将它们传递给平台。 您可以使用推断的配置灵活地在 SageMaker 托管基础设施中自定义您的运行时,或者通过将它们作为参数传递给装饰器来在 SDK 级别覆盖它们。

SageMaker Python SDK 的这一新功能可将您在现有工作区环境中的 ML 代码以及任何关联的数据处理代码和数据集转换为 SageMaker 训练作业。 此功能查找包装在 @remote 装饰器并自动将其转换为在 Studio 或本地 IDE(如 PyCharm)中运行的作业。

在以下部分中,我们将介绍此新功能的特性以及如何启动 python 函数作为 SageMaker 训练作业。

先决条件

要使用这个新的 SageMaker Python SDK 功能并运行与本文相关的代码,您需要满足以下先决条件:

- 一个包含您所有 AWS 资源的 AWS 账户

- 用于访问 SageMaker 的 IAM 角色

- 访问 Studio 或 SageMaker notebook 实例或 IDE(例如 PyCharm)

从 Studio 和 SageMaker notebooks 使用 SDK

您可以从 Studio 中使用此功能,方法是启动笔记本并使用 @remote 笔记本里面的装饰器。 您首先需要使用以下代码导入远程功能:

from sagemaker.remote_function import remote当您使用装饰器功能时,此功能将自动解释您代码的功能并将其作为 SageMaker 训练作业运行。

您还可以从 SageMaker 笔记本实例使用此功能。 您首先需要启动一个笔记本实例,在其上打开 Jupyter 或 Jupyter Lab,然后启动一个笔记本。 然后导入远程函数,如前面的代码所示,并用 @remote 装饰器。 我们将在本文后面提供一个示例,说明如何使用装饰器函数和相关设置。

从您的本地环境使用 SDK

您也可以从本地 IDE 使用此功能。 作为先决条件,您必须拥有 AWS命令行界面 (AWS CLI)、SageMaker Python SDK 和 适用于Python的AWS开发工具包(Boto3) 安装在您的本地环境中。 您需要在代码中导入这些库、设置 SageMaker 会话、指定设置并使用 @remote 装饰器。 在以下示例代码中,我们运行一个简单的除法函数作为 SageMaker 训练作业:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))我们可以使用类似的方法来运行高级函数作为训练作业,如下一节所示。

启动 Python 函数作为 SageMaker 作业

新的 SageMaker Python SDK 功能允许您运行 Python 函数 SageMaker 培训职位. 数据科学家使用他们首选的本地 IDE(PyCharm、VS Code)、SageMaker 笔记本或 Studio 笔记本开发的任何 Python 代码、ML 训练代码都可以作为托管 SageMaker 作业启动。

在使用此功能的 ML 工作负载中,关联的数据集、依赖项和工作区环境设置使用 ML 代码进行序列化,并作为 SageMaker 作业同步和异步运行。

你可以添加一个 @remote 装饰器注释到任何 Python 代码,包括本地 ML 处理或培训功能,以将其作为托管 SageMaker 培训作业启动,从而利用 SageMaker 的规模、性能和成本优势。 这可以通过向 Python 函数代码添加装饰器来以最少的代码更改来实现。 对装饰函数的调用是同步运行的,函数运行会等到 SageMaker 作业完成。

在下面的示例中,我们使用 @remote 装饰器使用 ml.m5.large 实例以装饰器模式启动 SageMaker 作业。 SageMaker 使用训练作业将此功能作为托管作业启动。

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])您还可以使用装饰器模式启动 SageMaker 作业、Python 包和依赖项。 您可以包含 VPC、子网和安全组等环境变量,以在 environment.yml 文件。 这允许 ML 工程师和管理员配置这些环境变量,以便数据科学家可以专注于 ML 模型构建和更快的迭代。 请参见以下代码:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_result您可以使用 RemoteExecutor 异步启动 Python 函数作为 SageMaker 作业。 执行程序异步轮询 SageMaker 训练作业以更新作业的状态。 这 RemoteExecutor 类是一个实现 并发.futures.Executor,用于异步提交 SageMaker 训练作业。 请参见以下代码:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)自定义运行时环境

装饰者模式和 RemoteExecutor 允许您为 SageMaker 作业定义和自定义运行时环境。 可以指定运行时依赖项,包括 SageMaker 作业的 Python 包和环境变量,以自定义运行时。 为了将本地 Python 代码作为 SageMaker 管理的作业运行,Python 包和依赖项需要可供 SageMaker 使用。 ML 工程师或数据科学管理员可以为 SageMaker 作业配置网络和安全配置,例如 VPC、子网和安全组,因此数据科学家可以在启动 SageMaker 作业时使用这些集中管理的配置。 您可以使用 requirements.txt 文件或 Conda environment.yaml 文件中。

当依赖项定义为 requirements.txt,这些包将在作业运行时使用 pip 安装。 如果用于运行作业的图像带有 Conda 环境,则包将安装在声明用于作业的 Conda 环境中。 下面的代码显示了一个例子 requirements.txt 文件:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0你可以通过你的 Conda environment.yaml 文件以创建您希望代码在训练作业期间运行的 Conda 环境。 如果用于运行作业的图像声明了运行代码的 Conda 环境,我们将使用给定的规范更新声明的 Conda 环境。 下面的代码是一个例子 Conda environment.yaml 文件:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemaker或者,您可以设置 dependencies=”auto_capture” 让 SageMaker Python SDK 捕获活动 Conda 环境中已安装的依赖项。 你必须有一个活跃的 Conda 环境 auto_capture 上班。 请注意,有以下先决条件 auto_capture 上班; 我们建议您将依赖项作为 requirement.txt or Conda environment.yml 如前一节所述的文件。

有关更多详细信息,请参阅 将您的本地代码作为 SageMaker 训练作业运行.

SageMaker 作业的配置

与基础架构相关的设置可以卸载到管理员用户可以帮助设置的配置文件中。 您只需设置一次。 基础设施设置涵盖网络配置、IAM 角色、 亚马逊简单存储服务 (Amazon S3) 输入、输出数据和标签的文件夹。 参考 使用 SageMaker Python 开发工具包配置和使用默认值 以获得更多细节。

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidSAP系统集成计划实施

PyTorch 或 TensorFlow 等深度学习模型也可以在 Studio 中运行,方法是将代码作为训练作业在 notebook 中运行。 要在 Studio 中展示此功能,您可以将此存储库克隆到您的 Studio 中并运行位于 GitHub上 库。

此示例演示了端到端二进制文本分类用例。 我们正在使用 Hugging Face 转换器和数据集库来微调二进制文本分类的预训练转换器。 特别是,预训练模型将使用 IMDb 数据集.

克隆存储库时,您应该找到以下文件:

- 配置文件 – 大多数装饰器参数都可以卸载到配置文件中,以便从代码库中分离出与基础设施相关的设置

- 拥抱脸.ipynb – 这包含训练预训练 HuggingFace 模型的代码,该模型将使用 IMDB 数据集进行微调

- requirements.txt – 此文件包含运行函数的所有依赖项,该函数将在本笔记本中用于运行代码并在 GPU 实例中远程运行训练作为训练作业

当你打开notebook时,会提示你设置notebook环境。 您可以选择具有 Python 3.0 内核和 ml.m3.large 的 Data Science 5 映像作为运行笔记本代码的快速启动实例类型。 这种实例类型在启动环境方面明显更快。

训练作业将在 ml.g4dn.xlarge 实例中运行,如 config.yaml 文件:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txt requirements.txt 运行Hugging Face模型训练函数的文件依赖包括:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Hugging Face 笔记本展示了如何通过 @remote 函数,它是同步运行的。 因此,为训练模型而运行的函数将等到 SageMaker 训练作业完成。 训练将使用 GPU 实例远程运行,其中实例类型在前面的配置文件中定义。

运行训练作业后,您可以运行 notebook 中的其余单元格来检查评估指标并对训练模型上的文本进行分类。

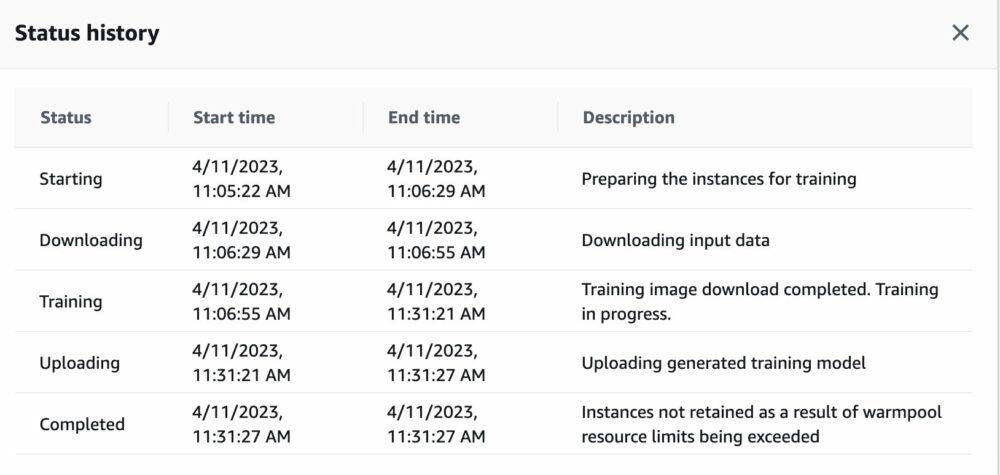

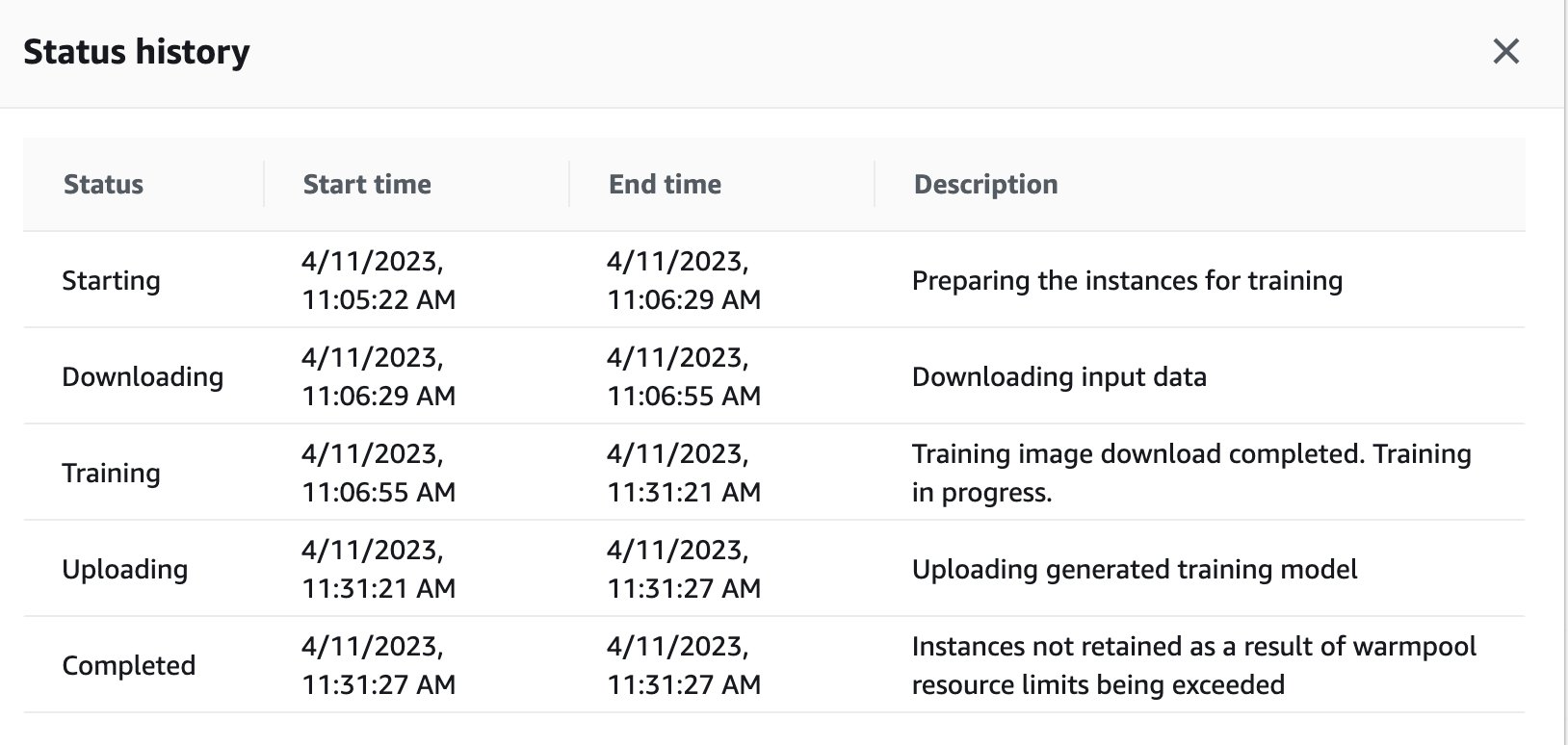

您还可以通过导航回 SageMaker 控制台,在 SageMaker 仪表板上查看在 GPU 实例中远程触发的训练作业状态。

一旦训练工作完成,它会继续运行笔记本中的指令进行评估和分类。 可以通过 Studio 笔记本中嵌入的远程执行器功能训练和运行类似的作业,以异步执行运行。

在 @remote 函数内与 SageMaker 实验集成

您可以将实验名称、运行名称和其他参数传递到远程函数中,以创建 SageMaker 实验运行。 以下代码示例导入实验名称、运行名称以及每次运行要记录的参数:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") 在前面的例子中,参数 p1 和 p2 在训练循环中随时间记录。 通用参数可能包括批量大小或时期。 在示例中,指标 A 和 B 在训练循环中记录运行时间。 常见指标可能包括准确性或损失。 有关详细信息,请参阅 创建 Amazon SageMaker 实验.

结论

在本文中,我们介绍了一种新的 SageMaker Python SDK 功能,使数据科学家能够在他们喜欢的 IDE 中运行他们的 ML 代码作为 SageMaker 训练作业。 我们讨论了使用此功能及其特性所需的先决条件。 我们还展示了如何在 Studio、SageMaker 笔记本实例和您的本地 IDE 中使用此功能。 此外,我们还提供了示例代码示例来演示如何使用此功能。 作为下一步,我们建议按照以下步骤在您的 IDE 或 SageMaker 中尝试此功能 代码示例 在这篇文章中引用。

作者简介

迪潘卡尔帕特罗 是 AWS SageMaker 的一名软件开发工程师,负责创新和构建 MLOps 解决方案,以帮助客户大规模采用 AI/ML 解决方案。 他拥有计算机科学硕士学位,感兴趣的领域是计算机安全、分布式系统和 AI/ML。

迪潘卡尔帕特罗 是 AWS SageMaker 的一名软件开发工程师,负责创新和构建 MLOps 解决方案,以帮助客户大规模采用 AI/ML 解决方案。 他拥有计算机科学硕士学位,感兴趣的领域是计算机安全、分布式系统和 AI/ML。

法鲁克萨比尔 是 AWS 的高级人工智能和机器学习专家解决方案架构师。 他拥有德克萨斯大学奥斯汀分校的电气工程博士和硕士学位,以及佐治亚理工学院的计算机科学硕士学位。 他拥有超过 15 年的工作经验,也喜欢教授和指导大学生。 在 AWS,他帮助客户制定和解决他们在数据科学、机器学习、计算机视觉、人工智能、数值优化和相关领域的业务问题。 他和他的家人居住在得克萨斯州达拉斯,喜欢旅行和长途旅行。

法鲁克萨比尔 是 AWS 的高级人工智能和机器学习专家解决方案架构师。 他拥有德克萨斯大学奥斯汀分校的电气工程博士和硕士学位,以及佐治亚理工学院的计算机科学硕士学位。 他拥有超过 15 年的工作经验,也喜欢教授和指导大学生。 在 AWS,他帮助客户制定和解决他们在数据科学、机器学习、计算机视觉、人工智能、数值优化和相关领域的业务问题。 他和他的家人居住在得克萨斯州达拉斯,喜欢旅行和长途旅行。

马诺拉维 是 Amazon SageMaker 的高级产品经理。 他热衷于构建下一代 AI 产品,并致力于开发软件和工具,让客户更轻松地进行大规模机器学习。 他拥有哈斯商学院的工商管理硕士学位和卡内基梅隆大学的信息系统管理硕士学位。 在业余时间,Manoj 喜欢打网球和追求风光摄影。

马诺拉维 是 Amazon SageMaker 的高级产品经理。 他热衷于构建下一代 AI 产品,并致力于开发软件和工具,让客户更轻松地进行大规模机器学习。 他拥有哈斯商学院的工商管理硕士学位和卡内基梅隆大学的信息系统管理硕士学位。 在业余时间,Manoj 喜欢打网球和追求风光摄影。

希哈尔夸特拉 是 Amazon Web Services 的 AI/ML 专家解决方案架构师,与领先的全球系统集成商合作。 他赢得了印度最年轻的发明大师之一的称号,在 AI/ML 和物联网领域拥有 500 多项专利。 Shikhar 协助为组织设计、构建和维护经济高效、可扩展的云环境,并支持 GSI 合作伙伴在 AWS 上构建战略性行业解决方案。 Shikhar 喜欢在业余时间弹吉他、作曲和练习正念。

希哈尔夸特拉 是 Amazon Web Services 的 AI/ML 专家解决方案架构师,与领先的全球系统集成商合作。 他赢得了印度最年轻的发明大师之一的称号,在 AI/ML 和物联网领域拥有 500 多项专利。 Shikhar 协助为组织设计、构建和维护经济高效、可扩展的云环境,并支持 GSI 合作伙伴在 AWS 上构建战略性行业解决方案。 Shikhar 喜欢在业余时间弹吉他、作曲和练习正念。

维克拉姆·埃兰戈 是美国弗吉尼亚州 AWS 的高级 AI/ML 专家解决方案架构师。 他目前专注于生成 AI、LLM、提示工程、大型模型推理优化和跨企业扩展 ML。 Vikram 通过设计和思想领导帮助金融和保险行业客户大规模构建和部署机器学习应用程序。 在业余时间,他喜欢旅行、远足、烹饪和露营。

维克拉姆·埃兰戈 是美国弗吉尼亚州 AWS 的高级 AI/ML 专家解决方案架构师。 他目前专注于生成 AI、LLM、提示工程、大型模型推理优化和跨企业扩展 ML。 Vikram 通过设计和思想领导帮助金融和保险行业客户大规模构建和部署机器学习应用程序。 在业余时间,他喜欢旅行、远足、烹饪和露营。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- 柏拉图爱流。 Web3 数据智能。 知识放大。 访问这里。

- 与 Adryenn Ashley 一起铸造未来。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :具有

- :是

- :不是

- $UP

- 1

- 10

- 100

- 15 年

- 500

- 7

- a

- 对,能力--

- Able

- 关于

- ACCESS

- 账号管理

- 实现

- 横过

- 要积极。

- 行为

- 加

- 添加

- 增加

- 管理员

- 管理员

- 采用

- 高级

- 优点

- AI

- AI / ML

- 艾滋病

- 所有类型

- 允许

- 沿

- 还

- Amazon

- 亚马逊SageMaker

- 亚马逊网络服务

- an

- 分析

- 和

- 公布

- 任何

- 应用领域

- 保健

- 地区

- 参数

- 人造的

- 人工智能

- 人工智能和机器学习

- AS

- 相关

- At

- 奥斯汀

- 自动

- 可使用

- AWS

- 背部

- 基地

- 基于

- BE

- 好处

- 预算

- 建立

- 建筑物

- 商业

- by

- CAN

- 能力

- 捕获

- 卡耐基 - 梅隆大学

- 携带

- 案件

- 细胞

- 更改

- 更改

- 通道

- 选择

- 程

- 分类

- 分类

- 云端技术

- 码

- 代码库

- 学院

- 购买的订单均

- 相当常见

- 兼容

- 完成

- 计算

- 一台

- 计算机科学

- 计算机安全

- 计算机视觉

- 概念

- 配置

- 安慰

- 包含

- 容器

- 包含

- 上下文

- 继续

- 核心

- 价格

- 可以

- 外壳

- 创建信息图

- 目前

- 合作伙伴

- 定制

- 达拉斯

- XNUMX月XNUMX日

- data

- 数据处理

- 数据科学

- 数据集

- 声明

- 默认

- 默认

- 定义

- 演示

- 演示

- 依赖

- 部署

- 描述

- 设计

- 详情

- 发达

- 开发商

- 研发支持

- 不同

- 讨论

- 分布

- 分布式系统

- 分布式培训

- 域名

- 完成

- 别

- ,我们将参加

- e

- 每

- 赚

- 使用方便

- 更容易

- 容易

- 或

- 嵌入式

- 使

- 加密

- 端至端

- 工程师

- 工程师

- 工程师

- 企业

- 条目

- 环境

- 环境中

- 时代

- 时代

- 评估

- 所有的

- 例子

- 例子

- 执行

- 现有

- 体验

- 实验

- 面部彩妆

- 熟悉

- 家庭

- 高效率

- 快

- 专栏

- 特征

- 少数

- 文件

- 档

- 金融

- 姓氏:

- 高度灵活

- 专注焦点

- 重点

- 以下

- 针对

- 骨架

- 止

- 充分

- 功能

- 功能

- 此外

- 未来

- 期货

- 生成的

- 生成式人工智能

- 特定

- 全球

- Go

- GPU

- 组的

- 有

- he

- 帮助

- 帮助

- 他的

- 持有

- 创新中心

- How To

- HTML

- HTTP

- HTTPS

- 拥抱脸

- 身分

- if

- 图片

- 履行

- 进口

- 进口

- in

- 包括

- 包含

- 印度

- 行业中的应用:

- 信息

- 信息系统

- 基础设施

- 创新

- 输入

- 安装

- 例

- 研究所

- 说明

- 保险

- 集成

- 集成

- 房源搜索

- 兴趣

- 成

- 介绍

- 介绍

- 发明者

- 物联网

- IT

- 迭代

- 它的

- 工作

- 工作机会

- JPG

- 只是

- 键

- 实验室

- 景观

- 笔记本电脑

- 大

- 大规模

- 最新

- 发射

- 推出

- 发射

- 领导团队

- 领导

- 学习用品

- 学习

- 让

- 让

- 库

- 自学资料库

- 生命周期

- 喜欢

- 喜欢

- Line

- 本地

- 当地

- 位于

- 日志

- 记录

- 长

- LOOKS

- 离

- 爱

- 机

- 机器学习

- 制成

- 维护

- 使

- 制作

- 管理

- 颠覆性技术

- 经理

- 主

- 可能..

- 梅隆

- 研究方法

- 指标

- 正念

- 最小

- 分钟

- ML

- 多播

- 时尚

- 模型

- 模型

- 模块

- 更多

- 最先进的

- 移动

- MS

- 多

- 音乐

- 姓名

- 亦即

- 导航

- 需求

- 打印车票

- 网络

- 工业网络

- 全新

- 下页

- 节点

- 笔记本

- 现在

- 麻木

- 对象

- of

- on

- 板载

- 一旦

- 一

- 仅由

- 打开

- 开放源码

- 优化

- or

- 秩序

- 组织

- OS

- 其他名称

- 我们的

- 输出

- 产量

- 超过

- 覆盖

- 包

- 包

- 大熊猫

- 并行

- 参数

- 特别

- 合伙人

- 通过

- 通行证

- 通过

- 多情

- 专利

- 径

- 性能

- 摄影

- 平台

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 播放

- 点

- 帖子

- 首选

- 先决条件

- 以前

- 市场问题

- 问题

- 处理

- 产品

- 产品经理

- 生产力

- 核心产品

- 提供

- 蟒蛇

- pytorch

- 准备

- 最近

- 最近

- 建议

- 有关

- 释放

- 远程

- 更换

- 知识库

- 必须

- 岗位要求

- REST的

- 回报

- 路

- 角色

- 角色

- 运行

- 运行

- sagemaker

- 可扩展性

- 鳞片

- 缩放

- 学校

- 科学

- 科学家

- scikit学习

- SDK

- 无缝

- 部分

- 部分

- 保安

- 看到

- 前辈

- 分开

- 特色服务

- 会议

- 集

- 设置

- 设置

- 格局

- 几个

- 应该

- 显示

- 展示

- 如图

- 作品

- 显著

- 类似

- 简易

- 只是

- 单

- 尺寸

- 小

- 快照

- So

- 软件

- 软件开发

- 解决方案

- 解决

- 专家

- 具体的

- 规范

- 指定

- 开始

- 开始

- Status

- 步

- 存储

- 善用

- 学生

- 工作室

- 提交

- 子网

- 这样

- 支持

- 支持

- 系统

- 产品

- 采取

- 需要

- 服用

- 任务

- 队

- 专业技术

- tensorflow

- 德州

- 文字分类

- 这

- 其

- 他们

- 然后

- 那里。

- 从而

- 因此

- 博曼

- 他们

- Free Introduction

- 思想

- 精神领袖

- 通过

- 次

- 标题

- 至

- 工具

- 火炬

- 向

- 培训

- 熟练

- 产品培训

- 变形金刚

- 旅行

- 旅游

- 引发

- 类型

- 一般

- 下

- 理解

- 大学

- 更新

- us

- 使用

- 用例

- 用过的

- 用户

- 运用

- 折扣值

- 价值观

- 版本

- 通过

- 查看

- 弗吉尼亚州

- 愿景

- vs

- VS代码

- 等待

- 想

- we

- 卷筒纸

- Web服务

- ,尤其是

- 这

- 而

- 将

- 中

- 工作

- 加工

- 合作

- 将

- 包装

- 包裹

- 写

- 写代码

- 书面

- X

- 年

- 完全

- 最年轻的

- 您一站式解决方案

- 和风网