如果有人告诉你一个你已经知道的事实,他们基本上什么也没告诉你。 而如果他们透露了一个秘密,那么可以说确实已经传达了一些东西。

这种区别是克劳德·香农信息论的核心。 在 1948 年的一篇划时代论文中介绍,“关于通讯的数学理论,”它提供了一个严格的数学框架,用于量化准确发送和接收消息所需的信息量,具体取决于预期消息可能表达的不确定程度。

也就是说,是时候举个例子了。

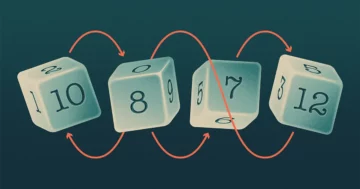

在一种情况下,我有一枚特技硬币——两面都是正面。 我要翻转它两次。 传达结果需要多少信息? 根本没有,因为在收到消息之前,您完全确定两次翻转都会出现。

在第二种情况下,我用一枚普通硬币进行两次翻转 - 一侧是正面,另一侧是反面。 我们可以使用二进制代码传达结果:0 表示正面,1 表示反面。 有四种可能的消息——00、11、01、10——每一种都需要两位信息。

那么,有什么意义呢? 在第一个场景中,您完全确定了消息的内容,并且传输它需要零位。 在一秒钟之内,你有四分之一的机会猜到正确答案——1% 的确定性——而消息需要两位信息来解决这种模棱两可的问题。 更一般地说,您对信息内容的了解越少,传达的信息就越多。

香农是第一个使这种关系在数学上精确的人。 他在一个公式中捕捉到了这一点,该公式计算了传递消息所需的最小比特数——后来称为香农熵的阈值。 他还表明,如果发送者使用的位数少于最小值,则消息将不可避免地被扭曲。

“他有一种很好的直觉,当你对了解某事感到最惊讶时,信息就会最大化,”说 塔拉·贾维迪,加州大学圣地亚哥分校的信息理论家。

“熵”这个词是从物理学中借来的,其中 熵是无序的量度. 云比冰块具有更高的熵,因为云比立方体的晶体结构允许更多的方式排列水分子。 以类似的方式,随机消息具有高香农熵——其信息的排列方式有很多可能性——而遵循严格模式的消息具有低熵。 在物理学和信息论中计算熵的方式也有形式上的相似之处。 在物理学中,熵的公式涉及对可能的物理状态取对数。 在信息论中,它是可能事件结果的对数。

香农熵的对数公式掩盖了它所捕获内容的简单性——因为考虑香农熵的另一种方式是,平均而言,确定消息内容所需的是或否问题的数量。

例如,假设有两个气象站,一个在圣地亚哥,另一个在圣路易斯。 每个人都想将其城市的 50 天预报发送给对方。 圣地亚哥几乎总是阳光明媚,这意味着您对预报的内容充满信心。 圣路易斯的天气更加不确定——晴天的几率接近 50-XNUMX。

传输每个 XNUMX 天预报需要多少个是或否问题? 对于圣地亚哥,第一个有利可图的问题可能是:预报的所有 XNUMX 天都是晴天吗? 如果答案是肯定的(而且很有可能),那么您已经在一个问题中确定了整个预测。 但是在圣路易斯,您几乎必须一天一次地通过预报:第一天晴吗? 第二个呢?

消息内容的确定性越高,平均而言,确定它所需的“是”或“否”问题就越少。

再举一个例子,考虑一个字母游戏的两个版本。 首先,我从英文字母表中随机选择了一个字母,我想让你猜一下。 如果你使用最好的猜测策略,平均需要 4.7 个问题才能得到它。 (一个有用的第一个问题是,“字母在字母表的前半部分吗?”)

在游戏的第二个版本中,您不是猜测随机字母的值,而是尝试猜测实际英文单词中的字母。 现在您可以调整您的猜测,以利用以下事实:某些字母比其他字母出现的频率更高(“它是元音吗?”)并且知道一个字母的值有助于您猜测下一个字母的值(q 几乎总是其次是你)。 Shannon 计算出英语的熵是每个字母 2.62 位(或 2.62 个是或否问题),远低于每个字母随机出现时所需的 4.7。 换句话说,模式减少了不确定性,这使得使用相对较少的信息进行大量交流成为可能。

请注意,在这些示例中,您可以提出更好或更坏的问题。 香农熵设置了一个不可侵犯的底线:它是传达信息所需的绝对最小位数,或者是或否问题。

“香农展示了光速之类的东西,这是一个基本极限,”贾维迪说。 “他表明,香农熵是我们可以压缩源的程度的基本限制,而不会有失真或丢失的风险。”

今天,香农熵已成为许多应用环境中的衡量标准,包括信息压缩技术。 例如,您可以压缩一个大型电影文件,这是因为像素颜色具有统计模式,就像英语单词一样。 工程师可以为从一帧到下一帧的像素颜色模式构建概率模型。 这些模型可以通过为模式分配权重然后对像素可能出现的所有可能方式取权重的对数来计算香农熵。 该值告诉您“无损”压缩的限制——在您开始丢失有关其内容的信息之前,电影可以被压缩的绝对最大值。

任何压缩算法的性能都可以与此限制进行比较。 如果你离它还很远,你就有动力更加努力地寻找更好的算法。 但如果你接近它,你就会知道宇宙的信息法则阻止你做得更好。