نماذج اللغات الكبيرة (LLMs) التي تحتوي على مليارات من المعلمات هي حاليًا في طليعة معالجة اللغة الطبيعية (NLP). تهز هذه النماذج المجال بقدراتها المذهلة على إنشاء نصوص وتحليل المشاعر وترجمة اللغات وغير ذلك الكثير. من خلال الوصول إلى كميات هائلة من البيانات ، تمتلك LLM القدرة على إحداث ثورة في الطريقة التي نتفاعل بها مع اللغة. على الرغم من أن LLMs قادرة على أداء مهام NLP المختلفة ، إلا أنها تعتبر عمومية وليست متخصصين. من أجل تدريب LLM ليصبح خبيرًا في مجال معين ، عادة ما يكون الضبط الدقيق مطلوبًا.

يتمثل أحد التحديات الرئيسية في تدريب ونشر LLM بمليارات من المعلمات في حجمها ، مما يجعل من الصعب تركيبها في وحدات معالجة رسومات واحدة ، وهي الأجهزة المستخدمة بشكل شائع للتعلم العميق. يتطلب الحجم الهائل لهذه النماذج موارد حوسبة عالية الأداء ، مثل وحدات معالجة الرسومات المتخصصة التي تحتوي على كميات كبيرة من الذاكرة. بالإضافة إلى ذلك ، يمكن أن يؤدي حجم هذه النماذج إلى جعلها باهظة التكلفة من الناحية الحسابية ، مما قد يؤدي إلى زيادة أوقات التدريب والاستدلال بشكل كبير.

في هذا المنشور ، نوضح كيف يمكننا استخدام أمازون سيج ميكر جومب ستارت لضبط نموذج إنشاء نص بلغة كبيرة بسهولة على مجموعة بيانات خاصة بالمجال بنفس الطريقة التي تدرب بها وتنشر أي نموذج على الأمازون SageMaker. على وجه الخصوص ، نوضح كيف يمكنك ضبط نموذج لغة GPT-J 6B لإنشاء نص مالي باستخدام كل من JumpStart SDK و أمازون ساجميكر ستوديو UI على مجموعة بيانات متاحة للجمهور من إيداعات SEC.

تساعدك JumpStart على البدء بسرعة وسهولة في التعلم الآلي (ML) وتوفر مجموعة من الحلول لحالات الاستخدام الأكثر شيوعًا التي يمكن تدريبها ونشرها بسهولة ببضع خطوات فقط. جميع الخطوات في هذا العرض التوضيحي متوفرة في دفتر الملاحظات المصاحب الضبط الدقيق لنموذج إنشاء النص GPT-J 6B على مجموعة بيانات خاصة بالمجال.

حل نظرة عامة

في الأقسام التالية ، نقدم عرضًا توضيحيًا خطوة بخطوة لضبط LLM لمهام إنشاء النص عبر كل من JumpStart Studio UI و Python SDK. على وجه الخصوص ، نناقش المواضيع التالية:

- نظرة عامة على بيانات ملف SEC في المجال المالي التي تم ضبط النموذج عليها

- نظرة عامة على طراز LLM GPT-J 6B الذي اخترناه لضبطه

- عرض توضيحي لطريقتين مختلفتين يمكننا ضبط LLM باستخدام JumpStart:

- استخدم JumpStart برمجيًا مع SageMaker Python SDK

- قم بالوصول إلى JumpStart باستخدام Studio UI

- تقييم للنموذج الدقيق من خلال مقارنته بالنموذج المدرَّب مسبقًا دون ضبطه

يشير الضبط الدقيق إلى عملية أخذ نموذج لغوي مدرب مسبقًا وتدريبه على مهمة مختلفة ولكنها ذات صلة باستخدام بيانات محددة. يُعرف هذا النهج أيضًا باسم نقل التعلم، والتي تنطوي على نقل المعرفة المكتسبة من مهمة إلى أخرى. يتم تدريب LLMs مثل GPT-J 6B على كميات هائلة من البيانات غير المسماة ويمكن ضبطها بدقة على مجموعات البيانات الأصغر ، مما يجعل النموذج يعمل بشكل أفضل في مجال معين.

كمثال على كيفية تحسين الأداء عند ضبط النموذج ، ضع في اعتبارك طرح السؤال التالي عليه:

"ما الذي يدفع نمو المبيعات في أمازون؟"

بدون الضبط الدقيق ، ستكون الاستجابة:

"أمازون هو أكبر بائع تجزئة عبر الإنترنت في العالم. إنه أيضًا أكبر سوق عبر الإنترنت في العالم. إنه العالم أيضًا "

مع الضبط الدقيق ، تكون الاستجابة:

"نمو المبيعات في أمازون مدفوع أساسًا بزيادة استخدام العملاء ، بما في ذلك زيادة الاختيار ، وانخفاض الأسعار ، وزيادة الراحة ، وزيادة مبيعات البائعين الآخرين على مواقعنا الإلكترونية."

التحسن من الضبط واضح.

نستخدم نصًا ماليًا من إيداعات SEC لضبط GPT-J 6B LLM للتطبيقات المالية. في الأقسام التالية ، نقدم البيانات و LLM التي سيتم ضبطها بدقة.

مجموعة بيانات حفظ SEC

إيداعات SEC ضرورية للتنظيم والإفصاح في مجال التمويل. تُعلم الإيداعات مجتمع المستثمرين بظروف عمل الشركات والتوقعات المستقبلية للشركات. يغطي النص في إيداعات SEC النطاق الكامل لعمليات الشركة وظروف العمل. نظرًا لقيمتها التنبؤية المحتملة ، تعد هذه الإيداعات مصادر جيدة للمعلومات للمستثمرين. على الرغم من أن هذه الإيداعات SEC هي متاح للعامة بالنسبة لأي شخص ، يعد تنزيل الملفات التي تم تحليلها وإنشاء مجموعة بيانات نظيفة مع ميزات إضافية عملية تستغرق وقتًا طويلاً. نجعل هذا ممكنًا في عدد قليل من استدعاءات API في JumpStart صناعة SDK.

باستخدام SageMaker API ، قمنا بتنزيل التقارير السنوية (10-K برادة. بحيرة كيف تقرأ a 10-K لمزيد من المعلومات) لعدد كبير من الشركات. نختار تقارير الإيداع الخاصة بـ Amazon SEC للأعوام 2021-2022 كبيانات تدريب لضبط نموذج GPT-J 6B. على وجه الخصوص ، نقوم بتجميع تقارير الإيداع الخاصة بـ SEC الخاصة بالشركة في سنوات مختلفة في ملف نصي واحد باستثناء قسم "مناقشة الإدارة والتحليل" ، والذي يحتوي على بيانات تطلعية من قبل إدارة الشركة ويتم استخدامها كبيانات التحقق من الصحة.

التوقع هو أنه بعد ضبط نموذج إنشاء نص GPT-J 6B على مستندات SEC المالية ، يكون النموذج قادرًا على إنشاء مخرجات نصية ذات صلة مالية ثاقبة ، وبالتالي يمكن استخدامها لحل العديد من مهام البرمجة اللغوية العصبية الخاصة بالمجال.

نموذج اللغة الكبيرة GPT-J 6B

جي بي تي-ي 6 ب هو نموذج مفتوح المصدر مكون من 6 مليارات معلمة تم إصداره بواسطة Eleuther AI. تم تدريب GPT-J 6B على مجموعة كبيرة من البيانات النصية وهو قادر على أداء مهام معالجة اللغات الطبيعية المختلفة مثل إنشاء النص وتصنيف النص وتلخيص النص. على الرغم من أن هذا النموذج مثير للإعجاب في عدد من مهام البرمجة اللغوية العصبية دون الحاجة إلى أي ضبط دقيق ، إلا أنك ستحتاج في كثير من الحالات إلى ضبط النموذج على مجموعة بيانات محددة ومهام البرمجة اللغوية العصبية التي تحاول حلها. تشمل حالات الاستخدام روبوتات المحادثة المخصصة ، وتوليد الأفكار ، واستخراج الكيانات ، والتصنيف ، وتحليل المشاعر.

الوصول إلى LLMs على SageMaker

الآن بعد أن حددنا مجموعة البيانات والنموذج الذي سنقوم بضبطه ، يوفر JumpStart طريقتين للبدء في استخدام ضبط إنشاء النص: SageMaker SDK و Studio.

استخدم JumpStart برمجيًا مع SageMaker SDK

ننتقل الآن إلى مثال لكيفية استخدام SageMaker JumpStart SDK للوصول إلى LLM (GPT-J 6B) وضبطه في مجموعة بيانات حفظ SEC. عند الانتهاء من الضبط الدقيق ، سنقوم بنشر النموذج الدقيق والاستدلال عليه. جميع الخطوات الواردة في هذا المنشور متوفرة في دفتر الملاحظات المصاحب: الضبط الدقيق لتوليد النص من طراز GPT-J 6B على مجموعة بيانات خاصة بالمجال.

في هذا المثال ، يستخدم JumpStart ملف حاوية التعلم العميق للوجه من SageMaker (DLC) و السرعة العميقة مكتبة لضبط النموذج. تم تصميم مكتبة DeepSpeed لتقليل استخدام قوة الحوسبة والذاكرة ولتدريب النماذج الموزعة الكبيرة بتوازي أفضل على أجهزة الكمبيوتر الموجودة. وهو يدعم التدريب الموزع على عقدة واحدة ، باستخدام نقاط فحص التدرج والتوازي النموذجي لتدريب النماذج الكبيرة على مثيل تدريب SageMaker واحد مع وحدات معالجة رسومات متعددة. مع JumpStart ، ندمج مكتبة DeepSpeed مع SageMaker Hugging Face DLC من أجلك ونعتني بكل شيء تحت الغطاء. يمكنك بسهولة ضبط النموذج على مجموعة البيانات الخاصة بالمجال دون إعداده يدويًا.

صقل النموذج المدرَّب مسبقًا على البيانات الخاصة بالمجال

لضبط النموذج المحدد ، نحتاج إلى الحصول على URI الخاص بهذا النموذج ، بالإضافة إلى البرنامج النصي للتدريب وصورة الحاوية المستخدمة للتدريب. لتسهيل الأمور ، تعتمد هذه المدخلات الثلاثة فقط على اسم الطراز والإصدار (للحصول على قائمة النماذج المتاحة ، راجع خوارزميات مدمجة مع نموذج جدول مدرب مسبقًا) ، ونوع المثيل الذي تريد التدرب عليه. هذا موضح في مقتطف الشفرة التالي:

نسترجع ملف model_id يتوافق مع نفس النموذج الذي نريد استخدامه. في هذه الحالة ، نقوم بضبط huggingface-textgeneration1-gpt-j-6b.

يتضمن تحديد المعلمات الفائقة تحديد قيم المعلمات المختلفة المستخدمة أثناء عملية التدريب لنموذج ML. يمكن أن تؤثر هذه المعلمات على أداء النموذج ودقته. في الخطوة التالية ، قمنا بإنشاء المعلمات التشعبية من خلال استخدام الإعدادات الافتراضية وتحديد القيم المخصصة للمعلمات مثل epochs و learning_rate:

يوفر JumpStart قائمة واسعة من المعلمات التشعبية المتاحة لضبطها. توفر القائمة التالية نظرة عامة على جزء من المعلمات التشعبية الرئيسية المستخدمة في ضبط النموذج. للحصول على قائمة كاملة بالمعلمات الفائقة ، راجع دفتر الملاحظات الضبط الدقيق لتوليد النص من طراز GPT-J 6B على مجموعة بيانات خاصة بالمجال.

- عهود - يحدد على الأكثر عدد فترات مجموعة البيانات الأصلية التي سيتم تكرارها.

- معدل التعليم - يتحكم في حجم الخطوة أو معدل التعلم لخوارزمية التحسين أثناء التدريب.

- تقييم_الخطوات - يحدد عدد الخطوات التي يجب تشغيلها قبل تقييم النموذج في مجموعة التحقق من الصحة أثناء التدريب. مجموعة التحقق من الصحة هي مجموعة فرعية من البيانات التي لا يتم استخدامها للتدريب ، ولكنها تستخدم بدلاً من ذلك للتحقق من أداء النموذج على البيانات غير المرئية.

- الوزن_التحلل - يتحكم في قوة التنظيم أثناء تدريب النموذج. التنظيم هو تقنية تساعد على منع النموذج من التخصيص الزائد لبيانات التدريب ، مما قد يؤدي إلى أداء أفضل على البيانات غير المرئية.

- fp16 - يتحكم في استخدام تدريب دقيق 16 بت (مختلط) fp16 بدلاً من تدريب 32 بت.

- إستراتيجية التقييم - إستراتيجية التقييم المستخدمة أثناء التدريب.

- خطوات_تراكم_التدرج - عدد خطوات التحديث لتجميع التدرجات قبل إجراء تمرير رجوع / تحديث.

لمزيد من التفاصيل حول المعلمات الفائقة ، يرجى الرجوع إلى المسؤول وثائق Hugging Face Trainer.

يمكنك الآن ضبط نموذج JumpStart هذا على مجموعة البيانات المخصصة الخاصة بك باستخدام SageMaker SDK. نحن نستخدم بيانات حفظ SEC التي وصفناها سابقًا. يتم استضافة بيانات القطار والتحقق من الصحة تحت train_dataset_s3_path و validation_dataset_s3_path. يتضمن التنسيق المدعوم للبيانات CSV و JSON و TXT. بالنسبة لبيانات CSV و JSON ، يتم استخدام البيانات النصية من العمود المسمى text أو العمود الأول إذا لم يتم العثور على عمود يسمى نص. نظرًا لأن هذا من أجل ضبط إنشاء النص بدقة ، فلا يلزم وجود تسميات للحقيقة الأساسية. الكود التالي هو مثال على SDK لكيفية ضبط النموذج:

بعد أن قمنا بإعداد SageMaker Estimator باستخدام المعلمات الفائقة المطلوبة ، نقوم بإنشاء مثيل لمقدر SageMaker واستدعاء .fit طريقة لبدء ضبط نموذجنا ، وتمريره خدمة تخزين أمازون البسيطة (Amazon S3) URI لبيانات التدريب الخاصة بنا. كما ترون ، فإن entry_point تم تسمية البرنامج النصي المقدم transfer_learning.py (نفس الشيء بالنسبة للمهام والنماذج الأخرى) ، وتم تمرير قناة بيانات الإدخال إلى .fit يجب تسمية القطار والتحقق من الصحة.

يدعم JumpStart أيضًا تحسين المعلمة الفائقة باستخدام SageMaker ضبط النموذج التلقائي. لمزيد من التفاصيل ، انظر المثال مفكرة.

انشر النموذج الدقيق

عند اكتمال التدريب ، يمكنك نشر النموذج الدقيق الخاص بك. للقيام بذلك ، كل ما نحتاج إلى الحصول عليه هو URI النصي للاستدلال (الكود الذي يحدد كيفية استخدام النموذج للاستدلال بمجرد نشره) وصورة حاوية الاستدلال URI ، والتي تتضمن خادمًا نموذجيًا مناسبًا لاستضافة النموذج الذي اخترناه. انظر الكود التالي:

بعد بضع دقائق ، يتم نشر نموذجنا ويمكننا الحصول على تنبؤات منه في الوقت الفعلي!

قم بالوصول إلى JumpStart من خلال Studio UI

هناك طريقة أخرى لضبط نماذج JumpStart ونشرها وهي من خلال Studio UI. توفر واجهة المستخدم هذه حلاً منخفض الكود / بدون رمز لضبط LLMs.

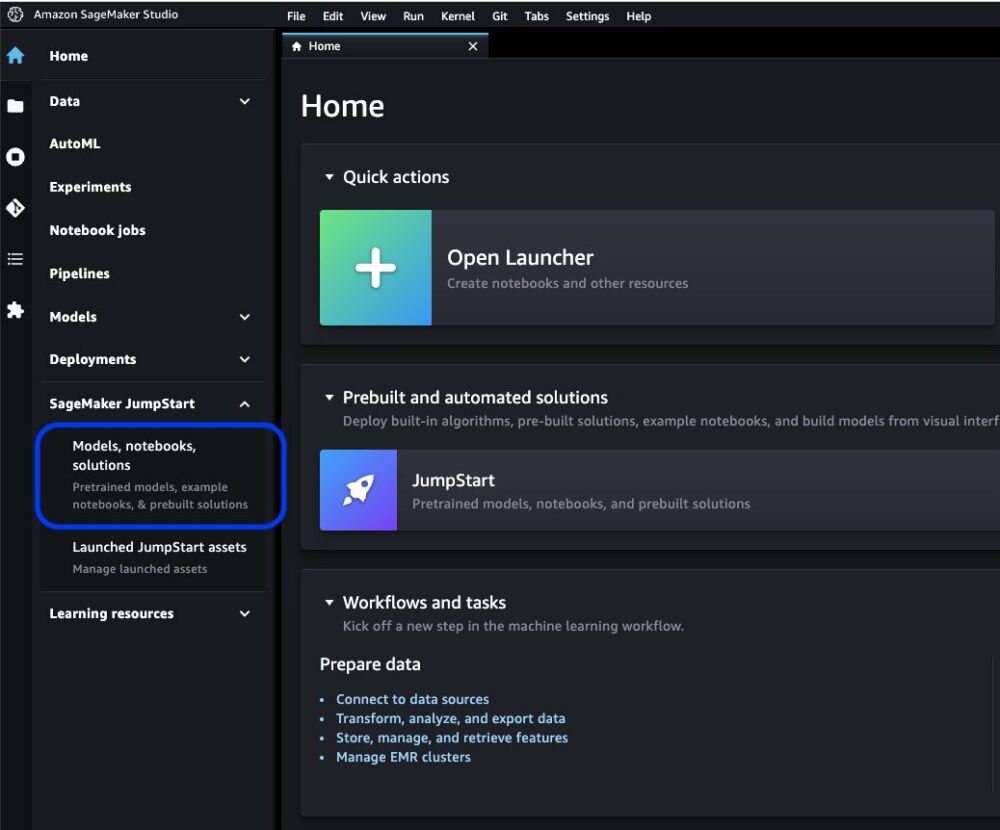

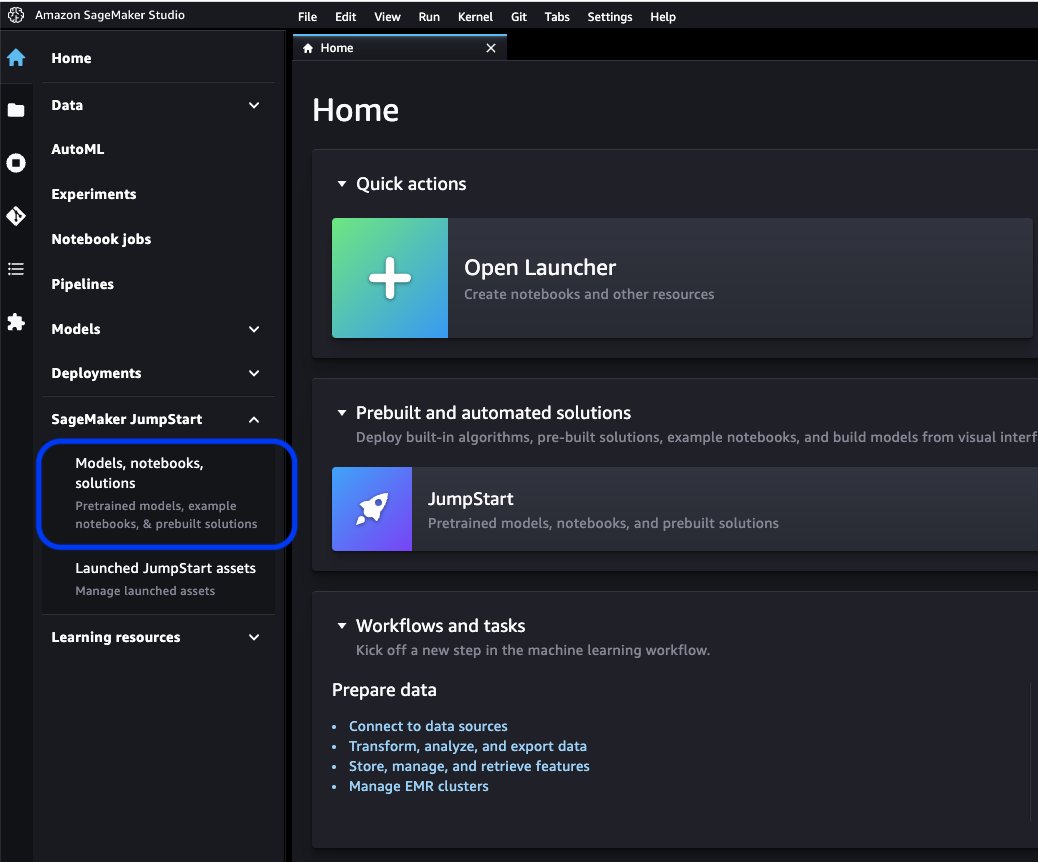

في وحدة تحكم الاستوديو ، اختر النماذج والدفاتر والحلول مع سيج ميكر جومب ستارت في جزء التنقل.

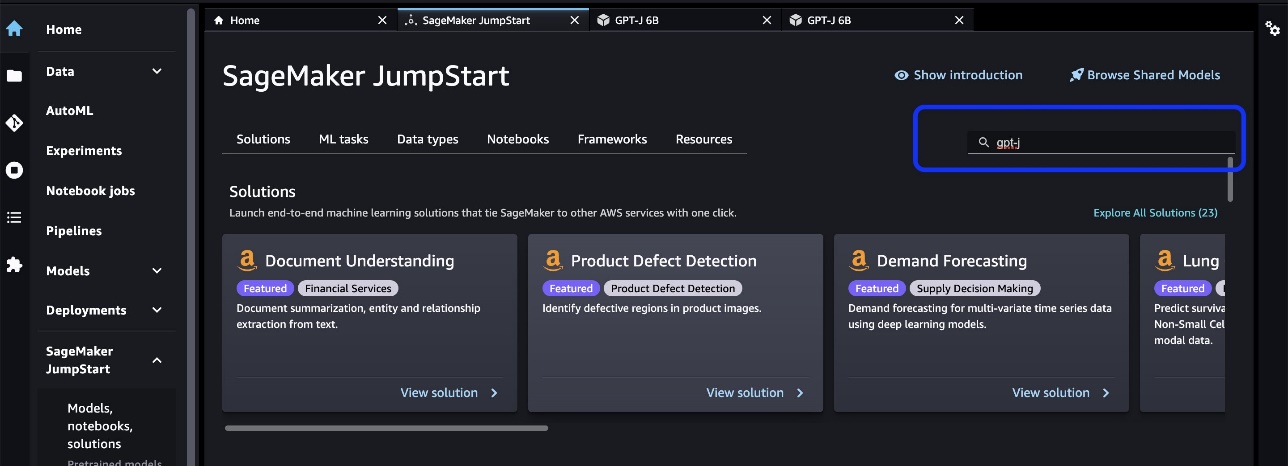

في شريط البحث ، ابحث عن النموذج الذي تريد ضبطه ونشره.

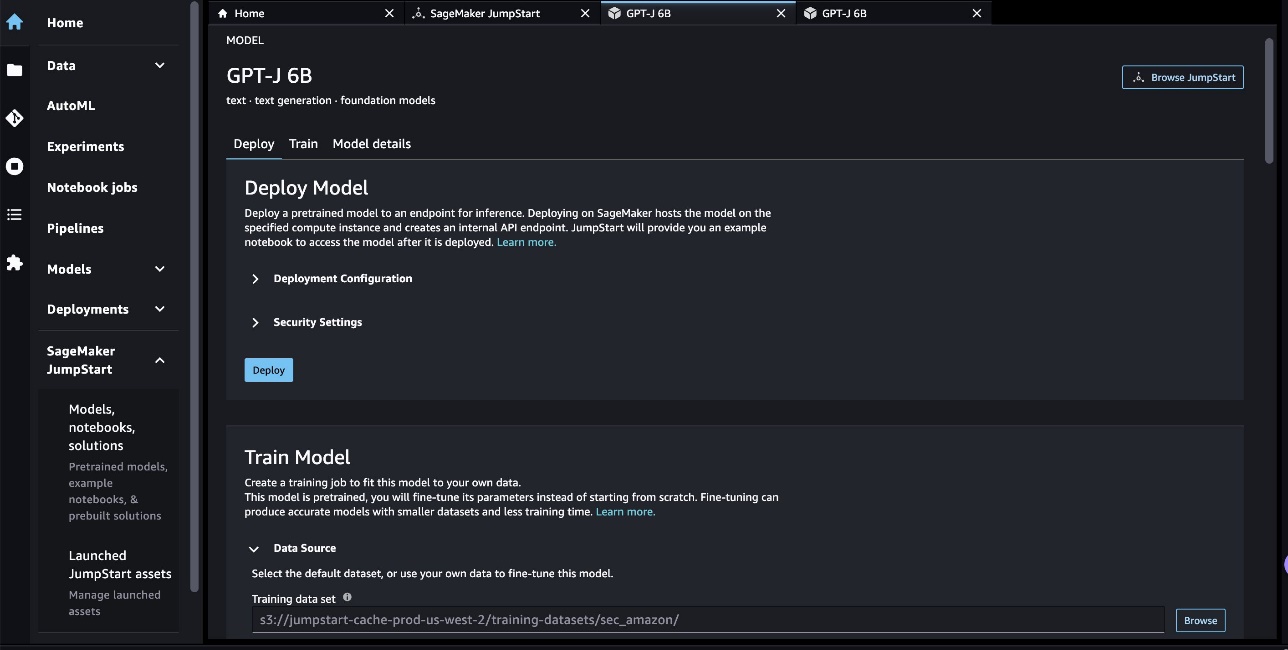

في حالتنا ، اخترنا بطاقة طراز GPT-J 6B. هنا يمكننا ضبط أو نشر LLM مباشرة.

تقييم النموذج

عند تقييم LLM ، يمكننا استخدام الحيرة (PPL). PPL هو مقياس شائع لمدى قدرة نموذج اللغة على التنبؤ بالكلمة التالية في تسلسل. بعبارات أبسط ، إنها طريقة لقياس مدى قدرة النموذج على فهم وتوليد لغة شبيهة بالبشر.

تعني درجة الارتباك الأقل أن النموذج يظهر أداءً أفضل في التنبؤ بالكلمة التالية. من الناحية العملية ، يمكننا استخدام الحيرة لمقارنة النماذج اللغوية المختلفة وتحديد أي منها يؤدي بشكل أفضل في مهمة معينة. يمكننا أيضًا استخدامه لتتبع أداء نموذج واحد بمرور الوقت. لمزيد من التفاصيل ، يرجى الرجوع إلى حيرة النماذج ذات الطول الثابت.

نقوم بتقييم أداء النموذج من خلال مقارنة أداءه قبل الضبط وبعده. تنبعث PPL في وظيفة التدريب الأمازون CloudWatch السجلات. بالإضافة إلى ذلك ، ننظر إلى المخرجات الناتجة عن النموذج استجابةً لمطالبات اختبار محددة.

| مقياس التقييم على بيانات التحقق من الصحة | قبل الصقل | بعد الصقل |

| الحيرة (PPL) | 8.147 | 1.437 |

يتم توضيح الأداء المحسن للنموذج من خلال تجربتين:

- جيل النص - نظهر أن الإخراج GPT-J الذي تم ضبطه بدقة يولد نصًا يشبه مجموعة بيانات SEC ، مما يشير إلى أنها تعلمت محاكاة أنماط اللغة واتفاقيات المجال التنظيمي المالي

- التعلم من الصفر - لقد أوضحنا أن GPT-J الذي تم ضبطه بدقة يُظهر أداءً أفضل بكثير من أداء GPT-J غير المضبوط بدقة في الإجابة على الأسئلة بدون طلقة

بالنسبة لتجربة إنشاء النص ، نستخدم معلمات الاستدلال التالية لتحقيق نتائجنا: max_length 400 (عدد الرموز التي تم إرجاعها) ، num_return_sequences من 1 (عدد أمثلة نص الاستجابة) ، top_k من 250 (اختر واحدة من أفضل 250 استمرارًا ممكنًا) ، top_p من 0.8 (حدد فقط من عمليات المتابعة التي تكون محتملة بنسبة 80٪ على الأقل) ، do_sample is True (أخذ العينات) ، و temperature من 1 (درجة الحرارة المرتفعة هي أكبر عشوائية في الردود). لمزيد من التفاصيل حول المعلمات ، يرجى الرجوع إلى تكوين الجيل. يقارن الجدول التالي GPT-J الذي تم ضبطه بدقة والأخرى غير المضبوطة في مهمة إكمال النص.

| مثال الاستدلال | الإخراج من GPT-J 6B قبل الضبط الدقيق | الإخراج من GPT-J 6B بعد الضبط الدقيق |

| يوضح هذا التقرير النموذجي 10-K ذلك |

يوضح تقرير النموذج 10-K ما يلي: بلغ صافي دخل الشركة المنسوب إلى الشركة للسنة المنتهية في 31 ديسمبر 2016 ما قيمته 3,923,000،0.21،3,818,000 دولار أمريكي ، أو 0.21 دولار أمريكي للسهم المخفف ، مقارنة بـ 31،2015،XNUMX دولار أمريكي ، أو XNUMX دولار أمريكي لكل سهم مخفف ، للسنة المنتهية في XNUMX ديسمبر XNUMX. بلغ صافي دخل الشركة المنسوب إلى الشركة للسنة المنتهية في 31 ديسمبر 2016 ما قيمته 4,816,000،0.28،4,726,000 دولار أمريكي ، أو 0.27 دولار أمريكي للسهم المخفف ، مقارنة بـ 31،2015،XNUMX دولار أمريكي ، أو XNUMX دولار أمريكي لكل سهم مخفف ، للسنة المنتهية في XNUMX ديسمبر XNUMX. بلغ صافي دخل الشركة المنسوب إلى الشركة للسنة المنتهية في 31 ديسمبر 2016 ما قيمته 5,828,000،0.34،5,716,000 دولار أمريكي ، أو 0.33 دولار أمريكي للسهم المخفف ، مقارنة بـ 31،2015،XNUMX دولار أمريكي ، أو XNUMX دولار أمريكي لكل سهم مخفف ، للسنة المنتهية في XNUMX ديسمبر XNUMX. في 21 أغسطس 2009 ، قدمت الشركة نموذج 10-Q للربع المنتهي في 31 ديسمبر 2008. في 21 أغسطس 2009 ، قدمت الشركة نموذج 10-Q للربع المنتهي في 30 سبتمبر 2008. في 21 أغسطس 2009 ، قدمت الشركة نموذج 10-Q للربع المنتهي في 31 مارس 2009. |

يوضح تقرير النموذج 10-K ما يلي: (1) اسم المسجل وعنوانه ورقم هاتفه كما يلي: Amazon.com، Inc. c / o Ernst & Young LLPSeattle، Washington انتباه: سكرتير الشركة (2) بالنسبة إلى الغرض من المادة الثالثة من قانون الأوراق المالية لعام 1934 ، يكون اسم وعنوان المسجل كما يلي: (3) الفترة الزمنية التي يتم الإبلاغ عنها بموجب قانون الصرف الخاص بالمسجل تبدأ من 1 يناير 2020 إلى الوقت الحاضر. [4) التقييم الشخصي للمسجل هو أن البيانات المالية والمعلومات المالية الأخرى الواردة في هذا التقرير ، ممثلة إلى حد ما من جميع النواحي الجوهرية للوضع المالي ونتائج العمليات والتدفقات النقدية للمسجل اعتبارًا من وللفترات المعروضة في هذا التقرير. [5) إدارة المسجل التقييم هو أن البيانات المالية والمعلومات المالية الأخرى الواردة في هذا التقرير ، ممثلة إلى حد ما من جميع النواحي الجوهرية للوضع المالي ونتائج العمليات والتدفقات النقدية لصاحب التسجيل اعتبارًا من ، وللفترات المعروضة في هذا التقرير. / s / Ernst & Young LLPSeattle ، واشنطن يناير 29 ، 2020EX-31.1 5 amzn-20201231xex311.htm EX-31.1 DocumentExhibit 31.1CERTIFICATIONSI ، Andrew R. Jassy ، تشهد بما يلي: 1. لقد راجعت هذا النموذج 10-K من Amazon.com، Inc. ؛ 2. بناءً على معلوماتي ، لا يحتوي هذا التقرير على أي بيان غير صحيح لحقيقة مادية أو حذف لتوضيح حقيقة مادية ضرورية لإثبات صحة البيانات المقدمة ، في ضوء الظروف التي تم فيها تقديم هذه البيانات ، غير مضللة فيما يتعلق بالفترة التي يغطيها هذا تقرير؛ |

| نحن نخدم المستهلكين من خلال |

نخدم المستهلكين من خلال: المدونة هل أنت صاحب عمل تتطلع إلى تنمية أعمالك؟ هل تريد إنشاء عمل أكثر فعالية وكفاءة؟ هل تريد أن تتعلم كيف تنمي عملك؟ إذا أجبت بـ "نعم" على أي من هذه الأسئلة ، فأنت بحاجة إلى قراءة هذا المقال. الخطوة الأولى لتنمية عملك هي فهم عملك. يجب أن تكون قادرًا على الإجابة على الأسئلة التالية حول عملك: من هم زبائنك؟ ماهو منتجك او خدمتك؟ ما هو عرض البيع الفريد الخاص بك؟ ما هي استراتيجيتك التسويقية؟ ما هي توقعات مبيعاتك؟ ما هي توقعات مبيعاتك؟ ما هي توقعات مبيعاتك؟ ما هي توقعات مبيعاتك؟ ما هي توقعات مبيعاتك؟ |

نحن نخدم المستهلكين من خلال: Amazon.com ، بائع تجزئة للمنتجات المادية والرقمية ؛ Amazon Web Services ، التي توفر خدمات البنية التحتية التكنولوجية التي تتيح فعليًا أي نوع من الأعمال ؛ Amazon Enterprise Solutions ، التي تزود الشركات بتكنولوجيا وخدمات مخصصة لتمكين عمليات تجارية أفضل وتحسين الكفاءة والإنتاجية ؛ و Audible ، ناشر كتاب صوتي رقمي. نحن نخدم المطورين والمؤسسات من جميع الأحجام من خلال AWS ، والتي تقدم مجموعة واسعة من عروض خدمات الحوسبة والتخزين وقواعد البيانات العالمية وغيرها من عروض الخدمات. نقوم أيضًا بتصنيع وبيع الأجهزة الإلكترونية. لقد نظمنا عملياتنا في قسمين رئيسيين: أمريكا الشمالية والدولي. انظر البند 8 من الجزء الثاني ، "" البيانات المالية والبيانات التكميلية - الملاحظة 12 - المعلومات القطاعية. "انظر البند 7 من الجزء الثاني ،" "مناقشة الإدارة وتحليلها للوضع المالي ونتائج العمليات - نتائج العمليات - المعلومات التكميلية" "للحصول على معلومات تكميلية حول صافي مبيعاتنا. العملاء نحن نخدم المستهلكين من خلال متاجرنا عبر الإنترنت والمادية ونركز على الاختيار والسعر والملاءمة. نصمم متاجرنا للسماح ببيع مئات الملايين من المنتجات الفريدة من قبلنا ومن قبل أطراف ثالثة عبر عشرات من فئات المنتجات. يصل العملاء إلى عروضنا من خلال مواقعنا الإلكترونية وتطبيقات الأجهزة المحمولة و Alexa وزيارة متاجرنا فعليًا. نقوم أيضًا بتصنيع وبيع أجهزة Kindledevices. نحن نسعى جاهدين لنقدم لعملائنا أقل الأسعار الممكنة من خلال عروض أسعار وشحن المنتجات اليومية المنخفضة ، ولتحسين كفاءاتنا التشغيلية حتى نتمكن من الاستمرار في خفض الأسعار لعملائنا. نقدم أيضًا وظائف سهلة الاستخدام ، وملء سريع وموثوق به ، وخدمة عملاء في الوقت المناسب. بالإضافة إلى ذلك ، نقدم Amazon Prime ، وهو برنامج عضوية يتضمن شحنًا مجانيًا غير محدود لأكثر من 100 مليون عنصر ، والوصول إلى تدفق غير محدود لعشرات الآلاف من الأفلام و حلقات تلفزيونية ومزايا أخرى. |

| هذا العام نركز بشكل خاص على |

نركز هذا العام بشكل خاص على: دور نظام الرعاية الصحية في الوقاية من السمنة ومرض السكري دور نظام الرعاية الصحية في الوقاية من السمنة ومرض السكري دور نظام الرعاية الصحية في الوقاية من السمنة ومرض السكري دور نظام الرعاية الصحية في الوقاية من السمنة ومرض السكري دور نظام الرعاية الصحية في الوقاية من السمنة ومرض السكري دور نظام الرعاية الصحية في الوقاية من السمنة ومرض السكري دور نظام الرعاية الصحية في الوقاية من السمنة ومرض السكري |

نركز هذا العام بشكل خاص على: - التوسع الدولي المستمر ، بما في ذلك تطوير الأعمال التجارية الجديدة في قطاعات السوق الدولية الحالية ، وكذلك تطوير قطاعات السوق الدولية الجديدة. - توسيع قاعدة عملائنا ، بما في ذلك زيادة المبيعات للعملاء الحاليين وجذب عملاء جدد ؛ - تطوير فرص عمل جديدة والدخول في اتفاقيات تجارية ، بما في ذلك من خلال الترخيص والترتيبات الأخرى ، مع شركات أخرى ، أو من خلال الاستحواذ على شركات أخرى ؛ -تطوير التكنولوجيا التي توفر خدمة عملاء محسنة وتقدم منتجاتنا وخدماتنا بكفاءة ؛ - تطوير عروض المنتجات والخدمات الجديدة ودمجها في عروض المنتجات والخدمات الحالية والجديدة ؛ - تطوير أنظمة كفؤة وفعالة لدعم أعمالنا ؛ و - مبادرات تجارية واستراتيجية أخرى. نعتقد أن تقديم أسعار منخفضة لعملائنا هو أمر أساسي لنجاحنا في المستقبل. إحدى الطرق التي نقدم بها أسعارًا أقل هي من خلال عروض الشحن المجاني التي تؤدي إلى تكلفة صافية لنا في توصيل المنتجات ، ومن خلال العضوية في Amazon Prime ، التي توفر شحنًا مجانيًا لملايين العناصر والوصول إلى الأفلام والمحتويات الأخرى. نقدم أيضًا عروضًا ترويجية أخرى تمكننا من تحويل صافي تكلفة مبيعات أقل ، وقد نظمنا عملياتنا في قسمين رئيسيين: أمريكا الشمالية والقطاع الدولي. انظر البند 8 من الجزء الثاني ، "" الكشوف المالية والبيانات التكميلية - الملاحظة 12 - المعلومات القطاعية "." انظر البند 7 من الجزء الثاني ، "مناقشة الإدارة وتحليلها للوضع المالي ونتائج العمليات - نتائج العمليات - المعلومات التكميلية" للحصول على معلومات تكميلية حول صافي مبيعاتنا. العملاء نحن نخدم المستهلكين من خلال مواقع البيع بالتجزئة والمتاجر الفعلية والتركيز على الاختيار والسعر والملاءمة. |

بالنسبة للتجربة الثانية بمهمة الإجابة على سؤال بدون طلقة ، قمنا بتعيين max_length أن تكون قيمة مختلفة (40 و 200 و 40 على التوالي) بناءً على المخرجات التي نتوقعها من كل سؤال. معلمات top_k, top_p, do_sample, temperature يتم تعيينها على 250 ، 0.8 ، Falseو 0 على التوالي. قمنا بتعيين درجة حرارة قريبة من 0 للتحكم في عشوائية الإخراج ، بينما في مهمة إنشاء النص ، قمنا بتعيينها بالقرب من 1 لجعل النموذج أكثر إبداعًا. الجدول التالي يقارن النتائج. لكل سؤال ، يكون الإخراج من GPT-J المضبوط بدقة أكثر دقة من غير المضبوط.

| إدخال | الإخراج من GPT-J 6B قبل الضبط الدقيق | الإخراج من GPT-J 6B بعد الضبط الدقيق |

| ما هو البند 7 من ملف 10-K SEC ؟: |

ما هو البند 7 من ملف 10-K SEC ؟: البند 7 من ملف 10-K SEC هو ما يلي: "لم تتلق الشركة أي سلبيات جوهرية |

البند 7. مناقشة الإدارة وتحليلها للوضع المالي ونتائج العمليات البيانات التطلعية |

| كيف أثر جائحة COVID-19 على أعمال أمازون؟: |

كيف أثر جائحة COVID-19 على أعمال أمازون؟: تتأثر أعمال أمازون بسبب جائحة COVID-19 بعدة طرق. تشهد الشركة انخفاضًا في عدد عضوية Prime ، وهو جزء كبير من أعمالها. تشهد الشركة أيضًا انخفاضًا في عدد عضوية Prime. تشهد أمازون أيضًا انخفاضًا في عدد الطلبات المقدمة على موقعها على الإنترنت. تشهد الشركة أيضًا انخفاضًا في عدد الأشخاص الذين يتسوقون على موقعها على الإنترنت. تشهد أمازون أيضًا انخفاضًا في عدد الأشخاص الذين يتسوقون على موقعها على الإنترنت. تشهد أمازون أيضًا انخفاضًا في عدد الأشخاص الذين يتسوقون على موقعها على الإنترنت. تشهد أمازون أيضًا انخفاضًا في عدد الأشخاص الذين يتسوقون على موقعها على الإنترنت. تشهد أمازون أيضًا انخفاضًا في عدد الأشخاص الذين يتسوقون |

كيف أثر جائحة COVID-19 على أعمال أمازون؟: أثر جائحة COVID-19 على أعمالنا بعدة طرق. أولاً ، لقد عطلت سلسلة التوريد لدينا ، وأثرت على طلب العملاء ، مما أثر بدوره على مبيعاتنا ونتائج التشغيل. ثانيًا ، لقد زاد من إنفاقنا على الإعلان والتسويق ، وهو ما قد لا يكون فعالًا على المدى الطويل. ثالثًا ، زاد إنفاقنا على البنية التحتية للتكنولوجيا والقدرة على الحوسبة ، والتي قد لا تكون فعالة على المدى الطويل. رابعًا ، لقد زاد من إنفاقنا على الوفاء وخدمة العملاء ، والتي قد لا تكون فعالة على المدى الطويل. أخيرًا ، لقد زاد من إنفاقنا على المحتوى ، والذي قد لا يكون فعالًا على المدى الطويل. انظر البند 8 من الجزء الثاني ، "البيانات المالية والبيانات التكميلية - الملاحظة 1 - وصف سياسات الأعمال والمحاسبة. |

| ما الذي يدفع نمو المبيعات في أمازون ؟: | أمازون هو أكبر بائع تجزئة عبر الإنترنت في العالم. إنه أيضًا أكبر سوق عبر الإنترنت في العالم. إنه أيضًا العالم " | نمو المبيعات في أمازون مدفوع بشكل أساسي بزيادة استخدام العملاء ، بما في ذلك زيادة الاختيار ، وانخفاض الأسعار ، وزيادة الراحة ، وزيادة مبيعات البائعين الآخرين على مواقعنا الإلكترونية. |

تنظيف

لتجنب الرسوم المستمرة ، احذف نقاط نهاية الاستدلال من SageMaker. يمكنك حذف نقاط النهاية عبر وحدة تحكم SageMaker أو من دفتر الملاحظات باستخدام الأوامر التالية:

وفي الختام

JumpStart هي قدرة في SageMaker تسمح لك بالبدء بسرعة مع ML. يستخدم JumpStart نماذج مفتوحة المصدر ومدربة مسبقًا لحل مشكلات ML الشائعة مثل تصنيف الصور واكتشاف الكائنات وتصنيف النص وتصنيف أزواج الجملة والإجابة على الأسئلة.

في هذا المنشور ، أوضحنا لك كيفية ضبط ونشر LLM (GPT-J 6B) مُدرَّب مسبقًا لإنشاء نص استنادًا إلى مجموعة بيانات تعبئة SEC. لقد أوضحنا كيف تحول النموذج إلى خبير في المجال المالي من خلال خضوعه لعملية الضبط الدقيق في تقريرين سنويين للشركة. مكن هذا الضبط الدقيق النموذج من إنشاء محتوى مع فهم الموضوعات المالية ودقة أكبر. جرب الحل بنفسك وأخبرنا كيف تسير الأمور في التعليقات.

هام: هذا المنشور هو لأغراض توضيحية فقط. إنها ليست نصيحة مالية ولا ينبغي الاعتماد عليها كمشورة مالية أو استثمارية. تم تدريب النماذج المستخدمة مسبقًا مسبقًا على البيانات التي تم الحصول عليها من قاعدة بيانات SEC EDGAR. أنت مسؤول عن الامتثال لشروط وأحكام الوصول الخاصة بـ EDGAR إذا كنت تستخدم بيانات SEC.

لمعرفة المزيد حول JumpStart ، تحقق من المنشورات التالية:

حول المؤلف

الدكتور شين هوانغ هو عالم تطبيقي كبير في Amazon SageMaker JumpStart وخوارزميات Amazon SageMaker المدمجة. يركز على تطوير خوارزميات التعلم الآلي القابلة للتطوير. تتركز اهتماماته البحثية في مجال معالجة اللغة الطبيعية ، والتعلم العميق القابل للتفسير على البيانات المجدولة ، والتحليل القوي لتجميع الزمكان غير المعياري. وقد نشر العديد من الأوراق في مؤتمرات ACL و ICDM و KDD والجمعية الملكية للإحصاء: السلسلة أ.

الدكتور شين هوانغ هو عالم تطبيقي كبير في Amazon SageMaker JumpStart وخوارزميات Amazon SageMaker المدمجة. يركز على تطوير خوارزميات التعلم الآلي القابلة للتطوير. تتركز اهتماماته البحثية في مجال معالجة اللغة الطبيعية ، والتعلم العميق القابل للتفسير على البيانات المجدولة ، والتحليل القوي لتجميع الزمكان غير المعياري. وقد نشر العديد من الأوراق في مؤتمرات ACL و ICDM و KDD والجمعية الملكية للإحصاء: السلسلة أ.

مارك كارب هو مهندس ML مع فريق Amazon SageMaker Service. يركز على مساعدة العملاء في تصميم ونشر وإدارة أعباء عمل ML على نطاق واسع. في أوقات فراغه ، يستمتع بالسفر واستكشاف أماكن جديدة.

مارك كارب هو مهندس ML مع فريق Amazon SageMaker Service. يركز على مساعدة العملاء في تصميم ونشر وإدارة أعباء عمل ML على نطاق واسع. في أوقات فراغه ، يستمتع بالسفر واستكشاف أماكن جديدة.

د. سانجيف داس هو باحث في أمازون وأستاذ تيري للتمويل وعلوم البيانات في جامعة سانتا كلارا. وهو حاصل على درجات عليا في العلوم المالية (ماجستير ودكتوراه من جامعة نيويورك) وعلوم الكمبيوتر (ماجستير من جامعة كاليفورنيا في بيركلي) ، وماجستير في إدارة الأعمال من المعهد الهندي للإدارة ، أحمد آباد. قبل أن يصبح أكاديميًا ، عمل في مجال المشتقات في منطقة آسيا والمحيط الهادئ كنائب رئيس في Citibank. يعمل على التعلم الآلي متعدد الوسائط في مجال التطبيقات المالية.

د. سانجيف داس هو باحث في أمازون وأستاذ تيري للتمويل وعلوم البيانات في جامعة سانتا كلارا. وهو حاصل على درجات عليا في العلوم المالية (ماجستير ودكتوراه من جامعة نيويورك) وعلوم الكمبيوتر (ماجستير من جامعة كاليفورنيا في بيركلي) ، وماجستير في إدارة الأعمال من المعهد الهندي للإدارة ، أحمد آباد. قبل أن يصبح أكاديميًا ، عمل في مجال المشتقات في منطقة آسيا والمحيط الهادئ كنائب رئيس في Citibank. يعمل على التعلم الآلي متعدد الوسائط في مجال التطبيقات المالية.

آرون كومار لوكاناثا مهندس حلول ML مع فريق Amazon SageMaker Service. إنه يركز على مساعدة العملاء في بناء وتدريب وترحيل أعباء عمل إنتاج ML إلى SageMaker على نطاق واسع. وهو متخصص في التعلم العميق ، وخاصة في مجال البرمجة اللغوية العصبية والسيرة الذاتية. خارج العمل ، يستمتع بالركض والمشي لمسافات طويلة.

آرون كومار لوكاناثا مهندس حلول ML مع فريق Amazon SageMaker Service. إنه يركز على مساعدة العملاء في بناء وتدريب وترحيل أعباء عمل إنتاج ML إلى SageMaker على نطاق واسع. وهو متخصص في التعلم العميق ، وخاصة في مجال البرمجة اللغوية العصبية والسيرة الذاتية. خارج العمل ، يستمتع بالركض والمشي لمسافات طويلة.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- بلاتوبلوكشين. Web3 Metaverse Intelligence. تضخيم المعرفة. الوصول هنا.

- سك المستقبل مع أدرين أشلي. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/financial-text-generation-using-a-domain-adapted-fine-tuned-large-language-model-in-amazon-sagemaker-jumpstart/

- :لديها

- :يكون

- $3

- $ UP

- 000

- 1

- 100

- 11

- 2016

- 2020

- 28

- 7

- 8

- 9

- a

- القدرات

- ماهرون

- من نحن

- أكاديمي

- الوصول

- المحاسبة

- جمع

- دقة

- دقيق

- التأهيل

- استحواذ

- في

- عمل

- وأضاف

- الميزات المضافة

- إضافة

- وبالإضافة إلى ذلك

- العنوان

- دعاية

- نصيحة

- تؤثر

- بعد

- ضد

- AI

- اليكسا

- خوارزمية

- خوارزميات

- الكل

- يسمح

- بالرغم ان

- أمازون

- الأمازون SageMaker

- أمازون سيج ميكر جومب ستارت

- أمازون ويب سيرفيسز

- Amazon.com

- أمريكا

- المبالغ

- تحليل

- تحليل

- و

- أندرو

- سنوي

- آخر

- إجابة

- أي وقت

- أي شخص

- API

- التطبيقات

- تطبيقي

- نهج

- مناسب

- التطبيقات

- هي

- المنطقة

- البند

- AS

- التقييم المناسبين

- At

- اهتمام

- جذب

- أغسطس

- أوتوماتيك

- متاح

- AWS

- شريط

- قاعدة

- على أساس

- BE

- لان

- أصبح

- كان

- قبل

- يجري

- اعتقد

- الفوائد

- بيركلي

- أفضل

- كبير

- المليارات

- واسع

- نساعدك في بناء

- مدمج

- الأعمال

- by

- دعوة

- تسمى

- دعوات

- CAN

- يستطيع الحصول على

- قادر على

- الطاقة الإنتاجية

- فيزا وماستركارد

- يهمني

- حقيبة

- الحالات

- يشهد

- سلسلة

- التحديات

- قناة

- اسعارنا محددة من قبل وزارة العمل

- chatbots

- التحقق

- اختار

- اختار

- اختيار

- ظروف

- سيتي بنك

- كلارا

- تصنيف

- اغلاق

- المجموعات

- الكود

- عمود

- COM

- تعليقات

- مشترك

- عادة

- مجتمع

- الشركات

- حول الشركة

- الشركة

- قارن

- مقارنة

- مقارنة

- مقارنة

- إكمال

- إكمال

- إحصاء

- الكمبيوتر

- علوم الكمبيوتر

- الحوسبة

- القدرة الحاسوبية

- حالة

- الشروط

- المؤتمرات

- نظر

- نظرت

- كنسولات

- بناء

- المستهلكين

- تحتوي على

- وعاء

- يحتوي

- محتوى

- استمر

- مراقبة

- ضوابط

- ملاءمة

- منظمة

- المقابلة

- التكلفة

- مغطى

- يغطي

- كوفيد-19

- وباء COVID-19

- خلق

- الإبداع

- حرج

- حاليا

- على

- زبون

- خدمة العملاء

- العملاء

- البيانات

- علم البيانات

- قاعدة البيانات

- قواعد البيانات

- ديسمبر

- رفض

- عميق

- التعلم العميق

- الترتيب

- تقديم

- يسلم

- الطلب

- شرح

- تظاهر

- نشر

- نشر

- نشر

- المشتقات

- وصف

- وصف

- تصميم

- تصميم

- تفاصيل

- كشف

- حدد

- يحدد

- المطورين

- تطوير

- التطوير التجاري

- الأجهزة

- فعل

- مختلف

- صعبة

- رقمي

- مباشرة

- إفشاء

- بحث

- مناقشة

- وزعت

- التدريب الموزع

- عامل في حوض السفن

- وثائق

- نطاق

- عشرات

- مدفوع

- أثناء

- كل

- في وقت سابق

- بسهولة

- سهلة الاستخدام

- الطُرق الفعّالة

- الكفاءات

- كفاءة

- فعال

- إلكتروني

- تمكين

- تمكين

- نقطة النهاية

- تعزيز

- مشروع

- الشركات

- كامل

- كيان

- عهود

- ارنست ويونغ

- خاصة

- إنشاء

- تقييم

- تقييم

- تقييم

- كل يوم

- كل شىء

- مثال

- أمثلة

- إلا

- تبادل

- ممارسة

- القائمة

- توسع

- توقع

- توقع

- ذو تكلفة باهظة

- تجربة

- خبير

- استكشاف

- واسع

- الوجه

- FAST

- المميزات

- قليل

- حقل

- قم بتقديم

- إيداع

- أخيرا

- تمويل

- مالي

- نصيحة مالية

- معلومات مالية

- نهاية

- الاسم الأول

- تناسب

- تركز

- ويركز

- متابعيك

- متابعات

- في حالة

- للمستثمرين

- توقعات

- طليعة

- النموذج المرفق

- شكل

- تطلعي

- وجدت

- رابع

- تبدأ من

- بالإضافة إلى

- وظيفة

- أساسي

- إضافي

- مستقبل

- توليد

- ولدت

- يولد

- جيل

- دولار فقط واحصل على خصم XNUMX% على جميع

- معطى

- العالمية

- Go

- يذهب

- الذهاب

- خير

- وحدات معالجة الرسومات

- التدرجات

- أكبر

- أرض

- النمو

- متزايد

- التسويق

- أجهزة التبخير

- يملك

- he

- صحة الإنسان

- الرعاية الصحية

- مساعدة

- يساعد

- هنا

- مرتفع

- أداء عالي

- يحمل

- غطاء محرك السيارة

- مضيف

- استضافت

- كيفية

- كيفية

- HTML

- HTTP

- HTTPS

- تعانق الوجه

- مئات

- مئات الملايين

- تحسين Hyperparameter

- i

- فكرة

- محدد

- صورة

- تصنيف الصورة

- التأثير

- أثر

- استيراد

- مثير للإعجاب

- تحسن

- تحسين

- in

- Inc.

- تتضمن

- شامل

- يشمل

- بما فيه

- دخل

- دمج

- القيمة الاسمية

- زيادة

- في ازدياد

- لا يصدق

- هندي

- معلومات

- البنية التحتية

- المبادرات

- إدخال

- مثل

- بدلًا من ذلك

- معهد

- دمج

- تفاعل

- السريرية

- عالميا

- تقديم

- استثمار

- Investopedia

- مستثمر

- المستثمرين

- IT

- العناصر

- انها

- وظيفة

- JPG

- جسون

- القفل

- علم

- المعرفة

- معروف

- ملصقات

- لغة

- اللغات

- كبير

- أكبر

- إطلاق

- تعلم

- تعلم

- تعلم

- المكتبة

- الترخيص

- ضوء

- مثل

- قائمة

- LLM

- طويل

- بحث

- أبحث

- خسارة

- منخفض

- أسعار منخفضة

- آلة

- آلة التعلم

- صنع

- رائد

- جعل

- القيام ب

- إدارة

- إدارة

- يدويا

- كثير

- مارس

- تجارة

- التسويق

- السوق

- هائل

- مادة

- مايو..

- يعني

- قياس

- عضوية

- عضوية

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- طريقة

- متري

- الهجرة

- مليون

- ملايين

- دقيقة

- مختلط

- ML

- الجوال

- تطبيقات الموبايل

- نموذج

- عارضات ازياء

- الأكثر من ذلك

- أكثر

- أفلام

- MS

- متعدد

- الاسم

- عين

- طبيعي

- معالجة اللغات الطبيعية

- قائمة الإختيارات

- ضروري

- حاجة

- صاف

- جديد

- منتج جديد

- نيويورك

- التالي

- البرمجة اللغوية العصبية

- العقدة

- شمال

- امريكا الشمالية

- مفكرة

- عدد

- • السمنة .

- موضوع

- كشف الكائن

- تحصل

- تم الحصول عليها

- of

- عرض

- الوهب

- عروض

- عروض

- on

- ONE

- جارية

- online

- السوق عبر الإنترنت

- بائع المفرق على الإنترنت

- المصدر المفتوح

- تعمل

- عمليات

- الفرص

- التحسين

- طلب

- الطلبات

- منظم

- أصلي

- أخرى

- لنا

- بريد اوتلوك

- الناتج

- في الخارج

- على مدى

- تجاوز

- نظرة عامة

- الخاصة

- كاتوا ديلز

- وباء

- خبز

- أوراق

- المعلمات

- جزء

- خاص

- خاصة

- الأحزاب

- pass

- مرت

- مرور

- مسار

- أنماط

- مجتمع

- نفذ

- أداء

- أداء

- ينفذ

- فترة

- فترات

- PHIL

- مادي

- جسديا

- اختيار

- وجهات

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- سياسات الخصوصية والبيع

- ممكن

- منشور

- المنشورات

- محتمل

- قوة

- عملية

- دقة

- تنبأ

- توقع

- تنبؤات

- متنبئ

- يقدم

- قدم

- رئيس

- منع

- الوقاية

- سابق

- السعر

- الأسعار

- التسعير

- في المقام الأول

- رئيسي

- رئيسي

- قبل

- مشاكل

- عملية المعالجة

- العمليات

- معالجة

- المنتج

- الإنتــاج

- إنتاجية

- المنتجات

- البروفيسور

- البرنامج

- العروض

- اقتراح

- تزود

- المقدمة

- ويوفر

- علانية

- نشرت

- الناشر

- غرض

- أغراض

- بايثون

- ربع

- سؤال

- الأسئلة المتكررة

- بسرعة

- العشوائية

- معدل

- عرض

- حقيقي

- تلقى

- تخفيض

- يشير

- بخصوص

- رجإكس

- منطقة

- اللائحة

- المنظمين

- ذات صلة

- صدر

- تقرير

- التقارير

- مطلوب

- يتطلب

- بحث

- الموارد

- احترام

- استجابة

- مسؤول

- نتيجة

- النتائج

- بيع بالتجزئة

- متاجر التجزئة

- استعرض

- ثور

- قوي

- النوع

- ملكي

- يجري

- تشغيل

- sagemaker

- الاستدلال SageMaker

- الأملاح

- نفسه

- سانتا

- تحجيم

- حجم

- علوم

- عالم

- أحرز هدفاً

- الإستراحة

- بحث

- ثانية

- سيك الإيداع

- الثاني

- سكرتير

- القسم

- أقسام

- ضمانات

- رؤية

- شرائح

- مختار

- اختيار

- بيع

- الباعة

- بيع

- كبير

- عقوبة

- عاطفة

- سبتمبر

- تسلسل

- مسلسلات

- السلسلة أ

- خدمة

- الخدمة

- خدماتنا

- طقم

- ضبط

- إعدادات

- عدة

- مشاركة

- الشحن

- التسوق والترفيه

- ينبغي

- إظهار

- أظهرت

- يظهر

- بشكل ملحوظ

- الاشارات

- عزباء

- المقاس

- الأحجام

- الأصغر

- So

- جاليات

- باعت

- حل

- الحلول

- حل

- مصادر

- المتخصصين

- متخصص

- تتخصص

- محدد

- الإنفاق

- بداية

- بدأت

- الولايه او المحافظه

- البيانات

- إحصائي

- خطوة

- خطوات

- تخزين

- فروعنا

- إستراتيجي

- الإستراتيجيات

- متدفق

- قوة

- السعي

- ستوديو

- تحقيق النجاح

- هذه

- تزويد

- سلسلة التوريد

- مدعومة

- دعم

- الدعم

- نظام

- أنظمة

- جدول

- أخذ

- مع الأخذ

- مهمة

- المهام

- فريق

- تكنولوجيا

- سياسة الحجب وتقييد الوصول

- الشروط والأحكام

- تجربه بالعربي

- تصنيف النص

- أن

- •

- المنطقة

- المستقبل

- من مشاركة

- منهم

- وبالتالي

- تشبه

- الأشياء

- الثالث

- طرف ثالث

- ثلاثة

- عبر

- الوقت

- استهلاك الوقت

- مرات

- إلى

- الرموز

- تيشرت

- المواضيع

- مسار

- قطار

- متدرب

- قادة الإيمان

- نقل

- تحول

- ترجمه

- السفر

- حقيقة

- منعطف أو دور

- tv

- ui

- مع

- فهم

- فهم

- فريد من نوعه

- جامعة

- غير محدود

- آخر التحديثات

- us

- الأستعمال

- تستخدم

- مستعمل

- عادة

- تستخدم

- استخدام

- التحقق من صحة

- قيمنا

- القيم

- مختلف

- الإصدار

- بواسطة

- Vice President

- عمليا

- واشنطن

- طريق..

- طرق

- الويب

- خدمات ويب

- الموقع الإلكتروني

- المواقع

- حسن

- سواء

- التي

- من الذى

- سوف

- مع

- بدون

- كلمة

- للعمل

- عمل

- أعمال

- العالم

- سوف

- عام

- سنوات

- أنت

- شاب

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت