I dette indlæg viser vi, hvordan du konfigurerer en ny OAuth-baseret godkendelsesfunktion til brug Snowflake in Amazon SageMaker Data Wrangler. Snowflake er en cloud-dataplatform, der leverer dataløsninger til data warehousing til datavidenskab. Snowflake er en AWS partner med flere AWS-akkrediteringer, herunder AWS-kompetencer inden for machine learning (ML), detailhandel og data og analyser.

Data Wrangler forenkler dataforberedelsen og funktionskonstruktionsprocessen og reducerer den tid, det tager fra uger til minutter, ved at tilbyde en enkelt visuel grænseflade til dataforskere til at udvælge og rense data, oprette funktioner og automatisere dataforberedelse i ML-arbejdsgange uden at skrive nogen kode. Du kan importere data fra flere datakilder, som f.eks Amazon Simple Storage Service (Amazon S3), Amazonas Athena, Amazon rødforskydning, Amazon EMR, og Snefnug. Med denne nye funktion kan du bruge din egen identitetsudbyder (IdP) som f.eks Okta, Azure AD eller Ping Federate for at oprette forbindelse til Snowflake via Data Wrangler.

Løsningsoversigt

I de følgende afsnit giver vi en administrator trin til at konfigurere IdP, Snowflake og Studio. Vi beskriver også de trin, som dataforskere kan tage for at konfigurere datastrømmen, analysere datakvaliteten og tilføje datatransformationer. Til sidst viser vi hvordan man eksporterer dataflowet og træner en model vha SageMaker Autopilot.

Forudsætninger

For denne gennemgang skal du have følgende forudsætninger:

- Til admin:

- En Snowflake-bruger med tilladelser til at oprette lagerintegrationer og sikkerhedsintegrationer i Snowflake.

- En AWS-konto med tilladelser til at oprette AWS identitets- og adgangsstyring (IAM) politikker og roller.

- Adgang og tilladelser til at konfigurere IDP til at registrere Data Wrangler-applikationen og opsætte autorisationsserveren eller API.

- Til dataforsker:

Administrator opsætning

I stedet for at få dine brugere til at indtaste deres Snowflake-legitimationsoplysninger direkte i Data Wrangler, kan du få dem til at bruge en IdP til at få adgang til Snowflake.

Følgende trin er involveret for at aktivere Data Wrangler OAuth-adgang til Snowflake:

- Konfigurer IdP.

- Konfigurer Snowflake.

- Konfigurer SageMaker Studio.

Konfigurer IdP

For at konfigurere din IdP skal du registrere Data Wrangler-applikationen og konfigurere din autorisationsserver eller API.

Registrer Data Wrangler-applikationen i IdP

Se følgende dokumentation for de IdP'er, som Data Wrangler understøtter:

Brug dokumentationen fra din IdP til at registrere din Data Wrangler-applikation. Oplysningerne og procedurerne i dette afsnit hjælper dig med at forstå, hvordan du bruger dokumentationen fra din IdP korrekt.

Specifikke tilpasninger ud over trinene i de respektive vejledninger er kaldt ud i underafsnittene.

- Vælg den konfiguration, der starter processen med at registrere Data Wrangler som en applikation.

- Giv brugerne i IdP adgang til Data Wrangler.

- Aktiver OAuth-klientgodkendelse ved at gemme klientlegitimationsoplysningerne som en Secrets Manager-hemmelighed.

- Angiv en omdirigerings-URL ved hjælp af følgende format:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Du angiver SageMaker-domæne-id'et og AWS-regionen, som du bruger til at køre Data Wrangler. Du skal registrere en URL for hvert domæne og område, hvor du kører Data Wrangler. Brugere fra et domæne og en region, der ikke har konfigureret omdirigerings-URL'er til dem, vil ikke være i stand til at godkende med IdP'et for at få adgang til Snowflake-forbindelsen.

- Sørg for, at autorisationskoden og opdateringstokenbevillingstyperne er tilladt for din Data Wrangler-applikation.

Konfigurer autorisationsserveren eller API'et i IdP'et

Inden for dit IdP skal du konfigurere en autorisationsserver eller en applikationsprogrammeringsgrænseflade (API). For hver bruger sender autorisationsserveren eller API'en tokens til Data Wrangler med Snowflake som publikum.

Snowflake bruger begrebet roller der adskiller sig fra IAM-roller, der bruges i AWS. Du skal konfigurere IdP'et til at bruge ENHVER rolle for at bruge standardrollen, der er knyttet til Snowflake-kontoen. For eksempel hvis en bruger har systems administrator som standardrolle i deres Snowflake-profil, bruger forbindelsen fra Data Wrangler til Snowflake systems administrator som rollen.

Brug følgende procedure til at konfigurere godkendelsesserveren eller API'en i din IdP:

- Start processen med at konfigurere serveren eller API'en fra din IdP.

- Konfigurer autorisationsserveren til at bruge autorisationskoden og opdatere token-tildelingstyper.

- Angiv levetiden for adgangstokenet.

- Indstil opdateringstokenets inaktive timeout.

Inaktiv timeout er den tid, hvor opdateringstokenet udløber, hvis det ikke bruges. Hvis du planlægger job i Data Wrangler, anbefaler vi at gøre den inaktive timeout-tid længere end frekvensen af behandlingsjobbet. Ellers kan nogle behandlingsjob mislykkes, fordi opdateringstokenet udløb, før de kunne køre. Når opdateringstokenet udløber, skal brugeren autentificere igen ved at få adgang til forbindelsen, som de har oprettet til Snowflake gennem Data Wrangler.

Bemærk, at Data Wrangler ikke understøtter roterende opdateringstokens. Brug af roterende opdateringstokens kan resultere i adgangsfejl eller brugere, der skal logge ind ofte.

Hvis opdateringstokenet udløber, skal dine brugere genautentificere ved at få adgang til den forbindelse, de har oprettet til Snowflake gennem Data Wrangler.

- Angiv

session:role-anysom det nye anvendelsesområde.

For Azure AD skal du også angive en unik identifikator for omfanget.

Når du har konfigureret OAuth-udbyderen, giver du Data Wrangler de oplysninger, den skal bruge for at oprette forbindelse til udbyderen. Du kan bruge dokumentationen fra din IdP til at få værdier for følgende felter:

- Token URL – URL'en på det token, som IdP'en sender til Data Wrangler

- Autorisations-URL – URL'en på IdP'ens autorisationsserver

- kunde-id – ID for IdP

- Klienthemmelighed – Hemmeligheden, som kun godkendelsesserveren eller API'en genkender

- OAuth-omfang – Dette er kun til Azure AD

Konfigurer Snowflake

For at konfigurere Snowflake skal du udfylde instruktionerne i Importer data fra Snowflake.

Brug Snowflake-dokumentationen til din IdP til at konfigurere en ekstern OAuth-integration i Snowflake. Se forrige afsnit Registrer Data Wrangler-applikationen i IdP for mere information om, hvordan du opsætter en ekstern OAuth-integration.

Når du opsætter sikkerhedsintegrationen i Snowflake, skal du sørge for at aktivere external_oauth_any_role_mode.

Konfigurer SageMaker Studio

Du gemmer felterne og værdierne i en Secrets Manager-hemmelighed og tilføjer den til Studio Lifecycle Configuration, som du bruger til Data Wrangler. En livscykluskonfiguration er et shell-script, der automatisk indlæser de legitimationsoplysninger, der er gemt i hemmeligheden, når brugeren logger på Studio. For information om at skabe hemmeligheder, se Flyt hårdkodede hemmeligheder til AWS Secrets Manager. For oplysninger om brug af livscykluskonfigurationer i Studio, se Brug livscykluskonfigurationer med Amazon SageMaker Studio.

Skab en hemmelighed for Snowflake-legitimationsoplysninger

For at skabe din hemmelighed til Snowflake-legitimationsoplysninger skal du udføre følgende trin:

- På Secrets Manager-konsollen skal du vælge Gem en ny hemmelighed.

- Til Hemmelig type, Vælg Anden type hemmelighed.

- Angiv detaljerne om din hemmelighed som nøgle-værdi-par.

Nøglenavne kræver små bogstaver på grund af følsomhed mellem store og små bogstaver. Data Wrangler giver en advarsel, hvis du indtaster nogle af disse forkert. Indtast de hemmelige værdier som nøgle-værdi-par Nøgle/værdi, hvis du vil, eller brug Simpel tekst valgmulighed.

Følgende er formatet på hemmeligheden, der bruges til Okta. Hvis du bruger Azure AD, skal du tilføje datasource_oauth_scope felt.

- Opdater de foregående værdier med dit valg af IdP og oplysninger indsamlet efter ansøgningsregistrering.

- Vælg Næste.

- Til Hemmeligt navn, tilføj præfikset

AmazonSageMaker(for eksempel er vores hemmelighedAmazonSageMaker-DataWranglerSnowflakeCreds). - I Tags sektion, tilføje et tag med nøglen

SageMakerog værditrue. - Vælg Næste.

- Resten af felterne er valgfrie; vælge Næste indtil du har mulighed for at vælge Butik at gemme hemmeligheden.

Når du har gemt hemmeligheden, vender du tilbage til Secrets Manager-konsollen.

- Vælg den hemmelighed, du lige har oprettet, og hent derefter det hemmelige ARN.

- Gem dette i din foretrukne teksteditor til brug senere, når du opretter Data Wrangler-datakilden.

Opret en Studio-livscykluskonfiguration

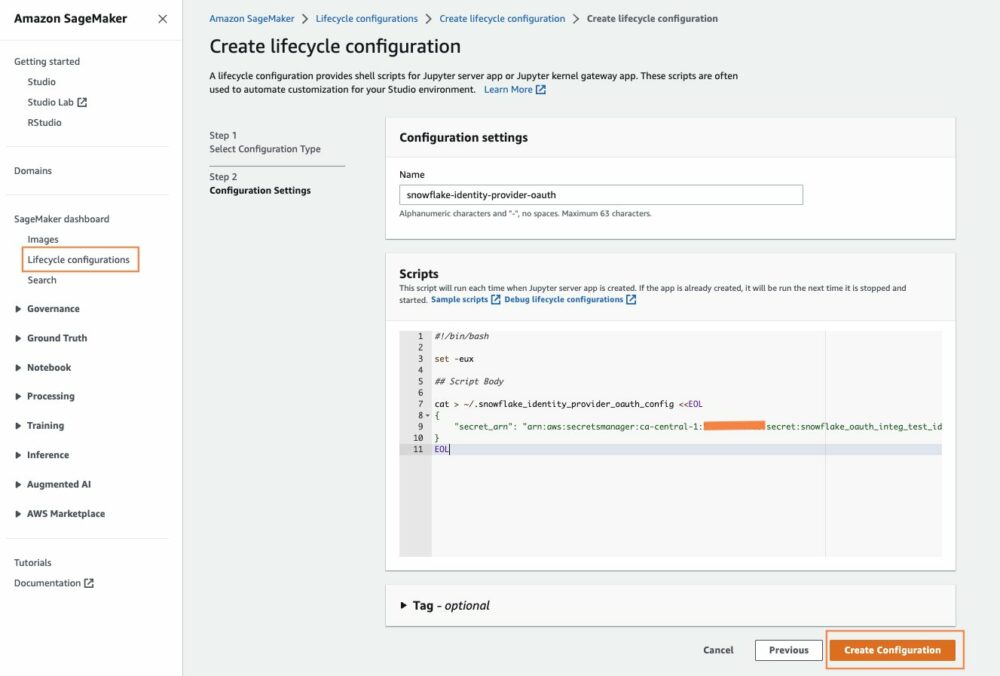

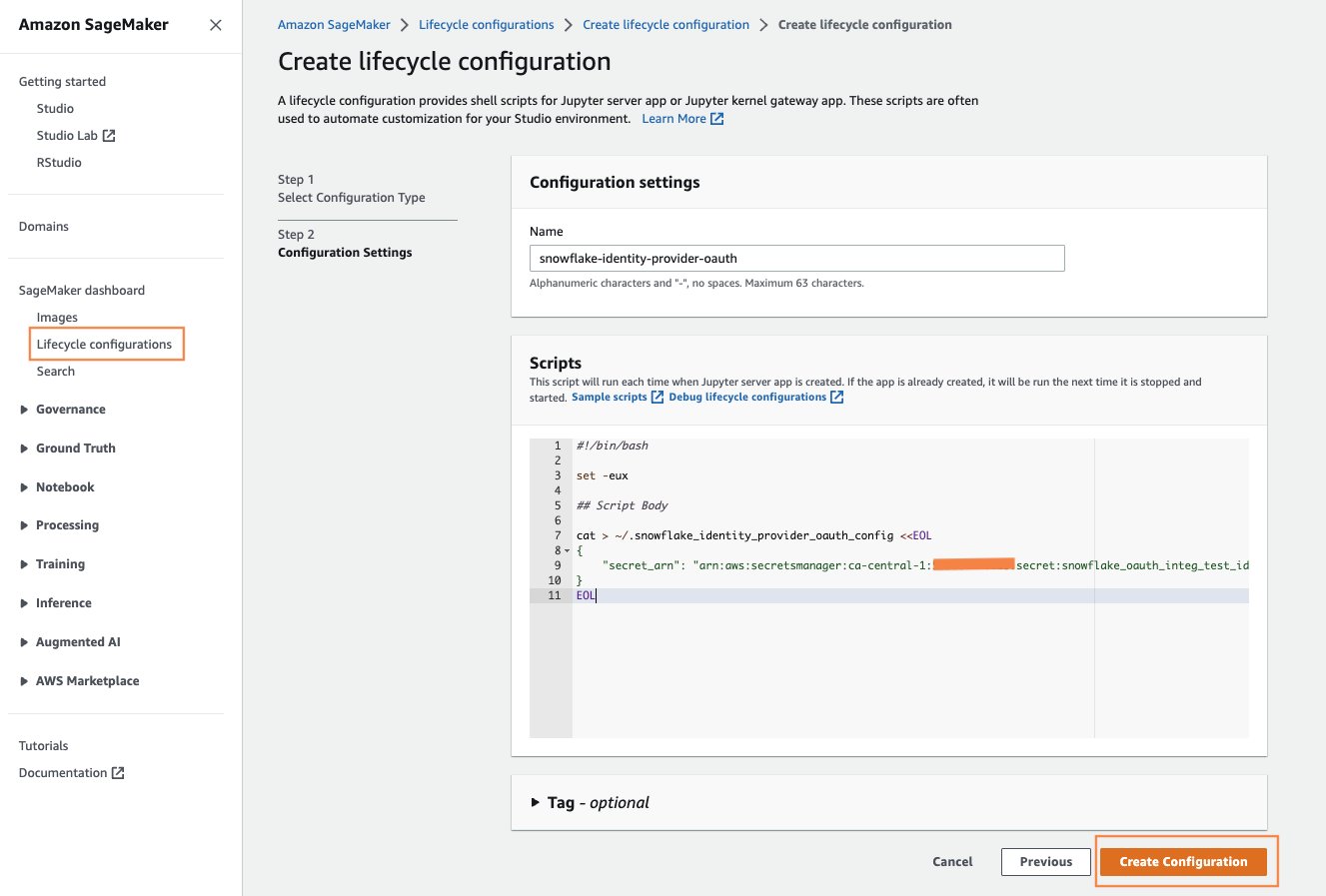

For at oprette en livscykluskonfiguration i Studio skal du udføre følgende trin:

- Vælg på SageMaker-konsollen Livscykluskonfigurationer i navigationsruden.

- Vælg Opret konfiguration.

- Vælg Jupyter server app.

- Opret en ny livscykluskonfiguration, eller tilføj en eksisterende med følgende indhold:

Konfigurationen opretter en fil med navnet ".snowflake_identity_provider_oauth_config", der indeholder hemmeligheden i brugerens hjemmemappe.

- Vælg Opret konfiguration.

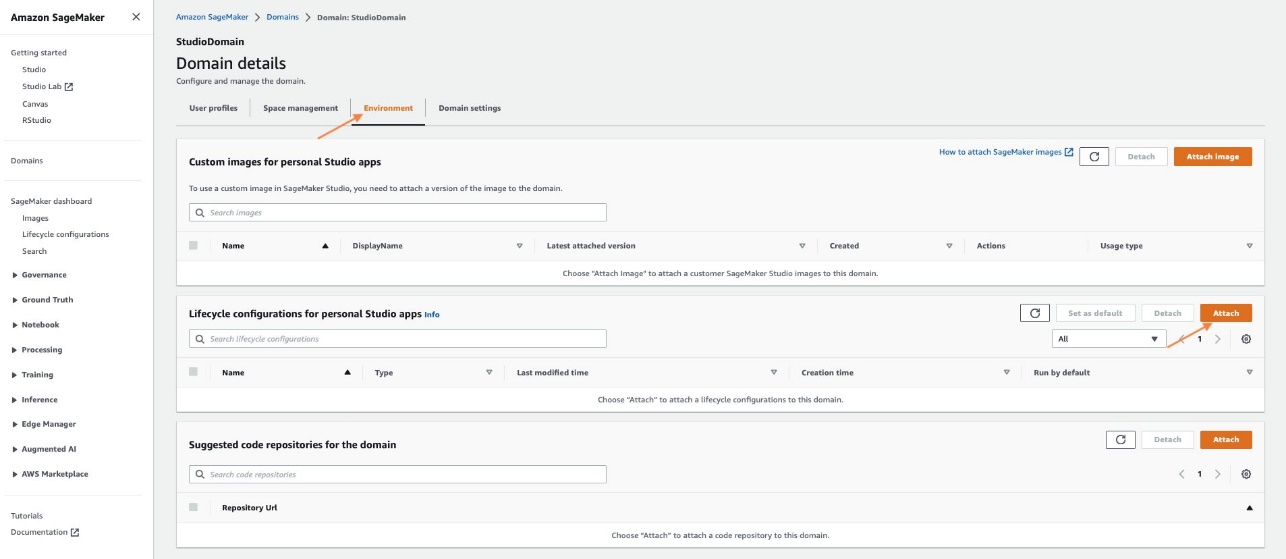

Indstil standard Lifecycle Configuration

Udfør følgende trin for at indstille den livscykluskonfiguration, du lige har oprettet, som standard:

- Vælg på SageMaker-konsollen domæner i navigationsruden.

- Vælg det Studio-domæne, du vil bruge til dette eksempel.

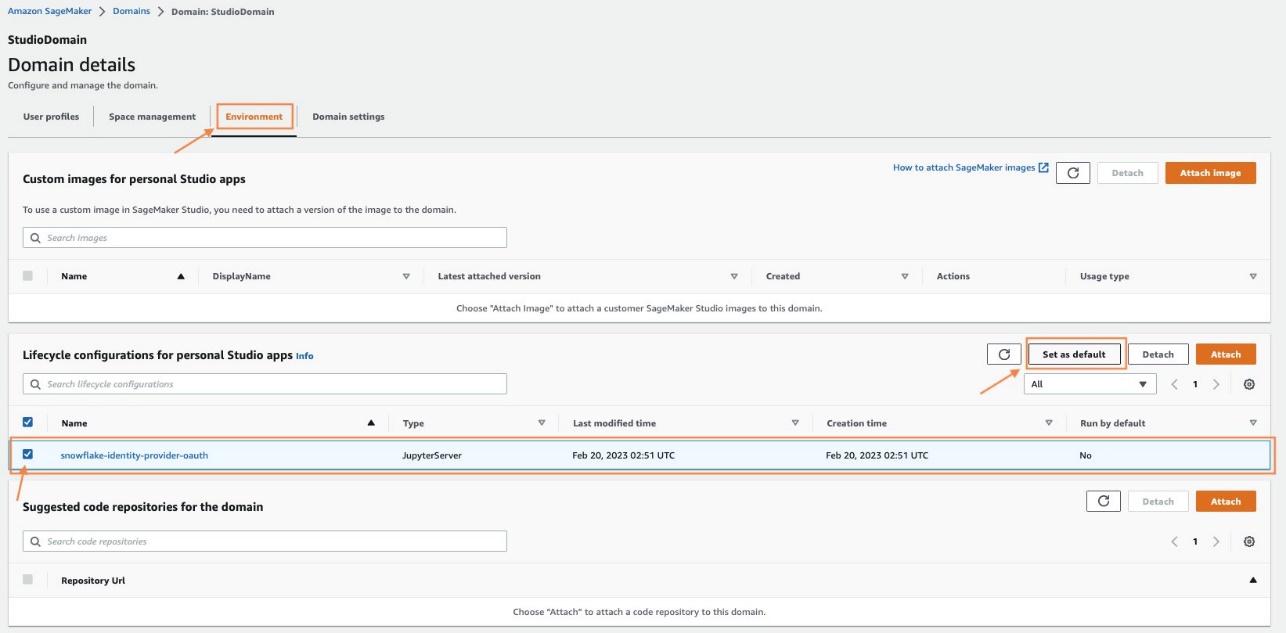

- På Miljø fanebladet i Livscykluskonfigurationer for personlige Studio-apps sektion, skal du vælge Vedhæft.

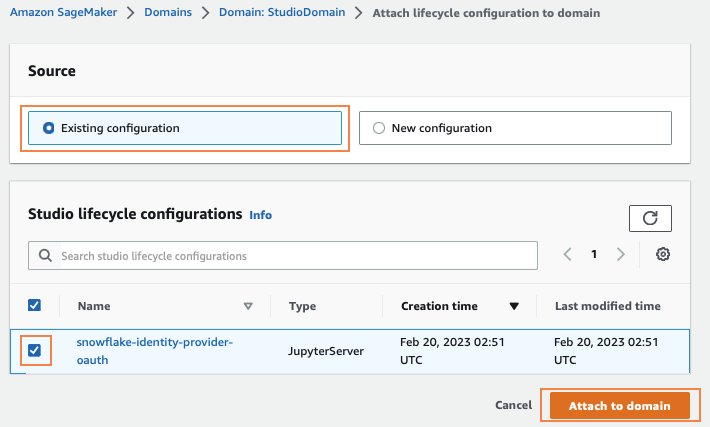

- Til Kilde, Vælg Eksisterende konfiguration.

- Vælg den konfiguration, du lige har lavet, og vælg derefter Vedhæft til domæne.

- Vælg den nye konfiguration og vælg Sæt som standard, Og vælg derefter Sæt som standard igen i pop op-meddelelsen.

Dine nye indstillinger skulle nu være synlige under Livscykluskonfigurationer for personlige Studio-apps som standard.

- Luk Studio-appen ned, og genstart, for at ændringerne træder i kraft.

Data scientist erfaring

I dette afsnit dækker vi, hvordan dataforskere kan oprette forbindelse til Snowflake som en datakilde i Data Wrangler og forberede data til ML.

Opret et nyt dataflow

For at oprette dit dataflow skal du udføre følgende trin:

- Vælg på SageMaker-konsollen Amazon SageMaker Studio i navigationsruden.

- Vælg Åben Studio.

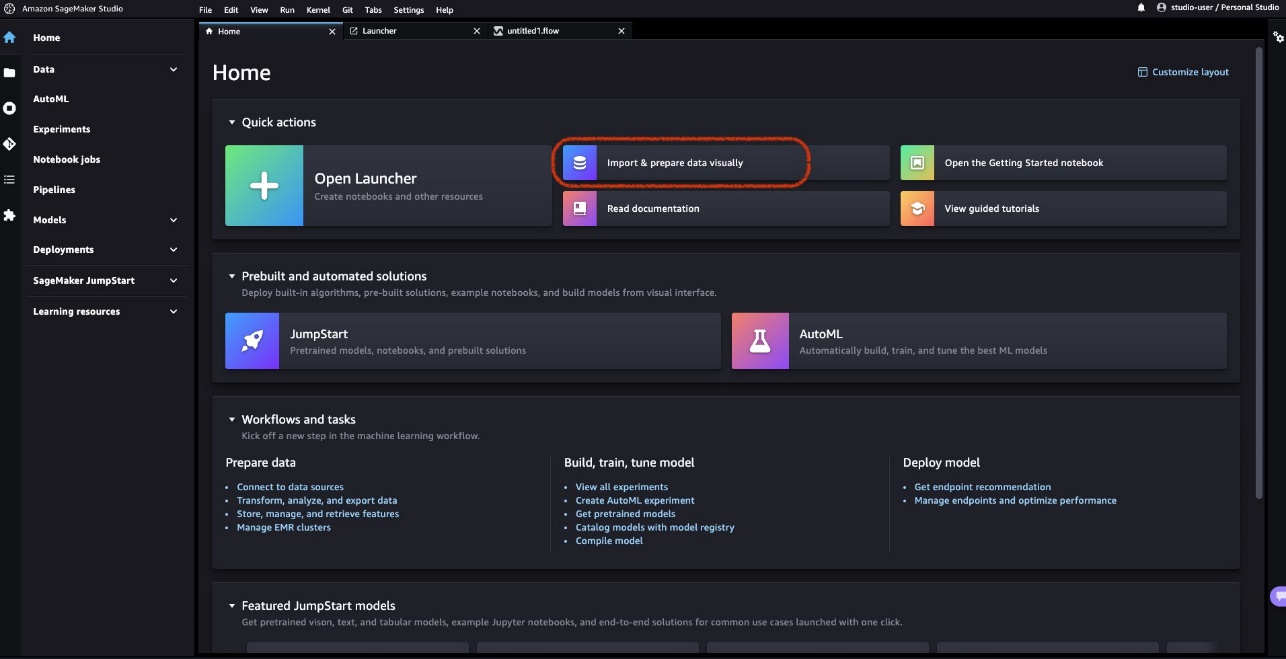

- På studiet Home side, vælg Importer og klargør data visuelt. Alternativt på File (Felt) drop-down, vælg Ny, Og vælg derefter SageMaker Data Wrangler Flow.

Oprettelse af et nyt flow kan tage et par minutter.

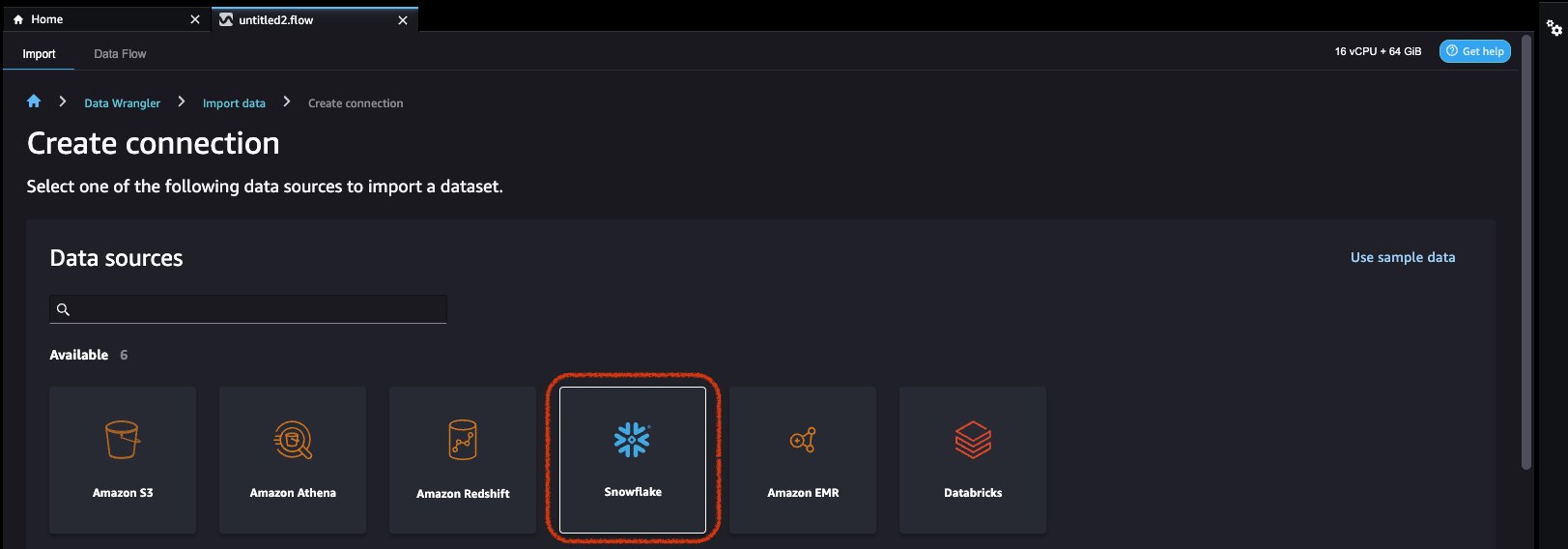

- På Import datoer side, vælg Opret forbindelse.

- Vælg Snowflake fra listen over datakilder.

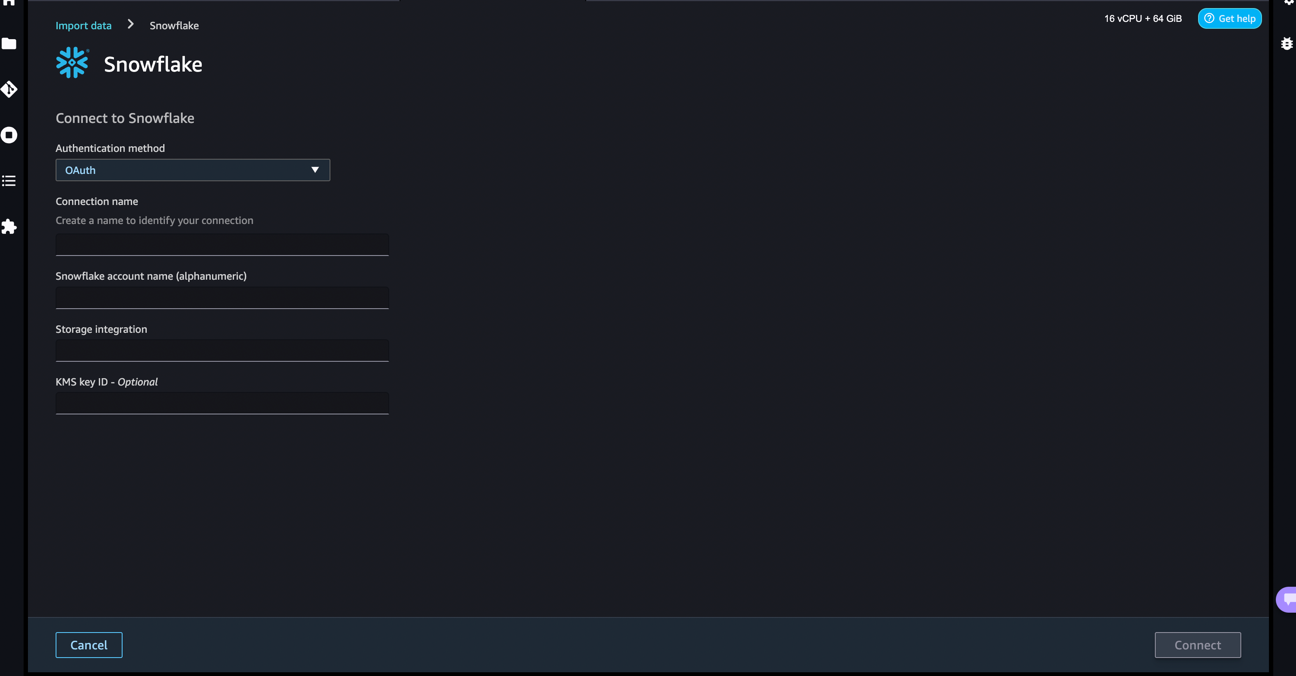

- Til Autentificeringsmetode, vælg OAuth.

Hvis du ikke kan se OAuth, skal du kontrollere de foregående livscykluskonfigurationstrin.

- Indtast detaljer for Snowflake kontonavn , Lagerintegration.

- Indtast et forbindelsesnavn, og vælg Tilslut.

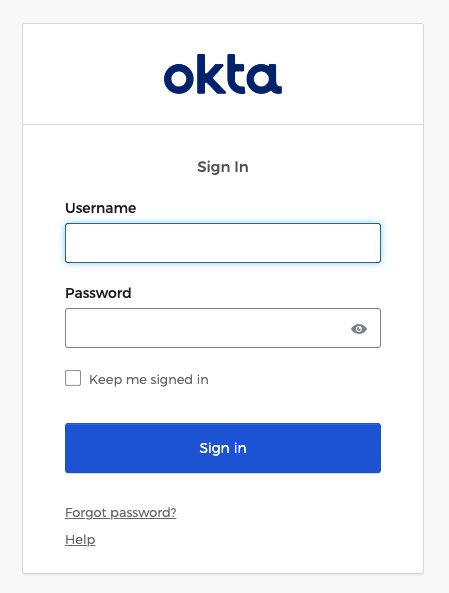

Du bliver omdirigeret til en IdP-godkendelsesside. Til dette eksempel bruger vi Okta.

- Indtast dit brugernavn og din adgangskode, og vælg derefter Log ind.

Når godkendelsen er vellykket, omdirigeres du til Studio-dataflowsiden.

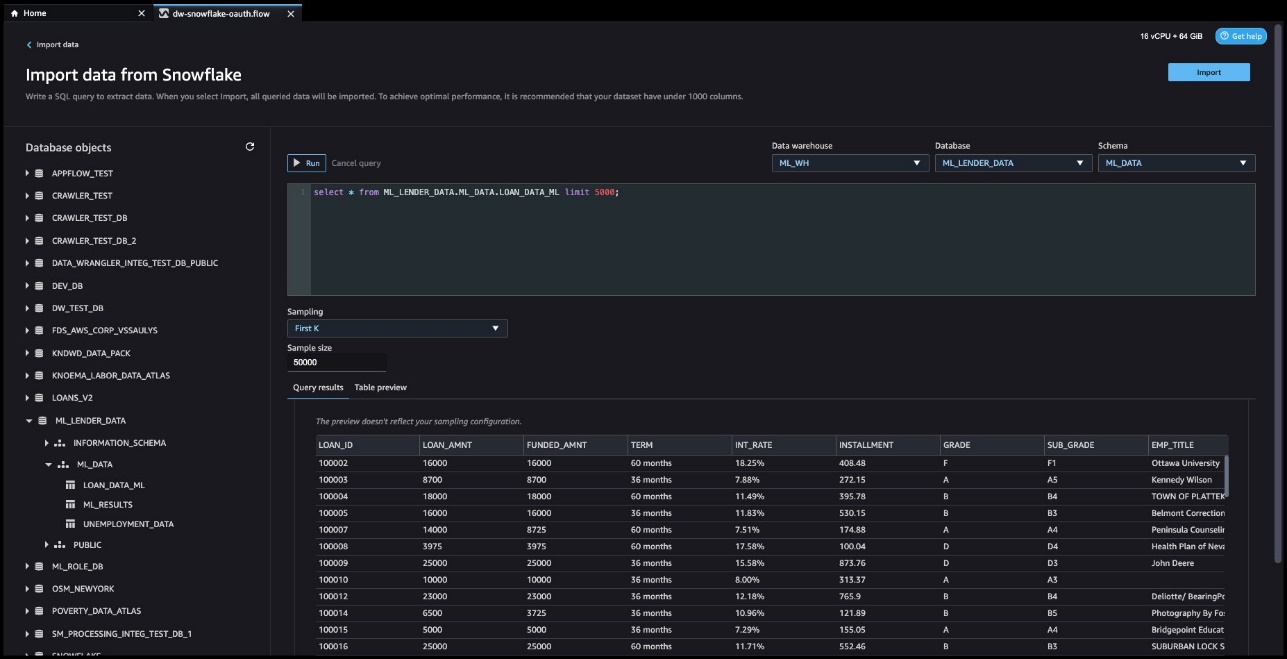

- På Importer data fra Snowflake side, gennemse databaseobjekterne eller kør en forespørgsel efter de målrettede data.

- Indtast en forespørgsel i forespørgselseditoren og få vist resultaterne.

I det følgende eksempel indlæser vi Lånedata og hent alle kolonner fra 5,000 rækker.

- Vælg Importere.

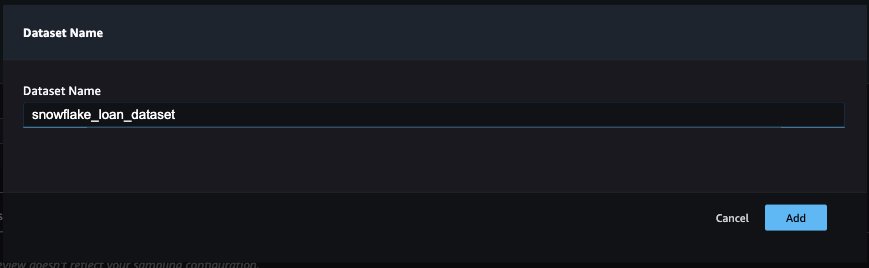

- Indtast et datasætnavn (til dette indlæg bruger vi

snowflake_loan_dataset) og vælg Tilføj.

Du bliver omdirigeret til Forbered side, hvor du kan tilføje transformationer og analyser til dataene.

Data Wrangler gør det nemt at indtage data og udføre dataforberedende opgaver såsom undersøgende dataanalyse, funktionsvalg og funktionsudvikling. Vi har kun dækket nogle få af funktionerne i Data Wrangler i dette indlæg om dataforberedelse; du kan bruge Data Wrangler til mere avanceret dataanalyse som f.eks. vigtighed af funktioner, mållækage og modelforklarlighed ved hjælp af en nem og intuitiv brugergrænseflade.

Analyser datakvalitet

Brug Rapport om datakvalitet og indsigt for at udføre en analyse af de data, du har importeret til Data Wrangler. Data Wrangler opretter rapporten ud fra de stikprøvedata.

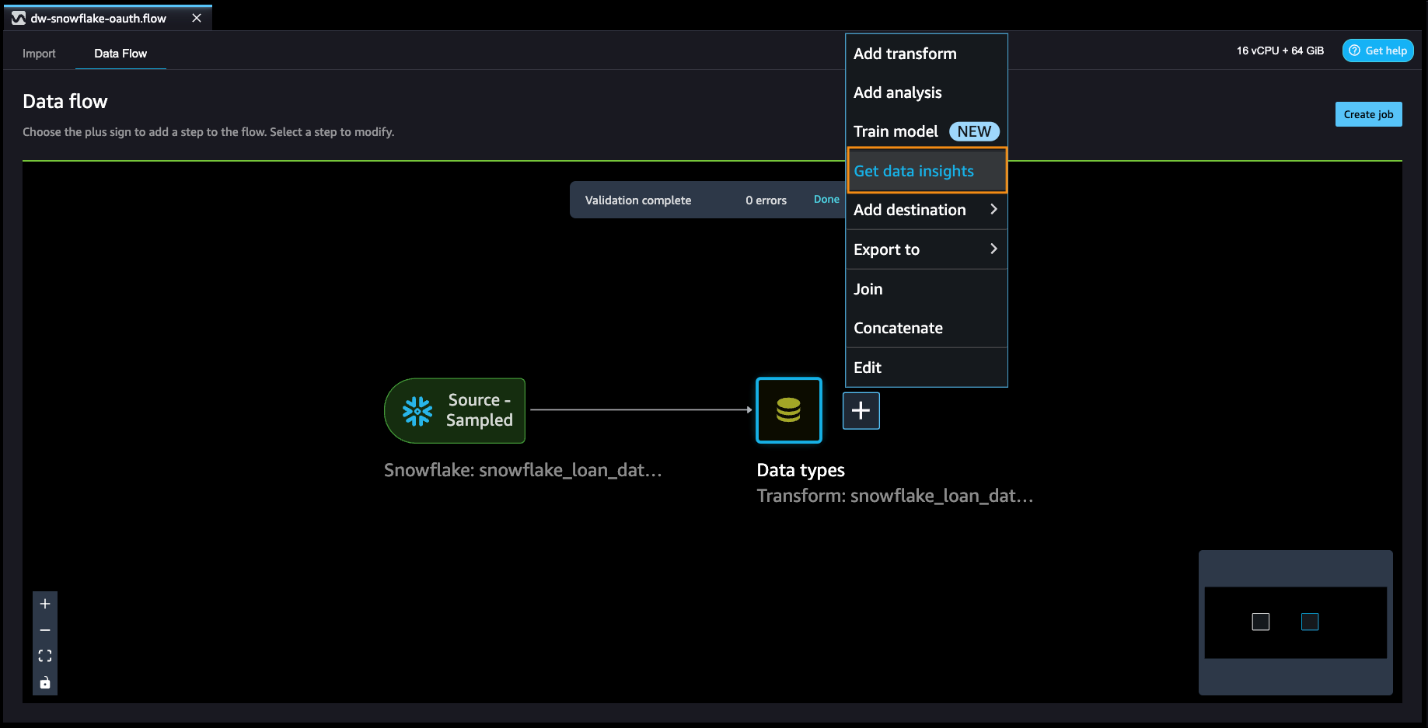

- På siden Data Wrangler flow skal du vælge plustegnet ved siden af Datatyper, Og vælg derefter Få dataindsigt.

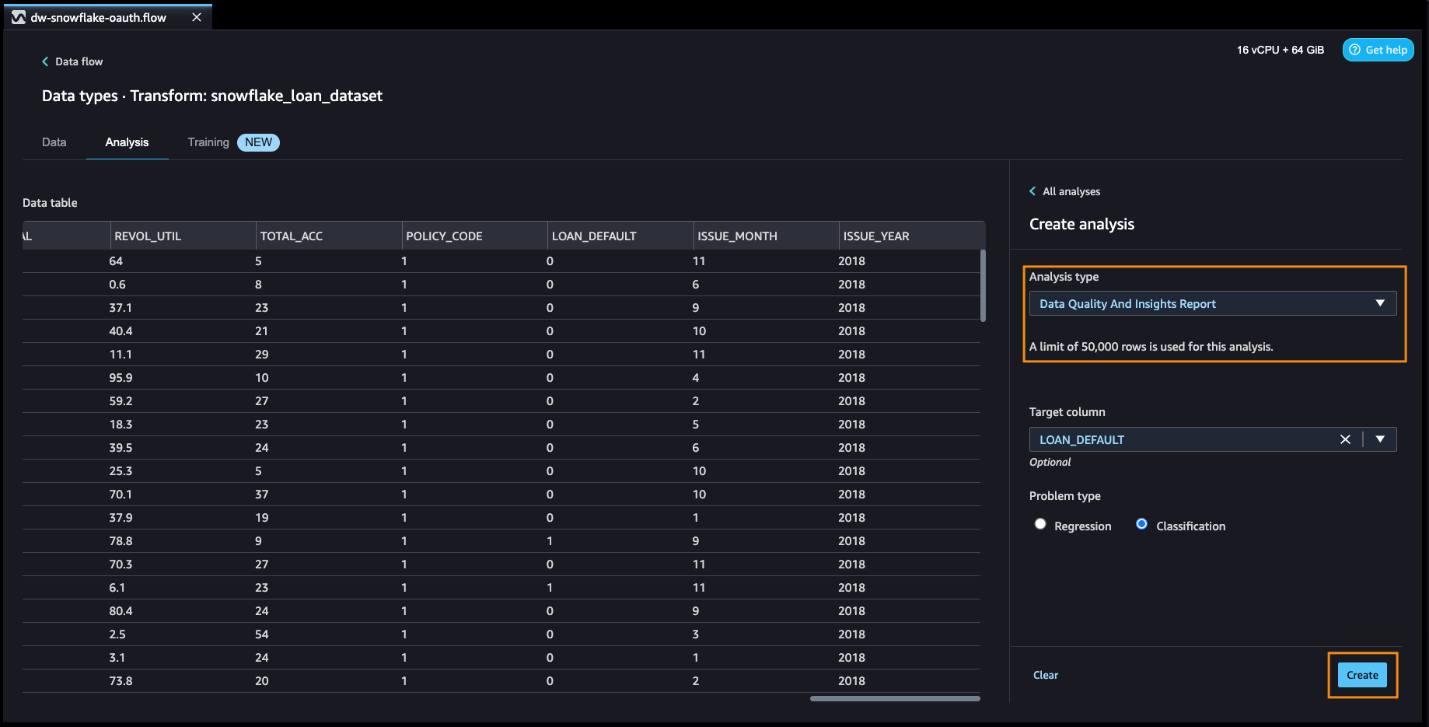

- Vælg Rapport om datakvalitet og indsigt forum Analyse type.

- Til Målkolonne, vælg din målkolonne.

- Til Problektype, Vælg Klassifikation.

- Vælg Opret.

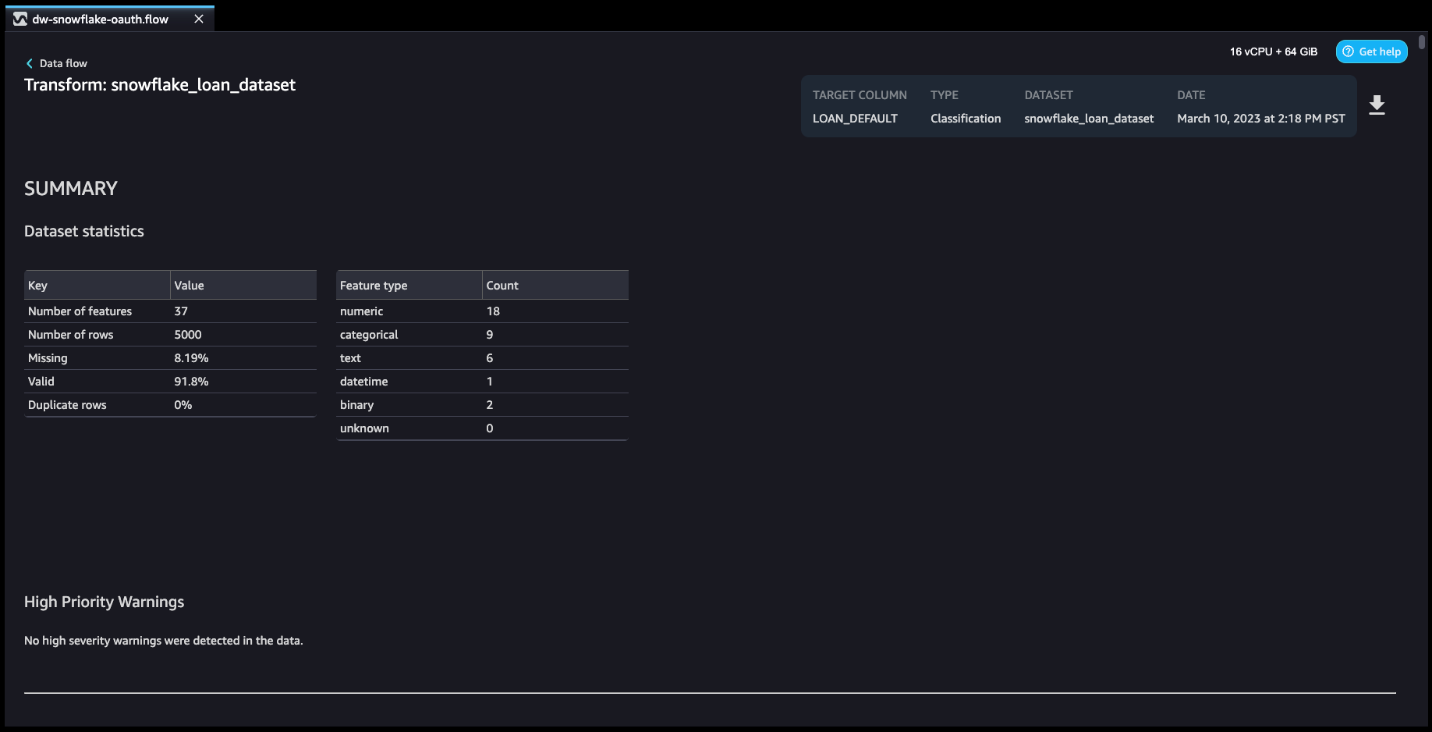

Indsigtsrapporten har en kort oversigt over dataene, som inkluderer generelle oplysninger såsom manglende værdier, ugyldige værdier, funktionstyper, afvigende tællinger og mere. Du kan enten downloade rapporten eller se den online.

Tilføj transformationer til dataene

Data Wrangler har over 300 indbyggede transformationer. I dette afsnit bruger vi nogle af disse transformationer til at forberede datasættet til en ML-model.

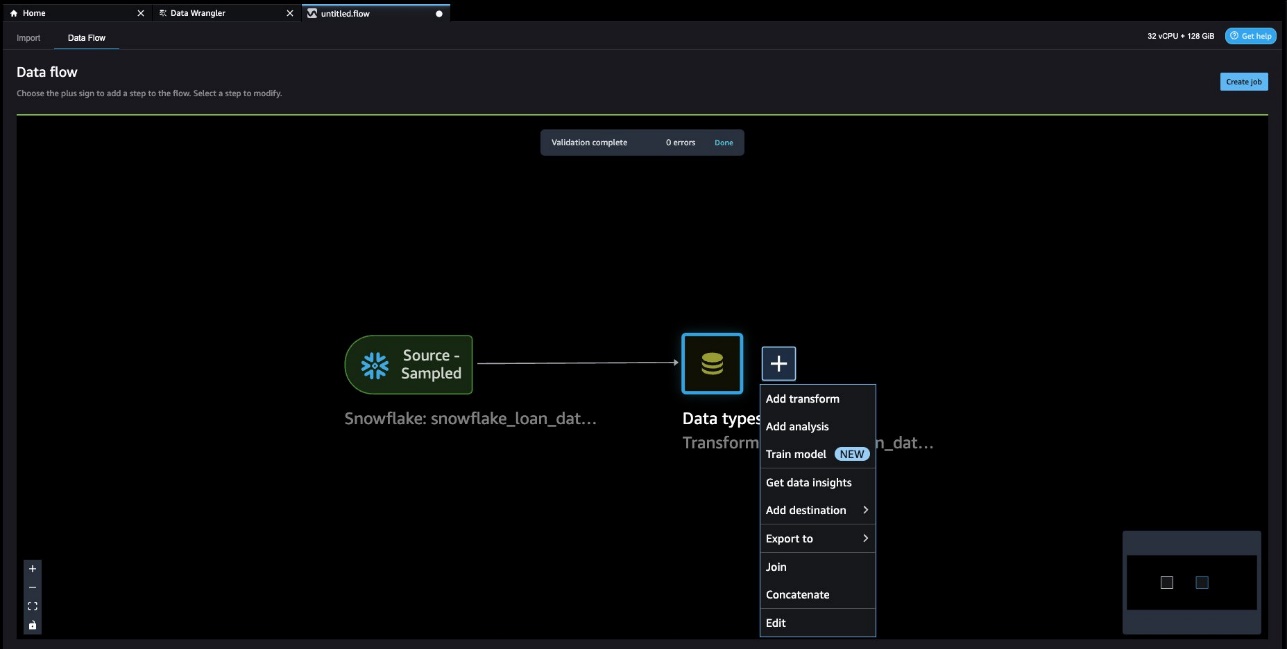

- På siden Data Wrangler flow skal du vælge plustegn og derefter vælge Tilføj transformation.

Hvis du følger trinene i indlægget, ledes du automatisk hertil efter tilføjelse af dit datasæt.

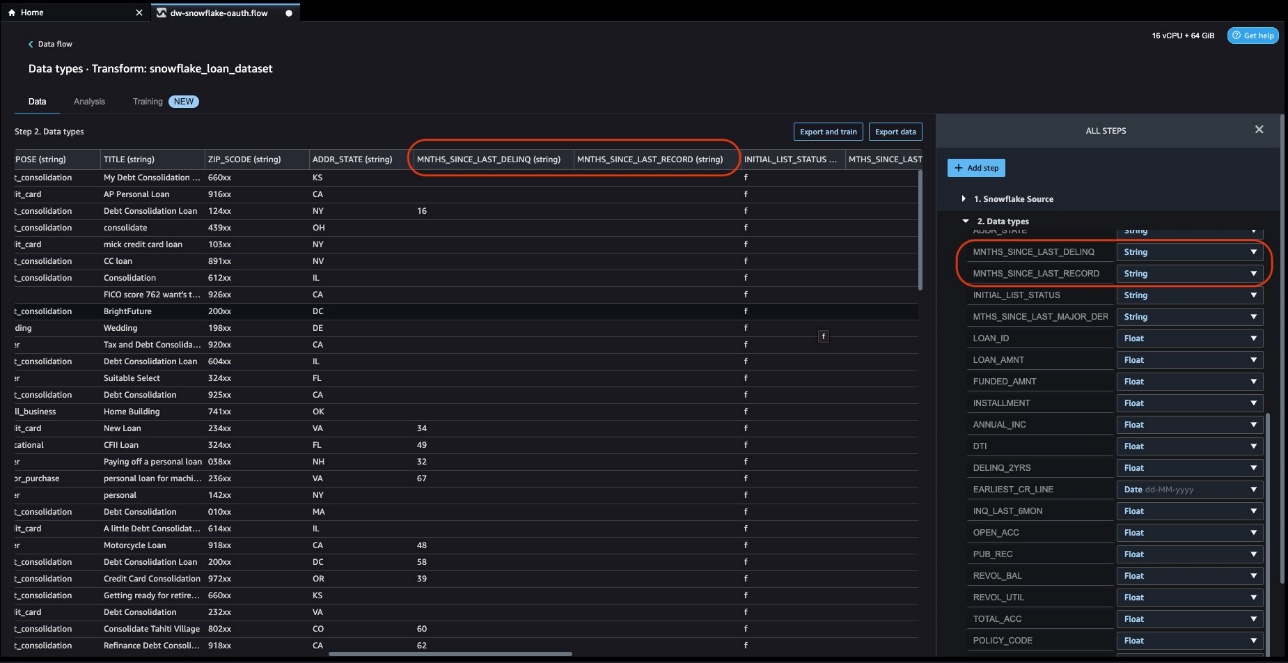

- Bekræft og modificer datatypen for kolonnerne.

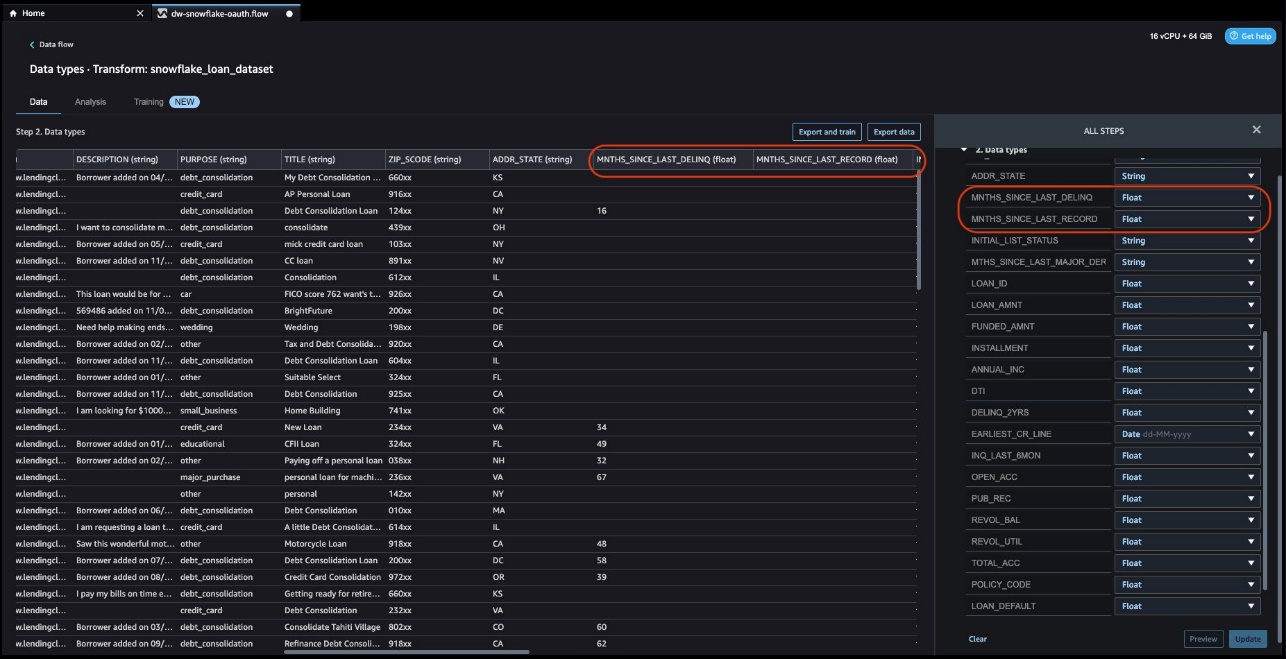

Når vi kigger gennem kolonnerne, identificerer vi det MNTHS_SINCE_LAST_DELINQ , MNTHS_SINCE_LAST_RECORD skal højst sandsynligt være repræsenteret som en taltype snarere end streng.

- Når du har anvendt ændringerne og tilføjet trinnet, kan du kontrollere, at kolonnedatatypen er ændret til flydende.

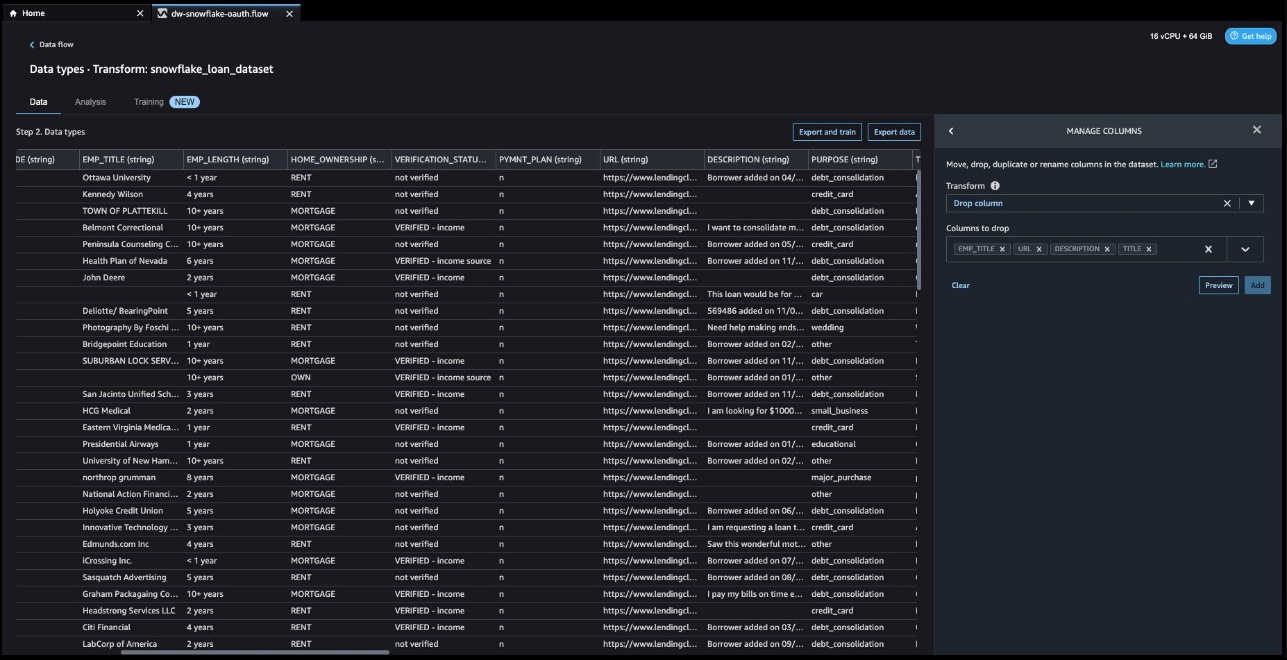

Ser vi gennem dataene, kan vi se, at felterne EMP_TITLE, URL, DESCRIPTIONog TITLE vil sandsynligvis ikke give værdi til vores model i vores use case, så vi kan droppe dem.

- Vælg Tilføj trin, Og vælg derefter Administrer kolonner.

- Til Transform, vælg Drop kolonne.

- Til Kolonne for at slippe, angiv

EMP_TITLE,URL,DESCRIPTIONogTITLE. - Vælg Eksempel , Tilføj.

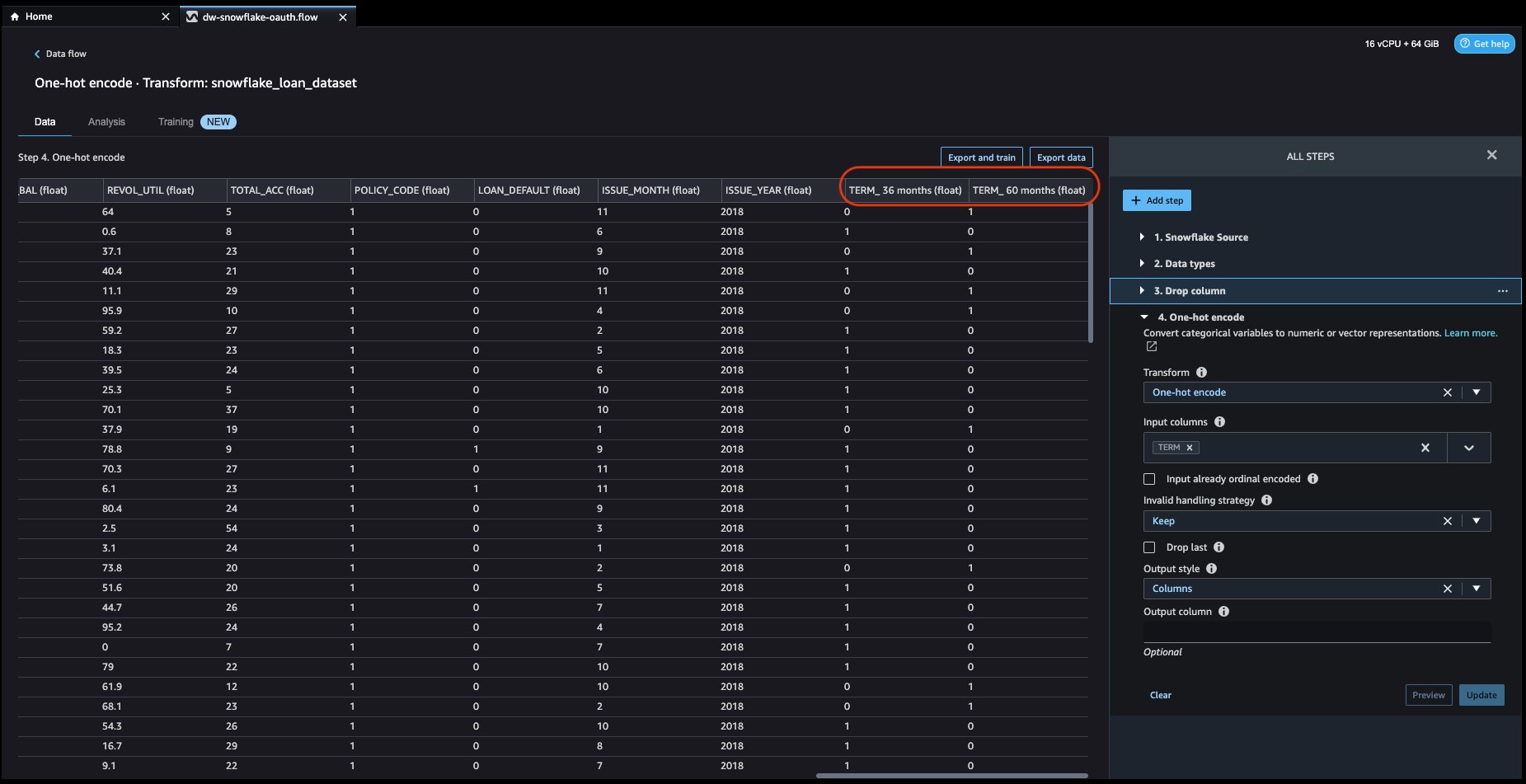

Dernæst vil vi lede efter kategoriske data i vores datasæt. Data Wrangler har en indbygget funktionalitet til at kode kategoriske data ved hjælp af både ordinal- og one-hot-kodninger. Ser vi på vores datasæt, kan vi se, at TERM, HOME_OWNERSHIPog PURPOSE kolonner ser alle ud til at være kategoriske.

- Tilføj endnu et trin og vælg Indkode kategorisk.

- Til Transform, vælg One-hot encode.

- Til Input kolonne, vælg

TERM. - Til Output stil, vælg Kolonner.

- Lad alle andre indstillinger være standard, og vælg derefter Eksempel , Tilføj.

HOME_OWNERSHIP kolonne har fire mulige værdier: RENT, MORTGAGE, OWN, og andre.

- Gentag de foregående trin for at anvende en one-hot-kodningstilgang på disse værdier.

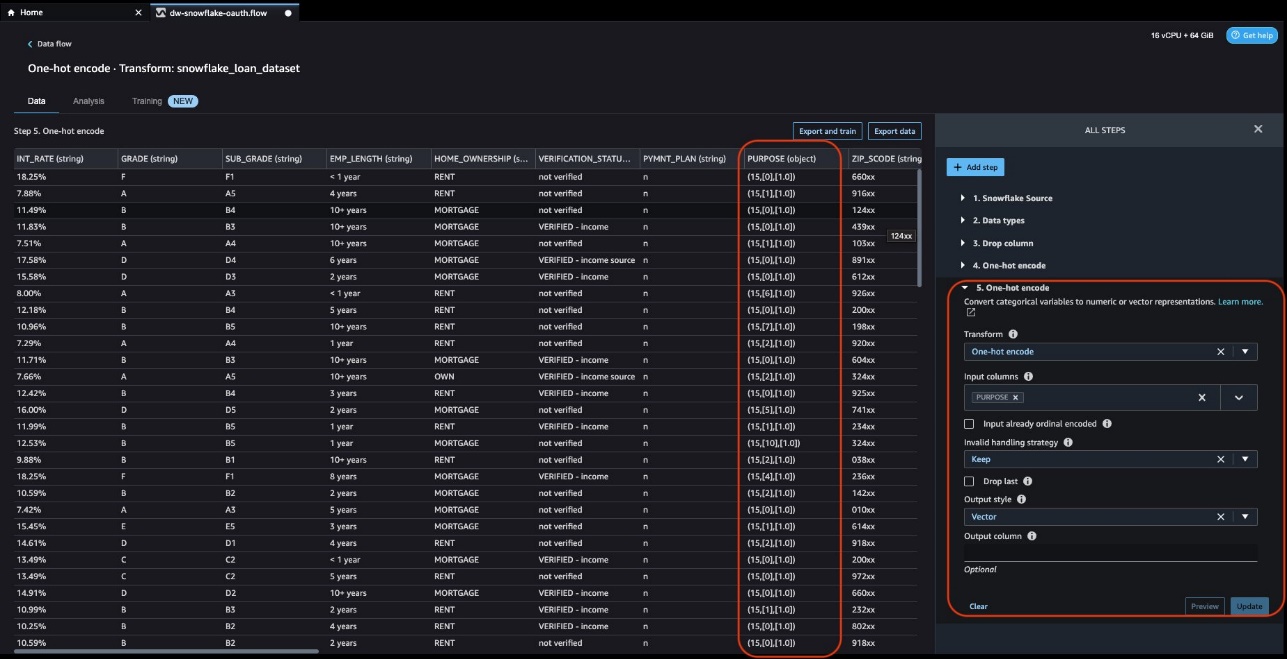

Endelig PURPOSE kolonne har flere mulige værdier. Til disse data bruger vi også en one-hot-kodningstilgang, men vi indstiller output til en vektor i stedet for kolonner.

- Til Transform, vælg One-hot encode.

- Til Input kolonne, vælg

PURPOSE. - Til Output stil, vælg vektor.

- Til Output kolonne, kalder vi denne kolonne

PURPOSE_VCTR.

Dette bevarer originalen PURPOSE kolonne, hvis vi beslutter os for at bruge den senere.

- Lad alle andre indstillinger være standard, og vælg derefter Eksempel , Tilføj.

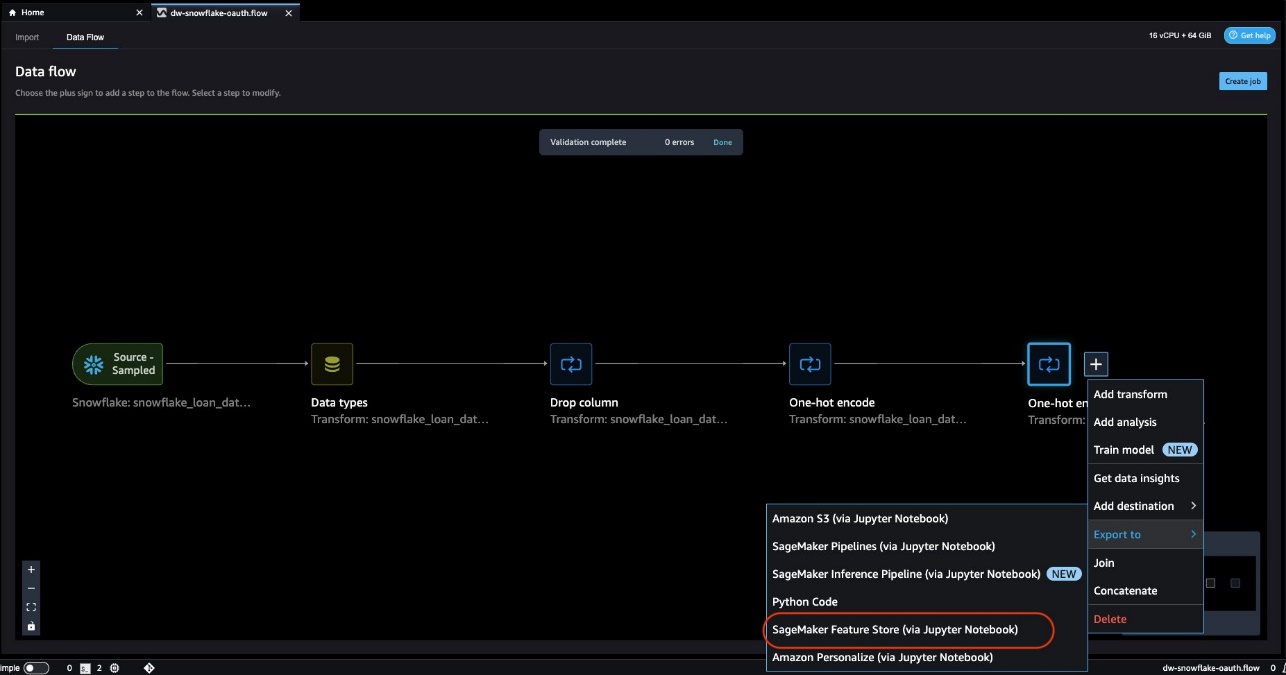

Eksporter datastrømmen

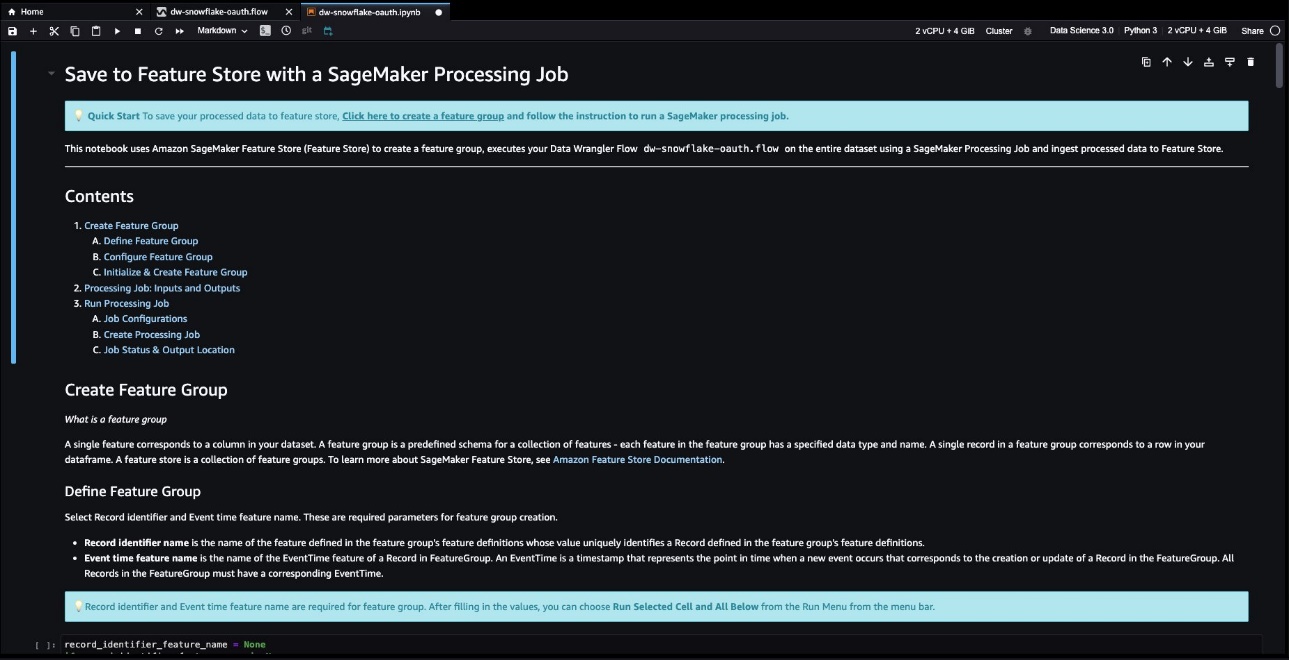

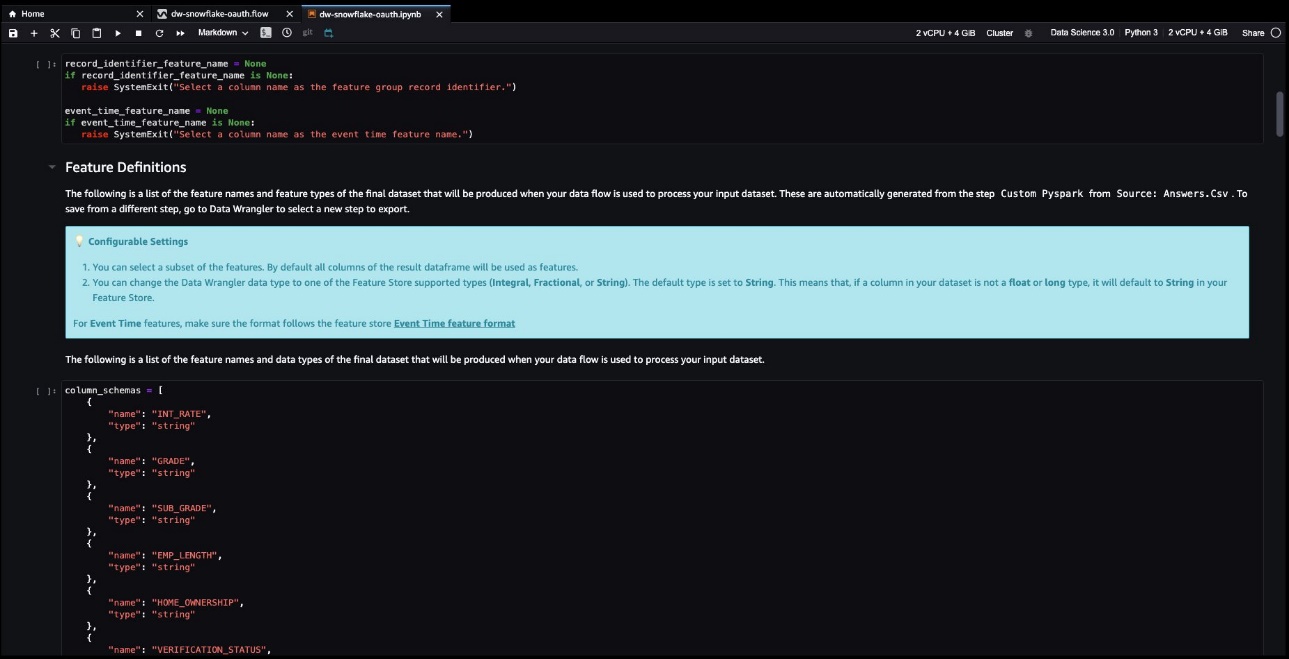

Til sidst eksporterer vi hele dette dataflow til en funktionsbutik med et SageMaker Processing-job, som opretter en Jupyter-notesbog med koden forududfyldt.

- På dataflowsiden skal du vælge plustegnet og Eksporter til.

- Vælg, hvor du vil eksportere. Til vores brugssag vælger vi SageMaker Feature Store.

Den eksporterede notesbog er nu klar til at køre.

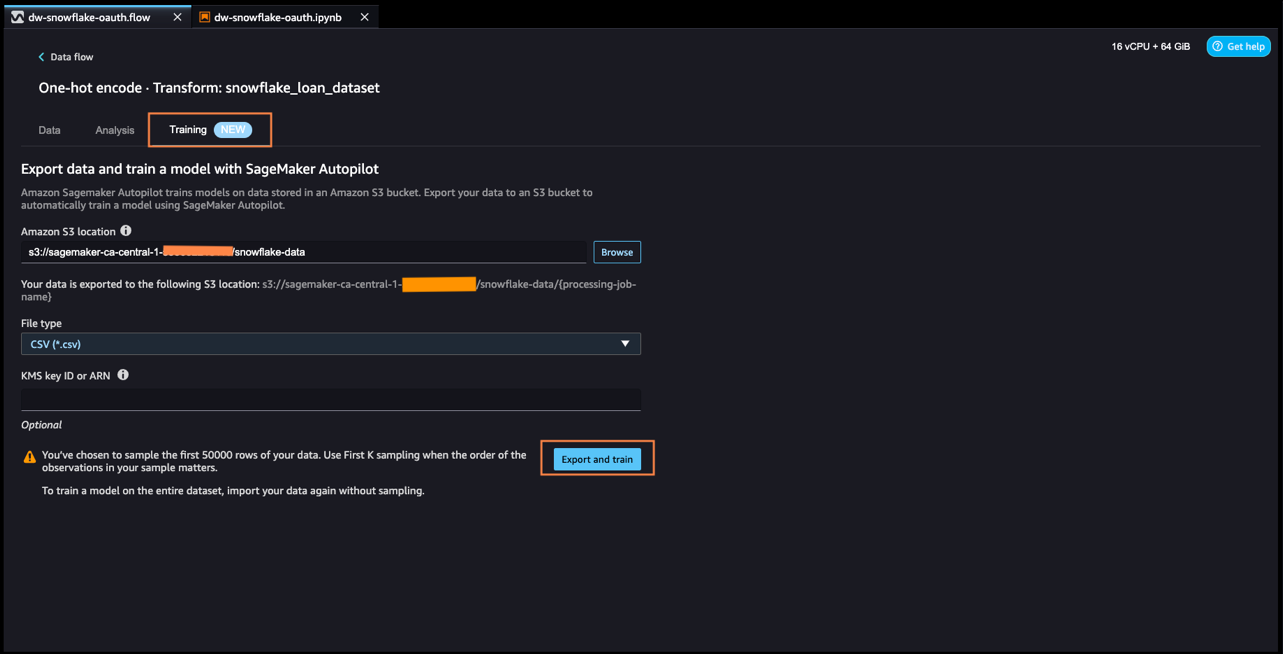

Eksporter data og træne en model med Autopilot

Nu kan vi træne modellen vha Amazon SageMaker Autopilot.

- På dataflowsiden skal du vælge Kurser fane.

- Til Amazon S3 placering, indtast en placering for de data, der skal gemmes.

- Vælg Eksport og træne.

- Angiv indstillingerne i Mål og funktioner, Træningsmetode, Indstillinger for implementering og avanceringog Gennemgå og opret sektioner.

- Vælg Opret eksperiment for at finde den bedste model til dit problem.

Ryd op

Hvis dit arbejde med Data Wrangler er afsluttet, luk din Data Wrangler-instans for at undgå ekstra gebyrer.

Konklusion

I dette indlæg demonstrerede vi forbindelse Data Wrangler til Snowflake ved hjælp af OAuth, transformere og analysere et datasæt og til sidst eksportere det til dataflowet, så det kunne bruges i en Jupyter-notesbog. Mest bemærkelsesværdigt skabte vi en pipeline til dataforberedelse uden at skulle skrive nogen kode overhovedet.

For at komme i gang med Data Wrangler, se Forbered ML Data med Amazon SageMaker Data Wrangler.

Om forfatterne

Ajjay Govindaram er Senior Solutions Architect hos AWS. Han arbejder med strategiske kunder, der bruger AI/ML til at løse komplekse forretningsproblemer. Hans erfaring ligger i at levere teknisk vejledning samt designassistance til beskedne til store AI/ML-applikationsimplementeringer. Hans viden spænder fra applikationsarkitektur til big data, analytics og machine learning. Han nyder at lytte til musik, mens han hviler sig, opleve udendørslivet og tilbringe tid med sine kære.

Ajjay Govindaram er Senior Solutions Architect hos AWS. Han arbejder med strategiske kunder, der bruger AI/ML til at løse komplekse forretningsproblemer. Hans erfaring ligger i at levere teknisk vejledning samt designassistance til beskedne til store AI/ML-applikationsimplementeringer. Hans viden spænder fra applikationsarkitektur til big data, analytics og machine learning. Han nyder at lytte til musik, mens han hviler sig, opleve udendørslivet og tilbringe tid med sine kære.

Bosco Albuquerque er en Sr. Partner Solutions Architect hos AWS og har over 20 års erfaring med at arbejde med database- og analyseprodukter fra enterprise database-leverandører og cloud-udbydere. Han har hjulpet store teknologivirksomheder med at designe dataanalyseløsninger og har ledet ingeniørteams med at designe og implementere dataanalyseplatforme og dataprodukter.

Bosco Albuquerque er en Sr. Partner Solutions Architect hos AWS og har over 20 års erfaring med at arbejde med database- og analyseprodukter fra enterprise database-leverandører og cloud-udbydere. Han har hjulpet store teknologivirksomheder med at designe dataanalyseløsninger og har ledet ingeniørteams med at designe og implementere dataanalyseplatforme og dataprodukter.

Matt Marzillo er Sr. Partner Sales Engineer hos Snowflake. Han har 10 års erfaring i datavidenskab og maskinlæringsroller både i rådgivning og med brancheorganisationer. Matt har erfaring med at udvikle og implementere AI- og ML-modeller på tværs af mange forskellige organisationer inden for områder som marketing, salg, drift, klinisk og økonomi, samt rådgiver i konsulentroller.

Matt Marzillo er Sr. Partner Sales Engineer hos Snowflake. Han har 10 års erfaring i datavidenskab og maskinlæringsroller både i rådgivning og med brancheorganisationer. Matt har erfaring med at udvikle og implementere AI- og ML-modeller på tværs af mange forskellige organisationer inden for områder som marketing, salg, drift, klinisk og økonomi, samt rådgiver i konsulentroller.

Huong Nguyen er produktleder for Amazon SageMaker Data Wrangler hos AWS. Hun har 15 års erfaring med at skabe kundebesatte og datadrevne produkter til både virksomheds- og forbrugerrum. I sin fritid nyder hun lydbøger, havearbejde, vandreture og tilbringe tid med sin familie og venner.

Huong Nguyen er produktleder for Amazon SageMaker Data Wrangler hos AWS. Hun har 15 års erfaring med at skabe kundebesatte og datadrevne produkter til både virksomheds- og forbrugerrum. I sin fritid nyder hun lydbøger, havearbejde, vandreture og tilbringe tid med sin familie og venner.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :er

- $OP

- 000

- 10

- 100

- 15 år

- 20 år

- 7

- 8

- 9

- a

- I stand

- Om

- adgang

- Adgang til data

- Adgang

- Konto

- tværs

- Ad

- Desuden

- Yderligere

- admin

- fremme

- fremskreden

- rådgive

- Efter

- AI

- AI / ML

- Alle

- Amazon

- Amazon SageMaker

- Amazon SageMaker Data Wrangler

- Analyser

- analyse

- analytics

- analysere

- analysere

- ,

- En anden

- api

- app

- vises

- Anvendelse

- Indløs

- Anvendelse

- tilgang

- apps

- arkitektur

- ER

- områder

- AS

- Assistance

- forbundet

- At

- vedhæfte

- publikum

- lyd

- autentificere

- Godkendelse

- tilladelse

- automatisere

- automatisk

- AWS

- Azure

- BE

- fordi

- før

- begynde

- BEDSTE

- Big

- Big data

- krop

- Bøger

- indbygget

- virksomhed

- by

- ringe

- kaldet

- CAN

- kapaciteter

- tilfælde

- KAT

- Ændringer

- valg

- Vælg

- kunde

- Klinisk

- Cloud

- kode

- Kolonne

- Kolonner

- Virksomheder

- fuldføre

- komplekse

- Konceptet

- Konfiguration

- Tilslut

- Tilslutning

- tilslutning

- Konsol

- rådgivning

- forbruger

- indhold

- kunne

- dæksel

- dækket

- skabe

- oprettet

- skaber

- Oprettelse af

- Legitimationsoplysninger

- Kunder

- data

- dataanalyse

- Dataanalyse

- Dataplatform

- Dataforberedelse

- datalogi

- dataforsker

- datastyret

- Database

- beslutte

- Standard

- demonstreret

- implementering

- implementeringer

- Design

- designe

- detail

- detaljer

- udvikling

- forskellige

- retning

- direkte

- distinkt

- dokumentation

- Er ikke

- domæne

- Dont

- ned

- downloade

- Drop

- hver

- editor

- effekt

- enten

- muliggøre

- ingeniør

- Engineering

- Indtast

- Enterprise

- Miljø

- eksempel

- eksisterende

- erfaring

- oplever

- Udforskende dataanalyse

- eksport

- ekstern

- FAIL

- familie

- Feature

- Funktionalitet

- Gebyrer

- få

- felt

- Fields

- File (Felt)

- Endelig

- finansiere

- Finde

- Flyde

- flow

- efter

- Til

- format

- Frekvens

- hyppigt

- venner

- fra

- funktionalitet

- Generelt

- få

- giver

- indrømme

- større

- Guides

- Have

- have

- hjælpe

- hjulpet

- link.

- Home

- Hvordan

- How To

- HTML

- http

- HTTPS

- ID

- identifikator

- identificere

- Identity

- tomgang

- gennemføre

- importere

- betydning

- in

- omfatter

- Herunder

- forkert

- industrien

- oplysninger

- indgang

- indsigt

- indsigt

- anvisninger

- integration

- integrationer

- grænseflade

- intuitiv

- involverede

- IT

- Job

- Karriere

- jpg

- Nøgle

- viden

- stor

- storstilet

- leder

- læring

- Led

- ligger

- livscyklus

- levetid

- ligesom

- Sandsynlig

- Liste

- Lytte

- belastning

- belastninger

- placering

- Se

- leder

- elskede

- maskine

- machine learning

- lavet

- lave

- maerker

- Making

- leder

- mange

- Marketing

- besked

- måske

- minutter

- mangler

- ML

- model

- modeller

- ændre

- mere

- mest

- flere

- Musik

- navn

- navne

- Natur

- Navigation

- Behov

- behøve

- behov

- Ny

- næste

- især

- notesbog

- nummer

- oauth

- objekter

- of

- Okta

- on

- ONE

- online

- Produktion

- Option

- organisationer

- original

- Andet

- Ellers

- udendørs

- output

- egen

- side

- par

- brød

- partner

- Adgangskode

- Udfør

- Tilladelser

- personale

- pipeline

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- plus

- politikker

- pop-up

- mulig

- Indlæg

- foretrækkes

- Forbered

- forudsætninger

- Eksempel

- tidligere

- Problem

- problemer

- procedurer

- behandle

- forarbejdning

- Produkt

- Produkter

- Profil

- Programmering

- korrekt

- give

- forudsat

- udbyder

- udbydere

- giver

- leverer

- kvalitet

- hellere

- klar

- anbefaler

- omdirigere

- reducere

- region

- register

- registrering

- Registrering

- relancering

- indberette

- repræsenteret

- kræver

- dem

- REST

- resultere

- Resultater

- detail

- roller

- roller

- Kør

- kører

- sagemaker

- salg

- planlægning

- Videnskab

- Videnskabsmand

- forskere

- rækkevidde

- Secret

- Sektion

- sektioner

- sikkerhed

- valg

- senior

- Følsomhed

- sæt

- indstilling

- indstillinger

- flere

- Shell

- bør

- Vis

- underskrive

- Simpelt

- enkelt

- So

- Løsninger

- SOLVE

- nogle

- Kilde

- Kilder

- rum

- udgifterne

- påbegyndt

- starter

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- lagring

- Strategisk

- String

- Studio

- vellykket

- sådan

- RESUMÉ

- support

- Understøtter

- TAG

- Tag

- tager

- mål

- målrettet

- opgaver

- hold

- Teknisk

- Teknologier

- teknologiselskaber

- at

- oplysninger

- deres

- Them

- Disse

- Gennem

- tid

- til

- token

- Tokens

- Tog

- Transform

- transformationer

- omdanne

- typer

- under

- forstå

- enestående

- Opdatering

- URL

- brug

- brug tilfælde

- Bruger

- Brugergrænseflade

- brugere

- værdi

- Værdier

- leverandører

- verificere

- via

- Specifikation

- synlig

- går igennem

- advarsel

- uger

- GODT

- som

- mens

- WHO

- Hele

- vilje

- med

- inden for

- uden

- Arbejde

- arbejdsgange

- arbejder

- virker

- skriver

- skrivning

- år

- Du

- Din

- zephyrnet