Lanceret i 2021, Amazon SageMaker lærred er en visuel peg-og-klik-tjeneste til opbygning og implementering af maskinlæringsmodeller (ML) uden behov for at skrive nogen kode. Klar-til-bruge Foundation Models (FM'er), der er tilgængelige i SageMaker Canvas, gør det muligt for kunder at bruge generativ AI til opgaver såsom generering af indhold og opsummering.

Vi er begejstrede for at annoncere de seneste opdateringer til Amazon SageMaker Canvas, som bringer spændende nye generative AI-egenskaber til platformen. Med understøttelse af Meta Llama 2- og Mistral.AI-modeller og lanceringen af streamingsvar fortsætter SageMaker Canvas med at styrke alle, der ønsker at komme i gang med generativ AI uden at skrive en eneste kodelinje. I dette indlæg diskuterer vi disse opdateringer og deres fordele.

Introduktion af Meta Llama 2 og Mistral modeller

Llama 2 er en banebrydende fundamentmodel fra Meta, der tilbyder forbedret skalerbarhed og alsidighed til en lang række generative AI-opgaver. Brugere har rapporteret, at Llama 2 er i stand til at engagere sig i meningsfulde og sammenhængende samtaler, generere nyt indhold og udtrække svar fra eksisterende noter. Llama 2 er blandt de avancerede store sprogmodeller (LLM'er), der er tilgængelige i dag for open source-fællesskabet til at bygge deres egne AI-drevne applikationer.

Mistral.AI, en førende fransk AI-start-up, har udviklet Mistral 7B, en kraftfuld sprogmodel med 7.3 milliarder parametre. Mistral-modeller er blevet meget godt modtaget af open source-fællesskabet takket være brugen af Grouped-Query Attention (GQA) for hurtigere inferens, hvilket gør det yderst effektivt og yder sammenligneligt med model med dobbelt eller tre gange antallet af parametre.

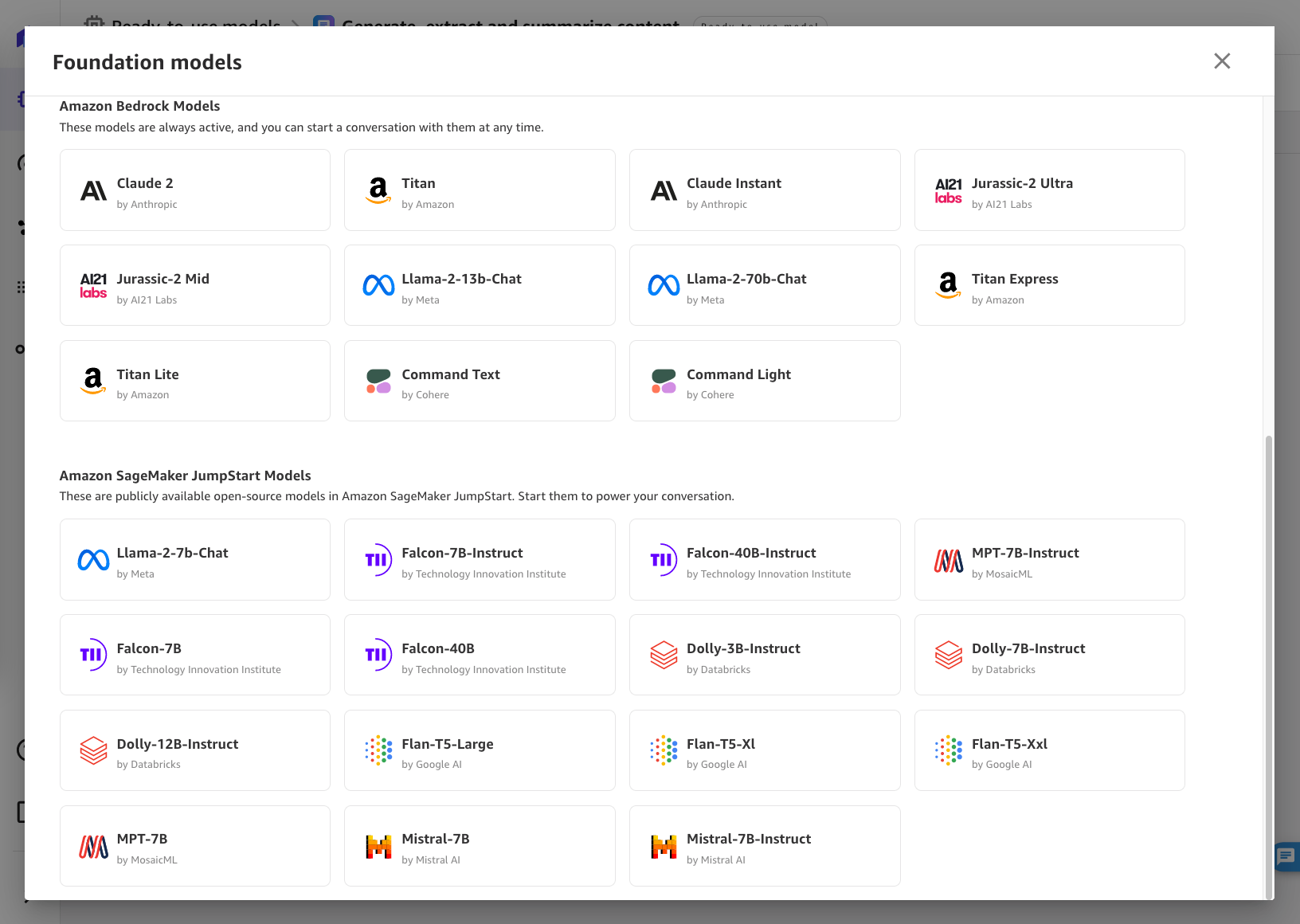

I dag er vi glade for at kunne meddele, at SageMaker Canvas nu understøtter tre Llama 2-modelvarianter og to Mistral 7B-varianter:

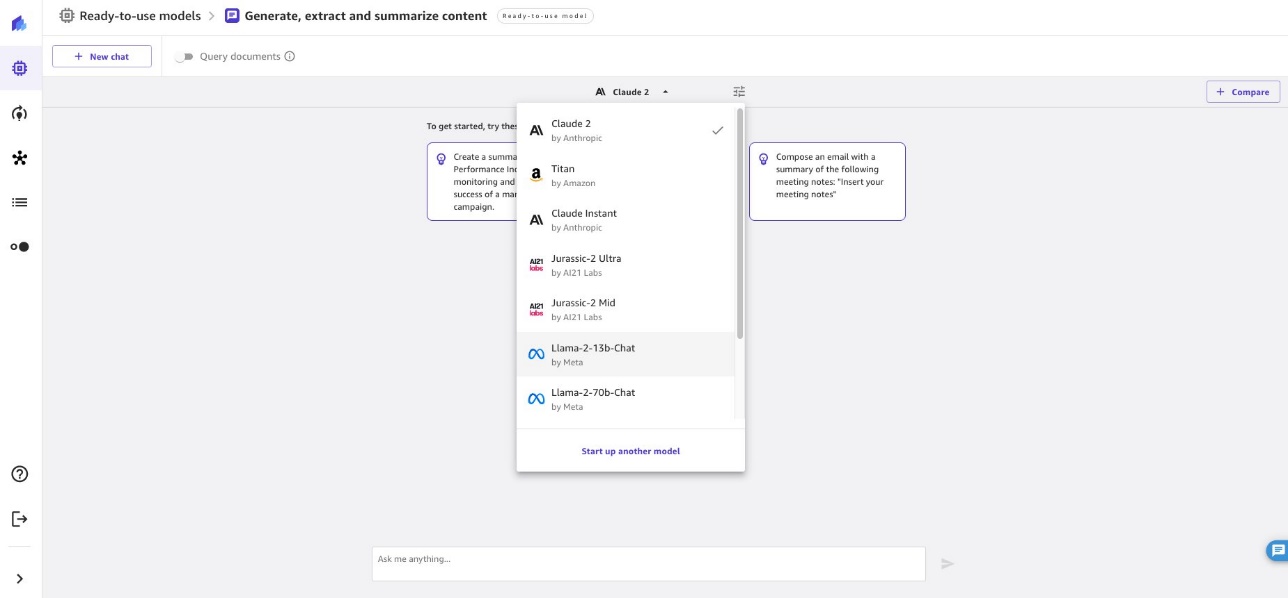

For at teste disse modeller skal du navigere til SageMaker Canvas Klar til brug modeller side, og vælg derefter Generer, udtræk og opsummer indhold. Det er her, du finder SageMaker Canvas GenAI-chatoplevelsen. Her kan du bruge enhver model fra Amazon Bedrock eller SageMaker JumpStart ved at vælge dem i rullemenuen for modellen.

I vores tilfælde vælger vi en af Llama 2-modellerne. Nu kan du give dit input eller forespørgsel. Mens du sender inputtet, sender SageMaker Canvas dit input videre til modellen.

At vælge hvilken af de tilgængelige modeller i SageMaker Canvas, der passer bedst til din brug, kræver, at du tager hensyn til oplysninger om selve modellerne: Llama-2-70B-chat-modellen er en større model (70 milliarder parametre sammenlignet med 13 milliarder med Llama-2-13B-chat ), hvilket betyder, at dens ydeevne generelt er højere end den mindre, på bekostning af en lidt højere latenstid og en øget pris pr. token. Mistral-7B har præstationer, der kan sammenlignes med Llama-2-7B eller Llama-2-13B, men den er hostet på Amazon SageMaker. Det betyder, at prismodellen er anderledes, idet den bevæger sig fra en dollar-per-token-prismodel til en dollar-per-time-model. Dette kan være mere omkostningseffektivt med et betydeligt antal anmodninger i timen og en ensartet brug i stor skala. Alle ovenstående modeller kan klare sig godt på en række forskellige anvendelsessager, så vores forslag er at vurdere, hvilken model der bedst løser dit problem under hensyntagen til output, gennemløb og omkostninger.

Hvis du leder efter en ligetil måde at sammenligne, hvordan modeller opfører sig på, tilbyder SageMaker Canvas denne egenskab i form af modelsammenligninger. Du kan vælge op til tre forskellige modeller og sende den samme forespørgsel til dem alle på én gang. SageMaker Canvas vil derefter få svarene fra hver af modellerne og vise dem i en side-by-side chat-brugergrænseflade. For at gøre dette skal du vælge Sammenlign og vælg andre modeller at sammenligne med, som vist nedenfor:

Introduktion af responsstreaming: Interaktioner i realtid og forbedret ydeevne

Et af de vigtigste fremskridt i denne udgivelse er introduktionen af streamede svar. Streamingen af svar giver en rigere oplevelse for brugeren og afspejler bedre en chatoplevelse. Med streamingsvar kan brugere modtage øjeblikkelig feedback og problemfri integration i deres chatbot-applikationer. Dette giver mulighed for en mere interaktiv og responsiv oplevelse, hvilket forbedrer chatbot'ens overordnede ydeevne og brugertilfredshed. Evnen til at modtage øjeblikkelige svar på en chat-lignende måde skaber et mere naturligt samtaleflow og forbedrer brugeroplevelsen.

Med denne funktion kan du nu interagere med dine AI-modeller i realtid, modtage øjeblikkelige svar og muliggøre problemfri integration i en række applikationer og arbejdsgange. Alle modeller, der kan forespørges i SageMaker Canvas – fra Amazon Bedrock og SageMaker JumpStart – kan streame svar til brugeren.

Kom i gang i dag

Uanset om du bygger en chatbot, et anbefalingssystem eller en virtuel assistent, giver Llama 2- og Mistral-modellerne kombineret med streamede svar forbedret ydeevne og interaktivitet til dine projekter.

For at bruge de nyeste funktioner i SageMaker Canvas skal du sørge for at slette og genskabe appen. For at gøre det skal du logge ud fra appen ved at vælge Log ud, og åbn derefter SageMaker Canvas igen. Du bør se de nye modeller og nyde de seneste udgivelser. Hvis du logger ud af SageMaker Canvas-applikationen, frigives alle ressourcer, der bruges af arbejdsområdeforekomsten, og undgår derfor at pådrage sig yderligere utilsigtede omkostninger.

Konklusion

For at komme i gang med de nye streamede svar til Llama 2- og Mistral-modellerne i SageMaker Canvas, besøg SageMaker konsol og udforsk den intuitive grænseflade. For at lære mere om, hvordan SageMaker Canvas og generativ AI kan hjælpe dig med at nå dine forretningsmål, se Giv dine forretningsbrugere mulighed for at udtrække indsigt fra virksomhedens dokumenter ved hjælp af Amazon SageMaker Canvas og Generative AI , Overvinde almindelige kontaktcenterudfordringer med generativ AI og Amazon SageMaker Canvas.

Hvis du vil lære mere om SageMaker Canvas-funktioner og dybtgående dyk i andre ML-brugssager, så tjek de andre tilgængelige indlæg i SageMaker Canvas kategori fra AWS ML-bloggen. Vi kan ikke vente med at se de fantastiske AI-applikationer, du vil skabe med disse nye muligheder!

Om forfatterne

Davide Gallitelli er Senior Specialist Solutions Architect for AI/ML. Han er baseret i Bruxelles og arbejder tæt sammen med kunder over hele kloden, der ønsker at anvende Low-Code/No-Code Machine Learning-teknologier og Generativ AI. Han har været udvikler, siden han var meget ung, og begyndte at kode i en alder af 7. Han begyndte at lære AI/ML på universitetet, og er blevet forelsket i det siden da.

Davide Gallitelli er Senior Specialist Solutions Architect for AI/ML. Han er baseret i Bruxelles og arbejder tæt sammen med kunder over hele kloden, der ønsker at anvende Low-Code/No-Code Machine Learning-teknologier og Generativ AI. Han har været udvikler, siden han var meget ung, og begyndte at kode i en alder af 7. Han begyndte at lære AI/ML på universitetet, og er blevet forelsket i det siden da.

Dan Sinnreich er Senior Product Manager hos AWS, der hjælper med at demokratisere lav-kode/no-code maskinlæring. Før AWS byggede og kommercialiserede Dan enterprise SaaS-platforme og tidsseriemodeller, der blev brugt af institutionelle investorer til at styre risiko og konstruere optimale porteføljer. Uden for arbejdet kan du finde ham, der spiller hockey, dykning og læser science fiction.

Dan Sinnreich er Senior Product Manager hos AWS, der hjælper med at demokratisere lav-kode/no-code maskinlæring. Før AWS byggede og kommercialiserede Dan enterprise SaaS-platforme og tidsseriemodeller, der blev brugt af institutionelle investorer til at styre risiko og konstruere optimale porteføljer. Uden for arbejdet kan du finde ham, der spiller hockey, dykning og læser science fiction.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/announcing-support-for-llama-2-models-and-streaming-responses-in-amazon-sagemaker-canvas/

- :har

- :er

- :hvor

- $OP

- 100

- 13

- 2021

- 7

- 70

- a

- evne

- Om

- over

- Konto

- opnå

- Yderligere

- vedtage

- fremskridt

- igen

- mod

- alder

- AI

- AI modeller

- AI-drevne

- AI / ML

- Alle

- tillader

- forbløffende

- Amazon

- Amazon SageMaker

- Amazon SageMaker lærred

- Amazon Web Services

- blandt

- beløb

- an

- ,

- Annoncere

- Annoncerer

- svar

- enhver

- app

- Anvendelse

- applikationer

- ER

- omkring

- AS

- Assistant

- At

- opmærksomhed

- til rådighed

- undgå

- AWS

- baseret

- BE

- været

- jf. nedenstående

- fordele

- BEDSTE

- Bedre

- større

- Billion

- Blog

- bringe

- Bruxelles

- bygge

- Bygning

- bygget

- virksomhed

- by

- CAN

- canvas

- kapaciteter

- kapacitet

- stand

- tilfælde

- tilfælde

- center

- udfordringer

- afgifter

- chatte

- chatbot

- kontrollere

- Vælg

- vælge

- nøje

- kode

- SAMMENHÆNGENDE

- kombineret

- Fælles

- samfund

- selskab

- sammenlignelig

- sammenligne

- sammenlignet

- sammenligninger

- Overvejer

- konsekvent

- konstruere

- kontakt

- kontaktcenter

- indhold

- Indholdsgenerering

- fortsætter

- Samtale

- samtaler

- Koste

- skabe

- skaber

- Kunder

- banebrydende

- dyb

- dyb dykke

- demokratisere

- implementering

- udviklet

- Udvikler

- forskellige

- diskutere

- dyk

- dykning

- do

- dokumenter

- hver

- Effektiv

- effektiv

- bemyndige

- muliggøre

- muliggør

- engagerende

- forbedret

- styrke

- nyde

- Enterprise

- evaluere

- alle

- ophidset

- spændende

- eksisterende

- erfaring

- udforske

- ekstrakt

- Fallen

- hurtigere

- Feature

- Funktionalitet

- tilbagemeldinger

- Fiktion

- Finde

- passer

- flow

- Til

- formular

- fundet

- Foundation

- Fransk

- fra

- genai

- generelt

- generere

- generation

- generative

- Generativ AI

- få

- kloden

- Mål

- Have

- he

- hjælpe

- hjælpe

- link.

- højere

- stærkt

- hostede

- time

- Hvordan

- Men

- HTTPS

- umiddelbar

- forbedret

- forbedrer

- in

- øget

- oplysninger

- indgang

- indsigt

- instans

- øjeblikkelig

- Institutionel

- Institutionelle investorer

- integration

- interagere

- interaktioner

- interaktiv

- interaktivitet

- grænseflade

- ind

- Introduktion

- intuitiv

- Investorer

- IT

- ITS

- jpg

- Nøgle

- Sprog

- stor

- Latency

- seneste

- Seneste opdateringer

- lancere

- førende

- LÆR

- læring

- Line (linje)

- Llama

- log

- logning

- leder

- kærlighed

- maskine

- machine learning

- lave

- Making

- administrere

- leder

- måde

- meningsfuld

- midler

- Menu

- Meta

- ML

- model

- modeller

- mere

- flytning

- indbygget

- Natural

- Naviger

- Behov

- Ny

- Noter

- nu

- nummer

- of

- Tilbud

- on

- engang

- ONE

- åbent

- open source

- optimal

- or

- Andet

- vores

- ud

- output

- uden for

- samlet

- egen

- side

- parametre

- per

- Udfør

- ydeevne

- forestillinger

- udfører

- billede

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- porteføljer

- Indlæg

- Indlæg

- vigtigste

- tidligere

- prissætning

- prisfastsættelsesmodel

- Problem

- Produkt

- produktchef

- projekter

- give

- giver

- query

- rækkevidde

- Læsning

- ægte

- realtid

- modtage

- modtaget

- modtagende

- Anbefaling

- henvise

- afspejler

- frigive

- Udgivelser

- rapporteret

- anmodninger

- Kræver

- Ressourcer

- svar

- reaktioner

- lydhør

- rigere

- Risiko

- SaaS

- sagemaker

- samme

- tilfredshed

- Skalerbarhed

- Scale

- Videnskab

- Science Fiction

- sømløs

- se

- Vælg

- udvælgelse

- send

- senior

- tjeneste

- Tjenester

- bør

- Vis

- vist

- signifikant

- siden

- enkelt

- mindre

- So

- Løsninger

- Løser

- Kilde

- specialist

- Opstart

- påbegyndt

- Starter

- state-of-the-art

- ligetil

- strøm

- streamet

- streaming

- sådan

- opsummere

- support

- Understøtter

- sikker

- systemet

- Tag

- opgaver

- Teknologier

- prøve

- Tak

- at

- deres

- Them

- selv

- derefter

- derfor

- Disse

- denne

- tre

- begejstret

- kapacitet

- tid

- gange

- til

- i dag

- token

- To gange

- to

- ui

- universitet

- opdateringer

- Brug

- brug

- brug tilfælde

- anvendte

- Bruger

- Brugererfaring

- brugere

- ved brug af

- række

- alsidighed

- meget

- Virtual

- virtuel assistent

- Besøg

- visuel

- vente

- ønsker

- ønsker

- var

- Vej..

- we

- web

- webservices

- GODT

- som

- bred

- Bred rækkevidde

- vilje

- med

- uden

- Arbejde

- arbejdsgange

- virker

- skriver

- skrivning

- Du

- unge

- Din

- zephyrnet