I nutidens informationsalder udgør de enorme mængder af data, der er indeholdt i utallige dokumenter, både en udfordring og en mulighed for virksomheder. Traditionelle dokumentbehandlingsmetoder mangler ofte i effektivitet og nøjagtighed, hvilket giver plads til innovation, omkostningseffektivitet og optimeringer. Dokumentbehandling har været vidne til betydelige fremskridt med fremkomsten af Intelligent Document Processing (IDP). Med IDP kan virksomheder transformere ustrukturerede data fra forskellige dokumenttyper til strukturerede, handlingsrettede indsigter, hvilket dramatisk forbedrer effektiviteten og reducerer den manuelle indsats. Potentialet stopper dog ikke der. Ved at integrere generativ kunstig intelligens (AI) i processen kan vi forbedre IDP-kapaciteten yderligere. Generativ AI introducerer ikke kun forbedrede muligheder inden for dokumentbehandling, den introducerer også en dynamisk tilpasningsevne til skiftende datamønstre. Dette indlæg fører dig gennem synergien mellem IDP og generativ kunstig intelligens og afslører, hvordan de repræsenterer den næste grænse inden for dokumentbehandling.

Vi diskuterer IDP i detaljer i vores serie Intelligent dokumentbehandling med AWS AI-tjenester (del 1 , del 2). I dette indlæg diskuterer vi, hvordan man kan udvide en ny eller eksisterende IDP-arkitektur med store sprogmodeller (LLM'er). Mere specifikt diskuterer vi, hvordan vi kan integrere amazontekst med Langkæde som dokumentindlæser og Amazonas grundfjeld at udtrække data fra dokumenter og bruge generative AI-kapaciteter inden for de forskellige IDP-faser.

Amazon Textract er en maskinlæringstjeneste (ML), der automatisk udtrækker tekst, håndskrift og data fra scannede dokumenter. Amazon Bedrock er en fuldt administreret tjeneste, der tilbyder et udvalg af højtydende fundamentmodeller (FM'er) gennem brugervenlige API'er.

Følgende diagram er en referencearkitektur på højt niveau, der forklarer, hvordan du yderligere kan forbedre en IDP-arbejdsgang med fundamentmodeller. Du kan bruge LLM'er i en eller alle faser af IDP afhængigt af use casen og det ønskede resultat.

I de følgende afsnit dykker vi dybt ned i, hvordan Amazon Textract er integreret i generative AI-arbejdsgange ved hjælp af LangChain til at behandle dokumenter til hver af disse specifikke opgaver. Kodeblokkene, der er angivet her, er blevet skåret ned for kortheds skyld. Se vores GitHub repository for detaljerede Python-notebooks og en trin-for-trin gennemgang.

Tekstudtræk fra dokumenter er et afgørende aspekt, når det kommer til behandling af dokumenter med LLM'er. Du kan bruge Amazon Textract til at udtrække ustruktureret rå tekst fra dokumenter og bevare de originale semi-strukturerede eller strukturerede objekter som nøgleværdi-par og tabeller, der findes i dokumentet. Dokumentpakker som sundheds- og forsikringskrav eller realkreditlån består af komplekse formularer, der indeholder en masse information på tværs af strukturerede, semistrukturerede og ustrukturerede formater. Dokumentudtrækning er et vigtigt skridt her, fordi LLM'er drager fordel af det rige indhold til at generere mere nøjagtige og relevante svar, som ellers kunne påvirke kvaliteten af LLM'ernes output.

LangChain er en kraftfuld open source-ramme til integration med LLM'er. LLM'er er generelt alsidige, men kan kæmpe med domænespecifikke opgaver, hvor der er behov for dybere kontekst og nuancerede svar. LangChain giver udviklere i sådanne scenarier mulighed for at bygge agenter, der kan opdele komplekse opgaver i mindre underopgaver. Underopgaverne kan derefter introducere kontekst og hukommelse i LLM'er ved at forbinde og kæde LLM-prompter.

LangChain tilbyder dokumentindlæsere der kan indlæse og transformere data fra dokumenter. Du kan bruge dem til at strukturere dokumenter i foretrukne formater, der kan behandles af LLM'er. Det AmazonTextractPDFLoader er en serviceindlæser type dokumentindlæser, der giver hurtig måde at automatisere dokumentbehandling ved at bruge Amazon Textract i kombination med LangChain. For flere detaljer vedr AmazonTextractPDFLoader, henvises til Langkæde dokumentation. For at bruge Amazon Textract-dokumentindlæseren starter du med at importere den fra LangChain-biblioteket:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Du kan også gemme dokumenter i Amazon S3 og henvise til dem ved hjælp af s3:// URL-mønsteret, som forklaret i Adgang til en spand ved hjælp af S3://, og send denne S3-sti til Amazon Textract PDF-indlæseren:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Et flersidet dokument vil indeholde flere sider med tekst, som derefter kan tilgås via dokumentobjektet, som er en liste over sider. Følgende kode går gennem siderne i dokumentobjektet og udskriver dokumentteksten, som er tilgængelig via page_content attribut:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend og LLM'er kan effektivt bruges til dokumentklassificering. Amazon Comprehend er en NLP-tjeneste (natural language processing), der bruger ML til at udtrække indsigt fra tekst. Amazon Comprehend understøtter også tilpasset klassificeringsmodeltræning med layoutbevidsthed på dokumenter som PDF'er, Word og billedformater. For mere information om brug af Amazon Comprehend-dokumentklassificeringen, se Amazon Comprehend dokumentklassificering tilføjer layoutunderstøttelse for højere nøjagtighed.

Når det parres med LLM'er, bliver dokumentklassificering en kraftfuld tilgang til håndtering af store mængder dokumenter. LLM'er er nyttige i dokumentklassificering, fordi de kan analysere teksten, mønstrene og kontekstuelle elementer i dokumentet ved hjælp af naturlig sprogforståelse. Du kan også finjustere dem til specifikke dokumentklasser. Når en ny dokumenttype introduceret i IDP-pipelinen skal klassificeres, kan LLM behandle tekst og kategorisere dokumentet givet et sæt klasser. Følgende er en eksempelkode, der bruger LangChain-dokumentindlæseren drevet af Amazon Textract til at udtrække teksten fra dokumentet og bruge den til at klassificere dokumentet. Vi bruger Antropiske Claude v2 model via Amazon Bedrock for at udføre klassificeringen.

I det følgende eksempel udtrækker vi først tekst fra en patientudskrivningsrapport og bruger en LLM til at klassificere den givet en liste over tre forskellige dokumenttyper—DISCHARGE_SUMMARY, RECEIPTog PRESCRIPTION. Følgende skærmbillede viser vores rapport.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Opsummering indebærer at kondensere en given tekst eller et dokument til en kortere version, mens dens nøgleoplysninger bevares. Denne teknik er gavnlig for effektiv informationssøgning, som gør det muligt for brugere hurtigt at forstå nøglepunkterne i et dokument uden at læse hele indholdet. Selvom Amazon Textract ikke direkte udfører tekstresumé, giver det de grundlæggende muligheder for at udtrække hele teksten fra dokumenter. Denne udtrukne tekst tjener som input til vores LLM-model til udførelse af tekstresuméopgaver.

Ved at bruge den samme prøveudskrivningsrapport, bruger vi AmazonTextractPDFLoader for at udtrække tekst fra dette dokument. Som før bruger vi Claude v2-modellen via Amazon Bedrock og initialiserer den med en prompt, der indeholder instruktionerne om, hvad man skal gøre med teksten (i dette tilfælde opsummering). Til sidst kører vi LLM-kæden ved at sende den udtrukne tekst fra dokumentindlæseren. Dette kører en slutningshandling på LLM med prompten, der består af instruktionerne til at opsummere, og dokumentets tekst markeret med Document. Se følgende kode:

Koden genererer resuméet af en patientudskrivningsrapport:

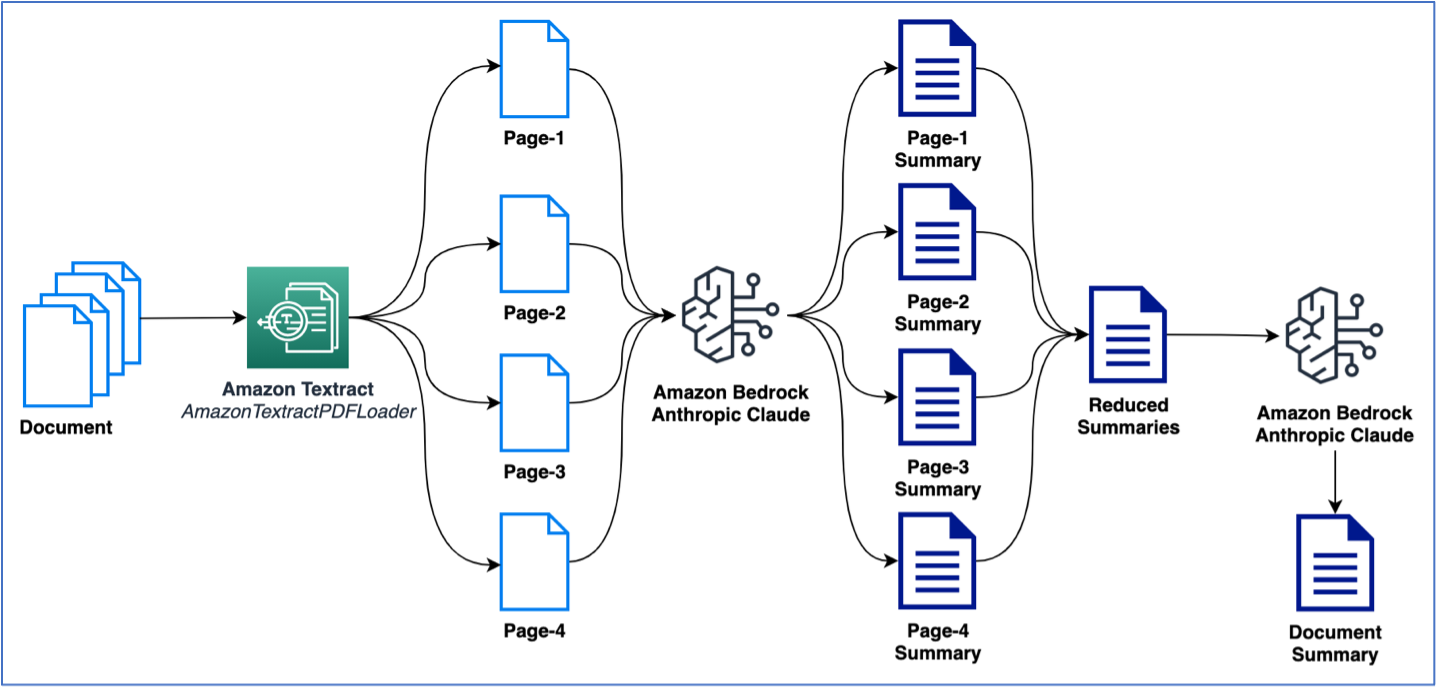

Det foregående eksempel brugte et enkeltsidet dokument til at udføre opsummering. Du vil dog sandsynligvis beskæftige dig med dokumenter, der indeholder flere sider, der skal opsummeres. En almindelig måde at udføre opsummeringer på flere sider er først at generere resuméer på mindre bidder af tekst og derefter kombinere de mindre resuméer for at få et endeligt resumé af dokumentet. Bemærk, at denne metode kræver flere opkald til LLM. Logikken for dette kan nemt udformes; LangChain har dog en indbygget opsummeringskæde, der kan opsummere store tekster (fra flersidede dokumenter). Opsummeringen kan ske enten via map_reduce eller med stuff muligheder, som er tilgængelige som muligheder for at administrere de flere opkald til LLM. I det følgende eksempel bruger vi map_reduce at opsummere et flersidet dokument. Følgende figur illustrerer vores arbejdsgang.

Lad os først starte med at udtrække dokumentet og se det samlede antal tokens pr. side og det samlede antal sider:

Dernæst bruger vi LangChains indbyggede load_summarize_chain for at opsummere hele dokumentet:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Standardisering og Q&A

I dette afsnit diskuterer vi standardisering og Q&A-opgaver.

Standardisering

Outputstandardisering er en tekstgenereringsopgave, hvor LLM'er bruges til at give en ensartet formatering af outputteksten. Denne opgave er især nyttig til automatisering af udtræk af nøgleenheder, der kræver, at outputtet er tilpasset de ønskede formater. For eksempel kan vi følge hurtige tekniske bedste praksisser for at finjustere en LLM til at formatere datoer til MM/DD/ÅÅÅÅ-format, som kan være kompatibelt med en database DATO-kolonne. Den følgende kodeblok viser et eksempel på, hvordan dette gøres ved hjælp af en LLM og prompt engineering. Vi standardiserer ikke kun outputformatet for datoværdierne, vi beder også modellen om at generere det endelige output i et JSON-format, så det nemt kan forbruges i vores downstream-applikationer. Vi bruger LangChain Expression Language (LCEL) for at kæde to handlinger sammen. Den første handling beder LLM om at generere et output i JSON-format med kun datoerne fra dokumentet. Den anden handling tager JSON-outputtet og standardiserer datoformatet. Bemærk, at denne to-trins handling også kan udføres i et enkelt trin med korrekt prompt engineering, som vi vil se i normalisering og skabelon.

Outputtet af den foregående kodeeksempel er en JSON-struktur med datoer 07/09/2020 og 08/09/2020, som er i formatet DD/MM/ÅÅÅÅ og er henholdsvis patientens indlæggelses- og udskrivelsesdato fra hospitalet, iht. til den sammenfattende rapport om decharge.

Q&A med Retrieval Augmented Generation

LLM'er er kendt for at beholde faktuelle oplysninger, ofte omtalt som deres verdensviden eller verdenssyn. Når de er finjusteret, kan de producere state-of-the-art resultater. Der er dog begrænsninger for, hvor effektivt en LLM kan få adgang til og manipulere denne viden. Som et resultat, i opgaver, der i høj grad er afhængige af specifik viden, er deres ydeevne muligvis ikke optimal til visse anvendelsestilfælde. For eksempel i spørgsmål og svar-scenarier er det vigtigt, at modellen nøje overholder den kontekst, der er angivet i dokumentet uden udelukkende at stole på sin verdensviden. Afvigelse fra dette kan føre til forkerte fremstillinger, unøjagtigheder eller endda forkerte svar. Den mest almindeligt anvendte metode til at løse dette problem er kendt som Retrieval Augmented Generation (KLUD). Denne tilgang synergerer styrkerne ved både genfindingsmodeller og sprogmodeller, hvilket forbedrer præcisionen og kvaliteten af de genererede svar.

LLM'er kan også pålægge token-begrænsninger på grund af deres hukommelsesbegrænsninger og begrænsningerne af den hardware, de kører på. For at håndtere dette problem bruges teknikker som chunking til at opdele store dokumenter i mindre portioner, der passer inden for token-grænserne for LLM'er. På den anden side anvendes indlejringer i NLP primært til at fange den semantiske betydning af ord og deres relationer til andre ord i et højdimensionelt rum. Disse indlejringer omdanner ord til vektorer, hvilket giver modeller mulighed for effektivt at behandle og forstå tekstdata. Ved at forstå de semantiske nuancer mellem ord og sætninger gør indlejringer det muligt for LLM'er at generere sammenhængende og kontekstuelt relevante output. Bemærk følgende nøgleord:

- chunking – Denne proces nedbryder store mængder tekst fra dokumenter til mindre, meningsfulde bidder af tekst.

- indlejringerne - Disse er fastdimensionelle vektortransformationer af hver chunk, der bevarer den semantiske information fra chunks. Disse indlejringer indlæses efterfølgende i en vektordatabase.

- Vektor database – Dette er en database med ordindlejringer eller vektorer, der repræsenterer ords kontekst. Det fungerer som en videnskilde, der hjælper med NLP-opgaver i dokumentbehandlingspipelines. Fordelen ved vektordatabasen her er, at den kun tillader den nødvendige kontekst at blive leveret til LLM'erne under tekstgenerering, som vi forklarer i det følgende afsnit.

RAG bruger indlejringskraften til at forstå og hente relevante dokumentsegmenter under genfindingsfasen. Ved at gøre det kan RAG arbejde inden for token-begrænsningerne for LLM'er og sikre, at den mest relevante information udvælges til generering, hvilket resulterer i mere nøjagtige og kontekstuelt relevante output.

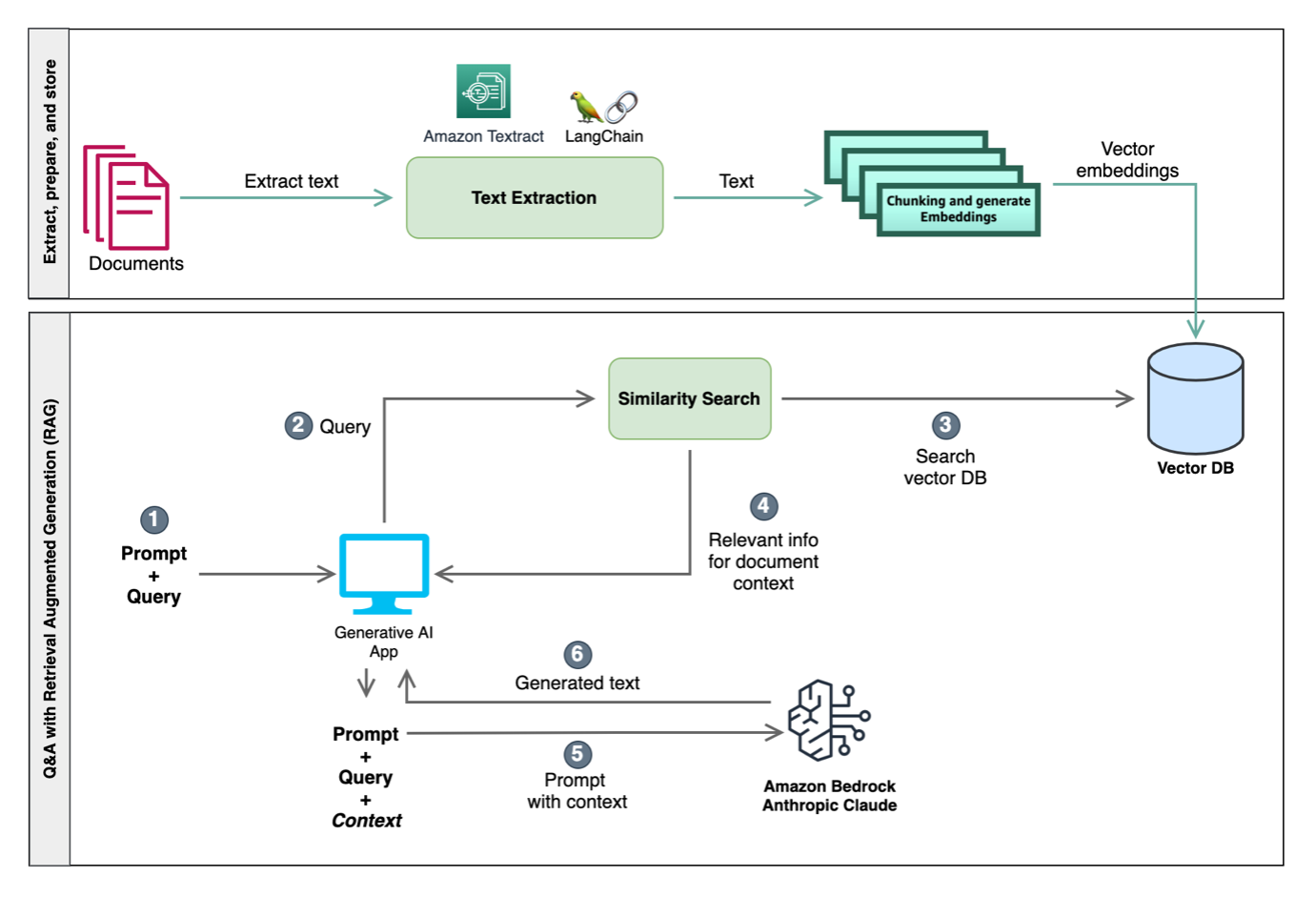

Følgende diagram illustrerer integrationen af disse teknikker til at skabe input til LLM'er, hvilket forbedrer deres kontekstuelle forståelse og muliggør mere relevante in-tekstsvar. En tilgang involverer lighedssøgning ved at bruge både en vektordatabase og chunking. Vektordatabasen gemmer indlejringer, der repræsenterer semantisk information, og chunking opdeler tekst i håndterbare sektioner. Ved at bruge denne kontekst fra lighedssøgning kan LLM'er køre opgaver såsom spørgsmålsbesvarelse og domænespecifikke operationer som klassificering og berigelse.

Til dette indlæg bruger vi en RAG-baseret tilgang til at udføre Q&A i kontekst med dokumenter. I det følgende kodeeksempel udtrækker vi tekst fra et dokument og deler derefter dokumentet op i mindre bidder af tekst. Chunking er påkrævet, fordi vi kan have store flersidede dokumenter, og vores LLM'er kan have token-grænser. Disse bidder indlæses derefter i vektordatabasen for at udføre lighedssøgning i de efterfølgende trin. I det følgende eksempel bruger vi Amazon Titan Embed Text v1-modellen, som udfører vektorindlejring af dokumentstykkerne:

Koden skaber en relevant kontekst for LLM'et ved hjælp af de bidder af tekst, der returneres af lighedssøgningshandlingen fra vektordatabasen. Til dette eksempel bruger vi en open source FAISS vektor butik som en eksempelvektordatabase til at gemme vektorindlejringer af hver tekstklump. Vi definerer derefter vektordatabasen som en LangChain retriever, som overføres til RetrievalQA kæde. Dette kører internt en lighedssøgeforespørgsel på vektordatabasen, der returnerer de øverste n (hvor n=3 i vores eksempel) tekststykker, der er relevante for spørgsmålet. Til sidst køres LLM-kæden med den relevante kontekst (en gruppe af relevante bidder af tekst) og spørgsmålet, som LLM skal besvare. For en trin-for-trin kodegennemgang af Q&A med RAG, se Python-notesbogen på GitHub.

Som et alternativ til FAISS kan du også bruge Amazon OpenSearch Service vektordatabasefunktioner, Amazon Relational Database Service (Amazon RDS) til PostgreSQL med pgvektor udvidelse som vektordatabaser eller open source Chroma-database.

Spørgsmål og svar med tabeldata

Tabeldata i dokumenter kan være udfordrende for LLM'er at behandle på grund af deres strukturelle kompleksitet. Amazon Textract kan udvides med LLM'er, fordi det gør det muligt at udtrække tabeller fra dokumenter i et indlejret format af elementer såsom side, tabel og celler. Udførelse af Q&A med tabeldata er en proces i flere trin og kan opnås via selvforespørgende. Følgende er en oversigt over trinene:

- Uddrag tabeller fra dokumenter ved hjælp af Amazon Textract. Med Amazon Textract kan tabelstrukturen (rækker, kolonner, overskrifter) udtrækkes fra et dokument.

- Gem tabeldataene i en vektordatabase sammen med metadataoplysninger, såsom headernavne og beskrivelsen af hver header.

- Brug prompten til at konstruere en struktureret forespørgsel ved hjælp af en LLM til at udlede dataene fra tabellen.

- Brug forespørgslen til at udtrække de relevante tabeldata fra vektordatabasen.

For eksempel, i et kontoudtog, givet prompten "Hvad er transaktionerne med mere end $1000 i indskud", vil LLM fuldføre følgende trin:

- Lav en forespørgsel, som f.eks

“Query: transactions” , “filter: greater than (Deposit$)”. - Konverter forespørgslen til en struktureret forespørgsel.

- Anvend den strukturerede forespørgsel på vektordatabasen, hvor vores tabeldata er gemt.

For en trin-for-trin eksempelkodegennemgang af Q&A med tabel, se Python-notesbogen i GitHub.

Skabeloner og normaliseringer

I dette afsnit ser vi på, hvordan man bruger prompt ingeniørteknikker og LangChains indbyggede mekanisme til at generere et output med udtræk fra et dokument i et specificeret skema. Vi udfører også en vis standardisering af de udtrukne data ved hjælp af de teknikker, der er diskuteret tidligere. Vi starter med at definere en skabelon for vores ønskede output. Dette vil tjene som et skema og indkapsle detaljerne om hver enhed, vi ønsker at udtrække fra dokumentets tekst.

Bemærk, at for hver af enhederne bruger vi beskrivelsen til at forklare, hvad denne enhed er, for at hjælpe LLM med at udtrække værdien fra dokumentets tekst. I den følgende eksempelkode bruger vi denne skabelon til at lave vores prompt til LLM sammen med teksten udtrukket fra dokumentet ved hjælp af AmazonTextractPDFLoader og derefter udføre inferens med modellen:

Som du kan se, det {keys} en del af prompten er nøglerne fra vores skabelon og {details} er nøglerne sammen med deres beskrivelse. I dette tilfælde beder vi ikke modellen eksplicit om outputformatet udover at angive i instruktionen om at generere output i JSON-format. Dette virker for det meste; men fordi outputtet fra LLM'er er ikke-deterministisk tekstgenerering, ønsker vi at specificere formatet eksplicit som en del af instruktionen i prompten. For at løse dette kan vi bruge LangChain's struktureret outputparser modul for at drage fordel af den automatiserede promptteknik, der hjælper med at konvertere vores skabelon til en formatinstruktionsprompt. Vi bruger skabelonen defineret tidligere til at generere formatinstruktionsprompten som følger:

Vi bruger derefter denne variabel i vores oprindelige prompt som en instruktion til LLM, så den udtrækker og formaterer outputtet i det ønskede skema ved at lave en lille ændring af vores prompt:

Indtil videre har vi kun trukket dataene ud af dokumentet i et ønsket skema. Vi mangler dog stadig at udføre en vis standardisering. Eksempelvis ønsker vi, at patientens indlæggelsesdato og udskrivelsesdato udtrækkes i DD/MM/ÅÅÅÅ format. I dette tilfælde forstærker vi description af nøglen med formateringsinstruktionen:

Se Python-notesbogen i GitHub for en komplet trin-for-trin gennemgang og forklaring.

Stavekontrol og rettelser

LLM'er har vist bemærkelsesværdige evner til at forstå og generere menneskelignende tekst. En af de mindre diskuterede, men uhyre nyttige anvendelser af LLM'er, er deres potentiale i grammatiske kontroller og sætningskorrektion i dokumenter. I modsætning til traditionelle grammatikkontrollere, der er afhængige af et sæt foruddefinerede regler, bruger LLM'er mønstre, som de har identificeret fra enorme mængder tekstdata til at bestemme, hvad der udgør et korrekt eller flydende sprog. Det betyder, at de kan opdage nuancer, kontekst og finesser, som regelbaserede systemer måske går glip af.

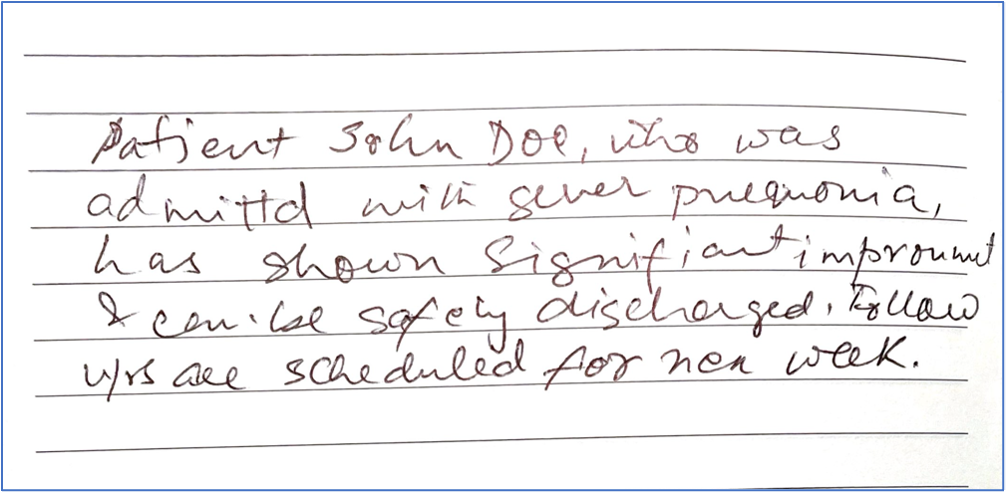

Forestil dig teksten uddraget fra et resumé af patientudskrivning, der lyder "Patienten Jon Doe, der blev indlagt med svær lungebetændelse, har vist betydelig forbedring og kan udskrives sikkert. Opfølgning er planlagt til næste uge." En traditionel stavekontrol kan genkende "admittd", "lungebetændelse", "forbedring" og "nex" som fejl. Konteksten af disse fejl kan dog føre til yderligere fejl eller generiske forslag. En LLM, udstyret med dens omfattende uddannelse, kunne foreslå: "Patienten John Doe, som blev indlagt med svær lungebetændelse, har vist betydelig forbedring og kan udskrives sikkert. Der er planlagt opfølgning i næste uge."

Det følgende er et dårligt håndskrevet eksempeldokument med samme tekst som forklaret tidligere.

Vi udtrækker dokumentet med en Amazon Textract-dokumentindlæser og instruerer derefter LLM, via prompt engineering, om at rette den udpakkede tekst for at rette eventuelle stave- og/eller grammatiske fejl:

Outputtet af den foregående kode viser den originale tekst udtrukket af dokumentindlæseren efterfulgt af den korrigerede tekst, der er genereret af LLM:

Husk, at lige så kraftfulde som LLM'er er, er det vigtigt at se deres forslag som netop det – forslag. Selvom de fanger sprogets forviklinger imponerende godt, er de ikke ufejlbarlige. Nogle forslag kan ændre den tilsigtede betydning eller tone i den originale tekst. Derfor er det afgørende for menneskelige anmeldere at bruge LLM-genererede rettelser som en guide, ikke en absolut. Samarbejdet mellem menneskelig intuition og LLM-kapaciteter lover en fremtid, hvor vores skriftlige kommunikation ikke bare er fejlfri, men også rigere og mere nuanceret.

Konklusion

Generativ AI ændrer, hvordan du kan behandle dokumenter med IDP for at opnå indsigt. I indlægget Forbedring af AWS intelligent dokumentbehandling med generativ AI, vi diskuterede de forskellige stadier af pipelinen, og hvordan AWS-kunden Ricoh forbedrer deres IDP-pipeline med LLM'er. I dette indlæg diskuterede vi forskellige mekanismer til at øge IDP-arbejdsgangen med LLM'er via Amazon Bedrock, Amazon Textract og den populære LangChain-ramme. Du kan komme i gang med den nye Amazon Textract-dokumentindlæser med LangChain i dag ved at bruge de eksempler på notesbøger, der er tilgængelige i vores GitHub repository. For mere information om at arbejde med generativ AI på AWS, se Annoncering af nye værktøjer til bygning med generativ AI på AWS.

Om forfatterne

Sonali Sahu leder intelligent dokumentbehandling med AI/ML-serviceteamet i AWS. Hun er forfatter, tankeleder og passioneret teknolog. Hendes kernefokusområde er AI og ML, og hun taler ofte ved AI- og ML-konferencer og -møder rundt om i verden. Hun har både bred og dybdegående erfaring inden for teknologi og teknologiindustrien, med brancheekspertise inden for sundhedspleje, finanssektoren og forsikring.

Sonali Sahu leder intelligent dokumentbehandling med AI/ML-serviceteamet i AWS. Hun er forfatter, tankeleder og passioneret teknolog. Hendes kernefokusområde er AI og ML, og hun taler ofte ved AI- og ML-konferencer og -møder rundt om i verden. Hun har både bred og dybdegående erfaring inden for teknologi og teknologiindustrien, med brancheekspertise inden for sundhedspleje, finanssektoren og forsikring.

Anjan Biswas er Senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del af det verdensomspændende AI-serviceteam og arbejder med kunder for at hjælpe dem med at forstå og udvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med at arbejde med globale forsyningskæder, fremstillings- og detailorganisationer og hjælper aktivt kunder med at komme i gang og skalere på AWS AI-tjenester.

Anjan Biswas er Senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del af det verdensomspændende AI-serviceteam og arbejder med kunder for at hjælpe dem med at forstå og udvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med at arbejde med globale forsyningskæder, fremstillings- og detailorganisationer og hjælper aktivt kunder med at komme i gang og skalere på AWS AI-tjenester.

Chinmayee Rane er AI/ML Specialist Solutions Architect hos Amazon Web Services. Hun brænder for anvendt matematik og maskinlæring. Hun fokuserer på at designe intelligent dokumentbehandling og generative AI-løsninger til AWS-kunder. Uden for arbejdet nyder hun salsa og bachata dans.

Chinmayee Rane er AI/ML Specialist Solutions Architect hos Amazon Web Services. Hun brænder for anvendt matematik og maskinlæring. Hun fokuserer på at designe intelligent dokumentbehandling og generative AI-løsninger til AWS-kunder. Uden for arbejdet nyder hun salsa og bachata dans.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :har

- :er

- :ikke

- :hvor

- . bilag

- $1000

- $OP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15 %

- 16

- 22

- 23

- 33

- 35 %

- 7

- 9

- a

- evner

- Om

- absolutte

- adgang

- af udleverede

- Ifølge

- nøjagtighed

- præcis

- opnået

- tværs

- Handling

- aktioner

- aktivt

- aktivitet

- handlinger

- Ad

- adresse

- Tilføjer

- klæbe

- indrømme

- indrømmede

- fremskridt

- Fordel

- advent

- alder

- midler

- AI

- AI-tjenester

- AI / ML

- justeret

- Alle

- tillade

- tillader

- sammen

- også

- alternativ

- Skønt

- Amazon

- Amazon Comprehend

- Amazon RDS

- amazontekst

- Amazon Web Services

- beløb

- an

- analytics

- analysere

- ,

- besvare

- Antropisk

- enhver

- API'er

- applikationer

- anvendt

- aftaler

- tilgang

- arkitektur

- ER

- OMRÅDE

- omkring

- Kunst

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- udseende

- hjælpe

- Assistant

- At

- forøge

- augmented

- forfatter

- automatisere

- Automatiseret

- automatisk

- Automation

- til rådighed

- bevidsthed

- AWS

- AWS kunde

- Bank

- BE

- fordi

- bliver

- været

- før

- gavnlig

- gavner det dig

- BEDSTE

- bedste praksis

- mellem

- Bloker

- Blocks

- både

- bredde

- Pause

- pauser

- bygge

- Bygning

- indbygget

- virksomhed

- virksomheder

- men

- by

- Opkald

- CAN

- Kan få

- kapaciteter

- fange

- tilfælde

- tilfælde

- Celler

- vis

- kæde

- kæder

- udfordre

- udfordrende

- lave om

- Ændringer

- skiftende

- Kontrol

- valg

- fordringer

- klasse

- klasser

- klassificering

- Klassificere

- kode

- SAMMENHÆNGENDE

- samarbejde

- Kolonne

- Kolonner

- kombination

- kombinerer

- kommer

- Fælles

- almindeligt

- Kommunikation

- kompatibel

- fuldføre

- komplekse

- kompleksitet

- forstå

- kortfattet

- konferencer

- Tilslutning

- konsekvent

- består

- begrænsninger

- konstruere

- indeholder

- indeholdt

- indeholder

- indhold

- sammenhæng

- kontekstuelle

- konvertere

- Core

- korrigere

- korrigeret

- Rettelser

- kunne

- håndværk

- udformet

- skaber

- afgørende

- skik

- kunde

- Kunder

- Dancing

- data

- Dataanalyse

- Database

- databaser

- Dato

- Datoer

- deal

- dyb

- dybere

- definere

- definerede

- definere

- demonstreret

- Afhængigt

- indskud

- dybde

- beskrevet

- beskrivelse

- designe

- ønskes

- detail

- detaljeret

- detaljer

- opdage

- Bestem

- udvikle

- udviklere

- Kost

- forskellige

- direkte

- diskutere

- drøftet

- dyk

- opdele

- skel

- do

- Doctor

- dokumentet

- dokumentation

- dokumenter

- doe

- Er ikke

- gør

- Don

- færdig

- Dont

- ned

- dramatisk

- grund

- i løbet af

- dynamisk

- e

- hver

- tidligere

- nemt

- nem at bruge

- effektivt

- effektivitet

- effektiv

- effektivt

- indsats

- enten

- elementer

- Integrer

- selvstændige

- bemyndiger

- muliggøre

- muliggør

- muliggør

- ende

- Engineering

- forbedre

- forbedret

- styrke

- sikre

- sikring

- Hele

- enheder

- enhed

- udstyret

- fejl

- væsentlig

- Endog

- eksempel

- Undtagen

- undtagelse

- eksisterende

- erfaring

- ekspertise

- Forklar

- forklarede

- Forklarer

- forklaring

- udtrykkeligt

- udtryk

- udvide

- udvidelse

- omfattende

- ekstrakt

- udvinding

- Uddrag

- Fall

- falsk

- langt

- træthed

- Fields

- Figur

- endelige

- Endelig

- finansielle

- Finansiel sektor

- Fornavn

- passer

- Fokus

- fokuserer

- følger

- efterfulgt

- efter

- følger

- Til

- format

- formularer

- fundet

- Foundation

- Framework

- Gratis

- hyppigt

- fra

- Frontier

- fuld

- fuldt ud

- yderligere

- fremtiden

- Generelt

- generere

- genereret

- genererer

- generere

- generation

- generative

- Generativ AI

- få

- Giv

- given

- Global

- grammatik

- forståelse

- større

- gruppe

- vejlede

- hånd

- håndtere

- ske

- Happening

- Hardware

- Have

- headers

- sundhedspleje

- stærkt

- hjælpe

- hjælpsom

- hjælpe

- hjælper

- hende

- link.

- højt niveau

- højtydende

- højere

- besidder

- hospital

- Hvordan

- How To

- Men

- HTML

- HTTPS

- menneskelig

- i

- ID

- identificeret

- if

- illustrerer

- billede

- uhyre

- KIMOs Succeshistorier

- importere

- vigtigt

- importere

- pålægge

- in

- Herunder

- indeks

- industrien

- oplysninger

- Information Alder

- Innovation

- indgang

- indsigt

- instans

- anvisninger

- forsikring

- integrere

- integreret

- Integration

- integration

- Intelligens

- Intelligent

- Intelligent dokumentbehandling

- beregnet

- internt

- ind

- snørklede

- indføre

- introduceret

- Introducerer

- IT

- ITS

- Jackson

- John

- John doe

- jon

- jpg

- json

- lige

- Nøgle

- nøgler

- Kend

- viden

- kendt

- Sprog

- stor

- Layout

- føre

- leder

- førende

- læring

- forlader

- Bibliotek

- ligesom

- Sandsynlig

- begrænsninger

- grænser

- Liste

- LLM

- belastning

- loader

- logik

- Se

- Lot

- maskine

- machine learning

- Making

- administrere

- håndterbar

- lykkedes

- styring

- manuel

- Produktion

- markeret

- matematik

- Kan..

- me

- betyder

- meningsfuld

- midler

- mekanisme

- mekanismer

- Meetups

- Hukommelse

- Meta

- Metadata

- metode

- metoder

- måske

- tankerne

- glip af

- fejl

- ML

- model

- modeller

- Moduler

- mere

- Realkreditlån

- mest

- flere

- navn

- navne

- Natural

- Natural Language Processing

- nødvendig

- Behov

- behov

- behov

- Ny

- næste

- næste uge

- NLP

- notesbog

- nu

- nuancer

- nummer

- objekt

- objekter

- of

- Tilbud

- tit

- on

- ONE

- kun

- open source

- Produktion

- Opportunity

- optimal

- Indstillinger

- or

- organisationer

- original

- Andet

- Ellers

- vores

- ud

- Resultat

- output

- udgange

- uden for

- i løbet af

- oversigt

- pakker

- side

- sider

- Smerte

- parret

- par

- del

- især

- passerer

- Bestået

- Passing

- lidenskabelige

- sti

- patient

- Mønster

- mønstre

- per

- Udfør

- ydeevne

- udføres

- udfører

- udfører

- fase

- phd

- sætninger

- pipeline

- fly

- plato

- Platon Data Intelligence

- PlatoData

- Vær venlig

- lungebetændelse

- punkter

- Populær

- mulig

- Indlæg

- potentiale

- magt

- strøm

- vigtigste

- praksis

- præcist

- Precision

- foretrækkes

- præsentere

- tidligere

- primært

- udskrifter

- Problem

- problemer

- behandle

- Behandlet

- forarbejdning

- producere

- Promises

- passende

- give

- forudsat

- udbyder

- giver

- Python

- Spørgsmål og svar

- kvalitet

- spørgsmål

- Hurtig

- hurtigt

- Raw

- Læsning

- genkende

- reducere

- henvise

- henvisningen

- benævnt

- Relationer

- relevant

- stole

- stole

- bemærkelsesværdig

- indberette

- repræsentere

- repræsenterer

- påkrævet

- Kræver

- henholdsvis

- reaktioner

- restriktioner

- resultere

- resulterer

- Resultater

- detail

- tilbageholde

- tilbageholdende

- afkast

- Rich

- Værelse

- regler

- Kør

- løber

- s

- sikkert

- samme

- siger

- Scale

- scenarier

- planlagt

- Søg

- Anden

- Sektion

- sektioner

- sektor

- se

- segmenter

- valgt

- senior

- dømme

- Series

- tjener

- tjener

- tjeneste

- Tjenester

- sæt

- svær

- hun

- Kort

- bør

- vist

- Shows

- signifikant

- enkelt

- lille

- mindre

- uddrag

- So

- Alene

- Løsninger

- SOLVE

- nogle

- Kilde

- Space

- Taler

- specialist

- specifikke

- specifikt

- specificeret

- stavning

- delt

- etaper

- standardisering

- starte

- påbegyndt

- state-of-the-art

- Statement

- Trin

- Steps

- Stadig

- butik

- opbevaret

- forhandler

- styrker

- String

- strukturel

- struktur

- struktureret

- Kamp

- efterfølgende

- Efterfølgende

- sådan

- tyder

- opsummere

- RESUMÉ

- forsyne

- forsyningskæde

- support

- Understøtter

- synergi

- Systemer

- bord

- Tag

- tager

- Opgaver

- opgaver

- hold

- teknik

- teknikker

- teknolog

- Teknologier

- skabelon

- vilkår

- tekst

- tekstmæssige

- end

- at

- verdenen

- deres

- Them

- derefter

- Der.

- derfor

- Disse

- de

- denne

- tænkte

- tre

- Gennem

- titan

- til

- i dag

- nutidens

- sammen

- token

- Tokens

- TONE

- værktøjer

- top

- I alt

- traditionelle

- Trailing

- Kurser

- Transaktioner

- Transform

- transformationer

- sand

- prøv

- to

- typen

- typer

- forstå

- forståelse

- I modsætning til

- afsløringen

- URL

- brug

- brug tilfælde

- anvendte

- brugere

- bruger

- ved brug af

- udnyttet

- Ved hjælp af

- v1

- værdi

- Værdier

- variabel

- forskellige

- Vast

- alsidige

- udgave

- via

- Specifikation

- mængder

- går igennem

- ønsker

- var

- Vej..

- we

- web

- webservices

- uge

- GODT

- Hvad

- hvornår

- som

- mens

- WHO

- vilje

- med

- inden for

- uden

- vidne

- ord

- ord

- Arbejde

- workflow

- arbejdsgange

- arbejder

- virker

- world

- ville

- skriftlig

- X

- år

- Du

- zephyrnet