Onlinespil og sociale fællesskaber tilbyder stemme- og tekstchatfunktionalitet, så deres brugere kan kommunikere. Selvom stemme- og tekstchat ofte understøtter venlige drillerier, kan det også føre til problemer som hadefulde ytringer, cybermobning, chikane og svindel. I dag er mange virksomheder udelukkende afhængige af menneskelige moderatorer til at gennemgå giftigt indhold. Men at verificere overtrædelser i chat er tidskrævende, fejltilbøjelige og udfordrende at skalere.

I dette indlæg introducerer vi løsninger, der muliggør lyd- og tekstchatmoderering ved hjælp af forskellige AWS-tjenester, herunder Amazon Transcrib, Amazon Comprehend, Amazonas grundfjeldog Amazon OpenSearch Service.

Sociale platforme søger en standardløsning til moderering, der er ligetil at starte, men de kræver også tilpasning til styring af forskellige politikker. Latency og omkostninger er også kritiske faktorer, der skal tages i betragtning. Ved at orkestrere toksicitetsklassificering med store sprogmodeller (LLM'er) ved hjælp af generativ AI tilbyder vi en løsning, der balancerer enkelhed, latens, omkostninger og fleksibilitet for at tilfredsstille forskellige krav.

Eksempelkoden til dette indlæg er tilgængelig i GitHub repository.

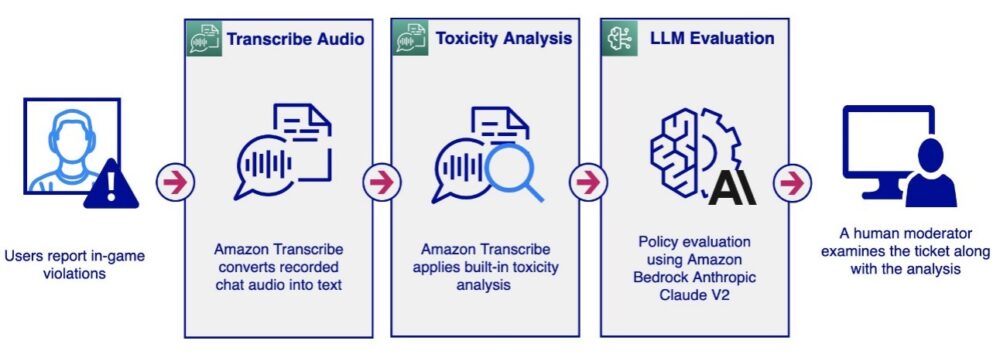

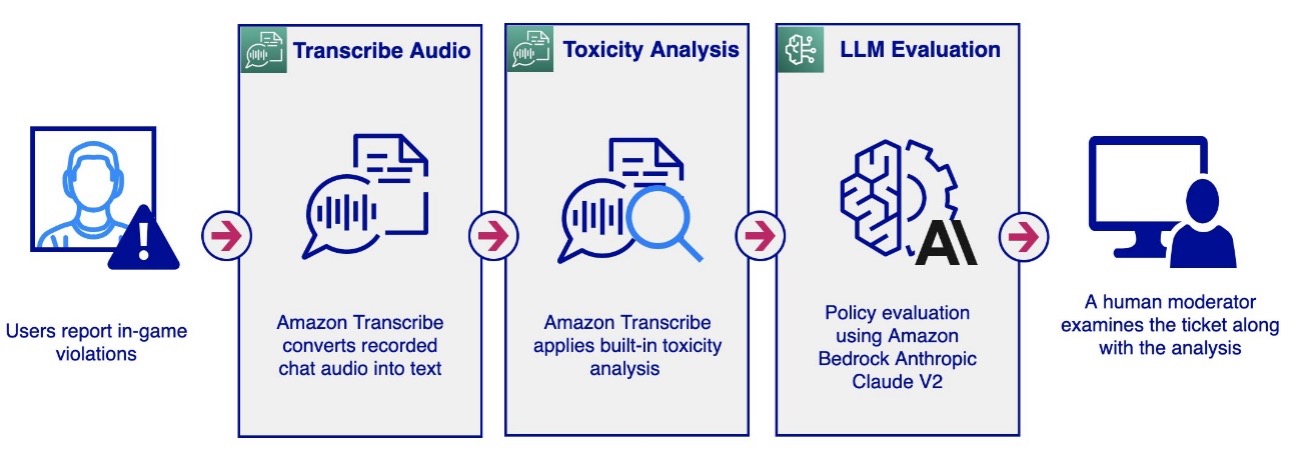

Workflow for moderation af lydchat

En arbejdsgang for moderering af lydchat kan startes af en bruger, der rapporterer andre brugere på en spilleplatform for overtrædelser af politikker såsom bandeord, hadefulde ytringer eller chikane. Dette repræsenterer en passiv tilgang til lydmoderering. Systemet optager alle lydsamtaler uden øjeblikkelig analyse. Når en rapport modtages, henter arbejdsgangen de relaterede lydfiler og starter analyseprocessen. En menneskelig moderator gennemgår derefter den rapporterede samtale og undersøger dens indhold for at afgøre, om den overtræder platformpolitikken.

Alternativt kan arbejdsgangen udløses proaktivt. For eksempel i et socialt lydchatrum kunne systemet optage alle samtaler og anvende analyser.

Både passive og proaktive tilgange kan udløse følgende pipeline til lydanalyse.

Workflowet for lydmoderering involverer følgende trin:

- Arbejdsgangen begynder med at modtage lydfilen og gemme den på en Amazon Simple Storage Service (Amazon S3)-bøtte til Amazon Transcribe.

- Amazon-transskriberingen

StartTranscriptionJobAPI påkaldes med Toksicitetspåvisning aktiveret. Amazon Transcribe konverterer lyden til tekst og giver yderligere oplysninger om toksicitetsanalyse. For mere information om toksicitetsanalyse, se Markér skadeligt sprog i talte samtaler med Amazon Transcribe Toxicity Detection. - Hvis toksicitetsanalysen returnerer en toksicitetsscore, der overstiger en vis tærskel (f.eks. 50 %), kan vi bruge Vidensbaser for Amazon Bedrock at evaluere budskabet i forhold til tilpassede politikker ved hjælp af LLM'er.

- Den menneskelige moderator modtager en detaljeret lydmodereringsrapport, der fremhæver de samtalesegmenter, der anses for at være giftige og i strid med politikken, hvilket giver dem mulighed for at træffe en informeret beslutning.

Følgende skærmbillede viser en prøveapplikation, der viser toksicitetsanalyse for et lydsegment. Det inkluderer den originale transskription, resultaterne fra Amazon Transcribe-toksicitetsanalysen og analysen udført ved hjælp af en vidensbase fra Amazon Bedrock gennem Amazon Bedrock Anthropic Claude V2-modellen.

LLM-analysen giver et overtrædelsesresultat (Y eller N) og forklarer rationalet bag modellens beslutning vedrørende overtrædelse af politik. Desuden omfatter videnbasen de refererede politiske dokumenter, der bruges af evalueringen, hvilket giver moderatorer yderligere kontekst.

Amazon Transkribering Toksicitet Detektion

Amazon Transcribe er en automatisk talegenkendelsestjeneste (ASR), der gør det nemt for udviklere at tilføje tale-til-tekst-funktioner til deres applikationer. Workflowet for lydmoderering bruger Amazon Transcribe Toxicity Detection, som er en maskinlæringsdrevet funktion (ML), der bruger lyd- og tekstbaserede signaler til at identificere og klassificere stemmebaseret giftigt indhold på tværs af syv kategorier, herunder seksuel chikane, hadefulde ytringer, trusler , misbrug, bandeord, fornærmelser og grafisk sprogbrug. Ud over at analysere tekst bruger Toxicity Detection talesignaler såsom toner og tonehøjde til at identificere giftige hensigter i tale.

Workflowet for lydmoderering aktiverer kun LLM's politikevaluering, når toksicitetsanalysen overstiger en fastsat tærskel. Denne tilgang reducerer latens og optimerer omkostningerne ved selektivt at anvende LLM'er, der filtrerer en betydelig del af trafikken fra.

Brug LLM prompt engineering til at imødekomme tilpassede politikker

De fortrænede Toxicity Detection-modeller fra Amazon Transcribe og Amazon Comprehend giver en bred toksicitetstaksonomi, der almindeligvis bruges af sociale platforme til at moderere brugergenereret indhold i lyd- og tekstformater. Selvom disse præ-trænede modeller effektivt registrerer problemer med lav latenstid, kan du have brug for en løsning til at opdage overtrædelser af din specifikke virksomheds- eller forretningsdomænepolitikker, som de præ-trænede modeller alene ikke kan opnå.

Derudover opdager krænkelser i kontekstuelle samtaler, såsom identifikation seksuel pleje af børn samtaler, kræver en tilpasselig løsning, der involverer overvejelse af chatbeskeder og kontekst uden for den, såsom brugerens alder, køn og samtalehistorik. Det er her, LLM'er kan tilbyde den nødvendige fleksibilitet til at udvide disse krav.

Amazon Bedrock er en fuldt administreret tjeneste, der tilbyder et udvalg af højtydende fundamentmodeller (FM'er) fra førende AI-virksomheder. Disse løsninger bruger Anthropic Claude v2 fra Amazon Bedrock til at moderere lydtransskriptioner og tekstchatbeskeder ved hjælp af en fleksibel promptskabelon, som beskrevet i følgende kode:

Skabelonen indeholder pladsholdere til politikbeskrivelsen, chatmeddelelsen og yderligere regler, der kræver moderering. Den antropiske Claude V2-model leverer svar i det instruerede format (J eller N) sammen med en analyse, der forklarer, hvorfor den mener, at budskabet overtræder politikken. Denne tilgang giver dig mulighed for at definere fleksible moderationskategorier og formulere dine politikker på et menneskeligt sprog.

Den traditionelle metode til træning af en intern klassifikationsmodel involverer besværlige processer såsom dataannotering, træning, test og modelimplementering, hvilket kræver ekspertise hos dataforskere og ML-ingeniører. LLM'er tilbyder derimod en høj grad af fleksibilitet. Forretningsbrugere kan ændre prompter på menneskeligt sprog, hvilket fører til øget effektivitet og reducerede iterationscyklusser i ML-modeltræning.

Amazon Bedrock vidensbaser

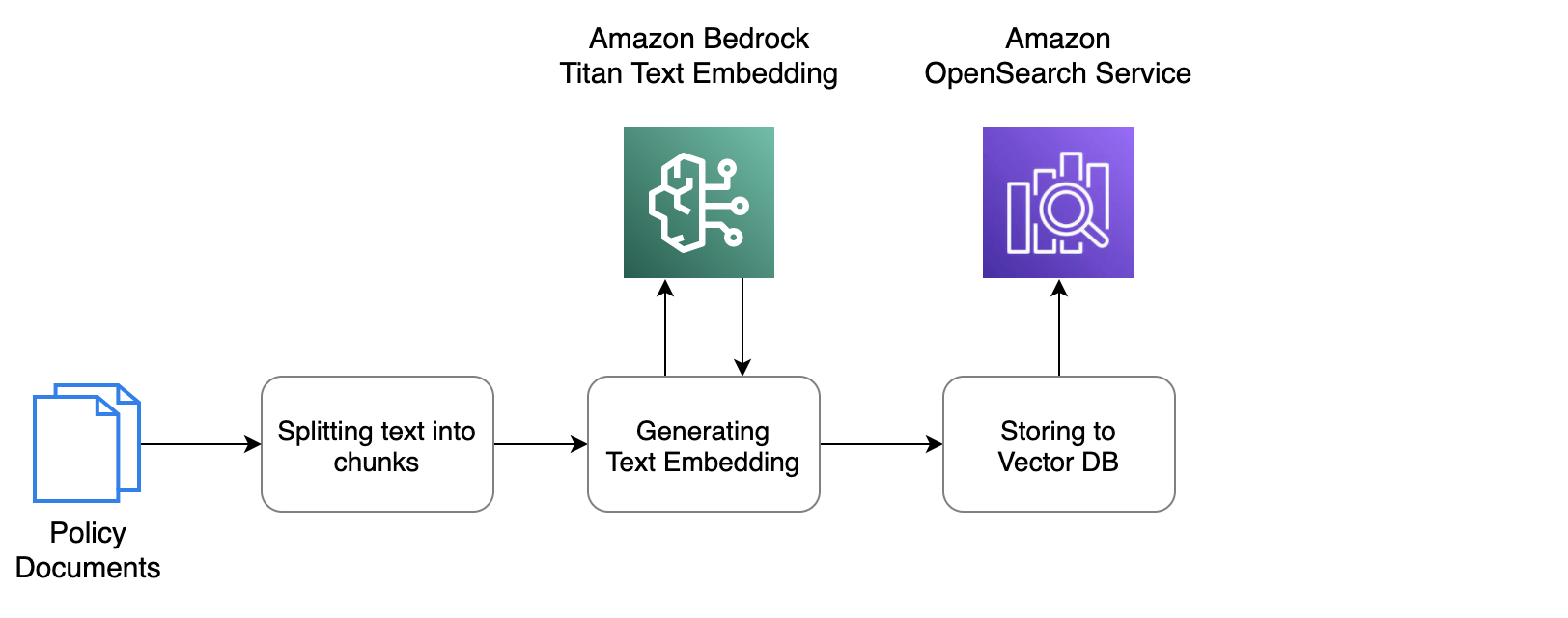

Selvom prompt engineering er effektiv til at tilpasse politikker, kan indsprøjtning af lange politikker og regler direkte i LLM-prompts for hver meddelelse indføre latens og øge omkostningerne. For at løse dette bruger vi Amazon Bedrock vidensbaser som et styret Retrieval Augmented Generation (RAG) system. Dette giver dig mulighed for at administrere politikdokumentet fleksibelt, så arbejdsgangen kun kan hente de relevante politiksegmenter for hver inputmeddelelse. Dette minimerer antallet af tokens, der sendes til LLM'erne til analyse.

Du kan bruge AWS Management Console at uploade politikdokumenterne til en S3-bøtte og derefter indeksere dokumenterne til en vektordatabase for effektiv hentning. Det følgende er en konceptuel arbejdsgang, der styres af en vidensbase fra Amazon Bedrock, der henter dokumenter fra Amazon S3, opdeler teksten i bidder og kalder Amazon Bedrock Titan tekstindlejringsmodel at konvertere tekstklumperne til vektorer, som derefter gemmes i vektordatabasen.

I denne løsning bruger vi Amazon OpenSearch Service som vektorlageret. OpenSearch er en skalerbar, fleksibel og udvidelsesbar open source-softwarepakke til søgning, analyse, sikkerhedsovervågning og observerbarhedsapplikationer, licenseret under Apache 2.0-licensen. OpenSearch Service er en fuldt administreret tjeneste, der gør det nemt at implementere, skalere og betjene OpenSearch i AWS Cloud.

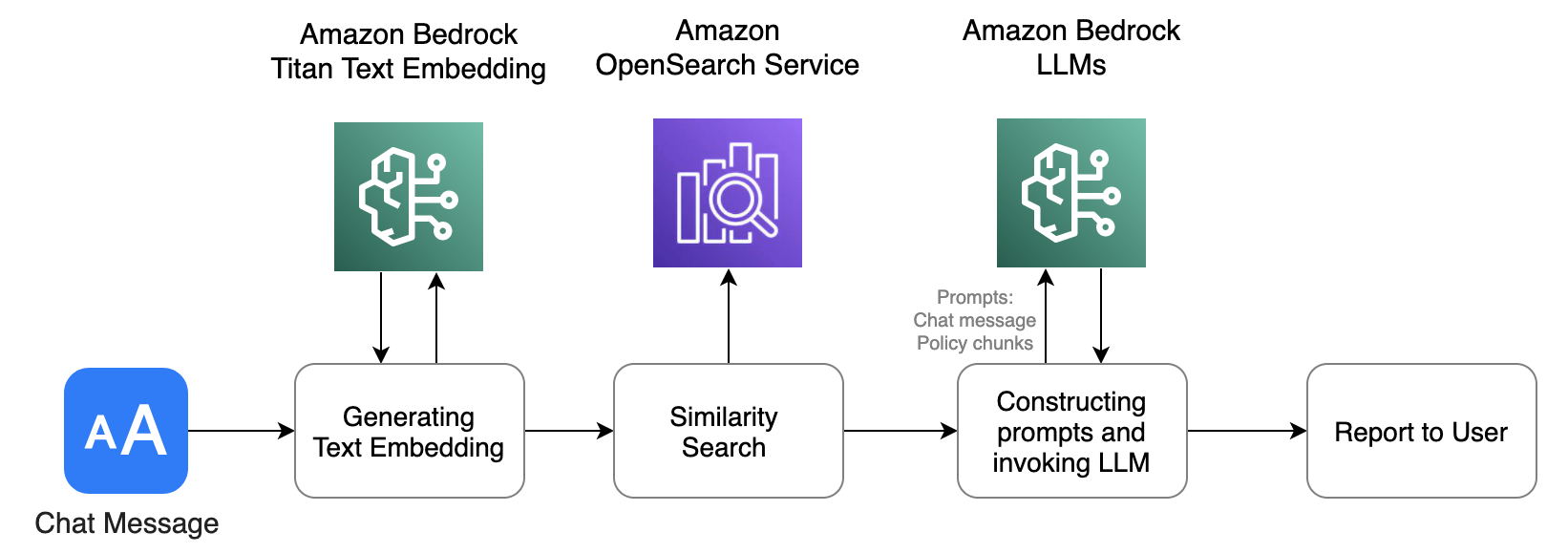

Når dokumentet er indekseret i OpenSearch Service, sender lyd- og tekstmodereringsworkflowet chatbeskeder, der udløser følgende forespørgselsflow til tilpasset politikevaluering.

Processen ligner initieringsarbejdsgangen. Først konverteres tekstbeskeden til tekstindlejringer ved hjælp af Amazon Bedrock Titan Text Embedding API. Disse indlejringer bruges derefter til at udføre en vektor søgning mod OpenSearch Service-databasen, som allerede er fyldt med dokumentindlejringer. Databasen returnerer politikstykker med den højeste matchende score, der er relevante for input-tekstmeddelelsen. Vi komponerer derefter prompter, der indeholder både input-chatbeskeden og politiksegmentet, som sendes til antropisk Claude V2 til evaluering. LLM-modellen returnerer et analyseresultat baseret på de prompte instruktioner.

For detaljerede instruktioner om, hvordan du opretter en ny instans med dit politikdokument i en vidensbase fra Amazon Bedrock, se Knowledge Bases leverer nu fuldt administreret RAG-oplevelse i Amazon Bedrock.

Workflow for moderering af tekstchat

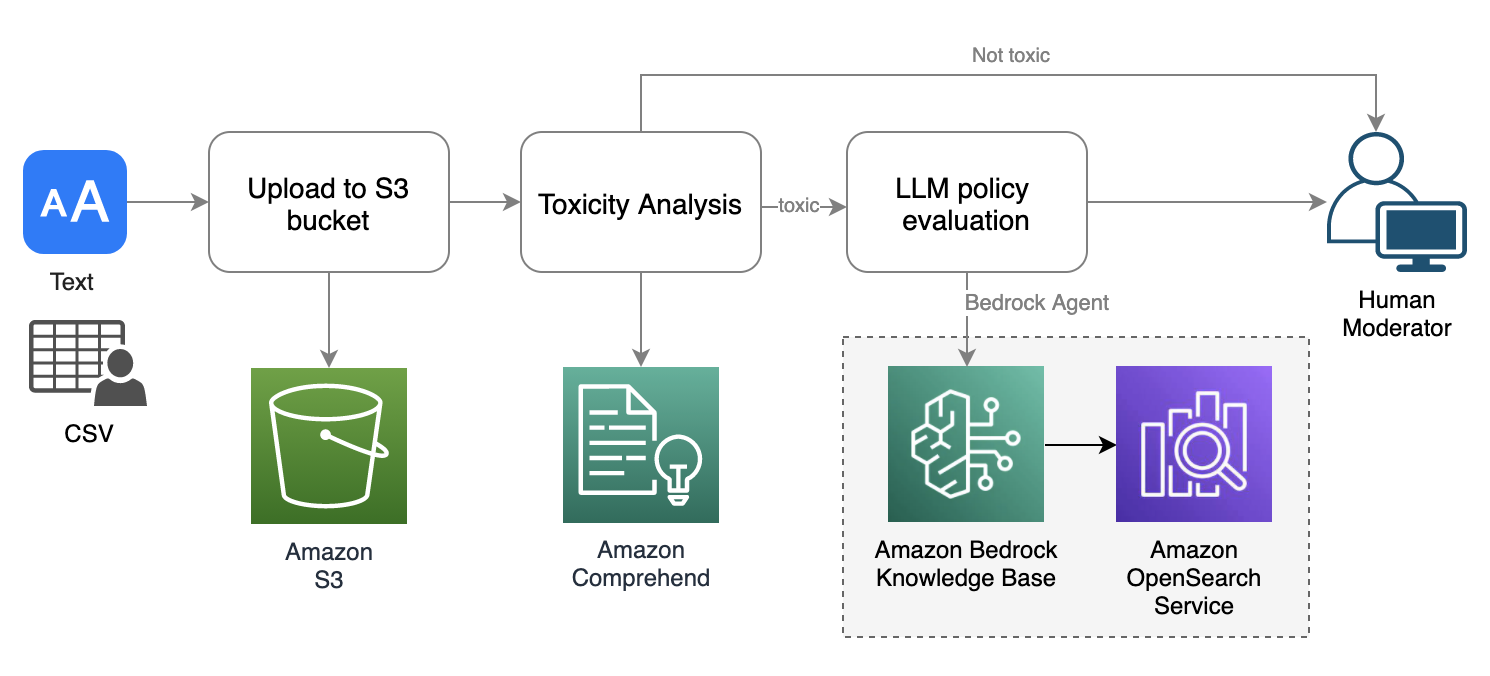

Workflowet for tekstchatmoderering følger et lignende mønster som lydmoderering, men det bruger Amazon Comprehend-toksicitetsanalyse, som er skræddersyet til tekstmoderering. Eksempelappen understøtter en grænseflade til upload af massetekstfiler i CSV- eller TXT-format og giver en enkelt-meddelelsesgrænseflade til hurtig test. Følgende diagram illustrerer arbejdsgangen.

Workflowet for tekstmoderering involverer følgende trin:

- Brugeren uploader en tekstfil til en S3-bøtte.

- Amazon Comprehend toksicitetsanalyse anvendes på tekstbeskeden.

- Hvis toksicitetsanalysen returnerer en toksicitetsscore, der overstiger en vis tærskel (f.eks. 50 %), bruger vi en vidensbase fra Amazon Bedrock til at evaluere budskabet i forhold til tilpassede politikker ved hjælp af Anthropic Claude V2 LLM.

- En politikevalueringsrapport sendes til den menneskelige moderator.

Amazon Comprehend toksicitetsanalyse

I arbejdsgangen for tekstmoderering bruger vi Amazon Comprehend-toksicitetsanalyse til at vurdere toksicitetsniveauet for tekstbeskederne. Amazon Comprehend er en NLP-tjeneste (natural language processing), der bruger ML til at afdække værdifuld indsigt og sammenhænge i tekst. Amazon Comprehend toxicity detection API tildeler en samlet toksicitetsscore til tekstindhold, der spænder fra 0-1, hvilket indikerer sandsynligheden for, at det er giftigt. Den kategoriserer også tekst i følgende kategorier og giver en tillidsscore for hver: hate_speech, grafisk, harrassement_or_abuse, seksuelle, violence_or_threat, fornærmelse og bandeord.

I denne arbejdsgang for tekstmoderering spiller Amazon Comprehend-toksicitetsanalyse en afgørende rolle i at identificere, om den indkommende tekstbesked indeholder giftigt indhold. I lighed med arbejdsgangen for lydmoderering inkluderer den en betingelse om kun at aktivere downstream-LLM-politikevalueringen, når toksicitetsanalysen returnerer en score, der overstiger en foruddefineret tærskel. Denne optimering hjælper med at reducere den samlede ventetid og omkostninger forbundet med LLM-analyse.

Resumé

I dette indlæg introducerede vi løsninger til lyd- og tekstchatmoderering ved hjælp af AWS-tjenester, herunder Amazon Transcribe, Amazon Comprehend, Amazon Bedrock og OpenSearch Service. Disse løsninger bruger præ-trænede modeller til toksicitetsanalyse og er orkestreret med generative AI LLM'er for at opnå den optimale balance i nøjagtighed, latenstid og omkostninger. De giver dig også mulighed for fleksibelt at definere dine egne politikker.

Du kan opleve eksempel-appen ved at følge instruktionerne i GitHub repo.

Om forfatteren

Lana Zhang er Senior Solutions Architect hos AWS WWSO AI Services-teamet, med speciale i AI og ML til Content Moderation, Computer Vision, Natural Language Processing og Generative AI. Med sin ekspertise er hun dedikeret til at promovere AWS AI/ML-løsninger og hjælpe kunder med at transformere deres forretningsløsninger på tværs af forskellige brancher, herunder sociale medier, spil, e-handel, medier, reklame og marketing.

Lana Zhang er Senior Solutions Architect hos AWS WWSO AI Services-teamet, med speciale i AI og ML til Content Moderation, Computer Vision, Natural Language Processing og Generative AI. Med sin ekspertise er hun dedikeret til at promovere AWS AI/ML-løsninger og hjælpe kunder med at transformere deres forretningsløsninger på tværs af forskellige brancher, herunder sociale medier, spil, e-handel, medier, reklame og marketing.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/moderate-audio-and-text-chats-using-aws-ai-services-and-llms/

- :har

- :er

- :ikke

- :hvor

- 100

- 118

- 14

- 7

- a

- Om

- misbrug

- adgang

- imødekomme

- Konto

- nøjagtighed

- opnå

- tværs

- aktivere

- tilføje

- Desuden

- Yderligere

- yderligere information

- adresse

- Reklame

- mod

- alder

- AI

- AI-tjenester

- AI / ML

- Alle

- tillade

- tillader

- alene

- sammen

- allerede

- også

- Skønt

- Amazon

- Amazon Comprehend

- Amazon Transcrib

- Amazon Web Services

- an

- analyse

- analytics

- analysere

- ,

- Antropisk

- Apache

- api

- app

- Anvendelse

- applikationer

- anvendt

- Indløs

- Anvendelse

- tilgang

- tilgange

- ER

- AS

- vurdere

- hjælpe

- Assistant

- bistår

- forbundet

- At

- lyd

- augmented

- forfatter

- Automatisk Ur

- til rådighed

- AWS

- Balance

- saldi

- bund

- baseret

- BE

- været

- begynder

- bag

- være

- både

- Breaking

- bred

- virksomhed

- men

- by

- CAN

- kapacitet

- kategorier

- vis

- udfordrende

- chatte

- katte

- valg

- klassificering

- Klassificere

- Cloud

- kode

- almindeligt

- kommunikere

- Fællesskaber

- Virksomheder

- selskab

- forstå

- computer

- Computer Vision

- konceptuelle

- betingelse

- gennemført

- tillid

- Tilslutninger

- Overvej

- betragtes

- Overvejer

- indeholder

- indhold

- sammenhæng

- kontekstuelle

- kontrast

- Samtale

- samtaler

- konvertere

- konverteret

- Koste

- Omkostninger

- kunne

- skabe

- kritisk

- afgørende

- besværlig

- Kunder

- tilpasses

- tilpasning

- tilpassede

- cykler

- data

- Database

- beslutte

- beslutning

- dedikeret

- definere

- Degree

- leverer

- indsætte

- implementering

- beskrivelse

- detaljeret

- opdage

- Detektion

- Bestem

- udviklere

- diagram

- direkte

- visning

- forskelligartede

- dokumentet

- dokumenter

- gør

- domæne

- ned

- e-handel

- hver

- effektivitet

- effektiv

- effektivt

- enten

- indlejring

- bemyndige

- muliggøre

- aktiveret

- muliggør

- Engineering

- Ingeniører

- forbedret

- evaluere

- evaluering

- eksempel

- overstiger

- overstiger

- erfaring

- ekspert

- ekspertise

- forklarer

- Forklarer

- udvide

- faktorer

- File (Felt)

- Filer

- filtrering

- Finde

- Fornavn

- Fleksibilitet

- fleksibel

- fleksibelt

- flow

- efter

- følger

- Til

- format

- Foundation

- venlige

- fra

- fuldt ud

- funktionalitet

- Endvidere

- spil

- spilplatform

- Køn

- generation

- generative

- Generativ AI

- Grafisk

- skadelig

- hader

- hjælper

- hende

- Høj

- højtydende

- højeste

- fremhæve

- historie

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- menneskelig

- identificere

- identificere

- if

- illustrerer

- umiddelbar

- in

- omfatter

- Herunder

- Indgående

- Forøg

- indeks

- indekseret

- angiver

- angiver

- industrier

- oplysninger

- informeret

- indlede

- indledt

- Indleder

- indledning

- indgang

- indsigt

- instans

- anvisninger

- Fornærme

- hensigt

- grænseflade

- ind

- indføre

- introduceret

- undersøge

- påberåbes

- påberåber sig

- involverer

- spørgsmål

- IT

- iteration

- ITS

- Job

- jpg

- Holde

- viden

- Sprog

- stor

- Latency

- føre

- førende

- læring

- Niveau

- Licens

- Licenseret

- sandsynlighed

- LLM

- Lav

- maskine

- machine learning

- lave

- maerker

- administrere

- lykkedes

- ledelse

- styring

- mange

- Marketing

- matchende

- Kan..

- midler

- Medier

- besked

- beskeder

- metode

- minimerer

- ML

- model

- modeller

- moderat

- modererende

- mådehold

- ændre

- overvågning

- mere

- skal

- Natural

- Natural Language Processing

- Behov

- behov

- Ny

- NLP

- nu

- nummer

- of

- tilbyde

- Tilbud

- tit

- on

- kun

- åbent

- open source

- betjene

- optimal

- optimering

- Optimerer

- or

- orkestreret

- orkestrering

- original

- Andet

- ud

- skitseret

- uden for

- samlet

- egen

- passive

- Mønster

- Udfør

- pipeline

- Pitch

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Vær venlig

- politikker

- politik

- befolkede

- del

- Indlæg

- foruddefineret

- Proaktiv

- problemer

- behandle

- Processer

- forarbejdning

- UPRÆK

- Fremme

- prompter

- give

- giver

- leverer

- query

- Hurtig

- klud

- spænder

- rationale

- modtaget

- modtager

- modtagende

- anerkendelse

- optage

- optegnelser

- reducere

- Reduceret

- reducerer

- henvise

- refereres

- om

- relaterede

- relevant

- stole

- indberette

- rapporteret

- Rapportering

- repræsenterer

- kræver

- Krav

- Kræver

- Svar

- reaktioner

- resultere

- Resultater

- hentning

- afkast

- gennemgå

- Anmeldelser

- roller

- Værelse

- Herske

- regler

- sikker

- Sikkerhed

- prøve

- tilfredsstille

- skalerbar

- Scale

- svindel

- forskere

- score

- Søg

- Sektion

- sikkerhed

- Søg

- segment

- segmenter

- sender

- senior

- sendt

- tjeneste

- Tjenester

- sæt

- syv

- Seksuel

- hun

- Shows

- signifikant

- lignende

- Simpelt

- enkelhed

- Social

- sociale medier

- sociale platforme

- Software

- Alene

- løsninger

- Løsninger

- Kilde

- speciale

- specifikke

- tale

- Talegenkendelse

- tale-til-tekst

- splits

- talt

- Steps

- opbevaring

- butik

- opbevaret

- lagring

- ligetil

- sådan

- suite

- support

- Understøtter

- systemet

- TAG

- skræddersyet

- taget

- taksonomi

- hold

- skabelon

- Test

- tekst

- at

- deres

- Them

- derefter

- Disse

- de

- tænker

- denne

- trusler

- tærskel

- Gennem

- tidskrævende

- titan

- til

- i dag

- Tokens

- traditionelle

- Trafik

- Kurser

- omdanne

- udløse

- udløst

- udløsning

- Stol

- afdække

- under

- Uploading

- brug

- anvendte

- Bruger

- brugere

- bruger

- ved brug af

- Værdifuld

- forskellige

- verificere

- KRÆNKELSE

- Overtrædelser

- vision

- Voice

- we

- web

- webservices

- hvornår

- hvorvidt

- som

- mens

- hvorfor

- Wikipedia

- vilje

- med

- inden for

- uden

- ord

- workflow

- Du

- Din

- zephyrnet