AutoML ermöglicht es Ihnen, direkt zu Beginn des Lebenszyklus eines Machine-Learning-Projekts (ML) schnelle, allgemeine Erkenntnisse aus Ihren Daten abzuleiten. Wenn Sie im Voraus wissen, welche Vorverarbeitungstechniken und Algorithmustypen die besten Ergebnisse liefern, verkürzt sich die Zeit für die Entwicklung, das Training und die Bereitstellung des richtigen Modells. Es spielt eine entscheidende Rolle im Entwicklungsprozess jedes Modells und ermöglicht es Datenwissenschaftlern, sich auf die vielversprechendsten ML-Techniken zu konzentrieren. Darüber hinaus bietet AutoML eine Basismodellleistung, die als Referenzpunkt für das Data-Science-Team dienen kann.

Ein AutoML-Tool wendet eine Kombination verschiedener Algorithmen und verschiedener Vorverarbeitungstechniken auf Ihre Daten an. Es kann beispielsweise die Daten skalieren, eine univariate Merkmalsauswahl durchführen, PCA bei verschiedenen Varianzschwellenwerten durchführen und Clustering anwenden. Solche Vorverarbeitungstechniken könnten einzeln angewendet oder in einer Pipeline kombiniert werden. Anschließend trainiert ein AutoML-Tool verschiedene Modelltypen, wie z. B. lineare Regression, Elastic-Net oder Random Forest, auf verschiedenen Versionen Ihres vorverarbeiteten Datensatzes und führt eine Hyperparameteroptimierung (HPO) durch. Amazon SageMaker-Autopilot macht die schwere Arbeit beim Erstellen von ML-Modellen überflüssig. Nach der Bereitstellung des Datensatzes untersucht SageMaker Autopilot automatisch verschiedene Lösungen, um das beste Modell zu finden. Was aber, wenn Sie Ihre maßgeschneiderte Version eines AutoML-Workflows bereitstellen möchten?

In diesem Beitrag wird gezeigt, wie Sie einen benutzerdefinierten AutoML-Workflow erstellen Amazon Sage Maker Verwendung von Automatische Modelloptimierung von Amazon SageMaker mit Beispielcode verfügbar in a GitHub Repo.

Lösungsüberblick

Nehmen wir für diesen Anwendungsfall an, dass Sie Teil eines Data-Science-Teams sind, das Modelle in einem speziellen Bereich entwickelt. Sie haben eine Reihe benutzerdefinierter Vorverarbeitungstechniken entwickelt und eine Reihe von Algorithmen ausgewählt, von denen Sie normalerweise erwarten, dass sie bei Ihrem ML-Problem gut funktionieren. Wenn Sie an neuen ML-Anwendungsfällen arbeiten, möchten Sie zunächst einen AutoML-Lauf mit Ihren Vorverarbeitungstechniken und Algorithmen durchführen, um den Umfang möglicher Lösungen einzugrenzen.

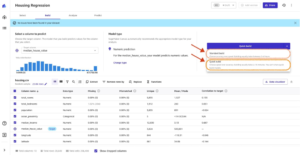

In diesem Beispiel verwenden Sie keinen speziellen Datensatz; Stattdessen arbeiten Sie mit dem California Housing-Datensatz, aus dem Sie importieren Amazon Simple Storage-Service (Amazon S3). Der Schwerpunkt liegt auf der Demonstration der technischen Umsetzung der Lösung mit SageMaker HPO, die später auf jeden Datensatz und jede Domäne angewendet werden kann.

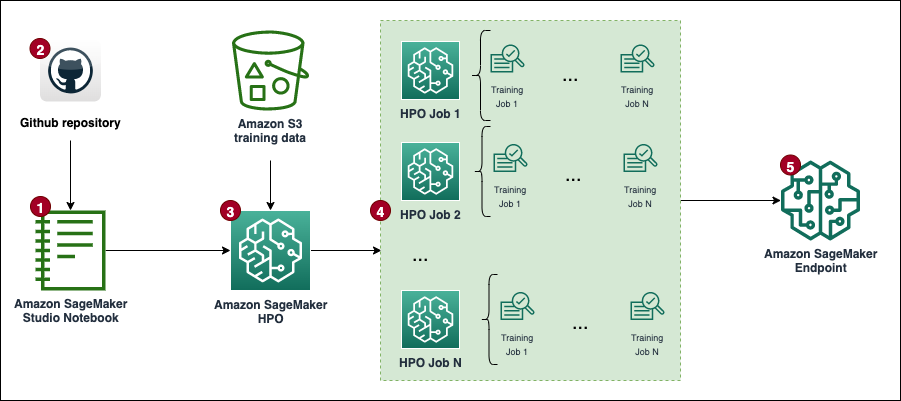

Das folgende Diagramm zeigt den gesamten Lösungsworkflow.

Voraussetzungen:

Die folgenden Voraussetzungen sind für den Abschluss der exemplarischen Vorgehensweise in diesem Beitrag erforderlich:

Implementieren Sie die Lösung

Der vollständige Code ist im verfügbar GitHub Repo.

Die Schritte zur Implementierung der Lösung (wie im Workflowdiagramm angegeben) sind wie folgt:

- Erstellen Sie eine Notebook-Instanz und geben Sie Folgendes an:

- Aussichten für Notebook-Instanztyp, wählen ml.t3.mittel.

- Aussichten für Elastische Inferenz, wählen keine.

- Aussichten für Plattformkennung, wählen Amazon Linux 2, Jupyter Lab 3.

- Aussichten für IAM-Rolle, wählen Sie die Standardeinstellung

AmazonSageMaker-ExecutionRole. Wenn es nicht existiert, erstellen Sie ein neues AWS Identity and Access Management and (IAM)-Rolle und hängen Sie die an AmazonSageMakerFullAccess IAM-Richtlinie.

Beachten Sie, dass Sie in der Produktion eine Ausführungsrolle und -richtlinie mit minimalem Umfang erstellen sollten.

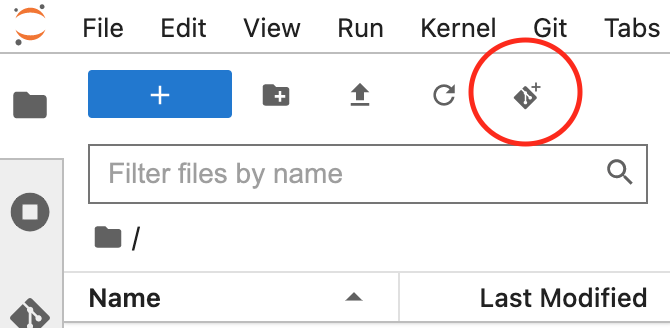

- Öffnen Sie die JupyterLab-Schnittstelle für Ihre Notebook-Instanz und klonen Sie das GitHub-Repository.

Sie können dies tun, indem Sie eine neue Terminalsitzung starten und ausführen git clone <REPO> Befehl oder mithilfe der UI-Funktionalität, wie im folgenden Screenshot gezeigt.

- Öffnen Sie den Microsoft Store auf Ihrem Windows-PC.

automl.ipynbNotebook-Datei, wählen Sie die ausconda_python3Kernel und befolgen Sie die Anweisungen zum Auslösen eines Satz von HPO-Jobs.

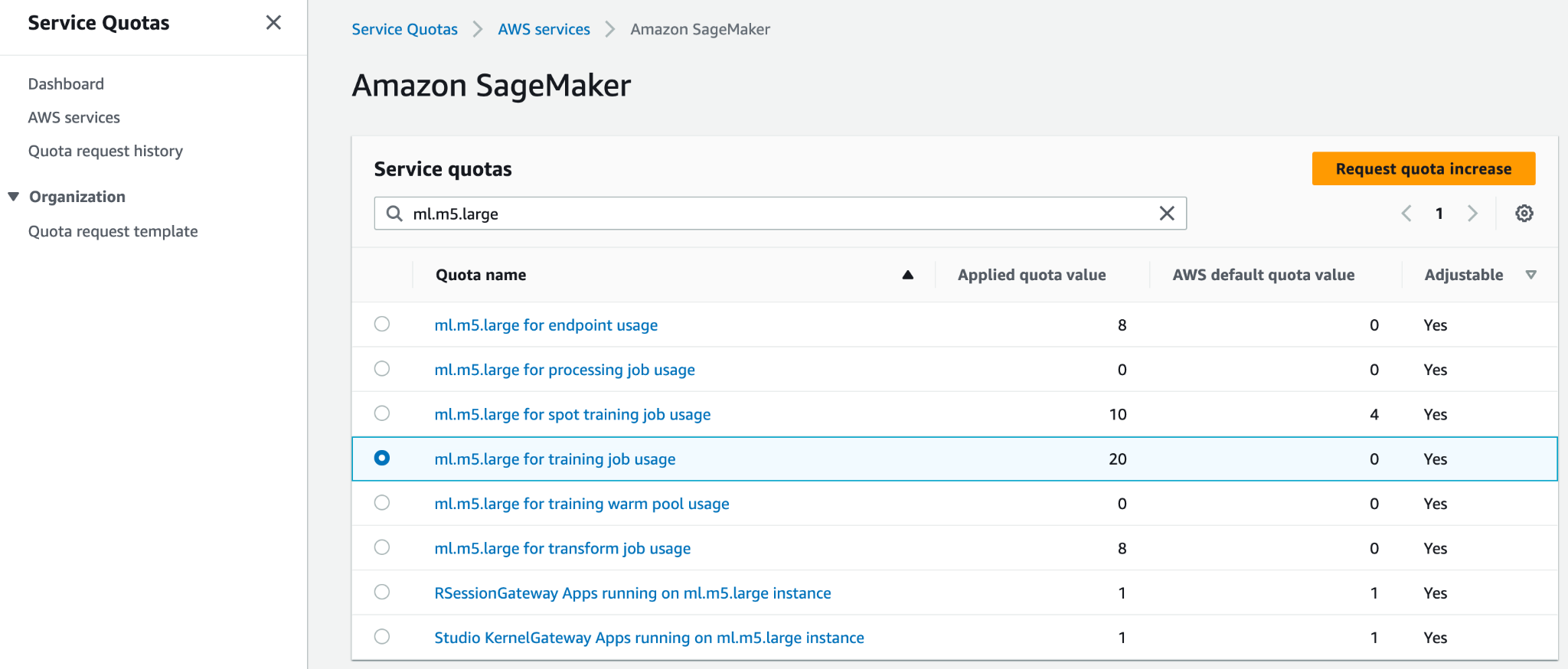

Um den Code ohne Änderungen auszuführen, müssen Sie das Dienstkontingent für erhöhen ml.m5.large für die Nutzung von Schulungsjobs und Anzahl der Instanzen für alle Trainingsjobs. AWS erlaubt standardmäßig nur 20 parallele SageMaker-Trainingsjobs für beide Kontingente. Für beide müssen Sie eine Quotenerhöhung auf 30 beantragen. Beide Kontingentänderungen sollten in der Regel innerhalb weniger Minuten genehmigt werden. Beziehen auf Beantragung einer Kontingenterhöhung um mehr zu erfahren.

Wenn Sie das Kontingent nicht ändern möchten, können Sie einfach den Wert ändern MAX_PARALLEL_JOBS Variable im Skript (zum Beispiel auf 5).

- Jeder HPO-Job schließt eine Reihe von Aufgaben ab Ausbildungs Job Versuche und geben das Modell mit optimalen Hyperparametern an.

- Analysieren Sie die Ergebnisse und Stellen Sie das leistungsstärkste Modell bereit.

Für diese Lösung fallen Kosten in Ihrem AWS-Konto an. Die Kosten dieser Lösung hängen von der Anzahl und Dauer der HPO-Schulungsaufträge ab. Wenn diese steigen, steigen auch die Kosten. Sie können die Kosten senken, indem Sie die Schulungszeit und die Konfiguration begrenzen TuningJobCompletionCriteriaConfig gemäß den Anweisungen, die später in diesem Beitrag besprochen werden. Preisinformationen finden Sie unter Amazon SageMaker Preise.

In den folgenden Abschnitten besprechen wir das Notebook ausführlicher mit Codebeispielen und den Schritten zur Analyse der Ergebnisse und Auswahl des besten Modells.

Ersteinrichtung

Beginnen wir mit dem Ausführen des Importe und Einrichtung Abschnitt in der custom-automl.ipynb Notizbuch. Es installiert und importiert alle erforderlichen Abhängigkeiten, instanziiert eine SageMaker-Sitzung und einen SageMaker-Client und legt die Standardregion und den S3-Bucket zum Speichern von Daten fest.

Datenaufbereitung

Laden Sie den Datensatz „California Housing“ herunter und bereiten Sie ihn vor, indem Sie Folgendes ausführen Daten herunterladen Abschnitt des Notizbuchs. Der Datensatz wird in Trainings- und Testdatenrahmen aufgeteilt und in den Standard-S3-Bucket der SageMaker-Sitzung hochgeladen.

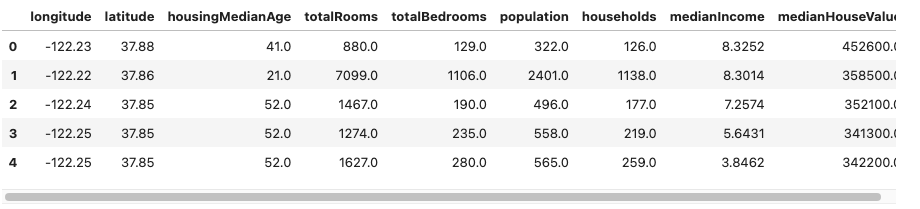

Der gesamte Datensatz umfasst 20,640 Datensätze und insgesamt 9 Spalten, einschließlich des Ziels. Ziel ist es, den Medianwert eines Hauses vorherzusagen (medianHouseValue Spalte). Der folgende Screenshot zeigt die oberen Zeilen des Datensatzes.

Vorlage für ein Schulungsskript

Der AutoML-Workflow in diesem Beitrag basiert auf scikit-lernen Vorverarbeitungspipelines und Algorithmen. Ziel ist es, eine große Kombination verschiedener Vorverarbeitungspipelines und Algorithmen zu generieren, um das leistungsstärkste Setup zu finden. Beginnen wir mit der Erstellung eines generischen Trainingsskripts, das lokal auf der Notebook-Instanz gespeichert wird. In diesem Skript gibt es zwei leere Kommentarblöcke: einen zum Einfügen von Hyperparametern und einen für das Pipeline-Objekt des Vorverarbeitungsmodells. Sie werden für jeden Vorverarbeitungsmodellkandidaten dynamisch eingefügt. Der Zweck eines generischen Skripts besteht darin, die Implementierung trocken zu halten (wiederholen Sie sich nicht).

Erstellen Sie Vorverarbeitungs- und Modellkombinationen

Das preprocessors Das Wörterbuch enthält eine Spezifikation der Vorverarbeitungstechniken, die auf alle Eingabemerkmale des Modells angewendet werden. Jedes Rezept wird mit a definiert Pipeline oder eine FeatureUnion Objekt von scikit-learn, das einzelne Datentransformationen verkettet und stapelt. Zum Beispiel, mean-imp-scale ist ein einfaches Rezept, das sicherstellt, dass fehlende Werte mithilfe von Mittelwerten der jeweiligen Spalten imputiert werden und dass alle Features mithilfe von skaliert werden Standardskala. Im Gegensatz dazu ist die mean-imp-scale-pca Rezept verkettet ein paar weitere Operationen:

- Imputieren Sie fehlende Werte in Spalten mit ihrem Mittelwert.

- Wenden Sie die Feature-Skalierung mithilfe von Mittelwert und Standardabweichung an.

- Berechnen Sie die PCA anhand der Eingabedaten bei einem angegebenen Varianzschwellenwert und führen Sie sie mit den unterstellten und skalierten Eingabemerkmalen zusammen.

In diesem Beitrag sind alle Eingabefunktionen numerisch. Wenn Ihr Eingabedatensatz mehr Datentypen enthält, sollten Sie eine kompliziertere Pipeline angeben, in der unterschiedliche Vorverarbeitungszweige auf unterschiedliche Feature-Type-Sets angewendet werden.

Das models Das Wörterbuch enthält Spezifikationen verschiedener Algorithmen, an die Sie den Datensatz anpassen. Jeder Modelltyp verfügt über die folgende Spezifikation im Wörterbuch:

- script_output – Zeigt auf den Speicherort des vom Schätzer verwendeten Trainingsskripts. Dieses Feld wird dynamisch gefüllt, wenn die

modelsWörterbuch wird mit dem kombiniertpreprocessorsWörterbuch. - Insertionen – Definiert Code, der in das eingefügt wird

script_draft.pyund anschließend unter gespeichertscript_output. Der Schlüssel“preprocessor”wird absichtlich leer gelassen, da dieser Ort mit einem der Präprozessoren gefüllt ist, um mehrere Modell-Präprozessor-Kombinationen zu erstellen. - Hyperparameter – Eine Reihe von Hyperparametern, die durch den HPO-Job optimiert werden.

- include_cls_metadata – Weitere vom SageMaker benötigte Konfigurationsdetails

TunerKlasse.

Ein vollständiges Beispiel dafür models Das Wörterbuch ist im GitHub-Repository verfügbar.

Als nächstes durchlaufen wir die preprocessors und models Wörterbücher und erstellen Sie alle möglichen Kombinationen. Zum Beispiel, wenn Ihr preprocessors Das Wörterbuch enthält 10 Rezepte und Sie haben 5 Modelldefinitionen im models Wörterbuch enthält das neu erstellte Pipelines-Wörterbuch 50 Präprozessormodell-Pipelines, die während HPO ausgewertet werden. Beachten Sie, dass zu diesem Zeitpunkt noch keine einzelnen Pipeline-Skripte erstellt wurden. Der nächste Codeblock (Zelle 9) des Jupyter-Notebooks durchläuft alle Präprozessormodellobjekte im pipelines Wörterbuch, fügt alle relevanten Codeteile ein und speichert eine Pipeline-spezifische Version des Skripts lokal im Notebook. Diese Skripte werden in den nächsten Schritten verwendet, wenn Sie einzelne Schätzer erstellen, die Sie in den HPO-Job einfügen.

Schätzer definieren

Sie können jetzt an der Definition von SageMaker-Schätzern arbeiten, die der HPO-Job verwendet, nachdem die Skripte fertig sind. Beginnen wir mit der Erstellung einer Wrapper-Klasse, die einige gemeinsame Eigenschaften für alle Schätzer definiert. Es erbt von der SKLearn Klasse und gibt die Rolle, die Instanzanzahl und den Typ sowie die Spalten an, die vom Skript als Features und Ziel verwendet werden.

Lassen Sie uns das bauen estimators Wörterbuch durch Durchlaufen aller zuvor generierten und im Verzeichnis befindlichen Skripte scripts Verzeichnis. Sie instanziieren einen neuen Schätzer mithilfe von SKLearnBase Klasse mit einem eindeutigen Schätzernamen und einem der Skripte. Notiere dass der estimators Das Wörterbuch hat zwei Ebenen: Die oberste Ebene definiert a pipeline_family. Dies ist eine logische Gruppierung basierend auf der Art der auszuwertenden Modelle und entspricht der Länge der models Wörterbuch. Die zweite Ebene enthält einzelne Präprozessortypen kombiniert mit den gegebenen pipeline_family. Diese logische Gruppierung ist beim Anlegen des HPO-Jobs erforderlich.

Definieren Sie HPO-Tuner-Argumente

Um die Übergabe von Argumenten an das HPO zu optimieren Tuner Klasse, die HyperparameterTunerArgs Die Datenklasse wird mit den für die HPO-Klasse erforderlichen Argumenten initialisiert. Es verfügt über eine Reihe von Funktionen, die sicherstellen, dass HPO-Argumente in einem Format zurückgegeben werden, das bei der gleichzeitigen Bereitstellung mehrerer Modelldefinitionen erwartet wird.

Der nächste Codeblock verwendet den zuvor eingeführten HyperparameterTunerArgs Datenklasse. Sie erstellen ein weiteres Wörterbuch mit dem Namen hp_args und generieren Sie jeweils einen Satz spezifischer Eingabeparameter estimator_family von dem estimators Wörterbuch. Diese Argumente werden im nächsten Schritt bei der Initialisierung von HPO-Jobs für jede Modellfamilie verwendet.

Erstellen Sie HPO-Tuner-Objekte

In diesem Schritt erstellen Sie für jeden einzelne Tuner estimator_family. Warum erstellen Sie drei separate HPO-Jobs, anstatt nur einen für alle Schätzer zu starten? Der HyperparameterTuner Die Klasse ist auf 10 angehängte Modelldefinitionen beschränkt. Daher ist jeder HPO dafür verantwortlich, den leistungsstärksten Präprozessor für eine bestimmte Modellfamilie zu finden und die Hyperparameter dieser Modellfamilie abzustimmen.

Im Folgenden noch ein paar Punkte zum Setup:

- Die Optimierungsstrategie ist Bayesianisch, was bedeutet, dass das HPO die Leistung aller Versuche aktiv überwacht und die Optimierung in Richtung vielversprechenderer Hyperparameterkombinationen steuert. Frühzeitiges Stoppen sollte eingestellt werden Off or Auto wenn mit einer Bayes'schen Strategie gearbeitet wird, die diese Logik selbst verwaltet.

- Jeder HPO-Job wird für maximal 100 Jobs ausgeführt und führt 10 Jobs parallel aus. Wenn Sie mit größeren Datensätzen arbeiten, möchten Sie möglicherweise die Gesamtzahl der Jobs erhöhen.

- Darüber hinaus möchten Sie möglicherweise Einstellungen verwenden, die steuern, wie lange ein Job ausgeführt wird und wie viele Jobs Ihr HPO auslöst. Eine Möglichkeit, dies zu erreichen, besteht darin, die maximale Laufzeit in Sekunden festzulegen (für diesen Beitrag legen wir sie auf 1 Stunde fest). Eine andere Möglichkeit besteht darin, das kürzlich veröffentlichte zu verwenden

TuningJobCompletionCriteriaConfig. Es bietet eine Reihe von Einstellungen, die den Fortschritt Ihrer Jobs überwachen und entscheiden, ob es wahrscheinlich ist, dass weitere Jobs das Ergebnis verbessern. In diesem Beitrag legen wir die maximale Anzahl der Trainingsjobs, die sich nicht verbessern, auf 20 fest. Wenn sich die Punktzahl also nicht verbessert (z. B. ab dem vierzigsten Versuch), müssen Sie für die verbleibenden Versuche erst bezahlenmax_jobsist erreicht.

Lassen Sie uns nun die durchlaufen tuners und hp_args Wörterbücher und lösen alle HPO-Jobs in SageMaker aus. Beachten Sie die Verwendung des auf gesetzten Wartearguments False, was bedeutet, dass der Kernel nicht wartet, bis die Ergebnisse vollständig sind und Sie alle Jobs auf einmal auslösen können.

Es ist wahrscheinlich, dass nicht alle Schulungsaufträge abgeschlossen werden und einige von ihnen möglicherweise durch den HPO-Auftrag gestoppt werden. Der Grund dafür ist die TuningJobCompletionCriteriaConfig– Die Optimierung wird abgeschlossen, wenn eines der angegebenen Kriterien erfüllt ist. In diesem Fall, wenn sich die Optimierungskriterien für 20 aufeinanderfolgende Jobs nicht verbessern.

Ergebnisse analysieren

Zelle 15 des Notebooks prüft, ob alle HPO-Jobs abgeschlossen sind, und kombiniert alle Ergebnisse in Form eines Pandas-Datenrahmens zur weiteren Analyse. Bevor wir die Ergebnisse im Detail analysieren, werfen wir einen allgemeinen Blick auf die SageMaker-Konsole.

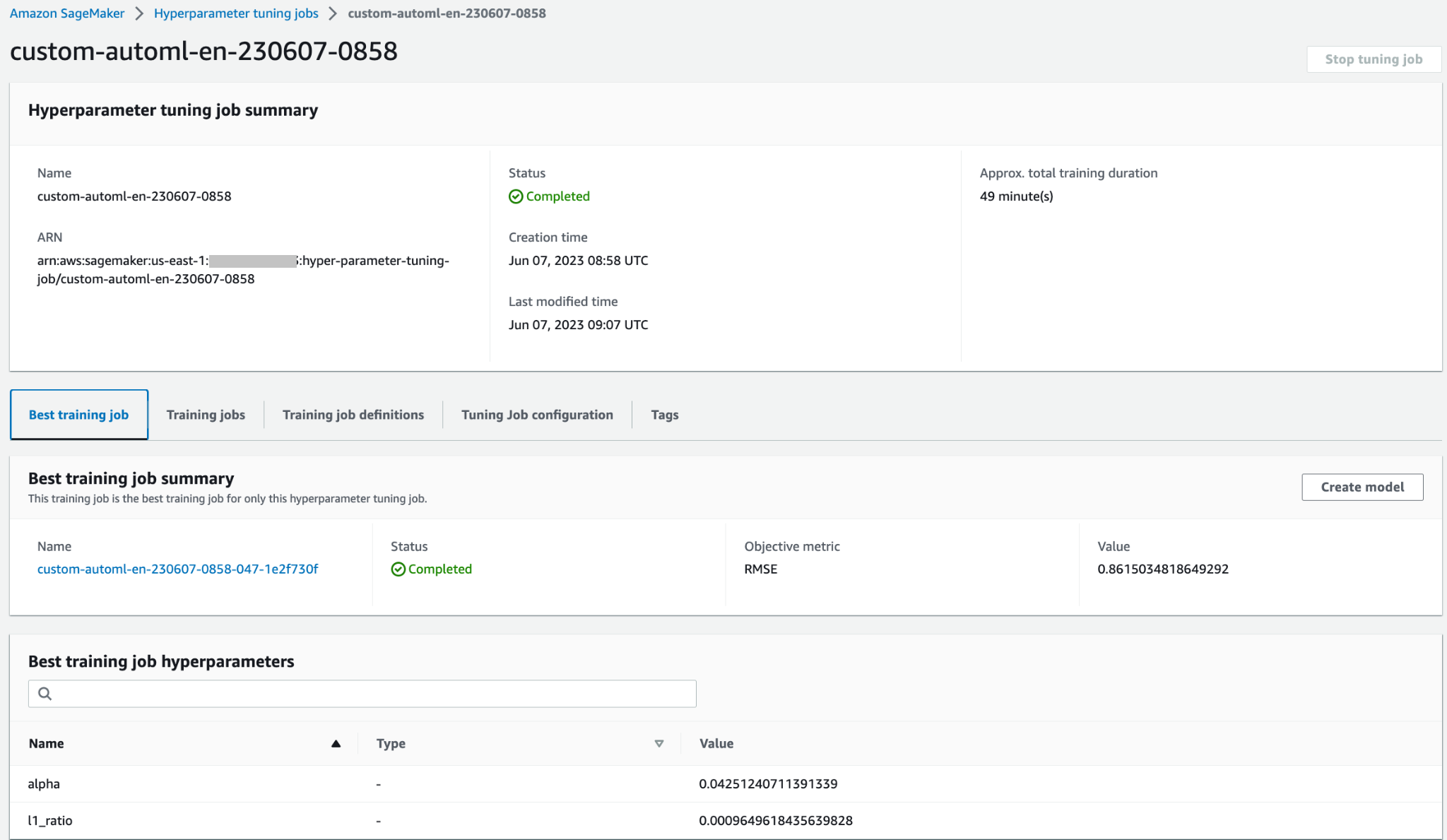

An der Spitze der Hyperparameter-Tuning-Jobs Auf der Seite können Sie Ihre drei gestarteten HPO-Jobs sehen. Alle waren vorzeitig fertig und haben nicht alle 100 Ausbildungsaufgaben erledigt. Im folgenden Screenshot sehen Sie, dass die Elastic-Net-Modellfamilie die meisten Versuche absolvierte, während andere nicht so viele Trainingsjobs benötigten, um das beste Ergebnis zu erzielen.

Sie können den HPO-Job öffnen, um auf weitere Details zuzugreifen, wie z. B. einzelne Trainingsjobs, Jobkonfiguration und die Informationen und Leistung des besten Trainingsjobs.

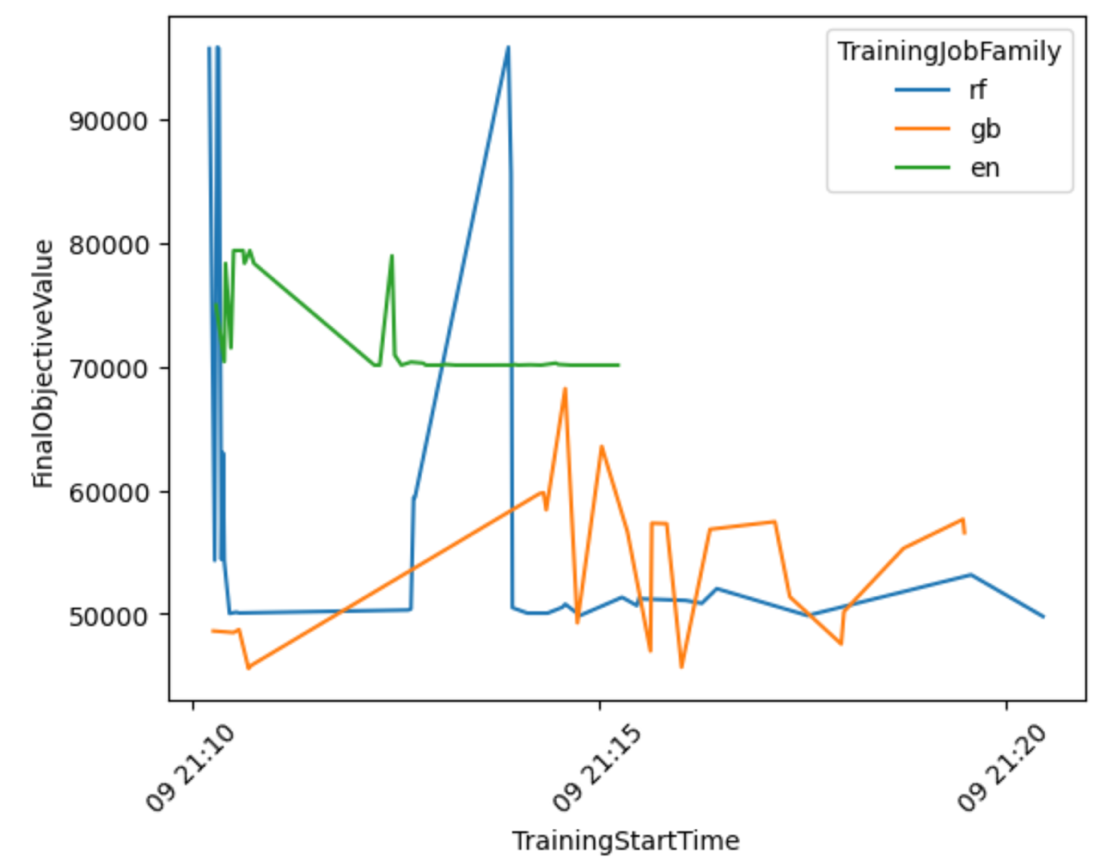

Lassen Sie uns eine Visualisierung basierend auf den Ergebnissen erstellen, um mehr Einblicke in die Leistung des AutoML-Workflows über alle Modellfamilien hinweg zu erhalten.

Aus der folgenden Grafik können Sie schließen, dass die Elastic-Net Die Leistung des Modells schwankte zwischen 70,000 und 80,000 RMSE und kam schließlich zum Stillstand, da der Algorithmus seine Leistung trotz des Versuchs verschiedener Vorverarbeitungstechniken und Hyperparameterwerte nicht verbessern konnte. Es scheint auch so RandomForest Die Leistung variierte stark je nach dem von HPO untersuchten Hyperparametersatz, aber trotz vieler Versuche konnte sie nicht unter den 50,000 RMSE-Fehler fallen. GradientBoosting erzielte bereits von Anfang an die beste Leistung bei unter 50,000 RMSE. HPO versuchte, dieses Ergebnis weiter zu verbessern, konnte jedoch bei anderen Hyperparameterkombinationen keine bessere Leistung erzielen. Eine allgemeine Schlussfolgerung für alle HPO-Jobs ist, dass nicht so viele Jobs erforderlich waren, um den leistungsstärksten Satz von Hyperparametern für jeden Algorithmus zu finden. Um das Ergebnis weiter zu verbessern, müssten Sie mit der Erstellung weiterer Features und der Durchführung zusätzlicher Feature-Engineerings experimentieren.

Sie können auch eine detailliertere Ansicht der Modell-Präprozessor-Kombination untersuchen, um Rückschlüsse auf die vielversprechendsten Kombinationen zu ziehen.

Wählen Sie das beste Modell aus und stellen Sie es bereit

Der folgende Codeausschnitt wählt das beste Modell basierend auf dem niedrigsten erreichten Zielwert aus. Anschließend können Sie das Modell als SageMaker-Endpunkt bereitstellen.

Aufräumen

Um unerwünschte Belastungen Ihres AWS-Kontos zu verhindern, empfehlen wir, die AWS-Ressourcen zu löschen, die Sie in diesem Beitrag verwendet haben:

- Leeren Sie auf der Amazon S3-Konsole die Daten aus dem S3-Bucket, in dem die Trainingsdaten gespeichert wurden.

- Stoppen Sie auf der SageMaker-Konsole die Notebook-Instanz.

- Löschen Sie den Modellendpunkt, wenn Sie ihn bereitgestellt haben. Endpunkte sollten gelöscht werden, wenn sie nicht mehr verwendet werden, da die Abrechnung nach Bereitstellungszeit erfolgt.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Sie mit einer benutzerdefinierten Auswahl an Algorithmen und Vorverarbeitungstechniken einen benutzerdefinierten HPO-Auftrag in SageMaker erstellen. Dieses Beispiel zeigt insbesondere, wie der Prozess der Generierung vieler Trainingsskripts automatisiert wird und wie Python-Programmierstrukturen für die effiziente Bereitstellung mehrerer paralleler Optimierungsjobs verwendet werden. Wir hoffen, dass diese Lösung das Gerüst für alle benutzerdefinierten Modelloptimierungsaufträge bildet, die Sie mit SageMaker bereitstellen, um eine höhere Leistung und Beschleunigung Ihrer ML-Workflows zu erzielen.

Schauen Sie sich die folgenden Ressourcen an, um Ihr Wissen über die Verwendung von SageMaker HPO weiter zu vertiefen:

Über die Autoren

Konrad Semsch ist Senior ML Solutions Architect beim Amazon Web Services Data Lab Team. Er hilft Kunden dabei, maschinelles Lernen zu nutzen, um ihre geschäftlichen Herausforderungen mit AWS zu lösen. Er erfindet und vereinfacht gerne, um Kunden einfache und pragmatische Lösungen für ihre KI/ML-Projekte zu ermöglichen. Seine größte Leidenschaft gilt MlOps und der traditionellen Datenwissenschaft. Außerhalb der Arbeit ist er ein großer Fan des Windsurfens und Kitesurfens.

Konrad Semsch ist Senior ML Solutions Architect beim Amazon Web Services Data Lab Team. Er hilft Kunden dabei, maschinelles Lernen zu nutzen, um ihre geschäftlichen Herausforderungen mit AWS zu lösen. Er erfindet und vereinfacht gerne, um Kunden einfache und pragmatische Lösungen für ihre KI/ML-Projekte zu ermöglichen. Seine größte Leidenschaft gilt MlOps und der traditionellen Datenwissenschaft. Außerhalb der Arbeit ist er ein großer Fan des Windsurfens und Kitesurfens.

Thunfisch Ersoy ist Senior Solutions Architect bei AWS. Ihr Hauptaugenmerk liegt darauf, Kunden aus dem öffentlichen Sektor bei der Einführung von Cloud-Technologien für ihre Arbeitslasten zu unterstützen. Sie verfügt über einen Hintergrund in Anwendungsentwicklung, Unternehmensarchitektur und Contact-Center-Technologien. Zu ihren Interessen zählen serverlose Architekturen und KI/ML.

Thunfisch Ersoy ist Senior Solutions Architect bei AWS. Ihr Hauptaugenmerk liegt darauf, Kunden aus dem öffentlichen Sektor bei der Einführung von Cloud-Technologien für ihre Arbeitslasten zu unterstützen. Sie verfügt über einen Hintergrund in Anwendungsentwicklung, Unternehmensarchitektur und Contact-Center-Technologien. Zu ihren Interessen zählen serverlose Architekturen und KI/ML.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Fähig

- LiveBuzz

- Zugang

- Nach

- Konto

- Erreichen

- erreicht

- über

- aktiv

- Zusätzliche

- zusätzlich

- adoptieren

- Nach der

- AI / ML

- Ziel

- Algorithmus

- Algorithmen

- Alle

- Zulassen

- erlaubt

- bereits

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analyse

- analysieren

- Analyse

- und

- Ein anderer

- jedem

- Anwendung

- Anwendungsentwicklung

- angewandt

- gilt

- Bewerben

- genehmigt

- Architektur

- SIND

- Argument

- Argumente

- AS

- annehmen

- At

- anhängen

- Auto

- automatisieren

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- AutoML

- verfügbar

- AWS

- Hintergrund

- Base

- basierend

- Baseline

- Bayesianisch

- BE

- weil

- Bevor

- Anfang

- unten

- BESTE

- Besser

- zwischen

- Big

- Blockieren

- Blockiert

- beide

- Geäst

- bauen

- Building

- Geschäft

- aber

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- Kalifornien

- rufen Sie uns an!

- namens

- CAN

- Kandidat

- Häuser

- Fälle

- Center

- Ketten

- Herausforderungen

- Übernehmen

- Änderungen

- Gebühren

- Schecks

- Auswählen

- Klasse

- CLF

- Auftraggeber

- Cloud

- Cluster

- Clustering

- Code

- Kolonne

- Spalten

- Kombination

- Kombinationen

- kombiniert

- vereint

- kommt

- Kommentar

- gemeinsam

- abschließen

- Abgeschlossene Verkäufe

- Abschluss

- kompliziert

- Schluss

- Abschluss

- Leiten

- Konfiguration

- aufeinanderfolgenden

- Konsul (Console)

- Kontakt

- Contact Center

- enthält

- Kontrast

- Smartgeräte App

- Kosten

- Kosten

- könnte

- erstellen

- erstellt

- Erstellen

- Kriterien

- wichtig

- Zur Zeit

- Original

- Kunden

- technische Daten

- Datenwissenschaft

- Datensätze

- Behandlung

- entscheidet

- Vertiefen

- Standard

- definiert

- Definiert

- Definition

- Definitionen

- zeigen

- zeigt

- abhängen

- Abhängigkeiten

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- ableiten

- Trotz

- Detail

- detailliert

- Details

- entwickeln

- entwickelt

- Entwicklung

- entwickelt

- Abweichung

- DICT

- anders

- Verzeichnisse

- diskutieren

- diskutiert

- do

- Tut nicht

- Domain

- Nicht

- nach unten

- zeichnen

- trocknen

- Dauer

- im

- dynamisch

- jeder

- Früh

- effizient

- eliminiert

- ermöglichen

- Endpunkt

- Entwicklung

- gewährleisten

- sorgt

- Unternehmen

- Ganz

- vollständig

- gleich

- Fehler

- bewerten

- Bewerten

- schließlich

- Jedes

- untersuchen

- Beispiel

- Beispiele

- Ausführung

- existieren

- erwarten

- erwartet

- Experiment

- erklärt

- Erkundet

- erforscht

- falsch

- Familien

- Familie

- Fan

- Merkmal

- Eigenschaften

- wenige

- Feld

- Reichen Sie das

- gefüllt

- Finden Sie

- Suche nach

- Vorname

- passen

- fünf

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- folgt

- Aussichten für

- Wald

- unten stehende Formular

- Format

- FRAME

- für

- Materials des

- voller

- Funktion

- Funktionalität

- Funktionen

- weiter

- Allgemeines

- erzeugen

- erzeugt

- Erzeugung

- bekommen

- Git

- GitHub

- gegeben

- Go

- Kundenziele

- gehen

- Graph

- Pflege

- Griffe

- Haben

- mit

- he

- schwer

- schweres Heben

- Unternehmen

- hilft

- hier (auf dänisch)

- High-Level

- höher

- höchste

- ein Geschenk

- Stunde

- Häuser

- Haushalte

- Gehäuse

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- Hyperparameteroptimierung

- Hyperparameter-Tuning

- Identitätsschutz

- if

- implementieren

- Implementierung

- importieren

- Importe

- zu unterstützen,

- Verbesserung

- in

- das

- Einschließlich

- Erhöhung

- zeigen

- Krankengymnastik

- Individuell

- Information

- Varianten des Eingangssignals:

- Eingänge

- Einsätze

- Einblicke

- Instanz

- beantragen müssen

- Anleitung

- Integration

- absichtlich

- Interessen

- Schnittstelle

- in

- eingeführt

- IT

- SEINE

- selbst

- Job

- Jobs

- jpg

- nur

- nur einer

- Behalten

- Wesentliche

- Wissen

- Labor

- grosse

- größer

- später

- ins Leben gerufen

- Start

- lernen

- links

- Länge

- Niveau

- Cholesterinspiegel

- Lebenszyklus

- Facelift

- Gefällt mir

- wahrscheinlich

- Begrenzung

- linux

- Belastung

- örtlich

- located

- Standorte

- Logik

- logisch

- Lang

- länger

- aussehen

- Los

- niedrigste

- Maschine

- Maschinelles Lernen

- viele

- maximal

- Kann..

- bedeuten

- Mittel

- Merge

- versiegelte

- Metrik

- könnte

- Minuten

- Kommt demnächst...

- ML

- MLOps

- Modell

- für

- ändern

- Überwachen

- Monitore

- mehr

- vor allem warme

- mehrere

- Name

- schmal

- navigiert

- Need

- Neu

- neu

- weiter

- nicht

- Andere

- Notizbuch

- bekannt

- jetzt an

- Anzahl

- numpig

- Objekt

- Ziel

- Objekte

- of

- WOW!

- Angebote

- on

- einmal

- EINEM

- einzige

- XNUMXh geöffnet

- Einkauf & Prozesse

- optimal

- Optimierung

- Optimieren

- optimiert

- or

- Auftrag

- OS

- Andere

- Anders

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Gesamt-

- Seite

- Pandas

- Parallel

- Parameter

- Teil

- besondere

- Bestehen

- leidenschaftlich

- Weg

- AUFMERKSAMKEIT

- Ausführen

- Leistung

- Durchführung

- besteht fort

- Stücke

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielt

- Stecker

- Points

- Punkte

- Datenschutzrichtlinien

- Bevölkerung

- möglich

- Post

- Potenzial

- pragmatisch

- vorhersagen

- Predictor

- Danach

- Voraussetzungen

- Geschenke

- verhindern

- vorher

- gebühr

- primär

- Aufgabenstellung:

- Prozessdefinierung

- produziert

- Produktion

- Programmierung

- Fortschritt

- Projekt

- Projekte

- aussichtsreich

- immobilien

- die

- bietet

- Bereitstellung

- Öffentlichkeit

- Zweck

- Python

- zufällig

- schnell

- erreicht

- bereit

- Grund

- kürzlich

- Rezept

- empfehlen

- Aufzeichnungen

- Veteran

- reduziert

- siehe

- Referenz

- in Bezug auf

- Regex

- Region

- freigegeben

- relevant

- verbleibenden

- entfernen

- wiederholen

- Quelle

- Anforderung

- erfordern

- falls angefordert

- Downloads

- diejenigen

- für ihren Verlust verantwortlich.

- eingeschränkt

- Folge

- Die Ergebnisse

- Rückkehr

- Recht

- Rollen

- Führen Sie

- Laufen

- läuft

- Laufzeit

- sagemaker

- Automatisches SageMaker-Modelltuning

- Gerettet

- Skalieren

- Skalierung

- Wissenschaft

- Wissenschaftler

- scikit-lernen

- Umfang

- Ergebnis

- Skript

- Skripte

- Zweite

- Sekunden

- Abschnitt

- Abschnitte

- Bibliotheken

- sehen

- scheint

- ausgewählt

- Auswahl

- SELF

- Senior

- getrennte

- brauchen

- Serverlos

- Lösungen

- Sitzung

- kompensieren

- Sets

- Einstellungen

- Setup

- sie

- sollte

- präsentiert

- gezeigt

- Konzerte

- Einfacher

- Vereinfachung

- einfach

- Schnipsel

- So

- Lösung

- Lösungen

- LÖSEN

- einige

- spezialisiert

- spezifisch

- Spezifikation

- Spezifikationen

- angegeben

- Geschwindigkeit

- gespalten

- Stapel

- Standard

- Anfang

- Beginnen Sie

- Status

- Schritt

- Shritte

- Stoppen

- gestoppt

- Einstellung

- Lagerung

- gelagert

- Speicherung

- Strategie

- Struktur

- Strukturen

- Anschließend

- so

- Unterstützte

- Tabelle

- zugeschnitten

- Nehmen

- Target

- Team

- Technische

- Techniken

- Technologies

- Terminal

- Test

- Testen

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Schwelle

- Durch

- Zeit

- zu

- gemeinsam

- Werkzeug

- Top

- Gesamt

- gegenüber

- traditionell

- Training

- Ausbildung

- Transformationen

- Versuch

- Studien

- versucht

- auslösen

- ausgelöst

- Auslösen

- Versuch

- Abstimmung

- XNUMX

- tippe

- Typen

- typisch

- ui

- für

- Verständnis

- einzigartiges

- bis

- unerwünscht

- hochgeladen

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- verwendet

- Verwendung von

- BESTÄTIGEN

- Wert

- Werte

- Variable

- vielfältig

- verschiedene

- Version

- Versionen

- Anzeigen

- Visualisierung

- W

- warten

- Walkthrough

- wollen

- wurde

- Weg..

- we

- Netz

- Web-Services

- GUT

- waren

- Was

- wann

- während

- ob

- welche

- warum

- werden wir

- mit

- .

- ohne

- Arbeiten

- Arbeitsablauf.

- Workflows

- arbeiten,

- würde

- schreiben

- noch

- Du

- Ihr

- sich selbst

- Zephyrnet