Fake News, definiert als Nachrichten, die falsche, fabrizierte oder absichtlich irreführende Informationen vermitteln oder enthalten, gab es bereits seit dem Aufkommen des Buchdrucks. Die rasante Verbreitung von Fake News und Desinformation im Internet täuscht nicht nur die Öffentlichkeit, sondern kann auch tiefgreifende Auswirkungen auf Gesellschaft, Politik, Wirtschaft und Kultur haben. Beispiele beinhalten:

- Misstrauen gegenüber den Medien kultivieren

- Untergrabung des demokratischen Prozesses

- Verbreitung falscher oder diskreditierter Wissenschaft (z. B. der Anti-Vax-Bewegung)

Fortschritte in der künstlichen Intelligenz (KI) und im maschinellen Lernen (ML) haben die Entwicklung von Tools zum Erstellen und Teilen gefälschter Nachrichten noch einfacher gemacht. Zu den ersten Beispielen gehören fortschrittliche Social Bots und automatisierte Konten, die die Anfangsphase der Verbreitung gefälschter Nachrichten beschleunigen. Im Allgemeinen ist es für die Öffentlichkeit nicht trivial festzustellen, ob es sich bei solchen Konten um Personen oder Bots handelt. Darüber hinaus sind Social Bots keine illegalen Tools und viele Unternehmen erwerben sie im Rahmen ihrer Marketingstrategie legal. Daher ist es nicht einfach, den Einsatz von Social Bots systematisch einzudämmen.

Jüngste Erkenntnisse auf dem Gebiet der generativen KI ermöglichen es, mit Hilfe großer Sprachmodelle (LLMs) Textinhalte in einem noch nie dagewesenen Tempo zu produzieren. LLMs sind generative KI-Textmodelle mit über 1 Milliarde Parametern und erleichtern die Synthese hochwertiger Texte.

In diesem Beitrag untersuchen wir, wie Sie LLMs nutzen können, um das weit verbreitete Problem der Erkennung gefälschter Nachrichten anzugehen. Wir gehen davon aus, dass LLMs für diese Aufgabe ausreichend fortgeschritten sind, insbesondere wenn verbesserte Prompt-Techniken wie z Gedankenkette und Reagieren werden in Verbindung mit Tools zur Informationsbeschaffung verwendet.

Wir veranschaulichen dies, indem wir eine erstellen LangChain Anwendung, die den Benutzer anhand einer Nachricht in natürlicher Sprache darüber informiert, ob der Artikel wahr oder falsch ist. Die Lösung nutzt auch Amazonas Grundgestein, ein vollständig verwalteter Dienst, der Foundation-Modelle (FMs) von Amazon und Drittanbietern von Modellen über das zugänglich macht AWS-Managementkonsole und APIs.

LLMs und Fake News

Das Fake-News-Phänomen begann sich mit dem Aufkommen des Internets und insbesondere der sozialen Medien rasant zu entwickeln (Nielsen et al., 2017). In sozialen Medien können Fake News schnell im Netzwerk eines Nutzers geteilt werden und so dazu führen, dass sich in der Öffentlichkeit eine falsche kollektive Meinung bildet. Darüber hinaus verbreiten Menschen Fake News oft impulsiv und ignorieren die Faktizität des Inhalts, wenn die Nachrichten ihren persönlichen Normen entsprechen (Tsipursky et al. 2018). Untersuchungen in den Sozialwissenschaften haben ergeben, dass kognitive Voreingenommenheit (Bestätigungsvoreingenommenheit, Mitläufereffekt und entscheidungsunterstützende Voreingenommenheit) einer der entscheidendsten Faktoren für irrationale Entscheidungen ist, sowohl hinsichtlich der Erstellung als auch des Konsums gefälschter Nachrichten (Kim et al., 2021). Dies impliziert auch, dass Nachrichtenkonsumenten Informationen nur zur Stärkung ihrer Überzeugungen weitergeben und konsumieren.

Die Fähigkeit der generativen KI, in beispiellosem Tempo textliche und reichhaltige Inhalte zu produzieren, verschärft das Fake-News-Problem. Ein erwähnenswertes Beispiel ist die Deepfake-Technologie – das Kombinieren verschiedener Bilder in einem Originalvideo und die Erstellung eines anderen Videos. Neben der Desinformationsabsicht, die menschliche Akteure mit sich bringen, bringen LLMs eine ganze Reihe neuer Herausforderungen mit sich:

- Sachliche Fehler – Bei LLMs besteht aufgrund der Art ihrer Ausbildung und ihrer Fähigkeit, beim Generieren der nächsten Wörter in einem Satz kreativ zu sein, ein erhöhtes Risiko, sachliche Fehler zu enthalten. Das LLM-Training basiert auf der wiederholten Präsentation eines Modells mit unvollständigen Eingaben und der anschließenden Verwendung von ML-Trainingstechniken, bis die Lücken korrekt gefüllt werden, wodurch die Sprachstruktur und ein sprachbasiertes Weltmodell erlernt werden. Obwohl LLMs hervorragende Mustervergleicher und Neukombinierer sind („stochastische Papageien“), versagen sie daher bei einer Reihe einfacher Aufgaben, die logisches Denken oder mathematische Schlussfolgerungen erfordern, und können Antworten halluzinieren. Darüber hinaus ist die Temperatur einer der LLM-Eingabeparameter, der das Verhalten des Modells bei der Generierung des nächsten Wortes in einem Satz steuert. Durch die Auswahl einer höheren Temperatur verwendet das Modell ein Wort mit geringerer Wahrscheinlichkeit und liefert so eine zufälligere Antwort.

- Langwierig – Generierte Texte sind in der Regel langwierig und weisen keine klar definierte Granularität für einzelne Sachverhalte auf.

- Mangelnde Faktenprüfung – Für die Faktenprüfung während der Texterstellung stehen keine standardisierten Tools zur Verfügung.

Insgesamt hat die Kombination aus menschlicher Psychologie und den Einschränkungen von KI-Systemen einen perfekten Sturm für die Verbreitung gefälschter Nachrichten und Fehlinformationen im Internet geschaffen.

Lösungsüberblick

LLMs zeigen herausragende Fähigkeiten in der Sprachgenerierung, im Sprachverständnis und beim Lernen in wenigen Schritten. Sie werden auf einem riesigen Textkorpus aus dem Internet geschult, wobei die Qualität und Genauigkeit der extrahierten natürlichen Sprache möglicherweise nicht gewährleistet ist.

In diesem Beitrag stellen wir eine Lösung zur Erkennung gefälschter Nachrichten vor, die sowohl auf Chain-of-Thought- als auch auf Re-Act-Ansätzen (Reasoning and Acting) basiert. Zuerst besprechen wir diese beiden Prompt-Engineering-Techniken und zeigen dann ihre Implementierung mit LangChain und Amazon Bedrock.

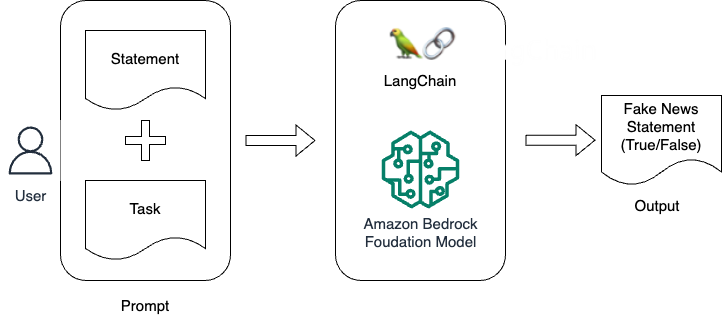

Das folgende Architekturdiagramm skizziert die Lösung für unseren Fake-News-Detektor.

Architekturdiagramm zur Erkennung gefälschter Nachrichten.

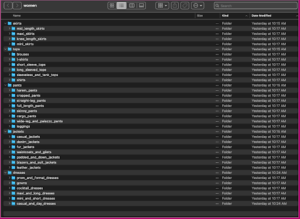

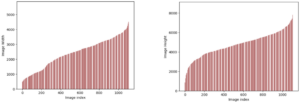

Wir verwenden eine Teilmenge davon FEVER-Datensatz enthält eine Aussage und die grundlegende Wahrheit über die Aussage, die auf falsche, wahre oder nicht überprüfbare Behauptungen hinweist (Thorne J. et al., 2018).

Der Arbeitsablauf kann in die folgenden Schritte unterteilt werden:

- Der Benutzer wählt eine der Aussagen aus, um zu prüfen, ob sie falsch oder wahr ist.

- Die Aussage und die Aufgabe zur Fake-News-Erkennung werden in die Eingabeaufforderung integriert.

- Die Eingabeaufforderung wird an LangChain übergeben, das das FM in Amazon Bedrock aufruft.

- Amazon Bedrock gibt eine Antwort auf die Benutzeranfrage mit der Aussage „True“ oder „False“ zurück.

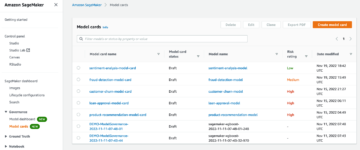

In diesem Beitrag verwenden wir das Claude v2-Modell von Anthropic (anthropic.claude-v2). Claude ist ein generatives LLM, das auf der Forschung von Anthropic zur Schaffung zuverlässiger, interpretierbarer und steuerbarer KI-Systeme basiert. Claude wurde mithilfe von Techniken wie konstitutioneller KI und Harmlosigkeitstraining erstellt und zeichnet sich durch durchdachten Dialog, Inhaltserstellung, komplexes Denken, Kreativität und Kodierung aus. Durch die Nutzung von Amazon Bedrock und unserer Lösungsarchitektur haben wir jedoch auch die Flexibilität, zwischen anderen FMs von zu wählen Amazon, AI21labs, Zusammenhängen und Stabilität. ai.

Die Implementierungsdetails finden Sie in den folgenden Abschnitten. Der Quellcode ist verfügbar in das GitHub-Repository.

Voraussetzungen:

Für dieses Tutorial benötigen Sie ein Bash-Terminal mit Python 3.9 oder höher, das entweder auf Linux, Mac oder einem Windows-Subsystem für Linux installiert ist, und ein AWS-Konto.

Wir empfehlen außerdem die Verwendung von entweder an Amazon SageMaker-Studio Notizbuch, ein AWS Cloud9 Instanz, oder ein Amazon Elastic Compute-Cloud (Amazon EC2)-Instanz.

Stellen Sie die Erkennung gefälschter Nachrichten mithilfe der Amazon Bedrock API bereit

Die Lösung nutzt die Amazon Bedrock API, auf die über zugegriffen werden kann AWS-Befehlszeilenschnittstelle (AWS CLI), die AWS SDK für Python (Boto3), Oder Amazon Sage Maker Notizbuch. Siehe die Amazon Bedrock-Benutzerhandbuch für mehr Informationen. Für diesen Beitrag verwenden wir die Amazon Bedrock API über das AWS SDK für Python.

Richten Sie die Amazon Bedrock API-Umgebung ein

Führen Sie die folgenden Schritte aus, um Ihre Amazon Bedrock API-Umgebung einzurichten:

- Laden Sie das neueste Boto3 herunter oder aktualisieren Sie es:

- Stellen Sie sicher, dass Sie die AWS-Anmeldeinformationen mithilfe von konfigurieren

aws configureBefehl eingeben oder an den Boto3-Client übergeben. - Installieren Sie die neueste Version von LangChain:

Sie können Ihr Setup jetzt mit dem folgenden Python-Shell-Skript testen. Das Skript instanziiert den Amazon Bedrock-Client mithilfe von Boto3. Als nächstes nennen wir die list_foundation_models API, um die Liste der zur Verwendung verfügbaren Fundamentmodelle abzurufen.

Nachdem Sie den vorherigen Befehl erfolgreich ausgeführt haben, sollten Sie die Liste der FMs von Amazon Bedrock erhalten.

LangChain als schnelle Verkettungslösung

Um Fake News für einen bestimmten Satz zu erkennen, folgen wir dem Zero-Shot-Chain-of-Thought-Argumentationsprozess (Wei J. et al., 2022), das aus den folgenden Schritten besteht:

- Zunächst versucht das Modell, eine Aussage über die angezeigten Nachrichten zu treffen.

- Das Modell erstellt eine Liste mit Aufzählungspunkten von Behauptungen.

- Für jede Behauptung bestimmt das Modell, ob die Behauptung wahr oder falsch ist. Beachten Sie, dass sich das Modell bei dieser Methodik ausschließlich auf sein internes Wissen (in der Vortrainingsphase berechnete Gewichte) verlässt, um zu einem Urteil zu gelangen. Die Informationen werden zu diesem Zeitpunkt noch nicht mit externen Daten abgeglichen.

- Angesichts der Fakten antwortet das Modell auf die gegebene Aussage in der Eingabeaufforderung mit WAHR oder FALSCH.

Um diese Schritte zu erreichen, verwenden wir LangChain, ein Framework zur Entwicklung von Anwendungen, die auf Sprachmodellen basieren. Dieses Framework ermöglicht es uns, die FMs durch die Verkettung verschiedener Komponenten zu erweitern, um erweiterte Anwendungsfälle zu erstellen. In dieser Lösung verwenden wir die integrierte SimpleSequentialChain in LangChain, um eine einfache sequentielle Kette zu erstellen. Dies ist sehr nützlich, da wir die Ausgabe einer Kette als Eingabe für eine andere verwenden können.

Amazon Bedrock ist in LangChain integriert, sodass Sie es nur durch Übergabe von instanziieren müssen model_id beim Instanziieren des Amazon Bedrock-Objekts. Bei Bedarf können die Modellinferenzparameter über bereitgestellt werden model_kwargs Argument, wie zum Beispiel:

- maxTokenCount – Die maximale Anzahl von Tokens in der generierten Antwort

- stopSequences – Die vom Modell verwendete Stoppsequenz

- Temperatur – Ein Wert im Bereich zwischen 0 und 1, wobei 0 für den deterministischsten und 1 für den kreativsten Wert steht

- Top – Ein Wert, der zwischen 0 und 1 liegt und zur Steuerung der Token-Auswahl basierend auf der Wahrscheinlichkeit der möglichen Entscheidungen verwendet wird

Wenn Sie zum ersten Mal ein Amazon Bedrock-Grundmodell verwenden, stellen Sie sicher, dass Sie Zugriff auf das Modell anfordern, indem Sie aus der Liste der Modelle auf der auswählen Modellzugriff Seite auf der Amazon Bedrock-Konsole, in unserem Fall claude-v2 von Anthropic.

Die folgende Funktion definiert die zuvor erwähnte Chain-of-Thought-Eingabeaufforderungskette zur Erkennung gefälschter Nachrichten. Die Funktion verwendet das Amazon Bedrock-Objekt (llm) und die Benutzeraufforderung (q) als Argumente. LangChains PromptTemplate Die Funktionalität wird hier verwendet, um ein Rezept für die Generierung von Eingabeaufforderungen vorzudefinieren.

Der folgende Code ruft die zuvor definierte Funktion auf und liefert die Antwort. Die Aussage ist TRUE or FALSE. TRUE bedeutet, dass die bereitgestellte Aussage korrekte Fakten enthält, und FALSE bedeutet, dass die Aussage mindestens eine falsche Tatsache enthält.

Ein Beispiel für eine Anweisung und eine Modellantwort finden Sie in der folgenden Ausgabe:

ReAct und Werkzeuge

Im vorherigen Beispiel hat das Modell korrekt erkannt, dass die Aussage falsch ist. Das erneute Einreichen der Abfrage zeigt jedoch, dass das Modell nicht in der Lage ist, die Richtigkeit von Fakten zu erkennen. Das Modell verfügt nicht über die Werkzeuge, um den Wahrheitsgehalt von Aussagen außerhalb seines eigenen Trainingsgedächtnisses zu überprüfen, sodass nachfolgende Durchläufe derselben Eingabeaufforderung dazu führen können, dass gefälschte Aussagen fälschlicherweise als wahr eingestuft werden. Im folgenden Code haben Sie eine andere Ausführung desselben Beispiels:

Eine Technik zur Gewährleistung der Wahrhaftigkeit ist ReAct. Reagieren (Yao S. et al., 2023) ist eine Prompt-Technik, die das Basismodell um den Aktionsraum eines Agenten erweitert. In diesem Beitrag sowie im ReAct-Artikel implementiert der Aktionsbereich den Informationsabruf mithilfe von Such-, Such- und Abschlussaktionen über eine einfache Wikipedia-Web-API.

Der Grund für die Verwendung von ReAct im Vergleich zu Chain-of-Thought besteht darin, mithilfe externer Wissensabfrage das Basismodell zu erweitern und so zu erkennen, ob eine bestimmte Nachricht falsch oder wahr ist.

In diesem Beitrag verwenden wir die Implementierung von ReAct durch LangChain über den Agenten ZERO_SHOT_REACT_DESCRIPTION. Wir ändern die vorherige Funktion, um ReAct zu implementieren und Wikipedia zu verwenden, indem wir die Funktion „load_tools“ aus dem verwenden langchain.agents.

Wir müssen auch das Wikipedia-Paket installieren:

!pip install Wikipedia

Unten ist der neue Code:

Das Folgende ist die Ausgabe der vorherigen Funktion mit derselben zuvor verwendeten Anweisung:

Aufräumen

Um Kosten zu sparen, löschen Sie alle Ressourcen, die Sie im Rahmen des Tutorials bereitgestellt haben. Wenn Sie AWS Cloud9 oder eine EC2-Instanz gestartet haben, können Sie diese über die Konsole oder mithilfe der AWS CLI löschen. Ebenso können Sie das SageMaker-Notizbuch, das Sie möglicherweise über die SageMaker-Konsole erstellt haben, löschen.

Einschränkungen und damit verbundene Arbeiten

Der Bereich der Fake-News-Erkennung wird in der wissenschaftlichen Gemeinschaft aktiv erforscht. In diesem Beitrag haben wir Chain-of-Thought- und ReAct-Techniken verwendet und uns bei der Bewertung der Techniken nur auf die Genauigkeit der Klassifizierung der Prompt-Technik konzentriert (ob eine bestimmte Aussage wahr oder falsch ist). Daher haben wir andere wichtige Aspekte wie die Reaktionsgeschwindigkeit nicht berücksichtigt und die Lösung auch nicht auf weitere Wissensdatenbankquellen außer Wikipedia ausgeweitet.

Obwohl sich dieser Beitrag auf zwei Techniken konzentrierte, Chain-of-Thought und ReAct, wurde in einer umfangreichen Arbeit untersucht, wie LLMs Fake News erkennen, beseitigen oder eindämmen können. Lee et al. hat die Verwendung eines Encoder-Decoder-Modells vorgeschlagen, das NER (Named Entity Recognition) verwendet, um die benannten Entitäten zu maskieren, um sicherzustellen, dass das maskierte Token tatsächlich das im Sprachmodell codierte Wissen verwendet. Chern et.al. entwickelte FacTool, das Chain-of-Thought-Prinzipien nutzt, um Ansprüche aus der Eingabeaufforderung zu extrahieren und folglich relevante Beweise für die Ansprüche zu sammeln. Das LLM beurteilt dann anhand der abgerufenen Beweisliste den Sachverhalt der Behauptung. Du E. et al. stellt einen komplementären Ansatz dar, bei dem mehrere LLMs ihre individuellen Antworten und Argumentationsprozesse in mehreren Runden vorschlagen und diskutieren, um zu einer gemeinsamen endgültigen Antwort zu gelangen.

Basierend auf der Literatur sehen wir, dass die Wirksamkeit von LLMs bei der Erkennung gefälschter Nachrichten zunimmt, wenn die LLMs durch externes Wissen und die Fähigkeit zur Kommunikation mit mehreren Agenten ergänzt werden. Allerdings sind diese Ansätze rechenintensiver, da sie mehrere Modellaufrufe und Interaktionen, längere Eingabeaufforderungen und langwierige Netzwerkschichtaufrufe erfordern. Letztlich führt diese Komplexität zu erhöhten Gesamtkosten. Wir empfehlen, das Kosten-Leistungs-Verhältnis zu bewerten, bevor ähnliche Lösungen in der Produktion eingesetzt werden.

Zusammenfassung

In diesem Beitrag haben wir uns damit befasst, wie man mit LLMs das weit verbreitete Problem der Fake News angehen kann, das heutzutage eine der größten Herausforderungen unserer Gesellschaft darstellt. Wir begannen damit, die Herausforderungen zu skizzieren, die Fake News mit sich bringen, wobei wir den Schwerpunkt auf ihr Potenzial legten, die öffentliche Stimmung zu beeinflussen und gesellschaftliche Störungen zu verursachen.

Anschließend haben wir das Konzept von LLMs als fortschrittliche KI-Modelle eingeführt, die auf einer erheblichen Datenmenge trainiert werden. Aufgrund dieser umfassenden Ausbildung verfügen diese Modelle über ein beeindruckendes Sprachverständnis, das es ihnen ermöglicht, menschenähnliche Texte zu verfassen. Mit dieser Kapazität haben wir gezeigt, wie LLMs im Kampf gegen Fake News genutzt werden können, indem wir zwei verschiedene Aufforderungstechniken nutzen: Chain-of-Thought und ReAct.

Wir haben hervorgehoben, wie LLMs Faktenprüfungsdienste in beispiellosem Umfang ermöglichen können, da sie in der Lage sind, große Textmengen schnell zu verarbeiten und zu analysieren. Dieses Potenzial der Echtzeitanalyse kann zur Früherkennung und Eindämmung von Fake News führen. Wir haben dies veranschaulicht, indem wir ein Python-Skript erstellt haben, das dem Benutzer anhand einer Anweisung in natürlicher Sprache anzeigt, ob der Artikel wahr oder falsch ist.

Abschließend betonten wir die Grenzen des aktuellen Ansatzes und schlossen mit einer hoffnungsvollen Bemerkung, indem wir betonten, dass LLMs mit den richtigen Schutzmaßnahmen und kontinuierlichen Verbesserungen zu unverzichtbaren Instrumenten im Kampf gegen Fake News werden könnten.

Wir würden uns freuen, von Ihnen zu hören. Teilen Sie uns Ihre Meinung im Kommentarbereich mit oder nutzen Sie das Themenforum das GitHub-Repository.

Haftungsausschluss: Der in diesem Beitrag bereitgestellte Code ist nur für Bildungs- und Experimentierzwecke gedacht. Man sollte sich nicht darauf verlassen, dass sie Fake News oder Fehlinformationen in realen Produktionssystemen erkennen. Es wird keine Garantie für die Richtigkeit oder Vollständigkeit der Fake-News-Erkennung mithilfe dieses Codes übernommen. Benutzer sollten Vorsicht walten lassen und die gebotene Sorgfalt walten lassen, bevor sie diese Techniken in sensiblen Anwendungen einsetzen.

Um mit Amazon Bedrock zu beginnen, besuchen Sie die Amazon Bedrock-Konsole.

Über die Autoren

Anamaria Todor ist ein Principal Solutions Architect mit Sitz in Kopenhagen, Dänemark. Sie sah ihren ersten Computer, als sie 4 Jahre alt war, und ließ seitdem Informatik, Videospiele und Ingenieurwesen nicht mehr los. Sie hat in verschiedenen technischen Positionen gearbeitet, von der Freiberuflerin, Full-Stack-Entwicklerin bis hin zur Dateningenieurin, technischen Leiterin und CTO, bei verschiedenen Unternehmen in Dänemark, mit Schwerpunkt auf der Spiele- und Werbebranche. Sie ist seit über drei Jahren bei AWS und arbeitet als Principal Solutions Architect mit Schwerpunkt auf Biowissenschaften und KI/ML. Anamaria hat einen Bachelor-Abschluss in Angewandter Technik und Informatik, einen Master-Abschluss in Informatik und über 3 Jahre AWS-Erfahrung. Wenn sie nicht gerade arbeitet oder Videospiele spielt, coacht sie Mädchen und weibliche Berufstätige darin, Technologie zu verstehen und ihren Weg darin zu finden.

Anamaria Todor ist ein Principal Solutions Architect mit Sitz in Kopenhagen, Dänemark. Sie sah ihren ersten Computer, als sie 4 Jahre alt war, und ließ seitdem Informatik, Videospiele und Ingenieurwesen nicht mehr los. Sie hat in verschiedenen technischen Positionen gearbeitet, von der Freiberuflerin, Full-Stack-Entwicklerin bis hin zur Dateningenieurin, technischen Leiterin und CTO, bei verschiedenen Unternehmen in Dänemark, mit Schwerpunkt auf der Spiele- und Werbebranche. Sie ist seit über drei Jahren bei AWS und arbeitet als Principal Solutions Architect mit Schwerpunkt auf Biowissenschaften und KI/ML. Anamaria hat einen Bachelor-Abschluss in Angewandter Technik und Informatik, einen Master-Abschluss in Informatik und über 3 Jahre AWS-Erfahrung. Wenn sie nicht gerade arbeitet oder Videospiele spielt, coacht sie Mädchen und weibliche Berufstätige darin, Technologie zu verstehen und ihren Weg darin zu finden.

Marcel Castro ist ein Senior Solutions Architect mit Sitz in Oslo, Norwegen. In seiner Rolle unterstützt Marcel Kunden bei Architektur, Design und Entwicklung einer Cloud-optimierten Infrastruktur. Er ist Mitglied des AWS Generative AI Ambassador-Teams mit dem Ziel, EMEA-Kunden auf ihrem Weg zur generativen KI voranzutreiben und zu unterstützen. Er hat einen Doktortitel in Informatik aus Schweden und einen Master- und Bachelor-Abschluss in Elektrotechnik und Telekommunikation aus Brasilien.

Marcel Castro ist ein Senior Solutions Architect mit Sitz in Oslo, Norwegen. In seiner Rolle unterstützt Marcel Kunden bei Architektur, Design und Entwicklung einer Cloud-optimierten Infrastruktur. Er ist Mitglied des AWS Generative AI Ambassador-Teams mit dem Ziel, EMEA-Kunden auf ihrem Weg zur generativen KI voranzutreiben und zu unterstützen. Er hat einen Doktortitel in Informatik aus Schweden und einen Master- und Bachelor-Abschluss in Elektrotechnik und Telekommunikation aus Brasilien.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- :hast

- :Ist

- :nicht

- :Wo

- 100 Mio. US$

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21.

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- Fähigkeit

- Über uns

- oben

- AC

- akademisch

- akademische Forschung

- Academy

- Zugang

- Zugriff

- zugänglich

- Konto

- Trading Konten

- Genauigkeit

- Erreichen

- Leistungen

- über

- Schauspielkunst

- Action

- Aktionen

- aktiv

- Akteure

- berührt das Schneidwerkzeug

- hinzufügen

- Zusatz

- Zusätzliche

- advanced

- Advent

- Marketings

- aufs Neue

- gegen

- Makler

- Agenten

- AI

- KI-Modelle

- KI-Systeme

- AI / ML

- AL

- Alle

- erlaubt

- allein

- ebenfalls

- Obwohl

- Amazon

- Amazon EC2

- Amazon Web Services

- Ambassador

- amerikanisch

- unter

- Beträge

- an

- Analyse

- analysieren

- Alt

- und

- Jährlich

- Ein anderer

- beantworten

- Antworten

- Anthropisch

- jedem

- Bienen

- APIs

- erscheint

- Anwendung

- Anwendungen

- angewandt

- ernannt

- Ansatz

- Ansätze

- ca.

- Architektur

- SIND

- Argument

- Argumente

- um

- Artikel

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz (AI)

- Kunst

- AS

- Aspekte

- Beurteilung

- Einschätzungen

- Annahmen

- gesichert

- Astronomie

- At

- Versuche

- vermehren

- Augmented

- Augmentationen

- Automatisiert

- verfügbar

- ausgezeichnet

- AWS

- AWS Cloud9

- Base

- basierend

- bash

- Schlacht

- BE

- weil

- werden

- Werden

- war

- Bevor

- Verhalten

- hinter

- Sein

- Überzeugungen

- neben

- zwischen

- Beyond

- vorspannen

- Milliarde

- Biologie

- biomedizinische

- Körper

- beide

- Bots

- Brasil

- bringen

- Gebrochen

- eingebaut

- Geschäftsmann

- aber

- by

- rufen Sie uns an!

- Aufrufe

- CAN

- Fähigkeiten

- capability

- Kapazität

- Häuser

- Fälle

- Verursachen

- Vorsicht

- Jahrhundert

- Kette

- Ketten

- Herausforderungen

- chang

- aus der Ferne überprüfen

- Chemie

- chinesisch

- Entscheidungen

- Auswählen

- Anspruch

- aus aller Welt

- Klasse

- Einstufung

- Auftraggeber

- Menu

- Cloud9

- test name

- Code

- Programmierung

- kognitiv

- sammeln

- Collective

- Hochschule

- COLUMBIA

- Kombination

- Bemerkungen

- gemeinsam

- häufig

- community

- Unternehmen

- Vergleich

- komplementär

- abschließen

- Komplex

- Komplexität

- Komponenten

- zusammengesetzt

- Berechnen

- Computer

- Computerwissenschaften

- konzept

- geschlossen

- Schichtannahme

- Bestätigung

- Verbindung

- Folglich

- betrachtet

- konsistent

- besteht

- Konsul (Console)

- verbrauchen

- KUNDEN

- Verbrauch

- Eindämmung

- enthält

- Inhalt

- Inhaltserstellung

- kontinuierlich

- Beitrag

- Smartgeräte App

- Steuerung

- Gespräch

- und beseitigen Muskelschwäche

- korrekt

- Kosten

- Kosten

- könnte

- Ländern

- Land

- erstellen

- erstellt

- schafft

- Erstellen

- Schaffung

- Kreativ (Creative)

- Kreativität

- Referenzen

- CTO

- KULTUR

- zügeln

- Strom

- Kunden

- technische Daten

- Debatten.

- Entscheidungen

- definiert

- Definiert

- Grad

- demokratisch

- weisen nach, dass

- zeigt

- demonstrieren

- Dänemark

- Abteilung

- Einsatz

- Bereitstellen

- Design

- Details

- entdecken

- Entdeckung

- Bestimmen

- entschlossen

- entwickelt

- Entwickler:in / Unternehmen

- Entwicklung

- Entwicklung

- Entwicklungen

- Dialog

- anders

- Fleiß

- Richtung

- diskutieren

- Desinformation

- Display

- Störungen

- unterscheiden

- Misstrauen

- Arzt

- die

- Tut nicht

- nach unten

- dr

- Antrieb

- zwei

- im

- e

- E & T

- jeder

- Früher

- Früh

- verdienen

- verdient

- Erde

- einfacher

- Einfache

- Wirtschaftskunde

- Wirtschaft

- Bildungs-

- Erzieher

- bewirken

- Wirksamkeit

- entweder

- beseitigen

- anderswo

- EMEA

- Entstehung

- Betonung

- ermöglichen

- beendet

- Ingenieur

- Entwicklung

- Verbesserungen

- gewährleisten

- Eingabe

- Entitäten

- Einheit

- Arbeitsumfeld

- Gleichheit

- Fehler

- insbesondere

- etablierten

- Auswerten

- Sogar

- Veranstaltungen

- sich entwickelnden

- Beispiel

- Beispiele

- ausschließlich

- Training

- ERFAHRUNGEN

- Erklären

- ERKUNDEN

- Erkundet

- umfangreiche

- extern

- Extrakt

- erleichtern

- erleichtert

- Tatsache

- Faktoren

- Fakten

- FAIL

- Fälschung

- gefälschte Nachrichten

- falsch

- berühmt

- weiblich

- Feld

- Kampf

- Füllungen

- Finale

- Revolution

- Finden Sie

- Suche nach

- Fertig

- Vorname

- erstes Mal

- Flexibilität

- konzentriert

- konzentriert

- Fokussierung

- folgen

- Folgende

- Aussichten für

- unten stehende Formular

- formal

- Forum

- Foundation

- Gründen

- Gründung

- Unser Ansatz

- für

- fu

- voll

- Funktion

- Funktionalität

- Games

- Gaming

- Lücken

- Geschlecht

- Geschlechter- gerechtigkeit

- Allgemeines

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- bekommen

- Mädchen

- GitHub

- gegeben

- Go

- Kundenziele

- groß

- Boden

- Garantien

- hätten

- Geschirr

- Haben

- he

- hören

- Hilfe

- hilft

- hier (auf dänisch)

- hier

- hochwertige

- höher

- Highlights

- hoch

- seine

- Geschichte

- hält

- Ehre

- hoffnungsvoll

- Gehäuse

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- human

- i

- IBM

- identifiziert

- if

- illegal

- veranschaulichen

- Bilder

- Impact der HXNUMXO Observatorien

- implementieren

- Implementierung

- implementiert

- importieren

- wichtig

- beeindruckend

- verbessert

- in

- Unfähigkeit

- das

- Dazu gehören

- Einschließlich

- Incorporated

- beinhaltet

- hat

- Steigert

- zeigt

- Krankengymnastik

- Branchen

- Information

- Informiert

- Infrastruktur

- Anfangs-

- Varianten des Eingangssignals:

- innerhalb

- installieren

- installiert

- Instanz

- Institut

- Institutionen

- integriert

- Intelligenz

- Absicht

- Interaktionen

- intern

- Internet

- in

- eingeführt

- ruft auf

- beteiligt

- Problem

- Probleme

- IT

- SEINE

- Reise

- jpg

- JSON

- Jury

- kenneth

- Wissen

- Wissen

- bekannt

- Mangel

- Sprache

- grosse

- Spät

- neueste

- Lateinisch

- ins Leben gerufen

- Schicht

- führen

- führenden

- lernen

- am wenigsten

- rechtlich

- lassen

- Lebensdauer

- Biowissenschaften

- Gefällt mir

- Einschränkungen

- Line

- Links

- linux

- Liste

- Gelistet

- Kataloge

- LLM

- logisch

- länger

- Nachschlagen

- ich liebe

- mac

- Maschine

- Maschinelles Lernen

- gemacht

- hauptsächlich

- unterhält

- Dur

- um

- MACHT

- Making

- verwaltet

- Management

- viele

- Marketing

- Maske"

- Meister

- mathematisch

- Mathematik

- maximal

- Kann..

- Mittel

- gemeint

- Medien

- sowie medizinische

- Medizin

- Mitglied

- Mitglieder

- Memory

- erwähnt

- Methodik

- Michigan

- Million

- Minen

- Fehlinformationen

- irreführend

- MIT

- Mildern

- mischen

- ML

- Modell

- für

- ändern

- mehr

- vor allem warme

- Bewegung

- mehrere

- my

- Namens

- NASA

- National

- Natürliche

- Natur

- Need

- erforderlich

- Netzwerk

- hört niemals

- Neu

- News

- weiter

- nicht

- Nobelpreisträger

- Normen

- Norwegen

- bemerkenswert

- Notizbuch

- jetzt an

- Anzahl

- Objekt

- Beobachtung

- Oktober

- of

- angeboten

- vorgenommen,

- Alt

- on

- EINEM

- Online

- einzige

- Einkauf & Prozesse

- Meinung

- or

- Auftrag

- Original

- Andere

- Andernfalls

- UNSERE

- Umrissen

- Skizzierung

- Möglichkeiten für das Ausgangssignal:

- hervorragend

- übrig

- Gesamt-

- besitzen

- Besitz

- Frieden

- Paket

- Seite

- Seiten

- Papier

- Parameter

- Teil

- passieren

- Bestanden

- Bestehen

- Patente

- Weg

- Schnittmuster

- Personen

- perfekt

- Ausführen

- persönliche

- Phase

- phd

- Phänomen

- Philosophie

- Physik

- Stück

- zentrale

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Points

- Politik

- möglich

- Post

- Potenzial

- Werkzeuge

- angetriebene

- vorgeführt

- Geschenke

- Presse

- vorherrschend

- früher

- vorher

- in erster Linie

- Principal

- Grundsätze

- Printing Press

- Vor

- Preise

- Aufgabenstellung:

- Prozessdefinierung

- anpassen

- produziert

- Produktion

- Profis

- tiefgreifende

- Programm

- bietet

- vorgeschlage

- die

- vorausgesetzt

- Anbieter

- bietet

- Bereitstellung

- Psychologie

- Öffentlichkeit

- Kauf

- Zwecke

- Python

- Qualität

- Menge

- schnell

- Radio

- zufällig

- Bereiche

- Platz

- schnell

- schnell

- Verhältnis

- erreichen

- Reagieren

- realen Welt

- Echtzeit

- Grund

- erhalten

- Received

- Rezept

- Anerkennung

- empfehlen

- siehe

- bezieht sich

- bezogene

- verhältnismäßig

- relevant

- zuverlässig

- WIEDERHOLT

- Quelle

- Anforderung

- erfordern

- falls angefordert

- Forschungsprojekte

- Resoniert

- Downloads

- Reagieren

- Antwort

- Antworten

- für ihren Verlust verantwortlich.

- Rückkehr

- Rückgabe

- Reiches

- Risiko

- Rollen

- Rollen

- Runde

- Führen Sie

- Laufen

- läuft

- s

- Schutzmaßnahmen

- sagemaker

- gleich

- Speichern

- sah

- Skalieren

- Schule

- School of Engineering

- Wissenschaft

- WISSENSCHAFTEN

- wissenschaftlich

- Wissenschaftler

- Skript

- Sdk

- Suche

- Abschnitt

- Abschnitte

- sehen

- Auswahl

- Senior

- empfindlich

- Satz

- Gefühl

- Reihenfolge

- Dienstleistungen

- kompensieren

- Setup

- Teilen

- von Locals geführtes

- Shares

- ,,teilen"

- sie

- Schale

- sollte

- erklären

- ähnlich

- Ähnlich

- Einfacher

- da

- Schwester

- So

- Social Media

- Social Media

- gesellschaftlich

- Gesellschaft

- Lösung

- Lösungen

- einige

- Quelle

- Quellcode

- Quellen

- Raumfahrt

- überspannend

- speziell

- Geschwindigkeit

- Verbreitung

- Verbreitung

- Stufe

- Standard

- Stanford

- Stanford Universität

- begonnen

- Erklärung

- Aussagen

- Staaten

- Shritte

- Stoppen

- Sturm

- Strategie

- Stärkung

- Struktur

- Die Kursteilnehmer

- Studie

- Folge

- wesentlich

- Erfolgreich

- so

- vorschlagen

- ZUSAMMENFASSUNG

- Aufladung

- Support

- sicher

- Schwanken

- Schweden

- schnell

- Synthese

- Systeme und Techniken

- angehen

- Nehmen

- nimmt

- Aufgabe

- und Aufgaben

- Team

- Technische

- Technik

- Techniken

- technologische

- Technologie

- Telekommunikation

- Vorlage

- Terminal

- AGB

- Test

- Text

- textuell

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- Die Quelle

- die Welt

- ihr

- Sie

- dann

- Dort.

- damit

- deswegen

- Diese

- vom Nutzer definierten

- think

- basierte Online-to-Offline-Werbezuordnungen von anderen gab.

- fehlen uns die Worte.

- diejenigen

- dachte

- Durch

- während

- KRAWATTE

- Zeit

- Timeline

- zu

- gemeinsam

- Zeichen

- Tokens

- Werkzeuge

- trainiert

- Ausbildung

- was immer dies auch sein sollte.

- Wahrheit

- Lernprogramm

- XNUMX

- Letztlich

- unterstrichen

- Verständnis

- Vereinigt

- USA

- Universitäten

- Universität

- beispiellos

- beispiellos

- bis

- mehr Stunden

- auf

- us

- -

- benutzt

- Mitglied

- Nutzer

- verwendet

- Verwendung von

- Verwendung

- Wert

- verschiedene

- riesig

- Urteil

- verified

- überprüfen

- Version

- sehr

- Video

- Videospiele

- Besuchen Sie

- wurde

- we

- Netz

- Web-Services

- GUT

- Was

- wann

- ob

- welche

- während

- WHO

- ganze

- warum

- Wikipedia

- werden wir

- Fenster

- mit

- .

- Frau

- Damen

- Gewonnen

- Word

- Worte

- Arbeiten

- gearbeitet

- Arbeitsablauf.

- arbeiten,

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- wert

- Falsch

- Jahr

- Du

- Ihr

- Zephyrnet