Natural Language Processing (NLP) ist der Bereich des maschinellen Lernens (ML), bei dem es darum geht, Computern die Fähigkeit zu geben, Texte und gesprochene Wörter auf die gleiche Weise zu verstehen wie Menschen. In letzter Zeit werden hochmoderne Architekturen wie die Transformator-Architektur werden verwendet, um eine nahezu menschliche Leistung bei NLP-Downstream-Aufgaben wie Textzusammenfassung, Textklassifizierung, Entitätserkennung und mehr zu erreichen.

Große Sprachmodelle (LLMs) sind transformatorbasierte Modelle, die auf einer großen Menge unbeschrifteten Textes mit Hunderten von Millionen (BERT) auf über eine Billion Parameter (MiCS) und deren Größe ein Training mit einer einzelnen GPU unpraktisch macht. Aufgrund ihrer inhärenten Komplexität ist die Ausbildung eines LLM von Grund auf eine sehr anspruchsvolle Aufgabe, die sich nur wenige Unternehmen leisten können. Eine gängige Praxis für nachgelagerte NLP-Aufgaben besteht darin, ein vorab trainiertes LLM zu nehmen und es zu verfeinern. Weitere Informationen zur Feinabstimmung finden Sie unter Domänenanpassung Feinabstimmung von Foundation-Modellen in Amazon SageMaker JumpStart auf Finanzdaten und Optimieren Sie Transformer-Sprachmodelle für sprachliche Vielfalt mit Hugging Face auf Amazon SageMaker.

Zero-Shot-Lernen im NLP ermöglicht a vorab trainiertes LLM um Antworten auf Aufgaben zu generieren, für die es nicht explizit trainiert wurde (auch ohne Feinabstimmung). Konkret geht es um die Textklassifizierung: Zero-Shot-Textklassifizierung ist eine Aufgabe in der Verarbeitung natürlicher Sprache, bei der im Gegensatz zu ein NLP-Modell verwendet wird, um Text aus unsichtbaren Klassen zu klassifizieren überwachte Klassifizierung, wobei NLP-Modelle nur Texte klassifizieren können, die zu Klassen in den Trainingsdaten gehören.

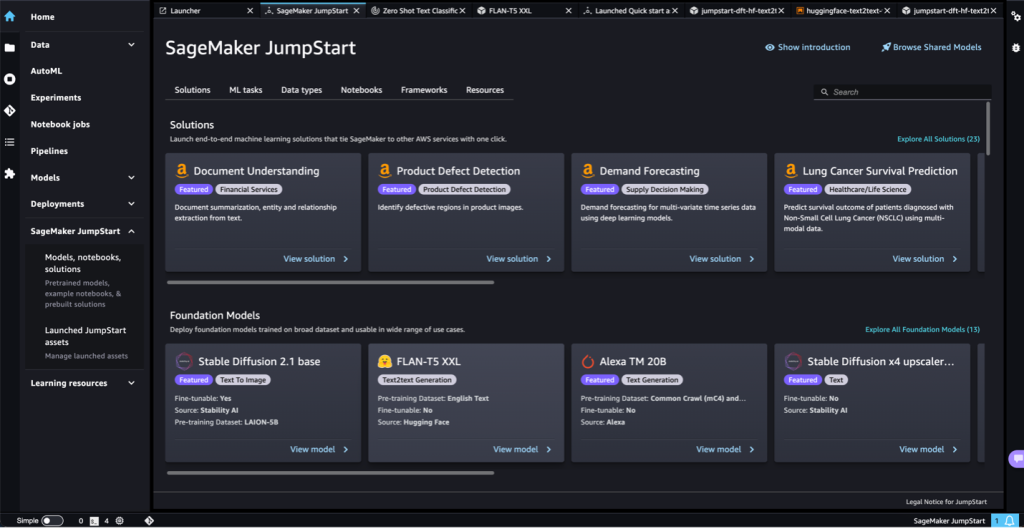

Wir haben kürzlich die Unterstützung für Zero-Shot-Klassifizierungsmodelle eingeführt Amazon SageMaker-JumpStart. SageMaker JumpStart ist der ML-Hub von Amazon Sage Maker Das bietet Zugriff auf vorab trainierte Basismodelle (FMs), LLMs, integrierte Algorithmen und Lösungsvorlagen, um Ihnen den schnellen Einstieg in ML zu erleichtern. In diesem Beitrag zeigen wir, wie Sie mit vorab trainierten Modellen in SageMaker Jumpstart eine Zero-Shot-Klassifizierung durchführen können. Sie erfahren, wie Sie die SageMaker Jumpstart-Benutzeroberfläche und das SageMaker Python SDK verwenden, um die Lösung bereitzustellen und Inferenzen mithilfe der verfügbaren Modelle auszuführen.

Zero-Shot-Lernen

Die Zero-Shot-Klassifizierung ist ein Paradigma, bei dem ein Modell neue, unsichtbare Beispiele klassifizieren kann, die zu Klassen gehören, die in den Trainingsdaten nicht vorhanden waren. Beispielsweise kann ein Sprachmodell, das darauf trainiert wurde, die menschliche Sprache zu verstehen, verwendet werden, um Tweets mit Neujahrsvorsätzen in mehrere Klassen zu klassifizieren, z career, health und finance, ohne dass das Sprachmodell explizit auf die Textklassifizierungsaufgabe trainiert wird. Dies steht im Gegensatz zur Feinabstimmung des Modells, da letztere ein erneutes Training des Modells (durch Transferlernen) erfordert, während Zero-Shot-Lernen kein zusätzliches Training erfordert.

Das folgende Diagramm veranschaulicht die Unterschiede zwischen Transferlernen (links) und Zero-Shot-Lernen (rechts).

Yin et al. schlug ein Framework zum Erstellen von Zero-Shot-Klassifikatoren mithilfe natürlicher Sprachinferenz (NLI) vor. Das Framework stellt die zu klassifizierende Sequenz als NLI-Prämisse dar und erstellt aus jedem Kandidatenlabel eine Hypothese. Wenn wir beispielsweise bewerten möchten, ob eine Sequenz zur Klasse gehört politics, könnten wir die Hypothese aufstellen: „In diesem Text geht es um Politik.“ Die Wahrscheinlichkeiten für Konsequenz und Widerspruch werden dann in Etikettenwahrscheinlichkeiten umgewandelt. Als kurzen Überblick betrachtet NLI zwei Sätze: eine Prämisse und eine Hypothese. Die Aufgabe besteht darin, zu bestimmen, ob die Hypothese angesichts der Prämisse wahr (Folge) oder falsch (Widerspruch) ist. Die folgende Tabelle enthält einige Beispiele.

| Prämisse | Label | Hypothese |

| Ein Mann inspiziert die Uniform einer Figur in einem ostasiatischen Land. | Widerspruch | Der Mann schläft. |

| Ein älterer und ein jüngerer Mann lächeln. | Neutral | Zwei Männer lächeln und lachen über die auf dem Boden spielenden Katzen. |

| Ein Fußballspiel, bei dem mehrere Männer spielen. | Folge | Einige Männer treiben Sport. |

Lösungsüberblick

In diesem Beitrag besprechen wir Folgendes:

- So stellen Sie vorab trainierte Zero-Shot-Textklassifizierungsmodelle mithilfe der SageMaker JumpStart-Benutzeroberfläche bereit und führen mithilfe von Kurztextdaten Rückschlüsse auf das bereitgestellte Modell aus

- So verwenden Sie das SageMaker Python SDK, um auf die vorab trainierten Zero-Shot-Textklassifizierungsmodelle in SageMaker JumpStart zuzugreifen und das Inferenzskript zu verwenden, um das Modell für einen Echtzeit-Textklassifizierungsanwendungsfall auf einem SageMaker-Endpunkt bereitzustellen

- So verwenden Sie das SageMaker Python SDK, um auf vorab trainierte Zero-Shot-Textklassifizierungsmodelle zuzugreifen und die SageMaker-Batch-Transformation für einen Anwendungsfall der Batch-Textklassifizierung zu verwenden

SageMaker JumpStart bietet Feinabstimmung und Bereitstellung mit einem Klick für eine Vielzahl vorab trainierter Modelle für gängige ML-Aufgaben sowie eine Auswahl an End-to-End-Lösungen zur Lösung gängiger Geschäftsprobleme. Diese Funktionen entlasten jeden Schritt des ML-Prozesses, vereinfachen die Entwicklung hochwertiger Modelle und verkürzen die Zeit bis zur Bereitstellung. Der JumpStart-APIs ermöglichen Ihnen die programmgesteuerte Bereitstellung und Feinabstimmung einer großen Auswahl an vortrainierten Modellen für Ihre eigenen Datensätze.

Der JumpStart-Modellhub bietet Zugriff auf eine große Anzahl von NLP-Modellen, die Transferlernen und die Feinabstimmung benutzerdefinierter Datensätze ermöglichen. Zum jetzigen Zeitpunkt enthält der JumpStart-Modell-Hub über 300 Textmodelle aus einer Vielzahl beliebter Modelle, wie z. B. Stable Diffusion, Flan T5, Alexa TM, Bloom und mehr.

Beachten Sie, dass Sie durch Befolgen der Schritte in diesem Abschnitt eine Infrastruktur für Ihr AWS-Konto bereitstellen, was möglicherweise Kosten verursacht.

Stellen Sie ein eigenständiges Zero-Shot-Textklassifizierungsmodell bereit

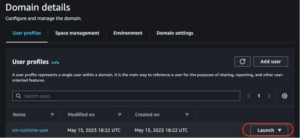

In diesem Abschnitt zeigen wir, wie Sie mit SageMaker JumpStart ein Zero-Shot-Klassifizierungsmodell bereitstellen. Sie können über die JumpStart-Landingpage in auf vorab trainierte Modelle zugreifen Amazon SageMaker-Studio. Führen Sie die folgenden Schritte aus:

- Öffnen Sie in SageMaker Studio die JumpStart-Landingpage.

Beziehen auf Öffnen und verwenden Sie JumpStart Weitere Informationen zur Navigation zu SageMaker JumpStart finden Sie hier. - Im Textmodelle Suchen Sie im Karussell nach der Modellkarte „Zero-Shot Text Classification“.

- Auswählen

Modell ansehen Zugriff auf die

facebook-bart-large-mnliModell.

Alternativ können Sie in der Suchleiste nach dem Zero-Shot-Klassifizierungsmodell suchen und in SageMaker JumpStart zum Modell gelangen. - Geben Sie eine Bereitstellungskonfiguration, den SageMaker-Hosting-Instanztyp, den Endpunktnamen und Amazon Simple Storage-Service (Amazon S3) Bucket-Name und andere erforderliche Parameter.

- Optional können Sie Sicherheitskonfigurationen angeben wie AWS Identity and Access Management and (IAM)-Rolle, VPC-Einstellungen und AWS-Schlüsselverwaltungsservice (AWS KMS)-Verschlüsselungsschlüssel.

- Auswählen Deploy um einen SageMaker-Endpunkt zu erstellen.

Dieser Schritt dauert einige Minuten. Wenn der Vorgang abgeschlossen ist, können Sie eine Inferenz für den SageMaker-Endpunkt ausführen, der das Zero-Shot-Klassifizierungsmodell hostet.

Im folgenden Video zeigen wir eine exemplarische Vorgehensweise für die Schritte in diesem Abschnitt.

Verwenden Sie JumpStart programmgesteuert mit dem SageMaker SDK

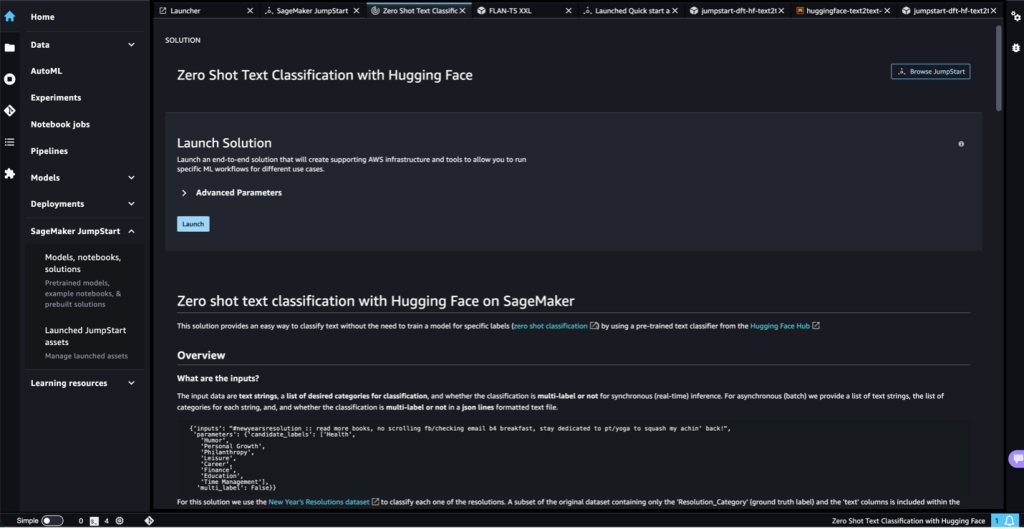

Im SageMaker JumpStart-Bereich von SageMaker Studio, unter Schnellstart-Lösungenfinden Sie die Lösungsvorlagen. SageMaker JumpStart-Lösungsvorlagen sind End-to-End-Lösungen mit nur einem Klick für viele gängige ML-Anwendungsfälle. Zum jetzigen Zeitpunkt sind über 20 Lösungen für verschiedene Anwendungsfälle verfügbar, wie zum Beispiel Bedarfsprognose, Betrugserkennung und personalisierte Empfehlungen, um nur einige zu nennen.

Die Lösung „Zero Shot Text Classification with Hugging Face“ bietet eine Möglichkeit, Text zu klassifizieren, ohne dass ein Modell für bestimmte Beschriftungen trainiert werden muss (Null-Schuss-Klassifizierung) mithilfe eines vorab trainierten Textklassifizierers. Das standardmäßige Zero-Shot-Klassifizierungsmodell für diese Lösung ist das facebook-bart-large-mnli (BART)-Modell. Für diese Lösung verwenden wir die Datensatz „Neujahrsvorsätze 2015“. Vorsätze einzuordnen. Eine Teilmenge des Originaldatensatzes, die nur die enthält Resolution_Category (Grundwahrheitsetikett) und das text Spalten sind in den Assets der Lösung enthalten.

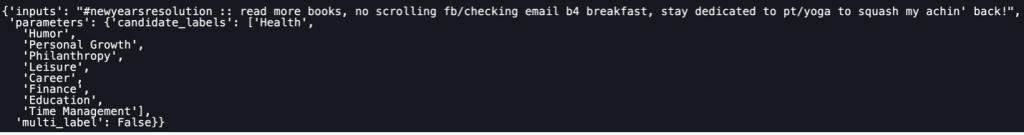

Die Eingabedaten umfassen Textzeichenfolgen, eine Liste der gewünschten Kategorien für die Klassifizierung und die Angabe, ob es sich bei der Klassifizierung um eine Multi-Label-Klassifizierung handelt oder nicht, für synchrone (Echtzeit-)Inferenz. Für die asynchrone (Batch-)Inferenz stellen wir eine Liste von Textzeichenfolgen, die Liste der Kategorien für jede Zeichenfolge und die Angabe, ob die Klassifizierung mehrere Bezeichnungen hat oder nicht, in einer mit JSON-Zeilen formatierten Textdatei bereit.

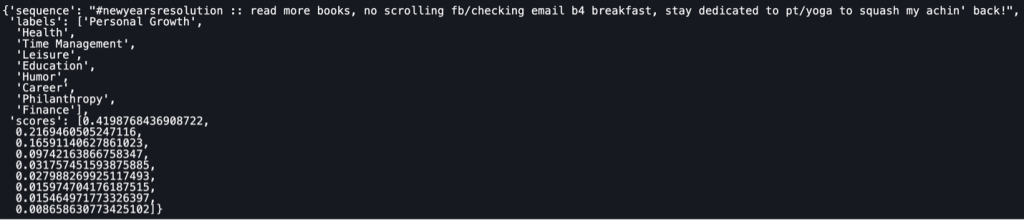

Das Ergebnis der Inferenz ist ein JSON-Objekt, das etwa wie im folgenden Screenshot aussieht.

Wir haben den Originaltext im sequence Feld, die Beschriftungen, die für die Textklassifizierung im verwendet werden labels Feld und die Wahrscheinlichkeit, die jeder Beschriftung (in derselben Reihenfolge des Auftretens) im Feld zugewiesen ist scores.

Führen Sie die folgenden Schritte aus, um die Lösung „Zero Shot Text Classification with Hugging Face“ bereitzustellen:

- Wählen Sie auf der Landingpage von SageMaker JumpStart die Option Modelle, Notizbücher, Lösungen im Navigationsbereich.

- Im Lösungen Wählen Sie im Abschnitt Entdecken Sie alle Lösungen.

- Auf dem Lösungen Wählen Sie auf der Seite „Zero Shot Text Classification with Hugging Face“ die Modellkarte „Zero Shot Text Classification with Hugging Face“.

- Überprüfen Sie die Bereitstellungsdetails und wählen Sie, wenn Sie damit einverstanden sind Einführung.

Die Bereitstellung stellt einen SageMaker-Echtzeit-Endpunkt für Echtzeit-Inferenz und einen S3-Bucket zum Speichern der Batch-Transformationsergebnisse bereit.

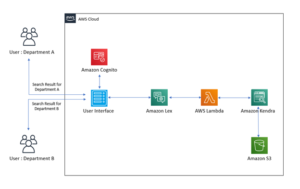

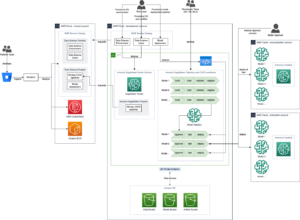

Das folgende Diagramm veranschaulicht die Architektur dieser Methode.

Führen Sie Echtzeitinferenzen mithilfe eines Zero-Shot-Klassifizierungsmodells durch

In diesem Abschnitt erfahren Sie, wie Sie mit dem Python SDK mithilfe eines SageMaker-Endpunkts eine Zero-Shot-Textklassifizierung (unter Verwendung eines der verfügbaren Modelle) in Echtzeit ausführen.

- Zuerst konfigurieren wir die Inferenznutzlastanforderung für das Modell. Dies ist modellabhängig, aber für das BART-Modell ist die Eingabe ein JSON-Objekt mit der folgenden Struktur:

- Beachten Sie, dass das BART-Modell nicht explizit darauf trainiert wird

candidate_labels. Wir werden die Zero-Shot-Klassifizierungstechnik verwenden, um die Textsequenz in unsichtbare Klassen zu klassifizieren. Der folgende Code ist ein Beispiel für die Verwendung von Text aus dem Datensatz „Neujahrsvorsätze“ und den definierten Klassen: - Als Nächstes können Sie einen SageMaker-Endpunkt mit der Zero-Shot-Nutzlast aufrufen. Der SageMaker-Endpunkt wird als Teil der SageMaker JumpStart-Lösung bereitgestellt.

- Das Inferenz-Antwortobjekt enthält die Originalsequenz, die Beschriftungen, sortiert nach der Punktzahl von maximal bis minimal, und die Punktzahlen pro Beschriftung:

Führen Sie einen SageMaker-Batch-Transformationsauftrag mit dem Python SDK aus

In diesem Abschnitt wird beschrieben, wie die Batch-Transformationsinferenz mit der Zero-Shot-Klassifizierung ausgeführt wird facebook-bart-large-mnli Modell mit dem SageMaker Python-SDK. Führen Sie die folgenden Schritte aus:

- Formatieren Sie die Eingabedaten im JSON-Zeilenformat und laden Sie die Datei auf Amazon S3 hoch.

Die SageMaker-Batchtransformation führt Rückschlüsse auf die in die S3-Datei hochgeladenen Datenpunkte durch. - Richten Sie die Modellbereitstellungsartefakte mit den folgenden Parametern ein:

- model_id - Benutzen

huggingface-zstc-facebook-bart-large-mnli. - Deploy_image_uri - Verwenden Sie die

image_urisPython SDK-Funktion zum Abrufen des vorgefertigten SageMaker Docker-Images fürmodel_id. Die Funktion gibt die zurück Amazon Elastic Container-Registrierung (Amazon ECR) URI. - Deploy_source_uri – Verwenden Sie das

script_urisDienstprogramm-API zum Abrufen des S3-URI, der Skripte zum Ausführen vorab trainierter Modellinferenz enthält. Wir spezifizieren diescript_scopeasinference. - model_uri - Benutzen

model_urium die Modellartefakte von Amazon S3 für das angegebene Objekt abzurufenmodel_id.

- model_id - Benutzen

- Verwenden Sie die

HF_TASKum die Aufgabe für die Hugging Face Transformers-Pipeline zu definieren undHF_MODEL_IDSo definieren Sie das zur Klassifizierung des Textes verwendete Modell:Eine vollständige Liste der Aufgaben finden Sie unter Pipelines in der Hugging Face-Dokumentation.

- Erstellen Sie ein Hugging Face-Modellobjekt, das mit dem SageMaker-Batch-Transformationsauftrag bereitgestellt werden soll:

- Erstellen Sie eine Transformation, um einen Batch-Job auszuführen:

- Starten Sie einen Batch-Transformationsauftrag und verwenden Sie S3-Daten als Eingabe:

Sie können Ihren Stapelverarbeitungsauftrag auf der SageMaker-Konsole überwachen (wählen Sie „ Batch-Transformationsjobs für Inferenz im Navigationsbereich). Wenn der Auftrag abgeschlossen ist, können Sie die Ausgabe der Modellvorhersage in der in angegebenen S3-Datei überprüfen output_path.

Eine Liste aller verfügbaren vorab trainierten Modelle in SageMaker JumpStart finden Sie unter Eingebaute Algorithmen mit vortrainierter Modelltabelle. Verwenden Sie das Schlüsselwort „zstc“ (kurz für Zero-Shot-Textklassifizierung) in der Suchleiste, um alle Modelle zu finden, die eine Zero-Shot-Textklassifizierung durchführen können.

Aufräumen

Nachdem Sie das Notebook ausgeführt haben, löschen Sie unbedingt alle dabei erstellten Ressourcen, um sicherzustellen, dass die Kosten, die durch die in diesem Handbuch bereitgestellten Assets entstehen, gestoppt werden. Der Code zum Bereinigen der bereitgestellten Ressourcen wird in den Notebooks bereitgestellt, die der Zero-Shot-Textklassifizierungslösung und dem Zero-Shot-Textklassifizierungsmodell zugeordnet sind.

Standardsicherheitskonfigurationen

Die SageMaker JumpStart-Modelle werden mit den folgenden Standardsicherheitskonfigurationen bereitgestellt:

Weitere Informationen zu sicherheitsrelevanten Themen von SageMaker finden Sie hier Konfigurieren Sie die Sicherheit in Amazon SageMaker.

Zusammenfassung

In diesem Beitrag haben wir Ihnen gezeigt, wie Sie mithilfe der SageMaker JumpStart-Benutzeroberfläche ein Zero-Shot-Klassifizierungsmodell bereitstellen und mithilfe des bereitgestellten Endpunkts Inferenzen durchführen. Wir haben die SageMaker JumpStart-Lösung für Neujahrsvorsätze verwendet, um zu zeigen, wie Sie mit dem SageMaker Python SDK eine End-to-End-Lösung erstellen und eine Zero-Shot-Klassifizierungsanwendung implementieren können. SageMaker JumpStart bietet Zugriff auf Hunderte vorab trainierter Modelle und Lösungen für Aufgaben wie Computer Vision, Verarbeitung natürlicher Sprache, Empfehlungssysteme und mehr. Probieren Sie die Lösung selbst aus und teilen Sie uns Ihre Meinung mit.

Über die Autoren

David Laredo ist Prototyping-Architekt bei AWS Envision Engineering in LATAM, wo er an der Entwicklung mehrerer Prototypen für maschinelles Lernen mitgewirkt hat. Zuvor war er als Ingenieur für maschinelles Lernen tätig und beschäftigt sich seit über 5 Jahren mit maschinellem Lernen. Seine Interessengebiete sind NLP, Zeitreihen und End-to-End-ML.

David Laredo ist Prototyping-Architekt bei AWS Envision Engineering in LATAM, wo er an der Entwicklung mehrerer Prototypen für maschinelles Lernen mitgewirkt hat. Zuvor war er als Ingenieur für maschinelles Lernen tätig und beschäftigt sich seit über 5 Jahren mit maschinellem Lernen. Seine Interessengebiete sind NLP, Zeitreihen und End-to-End-ML.

Vikram Elango ist ein KI/ML-Spezialist für Lösungsarchitekten bei Amazon Web Services mit Sitz in Virginia, USA. Vikram unterstützt Kunden aus der Finanz- und Versicherungsbranche mit Design und Vordenkerrolle bei der Entwicklung und Bereitstellung von Anwendungen für maschinelles Lernen in großem Maßstab. Derzeit konzentriert er sich auf die Verarbeitung natürlicher Sprache, verantwortungsvolle KI, Inferenzoptimierung und die Skalierung von ML im gesamten Unternehmen. In seiner Freizeit reist er gerne, wandert, kocht und campt mit seiner Familie.

Vikram Elango ist ein KI/ML-Spezialist für Lösungsarchitekten bei Amazon Web Services mit Sitz in Virginia, USA. Vikram unterstützt Kunden aus der Finanz- und Versicherungsbranche mit Design und Vordenkerrolle bei der Entwicklung und Bereitstellung von Anwendungen für maschinelles Lernen in großem Maßstab. Derzeit konzentriert er sich auf die Verarbeitung natürlicher Sprache, verantwortungsvolle KI, Inferenzoptimierung und die Skalierung von ML im gesamten Unternehmen. In seiner Freizeit reist er gerne, wandert, kocht und campt mit seiner Familie.

Vivek Madan ist ein angewandter Wissenschaftler im Amazon SageMaker JumpStart-Team. Er promovierte an der University of Illinois at Urbana-Champaign und war Postdoktorand an der Georgia Tech. Er ist ein aktiver Forscher in den Bereichen maschinelles Lernen und Algorithmendesign und hat Artikel auf Konferenzen von EMNLP, ICLR, COLT, FOCS und SODA veröffentlicht.

Vivek Madan ist ein angewandter Wissenschaftler im Amazon SageMaker JumpStart-Team. Er promovierte an der University of Illinois at Urbana-Champaign und war Postdoktorand an der Georgia Tech. Er ist ein aktiver Forscher in den Bereichen maschinelles Lernen und Algorithmendesign und hat Artikel auf Konferenzen von EMNLP, ICLR, COLT, FOCS und SODA veröffentlicht.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/zero-shot-text-classification-with-amazon-sagemaker-jumpstart/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 12

- 16

- 17

- 20

- 22

- 30

- 7

- 8

- 9

- a

- Fähigkeit

- Über Uns

- oben

- Zugang

- Konto

- Erreichen

- über

- aktiv

- Zusätzliche

- gegen

- AI

- AI / ML

- AL

- Alexa

- Algorithmus

- Algorithmen

- Alle

- erlauben

- erlaubt

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- Betrag

- an

- und

- jedem

- Bienen

- Anwendung

- Anwendungen

- angewandt

- Architektur

- SIND

- Bereiche

- AS

- asiatisch

- Details

- zugewiesen

- damit verbundenen

- At

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- AWS

- Bar

- Base

- basierend

- BE

- war

- Sein

- gehört

- zwischen

- Blühen

- Körper

- Bücher

- Frühstück

- bauen

- eingebaut

- Geschäft

- aber

- by

- CAN

- Kandidat

- fähig

- Karte

- Karriere

- Karussell

- Fälle

- Kategorien

- Katzen

- herausfordernd

- aus der Ferne überprüfen

- Auswählen

- Klasse

- Unterricht

- Einstufung

- eingestuft

- klassifizieren

- Code

- Spalten

- gemeinsam

- abschließen

- Komplexität

- Computer

- Computer Vision

- Computer

- betroffen

- Kongressbegleitung

- Konfiguration

- überlegt

- Konsul (Console)

- konstruieren

- Container

- enthält

- Kontrast

- umgewandelt

- Kosten

- könnte

- Land

- Paar

- erstellen

- erstellt

- Erstellen

- Zur Zeit

- Original

- Kunden

- technische Daten

- Datenpunkte

- Datensätze

- gewidmet

- Standard

- definieren

- definiert

- Demand

- Nachfragevorhersage

- zeigen

- Abhängigkeiten

- abhängig

- einsetzen

- Einsatz

- Einsatz

- Design

- erwünscht

- Details

- Entdeckung

- Bestimmen

- entwickeln

- Entwicklung

- Unterschiede

- Rundfunk

- diskutieren

- Diversität

- Docker

- Dokumentation

- Tut nicht

- Dabei

- erledigt

- zwei

- E & T

- jeder

- Osten

- Bildungswesen

- ermöglichen

- Verschlüsselung

- End-to-End

- Endpunkt

- Ingenieur

- Entwicklung

- gewährleisten

- Unternehmen

- Einheit

- vorstellen

- bewerten

- Sogar

- Beispiel

- Beispiele

- Gesicht

- falsch

- Familie

- Eigenschaften

- wenige

- Feld

- Abbildung

- Reichen Sie das

- Finanzen

- Revolution

- Finden Sie

- Boden

- konzentriert

- Folgende

- Aussichten für

- Format

- Foundation

- Unser Ansatz

- Betrug

- Betrugserkennung

- für

- Funktion

- Spiel

- erzeugen

- Georgien

- bekommen

- GitHub

- gegeben

- Unterstützung

- Boden

- Wachstum

- Guide

- Handling

- Haben

- he

- Gesundheit

- schwer

- schweres Heben

- Hilfe

- dazu beigetragen,

- hilft

- hochwertige

- seine

- Hosting

- Gastgeber

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- Nabe

- human

- Humor

- hunderte

- hunderte Millionen

- ID

- Identitätsschutz

- if

- Illinois

- zeigt

- Image

- implementieren

- importieren

- in

- inklusive

- Dazu gehören

- Energiegewinnung

- Information

- Infrastruktur

- inhärent

- Varianten des Eingangssignals:

- Eingänge

- Instanz

- Versicherung

- Interesse

- IT

- Job

- Jobs

- jpg

- JSON

- Wesentliche

- Tasten

- Wissen

- Label

- Etiketten

- Landung

- Sprache

- grosse

- LATAM

- ins Leben gerufen

- Leadership

- LERNEN

- lernen

- links

- lassen

- Facelift

- Gefällt mir

- Line

- Linien

- Liste

- LLM

- Laden

- SIEHT AUS

- Maschine

- Maschinelles Lernen

- um

- MACHT

- Mann

- Management

- viele

- max

- Kann..

- Herren

- Methode

- Millionen

- Min.

- Minuten

- ML

- Modell

- für

- Überwachen

- mehr

- mehrere

- my

- Name

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigieren

- Menü

- Need

- Neu

- Neujahr

- Nlp

- nicht

- Notizbuch

- Anzahl

- Objekt

- of

- on

- einzige

- XNUMXh geöffnet

- Optimierung

- or

- Auftrag

- Organisationen

- Original

- Andere

- Möglichkeiten für das Ausgangssignal:

- übrig

- besitzen

- Seite

- Brot

- Papiere

- Paradigma

- Parameter

- Teil

- Weg

- für

- Ausführen

- Leistung

- Berechtigungen

- persönliche

- Personalisiert

- phd

- PHILANTHROPIE

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Punkte

- Politik

- Beliebt

- Post

- Praxis

- Prognose

- Prognosen

- Gegenwart

- vorher

- Probleme

- Prozessdefinierung

- Verarbeitung

- vorgeschlage

- Prototypen

- Prototyping

- die

- vorausgesetzt

- bietet

- Bereitstellung

- veröffentlicht

- Python

- Pytorch

- Direkt

- schnell

- Lesen Sie mehr

- echt

- Echtzeit

- kürzlich

- Anerkennung

- Software Empfehlungen

- Empfehlungen

- Reduzierung

- entfernen

- Anforderung

- erfordern

- falls angefordert

- Forscher

- Downloads

- Antwort

- Antworten

- für ihren Verlust verantwortlich.

- Folge

- Die Ergebnisse

- Rückgabe

- Überprüfen

- Recht

- Rollen

- Führen Sie

- Laufen

- s

- sagemaker

- gleich

- Speichern

- Skalieren

- Skalierung

- Wissenschaftler

- Ergebnis

- kratzen

- Skripte

- Scrollen

- Sdk

- Suche

- Abschnitt

- Sicherheitdienst

- sehen

- Auswahl

- Reihenfolge

- Modellreihe

- Lösungen

- Einstellungen

- Short

- Schuss

- erklären

- zeigte

- Einfacher

- Vereinfachung

- da

- Größe

- Fußball

- Lösung

- Lösungen

- LÖSEN

- einige

- etwas

- Sprechen

- Spezialist

- spezifisch

- speziell

- angegeben

- gesprochen

- Sport

- stabil

- standalone

- Anfang

- begonnen

- State-of-the-art

- bleiben

- Schritt

- Shritte

- gestoppt

- Lagerung

- Speicherung

- Schnur

- Struktur

- Studio Adressen

- so

- Support

- sicher

- Systeme und Techniken

- Tabelle

- Nehmen

- nimmt

- Aufgabe

- und Aufgaben

- Team

- Tech

- Vorlagen

- Textklassifizierung

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- dann

- Diese

- fehlen uns die Worte.

- dachte

- Gedankenführung

- Durch

- Zeit

- Zeitfolgen

- TM

- zu

- Themen

- Training

- trainiert

- Ausbildung

- privaten Transfer

- Transformieren

- Transformation

- Transformator

- Transformer

- Reise

- Billion

- was immer dies auch sein sollte.

- Wahrheit

- versuchen

- Tweets

- XNUMX

- tippe

- ui

- für

- verstehen

- Universität

- hochgeladen

- us

- -

- benutzt

- Verwendung von

- Nutzen

- Vielfalt

- riesig

- Version

- sehr

- Video

- Virginia

- Seh-

- vs

- Walkthrough

- wollen

- wurde

- Weg..

- we

- Netz

- Web-Services

- GUT

- waren

- wann

- ob

- während

- deren

- breit

- werden wir

- mit

- ohne

- Worte

- gearbeitet

- Werk

- Schreiben

- Jahr

- Jahr

- Du

- Jünger

- Ihr

- Zephyrnet

- Null

- Zero-Shot-Lernen