Dies ist Teil 3 unserer Serie, in der wir eine MLOps-Pipeline für die visuelle Qualitätsprüfung am Edge entwerfen und implementieren. In diesem Beitrag konzentrieren wir uns auf die Automatisierung des Edge-Bereitstellungsteils der End-to-End-MLOps-Pipeline. Wir zeigen Ihnen die Anwendung AWS IoT Greengrass wie man Modellinferenzen am Edge verwaltet und wie man den Prozess damit automatisiert AWS Step-Funktionen und andere AWS-Services.

Lösungsüberblick

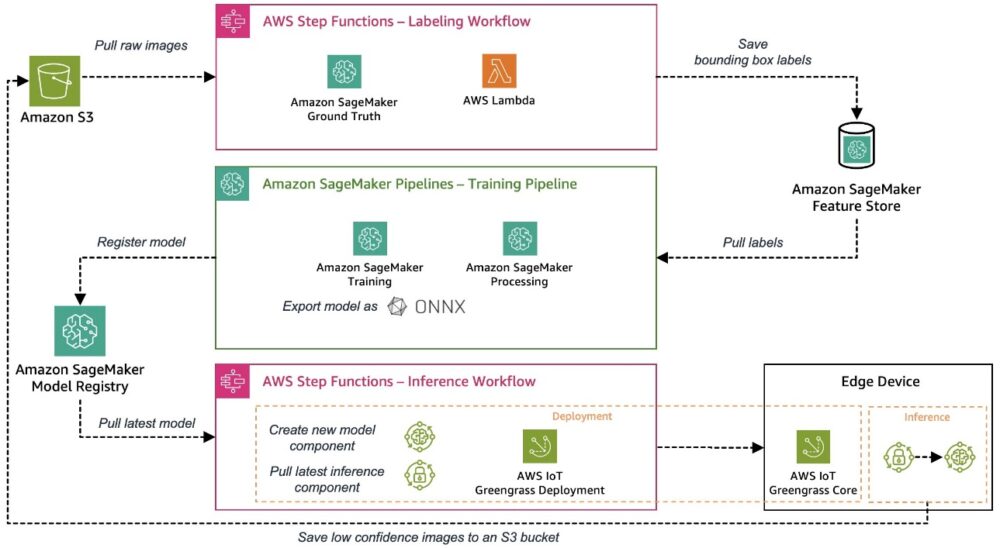

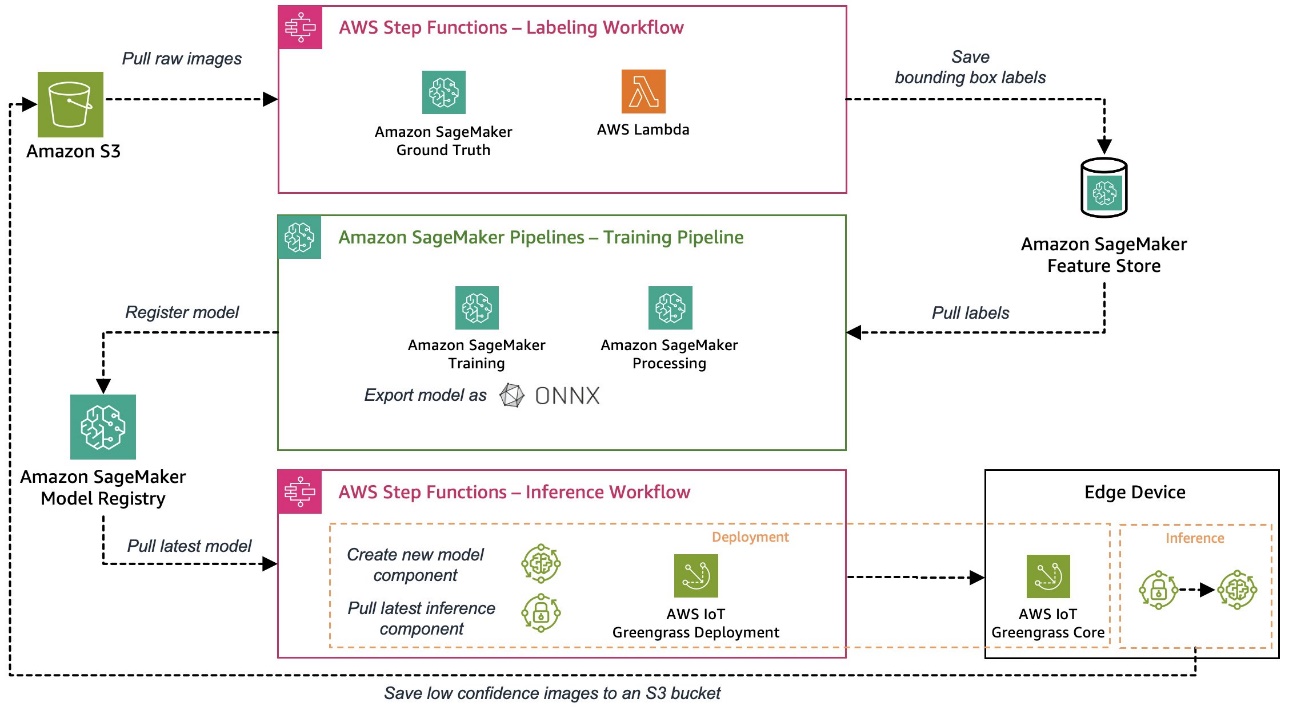

In Teil 1 In dieser Serie haben wir eine Architektur für unsere End-to-End-MLOps-Pipeline entworfen, die den gesamten Prozess des maschinellen Lernens (ML) automatisiert, von der Datenkennzeichnung bis zum Modelltraining und der Bereitstellung am Edge. In Teil 2haben wir gezeigt, wie man die Beschriftungs- und Modelltrainingsteile der Pipeline automatisiert.

Der für diese Serie verwendete Beispielanwendungsfall ist eine Lösung zur visuellen Qualitätsprüfung, die Fehler auf Metallschildern erkennen kann, die Sie als Teil eines Herstellungsprozesses einsetzen können. Das folgende Diagramm zeigt die übergeordnete Architektur der MLOps-Pipeline, die wir zu Beginn dieser Serie definiert haben. Wenn Sie es noch nicht gelesen haben, empfehlen wir Ihnen, es sich anzusehen Teil 1.

Automatisierung der Edge-Bereitstellung eines ML-Modells

Nachdem ein ML-Modell trainiert und bewertet wurde, muss es in einem Produktionssystem bereitgestellt werden, um durch Vorhersagen zu eingehenden Daten einen Geschäftswert zu generieren. Dieser Prozess kann in einer Edge-Umgebung, in der Modelle auf Geräten bereitgestellt und ausgeführt werden müssen, die sich häufig weit entfernt von der Cloud-Umgebung befinden, in der die Modelle trainiert wurden, schnell komplex werden. Im Folgenden sind einige der besonderen Herausforderungen aufgeführt, die maschinelles Lernen am Edge mit sich bringt:

- ML-Modelle müssen aufgrund von Ressourcenbeschränkungen auf Edge-Geräten häufig optimiert werden

- Edge-Geräte können nicht wie ein Server in der Cloud erneut bereitgestellt oder sogar ersetzt werden, daher benötigen Sie einen robusten Modellbereitstellungs- und Geräteverwaltungsprozess

- Die Kommunikation zwischen Geräten und der Cloud muss effizient und sicher sein, da sie häufig über nicht vertrauenswürdige Netzwerke mit geringer Bandbreite erfolgt

Sehen wir uns an, wie wir diese Herausforderungen mit AWS-Diensten bewältigen können, zusätzlich zum Export des Modells im ONNX-Format, was uns beispielsweise die Anwendung von Optimierungen wie Quantisierung ermöglicht, um die Modellgröße für Einschränkungsgeräte zu reduzieren. ONNX bietet außerdem optimierte Laufzeiten für die gängigsten Edge-Hardwareplattformen.

Um den Edge-Bereitstellungsprozess aufzuschlüsseln, benötigen wir zwei Komponenten:

- Ein Bereitstellungsmechanismus für die Modellbereitstellung, der das Modell selbst und einige Geschäftslogiken zur Verwaltung und Interaktion mit dem Modell umfasst

- Eine Workflow-Engine, die den gesamten Prozess orchestrieren kann, um ihn robust und wiederholbar zu machen

In diesem Beispiel verwenden wir verschiedene AWS-Dienste, um unseren automatisierten Edge-Bereitstellungsmechanismus aufzubauen, der alle erforderlichen Komponenten integriert, die wir besprochen haben.

Zunächst simulieren wir ein Edge-Gerät. Um Ihnen das Durchlaufen des End-to-End-Workflows zu erleichtern, verwenden wir eine Amazon Elastic Compute-Cloud (Amazon EC2)-Instanz zur Simulation eines Edge-Geräts durch Installation der AWS IoT Greengrass Core-Software auf der Instanz. Sie können EC2-Instanzen auch verwenden, um die verschiedenen Komponenten in einem Qualitätssicherungsprozess zu validieren, bevor Sie sie auf einem tatsächlichen Edge-Produktionsgerät bereitstellen. AWS IoT Greengrass ist ein Open-Source-Edge-Laufzeit- und Cloud-Service für das Internet der Dinge (IoT), der Sie beim Erstellen, Bereitstellen und Verwalten von Edge-Gerätesoftware unterstützt. AWS IoT Greengrass reduziert den Aufwand für die sichere und skalierbare Erstellung, Bereitstellung und Verwaltung von Edge-Gerätesoftware. Nachdem Sie die AWS IoT Greengrass Core-Software auf Ihrem Gerät installiert haben, können Sie Funktionen und Komponenten hinzufügen oder entfernen und Ihre IoT-Geräteanwendungen mit AWS IoT Greengrass verwalten. Es bietet viele integrierte Komponenten, die Ihnen das Leben erleichtern, wie zum Beispiel die StreamManager- und MQTT-Broker-Komponenten, mit denen Sie sicher mit der Cloud kommunizieren können und die eine End-to-End-Verschlüsselung unterstützen. Mit diesen Funktionen können Sie Inferenzergebnisse und Bilder effizient hochladen.

In einer Produktionsumgebung verfügen Sie normalerweise über eine Industriekamera, die Bilder liefert, für die das ML-Modell Vorhersagen erstellen soll. Für unser Setup simulieren wir diese Bildeingabe, indem wir eine Voreinstellung von Bildern in ein bestimmtes Verzeichnis auf dem Edge-Gerät hochladen. Anschließend verwenden wir diese Bilder als Inferenzeingabe für das Modell.

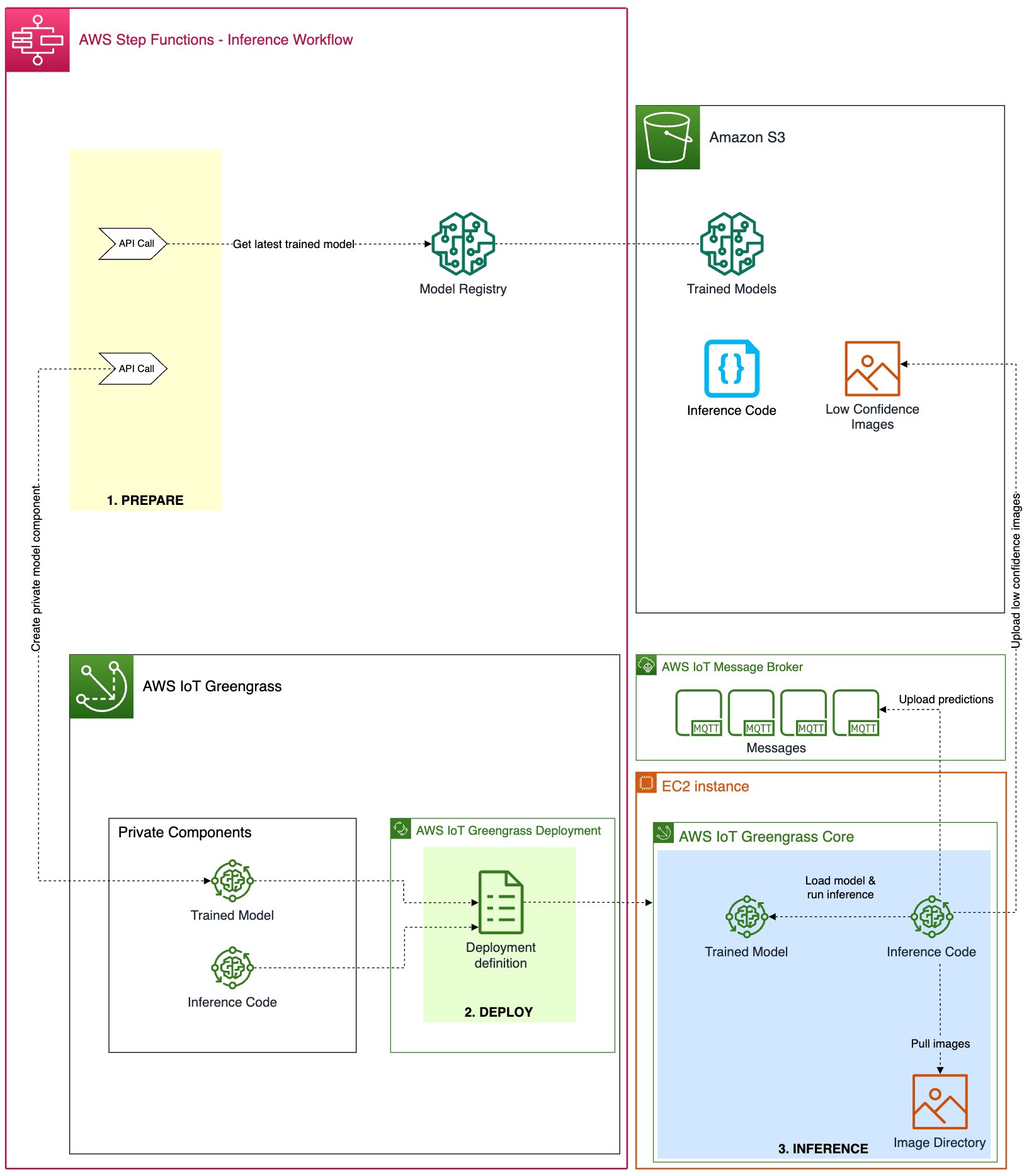

Wir haben den gesamten Bereitstellungs- und Inferenzprozess in drei aufeinanderfolgende Schritte unterteilt, um ein in der Cloud trainiertes ML-Modell in einer Edge-Umgebung bereitzustellen und es für Vorhersagen zu verwenden:

- Danach – Verpacken Sie das trainierte Modell für die Edge-Bereitstellung.

- Deploy – Übertragung von Modell- und Inferenzkomponenten von der Cloud auf das Edge-Gerät.

- Inferenz – Laden Sie das Modell und führen Sie den Inferenzcode für Bildvorhersagen aus.

Das folgende Architekturdiagramm zeigt die Details dieses dreistufigen Prozesses und wie wir ihn mit AWS-Services implementiert haben.

In den folgenden Abschnitten besprechen wir die Details für jeden Schritt und zeigen, wie dieser Prozess in einen automatisierten und wiederholbaren Orchestrierungs- und CI/CD-Workflow sowohl für die ML-Modelle als auch für den entsprechenden Inferenzcode eingebettet werden kann.

Danach

Edge-Geräte verfügen im Vergleich zu einer Cloud-Umgebung, in der leistungsstarke CPUs und GPUs problemlos ML-Modelle ausführen können, häufig über begrenzte Rechenleistung und Speicher. Mithilfe verschiedener Modelloptimierungstechniken können Sie ein Modell für eine bestimmte Software- oder Hardwareplattform anpassen, um die Vorhersagegeschwindigkeit zu erhöhen, ohne an Genauigkeit zu verlieren.

In diesem Beispiel haben wir das trainierte Modell in der Trainingspipeline zur Portabilität, möglichen Optimierungen sowie optimierten Edge-Laufzeiten in das ONNX-Format exportiert und das Modell darin registriert Amazon SageMaker-Modellregistrierung. In diesem Schritt erstellen wir eine neue Greengrass-Modellkomponente einschließlich des neuesten registrierten Modells für die spätere Bereitstellung.

Deploy

Bei der Bereitstellung eines Modells aus der Cloud auf einem Edge-Gerät ist ein sicherer und zuverlässiger Bereitstellungsmechanismus von entscheidender Bedeutung. Da AWS IoT Greengrass bereits über ein robustes und sicheres Edge-Bereitstellungssystem verfügt, verwenden wir dieses für unsere Bereitstellungszwecke. Bevor wir uns unseren Bereitstellungsprozess im Detail ansehen, werfen wir einen kurzen Rückblick auf die Funktionsweise von AWS IoT Greengrass-Bereitstellungen. Im Mittelpunkt des AWS IoT Greengrass-Bereitstellungssystems stehen: Komponenten, die die Softwaremodule definieren, die auf einem Edge-Gerät bereitgestellt werden, auf dem AWS IoT Greengrass Core ausgeführt wird. Dies können entweder private Komponenten sein, die Sie erstellen, oder öffentliche Komponenten, die von einem der beiden bereitgestellt werden AWS oder das breitere Greengrass-Gemeinschaft. Im Rahmen einer Bereitstellung können mehrere Komponenten gebündelt werden. Eine Bereitstellungskonfiguration definiert die in einer Bereitstellung enthaltenen Komponenten und die Zielgeräte der Bereitstellung. Es kann entweder in einer Bereitstellungskonfigurationsdatei (JSON) oder über die AWS IoT Greengrass-Konsole beim Erstellen einer neuen Bereitstellung definiert werden.

Wir erstellen die folgenden zwei Greengrass-Komponenten, die dann über den Bereitstellungsprozess auf dem Edge-Gerät bereitgestellt werden:

- Verpacktes Modell (private Komponente) – Diese Komponente enthält das trainierte und ML-Modell im ONNX-Format.

- Inferenzcode (private Komponente) – Abgesehen vom ML-Modell selbst müssen wir eine gewisse Anwendungslogik implementieren, um Aufgaben wie Datenvorbereitung, Kommunikation mit dem Modell für Inferenz und Nachbearbeitung von Inferenzergebnissen zu bewältigen. In unserem Beispiel haben wir eine Python-basierte private Komponente entwickelt, um die folgenden Aufgaben zu erledigen:

- Installieren Sie die erforderlichen Laufzeitkomponenten wie das Ultralytics YOLOv8 Python-Paket.

- Anstatt Bilder aus einem Kamera-Livestream aufzunehmen, simulieren wir dies, indem wir vorbereitete Bilder aus einem bestimmten Verzeichnis laden und die Bilddaten entsprechend den Modelleingabeanforderungen aufbereiten.

- Führen Sie Rückschlussaufrufe für das geladene Modell mit den vorbereiteten Bilddaten durch.

- Überprüfen Sie die Vorhersagen und laden Sie die Inferenzergebnisse zurück in die Cloud.

Wenn Sie sich den von uns erstellten Inferenzcode genauer ansehen möchten, lesen Sie die GitHub Repo.

Inferenz

Der Modellinferenzprozess auf dem Edge-Gerät startet automatisch, nachdem die Bereitstellung der oben genannten Komponenten abgeschlossen ist. Die benutzerdefinierte Inferenzkomponente führt das ML-Modell regelmäßig mit Bildern aus einem lokalen Verzeichnis aus. Das vom Modell zurückgegebene Inferenzergebnis pro Bild ist ein Tensor mit folgendem Inhalt:

- Vertrauenswerte – Wie sicher ist das Modell hinsichtlich der Erkennungen?

- Objektkoordinaten – Die vom Modell im Bild erkannten Kratzobjektkoordinaten (x, y, Breite, Höhe).

In unserem Fall kümmert sich die Inferenzkomponente darum, Inferenzergebnisse an ein bestimmtes MQTT-Thema in AWS IoT zu senden, wo sie zur weiteren Verarbeitung gelesen werden können. Diese Nachrichten können zum Debuggen über den MQTT-Testclient auf der AWS IoT-Konsole angezeigt werden. In einer Produktionsumgebung können Sie sich dafür entscheiden, automatisch ein anderes System zu benachrichtigen, das fehlerhafte Metalletiketten aus der Produktionslinie entfernt.

Besetzung

Wie in den vorherigen Abschnitten gezeigt, sind mehrere Schritte erforderlich, um ein ML-Modell, den entsprechenden Inferenzcode und die erforderliche Laufzeit oder den erforderlichen Agenten auf einem Edge-Gerät vorzubereiten und bereitzustellen. Step Functions ist ein vollständig verwalteter Dienst, der es Ihnen ermöglicht, diese dedizierten Schritte zu orchestrieren und den Workflow in Form einer Zustandsmaschine zu entwerfen. Der serverlose Charakter dieses Dienstes und native Step Functions-Funktionen wie AWS-Service-API-Integrationen ermöglichen Ihnen die schnelle Einrichtung dieses Workflows. Integrierte Funktionen wie Wiederholungsversuche oder Protokollierung sind wichtige Punkte für den Aufbau robuster Orchestrierungen. Weitere Einzelheiten zur Definition des Zustandsautomaten selbst finden Sie im GitHub-Repository Oder überprüfen Sie das Zustandsmaschinendiagramm in der Step Functions-Konsole, nachdem Sie dieses Beispiel in Ihrem Konto bereitgestellt haben.

Infrastrukturbereitstellung und Integration in CI/CD

Die CI/CD-Pipeline zur Integration und Erstellung aller erforderlichen Infrastrukturkomponenten folgt dem gleichen Muster, das in dargestellt ist Teil 1 dieser Serie. Wir benutzen das AWS Cloud-Entwicklungskit (AWS CDK), um die erforderlichen Pipelines bereitzustellen AWS CodePipeline.

Lernen

Es gibt mehrere Möglichkeiten, eine Architektur für ein automatisiertes, robustes und sicheres ML-Modell-Edge-Bereitstellungssystem zu erstellen, die oft stark vom Anwendungsfall und anderen Anforderungen abhängen. Hier jedoch einige Erkenntnisse, die wir gerne mit Ihnen teilen möchten:

- Bewerten Sie im Voraus, ob das zusätzliche Anforderungen an die Rechenressourcen von AWS IoT Greengrass Passen Sie Ihr Gehäuse an, insbesondere bei Geräten mit eingeschränkter Kante.

- Richten Sie einen Bereitstellungsmechanismus ein, der einen Überprüfungsschritt der bereitgestellten Artefakte vor der Ausführung auf dem Edge-Gerät integriert, um sicherzustellen, dass während der Übertragung keine Manipulationen vorgenommen wurden.

- Es empfiehlt sich, die Bereitstellungskomponenten auf AWS IoT Greengrass so modular und eigenständig wie möglich zu halten, um sie unabhängig bereitstellen zu können. Wenn Sie beispielsweise ein relativ kleines Inferenzcodemodul, aber ein großes ML-Modell in Bezug auf die Größe haben, möchten Sie nicht immer beide bereitstellen, wenn sich nur der Inferenzcode geändert hat. Dies ist besonders wichtig, wenn Sie über eine begrenzte Bandbreite oder teure Edge-Gerätekonnektivität verfügen.

Zusammenfassung

Damit ist unsere dreiteilige Serie zum Aufbau einer End-to-End-MLOps-Pipeline für die visuelle Qualitätsprüfung am Netzwerkrand abgeschlossen. Wir haben uns die zusätzlichen Herausforderungen angesehen, die mit der Bereitstellung eines ML-Modells am Edge einhergehen, wie z. B. Modellpaketierung oder komplexe Bereitstellungsorchestrierung. Wir haben die Pipeline vollständig automatisiert implementiert, damit wir unsere Modelle robust, sicher, wiederholbar und nachvollziehbar in Produktion bringen können. Nutzen Sie die in dieser Serie entwickelte Architektur und Implementierung gerne als Ausgangspunkt für Ihr nächstes ML-fähiges Projekt. Wenn Sie Fragen zur Architektur und zum Aufbau eines solchen Systems für Ihre Umgebung haben, wenden Sie sich bitte an uns erreichen. Weitere Themen und Anwendungsfälle finden Sie in unserer Maschinelles lernen und IoT Blogs.

Über die Autoren

Michael Roth ist Senior Solutions Architect bei AWS und unterstützt Fertigungskunden in Deutschland bei der Lösung ihrer geschäftlichen Herausforderungen mithilfe der AWS-Technologie. Neben Beruf und Familie interessiert er sich für Sportwagen und genießt italienischen Kaffee.

Michael Roth ist Senior Solutions Architect bei AWS und unterstützt Fertigungskunden in Deutschland bei der Lösung ihrer geschäftlichen Herausforderungen mithilfe der AWS-Technologie. Neben Beruf und Familie interessiert er sich für Sportwagen und genießt italienischen Kaffee.

Jörg Wöhrle ist Solutions Architect bei AWS und arbeitet mit Fertigungskunden in Deutschland. Mit einer Leidenschaft für Automatisierung hat Joerg in seinem Leben vor AWS als Softwareentwickler, DevOps-Ingenieur und Site Reliability Engineer gearbeitet. Außerhalb der Cloud ist er ein ehrgeiziger Läufer und genießt die schöne Zeit mit seiner Familie. Wenn Sie also eine DevOps-Herausforderung haben oder einen Lauf machen möchten: Sagen Sie ihm Bescheid.

Jörg Wöhrle ist Solutions Architect bei AWS und arbeitet mit Fertigungskunden in Deutschland. Mit einer Leidenschaft für Automatisierung hat Joerg in seinem Leben vor AWS als Softwareentwickler, DevOps-Ingenieur und Site Reliability Engineer gearbeitet. Außerhalb der Cloud ist er ein ehrgeiziger Läufer und genießt die schöne Zeit mit seiner Familie. Wenn Sie also eine DevOps-Herausforderung haben oder einen Lauf machen möchten: Sagen Sie ihm Bescheid.

Johannes Langer ist Senior Solutions Architect bei AWS und arbeitet mit Unternehmenskunden in Deutschland. Johannes setzt sich leidenschaftlich dafür ein, maschinelles Lernen zur Lösung realer Geschäftsprobleme einzusetzen. Privat arbeitet Johannes gerne an Heimwerkerprojekten und verbringt gerne Zeit im Freien mit seiner Familie.

Johannes Langer ist Senior Solutions Architect bei AWS und arbeitet mit Unternehmenskunden in Deutschland. Johannes setzt sich leidenschaftlich dafür ein, maschinelles Lernen zur Lösung realer Geschäftsprobleme einzusetzen. Privat arbeitet Johannes gerne an Heimwerkerprojekten und verbringt gerne Zeit im Freien mit seiner Familie.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-an-end-to-end-mlops-pipeline-for-visual-quality-inspection-at-the-edge-part-3/

- :hast

- :Ist

- :Wo

- $UP

- 150

- 7

- a

- Fähig

- LiveBuzz

- Nach

- Konto

- Genauigkeit

- präsentieren

- hinzufügen

- Zusatz

- Zusätzliche

- vorantreiben

- Nach der

- gegen

- Makler

- Alle

- erlauben

- erlaubt

- bereits

- ebenfalls

- immer

- Amazon

- Amazon EC2

- Amazon Web Services

- ehrgeizig

- an

- und

- Ein anderer

- jedem

- Bienen

- Anwendung

- Anwendungen

- Bewerben

- Anwendung

- Architektur

- SIND

- AS

- beiseite

- At

- automatisieren

- Automatisiert

- Automatisches Erfassen:

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Automation

- ein Weg

- AWS

- AWS IoT Greengrass

- Zurück

- Bandbreite

- BE

- weil

- werden

- war

- Bevor

- Anfang

- neben

- zwischen

- Beyond

- Big

- Blogs

- beide

- breiteres

- Makler

- bauen

- Building

- erbaut

- eingebaut

- gebündelt

- Geschäft

- aber

- by

- Aufrufe

- Kamera

- CAN

- Fähigkeiten

- österreichische Unternehmen

- Autos

- Häuser

- Fälle

- challenges

- Herausforderungen

- geändert

- aus der Ferne überprüfen

- Überprüfung

- Auftraggeber

- Cloud

- Code

- Kaffee

- wie die

- gemeinsam

- mit uns kommunizieren,

- Kommunikation

- verglichen

- Komplex

- Komponente

- Komponenten

- Berechnen

- zuversichtlich

- Konfiguration

- Konnektivität

- aufeinanderfolgenden

- Konsul (Console)

- Einschränkungen

- enthält

- Inhalt

- Kernbereich

- Kernsoftware

- Dazugehörigen

- Kosten

- erstellen

- Erstellen

- Original

- Kunden

- technische Daten

- Datenaufbereitung

- entscheidet

- gewidmet

- tiefer

- definieren

- definiert

- Definiert

- Definition

- liefern

- Lieferanten

- abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Implementierungen

- Design

- Detail

- Details

- entdecken

- erkannt

- entwickelt

- Entwickler:in / Unternehmen

- Entwicklung

- Gerät

- Geräte

- anders

- diskutieren

- diskutiert

- geteilt

- do

- Nicht

- nach unten

- zwei

- im

- jeder

- einfacher

- leicht

- Edge

- effizient

- effizient

- Anstrengung

- entweder

- einbetten

- Verschlüsselung

- End-to-End

- Motor

- Ingenieur

- gewährleisten

- Unternehmen

- Ganz

- Arbeitsumfeld

- insbesondere

- Bewerten

- Sogar

- Beispiel

- Familie

- weit

- Fashion

- fehlerhaft

- Eigenschaften

- fühlen

- wenige

- Reichen Sie das

- passen

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Aussichten für

- unten stehende Formular

- Format

- Frei

- für

- voll

- Funktionen

- weiter

- erzeugen

- Deutschland

- Go

- gut

- GPUs

- Graph

- Griff

- passiert

- Hardware

- Haben

- Höhe

- hilft

- hier

- GUTE

- High-Level

- ihm

- seine

- Startseite

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- if

- Image

- Bilder

- implementieren

- Implementierung

- umgesetzt

- wichtig

- Verbesserung

- in

- inklusive

- Dazu gehören

- Einschließlich

- Eingehende

- Erhöhung

- unabhängig

- industriell

- Infrastruktur

- Varianten des Eingangssignals:

- installieren

- Installieren

- Instanz

- integrieren

- Integriert

- Integration

- Integrationen

- interagieren

- interessiert

- Internet

- Internet der Dinge

- in

- iot

- IoT-Gerät

- IT

- italienisch

- selbst

- jpg

- JSON

- nur

- Behalten

- Wesentliche

- Wissen

- Beschriftung

- neueste

- lernen

- lassen

- Lebensdauer

- Gefällt mir

- Limitiert

- Line

- leben

- Belastung

- Laden

- aus einer regionalen

- located

- Protokollierung

- Logik

- aussehen

- sah

- verlieren

- Los

- Maschine

- Maschinelles Lernen

- um

- Making

- verwalten

- verwaltet

- Management

- Herstellung

- Mechanismus

- Memory

- Nachrichten

- Metall

- Michael

- ML

- MLOps

- Modell

- für

- modulare

- Modul

- Module

- mehr

- vor allem warme

- mehrere

- nativen

- Natur

- Need

- Bedürfnisse

- Neu

- weiter

- nicht

- Objekt

- of

- Angebote

- vorgenommen,

- on

- Open-Source-

- optimiert

- or

- Orchesterbearbeitung

- Andere

- UNSERE

- im Freien

- Gesamt-

- Paket

- Verpackung

- Teil

- Teile

- Leidenschaft & KREATIVITÄT

- leidenschaftlich

- Schnittmuster

- für

- persönliche

- Pipeline

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Bitte

- Points

- Punkte

- Portabilität

- möglich

- Post

- größte treibende

- Praxis

- Prognose

- Prognosen

- Vorbereitung

- Danach

- bereit

- Vorbereitung

- privat

- Probleme

- Prozessdefinierung

- Verarbeitung

- produziert

- Produktion

- Projekt

- Projekte

- vorausgesetzt

- bietet

- Öffentlichkeit

- Zwecke

- setzen

- Python

- F&A

- Qualität

- Fragen

- Direkt

- schnell

- Lesen Sie mehr

- echt

- rekapitulieren

- empfehlen

- Veteran

- reduziert

- siehe

- in Bezug auf

- eingetragen

- verhältnismäßig

- Zuverlässigkeit

- zuverlässig

- entfernen

- Entfernen

- wiederholbar

- ersetzt

- erfordern

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Folge

- Die Ergebnisse

- robust

- Führen Sie

- Läufer

- Laufen

- läuft

- sagemaker

- gleich

- skalierbaren

- kratzen

- Abschnitte

- Verbindung

- sicher

- sehen

- gesehen

- Sendung

- Senior

- Modellreihe

- Server

- Serverlos

- Lösungen

- kompensieren

- Einstellung

- Setup

- Teilen

- sollte

- erklären

- zeigte

- Konzerte

- am Standort

- Größe

- klein

- So

- Software

- Lösung

- Lösungen

- LÖSEN

- einige

- spezifisch

- Geschwindigkeit

- Ausgabe

- Sports

- Beginnen Sie

- beginnt

- Bundesstaat

- Schritt

- Shritte

- einfach

- Strom

- Folge

- so

- Unterstützung

- System

- angehen

- nimmt

- Einnahme

- Target

- und Aufgaben

- Techniken

- Technologie

- AGB

- Test

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Der Staat

- ihr

- Sie

- dann

- Diese

- fehlen uns die Worte.

- diejenigen

- nach drei

- dreistufig

- Durch

- Zeit

- zu

- gemeinsam

- Thema

- Themen

- rückverfolgbar

- trainiert

- Ausbildung

- privaten Transfer

- XNUMX

- typisch

- einzigartiges

- Uploading

- us

- -

- Anwendungsfall

- benutzt

- Verwendung von

- BESTÄTIGEN

- Wert

- Verification

- sehr

- wollen

- Weg..

- Wege

- we

- Netz

- Web-Services

- GUT

- wann

- welche

- ganze

- Breite

- mit

- .

- ohne

- Arbeiten

- gearbeitet

- Arbeitsablauf.

- arbeiten,

- würde

- X

- noch

- Du

- Ihr

- Zephyrnet