Amazon-Anerkennung ist ein Computer-Vision-Service, der es einfach macht, Bild- und Videoanalysen zu Ihren Anwendungen hinzuzufügen, indem er bewährte, hochgradig skalierbare Deep-Learning-Technologie verwendet, die kein Fachwissen über maschinelles Lernen (ML) erfordert. Mit Amazon Rekognition können Sie Objekte, Personen, Texte, Szenen und Aktivitäten in Bildern und Videos identifizieren und unangemessene Inhalte erkennen. Amazon Rekognition bietet auch hochpräzise Gesichtsanalyse- und Gesichtssuchfunktionen, mit denen Sie Gesichter für eine Vielzahl von Anwendungsfällen erkennen, analysieren und vergleichen können.

Benutzerdefinierte Etiketten von Amazon Rekognition ist eine Funktion von Amazon Rekognition, die es einfach macht, Ihre eigenen spezialisierten ML-basierten Bildanalysefunktionen zu erstellen, um einzigartige Objekte und Szenen zu erkennen, die für Ihren spezifischen Anwendungsfall von wesentlicher Bedeutung sind.

Einige häufige Anwendungsfälle von Rekognition Custom Labels umfassen das Auffinden Ihres Logos in Social-Media-Beiträgen, das Identifizieren Ihrer Produkte in Verkaufsregalen, das Klassifizieren von Maschinenteilen in einem Fließband, das Unterscheiden zwischen gesunden und infizierten Pflanzen und vieles mehr.

Amazon Rekognition-Etiketten unterstützt beliebte Sehenswürdigkeiten wie die Brooklyn Bridge, das Kolosseum, den Eiffelturm, Machu Picchu und das Taj Mahal, und mehr. Wenn Sie andere Sehenswürdigkeiten oder Gebäude haben, die noch nicht von Amazon Rekognition unterstützt werden, können Sie dennoch benutzerdefinierte Amazon Rekognition-Etiketten verwenden.

In diesem Beitrag demonstrieren wir die Verwendung von Rekognition Custom Labels zur Erkennung des Amazon Spheres-Gebäudes in Seattle.

Mit Rekognition Custom Labels übernimmt AWS die schwere Arbeit für Sie. Rekognition Custom Labels baut auf den bestehenden Funktionen von Amazon Rekognition auf, das bereits mit Millionen von Bildern in vielen Kategorien trainiert wurde. Anstelle von Tausenden von Bildern müssen Sie einfach einen kleinen Satz von Schulungsbildern (normalerweise einige hundert Bilder oder weniger) hochladen, die für Ihren Anwendungsfall spezifisch sind, über unsere unkomplizierte Konsole. Amazon Rekognition kann mit nur wenigen Klicks mit dem Training beginnen. Nachdem Amazon Rekognition mit dem Training aus Ihrem Bildsatz begonnen hat, kann es innerhalb weniger Minuten oder Stunden ein benutzerdefiniertes Bildanalysemodell für Sie erstellen. Hinter den Kulissen lädt und untersucht Rekognition Custom Labels automatisch die Trainingsdaten, wählt die geeigneten ML-Algorithmen aus, trainiert ein Modell und stellt Modellleistungsmetriken bereit. Anschließend können Sie Ihr benutzerdefiniertes Modell über die Rekognition Custom Labels API verwenden und es in Ihre Anwendungen integrieren.

Lösungsüberblick

Für unser Beispiel verwenden wir die Amazonas-Kugeln Gebäude in Seattle. Wir trainieren ein Modell mit Rekognition Custom Labels; Wann immer ähnliche Bilder verwendet werden, sollte der Algorithmus dies als identifizieren Amazon Spheres statt Dome, Architecture, Glass building, oder andere Etiketten.

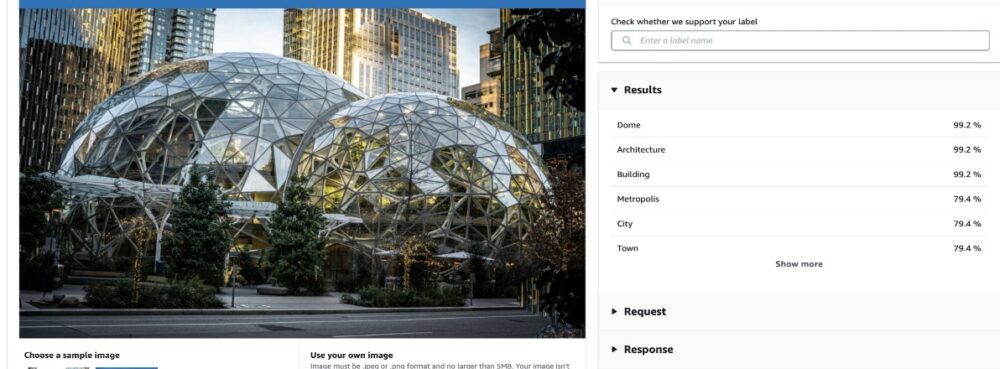

Lassen Sie uns zunächst ein Beispiel für die Verwendung der Etikettenerkennungsfunktion von Amazon Rekognition zeigen, bei der wir das Bild von Amazon Spheres ohne benutzerdefiniertes Training einspeisen. Wir verwenden die Amazon Rekognition-Konsole, um die Etikettenerkennungsdemo zu öffnen und unser Foto hochzuladen.

Nachdem das Bild hochgeladen und analysiert wurde, sehen wir unten Labels mit ihren Vertrauenswerten Die Ergebnisse. In diesem Fall, Dome wurde mit einem Konfidenzwert von 99.2 % erkannt, Architecture mit 99.2% Building mit 99.2% Metropolis mit 79.4 % usw.

Wir möchten eine benutzerdefinierte Beschriftung verwenden, um ein Computer-Vision-Modell zu erstellen, das das Bild beschriften kann Amazon Spheres.

In den folgenden Abschnitten führen wir Sie durch die Vorbereitung Ihres Datensatzes, das Erstellen eines Rekognition Custom Labels-Projekts, das Trainieren des Modells, das Auswerten der Ergebnisse und das Testen mit zusätzlichen Bildern.

Voraussetzungen:

Bevor Sie mit den Schritten beginnen, gibt es Quoten für Rekognition Custom Labels, die Sie kennen müssen. Wenn Sie die Limits ändern möchten, können Sie a anfordern Dienstlimit erhöhen.

Erstellen Sie Ihren Datensatz

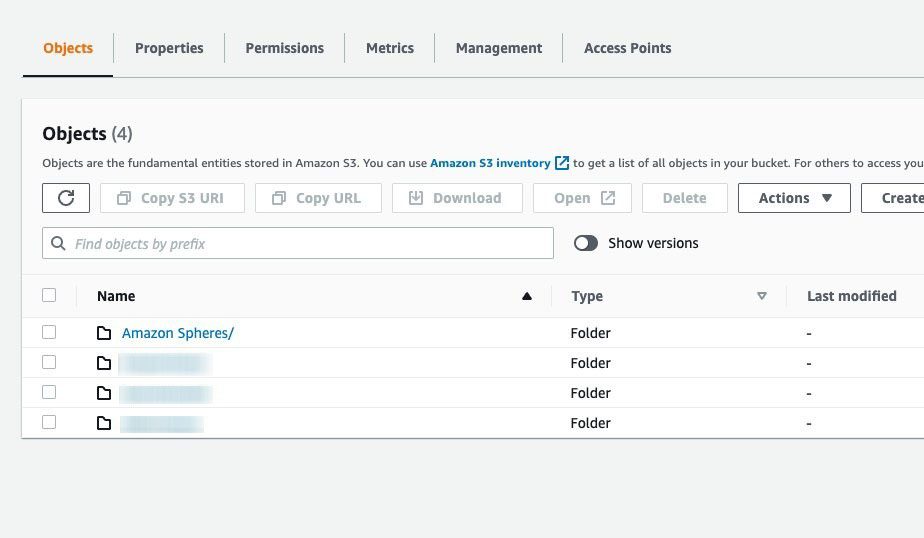

Wenn Sie Rekognition Custom Labels zum ersten Mal verwenden, werden Sie aufgefordert, eine zu erstellen Amazon Simple Storage-Service (Amazon S3)-Bucket zum Speichern Ihres Datensatzes.

Für diese Blog-Demonstration haben wir Bilder der Amazon Spheres verwendet, die wir bei unserem Besuch in Seattle, WA, aufgenommen haben. Fühlen Sie sich frei, Ihre eigenen Bilder nach Bedarf zu verwenden.

Kopieren Sie Ihr Dataset in den neu erstellten Bucket, der Ihre Bilder in ihren jeweiligen Präfixen speichert.

Erstellen Sie ein Projekt

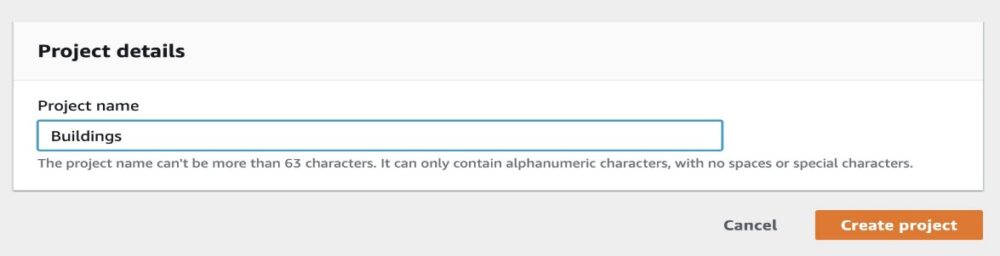

Führen Sie die folgenden Schritte aus, um Ihr Rekognition Custom Labels-Projekt zu erstellen:

- Wählen Sie in der Rekognition Custom Labels-Konsole aus Erstellen Sie ein Projekt.

- Aussichten für Projektname, Geben Sie einen Namen ein.

- Auswählen

Projekt anlegen.

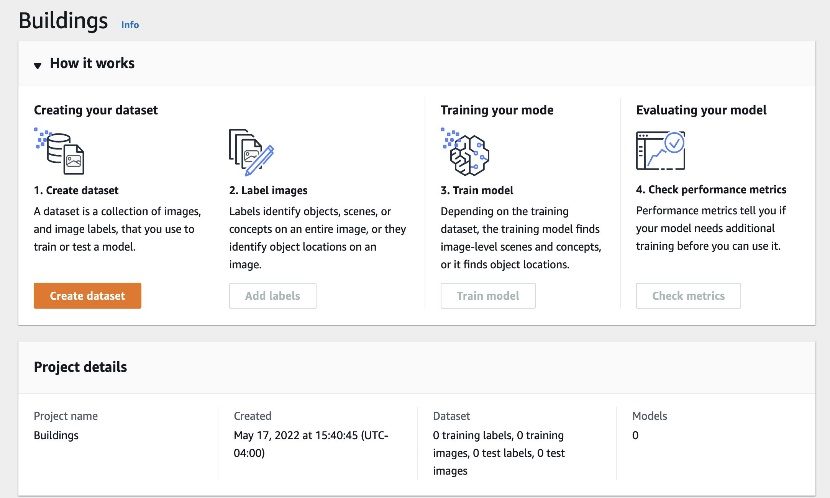

Nun spezifizieren wir die Konfiguration und den Pfad Ihres Trainings- und Testdatensatzes. - Auswählen

Datensatz erstellen.

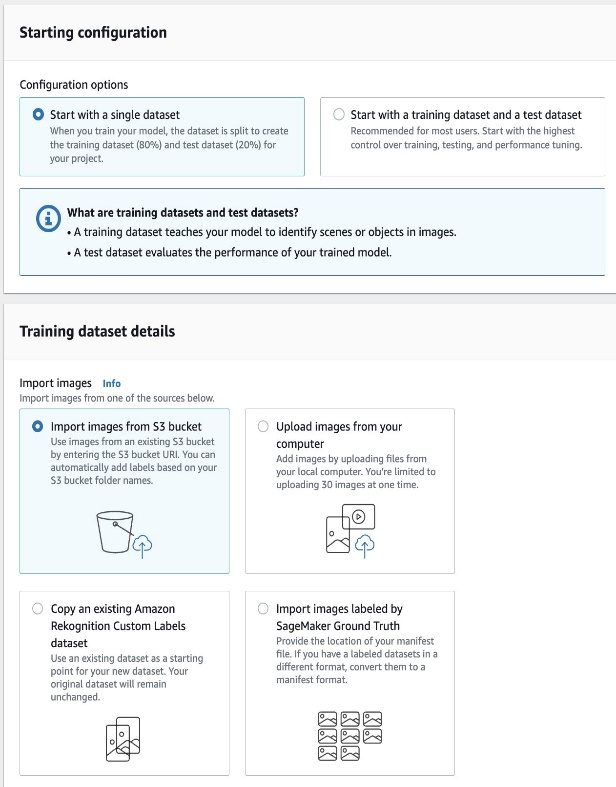

Sie können mit einem Projekt beginnen, das über ein einzelnes Dataset verfügt, oder mit einem Projekt, das über separate Trainings- und Test-Datasets verfügt. Wenn Sie mit einem einzelnen Datensatz beginnen, teilt Rekognition Custom Labels Ihren Datensatz während des Trainings auf, um einen Trainingsdatensatz (80 %) und einen Testdatensatz (20 %) für Ihr Projekt zu erstellen.

Darüber hinaus können Sie Trainings- und Testdatensätze für ein Projekt erstellen, indem Sie Bilder von einem der folgenden Speicherorte importieren:

Für diesen Beitrag verwenden wir unseren eigenen benutzerdefinierten Datensatz von Amazon Spheres.

- Auswählen Beginnen Sie mit einem einzelnen Datensatz.

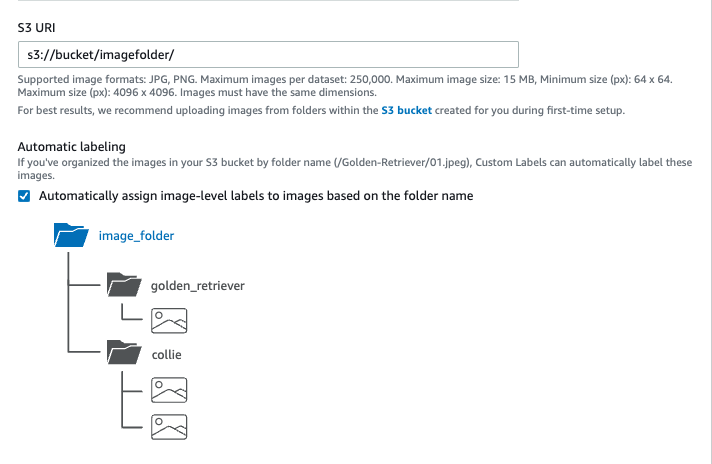

- Auswählen Importieren Sie Bilder aus dem S3-Bucket.

- Aussichten für S3-URI, geben Sie den Pfad zu Ihrem S3-Bucket ein.

- Wenn Sie möchten, dass Rekognition Custom Labels die Bilder basierend auf den Ordnernamen in Ihrem S3-Bucket automatisch für Sie beschriftet, wählen Sie aus Weisen Sie Bildern basierend auf dem Ordnernamen automatisch Labels auf Bildebene zu.

- Auswählen Datensatz erstellen.

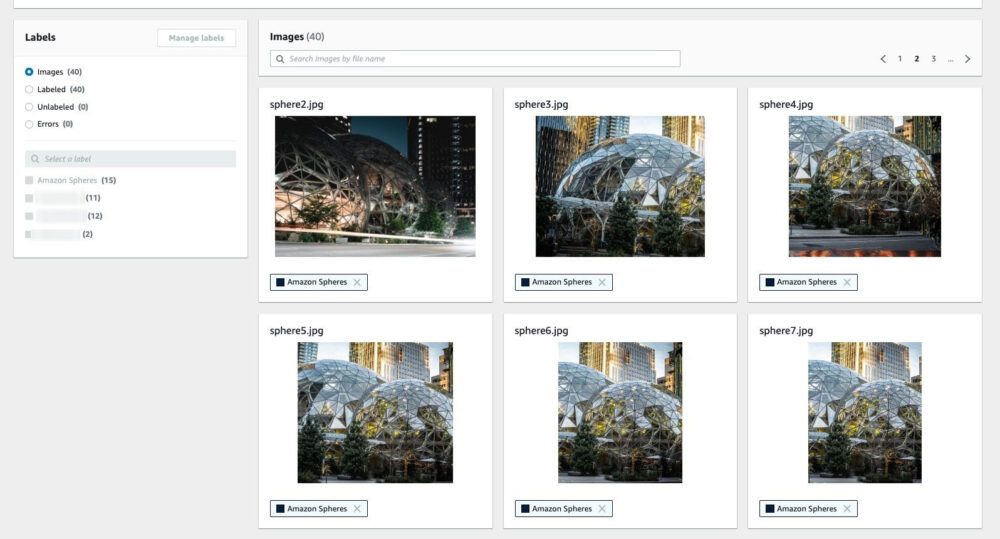

Es öffnet sich eine Seite, die Ihnen die Bilder mit ihren Beschriftungen zeigt. Wenn Sie Fehler in den Etiketten sehen, lesen Sie unter Datensätze debuggen.

Trainiere das Modell

Nachdem Sie Ihr Dataset überprüft haben, können Sie nun das Modell trainieren.

- Auswählen Modell trainieren.

- Aussichten für Projekt auswählen, geben Sie den ARN für Ihr Projekt ein, falls er noch nicht aufgeführt ist.

- Auswählen Zugmodell.

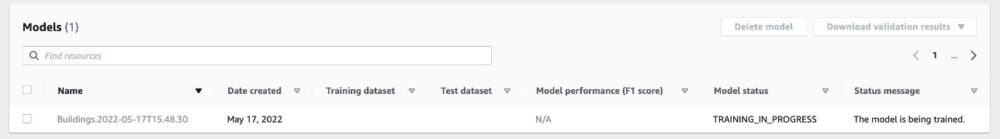

Im Modelle Abschnitt der Projektseite können Sie den aktuellen Status im überprüfen Modellstatus Spalte, wo das Training im Gange ist. Die Trainingszeit dauert in der Regel 30 Minuten bis 24 Stunden, abhängig von mehreren Faktoren wie der Anzahl der Bilder und der Anzahl der Beschriftungen im Trainingssatz und den Arten der ML-Algorithmen, die zum Trainieren Ihres Modells verwendet werden.

Wenn das Modelltraining abgeschlossen ist, können Sie den Modellstatus als sehen TRAINING_COMPLETED. Wenn das Training fehlschlägt, beziehen Sie sich auf Debuggen eines fehlgeschlagenen Modelltrainings.

Bewerten Sie das Modell

Öffnen Sie die Modelldetailseite. Das Evaluierung Registerkarte zeigt Metriken für jedes Label und die durchschnittliche Metrik für den gesamten Testdatensatz.

Die Rekognition Custom Labels-Konsole bietet die folgenden Metriken als Zusammenfassung der Trainingsergebnisse und als Metriken für jedes Label:

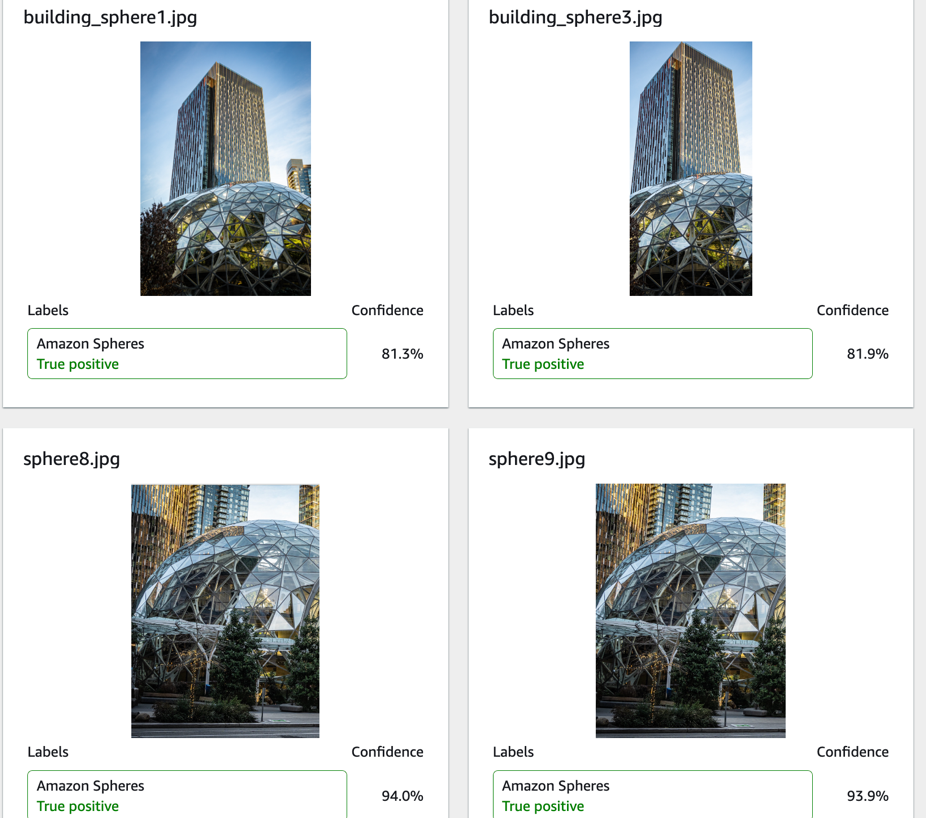

Sie können die Ergebnisse Ihres trainierten Modells für einzelne Bilder anzeigen, wie im folgenden Screenshot gezeigt.

Testen Sie das Modell

Nachdem wir uns die Auswertungsergebnisse angesehen haben, können wir das Modell starten und neue Bilder analysieren.

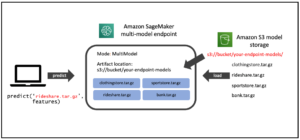

Sie können das Modell auf der starten Modell verwenden auf der Rekognition Custom Labels-Konsole oder über die StartProjektVersion Betrieb über die AWS-Befehlszeilenschnittstelle (AWS CLI) oder Python SDK.

Wenn das Modell läuft, können wir die neuen Bilder mit analysieren Erkennen Sie benutzerdefinierte Etiketten API. Das Ergebnis aus DetectCustomLabels ist eine Vorhersage, dass das Bild bestimmte Objekte, Szenen oder Konzepte enthält. Siehe folgenden Code:

In der Ausgabe sehen Sie das Etikett mit seinem Konfidenzwert:

Wie Sie anhand des Ergebnisses sehen können, können Sie mit nur wenigen einfachen Klicks benutzerdefinierte Rekognition-Etiketten verwenden, um genaue Etikettierungsergebnisse zu erzielen. Sie können dies für eine Vielzahl von Bildanwendungsfällen verwenden, z. B. zum Identifizieren von benutzerdefinierten Etiketten für Lebensmittel, Haustiere, Maschinenteile und mehr.

Aufräumen

Führen Sie die folgenden Schritte aus, um die Ressourcen, die Sie im Rahmen dieses Beitrags erstellt haben, zu bereinigen und mögliche wiederkehrende Kosten zu vermeiden:

- Auf dem Modell verwenden Tab, Stoppen Sie das Modell.

Alternativ können Sie das Modell auch mit stoppen StopProjectVersion Betrieb über die AWS CLI oder das Python SDK. Warten Sie, bis sich das Modell in der befindetStoppedStatus, bevor Sie mit den nächsten Schritten fortfahren. - Modell löschen.

- Löschen Sie das Projekt.

- Löschen Sie den Datensatz.

- leer der Inhalt des S3-Buckets und löschen der Eimer.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Sie Rekognition Custom Labels verwenden, um Gebäudebilder zu erkennen.

Sie können mit Ihren benutzerdefinierten Bilddatensätzen beginnen und mit ein paar einfachen Klicks auf der Rekognition Custom Labels-Konsole Ihr Modell trainieren und Objekte in Bildern erkennen. Rekognition Custom Labels können die Daten automatisch laden und prüfen, die richtigen ML-Algorithmen auswählen, ein Modell trainieren und Modellleistungsmetriken bereitstellen. Sie können detaillierte Leistungsmetriken wie Genauigkeit, Erinnerung, F1-Ergebnisse und Vertrauenswerte überprüfen.

Der Tag ist gekommen, an dem wir jetzt beliebte Gebäude wie das Empire State Building in New York City, das Taj Mahal in Indien und viele andere auf der ganzen Welt vorbeschriftet und gebrauchsfertig für intelligente Anwendungen identifizieren können. Aber wenn Sie andere Orientierungspunkte haben, die derzeit noch nicht von Amazon Rekognition Labels unterstützt werden, suchen Sie nicht weiter und probieren Sie Amazon Rekognition Custom Labels aus.

Weitere Informationen zur Verwendung benutzerdefinierter Beschriftungen finden Sie unter Was sind benutzerdefinierte Etiketten von Amazon Rekognition? Besuchen Sie auch unsere GitHub Repo für einen End-to-End-Workflow der benutzerdefinierten Markenerkennung von Amazon Rekognition.

Über die Autoren:

Suresh Patnam ist Principal BDM – GTM AI/ML Leader bei AWS. Er arbeitet mit Kunden zusammen, um eine IT-Strategie zu entwickeln und die digitale Transformation durch die Cloud durch die Nutzung von Data & AI/ML zugänglicher zu machen. In seiner Freizeit spielt Suresh gerne Tennis und verbringt Zeit mit seiner Familie.

Suresh Patnam ist Principal BDM – GTM AI/ML Leader bei AWS. Er arbeitet mit Kunden zusammen, um eine IT-Strategie zu entwickeln und die digitale Transformation durch die Cloud durch die Nutzung von Data & AI/ML zugänglicher zu machen. In seiner Freizeit spielt Suresh gerne Tennis und verbringt Zeit mit seiner Familie.

Häschen Kauschik ist Lösungsarchitekt bei AWS. Er entwickelt leidenschaftlich KI/ML-Lösungen auf AWS und unterstützt Kunden bei Innovationen auf der AWS-Plattform. Außerhalb der Arbeit wandert, klettert und schwimmt er gerne.

Häschen Kauschik ist Lösungsarchitekt bei AWS. Er entwickelt leidenschaftlich KI/ML-Lösungen auf AWS und unterstützt Kunden bei Innovationen auf der AWS-Plattform. Außerhalb der Arbeit wandert, klettert und schwimmt er gerne.

- AI

- Kunst

- KI-Kunstgenerator

- KI-Roboter

- Amazon-Anerkennung

- künstliche Intelligenz

- Zertifizierung für künstliche Intelligenz

- Künstliche Intelligenz im Bankwesen

- Roboter mit künstlicher Intelligenz

- Roboter mit künstlicher Intelligenz

- Software für künstliche Intelligenz

- AWS Maschinelles Lernen

- Blockchain

- Blockchain-Konferenz ai

- Einfallsreichtum

- dialogorientierte künstliche Intelligenz

- Krypto-Konferenz ai

- Dalls

- tiefe Lernen

- Google Ai

- Maschinelles Lernen

- Plato

- platon ai

- Datenintelligenz von Plato

- Plato-Spiel

- PlatoData

- Platogaming

- Skala ai

- Syntax

- Zephyrnet