Forscher entwickeln weiterhin neue Modellarchitekturen für gängige Aufgaben des maschinellen Lernens (ML). Eine solche Aufgabe ist die Bildklassifizierung, bei der Bilder als Eingabe akzeptiert werden und das Modell versucht, das Bild als Ganzes mit Objektkennzeichnungsausgaben zu klassifizieren. Da heute viele Modelle verfügbar sind, die diese Bildklassifizierungsaufgabe erfüllen, kann ein ML-Experte Fragen stellen wie: „Welches Modell sollte ich optimieren und dann einsetzen, um die beste Leistung für meinen Datensatz zu erzielen?“ Und ein ML-Forscher kann Fragen stellen wie: „Wie kann ich meinen eigenen fairen Vergleich mehrerer Modellarchitekturen mit einem bestimmten Datensatz erstellen und gleichzeitig Trainings-Hyperparameter und Computerspezifikationen wie GPUs, CPUs und RAM kontrollieren?“ Die erstere Frage befasst sich mit der Modellauswahl über Modellarchitekturen hinweg, während die letztere Frage das Benchmarking trainierter Modelle mit einem Testdatensatz betrifft.

In diesem Beitrag erfahren Sie, wie die TensorFlow-Bildklassifizierung Algorithmus von Amazon SageMaker-JumpStart kann die Implementierungen vereinfachen, die zur Beantwortung dieser Fragen erforderlich sind. Zusammen mit den Implementierungsdetails in einem entsprechenden Beispiel Jupyter-Notebook, stehen Ihnen Tools zur Modellauswahl zur Verfügung, indem Sie Pareto-Grenzen erkunden, bei denen die Verbesserung einer Leistungsmetrik, z. B. der Genauigkeit, nicht möglich ist, ohne eine andere Metrik, z. B. den Durchsatz, zu verschlechtern.

Lösungsüberblick

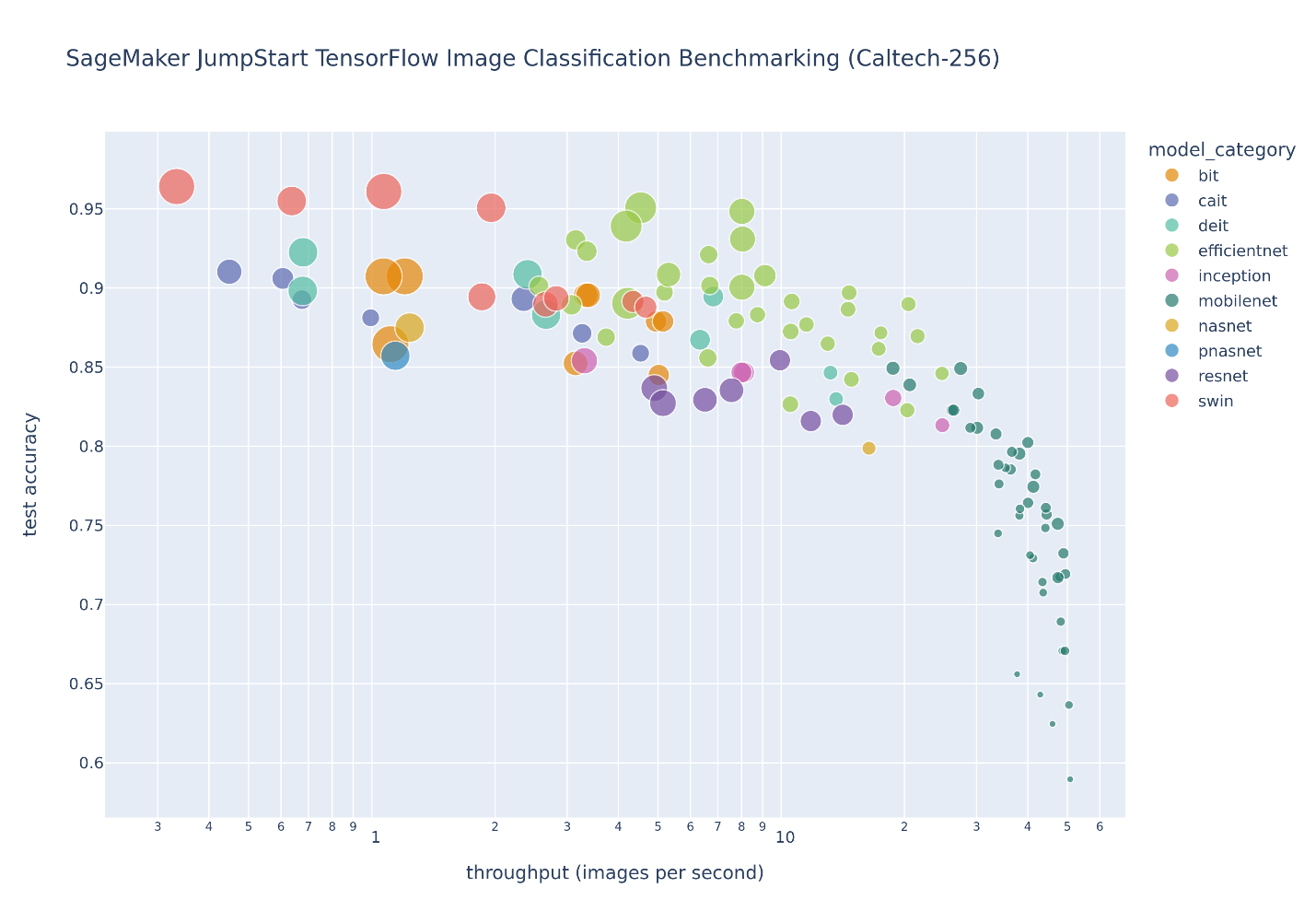

Die folgende Abbildung veranschaulicht den Kompromiss bei der Modellauswahl für eine große Anzahl von Bildklassifizierungsmodellen, die auf dem feinabgestimmt wurden Caltech-256 Datensatz, der ein anspruchsvoller Satz von 30,607 realen Bildern ist, die 256 Objektkategorien umfassen. Jeder Punkt stellt ein einzelnes Modell dar, Punktgrößen werden in Bezug auf die Anzahl der Parameter skaliert, aus denen das Modell besteht, und die Punkte sind basierend auf ihrer Modellarchitektur farbcodiert. Beispielsweise stellen die hellgrünen Punkte die EfficientNet-Architektur dar; Jeder hellgrüne Punkt ist eine andere Konfiguration dieser Architektur mit einzigartigen, fein abgestimmten Modellleistungsmessungen. Die Abbildung zeigt die Existenz einer Pareto-Grenze für die Modellauswahl, bei der eine höhere Genauigkeit gegen einen geringeren Durchsatz eingetauscht wird. Letztendlich hängt die Auswahl eines Modells entlang der Pareto-Grenze oder des Satzes pareto-effizienter Lösungen von den Leistungsanforderungen Ihrer Modellbereitstellung ab.

Wenn Sie interessierende Testgenauigkeits- und Testdurchsatzgrenzen beobachten, wird der Satz von pareto-effizienten Lösungen in der vorherigen Abbildung in der folgenden Tabelle extrahiert. Zeilen werden so sortiert, dass der Testdurchsatz zunimmt und die Testgenauigkeit abnimmt.

| Modell | Anzahl der Parameter | Testgenauigkeit | Test Top 5 Genauigkeit | Durchsatz (Bilder/s) | Dauer pro Epoche(n) |

| swin-large-patch4-window12-384 | 195.6M | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-large-patch4-window7-224 | 195.4M | 96.1% | 99.5% | 1.1 | 698.0 |

| efficiencynet-v2-imagenet21k-ft1k-l | 118.1M | 95.1% | 99.2% | 4.5 | 1434.7 |

| efficiencynet-v2-imagenet21k-ft1k-m | 53.5M | 94.8% | 99.1% | 8.0 | 769.1 |

| efficiencynet-v2-imagenet21k-m | 53.5M | 93.1% | 98.5% | 8.0 | 765.1 |

| effizientnet-b5 | 29.0M | 90.8% | 98.1% | 9.1 | 668.6 |

| efficiencynet-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% | 97.3% | 14.6 | 54.3 |

| efficiencynet-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% | 97.0% | 20.5 | 38.3 |

| efficiencynet-v2-imagenet21k-b0 | 6.2M | 87.0% | 95.6% | 21.5 | 38.2 |

| mobilenet-v3-large-100-224 | 4.6M | 84.9% | 95.4% | 27.4 | 28.8 |

| mobilenet-v3-large-075-224 | 3.1M | 83.3% | 95.2% | 30.3 | 26.6 |

| mobilenet-v2-100-192 | 2.6M | 80.8% | 93.5% | 33.5 | 23.9 |

| mobilenet-v2-100-160 | 2.6M | 80.2% | 93.2% | 40.0 | 19.6 |

| mobilenet-v2-075-160 | 1.7M | 78.2% | 92.8% | 41.8 | 19.3 |

| mobilenet-v2-075-128 | 1.7M | 76.1% | 91.1% | 44.3 | 18.3 |

| mobilenet-v1-075-160 | 2.0M | 75.7% | 91.0% | 44.5 | 18.2 |

| mobilenet-v1-100-128 | 3.5M | 75.1% | 90.7% | 47.4 | 17.4 |

| mobilenet-v1-075-128 | 2.0M | 73.2% | 90.0% | 48.9 | 16.8 |

| mobilenet-v2-075-96 | 1.7M | 71.9% | 88.5% | 49.4 | 16.6 |

| mobilenet-v2-035-96 | 0.7M | 63.7% | 83.1% | 50.4 | 16.3 |

| mobilenet-v1-025-128 | 0.3M | 59.0% | 80.7% | 50.8 | 16.2 |

Dieser Beitrag enthält Details zur Implementierung in großem Maßstab Amazon Sage Maker Benchmarking- und Modellauswahlaufgaben. Zuerst stellen wir JumpStart und die integrierten TensorFlow-Bildklassifizierungsalgorithmen vor. Anschließend diskutieren wir allgemeine Überlegungen zur Implementierung, z. B. Hyperparameterkonfigurationen für JumpStart, Metrikextraktion aus Amazon CloudWatch-Protokolle, und Starten von asynchronen Hyperparameter-Tuning-Jobs. Schließlich behandeln wir die Implementierungsumgebung und Parametrisierung, die zu den pareto-effizienten Lösungen in der vorangehenden Tabelle und Abbildung führen.

Einführung in die JumpStart TensorFlow-Bildklassifizierung

JumpStart bietet mit einem Klick die Feinabstimmung und Bereitstellung einer Vielzahl vortrainierter Modelle für beliebte ML-Aufgaben sowie eine Auswahl an End-to-End-Lösungen, die allgemeine Geschäftsprobleme lösen. Diese Funktionen entlasten jeden Schritt des ML-Prozesses, erleichtern die Entwicklung hochwertiger Modelle und verkürzen die Bereitstellungszeit. Der JumpStart-APIs ermöglichen Ihnen die programmgesteuerte Bereitstellung und Feinabstimmung einer großen Auswahl an vortrainierten Modellen für Ihre eigenen Datensätze.

Der JumpStart-Modellhub bietet Zugriff auf eine große Anzahl von TensorFlow-Bildklassifizierungsmodelle die das Transferlernen und die Feinabstimmung benutzerdefinierter Datensätze ermöglichen. Zum jetzigen Zeitpunkt enthält der JumpStart-Modell-Hub 135 TensorFlow-Bildklassifizierungsmodelle über eine Vielzahl gängiger Modellarchitekturen hinweg TensorFlow-Hub, um Restnetzwerke (ResNet), MobileNet, Effizientes Netz, Beginn, Suchnetzwerke mit neuronaler Architektur (NASNet), Großer Transfer (Bisschen), verschobenes Fenster (Swin) Transformatoren, Klasse-Aufmerksamkeit in Bildtransformatoren (CaiT) und dateneffiziente Bildtransformatoren (DeiT).

Jede Modellarchitektur besteht aus sehr unterschiedlichen internen Strukturen. Beispielsweise verwenden ResNet-Modelle Skip-Verbindungen, um wesentlich tiefere Netzwerke zu ermöglichen, während transformatorbasierte Modelle Selbstaufmerksamkeitsmechanismen verwenden, die die intrinsische Lokalität von Faltungsoperationen zugunsten globalerer Empfangsfelder eliminieren. Zusätzlich zu den vielfältigen Funktionssätzen, die diese unterschiedlichen Strukturen bereitstellen, verfügt jede Modellarchitektur über mehrere Konfigurationen, die die Modellgröße, -form und -komplexität innerhalb dieser Architektur anpassen. Dies führt zu Hunderten einzigartiger Bildklassifizierungsmodelle, die im JumpStart-Modell-Hub verfügbar sind. In Kombination mit integrierten Transferlern- und Inferenzskripten, die viele SageMaker-Funktionen umfassen, ist die JumpStart-API ein großartiger Ausgangspunkt für ML-Praktiker, um schnell mit dem Training und der Bereitstellung von Modellen zu beginnen.

Beziehen auf Transfer Learning für TensorFlow-Bildklassifizierungsmodelle in Amazon SageMaker und die folgende Beispiel Notizbuch um mehr über die SageMaker TensorFlow-Bildklassifizierung zu erfahren, einschließlich der Ausführung von Inferenzen auf einem vortrainierten Modell sowie der Feinabstimmung des vortrainierten Modells auf einem benutzerdefinierten Datensatz.

Überlegungen zur Modellauswahl im großen Maßstab

Die Modellauswahl ist der Prozess der Auswahl des besten Modells aus einer Reihe von Kandidatenmodellen. Dieser Prozess kann auf Modelle desselben Typs mit unterschiedlichen Parametergewichten und auf Modelle unterschiedlicher Typen angewendet werden. Beispiele für die Modellauswahl über Modelle desselben Typs hinweg umfassen das Anpassen desselben Modells mit unterschiedlichen Hyperparametern (z. B. Lernrate) und frühes Stoppen, um eine übermäßige Anpassung von Modellgewichten an den Zugdatensatz zu verhindern. Die Modellauswahl über Modelle verschiedener Typen hinweg umfasst die Auswahl der besten Modellarchitektur (z. B. Swin vs. MobileNet) und die Auswahl der besten Modellkonfigurationen innerhalb einer einzelnen Modellarchitektur (z. B. mobilenet-v1-025-128 vs mobilenet-v3-large-100-224).

Die in diesem Abschnitt skizzierten Überlegungen ermöglichen alle diese Modellauswahlprozesse für einen Validierungsdatensatz.

Wählen Sie Hyperparameterkonfigurationen aus

Die TensorFlow-Bildklassifizierung in JumpStart hat eine große Anzahl von verfügbaren Hyperparameter die das Transfer-Learning-Script-Verhalten einheitlich für alle Modellarchitekturen anpassen können. Diese Hyperparameter beziehen sich auf die Datenerweiterung und -vorverarbeitung, die Optimiererspezifikation, Overfitting-Steuerelemente und trainierbare Schichtindikatoren. Sie werden ermutigt, die Standardwerte dieser Hyperparameter nach Bedarf für Ihre Anwendung anzupassen:

Für diese Analyse und das zugehörige Notizbuch werden alle Hyperparameter mit Ausnahme der Lernrate, der Anzahl der Epochen und der Spezifikation für frühes Stoppen auf Standardwerte gesetzt. Die Lernrate wird als a eingestellt kategorialer Parameter von dem Automatische Modellabstimmung von SageMaker Arbeit. Da jedes Modell eindeutige Standard-Hyperparameterwerte hat, enthält die diskrete Liste möglicher Lernraten die Standard-Lernrate sowie ein Fünftel der Standard-Lernrate. Dadurch werden zwei Trainingsjobs für einen einzelnen Hyperparameter-Tuning-Job gestartet, und der Trainingsjob mit der besten gemeldeten Leistung für das Validierungsdataset wird ausgewählt. Da die Anzahl der Epochen auf 10 festgelegt ist, was größer ist als die standardmäßige Hyperparametereinstellung, entspricht der ausgewählte beste Trainingsjob nicht immer der standardmäßigen Lernrate. Schließlich wird ein frühes Beendigungskriterium mit einer Geduld oder der Anzahl von Epochen zum Fortsetzen des Trainings ohne Verbesserung von drei Epochen verwendet.

Eine Standard-Hyperparametereinstellung von besonderer Bedeutung ist train_only_on_top_layer, wo, wenn gesetzt True, sind die Feature-Extraktions-Layer des Modells nicht auf das bereitgestellte Trainings-Dataset abgestimmt. Der Optimierer trainiert nur Parameter in der obersten vollständig verbundenen Klassifizierungsschicht mit einer Ausgabedimensionalität, die der Anzahl der Klassenbezeichnungen im Datensatz entspricht. Standardmäßig ist dieser Hyperparameter auf eingestellt True, eine Einstellung, die auf das Transferlernen bei kleinen Datensätzen abzielt. Möglicherweise verfügen Sie über einen benutzerdefinierten Datensatz, bei dem die Merkmalsextraktion aus dem Vortraining des ImageNet-Datensatzes nicht ausreicht. In diesen Fällen sollten Sie einstellen train_only_on_top_layer zu False. Obwohl diese Einstellung die Trainingszeit verlängert, extrahieren Sie aussagekräftigere Merkmale für Ihr interessierendes Problem, wodurch die Genauigkeit erhöht wird.

Extrahieren Sie Metriken aus CloudWatch Logs

Der JumpStart TensorFlow-Bildklassifizierungsalgorithmus protokolliert während des Trainings zuverlässig eine Vielzahl von Metriken, auf die SageMaker zugreifen kann Estimator und HyperparameterTuner-Objekte. Der Konstruktor eines SageMaker Estimator hat eine metric_definitions Schlüsselwortargument, das zur Bewertung des Trainingsjobs verwendet werden kann, indem eine Liste von Wörterbüchern mit zwei Schlüsseln bereitgestellt wird: Name für den Namen der Metrik und Regex für den regulären Ausdruck, der zum Extrahieren der Metrik aus den Protokollen verwendet wird. Das begleitende Notizbuch zeigt die Implementierungsdetails. Die folgende Tabelle listet die verfügbaren Metriken und zugehörigen regulären Ausdrücke für alle JumpStart TensorFlow-Bildklassifizierungsmodelle auf.

| Metrikname | Regulärer Ausdruck |

| Anzahl Parameter | „- Parameteranzahl: ([0-9\.]+)“ |

| Anzahl trainierbarer Parameter | „- Anzahl trainierbarer Parameter: ([0-9\.]+)“ |

| Anzahl nicht trainierbarer Parameter | „- Anzahl nicht trainierbarer Parameter: ([0-9\.]+)“ |

| Datensatzmetrik trainieren | f”- {metrisch}: ([0-9\.]+)” |

| Validierungs-Dataset-Metrik | f”- val_{metrisch}: ([0-9\.]+)” |

| Testdatensatz-Metrik | f”- Test {Metrik}: ([0-9\.]+)” |

| Zugdauer | „- Gesamttrainingsdauer: ([0-9\.]+)“ |

| Zugdauer pro Epoche | „- Durchschnittliche Trainingsdauer pro Epoche: ([0-9\.]+)“ |

| Testauswertungslatenz | „- Testauswertungslatenz: ([0-9\.]+)“ |

| Testlatenz pro Sample | „- Durchschnittliche Testlatenz pro Sample: ([0-9\.]+)“ |

| Testdurchsatz | „- Durchschnittlicher Testdurchsatz: ([0-9\.]+)“ |

Das integrierte Transfer-Lernskript bietet eine Vielzahl von Trainings-, Validierungs- und Testdatensatzmetriken innerhalb dieser Definitionen, wie durch die F-String-Ersatzwerte dargestellt. Die genauen verfügbaren Metriken variieren je nach Art der durchgeführten Klassifizierung. Alle kompilierten Modelle haben eine loss Metrik, die durch einen Kreuzentropieverlust für entweder ein binäres oder ein kategorisches Klassifizierungsproblem dargestellt wird. Ersteres wird verwendet, wenn es eine Klassenbezeichnung gibt; Letzteres wird verwendet, wenn es zwei oder mehr Klassenbezeichnungen gibt. Wenn es nur eine einzige Klassenbezeichnung gibt, werden die folgenden Metriken berechnet, protokolliert und können über die regulären F-String-Ausdrücke in der vorhergehenden Tabelle extrahiert werden: Anzahl der True-Positives (true_pos), Anzahl der Fehlalarme (false_pos), Anzahl richtig negativer (true_neg), Anzahl falsch negativer Ergebnisse (false_neg), precision, recall, Fläche unter der Receiver Operating Characteristic (ROC)-Kurve (auc) und Fläche unter der Precision-Recall (PR)-Kurve (prc). Ebenso wird bei sechs oder mehr Klassenlabels ein Top-5-Genauigkeitsmesswert (top_5_accuracy) kann auch über die vorangehenden regulären Ausdrücke berechnet, protokolliert und extrahiert werden.

Während des Trainings werden Metriken für einen SageMaker angegeben Estimator werden an CloudWatch Logs ausgegeben. Wenn das Training abgeschlossen ist, können Sie die aufrufen SageMaker DescribeTrainingJob-API und inspizieren Sie die FinalMetricDataList Geben Sie die JSON-Antwort ein:

Diese API erfordert nur die Bereitstellung des Jobnamens für die Abfrage, sodass Metriken nach Abschluss in zukünftigen Analysen abgerufen werden können, solange der Name des Trainingsjobs entsprechend protokolliert und wiederherstellbar ist. Für diese Modellauswahlaufgabe werden Hyperparameter-Tuning-Job-Namen gespeichert und nachfolgende Analysen wieder angehängt a HyperparameterTuner Objekt mit dem Tuning-Job-Namen, extrahieren Sie den besten Trainings-Job-Namen aus dem angehängten Hyperparameter-Tuner und rufen Sie dann das auf DescribeTrainingJob API wie zuvor beschrieben, um Metriken zu erhalten, die dem besten Trainingsjob zugeordnet sind.

Starten Sie asynchrone Hyperparameter-Tuning-Jobs

Siehe entsprechendes Notizbuch für Implementierungsdetails zum asynchronen Starten von Hyperparameter-Tuning-Jobs, die die Python-Standardbibliothek verwenden gleichzeitige Futures -Modul, eine High-Level-Schnittstelle für asynchron ausgeführte Callables. In dieser Lösung sind mehrere SageMaker-bezogene Überlegungen implementiert:

- Jedes AWS-Konto ist mit verbunden SageMaker-Dienstkontingente. Sie sollten Ihre aktuellen Limits anzeigen, um Ihre Ressourcen voll auszuschöpfen, und gegebenenfalls eine Erhöhung der Ressourcenlimits nach Bedarf anfordern.

- Häufige API-Aufrufe zum Erstellen vieler gleichzeitiger Hyperparameter-Tuning-Jobs können die Python-SDK-Rate überschreiten und Drosselungsausnahmen auslösen. Eine Lösung hierfür besteht darin, einen SageMaker Boto3-Client mit einer benutzerdefinierten Wiederholungskonfiguration zu erstellen.

- Was passiert, wenn Ihr Skript auf einen Fehler stößt oder das Skript vor der Fertigstellung gestoppt wird? Für eine so große Modellauswahl oder Benchmarking-Studie können Sie Tuning-Auftragsnamen protokollieren und Komfortfunktionen bereitstellen Hyperparameter-Tuning-Jobs neu anhängen die es schon gibt:

Analysedetails und Diskussion

Die Analyse in diesem Beitrag führt Transferlernen durch für Modell-IDs im JumpStart TensorFlow-Bildklassifizierungsalgorithmus auf dem Caltech-256-Datensatz. Alle Trainingsjobs wurden auf der SageMaker-Trainingsinstanz ml.g4dn.xlarge ausgeführt, die eine einzelne NVIDIA T4-GPU enthält.

Der Testdatensatz wird am Ende des Trainings auf der Trainingsinstanz ausgewertet. Die Modellauswahl wird vor der Auswertung des Testdatensatzes durchgeführt, um die Modellgewichtungen auf die Epoche mit der besten Leistung des Validierungssatzes festzulegen. Der Testdurchsatz ist nicht optimiert: Die Dataset-Batchgröße ist auf die Standard-Batchgröße für Trainings-Hyperparameter festgelegt, die nicht angepasst wird, um die GPU-Speicherauslastung zu maximieren; der gemeldete Testdurchsatz beinhaltet die Datenladezeit, da das Dataset nicht vorab zwischengespeichert wird; und verteilte Inferenz über mehrere GPUs wird nicht verwendet. Aus diesen Gründen ist dieser Durchsatz ein gutes relatives Maß, aber der tatsächliche Durchsatz hängt stark von Ihren Inferenzendpunkt-Bereitstellungskonfigurationen für das trainierte Modell ab.

Obwohl der JumpStart-Modellhub viele Bildklassifizierungsarchitekturtypen enthält, wird diese Pareto-Grenze von ausgewählten Swin-, EfficientNet- und MobileNet-Modellen dominiert. Swin-Modelle sind größer und relativ genauer, während MobileNet-Modelle kleiner, relativ weniger genau und für Ressourcenbeschränkungen von Mobilgeräten geeignet sind. Es ist wichtig zu beachten, dass diese Grenze von einer Vielzahl von Faktoren abhängt, einschließlich des genauen verwendeten Datensatzes und der ausgewählten Hyperparameter zur Feinabstimmung. Möglicherweise stellen Sie fest, dass Ihr benutzerdefiniertes Dataset einen anderen Satz pareto-effizienter Lösungen erzeugt, und Sie wünschen sich möglicherweise längere Trainingszeiten mit anderen Hyperparametern, z. B. mehr Datenerweiterung oder Feinabstimmung von mehr als nur der obersten Klassifizierungsebene des Modells.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Sie umfangreiche Modellauswahl- oder Benchmarking-Aufgaben mithilfe des JumpStart-Modellhubs ausführen. Diese Lösung kann Ihnen helfen, das beste Modell für Ihre Bedürfnisse auszuwählen. Wir empfehlen Ihnen, dies auszuprobieren und zu erkunden Lösung auf Ihrem eigenen Datensatz.

Bibliographie

Weitere Informationen finden Sie in den folgenden Ressourcen:

Über die Autoren

Kyle Ulrich ist Angewandte Wissenschaftlerin bei der Integrierte Amazon SageMaker-Algorithmen Team. Seine Forschungsinteressen umfassen skalierbare Algorithmen für maschinelles Lernen, Computer Vision, Zeitreihen, bayessche nichtparametrische Verfahren und Gaußsche Prozesse. Er hat an der Duke University promoviert und Artikel in NeurIPS, Cell und Neuron veröffentlicht.

Kyle Ulrich ist Angewandte Wissenschaftlerin bei der Integrierte Amazon SageMaker-Algorithmen Team. Seine Forschungsinteressen umfassen skalierbare Algorithmen für maschinelles Lernen, Computer Vision, Zeitreihen, bayessche nichtparametrische Verfahren und Gaußsche Prozesse. Er hat an der Duke University promoviert und Artikel in NeurIPS, Cell und Neuron veröffentlicht.

Dr. Ashish Khetan ist Senior Applied Scientist mit Integrierte Amazon SageMaker-Algorithmen und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana Champaign. Er ist ein aktiver Forscher auf dem Gebiet des maschinellen Lernens und der statistischen Inferenz und hat viele Artikel auf den Konferenzen NeurIPS, ICML, ICLR, JMLR, ACL und EMNLP veröffentlicht.

Dr. Ashish Khetan ist Senior Applied Scientist mit Integrierte Amazon SageMaker-Algorithmen und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana Champaign. Er ist ein aktiver Forscher auf dem Gebiet des maschinellen Lernens und der statistischen Inferenz und hat viele Artikel auf den Konferenzen NeurIPS, ICML, ICLR, JMLR, ACL und EMNLP veröffentlicht.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- LiveBuzz

- Zugang

- zugänglich

- Konto

- Genauigkeit

- genau

- Erreichen

- über

- aktiv

- Zusatz

- Adresse

- Adressen

- Bereinigt

- Verbunden

- gegen

- Algorithmus

- Algorithmen

- Alle

- bereits

- Obwohl

- immer

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Analysen

- Analyse

- und

- Ein anderer

- Bienen

- Anwendung

- angewandt

- passend

- Architektur

- Bereich

- Argument

- damit verbundenen

- anhängen

- Versuche

- automatische

- verfügbar

- durchschnittlich

- AWS

- basierend

- Bayesianisch

- weil

- Bevor

- Sein

- Benchmarking

- BESTE

- Big

- eingebaut

- Geschäft

- Aufrufe

- Kandidat

- Fälle

- Kategorien

- herausfordernd

- Merkmal

- Auswählen

- Klasse

- Einstufung

- klassifizieren

- Auftraggeber

- kombiniert

- gemeinsam

- Vergleich

- abschließen

- Abgeschlossene Verkäufe

- Abschluss

- Komplexität

- Computer

- Computer Vision

- Bedenken

- Kongressbegleitung

- Konfiguration

- Sie

- Verbindungen

- Überlegungen

- Einschränkungen

- enthält

- fortsetzen

- Regelung

- Steuerung

- sehr beliebtes Sprach- und Freizeitprogramm

- Dazugehörigen

- Abdeckung

- erstellen

- Strom

- Kurve

- Original

- technische Daten

- Datensätze

- tiefer

- Standard

- hängt

- einsetzen

- Bereitstellen

- Einsatz

- Tiefe

- beschrieben

- Beschreibung

- Details

- entwickeln

- Geräte

- anders

- diskutieren

- verteilt

- verschieden

- Tut nicht

- Herzog

- Duke University

- im

- jeder

- Früher

- Früh

- einfacher

- effizient

- entweder

- beseitigen

- ermöglichen

- ermutigen

- ermutigt

- End-to-End

- Endpunkt

- Arbeitsumfeld

- Epoche

- Epochen

- Fehler

- bewerten

- Bewerten

- Auswertung

- Beispiel

- Beispiele

- Außer

- ERKUNDEN

- Möglichkeiten sondieren

- Ausdrücke

- Extrakt

- Faktoren

- Messe

- Favor

- Merkmal

- Eigenschaften

- Felder

- Abbildung

- Endlich

- Finden Sie

- Vorname

- passend zu

- Folgende

- Früher

- für

- Grenze

- Frontiers

- voll

- Funktionen

- Zukunft

- Futures

- erzeugen

- bekommen

- gegeben

- Global

- gut

- GPU

- GPUs

- groß

- mehr

- Grün

- das passiert

- schwer

- Hilfe

- hilft

- High-Level

- hochwertige

- höher

- Ultraschall

- Hilfe

- HTML

- HTTPS

- Nabe

- hunderte

- Hyperparameter-Tuning

- Illinois

- Image

- Bildklassifizierung

- Bilder

- implementieren

- Implementierung

- umgesetzt

- Bedeutung

- wichtig

- Verbesserung

- Verbesserung

- in

- das

- Dazu gehören

- Einschließlich

- Erhöhung

- Steigert

- zunehmend

- Anzeigen

- Information

- Varianten des Eingangssignals:

- Instanz

- Interesse

- Interessen

- Schnittstelle

- intern

- innere

- einführen

- IT

- Job

- Jobs

- JSON

- Wesentliche

- Tasten

- Label

- Etiketten

- grosse

- großflächig

- größer

- Latency

- startet

- Start

- Schicht

- Lagen

- führenden

- LERNEN

- lernen

- Facelift

- !

- LIMIT

- Grenzen

- Liste

- Listen

- Laden

- Lang

- länger

- Verlust

- Maschine

- Maschinelles Lernen

- Making

- viele

- Maximieren

- sinnvoll

- Messungen

- Memory

- Metrisch

- Metrik

- ML

- Mobil

- mobile Geräte

- Modell

- für

- Modul

- mehr

- mehrere

- Name

- Namen

- notwendig,

- Bedürfnisse

- Netzwerke

- Neu

- Notizbuch

- Anzahl

- Nvidia

- Objekt

- Objekte

- beobachten

- erhalten

- erhalten

- EINEM

- die

- Einkauf & Prozesse

- optimiert

- skizzierte

- besitzen

- Papiere

- Parameter

- Parameter

- besondere

- Geduld ist eine Tugend

- Ausführen

- Leistung

- führt

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Punkte

- Beliebt

- möglich

- Post

- möglicherweise

- pr

- verhindern

- Vor

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- anpassen

- die

- vorausgesetzt

- bietet

- Bereitstellung

- veröffentlicht

- Python

- Frage

- Fragen

- schnell

- RAM

- Bewerten

- Honorar

- realen Welt

- Gründe

- Reduzierung

- regulär

- verhältnismäßig

- entfernen

- Berichtet

- vertreten

- vertreten

- representiert

- Anforderung

- falls angefordert

- Voraussetzungen:

- erfordert

- Forschungsprojekte

- Forscher

- Auflösung

- Ressourcen

- Downloads

- Antwort

- Die Ergebnisse

- Führen Sie

- Laufen

- sagemaker

- gleich

- skalierbaren

- Wissenschaftler

- Skripte

- Sdk

- Suche

- Abschnitt

- ausgewählt

- Auswahl

- Auswahl

- Senior

- Modellreihe

- Sitzung

- kompensieren

- Sets

- Einstellung

- mehrere

- Form

- sollte

- Konzerte

- Ähnlich

- vereinfachen

- Single

- SIX

- Größe

- Größen

- klein

- kleinere

- So

- Lösung

- Lösungen

- LÖSEN

- Spezifikation

- Spezifikationen

- angegeben

- Standard

- begonnen

- statistisch

- Schritt

- gestoppt

- Einstellung

- gelagert

- Studie

- Folge

- so

- ausreichend

- geeignet

- Tabelle

- gezielt

- Aufgabe

- und Aufgaben

- Team

- Tensorfluss

- Test

- Das

- ihr

- damit

- nach drei

- Durchsatz

- Zeit

- Zeitfolgen

- mal

- zu

- heute

- gemeinsam

- Werkzeuge

- Top

- top 5

- Gesamt

- Training

- trainiert

- Ausbildung

- privaten Transfer

- Transformer

- was immer dies auch sein sollte.

- Typen

- Letztlich

- für

- einzigartiges

- Universität

- Anwendungsbereich

- -

- Nutzen

- seit

- Bestätigung

- Werte

- Vielfalt

- riesig

- Anzeigen

- Seh-

- welche

- während

- ganze

- breit

- werden wir

- .

- ohne

- würde

- Schreiben

- Du

- Ihr

- Zephyrnet