Tämän vierasviestin ovat kirjoittaneet Vihan Lakshman, Tharun Medini ja Anshumali Shrivastava ThirdAI:sta.

Laajamittainen syväoppiminen on viime aikoina tuottanut vallankumouksellisia edistysaskeleita monilla aloilla. Vaikka tämä tekoälyn hämmästyttävä edistys on edelleen huomattava, näiden mallien kouluttamiseen vaadittavat taloudelliset kustannukset ja energiankulutus ovat nousseet kriittiseksi pullonkaulaksi, koska tarvitaan erikoislaitteita, kuten GPU:ita. Perinteisesti vaatimattoman kokoisetkin hermomallit ovat vaatineet koulutukseen kalliita laitteistokiihdyttimiä, mikä rajoittaa niiden organisaatioiden määrää, joilla on taloudelliset mahdollisuudet hyödyntää tätä teknologiaa täysimääräisesti.

Vuonna 2021 perustettu ThirdAI Corp. on startup-yritys, jonka tehtävänä on demokratisoida tekoälyteknologiaa algoritmien ja ohjelmistoinnovaatioiden avulla, jotka muuttavat perusteellisesti syvän oppimisen taloutta. Olemme kehittäneet harvan syvän oppimismoottorin, joka tunnetaan nimellä BOLT, joka on suunniteltu erityisesti koulutukseen ja mallien käyttöönottoon tavallisilla prosessorilaitteistoilla verrattuna kalliisiin ja energiaa kuluttaviin kiihdyttimiin, kuten GPU:ihin. Monilla asiakkaistamme on ilmoitti olevansa erittäin tyytyväinen ThirdAI:n kyvyllä kouluttaa ja ottaa käyttöön syväoppimismalleja kriittisiin liiketoimintaongelmiin kustannustehokkaassa suoritininfrastruktuurissa.

Tässä viestissä tutkimme AWS Graviton3 -prosessorin mahdollisuuksia nopeuttaa hermoverkkojen koulutusta ThirdAI:n ainutlaatuiselle prosessoripohjaiselle syväoppimismoottorille.

Suorituskykyisten suorittimien edut

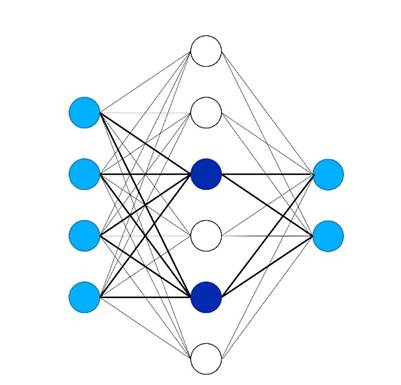

ThirdAI:ssa saavutamme nämä läpimurrot tehokkaassa hermoverkkokoulutuksessa prosessoreilla patentoitujen dynaamisten harvalukuisten algoritmien avulla, jotka aktivoivat vain osan neuroneista tietylle syötteelle (katso seuraava kuva), mikä sivuuttaa täyden tiheän laskennan tarpeen. Toisin kuin muut lähestymistavat harvaan hermoverkkokoulutukseen, ThirdAI käyttää paikkaherkkä hajautus valitaksesi dynaamisesti neuronit tietylle syötteelle, kuten alla olevissa lihavoituissa riveissä näkyy. Joissain tapauksissa olemme jopa havainneet, että meidän harvassa CPU-pohjaisissa malleissa harjoitella nopeammin kuin vastaava tiheä arkkitehtuuri GPU:illa.

Koska monet kohdeasiakkaamme toimivat pilvessä – ja heistä suurin osa käyttää AWS:ää – olimme innoissamme voidessamme kokeilla AWS Graviton3 -prosessoria nähdäksemme, voisivatko Amazonin piiinnovaatioiden vaikuttavat hinta-suorituskykyparannukset muuttaa ainutlaatuiseksi työmäärämme. harvaan neuroverkkokoulutukseen ja tuovat siten lisäsäästöjä asiakkaille. Vaikka sekä tutkimusyhteisö että AWS Graviton -tiimi ovat tuottaneet jännittäviä edistysaskeleita kiihdyttämisessä neuroverkkopäätelmä CPU-instanssien osalta me ThirdAI:lla olemme tietojemme mukaan ensimmäisiä, jotka tutkivat vakavasti, kuinka tehokkaasti kouluttaa hermomalleja suorittimissa.

Kuten tuloksistamme näkyy, havaitsimme AWS Graviton3:lla merkittävän harjoittelun nopeutumisen verrattuna vastaaviin Intel- ja NVIDIA-instanssiin useilla edustavilla mallinnustyökuormilla.

Ilmentymien tyypit

Arvioimme kahta vertailukelpoista AWS-suoritinesiintymää: c6i.8xlarge-konetta, joka toimii Intelin Ice Lake -prosessorilla, ja c7g.8xlarge-konetta, jonka teho on AWS Graviton3. Seuraavassa taulukossa on yhteenveto kunkin esiintymän yksityiskohdista.

| Ilmentymä | vCPU | RAM (GB) | Suoritin | On-demand -hinta (us-itä-1) |

| c7g.8xsuuri | 32 | 64 | AWS Graviton 3 | $ 1.1562 / h |

| c6i.8xlarge | 32 | 64 | Intel Ice Lake | $ 1.36 / h |

| g5g.8xlarge (GPU) | 32 | 64 16 Gt GPU-muistilla | AWS Graviton2 -prosessorit 1 NVIDIA T4G GPU:lla | $ 1.3720 / h |

Arviointi 1: Äärimmäinen luokitus

Ensimmäisessä arvioinnissamme keskitymme äärimmäisen monimerkkiluokituksen (XMC) ongelmaan, joka on yhä suositumpi koneoppimisen (ML) paradigma, jossa on useita käytännön sovelluksia haussa ja suosituksissa (mukaan lukien Amazon). Keskitymme arvioinnissamme yleisöön Amazon-670K tuotesuositustehtävä, joka syöttötuotteen perusteella tunnistaa samanlaisia tuotteita yli 670,000 XNUMX tuotteen kokoelmasta.

Tässä kokeilussa vertaamme ThirdAI:n BOLT-moottoria TensorFlow 2.11:een ja PyTorch 2.0:aan edellä mainituilla laitteistovalinnoilla: Intel Ice Lake, AWS Graviton3 ja NVIDIA T4G GPU. Intel- ja AWS Graviton -kokeiluissamme käytämme AWS Deep Learning AMI (Ubuntu 18.04) -versiota 59.0. Grafiikkasuorittimen arvioinnissa käytämme NVIDIA GPU-optimoitu Arm64 AMI, saatavilla AWS Marketplacen kautta. Tätä arviointia varten käytämme SLIDE-mallin arkkitehtuuri, joka saavuttaa sekä kilpailukykyisen suorituskyvyn tässä äärimmäisessä luokittelutehtävässä että vahvan koulutussuorituskyvyn suorittimissa. TensorFlow- ja PyTorch-vertailuissamme toteutamme SLIDE-monikerroksisen perceptron-arkkitehtuurin (MLP) analogisen version tiheillä matriisikertoloilla. Koulutamme kutakin mallia viiden aikakauden ajan (täysi läpikulku koulutustietojoukon läpi) kiinteällä eräkoolla 256 ja oppimisnopeudella 0.001. Havaitsimme, että kaikki mallit saavuttivat saman 33.6 prosentin testitarkkuuden.

Seuraavassa kaaviossa verrataan ThirdAI:n BOLTin harjoitusaikaa TensorFlow 2.11:een ja PyTorch 2.0:aan Amazon670k:n äärimmäisen luokituksen vertailuarvolla. Kaikki mallit saavuttavat saman testitarkkuuden. Huomaamme, että AWS Graviton3 nopeuttaa huomattavasti BOLTin suorituskykyä ilman räätälöintiä – noin 40 %. ThirdAI:n BOLT AWS Graviton3:ssa saavuttaa myös huomattavasti nopeamman harjoittelun kuin GPU:lla koulutetut TensorFlow- tai PyTorch-mallit. Huomaa, että NVIDIA GPU-vertailussa ei ole ThirdAI-tulosta, koska BOLT on suunniteltu toimimaan suorittimissa. Emme sisällytä TensorFlow- ja PyTorch-suorittimen vertailuarvoja kohtuuttoman pitkän harjoitusajan vuoksi.

Seuraavassa taulukossa on yhteenveto kunkin prosessorin/erikoissuorittimen (GPU) harjoitusajasta ja testitarkkuudesta.

| Suoritin | Moottori | Harjoitusaika (s) | Testin tarkkuus |

| Intel Ice Lake (c6i.8xlarge) | BOLT | 1470 | 33.6 |

| AWS Graviton3 (c7g.8xlarge) | BOLT | 935 | 33.6 |

| NVIDIA T4G (g5g.8xlarge) | TensorFlow | 7550 | 33.6 |

| NVIDIA T4G (g5g.8xlarge) | PyTorch | 5130 | 33.6 |

Arviointi 2: Yelp Polariteettisentimenttianalyysi

Toisessa arvioinnissamme keskitymme suosituimpiin Yelp-napaisuus mielialan analyysin vertailuarvo, joka sisältää arvostelun luokittelun positiiviseksi tai negatiiviseksi. Tätä arviointia varten vertaamme ThirdAI:ta Universal Deep Transformers (UDT) mallia hienosäädettyä vastaan DistilBERT verkko, pakattu esiopetettu kielimalli, joka saavuttaa lähes huipputason suorituskyvyn pienemmällä päättelyviiveellä. Koska DistilBERT-mallien hienosäätö suorittimella kestäisi kohtuuttoman kauan (ainakin useita päiviä), vertaamme ThirdAI:n prosessoripohjaisia malleja GPU:lla hienosäädettyyn DistilBERTiin. Koulutamme kaikki mallit, joiden eräkoko on 256, yhden tiedon läpikulkua varten (yksi aikakausi). Huomaamme, että voimme saavuttaa hieman suuremman tarkkuuden BOLTilla, kun tietoja on lisätty, mutta rajoitamme tässä arvioinnissa yhteen läpimenoon johdonmukaisuuden vuoksi.

Kuten seuraavasta kuvasta näkyy, AWS Graviton3 nopeuttaa jälleen ThirdAI:n UDT-mallin harjoittelua huomattavasti. Lisäksi UDT pystyy saavuttamaan DistilBERTiin verrattavan testitarkkuuden murto-osalla harjoitusajasta ja ilman GPU:ta. Huomaa, että myös viime aikoina on tehty töitä optimoida hienosäätö Yelp Polarity prosessoreissa. Mallillamme saavutetaan kuitenkin yhä suurempi tehokkuushyöty ja vältytään esikoulutuksesta, joka on huomattava ja vaatii laitteistokiihdyttimien, kuten GPU:iden, käyttöä.

Seuraavassa taulukossa on yhteenveto harjoitusajasta, testin tarkkuudesta ja päättelyviiveestä.

| Suoritin | Moottori | Malli | Harjoitusaika (s) | Testin tarkkuus | Päätelmäviive (ms) |

| Intel Icelake (c6i.8xlarge) | BOLT | UDT | 47 | 93.2 | <1 |

| Graviton3 (c7g.8xlarge) | BOLT | UDT | 29 | 92.9 | <1 |

| T4G GPU (g5g.8xlarge) | TensorFlow | DistilBERT | 4200 | 93.3 | 8.7 |

| T4G GPU (g5g.8xlarge) | PyTorch | DistilBERT | 3780 | 93.4 | 8.3 |

Arviointi 3: Moniluokkainen tekstiluokitus (DBPedia)

Loppuarvioinnissa keskitymme moniluokkaisen tekstin luokittelun ongelmaan, joka sisältää tunnisteen osoittamisen tietylle syöttötekstille useammasta kuin kahdesta tulosluokista. Keskitymme siihen DBPedia benchmark, joka koostuu 14 mahdollisesta tulosluokasta. Näemme jälleen, että AWS Graviton3 nopeuttaa UDT-suorituskykyä verrattuna vastaavaan Intel-instanssiin noin 40%. Näemme myös, että BOLT saavuttaa vertailukelpoisia tuloksia DistilBERT-muuntajapohjaiseen malliin, joka on hienosäädetty GPU:lla, samalla kun se saavuttaa alle millisekunnin latenssin.

Seuraavassa taulukossa on yhteenveto harjoitusajasta, testin tarkkuudesta ja päättelyviiveestä.

| Suoritin | Moottori | Malli | Harjoitusaika (s) | Testin tarkkuus | Päätelmäviive (ms) |

| Intel Icelake (c6i.8xlarge) | BOLT | UDT | 23 | 98.23 | <1 |

| Graviton3 (c7g.8xlarge) | BOLT | UDT | 14 | 98.10 | <1 |

| T4G GPU (g5g.8xlarge) | TensorFlow | DistilBERT | 4320 | 99.23 | 8.6 |

| T4G GPU (g5g.8xlarge) | PyTorch | DistilBERT | 3480 | 99.29 | 8 |

Aloita ThirdAI:n käyttö AWS Gravitonissa

Olemme suunnitelleet BOLT-ohjelmistomme yhteensopivaksi kaikkien tärkeimpien suoritinarkkitehtuurien kanssa, mukaan lukien AWS Graviton3. Itse asiassa meidän ei tarvinnut tehdä mitään mukautuksia koodiimme toimiaksemme AWS Graviton3:ssa. Siksi voit käyttää ThirdAI:ta mallin koulutukseen ja käyttöönottoon AWS Graviton3:ssa ilman lisäponnistuksia. Lisäksi, kuten on kuvattu viimeaikaisessa tutkimusraportti, olemme kehittäneet joukon uusia matemaattisia tekniikoita säätämään automaattisesti harvaan malleihimme liittyvät erikoistuneet hyperparametrit, jolloin mallimme toimivat hyvin heti laatikosta otettuna.

Huomaa myös, että mallimme toimivat ensisijaisesti hyvin haku-, suositus- ja luonnollisen kielen prosessointitehtävissä, joissa on tyypillisesti suuria, suuriulotteisia tulostiloja ja vaatimus erittäin alhaisesta päättelyviiveestä. Työskentelemme aktiivisesti laajentaaksemme menetelmiämme muihin alueisiin, kuten tietokonenäköön, mutta huomaa, että tehokkuuden parannukset eivät tällä hetkellä käänny kaikille ML-alueille.

Yhteenveto

Tässä viestissä tutkimme AWS Graviton3 -prosessorin mahdollisuuksia nopeuttaa hermoverkkojen koulutusta ThirdAI:n ainutlaatuiselle prosessoripohjaiselle syväoppimismoottorille. Haun, tekstin luokittelun ja suositusten vertailuarvomme viittaavat siihen, että AWS Graviton3 voi nopeuttaa ThirdAI:n mallin koulutustyökuormitusta 30–40 % verrattuna vastaaviin x86-esiintymiin, ja hinta-suorituskyky paranee lähes 50 %. Lisäksi, koska AWS Graviton3 -esiintymät ovat saatavilla halvemmalla kuin analogiset Intel- ja NVIDIA-koneet ja mahdollistavat lyhyemmät koulutus- ja päättelyajat, voit edelleen vapauttaa AWS:n pay-as-you-go -käyttömallin arvoa käyttämällä halvempia kustannuksia. koneita lyhyemmäksi ajaksi.

Olemme erittäin innoissamme AWS Graviton3:n hinnan ja suorituskyvyn säästöistä ja pyrimme välittämään nämä parannukset asiakkaillemme, jotta he voivat nauttia nopeammasta ML-koulutuksesta ja johtopäätöksistä paremman suorituskyvyn ansiosta edullisissa prosessoreissa. Itse AWS:n asiakkaina olemme iloisia nopeudesta, jolla AWS Graviton3 antaa meille mahdollisuuden kokeilla mallejamme, ja odotamme innolla AWS:n huippuluokan piiinnovaatioiden käyttöä jatkossa. Gravitonin tekninen opas on hyvä resurssi, joka kannattaa ottaa huomioon arvioitaessa ML-työkuormia Gravitonissa. Voit myös kokeilla Graviton t4g -esiintymiä ilmainen kokeilu.

Tämän viestin sisältö ja mielipiteet ovat kolmannen osapuolen kirjoittajan omia, eikä AWS ole vastuussa tämän viestin sisällöstä tai tarkkuudesta. Blogia kirjoitettaessa uusin esiintymä oli c6i, joten vertailu tehtiin c6i-instanssien kanssa.

kirjailijasta

Vihan Lakshman – Vihan Lakshman on ThirdAI Corp.:n tutkija, joka keskittyy resurssitehokkaan syväoppimisen järjestelmien kehittämiseen. Ennen ThirdAI:ta hän työskenteli soveltavana tutkijana Amazonissa ja suoritti perustutkinto- ja maisterintutkinnot Stanfordin yliopistosta. Vihan on myös saanut National Science Foundationin tutkimusapurahaa.

Tharun Medini – Tharun Medini on yksi ThirdAI Corp.:n perustajista ja teknologiajohtaja. Hän väitteli tohtorintutkinnon aiheesta "Hashing Algorithms for Search and Information Retrieval" Ricen yliopistossa. Ennen ThirdAI:ta Tharun työskenteli Amazonilla ja Targetilla. Tharun on saanut lukuisia palkintoja tutkimuksestaan, mukaan lukien Ken Kennedy Institute BP Fellowship, American Society of Indian Engineers Scholarship ja Rice University Graduate Fellowship.

Anshumali Shrivastava – Anshumali Shrivastava on apulaisprofessori Rice Universityn tietojenkäsittelytieteen laitoksella. Hän on myös ThirdAI Corp -yrityksen perustaja ja toimitusjohtaja, yritys, joka demokratisoi tekoälyä hyödykelaitteistoiksi ohjelmistoinnovaatioiden avulla. Hänen laajoihin tutkimusintresseihinsä kuuluvat todennäköisyyspohjaiset algoritmit resursseja säästävään syväoppimiseen. Vuonna 2018 Science News nimesi hänet yhdeksi 10 parhaan alle 40-vuotiaan tutkijan joukosta. Hän on saanut National Science Foundation CAREER Award -palkinnon, Young Investigator Awardin Air Force Office of Scientific Research -palkinnon, koneoppimisen tutkimuspalkinnon Amazonilta ja Data Science Research Award -palkinnon Adobelta. Hän on voittanut lukuisia paperipalkintoja, mukaan lukien Best Paper Awards -palkinnot NIPS 2014:ssä ja MLSys 2022:ssa sekä eniten toistettavissa oleva paperi -palkinnon SIGMOD 2019 -tapahtumassa. Hänen työstään suorittimien tehokkaiden koneoppimistekniikoiden parissa on käsitelty suosituissa lehdissä, kuten Wall Street Journalissa, New York Times, TechCrunch, NDTV jne.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/accelerating-large-scale-neural-network-training-on-cpus-with-thirdai-and-aws-graviton/

- :on

- :On

- :ei

- 000

- 001

- 1

- 11

- 14

- 16

- 2014

- 2018

- 2019

- 2021

- 2022

- 33

- 385

- 40

- 7

- a

- kyky

- pystyy

- kiihdyttää

- kiihdyttää

- kiihtyvä

- kiihdyttimiä

- tarkkuus

- Saavuttaa

- saavutettu

- päästään

- saavuttamisessa

- aktivoida

- aktiivisesti

- Lisäksi

- lisä-

- Adobe

- ennakot

- Etu

- uudelleen

- vastaan

- AI

- AIR

- Ilmavoimat

- algoritmi

- algoritmit

- Kaikki

- Salliminen

- mahdollistaa

- Myös

- Vaikka

- Amazon

- Amazon Web Services

- Amerikkalainen

- keskuudessa

- an

- analyysi

- ja

- Kaikki

- sovellukset

- sovellettu

- lähestymistavat

- suunnilleen

- arkkitehtuuri

- arkkitehtuurit

- OVAT

- Ryhmä

- keinotekoinen

- tekoäly

- AS

- Työtoveri

- liittyvä

- At

- kirjoittaja

- automaattisesti

- saatavissa

- välttää

- palkinto

- palkinnot

- tietoinen

- AWS

- AWS Marketplace

- baari

- BE

- koska

- ollut

- alle

- benchmark

- Viitearvot

- Hyödyt

- PARAS

- Uutiset ja media

- tappi

- Pultti

- sekä

- pullonkaula

- Laatikko

- BP

- läpimurtoja

- laaja

- liiketoiminta

- mutta

- by

- CAN

- Ura

- tapauksissa

- toimitusjohtaja

- tietty

- muuttaa

- Kaavio

- valintoja

- luokat

- luokittelu

- Perustaja

- koodi

- kokoelma

- hyödyke

- yhteisö

- yritys

- vertailukelpoinen

- verrata

- vertaamalla

- vertailu

- vertailuja

- yhteensopivuus

- kilpailukykyinen

- laskelmat

- tietokone

- Tietojenkäsittelyoppi

- Tietokoneen visio

- Harkita

- harkittu

- muodostuu

- kulutus

- pitoisuus

- Corp

- Hinta

- kustannustehokas

- kallis

- kustannukset

- katettu

- kriittinen

- CTO

- Nykyinen

- Asiakkaat

- leikkaamisreuna

- tiedot

- tietojenkäsittely

- päivää

- omistautunut

- syvä

- syvä oppiminen

- iloinen

- toimitettu

- Democratizing

- osasto

- sijoittaa

- levityspinnalta

- käyttöönotto

- suunniteltu

- yksityiskohtainen

- yksityiskohdat

- kehitetty

- kehittämällä

- DID

- do

- verkkotunnuksia

- tehty

- kaksi

- dynaaminen

- dynaamisesti

- kukin

- Taloustiede

- tehokkuus

- tehokas

- tehokkaasti

- vaivaa

- syntyi

- mahdollistaa

- energia

- Energian kulutus

- Moottori

- Engineers

- nauttia

- aikakausi

- aikakausia

- jne.

- arviointiin

- arviointi

- Jopa

- innoissaan

- jännittävä

- kokeilu

- kokeiluja

- ulottuu

- äärimmäinen

- erittäin

- tosiasia

- nopeampi

- Ominaisuus

- Fields

- Kuva

- lopullinen

- taloudellinen

- Etunimi

- viisi

- kiinteä

- Keskittää

- keskityttiin

- jälkeen

- varten

- voima

- Eteenpäin

- perusta

- perustaja

- Perustaja ja toimitusjohtaja

- jae

- alkaen

- koko

- pohjimmiltaan

- edelleen

- Lisäksi

- voitto

- gif

- tietty

- menee

- hyvä

- GPU

- GPU

- valmistua

- suurempi

- vieras

- vieras Lähetä

- Palvelimet

- Olla

- he

- siten

- korkea suorituskyky

- korkeampi

- häntä

- hänen

- Miten

- Miten

- Kuitenkin

- http

- HTTPS

- ICE

- tunnistaa

- if

- heti

- toteuttaa

- vaikuttava

- parani

- parannus

- parannuksia

- in

- sisältää

- Mukaan lukien

- yhä useammin

- intialainen

- tiedot

- Infrastruktuuri

- Innovaatio

- innovaatiot

- panos

- esimerkki

- Instituutti

- Intel

- Älykkyys

- etu

- tutkia

- liittyy

- kohdetta

- päiväkirja

- jpg

- tuntemus

- tunnettu

- Merkki

- järvi

- Kieli

- suuri

- laaja

- Viive

- oppiminen

- vähiten

- pitää

- rajat

- linjat

- Pitkät

- pitkä aika

- katso

- Matala

- edullisia

- alentaa

- kone

- koneoppiminen

- Koneet

- merkittävä

- Enemmistö

- tehdä

- monet

- markkinat

- maisterin

- matemaattinen

- Matriisi

- välineet

- menetelmät

- Tehtävä

- ML

- malli

- mallintaminen

- mallit

- lisää

- eniten

- MS

- kertolaskuja

- nimetty

- kansallinen

- Kansallinen tiede

- Luonnollinen

- Luonnollinen kielen käsittely

- lähes

- Tarve

- negatiivinen

- verkko

- hermo-

- neuroverkkomallien

- neuronien

- Uusi

- New York

- New York Times

- uutiset

- Nro

- huomata

- romaani

- numero

- useat

- Nvidia

- tarkkailla

- of

- Office

- on

- ONE

- vain

- käyttää

- Lausunnot

- vastakkainen

- or

- organisaatioiden

- Muut

- meidän

- itse

- ulos

- ulostulo

- yli

- Paperi

- paradigma

- kulkea

- kulkee

- suorituskyky

- phd

- Platon

- Platonin tietotieto

- PlatonData

- Suosittu

- positiivinen

- mahdollinen

- Kirje

- mahdollinen

- powered

- Käytännön

- Tarkkuus

- painaa

- hinta

- pääasiallisesti

- Aikaisempi

- Ongelma

- ongelmia

- käsittely

- Suoritin

- prosessorit

- valmistettu

- Tuotteet

- Tuotteemme

- Opettaja

- Edistyminen

- patentoitu

- toimittaa

- julkinen

- pytorch

- hinta

- äskettäinen

- äskettäin

- Suositus

- suosituksia

- Vähentynyt

- jäännökset

- huomattava

- edustaja

- tarvitaan

- vaatimus

- Vaatii

- tutkimus

- resurssi

- vastuullinen

- rajoittaa

- johtua

- tulokset

- arviot

- vallankumouksellinen

- Riisi

- karkeasti

- ajaa

- s

- sama

- Säästöt

- tiede

- Tiedesäätiö

- tieteellinen

- Tiedemies

- tutkijat

- Haku

- Toinen

- nähdä

- valita

- valittu

- näkemys

- vakavasti

- Palvelut

- setti

- useat

- näyttää

- esitetty

- merkittävä

- Pii

- samankaltainen

- single

- Koko

- kokoinen

- SLIDE

- So

- yhteiskunta

- Tuotteemme

- tilat

- erikoistunut

- erityisesti

- nopeus

- standardi

- Stanford

- Stanfordin yliopisto

- alkoi

- käynnistyksen

- Yhä

- katu

- vahva

- tutkimus

- Upea

- merkittävä

- niin

- ehdottaa

- järjestelmät

- taulukko

- ottaa

- Kohde

- Tehtävä

- tehtävät

- joukkue-

- TechCrunch

- Tekninen

- tekniikat

- Technologies

- Elektroniikka

- tensorflow

- testi

- teksti

- Tekstiluokitus

- kuin

- että

- -

- Siellä.

- siten

- siksi

- Nämä

- ne

- kolmannen osapuolen

- tätä

- ne

- Kautta

- aika

- kertaa

- että

- perinteisesti

- Juna

- koulutettu

- koulutus

- muuntajat

- Kääntää

- yrittää

- virittää

- kaksi

- tyypillisesti

- Ubuntu

- varten

- unique

- yliopisto

- toisin kuin

- avata

- us

- Käyttö

- käyttää

- käyttötarkoituksiin

- käyttämällä

- arvo

- valtava

- versio

- hyvin

- kautta

- visio

- vs

- Seinä

- Wall Street

- Wall Street Journal

- oli

- Katso

- we

- verkko

- verkkopalvelut

- HYVIN

- olivat

- joka

- vaikka

- wikipedia

- tulee

- with

- ilman

- Voitetut

- Referenssit

- työskenteli

- työskentely

- olisi

- kirjoittaminen

- kirjallinen

- york

- Voit

- nuori

- Sinun

- zephyrnet