OpenAI Whisper on edistynyt automaattinen puheentunnistuksen (ASR) malli MIT-lisenssillä. ASR-teknologiasta on hyötyä transkriptiopalveluissa, ääniavusteissa ja kuulovammaisten henkilöiden saavutettavuuden parantamisessa. Tämä huippuluokan malli on koulutettu laajalle ja monipuoliselle tietojoukolle, joka sisältää verkosta kerättyä monikielistä ja moniajoista valvottua dataa. Sen korkea tarkkuus ja mukautumiskyky tekevät siitä arvokkaan voimavaran monenlaisiin puhetehtäviin.

Koneoppimisen ja tekoälyn jatkuvasti kehittyvässä maisemassa Amazon Sage Maker tarjoaa kattavan ekosysteemin. SageMaker antaa tietotieteilijöille, kehittäjille ja organisaatioille mahdollisuuden kehittää, kouluttaa, ottaa käyttöön ja hallita koneoppimismalleja mittakaavassa. Se tarjoaa laajan valikoiman työkaluja ja ominaisuuksia, ja se yksinkertaistaa koko koneoppimisen työnkulkua tietojen esikäsittelystä ja mallinkehityksestä vaivattomaan käyttöönottoon ja valvontaan. SageMakerin käyttäjäystävällinen käyttöliittymä tekee siitä keskeisen alustan tekoälyn täyden potentiaalin vapauttamiselle ja tekee siitä pelin muuttavan ratkaisun tekoälyn alueella.

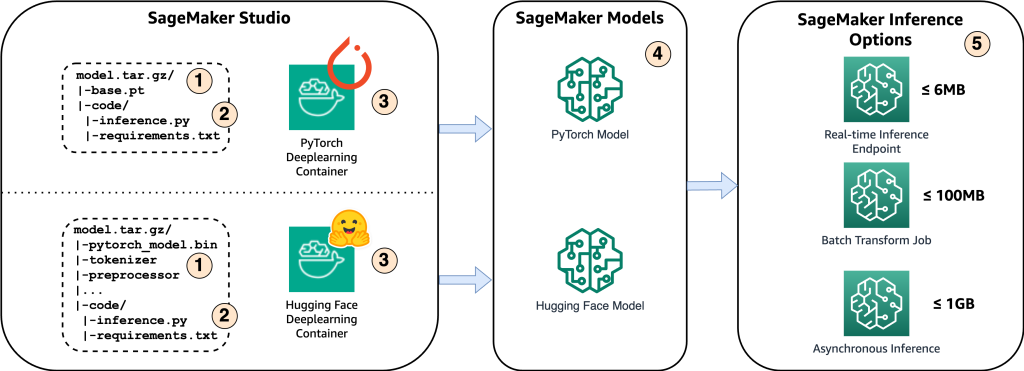

Tässä viestissä ryhdymme SageMakerin ominaisuuksien tutkimiseen keskittyen erityisesti Whisper-mallien isännöintiin. Sukellaan syvälle kahteen tapaan tehdä tämä: toinen käyttää Whisper PyTorch -mallia ja toinen käyttää Whisper-mallin Hugging Face -toteutusta. Lisäksi tutkimme perusteellisesti SageMakerin päättelyvaihtoehtoja ja vertaamme niitä eri parametrien, kuten nopeuden, kustannusten, hyötykuorman koon ja skaalautuvuuden, välillä. Tämä analyysi antaa käyttäjille mahdollisuuden tehdä tietoisia päätöksiä, kun he integroivat Whisper-malleja erityisiin käyttötapauksiinsa ja järjestelmiinsä.

Ratkaisun yleiskatsaus

Seuraava kaavio esittää tämän ratkaisun pääkomponentit.

- Jotta malli voidaan isännöidä Amazon SageMakerissa, ensimmäinen askel on tallentaa mallin esineet. Nämä artefaktit viittaavat koneoppimismallin olennaisiin osiin, joita tarvitaan eri sovelluksissa, mukaan lukien käyttöönotto ja uudelleenkoulutus. Ne voivat sisältää malliparametreja, määritystiedostoja, esikäsittelykomponentteja sekä metatietoja, kuten versiotiedot, tekijän ja kaikki sen suorituskykyyn liittyvät huomautukset. On tärkeää huomata, että PyTorch- ja Hugging Face -toteutusten Whisper-mallit koostuvat erilaisista malliartefakteista.

- Seuraavaksi luomme mukautettuja päättelykomentosarjat. Näissä skripteissä määritämme kuinka malli ladataan ja määritämme päättelyprosessin. Täällä voimme myös sisällyttää mukautettuja parametreja tarpeen mukaan. Lisäksi voit luetella tarvittavat Python-paketit kohdassa a

requirements.txttiedosto. Mallin käyttöönoton aikana nämä Python-paketit asennetaan automaattisesti alustusvaiheessa. - Sitten valitsemme joko PyTorch- tai Hugging Face -syvät oppimissäiliöt (DLC), joita tarjoaa ja ylläpitää AWS. Nämä säilöt ovat valmiiksi rakennettuja Docker-kuvia, joissa on syvä oppimiskehys ja muut tarvittavat Python-paketit. Jos haluat lisätietoja, voit tarkistaa tämän linkkiä.

- Mallin artefaktien, mukautettujen päättelykomentosarjojen ja valittujen DLC:iden avulla luomme Amazon SageMaker -malleja PyTorchille ja Hugging Facelle.

- Lopuksi mallit voidaan ottaa käyttöön SageMakerissa ja käyttää seuraavien vaihtoehtojen kanssa: reaaliaikaiset päättelypäätepisteet, erämuunnostyöt ja asynkroniset päättelypäätepisteet. Sukellaan näihin vaihtoehtoihin tarkemmin myöhemmin tässä viestissä.

Tämän ratkaisun esimerkkimuistikirja ja koodi ovat saatavilla tästä GitHub-arkisto.

Kuva 1. Yleiskatsaus ratkaisun tärkeimpiin osiin

Walkthrough

Whisper-mallin isännöinti Amazon SageMakerissa

Tässä osiossa selitämme vaiheet Whisper-mallin isännöimiseksi Amazon SageMakerissa käyttämällä PyTorchia ja Hugging Face Frameworksia. Tämän ratkaisun kokeilemiseksi tarvitset AWS-tilin ja pääsyn Amazon SageMaker -palveluun.

PyTorch-kehys

- Tallenna malliesineet

Ensimmäinen mallin isännöintivaihtoehto on käyttää Whisper virallinen Python-paketti, joka voidaan asentaa käyttämällä pip install openai-whisper. Tämä paketti tarjoaa PyTorch-mallin. Kun tallennat mallin artefakteja paikalliseen arkistoon, ensimmäinen askel on tallentaa mallin opittavat parametrit, kuten mallin painot ja kunkin hermoverkon kerroksen biasit, "pt"-tiedostona. Voit valita eri mallikoista, mukaan lukien "pieni", "perus", "pieni", "keskikokoinen" ja "suuri". Suuremmat mallikoot tarjoavat paremman tarkkuuden, mutta niiden hintana on pidempi päättelyviive. Lisäksi sinun on tallennettava mallin tilasanakirja ja ulottuvuussanakirja, jotka sisältävät Python-sanakirjan, joka kartoittaa PyTorch-mallin jokaisen kerroksen tai parametrin sen vastaaviin opittaviin parametreihin, muiden metatietojen ja mukautettujen kokoonpanojen kanssa. Alla oleva koodi näyttää, kuinka Whisper PyTorch -artefaktit tallennetaan.

- Valitse DLC

Seuraava vaihe on valita valmiiksi rakennettu DLC tästä linkkiä. Ole varovainen valitessasi oikean kuvan ottamalla huomioon seuraavat asetukset: kehys (PyTorch), kehysversio, tehtävä (päätelmä), Python-versio ja laitteisto (eli GPU). On suositeltavaa käyttää viitekehyksen ja Pythonin uusimpia versioita aina kun mahdollista, koska tämä parantaa suorituskykyä ja korjaa aiempien julkaisujen tunnetut ongelmat ja bugit.

- Luo Amazon SageMaker -malleja

Seuraavaksi hyödynnämme SageMaker Python SDK PyTorch-mallien luomiseen. PyTorch-mallia luotaessa on tärkeää muistaa lisätä ympäristömuuttujia. Oletusarvoisesti TorchServe voi käsitellä enintään 6 Mt:n tiedostokokoja käytetystä päättelytyypistä riippumatta.

Seuraava taulukko näyttää asetukset eri PyTorch-versioille:

| Puitteet | Ympäristömuuttujat |

| PyTorch 1.8 (perustuu TorchServeen) | "TS_MAX_REQUEST_SIZE": "100000000"" TS_MAX_RESPONSE_SIZE": "100000000"" TS_DEFAULT_RESPONSE_TIMEOUT": "1000" |

| PyTorch 1.4 (pohjainen MMS) | "MMS_MAX_REQUEST_SIZE": "1000000000"" MMS_MAX_RESPONSE_SIZE": "1000000000"" MMS_DEFAULT_RESPONSE_TIMEOUT": "900" |

- Määritä mallin latausmenetelmä tiedostossa inference.py

Tavassa inference.py script, tarkistamme ensin CUDA-yhteensopivan GPU:n saatavuuden. Jos tällainen GPU on saatavilla, määritämme sen 'cuda' laitteen DEVICE muuttuva; muussa tapauksessa määritämme 'cpu' laite. Tämä vaihe varmistaa, että malli sijoitetaan käytettävissä olevaan laitteistoon tehokkaan laskennan varmistamiseksi. Lataamme PyTorch-mallin käyttämällä Whisper Python -pakettia.

Hugging Face -kehys

- Tallenna malliesineet

Toinen vaihtoehto on käyttää Hugging Face's Whisper toteutus. Malli voidaan ladata käyttämällä AutoModelForSpeechSeq2Seq muuntajaluokka. Opittavat parametrit tallennetaan binääritiedostoon (bin) käyttämällä save_pretrained menetelmä. Tokenizer ja esiprosessori on myös tallennettava erikseen, jotta Hugging Face -malli toimii oikein. Vaihtoehtoisesti voit ottaa mallin käyttöön Amazon SageMakerissa suoraan Hugging Face Hubista asettamalla kaksi ympäristömuuttujaa: HF_MODEL_ID ja HF_TASK. Lisätietoja saat tästä verkkosivu.

- Valitse DLC

PyTorch-kehyksen tapaan voit valita valmiiksi rakennetun Hugging Face DLC:n samasta linkkiä. Varmista, että valitset DLC:n, joka tukee uusimpia Hugging Face -muuntajia ja sisältää GPU-tuen.

- Luo Amazon SageMaker -malleja

Vastaavasti hyödynnämme SageMaker Python SDK luodaksesi Hugging Face -malleja. Hugging Face Whisper -mallissa on oletusrajoitus, jossa se pystyy käsittelemään vain enintään 30 sekuntia kestäviä äänisegmenttejä. Voit korjata tämän rajoituksen sisällyttämällä chunk_length_s -parametri ympäristömuuttujassa, kun luot Hugging Face -mallia, ja siirrä tämä parametri myöhemmin mukautettuun päättelykomentosarjaan mallia ladattaessa. Aseta lopuksi ympäristömuuttujat lisäämään hyötykuorman kokoa ja vasteaikakatkaisua Hugging Face -säilön osalta.

| Puitteet | Ympäristömuuttujat |

|

HuggingFace Inference Container (MMS:n perusteella) |

"MMS_MAX_REQUEST_SIZE": "2000000000"" MMS_MAX_RESPONSE_SIZE": "2000000000"" MMS_DEFAULT_RESPONSE_TIMEOUT": "900" |

- Määritä mallin latausmenetelmä tiedostossa inference.py

Kun luomme mukautettua päättelykomentosarjaa Hugging Face -mallille, käytämme liukuhihnaa, jonka avulla voimme välittää chunk_length_s parametrina. Tämän parametrin avulla malli pystyy käsittelemään tehokkaasti pitkiä äänitiedostoja päättelyn aikana.

Erilaisten päättelyvaihtoehtojen tutkiminen Amazon SageMakerissa

Päättelyvaihtoehtojen valinnan vaiheet ovat samat sekä PyTorch- että Hugging Face -malleissa, joten emme tee eroa niiden välillä alla. On kuitenkin syytä huomata, että tätä viestiä kirjoitettaessa palvelimeton johtopäätös SageMakerin vaihtoehto ei tue GPU:ita, ja siksi jätämme tämän vaihtoehdon pois tässä käyttötapauksessa.

Voimme ottaa mallin käyttöön reaaliaikaisena päätepisteenä, joka tarjoaa vastaukset millisekunneissa. On kuitenkin tärkeää huomata, että tämä vaihtoehto on rajoitettu alle 6 Mt:n tulojen käsittelyyn. Määrittelemme serialisaattorin audioserialisoijaksi, joka on vastuussa syötetietojen muuntamisesta käytettävälle mallille sopivaan muotoon. Käytämme GPU-instanssia päättelyyn, mikä mahdollistaa äänitiedostojen nopeutetun käsittelyn. Päätelmätulo on äänitiedosto, joka on peräisin paikallisesta arkistosta.

Toinen päättelyvaihtoehto on erämuunnostyö, joka pystyy käsittelemään syötettäviä hyötykuormia jopa 100 megatavuun asti. Tämä menetelmä voi kuitenkin kestää muutaman minuutin viiveen. Kukin esiintymä voi käsitellä vain yhden eräpyynnön kerrallaan, ja ilmentymän aloitus ja sammutus vievät myös muutaman minuutin. Päättelytulokset tallennetaan Amazon Simple Storage Service -palveluun (Amazon S3) ämpäri erämuunnostyön päätyttyä.

Kun määrität erämuuntajaa, muista sisällyttää se max_payload = 100 käsitellä suurempia hyötykuormia tehokkaasti. Päätelmäsyötteen tulee olla Amazon S3 -polku äänitiedostoon tai Amazon S3 Bucket -kansioon, joka sisältää luettelon äänitiedostoista, joiden kunkin koko on alle 100 Mt.

Erämuunnos osittaa syötteessä olevat Amazon S3 -objektit avaimella ja kartoittaa Amazon S3 -objektit ilmentymiin. Jos sinulla on esimerkiksi useita äänitiedostoja, yksi ilmentymä saattaa käsitellä input1.wav-tiedostoa ja toinen ilmentymä saattaa käsitellä tiedostoa nimeltä input2.wav skaalautuvuuden parantamiseksi. Erämuunnos antaa sinun määrittää max_concurrent_transforms lisätä jokaiselle yksittäiselle muuntajasäiliölle tehtyjen HTTP-pyyntöjen määrää. On kuitenkin tärkeää huomata, että arvo (max_concurrent_transforms* max_payload) ei saa ylittää 100 Mt.

Lopuksi Amazon SageMaker Asynchronous Inference on ihanteellinen useiden pyyntöjen käsittelyyn samanaikaisesti. Se tarjoaa kohtuullisen viiveen ja tukee jopa 1 Gt:n syöttökuormia. Tämä vaihtoehto tarjoaa erinomaisen skaalautuvuuden, mikä mahdollistaa päätepisteen automaattisen skaalausryhmän määrittämisen. Kun pyyntöjen määrä lisääntyy, se skaalautuu automaattisesti käsittelemään liikennettä, ja kun kaikki pyynnöt on käsitelty, päätepiste skaalautuu nollaan kustannusten säästämiseksi.

Asynkronisen päättelyn avulla tulokset tallennetaan automaattisesti Amazon S3 -ämpäriin. Vuonna AsyncInferenceConfig, voit määrittää ilmoitukset onnistuneista tai epäonnistuneista suorituksista. Syöttöpolku osoittaa äänitiedoston Amazon S3 -sijaintiin. Katso lisätietoja koodista osoitteessa GitHub.

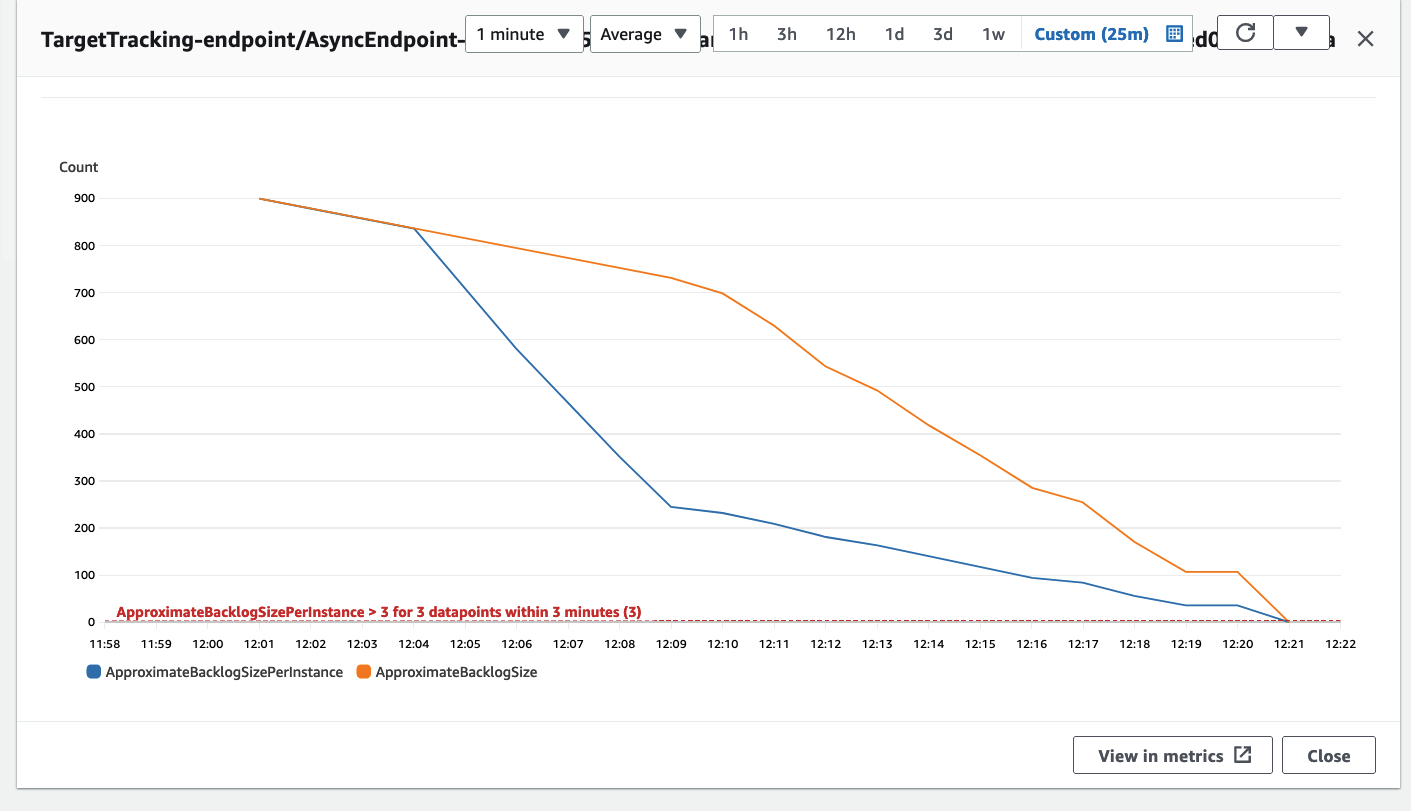

Valinnainen: Kuten aiemmin mainittiin, meillä on mahdollisuus määrittää automaattinen skaalausryhmä asynkroniselle päättelypäätepisteelle, jonka avulla se voi käsitellä äkillisen päättelypyyntöjen nousun. Tässä on esimerkki koodista GitHub-arkisto. Seuraavassa kaaviossa voit tarkkailla viivakaaviota, jossa näkyy kaksi mittaria amazonin pilvikello: ApproximateBacklogSize ja ApproximateBacklogSizePerInstance. Aluksi, kun 1000 pyyntöä käynnistettiin, vain yksi ilmentymä oli käytettävissä päättelyn käsittelemiseksi. Kolmen minuutin ajan ruuhkan koko ylitti johdonmukaisesti kolme (huomaa, että nämä luvut voidaan määrittää), ja automaattinen skaalausryhmä vastasi käynnistämällä lisäesiintymiä ruuhkan poistamiseksi tehokkaasti. Tämä johti merkittävään laskuun ApproximateBacklogSizePerInstance, mikä mahdollistaa ruuhkapyyntöjen käsittelyn paljon nopeammin kuin alkuvaiheessa.

Kuva 2. Viivakaavio, joka havainnollistaa Amazon CloudWatch -mittareiden ajallisia muutoksia

Vertaileva analyysi johtopäätösvaihtoehdoista

Eri päättelyvaihtoehtojen vertailut perustuvat yleisiin äänenkäsittelyn käyttötapauksiin. Reaaliaikainen päättely tarjoaa nopeimman päättelynopeuden, mutta rajoittaa hyötykuorman koon 6 megatavuun. Tämä päättelytyyppi sopii äänikomentojärjestelmiin, joissa käyttäjät ohjaavat laitteita tai ohjelmistoja tai ovat vuorovaikutuksessa niiden kanssa äänikomentojen tai puheohjeiden avulla. Äänikomennot ovat tyypillisesti pienikokoisia, ja alhainen päättelyviive on ratkaisevan tärkeä sen varmistamiseksi, että transkriptoidut komennot voivat käynnistää myöhempiä toimintoja. Erämuunnos on ihanteellinen ajoitettuihin offline-tehtäviin, kun jokaisen äänitiedoston koko on alle 100 Mt, eikä nopeille päätelmien vasteajoille ole erityisiä vaatimuksia. Asynkroninen päättely mahdollistaa jopa 1 Gt:n lataukset ja tarjoaa kohtuullisen päättelyviiveen. Tämä päättelytyyppi sopii hyvin elokuvien, TV-sarjojen ja tallennettujen konferenssien transkriptioon, joissa on käsiteltävä suurempia äänitiedostoja.

Sekä reaaliaikaiset että asynkroniset päättelyvaihtoehdot tarjoavat automaattisen skaalauksen, jolloin päätepisteet voivat skaalata automaattisesti ylös tai alas pyyntöjen määrän perusteella. Tapauksissa, joissa ei ole pyyntöjä, automaattinen skaalaus poistaa tarpeettomat esiintymät, mikä auttaa sinua välttämään kustannuksia, jotka liittyvät valmiisiin esiintymiin, jotka eivät ole aktiivisesti käytössä. Reaaliaikaista päättelyä varten on kuitenkin säilytettävä vähintään yksi pysyvä esiintymä, mikä voi johtaa korkeampiin kustannuksiin, jos päätepiste toimii jatkuvasti. Sitä vastoin asynkroninen päättely mahdollistaa ilmentymän äänenvoimakkuuden pienentämisen nollaan, kun sitä ei käytetä. Kun määrität erämuunnostyötä, on mahdollista käyttää useita esiintymiä työn käsittelemiseen ja säätää max_concurrent_transforms-arvoa, jotta yksi ilmentymä voi käsitellä useita pyyntöjä. Siksi kaikki kolme päättelyvaihtoehtoa tarjoavat erinomaisen skaalautuvuuden.

Puhdistaa

Kun olet käyttänyt ratkaisua loppuun, poista SageMaker-päätepisteet lisäkustannusten välttämiseksi. Voit käyttää toimitettua koodia reaaliaikaisten ja asynkronisten päätepisteiden poistamiseen.

Yhteenveto

Tässä viestissä näytimme sinulle, kuinka koneoppimismallien käyttöönotosta äänenkäsittelyssä on tullut yhä tärkeämpää eri toimialoilla. Whisper-mallin esimerkkinä osoitimme kuinka isännöidä avoimen lähdekoodin ASR-malleja Amazon SageMakerissa käyttämällä PyTorch- tai Hugging Face -lähestymistapoja. Tutkimus sisälsi useita Amazon SageMakerin päättelyvaihtoehtoja, jotka tarjosivat oivalluksia äänidatan tehokkaaseen käsittelyyn, ennusteiden tekemiseen ja kustannusten tehokkaaseen hallintaan. Tämän postauksen tarkoituksena on tarjota tietoa tutkijoille, kehittäjille ja datatieteilijöille, jotka ovat kiinnostuneita Whisper-mallin hyödyntämisestä ääneen liittyvissä tehtävissä ja tietoon perustuvien päätösten tekemisestä päättelystrategioista.

Lisätietoja mallien käyttöönotosta SageMakerissa on tässä Kehittäjän opas. Lisäksi Whisper-malli voidaan ottaa käyttöön SageMaker JumpStartin avulla. Jos haluat lisätietoja, tarkista ystävällisesti Whisper-mallit automaattista puheentunnistusta varten ovat nyt saatavilla Amazon SageMaker JumpStartissa lähettää.

Voit vapaasti tutustua tämän projektin muistikirjaan ja koodiin GitHub ja jaa kommenttisi kanssamme.

kirjailijasta

Ying Hou, tohtori, on AWS:n koneoppimisen prototyyppiarkkitehti. Hänen ensisijaisia kiinnostuksen kohteitaan ovat Deep Learning, joka keskittyy GenAI:hen, Computer Visioniin, NLP:hen ja aikasarjatietojen ennustamiseen. Vapaa-ajallaan hän viettää laadukkaita hetkiä perheensä kanssa, uppoutuu romaaneihin ja vaeltelee Ison-Britannian kansallispuistoissa.

Ying Hou, tohtori, on AWS:n koneoppimisen prototyyppiarkkitehti. Hänen ensisijaisia kiinnostuksen kohteitaan ovat Deep Learning, joka keskittyy GenAI:hen, Computer Visioniin, NLP:hen ja aikasarjatietojen ennustamiseen. Vapaa-ajallaan hän viettää laadukkaita hetkiä perheensä kanssa, uppoutuu romaaneihin ja vaeltelee Ison-Britannian kansallispuistoissa.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/host-the-whisper-model-on-amazon-sagemaker-exploring-inference-options/

- :on

- :On

- :ei

- :missä

- $ YLÖS

- 1

- 10

- 100

- 12

- 14

- 140

- 16

- 19

- 30

- 32

- 7

- 8

- 900

- a

- kiihtyi

- pääsy

- saavutettavuus

- Tili

- tarkkuus

- poikki

- toimet

- aktiivisesti

- lisätä

- lisä-

- Lisäksi

- osoite

- kehittynyt

- AI

- tavoitteet

- Kaikki

- Salliminen

- mahdollistaa

- pitkin

- Myös

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- analyysi

- ja

- Toinen

- Kaikki

- sovellukset

- lähestymistavat

- OVAT

- alueet

- Ryhmä

- keinotekoinen

- tekoäly

- AS

- etu

- avustajat

- liittyvä

- At

- audio-

- Authorship

- automaattisesti

- automaattisesti

- saatavuus

- saatavissa

- välttää

- AWS

- pohja

- perustua

- BE

- tulevat

- alle

- Paremmin

- välillä

- harhat

- BIN

- sekä

- Bugs

- mutta

- by

- CAN

- kyvyt

- kykenee

- varovainen

- tapauksissa

- Muutokset

- Kaavio

- tarkastaa

- Valita

- valita

- luokka

- selkeä

- koodi

- Tulla

- kommentti

- Yhteinen

- vertaamalla

- vertailuja

- Valmistunut

- valmistuminen

- osat

- kattava

- laskeminen

- tietokone

- Tietokoneen visio

- Suorittaa

- konferenssit

- Konfigurointi

- määritetty

- konfigurointi

- ottaen huomioon

- johdonmukaisesti

- sisältää

- Kontti

- Kontit

- jatkuvasti

- kontrasti

- ohjaus

- muuntaminen

- korjata

- vastaava

- Hinta

- kustannukset

- voisi

- luoda

- Luominen

- ratkaiseva

- asiakassuhde

- tiedot

- päätökset

- vähentää

- syvä

- syvä oppiminen

- oletusarvo

- määritellä

- osoittivat

- sijoittaa

- käyttöön

- levityspinnalta

- käyttöönotto

- yksityiskohta

- yksityiskohtainen

- yksityiskohdat

- kehittää

- kehittäjille

- Kehitys

- laite

- Laitteet

- eri

- eriyttää

- Ulottuvuus

- suoraan

- näyttämällä

- sukellus

- useat

- Satamatyöläinen

- ei

- tekee

- alas

- aikana

- e

- kukin

- Aikaisemmin

- ekosysteemi

- tehokkaasti

- tehokas

- tehokkaasti

- vaivaton

- myöskään

- muu

- Lähde

- valtuutetaan

- mahdollistaa

- mahdollistaa

- mahdollistaa

- käsittää

- sisältyvät

- päätepiste

- parantaa

- parantaa

- varmistaa

- varmistaa

- Koko

- ympäristö

- olennainen

- perustamisesta

- esimerkki

- ylittää

- ylitetty

- erinomainen

- kokeilu

- Selittää

- tutkimus

- Tutkiminen

- Kasvot

- Epäonnistui

- väärä

- perhe

- FAST

- nopeampi

- nopein

- harvat

- filee

- Asiakirjat

- löydöt

- Etunimi

- Keskittää

- tarkennus

- jälkeen

- varten

- muoto

- Puitteet

- puitteet

- Ilmainen

- alkaen

- koko

- GPU

- GPU

- suuri

- Ryhmä

- kahva

- Käsittely

- Palvelimet

- Olla

- kuulo

- auttaa

- hänen

- Korkea

- korkeampi

- isäntä

- hotellit

- Miten

- Miten

- Kuitenkin

- HTML

- http

- HTTPS

- Napa

- HalaaKasvot

- i

- ihanteellinen

- if

- havainnollistaa

- kuva

- kuvien

- täytäntöönpano

- toteutukset

- tuoda

- tärkeä

- in

- perusteellinen

- sisältää

- sisältää

- Mukaan lukien

- sisällyttää

- Kasvaa

- yhä useammin

- henkilökohtainen

- henkilöt

- teollisuuden

- tiedot

- tietoa

- ensimmäinen

- ensin

- aloittamista

- panos

- tuloa

- oivalluksia

- asentaa

- asennetaan

- esimerkki

- ohjeet

- Integrointi

- Älykkyys

- olla vuorovaikutuksessa

- korko

- kiinnostunut

- liitäntä

- tulee

- kysymykset

- IT

- SEN

- Job

- Työpaikat

- jpg

- avain

- tuntemus

- tunnettu

- Landschaft

- suurempi

- lopuksi

- Viive

- myöhemmin

- uusin

- kerros

- johtaa

- oppiminen

- vähiten

- vipuvaikutuksen

- Lisenssi

- rajoitus

- rajallinen

- linja

- Lista

- kuormitus

- lastaus

- paikallinen

- sijainti

- Pitkät

- kauemmin

- Matala

- kone

- koneoppiminen

- tehty

- tärkein

- tehdä

- TEE

- Tekeminen

- hoitaa

- toimitusjohtaja

- Kartat

- Saattaa..

- mainitsi

- Metadata

- menetelmä

- menetelmät

- Metrics

- ehkä

- millisekuntia

- minuuttia

- MIT

- ML

- malli

- mallit

- kohtalainen

- Moments

- seuranta

- lisää

- Elokuvat

- paljon

- moninkertainen

- täytyy

- nimetty

- kansallinen

- välttämätön

- Tarve

- tarvitaan

- verkko

- hermo-

- neuroverkkomallien

- seuraava

- NLP

- Nro

- huomata

- muistikirja

- Huomautuksia

- ilmoituksen

- ilmoitukset

- huomata

- nyt

- numero

- numerot

- objekti

- esineet

- tarkkailla

- of

- kampanja

- tarjoamalla

- Tarjoukset

- virallinen

- offline

- on

- kerran

- ONE

- vain

- avoimen lähdekoodin

- toimii

- Vaihtoehto

- Vaihtoehdot

- or

- tilata

- organisaatioiden

- OS

- Muut

- muuten

- ulos

- yleiskatsaus

- paketti

- paketit

- parametri

- parametrit

- kulkea

- polku

- Suorittaa

- suorituskyky

- vaihe

- putki

- keskeinen

- foorumi

- Platon

- Platonin tietotieto

- PlatonData

- Ole hyvä

- pistettä

- mahdollinen

- Kirje

- mahdollinen

- ennustus

- Ennusteet

- estää

- edellinen

- ensisijainen

- prosessi

- Käsitelty

- käsittely

- Suoritin

- projekti

- asianmukaisesti

- prototyyppien

- toimittaa

- mikäli

- tarjoaa

- tarjoamalla

- Python

- pytorch

- laatu

- alue

- reaaliaikainen

- valtakunta

- tunnustaminen

- suositeltu

- kirjataan

- Vähentynyt

- katso

- riippumatta

- liittyvä

- Tiedotteet

- muistaa

- poistaa

- Poistaa

- säilytyspaikka

- pyyntö

- pyynnöt

- edellyttää

- tarvitaan

- vaatimus

- Tutkijat

- vastaavasti

- vastaus

- vasteet

- vastuullinen

- johtua

- tulokset

- palata

- sagemaker

- sama

- Säästä

- tallennettu

- tallentaa

- skaalautuvuus

- Asteikko

- asteikot

- suunniteltu

- tutkijat

- käsikirjoitus

- skriptejä

- Toinen

- sekuntia

- Osa

- segmentit

- valita

- valittu

- valitsemalla

- Sarjat

- palvelu

- Palvelut

- setti

- asetus

- settings

- Jaa:

- hän

- shouldnt

- osoittivat

- Näytä

- sulkeminen

- merkittävä

- Yksinkertainen

- yksinkertaistetaan

- Koko

- koot

- pieni

- pienempiä

- So

- Tuotteemme

- ratkaisu

- erityinen

- erityisesti

- määritelty

- puhe

- Puheentunnistus

- nopeus

- menot

- puhuttu

- Alkaa

- Osavaltio

- huippu-

- Vaihe

- Askeleet

- Levytila

- strategiat

- myöhempi

- onnistunut

- niin

- äkillinen

- sopiva

- tuki

- Tukea

- Tukee

- varma

- syntyy

- järjestelmät

- taulukko

- ottaa

- ottaen

- Tehtävä

- tehtävät

- Elektroniikka

- kuin

- että

- -

- UK

- heidän

- Niitä

- sitten

- Siellä.

- siksi

- Nämä

- ne

- tätä

- kolmella

- aika

- Aikasarja

- kertaa

- että

- työkalut

- taskulamppu

- liikenne

- Juna

- koulutettu

- Muuttaa

- muuntaja

- muuntajat

- laukaista

- laukeaa

- tv

- kaksi

- tyyppi

- tyypillisesti

- Uk

- varten

- lukituksen

- tarpeeton

- päälle

- us

- käyttää

- käytetty

- helppokäyttöinen

- Käyttäjät

- käyttämällä

- hyödyllisyys

- käyttää

- Hyödyntämällä

- arvokas

- arvo

- muuttuja

- eri

- valtava

- versio

- versiot

- visio

- Ääni

- tilavuus

- odottaa

- haluta

- oli

- we

- verkko

- verkkopalvelut

- HYVIN

- olivat

- kun

- aina kun

- joka

- Kuiskaus

- leveä

- Laaja valikoima

- with

- sisällä

- työnkulku

- toimii

- arvoinen

- kirjoittaminen

- Voit

- Sinun

- zephyrnet