KT Oyj on yksi Etelä-Korean suurimmista televiestinnän tarjoajista, joka tarjoaa laajan valikoiman palveluita, mukaan lukien kiinteän verkon puhelin-, matkaviestin- ja Internet- sekä tekoälypalvelut. KT:n AI Food Tag on tekoälyyn perustuva ruokavalionhallintaratkaisu, joka tunnistaa kuvissa olevan ruoan tyypin ja ravintosisällön tietokonenäkömallin avulla. Tämä KT:n kehittämä visiomalli perustuu malliin, joka on valmiiksi koulutettu suurella määrällä leimaamatonta kuvadataa analysoimaan eri elintarvikkeiden ravintosisältöä ja kaloritietoja. AI Food Tag voi auttaa potilaita, joilla on kroonisia sairauksia, kuten diabetes, hallitsemaan ruokavaliotaan. KT käytti AWS:ää ja Amazon Sage Maker kouluttaa tätä AI Food Tag -mallia 29 kertaa nopeammin kuin ennen ja optimoida sen tuotantokäyttöä varten mallitislaustekniikalla. Tässä viestissä kuvaamme KT:n mallinkehitysmatkaa ja menestystä SageMakerin avulla.

KT-projektin esittely ja ongelman määrittely

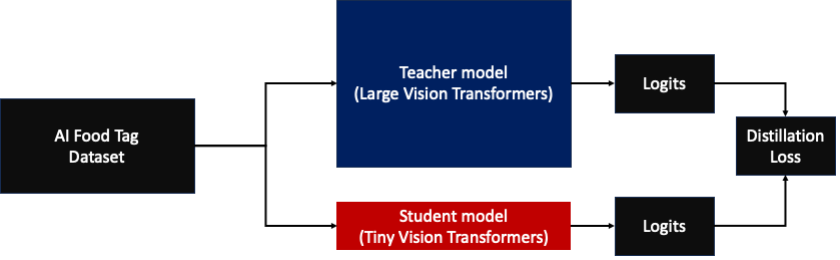

KT:n esiopettama AI Food Tag -malli perustuu vision transformers (ViT) -arkkitehtuuriin, ja siinä on enemmän malliparametreja kuin aiemmassa visiomallissaan tarkkuuden parantamiseksi. Mallin koon pienentämiseksi tuotantoa varten KT käyttää tietämyksen tislaustekniikkaa (KD) vähentääkseen malliparametrien määrää ilman merkittävää vaikutusta tarkkuuteen. Tiedon tislaamalla esikoulutettua mallia kutsutaan a opettajan malli, ja kevyt tulostemalli on koulutettu a opiskelija malli, kuten seuraavassa kuvassa näkyy. Kevyessä opiskelijamallissa on vähemmän malliparametreja kuin opettajalla, mikä vähentää muistivaatimuksia ja mahdollistaa käyttöönoton pienempiin, halvempiin tapauksiin. Opiskelija säilyttää hyväksyttävän tarkkuuden, vaikka se on pienempi, oppimalla opettajamallin tuloksista.

Opettajamalli pysyy muuttumattomana KD:n aikana, mutta opiskelijamallia opetetaan käyttämällä opettajamallin lähtölogisteja tunnisteina häviön laskemiseen. Tämän KD-paradigman avulla sekä opettajan että oppilaan on oltava yhdellä GPU-muistilla harjoittelua varten. KT käytti aluksi kahta GPU:ta (A100 80 Gt) sisäisessä, paikallisessa ympäristössä opiskelijamallin kouluttamiseen, mutta prosessi kesti noin 40 päivää 300 aikakauden kattamiseen. KT teki yhteistyötä AWS:n kanssa nopeuttaakseen koulutusta ja luodakseen opiskelijamallin lyhyemmässä ajassa. Yhdessä tiimit lyhensivät malliharjoitteluaikaa merkittävästi. Tässä postauksessa kerrotaan, kuinka tiimi käytti Amazon SageMaker -koulutus, The SageMaker Data Parallelism -kirjasto, Amazon SageMaker -korjaamoja Amazon SageMaker Profiler kehittää onnistuneesti kevyt AI Food Tag -malli.

Hajautetun koulutusympäristön rakentaminen SageMakerin avulla

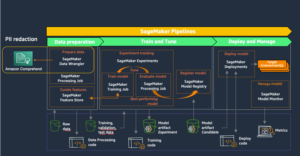

SageMaker Training on hallittu koneoppimisen (ML) koulutusympäristö AWS:ssä, joka tarjoaa joukon ominaisuuksia ja työkaluja koulutuskokemuksen yksinkertaistamiseksi ja voi olla hyödyllinen hajautetussa tietojenkäsittelyssä, kuten seuraavassa kaaviossa näkyy.

SageMaker-asiakkaat voivat myös käyttää sisäänrakennettuja Docker-kuvia, joissa on erilaisia esiasennettuja syväoppimiskehyksiä ja tarvittavia Linux-, NCCL- ja Python-paketteja mallikoulutukseen. Datatieteilijät tai ML-insinöörit, jotka haluavat suorittaa mallikoulutusta, voivat tehdä sen ilman koulutusinfrastruktuurin määrittämistä tai Dockerin hallintaa ja eri kirjastojen yhteensopivuutta.

Yhden päivän työpajan aikana pystyimme määrittämään hajautetun harjoituskokoonpanon SageMakeriin perustuvan KT:n AWS-tilin sisällä, nopeuttamaan KT:n harjoitusskriptejä SageMaker Distributed Data Parallel (DDP) -kirjaston avulla ja jopa testaamaan harjoitustyötä kahdella ml:lla. p1d.4xsuuret esiintymät. Tässä osiossa kuvaamme KT:n kokemusta työskentelystä AWS-tiimin kanssa ja SageMakerin käyttämistä mallin kehittämiseen.

Todistuksessa halusimme nopeuttaa koulutustyötä käyttämällä SageMaker DDP -kirjastoa, joka on optimoitu AWS-infrastruktuurille hajautetun koulutuksen aikana. Jos haluat vaihtaa PyTorch DDP:stä SageMaker DDP:hen, sinun on yksinkertaisesti ilmoitettava torch_smddp paketti ja muuta taustaversioksi smddp, kuten seuraavassa koodissa esitetään:

Lisätietoja SageMaker DDP -kirjastosta on kohdassa SageMakerin Data Parallelism Library.

Hitaan harjoitusnopeuden syiden analysointi SageMaker Debuggerilla ja Profilerilla

Ensimmäinen askel koulutustyömäärän optimoinnissa ja nopeuttamisessa on pullonkaulojen tilan ymmärtäminen ja diagnosointi. KT:n harjoitustyötä varten mittasimme harjoitusajan datalataajan iteraatiota, eteenpäin- ja taaksepäin-ajoa kohti:

| 1 iter time – dataloader: 0.00053 s, eteenpäin: 7.77474 s, taaksepäin: 1.58002 kuiva |

| 2 iter time – dataloader: 0.00063 s, eteenpäin: 0.67429 s, taaksepäin: 24.74539 kuiva |

| 3 iter time – dataloader: 0.00061 s, eteenpäin: 0.90976 s, taaksepäin: 8.31253 kuiva |

| 4 iter time – dataloader: 0.00060 s, eteenpäin: 0.60958 s, taaksepäin: 30.93830 kuiva |

| 5 iter time – dataloader: 0.00080 s, eteenpäin: 0.83237 s, taaksepäin: 8.41030 kuiva |

| 6 iter time – dataloader: 0.00067 s, eteenpäin: 0.75715 s, taaksepäin: 29.88415 kuiva |

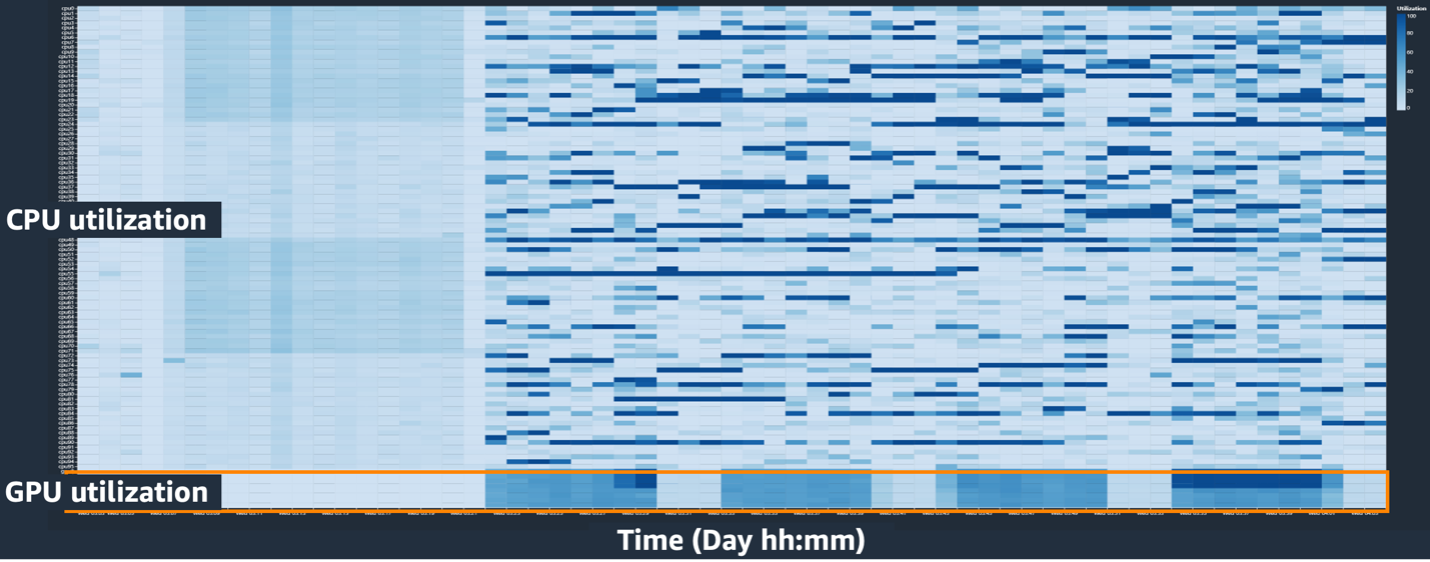

Tarkasteltaessa kunkin iteraation vakiotulosteen aikaa havaitsimme, että taaksepäin kulkevan kierron ajoaika vaihteli merkittävästi iteraatiosta iteraatioon. Tämä vaihtelu on epätavallinen ja voi vaikuttaa koko harjoitusaikaan. Tämän epäjohdonmukaisen harjoitusnopeuden syyn selvittämiseksi yritimme ensin tunnistaa resurssien pullonkauloja käyttämällä System Monitoria (SageMaker Debugger UI), jonka avulla voit korjata SageMaker Trainingin koulutustöitä ja tarkastella resurssien, kuten hallitun koulutusalustan, tilaa. CPU, GPU, verkko ja I/O tietyssä sekuntimäärässä.

SageMaker Debugger -käyttöliittymä tarjoaa yksityiskohtaisia ja olennaisia tietoja, jotka voivat auttaa tunnistamaan ja diagnosoimaan koulutustyön pullonkauloja. Erityisesti prosessorin käyttöasteen viivakaavio ja prosessorin/grafiikkayksikön käyttöasteen lämpökartta instanssikohtaisesti kiinnittivät huomiomme.

Suorittimen käyttöasteen viivakaaviossa havaitsimme, että joitain suorittimia käytettiin 100%.

Lämpökartassa (jossa tummemmat värit osoittavat korkeampaa käyttöastetta) havaitsimme, että muutaman prosessoriytimen käyttöaste oli korkea koko koulutuksen ajan, kun taas GPU:n käyttöaste ei ollut jatkuvasti korkea ajan mittaan.

Tästä lähtien aloimme epäillä, että yksi syy hitaalle harjoitusnopeudelle oli suorittimen pullonkaula. Tarkistimme harjoitusskriptikoodin nähdäksemme, aiheuttaako jokin prosessorin pullonkaulan. Epäilyttävin osa oli sen suuri arvo num_workers tiedonlataajassa, joten muutimme tämän arvon 0:ksi tai 1:ksi prosessorin käytön vähentämiseksi. Sitten suoritimme koulutustyön uudelleen ja tarkistimme tulokset.

Seuraavat kuvakaappaukset näyttävät suorittimen käyttöasteen viivakaavion, GPU:n käytön ja lämpökartan suorittimen pullonkaulan lieventämisen jälkeen.

Yksinkertaisesti vaihtamalla num_workers, havaitsimme prosessorin käytön merkittävän laskun ja GPU-käytön yleisen nousun. Tämä oli tärkeä muutos, joka paransi harjoitusnopeutta merkittävästi. Halusimme kuitenkin nähdä, missä voisimme optimoida GPU:n käytön. Tätä varten käytimme SageMaker Profileria.

SageMaker Profiler auttaa tunnistamaan optimointivihjeitä tarjoamalla näkyvyyttä toimintojen käyttöön, mukaan lukien GPU:n ja CPU:n käyttömittojen seuranta sekä GPU/CPU:n ytimen kulutus opetusskripteissä. Se auttaa käyttäjiä ymmärtämään, mitkä toiminnot kuluttavat resursseja. Ensinnäkin, jotta voit käyttää SageMaker Profileria, sinun on lisättävä ProfilerConfig toimintoon, joka kutsuu harjoitustyön SageMaker SDK:lla seuraavan koodin mukaisesti:

SageMaker Python SDK:ssa voit lisätä joustavuutta annotate toiminnot SageMaker Profilerille valitakseen koodin tai vaiheet harjoitusskriptistä, joka vaatii profiloinnin. Seuraavassa on esimerkki koodista, joka sinun tulee ilmoittaa SageMaker Profilerille koulutusskripteissä:

Edellisen koodin lisäämisen jälkeen, jos suoritat koulutustyötä harjoitusskripteillä, saat tietoja GPU-ytimen kuluttamista toiminnoista (kuten seuraavassa kuvassa) sen jälkeen, kun koulutus on suoritettu jonkin aikaa. KT:n harjoitusskriptien tapauksessa suoritimme sen yhden aikakauden ja saimme seuraavat tulokset.

Kun tarkistimme SageMaker Profilerin tuloksista GPU-ytimen viisi suurinta toiminnankulutusaikaa, havaitsimme, että KT-harjoituskomentosarjassa eniten aikaa kuluttaa matriisitulooperaatio, joka on yleinen matriisin kertolasku (GEMM) -toiminto. GPU:illa. Tämän SageMaker Profilerin tärkeän näkemyksen ansiosta aloimme tutkia tapoja nopeuttaa näitä toimintoja ja parantaa GPU:n käyttöä.

Harjoitteluajan nopeuttaminen

Tarkastelimme erilaisia tapoja lyhentää matriisin kertolaskua ja käytimme kahta PyTorch-funktiota.

Sirpaleen optimointitila ZeroRedundancyOptimizerilla

Jos katsot Zero Redundancy Optimizer (ZeRO), DeepSpeed/ZeRO-tekniikka mahdollistaa suuren mallin harjoittamisen tehokkaasti ja paremmalla harjoitusnopeudella eliminoimalla mallin käyttämät redundanssit muistista. ZeroRedundancyOptimizer PyTorch käyttää optimoijan tilan jakamistekniikkaa vähentääkseen muistin käyttöä prosessia kohden Distributed Data Parallelissa (DDP). DDP käyttää synkronoituja gradientteja taaksepäin siirtymisessä, jotta kaikki optimointikopiot toistuvat samoilla parametreilla ja gradienttiarvoilla, mutta sen sijaan, että niillä olisi kaikki malliparametrit, kutakin optimoijan tilaa ylläpidetään jakamalla vain eri DDP-prosesseja muistin käytön vähentämiseksi.

Voit käyttää sitä jättämällä nykyisen Optimizerisi käyttöön optimizer_class ja julistaa a ZeroRedundancyOptimizer loput malliparametrit ja oppimisnopeus parametreina.

Automaattinen sekoitettu tarkkuus

Automaattinen sekoitettu tarkkuus (AMP) käyttää torch.float32-tietotyyppiä joihinkin toimintoihin ja taskulamppu.bfloat16 tai torch.float16 muille nopean laskennan ja muistin käytön vähentämisen helpottamiseksi. Erityisesti, koska syväoppimismallit ovat tyypillisesti herkempiä eksponenttibiteille kuin murto-biteille laskelmissaan, torch.bfloat16 vastaa torch.float32:n eksponenttibittejä, mikä mahdollistaa niiden oppimisen nopeasti minimaalisella häviöllä. torch.bfloat16 toimii vain tapauksissa, joissa on A100 NVIDIA-arkkitehtuuri (Ampere) tai uudempi, kuten ml.p4d.24xlarge, ml.p4de.24xlarge ja ml.p5.48xlarge.

Voit ottaa käyttöön AMP:n ilmoittamalla torch.cuda.amp.autocast koulutusskripteissä yllä olevan koodin mukaisesti ja ilmoittaa dtype kuten taskulamppu.bfloat16.

Tulokset SageMaker Profilerissa

Kun nämä kaksi funktiota oli otettu käyttöön opetusskripteihin ja suoritettu harjoitustyö uudelleen yhden aikakauden ajan, tarkistimme SageMaker Profilerissa GPU-ytimen viisi suurinta toimintojen kulutusaikaa. Seuraava kuva näyttää tuloksemme.

Näemme, että GEMM-operaatio, joka oli listan kärjessä ennen kahden Torch-toiminnon käyttöönottoa, on kadonnut viiden suurimman toiminnon joukosta, ja sen tilalle on tullut ReduceScatter-toiminto, joka esiintyy tyypillisesti hajautetussa koulutuksessa.

KT-tislatun mallin harjoitusnopeustulokset

Lisäsimme harjoituserän kokoa 128:lla ottaaksemme huomioon kahden Torch-toiminnon käyttämisen aiheuttamat muistisäästöt, jolloin lopullinen eräkoko oli 1152 1024:n sijaan. Lopullisen opiskelijamallin koulutus pystyi ajamaan 210 jaksoa päivässä. ; harjoitusaika ja nopeus KT:n sisäisen harjoitusympäristön ja SageMakerin välillä on yhteenveto seuraavassa taulukossa.

| Koulutusympäristö | Koulutus GPU-spes. | GPU:n määrä | Harjoitusaika (tuntia) | Aikakausi | Tunteja per aikakausi | Vähennyssuhde |

| KT:n sisäinen koulutusympäristö | A100 (80 Gt) | 2 | 960 | 300 | 3.20 | 29 |

| Amazon Sage Maker | A100 (40 Gt) | 32 | 24 | 210 | 0.11 | 1 |

AWS:n skaalautuvuuden ansiosta pystyimme suorittamaan koulutustyön 29 kertaa nopeammin kuin ennen, kun käytimme 32 GPU:ta tiloissa 2 sijasta. Tämän seurauksena useamman grafiikkasuorittimen käyttäminen SageMakerissa olisi lyhentänyt harjoitusaikaa merkittävästi ilman eroa koulutuskustannuksissa.

Yhteenveto

Park Sang-min (Vision AI Serving Technology Team Leader) KT:n Convergence Technology Centerin AI2XL Labista kommentoi yhteistyötä AWS:n kanssa AI Food Tag -mallin kehittämiseksi:

”Viime aikoina, kun muuntajapohjaisia malleja näkökentässä on enemmän, malliparametrit ja tarvittava GPU-muisti ovat lisääntyneet. Käytämme kevyttä tekniikkaa tämän ongelman ratkaisemiseen, ja yhden kerran oppiminen vie paljon aikaa, noin kuukauden. Tämän AWS:n kanssa varustetun PoC:n avulla pystyimme tunnistamaan resurssien pullonkaulat SageMaker Profilerin ja Debuggerin avulla, ratkaisemaan ne ja suorittamaan koulutuksen SageMakerin tietojen rinnakkaiskirjaston avulla noin yhdessä päivässä optimoidun mallikoodin avulla neljällä ml.p4d:llä. 24xsuuria tapauksia."

SageMaker auttoi säästämään Sang-minin tiimiä viikkoja mallikoulutuksessa ja kehityksessä.

Tämän visiomallin yhteistyön pohjalta AWS ja SageMaker-tiimi jatkavat yhteistyötä KT:n kanssa erilaisissa AI/ML-tutkimusprojekteissa parantaakseen mallin kehitystä ja palveluiden tuottavuutta SageMaker-ominaisuuksien avulla.

Saat lisätietoja SageMakerin liittyvistä ominaisuuksista tutustumalla seuraavaan:

Tietoja kirjoittajista

Youngjoon Choi, AI/ML Expert SA, on kokenut yritystietotekniikan eri aloilla, kuten valmistus, huipputeknologia ja rahoitus, kehittäjänä, arkkitehtina ja datatieteilijänä. Hän suoritti tutkimusta koneoppimisesta ja syväoppimisesta, erityisesti sellaisista aiheista kuin hyperparametrien optimointi ja verkkotunnuksen mukauttaminen, esitellen algoritmeja ja papereita. AWS:ssä hän on erikoistunut tekoälyyn/ML:ään eri toimialoilla tarjoten teknistä validointia käyttämällä AWS-palveluita hajautettuun koulutukseen/suuren mittakaavan malleihin ja MLO:iden rakentamiseen. Hän ehdottaa ja arvioi arkkitehtuureja, joiden tavoitteena on edistää AI/ML-ekosysteemin laajentamista.

Youngjoon Choi, AI/ML Expert SA, on kokenut yritystietotekniikan eri aloilla, kuten valmistus, huipputeknologia ja rahoitus, kehittäjänä, arkkitehtina ja datatieteilijänä. Hän suoritti tutkimusta koneoppimisesta ja syväoppimisesta, erityisesti sellaisista aiheista kuin hyperparametrien optimointi ja verkkotunnuksen mukauttaminen, esitellen algoritmeja ja papereita. AWS:ssä hän on erikoistunut tekoälyyn/ML:ään eri toimialoilla tarjoten teknistä validointia käyttämällä AWS-palveluita hajautettuun koulutukseen/suuren mittakaavan malleihin ja MLO:iden rakentamiseen. Hän ehdottaa ja arvioi arkkitehtuureja, joiden tavoitteena on edistää AI/ML-ekosysteemin laajentamista.

Jung Hoon Kim on AWS Korean SA-tili. Hän työskentelee AWS Cloud -matkan ja AWS:n työkuormien optimoinnin parissa yritysasiakkaiden AWS Cloud -matkan ja työkuormien optimoinnin parissa eri teollisuudenaloilla, kuten huipputeknologiassa, teollisuudessa, rahoituksessa ja julkisella sektorilla, saatujen kokemusten perusteella.

Jung Hoon Kim on AWS Korean SA-tili. Hän työskentelee AWS Cloud -matkan ja AWS:n työkuormien optimoinnin parissa yritysasiakkaiden AWS Cloud -matkan ja työkuormien optimoinnin parissa eri teollisuudenaloilla, kuten huipputeknologiassa, teollisuudessa, rahoituksessa ja julkisella sektorilla, saatujen kokemusten perusteella.

Rock Sakong on tutkija KT R&D:ssä. Hän on tehnyt näön tekoälyn tutkimusta ja kehitystä eri aloilla ja pääosin tehnyt kasvojen attribuutteja (sukupuoli/lasit, hatut jne.)/kasvojentunnistustekniikkaa. Tällä hetkellä hän työskentelee kevytteknologian parissa näkömalleihin.

Rock Sakong on tutkija KT R&D:ssä. Hän on tehnyt näön tekoälyn tutkimusta ja kehitystä eri aloilla ja pääosin tehnyt kasvojen attribuutteja (sukupuoli/lasit, hatut jne.)/kasvojentunnistustekniikkaa. Tällä hetkellä hän työskentelee kevytteknologian parissa näkömalleihin.

Manoj Ravi on Amazon SageMakerin vanhempi tuotepäällikkö. Hän on intohimoinen seuraavan sukupolven tekoälytuotteiden rakentamiseen ja työskentelee ohjelmistojen ja työkalujen parissa, jotka helpottavat laajamittaista koneoppimista asiakkaille. Hän on suorittanut MBA-tutkinnon Haas School of Businessista ja tietojärjestelmien hallinnan maisterin tutkinnon Carnegie Mellonin yliopistosta. Vapaa-ajallaan Manoj pelaa tennistä ja harrastaa maisemakuvausta.

Manoj Ravi on Amazon SageMakerin vanhempi tuotepäällikkö. Hän on intohimoinen seuraavan sukupolven tekoälytuotteiden rakentamiseen ja työskentelee ohjelmistojen ja työkalujen parissa, jotka helpottavat laajamittaista koneoppimista asiakkaille. Hän on suorittanut MBA-tutkinnon Haas School of Businessista ja tietojärjestelmien hallinnan maisterin tutkinnon Carnegie Mellonin yliopistosta. Vapaa-ajallaan Manoj pelaa tennistä ja harrastaa maisemakuvausta.

Robert Van Dusen on vanhempi tuotepäällikkö Amazon SageMakerissa. Hän johtaa puitteita, kääntäjiä ja optimointitekniikoita syväoppimisen koulutukseen.

Robert Van Dusen on vanhempi tuotepäällikkö Amazon SageMakerissa. Hän johtaa puitteita, kääntäjiä ja optimointitekniikoita syväoppimisen koulutukseen.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/kts-journey-to-reduce-training-time-for-a-vision-transformers-model-using-amazon-sagemaker/

- :on

- :On

- :missä

- $ YLÖS

- 1

- 10

- 100

- 11

- 12

- 15%

- 22

- 29

- 32

- 378

- 40

- 7

- 710

- 80

- a

- pystyy

- Meistä

- edellä

- kiihdyttää

- kiihtyvä

- hyväksyttävä

- pääsy

- Tili

- tarkkuus

- poikki

- sovitus

- lisätä

- lisää

- Jälkeen

- uudelleen

- AI

- Tekoälyn palvelut

- AI / ML

- Tähtäimessä

- algoritmit

- Kaikki

- sallittu

- Salliminen

- mahdollistaa

- Myös

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- keskuudessa

- määrä

- amp

- an

- analysoida

- ja

- mitään

- sovellukset

- sovellettu

- käyttää

- Hakeminen

- arkkitehtuuri

- OVAT

- AS

- At

- attribuutteja

- AWS

- taustaosa

- perustua

- BE

- koska

- ennen

- alkoi

- ovat

- Paremmin

- välillä

- sekä

- pullonkauloja

- Rakentaminen

- sisäänrakennettu

- taakka

- liiketoiminta

- mutta

- by

- laskea

- nimeltään

- CAN

- Voi saada

- kyvyt

- Carnegie Mellon

- tapaus

- kiinni

- Aiheuttaa

- syyt

- aiheuttaen

- keskus

- muuttaa

- muuttunut

- muuttuviin

- Kaavio

- tarkastaa

- tarkistettu

- pilvi

- koodi

- tehdä yhteistyötä

- yhteistyö

- kommentoi

- Viestintä

- yhteensopivuus

- täydellinen

- laskeminen

- laskelmat

- tietokone

- Tietokoneen visio

- tietojenkäsittely

- käsite

- tehty

- Konfigurointi

- johdonmukaisesti

- kulutetaan

- kuluttaa

- kulutus

- pitoisuus

- jatkaa

- edistävät

- mukavuus

- Lähentyminen

- kustannukset

- voisi

- kattaa

- Tällä hetkellä

- Asiakkaat

- tummempi

- tiedot

- tietojen tutkija

- päivä

- päivää

- DDP

- vähentää

- syvä

- syvä oppiminen

- määrittelemällä

- käyttöönotto

- kuvata

- Malli

- yksityiskohtainen

- kehittää

- kehitetty

- Kehittäjä

- Kehitys

- Diabetes

- diagnosoinnissa

- ero

- eri

- sairauksien

- jaettu

- hajautettu laskenta

- hajautettu koulutus

- do

- Satamatyöläinen

- verkkotunnuksen

- aikana

- kukin

- helpompaa

- ekosysteemi

- tehokkaasti

- poistamalla

- käytössä

- mahdollistaa

- Engineers

- yritys

- ympäristö

- aikakausi

- aikakausia

- Vastaava

- olennainen

- jne.

- Jopa

- esimerkki

- olemassa

- laajeneminen

- kallis

- experience

- kokenut

- Elämykset

- asiantuntija

- silmä

- Kasvot

- kasvohoito

- FAST

- nopeampi

- Ominaisuudet

- harvat

- vähemmän

- ala

- Fields

- Kuva

- lopullinen

- rahoittaa

- Löytää

- Etunimi

- viisi

- Joustavuus

- vaihdellut

- jälkeen

- ruoka

- elintarvikkeet

- varten

- Eteenpäin

- löytyi

- neljä

- jae

- puitteet

- alkaen

- toiminto

- tehtävät

- general

- tuottaa

- saada

- sai

- GPU

- GPU

- kaltevuudet

- HAD

- Olla

- ottaa

- he

- auttaa

- auttanut

- auttaa

- tätä

- hi-tech

- Korkea

- korkeampi

- hänen

- pitää

- TUNTIA

- Miten

- HTML

- HTTPS

- Hyperparametrien optimointi

- tunnistaa

- tunnistaa

- tunnistaminen

- if

- kuva

- kuvien

- Vaikutus

- tuoda

- tärkeä

- parantaa

- parani

- in

- Mukaan lukien

- Kasvaa

- kasvoi

- lisää

- osoittaa

- teollisuuden

- tiedot

- Tietojärjestelmä

- Infrastruktuuri

- ensin

- tietoa

- esimerkki

- sen sijaan

- sisäinen

- Internet

- tulee

- tutkii

- vedotaan

- kysymys

- IT

- iteraatio

- Job

- Työpaikat

- matka

- tuntemus

- Korea

- laboratorio

- tarrat

- Landschaft

- suuri

- laaja

- suurin

- johtaja

- Liidit

- OPPIA

- oppiminen

- jättää

- vähemmän

- kirjastot

- Kirjasto

- kevyt

- pitää

- linja

- linux

- Lista

- loader

- katso

- pois

- Erä

- kone

- koneoppiminen

- pääasiallisesti

- ylläpitää

- tehdä

- hoitaa

- onnistui

- johto

- Hallintaratkaisu

- johtaja

- toimitusjohtaja

- valmistus

- kartta

- Matriisi

- Mellon

- Muisti

- Metrics

- minimi

- lieventävä

- sekoitettu

- ML

- MLOps

- Puhelinnumero

- malli

- mallintaminen

- mallit

- monitori

- Kuukausi

- lisää

- eniten

- välttämätön

- Tarve

- tarpeet

- verkko

- Nro

- huomattava

- numero

- ravinto-

- Nvidia

- of

- tarjoamalla

- on

- kerran

- ONE

- vain

- toiminta

- Operations

- optimointi

- Optimoida

- optimoitu

- optimoimalla

- or

- Muuta

- meidän

- ulos

- ulostulo

- lähdöt

- yli

- yleinen

- paketti

- paketit

- paperit

- paradigma

- Parallel

- parametrit

- osa

- erityinen

- kumppanuuteen

- kulkea

- intohimoinen

- potilaat

- varten

- aika

- valokuvaus

- Valokuvat

- Platforms

- Platon

- Platonin tietotieto

- PlatonData

- pelaa

- PoC

- Kirje

- Tarkkuus

- edellinen

- Ongelma

- prosessi

- Prosessit

- Tuotteet

- tuotepäällikkö

- tuotanto

- tuottavuus

- Tuotteemme

- profilointi

- projekti

- hankkeet

- todiste

- todiste käsitteestä

- ehdottaa

- tarjoajat

- tarjoaa

- tarjoamalla

- julkinen

- Python

- pytorch

- nopeasti

- T & K-

- alue

- sijoitus

- hinta

- syistä

- tunnustaminen

- vähentää

- Vähentynyt

- vähentää

- katso

- liittyvä

- jäännökset

- korvataan

- tarvitaan

- vaatimukset

- tutkimus

- tutkimus ja kehitys

- tutkija

- ratkaisee

- resurssi

- Esittelymateriaalit

- REST

- johtua

- Saatu ja

- tulokset

- tarkistetaan

- Arvostelut

- ajaa

- juoksu

- toimii

- SA

- sagemaker

- sama

- Säästä

- Säästöt

- näki

- skaalautuvuus

- Asteikko

- Koulu

- Tiedemies

- tutkijat

- kuvakaappauksia

- käsikirjoitus

- skriptejä

- sdk

- SEK

- sekuntia

- Osa

- sektori

- nähdä

- vanhempi

- sensible

- palvelu

- Palvelut

- palvelevat

- setti

- sharding

- shouldnt

- näyttää

- esitetty

- Näytä

- merkittävä

- merkittävästi

- yksinkertaistaa

- yksinkertaisesti

- single

- Koko

- hidas

- pienempiä

- So

- Tuotteemme

- ratkaisu

- SOLVE

- jonkin verran

- Etelä

- Etelä-Korea

- erikoistunut

- erityisesti

- nopeus

- käytetty

- standardi

- Osavaltio

- Valtiot

- Tila

- Vaihe

- Askeleet

- Yhä

- opiskelija

- menestys

- Onnistuneesti

- niin

- sviitti

- epäilyttävä

- järjestelmä

- järjestelmät

- taulukko

- TAG

- vie

- Kohde

- joukkue-

- tiimit

- Tekninen

- tekniikka

- tekniikat

- Elektroniikka

- tietoliikenne

- testi

- kuin

- että

- -

- Matriisi

- heidän

- Niitä

- sitten

- Siellä.

- Nämä

- tätä

- vaikka?

- Kautta

- kauttaaltaan

- aika

- kertaa

- että

- yhdessä

- otti

- työkalut

- ylin

- Aiheet

- taskulamppu

- Yhteensä

- Seuranta

- Juna

- koulutettu

- koulutus

- muuntajat

- kokeillut

- totta

- kaksi

- tyyppi

- tyypillisesti

- ui

- ymmärtää

- ymmärtäminen

- yliopisto

- us

- Käyttö

- käyttää

- käytetty

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- Hyödyntämällä

- validointi

- arvo

- arvot

- eri

- Näytä

- näkyvyys

- visio

- haluta

- halusi

- oli

- tavalla

- we

- verkko

- verkkopalvelut

- viikkoa

- olivat

- taas

- joka

- KUKA

- leveä

- Laaja valikoima

- wikipedia

- tulee

- with

- sisällä

- ilman

- työskentely

- toimii

- työpaja

- olisi

- Voit

- Sinun

- zephyrnet

- nolla-