Tämä viesti on kirjoitettu yhdessä Forethought Technologies, Inc:n suunnittelujohtaja Jad Chamounin ja Forethought Technologies, Inc:n ML-insinöörin Salina Wun kanssa.

Ennakko on johtava generatiivinen AI-ohjelmisto asiakaspalveluun. Sen sviitin ytimessä on innovatiivisuus SupportGPT™ teknologia, joka käyttää koneoppimista muuttamaan asiakastuen elinkaarta – lisäämään taipumista, parantamaan CSAT:ia ja lisäämään agenttien tuottavuutta. SupportGPT™ hyödyntää huippuluokan tiedonhakujärjestelmiä (IR) ja suuria kielimalleja (LLM) yli 30 miljoonan asiakasvuorovaikutuksen mahdollistamiseksi vuosittain.

SupportGPT:n ensisijainen käyttötapa on asiakastuen vuorovaikutuksen ja toiminnan laadun ja tehokkuuden parantaminen. Käyttämällä huippuluokan IR-järjestelmiä, jotka perustuvat upotuksiin ja sijoitusmalleihin, SupportGPT voi etsiä nopeasti olennaista tietoa ja antaa tarkkoja ja ytimekkäitä vastauksia asiakkaiden kyselyihin. Forethought käyttää asiakaskohtaisia hienosäädettyjä malleja tunnistaakseen asiakkaiden aikeet asiakkaiden vuorovaikutuksen ratkaisemiseksi. Suurten kielimallien integrointi auttaa inhimillistämään vuorovaikutusta automatisoitujen agenttien kanssa, mikä luo kiinnostavamman ja tyydyttävämmän tukikokemuksen.

SupportGPT auttaa myös asiakastuen edustajia tarjoamalla automaattisen täydennyksen ehdotuksia ja laatimalla asianmukaisia vastauksia asiakaslippuihin, jotka vastaavat yrityksen aikaisempien vastausten perusteella. Edistyneitä kielimalleja käyttämällä edustajat voivat käsitellä asiakkaiden huolenaiheita nopeammin ja tarkemmin, mikä parantaa asiakastyytyväisyyttä.

Lisäksi SupportGPT:n arkkitehtuuri mahdollistaa tukitietokantojen aukkojen havaitsemisen, mikä auttaa agentteja tarjoamaan asiakkaille tarkempaa tietoa. Kun nämä puutteet on tunnistettu, SupportGPT voi automaattisesti luoda artikkeleita ja muuta sisältöä täyttääkseen nämä tietotyhjät ja varmistaa, että tukitietokanta pysyy asiakaslähtöisenä ja ajan tasalla.

Tässä viestissä kerromme, miten Forethought käyttää Amazon Sage Maker monen mallin päätepisteet generatiivisissa tekoälyn käyttötapauksissa säästävät yli 66 % kustannuksissa.

Infrastruktuurin haasteet

Auttaakseen näiden ominaisuuksien tuomista markkinoille Forethought skaalaa tehokkaasti ML-työkuormituksensa ja tarjoaa hyperpersonoituja ratkaisuja, jotka on räätälöity kunkin asiakkaan erityiseen käyttötapaukseen. Tämä hyperpersonointi saavutetaan hienosäätämällä upotusmalleja ja luokituksia asiakastietoihin, mikä varmistaa tarkat tiedonhakutulokset ja verkkotunnuksen tuntemuksen, joka vastaa kunkin asiakkaan yksilöllisiin tarpeisiin. Räätälöidyt automaattisen täydennyksen mallit on myös hienosäädetty asiakastietojen perusteella, mikä parantaa edelleen luotujen vastausten tarkkuutta ja osuvuutta.

Yksi AI-käsittelyn merkittävistä haasteista on laitteistoresurssien, kuten grafiikkasuorittimen, tehokas hyödyntäminen. Tämän haasteen ratkaisemiseksi Forethought käyttää SageMaker-multimallien päätepisteitä (MME) useiden tekoälymallien suorittamiseen yhdellä päättelypäätepisteellä ja -asteikolla. Koska mallien hyperpersonointi vaatii ainutlaatuisten mallien kouluttamista ja käyttöönottoa, mallien määrä skaalautuu lineaarisesti asiakkaiden määrän kanssa, mikä voi tulla kalliiksi.

Oikean suorituskyvyn tasapainon saavuttamiseksi reaaliaikaisia päätelmiä ja kustannuksia varten Forethought päätti käyttää SageMaker MME:itä, jotka tukevat GPU-kiihdytystä. SageMaker MME:t mahdollistavat Forethoughtin toimittamaan korkean suorituskyvyn, skaalautuvia ja kustannustehokkaita ratkaisuja sekunnin jälkeisellä viiveellä, mikä vastaa useisiin asiakastuen skenaarioihin mittakaavassa.

SageMaker ja Forethought

SageMaker on täysin hallittu palvelu, joka tarjoaa kehittäjille ja datatieteilijöille mahdollisuuden rakentaa, kouluttaa ja ottaa käyttöön ML-malleja nopeasti. SageMaker MME:t tarjoavat skaalautuvan ja kustannustehokkaan ratkaisun useiden mallien käyttöönottamiseksi reaaliaikaista päättelyä varten. MME:t käyttävät jaettua käyttösäiliötä ja resursseja, jotka voivat isännöidä kaikkia mallejasi kiihdytettyjen esiintymien, kuten GPU:iden, avulla. Tämä vähentää ylläpitokustannuksia maksimoimalla päätepisteiden käytön verrattuna yhden mallin päätepisteiden käyttöön. Se myös vähentää käyttöönoton yleiskustannuksia, koska SageMaker hallitsee mallien lataamista ja purkamista muistiin ja skaalaa niitä päätepisteen liikennemallien perusteella. Lisäksi kaikki SageMakerin reaaliaikaiset päätepisteet hyötyvät sisäänrakennetuista ominaisuuksista hallita ja valvoa malleja, kuten esim. varjomuunnelmia, automaattinen skaalaus, ja alkuperäisen integroinnin kanssa amazonin pilvikello (lisätietoja, katso CloudWatch-mittarit usean mallin päätepisteiden käyttöönotuksiin).

Kun Foretthought kasvoi isännöimään satoja malleja, jotka vaativat myös GPU-resursseja, näimme mahdollisuuden luoda kustannustehokkaampi, luotettavampi ja hallittavampi arkkitehtuuri SageMaker MME:iden avulla. Ennen siirtymistä SageMaker MME:ihin mallimme otettiin käyttöön Kubernetesissa Amazonin elastisten kuberneettien palvelu (Amazon EKS). Vaikka Amazon EKS tarjosi hallintaominaisuuksia, oli heti selvää, että hallinnoimme infrastruktuuria, jota ei ollut erityisesti räätälöity päätelmiä varten. Foretoughtin piti itse hallita mallipäätelmiä Amazon EKS:stä, mikä rasitti suunnittelun tehokkuutta. Esimerkiksi kalliiden GPU-resurssien jakamiseksi useiden mallien välillä olimme vastuussa jäykkien muistiosien allokoinnista malleille, jotka määriteltiin käyttöönoton aikana. Halusimme ratkaista seuraavat keskeiset ongelmat olemassa olevassa infrastruktuurissamme:

- Hintava – Varmistaaksemme, että jokaisessa mallissa on riittävästi resursseja, olisimme hyvin konservatiivisia sen suhteen, kuinka monta mallia per instanssi mahtuu. Tämä johti paljon korkeampiin kustannuksiin mallin isännöintiin kuin oli tarpeen.

- Alhainen luotettavuus – Huolimatta konservatiivisuudesta muistin allokoinnissa, kaikilla malleilla ei ole samoja vaatimuksia, ja joskus jotkut mallit aiheuttavat muistin loppumisen (OOM) virheitä.

- Tehoton hallinto – Jouduimme hallitsemaan erilaisia käyttöönottoluetteloita jokaiselle mallityypille (kuten luokittelijat, upotukset ja automaattinen täydennys), mikä oli aikaa vievää ja virhealtista. Meidän piti myös ylläpitää logiikkaa määrittääksemme muistin allokoinnin eri mallityypeille.

Lopulta tarvitsimme päättelyalustan, jonka avulla pystyimme ottamaan malliemme hallinnan raskaan työn suoritusaikana parantaaksemme kustannuksia, luotettavuutta ja malliemme palvelun hallintaa. SageMaker MME:t antoivat meille mahdollisuuden vastata näihin tarpeisiin.

Älykkään ja dynaamisen mallien lataamisen ja purkamisen sekä skaalausominaisuuksiensa ansiosta SageMaker MME:t tarjosivat huomattavasti halvemman ja luotettavamman ratkaisun mallien isännöintiin. Pystymme nyt sovittamaan useampia malleja per esiintymä, eikä sinun tarvitse huolehtia OOM-virheistä, koska SageMaker MME:t käsittelevät mallien lataamista ja purkamista dynaamisesti. Lisäksi käyttöönotot ovat nyt yhtä yksinkertaisia kuin Boto3 SageMaker -sovellusliittymien kutsuminen ja asianmukaisten automaattisen skaalauskäytäntöjen liittäminen.

Seuraava kaavio havainnollistaa vanhaa arkkitehtuuriamme.

Aloitaksemme siirtymisemme SageMaker MME:ihin tunnistimme MME:iden parhaat käyttötavat ja mitkä malleistamme hyötyisivät eniten tästä muutoksesta. MME:itä käytetään parhaiten seuraaviin:

- Mallit, joiden odotetaan olevan alhainen latenssi, mutta jotka kestävät kylmäkäynnistysajan (kun se ladataan ensimmäisen kerran)

- Mallit, joita kutsutaan usein ja johdonmukaisesti

- Mallit, jotka tarvitsevat osittaisia GPU-resursseja

- Mallit, joilla on yhteiset vaatimukset ja päättelylogiikka

Tunnistimme upotusmallimme ja automaattisen täydennyksen kielimallimme parhaiksi ehdokkaiksi siirtoamme. Järjestäksemme nämä mallit MME:iden alle luomme yhden MME:n mallityyppiä tai tehtävää kohden, yhden upotusmalleillemme ja toisen automaattisesti täydentäviä kielimalleja varten.

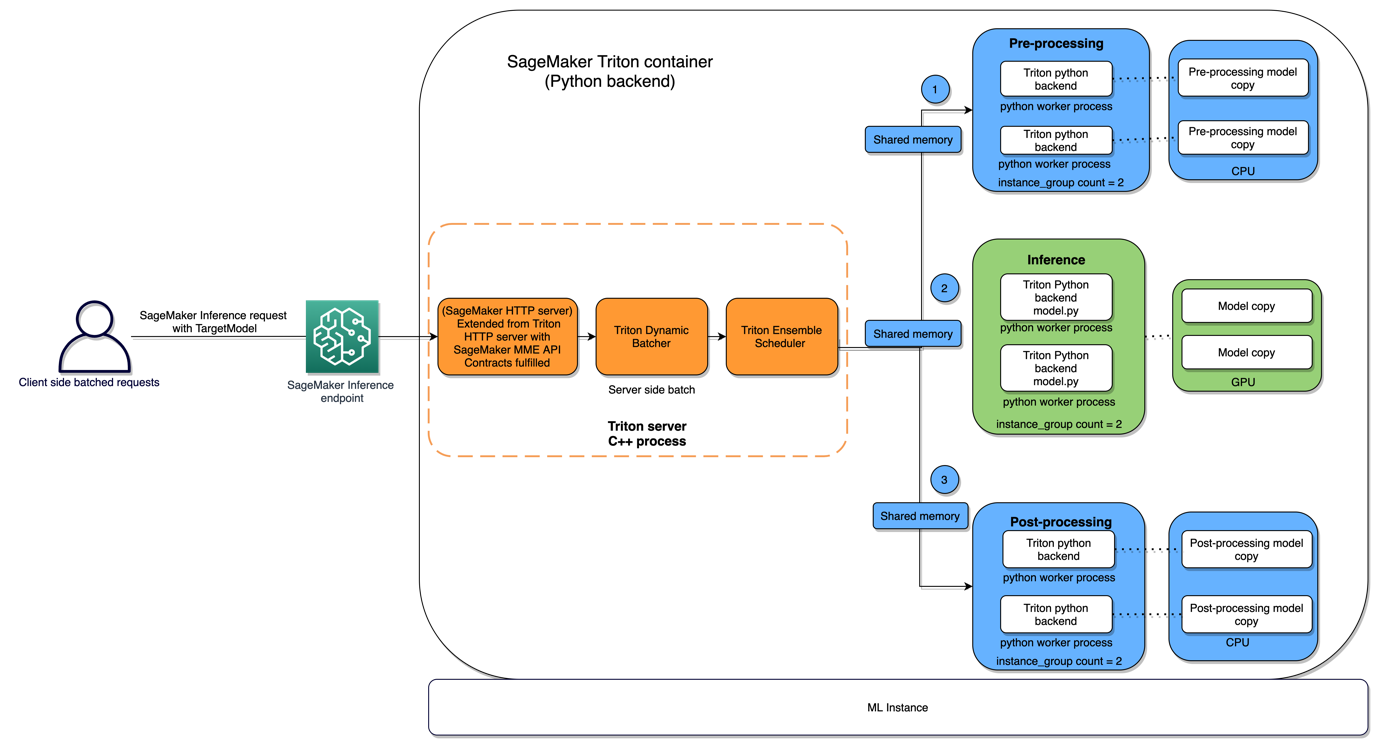

Meillä oli jo mallien päällä API-kerros mallien hallintaa ja päätelmiä varten. Tehtävänämme oli muokata sitä, miten tämä API otti käyttöön ja käsitteli päätelmiä kotelon alla olevista malleista SageMakerin avulla muuttaen vain vähän asiakkaiden ja tuotetiimien vuorovaikutusta API:n kanssa. Meidän piti myös pakata mallimme ja mukautettu päättelylogiikkamme ollakseen yhteensopivia NVIDIA Triton Inference Serverin kanssa käyttämällä SageMaker MME:itä.

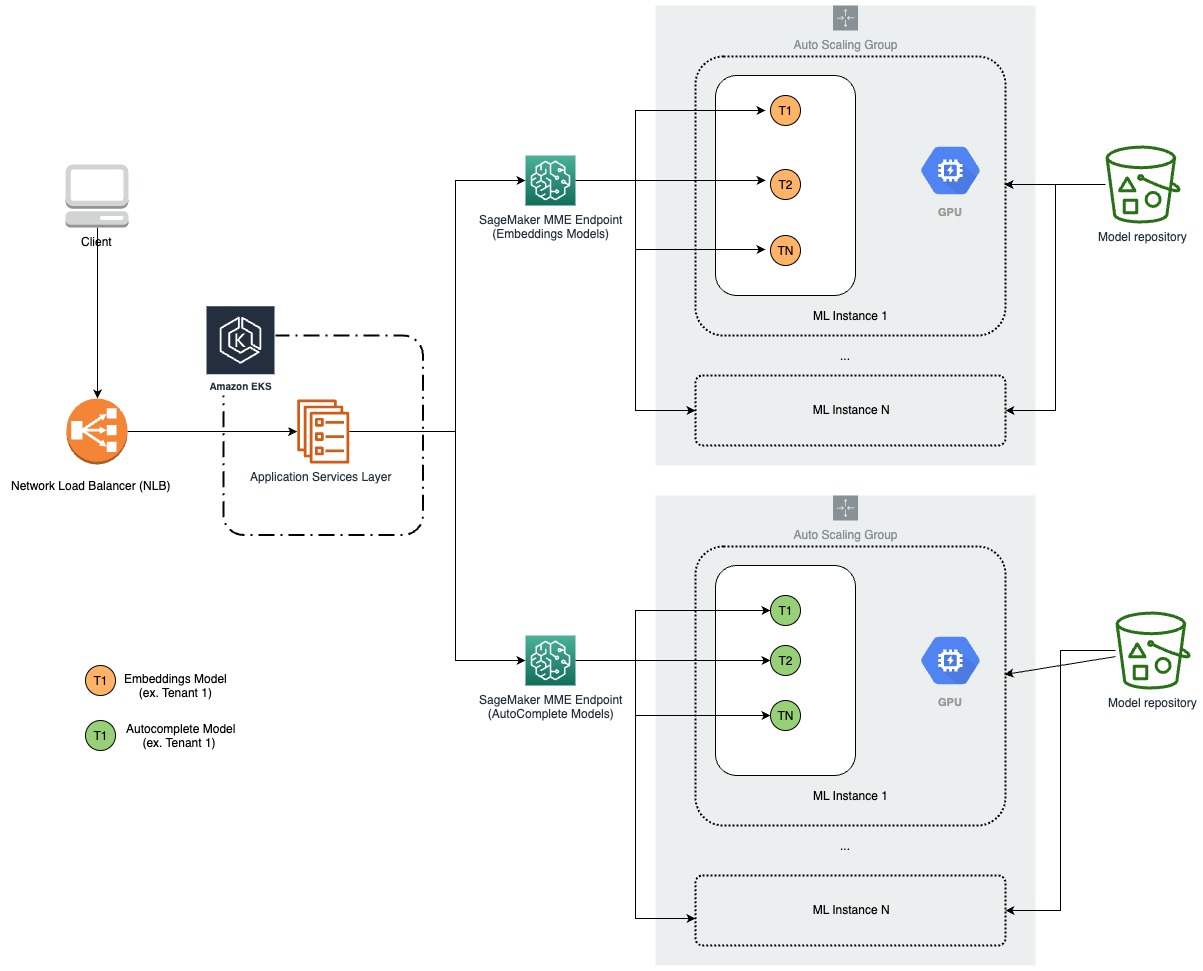

Seuraava kaavio havainnollistaa uutta arkkitehtuuriamme.

Mukautettu päättelylogiikka

Ennen SageMakeriin siirtymistä Forethoughtin mukautettu päättelykoodi (esikäsittely ja jälkikäsittely) suoritettiin API-kerroksessa, kun mallia vedettiin. Tavoitteena oli siirtää tämä toiminnallisuus itse malliin selventääkseen vastuiden jakoa, moduloida ja yksinkertaistaa niiden koodia sekä vähentää API:n kuormitusta.

upotukset

Forethoughtin upotusmallit koostuvat kahdesta PyTorch-mallin artefaktista, ja päättelypyyntö määrittää, kumpi malli kutsutaan. Jokainen malli vaatii esikäsiteltyä tekstiä syötteenä. Tärkeimmät haasteet olivat esikäsittelyvaiheen integrointi ja kahden malliartefaktin sovittaminen mallin määritelmään. Vastatakseen useiden vaiheiden tarpeeseen päättelylogiikassa Forethought kehitti Triton-ensemble-mallin, jossa on kaksi vaihetta: Python-taustaesikäsittelyprosessi ja PyTorch-taustamallin kutsu. Ensemble-mallit mahdollistavat vaiheiden määrittämisen ja järjestämisen päättelylogiikassa, ja jokaista vaihetta edustaa minkä tahansa taustatyypin Triton-malli. Yhteensopivuuden varmistamiseksi Triton PyTorch -taustajärjestelmän kanssa olemassa olevat mallin artefaktit muunnettiin TorchScript-muotoon. Jokaiselle mallimäärittelylle luotiin erilliset Triton-mallit, ja Forethoughtin API-kerros vastasi sopivan määrittämisestä. TargetModel kutsua saapuvan pyynnön perusteella.

Autocomplete

Automaattisen täydennyksen mallit (sekvenssistä järjestykseen) esittivät erilliset vaatimukset. Erityisesti meidän täytyi mahdollistaa kyky kiertää useita mallipuheluita ja tallentaa välimuistiin merkittäviä syötteitä jokaiselle puhelulle säilyttäen samalla alhainen viive. Lisäksi nämä mallit vaativat sekä esi- että jälkikäsittelyvaiheita. Näiden vaatimusten täyttämiseksi ja halutun joustavuuden saavuttamiseksi Forethought kehitti automaattisesti täydentäviä MME-malleja käyttämällä Triton Python -taustajärjestelmää, jonka etuna on kirjoittaa malli Python-koodina.

benchmarking

Kun Triton-mallin muodot oli määritetty, otimme malleja käyttöön päätepisteiden määrittämiseen ja suoritimme resurssien ja suorituskyvyn vertailua. Päätavoitteemme oli määrittää kylmäkäynnistys- ja muistimallien latenssi ja kuinka pyynnön koko ja samanaikaisuus vaikuttivat latenssiin. Halusimme myös tietää, kuinka monta mallia mahtuu kuhunkin esiintymään, kuinka monta mallia saisi esiintymät skaalautumaan automaattisen skaalauskäytäntömme mukaisesti ja kuinka nopeasti skaalautuminen tapahtuisi. Jo käyttämiemme ilmentymätyyppien mukaisesti teimme vertailut ml.g4dn.xlarge- ja ml.g4dn.2xlarge-esiintymillä.

tulokset

Seuraavassa taulukossa on yhteenveto tuloksistamme.

| Pyydä kokoa | Kylmäkäynnistysviive | Välimuistissa olevan päätelmän viive | Samanaikainen latenssi (5 pyyntöä) |

| Pieni (30 merkkiä) | 12.7 sekuntia | 0.03 sekuntia | 0.12 sekuntia |

| Keskikokoinen (250 merkkiä) | 12.7 sekuntia | 0.05 sekuntia | 0.12 sekuntia |

| Suuri (550 tokenia) | 12.7 sekuntia | 0.13 sekuntia | 0.12 sekuntia |

On huomattava, että kylmäkäynnistyspyyntöjen latenssi on huomattavasti korkeampi kuin välimuistissa olevien päättelypyyntöjen latenssi. Tämä johtuu siitä, että malli on ladattava levyltä tai Amazonin yksinkertainen tallennuspalvelu (Amazon S3), kun kylmäkäynnistyspyyntö tehdään. Samanaikaisten pyyntöjen latenssi on myös suurempi kuin yksittäisten pyyntöjen latenssi. Tämä johtuu siitä, että malli on jaettava samanaikaisten pyyntöjen kesken, mikä voi johtaa kiistaan.

Seuraavassa taulukossa verrataan vanhojen mallien ja SageMaker-mallien latenssia.

| Pyydä kokoa | Vanhat mallit | SageMaker mallit |

| Pieni (30 merkkiä) | 0.74 sekuntia | 0.24 sekuntia |

| Keskikokoinen (250 merkkiä) | 0.74 sekuntia | 0.24 sekuntia |

| Suuri (550 tokenia) | 0.80 sekuntia | 0.32 sekuntia |

Kaiken kaikkiaan SageMaker-mallit ovat parempi valinta automaattisen täydennyksen malleihin kuin vanhat mallit. Ne tarjoavat pienemmän latenssin, skaalautuvuuden, luotettavuuden ja turvallisuuden.

Resurssien käyttö

Suoritimme sarjan testejä pyrkiessämme määrittämään kuhunkin esiintymään mahtuvien mallien optimaalisen määrän. Kokeilumme sisälsi mallien lataamisen päätepisteihimme käyttämällä ml.g4dn.xlarge-instanssityyppiä ilman automaattista skaalauskäytäntöä.

Nämä tietyt esiintymät tarjoavat 15.5 Gt muistia, ja pyrimme saavuttamaan noin 80 % GPU-muistin käytön esiintymää kohden. Kunkin enkooderimallin artefaktin koon huomioon ottaen onnistuimme löytämään optimaalisen määrän Triton-enkoodereita, jotka ladataan ilmentymään saavuttaaksemme tavoitteemme GPU-muistin käytön. Lisäksi, koska jokainen upotusmallimme vastaa kahta Triton-enkooderimallia, pystyimme sisällyttämään tietyn määrän upotusmalleja esiintymää kohti. Tuloksena laskimme kaikkien upotusmalliemme näyttämiseen tarvittavien esiintymien kokonaismäärän. Tämä kokeilu on ollut ratkaisevan tärkeää resurssien käytön optimoinnissa ja malliemme tehokkuuden parantamisessa.

Teimme vastaavan vertailun automaattisen täydennyksen malleillemme. Nämä mallit olivat noin 292.0 Mt kukin. Kun testasimme kuinka monta mallia mahtuisi yhteen ml.g4dn.xlarge-instanssiin, huomasimme, että pystyimme sovittamaan vain neljä mallia ennen kuin instanssimme alkoi purkaa malleja, vaikka mallit olivat pieniä. Tärkeimmät huolenaiheemme olivat:

- Syy prosessorin muistin käyttöasteen nousuun

- Syy mallien purkamiseen, kun yritimme ladata vielä yhden mallin vähiten käytetyn (LRU) mallin sijaan

Pystyimme paikantamaan perimmäisen syyn muistin käyttöpiikkiin, joka johtui CUDA-ajonaikaisen ympäristömme alustamisesta Python-mallissamme, mikä oli tarpeen mallin ja datan siirtämiseksi GPU-laitteeseen ja siitä pois. CUDA lataa monia ulkoisia riippuvuuksia suorittimen muistiin, kun suoritusaika alustetaan. Koska Triton PyTorch -taustaosa käsittelee ja tiivistää liikkuvaa dataa GPU-laitteessa ja siitä pois, emme törmänneet tähän ongelmaan upotusmalleissamme. Tämän korjaamiseksi yritimme käyttää ml.g4dn.2xlarge-esiintymiä, joissa oli sama määrä GPU-muistia, mutta kaksi kertaa enemmän CPU-muistia. Lisäksi lisäsimme useita pieniä optimointeja Python-taustakoodiimme, mukaan lukien tensorien poistaminen käytön jälkeen, välimuistin tyhjennys, liukuvärien poistaminen käytöstä ja roskien kerääminen. Suuremmalla ilmentymätyypillä pystyimme sovittamaan 10 mallia instanssia kohden, ja suorittimen ja grafiikkasuorittimen muistin käyttöaste tuli paljon paremmin kohdakkain.

Seuraava kaavio kuvaa tätä arkkitehtuuria.

Automaattinen skaalaus

Liittimme automaattisen skaalauskäytännön sekä upotuksiin että automaattisen täydennyksen MME:ihin. Upotuspäätepisteitämme koskeva käytäntömme tavoitti 80 %:n keskimääräisen GPU-muistin käyttöasteen mukautettuja mittareita käyttäen. Automaattisesti täydennetyissä malleissamme oli runsaasti liikennettä työaikana ja vähäistä liikennettä yön aikana. Tämän vuoksi loimme automaattisen skaalauskäytännön, joka perustuu InvocationsPerInstance jotta voimme skaalata liikennemuotojen mukaan ja säästää kustannuksissa luotettavuudesta tinkimättä. Resurssien käytön vertailun perusteella määritimme skaalauskäytäntömme tavoitteeksi 225 InvocationsPerInstance.

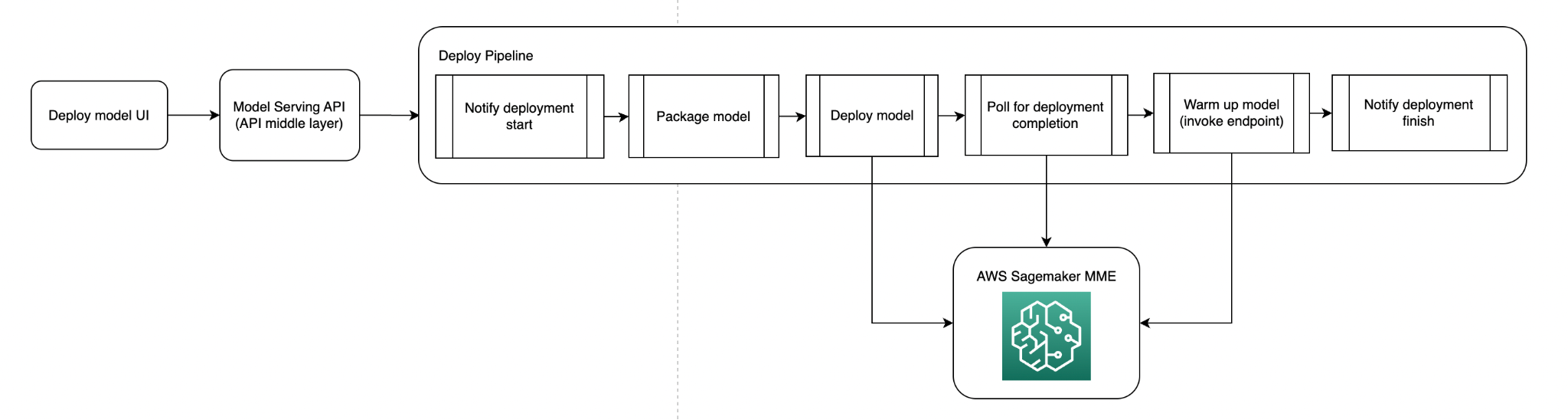

Ota käyttöön logiikka ja putkisto

MME:n luominen SageMakerissa on yksinkertaista ja samanlaista kuin minkä tahansa muun päätepisteen luominen SageMakerissa. Kun päätepiste on luotu, lisämallien lisääminen päätepisteeseen on yhtä helppoa kuin mallin artefaktin siirtäminen S3-polulle, johon päätepiste kohdistaa; tässä vaiheessa voimme tehdä johtopäätöspyyntöjä uudelle mallillemme.

Määritimme logiikan, joka ottaisi mallin metatiedot, muotoilee päätepisteen deterministisesti metatietojen perusteella ja tarkistaisi, onko päätepiste olemassa. Jos näin ei ole, luomme päätepisteen ja lisäämme Triton-mallin artefaktin päätepisteen S3-korjaukseen (myös deterministisesti muotoiltu). Jos esimerkiksi mallin metatiedot osoittavat, että se on automaattisesti täydennetty malli, se loisi päätepisteen automaattisesti täydennettäville malleille ja siihen liittyvän S3-polun automaattisesti täydentäville mallin artefakteille. Jos päätepiste olisi olemassa, kopioimme malliartefaktin S3-polkuun.

Nyt kun meillä oli mallimuotomme MME-malleillemme ja toiminnot mallien käyttöönottamiseksi MME:ssä, tarvitsimme tavan automatisoida käyttöönotto. Käyttäjiemme on määritettävä, mikä malli he haluavat ottaa käyttöön. Hoidamme mallin pakkaamisen ja käyttöönoton. Mallin mukana toimitettu mukautettu päättelykoodi versioitetaan ja välitetään Amazon S3:lle; pakkausvaiheessa vedämme päättelykoodin määritetyn version (tai uusimman version) mukaan ja käytämme YAML-tiedostoja, jotka osoittavat Triton-mallien tiedostorakenteet.

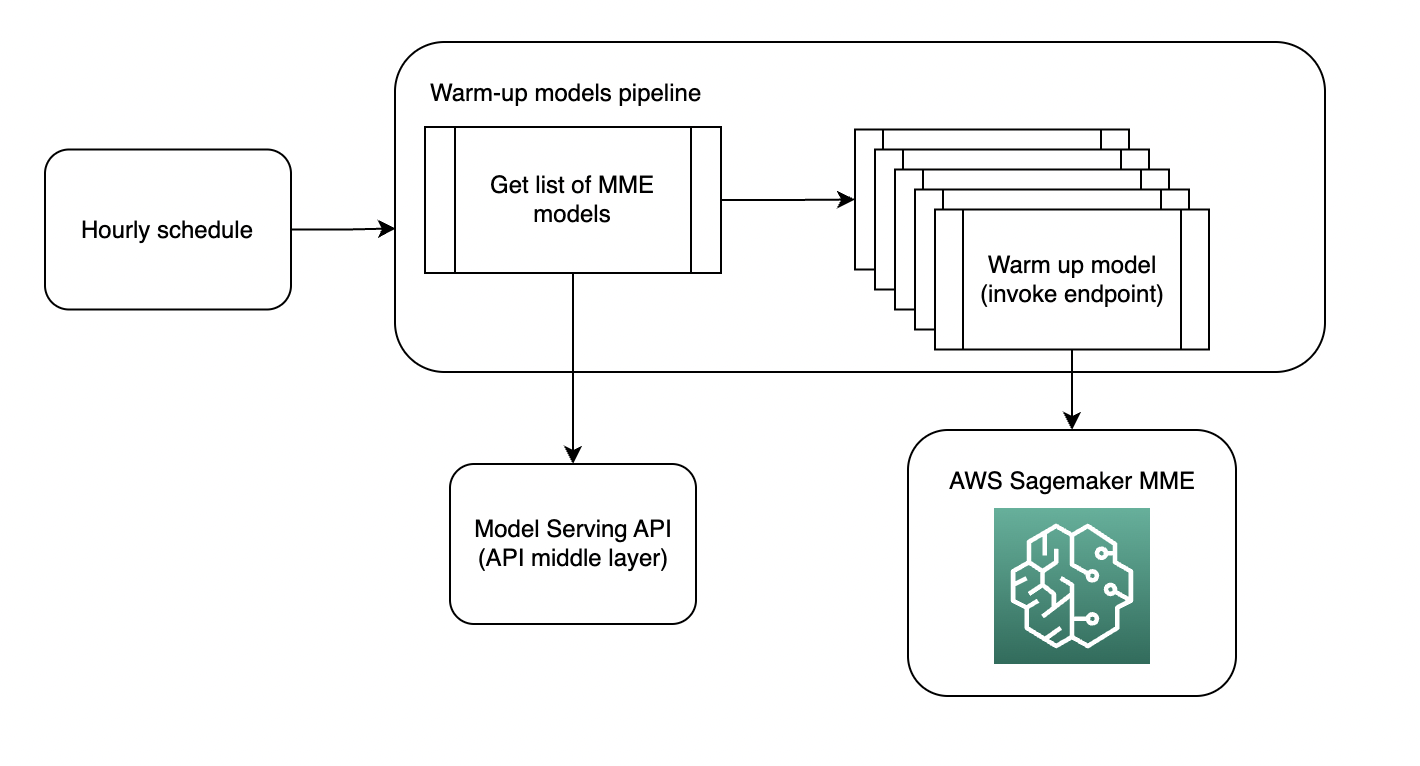

Yksi vaatimus meille oli, että kaikki MME-mallimme ladataan muistiin, jotta vältytään kylmäkäynnistysviiveeltä tuotannon päättelypyyntöjen aikana. Tämän saavuttamiseksi tarjoamme riittävästi resursseja, jotka sopivat kaikkiin malleihimme (edellisen benchmarkingin mukaan) ja kutsumme jokaista MME-malliamme tunnin välein.

Seuraava kaavio havainnollistaa mallin käyttöönottoprosessia.

Seuraava kaavio havainnollistaa mallin lämmitysputkia.

Mallin kutsuminen

Nykyinen API-kerrosmme tarjoaa soittajille abstraktion, jonka avulla he voivat tehdä johtopäätöksiä kaikista ML-malleistamme. Tämä tarkoitti, että meidän täytyi vain lisätä toimintoja API-kerrokseen kutsuaksemme SageMaker MME:tä oikealla kohdemallilla päättelypyynnöstä riippuen ilman muutoksia kutsukoodiin. SageMaker-päätelmäkoodi ottaa päättelypyynnön, muotoilee Triton-malleissamme määritetyt Triton-tulot ja kutsuu MME:t Boto3:n avulla.

Kustannushyödyt

Foretought saavutti merkittäviä harppauksia mallin isännöintikulujen vähentämisessä ja mallien OOM-virheiden lieventämisessä SageMaker MME:ihin siirtymisen ansiosta. Ennen tätä muutosta ml.g4dn.xlarge esiintymät käynnissä Amazon EKS:ssä. Siirtyessämme MME:iin huomasimme, että se voisi sisältää 12 upotusmallia per esiintymä ja samalla saavuttaa 80 % GPU-muistin käyttöasteen. Tämä johti kuukausittaisten kulujemme merkittävään laskuun. Perspektiivistä katsottuna saavutimme jopa 80 %:n kustannussäästön. Suuremman liikenteen hallitsemiseksi harkitsimme myös kopioiden skaalaamista. Olettaen skenaarion, jossa käytämme kolmea kopiota, havaitsimme, että kustannussäästömme olisivat edelleen huomattavat myös näissä olosuhteissa, noin 43 %.

Matka SageMaker MME:iden kanssa on osoittautunut taloudellisesti hyödylliseksi, mikä on vähentänyt kulujamme ja varmistanut mallin optimaalisen suorituskyvyn. Aiemmin automaattisen täydennyksen kielimallimme otettiin käyttöön Amazon EKS:ssä, mikä vaati vaihtelevan määrän ml.g4dn.xlarge-esiintymiä mallikohtaisen muistin varauksen perusteella. Tästä aiheutui huomattavat kuukausikustannukset. Äskettäin SageMaker MME:ihin siirtymisemme myötä olemme kuitenkin pystyneet vähentämään näitä kustannuksia huomattavasti. Isännöimme nyt kaikkia mallejamme ml.g4dn.2xlarge-esiintymissä, mikä antaa meille mahdollisuuden pakata malleja tehokkaammin. Tämä on leikannut kuukausikulujamme merkittävästi, ja nyt olemme saavuttaneet 66–74 %:n kustannussäästöjä. Tämä liike on osoittanut, kuinka tehokas resurssien käyttö voi johtaa merkittäviin taloudellisiin säästöihin käyttämällä SageMaker MME:itä.

Yhteenveto

Tässä viestissä tarkastelimme, kuinka Forethought käyttää SageMakerin usean mallin päätepisteitä vähentääkseen reaaliaikaisten päätelmien kustannuksia. SageMaker ottaa kantaa erittelemättömään raskaiden nostoihin, joten Foretthought voi lisätä suunnittelun tehokkuutta. Sen avulla Forethought voi myös alentaa dramaattisesti reaaliaikaisten päätelmien kustannuksia säilyttäen samalla liiketoimintakriittisten toimintojen edellyttämän suorituskyvyn. Näin Forethought pystyy tarjoamaan asiakkailleen yksilöllisen tarjouksen hyperpersonoitujen mallien avulla. Käytä SageMaker MME:tä isännöimään mallejasi suuressa mittakaavassa ja alentamaan isännöintikustannuksia parantamalla päätepisteiden käyttöä. Se myös vähentää käyttöönoton yleiskustannuksia, koska Amazon SageMaker hallitsee mallien lataamista muistiin ja skaalaa niitä päätepisteesi liikennemallien perusteella. Löydät koodinäytteitä useiden mallien isännöimisestä SageMaker MME:n avulla GitHub.

Tietoja Tekijät

Jad Chamoun on Forethoughtin ydintekniikan johtaja. Hänen tiiminsä keskittyy alustasuunnitteluun, joka kattaa tietotekniikan, koneoppimisinfrastruktuurin ja pilviinfrastruktuurin. Löydät hänet LinkedIn.

Jad Chamoun on Forethoughtin ydintekniikan johtaja. Hänen tiiminsä keskittyy alustasuunnitteluun, joka kattaa tietotekniikan, koneoppimisinfrastruktuurin ja pilviinfrastruktuurin. Löydät hänet LinkedIn.

Salina Wu on vanhempi koneoppimisinfrastruktuuri-insinööri Forethought.ai:ssa. Hän työskentelee tiiviissä koneoppimistiimin kanssa rakentaakseen ja ylläpitääkseen heidän kokonaisvaltaista koulutus-, palvelu- ja datainfrastruktuuriaan. Hän on erityisen motivoitunut esittelemällä uusia tapoja parantaa tehokkuutta ja alentaa kustannuksia koko ML-tilassa. Kun Salina ei ole töissä, hän nauttii surffauksesta, keramiikasta ja luonnossa olemisesta.

Salina Wu on vanhempi koneoppimisinfrastruktuuri-insinööri Forethought.ai:ssa. Hän työskentelee tiiviissä koneoppimistiimin kanssa rakentaakseen ja ylläpitääkseen heidän kokonaisvaltaista koulutus-, palvelu- ja datainfrastruktuuriaan. Hän on erityisen motivoitunut esittelemällä uusia tapoja parantaa tehokkuutta ja alentaa kustannuksia koko ML-tilassa. Kun Salina ei ole töissä, hän nauttii surffauksesta, keramiikasta ja luonnossa olemisesta.

James Park on ratkaisuarkkitehti Amazon Web Servicesissä. Hän työskentelee Amazon.comin kanssa suunnitella, rakentaa ja ottaa käyttöön teknologiaratkaisuja AWS:ssä, ja hän on erityisen kiinnostunut tekoälystä ja koneoppimisesta. Vapaa-ajallaan hän etsii uusia kulttuureja, uusia kokemuksia ja pysyy ajan tasalla uusimpien teknologiatrendien kanssa. Löydät hänet osoitteessa LinkedIn.

James Park on ratkaisuarkkitehti Amazon Web Servicesissä. Hän työskentelee Amazon.comin kanssa suunnitella, rakentaa ja ottaa käyttöön teknologiaratkaisuja AWS:ssä, ja hän on erityisen kiinnostunut tekoälystä ja koneoppimisesta. Vapaa-ajallaan hän etsii uusia kulttuureja, uusia kokemuksia ja pysyy ajan tasalla uusimpien teknologiatrendien kanssa. Löydät hänet osoitteessa LinkedIn.

Sunil Padmanabhan on Startup Solutions -arkkitehti AWS:ssä. Entisenä startup-perustajana ja teknologiajohtajana hän on intohimoinen koneoppimiseen ja keskittyy auttamaan startup-yrityksiä hyödyntämään tekoälyä/ML:ää liiketoimintansa tulosten saavuttamiseksi sekä suunnittelemaan ja ottamaan käyttöön ML/AI-ratkaisuja mittakaavassa.

Sunil Padmanabhan on Startup Solutions -arkkitehti AWS:ssä. Entisenä startup-perustajana ja teknologiajohtajana hän on intohimoinen koneoppimiseen ja keskittyy auttamaan startup-yrityksiä hyödyntämään tekoälyä/ML:ää liiketoimintansa tulosten saavuttamiseksi sekä suunnittelemaan ja ottamaan käyttöön ML/AI-ratkaisuja mittakaavassa.

Dhawal Patel on AWS:n koneoppimisarkkitehti. Hän on työskennellyt organisaatioiden kanssa suurista yrityksistä keskikokoisiin startup-yrityksiin hajautettuun tietojenkäsittelyyn ja tekoälyyn liittyvien ongelmien parissa. Hän keskittyy syväoppimiseen, mukaan lukien NLP- ja Computer Vision -alueet. Hän auttaa asiakkaita tekemään korkean suorituskyvyn mallipäätelmiä SageMakerissa.

Dhawal Patel on AWS:n koneoppimisarkkitehti. Hän on työskennellyt organisaatioiden kanssa suurista yrityksistä keskikokoisiin startup-yrityksiin hajautettuun tietojenkäsittelyyn ja tekoälyyn liittyvien ongelmien parissa. Hän keskittyy syväoppimiseen, mukaan lukien NLP- ja Computer Vision -alueet. Hän auttaa asiakkaita tekemään korkean suorituskyvyn mallipäätelmiä SageMakerissa.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- EVM Finance. Hajautetun rahoituksen yhtenäinen käyttöliittymä. Pääsy tästä.

- Quantum Media Group. IR/PR vahvistettu. Pääsy tästä.

- PlatoAiStream. Web3 Data Intelligence. Tietoa laajennettu. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/how-forethought-saves-over-66-in-costs-for-generative-ai-models-using-amazon-sagemaker/

- :on

- :On

- :ei

- :missä

- $ YLÖS

- 1

- 10

- 100

- 12

- 13

- 15%

- 24

- 250

- 30

- 32

- 7

- 80

- a

- kyky

- pystyy

- Meistä

- abstraktio

- abstrakteja

- kiihtyi

- Mukaan

- tarkkuus

- tarkka

- tarkasti

- Saavuttaa

- saavutettu

- saavuttamisessa

- poikki

- lisätä

- lisä-

- lisää

- Lisäksi

- lisä-

- Lisäksi

- osoite

- käsitellään

- kehittynyt

- Etu

- Jälkeen

- Agentti

- aineet

- AI

- ai käyttötapauksia

- AI / ML

- jonka tarkoituksena

- kohdista

- linjassa

- Kaikki

- jako

- sallia

- mahdollistaa

- jo

- Myös

- Vaikka

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon.com

- määrä

- an

- ja

- Vuosittain

- Toinen

- vastauksia

- Kaikki

- api

- API

- näennäinen

- sopiva

- suunnilleen

- arkkitehtuuri

- OVAT

- noin

- artikkelit

- keinotekoinen

- tekoäly

- AS

- avustaa

- liittyvä

- At

- auto

- automatisoida

- Automatisoitu

- automaattisesti

- keskimäärin

- välttää

- pois

- AWS

- taustaosa

- Balance

- pohja

- perustua

- BE

- tuli

- koska

- tulevat

- ollut

- ennen

- alkaa

- ovat

- benchmarking

- suotuisa

- hyödyttää

- PARAS

- Paremmin

- välillä

- lisäämällä

- sekä

- tuoda

- rakentaa

- sisäänrakennettu

- taakka

- liiketoiminta

- mutta

- by

- Kätkö

- laskettu

- soittaa

- nimeltään

- soittamalla

- Puhelut

- CAN

- ehdokkaat

- kyvyt

- tapaus

- tapauksissa

- Catering

- Aiheuttaa

- haaste

- haasteet

- muuttaa

- Muutokset

- tarkastaa

- valinta

- valitsi

- asiakkaat

- tarkasti

- pilvi

- pilvi infrastruktuuri

- koodi

- kylmä

- Kerääminen

- KOM

- tuleva

- Yhteinen

- Yrityksen

- verrattuna

- yhteensopivuus

- yhteensopiva

- tietokone

- Tietokoneen visio

- tietojenkäsittely

- huolenaiheet

- samanaikainen

- olosuhteet

- tehty

- määritetty

- konservatiivinen

- huomattava

- harkittu

- ottaen huomioon

- Kontti

- pitoisuus

- muunnetaan

- Ydin

- korjata

- vastaa

- Hinta

- kustannussäästöjä

- kustannustehokas

- kallis

- kustannukset

- voisi

- päällyste

- luoda

- luotu

- Luominen

- ratkaiseva

- CTO

- asiakassuhde

- asiakas

- asiakastiedot

- Asiakastyytyväisyys

- Asiakaspalvelu

- Asiakaspalvelu

- Asiakkaat

- räätälöityjä

- tiedot

- Päivämäärä

- Hylkää

- vähentää

- syvä

- syvä oppiminen

- määritelty

- määrittelemällä

- toimittaa

- tuottaa

- osoittivat

- Riippuen

- sijoittaa

- käyttöön

- levityspinnalta

- käyttöönotto

- käyttöönotot

- Malli

- haluttu

- Huolimatta

- Määrittää

- määritetty

- määrittää

- määritetään

- kehitetty

- kehittäjille

- laite

- DID

- eri

- eriytetty

- Johtaja

- löysi

- selvä

- jaettu

- hajautettu laskenta

- tekee

- verkkotunnuksen

- verkkotunnuksia

- Dont

- dramaattisesti

- aikana

- dynaaminen

- dynaamisesti

- kukin

- tehokkuus

- tehokas

- tehokkaasti

- upottamisen

- mahdollistaa

- mahdollistaa

- päittäin

- päätepiste

- harjoittaa

- insinööri

- Tekniikka

- parantaa

- parantaa

- tarpeeksi

- varmistaa

- varmistamalla

- yrityksille

- ympäristö

- virheet

- Jopa

- Joka

- esimerkki

- olemassa

- odotettu

- kulut

- kallis

- experience

- Elämykset

- kokeilu

- ulkoinen

- nopeampi

- filee

- Asiakirjat

- täyttää

- taloudellinen

- taloudellisesti

- Löytää

- Etunimi

- sovittaa

- LAIVASTON

- Joustavuus

- keskittyy

- jälkeen

- varten

- muoto

- Entinen

- löytyi

- perustaja

- neljä

- alkaen

- täysin

- toiminnallisuus

- edelleen

- Lisäksi

- aukkoja

- tuottaa

- syntyy

- generatiivinen

- Generatiivinen AI

- saada

- gif

- tietty

- Antaminen

- tavoite

- GPU

- GPU

- kaltevuudet

- HAD

- käsi

- kahva

- Vetimet

- Käsittely

- tapahtua

- Palvelimet

- Olla

- ottaa

- he

- raskas

- raskas nosto

- auttaa

- auttaa

- auttaa

- Korkea

- korkea suorituskyky

- korkeampi

- häntä

- hänen

- huppu

- isäntä

- hotellit

- isännöintikulut

- TUNTIA

- Talo

- Miten

- Kuitenkin

- HTML

- http

- HTTPS

- Sadat

- tunnistettu

- if

- havainnollistaa

- heti

- parantaa

- parantaminen

- in

- Inc.

- Mukaan lukien

- Saapuva

- Kasvaa

- osoittaa

- ilmoitettu

- tiedot

- Infrastruktuuri

- infrastruktuuri

- innovatiivinen

- panos

- tuloa

- esimerkki

- sen sijaan

- Integrointi

- integraatio

- Älykkyys

- vuorovaikutus

- vuorovaikutukset

- korko

- tulee

- käyttöön

- kutsuttuihin

- vedotaan

- osallistuva

- kysymys

- IT

- SEN

- itse

- matka

- jpg

- vain

- pito

- avain

- Tietää

- tuntemus

- Kieli

- suuri

- Suuret yritykset

- suurempi

- Viive

- uusin

- kerros

- johtaa

- johtava

- oppiminen

- vähiten

- Led

- Perintö

- vähemmän

- Vaikutusvalta

- vipusuhteita

- nosto

- kuormitus

- lastaus

- kuormat

- logiikka

- Matala

- alentaa

- kone

- koneoppiminen

- tehty

- tärkein

- ylläpitää

- ylläpitäminen

- tehdä

- hoitaa

- onnistui

- johto

- hallinnoi

- toimitusjohtaja

- monet

- markkinat

- maksimointi

- tarkoitti

- Muisti

- Metadata

- Metrics

- siirtyvät

- muutto

- miljoona

- minimi

- vähäinen

- lieventävä

- ML

- malli

- mallit

- monitori

- kuukausittain

- lisää

- Lisäksi

- eniten

- motivoituneita

- liikkua

- liikkuvat

- paljon

- Monen mallin päätepiste

- moninkertainen

- täytyy

- syntyperäinen

- luonto

- välttämätön

- Tarve

- tarvitaan

- tarpeet

- Uusi

- NLP

- nyt

- numero

- Nvidia

- tavoite

- of

- pois

- kampanja

- tarjoamalla

- Tarjoukset

- usein

- on

- kerran

- ONE

- vain

- Operations

- Tilaisuus

- optimaalinen

- optimoimalla

- or

- tilata

- organisaatioiden

- Muut

- meidän

- itse

- ulos

- tuloksiin

- yli

- yön aikana

- Pakkaus

- paketti

- pakattu

- pakkaus

- erityinen

- erityisesti

- intohimoinen

- läikkä

- polku

- Kuvio

- kuviot

- suorituskyky

- näkökulma

- putki

- foorumi

- Platon

- Platonin tietotieto

- PlatonData

- Kohta

- politiikkaa

- politiikka

- Kirje

- teho

- powered

- esitetty

- edellinen

- aiemmin

- ensisijainen

- Pääasiallinen

- Aikaisempi

- ongelmia

- prosessi

- käsittely

- Tuotteet

- tuotanto

- tuottavuus

- asianmukainen

- todistettu

- toimittaa

- mikäli

- tarjoaa

- säännös

- työntää

- laittaa

- Python

- pytorch

- laatu

- kyselyt

- etsintä

- nopeasti

- alue

- alainen

- Sijoitus

- tavoittaa

- reaaliaikainen

- tajusi

- äskettäinen

- äskettäin

- vähentää

- vähentää

- vähentämällä

- liittyvä

- Merkitys

- merkityksellinen

- luotettavuus

- luotettava

- jäännökset

- edustettuina

- pyyntö

- pyynnöt

- tarvitaan

- vaatimus

- vaatimukset

- Vaatii

- resurssi

- Esittelymateriaalit

- vasteet

- vastuut

- vastuullinen

- johtua

- Saatu ja

- tulokset

- tarkistetaan

- oikein

- jäykkä

- juuri

- ajaa

- juoksu

- uhraa

- sagemaker

- SageMaker-johtopäätös

- sama

- tyytyväisyys

- Säästä

- tallentaa

- Säästöt

- näki

- skaalautuvuus

- skaalautuva

- Asteikko

- skaalata

- asteikot

- skaalaus

- skenaario

- skenaariot

- tutkijat

- Haku

- turvallisuus

- etsiä

- vanhempi

- erillinen

- Järjestys

- Sarjat

- palvella

- palvelu

- Palvelut

- palvelevat

- setti

- useat

- varjo

- muodot

- Jaa:

- yhteinen

- hän

- merkittävä

- merkittävästi

- samankaltainen

- Yksinkertainen

- yksinkertaistaa

- single

- Koko

- pieni

- fiksu

- So

- ratkaisu

- Ratkaisumme

- SOLVE

- jonkin verran

- Tila

- erityinen

- erityisesti

- määritelty

- piikki

- näyttämöllepano

- Alkaa

- alkoi

- käynnistyksen

- Startups

- huippu-

- Vaihe

- Askeleet

- Yhä

- Levytila

- suora

- harppauksia

- merkittävä

- niin

- sviitti

- tuki

- järjestelmät

- taulukko

- puuttua

- Räätälöity

- ottaa

- vie

- Kohde

- kohdennettu

- tavoitteet

- Tehtävä

- joukkue-

- tiimit

- Technologies

- Elektroniikka

- testattu

- testit

- kuin

- Kiitos

- että

- -

- heidän

- Niitä

- Nämä

- ne

- tätä

- kolmella

- Kautta

- liput

- aika

- aikaavievä

- että

- tokens

- ylin

- Yhteensä

- liikenne

- Juna

- koulutettu

- koulutus

- siirtää

- Muuttaa

- siirtyminen

- Trendit

- kokeillut

- Triton

- Kahdesti

- kaksi

- tyyppi

- tyypit

- varten

- unique

- us

- Käyttö

- käyttää

- käyttölaukku

- käytetty

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- Hyödyntämällä

- versio

- hyvin

- visio

- vs

- haluta

- halusi

- oli

- Tapa..

- tavalla

- we

- verkko

- verkkopalvelut

- olivat

- kun

- onko

- joka

- vaikka

- with

- ilman

- Referenssit

- työskenteli

- toimii

- huoli

- olisi

- kirjoittaminen

- wu

- yaml

- Voit

- Sinun

- zephyrnet