Tämä blogiviesti on kirjoitettu yhdessä Deepsetin Tuana Çelikin kanssa.

Yrityshaku on kriittinen osa organisaation tehokkuutta asiakirjojen digitalisoinnin ja tiedonhallinnan kautta. Yrityshaku kattaa asiakirjojen, kuten digitaalisten tiedostojen, tallentamisen, asiakirjojen indeksoinnin hakua varten ja osuvien tulosten tarjoamisen käyttäjien kyselyjen perusteella. Suurten kielimallien (LLM) myötä voimme toteuttaa keskustelukokemuksia tulosten tarjoamisessa käyttäjille. Meidän on kuitenkin varmistettava, että LLM:t rajoittavat vastauksia yritystietoihin ja vähentävät siten mallihalusinaatioita.

Tässä viestissä esittelemme, kuinka luodaan päästä päähän generatiivinen tekoälysovellus yrityshakuun Retrieval Augmented Generation (RAG) -tekniikalla käyttämällä Haystack-putkia ja Falcon-40b-ohjemallia Amazon SageMaker JumpStart ja Amazon OpenSearch-palvelu. Tässä viestissä esitellyn näytteen lähdekoodi on saatavilla osoitteessa GitHub-arkisto

Ratkaisun yleiskatsaus

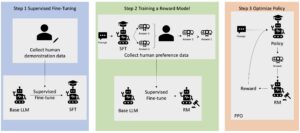

Rajoittaaksemme generatiiviset tekoälysovellusvastaukset vain yritystietoihin, meidän on käytettävä tekniikkaa nimeltä Retrieval Augmented Generation (RAG). RAG-lähestymistapaa käyttävä sovellus hakee käyttäjän pyyntöön oleellisimmat tiedot yrityksen tietokannasta tai sisällöstä, niputtaa ne kontekstiksi käyttäjän pyyntöön kehotteena ja lähettää sen sitten LLM:lle saadakseen vastauksen. LLM:illä on rajoituksia syöttökehotteiden enimmäissanamäärän suhteen, joten oikeiden kohtien valitseminen tuhansien tai miljoonien asiakirjojen joukosta yrityksessä vaikuttaa suoraan LLM:n tarkkuuteen.

RAG-tekniikasta on tullut yhä tärkeämpi yrityshaussa. Tässä viestissä näytämme työnkulun, jossa hyödynnetään SageMaker JumpStartia Falcon-40b-ohjemallin käyttöönotossa ja Haystackin avulla suunnitellaan ja ajetaan haun lisätty kysymysvastausputki. Viimeinen noudon lisäyksen työnkulku kattaa seuraavat korkean tason vaiheet:

- Käyttäjäkyselyä käytetään noutajakomponentille, joka tekee vektorihaun hakeakseen tärkeimmän kontekstin tietokannastamme.

- Tämä konteksti on upotettu kehotteeseen, joka on suunniteltu ohjeistamaan LLM:ää luomaan vastaus vain tarjotusta kontekstista.

- LLM luo vastauksen alkuperäiseen kyselyyn vain huomioimalla sen vastaanottamaan kehotteeseen upotetun kontekstin.

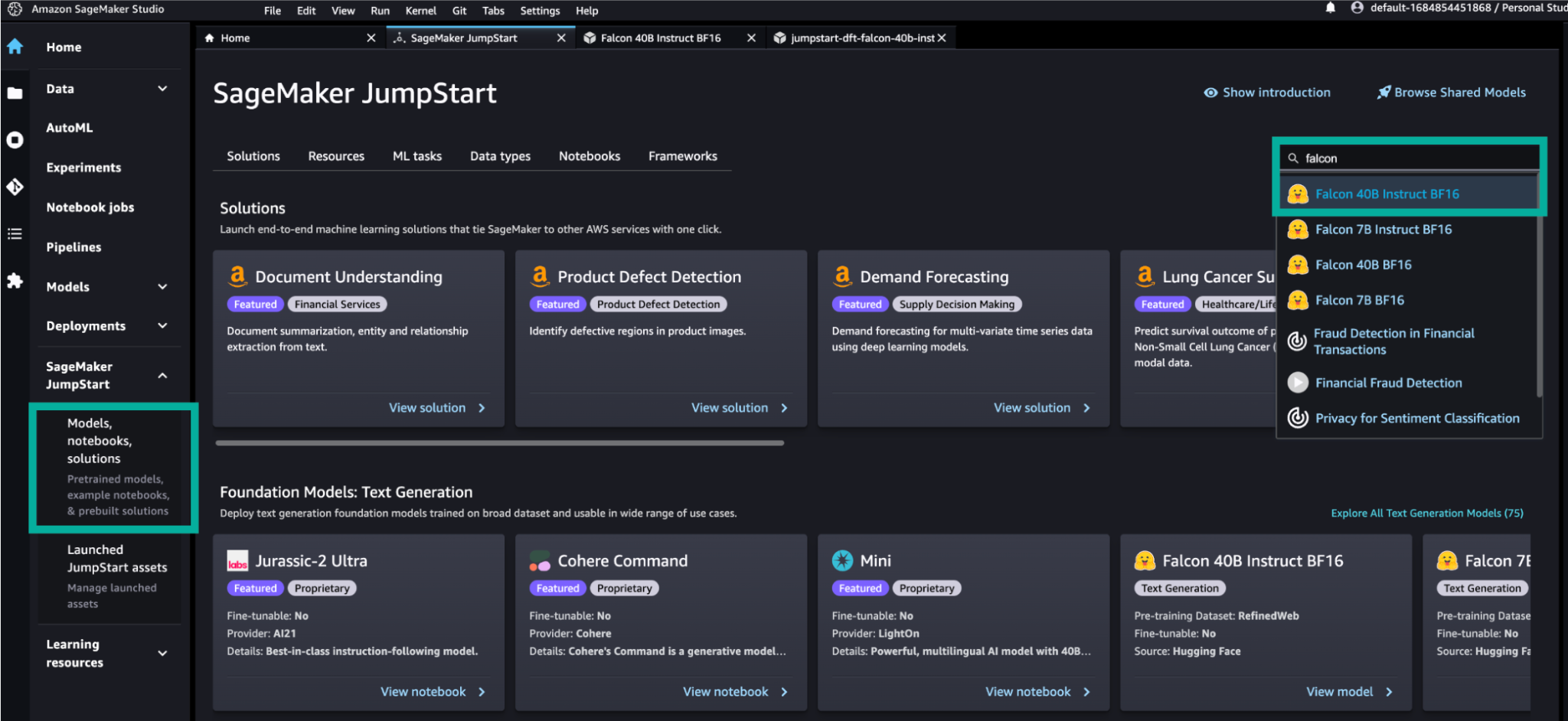

SageMaker JumpStart

SageMaker JumpStart toimii mallikeskuksena, joka sisältää laajan valikoiman syväoppimismalleja tekstin, näön, äänen ja upotuksen käyttötapauksiin. Sen yli 500 mallia sisältävä mallikeskus sisältää sekä julkisia että omia malleja AWS:n kumppaneilta, kuten AI21, Stability AI, Cohere ja LightOn. Se isännöi myös yksinomaan Amazonin kehittämiä perusmalleja, kuten AlexaTM. Jotkin mallit tarjoavat mahdollisuuden hienosäätää niitä omilla tiedoillasi. SageMaker JumpStart tarjoaa myös ratkaisumalleja, jotka määrittävät infrastruktuurin yleisiin käyttötapauksiin, ja suoritettavia esimerkkimuistikirjoja koneoppimista (ML) varten SageMakerin avulla.

heinäsuova

heinäsuova on Deepsetin avoimen lähdekoodin kehys, jonka avulla kehittäjät voivat organisoida LLM-sovelluksia, jotka koostuvat eri komponenteista, kuten malleista, vektoritietokannoista, tiedostomuuntimista ja lukemattomista muista moduuleista. Heinäsuovasta tarjoaa putkistojen ja Kiinteistönvälittäjät, kaksi tehokasta rakennetta LLM-sovellusten suunnitteluun erilaisiin käyttötapauksiin, mukaan lukien haku, kysymyksiin vastaaminen ja keskustelullinen tekoäly. Se keskittyy suuresti huippuluokan hakumenetelmiin ja vankoihin arviointimittauksiin, joten se tarjoaa sinulle kaiken, mitä tarvitset luotettavan ja luotettavan sovelluksen toimittamiseen. Voit sarjoittaa putkia YAML tiedostot, paljasta ne kautta a REST API, ja skaalata ne joustavasti työkuormituksiesi mukaan, jolloin sovelluksesi siirtäminen prototyyppivaiheesta tuotantoon on helppoa.

Amazon OpenSearch

OpenSearch Service on täysin hallittu palvelu, jonka avulla on helppo ottaa käyttöön, skaalata ja käyttää OpenSearchia AWS-pilvessä. OpenSearch on skaalautuva, joustava ja laajennettava avoimen lähdekoodin ohjelmistopaketti haku-, analytiikka-, turvallisuusseuranta- ja havainnointisovelluksiin, ja se on lisensoitu Apache 2.0 -lisenssillä.

Viime vuosina ML-tekniikat ovat tulleet yhä suositummiksi hakujen tehostamiseksi. Niiden joukossa on käyttö upotetut mallit, malli, joka voi koodata suuren määrän dataa n-ulotteiseen tilaan, jossa jokainen entiteetti on koodattu vektori, tietopiste kyseisessä tilassa ja järjestetty siten, että samanlaiset kokonaisuudet ovat lähempänä toisiaan. Vektoritietokanta tarjoaa tehokkaan vektorien samankaltaisuushaun tarjoamalla erikoistuneita indeksejä, kuten k-NN-indeksejä.

OpenSearch Servicen vektoritietokantaominaisuuksien avulla voit toteuttaa semanttisen haun, RAG:n LLM:illä, suosituskoneita ja etsiä multimediaa. Tässä viestissä käytämme RAG:tä täydentämään generatiivisia LLM:itä ulkoisella tietopohjalla, joka on tyypillisesti rakennettu käyttämällä vektoritietokantaa, joka on hydratoitu vektorikoodatuilla tietoartikkeleilla.

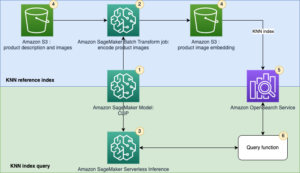

Sovelluksen yleiskatsaus

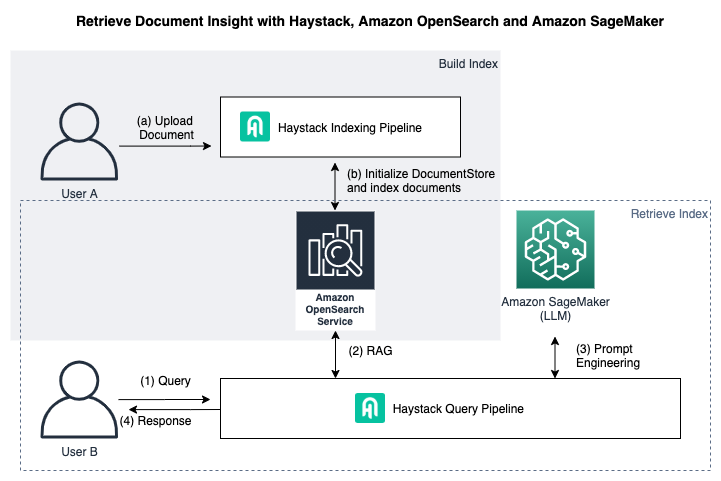

Seuraava kaavio esittää lopullisen sovelluksen rakenteen.

Tässä sovelluksessa käytämme Haystack Indexing Pipelineä ladattujen asiakirjojen ja hakemistoasiakirjojen hallintaan ja Haystack Query Pipelineä tietojen hakemiseen indeksoiduista asiakirjoista.

Haystack Indexing Pipeline sisältää seuraavat korkean tason vaiheet:

- Lataa asiakirja.

- Alustaa

DocumentStoreja hakemistoasiakirjoja.

Käytämme OpenSearchia Asiakirjakauppa ja heinäsuovasta indeksointiputki esikäsitelläksemme ja indeksoidaksemme tiedostomme OpenSearchiin. Heinäsuovasta Tiedostomuuntimet ja Esiprosessori voit puhdistaa ja valmistella raakatiedostosi sellaiseen muotoon ja muotoon, jota valitsemasi luonnollisen kielen käsittelyprosessi (NLP) ja kielimalli voivat käsitellä. Myös tässä käyttämämme indeksointiputkisto käyttää sentence-transformers/all-MiniLM-L12-v2 luoda upotuksia jokaiselle asiakirjalle, joita käytämme tehokkaaseen noutoon.

Haystack Query Pipeline sisältää seuraavat korkean tason vaiheet:

- Lähetämme kyselyn RAG-putkeen.

- An EmbeddingRetriever komponentti toimii suodattimena, joka hakee tärkeimmät

top_kdokumentteja OpenSearchin indeksoiduista asiakirjoistamme. Käytämme valitsemaamme upotusmallia upottaaksemme sekä kyselyn että asiakirjat (indeksoinnin yhteydessä) saavuttaaksemme tämän. - Haetut asiakirjat upotetaan kehotteeseemme Falcon-40b-ohjemalliin.

- LLM palauttaa vastauksen, joka perustuu haettuihin asiakirjoihin.

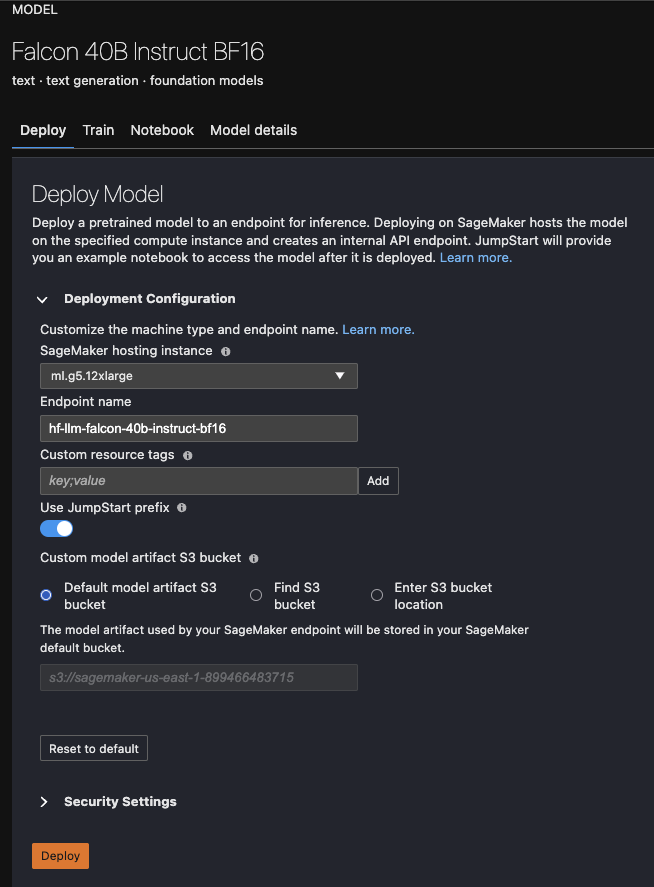

Mallin käyttöönottoon käytämme SageMaker JumpStartia, joka yksinkertaistaa mallien käyttöönottoa yksinkertaisella napin painalluksella. Vaikka olemme käyttäneet ja testanneet Falcon-40b-ohjetta tässä esimerkissä, voit käyttää mitä tahansa SageMakerissa saatavilla olevaa Hugging Face -mallia.

Lopullinen ratkaisu on saatavilla osoitteessa heinäsuovasta-salvia arkiston ja käyttää OpenSearch-verkkosivustoa ja dokumentaatiota (OpenSearch 2.7:lle) esimerkkitietoina suorittaakseen lisätyn kysymyksen vastausta.

Edellytykset

Ensimmäinen asia, joka on tehtävä ennen kuin voimme käyttää AWS-palveluita, on varmistaa, että olemme rekisteröityneet ja luoneet AWS-tilin. Sitten sinun tulee luoda järjestelmänvalvojan käyttäjä ja ryhmä. Katso molempien vaiheiden ohjeet kohdasta Määritä Amazon SageMakerin edellytykset.

Jotta voit käyttää Heinäsuovasta, sinun on asennettava farm-haystack paketti tarvittavilla riippuvuuksilla. Suorittaaksesi tämän, käytä requirements.txt Tiedosto GitHub-arkisto juoksemalla pip install requirements.txt.

Indeksoi asiakirjat OpenSearchiin

Haystack tarjoaa useita liittimiä tietokantoihin, joita kutsutaan DocumentStores. Tässä RAG-työnkulussa käytämme OpenSearchDocumentStore. Esimerkki säilytyspaikka sisältää indeksointiputken ja AWS-pilven muodostuminen sapluuna perustaa OpenSearchDocumentStore OpenSearch-verkkosivustolta ja dokumentaatiosivuilta indeksoitujen asiakirjojen kanssa.

Usein joudumme miettimään tietojen valmistelua ja puhdistusta saadaksemme NLP-sovelluksen toimimaan tuotantokäyttöön. Tämä on peitetty Heinäsuovasta indeksointiputket, jonka avulla voit suunnitella omat tietojen valmisteluvaiheet, jotka lopulta kirjoittavat asiakirjasi valitsemaasi tietokantaan.

Indeksointiputkessa voi myös olla vaihe, jolla luodaan upotuksia asiakirjoillesi. Tämä on erittäin tärkeää hakuvaiheen kannalta. Esimerkissämme käytämme lause-muuntajat/all-MiniLM-L12-v2 kuin upotusmallimme. Tätä mallia käytetään upotusten luomiseen kaikille indeksoiduille asiakirjoillemme, mutta myös käyttäjän kyselylle kyselyn aikana.

Asiakirjojen indeksointi OpenSearchDocumentStore, tarjoamme kaksi vaihtoehtoa yksityiskohtaisten ohjeiden kera LUEMINUT esimerkkiarkistosta. Tässä käydään läpi vaiheet indeksoimiseksi OpenSearch-palveluun, joka on otettu käyttöön AWS:ssä.

Käynnistä OpenSearch-palvelu

Käytä mukana toimitettua CloudFormation -malli OpenSearch-palvelun luomiseksi AWS:ssä. Suorittamalla seuraavan komennon sinulla on tyhjä OpenSearch-palvelu. Voit sitten joko indeksoida toimittamiamme esimerkkitietoja tai käyttää omia tietojasi, jotka voit puhdistaa ja esikäsitellä Heinäsuovasta indeksointiputki. Huomaa, että tämä luo Internetille avoimen ilmentymän, jota ei suositella tuotantokäyttöön.

Odota pinon käynnistämiseen noin 30 minuuttia. Voit tarkistaa sen edistymisen AWS CloudFormation -konsolissa siirtymällä kohtaan Stacks sivua ja etsii pinoa nimeltä HaystackOpensearch.

Indeksoi asiakirjat OpenSearchiin

Nyt kun meillä on käynnissä OpenSearch-palvelu, voimme käyttää OpenSearchDocumentStore-luokkaa muodostaaksemme yhteyden siihen ja kirjoittaaksemme dokumenttejamme siihen.

Saadaksesi isäntänimen OpenSearchille, suorita seuraava komento:

Vie ensin seuraavat:

Sitten voit käyttää opensearch_indexing_pipeline.py komentosarja toimitettujen demotietojen esikäsittelyä ja indeksointia varten.

Jos haluat käyttää omia tietojasi, muokkaa indeksointiputkea opensearch_indexing_pipeline.py sisällyttää FileConverter ja Esiprosessori tarvitsemasi asennusvaiheet.

Ota käyttöön noudon lisätty kysymysvastausputki

Nyt kun olemme indeksoineet tiedot OpenSearchissa, voimme vastata kysymyksiin näille asiakirjoille. Tässä RAG-putkilinjassa käytämme Falcon-40b-ohjemallia, jonka olemme ottaneet käyttöön SageMaker JumpStartissa.

Voit myös ottaa mallin käyttöön ohjelmallisesti Jupyter-muistikirjasta. Katso ohjeet osoitteesta GitHub repo.

- Etsi Falcon-40b-ohjemalli SageMaker JumpStartista.

- Ota mallisi käyttöön SageMaker JumpStartissa ja huomioi päätepisteen nimi.

- Vie seuraavat arvot:

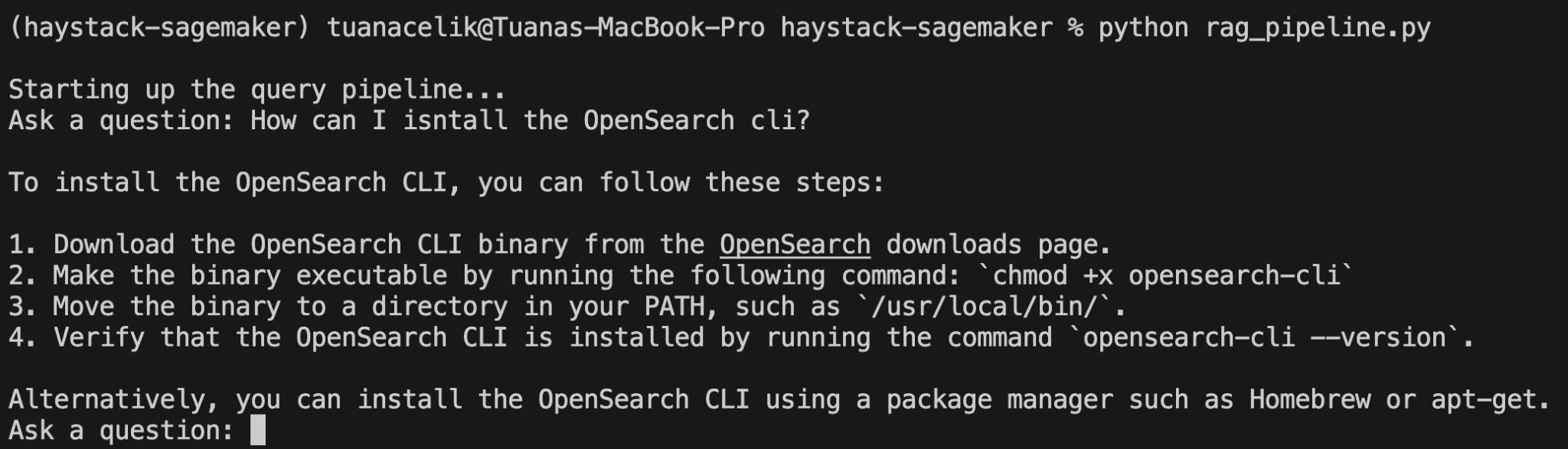

- ajaa

python rag_pipeline.py.

Tämä käynnistää komentorivityökalun, joka odottaa käyttäjän kysymystä. Kysytään esimerkiksi "Kuinka voin asentaa OpenSearch cli?"

Tämä tulos saavutetaan, koska olemme määrittäneet kehotteen Haystack Prompt Template olla seuraava:

Muita mukautuksia

Voit tehdä lisämuokkauksia ratkaisun eri elementteihin, kuten seuraavat:

- Tiedot – Olemme tarjonneet OpenSearchin dokumentointi ja verkkosivusto data esimerkkitietona. Muista muokata

opensearch_indexing_pipeline.pyskripti tarpeidesi mukaan, jos päätit käyttää omia tietojasi. - Malli – Tässä esimerkissä olemme käyttäneet Falcon-40b-ohjemallia. Voit vapaasti ottaa käyttöön ja käyttää mitä tahansa muuta Hugging Face -mallia SageMakerissa. Huomaa, että mallin vaihtaminen tarkoittaa todennäköisesti sitä, että kehote tulee mukauttaa johonkin, joka on suunniteltu käsittelemään sitä.

- kehote – Tätä postausta varten loimme oman

PromptTemplatejoka ohjaa mallia vastaamaan kysymyksiin tarjotun kontekstin perusteella ja vastaamaan "en tiedä", jos konteksti ei sisällä oleellista tietoa. Voit muuttaa tätä kehotetta kokeillaksesi erilaisia kehotteita Falcon-40b-ohjeella. Voit myös yksinkertaisesti vetää joitain kehotteitamme PromptHub. - Upotusmalli – Hakuvaiheessa käytämme kevyttä upotusmallia: lause-muuntajat/all-MiniLM-L12-v2. Voit kuitenkin myös muuttaa tätä tarpeidesi mukaan. Muista muokata odotettuja upotusmittoja

DocumentStorevastaavasti. - Haettujen asiakirjojen määrä – Voit myös leikkiä pyytämiesi asiakirjojen määrällä

EmbeddingRetrievernoudettavaksi jokaiselle kyselylle. Asetuksissamme tämä on asetettu top_k=5. Voit kokeilla muuttaa tätä lukua nähdäksesi, parantaako kontekstin lisääminen tulostesi tarkkuutta.

Tuotantovalmius

Tässä viestissä ehdotettu ratkaisu voi nopeuttaa projektin kehitysprosessin arvon saavuttamista. Voit rakentaa projektin, joka on helppo skaalata AWS Cloudin tietoturva- ja yksityisyysympäristön avulla.

Turvallisuuden ja yksityisyyden vuoksi OpenSearch Service tarjoaa tietosuojan identiteetin ja pääsyn hallinta ja palvelujen välinen sekava välityspalvelimen esto. Voit käyttää hienorakeista käyttäjän pääsynhallintaa, jotta käyttäjä pääsee käsiksi vain niihin tietoihin, joihin hänellä on lupa. Lisäksi SageMaker tarjoaa konfiguroitavia suojausasetuksia kulunvalvonta, tietosuojaja kirjaaminen ja seuranta. Voit suojata tietojasi lepotilassa ja siirron aikana AWS-avainhallintapalvelu (AWS KMS) avaimet. Voit myös seurata SageMaker-mallin käyttöönoton tai päätepisteen käytön lokia käyttämällä amazonin pilvikello. Lisätietoja on kohdassa Seuraa Amazon SageMakeria Amazon CloudWatch -sovelluksella.

OpenSearch Servicen korkean skaalautuvuuden vuoksi voit säätää sitä OpenSearch Service -verkkotunnusten koon määrittäminen ja työllistäminen toiminnan parhaita käytäntöjä. Voit myös hyödyntää SageMaker-päätepisteesi automaattista skaalausta – voit automaattisesti skaalautuvat SageMaker-mallit säätää päätepistettä sekä silloin, kun liikennettä kasvaa tai resursseja ei käytetä.

Puhdistaa

Kustannusten säästämiseksi poista kaikki resurssit, jotka otit käyttöön osana tätä viestiä. Jos käynnistit CloudFormation-pinon, voit poistaa sen AWS CloudFormation -konsolin kautta. Vastaavasti voit poistaa kaikki SageMaker-päätepisteet, jotka olet luonut SageMaker-konsolin kautta.

Yhteenveto

Tässä viestissä esittelimme, kuinka luodaan päästä päähän generatiivinen tekoälysovellus yrityshakuun RAG:n avulla käyttämällä Haystack-putkia ja Falcon-40b-ohjemallia SageMaker JumpStartista ja OpenSearch Servicestä. RAG-lähestymistapa on kriittinen yrityshaussa, koska se varmistaa, että luodut vastaukset ovat toimialueen sisällä ja vähentävät siten hallusinaatioita. Käyttämällä Haystack-putkia pystymme organisoimaan LLM-sovelluksia, jotka koostuvat erilaisista komponenteista, kuten malleista ja vektoritietokannoista. SageMaker JumpStart tarjoaa meille yhden napsautuksen ratkaisun LLM:ien käyttöönottoon, ja käytimme OpenSearch-palvelua indeksoitujen tietojen vektoritietokantana. Voit alkaa kokeilla ja rakentaa RAG-konseptitodistuksia yrityksesi luoville tekoälysovelluksille käyttämällä tässä viestissä esitettyjä vaiheita ja julkaisussa saatavilla olevaa lähdekoodia. GitHub-arkisto.

Tietoja Tekijät

Tuana Celik on Developer Advocate Develsetissä, jossa hän keskittyy Haystackin avoimen lähdekoodin yhteisöön. Hän johtaa kehittäjäsuhdetoimintoa ja puhuu säännöllisesti tapahtumissa NLP:stä ja luo oppimateriaaleja yhteisölle.

Tuana Celik on Developer Advocate Develsetissä, jossa hän keskittyy Haystackin avoimen lähdekoodin yhteisöön. Hän johtaa kehittäjäsuhdetoimintoa ja puhuu säännöllisesti tapahtumissa NLP:stä ja luo oppimateriaaleja yhteisölle.

Roy Allela on vanhempi AI/ML Specialist Solutions -arkkitehti AWS:ssä Münchenissä, Saksassa. Roy auttaa AWS-asiakkaita – pienistä startupeista suuriin yrityksiin – kouluttamaan ja ottamaan käyttöön suuria kielimalleja tehokkaasti AWS:ssä. Roy on intohimoinen laskennallisiin optimointiongelmiin ja tekoälyn työkuormien suorituskyvyn parantamiseen.

Roy Allela on vanhempi AI/ML Specialist Solutions -arkkitehti AWS:ssä Münchenissä, Saksassa. Roy auttaa AWS-asiakkaita – pienistä startupeista suuriin yrityksiin – kouluttamaan ja ottamaan käyttöön suuria kielimalleja tehokkaasti AWS:ssä. Roy on intohimoinen laskennallisiin optimointiongelmiin ja tekoälyn työkuormien suorituskyvyn parantamiseen.

Mia Chang on ML Specialist Solutions -arkkitehti Amazon Web Servicesille. Hän työskentelee asiakkaiden kanssa EMEA-alueella ja jakaa parhaita käytäntöjä tekoälyn/ML-työkuormien suorittamiseen pilvessä taustansa soveltavan matematiikan, tietojenkäsittelytieteen ja tekoälyn/ML:n alalla. Hän keskittyy NLP-spesifisiin työkuormiin ja jakaa kokemuksiaan konferenssipuhujana ja kirjailijana. Vapaa-ajallaan hän harrastaa patikointia, lautapelejä ja kahvin keittämistä.

Mia Chang on ML Specialist Solutions -arkkitehti Amazon Web Servicesille. Hän työskentelee asiakkaiden kanssa EMEA-alueella ja jakaa parhaita käytäntöjä tekoälyn/ML-työkuormien suorittamiseen pilvessä taustansa soveltavan matematiikan, tietojenkäsittelytieteen ja tekoälyn/ML:n alalla. Hän keskittyy NLP-spesifisiin työkuormiin ja jakaa kokemuksiaan konferenssipuhujana ja kirjailijana. Vapaa-ajallaan hän harrastaa patikointia, lautapelejä ja kahvin keittämistä.

Inaam Syed on AWS:n Startup Solutions -arkkitehti, joka keskittyy vahvasti B2B- ja SaaS-aloitusyritysten auttamiseen skaalaamisessa ja kasvun saavuttamisessa. Hänellä on syvä intohimo palvelimettomiin arkkitehtuureihin ja AI/ML:ään. Vapaa-ajallaan Inaam nauttii laadukkaista hetkistä perheensä kanssa ja antautuu rakkaudelleen pyöräilyyn ja sulkapalloon.

Inaam Syed on AWS:n Startup Solutions -arkkitehti, joka keskittyy vahvasti B2B- ja SaaS-aloitusyritysten auttamiseen skaalaamisessa ja kasvun saavuttamisessa. Hänellä on syvä intohimo palvelimettomiin arkkitehtuureihin ja AI/ML:ään. Vapaa-ajallaan Inaam nauttii laadukkaista hetkistä perheensä kanssa ja antautuu rakkaudelleen pyöräilyyn ja sulkapalloon.

David Tippett on Senior Developer Advocate, joka työskentelee avoimen lähdekoodin OpenSearchin parissa AWS:ssä. Hänen työnsä kattaa kaikki OpenSearchin osa-alueet hausta ja relevanssista havainnointi- ja turvallisuusanalytiikkaan.

David Tippett on Senior Developer Advocate, joka työskentelee avoimen lähdekoodin OpenSearchin parissa AWS:ssä. Hänen työnsä kattaa kaikki OpenSearchin osa-alueet hausta ja relevanssista havainnointi- ja turvallisuusanalytiikkaan.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. Autot / sähköautot, hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- ChartPrime. Nosta kaupankäyntipeliäsi ChartPrimen avulla. Pääsy tästä.

- BlockOffsets. Ympäristövastuun omistuksen nykyaikaistaminen. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :on

- :On

- :ei

- :missä

- $ YLÖS

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- pystyy

- Meistä

- kiihdyttää

- pääsy

- suorittaa

- sen mukaisesti

- Tili

- tarkkuus

- Saavuttaa

- saavutettu

- saavuttamisessa

- säädökset

- sopeuttaa

- lisä-

- Lisäksi

- hallinnollinen

- Etu

- tulo

- puolestapuhuja

- AI

- AI / ML

- Kaikki

- sallia

- mahdollistaa

- pitkin

- Myös

- Vaikka

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- keskuudessa

- an

- Analytics

- ja

- vastaus

- Kaikki

- Apache

- Hakemus

- sovellukset

- sovellettu

- lähestymistapa

- suunnilleen

- OVAT

- alueet

- noin

- Ryhmä

- Art

- artikkelit

- AS

- avustaminen

- At

- audio-

- täydennetty

- kirjoittaja

- valtuutettu

- auto

- saatavissa

- AWS

- AWS-pilven muodostuminen

- B2B

- tausta

- pohja

- perustua

- BE

- koska

- tulevat

- ennen

- ovat

- alle

- PARAS

- parhaat käytännöt

- Iso

- Blogi

- hallitus

- Lautapelit

- elin

- kirja

- sekä

- laaja

- rakentaa

- Rakentaminen

- rakennettu

- nippuja

- mutta

- nappia

- by

- nimeltään

- CAN

- kyvyt

- tapauksissa

- muuttaa

- muuttuviin

- tarkastaa

- valinta

- Valita

- valita

- valitsi

- luokka

- Siivous

- lähempänä

- pilvi

- koodi

- kahvi

- Yhteinen

- yhteisö

- yritys

- Täydentää

- täydellinen

- komponentti

- osat

- käsittää

- tietokone

- Tietojenkäsittelyoppi

- käsite

- Konferenssi

- sekava

- kytkeä

- ottaen huomioon

- Console

- sisälsi

- pitoisuus

- tausta

- ohjaus

- puhekielen

- keskusteleva AI

- kustannukset

- katettu

- Covers

- luoda

- luotu

- luo

- kriittinen

- Asiakkaat

- tiedot

- Tietojen valmistelu

- tietosuoja

- tietokanta

- tietokannat

- DBS

- sopimus

- syvä

- syvä oppiminen

- määritelty

- esittely

- riippuvuudet

- sijoittaa

- käyttöön

- levityspinnalta

- käyttöönotto

- Malli

- suunniteltu

- suunnittelu

- yksityiskohtainen

- kehitetty

- Kehittäjä

- kehittäjille

- Kehitys

- eri

- digitaalinen

- digitalisointi

- mitat

- ohjata

- do

- asiakirja

- dokumentointi

- asiakirjat

- ei

- ei

- Don

- Dont

- kukin

- helppo

- tehokkuus

- tehokas

- tehokkaasti

- myöskään

- elementtejä

- Upottaa

- upotettu

- upottamisen

- EMEA

- mahdollistaa

- loppu

- päittäin

- päätepiste

- Moottorit

- parantaa

- varmistaa

- varmistaa

- yritys

- yksiköt

- kokonaisuus

- ympäristö

- arviointi

- Tapahtumat

- kaikki

- esimerkki

- odotettu

- experience

- Elämykset

- kokeilu

- vienti

- ulkoinen

- Kasvot

- perhe

- Kuva

- filee

- Asiakirjat

- suodattaa

- lopullinen

- Etunimi

- sovittaa

- joustava

- joustavasti

- Keskittää

- keskittyy

- jälkeen

- varten

- muoto

- perusta

- Puitteet

- Ilmainen

- alkaen

- täysin

- toiminto

- Pelit

- tuottaa

- syntyy

- synnyttää

- sukupolvi

- generatiivinen

- Generatiivinen AI

- Saksa

- saada

- tietty

- Ryhmä

- Kasvu

- kahva

- Olla

- ottaa

- he

- auttaa

- hänen

- tätä

- Korkea

- korkean tason

- erittäin

- hänen

- isännät

- Miten

- Miten

- Kuitenkin

- HTML

- http

- HTTPS

- Napa

- i

- Identiteetti

- if

- Vaikutus

- toteuttaa

- tärkeä

- parantaminen

- in

- sisältää

- sisältää

- Mukaan lukien

- kasvoi

- yhä useammin

- indeksi

- indeksoitu

- indeksit

- tiedot

- Infrastruktuuri

- panos

- asentaa

- esimerkki

- ohjeet

- Internet

- tulee

- IT

- SEN

- jpg

- avain

- avaimet

- Tietää

- tuntemus

- Tietämyksen hallinta

- Kieli

- suuri

- käynnistää

- käynnistettiin

- johtaa

- Liidit

- oppiminen

- Lisenssi

- Licensed

- kevyt

- pitää

- Todennäköisesti

- RAJOITA

- rajoitukset

- linja

- OTK

- log

- hakkuu

- näköinen

- rakkaus

- kone

- koneoppiminen

- tehty

- tehdä

- TEE

- Tekeminen

- hoitaa

- onnistui

- johto

- tarvikkeet

- matematiikka

- maksimi

- Saattaa..

- tarkoittaa

- Media

- menetelmät

- Metrics

- miljoonia

- minuuttia

- lieventävä

- ML

- malli

- mallit

- muokata

- Moduulit

- Moments

- seuranta

- lisää

- eniten

- liikkua

- nimi

- nimetty

- Luonnollinen

- Luonnollinen kielen käsittely

- navigointi

- Tarve

- tarpeet

- NLP

- muistikirja

- numero

- of

- kampanja

- Tarjoukset

- on

- vain

- avata

- avoimen lähdekoodin

- Avoimen lähdekoodin ohjelmisto

- käyttää

- optimointi

- Vaihtoehto

- Vaihtoehdot

- or

- organisatorinen

- Järjestetty

- alkuperäinen

- Muut

- meidän

- hahmoteltu

- yli

- oma

- paketti

- sivulla

- sivut

- osa

- kumppani

- intohimo

- intohimoinen

- Suorittaa

- suorituskyky

- putki

- Platon

- Platonin tietotieto

- PlatonData

- Pelaa

- Ole hyvä

- Kohta

- Suosittu

- Kirje

- voimakas

- käytännöt

- valmistelu

- Valmistella

- yksityisyys

- ongelmia

- prosessi

- käsittely

- tuotanto

- Edistyminen

- projekti

- todisteet

- ehdotettu

- patentoitu

- suojella

- suojaus

- prototyyppi

- toimittaa

- mikäli

- tarjoaa

- tarjoamalla

- valtuutettu

- julkinen

- Työnnä

- laatu

- kyselyt

- kysymys

- kysymykset

- raaka

- sai

- äskettäinen

- Suositus

- suositeltu

- säännöllisesti

- suhteet

- Merkitys

- merkityksellinen

- luotettava

- muistaa

- säilytyspaikka

- pyyntö

- edellyttää

- tarvitaan

- vaatimukset

- Esittelymateriaalit

- vastaus

- vasteet

- REST

- rajoittaa

- johtua

- tulokset

- Tuotto

- Rikas

- oikein

- roy

- ajaa

- juoksu

- SaaS

- sagemaker

- Säästä

- sanoa

- skaalautuvuus

- skaalautuva

- Asteikko

- skaalaus

- tiede

- Haku

- turvallisuus

- nähdä

- lähettää

- lähettää

- vanhempi

- serverless

- palvelee

- palvelu

- Palvelut

- setti

- settings

- setup

- Muoto

- osakkeet

- hän

- LAIVA

- shouldnt

- näyttää

- näyteikkuna

- malliesimerkki

- allekirjoitettu

- samankaltainen

- samalla lailla

- Yksinkertainen

- yksinkertaisesti

- pieni

- So

- Tuotteemme

- Yksin

- vankka

- ratkaisu

- Ratkaisumme

- jonkin verran

- jotain

- lähde

- lähdekoodi

- Tila

- Kaiutin

- puhuu

- asiantuntija

- erikoistunut

- Pysyvyys

- pino

- Vaihe

- Alkaa

- käynnistyksen

- Startups

- Vaihe

- Askeleet

- tallentamiseksi

- vahva

- rakenne

- niin

- sviitti

- varma

- ottaa

- vie

- tekniikat

- malleja

- testattu

- että

- -

- Lähde

- Niitä

- sitten

- siten

- siksi

- Nämä

- ne

- asia

- ajatella

- tätä

- tuhansia

- Kautta

- aika

- että

- yhdessä

- raita

- liikenne

- kauttakulku

- luotettava

- kaksi

- tyyppi

- tyypillisesti

- Lopulta

- varten

- ladattu

- us

- käyttää

- käytetty

- käyttäjä

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- hyödyllisyys

- arvo

- arvot

- eri

- kautta

- visio

- odottaa

- we

- verkko

- verkkopalvelut

- Verkkosivu

- kun

- joka

- tulee

- with

- sisällä

- sana

- Referenssit

- työnkulku

- työskentely

- toimii

- olisi

- kirjoittaa

- yaml

- vuotta

- Voit

- Sinun

- zephyrnet