Tekoälyn (AI) ja koneoppimisen (ML) maailma on ollut todistamassa paradigman muutosta generatiivisten tekoälymallien myötä, jotka voivat luoda ihmisen kaltaista tekstiä, kuvia, koodia ja ääntä. Verrattuna klassisiin ML-malleihin generatiiviset tekoälymallit ovat huomattavasti suurempia ja monimutkaisempia. Niiden lisääntyvä monimutkaisuus aiheuttaa kuitenkin myös korkeat päättelykustannukset ja kasvava tarve tehokkaille laskentaresursseille. Generatiivisten tekoälymallien päättelyjen korkeat kustannukset voivat olla esteenä yrityksille ja tutkijoille, joilla on rajalliset resurssit, mikä edellyttää tehokkaampia ja kustannustehokkaampia ratkaisuja. Lisäksi suurin osa generatiivisista tekoälyn käyttötapauksista liittyy ihmisten vuorovaikutukseen tai todellisiin skenaarioihin, mikä edellyttää laitteistoa, joka voi tarjota alhaisen latenssin suorituskyvyn. AWS on innovoinut tarkoitukseen rakennetuilla siruilla vastatakseen tehokkaan, tehokkaan ja kustannustehokkaan laskentalaitteiston kasvavaan tarpeeseen.

Tänään meillä on ilo ilmoittaa siitä Amazon Sage Maker tukee AWS Inferentia2 (ml.inf2) ja AWS Trainium (ml.trn1) -pohjaiset SageMaker-instanssit generatiivisten tekoälymallien isännöimiseksi reaaliaikaista ja asynkronista johtopäätöstä varten. ml.inf2-esiintymät ovat saatavilla mallin käyttöönottamiseksi SageMakerissa USA:n itäosassa (Ohio) ja ml.trn1-esiintymiä USA:n itäosassa (N. Virginia).

Voit käyttää näitä tapauksia SageMakerissa saavuttaaksesi korkean suorituskyvyn alhaisin kustannuksin generatiivisille tekoälymalleille, mukaan lukien suuret kielimallit (LLM), vakaa diffuusio ja näkömuuntajat. Lisäksi voit käyttää Amazon SageMakerin päätelmäsuositus auttaa sinua suorittamaan kuormitustestejä ja arvioimaan mallisi käyttöönoton hinta-suorituskykyetuja näissä tapauksissa.

Voit käyttää ml.inf2- ja ml.trn1-esiintymiä ML-sovellusten suorittamiseen SageMakerissa tekstin yhteenvetoon, koodin luomiseen, videoiden ja kuvien luomiseen, puheentunnistukseen, personointiin, petosten havaitsemiseen ja muuhun. Pääset helposti alkuun määrittämällä ilmentymät ml.trn1 tai ml.inf2 määrittäessäsi SageMaker-päätepistettä. Voit käyttää ml.trn1- ja ml.inf2-yhteensopivia AWS Deep Learning Containers (DLC) -säilöjä PyTorchille, TensorFlow'lle, Hugging Facelle ja suurelle mallipäätelmälle (LMI) aloittaaksesi helposti. Katso täydellinen luettelo versioineen Käytettävissä olevat Deep Learning Containers -kuvat.

Tässä viestissä näytämme suuren kielimallin käyttöönottoprosessin AWS Inferentia2:ssa SageMakerin avulla ilman ylimääräistä koodausta hyödyntämällä LMI-säilöä. Käytämme GPT4ALL-J, hienosäädetty GPT-J 7B -malli, joka tarjoaa chatbot-tyylisen vuorovaikutuksen.

Yleiskatsaus ml.trn1- ja ml.inf2-esiintymiin

ml.trn1-instanssit saavat virtansa Trainium-kiihdyttimestä, joka on suunniteltu pääasiassa generatiivisten AI-mallien, mukaan lukien LLM:iden, korkean suorituskyvyn syväoppimiskoulutukseen. Nämä ilmentymät tukevat kuitenkin myös päättelykuormia malleille, jotka ovat jopa suurempia kuin Inf2:een mahtuvat. Suurin ilmentymäkoko, trn1.32xlarge instances, sisältää 16 Trainiumin kiihdyttimet 512 Gt:n kiihdytinmuistilla yhdessä tapauksessa, joka tuottaa jopa 3.4 petaflopsia FP16/BF16-laskentatehoa. 16 Trainium-kiihdytintä on yhdistetty erittäin nopeaan NeuronLinkv2:een virtaviivaistamaan kollektiivista viestintää.

ml.Inf2-esiintymien virtalähteenä on AWS Inferentia2 -kiihdytin, tarkoitukseen rakennettu kiihdytin johtopäätösten tekemiseen. Se tarjoaa kolme kertaa paremman laskentatehon, jopa neljä kertaa suuremman suorituskyvyn ja jopa 10 kertaa pienemmän latenssin verrattuna ensimmäisen sukupolven AWS Inferentiaan. Suurin ilmentymäkoko, Inf2.48xlarge, sisältää 12 AWS Inferentia2 -kiihdytintä ja 384 Gt:n kiihdytinmuistia yhdessä tapauksessa 2.3 petaflopsin yhdistettyyn laskentatehoon BF16/FP16:lle. Sen avulla voit ottaa käyttöön jopa 175 miljardin parametrin mallin yhdessä tapauksessa. Inf2 on ainoa päätelmiin optimoitu ilmentymä, joka tarjoaa tämän yhteenliittämisen, ominaisuuden, joka on saatavilla vain kalliimmissa koulutustapauksissa. Erittäin suurissa malleissa, jotka eivät mahdu yhteen kiihdytin, tiedot kulkevat suoraan kiihdyttimien välillä NeuronLinkin avulla ohittaen suorittimen kokonaan. NeuronLinkin avulla Inf2 tukee nopeampaa hajautettua päättelyä ja parantaa suorituskykyä ja latenssia.

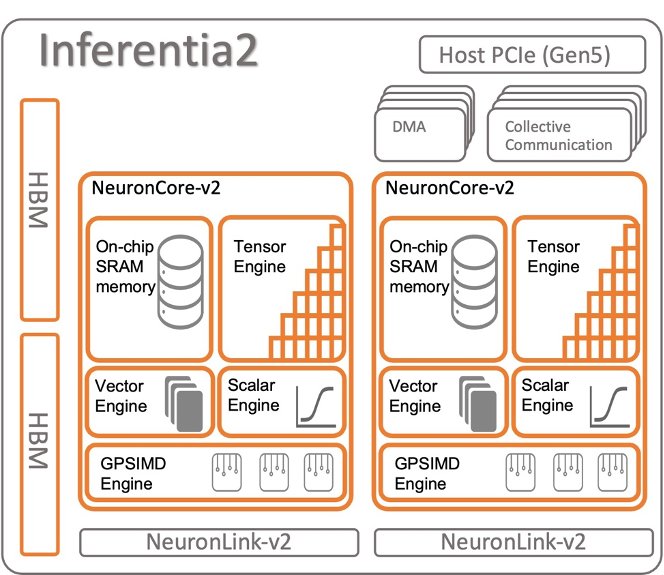

Sekä AWS Inferentia2- että Trainium-kiihdytintä on kaksi NeuronCores-v2, 32 Gt:n HBM-muistipinot ja erilliset kollektiivisen laskentamoottorit, jotka optimoivat automaattisesti suoritusajan päällekkäin laskemalla ja kommunikoimalla tehdessään monikiihdytinpäätelmiä. Lisätietoja arkkitehtuurista on osoitteessa Trainium- ja Inferentia-laitteet.

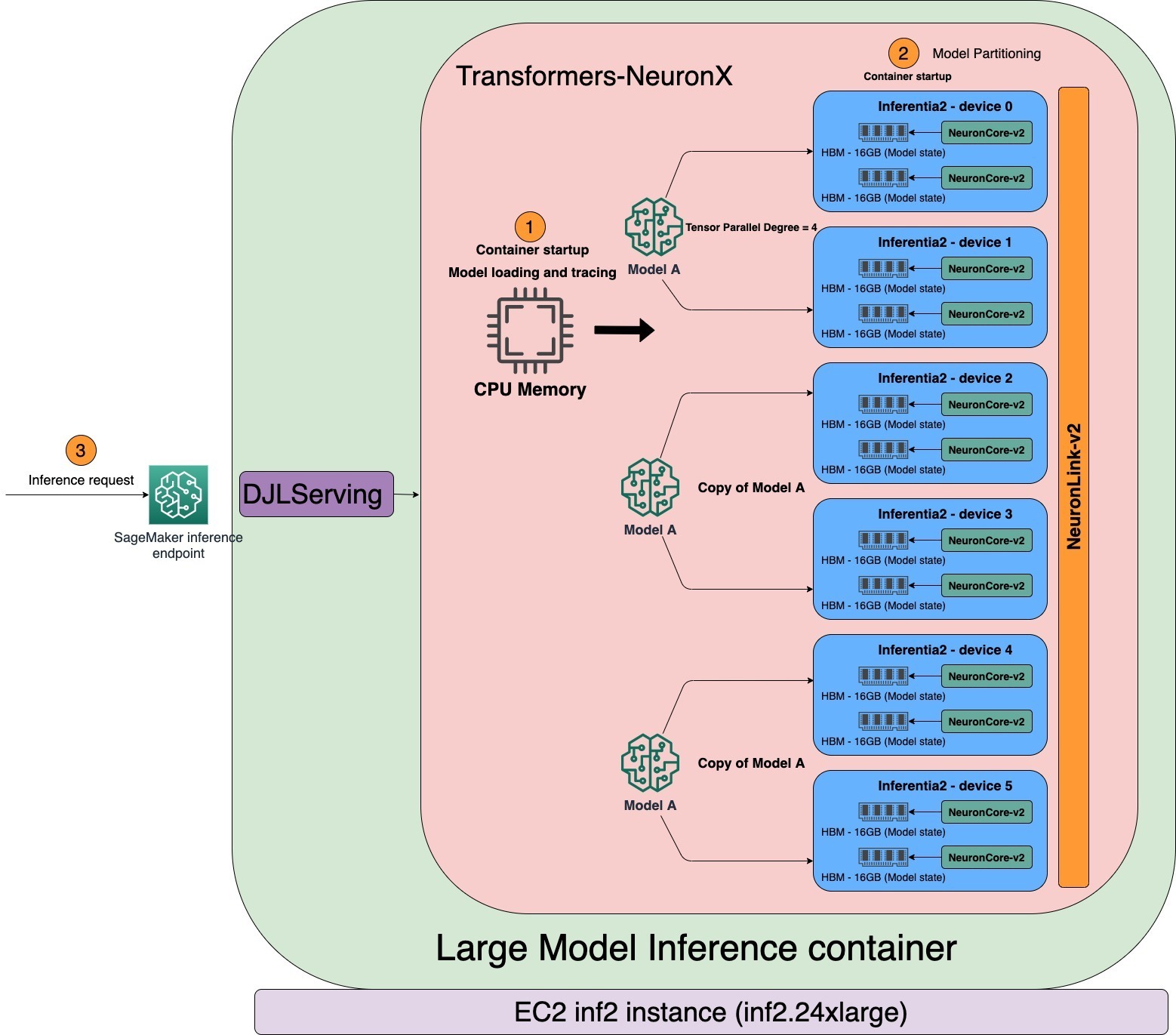

Seuraavassa kaaviossa on esimerkkiarkkitehtuuri, jossa käytetään AWS Inferentia2:ta.

AWS Neuron SDK

AWS Neuron on SDK, jota käytetään suorittamaan syvän oppimisen työkuormia AWS Inferentia- ja Trainium-pohjaisissa instansseissa. AWS Neuron sisältää syvän oppimiskääntäjän, ajonajan ja työkalut, jotka on integroitu natiivisti TensorFlowiin ja PyTorchiin. Neuronin avulla voit kehittää, profiloida ja ottaa käyttöön korkean suorituskyvyn ML-työkuormia ml.trn1- ja ml.inf2-tiedostoissa.

- Neuronin kääntäjä hyväksyy ML-malleja eri muodoissa (TensorFlow, PyTorch, XLA HLO) ja optimoi ne toimimaan Neuron-laitteissa. Neuron-kääntäjä kutsutaan ML-kehyksessä, jossa Neuron-kehyslaajennus lähettää ML-mallit kääntäjälle. Tuloksena olevaa kääntäjän artefaktia kutsutaan NEFF-tiedostoksi (Neuron Executable File Format), jonka Neuron-ajoaika puolestaan lataa Neuron-laitteeseen.

- Neuronin käyttöaika koostuu ytimen ajureista ja C/C++-kirjastoista, jotka tarjoavat API:t AWS Inferentia- ja Trainium Neuron -laitteiden käyttämiseen. TensorFlow- ja PyTorchin Neuron ML -kehyslaajennukset käyttävät Neuron-ajoaikaa mallien lataamiseen ja suorittamiseen NeuronCoresissa. Neuron-ajoaika lataa käännetyt syväoppimismallit (NEFF) Neuron-laitteisiin ja on optimoitu korkealle suorituskyvylle ja alhaiselle latenssille.

Isännöi NLP-malleja SageMaker ml.inf2 -esiintymillä

Ennen kuin sukeltaamme syvälle LLM:ien palvelemiseen muuntajat-neuronx, joka on avoimen lähdekoodin kirjasto mallin suurten painomatriisien sirpaloimiseksi useisiin NeuronCoreen. Käydäänpä lyhyesti läpi tyypillinen käyttöönottokulku mallille, joka mahtuu yhteen NeuronCoreen.

Tarkista luettelo tuetuista malleista varmistaaksesi, että AWS Inferentia2 tukee mallia. Seuraavaksi Neuron Compilerin on esikäännetty malli. Voit käyttää SageMaker-muistikirjaa tai Amazonin elastinen laskentapilvi (Amazon EC2) -esiintymä mallin kokoamiseksi. SageMaker Python SDK:n avulla voit ottaa käyttöön malleja, jotka käyttävät suosittuja syväoppimiskehyksiä, kuten PyTorchia, kuten seuraavassa koodissa näkyy. Voit ottaa mallin käyttöön SageMaker-isännöintipalveluissa ja saada päätepisteen, jota voidaan käyttää päätelmien tekemiseen. Nämä päätepisteet ovat täysin hallittuja ja tukevat automaattista skaalausta.

Mainita Kehittäjävirtaukset saadaksesi lisätietoja Inf2:n tyypillisistä kehityskulkuista SageMakerissa esimerkkiskripteillä.

Isännöi LLM:itä SageMaker ml.inf2 -esiintymien avulla

Suuret kielimallit, joissa on miljardeja parametreja, ovat usein liian suuria mahtuakseen yhteen kiihdytin. Tämä edellyttää rinnakkaisten mallitekniikoiden käyttöä LLM:ien isännöimiseksi useiden kiihdyttimien kautta. Toinen ratkaiseva vaatimus LLM:ien isännöinnille on tehokkaan mallinpalveluratkaisun käyttöönotto. Tämän ratkaisun pitäisi ladata malli tehokkaasti, hallita osiointia ja palvella pyyntöjä saumattomasti HTTP-päätepisteiden kautta.

SageMaker sisältää erikoistuneita syväoppimissäilöjä (DLC), kirjastoja ja työkaluja mallien rinnakkaisuudelle ja suurille mallipäätelmille. Katso resurssit LMI:n käytön aloittamiseen SageMakerissa Mallin rinnakkaisuus ja suuren mallin päättely. SageMaker ylläpitää DLC:itä suosittujen avoimen lähdekoodin kirjastojen kanssa suurten mallien, kuten GPT, T5, OPT, BLOOM ja Stable Diffusion, isännöimiseksi AWS-infrastruktuurissa. Näitä erikoistuneita DLC:itä kutsutaan SageMaker LMI -säiliöiksi.

SageMaker LMI-säiliöt käytä DJLServingiä, mallipalvelinta, joka on integroitu transformers-neuronx-kirjastoon tukemaan tensorin rinnakkaisuutta NeuronCoresin välillä. Lisätietoja DJLServingin toiminnasta on kohdassa Ota suuria malleja käyttöön Amazon SageMakerissa käyttämällä DJLServing- ja DeepSpeed-mallin rinnakkaisjohtopäätöstä. DJL-mallipalvelin ja transformers-neuronx-kirjasto toimivat säiliön ydinkomponentteina, joka sisältää myös Neuron SDK:n. Tämä asennus helpottaa mallien lataamista AWS Inferentia2 -kiihdyttimiin, rinnastaa mallin useiden NeuronCore-yksiköiden kesken ja mahdollistaa palvelun HTTP-päätepisteiden kautta.

LMI-kontti tukee lastausmalleja Amazonin yksinkertainen tallennuspalvelu (Amazon S3) ämpäri tai Hugging Face Hub. Käsittelijän oletusskripti lataa mallin, kokoaa ja muuntaa sen Neuron-optimoituun muotoon ja lataa sen. Voit käyttää LMI-säilöä LLM:ien isännöimiseen kaksi vaihtoehtoa:

- Ei-koodia (suositus) – Tämä on helpoin tapa ottaa LLM käyttöön LMI-säilön avulla. Tässä menetelmässä voit käyttää toimitettua oletuskäsittelijä ja anna vain mallin nimi ja vaaditut parametrit

serving.propertiestiedosto mallin lataamiseksi ja isännöimiseksi. Jos haluat käyttää oletuskäsittelijää, tarjoammeentryPointparametri asdjl_python.transformers-neuronx. - Tuo oma käsikirjoitus – Tässä lähestymistavassa sinulla on mahdollisuus luoda oma model.py-tiedosto, joka sisältää mallin lataamiseen ja palvelemiseen tarvittavan koodin. Tämä tiedosto toimii välittäjänä tiedostojen välillä

DJLServingAPI:t jatransformers-neuronxAPI:t. Voit mukauttaa mallin latausprosessiaserving.propertieskonfiguroitavilla parametreilla. Katso kattava luettelo käytettävissä olevista konfiguroitavista parametreista Kaikki DJL-kokoonpanovaihtoehdot. Tässä on esimerkki a malli.py tiedosto.

Runtime arkkitehtuuri

- tensor_parallel_degree ominaisuuden arvo määrittää tensorin rinnakkaisten moduulien jakautumisen useiden neuronytimien kesken. Esimerkiksi inf2.24xlargessa on kuusi AWS Inferentia2 -kiihdytintä. Jokaisessa AWS Inferentia2 -kiihdyttimessä on kaksi NeuronCorea. Jokaisessa NeuronCoressa on 16 Gt:n oma korkean kaistanleveyden muisti (HBM), joka tallentaa tensorin rinnakkaismoduuleja. Kun tensorin rinnakkaisaste on 4, LMI varaa kolme mallikopiota samasta mallista, joista jokainen käyttää neljää NeuronCorea. Kuten seuraavassa kaaviossa näkyy, kun LMI-säilö käynnistyy, malli ladataan ja jäljitetään ensin CPU:n osoitettavassa muistissa. Kun jäljitys on valmis, malli ositetaan NeuronCoresin poikki tensorin rinnakkaisasteen perusteella.

LMI käyttää DJLServingiä mallinkäyttöpinona. Kun säilön kuntotarkastus on läpäissyt SageMakerissa, säilö on valmis palvelemaan päättelypyyntöä. DJLServing käynnistää useita Python-prosesseja, jotka vastaavat TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Jokainen Python-prosessi sisältää säikeitä C++-kielellä, joka vastaa sitä TENSOR_PARALLEL_DEGREE. Jokaisessa C++-säikeessä on yksi mallin sirpale yhdessä NeuronCoressa.

Monilla käyttäjillä (Python-prosessi) on tapana suorittaa johtopäätös peräkkäin, kun palvelinta kutsutaan useilla itsenäisillä pyynnöillä. Vaikka se on helpompi määrittää, se ei yleensä ole paras käytäntö hyödyntää kiihdytin laskentatehoa. Tämän korjaamiseksi DJLServing tarjoaa dynaamisen erän sisäänrakennettuja optimointeja yhdistääkseen nämä riippumattomat päättelypyynnöt palvelinpuolella suuremman erän muodostamiseksi dynaamisesti suorituskyvyn lisäämiseksi. Kaikki pyynnöt saapuvat ensin dynaamiseen anturiin ennen kuin ne siirtyvät todellisiin työjonoihin odottamaan päätelmiä. Voit määrittää haluamasi eräkoot dynaamista erää varten käyttämällä batch_size asetuksia serving.properties. Voit myös määrittää max_batch_delay määrittääksesi antajan maksimiviiveen, joka odottaa muita pyyntöjä liittyä eräan latenssivaatimustesi perusteella. Suorituskyky riippuu myös mallikopioiden määrästä ja säilössä käynnistetyistä Python-prosessiryhmistä. Kuten seuraavassa kaaviossa näkyy, kun tensorin rinnakkaisaste on asetettu arvoon 4, LMI-säilö käynnistää kolme Python-prosessiryhmää, joista jokaisessa on mallin täydellinen kopio. Tämän avulla voit suurentaa eräkokoa ja saada suuremman suorituskyvyn.

SageMaker-muistikirja LLM:ien käyttöönottoon

Tässä osiossa annamme vaiheittaisen esittelyn GPT4All-J:n käyttöönotosta, 6 miljardin parametrin mallista, joka on 24 Gt FP32:ssa. GPT4All-J on suosittu chatbot, joka on koulutettu monenlaiseen vuorovaikutussisältöön, kuten tekstiongelmiin, dialogeihin, koodiin, runoihin, lauluihin ja tarinoihin. GPT4all-J on hienosäädetty GPT-J-malli, joka tuottaa ihmisen vuorovaikutuksen kaltaisia vasteita.

Tämän esimerkin täydellinen muistikirja on saatavilla osoitteessa GitHub. Voimme käyttää SageMaker Python SDK:ta mallin käyttöönottamiseksi Inf2-instanssiin. Käytämme tarjottua oletuskäsittelijä mallin lataamiseen. Tämän avulla meidän on vain tarjottava a annokset.ominaisuudet tiedosto. Tässä tiedostossa on tarvittavat asetukset, jotta DJL-mallipalvelin voi ladata ja isännöidä mallia. Voimme määrittää Hugging Face -mallin nimen käyttämällä model_id parametri ladataksesi mallin suoraan Hugging Face -varastosta. Vaihtoehtoisesti voit ladata mallin Amazon S3:sta toimittamalla s3url parametri. The entryPoint parametri on määritetty osoittamaan kirjastoon mallin lataamista varten. Lisätietoja aiheesta djl_python.fastertransformer, Viittaavat GitHub-koodi.

- tensor_parallel_degree ominaisuuden arvo määrittää tensorin rinnakkaisten moduulien jakautumisen useiden laitteiden välillä. Esimerkiksi 12 neuronytimellä ja tensorin rinnakkaisasteella 4, LMI varaa kolme mallikopiota, joista jokainen käyttää neljää NeuronCorea. Voit myös määrittää tarkkuustyypin ominaisuuden avulla dtype. n_position parametri määrittää mallin maksimitulon ja lähtösekvenssin pituuden summan. Katso seuraava koodi:

Rakenna tarball sisältävä serving.properties ja lataa se S3-ämpäriin. Vaikka tässä esimerkissä käytetään oletuskäsittelijää, voit kehittää a model.py tiedosto lataus- ja tarjoiluprosessin mukauttamiseen. Jos on paketteja, jotka vaativat asennusta, sisällytä ne tiedostoon requirements.txt tiedosto. Katso seuraava koodi:

Hae DJL-säiliökuva ja luo SageMaker-malli:

Seuraavaksi luomme SageMaker-päätepisteen aiemmin määritetyllä mallikonfiguraatiolla. Säiliö lataa mallin tiedostoon /tmp tilaa, koska SageMaker kartoittaa /tmp että Amazonin elastisten lohkojen myymälä (Amazon EBS). Meidän on lisättävä a volume_size parametri varmistaaksesi /tmp hakemistossa on tarpeeksi tilaa mallin lataamiseen ja kääntämiseen. Asetamme container_startup_health_check_timeout 3,600 2.8 sekuntiin varmistaaksesi, että kuntotarkastus alkaa mallin valmistuttua. Käytämme ilmentymää ml.infXNUMXxlarge. Katso seuraava koodi:

Kun SageMaker-päätepiste on luotu, voimme tehdä reaaliaikaisia ennusteita SageMaker-päätepisteitä vastaan käyttämällä Predictor esine:

Puhdistaa

Voit säästää kustannuksia poistamalla päätepisteet, kun olet suorittanut testit:

Yhteenveto

Tässä viestissä esittelimme äskettäin lanseeratun SageMaker-ominaisuuden, joka tukee nyt ml.inf2- ja ml.trn1-esiintymiä generatiivisten AI-mallien isännöimiseksi. Osoitimme, kuinka GPT4ALL-J, generatiivinen tekoälymalli, otetaan käyttöön AWS Inferentia2:ssa SageMakerin ja LMI-säilön avulla ilman koodin kirjoittamista. Esittelimme myös kuinka voit käyttää DJLServingiä ja transformers-neuronx ladata mallin, osioida sen ja palvella.

Inf2-instanssit tarjoavat kustannustehokkaimman tavan käyttää generatiivisia tekoälymalleja AWS:ssä. Katso suoritustiedot kohdasta Inf2-suorituskyky.

Tutustu GitHub repo esimerkkimuistikirjaa varten. Kokeile sitä ja kerro meille, jos sinulla on kysyttävää!

Tietoja Tekijät

Vivek Gangasani on vanhempi koneoppimisratkaisuarkkitehti Amazon Web Servicesissä. Hän työskentelee Machine Learning Startupsin kanssa rakentaakseen ja ottaakseen käyttöön AI/ML-sovelluksia AWS:ssä. Hän keskittyy tällä hetkellä ratkaisujen toimittamiseen MLOps-, ML Inference- ja low-code ML -ratkaisuille. Hän on työskennellyt projekteissa eri aloilla, mukaan lukien Natural Language Processing ja Computer Vision.

Vivek Gangasani on vanhempi koneoppimisratkaisuarkkitehti Amazon Web Servicesissä. Hän työskentelee Machine Learning Startupsin kanssa rakentaakseen ja ottaakseen käyttöön AI/ML-sovelluksia AWS:ssä. Hän keskittyy tällä hetkellä ratkaisujen toimittamiseen MLOps-, ML Inference- ja low-code ML -ratkaisuille. Hän on työskennellyt projekteissa eri aloilla, mukaan lukien Natural Language Processing ja Computer Vision.

Hiroshi Tokoyo on ratkaisuarkkitehti AWS Annapurna Labsissa. Japanissa asuva hän liittyi Annapurna Labsiin jo ennen AWS:n yritysostoa ja on jatkuvasti auttanut asiakkaita Annapurna Labs -teknologian kanssa. Hänen viime aikoina hän keskittyy koneoppimisratkaisuihin, jotka perustuvat tarkoitukseen rakennettuun piiin, AWS Inferentiaan ja Trainiumiin.

Hiroshi Tokoyo on ratkaisuarkkitehti AWS Annapurna Labsissa. Japanissa asuva hän liittyi Annapurna Labsiin jo ennen AWS:n yritysostoa ja on jatkuvasti auttanut asiakkaita Annapurna Labs -teknologian kanssa. Hänen viime aikoina hän keskittyy koneoppimisratkaisuihin, jotka perustuvat tarkoitukseen rakennettuun piiin, AWS Inferentiaan ja Trainiumiin.

Dhawal Patel on AWS:n koneoppimisarkkitehti. Hän on työskennellyt organisaatioiden kanssa suurista yrityksistä keskikokoisiin startup-yrityksiin hajautettuun tietojenkäsittelyyn ja tekoälyyn liittyvien ongelmien parissa. Hän keskittyy syväoppimiseen, mukaan lukien NLP- ja Computer Vision -alueet. Hän auttaa asiakkaita tekemään korkean suorituskyvyn mallipäätelmiä SageMakerissa.

Dhawal Patel on AWS:n koneoppimisarkkitehti. Hän on työskennellyt organisaatioiden kanssa suurista yrityksistä keskikokoisiin startup-yrityksiin hajautettuun tietojenkäsittelyyn ja tekoälyyn liittyvien ongelmien parissa. Hän keskittyy syväoppimiseen, mukaan lukien NLP- ja Computer Vision -alueet. Hän auttaa asiakkaita tekemään korkean suorituskyvyn mallipäätelmiä SageMakerissa.

Qing Lan on ohjelmistokehitysinsinööri AWS:ssä. Hän on työskennellyt useiden haastavien tuotteiden parissa Amazonissa, mukaan lukien korkean suorituskyvyn ML-johtopäätösratkaisut ja korkean suorituskyvyn lokijärjestelmä. Qingin tiimi lanseerasi onnistuneesti ensimmäisen Billion-parametrin mallin Amazon Advertisingissä erittäin alhaisella latenssilla. Qingillä on syvällinen tietämys infrastruktuurin optimoinnista ja Deep Learning -kiihdytyksestä.

Qing Lan on ohjelmistokehitysinsinööri AWS:ssä. Hän on työskennellyt useiden haastavien tuotteiden parissa Amazonissa, mukaan lukien korkean suorituskyvyn ML-johtopäätösratkaisut ja korkean suorituskyvyn lokijärjestelmä. Qingin tiimi lanseerasi onnistuneesti ensimmäisen Billion-parametrin mallin Amazon Advertisingissä erittäin alhaisella latenssilla. Qingillä on syvällinen tietämys infrastruktuurin optimoinnista ja Deep Learning -kiihdytyksestä.

Qingwei Li on koneoppimisen asiantuntija Amazon Web Services -palvelussa. Hän sai tohtorin tutkinnon operatiivisessa tutkimuksessa sen jälkeen, kun hän rikkoi neuvonantajan tutkimusapurahatilin ja ei toimittanut lupaamaansa Nobelin palkintoa. Tällä hetkellä hän auttaa finanssi- ja vakuutusalan asiakkaita rakentamaan koneoppimisratkaisuja AWS: lle. Vapaa-ajallaan hän pitää lukemisesta ja opettamisesta.

Qingwei Li on koneoppimisen asiantuntija Amazon Web Services -palvelussa. Hän sai tohtorin tutkinnon operatiivisessa tutkimuksessa sen jälkeen, kun hän rikkoi neuvonantajan tutkimusapurahatilin ja ei toimittanut lupaamaansa Nobelin palkintoa. Tällä hetkellä hän auttaa finanssi- ja vakuutusalan asiakkaita rakentamaan koneoppimisratkaisuja AWS: lle. Vapaa-ajallaan hän pitää lukemisesta ja opettamisesta.

Alan Tan on vanhempi tuotepäällikkö SageMakerin kanssa, joka johtaa suuria mallipäätelmiä. Hän on intohimoinen koneoppimisen soveltamisesta Analyticsin alueella. Työn ulkopuolella hän viihtyy ulkona.

Alan Tan on vanhempi tuotepäällikkö SageMakerin kanssa, joka johtaa suuria mallipäätelmiä. Hän on intohimoinen koneoppimisen soveltamisesta Analyticsin alueella. Työn ulkopuolella hän viihtyy ulkona.

Varun Syal on AWS Sagemakerin ohjelmistokehitysinsinööri, joka työskentelee kriittisten asiakaskohtaisten ominaisuuksien parissa ML Inference -alustaa varten. Hän on intohimoinen työskentelyyn hajautettujen järjestelmien ja tekoälyn parissa. Vapaa-ajallaan hän pitää lukemisesta ja puutarhanhoidosta.

Varun Syal on AWS Sagemakerin ohjelmistokehitysinsinööri, joka työskentelee kriittisten asiakaskohtaisten ominaisuuksien parissa ML Inference -alustaa varten. Hän on intohimoinen työskentelyyn hajautettujen järjestelmien ja tekoälyn parissa. Vapaa-ajallaan hän pitää lukemisesta ja puutarhanhoidosta.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoAiStream. Web3 Data Intelligence. Tietoa laajennettu. Pääsy tästä.

- Tulevaisuuden lyöminen Adryenn Ashley. Pääsy tästä.

- Osta ja myy osakkeita PRE-IPO-yhtiöissä PREIPO®:lla. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :on

- :On

- :ei

- :missä

- $ YLÖS

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- Meistä

- kiihdytin

- kiihdyttimiä

- hyväksyy

- pääsy

- Tili

- Saavuttaa

- hankinta

- poikki

- säädökset

- lisätä

- Lisäksi

- osoite

- osoitteellinen

- Etu

- mainonta

- Jälkeen

- vastaan

- AI

- ai käyttötapauksia

- AI / ML

- Kaikki

- mahdollistaa

- Myös

- Vaikka

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- an

- Analytics

- ja

- Ilmoittaa

- Toinen

- Kaikki

- API

- sovellukset

- Hakeminen

- lähestymistapa

- arkkitehtuuri

- OVAT

- ALUE

- keinotekoinen

- tekoäly

- Tekoäly (AI)

- AS

- At

- audio-

- auto

- automaattisesti

- saatavissa

- AWS

- AWS Inferencia

- pallo

- kaistanleveys

- este

- perustua

- BE

- koska

- ollut

- ennen

- Hyödyt

- PARAS

- välillä

- Iso

- suurempi

- miljardeja

- Tukkia

- Blogi

- Kukinta

- lyhyesti

- Broke

- rakentaa

- rakennettu

- sisäänrakennettu

- yritykset

- by

- C + +

- nimeltään

- CAN

- tapauksissa

- haastava

- chatbot

- tarkastaa

- sirut

- koodi

- Koodaus

- Kollektiivinen

- yhdistää

- yhdistetty

- tulee

- Viestintä

- Yhteydenpito

- verrattuna

- yhteensopiva

- täydellinen

- täysin

- monimutkainen

- monimutkaisuus

- osat

- kattava

- laskeminen

- Laskea

- tietokone

- Tietokoneen visio

- tietojenkäsittely

- Konfigurointi

- kytketty

- Kontti

- Kontit

- sisältää

- pitoisuus

- Ydin

- Hinta

- kustannustehokas

- kustannukset

- luoda

- luotu

- kriittinen

- ratkaiseva

- Tällä hetkellä

- asiakas

- Asiakkaat

- räätälöidä

- tiedot

- omistautunut

- syvä

- syvä oppiminen

- oletusarvo

- määritelty

- määrittelee

- Aste

- viivyttää

- toimittaa

- tuottaa

- Antaa

- osoittivat

- riippuu

- sijoittaa

- levityspinnalta

- käyttöönotto

- yksityiskohdat

- Detection

- määrittää

- kehittää

- Kehitys

- laite

- Laitteet

- eri

- Diffuusio

- suoraan

- jaettu

- hajautettu laskenta

- hajautetut järjestelmät

- jakelu

- tekee

- verkkotunnuksia

- Dont

- download

- lataukset

- kuljettaja

- dynaaminen

- dynaamisesti

- kukin

- Aikaisemmin

- helpompaa

- Helpoin

- helposti

- Itään

- tehokas

- tehokkaasti

- ponnisteluja

- mahdollistaa

- loppu

- päätepiste

- insinööri

- Moottorit

- tarpeeksi

- varmistaa

- kirjoittamalla

- yrityksille

- merkintä

- Vastaava

- arvioida

- Jopa

- esimerkki

- innoissaan

- kallis

- lisää

- Kasvot

- Helpottaa

- päin

- Epäonnistui

- nopeampi

- Ominaisuus

- Ominaisuudet

- filee

- taloudellinen

- rahoituspalvelu

- viimeistely

- Etunimi

- sovittaa

- virtaus

- virrat

- Keskittää

- keskityttiin

- keskittyy

- jälkeen

- varten

- muoto

- muoto

- neljä

- Puitteet

- puitteet

- petos

- petosten havaitseminen

- alkaen

- koko

- täysin

- Lisäksi

- synnyttää

- sukupolvi

- generatiivinen

- Generatiivinen AI

- saada

- Go

- myöntää

- Ryhmän

- Kasvava

- Palvelimet

- Olla

- he

- terveys

- auttaa

- auttanut

- auttaa

- tätä

- Korkea

- korkea suorituskyky

- korkeampi

- hänen

- pito

- pitää

- isäntä

- hotellit

- isännöintipalvelut

- Talo

- Miten

- Miten

- Kuitenkin

- HTML

- http

- HTTPS

- Napa

- ihmisen

- if

- kuva

- kuvien

- täytäntöönpano

- tuoda

- in

- perusteellinen

- sisältää

- sisältää

- Mukaan lukien

- Kasvaa

- lisää

- itsenäinen

- teollisuus

- Infrastruktuuri

- innovoidaan

- panos

- tuloa

- asennus

- esimerkki

- vakuutus

- integroitu

- Älykkyys

- vuorovaikutus

- vuorovaikutukset

- välittäjä

- tulee

- kutsuttuihin

- aiheuttaa

- IT

- SEN

- Japani

- Job

- yhdistää

- liittyi

- jpg

- json

- vain

- Tietää

- tuntemus

- Labs

- Kieli

- suuri

- Suuret yritykset

- suurempi

- suurin

- Viive

- käynnistettiin

- käynnistää

- johtava

- OPPIA

- oppiminen

- Pituus

- antaa

- kirjastot

- Kirjasto

- pitää

- tykkää

- rajallinen

- Lista

- OTK

- kuormitus

- lastaus

- kuormat

- hakkuu

- Matala

- alentaa

- alin

- kone

- koneoppiminen

- pääasiallisesti

- ylläpitää

- Enemmistö

- tehdä

- hoitaa

- onnistui

- johtaja

- Kartat

- max

- maksimi

- Muisti

- menetelmä

- ML

- MLOps

- malli

- mallit

- Moduulit

- lisää

- tehokkaampi

- eniten

- moninkertainen

- nimi

- Luonnollinen

- Luonnollinen kielen käsittely

- välttämätön

- Tarve

- tarpeet

- Uusi

- New York

- seuraava

- NLP

- Nobel palkinto

- muistikirja

- nyt

- numero

- objekti

- of

- kampanja

- Tarjoukset

- usein

- Ohio

- on

- ONE

- vain

- avoimen lähdekoodin

- Operations

- optimointi

- Optimoida

- optimoitu

- Optimismi

- Vaihtoehto

- Vaihtoehdot

- or

- organisaatioiden

- Muut

- meidän

- ulos

- ulkona

- ulostulo

- ulkopuolella

- oma

- paketit

- paradigma

- Parallel

- parametri

- parametrit

- kulkea

- kulkee

- intohimoinen

- suorituskyky

- Personointi

- foorumi

- Platon

- Platonin tietotieto

- PlatonData

- kytkeä

- liitännäiset

- Kohta

- Suosittu

- Kirje

- teho

- powered

- voimakas

- harjoitusta.

- Tarkkuus

- Ennusteet

- Predictor

- Suositut

- Pääasiallinen

- palkinto

- ongelmia

- prosessi

- Prosessit

- käsittely

- Tuotteet

- tuotepäällikkö

- Tuotteemme

- Profiili

- hankkeet

- luvattu

- ominaisuudet

- omaisuus

- toimittaa

- mikäli

- tarjoaa

- tarjoamalla

- tarkoitus

- Python

- pytorch

- alainen

- tavoittaa

- Lukeminen

- valmis

- todellinen maailma

- reaaliaikainen

- sai

- äskettäinen

- tunnustaminen

- tarkoitettuja

- liittyvä

- pyyntö

- pyynnöt

- tarvitaan

- vaatimus

- vaatimukset

- tutkimus

- Tutkijat

- Esittelymateriaalit

- vasteet

- Saatu ja

- Nousta

- ajaa

- sagemaker

- SageMaker-johtopäätös

- sama

- Säästä

- skaalaus

- skenaariot

- skriptejä

- sdk

- saumattomasti

- sekuntia

- Osa

- nähdä

- vanhempi

- Järjestys

- palvella

- palvelu

- Palvelut

- palvelevat

- setti

- settings

- setup

- useat

- siirtää

- shouldnt

- näyttää

- malliesimerkki

- esitetty

- Näytä

- puoli

- merkittävästi

- Pii

- samankaltainen

- Yksinkertainen

- single

- SIX

- Koko

- koot

- So

- Tuotteemme

- ohjelmistokehitys

- ratkaisu

- Ratkaisumme

- Tila

- asiantuntija

- erikoistunut

- puhe

- Puheentunnistus

- vakaa

- pino

- Stacks

- Alkaa

- alkoi

- alkaa

- Startups

- Levytila

- tarinat

- tallentamiseksi

- virtaviivainen

- tyyli

- Onnistuneesti

- niin

- tuki

- Tuetut

- Tukee

- järjestelmä

- järjestelmät

- ottaen

- Opetus

- joukkue-

- tekniikat

- Elektroniikka

- tensorflow

- testit

- kuin

- että

- -

- Alue

- heidän

- Niitä

- Siellä.

- Nämä

- tätä

- kolmella

- Kautta

- suoritusteho

- aika

- kertaa

- että

- liian

- työkalut

- jäljitys

- koulutettu

- koulutus

- muuntajat

- VUORO

- kaksi

- tyyppi

- tyypillinen

- ladattu

- us

- käyttää

- käytetty

- käyttämällä

- yleensä

- käyttää

- Hyödyntämällä

- arvo

- lajike

- eri

- valtava

- hyvin

- kautta

- Video

- virginia

- visio

- odottaa

- läpikäynti

- Tapa..

- we

- verkko

- verkkopalvelut

- paino

- Mitä

- kun

- joka

- tulee

- with

- sisällä

- ilman

- todistamassa

- sana

- Referenssit

- työskenteli

- työskentely

- toimii

- maailman-

- kirjoittaa

- kirjoittaminen

- york

- Voit

- Sinun

- zephyrnet