Ezt a bejegyzést Jad Chamounnal, a Forethought Technologies, Inc. mérnöki igazgatójával és Salina Wuval, a Forethought Technologies, Inc. vezető ML mérnökével közösen írták.

Előrelátás egy vezető generatív AI csomag az ügyfélszolgálathoz. Lakosztályának lényege az innovatív SupportGPT™ technológia, amely gépi tanulást használ az ügyfélszolgálati életciklus átalakítására – növeli az eltérítést, javítja a CSAT-ot és növeli az ügynöki termelékenységet. A SupportGPT™ a legkorszerűbb információ-visszakereső (IR) rendszereket és a nagy nyelvi modelleket (LLM) használja fel, hogy évente több mint 30 millió ügyfélkapcsolatot hajtson végre.

A SupportGPT elsődleges felhasználási célja az ügyfélszolgálati interakciók és műveletek minőségének és hatékonyságának javítása. A legkorszerűbb, beágyazásokkal és rangsorolási modellekkel hajtott IR-rendszerek használatával a SupportGPT gyorsan megkeresheti a releváns információkat, pontos és tömör válaszokat adva az ügyfelek kérdéseire. A Forethought vevőnként finomhangolt modelleket használ az ügyfelek szándékainak észlelésére az ügyfelek interakcióinak megoldása érdekében. A nagy nyelvi modellek integrációja segít humanizálni az automatizált ügynökökkel való interakciót, vonzóbb és kielégítőbb támogatási élményt teremtve.

A SupportGPT azáltal is segíti az ügyfélszolgálati ügynököket, hogy automatikus kiegészítési javaslatokat kínál, és megfelelő válaszokat készít az ügyféljegyekre, amelyek összhangban vannak a vállalat korábbi válaszai alapján. A fejlett nyelvi modellek használatával az ügynökök gyorsabban és pontosabban tudják kezelni az ügyfelek aggályait, ami magasabb ügyfél-elégedettséget eredményez.

Ezenkívül a SupportGPT architektúrája lehetővé teszi a támogatási tudásbázisok hiányosságainak észlelését, ami segít az ügynököknek, hogy pontosabb információkat nyújtsanak az ügyfeleknek. Amint ezeket a hiányosságokat azonosítja, a SupportGPT automatikusan cikkeket és egyéb tartalmakat generálhat, hogy kitöltse ezeket a tudáshézagokat, biztosítva, hogy a támogatási tudásbázis ügyfélközpontú és naprakész maradjon.

Ebben a bejegyzésben megosztjuk, hogyan használja a Forethought Amazon SageMaker több modelles végpontok generatív mesterséges intelligencia felhasználási esetekben több mint 66%-os költségmegtakarítás érdekében.

Infrastrukturális kihívások

E képességek piacra vitelének elősegítése érdekében a Forethought hatékonyan skálázza az ML munkaterhelését, és hiperszemélyre szabott megoldásokat kínál az egyes ügyfelek egyedi használati eseteire szabva. Ezt a hiper-személyre szabást az ügyféladatokba beágyazott modellek és osztályozók finomhangolásával érik el, biztosítva a pontos információ-visszakeresési eredményeket és az egyes ügyfelek egyedi igényeit kielégítő tartományismeretet. A személyre szabott automatikus kiegészítési modelleket az ügyféladatokra is finomhangolják, hogy tovább javítsák a generált válaszok pontosságát és relevanciáját.

Az AI-feldolgozás egyik jelentős kihívása a hardver erőforrások, például a GPU-k hatékony kihasználása. Ennek a kihívásnak a leküzdésére a Forethought a SageMaker többmodell végpontjait (MME) használja, hogy több AI-modellt futtasson egyetlen következtetési végponton és skálán. Mivel a modellek hiper-személyre szabásához egyedi modellek betanítása és bevezetése szükséges, a modellek száma lineárisan skálázódik az ügyfelek számával, ami költségessé válhat.

A valós idejű következtetés és a költségek közötti megfelelő egyensúly elérése érdekében a Forethought a SageMaker MME-k használatát választotta, amelyek támogatják a GPU-gyorsítást. A SageMaker MME-k lehetővé teszik a Forethought számára, hogy nagy teljesítményű, méretezhető és költséghatékony megoldásokat hozzon létre a másodperc alatti késleltetéssel, és több ügyfélszolgálati forgatókönyvet is képes kezelni.

SageMaker és Forethought

A SageMaker egy teljesen felügyelt szolgáltatás, amely lehetővé teszi a fejlesztők és adatkutatók számára az ML modellek gyors felépítését, betanítását és üzembe helyezését. A SageMaker MME-k méretezhető és költséghatékony megoldást kínálnak nagyszámú modell telepítéséhez valós idejű következtetésekhez. Az MME-k megosztott kiszolgálótárolót és erőforrásflottát használnak, amelyek gyorsított példányokat, például GPU-kat használhatnak az összes modell tárolására. Ez csökkenti az üzemeltetési költségeket a végpontok kihasználtságának maximalizálásával az egymodell végpontok használatához képest. Csökkenti a telepítési többletköltséget is, mivel a SageMaker kezeli a modellek be- és kirakodását a memóriában, és a végpont forgalmi mintái alapján méretezi azokat. Ezenkívül az összes SageMaker valós idejű végpont a modellek kezeléséhez és figyeléséhez szükséges beépített képességekkel rendelkezik, mint pl. árnyékváltozatok, automatikus méretezés, és natív integrációval amazonfelhőóra (további információért lásd CloudWatch metrikák többmodell végpont-telepítésekhez).

Ahogy a Forethought több száz modellnek ad otthont, amelyek GPU-erőforrásokat is igényeltek, lehetőséget láttunk egy költséghatékonyabb, megbízhatóbb és kezelhetőbb architektúra létrehozására a SageMaker MME-ken keresztül. A SageMaker MME-kre való átállás előtt modelljeinket Kubernetesen telepítettük Amazon Elastic Kubernetes szolgáltatás (Amazon EKS). Bár az Amazon EKS biztosította a felügyeleti képességeket, azonnal feltűnt, hogy olyan infrastruktúrát kezelünk, amelyet nem kifejezetten következtetésekre szabtak. A Forethoughtnak magunknak kellett kezelnie a modellkövetkeztetést az Amazon EKS-ről, ami megterhelte a mérnöki hatékonyságot. Például a drága GPU-erőforrások több modell közötti megosztása érdekében felelősek voltunk a merev memóriarészek kiosztásáért a telepítés során megadott modellekhez. Meglévő infrastruktúránkkal kapcsolatban a következő főbb problémákat kívántuk megoldani:

- Magas ár – Annak érdekében, hogy minden modell elegendő erőforrással rendelkezzen, nagyon óvatosak lennénk abban, hogy hány modellt illesszünk egy példányra. Ez a szükségesnél jóval magasabb költségeket eredményezett a modelltárhely esetében.

- Alacsony megbízhatóság – Annak ellenére, hogy a memóriafoglalást tekintve konzervatívak, nem minden modellnek ugyanazok a követelményei, és időnként egyes modellek memóriából (OOM) hibákat dobnak ki.

- Nem hatékony gazdálkodás – Minden típusú modellhez (például osztályozók, beágyazások és automatikus kiegészítés) különböző telepítési jegyzékeket kellett kezelnünk, ami időigényes és hibás volt. Fenn kellett tartanunk azt a logikát is, hogy meghatározzuk a memóriafoglalást a különböző modelltípusokhoz.

Végső soron szükségünk volt egy következtetési platformra ahhoz, hogy vállaljuk a modelljeink futásidejű kezelésének nehéz terheit, hogy javítsuk a költségeket, a megbízhatóságot és a modellek kiszolgálásának kezelését. A SageMaker MME-k lehetővé tették számunkra, hogy megfeleljünk ezeknek az igényeknek.

Intelligens és dinamikus modellbe- és kirakodása, valamint skálázási képességei révén a SageMaker MME-k lényegesen olcsóbb és megbízhatóbb megoldást kínáltak modelljeink tárolására. Mostantól sokkal több modellt tudunk illeszteni példányonként, és nem kell aggódnunk az OOM hibák miatt, mert a SageMaker MME-k dinamikusan kezelik a modellek be- és kirakodását. Ezenkívül a telepítések ma már olyan egyszerűek, mint a Boto3 SageMaker API-k meghívása és a megfelelő automatikus skálázási szabályzatok csatolása.

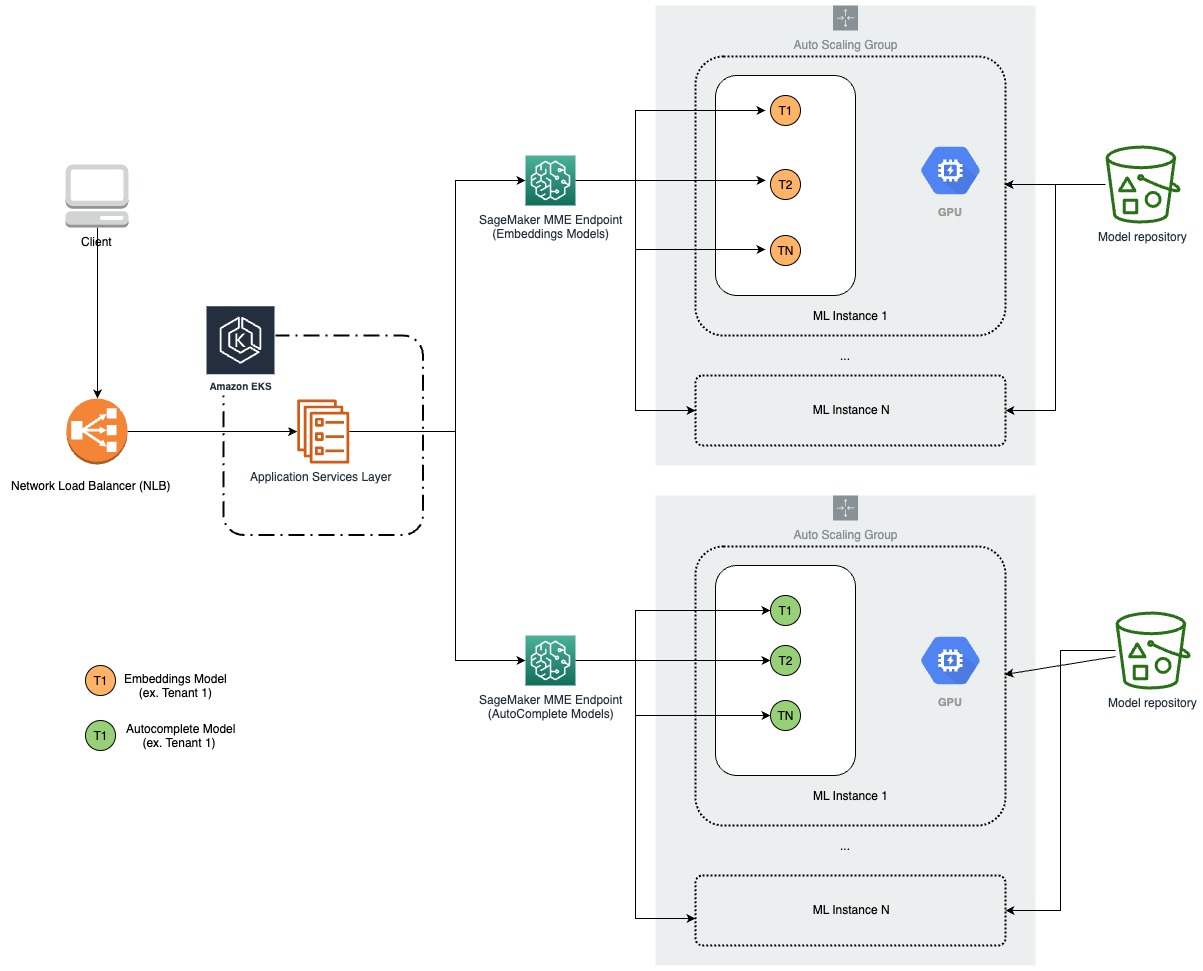

Az alábbi ábra szemlélteti örökölt architektúránkat.

A SageMaker MME-kre való migráció megkezdéséhez azonosítottuk az MME-k legjobb felhasználási eseteit, és hogy melyik modellünk profitálna a legtöbbet ebből a változásból. Az MME-k a legjobbak a következőkhöz:

- Olyan modellek, amelyek várakozási ideje alacsony, de kibírják a hidegindítási időt (első betöltéskor)

- Gyakran és következetesen hívott modellek

- Modellek, amelyek részleges GPU-erőforrást igényelnek

- Közös követelményeket és következtetési logikát használó modellek

A beágyazási modelljeinket és az automatikus kiegészítési nyelvi modelljeinket a migrációnk legjobb jelöltjeként határoztuk meg. Ahhoz, hogy ezeket a modelleket MME-k alá rendezhessük, modelltípusonként vagy feladatonként egy MME-t hozunk létre, egyet a beágyazási modelljeinkhez, egy másikat pedig az automatikus kiegészítési nyelvi modellekhez.

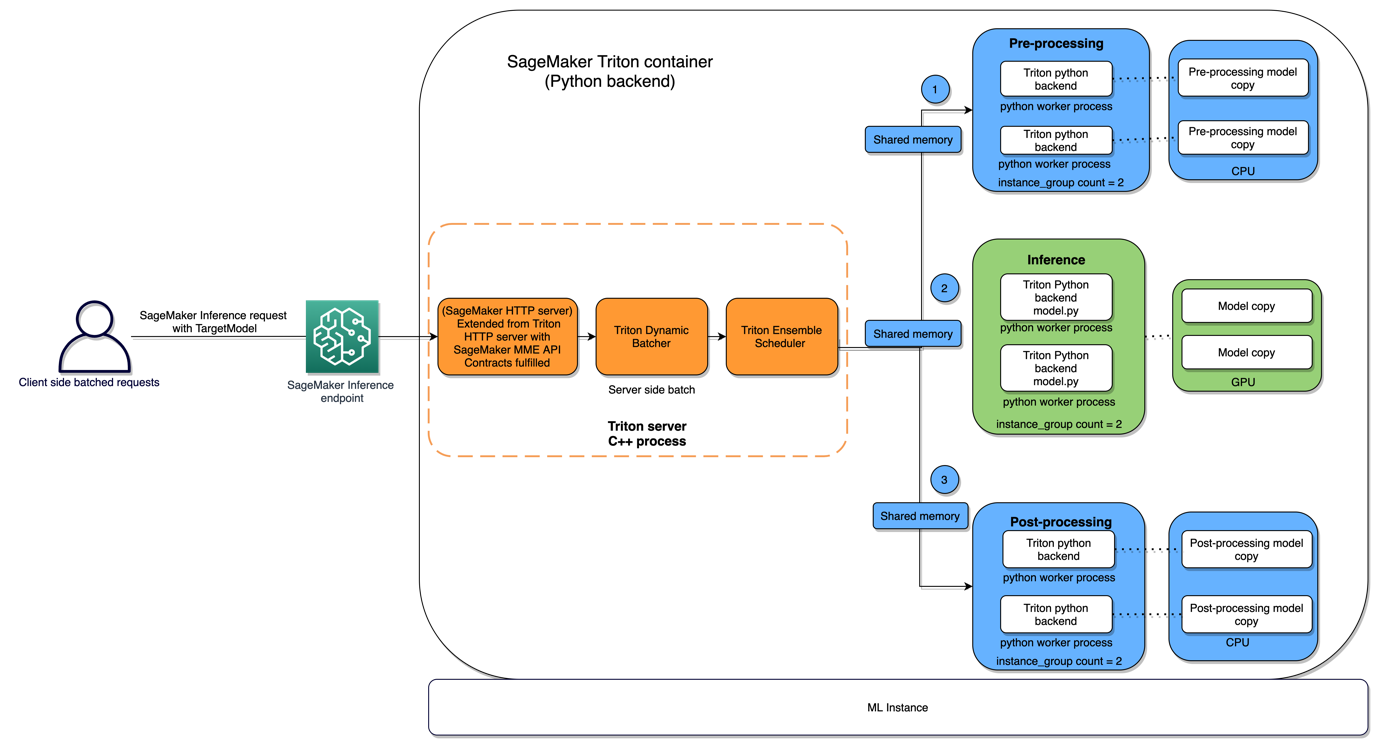

Már volt egy API réteg a modelljeink tetején a modellkezeléshez és a következtetésekhez. Feladatunk az volt, hogy a SageMakerrel átdolgozzuk, hogyan telepítette és kezeli a következtetéseket ez az API a burkolat alatt lévő modelleken, minimális változtatásokkal az ügyfelek és a termékcsapatok API-val való interakciójában. A modelljeinket és az egyéni következtetési logikát is csomagolnunk kellett, hogy kompatibilisek legyenek az NVIDIA Triton Inference Serverrel a SageMaker MME-k használatával.

Az alábbi ábra szemlélteti új architektúránkat.

Egyedi következtetési logika

A SageMakerre való átállás előtt a Forethought egyéni következtetési kódja (elő- és utófeldolgozás) futott az API-rétegben, amikor egy modellt meghívtak. A cél az volt, hogy ezt a funkcionalitást magába a modellbe vigyék át, hogy tisztázzák a felelősségek szétválasztását, modularizálják és egyszerűsítsék a kódjukat, és csökkentsék az API terhelését.

embeddings

A Forethought beágyazási modelljei két PyTorch-modell-műtermékből állnak, és a következtetési kérés határozza meg, hogy melyik modellt hívja meg. Minden modell előre feldolgozott szöveget igényel bemenetként. A fő kihívást egy előfeldolgozási lépés integrálása és két modellműtermék modelldefiníciónkénti elhelyezése jelentette. Annak érdekében, hogy a következtetési logikában több lépésre van szükség, a Forethought kifejlesztett egy Triton ensemble modellt, amely két lépésből áll: egy Python háttér-előfeldolgozási folyamatból és egy PyTorch háttérmodellhívásból. Az együttes modellek lehetővé teszik a lépések meghatározását és sorrendbe állítását a következtetési logikában, ahol minden lépést bármilyen háttértípusú Triton modell képvisel. A Triton PyTorch háttérrendszerrel való kompatibilitás biztosítása érdekében a meglévő modelltermékeket TorchScript formátumba konvertáltuk. Minden modelldefinícióhoz külön Triton modell készült, és a Forethought API rétege volt felelős a megfelelő meghatározásáért. TargetModel a bejövő kérés alapján hívni.

Automatikus kiegészítés

Az automatikus kiegészítési modellek (szekvenciától a szekvenciáig) eltérő követelményeket támasztottak. Pontosabban, lehetővé kellett tennünk, hogy több modellhíváson keresztül hurkolhassunk, és minden egyes híváshoz jelentős bemenetek gyorsítótárazhatók legyenek, mindezt alacsony késleltetés mellett. Ezenkívül ezek a modellek elő- és utófeldolgozási lépéseket is szükségessé tettek. E követelmények teljesítése és a kívánt rugalmasság elérése érdekében a Forethought automatikusan kiegészítõ MME-modelleket fejlesztett ki a Triton Python háttérrendszer felhasználásával, amely azt az elõnyt kínálja, hogy a modellt Python-kódként írja meg.

benchmarking

A Triton-modell alakzatainak meghatározása után modelleket telepítettünk a végpontok szakaszolására, és erőforrás- és teljesítmény-benchmarkingot végeztünk. Fő célunk az volt, hogy meghatározzuk a hidegindítási és a memórián belüli modellek késleltetését, valamint azt, hogy a várakozási időt hogyan befolyásolta a kérés mérete és egyidejűsége. Azt is tudni akartuk, hogy hány modell fér el az egyes példányokon, hány modell okozza a példányok méretezését az automatikus méretezési irányelvünkkel, és milyen gyorsan megy végbe a méretnövelés. A már használt példánytípusoknak megfelelően a teljesítményértékelést ml.g4dn.xlarge és ml.g4dn.2xlarge példányokkal végeztük.

Eredmények

Eredményeinket az alábbi táblázat foglalja össze.

| Méret kérése | Hidegindítási késleltetés | Gyorsítótárazott következtetési késleltetés | Egyidejű késleltetés (5 kérés) |

| Kicsi (30 token) | 12.7 másodperc | 0.03 másodperc | 0.12 másodperc |

| Közepes (250 token) | 12.7 másodperc | 0.05 másodperc | 0.12 másodperc |

| Nagy (550 token) | 12.7 másodperc | 0.13 másodperc | 0.12 másodperc |

Figyelemre méltó, hogy a hidegindítási kérelmek várakozási ideje lényegesen magasabb, mint a gyorsítótárazott következtetési kérések késése. Ennek az az oka, hogy a modellt lemezről, ill Amazon egyszerű tárolási szolgáltatás (Amazon S3) hidegindítási kérés esetén. Az egyidejű kérések várakozási ideje is magasabb, mint az egyedi kérések késése. Ennek az az oka, hogy a modellt meg kell osztani az egyidejű kérések között, ami vitához vezethet.

A következő táblázat összehasonlítja a régi modellek és a SageMaker modellek késleltetését.

| Méret kérése | Hagyományos modellek | SageMaker modellek |

| Kicsi (30 token) | 0.74 másodperc | 0.24 másodperc |

| Közepes (250 token) | 0.74 másodperc | 0.24 másodperc |

| Nagy (550 token) | 0.80 másodperc | 0.32 másodperc |

Összességében a SageMaker modellek jobb választás az automatikus kiegészítési modellek tárolására, mint a régi modellek. Alacsonyabb késleltetést, méretezhetőséget, megbízhatóságot és biztonságot kínálnak.

Készlet felhasználás

Annak érdekében, hogy meghatározzuk az egyes példányokhoz illeszkedő modellek optimális számát, tesztsorozatot végeztünk. Kísérletünk során modelleket töltöttünk be a végpontjainkba egy ml.g4dn.xlarge példánytípus használatával, automatikus skálázási szabályzat nélkül.

Ezek a konkrét példányok 15.5 GB memóriát kínálnak, és arra törekedtünk, hogy példányonként körülbelül 80%-os GPU-memóriahasználatot érjünk el. Figyelembe véve az egyes kódolómodell-termékek méretét, sikerült megtalálnunk az optimális számú Triton kódolót, amelyet egy példányra be kell tölteni, hogy elérjük a megcélzott GPU-memóriahasználatot. Továbbá, mivel mindegyik beágyazási modellünk két Triton kódolómodellnek felel meg, példányonként meghatározott számú beágyazási modellt tudtunk elhelyezni. Ennek eredményeként kiszámítottuk az összes beágyazási modellünk kiszolgálásához szükséges példányok teljes számát. Ez a kísérletezés kulcsfontosságú volt erőforrás-felhasználásunk optimalizálása és modelljeink hatékonyságának növelése szempontjából.

Hasonló teljesítményértékelést végeztünk az automatikus kiegészítési modelljeinknél. Ezek a modellek egyenként 292.0 MB körüliek voltak. Miközben teszteltük, hogy hány modell férne el egyetlen ml.g4dn.xlarge példányon, észrevettük, hogy csak négy modellt tudtunk elhelyezni, mielőtt a példányunk elkezdte volna kirakni a modelleket, annak ellenére, hogy a modellek kicsik voltak. Fő aggályaink a következők voltak:

- A CPU-memória kihasználtságának kiugró oka

- A modellek lemerülésének oka, amikor megpróbáltunk még egy modellt betölteni a legkevésbé használt (LRU) modell helyett

Sikerült meghatároznunk a memóriahasználati csúcs kiváltó okát, amely a CUDA futtatókörnyezetünk Python-modellünkben történő inicializálásából ered, ami szükséges volt ahhoz, hogy modelljeinket és adatainkat a GPU-eszközre és onnan lehessen mozgatni. A CUDA számos külső függőséget betölt a CPU memóriájába a futási környezet inicializálása során. Mivel a Triton PyTorch háttérrendszer kezeli és elvonatkoztatja a mozgó adatokat a GPU-eszközön és azon kívül, beágyazó modelljeink esetében nem ütköztünk ebbe a problémába. Ennek megoldására ml.g4dn.2xlarge példányokat próbáltunk használni, amelyekben ugyanannyi GPU-memória, de kétszer annyi CPU-memória volt. Ezenkívül számos kisebb optimalizálást adtunk a Python háttérkódunkhoz, beleértve a tenzorok használat utáni törlését, a gyorsítótár ürítését, a színátmenetek letiltását és a szemétgyűjtést. A nagyobb példánytípussal példányonként 10 modellt tudtunk elhelyezni, és a CPU és a GPU memóriahasználata sokkal jobban összehangolódott.

A következő diagram ezt az architektúrát szemlélteti.

Automatikus méretezés

Az automatikus skálázási szabályzatot mind a beágyazásainkhoz, mind az automatikus kiegészítõ MME-hez csatoltuk. A beágyazási végpontunkra vonatkozó irányelvünk 80%-os átlagos GPU-memóriakihasználást céloz meg egyéni mutatók használatával. Automatikusan kiegészített modelljeink munkaidőben nagy forgalommal, éjszaka pedig minimális forgalommal jellemezhetők. Emiatt létrehoztunk egy automatikus skálázási szabályzatot, amely alapján InvocationsPerInstance hogy a forgalmi mintáknak megfelelően méretezhessünk, költségmegtakarítást eredményezve a megbízhatóság feláldozása nélkül. Erőforrás-használati benchmarkingunk alapján a méretezési irányelveinket 225-ös céllal konfiguráltuk. InvocationsPerInstance.

Telepítse a logikát és a folyamatot

Az MME létrehozása a SageMakeren egyszerű, és hasonló a SageMaker bármely más végpontjának létrehozásához. A végpont létrehozása után további modellek hozzáadása a végponthoz olyan egyszerű, mint a modellműtermék mozgatása a végpont által megcélzott S3 útvonalra; ezen a ponton következtetési kéréseket tehetünk az új modellünkhöz.

Olyan logikát definiáltunk, amely beveszi a modell metaadatait, determinisztikusan formázza a végpontot a metaadatok alapján, és ellenőrzi, hogy a végpont létezik-e. Ha nem, akkor létrehozzuk a végpontot, és hozzáadjuk a Triton modell melléktermékét a végpont S3 javításához (szintén determinisztikusan formázott). Például, ha a modell metaadatai azt jelezték, hogy ez egy automatikus kiegészítési modell, akkor létrehoz egy végpontot az automatikusan kiegészített modellekhez, és egy kapcsolódó S3 útvonalat az automatikus kiegészítési modell melléktermékei számára. Ha a végpont létezne, a modell melléktermékét az S3 elérési útra másolnánk.

Most, hogy megvannak az MME-modelljeink modellformái és a modelljeink MME-be való üzembe helyezésének funkcionalitása, szükségünk volt egy módra a telepítés automatizálására. Felhasználóinknak meg kell adniuk, hogy melyik modellt kívánják telepíteni; mi kezeljük a modell csomagolását és telepítését. A modellhez csomagolt egyéni következtetési kód verziószáma megtörténik, és az Amazon S3-ra kerül; a csomagolási lépésben a megadott verziónak (vagy a legújabb verziónak) megfelelő következtetési kódot húzzuk le, és YAML fájlokat használunk, amelyek jelzik a Triton modellek fájlszerkezetét.

Az egyik követelmény számunkra az volt, hogy az összes MME-modellünket a memóriába töltsük be, hogy elkerüljük a hidegindítási késleltetést a termelési következtetési kérelmek modellekbe való betöltése során. Ennek eléréséhez elegendő erőforrást biztosítunk az összes modellünkhöz (az előző benchmarkingnak megfelelően), és óránkénti ütemben hívjuk meg az MME minden modelljét.

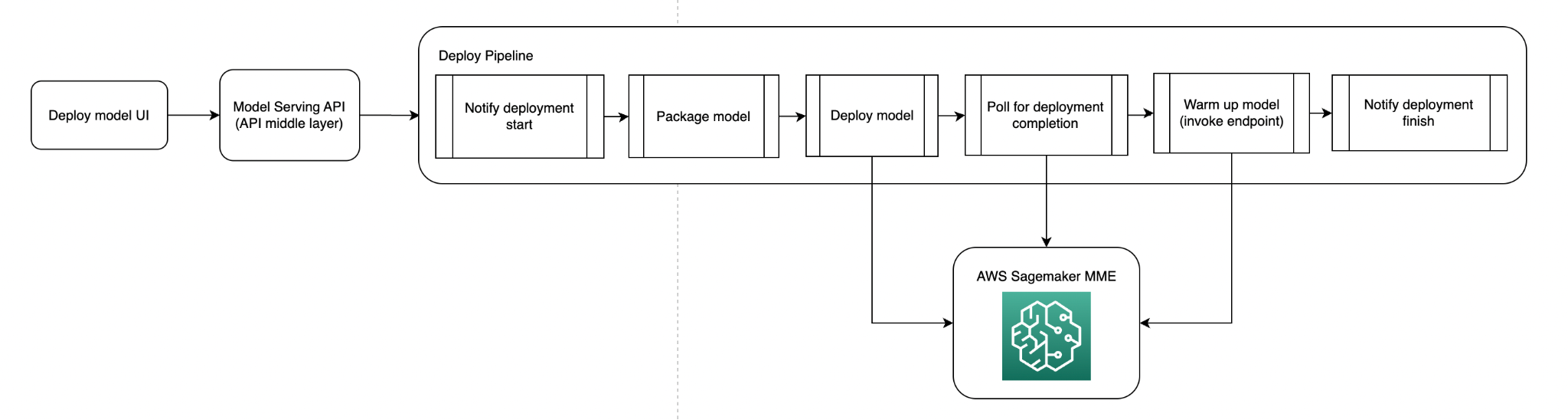

A következő diagram a modell telepítési folyamatát mutatja be.

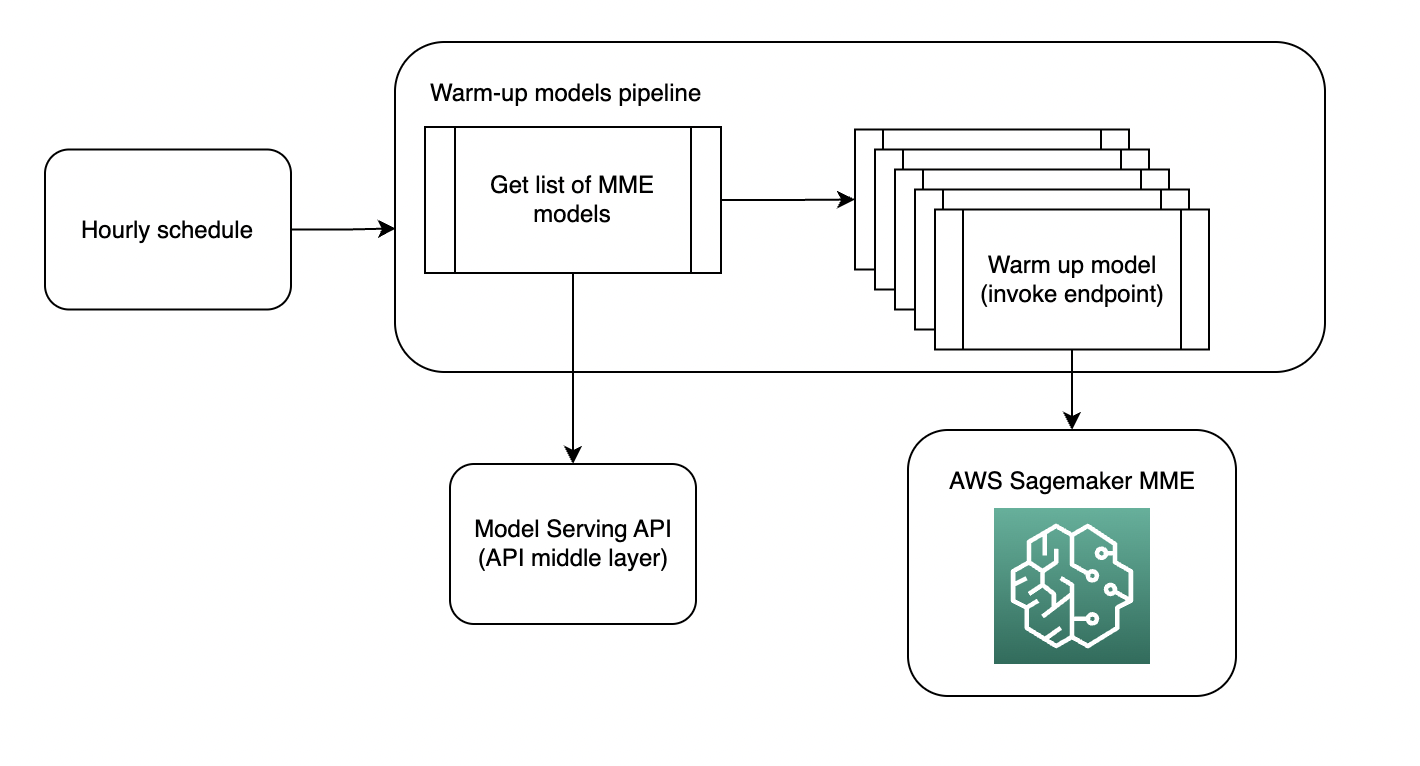

A következő ábra a bemelegítő csővezeték modelljét mutatja be.

Modellhívás

Meglévő API rétegünk absztrakciót biztosít a hívók számára, hogy következtetéseket vonhassanak le az összes ML modellünkről. Ez azt jelentette, hogy csak funkcionalitást kellett hozzáadnunk az API réteghez, hogy a következtetési kéréstől függően a megfelelő célmodellel hívhassuk meg a SageMaker MME-t, a hívókód módosítása nélkül. A SageMaker következtetési kód veszi a következtetési kérelmet, formázza a Triton modellekben definiált Triton bemeneteket, és meghívja az MME-ket a Boto3 segítségével.

Költséghaszon

A SageMaker MME-kre való átállásnak köszönhetően a Forethough jelentős lépéseket tett a modellek üzemeltetési költségeinek csökkentése és a modell OOM-hibáinak mérséklése terén. A változás előtt az Amazon EKS-ben futó ml.g4dn.xlarge példányok. Az MME-re való átállással rájöttünk, hogy példányonként 12 beágyazási modellt tud befogadni, miközben 80%-os GPU-memóriakihasználást ér el. Ez a havi kiadásaink jelentős csökkenéséhez vezetett. Perspektivikusan akár 80%-os költségmegtakarítást értünk el. Ezenkívül a nagyobb forgalom kezelése érdekében fontolóra vettük a replikák felnagyítását. Feltételezve egy olyan forgatókönyvet, amelyben három replikát alkalmazunk, azt találtuk, hogy költségmegtakarításunk még ilyen körülmények között is jelentős, 43% körül mozog.

A SageMaker MME-kkel való utazás pénzügyileg előnyösnek bizonyult, csökkentve kiadásainkat, miközben optimális modellteljesítményt biztosított. Korábban az automatikus kiegészítési nyelvi modelljeink az Amazon EKS-ben voltak üzembe helyezve, így a modellenkénti memóriafoglalás alapján változó számú ml.g4dn.xlarge példányra volt szükség. Ez jelentős havi költséget eredményezett. A SageMaker MME-kre való közelmúltbeli migrációnkkal azonban jelentősen csökkentettük ezeket a költségeket. Mostantól minden modellünket ml.g4dn.2xlarge példányokon tároljuk, ami lehetővé teszi a modellek hatékonyabb csomagolását. Ez jelentősen csökkentette a havi kiadásainkat, és mostanra 66–74%-os költségmegtakarítást értünk el. Ez a lépés bebizonyította, hogy a hatékony erőforrás-felhasználás milyen jelentős pénzügyi megtakarításokat eredményezhet a SageMaker MME-k használatával.

Következtetés

Ebben a bejegyzésben áttekintettük, hogy a Forethought hogyan használja a SageMaker többmodell végpontjait a valós idejű következtetés költségeinek csökkentése érdekében. A SageMaker vállalja a differenciálatlan nehézemelést, így a Forethought növelheti a mérnöki hatékonyságot. Lehetővé teszi továbbá a Forethought számára, hogy drámaian csökkentse a valós idejű következtetések költségeit, miközben fenntartja az üzleti szempontból kritikus műveletekhez szükséges teljesítményt. Ezáltal a Forethought hiperszemélyre szabott modellek segítségével differenciált ajánlatot tud nyújtani ügyfelei számára. Használja a SageMaker MME-t a modellek méretarányos tárolására, és a végpontok kihasználtságának javításával csökkenti a tárhely költségeit. Csökkenti a telepítési költségeket is, mivel az Amazon SageMaker kezeli a modellek betöltését a memóriába, és a végponthoz vezető forgalmi minták alapján méretezi azokat. Kódmintákat találhat több modell tárolására a SageMaker MME használatával GitHub.

A szerzőkről

Jad Chamoun a Forethought Core Engineering igazgatója. Csapata a platformtervezésre összpontosít, amely magában foglalja az adatmérnökséget, a gépi tanulási infrastruktúrát és a felhő infrastruktúrát. Megtalálhatod rajta LinkedIn.

Jad Chamoun a Forethought Core Engineering igazgatója. Csapata a platformtervezésre összpontosít, amely magában foglalja az adatmérnökséget, a gépi tanulási infrastruktúrát és a felhő infrastruktúrát. Megtalálhatod rajta LinkedIn.

Salina Wu a Forethought.ai idősebb gépi tanulási infrastruktúra mérnöke. Szorosan együttműködik a Machine Learning csapattal a teljes körű képzési, kiszolgálási és adatinfrastruktúrák kiépítésében és karbantartásában. Különösen az motiválja, hogy új módszereket vezet be a hatékonyság növelésére és a költségek csökkentésére az ML területen. Amikor nem dolgozik, Salina szeret szörfözni, agyagozni és a természetben lenni.

Salina Wu a Forethought.ai idősebb gépi tanulási infrastruktúra mérnöke. Szorosan együttműködik a Machine Learning csapattal a teljes körű képzési, kiszolgálási és adatinfrastruktúrák kiépítésében és karbantartásában. Különösen az motiválja, hogy új módszereket vezet be a hatékonyság növelésére és a költségek csökkentésére az ML területen. Amikor nem dolgozik, Salina szeret szörfözni, agyagozni és a természetben lenni.

James Parker az Amazon Web Services megoldástervezője. Együttműködik az Amazon.com-tal az AWS technológiai megoldások tervezésében, kiépítésében és üzembe helyezésében, és különösen érdeklődik az AI és a gépi tanulás iránt. Szabadidejében szívesen keres új kultúrákat, új tapasztalatokat, és naprakész marad a legújabb technológiai trendekkel. LinkedIn.

James Parker az Amazon Web Services megoldástervezője. Együttműködik az Amazon.com-tal az AWS technológiai megoldások tervezésében, kiépítésében és üzembe helyezésében, és különösen érdeklődik az AI és a gépi tanulás iránt. Szabadidejében szívesen keres új kultúrákat, új tapasztalatokat, és naprakész marad a legújabb technológiai trendekkel. LinkedIn.

Sunil Padmanabhan az AWS Startup Solutions építésze. Korábbi startup-alapítóként és technológiai igazgatóként szenvedélyesen rajong a gépi tanulásért, és arra összpontosít, hogy segítse az induló vállalkozásokat az AI/ML-nek az üzleti eredményeik hasznosításában, valamint az ML/AI-megoldások széles körű tervezésében és bevezetésében.

Sunil Padmanabhan az AWS Startup Solutions építésze. Korábbi startup-alapítóként és technológiai igazgatóként szenvedélyesen rajong a gépi tanulásért, és arra összpontosít, hogy segítse az induló vállalkozásokat az AI/ML-nek az üzleti eredményeik hasznosításában, valamint az ML/AI-megoldások széles körű tervezésében és bevezetésében.

Dhawal Patel az AWS vezető gépi tanulási építésze. Az elosztott számítástechnikával és a mesterséges intelligenciával kapcsolatos problémákon a nagyvállalatoktól a közepes méretű induló vállalkozásokig szervezetekkel dolgozott együtt. A mély tanulásra összpontosít, beleértve az NLP és a Computer Vision tartományokat. Segít az ügyfeleknek abban, hogy a SageMaker-en nagy teljesítményű modellkövetkeztetést érjenek el.

Dhawal Patel az AWS vezető gépi tanulási építésze. Az elosztott számítástechnikával és a mesterséges intelligenciával kapcsolatos problémákon a nagyvállalatoktól a közepes méretű induló vállalkozásokig szervezetekkel dolgozott együtt. A mély tanulásra összpontosít, beleértve az NLP és a Computer Vision tartományokat. Segít az ügyfeleknek abban, hogy a SageMaker-en nagy teljesítményű modellkövetkeztetést érjenek el.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- EVM Finance. Egységes felület a decentralizált pénzügyekhez. Hozzáférés itt.

- Quantum Media Group. IR/PR erősített. Hozzáférés itt.

- PlatoAiStream. Web3 adatintelligencia. Felerősített tudás. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/how-forethought-saves-over-66-in-costs-for-generative-ai-models-using-amazon-sagemaker/

- :van

- :is

- :nem

- :ahol

- $ UP

- 1

- 10

- 100

- 12

- 13

- 15%

- 24

- 250

- 30

- 32

- 7

- 80

- a

- képesség

- Képes

- Rólunk

- absztrakció

- absztraktokat

- felgyorsult

- Szerint

- pontosság

- pontos

- pontosan

- Elérése

- elért

- elérése

- át

- hozzá

- hozzáadott

- hozzáadásával

- mellett

- További

- Ezen kívül

- cím

- címzés

- fejlett

- Előny

- Után

- Ügynök

- szerek

- AI

- ai használati esetek

- AI / ML

- célzó

- összehangolása

- igazított

- Minden termék

- kiosztás

- lehetővé

- lehetővé teszi, hogy

- már

- Is

- Bár

- amazon

- Amazon SageMaker

- Az Amazon Web Services

- Amazon.com

- összeg

- an

- és a

- Évente

- Másik

- válaszok

- bármilyen

- api

- API-k

- látszólagos

- megfelelő

- körülbelül

- építészet

- VANNAK

- körül

- cikkek

- mesterséges

- mesterséges intelligencia

- AS

- segítséget nyújt

- társult

- At

- auto

- automatizált

- Automatizált

- automatikusan

- átlagos

- elkerülése érdekében

- el

- AWS

- háttér

- Egyenleg

- bázis

- alapján

- BE

- lett

- mert

- válik

- óta

- előtt

- kezdődik

- hogy

- benchmarking

- előnyös

- haszon

- BEST

- Jobb

- között

- fellendítése

- mindkét

- hoz

- épít

- beépített

- teher

- üzleti

- de

- by

- Gyorsítótár

- számított

- hívás

- hívott

- hívás

- kéri

- TUD

- jelöltek

- képességek

- eset

- esetek

- kiszolgál

- Okoz

- kihívás

- kihívások

- változik

- Változások

- ellenőrizze

- választás

- választotta

- ügyfél részére

- szorosan

- felhő

- felhő infrastruktúra

- kód

- hideg

- Gyűjtő

- COM

- érkező

- Közös

- Társaságé

- képest

- kompatibilitás

- összeegyeztethető

- számítógép

- Számítógépes látás

- számítástechnika

- aggodalmak

- egyidejű

- Körülmények

- lefolytatott

- konfigurálva

- konzervatív

- tekintélyes

- figyelembe vett

- figyelembe véve

- Konténer

- tartalom

- átalakított

- Mag

- kijavítására

- megfelel

- Költség

- költségmegtakarítás

- költséghatékony

- drága

- kiadások

- tudott

- fedő

- teremt

- készítette

- létrehozása

- kritikus

- CTO

- szokás

- vevő

- ügyféladatok

- Vevői elégedettség

- Vevőszolgálat

- Vevőszolgálat

- Ügyfelek

- szabott

- dátum

- találka

- Elutasítása

- csökkenés

- mély

- mély tanulás

- meghatározott

- meghatározó

- szállít

- átadó

- igazolták

- attól

- telepíteni

- telepített

- bevezetéséhez

- bevetés

- bevetések

- Design

- kívánatos

- Ellenére

- Határozzuk meg

- eltökélt

- meghatározza

- meghatározó

- fejlett

- fejlesztők

- eszköz

- DID

- különböző

- differenciált

- Igazgató

- felfedezett

- különböző

- megosztott

- elosztott számítástechnika

- Ennek

- domain

- domainek

- ne

- drámaian

- alatt

- dinamikus

- dinamikusan

- minden

- hatékonyság

- hatékony

- eredményesen

- beágyazás

- lehetővé

- lehetővé teszi

- végtől végig

- Endpoint

- vonzó

- mérnök

- Mérnöki

- növelése

- fokozása

- elég

- biztosítására

- biztosítása

- Vállalatok

- Környezet

- hibák

- Még

- Minden

- példa

- létező

- várható

- költségek

- drága

- tapasztalat

- Tapasztalatok

- kísérlet

- külső

- gyorsabb

- filé

- Fájlok

- kitöltése

- pénzügyi

- pénzügyileg

- Találjon

- vezetéknév

- megfelelő

- FLOTTA

- Rugalmasság

- koncentrál

- következő

- A

- formátum

- Korábbi

- talált

- alapító

- négy

- ból ből

- teljesen

- funkcionalitás

- további

- Továbbá

- rések

- generál

- generált

- nemző

- Generatív AI

- szerzés

- gif

- adott

- Giving

- cél

- GPU

- GPU

- színátmenetek

- kellett

- kéz

- fogantyú

- Fogantyúk

- Kezelés

- történik

- hardver

- Legyen

- tekintettel

- he

- nehéz

- súlyemelés

- segít

- segít

- segít

- Magas

- nagy teljesítményű

- <p></p>

- őt

- övé

- motorháztető

- vendéglátó

- tárhely

- hosting költségek

- NYITVATARTÁS

- Ház

- Hogyan

- azonban

- HTML

- http

- HTTPS

- Több száz

- azonosított

- if

- illusztrálja

- azonnal

- javul

- javuló

- in

- Inc.

- Beleértve

- Bejövő

- Növelje

- jelez

- jelzett

- információ

- Infrastruktúra

- infrastruktúrák

- újító

- bemenet

- bemenet

- példa

- helyette

- integrálása

- integráció

- Intelligencia

- kölcsönhatás

- kölcsönhatások

- kamat

- bele

- bevezetéséről

- hivatkozni

- behívja

- részt

- kérdés

- IT

- ITS

- maga

- utazás

- jpg

- éppen

- tartás

- Kulcs

- Ismer

- tudás

- nyelv

- nagy

- Nagy vállalkozások

- nagyobb

- Késleltetés

- legutolsó

- réteg

- vezet

- vezető

- tanulás

- legkevésbé

- Led

- Örökség

- kevesebb

- Tőkeáttétel

- kihasználja

- emelő

- kiszámításának

- betöltés

- terhelések

- logika

- Elő/Utó

- alacsonyabb

- gép

- gépi tanulás

- készült

- Fő

- fenntartása

- fenntartása

- csinál

- kezelése

- sikerült

- vezetés

- kezeli

- kezelése

- sok

- piacára

- maximalizálása

- jelentett

- Memory design

- Metaadatok

- Metrics

- vándorló

- elvándorlás

- millió

- minimális

- kisebb

- enyhítő

- ML

- modell

- modellek

- monitor

- havi

- több

- Ráadásul

- a legtöbb

- motivált

- mozog

- mozgó

- sok

- Többmodell végpont

- többszörös

- kell

- bennszülött

- Természet

- elengedhetetlen

- Szükség

- szükséges

- igények

- Új

- NLP

- Most

- szám

- Nvidia

- célkitűzés

- of

- kedvezmény

- ajánlat

- felajánlás

- Ajánlatok

- gyakran

- on

- egyszer

- ONE

- csak

- Művelet

- Alkalom

- optimálisan

- optimalizálása

- or

- érdekében

- szervezetek

- Más

- mi

- magunkat

- ki

- eredmények

- felett

- éjszakai

- Csomag

- csomag

- becsomagolt

- csomagolás

- különös

- különösen

- szenvedélyes

- Tapasz

- ösvény

- Mintás

- minták

- teljesítmény

- perspektíva

- csővezeték

- emelvény

- Plató

- Platón adatintelligencia

- PlatoData

- pont

- Politikák

- politika

- állás

- hatalom

- powered

- bemutatott

- előző

- korábban

- elsődleges

- Fő

- Előzetes

- problémák

- folyamat

- feldolgozás

- Termékek

- Termelés

- termelékenység

- megfelelő

- igazolt

- ad

- feltéve,

- biztosít

- ellátás

- meglökött

- tesz

- Piton

- pytorch

- világítás

- lekérdezések

- keresés

- gyorsan

- hatótávolság

- kezdve

- Ranking

- el

- real-time

- realizált

- új

- nemrég

- csökkenteni

- csökkenti

- csökkentő

- összefüggő

- relevancia

- megbízhatóság

- megbízható

- maradványok

- képviselők

- kérni

- kéri

- kötelező

- követelmény

- követelmények

- megköveteli,

- forrás

- Tudástár

- válaszok

- felelősség

- felelős

- eredményez

- kapott

- Eredmények

- felül

- jobb

- merev

- gyökér

- futás

- futás

- feláldozása

- sagemaker

- SageMaker következtetés

- azonos

- elégedettség

- Megtakarítás

- megtakarítás

- Megtakarítás

- látta

- skálázhatóság

- skálázható

- Skála

- felkerekítés, fokozás

- Mérleg

- skálázás

- forgatókönyv

- forgatókönyvek

- tudósok

- Keresés

- biztonság

- keres

- idősebb

- különálló

- Sorozat

- Series of

- szolgál

- szolgáltatás

- Szolgáltatások

- szolgáló

- készlet

- számos

- árnyék

- formák

- Megosztás

- megosztott

- ő

- jelentős

- jelentősen

- hasonló

- Egyszerű

- egyszerűsítése

- egyetlen

- Méret

- kicsi

- okos

- So

- megoldások

- Megoldások

- SOLVE

- néhány

- Hely

- különleges

- kifejezetten

- meghatározott

- tüske

- színpadra állítás

- kezdet

- kezdődött

- indítás

- Startups

- csúcs-

- Lépés

- Lépései

- Még mindig

- tárolás

- egyértelmű

- léptekkel

- lényeges

- ilyen

- kíséret

- támogatás

- Systems

- táblázat

- felszerelés

- szabott

- Vesz

- tart

- cél

- célzott

- célok

- Feladat

- csapat

- csapat

- Technologies

- Technológia

- kipróbált

- tesztek

- mint

- Kösz

- hogy

- A

- azok

- Őket

- Ezek

- ők

- ezt

- három

- Keresztül

- jegyek

- idő

- időigényes

- nak nek

- tokenek

- felső

- Végösszeg

- forgalom

- Vonat

- kiképzett

- Képzések

- átruházás

- Átalakítás

- átmenet

- Trends

- kipróbált

- Triton

- Kétszer

- kettő

- típus

- típusok

- alatt

- egyedi

- us

- Használat

- használ

- használati eset

- használt

- Felhasználók

- használ

- segítségével

- kihasználva

- változat

- nagyon

- látomás

- vs

- akar

- kívánatos

- volt

- Út..

- módon

- we

- háló

- webes szolgáltatások

- voltak

- amikor

- vajon

- ami

- míg

- val vel

- nélkül

- Munka

- dolgozott

- művek

- aggódik

- lenne

- írás

- wu

- yaml

- te

- A te

- zephyrnet